Область техники, к которой относится изобретение

Изобретение относится к системе записи данных изображений, способу записи данных изображений и к камере для записи данных изображений.

Уровень техники

В последнее время значительно усилился интерес к представлению 3-мерных изображений на 3-мерных дисплеях. Полагают, что 3-мерная визуализация станет, после цветной визуализации, следующим значительным нововведением в области визуализации. Авторы настоящего изобретения собираются на данный момент представить 3-мерные дисплеи на потребительском рынке.

Устройство 3-мерного дисплея, обычно, содержит дисплейный экран, на который выводятся изображения. По существу, трехмерное восприятие можно создавать с использованием стереоизображений, т.е. двух немного отличающихся изображений, адресованных двум глазам наблюдателя. Примером данного устройства является автостереоскопический дисплей. В других устройствах изображения передаются во всех направлениях и применяются очки для блокирования некоторых изображений, чтобы обеспечить 3-мерное восприятие.

Независимо от типа применяемого 3-мерного дисплея, в дисплейное устройство должна представляться информация, относящаяся к 3-мерному изображению. Обычно упомянутая информация представляется в форме сигнала 3-мерного изображения, содержащего цифровые данные.

Формирование 3-мерных изображений обычно выполняется посредством добавления карты глубины, при этом упомянутая карта глубины предоставляет информацию о глубине пикселя в изображении и, тем самым, обеспечивает 3-мерную информацию. При использовании карты глубины для изображения можно построить левое и правое изображения, обеспечивающие 3-мерное изображение.

Восстановление 3-мерной информации по изображениям является одной из фундаментальных задач, относящихся к 3-мерной визуализации. Наиболее общий способ вычисления карты глубины состоит в использовании стереоскопического зрения. Хотя в стереоскопическом зрении достигнут значительный прогресс, фундаментальную проблему согласования по-прежнему сложно решать в реальных прикладных устройствах. В частности, требование к сверхточному совмещению двух камер препятствует созданию дешевых потребительских устройств.

Ранее предлагались способы извлечения 3-мерной информации из одного изображения. Один из данных способов заключается, например, в применении принципа «глубина по дефокусировке». В данном способе используют вариообъектив для развертывания фокальной плоскости по сцене и для определения, в каком местоположении фокусировки наиболее четко наблюдается каждый объект. Однако, хотя данный способ может удовлетворительно срабатывать для одного изображения, для видеоизображений, на которых объекты перемещаются, описанный подход становится очень сложным. Использование вариообъектива, при одновременной записи видеоизображений с изменяющимся информационным содержанием, представляет очень сложную задачу, требующую быстродействующих вариообъективов и большой вычислительной мощности. Кроме того, упомянутый способ нельзя применить в известной камере, если камера не содержит вариообъектив с необходимыми скоростью и границами изменения фокуса.

Другой способ состоит в использовании, так называемого, принципа измерения времени распространения волн (ToF). Свет модулируется и направляется к объекту, и камера измеряет временную задержку между направленным и полученным светом. Так как свет распространяется с постоянной скоростью c, то данным способом можно измерять расстояния. Компании 3DV Systems, Mesa Imaging и Canesta разработали камеры на основе технологий ToF. Однако упомянутые камеры обычно дорого стоят и имеют ограниченную пространственную разрешающую способность (например, 64×64 для датчика Canesta). Кроме того, упомянутые технологии не применимы или очень сложны для применения к известным камерам. На небольших расстояниях из-за короткого времени распространения волн измерение становится совсем сложным. Другие системы записывают одной камерой, поочередно, левое и правое изображения с использованием затворов для блокирования одного из изображений.

Поочередная запись левого и правого изображений эффективна при статических объектах, но имеет недостаток, заключающийся в том, что для подвижных объектов левое и правое изображения не являются одинаковыми, так как объекты смещаются между съемками изображений. В таком случае различие между местоположениями объекта на левом и правом изображениях зависит от расстояния между объективом и объектом, а также от перемещения объекта. Для точного определения расстояния требуется выполнить точную оценку движения, а также стереоскопическое совмещение. Оба параметра, расстояние, а также движение неизвестны априори, а также будут иметь неизвестный характер изменения во времени. До появления возможности точной оценки движения требуется несколько кадров. В таких обстоятельствах, как перемещение с большой скоростью или неупорядоченное движение подвижных периодически повторяющихся структур или объектов, точная оценка движения почти невозможна.

Следует отметить, что в патенте США 6807295 приведено описание системы, в которой за объективом обеспечена маска с двумя небольшими отверстиями, пропускающими свет от разных частей входного объектива. Обеспечение отверстий в маске за объективом обеспечивает, для изображений, которые находятся не в фокусе, разные пятна для объекта. Расстояние между пятнами расфокусировки равно нулю для объектов, которые находятся в фокусе, и увеличивается по мере того, как объекты становятся менее сфокусированными. Данная конструкция с трудом применима к существующим камерам.

Поэтому существует потребность в системе, основанной на одной камере, которая способна относительно простым способом обеспечивать 3-мерную информацию и может быть применена для существующих камер, и для которой смягчаются вышеописанные проблемы.

Раскрытие изобретения

С приведенной целью способ, система и камера в соответствии с изобретением отличаются тем, что перед объективом и датчиком изображений для записи изображения обеспечивают оптическое устройство для формирования составного изображения на датчике, содержащего два или более наложенных, одновременно полученных изображений одного и того же объекта, при этом расстояние между соответствующими объектами на общем датчике изображений в составном изображении зависит от расстояния упомянутого изображенного объекта от объектива, причем два или более наложенных изображений отображают на общем датчике изображений посредством общего объектива и составное изображение анализируют для определения пространственного расстояния между соответствующими объектами в составном изображении на датчике.

Авторы настоящего изобретения пришли к пониманию, что при применении оптического устройства, которое создает составное изображение, т.е. изображение, содержащее одновременно полученные левое и правое (или полученные с большего числа направлений) изображения, можно определить расстояние записанного объекта до объектива и, тем самым, создать карту глубины для записанного изображения. При этом отсутствует потребность в двух камерах, и, следовательно, не возникает потребности в точном совмещении камер. Изображения получают одновременно, и, следовательно, исключаются проблемы со сдвигом подвижных объектов, обусловленным движением объектов между моментами времени, когда получают левое и правое изображения. Анализ составного изображения позволяет, например, посредством обратной свертки составного изображения, получить два или более одновременно полученных составляющих изображений составного изображения. Приведенный подход позволяет определить расстояние в пикселях или в сантиметрах между соответствующими объектами в записанном составном изображении. Затем расстояние в составном изображении можно легко преобразовать в расстояние до объектива, так как первое определяется только вторым расстоянием.

Существует много оптических устройств, которые создают двойное изображение, например:

- Дифракционная решетка. Дифракционные решетки создают путем дифракции, рядом с основным изображением боковые изображения объектов в плоскости записи. Расстояние между объектами в основном изображении и в боковых изображениях непосредственно зависит от расстояния до объектива. Кроме упомянутой зависимости упомянутое расстояние зависит также от длины волны света. Приведенный вариант осуществления очень полезен при использовании света с известной длиной волны или почти монохроматического света, так как данные условия упрощают расчеты.

- Двоякопреломляющая пластина. Двоякопреломляющие пластины можно применять для создания двух изображений, в зависимости от поляризации света. Между двумя оптическими осями изображений существует небольшой угол, и, следовательно, расстояние между объектами в плоскости записи зависит от их расстояния от общего объектива. Преимущество устройства данного типа, в сравнении с применением дифракционной решетки, состоит в отсутствии или только умеренной зависимости от длины волны света.

- Призменная схема. При использовании призменной схемы можно создать два или более изображений одного и того же объекта, которые разделены некоторым расстоянием. Преимущество устройства данного типа состоит в отсутствии или только умеренной зависимости от длины волны света.

- Конфигурация, содержащая зеркало и делитель пучка для создания первого ракурса и второго ракурса. Угол, под которым два ракурса ориентированы к объектам изображения, различается. Преимущество устройства данного типа состоит в том, что данное устройство совершенно или почти не зависит от длины волны света.

- Конфигурация из двух зеркал, по меньшей мере одно из которых имеет две отражающие поверхности, расположенные на некотором расстоянии одна от другой. Преимущество устройства данного типа состоит в том, что данное устройство совершенно или почти не зависит от длины волны света.

В основном существуют два основных типа:

В устройствах одного типа, например, с дифракционной решеткой, свет приходит от точки объекта в двух или более направлениях и попадает на датчик в разных местоположениях. Тем самым, единственный ракурс делится на два или более изображений, при этом расстояние между изображениями на датчике является показателем расстояния от объекта до объектива или датчика.

В устройствах другого типа, например, в конфигурации с зеркалом и делителем пучка, свет приходит из двух разных местоположений, разделенных некоторой базой, но в одном направлении. В составном изображении на датчике записываются два немного разных ракурса.

В сравнении с устройством первого типа, устройство последнего типа обладает преимуществом в том, что дает некоторую возможность видеть что-то позади объекта на переднем плане, так как использует два изображения с немного разными точками наблюдения.

Два разных типа устройств характеризуются разными взаимосвязями между расстоянием до датчика и расстоянием между соответствующими изображениями на датчике.

Основная идея настоящего изобретения состоит в создании, с использованием оптического устройства, установленного перед камерой составного изображения, содержащего два или более изображений одних и тех же объектов на датчике изображений, при этом два или более изображений составного изображения получают одновременно, причем составляющие изображения пространственно сдвинуты одно относительно другого в записанном составном изображении и пространственный сдвиг зависит от расстояния объекта до камеры.

Затем записанное изображение анализируют для определения расстояний на датчике, и тогда можно вычислить расстояние от объекта до камеры. Данный подход позволяет построить карту глубины.

В предпочтительных вариантах осуществления анализ проводят далее с выполнением дополнительного этапа, на котором реконструируют одно из составляющих изображений из записанного составного изображения. Реконструкция позволяет пользователю наблюдать изображение, что привычно для пользователя.

Вкратце, программное обеспечение выполняет следующую задачу:

- Оценивает смещение между двумя или более составляющими изображениями, обусловленное механизмом дифракции (для дифракционной решетки) или сдвигом (для зеркала и делителя пучка),

- вычисляет карту глубины по упомянутому смещению и по желанию,

- реконструирует неискаженное изображение на основании полученной карты глубины.

В некоторых вариантах осуществления реконструированное изображение представляют на дисплее системы или камеры, при этом карту глубины также можно сделать видимой, или, в одном варианте осуществления, можно представлять изображение, которое объединяет два изображения в одно изображение. В альтернативном варианте осуществления, если камера содержит средство для стереоскопического зрения, то можно отображать стереоизображение.

В вариантах осуществления, в которых видеоинформация записывается по кадрам, система и камера в соответствии с некоторыми вариантами осуществления изобретения выполнены с возможностью посредством управления работой оптического устройства записывать ряд кадров, содержащих ряд простых изображений и ряд составных изображений.

Если одно изображение, т.е. несоставное изображение, известно, то информация, полученная по простому изображению, допускает сравнительно простое выделение составляющих изображений из составного изображения и/или сравнительно надежную проверку результатов, и/или сравнительно простую реконструкцию одного из составляющих изображений. По существу, изобретение состоит в том, что, когда получают составные изображения, то:

1) составляющие изображения получают одновременно;

2) изображения записывают на один и тот же датчик.

Первый признак, т.е. одновременная запись составляющих изображений, исключает любую проблему сдвига местоположения объектов вследствие движения объекта между моментами времени получения составляющих изображений.

Второй признак исключает любую проблему, обусловленную неопределенностью совмещения датчика или различиями между датчиками. В предпочтительном варианте осуществления составляющие изображения также получают посредством одного и того же объектива для исключения любых проблем совмещения объективов.

В предпочтительном варианте осуществления составляющие изображения различаются либо по интенсивности, либо по цвету информационного содержания, при этом различие является сравнительно небольшим. Если два изображения имеют одинаковое информационное содержание, то обратная свертка составного изображения усложняется.

Краткое описание чертежей

Приведенные и дополнительные аспекты изобретения подробно поясняются ниже на примерах и со ссылками на прилагаемые чертежи, на которых:

Фиг.1 иллюстрирует стандартный способ записи электронных данных изображений.

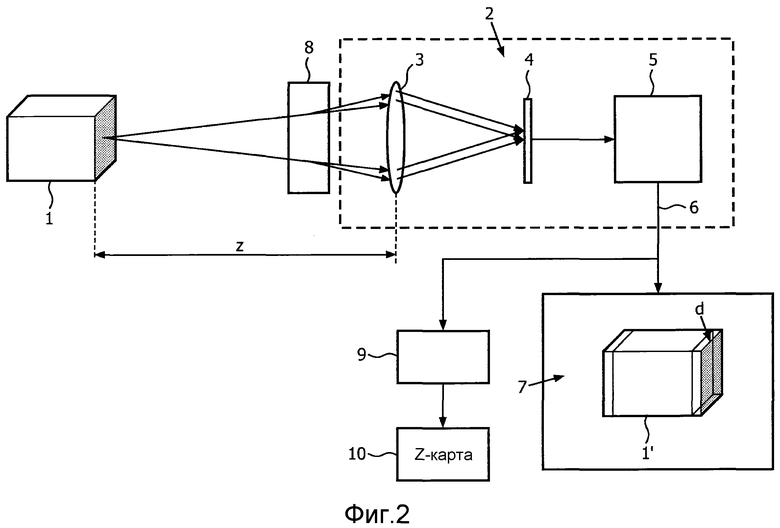

Фиг.2 иллюстрирует способ, систему и камеру в соответствии с изобретением.

Фиг.3 иллюстрирует вариант осуществления с использованием дифракционной решетки перед объективом.

Фиг.4 иллюстрирует взаимосвязь между периодом d дифракционной решетки, расстоянием до объектива и расстоянием между составляющими изображениями в составном изображении.

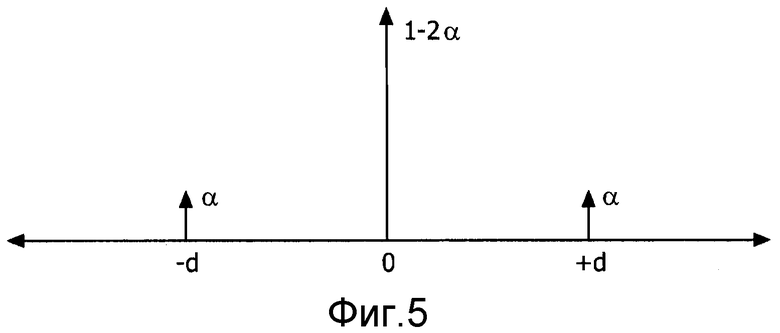

Фиг.5 иллюстрирует интенсивности дифракционных картин.

Фиг.6 иллюстрирует взаимосвязь между расстоянием в пикселях между соответствующими изображениями на датчике и расстоянием до датчика.

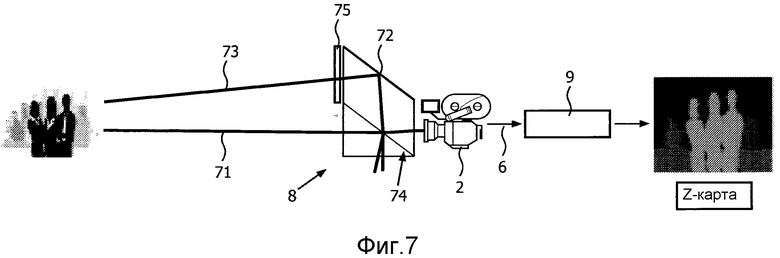

Фиг.7 иллюстрирует второй вариант осуществления, в котором применена конструкция, содержащая зеркало и делитель пучка.

Фиг.8 иллюстрирует взаимосвязь между расстоянием в пикселях между соответствующими изображениями на датчике и расстоянием до датчика.

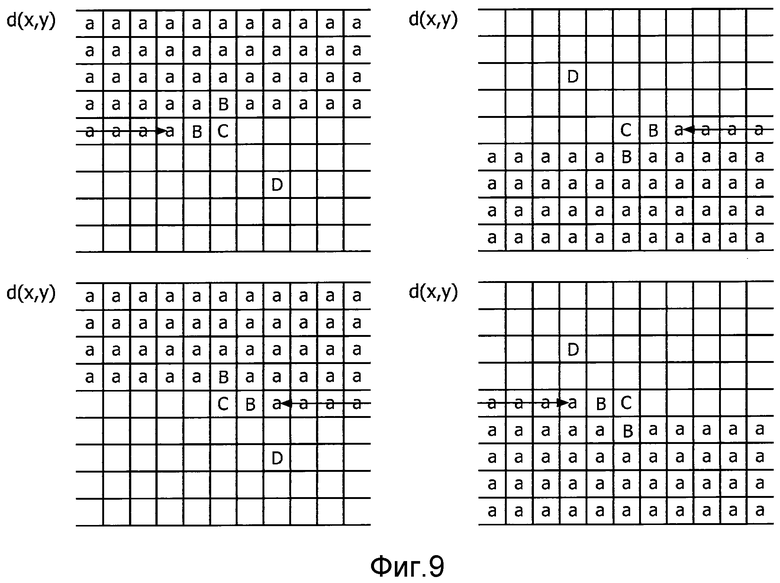

Фиг.9 иллюстрирует способ определения по составному изображению пространственных расстояний между соответствующими объектами.

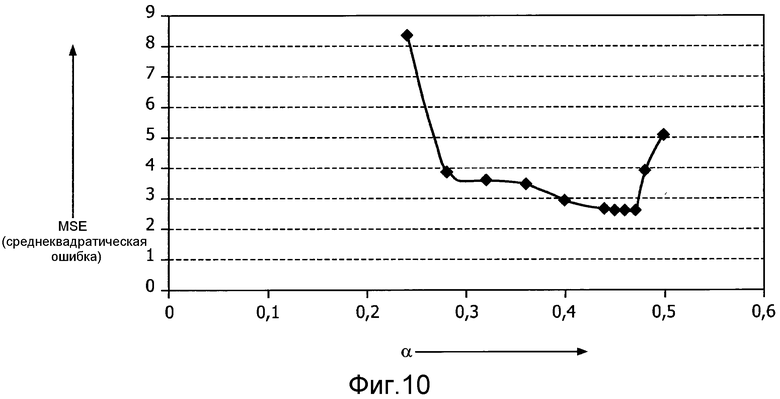

Фиг.10 иллюстрирует показатель качества определенных расстояний.

Чертежи построены не в масштабе. Как правило, идентичные компоненты на чертежах обозначены одинаковыми позициями.

Осуществление изобретения

На фиг.1 схематично показаны система, способ и камера для записи изображений.

Объект 1 снимают с использованием объектива 3 камеры 2. Изображение фокусируется на датчике 4, например, ПЗС (приборе с зарядовой связью). Данное устройство формирует сигнал, который преобразуется в сигнал 6 посредством кодера 5. Кодер 5 может выполнять некоторое повышение качества изображения или улучшение сигнала изображения.

Сигнал может передаваться либо в кодированной форме, либо непосредственно, в дисплейное устройство, содержащее дисплей 7, на котором можно наблюдать изображение 1'. Сигнал 6 можно также сохранять на носителе данных некоторого типа.

На фиг.2 схематично показаны система, способ и камера для записи данных изображений в соответствии с изобретением.

Перед линзой установлено оптическое устройство 8. Оптическое устройство может быть расположено на некотором расстоянии от камеры или прикреплено к камере. Оптическое устройство создает два или более наложенных изображений на датчике. На дисплее 7 можно будет видеть два или более составляющих изображений, немного сдвинутых относительно друг друга. Сдвиг d является показателем расстояния z объекта до объектива. Составляющие изображения записывают одновременно. Сигнал 6 составного изображения передается в анализатор 9, который анализирует изображение для определения расстояний d между объектами в составном изображении и вычисляет z-карту 10 для изображения по расстояниям d. Упомянутый анализатор может быть частью системы, устройства и камеры для непосредственного определения z-карты. В альтернативном варианте сигнал для составного изображения может передаваться в отдельный анализатор для определения z-карты. Например, камера может записывать изображение, и сигнал передается по сети Интернет в анализатор, связанный с Интернет-сайтом. Сигнал 6 можно также сначала сохранять на электронном носителе данных и, затем, передавать в анализатор для анализа.

На фиг.3 изображен вариант осуществления изобретения, в котором оптическое устройство 8, в приведенном примере - дифракционная решетка, расположено перед линзой. Дифракционная решетка 8 создает, посредством дифракции, не только одно прямое изображение R, т.е. обычное стандартное изображение, на датчике, но также несколько дифракционных изображений V1 и V2 более высокого порядка на датчике. Следовательно, изображение, представленное в виде данных, содержит не только прямое изображение, но также и два боковых изображения V1' и V2' Для простоты упомянутые боковые изображения будут называться «повторными изображениями» V1 и V2, соответственно. Расстояние d между прямым изображением R и повторными изображениями V1 и V2 можно выразить в виде функции длины волны света и расстояния от объекта до датчика. В дальнейшем прямое изображение называется также реальным объектом, а повторные изображения называются виртуальными объектами.

Приведенные выше положения поясняются на фиг.4, схематично изображающей главную ось 1-го дифракционного изображения, приводящего к смещению d. Датчик 4, объектив 3, дифракционная решетка 8 и объект 1 находятся, соответственно, в местоположении 0 (нуль), местоположении L, местоположении G и местоположении O объекта.

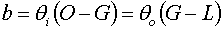

После того, как получено качественное представление о получении результата, можно вывести количественные взаимосвязи. На основании схемы, изображенной на фиг.4, можно получить зависимость расстояния между реальным объектом и виртуальным объектом на датчике (которое называется смещением d) от расстояния b (между оптической осью и точкой отклонения дифракционной решетки):

Кроме того, перемену угла на дифракционной решетке можно описать уравнением дифракционной решетки:

где dgrating означает период дифракционной решетки, λ означает длину волны света, и n=1 означает дифракционный порядок. Для небольших углов упомянутое уравнение можно аппроксимировать следующим уравнением:

Затем можно вычислить b в виде (в малоугловом (параксиальном) приближении):

Решение данного уравнения относительно b дает:

Данную формулу можно использовать для вычисления смещения d:

И наоборот, расстояние объекта О, когда смещение d измерено:

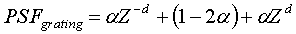

Данный вариант осуществления является примером первого типа оптического устройства, в котором свет от одной точки объекта распространяется в разных направлениях. Поскольку d измеряют, L и G известны и θgrating известно для n=1 и для данной длины волны, то расстояние О объекта можно вычислить по измеренному d. Для простоты можно применить дифракционную решетку только с дифракционными порядками -1, 0, +1; в более сложных конструкциях можно применить более высокие порядки дифракции. Кроме того, можно изготавливать дифракционные решетки, в которых дифракционные порядки усилены, например, для направления более интенсивного излучения в первый порядок дифракционной картины. Дифракционную решетку с дифракционными порядками, в основном, -1, 0, 1 можно получить, например, с использованием фазовой дифракционной решетки с 50% коэффициентом заполнения, и коэффициент дифракции альфа непосредственно зависит от глубины травления. В данном случае способ формирования изображения можно рассматривать как простую свертку исходного изображения (без дифракционной решетки) с функцией рассеяния точки (PSF), которая имеет сильный максимум 1-2α в середине и ослабленные максимумы с интенсивностью α с характерными координатами, которые соответствуют дифракционным порядкам, показанным на Фиг.5. Мощность второстепенных максимумов, т.е. α, можно подбирать в увязке с конструкцией дифракционной решетки и требуется измерить только один раз.

Входной сигнал F(x) обеспечивает дифракционный сигнал

Приведенную функцию рассеяния точки (PSF) можно математически записать в Z-области (или Фурье-пространстве) в виде:

Для получения карты глубины по полученному составному изображению следует оценить смещение d части изображения и вычислить из уравнения смещения соответствующее расстояние O объекта.

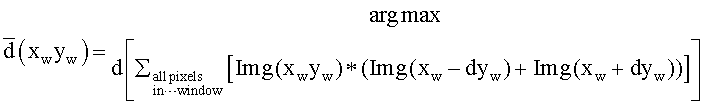

Из литературных данных известны различные существующие способы оценки, а авторы настоящего изобретения с успехом применили следующий способ. Локальное смещение d можно оценить путем определения второстепенных максимумов, находящихся в корреляционной связи, в окне изображения (заданном x-координатами xw и y-координатами yw) и окне, сдвинутом на d, с обеих сторон:

Корреляция будет максимальной, если сдвиг d равен сдвигу, обусловленному дифракцией. После этого, окно для значения d найдено.

Как известно, корреляция дает более точный результат, когда подавляют постоянную составляющую (DC). Такое подавление можно обеспечить предварительной фильтрацией изображения фильтром верхних частот (например, дифференцирующим фильтром [+1, -1]).

После того, как определена глубина объекта, можно попробовать вернуть эффект дифракционной решетки посредством обращения функции рассеяния точки (PSF), которую можно аппроксимировать следующим фильтром FIR (конечного импульсного отклика), для малых значений α, в Z-области:

Данный способ можно также дополнить жидкостным/автофокусирующимся объективом. При этом получают преимущество возможности минимизации потери четкости, обусловленной дефокусировкой, что дает более четкие оценки функции рассеяния точки (PSF).

На фиг.6 представлены экспериментальные результаты для измеренного смещения d в пикселях в виде функции расстояния О для расстояния 250 мм от объектива и для света с длиной волны приблизительно 650 нм. Экспериментальные результаты приведены для различных решеток, при этом численное значение представляет число линий на один мм.

В вышеописанном варианте осуществления использовано устройство, в котором с помощью дифракционной решетки на датчике формируют два или более (в приведенном случае, три, центральное изображение и два повторных изображения) изображений одного и того же объекта. Расстояние d между изображениями объекта является показателем расстояния О от объекта до датчика и, при известным расстояниях для объектива (L) и дифракционной решетки (G), также до упомянутых компонентов.

Приведенные варианты осуществления выполняют искомую функцию, однако имеют недостаток; дифракция на дифракционной решетке зависит от длины волны. Когда используют свет с одной длиной волны λ или почти одной волны, или преобладающей длиной волны, упомянутый недостаток не составляет проблему. Следовательно, например, приведенный вариант осуществления можно очень эффективно применить в обзорных камерах, просматривающих зону, освещаемую искусственным светом с некоторой известной длиной волны. В более сложных случаях анализ для поиска расстояния d можно выполнять с использованием цветовой информации, которая имеется в изображении. Первое грубое приближение расстояния О можно выполнить с использованием расстояния d, не зависящего от цветового содержания, и, в последующем, можно выполнять точное определение с использованием цветового содержания.

Дифракционная решетка может быть также решеткой на основе, например, ячеек ЖК (жидкокристаллического) дисплея, при этом решетку можно включать и выключать по желанию, например, посредством регулирования прозрачности ячеек ЖК-дисплея. В альтернативном варианте можно воспользоваться маской с фазой модуляцией, которая обеспечивает более высокую интенсивность, чем при амплитудной модуляции, так как прозрачность остается равной 1 в любом месте, а модуляции подвергается показатель n преломления света. При этом требуются только 1 поляризатор и LC (жидкокристаллическая ячейка). Включение и выключение дифракционной ячейки будет допускать применение камеры в форме «нормальной» камеры, когда все ячейки прозрачны, с обеспечением обычного 2-мерного изображения, а также «3-мерной» камеры посредством моделирования дифракционной решетки блокированием строк ячеек.

В вариантах осуществления, в которых можно переключать дифракционную решетку, устройство можно выполнить с возможностью записи нескольких кадров, при этом некоторые кадры получают без применения дифракционной решетки и некоторые кадры получают с применением дифракционной решетки. Например, дифракционная решетка может работать так, что в секунду записывают 25 простых изображений, чередуемых с 25 составными изображениями.

Данное решение предоставляет ряд возможностей, например:

- Обеспечение, в одном и том же сигнале, составного изображения, а также нормального изображения. В таком случае нормальные изображения, например, передаются на дисплей камеры, чтобы оператор видел «нормальное» изображение, а составные изображения сохраняются и/или анализируются.

- Упрощение анализа, причем кадры «нормального» изображения дают подходящую отправную точку для анализа.

Однако, хотя в упомянутых вариантах осуществления применяют динамическую систему, существенным остается то, что составные изображения содержат несколько одновременно записанных ракурсов. В данном примере присутствуют три ракурса: центральный ракурс и два боковых ракурса.

На фиг.7 изображен другой вариант осуществления изобретения. В данном варианте осуществления оптическое устройство содержит конфигурацию, содержащую зеркало 72 и делитель 74 пучка. Ракурс 71 прямого наблюдения записывается через делитель пучка, зеркало 72 отражает боковой ракурс 73, который затем отражается делителем пучка, а также входит в линзу камеры 2. В случае, если делитель пучка является 50%/50% делителем пучка, перед зеркалом обеспечивают нейтральный светофильтр 75. В описании примерного варианта осуществления, первый ракурс называется «ракурсом прямого наблюдения», второй ракурс называется «боковым ракурсом». Однако приведенные термины нельзя толковать как ограничение; в данном варианте осуществления существуют по меньшей мере два ракурса, при этом один из ракурсов можно называть «ракурсом прямого наблюдения». В других вариантах осуществления оба ракурса могут быть боковыми ракурсами, один ракурс немного слева, и другой ракурс немного справа. Не существует также такого ограничения, что должно быть два ракурса; возможно одновременное получение более двух ракурсов. Конструкции, содержащие зеркало и делитель пучка, содержат комбинации из данных элементов, например, делитель пучка с поперечным смещением. В устройствах данного типа, свет приходит из двух разных местоположений, разделенных некоторой базой по одному направлению к датчику.

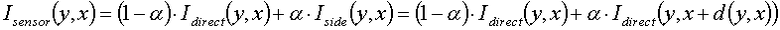

В предпочтительном варианте оптический элемент является делителем пучка с асимметричным распределением интенсивности света, например, 40%-60% или, в альтернативном варианте, 50%-50% делителем пучка, с нейтральным светофильтром перед боковым ракурсом, см. Фиг.7. Изображение, полученное датчиком 4 камеры 2, можно представить в виде:

где α<0.5 является параметром, описывающим вклад бокового ракурса в составное изображение Isensor(x,y), и d(x,y) является диспаратностью (=расстоянию на датчике между соответствующими частями двух изображений), созданной делителем пучка. Диспаратность d(x,y) является функцией расстояния D(x,y) до объекта и параметров оптической системы, например, полосой базы при расстоянии L между объективом и датчиком в камере, как показано на Фиг.8

Поэтому оценка D(x,y) глубины, эквивалентна оценке диспаратности d(x,y) на составном изображении Isensor(x,y). Следует отметить, что для оптического устройства данного типа взаимосвязь между D и d немного отличается от взаимосвязи между O и d для устройства первого типа с дифракционной решеткой, показанного на Фиг.3. Вышеупомянутая взаимосвязь проще и не зависит от длины волны. Данная особенность является преимуществом.

Ниже приведено описание итеративного алгоритма, который находит карту d(x,y) диспаратностей и ракурс Idirect(x,y) прямого наблюдения по составному изображению Isensor(x,y), в виде примера и в дополнение к вышеописанному возможному алгоритму.

Алгоритм является итеративным, и на каждой итерации аппроксимацию Iout(x,y) прямого изображения и аппроксимацию dout(x,y) карты глубины вычисляют по составному изображению Isensor(x,y) и предшествующим значениям аппроксимации I(x,y) прямого изображения и аппроксимации d(x,y) карты глубины:

Скорректированные аппроксимации инициализируют как Iout(x,y)=I(x,y) и dout(x,y)=d(x,y), и затем их корректируют блочным методом. Размеры Δx и Δy блока являются параметрами алгоритма. Затем Iout(x,y) и dout(x,y) корректируют в соответствии с алгоритмом 3DRS 3-мерного рекурсивного поиска. В соответствии с алгоритмом 3DRS 3-мерного рекурсивного поиска последовательно обрабатывают все блоки изображения, и для каждого блока оценивают несколько возможных глубин. Возможные значения являются композицией значений соседних блоков и случайных коррекций. Местоположение соседних блоков, обеспечивающих возможные варианты, может зависеть от направления сканирования на блочной сетке, представленной, например, на Фиг.9 и отражающей примерное местоположение блоков, обеспечивающих возможные глубины. На Фиг.9 уже обработанные блоки обозначены буквой a, текущий блок обозначен буквой C, соседние «пространственные» блоки обозначены буквой В, и соседние «временные» блоки обозначены буквой D. Стрелки указывают направление обработки.

Случайные возможные варианты можно получать добавлением случайных коррекций к значениям других возможных вариантов. Каждый возможный вариант оценивают, а затем выбирают оптимальный вариант, обеспечивающий значения dout(x,y) в текущем блоке. Процесс оценки состоит из трех этапов: во-первых, значения dout(x,y) в текущем блоке изменяют на значение оцененного возможного варианта; во-вторых, при данной карте глубин составное изображение Isensor(x,y) подвергают локальной (частной) обратной свертке. Выполнение (частной) обратной свертки возможно множеством разных способов. Например, можно применить несколько итераций методом обратной свертки Гаусса-Зайделя в окрестности текущего блока:

На третьем этапе оценивают качество Iout(x,y) в окрестности текущего блока посредством безреференсных показателей качества. С данной целью можно воспользоваться, например, выражением,

где В является некоторой окрестностью текущего блока. Возможный вариант, который максимизирует показатели качества, выбирают как оптимальный в отношении обеспечения значений dout(x,y) в текущем блоке.

Следует отметить, что после каждой оценки возможного варианта значения Iout(x,y) восстанавливаются до первоначальных, и после всех оценок, когда dout((x,y) скорректировано, выполняется (частная) обратная свертка Iout(x,y) в окрестности текущего блока.

Вышеописанный способ определения глубины содержит несколько параметров, которые можно оптимизировать для получения оптимальной характеристики.

Сначала, авторами изобретения установлено, что результаты зависят от смешения интенсивностей, т.е. значения для α, и очень высокие результаты можно получить с α от 0,28 до 0,49 или от 0,51 до 0,72, например α≈0,45. Это означает, что одно из изображений, либо прямое, либо Iside имеет интенсивность выше на 4-133%, чем интенсивность другого изображения. На Фиг.10 показан результат. На горизонтальной оси отложены значения α, а вертикальная ось отражает среднеквадратическую погрешность (MSE) рассчитанной диспаратности относительно истинных значений. Отчетливый минимум наблюдается около α=0,45, в частности между α=0,42 и 0,48. В предпочтительном варианте, изображение ракурса прямого наблюдения имеет более высокую интенсивность, чем боковой ракурс. Для некоторых целей, возможно, лучше всего реконструировать ракурс прямого наблюдения, при этом полезно, что на ракурс прямого наблюдения приходится большая часть интенсивности. Когда составляющие изображения имеют равную интенсивность, то два изображения становятся очень трудноразличимыми, и способ очень осложняется. Когда одно из изображений является очень слабым по сравнению с другим, данные изображения становятся трудноразличимыми.

Зависимость качества оценки глубины от коэффициента вклада бокового ракурса (альфа) исследовали следующим образом. Смоделировали изображение, получаемое с помощью делителя пучка, для данной карты глубины. Затем применили описанный алгоритм обратной свертки для оценки карты глубины по смоделированному составному изображению. Среднеквадратичную погрешность между использованной и полученной оценкой картами глубины получали как показатель качества. На Фиг.10 приведена зависимость показателя качества от альфа. На фиг.10 показано, что оптимальные результаты можно получить с альфа в диапазоне [0,28, 0,48], который соответствует отношениям 1,07-2,57 (=(1-альфа)/альфа) интенсивностей в ракурсе прямого наблюдения и боковом ракурсе. Минимум имеет место с альфа в пределах от 0,42 до 0,47.

Во-вторых, поскольку алгоритм предполагает несколько итераций, то можно выбрать разные Δх, Δу для каждой итерации. Обычно большие значения Δх, Δу улучшают сходимость, а меньшие значения повышают пространственную разрешающую способность аппроксимированной карты глубины. В процессе оценки авторы настоящего изобретения получили наилучшие результаты с Δх, Δу, уменьшающимися при каждой итерации, например, для изображения 800×576 пикселей, авторы использовали Δх=Δy=16 на первой итерации, Δх=Δy=8 на второй итерации и Δх=Δy=4 на третьей итерации. Данный вариант осуществления объединяет быструю сходимость результатов с высокой пространственной разрешающей способностью.

Как в варианте осуществления с дифракционной решеткой, нейтральный светофильтр можно переключать во времени или даже модулировать по времени, чтобы обеспечивать возможность двойного применения, т.е. в качестве нормальной 2-мерной камеры и 3-мерной камеры, в зависимости от того, включен ли или выключен нейтральный светофильтр, а также последовательности кадров, в которых несколько кадров содержат несоставное изображение, представляющее только ракурс прямого наблюдения (или боковой ракурс), и несколько кадров содержат составные изображения.

Нейтральный светофильтр может характеризоваться пространственной вариацией. Данная вариация позволит проще, посредством пространственной фильтрации, отличать боковой ракурс от ракурса прямого наблюдения, который может представлять входные данные для анализа, что позволяет быстрее и/или точнее определять диспаратности. Однако существенным является тот факт, что, хотя некоторые из изображений являются составными и некоторые являются одиночными, составляющие изображения составных изображений получают одновременно. Одновременная запись составляющих изображений исключает проблемы с перемещением объектов. В этом отношении следует отметить, что обычно расстояние, измеренное в пикселях между объектами на левом и правом ракурсах, составляет несколько десятков пикселей. Разность упомянутых расстояний является показателем глубины и, следовательно, составляет обычно меньшее число десятков пикселей. Перемещение объектов между кадрами может составлять аналогичное расстояние в пикселях.

Следовательно, сравнение левого и правого изображений, полученных в разные моменты времени, т.е. неналоженных изображений, даже при разделении одним кадром, усложняет вопрос. Для подвижных объектов потребуется наличие информации, касающейся движения объектов. При этом требуется несколько кадров для получения точного измерения движения объектов. Только когда перемещение известно, можно разделить измеренное расстояние для подвижного объекта на расстояние в пикселях, вызванное параллаксом, по которому можно вычислить глубину, и расстояние в пикселях, вызванное перемещением, которое не связано напрямую с глубиной. Для получения точного измерения глубины для подвижных объектов приходится анализировать данные, касающиеся объектов, от относительно большого числа изображений. Обычно необходимо принимать некоторые дополнительные допущения относительно движения, например, что движение является более или менее одинаковым или лишь линейно изменяется между кадрами. Все упомянутые особенности усложняют вычисления, и все-таки любая неточность при определении перемещения приводит к неточности определения параллакса и, следовательно, глубины. Определенные проблемы возникают, когда подвижные объекты содержат повторяющиеся структуры. Если имеет место случай, когда объекты двигаются так, что повторяющиеся структуры сдвигаются между кадрами на один шаг, то становится очень сложно, если не невозможно, обеспечить оценку движения с какой-либо точностью. При одновременной записи составляющих изображений составного изображения любая проблема движения исключается. Дополнительная проблема возникает в случае с объектами, которые движутся от или в направлении камеры. Задача оценки упомянутых перемещений очень сложна.

Факт, что в некоторых вариантах осуществления кроме составных изображений можно получать одиночные изображения, не отменяет упомянутый факт. Одиночные изображения (центральное, левое или правое изображения) допускают проверку результатов, что обеспечивает более точное определение глубины и/или облегчает выделение одного или обоих составляющих изображений из составного изображения.

Устройство просмотра камеры в некоторых вариантах осуществления представляет не составное изображение, а несоставное изображение. Наблюдение составного изображения раздражает человека. В некоторых вариантах осуществления камера может также непосредственно представлять изображение глубины с визуализацией z-карты или зрительного образа, который объединяет оба параметра.

Изображение можно также получать в видимом свете и, с одинаковым результатом, в инфракрасном свете. Например, инфракрасную камеру можно снабдить оптическим устройством для создания двойного составного изображения, в котором программное обеспечение создает из двойного изображения несоставное изображение, при этом, интенсивность изображения показывает нагревание, и дополнительно применяют цветовую кодировку объектов в зависимости от расстояния до датчика. Вышеописанное решение позволит наблюдателю, использующему очки ночного видения, не только наблюдать людей и объекты по мере их движения в темноте, но также немедленно получать представление о том, насколько удалены упомянутые люди или объекты от наблюдателя.

Вкратце изобретение можно описать следующим образом.

Камера и система камеры снабжены оптическим устройством (8). Оптическое устройство создает одновременно два или более изображений объекта на датчике (4) для формирования составного изображения. Расстояние d между составляющими изображениями объекта в составном изображении зависит от расстояния Z до камеры. Составное изображение анализируют (9), например обрабатывают методом обратной свертки для определения расстояний d между двойными изображениями. Затем упомянутые расстояния преобразуют в карту глубины (10).

Изобретение относится также к компьютерным программам, содержащим управляющее программное средство для выполнения способа в соответствии с изобретением, когда упомянутая программа исполняется в компьютере, а также к компьютерному программному продукту, содержащему управляющее программное средство, хранящееся на машиночитаемом носителе для выполнения способа в соответствии с изобретением.

Никакие позиции, помещенные в скобки в формуле изобретения, нельзя интерпретировать как ограничивающие пункт формулы изобретения.

Формулировка «содержащий» не исключает присутствия других элементов или этапов, кроме перечисленных в пункте формулы изобретения. Изобретение может быть реализовано посредством любой комбинации признаков разных вышеописанных предпочтительных вариантов осуществления.

Камера представляет собой любое устройство для формирования изображений. Камера может быть частью устройства, применяемого также в других целях, например для связи, или закрепленной, встроенной, или взаимодействующей с упомянутым устройством связи.

Изобретение относится к средствам записи стереоскопических изображений. Техническим результатом является повышение точности оценки движения объекта на изображении при трехмерной съемке изображения одной камерой. В способе перед объективом (L), расположенным перед датчиком (4) изображения для записи, обеспечено оптическое устройство (8) создания составного изображения (1') на датчике (4). Составное изображение содержит два наложенных, одновременно полученных изображения одного объекта. В способе пространственное расстояние (d) между соответствующими объектами на общем датчике (4) изображения в составном изображении зависит от расстояния (O) упомянутого изображаемого объекта от объектива, наложенные изображения отображают на общем датчике (4) изображения общим объективом (L), составное изображение анализируют (9) для определения пространственного расстояния (d) между соответствующими объектами в наложенных изображениях в составном изображении на датчике (4). 2 н. и 11 з.п. ф-лы, 10 ил.

1. Способ записи данных изображения, в котором перед объективом (L), расположенным перед датчиком (4) изображения для записи изображения, обеспечивают оптическое устройство (8) для создания составного изображения (1') на датчике (4), при этом составное изображение содержит два или более наложенных, одновременно полученных изображения одного и того же объекта, причем пространственное расстояние (d) между соответствующими объектами на общем датчике (4) изображения в составном изображении зависит от расстояния (O) упомянутого изображаемого объекта от объектива, причем по меньшей мере два наложенных изображения отображают на общем датчике (4) изображения общим объективом (L), и причем составное изображение анализируют (9) для определения пространственного расстояния (d) между соответствующими объектами в наложенных изображениях в составном изображении на датчике (4).

2. Способ по п.1, в котором для пикселей внутри окна изображения вычисляют максимумы, находящиеся в корреляционной связи, для сдвига (d) окна изображения.

3. Способ по п.1, в котором в ходе итерационной процедуры на каждой итерации вычисляют аппроксимированное прямое изображение Iout(x,y) и аппроксимированную карту dout(x,y) глубины по составному изображению Isensor(x,y) и предшествующим значениям аппроксимированного прямого изображения I(x,y) и аппроксимированной карты d(x,y) глубины.

4. Способ по одному из пп.1-3, в котором составное изображение создают дифракцией, причем оптическое устройство (8) содержит дифракционную решетку (G) для упомянутого создания дифракцией.

5. Способ по любому из пп.1-3, в котором составное изображение создают сдвигом ракурсов, причем оптическое устройство содержит зеркало (72) и делитель (74) пучка для упомянутого создания дифракцией.

6. Способ по любому из пп.1-3, в котором оптическое устройство выполнено с возможностью переключения между первым рабочим состоянием, в котором записывают единственное изображение, и вторым рабочим состоянием, в котором записывают составное изображение.

7. Способ по п.3, в котором первый ракурс записывают с первой интенсивностью (Idirect) и второй ракурс записывают со второй интенсивностью (Iside), при этом отношение упомянутых интенсивностей составляет от 1,04 до 2,57 или от 1/2,57 до 1/1,04.

8. Система для записи данных изображения, содержащая объектив (3) и датчик (4) изображения, и, перед объективом, оптическое устройство (8) для создания составного изображения (1') на датчике (4), содержащего два и более наложенных, одновременно полученных изображения одного и того же объекта, при этом пространственное расстояние (d) между соответствующими объектами на общем датчике (4) изображения в составном изображении зависит от расстояния (O) упомянутого изображаемого объекта от объектива, и содержащая анализатор (9) для анализа составного изображения, чтобы определять пространственное расстояние (d) между соответствующими объектами в наложенных изображениях в составном изображении на датчике (4).

9. Система по п.8, в которой оптическое устройство является переключаемым между первым рабочим состоянием, в котором записывается единственное изображение, и вторым рабочим состоянием, в котором записывается составное изображение.

10. Система по любому из пп.8-9, в которой оптическое устройство (8) содержит дифракционную решетку.

11. Система по п.10, в которой дифракционная решетка содержит переключаемые элементы для включения и выключения дифракционной решетки.

12. Система по любому из пп.8-9, в которой оптическое устройство содержит зеркало (72) и делитель (74) пучка.

13. Система по любому из пп.8-9 с дисплеем, при этом на упомянутом дисплее представляется несоставное изображение, и/или оценка карты глубины, и/или изображение, обеспечивающее информацию об изображении и глубине.

| US 6807295 B1, 19.10.2004 | |||

| US 5671089 A, 23.09.1997 | |||

| DE 10041053 A1, 14.03.2002 | |||

| US 6687003 B1, 01.02.2004 | |||

| US 20080259354 A1, 23.10.2008 | |||

| US 20070285554 A1, 13.12.2007 | |||

| СПОСОБ ВОСПРОИЗВЕДЕНИЯ СТЕРЕОСКОПИЧЕСКОГО ИЗОБРАЖЕНИЯ ОТ ВИДЕОКАМЕР СО СХОДЯЩИМИСЯ ОСЯМИ | 2007 |

|

RU2340116C1 |

| СТЕРЕОСКОПИЧЕСКАЯ СИСТЕМА | 1999 |

|

RU2221350C2 |

Авторы

Даты

2015-01-10—Публикация

2010-06-21—Подача