УРОВЕНЬ ТЕХНИКИ

Мобильный блок (MU) может включать в себя интерфейс пользователя с широкими возможностями, который обеспечивает пользователя возможностью активировать элемент управления MU. Тем не менее, активация элементов управления MU часто представляет собой операцию, для которой нужны две руки, по той причине, что если необходимо получить доступ к элементу управления на дисплее, то, чтобы активировать данный элемент управления посредством пальца или стилуса, требуется вторая рука. Стандартные MU включают в себя многообразие разных способов для осуществления ввода. Например, MU может включать в себя клавишную панель для осуществления ввода. В другом примере MU может включать в себя датчики движения и/или ориентации для обнаружения движения и/или ориентации, которое соответствует осуществлению ввода.

Несмотря на то, что известно использование датчиков движения для обнаружения движения, которое соответствует осуществлению ввода, стандартные MU не включают в себя никаких указаний на то, какие движения управляют возможными действиями. Например, в приложении браузера с возможностью подключения к сети Интернет (например, web-странице) пользователь может не знать действие, которое активирует конкретную команду, или даже может быть полностью не осведомлен о том, что определенное действие активирует команду. Соответственно, пользователь может не иметь возможности в полной мере использовать все возможные опции или может неумышленно выполнить действие, которое является нежелательным.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Примерные варианты осуществления описывают мобильный блок, включающий в себя процессор, память и дисплей. Дисплей показывает интерфейс пользователя, включающий в себя множество команд. Каждая сенсорно активируемая команда из множества команд показывается с помощью соответствующей пиктограммы, указывающей, по меньшей мере, одно из движения и ориентации, назначенное сенсорно активируемой команде.

ОПИСАНИЕ ЧЕРТЕЖЕЙ

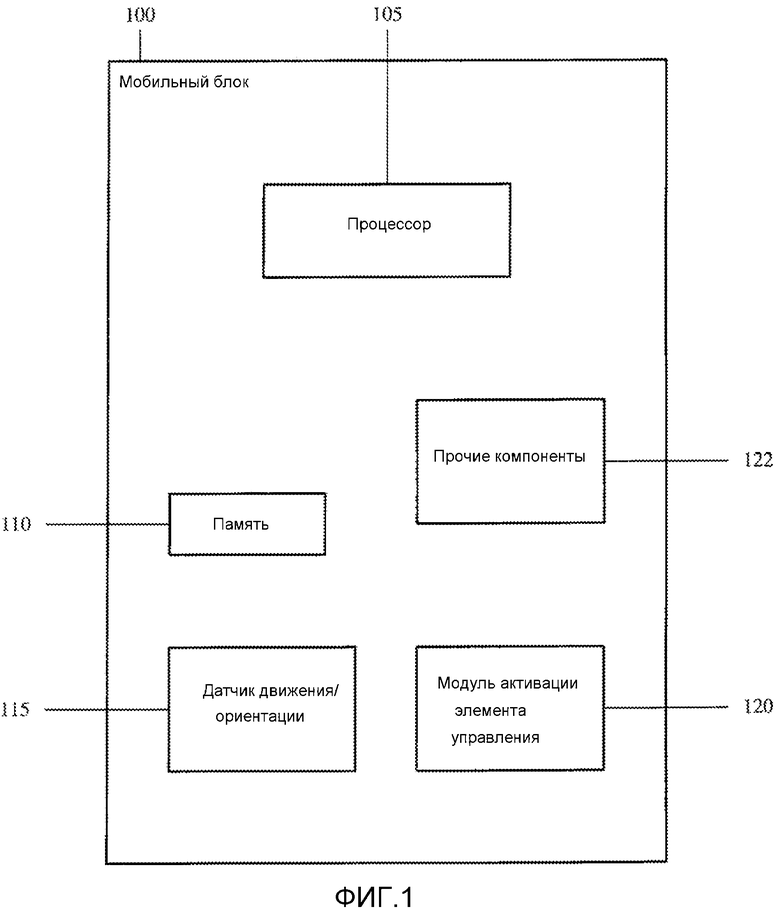

Фиг. 1 показывает компоненты мобильного блока в соответствии с примерным вариантом осуществления.

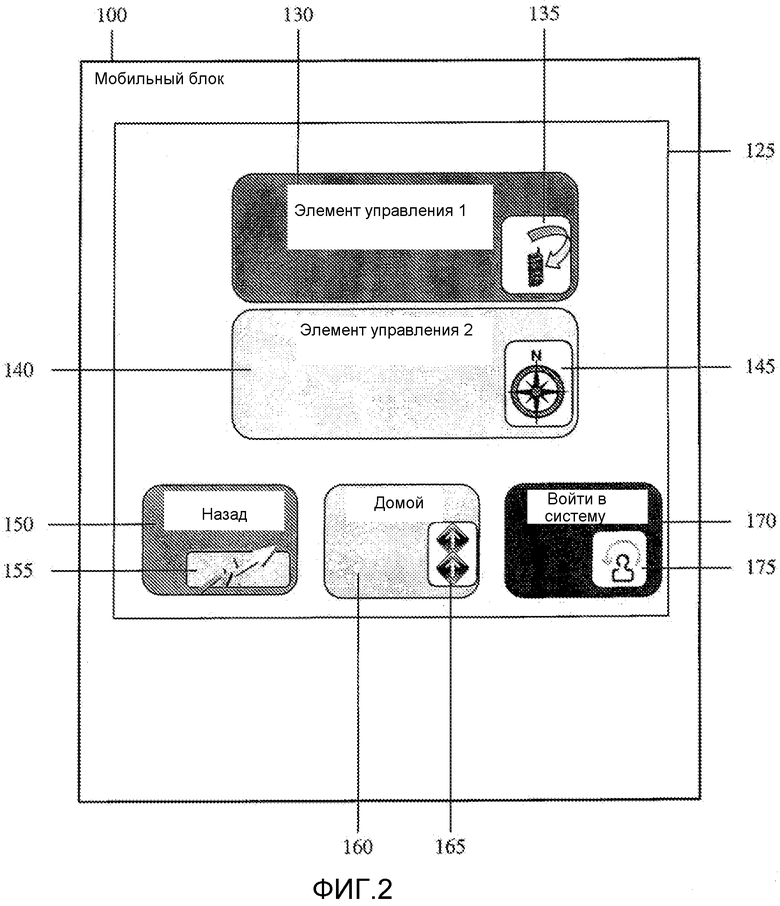

Фиг. 2 показывает мобильный блок с Фиг. 1, включающий в себя дисплей, в соответствии с примерным вариантом осуществления.

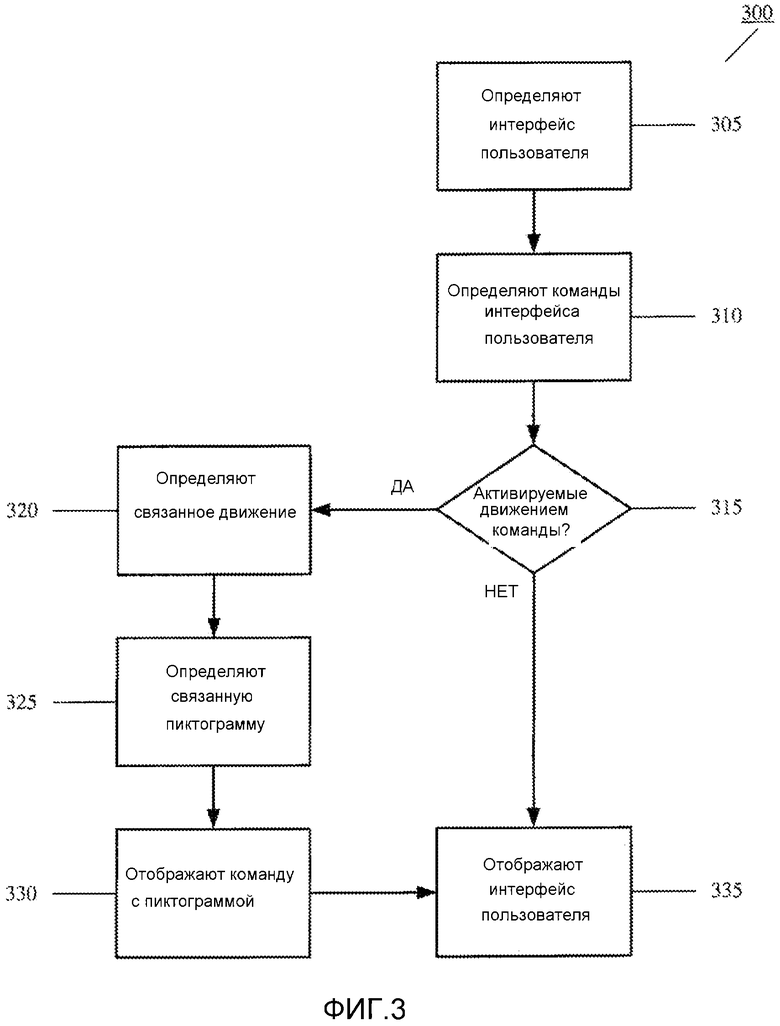

Фиг. 3 показывает способ указания движения, которое активирует команду, в соответствии с примерным вариантом осуществления.

ПОДРОБНОЕ ОПИСАНИЕ

Примерные варианты осуществления могут быть более понятны со ссылкой к нижеследующему описанию и прилагаемым чертежам, в которых подобные элементы обозначены одинаковыми цифровыми обозначениями. Примерные варианты осуществления описывают мобильный блок с дисплеем, выполненным с возможностью показа пиктограмм, представляющих движения и/или ориентации, которые активируют команду. В частности, движения представлены в качестве пиктограмм, совместно с действием, для указания пользователю того, что выполнение движения приводит к активации команды. Примерные варианты осуществления дополнительно описывают среду разработки для разработки приложений, которые включают в себя сенсорно активируемые команды. Мобильный блок, дисплей, движения и/или ориентации, пиктограммы, среда разработки и связанный с ней способ будут более подробно рассмотрены ниже.

Фиг. 1 показывает компоненты мобильного блока 100 (MU) в соответствии с примерным вариантом осуществления. MU 100 может быть электронным устройством, которое является портативным. Компоненты MU 100 могут включать в себя процессор 105, память 110, датчик 115 движения и/или ориентации и модуль 120 активации элемента управления. Следует отметить, что MU 100 может включать в себя многообразие других стандартных компонентов, представленных в виде других компонентов 122. Например, другие компоненты 122 могут включать в себя источник питания, клавишную панель, входной приемник, порты для подключения к другим устройствам, беспроводной приемопередатчик, громкоговоритель и т.д.

Процессор 105 может обеспечивать стандартные функциональные возможности для MU 100. Например, MU 100 может включать в себя множество приложений, которые исполняются процессором 105. В частности, MU 100 может включать в себя приложение, включающее в себя web-браузер, при наличии соединения с сетью через беспроводной приемопередатчик. Память 110 также может обеспечивать стандартные функциональные возможности для MU 100. Например, память 110 может хранить данные, которые относятся к операциям, которые выполняются процессором 105. В частности, память 110 может хранить множество движений и/или ориентаций и связи движений и/или ориентаций.

Датчики 115 движения и/или ориентации могут быть любым стандартным устройством, которое выполнено с возможностью приема и интерпретации данных движения и/или ориентации. Например, датчик 115 движения и/или ориентации может включать в себя акселерометр применительно к движению и магнитометр применительно к ориентации. Акселерометр может измерять точное ускорение по одной или нескольким осям, чтобы обнаружить величину и направление ускорения, воспринимаемого MU 100, в виде векторной величины. Соответственно, датчик 115 движения, будучи акселерометром, может использоваться для восприятия ориентации с помощью или без помощи магнитометра или гироскопа, ускорения, вибрационного удара, падения и т.д. В другом примере датчик 115 движения может быть связан с сенсорным дисплеем. Датчик 115 движения может принимать исходные сенсорные данные, промежуточные сенсорные данные и конечные сенсорные данные. Затем датчик 115 движения может экстраполировать движение, выполненное по сенсорному дисплею. Следует отметить, что датчики 115 движения и/или ориентации также могут быть известными устройствами других типов, которые обнаруживают движение и/или ориентацию, а также могут быть любой комбинацией этих устройств.

Модуль 120 активации элемента управления (CAM) может быть аппаратным обеспечением, программным обеспечением, их комбинацией или расширением памяти 110. Например, CAM 120 может быть библиотекой или хранилищем для информации, которая относится к движению и/или ориентации. Таким образом, если датчик 115 движения обнаруживает поворачивающее движение, то CAM 120 может включать в себя список действий со связанными движениями и/или ориентациями, чтобы определить, с каким действием связано поворачивающее движение. Процессор 105 может получать доступ к CAM 120 для определения соответствующего действия, которое должно быть выполнено.

Обнаружение жеста движения хорошо известно в соответствующей области техники и может выполняться разнообразными известными способами, такими как Скрытая Марковская Модель (HMM), Древа Решений, Динамическая Трансформация Времени (DWT) и т.д. Независимо от способа требуется наличие некоторого объема обучающих данных до использования системы, чтобы создать шаблоны стандартных жестов для выбранного множества жестов движения. Затем во время обычного использования, данные движения в режиме реального времени сравниваются с этими шаблонами для определения того, выполнен или нет распознаваемый жест. Также до использования, полезно сформировать матрицу неточностей, которая показывает вероятность того, что один жест будет перепутан с другим. Затем данная информация может быть предоставлена разработчикам приложений, чтобы обеспечить понимание того, какие жесты могут вызвать проблемы в отношении внесения путаницы в систему, когда они используются вместе.

В предпочтительном варианте осуществления динамическая трансформация времени используется для сравнения текущей последовательности движений с множеством шаблонов движений, хранящихся в устройстве, чтобы определить, достаточно ли совпадает текущая последовательность с любым известным шаблоном движения. Если в рамках определенного порогового значения обнаруживается совпадение, тогда жест движения рассматривается как обнаруженный. Данное пороговое значение может быть либо жестко запрограммированным, либо может настраиваться пользователем. Что касается шаблонов движения, то они могут быть разработаны и предварительно запрограммированы производителем устройства или разработчиком программного обеспечения посредством стандартных способов машинного обучения. Такие шаблоны могут быть статичными, или они могут адаптироваться посредством усовершенствованных алгоритмов, которые изучают предпочтения конкретного пользователя или группы пользователей. Шаблоны также могут записываться пользователями и сохраняться на устройстве для представления персонализированных движений, жестов или ориентаций.

В соответствии с примерными вариантами осуществления CAM 120 может включать в себя список связей пиктограмм, которые представляют собой различные движения и/или ориентации, которые назначены для выбора команд применительно к множеству интерфейсов пользователей. Процессор 105 может получать доступ к CAM 120 для загрузки интерфейса пользователя соответственно с правильными пиктограммами, отображаемыми для выбора команд. Например, если приложение инициируется пользователем, то интерфейс приложения может включать в себя различные операции, которые могут быть выполнены. CAM 120 может хранить список из любых различных операций, который включает в себя связанное движение и/или ориентацию, которое инициирует действие. Затем процессор 105 может показывать пиктограмму движения для инициируемого движением действия, чтобы указывать пользователю соответствующие движения в зависимости от CAM 120. Таким образом, пиктограмма команды может дополнительно включать в себя пиктограмму движения и/или ориентации, как более подробно будет рассмотрено ниже.

Фиг. 2 показывает MU 100 по Фиг. 1, включающее в себя дисплей 125, в соответствии с примерным вариантом осуществления. В частности, MU 100 соответствует примерному интерфейсу пользователя для приложения браузера. Дисплей 125 иллюстрирует различные движения и/или ориентации, которые могут выполняться для исполнения связанного действия. Как показано, первый элемент 130 управления может включать в себя пиктограмму 135, которая указывает связанное движение и/или ориентацию. Пиктограмма 135 показывает, что если MU 100 поворачивается направо, то будет выполнен первый элемент управления. Второй элемент 140 управления может включать в себя пиктограмму 145, которая показывает связанное движение и/или ориентацию. Пиктограмма 145 показывает, что если MU сориентировано на север, то будет выполнен второй элемент 140 управления. Команда 150 назад может включать в себя пиктограмму 155, которая указывает связанное движение. Пиктограмма 155 показывает, что если MU 100 встряхивается вправо, то выполняется команда 150 назад. Команда 160 домой может включать в себя пиктограмму 165, которая показывает связанное движение. Пиктограмма 165 показывает, что если MU 100 встряхивается вверх и вниз, то выполняется команда 160 «домой». Команда 170 входа в систему может включать в себя пиктограмму 175, которая указывает связанное движение. Пиктограмма 175 показывает, что если выполнен персональный жест (например, поворот на 180 градусов в направлении против часовой стрелки MU 100), то выполняется команда 170 входа в систему.

В соответствии с примерными вариантами осуществления движения и пиктограммы могут быть настройками по умолчанию и/или определяться предпочтениями пользователя. Например, CAM 120 может включать в себя список установленных по умолчанию пиктограмм и связанные движения и/или ориентации, указанные для интерфейса пользователя, показанного на дисплее 125. Как показано на дисплее 125 на Фиг. 2, пиктограммы 135, 145, 155 и 165 могут быть установленными по умолчанию пиктограммами. Эти установленные по умолчанию пиктограммы могут быть интуитивно понятными пользователю символами, в которых любой пользователь, который видит установленную по умолчанию пиктограмму, может определить связанное движение и/или ориентацию. Список установленных по умолчанию пиктограмм может включать в себя другие доступные пиктограммы, которые могут использоваться для связи с другими предпринимаемыми действиями, которые пользователь может им назначить. Например, пиктограмма 175 может быть выбрана пользователем из списка установленных по умолчанию пиктограмм, в которой движение соответствует повороту в направлении против часовой стрелки.

Пиктограммы также могут быть создаваемыми пользователем. Т.е. CAM 120 также может включать в себя приложение, выполняемое процессором 105, в котором пользователь может создавать пиктограмму. Затем созданная пиктограмма может быть связана с движением и/или ориентацией, которое определено пользователем. CAM 120 может включать в себя список доступных движений и/или ориентаций, которые могут быть связаны с созданной пиктограммой. Затем пользователь может связать созданную пиктограмму с действием. Когда действие является частью интерфейса пользователя, то процессор 105 может получить доступ к CAM 120, чтобы показать пиктограмму с действием. Таким образом, когда выполняется движение и/или ориентация, то также может выполняться действие. Кроме того, выбранная пользователем пиктограмма и/или созданная пользователем пиктограмма может быть связана с созданным пользователем движением и/или ориентацией. Например, приложение для создания пиктограмм также может позволить пользователю сформировать движение или ориентацию, которые сохраняются. Затем пользователь может связать созданное пользователем движение или ориентацию с пиктограммой.

Назначение движений и/или ориентаций команде, как впрочем, и связывание пиктограммы может возлагаться на пользователя (как описано выше) и/или может возлагаться на разработчиков (как в случае назначений по умолчанию). Разработчики также могут назначать движения и/или ориентации команде с помощью пиктограммы для интерфейсов пользователя, которые потенциально могут изменяться. Например, на дисплей 125 может быть загружена web-страница. Web-страница управляется разработчиками данной страницы. Разработчики могут назначить различные движения и/или ориентации для выбора одной из команд, а также назначить соответствующую пиктограмму для каждого движения и/или ориентации. MU 100, которое выполнено с возможностью приема данных движения и/или ориентации (например, посредством датчика 115 движения и/или ориентации), может показывать пиктограммы, чтобы указать пользователю, какие команды являются активируемыми движением. Таким образом, когда web-страница загружена, то данные движения и ориентации могут использоваться для навигации.

Как рассмотрено выше, примерные варианты осуществления могут дополнительно использоваться со средой разработки. Описанное выше исполнение web-страницы может воплощать один пример среды разработки. Во время разработки приложения командам могут быть назначены движения и/или ориентации, которые исполняют команды. Кроме того, разработчик может назначить соответствующие пиктограммы, которые представляют собой движения и/или ориентации, используемые для исполнения команд. Разработчик может получить доступ к по сути сходной библиотеке движений, ориентаций и пиктограмм, как описано выше. В дополнение, библиотека может включать в себя эксклюзивные пиктограммы разработчика, которые назначаются лишь на уровне разработчика. Кроме того, библиотека пиктограмм может фильтроваться (как на уровне разработчика, так и на уровне пользователя) в зависимости от количества сенсорных активируемых команд. Например, когда по одному действию могут быть одновременно зарегистрированы, по меньшей мере, два движения и/или ориентации, то может не допускаться связывание движений и/или ориентаций с командами, которые присутствуют в одном интерфейсе. Среда разработки может предоставлять механизм для загрузки шаблона распознавания, который соответствует выбранному сенсорному вводу, выбранному разработчиком, и который связан с командой.

Среда разработки также может позволять разработчику включать дополнительные опции рассмотренные здесь выше и ниже. Например, разработчик может предоставить приложение, которое позволяет пользователю создавать пиктограммы или изменять команду таким образом, чтобы она стала командой сенсорно активируемой. В другом примере разработчик может предоставить пользователю мгновенный предварительный просмотр пиктограмм в качестве подсказок. Таким образом, независимо от того, показана или нет пиктограмма, представляющая движение и/или ориентацию, мгновенный предварительный просмотр может использоваться для временного показа пиктограммы, временного формирования большего изображения пиктограммы и т.д.

Вместе с опциями, которыми разрешено управлять пользователю, разработчик может исходно связывать шаблоны с конкретными приложениями и командами приложений. Например, с заданным приложением или конкретно с командой приложения может связываться шаблон жеста. Таким образом, когда пользователь делает из команды команду, сенсорно активируемую, то может предоставляться выбор из шаблонов жестов.

Доступные движения, ориентации, события распознавания и т.д. могут классифицироваться по множествам, подмножествам, типам классов и т.д., таким как типа встряхивания, типа наклона, типа ориентации и т.д. Шаблоны, которые предназначены для выбранных приложений, могут быть связаны с категорией или подмножествами доступных сенсорных вводов. Таким образом, среда разработки может дополнительно предоставлять возможность связывать конкретные множества сенсорных вводов с заранее определенными приложениями. Вследствие этого меню движений, ориентаций, пиктограмм и т.д. может фильтроваться применительно к приложению в зависимости от связи с шаблонами и типами классов для приложения.

Следует отметить, что CAM 120 может включать в себя другие функциональные возможности. В первом примере CAM 120 может включать в себя функции для помощи пользователю. Например, аудиоподсказки могут использоваться для информирования пользователя о том, какие движения и/или ориентации связаны с активируемой командой. При такой функции аудиоподсказка может воспроизводить голосовой файл, сообщающий движение и/или ориентацию, связанную с действием. Таким образом, в первом сценарии, когда пользователь физически выполняет движение и/или ориентацию, голосовой файл может сообщать выполняемое движение и/или ориентацию, которое, например, служит в качестве проверки того, что пользователь будет выполнять требуемое действие. Во втором сценарии, когда пользователь выбирает пиктограмму, голосовой файл может сообщать движение и/или ориентацию, связанную с пиктограммой. Следует отметить, что пиктограмма также может включать в себя графически написанное указание движения и/или ориентации.

Также следует отметить, что MU 100 может включать в себя дополнительные датчики, которые определяют другие воспринимаемые условия, такие как окружающие, биологические, электромагнитные и т.д. события распознавания. Таким образом, CAM 120 может дополнительно рассматривать эти воспринимаемые условия в качестве фактора для выполнения действия. Следует отметить, что эти другие воспринимаемые условия могут использоваться для выполнения действия совместно с датчиком 115 движения и/или ориентации или отдельно.

Дополнительно следует отметить, что MU 100 может включать в себя другие приемники ввода, такие как мышь, стилус, тактильный ввод и т.д., которые могут использоваться совместно с движениями и/или ориентациями. Например, некоторые пиктограммы могут показывать, что для активации команды требуется другой ввод совместно с движением и/или ориентацией. В конкретном примере пиктограмма 145 указывает на то, что, когда MU 100 сориентировано на север, выполняется действие. Пиктограмма 145 также может включать в себя опцию, при которой пользователю требуется удерживать командную кнопку 140 в интерфейсе, например, с помощью тактильного ввода, таким образом, что действие выполняется, когда командная кнопка 140 нажата совместно с ориентацией MU 100 на север. В другом примере совместное использование другого ввода и движения и/или ориентации может быть динамическим. Т.е. в конкретном примере движение и/или ориентация могут стать доступными для активации команды только после того, как выполнено/воспринято другое действие.

MU 100 может быть удобным для использования в том плане, что конкретные датчики могут активироваться/деактивироваться в зависимости от предпочтений пользователя. Например, если MU 100 находится в условиях, при которых воспринимается множество событий движения или ориентации, которые могут пересекаться с желаемыми действиями, которые должны быть приняты, то пользователь может деактивировать датчик 115 движения и/или ориентации и активировать только другие датчики (например, мышь/стилус). В другом примере, если пользователю требуется использование MU 100 только с помощью одной руки, то пользователь может деактивировать другие датчики и активировать только датчик 115 движения и/или ориентации.

Как рассматривалось выше, с MU 100 могут использоваться другие приемники ввода, такие как мышь/стилус. CAM 120 может включать в себя другие функции, которые используются совместно с этими другими приемниками ввода. Например, другие приемники ввода могут разрешать пользователю мгновенный предварительный просмотр пиктограммы в качестве подсказки. В таком варианте осуществления пиктограмма может быть мгновенно увеличена для обеспечения более хорошего вида пиктограммы для пользователя. Как рассматривалось выше, для указания пользователю движения и/или ориентации, связанного с пиктограммой, может воспроизводиться аудиоподсказка.

Фиг. 3 показывает способ 300 указания движения и/или ориентации, которое активирует команду, в соответствии с примерным вариантом осуществления. Способ 300 может предполагать, что отображаемые пиктограммы интерфейса пользователя уже связаны с движениями и/или ориентациями и действиями. Способ 300 также может предполагать, что только движение и/или ориентация используется для выполнения действия. Тем не менее, следует отметить, что другие приемники ввода и/или факторы также могут быть связаны с выполнением действия. Способ 300 будет рассмотрен со ссылкой на MU 100 на Фиг. 1 и дисплей 125 на Фиг. 2.

На этапе 305 процессор 105 определяет интерфейс пользователя, который будет отображаться. Как рассмотрено выше, процессор 105 выполняет стандартные функциональные возможности, такие как приложения/программы MU 100. Приложение может включать в себя интерфейс пользователя, в котором пользователю разрешено осуществлять ввод. На этапе 310 процессор 105 определяет команды, которые будут отображаться с помощью интерфейса пользователя. Например, как показано на дисплее 125 на Фиг. 2, команды могут включать в себя первый элемент 130 управления, второй элемент 140 управления, команду 150 назад, команду 160 домой и команду 170 входа в систему.

На этапе 315 выполняется определение, являются ли некоторые из команд активируемыми движением и/или ориентацией. Как рассмотрено выше, MU 100 может быть выполнено с датчиком 115 движения и/или ориентации, который принимает данные датчика, которые могут использоваться для указания того, должно ли быть выполнено действие. MU 100 также может быть выполнено с возможностью предоставления возможности пользователю связывать движения и/или ориентации с действиями, и/или оно может иметь настройки по умолчанию движений и/или ориентаций, связанных с действиями. Если, по меньшей мере, одна из команд является активируемой движением и/или ориентацией, то способ 300 переходит к этапу 320.

На этапе 320 процессор 105 получает доступ к CAM 120, чтобы определить движения и/или ориентации, связанные с соответствующими командами. Обращаясь к дисплею 125 на Фиг. 2, первый элемент 130 управления имеет связанное движение в виде поворота MU 100 направо; второй элемент 140 управления имеет связанное движение в виде ориентации MU 100 на сервер; команда 150 назад имеет связанное движение в виде встряхивания MU 100 влево; команда 160 «домой» имеет связанное движение в виде перемещения MU 100 вверх и вниз; и команда 170 входа в систему имеет связанное движение в виде персонализированного движения.

На этапе 325 процессор 105 получает доступ к CAM 120, чтобы определить связанную пиктограмму со связанными движениями и/или ориентациями соответствующих команд. Обращаясь к дисплею 125 на Фиг. 2, указанное выше движение для первого элемента 130 управления связано с пиктограммой 135; указанное выше движение для второго элемента 140 управления связано с пиктограммой 145; указанное выше движение для команды 150 назад связано с пиктограммой 155; указанное выше движение для команды 160 домой связано с пиктограммой 165; и указанное выше движение для команды 170 входа в систему связано с пиктограммой 175.

На этапе 330 процессор 105 подготавливает отображение команды с соответствующей пиктограммой. Таким образом, на этапе 335 дисплей 125 показывает интерфейс пользователя, включающий в себя команды вместе со связанными пиктограммами. Т.е. показывается дисплей 125, как проиллюстрировано на Фиг. 2.

Следует отметить, что интерфейс пользователя может включать в себя команды, которые не имеют связанное с ним движение и/или ориентацию. Т.е. некоторые команды, показываемые интерфейсом пользователя, могут активироваться с помощью любых других средств ввода, таких как сенсорные данные, мышь, стилус и т.д. Способ 300 учитывает такие команды на этапе 315 определения, когда эти команды просто показываются на дисплее 125.

Примерные варианты осуществления обеспечивают усовершенствованное средство использования активируемых движением и/или ориентацией команд на мобильном блоке. Когда дисплей мобильного блока показывает интерфейс пользователя, включающий в себя множество команд, то каждая активируемая движением и/или ориентацией команда дополнительно отображается с пиктограммой, которая указывает движение и/или ориентацию, которое выполняется для активации команды. Пиктограмма показывает пользователю интуитивно понятное изображение, которое позволяет пользователю определить движение и/или ориентацию. Мобильный блок может быть дополнительно выполнен с другими подсказками для указания пользователю движения и/или ориентации, которое связано с активацией команды.

Специалистам в соответствующей области будет очевидно, что в отношении настоящего изобретения могут быть сделаны различные модификации, не отступая от сущности и объема изобретения. Таким образом, предполагается, что настоящее изобретение охватывает модификации и вариации данного изобретения, рассматривая их как находящиеся в рамках объема прилагаемой формулы изобретения и ее эквивалентов.

| название | год | авторы | номер документа |

|---|---|---|---|

| ИНТЕРФЕЙС ПОЛЬЗОВАТЕЛЯ ДЛЯ УПРАВЛЕНИЯ ПРИЛОЖЕНИЕМ МОБИЛЬНОГО УСТРОЙСТВА | 2013 |

|

RU2635231C2 |

| СПОСОБ ВЫПОЛНЕНИЯ ФУНКЦИИ УСТРОЙСТВА И УСТРОЙСТВО ДЛЯ ВЫПОЛНЕНИЯ СПОСОБА | 2014 |

|

RU2635246C2 |

| ИНТЕРФЕЙС ПОЛЬЗОВАТЕЛЯ ДЛЯ УПРАВЛЕНИЯ ПРИЛОЖЕНИЕМ МОБИЛЬНОГО УСТРОЙСТВА | 2009 |

|

RU2477879C2 |

| СПОСОБ ВЫПОЛНЕНИЯ ФУНКЦИИ УСТРОЙСТВА И УСТРОЙСТВО ДЛЯ ВЫПОЛНЕНИЯ СПОСОБА | 2014 |

|

RU2744816C2 |

| СИСТЕМА ДИСТАНЦИОННОГО УПРАВЛЕНИЯ, ПОЗВОЛЯЮЩАЯ ОБОЙТИСЬ БЕЗ ВИЗУАЛЬНОГО КОНТРОЛЯ УСТРОЙСТВА УПРАВЛЕНИЯ И ОБЕСПЕЧИВАЮЩАЯ ВИЗУАЛЬНУЮ ОБРАТНУЮ СВЯЗЬ | 2012 |

|

RU2594178C2 |

| НОСИМОЕ ЭЛЕКТРОННОЕ УСТРОЙСТВО | 2013 |

|

RU2614575C2 |

| ВВОД ЖЕСТА ПОЛЬЗОВАТЕЛЕМ НА НОСИМОМ ЭЛЕКТРОННОМ УСТРОЙСТВЕ, ВКЛЮЧАЮЩИЙ В СЕБЯ ДВИЖЕНИЕ УСТРОЙСТВА | 2013 |

|

RU2623805C2 |

| ПЕРЕХОДЫ ГРАФИЧЕСКОГО ПОЛЬЗОВАТЕЛЬСКОГО ИНТЕРФЕЙСА (GUI) НА НОСИМОМ ЭЛЕКТРОННОМ УСТРОЙСТВЕ | 2013 |

|

RU2641462C2 |

| ПЕРЕХОДЫ ГРАФИЧЕСКОГО ПОЛЬЗОВАТЕЛЬСКОГО ИНТЕРФЕЙСА (GUI) НА НОСИМОМ ЭЛЕКТРОННОМ УСТРОЙСТВЕ | 2013 |

|

RU2754525C2 |

| ДЕЛЕГИРОВАНИЕ ОБРАБОТКИ ИЗ НОСИМОГО ЭЛЕКТРОННОГО УСТРОЙСТВА | 2013 |

|

RU2621975C2 |

Изобретение относится к мобильному блоку и способу активирования сенсорно активируемой команды. Техническим результатом является обеспечение представления пользователю пиктограмм, представляющих движения и/или ориентации, которые активируют различные команды. Мобильный блок для активирования сенсорно активируемой команды содержит процессор, память и дисплей, отображающий интерфейс пользователя, в котором каждая сенсорно активируемая команда из множества команд показывается с соответствующей пиктограммой, выбранной из библиотеки пиктограмм, которая фильтруется в зависимости от одной или более сенсорно активируемых команд, соответствующая пиктограмма указывает выбранную ориентацию мобильного блока, назначенную сенсорно активируемой команде, и выбор ориентации мобильного блока фильтруется в созданном пользователем интерфейсе, чтобы деактивировать выбор ориентаций, которые приведут к пересечению между командами; и датчик, определяющий ориентацию мобильного блока, которая активирует соответствующую сенсорно активируемую команду. 2 н. и 15 з.п. ф-лы, 3 ил.

1. Мобильный блок для активирования сенсорно активируемой команды, содержащий:

процессор;

память; и

дисплей, отображающий интерфейс пользователя, включающий в себя множество команд, при этом каждая сенсорно активируемая команда из множества команд показывается с соответствующей пиктограммой, выбранной из библиотеки пиктограмм, которая фильтруется в зависимости от одной или более сенсорно активируемых команд, при этом соответствующая пиктограмма указывает выбранную ориентацию мобильного блока, назначенную сенсорно активируемой команде, и при этом выбор ориентации мобильного блока фильтруется в созданном пользователем интерфейсе, чтобы деактивировать выбор некоторых ориентаций, которые приведут к пересечению между командами; и

датчик, определяющий ориентацию мобильного блока, при этом ориентация мобильного блока активирует соответствующую сенсорно активируемую команду.

2. Мобильный блок по п. 1, в котором сенсорно активируемые команды связаны с установленными по умолчанию ориентациями мобильного блока и соответствующими установленными по умолчанию пиктограммами.

3. Мобильный блок по п. 1, в котором выбор одной из сенсорно активируемых команд связан с персонализированными движениями и персонализированными пиктограммами.

4. Мобильный блок по п. 1, дополнительно содержащий:

громкоговоритель, воспроизводящий аудиоподсказки, указывающие ориентацию мобильного блока.

5. Мобильный блок по п. 1, в котором датчик является одним из акселерометра, магнитометра, гироскопа и их комбинации.

6. Мобильный блок по п. 1, дополнительно содержащий:

по меньшей мере одно дополнительное устройство приема ввода, при этом датчик и по меньшей мере одно дополнительное устройство приема ввода используются для активации соответствующей сенсорно активируемой команды.

7. Мобильный блок по п. 6, в котором датчик включает в себя датчик движения и указанное по меньшей мере одно дополнительное устройство приема ввода является сенсорным экраном, при этом датчик движения выполнен с возможностью принимать исходные сенсорные данные, промежуточные сенсорные данные и конечные сенсорные данные, вследствие чего мобильный блок затем может экстраполировать движение, выполненное по сенсорному дисплею с использованием сенсорных данных.

8. Мобильный блок по п. 7, в котором процессор сравнивает последовательность движений из датчика движения с множеством шаблонов движений, хранящихся в памяти, чтобы определить, совпадает ли последовательность с любым из шаблонов движения.

9. Мобильный блок по п. 6, в котором по меньшей мере одно дополнительное устройство приема ввода является одним из окружающих и биологическим датчиком, и при этом по меньшей мере одно дополнительное устройство приема ввода и датчик действуют во взаимодействии, чтобы выбрать сенсорно активируемую команду.

10. Способ активирования сенсорно активируемой команды, содержащий этапы, на которых

отображают интерфейс пользователя, включающий в себя множество команд на дисплее мобильного блока, сенсорно активируемую команду из множества команд, показанную с соответствующей пиктограммой, выбранной из библиотеки пиктограмм, которая фильтруется в зависимости от одной или более сенсорно активируемых команд, при этом соответствующая пиктограмма указывает выбранную ориентацию мобильного блока, назначенную сенсорно активируемой команде, и при этом выбор ориентации мобильного блока фильтруется в созданном пользователем интерфейсе, чтобы деактивировать выбор некоторых ориентаций, которые приведут к пересечению между командами; и

определяют ориентацию мобильного блока датчиком, при этом ориентация мобильного блока активирует соответствующую сенсорно активируемую команду.

11. Способ по п. 10, в котором ориентация мобильного блока выбирается из списка доступных ориентаций, а сенсорная пиктограмма выбирается из списка доступных пиктограмм.

12. Способ по п. 11, в котором выбор ориентации мобильного блока выбирается из шаблона жестов.

13. Способ по п. 10, дополнительно содержащий этап, на котором

формируют предварительный просмотр сенсорной пиктограммы.

14. Способ по п. 11, в котором ориентация мобильного блока классифицируется по типам классов.

15. Способ по п. 14, в котором сенсорные пиктограммы связаны с соответствующим одним из типов классов.

16. Способ по п. 14, в котором список доступных ориентаций и список доступных пиктограмм фильтруются в зависимости от типов классов для выбора ориентации мобильного блока и сенсорной пиктограммы.

17. Способ по п. 10, в котором интерфейс пользователя включает в себя по меньшей мере одну дополнительную сенсорно активируемую команду, причем каждая из по меньшей мере одной дополнительной сенсорно активируемой команды показывается с соответствующей дополнительной пиктограммой.

| Пресс для выдавливания из деревянных дисков заготовок для ниточных катушек | 1923 |

|

SU2007A1 |

| US 6057845 A, 02.05.2000 | |||

| СПОСОБ ПРИЕМА ВВОДОВ ОТ ПОЛЬЗОВАТЕЛЯ ЭЛЕКТРОННОГО УСТРОЙСТВА | 2004 |

|

RU2391696C2 |

| СПОСОБ И УСТРОЙСТВО ДЛЯ ПРОСМОТРА ИНФОРМАЦИИ НА ДИСПЛЕЕ | 2002 |

|

RU2288512C2 |

Авторы

Даты

2015-12-20—Публикация

2011-08-15—Подача