[0001] Настоящая заявка испрашивает приоритет предварительной заявки на патент США №61/705119, поданной 24 сентября 2012 и предварительной заявки на патент США №61/708475, поданной 1 октября 2012, содержимое каждой из которых включены по ссылке в их полноте.

ОБЛАСТЬ ТЕХНИКИ

[0002] Настоящее раскрытие относится к кодированию видео.

УРОВЕНЬ ТЕХНИКИ

[0003] Цифровые видео способности могут быть включены в широкий диапазон устройств, включая цифровые телевизоры, цифровые системы прямого вещания, беспроводные системы вещания, персональные цифровые помощники (PDAs), ноутбуки или настольные компьютеры, планшетные компьютеры, считыватели электронных книг, цифровые камеры, устройства цифровой записи, цифровые медиаплееры, устройства видео игр, пульты видеоигр, сотовые или спутниковые радио-телефоны, так называемые “смартфоны,” устройства организации видео телеконференций, устройства потоковой передачи видео, и т.п. Цифровые видео устройства реализуют способы сжатия видео, такие как описанные в стандартах, определенных посредством MPEG-2, MPEG-4, ITU-T H.263, ITU-T H.264/MPEG-4, Часть 10, Усовершенствованное видео кодирование (AVC), стандарт высокоэффективного кодирования видео (HEVC), и расширения таких стандартов. Видео устройства могут передавать, принимать, кодировать, декодировать, и/или хранить цифровую видео информацию более эффективно, реализовывая такие способы сжатия видео.

[0004] Способы сжатия видео выполняют пространственное (внутри картинки) предсказание и/или временное (между картинками) предсказание, чтобы уменьшить или удалить избыточность, присущую видео последовательностям. Для основанного на блоках кодирования видео видео вырезка (то есть, видео кадр или часть видео кадра) может быть разделена на блоки видео, которые могут также упоминаться как блоки дерева, единицы кодирования (CUs), и/или узлы кодирования. Блоки видео во внутренне кодированной (I) вырезке картинки закодированы, используя пространственное предсказание относительно опорных выборок в соседних блоках в той же самой картинке. Блоки видео во внешне кодированной (P или B) вырезке картинки могут использовать пространственное предсказание относительно опорных выборок в соседних блоках в той же самой картинке или временное предсказание относительно опорных выборок в других опорных картинках. Картинки могут упоминаться как кадры, и опорные картинки могут упоминаться как опорные кадры.

[0005] Пространственное или временное предсказание приводит к предсказывающему блоку для блока, который должен быть закодирован. Остаточные данные представляют пиксельные разности между первоначальным блоком, который должен быть закодирован, и предсказывающим блоком. Внешне кодированный блок закодирован согласно вектору движения, который указывает на блок опорных выборок, формирующих предсказывающий блок, и остаточным данным, указывающим разность между закодированным блоком и предсказывающим блоком. Внутренне кодированный блок закодирован согласно режиму внутреннего кодирования и остаточным данным. Для дальнейшего сжатия остаточные данные могут быть преобразованы из пиксельной области в область преобразования, приводя к остаточным коэффициентам преобразования, которые затем могут быть квантованы. Квантованные коэффициенты преобразования, первоначально размещенные в двумерном массиве, могут сканироваться, чтобы сформировать одномерный вектор коэффициентов преобразования, и энтропийное кодирование может быть применено, чтобы достигнуть даже большей степени сжатия.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

[0006] В целом, способы, описанные в настоящем раскрытии, относятся к сигнализации и выведению времен удаления из буфера кодированных картинок при кодировании видео.

[0007] В одном примере способы, описанные в настоящем раскрытии, относятся к способу для декодирования данных видео. Способ может включать в себя декодирование длительности между удалением из буфера кодированных картинок (CPB) первой единицы декодирования (DU) в единице доступа (AU) и удалением из CPB второй DU, при этом вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU как первая DU. Способ может также включать в себя определение времени удаления первой DU на основании, по меньшей мере частично, декодированной длительности и декодирование видео данных первой DU на основании, по меньшей мере частично, времени удаления.

[0008] В другом примере способы, описанные в настоящем раскрытии, относятся к способу для кодирования видео данных. Способ может включать в себя кодирование длительности между удалением из CPB первой DU в AU и удалением из CPB второй DU, при этом вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU как первая DU. Способ может также включать в себя определение времени удаления первой DU на основании, по меньшей мере частично, закодированной длительности.

[0009] В еще одном примере обеспечено устройство кодирования видео, содержащее кодировщик видео. Видео кодировщик сконфигурирован, чтобы закодировать длительность между удалением из CPB первой DU в AU и второй DU, при этом вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU как первая DU. Видео кодировщик также сконфигурирован, чтобы определить время удаления DU, на основании по меньшей мере закодированной длительности.

[0010] Способы, описанные в настоящем описании, также включают в себя пример считываемого компьютером запоминающего носителя, имеющего сохраненные на нем инструкции, которые, когда выполняются, вынуждают процессор устройства для кодирования видео данных закодировать длительность между удалением из CPB первой DU в AU и второй DU, при этом вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU как первая DU. Инструкции, когда выполняются, также вынуждают процессор определять время удаления DU, на основании по меньшей мере закодированной длительности.

[0011] В другом примере способы, описанные в настоящем раскрытии, относятся к устройству кодирования видео. Устройство кодирования видео может включать в себя средство для кодирования длительности между удалением из буфера кодированных картинок (CPB) первой единицы декодирования (DU) в единице доступа (AU) и второй DU, при этом вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU как первая DU. Устройство кодирования видео может также включать в себя средство для определения времени удаления DU, на основании по меньшей мере закодированной длительности.

[0012] Эти примерные способы могут быть реализованы вместе или по отдельности. Способы настоящего раскрытия также описаны в терминах устройств, конфигурируемых, чтобы реализовать способы, так же как считываемых компьютером запоминающих носителей, хранящих инструкции, которые заставляют один или более процессоров выполнять эти способы.

[0013] Подробности одного или более примеров сформулированы в сопроводительных чертежах и описании ниже. Другие признаки, задачи и преимущества будут очевидны из описания и чертежей, и из формулы изобретения.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

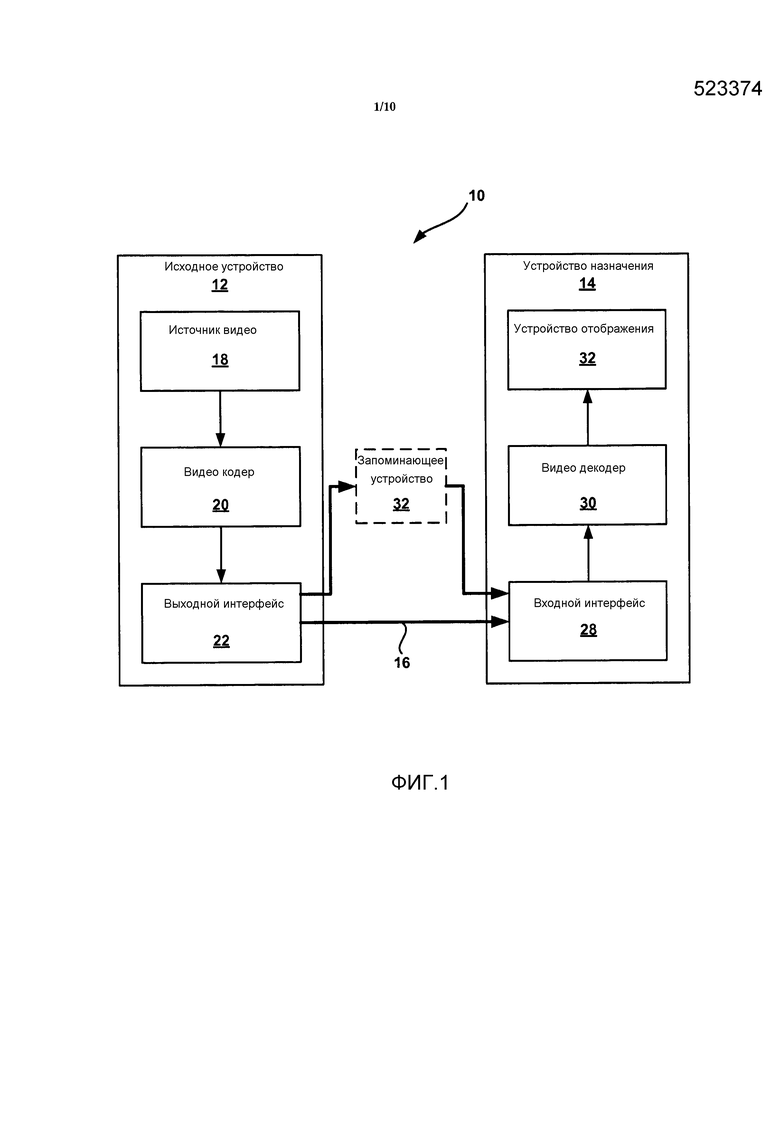

[0014] Фиг. 1 является блок-схемой, иллюстрирующей примерную систему кодирования и декодирования видео, которая может использовать способы, описанные в настоящем раскрытии.

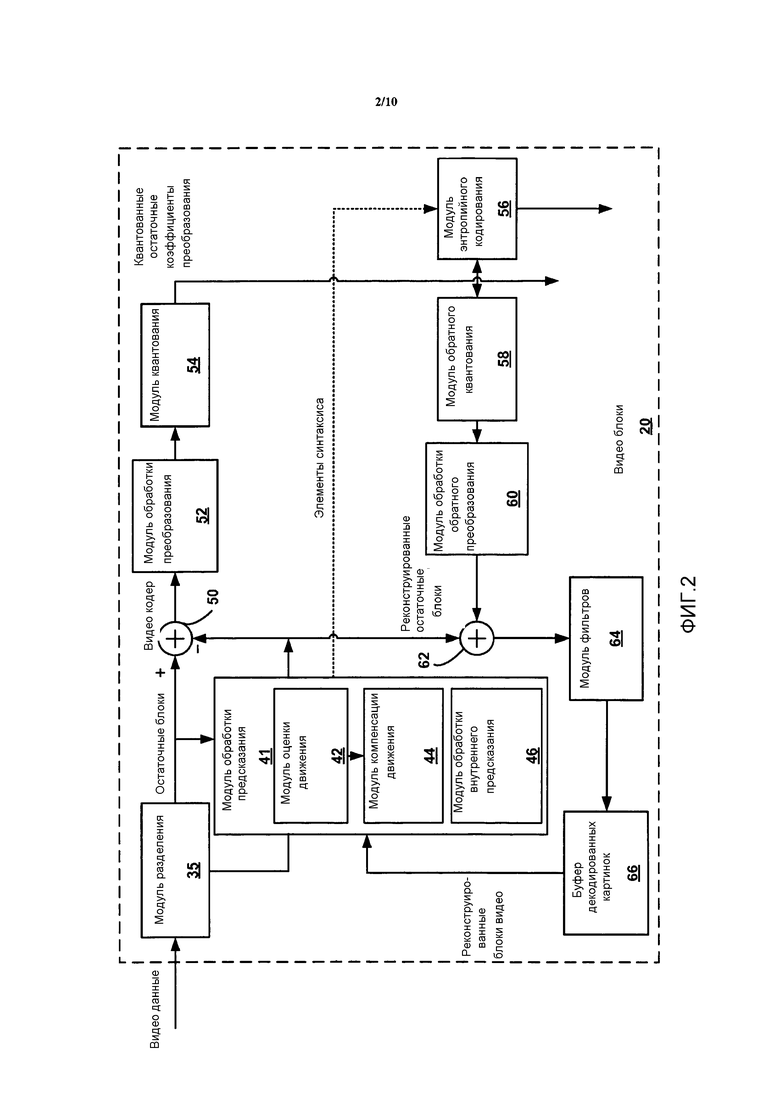

[0015] Фиг. 2 является блок-схемой, иллюстрирующей примерный кодер видео, который может реализовать способы, описанные в настоящем раскрытии.

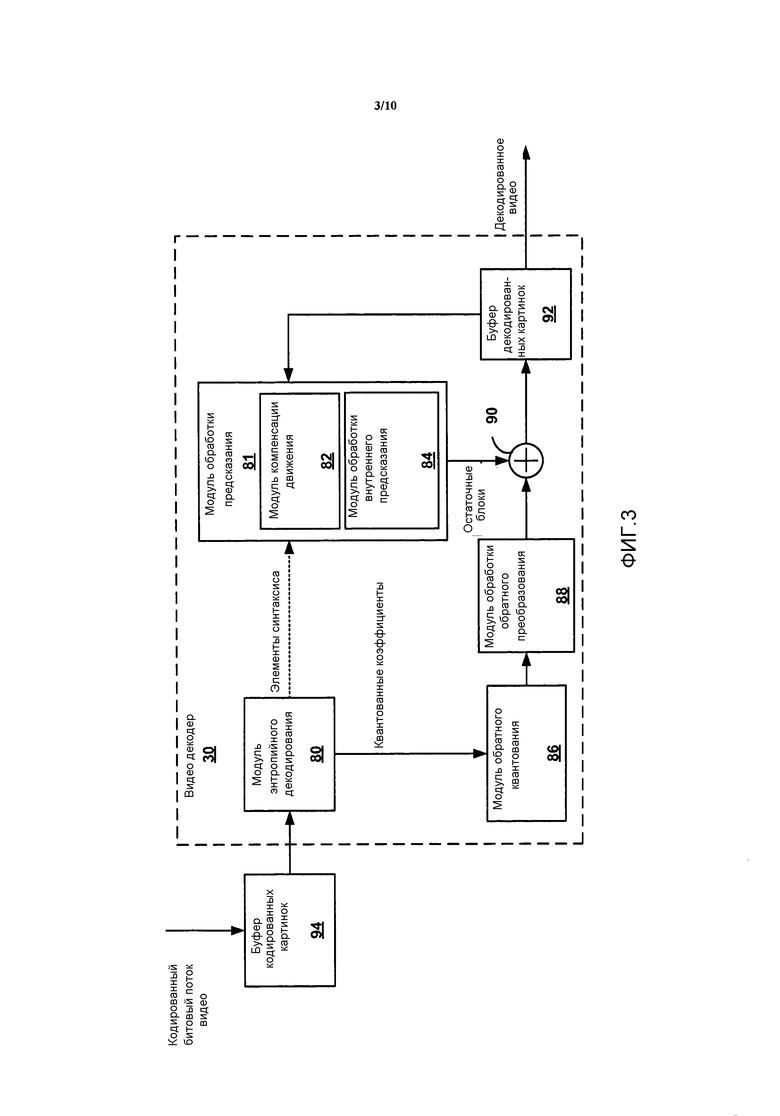

[0016] Фиг. 3 является блок-схемой, иллюстрирующей примерный декодер видео, который может реализовать способы, описанные в настоящем раскрытии.

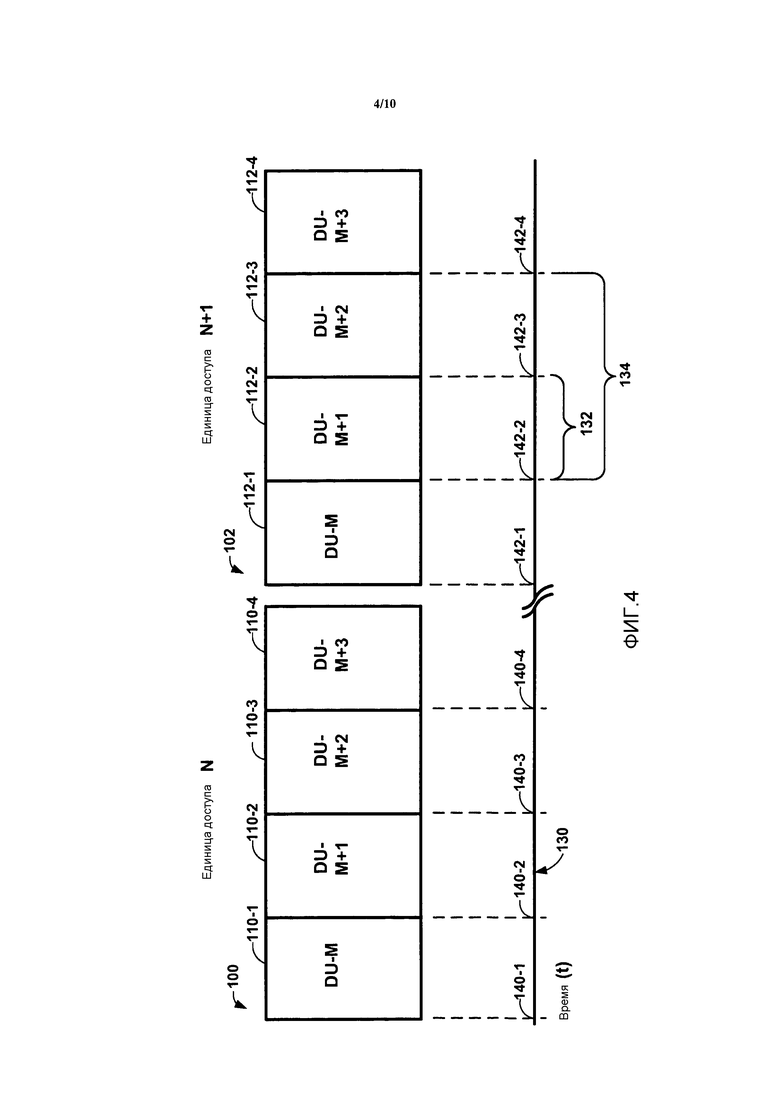

[0017] Фиг. 4 является концептуальной диаграммой, иллюстрирующей две единицы доступа (AU) в последовательном порядке декодирования, которые могут иметь времена декодирования, определенные согласно способам, описанным в настоящем раскрытии.

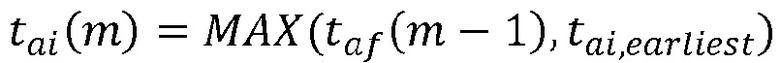

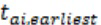

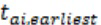

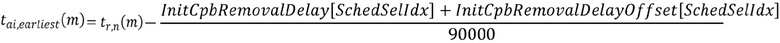

[0018] Фиг. 5 является последовательностью операций, иллюстрирующей способ для определения времени удаления из буфера кодированных картинок (CPB) первой единицы декодирования (DU) в AU на основании времени удаления из CPB для второй DU AU согласно способам, описанным в настоящем раскрытии.

[0019] Фиг. 6 является последовательностью операций, иллюстрирующей другой способ для определения времени удаления из буфера кодированных картинок (CPB) первой единицы декодирования в единице доступа на основании времени удаления из CPB для второй единицы декодирования единицы доступа согласно способам, описанным в настоящем раскрытии.

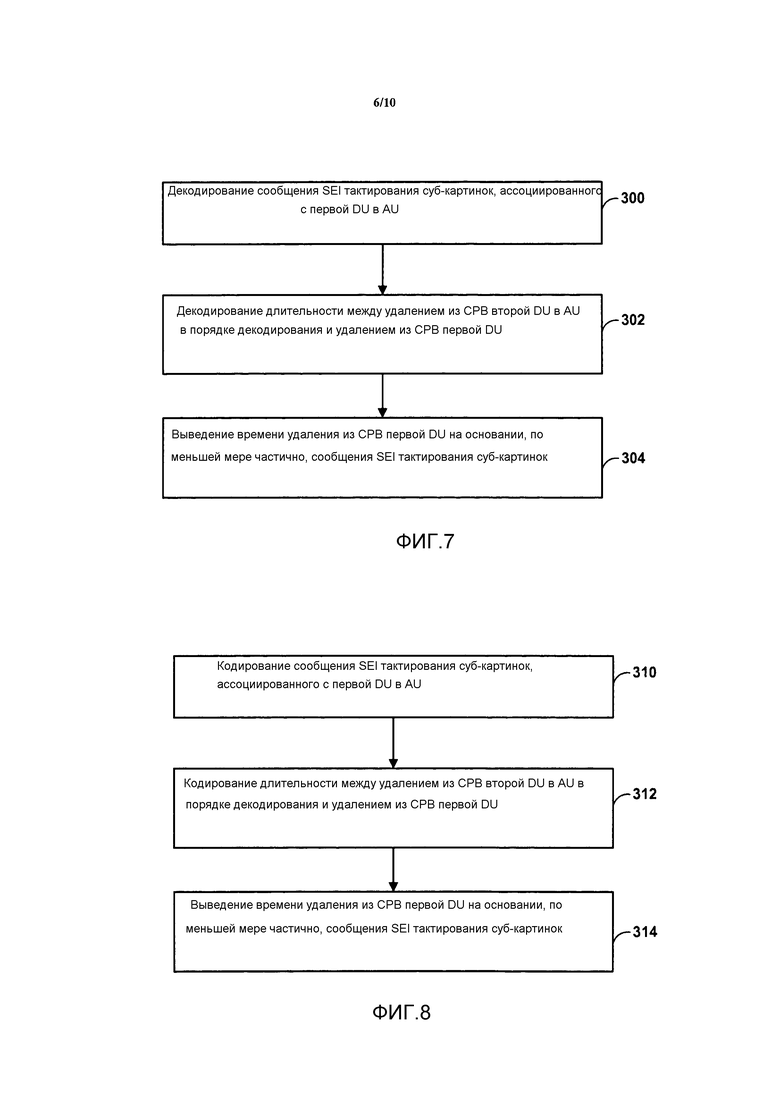

[0020] Фиг. 7 является последовательностью операций, иллюстрирующей способ для выведения времени удаления из CPB первой DU на основании, по меньшей мере частично, сообщения SEI тактирования суб-картинок согласно способам, описанным в настоящем раскрытии.

[0021] Фиг. 8 является последовательностью операций, иллюстрирующей другой способ для выведения времени удаления из CPB первой DU, на основании, по меньшей мере частично, кодирования сообщения SEI тактирования суб-картинок согласно способам, описанным в настоящем раскрытии.

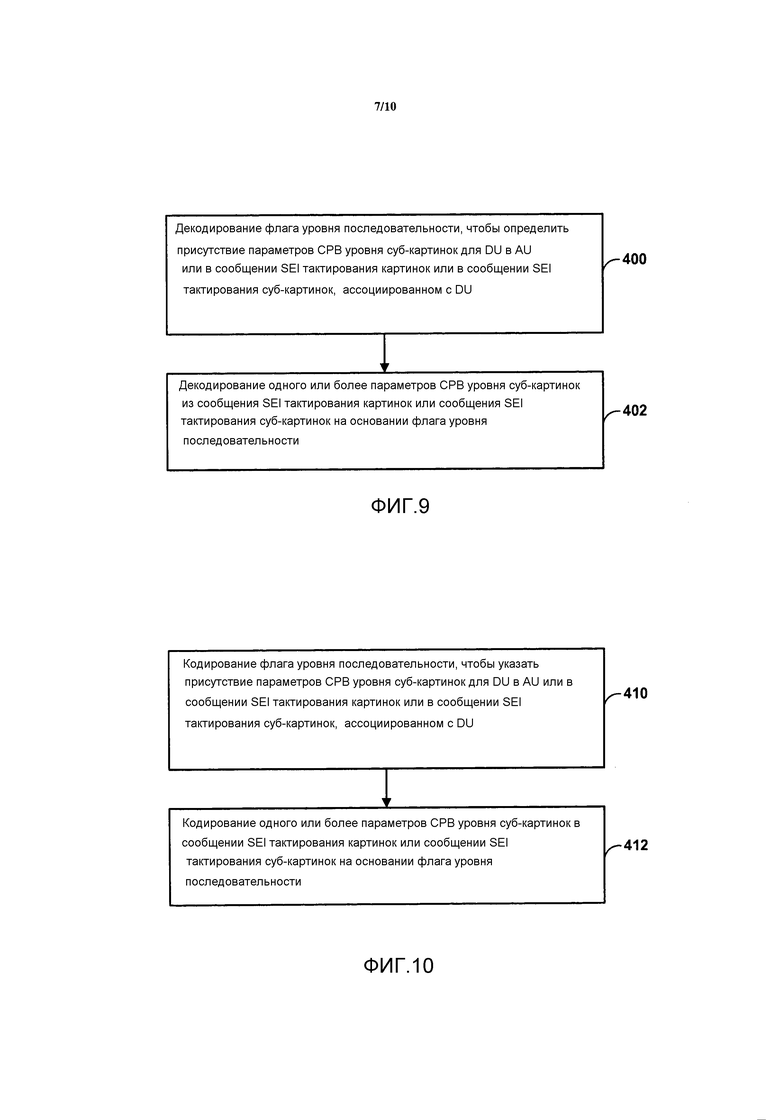

[0022] Фиг. 9 является последовательностью операций, иллюстрирующей способ для декодирования флага уровня последовательности для параметра буфера кодированных картинок уровня суб-картинки согласно способам, описанным в настоящем раскрытии.

[0023] Фиг. 10 является последовательностью операций, иллюстрирующей способ для кодирования флага уровня последовательности для параметра буфера кодированных картинок уровня суб-картинки согласно способам, описанным в настоящем раскрытии.

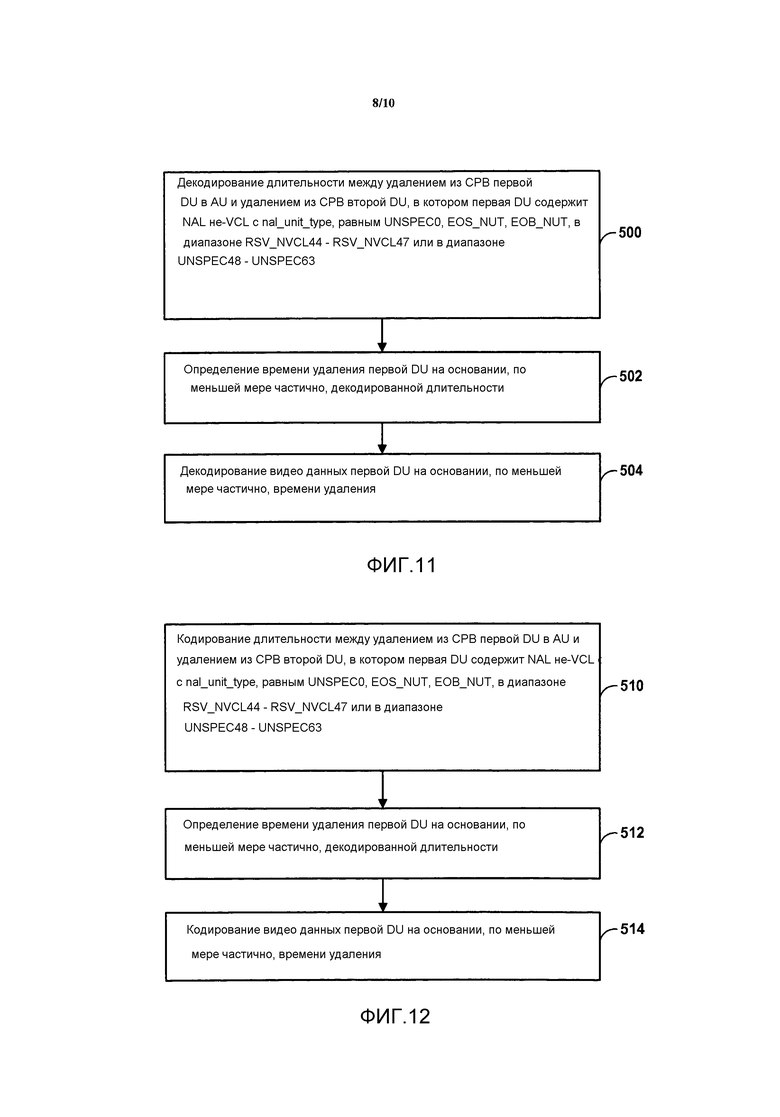

[0024] Фиг. 11 является последовательностью операций, иллюстрирующей способ для декодирования DU, имеющей расширенное определение согласно способам, описанным в настоящем раскрытии.

[0025] Фиг. 12 является последовательностью операций, иллюстрирующей способ для кодирования DU, имеющей расширенное определение, согласно способам, описанным в настоящем раскрытии.

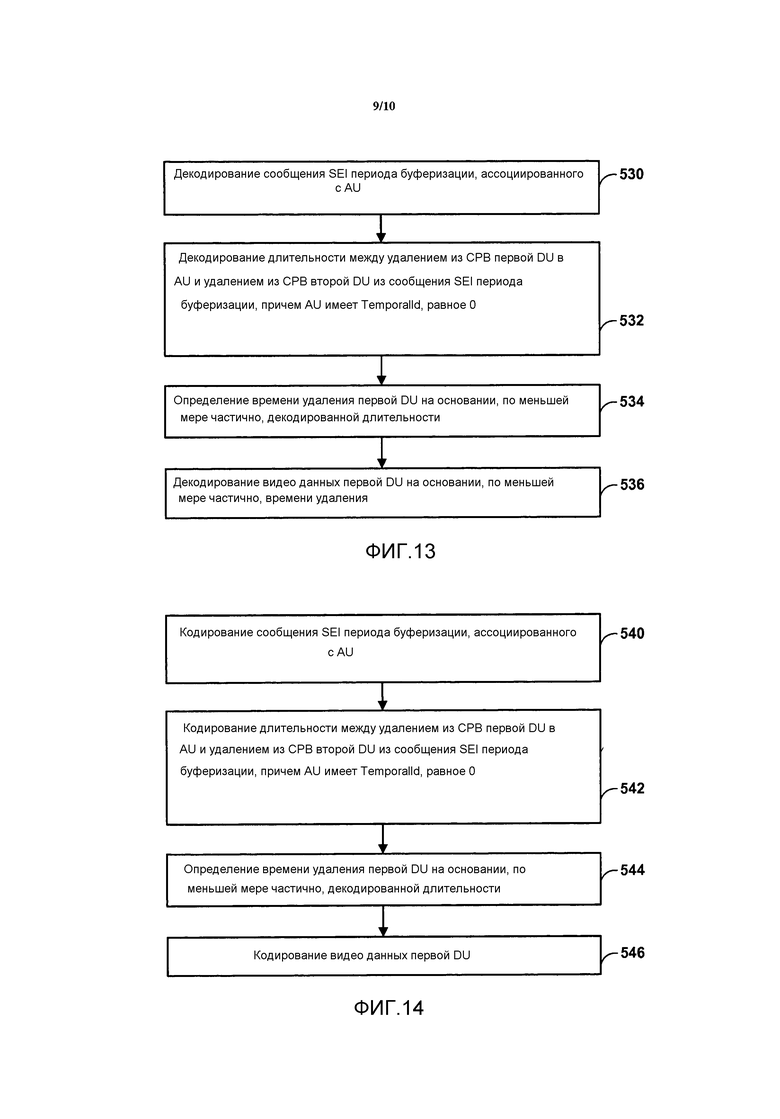

[0026] Фиг. 13 является последовательностью операций, иллюстрирующей способ для декодирования периода буферизации согласно способам, описанным в настоящем раскрытии.

[0027] Фиг. 14 является последовательностью операций, иллюстрирующей способ для кодирования периода буферизации согласно способам, описанным в настоящем раскрытии.

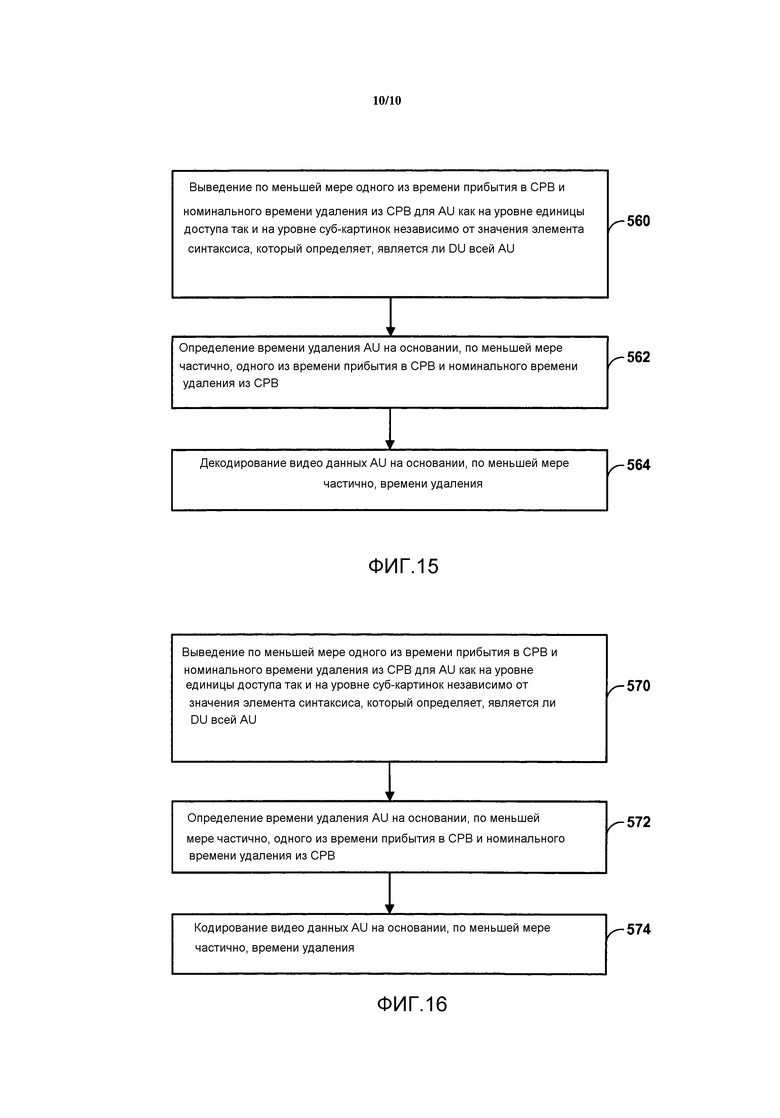

[0028] Фиг. 15 является последовательностью операций, иллюстрирующей способ для декодирования времени прибытии и номинального времени удаления из буфера кодированных картинок согласно способам, описанным в настоящем раскрытии.

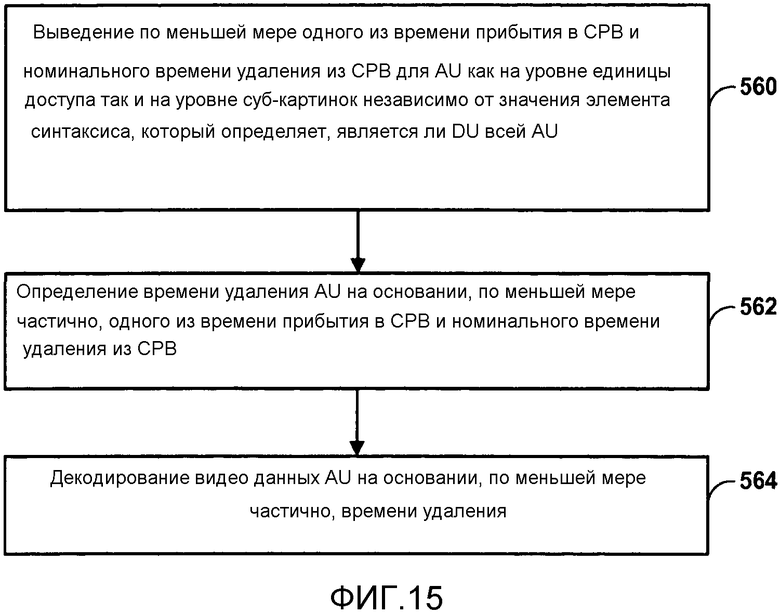

[0029] Фиг. 16 является последовательностью операций, иллюстрирующей способ для кодирования времени прибытия и номинального времени удаления из буфера кодированных картинок согласно способам, описанным в настоящем раскрытии.

ПОДРОБНОЕ ОПИСАНИЕ

[0030] Настоящее раскрытие описывает способы для устойчивой к ошибкам и эффективной сигнализации и выведению времен удаления из буфера кодированных картинок (CPB) закодированных единиц данных при кодировании видео. Времена удаления (извлечения) из CPB также известны как времена декодирования. Раскрытие обеспечивает способы для определения времени удаления из CPB для единицы декодирования (DU) единицы доступа (AU), которое является независимым от времен удаления любой другой AU. Например, времена удаления из CPB для текущей DU в AU будут сигнализированы на основании или длительности между временем удаления из CPB следующей DU в порядке декодирования в AU и текущей DU или длительности между временем удаления из CPB последней DU в AU и текущей DU. В другом примере выведение времени удаления из CPB определено таким способом, который использует информацию, которую переносят в сообщении дополнительной информации расширения (SEI) тактирования суб-картинок. Длительность между временем удаления из CPB последней DU в AU в порядке декодирования и DU, ассоциированной с сообщением (SEI) тактирования суб-картинок, сигнализируется.

[0031] Далее, предоставлены способы для включения флага уровня последовательности, который может быть сигнализирован, чтобы указывать, контролируют ли параметры CPB суб-картинки только в одном из сообщений SEI тактирования картинок или сообщений SEI тактирования суб-картинок, но никогда в обоих, согласно способам, описанным в настоящем описании. Флаг, равный 1, указывает, что параметры задержки удаления из CPB на уровне суб-картинок присутствуют в сообщениях SEI тактирования картинок и не присутствуют в сообщениях SEI тактирования суб-картинок. Флаг, равный 0, указывает, что параметры задержки удаления из CPB на уровне суб-картинок присутствуют в сообщениях SEI тактирования суб-картинок и сообщения SEI тактирования картинок не включают в себя параметры задержки удаления из CPB на уровне суб-картинок.

[0032] Настоящее раскрытие также обеспечивает способы для расширения определения единицы декодирования. Настоящее раскрытие далее обеспечивает способы для ограничения сообщений SEI периода буферизации и сообщений SEI точки восстановления таким образом, что они не могут быть ассоциированы с единицами AU с переменной, TemporalId, большей чем 0. Переменная TemporalId выводится из элемента синтаксиса, ассоциированного с каждой AU. Настоящее раскрытие также обеспечивает способы для обеспечения флага, чтобы сигнализировать, выводить ли времена удаления из CPB на уровне AU или уровне суб-картинок.

[0033] Способы, описанные в настоящем описании, могут относиться к различным стандартам кодирования видео. Стандарты кодирования видео включают в себя ITU-T H.261, ISO/IEC MPEG-1 Visual, ITU-T H.262 или ISO/IEC MPEG-2 Visual, ITU-T H.263, ISO/IEC MPEG-4 Visual и ITU-T H.264 (также известный как ISO/IEC MPEG-4 AVC), включая его расширения масштабируемое кодирование видео (SVC) и кодирование видео с множественными видами (MVC).

[0034] Кроме того, имеется новый стандарт кодирования видео, а именно, высокоэффективное кодирование видео (HEVC), развиваемый объединенной командой сотрудничества по кодированию видео (JCT-VC) группы экспертов по кодированию видео ITU-T (VCEG) и ISO/IEC группы экспертов по движущимся изображениям (MPEG). Недавний рабочий проект (WD) HEVC Working Draft 8, и упомянутый в дальнейшем как HEVC WD8. Bross et. al, High Efficiency Video Coding (HEVC) Text Specification Draft 8, July 2012, Stockholm, available as of May 2, 2013 from http://phenix.int-evry.fr/jct/doc_end_user/documents/10_Stockholm/wg11/JCTVC-J1003-v8.zip.

[0035] HEVC WD8 включен по ссылке полностью в настоящее описание. Кроме того, хотя способы, описанные в настоящем раскрытии, описаны относительно стандарта HEVC, аспекты настоящего раскрытия этим не ограничены и могут быть расширены на другие стандарты кодирования видео, так же как составляющие собственность способы кодирования видео.

[0036] Видео кодер может генерировать поток битов, который включает в себя закодированные видео данные. Поток битов может содержать последовательность единиц уровня абстракции сети (NAL). Единицы NAL потока битов могут включать в себя единицы NAL уровня кодирования видео (VCL) и единицы NAL не-VCL. Единицы NAL VCL могут включать в себя закодированные вырезки картинок. Единица NAL не-VCL может включать в себя набор параметров видео (VPS), набор параметров последовательности (SPS), набор параметров картинки (PPS), дополнительную информацию расширения (SEI), или другие типы данных. VPS является синтаксической структурой, которая может содержать элементы синтаксиса, которые применяются к нулю или более полностью закодированным видео последовательностям. SPS является синтаксической структурой, которая может содержать элементы синтаксиса, которые применяются к нулю или более полностью закодированным видео последовательностям. Единственный VPS может быть применимым ко множественным SPS. PPS является синтаксической структурой, которая может содержать элементы синтаксиса, которые применяются к нулю или более полностью закодированным картинкам. Единственный SPS может быть применимым ко множественным PPS. Различные аспекты VPS, SPS и PPS могут быть сформированы, вообще, как определено по стандарту HEVC.

[0037] Единицы NAL могут включать в себя элемент синтаксиса, который является указывающим значения переменной temporalId. Это значение temporalId единицы NAL задает временный идентификатор единицы NAL. Если временный идентификатор первой единицы NAL меньше, чем временный идентификатор второй единицы NAL, данные, инкапсулированные первой единицей NAL, могут быть декодированы независимо от данных, инкапсулированных второй единицей NAL.

[0038] Каждый стандарт кодирования видео обычно включает в себя спецификацию модели буферизации видео. В AVC и HEVC модель буферизации упоминается как гипотетический опорный декодер (HRD), который описывает, как данные должны быть буферизованы для декодирования и как декодированные данные буферизуются для вывода. HRD включает в себя модель буферизации как буфера кодированных картинок (CPB) так и буфера декодированных картинок (DPB). CPB является буфером «первый вошел - первый вышел», содержащим единицы доступа в порядке декодирования, заданном посредством HRD. DPB является буфером, хранящим декодированные картинки для ссылки на них, переупорядочения вывода или задержки вывода, заданных посредством HRD. Параметры гипотетического опорного декодера математически задают поведения CPB и DPB. HRD может непосредственно наложить ограничения на различные параметры, включая тактирования, размеры буфера, и частоты следования битов, и может косвенно наложить ограничения на характеристики потока битов и статистику. В некоторых примерах полный набор параметров HRD может включать в себя пять основных параметров: начальную задержку удаления из CPB, размер CPB, частоту следования битов, начальную задержку вывода DPB, и размер DPB.

[0039] В AVC и HEVC соответствие потока битов и соответствие декодера заданы как часть спецификации HRD. Хотя название гипотетического опорного декодера относится к роду декодера, HRD типично необходим на стороне кодера для обеспечения соответствия потока битов, в то время как не является обязательно необходимым на стороне декодера. Однако, аспекты настоящего раскрытия этим не ограничены, и HRD может быть также частью стороны декодера. AVC и HEVC могут задавать два типа потока битов или соответствия HRD, а именно, Тип I и Тип II. Кроме того, AVC и HEVC задают два типа соответствия декодера: соответствие декодера тактированию вывода и соответствие декодера порядку вывода.

[0040] В моделях HRD в AVC и HEVC декодирование или удаление из CPB основано на единицах доступа, и стандарты предполагают, что декодирование картинок является мгновенным. В практических применениях, если соответствующий декодер строго следует сигнализированным временам декодирования (например, в сообщениях дополнительной информации расширения (SEI)), чтобы начать декодирование единицы доступа, то самое раннее время, чтобы вывести конкретную декодированную картинку, равно времени декодирования этой конкретной картинки плюс время, необходимое для того, чтобы декодировать эту конкретную картинку. Таким образом, самое раннее время, чтобы вывести декодированную картинку является временем декодирования плюс время, чтобы декодировать картинку. Однако, время, необходимое для того, чтобы декодировать картинку, в практических применениях не может быть равным нулю.

[0041] В HEVC WD8 гипотетический опорный декодер (HRD) задан в Приложении C. HRD полагается на параметры HRD, которые могут быть предоставлены в потоке битов в синтаксической структуре hrd_parameters () (в наборе параметров видео (VPS) и/или наборе параметров последовательности (SPS)), сообщениях SEI периода буферизации и сообщениях SEI тактирования картинок. Предварительная заявка на патент США № 61/705,102, поданная 24 сентября 2012, предлагает расширенную сигнализацию и выбор параметров HRD.

[0042] Могут иметь место проблемы, ассоциированные с существующими способами для сигнализации и выведения времен удаления из CPB, также известных как времена декодирования. Нижеследующее описывает некоторые из этих проблем.

[0043] Времена удаления из CPB единицы декодирования могут не быть устойчивыми к ошибкам, когда времена удаления из CPB для единиц декодирования в пределах единицы доступа зависят от информации тактирования от предыдущей единицы доступа. Единица доступа может содержать одну или более единиц декодирования. Время удаления может быть определено для каждой DU в AU. Время удаления из CPB может быть сигнализировано для AU и для одной или более единиц DU в пределах AU. Сообщение SEI для AU может включать в себя время удаления из CPB для AU непосредственно, которое также соответствует времени удаления из CPB для последней DU в пределах AU.

[0044] Буфер кодированных картинок может работать на двух уровнях: уровне единицы доступа и уровне суб-картинок. Когда CPB работает на уровне суб-картинок (то есть, когда SubPicCpbFlag равен 1), сигнализация и выведение времен удаления из CPB единицы декодирования (DU), которые основаны на сообщениях SEI тактирования картинок, могут не быть устойчивыми к ошибкам в обстоятельствах, когда информация потеряна от предыдущей AU в порядке декодирования. Например, информация тактирования, которая сигнализируется для текущей AU, включает в себя длительность между временем удаления из CPB для первой DU в текущей AU и последней DU в предыдущей AU. Таким образом, если информация тактирования для последней DU в предыдущей AU потеряна, то декодер не может определить время удаления для первой DU в текущей AU, потому что время удаления для первой DU зависит от потерянной информации тактирования.

[0045] Другими словами, сигнализация длительности между временами удаления из CPB первой единицы декодирования в текущей AU и последней DU в предыдущей AU в порядке декодирования, так же как использование такой сигнализации в выведении времени удаления из CPB, делает систему или кодировщик уязвимыми к потерянной информации тактирования. Например, если информация удаления из CPB (то есть, сообщение SEI тактирования картинок) предыдущей AU, потеряна, то время удаления из CPB первой DU в текущей AU не может быть правильно выведено. Кроме того, за исключением последней DU текущей AU, для которой время удаления из CPB выведено как равное таковому из текущей AU, каждое из времен удаления из CPB всех других единиц DU в текущей AU полагается на время удаления из CPB предыдущей DU в порядке декодирования. Таким образом, если вышеупомянутая потеря случается, время удаления из CPB каждой DU в текущей AU, за исключением последней DU, не может быть правильно выведено.

[0046] Напротив, здесь описаны способы, которые могут уменьшить уязвимость системы или кодировщика к потерянной информации тактирования. Например, способы предоставлены для того, чтобы определить время удаления из буфера кодированных картинок для DU в AU, которое является независимым от времен удаления любой другой единицы доступа. Например, видео кодер будет сигнализировать, в сообщении SEI тактирования картинок, времена удаления из CPB для DU в AU, которая должна быть принята видео декодером, на основании или длительности времени между текущей DU и или временем удаления из CPB следующей DU в порядке декодирования в AU или временем удаления из CPB последней DU в AU. Таким образом, настоящее раскрытие описывает способы для обеспечения большей устойчивости к ошибкам и эффективной сигнализации и выведения времен удаления из CPB закодированных блоков данных при кодировании видео, потому что информация тактирования для каждой DU в AU не зависит от информации тактирования от другой, отличной AU.

[0047] Другая проблема, ассоциированная с существующими способами для сигнализации и выведения времен удаления из CPB, является той, что информация тактирования в сообщениях SEI тактирования суб-картинок не может быть использована даже хотя она присутствует. Например, сообщения SEI тактирования суб-картинок, несущие информацию задержки удаления из CPB DU, могут присутствовать. Однако, работа CPB на уровне суб-картинок задана способом, которым видео декодер всегда использует сообщения SEI тактирования картинок, и никогда не использует сообщения SEI тактирования суб-картинок. Таким образом, биты, использованные для представления сообщений SEI тактирования суб-картинок, могут быть потрачены впустую. Кроме того, задержка удаления из CPB DU, сигнализированная в сообщении SEI тактирования суб-картинок, является разностью между временем удаления из CPB ассоциированной DU и временем удаления из CPB первой DU предшествующей AU, ассоциированной с сообщением SEI периода буферизации. В то время как это может быть отчасти устойчивым к ошибкам, это может быть также не эффективным, поскольку разница во времени может быть существенным значением.

[0048] Однако, способы предоставлены в настоящем раскрытии для того, чтобы задать выведение времени удаления из CPB способом, который может использовать информацию, переносимую в сообщении дополнительной информации расширения (SEI) тактирования суб-картинок. Например, выведение времени удаления из CPB задано способом, который может использовать информацию, переносимую в сообщениях SEI тактирования суб-картинок, и видео кодер может сигнализировать длительность между удалением из CPB последней DU в AU в порядке декодирования и DU, ассоциированной с сообщением (SEI) тактирования суб-картинок, делая сигнализацию кодера и выведение декодера как более эффективным так и устойчивым к ошибкам.

[0049] Другая проблема, ассоциированная с существующими способами для сигнализации и выведения времен удаления из CPB, является той, что параметры CPB уровня суб-картинок в сообщениях SEI тактирования картинок и сообщениях SEI тактирования суб-картинок могут быть оба присутствующими для одних и тех же функциональных возможностей. Эти функциональные возможности могут быть предоставлены, чтобы поддерживать основанную на суб-картинках операцию CPB. Дублирование этих параметров для одних и тех же функциональных возможностей может быть неэффективным. Может быть возможно, что только один набор параметров CPB уровня суб-картинок, в любом типе сообщений SEI, является достаточным. Способы описаны в настоящем описании, которые конфигурируют видео кодер, чтобы обеспечить флаг уровня последовательности, который может быть сигнализирован, чтобы указывать присутствие параметров CPB уровня суб-картинок в только одном из сообщений SEI тактирования картинок или сообщений SEI тактирования суб-картинок, но не обоих. Используя этот флаг уровня последовательности, видео декодер определяет, найти ли параметры CPB уровня суб-картинок, такие как параметры задержки удаления из CPB на уровне суб-картинок, в сообщении SEI тактирования картинок или в сообщении SEI тактирования суб-картинок.

[0050] Еще одна проблема, ассоциированная с существующими способами для сигнализации и выведения времен удаления из CPB, является той, что определение единиц декодирования не рассматривало единицы NAL не-VCL с nal_unit_type равным UNSPEC0, EOS_NUT, EOB_NUT, в диапазоне RSV_NVCL44 - RSV_NVCL47, или в диапазоне UNSPEC48 - UNSPEC63. Таким образом, когда некоторые из этих единиц NAL не-VCL присутствуют, неожиданное поведение CPB уровня суб-картинок может иметь место. Напротив, настоящее раскрытие обеспечивает способы для расширения определения единицы декодирования, чтобы включать в себя единицы NAL не-VCL с nal_unit_type равным UNSPEC0, EOS_NUT, EOB_NUT, в диапазоне RSV_NVCL44 - RSV_NVCL47 или в диапазоне UNSPEC48 - UNSPEC63.

[0051] Другая потенциальная проблема, ассоциированная с существующими способами для сигнализации и выведения времен удаления из CPB, является той, что сообщение SEI периода буферизации и сообщение SEI точки восстановления могут быть ассоциированы с единицами AU с любым значением временного значения идентификационной информации (TemporalId). Таким образом, кодер может инициализировать HRD в AU с TemporalId, большим чем 0. В этом случае, когда временная масштабируемость поддерживается, время удаления из CPB AU с меньшим значением TemporalId в одном и том же периоде буферизации может зависеть от информации в AU с большим значением TemporalId. Однако, для того, чтобы временная масштабируемость работала, процесс декодирования любой AU может не зависеть от другой AU с большим TemporalId. Настоящее раскрытие также обеспечивает способы для ограничения сообщений SEI периода буферизации и сообщений SEI точки восстановления таким образом, что они не могут быть ассоциированы с единицами AU с TemporalId, большим чем 0.

[0052] Временное значение идентификационной информации (TemporalId) может быть иерархическим значением, которое указывает, какие картинки могут использоваться для кодирования текущей картинки. Вообще, картинка с конкретным значением TemporalId возможно может быть опорной картинкой для картинок с равными или большими значениями TemporalId, но не наоборот. Например, картинка со значением TemporalId, равным 1 возможно может быть опорной картинкой для картинок со значениями TemporalId, равными 1, 2, 3, …, но не для картинки со значением TemporalId, равным 0.

[0053] Самое низкое значение TemporalId может также указывать самую низкую частоту отображения. Например, если видео декодер декодирует только картинки со значениями TemporalId 0, частота отображения может быть 7.5 картинок в секунду. Если видео декодер декодирует только картинки со значениями TemporalId 0 и 1, частота отображения может быть 15 картинок в секунду, и т.д.

[0054] Дополнительная потенциальная проблема, ассоциированная с существующими способами для сигнализации и выведения времен удаления из CPB, заключается в процессе выведения времени удаления из CPB, когда sub_pic_cpb_params_present_flag равен 1, выведение времени удаления из CPB использует оконечное время прибытия и номинальные времена удаления для обоих случаев с SubPicCpbFlag, равным 0 (когда CPB работает на уровне AU), и с SubPicCpbFlag, равным 1 (когда CPB работает на уровне суб-картинок). Однако, эти используемые значения для оконечного времени прибытия и номинальных времен удаления могут быть выведены только для одного из этих двух случаев (например, или для SubPicCPBFlag, равного 0, или для SubPicCPBFlag, равного 1), и следовательно не доступны для другого случая. Описанные способы здесь предусматривают флаг, чтобы сигнализировать, должен ли декодер вывести времена удаления из CPB на уровне AU или уровне суб-картинок. Например, декодер выводит времена прибытия в CPB и номинальные времена удаления и для уровня AU и для уровня суб-картинок независимо от значения SubPicCpbFlag, в то время как декодер выводит времена удаления из CPB только для уровня AU, когда SubPicCpbFlag равен 0, и только для уровня суб-картинок, когда SubPicCpbFlag равен 1, согласно способам, описанным в настоящем описании. Как описано в настоящем описании, номинальное время удаления из CPB может быть значением по умолчанию для времени удаления из CPB. В некоторых примерах с типичными условиями время удаления из CPB равно номинальному времени удаления из CPB. Однако, при некоторых условиях они различны, и время удаления из CPB может немного отличаться от значения по умолчанию.

[0055] Следующие способы, описанные в настоящем раскрытии, могут относиться к проблемам, описанным выше. Например, способы, описанные в настоящем раскрытии, могут обеспечить более устойчивое к ошибкам определение времени удаления из буфера кодированных картинок. Кроме того, в дополнение к улучшенной устойчивости к ошибкам, способы могут способствовать эффективности сигнализации, которая уменьшает полосу пропускания, служебные расходы сигнализации, и увеличивает эффективность кодирования. Кроме того, способы, описанные в настоящем раскрытии, могут учесть надлежащую временную масштабируемость.

[0056] Такие способы могут включать в себя, например, определение времени удаления из буфера кодированных картинок для единицы декодирования (DU) единицы доступа (AU), которое является независимым от времен удаления любой другой единицы доступа. Например, времена удаления из CPB для DU в AU будут сигнализированы на основании длительности между текущей DU и или временем удаления из CPB следующей DU в порядке декодирования в AU или временем удаления из CPB последней DU в AU. Способы могут также включать в себя сигнализацию флага уровня последовательности, чтобы управлять присутствием параметров CPB уровня суб-картинок в только одном из сообщений SEI тактирования картинок или сообщений SEI тактирования суб-картинок согласно способам, описанным в настоящем описании. Способы могут также включать в себя расширение определения единицы декодирования. Дополнительные способы обеспечивают ограничение сообщений SEI периода буферизации и сообщений SEI точки восстановления таким образом, что они не могут быть ассоциированы с единицами AU с переменной TemporalId, большей чем 0. Способы могут также включать в себя обеспечение флага, чтобы сигнализировать, вывести ли времена удаления из CPB на уровне AU или уровне суб-картинок.

[0057] Подробности для реализации этих способов описаны более подробно ниже. Другие части, не упомянутые, могут быть теми же самыми как в HEVC WD8.

[0058] Фиг. 1 является блок-схемой, иллюстрирующей примерную систему 10 кодирования и декодирования видео, которая может использовать способы, описанные в настоящем раскрытии. Как показано на фиг. 1, система 10 включает в себя исходное устройство 12, которое генерирует закодированные видео данные, которые должны быть декодированы в более позднее время устройством 14 назначения. Исходное устройство 12 и устройство 14 назначения может содержать любое из широкого диапазона устройств, включая настольные компьютеры, портативные (например, ноутбук) компьютеры, планшетные компьютеры, телевизионные приставки, телефонные трубки, такие как так называемые смартфоны, так называемые «смарт-» клавиатуры, телевизоры, камеры, устройства отображения, цифровые медиаплееры, пульты видео игр, устройство потоковой передачи видео, или подобное. В некоторых случаях исходное устройство 12 и устройство 14 назначения может быть оборудовано для беспроводной связи.

[0059] В примере согласно Фиг. 1 исходное устройство 12 включает в себя видео источник 18, видео кодер 20 и интерфейс 22 вывода. В некоторых случаях интерфейс 22 вывода может включать в себя модулятор/демодулятор (модем) и/или передатчик. В исходном устройстве 12 видео источник 18 может включать в себя источник, такой как устройство захвата видео, например, видео камеру, видео архив, содержащий ранее захваченное видео, интерфейс подачи видео, чтобы принять видео от поставщика видео контента, и/или систему компьютерной графики для того, чтобы генерировать данные компьютерной графики как исходное видео, или комбинацию таких источников. В качестве одного примера, если видео источник 18 является видео камерой, исходное устройство 12 и устройство 14 назначения могут сформировать так называемые камерофоны или видео телефоны. Однако, способы, описанные в настоящем раскрытии, могут быть применимыми к кодированию видео вообще, и могут быть применены к беспроводным и/или проводным приложениям.

[0060] Захваченное, предварительно захваченное или машинно-генерируемое видео может быть закодировано видео кодером 20. Закодированные видео данные могут быть переданы непосредственно к устройству 14 назначения через интерфейс 22 вывода из исходного устройства 12. Закодированные видео данные могут также (или альтернативно) храниться на устройстве 32 хранения для более позднего доступа устройством 14 назначения или другими устройствами для декодирования и/или воспроизведения.

[0061] Устройство 14 назначения включает в себя интерфейс 28 ввода, видео декодер 30 и устройство 32 отображения. В некоторых случаях интерфейс 28 ввода может включать в себя приемник и/или модем. Интерфейс 28 ввода из устройства 14 назначения принимает закодированные видео данные по линии 16 связи. Закодированные видео данные, переданные по линии 16 связи, или предоставленные на устройстве 32 хранения, могут включать в себя множество элементов синтаксиса, генерируемых видео кодером 20, для использования видео декодером, таким как видео декодер 30, при декодировании видео данных. Такие элементы синтаксиса могут быть включены в закодированные видео данные, переданы на коммуникационном носителе, сохранены на запоминающем носителе, или сохранены файловым сервером.

[0062] Устройство 32 отображения может быть интегрированным с, или быть внешним к, устройству 14 назначения. В некоторых примерах устройство 14 назначения может включать в себя интегрированное устройство отображения и также конфигурироваться, чтобы соединяться с внешним устройством отображения. В других примерах устройство 14 назначения может быть устройством отображения. Вообще, устройство 32 отображения отображает декодированные видео данные пользователю, и может содержать любое из множества устройств отображения, таких как жидкокристаллический дисплей (LCD), плазменный дисплей, дисплей с матрицей точек, дисплей на органических светоизлучающих (OLED) диодах, электронные чернила, или другой тип устройства отображения.

[0063] Устройство 14 назначения может принять закодированные видео данные, которые должны быть декодированы, через линию 16 связи. Линия 16 связи может содержать любой тип носителя или устройства, способного к перемещению закодированных видео данных от исходного устройства 12 к устройству 14 назначения. В одном примере линия 16 связи может содержать коммуникационный носитель, чтобы разрешить исходному устройству 12 передавать закодированные видео данные непосредственно к устройству 14 назначения в реальном времени. Закодированные видео данные могут модулироваться согласно стандарту связи, такому как протокол беспроводной связи, и переданы к устройству 14 назначения. Коммуникационный носитель может содержать любой беспроводной или проводной коммуникационный носитель, такой как радиочастотный (RF) спектр или одна или более физических линий передачи. Коммуникационный носитель может являться частью основанной на пакетной передаче сети, такой как локальная сеть, региональная сеть, или глобальная сеть, такая как Интернет. Коммуникационный носитель может включать в себя маршрутизаторы, переключатели, базовые станции или любое другое оборудование, которое может быть полезным, чтобы облегчить связь от исходного устройства 12 к устройству 14 назначения.

[0064] Альтернативно, закодированные данные могут быть выведены из интерфейса 22 вывода на устройство 32 хранения. Аналогично, к закодированным данным можно получить доступ от устройства 32 хранения через интерфейс ввода. Устройство 32 хранения может включать в себя любой из множества распределенных или запоминающих носителей данных, к которым локально получают доступ, такой как накопитель на жестких дисках, диски Blu-ray, DVD, CD-ROM, флэш-память, энергозависимая или энергонезависимая память, или любые другие подходящие цифровые запоминающие носители для того, чтобы хранить закодированные видео данные. В дальнейшем примере устройство 32 хранения может соответствовать файловому серверу или другому промежуточному устройству хранения, которое может хранить закодированное видео, генерируемые исходным устройством 12. Устройство 14 назначения может получить доступ к сохраненным видео данным от устройства 32 хранения с помощью потоковой передачи или загрузки. Файловый сервер может быть любым типом сервера, способного к тому, чтобы хранить закодированные видео данные и передавать эти закодированные видео данные к устройству 14 назначения. Примерные файловые серверы включают в себя web-сервер (например, для вебсайта), сервер FTP, устройства соединенных с сетью устройств хранения (NAS) , или локальный дисковод. Устройство 14 назначения может получить доступ к закодированным видео данным через любое стандартное соединение данных, включая интернет-соединение. Это может включать в себя беспроводный канал (например, соединение Wi-Fi), проводное соединение (например, DSL, кабельный модем, и т.д.), или комбинацию обоих, которая является подходящей для того, чтобы получить доступ к закодированным видео данным, хранящимся на файловом сервере. Передача закодированных видео данных от устройства 32 хранения может быть потоковой передачей, передачей загрузки или комбинацией обоих.

[0065] Способы настоящего раскрытия не обязательно ограничены беспроводными приложениями или параметрами настройки. Способы могут быть применены к кодированию видео в поддержку любого из множества мультимедийных приложений, таких как эфирное телевидение, передачи кабельного телевидения, передачи спутникового телевидения, потоковые передачи видео, например, через Интернет, кодирование цифрового видео для сохранения на запоминающем носителе данных, декодирование цифрового видео, сохраненного на запоминающем носителе данных, или других приложений. В некоторых примерах система 10 может быть сконфигурирована, чтобы поддерживать одностороннюю или двухстороннюю видео передачу, чтобы поддерживать приложения, такие как потоковая передача видео, воспроизведение видео, вещание видео, и/или видео телефония.

[0066] Видео кодер 20 и видео декодер 30 могут работать согласно стандарту сжатия видео, такому как стандарт высокоэффективного кодирования видео (HEVC), в настоящее время развиваемый объединенной командой сотрудничества по кодированию видео (JCT-VC) группы экспертов по кодированию видео ITU-T (VCEG) и ISO/IEC группы экспертов по движущимся изображениям (MPEG). Видео кодер 20 и видео декодер 30 могут работать согласно HEVC WD8. Альтернативно, видео кодер 20 и видео декодер 30 могут работать согласно другим составляющим собственность стандартам или стандартам промышленности, таким как ITU-T H.261, ISO/IEC MPEG-1 Visual, ITU-T H.262 или ISO/IEC MPEG-2 Visual, ITU-T H.263, ISO/IEC MPEG-4 Visual и ITU-T H.264 (также известный как ISO/IEC MPEG-4 AVC), включая его расширения масштабируемого кодирования видео (SVC) и кодирования видео с множественными видами (MVC), или расширения таких стандартов. Способы настоящего раскрытия, однако, не ограничены никаким конкретным стандартом кодирования.

[0067] В некоторых примерах видео кодер 20 и видео декодер 30 могут каждый быть интегрирован с аудио кодером и декодером, и могут включать в себя соответствующие блоки MUX-DEMUX (мультиплексор-демультиплексор), или другое аппаратное обеспечение и программное обеспечение, чтобы обрабатывать кодирование и аудио и видео в общем потоке данных или отдельных потоках данных. Если применимо, в некоторых примерах блоки MUX-DEMUX могут соответствовать протоколу мультиплексора ITU H.223 или другим протоколам, таким как протокол дейтаграмм пользователя (UDP).

[0068] Видео кодер 20 и видео декодер 30 каждый может быть реализован как любая из множества подходящих схем кодера, таких как один или более микропроцессоров, цифровые сигнальные процессоры (DSPs), специализированные интегральные схемы (ASICs), программируемые пользователем вентильные матрицы (FPGAs), дискретная логика, программное обеспечение, аппаратное обеспечение, программно-аппаратные средства или любые их комбинации. Когда способы реализованы частично в программном обеспечении, устройство может сохранить инструкции для программного обеспечения в подходящем невременном считываемом компьютером носителе и выполнять инструкции в аппаратном обеспечении, используя один или более процессоров, чтобы выполнить способы настоящего раскрытия. Каждый из видео кодера 20 и видео декодера 30 может быть включен в один или более кодеров или декодеров, любой из которых может быть интегрирован как часть объединенного кодера/декодера (кодек) в соответствующем устройстве.

[0069] JCT-VC работает над развитием стандарта HEVC. Усилия по стандартизации HEVC основаны на развивающейся модели устройства кодирования видео, называемой тестовой моделью HEVC (HM). HM предполагает несколько дополнительных возможностей устройств кодирования видео относительно существующих устройств согласно, например, ITU-T H.264/AVC. Например, тогда как H.264 обеспечивает девять режимов кодирования с внутренним предсказанием, HM может обеспечить целых тридцать три режима кодирования с внутренним предсказанием.

[0070] Вообще, рабочая модель HM описывает, что видео кадр или картинка могут быть разделены на последовательность блоков дерева или наибольших единиц кодирования (LCU), которые включают в себя выборки как яркости так и насыщенности цвета. Блок дерева имеет аналогичную цель что и макроблок в стандарте H.264. Вырезка включает в себя ряд последовательных блоков дерева в порядке кодирования. Видео кадр или картинка могут быть разделены на одну или более вырезок. Каждый блок дерева может быть разделен на единицы кодирования (CUs) согласно квадродереву. Например, блок дерева, как корневой узел квадродерева, может быть разделен на четыре дочерних узла, и каждый дочерний узел может, в свою очередь, быть родительским узлом и быть разделен еще на четыре дочерних узла. Оконечный, неразделенный дочерний узел, как листовой узел квадродерева, содержит узел кодирования, то есть, закодированный блок видео. Данные синтаксиса, ассоциированные с закодированным потоком битов, могут определить максимальное количество раз, сколько блок дерева может быть разделен, и может также определить минимальный размер узлов кодирования.

[0071] CU включает в себя узел кодирования и единицы предсказания (PU) и единицы преобразования (TU), ассоциированные с узлом кодирования. Размер CU обычно соответствует размеру узла кодирования и является типично квадратным по форме. Размер CU может ранжироваться от 8x8 пикселей до размера блока дерева с максимумом 64x64 пикселей или больше. Каждая CU может содержать одну или более единиц PU и одну или более единиц TU. Данные синтаксиса, ассоциированные с CU, могут описывать, например, разделение CU в одну или более единиц PU. Режимы разделения могут отличаться между тем, является ли CU закодированной в режиме пропуска или прямом режиме, закодированной в режиме внутреннего предсказания или закодированной в режиме внешнего предсказания. Единицы PU могут быть разделены, чтобы быть неквадратными по форме. Данные синтаксиса, ассоциированные с CU, могут также описывать, например, разделение CU в одну или более единиц TU согласно квадродереву. TU может быть квадратной или неквадратной по форме.

[0072] Стандарт HEVC учитывает преобразования согласно единицам TU, которые может быть различными для различных единиц CU. Единицы TU типично имеют размеры на основании размера единиц PU в пределах заданной CU, определенной для разделенной LCU, хотя это может не всегда иметь место. Единицы TU типично имеют тот же размер или меньший, что и единицы PU. В некоторых примерах остаточные выборки, соответствующие CU, могут быть подразделены на меньшие блоки, используя структуру квадродерева, известную как "остаточное квадродерево" (RQT). Листовые узлы RQT могут упоминаться как единицы преобразования (единицы TU). Значения пиксельной разности, ассоциированные с единицами TU, могут быть преобразованы, чтобы сформировать коэффициенты преобразования, которые могут быть квантованы.

[0073] Вообще, PU включает в себя данные, относящиеся к процессу предсказания. Например, когда PU является закодированной во внутреннем режиме, PU может включать в себя данные, описывающие режим внутреннего предсказания для PU. В качестве другого примера, когда PU является закодированной во внешнем режиме, PU может включать в себя данные, определяющие вектор движения для PU. Данные, определяющие вектор движения для PU, могут описывать, например, горизонтальный компонент вектора движения, вертикальный компонент вектора движения, разрешения для вектора движения (например, пиксельную точность в одну четверть или пиксельную точность в одну восьмую), опорную картинку, на которую вектор движения указывает, и/или список опорных картинок (например, Список 0, Список 1, или Список C) для вектора движения.

[0074] Вообще, TU используется для процессов квантования и преобразования. Заданная CU, имеющая одну или более единиц PU, может также включать в себя одну или более единиц преобразования (единиц TU). Вслед за предсказанием, видео кодер 20 может вычислить остаточные значения от блока видео, идентифицированного узлом кодирования в соответствии с PU. Узел кодирования затем обновляется, чтобы сослаться на остаточные значения, а не на первоначальный блок видео. Остаточные значения содержат значения пиксельной разности, которые могут быть преобразованы в коэффициенты преобразования, квантованы и сканированы с использованием преобразования и другой информации преобразования, заданной в единицах TU, чтобы сформировать преобразованные в последовательную форму коэффициенты преобразования для энтропийного кодирования. Узел кодирования может еще раз быть обновлен, чтобы ссылаться на эти преобразованные в последовательную форму коэффициенты преобразования. Настоящее раскрытие типично использует термин "блок видео", чтобы ссылаться на узел кодирования CU. В некоторых конкретных случаях настоящее раскрытие может также использовать термин "блок видео", чтобы ссылаться на блок дерева, то есть, LCU, или CU, которая включает в себя узел кодирования и единицы PU и единицы TU.

[0075] Видео последовательность типично включает в себя последовательность видео кадров или картинок. Группа картинок (GOP) вообще содержит последовательность из одной или более видео картинок. GOP может включать данные синтаксиса в заголовок GOP, заголовок одной или более картинок, или в другое место, которое описывает множество картинок, включенных в GOP. Каждая вырезка картинки может включать в себя данные синтаксиса вырезки, которые описывают режим кодирования для соответствующей вырезки. Видео кодер 20 типично оперирует над блоками видео в пределах индивидуальных видео вырезок, чтобы закодировать видео данные. Блок видео может соответствовать узлу кодирования в пределах CU. Блоки видео могут иметь фиксированный или переменный размеры, и могут отличаться по размеру согласно указанному стандарту кодирования.

[0076] Как пример, HM поддерживает предсказание в PU различных размеров. Предполагая, что размер конкретной CU равен 2N×2N, HM поддерживает внутреннее предсказание в размерах PU, равных 2N×2N или N×N, и внешнее предсказание в симметричных размерах PU, равных 2N×2N, 2N×N, N×2N, или N×N. HM также поддерживает асимметричное разделение для внешнего предсказания в размерах PU, равных 2N×nU, 2N×nD, nL×2N, и nR×2N. При асимметричном разделении одно направление CU не разделяется, в то время как другое направление разделяется на 25% и 75%. Часть CU, соответствующая 25%-ому разделению, обозначена “n”, сопровождаемая индикацией «верхний», «нижний», «левый» или «правый». Таким образом, например, “2N×nU” относится к CU размером 2N×2N, которая разделена горизонтально с 2N×0.5N PU сверху и 2N×1.5N PU внизу.

[0077] В настоящем раскрытии “N×N” и “N на N” может использоваться взаимозаменяемо, чтобы относиться к пиксельным измерениям блока видео в терминах вертикального и горизонтального измерений, например, 16×16 пикселей или 16 на 16 пикселей. Вообще, блок 16×16 имеет 16 пикселей в вертикальном направлении (y=16) и 16 пикселей в горизонтальном направлении (x=16). Аналогично, блок N×N обычно имеет N пикселей в вертикальном направлении и N пикселей в горизонтальном направлении, где N представляет неотрицательное целочисленное значение. Пиксели в блоке могут быть размещены в рядах и колонках. Кроме того, блоки должен не обязательно иметь то же количество пикселей в горизонтальном направлении, как в вертикальном направлении. Например, блоки могут содержать N×M пикселей, где М не обязательно равно N.

[0078] После кодирования с внутренним предсказанием или с внешним предсказанием, используя единицы PU в CU, видео кодер 20 может вычислить остаточные данные, к которым преобразования, заданные единицами TU в CU, применяются. Остаточные данные могут соответствовать пиксельным разностям между пикселями незакодированной картинки и значениями предсказания, соответствующими единицам CU. Видео кодер 20 может сформировать остаточные данные для CU и затем преобразовать остаточные данные, чтобы сформировать коэффициенты преобразования.

[0079] После любого преобразования, чтобы сформировать коэффициенты преобразования, видео кодер 20 может выполнить квантование коэффициентов преобразования. Квантование обычно относится к процессу, в котором коэффициенты преобразования квантуются, чтобы возможно уменьшить объем данных, использованных для представления коэффициентов, обеспечивая дальнейшее сжатие. Процесс квантования может уменьшить битовую глубину, ассоциированную с некоторыми или всеми коэффициентами. Например, n-битовое значение может быть округлено в меньшую сторону до m-битового значения во время квантования, где n больше чем m.

[0080] В некоторых примерах видео кодер 20 может использовать заранее заданный порядок сканирования, чтобы сканировать квантованные коэффициенты преобразования, чтобы сформировать преобразованный в последовательную форму вектор, который может быть энтропийно кодирован. В других примерах видео кодер 20 может выполнить адаптивное сканирование. После сканирования квантованных коэффициентов преобразования, чтобы сформировать одномерный вектор, видео кодер 20 может энтропийно кодировать одномерный вектор, например, согласно контекстно-адаптивному кодированию с переменной длиной кода (CAVLC), контекстно-адаптивному двоичному арифметическому кодированию (CABAC), основанному на синтаксисе контекстно-адаптивному двоичному арифметическому кодированию (SBAC), энтропийному кодированию с разделением интервала вероятности (PIPE) или другой методологии энтропийного кодирования. Видео кодер 20 может также энтропийно кодировать элементы синтаксиса, ассоциированные с закодированными видео данными, для использования видео декодером 30 при декодировании видео данных.

[0081] Чтобы выполнить CABAC, видео кодер 20 может назначить контекст в пределах контекстной модели символу, который должен быть передан. Контекст может относиться, например, к тому, являются ли соседние значения символа ненулевыми или нет. Чтобы выполнить CAVLC, видео кодер 20 может выбрать код с переменной длиной слова для символа, который должен быть передан. Кодовые слова в VLC могут быть построены таким образом, что относительно более короткие коды соответствуют более вероятным символам, в то время как более длинные коды соответствуют менее вероятным символам. Таким образом, использование VLC может достигнуть экономии битов, например, используя кодовые слова равной длины для каждого символа, который должен быть передан. Определение вероятности может быть основано на контексте, назначенном на символ.

[0082] В некоторых примерах видео кодер 20 и видео декодер 30 могут быть сконфигурированы, чтобы реализовать один или более примерных способов, описанных в настоящем раскрытии. Видео кодер 20 может закодировать видео данные в форме единицы доступа, которая разделена на одну или более единиц декодирования. Эти единицы доступа могут быть временно сохранены в буфере кодированных картинок. Видео декодер 30 может извлечь единицы DU для декодирования в порядке декодирования на основании информации тактирования, включенной в элементы синтаксиса для соответствующей AU или DU.

[0083] В соответствии со способами, описанными в настоящем раскрытии, термин "единица декодирования" может быть определен следующим образом. Единица декодирования является единицей доступа или поднабором единиц доступа. Если элемент синтаксиса SubPicCpbFlag равен 0, единица декодирования является единицей доступа. Иначе, DU включает в себя одну или более единиц NAL VCL в AU и ассоциированные единицы NAL не-VCL. Если единица NAL не-VCL имеет nal_unit_type, равный UNSPEC0, EOS_NUT, EOB_NUT, FD _NUT, в диапазоне RSV_NVCL44 - RSV_NVCL47, или в диапазоне UNSPEC48 - UNSPEC63, единица NAL не-VCL ассоциирована с наиболее недавней предшествующей единицей NAL VCL в порядке декодирования, иначе единица NAL не-VCL ассоциирована с первой последующей единицей NAL VCL в порядке декодирования. Для того, чтобы корректно рассмотреть единицы NAL не-VLC согласно способам, описанным в настоящем описании, DU может быть определена, чтобы рассматривать единицы NAL не-VCL с nal_unit_type, равным UNSPEC0, EOS_NUT, EOB_NUT, в диапазоне RSV_NVCL44 - RSV_NVCL47 или в диапазоне UNSPEC48 - UNSPEC63.

[0084] В соответствии со способами, описанными в настоящем раскрытии, термин "точка операции" может быть определен следующим образом. Точка операции идентифицируется набором nuh_reserved_zero_6bits значений (обозначенных как OpLayerIdSet) и значением TemporalId (обозначенным как OpTid), и ассоциированным поднабором потока битов, выведенным как результат процесса извлечения подпотока битов, как определено в подпункте 10.1 в HEVC WD8. Элементы синтаксиса OpTid и OpLayerIdSet могут функционировать как входные данные и быть независимо декодируемыми.

[0085] Некоторые примеры потоков битов, генерируемых согласно способам, описанным в настоящем описании, могут иметь уровень соответствия потока битов. Подпункт 10.1 HEVC WD8 описывает, что может иметь место требование соответствия (согласования) потока битов, что любой подпоток битов, который включен в выходные данные процесса, определенного в подпункте 10.1, с tIdTarget, равным любому значению в диапазоне от 0 до 6, включительно, и с targetDecLayerIdSet, содержащим значение 0, может соответствовать HEVC.

[0086] В некоторых примерах соответствующий (согласующийся) поток битов может содержать одну или более закодированных единиц NAL вырезки с nuh_reserved_zero_6bits, равным 0, и TemporalId, равным 0.

[0087] Входными данными к процессу, описанному здесь, могут быть переменная tIdTarget и список targetDecLayerIdSet. Выходные данные включают в себя подпоток битов. Подпоток битов может быть выведен посредством удаления из потока битов всех единиц NAL с TemporalId, большим чем tIdTarget или nuh_reserved_zero_6bits не среди значений в targetDecLayerIdSet.

[0088] Каждая единица NAL может быть ассоциирована с информацией заголовка. Для семантики заголовка единицы NAL может быть определено следующее. Во время декодирования декодер 30 может проигнорировать (например, удалить из потока битов и отбросить) содержимое всех единиц NAL, которые используют сохраненные значения nal_unit_type. В операциях HRD, как определено в Приложении C в HEVC WD8, в зависимости от выбранной точки операции, подвергаемой тесту, единицы NAL с сохраненными значениями nal_unit_type могут быть рассмотрены при выведении времен прибытия и удаления из CPB, но во время декодирования они могут быть безопасно проигнорированы (удалены и отброшены).

[0089] Во время декодирования декодеры могут проигнорировать (например, удалить из потока битов и отбросить) все единицы NAL со значениями nuh_reserved_zero_6bits, не равными 0. В операциях HRD, как определено в Приложении C в HEVC WD8, в зависимости от выбранной точки операции, подвергаемой тесту, единицы NAL с сохраненными значениями nuh_reserved_zero_6bits могут быть рассмотрены при выведении тактирования прибытия и удаления из CPB, но во время декодирования они могут быть безопасно проигнорированы (удалены и отброшены).

[0090] Времена прибытия и времена удаления из буфера кодированных картинок могут быть основаны на двух уровнях: уровень единицы доступа и уровень суб-картинок. Видео кодировщик (например, видео кодер 20 или видео декодер 30) может быть сконфигурирован, чтобы вывести время прибытия в CPB и номинальное время удаления из CPB и для уровня единицы доступа и для уровня суб-картинок независимо от значения элемента синтаксиса, который определяет, находится ли DU в AU (например, включает ли AU в себя только одну DU). Элементом синтаксиса может быть SubPicCpbFlag, который может быть сигнализирован для каждой AU. Как описано выше, когда SubPicCpbFlag равно 0, DU составляет всю AU. Иначе, когда SubPicCpbFlag равен ненулевому значению, DU включает в себя одну или более единиц NAL VCL в AU и ассоциированные единицы NAL не-VCL. В некоторых примерах видео кодировщик может быть сконфигурирован, чтобы также вывести времена удаления из CPB для уровня AU, когда элемент синтаксиса указывает, что DU является единицей AU. В некоторых из этих примеров видео кодировщик может быть сконфигурирован, чтобы вывести времена удаления из CPB только для уровня AU, когда элемент синтаксиса указывает, что DU является единицей AU.

[0091] В некоторых примерах видео кодировщик (например, видео кодер 20 или видео декодер 30) может быть сконфигурирован, чтобы также вывести времена удаления из CPB для уровня суб-картинок, когда элемент синтаксиса указывает, что DU не является единицей AU. В некоторых из этих примеров видео кодировщик может быть сконфигурирован, чтобы вывести времена удаления из CPB только для уровня суб-картинок, когда элемент синтаксиса указывает, что DU не является AU.

[0092] Видео кодировщик может быть сконфигурирован, чтобы вывести время прибытия в CPB и номинальное время удаления из CPB, когда второй элемент синтаксиса определяет, что параметры задержки удаления из CPB на уровне суб-картинок присутствуют, и CPB может работать на уровне AU или уровне суб-картинок. Второй элемент синтаксиса может быть sub_pic_cpb_params_present_flag. Когда sub_pic_cpb_params_present_flag равен 1, параметры задержки удаления из CPB на уровне суб-картинок присутствуют, и CPB может работать на уровне единицы доступа или уровне суб-картинок, и когда sub_pic_cpb_params_present_flag равен 0, параметры задержки удаления из CPB на уровне суб-картинок не присутствуют, и CPB работает на уровне единицы доступа.

[0093] В некоторых из примеров, где sub_pic_cpb_params_present_flag равен 1, видео кодировщик может быть сконфигурирован, чтобы установить переменную subPicParamsPresentFlag равной 0, и вывести начальное и оконечное время прибытия AU. Затем видео кодировщик может быть сконфигурирован, чтобы установить переменную subPicParamsPresentFlag равной 1, и вывести начальное и оконечное время прибытия DU для единицы DU в пределах AU.

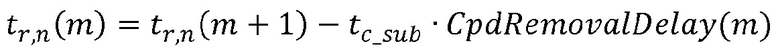

[0094] Кроме того, в некоторых примерах видео кодировщик (например, видео кодер 20 или видео декодер 30) может быть сконфигурирован, чтобы закодировать (например, закодировать или декодировать) длительность времени между удалением из CPB первой единицы декодирования в единице доступа и второй DU в единице доступа. В этом примере вторая DU является следующей за первой DU в порядке декодирования и в той же самой AU что и DU. Видео кодировщик может быть сконфигурирован, чтобы определить время удаления первой DU на основании по меньшей мере закодированной длительности. В некоторых способах видео кодировщик может определить время удаления первой DU без кодирования начальной задержки удаления из CPB и смещения. В некоторых примерах вторая DU является непосредственно следующей за первой DU в единице доступа. В некоторых примерах вторая DU является последней DU в единице доступа в порядке декодирования.

[0095] Видео кодировщик (например, видео кодер 20 или видео декодер 30) может также быть сконфигурирован, чтобы закодировать параметры CPB уровня суб-картинок. В этих примерах видео кодировщик может определить время удаления первой DU на основании по меньшей мере одного из закодированной длительности и параметров CPB уровня суб-картинок. Например, параметры CPB уровня суб-картинок могут быть сообщением SEI тактирования суб-картинок, которое ассоциировано с первой DU. В некоторых примерах видео кодировщик может закодировать длительность между временем удаления последней DU в AU в порядке декодирования и первой DU в сообщении SEI суб-картинок. В некоторых примерах видео кодировщик может закодировать флаг уровня последовательности, чтобы указывать присутствие параметров CPB уровня суб-картинок или в сообщениях SEI тактирования картинок или в сообщениях SEI тактирования суб-картинок.

[0096] Например, видео кодер 20 может быть сконфигурирован, чтобы закодировать длительность времени между удалением из CPB первой DU в AU и второй DU в AU. Видео кодер 20 может закодировать параметры CPB уровня суб-картинок, такие как параметры задержки удаления из CPB на уровне суб-картинок, в одном из сообщения SEI тактирования картинок или сообщения SEI тактирования суб-картинок. Видео кодер 20 может закодировать флаг, sub_pic_cpb_params_in_pic_timing_sei_flag, чтобы указать, присутствует ли параметры CPB уровня суб-картинок в сообщении SEI тактирования картинок или в сообщении SEI тактирования суб-картинок.

[0097] Например, видео декодер 30 может декодировать длительность времени между удалением из CPB первой DU в AU и второй DU в этой AU. Видео декодер 30 может быть сконфигурирован, чтобы определить время удаления первой DU на основании по меньшей мере декодированной длительности. В некоторых способах видео кодировщик может определить время удаления первой DU без декодирования начальной задержки удаления из CPB и смещения. Видео декодер 30 может декодировать параметры CPB уровня суб-картинок из сообщения SEI тактирования картинок или сообщения SEI тактирования суб-картинок, принятого от видео кодера 20. Видео декодер 30 может определить - в каком сообщении SEI искать параметры CPB уровня суб-картинок, на основании присутствия флага, sub_pic_cpb_params_in_pic_timing_sei_flag.

[0098] В некоторых из примерных способов, описанных в настоящем раскрытии, временное значение идентификационной информации (TemporalId) второй DU может не быть больше чем TemporalId первой DU. В некоторых примерах TemporalId второй DU может не быть больше чем ноль.

[0099] Например, способы, описанные в настоящем раскрытии, могут обеспечить более устойчивое к ошибкам определение времени удаления из буфера кодированных картинок. Кроме того, в дополнение к улучшенной устойчивости к ошибкам, способы могут способствовать эффективности сигнализации, которая уменьшает полосу пропускания, служебные расходы сигнализации и увеличивает время кодирования. Кроме того, способы, описанные в настоящем раскрытии, могут учесть улучшенную временную масштабируемость.

[0100] Фиг. 2 является блок-схемой, иллюстрирующей примерный кодер видео 20, который может реализовать способы, описанные в настоящем раскрытии. Видео кодер 20 может выполнять внутреннее и внешнее кодирование блоков видео в пределах видео вырезок. Внутреннее кодирование полагается на пространственное предсказание, чтобы уменьшить или удалить пространственную избыточность в видео в пределах заданного видео кадра или картинки. Внешнее кодирование полагается на временное предсказание, чтобы уменьшить или удалить временную избыточность в видео в пределах смежных кадров или картинок видео последовательности. Внутренний режим (I режим) может относиться к любому из нескольких основанных на пространстве режимов сжатия. Внешние режимы, такие как однонаправленное предсказание (P режим) или би-предсказание (B режим), могут относиться к любому из нескольких основанных на времени режимов сжатия.

[0101] В примере согласно Фиг. 2 видео кодер 20 включает в себя модуль 35 разделения, модуль 41 обработки предсказания, сумматор 50, модуль 52 обработки преобразования, модуль 54 квантования и модуль 56 энтропийного кодирования. Модуль 41 обработки предсказания включает в себя модуль 42 оценки движения, модуль 44 компенсации движения и модуль 46 обработки внутреннего предсказания. Для реконструкции блока видео, видео кодер 20 также включает в себя модуль 58 обратного квантования, модуль 60 обработки обратного преобразования, сумматор 62, модуль 64 фильтров и буфер декодированных картинок (DPB) 66. Буфер 66 декодированных картинок может также упоминаться как память опорных картинок. В других примерах видео кодер 20 может включать в себя больше, меньше, или другие функциональные компоненты.

[0102] Как показано на фиг. 2, видео кодер 20 принимает видео данные и модуль 35 разделения разделяет данные на блоки видео. Это разделение видео данных может также включать в себя разделение видео данных на вырезки, мозаичные элементы (плитки), или другие большие блоки, а также разделение блока видео, например, согласно структуре квадродерева единиц LCU и единиц CU. Видео кодер 20 обычно иллюстрирует компоненты, которые кодируют блоки видео в пределах видео вырезки, которая должна быть закодирована. Вырезка может быть разделена на множественные блоки видео (и возможно на наборы блоков видео, называемых «мозаичные элементы»).

[0103] Модуль 41 обработки предсказания может выбрать один из множества возможных режимов кодирования, таких как один из множества режимов внутреннего кодирования или один из множества внешних режимов кодирования, для текущего блока видео, на основании результатов ошибок (например, скорость кодирования и уровень искажения). Модуль 41 обработки предсказания может выдать результирующий внутреннее или внешне кодированный блок к сумматору 50, чтобы генерировать остаточные данные блока, и к сумматору 62, чтобы восстановить закодированный блок для использования в качестве опорной картинки.

[0104] Модуль 46 обработки внутреннего предсказания, находящийся в пределах модуля 41 обработки предсказания, может выполнить кодирование с внутренним предсказанием текущего блока видео относительно одного или более соседних блоков в том же самом кадре или вырезке как и текущий блок, который должен быть закодирован, чтобы обеспечить пространственное сжатие. Модуль 42 оценки движения и модуль 44 компенсации движения в пределах модуля 41 обработки предсказания выполняют кодирование с внешним предсказанием текущего блока видео относительно одного или более предсказывающих блоков в одной или более опорных картинок, чтобы обеспечить временное сжатие.

[0105] Модуль 42 оценки движения может быть сконфигурирован, чтобы определить режим внешнего предсказания для видео вырезки согласно заранее определенному шаблону для видео последовательности. Заранее определенный шаблон может определять видео вырезки в последовательности как P вырезки, B вырезки или вырезки GPB. Модуль 42 оценки движения и модуль 44 компенсации движения могут быть интегрированными, но иллюстрированы отдельно в концептуальных целях. Оценка движения, выполненная модулем 42 оценки движения, является процессом генерирования векторов движения, которые оценивают движение для блоков видео. Вектор движения, например, может указывать смещение PU блока видео в пределах текущего видео кадра или картинки относительно предсказывающего блока в пределах опорной картинки.

[0106] Предсказывающий блок является блоком, который, как находят, близко соответствует PU блока видео, который должен быть закодирован, в терминах пиксельной разности, которая может быть определена суммой абсолютных разностей (SAD), сумма разностей квадратов (SSD), или другими метриками различия. В некоторых примерах видео кодер 20 может вычислить значения для суб-целочисленных пиксельных позиций опорных картинок, сохраненных в буфере 66 декодированных картинок. Например, видео кодер 20 может интерполировать значения пиксельных позиций в одну четверть, пиксельных позиций в одну восьмую, или других фракционных пиксельных позиций опорной картинки. Поэтому модуль 42 оценки движения может выполнить поиск движения относительно полных пиксельных позиций и фракционных пиксельных позиций и вывести вектор движения с фракционной пиксельной точностью.

[0107] Модуль 42 оценки движения вычисляет вектор движения для PU блока видео во внешне кодированной вырезке, сравнивая позицию PU с позицией предсказывающего блока опорной картинки. Опорная картинка может быть выбрана из первого списка опорных картинок (Список 0) или второго списка опорных картинок (Список 1), каждый из которых идентифицирует одну или более опорных картинок, сохраненных в буфере 66 декодированных картинок. Модуль 42 оценки движения посылает вычисленный вектор движения в модуль 56 энтропийного кодирования и модуль 44 компенсации движения.

[0108] Компенсация движения, выполненная модулем 44 компенсации движения, может включать в себя установку или генерирование предсказывающего блока на основании вектора движения, определенного посредством оценки движения, возможно выполняя интерполяции до суб-пиксельной точности. После приема вектора движения для PU текущего блока видео модуль 44 компенсации движения может определить местонахождение предсказывающего блока, на который вектор движения указывает в одном из списков опорных картинок. Видео кодер 20 формирует остаточный блок видео, вычитая пиксельные значения предсказывающего блока из пиксельных значений текущего закодированного блока видео, формируя значения пиксельной разности. Значения пиксельной разности формируют остаточные данные для блока, и могут включать в себя разностные компоненты как яркости так и насыщенности цвета. Сумматор 50 представляет компонент или компоненты, которые выполняют эту операцию вычитания. Модуль 44 компенсации движения может также генерировать элементы синтаксиса, ассоциированные с блоками видео и видео вырезкой, для использования видео декодером 30 при декодировании блоков видео в видео вырезке.

[0109] Модуль 46 обработки внутреннего предсказания может внутренне предсказывать текущий блок, как альтернатива внешнему предсказанию, выполненному модулем 42 оценки движения и модулем 44 компенсации движения, как описано выше. В частности, модуль 46 обработки внутреннего предсказания может определить режим внутреннего предсказания, чтобы использовать для кодирования текущего блока. В некоторых примерах модуль 46 обработки внутреннего предсказания может закодировать текущий блок, используя различные режимы внутреннего предсказания, например, во время отдельных проходов кодирования, и модуль 46 обработки внутреннего предсказания (или модуль 40 выбора режима, в некоторых примерах) может выбрать соответствующий режим внутреннего предсказания для использования из протестированных режимов. Например, модуль 46 обработки внутреннего предсказания может вычислить значения «скорость передачи – искажение», используя анализ «скорость передачи – искажение» для различных протестированных режимов внутреннего предсказания, и выбрать режим внутреннего предсказания, имеющий лучшие характеристики скорости передачи - искажение среди протестированных режимов. Анализ «скорость передачи – искажение» вообще определяет величину искажения (или ошибку) между закодированным блоком и первоначальным, незакодированным блоком, который был закодирован, чтобы сформировать закодированный блок, а также частоту следования битов (то есть, количество битов), использованную для формирования закодированного блока. Модуль 46 обработки внутреннего предсказания может вычислить отношения из искажений и скоростей передачи для различных закодированных блоков, чтобы определить, какой режим внутреннего предсказания показывает лучшее значение «скорость передачи – искажение» для блока.

[0110] В любом случае после выбора режима внутреннего предсказания для блока модуль 46 обработки внутреннего предсказания может предоставить информацию, указывающую выбранный режим внутреннего предсказания для блока, к модулю 56 энтропийного кодирования. Модуль 56 энтропийного кодирования может закодировать информацию, указывающую выбранный режим внутреннего предсказания, в соответствии со способами настоящего раскрытия. Видео кодер 20 может включать в переданные данные конфигурацию потока битов, которая может включать в себя множество таблиц индекса режима внутреннего предсказания, и множество модифицированных таблиц индекса режима внутреннего предсказания (также называемых таблицами отображения кодовых слов), определения контекстов кодирования для различных блоков, и индикации наиболее вероятного режима внутреннего предсказания, таблицы индекса режима внутреннего предсказания, и модифицированные таблицы индекса режима внутреннего предсказания, чтобы использовать для каждого из контекстов.

[0111] После того, как модуль 41 обработки предсказания генерирует предсказывающий блок для текущего блока видео или через внешнее предсказание или через внутреннее предсказание, видео кодер 20 формирует остаточный блок видео, вычитая предсказывающий блок из текущего блока видео. Остаточные видео данные в остаточном блоке могут быть включены в одну или более единиц TU и поданы на модуль 52 обработки преобразования. Модуль 52 обработки преобразования преобразовывает остаточные видео данные в остаточные коэффициенты преобразования, используя преобразование, такие как дискретное косинусное преобразование (DCT) или концептуально подобное преобразование. Модуль 52 обработки преобразования может преобразовать остаточные видео данные из пиксельной области в область преобразования, такую как частотная область.

[0112] Модуль 52 обработки преобразования может послать результирующие коэффициенты преобразования в модуль 54 квантования. Модуль 54 квантования квантует коэффициенты преобразования, чтобы далее уменьшить частоту следования битов. Процесс квантования может уменьшить битовую глубину, ассоциированную с некоторыми или всеми коэффициентами. Степень квантования может быть модифицирована, регулируя параметр квантования. В некоторых примерах модуль 54 квантования может затем выполнить сканирование матрицы, включающей в себя квантованные коэффициенты преобразования. Альтернативно, модуль 56 энтропийного кодирования может выполнить сканирование.

[0113] Вслед за квантованием модуль 56 энтропийного кодирования может энтропийно кодировать квантованные коэффициенты преобразования. Например, модуль 56 энтропийного кодирования может выполнить контекстно-адаптивное кодирование с переменной длиной кода (CAVLC), контекстно-адаптивное двоичное арифметическое кодирование (CABAC), основанное на синтаксисе контекстно-адаптивное двоичное арифметическое кодирование (SBAC), энтропийное кодирование с разделением интервала вероятности (PIPE) или другую методологию энтропийного кодирования или способ. После энтропийного кодирования модулем 56 энтропийного кодирования закодированный поток битов может быть передан к видео декодеру 30 или заархивирован для более поздней передачи или поиска видео декодером 30. Модуль 56 энтропийного кодирования может также энтропийно кодировать вектора движения и другие элементы синтаксиса для текущей видео закодированной вырезки.

[0114] Модуль 58 обратного квантования и модуль 60 обработки обратного преобразования применяют обратное квантование и обратное преобразование, соответственно, чтобы восстановить остаточный блок в пиксельной области для более позднего использования в качестве опорного блока опорной картинки. Модуль 44 компенсации движения может вычислить опорный блок, добавляя остаточный блок к предсказывающему блоку одной из опорных картинок в пределах одного из списков опорных картинок. Модуль 44 компенсации движения может также применить один или более фильтров интерполяции к восстановленному остаточному блоку, чтобы вычислить суб-целочисленные пиксельные значения для использования в оценке движения. Сумматор 62 добавляет восстановленный остаточный блок к блоку предсказания со скомпенсированным движением, сформированному модулем 44 компенсации движения, чтобы сформировать опорный блок, для сохранения в буфере 66 декодированных картинок. Опорный блок может использоваться модулем 42 оценки движения и модулем 44 компенсации движения как опорный блок, чтобы внешне предсказать блок в последующем видео кадре или картинке.

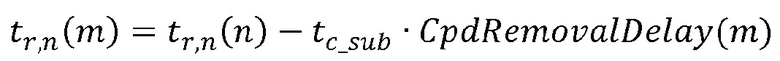

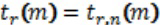

[0115] Видео кодер 20 также включает в себя модуль 64 фильтров, который может фильтровать границы блока, чтобы удалить артефакты блочности из восстановленного видео. Таким образом, модуль 64 фильтров может выполнять одну или более операций удаления блочности, чтобы уменьшить артефакты блочности в блоках кодирования, ассоциированных с CU. Модуль 64 фильтров может быть фильтром удаления блочности и фильтрует выходной сигнал сумматора 62. Дополнительные контурные фильтры (в контуре или после контура) могут также использоваться в дополнение к модулю 64 фильтров.