ОБЛАСТЬ ТЕХНИКИ, К КОТОРОЙ ОТНОСИТСЯ ИЗОБРЕТЕНИЕ

Настоящие варианты осуществления, в целом, относятся к способу, устройствам и компьютерной программе для кодирования пикселя входной видеопоследовательности.

УРОВЕНЬ ТЕХНИКИ

Высокий динамический диапазон (HDR) за последнюю пару лет стал весьма популярен в области телевидения и мультимедиа. На потребительском рынке появились экраны, способные отображать видеосигнал HDR. Было объявлено, что проигрыватели, воспроизводящие сигнал, поступающий через интернет (Over-The-Top (OTT)), например Netflix, способны доставлять конечному пользователю контент HDR. Органы стандартизации работают над формулированием требований к HDR. Например, согласно дорожной карте для цифрового телевизионного вещания (DVB), телевидение сверхвысокой четкости (UHDTV) фаза 2 будет включать в себя поддержку HDR. Экспертная группа по движущимся изображениям (MPEG) в настоящее время исследует возможности сжатия видеосигнала HDR.

Формирование изображения HDR представляет собой набор методов фотографирования, обеспечивающих расширенный динамический диапазон яркости по сравнению со стандартным формированием цифрового изображения. Динамический диапазон в цифровых камерах обычно измеряется в делениях диафрагмы, где увеличение диафрагмы на 1 деление удваивает количество света. Стандартный телевизор высокой четкости (HDTV) с жидкокристаллическим дисплеем (LCD), использующий стандартный динамический диапазон (SDR), может отображать до 10 делений диафрагмы. Согласно спецификации MPEG, HDR имеет динамический диапазон свыше 16 делений диафрагмы.

В ходе кодирования видеосигнала, также именуемого сжатием, яркостная компонента Y' и две цветностные компоненты Cb' и Cr' обычно обрабатываются независимо, поскольку, они, согласно стандарту, в ходе декодирования, также именуемого снятием сжатия, обрабатываются независимо. Однако, после декодирования, реконструированные яркостные и цветностные компоненты преобразуются в цветовую схему RGB (красный, зеленый, синий). Таким образом, если принимать во внимание, что после декодирования осуществляется преобразование в RGB, яркостные и цветностные компоненты больше не являются независимыми.

В результате, ошибка, например, в цветностной компоненте Cb' или Cr' в ходе кодирования будет приводить к ошибке в цветовых компонентах R, G и B. В частности, это может приводить к неверной яркости, к которой наши глаза наиболее чувствительны.

Таким образом, требуется усовершенствовать кодирование видеопоследовательностей.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Общей задачей является обеспечение улучшенного кодирования пикселей входной видеопоследовательности.

Эта и другие задачи решаются раскрытыми здесь вариантами осуществления.

Аспект вариантов осуществления относится к способу кодирования пикселя входной видеопоследовательности. Способ содержит кодирование значения второй цветовой компоненты и значения третьей цветовой компоненты пикселя в первом цветовом пространстве. Способ также содержит получение значения первой цветовой компоненты во втором цветовом пространстве для пикселя, причем второе цветовое пространство отличается от первого цветового пространства. Способ дополнительно содержит определение значения первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве, причем пробное значение цветовой компоненты выводится на основании кодированного значения второй цветовой компоненты и значения кодированной третьей компоненты. Способ дополнительно содержит кодирование значения первой цветовой компоненты пикселя в первом цветовом пространстве.

Другой аспект вариантов осуществления относится к устройству для кодирования пикселя входной видеопоследовательности. Устройство выполнено с возможностью кодирования значения второй цветовой компоненты и значения третьей цветовой компоненты пикселя в первом цветовом пространстве. Устройство также выполнено с возможностью получения значения первой цветовой компоненты во втором цветовом пространстве для пикселя, причем второе цветовое пространство отличается от первого цветового пространства. Устройство дополнительно выполнено с возможностью определения значения первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве, причем пробное значение цветовой компоненты выводится на основании кодированного значения второй цветовой компоненты и значения кодированной третьей компоненты. Устройство дополнительно выполнено с возможностью кодирования значения первой цветовой компоненты пикселя в первом цветовом пространстве.

Дополнительный аспект вариантов осуществления относится к устройству для кодирования пикселя входной видеопоследовательности. Устройство содержит средство кодирования для кодирования значения второй цветовой компоненты и значения третьей цветовой компоненты пикселя в первом цветовом пространстве. Устройство также содержит средство получения для получения значения первой цветовой компоненты во втором цветовом пространстве для пикселя, причем второе цветовое пространство отличается от первого цветового пространства. Устройство дополнительно содержит средство модификации для определения значения первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве, причем пробное значение цветовой компоненты выводится на основании кодированного значения второй цветовой компоненты и значения кодированной третьей компоненты. Устройство дополнительно содержит средство кодирования для кодирования значения первой цветовой компоненты пикселя в первом цветовом пространстве.

Еще один аспект вариантов осуществления относится к компьютерной программе, содержащей инструкции, которые, при исполнении процессором, предписывают процессору для кодирования значения второй цветовой компоненты и значения третьей цветовой компоненты, пикселя входной видеопоследовательности, в первом цветовом пространстве. Процессору также предписывается получать значение первой цветовой компоненты во втором цветовом пространстве для пикселя, причем второе цветовое пространство отличается от первого цветового пространства. Процессору дополнительно предписывается определять значение первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве, причем пробное значение цветовой компоненты выводится на основании кодированного значения второй цветовой компоненты и значения кодированной третьей компоненты. Процессору дополнительно предписывается кодировать значение первой цветовой компоненты пикселя в первом цветовом пространстве.

Родственный аспект вариантов осуществления предусматривает носитель, содержащий компьютерную программу согласно вышеописанному. Носитель представляет собой один из электронного сигнала, оптического сигнала, электромагнитного сигнала, магнитного сигнала, электрического сигнала, радиосигнала, микроволнового сигнала или компьютерно-считываемого носителя данных.

Другой аспект вариантов осуществления относится к сигналу, представляющему кодированную версию пикселя изображения входной видеопоследовательности. При этом кодированная версия содержит значение первой цветовой компоненты, значение второй цветовой компоненты и значение третьей цветовой компоненты в первом цветовом пространстве, кодированные согласно вышеописанному способу или вышеописанным устройством.

Варианты осуществления предусматривают улучшенное кодирование пикселей во входной видеопоследовательности с учетом любых ошибок, уже внесенных кодером в кодирование значений второй и третьей цветовых компонент для пикселя при кодировании значения первой цветовой компоненты пикселя. В результате улучшенного кодирования, визуальное качество, например, воспринимаемое в яркости пикселя, может повышаться.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

Варианты осуществления, совместно с их дополнительными задачами и преимуществами, можно наилучшим образом понять, обратившись к нижеследующему описанию, приведенному совместно с прилагаемыми чертежами, в которых:

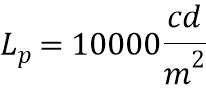

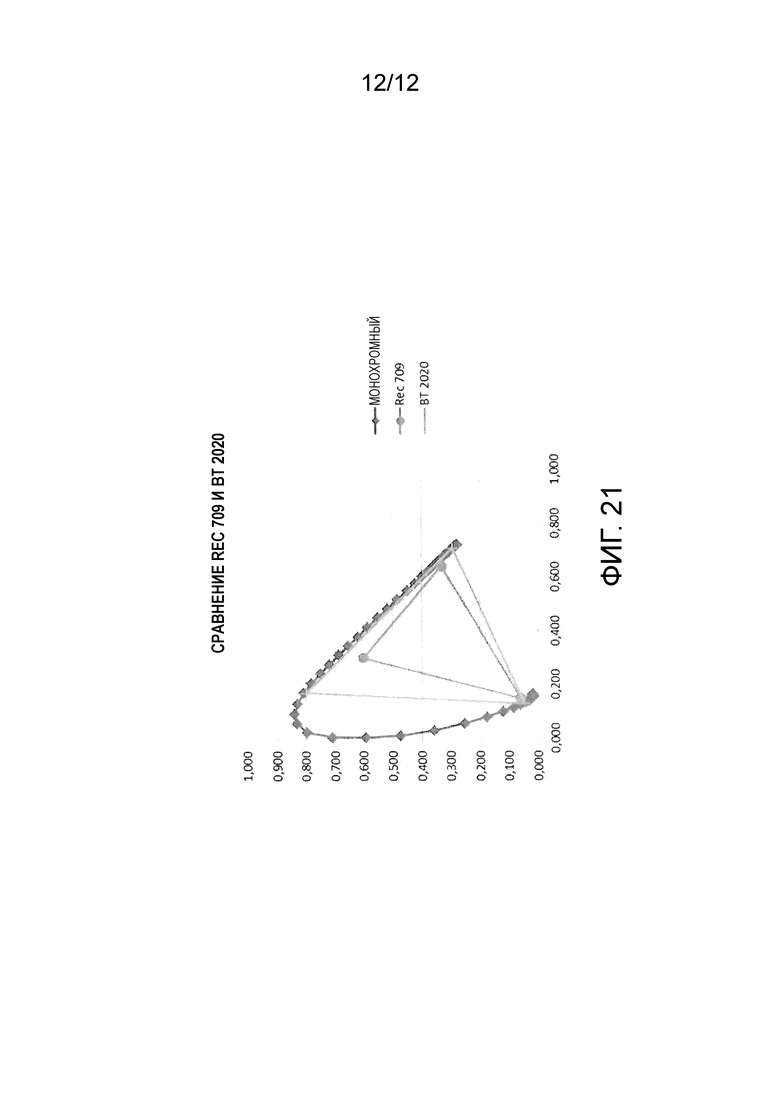

фиг. 1 - блок-схема последовательности операций, демонстрирующая способ кодирования пикселя согласно варианту осуществления;

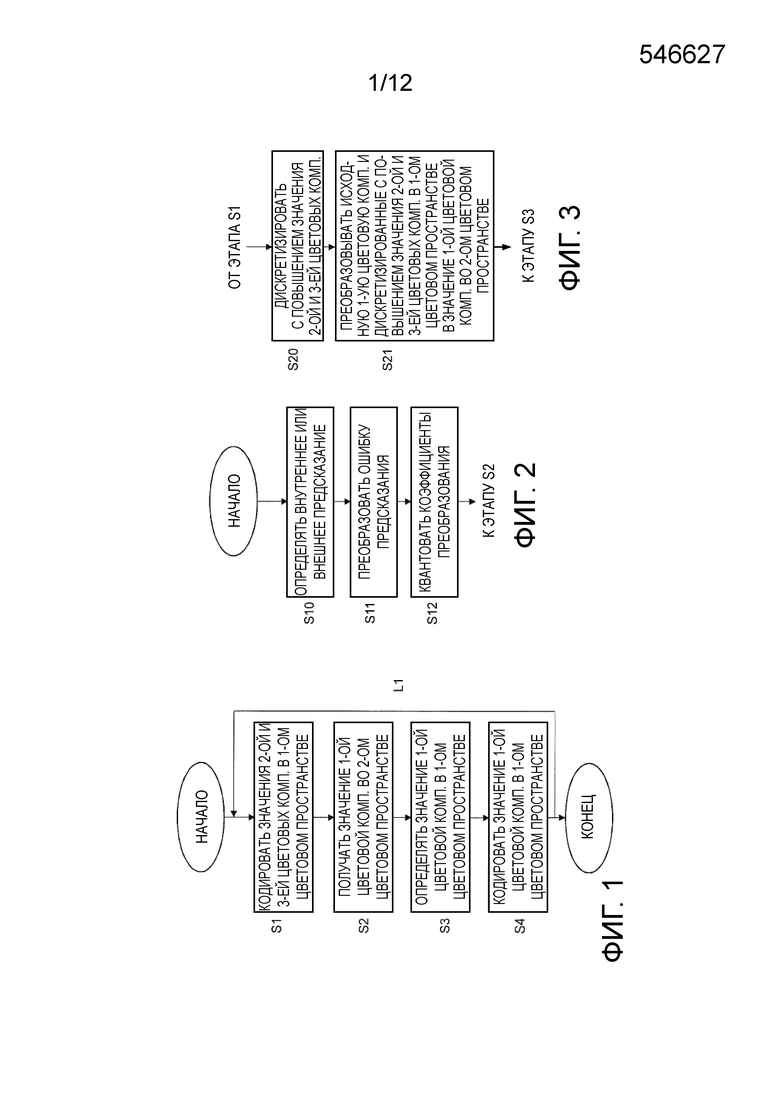

фиг. 2 - блок-схема последовательности операций, демонстрирующая вариант осуществления кодирования на этапе S1 на фиг. 1;

фиг. 3 - блок-схема последовательности операций, демонстрирующая вариант осуществления получения на этапе S2 на фиг. 1;

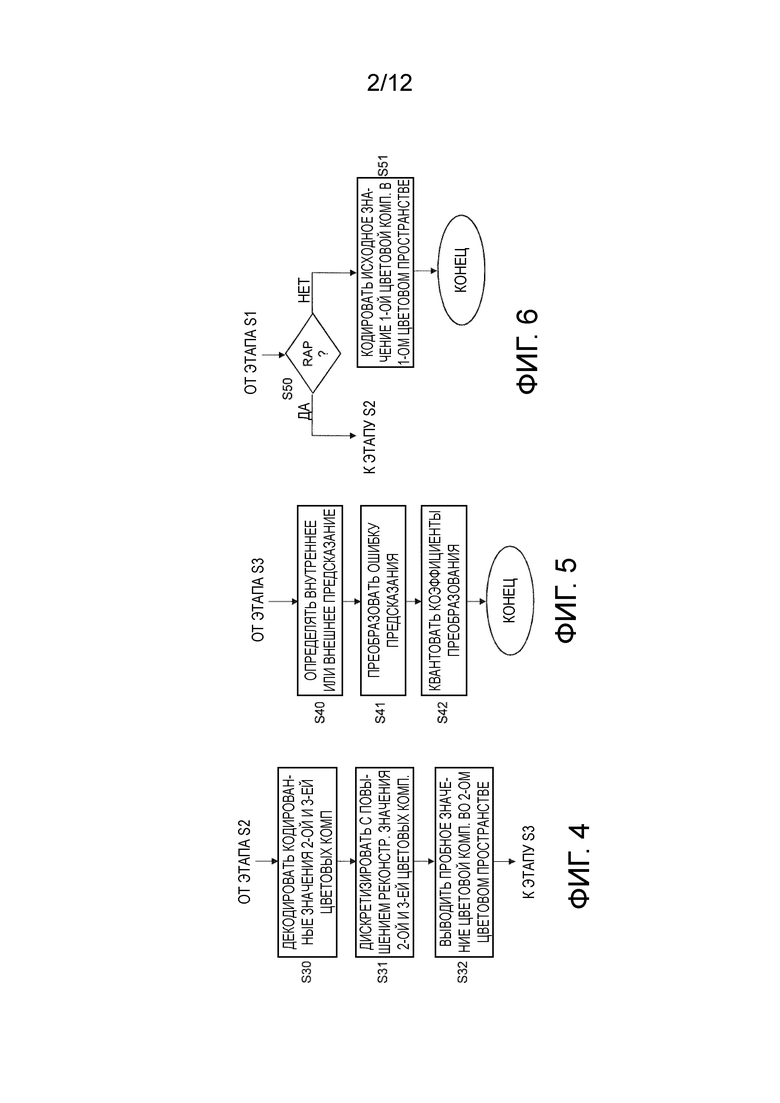

фиг. 4 - блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа на фиг. 1 согласно варианту осуществления;

фиг. 5 - блок-схема последовательности операций, демонстрирующая вариант осуществления кодирования на этапе S4 на фиг. 1;

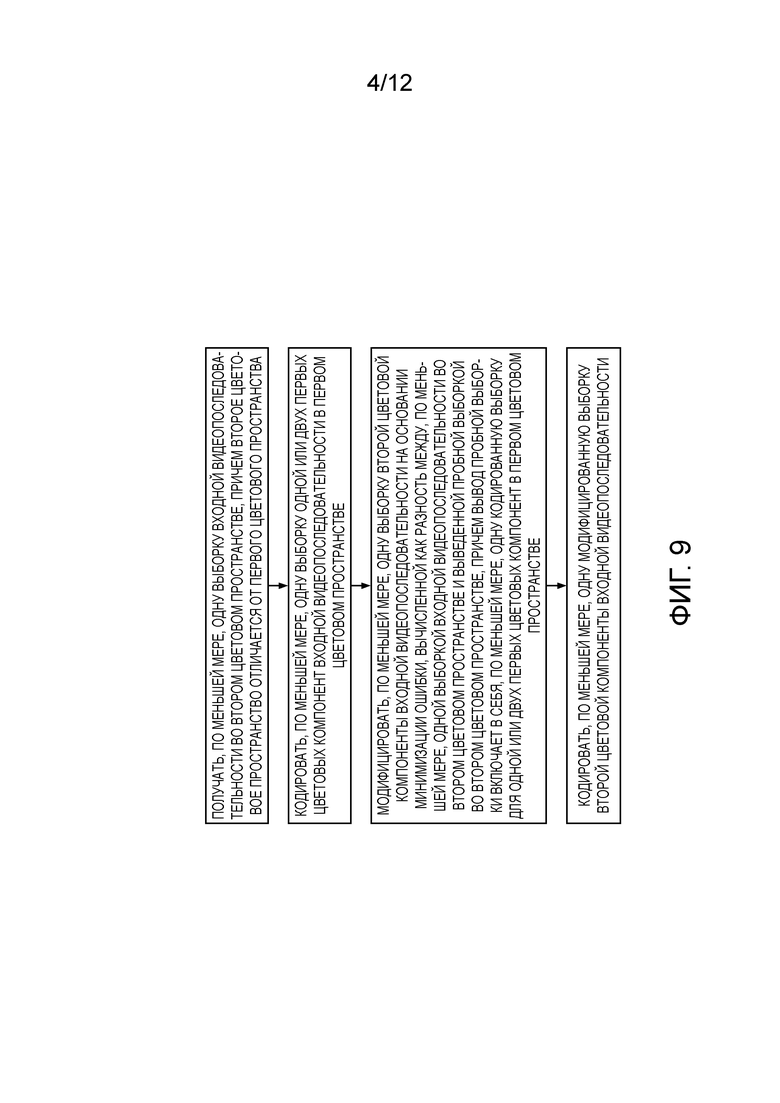

фиг. 6 - блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа на фиг. 1 согласно другому варианту осуществления;

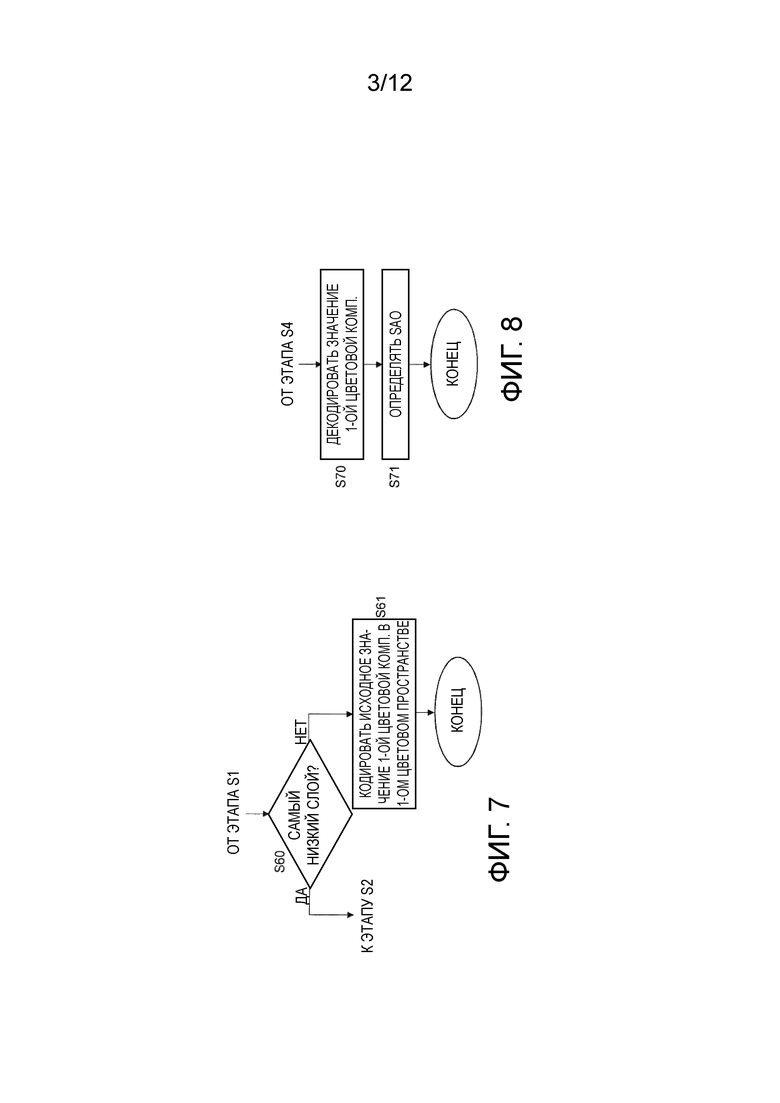

фиг. 7 - блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа на фиг. 1 согласно дополнительному варианту осуществления;

фиг. 8 - блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа на фиг. 1 согласно еще одному варианту осуществления;

фиг. 9 - блок-схема последовательности операций, демонстрирующая способ кодирования, по меньшей мере, одной выборки входной видеопоследовательности согласно варианту осуществления;

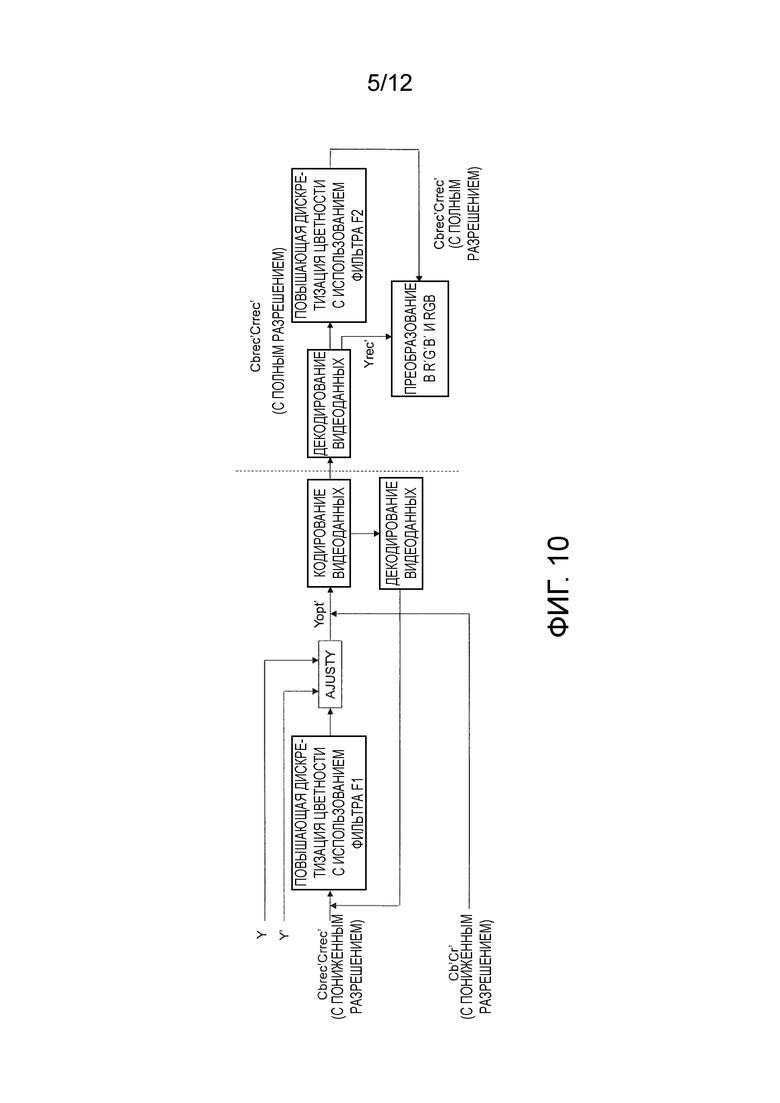

фиг. 10 схематически демонстрирует вариант осуществления, использующий разные фильтры повышающей дискретизации в ходе кодирования и декодирования;

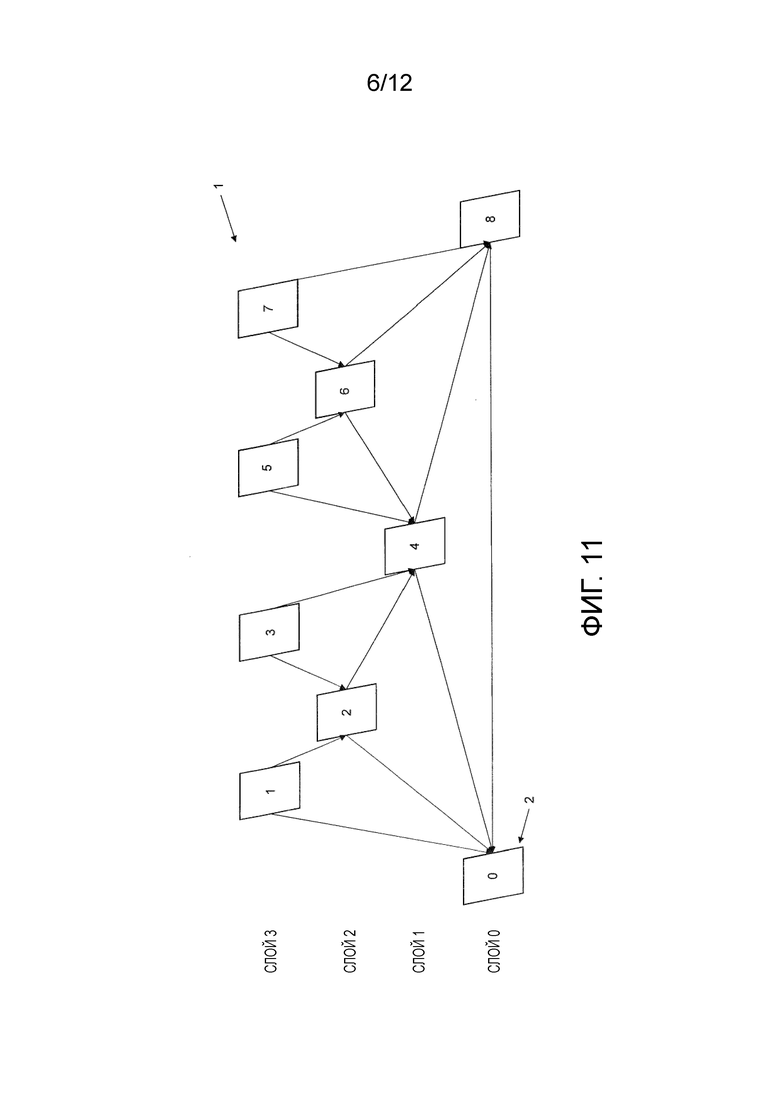

фиг. 11 схематически демонстрирует изображения входной видеопоследовательности, организованные в виде структуры групп изображений (GOP);

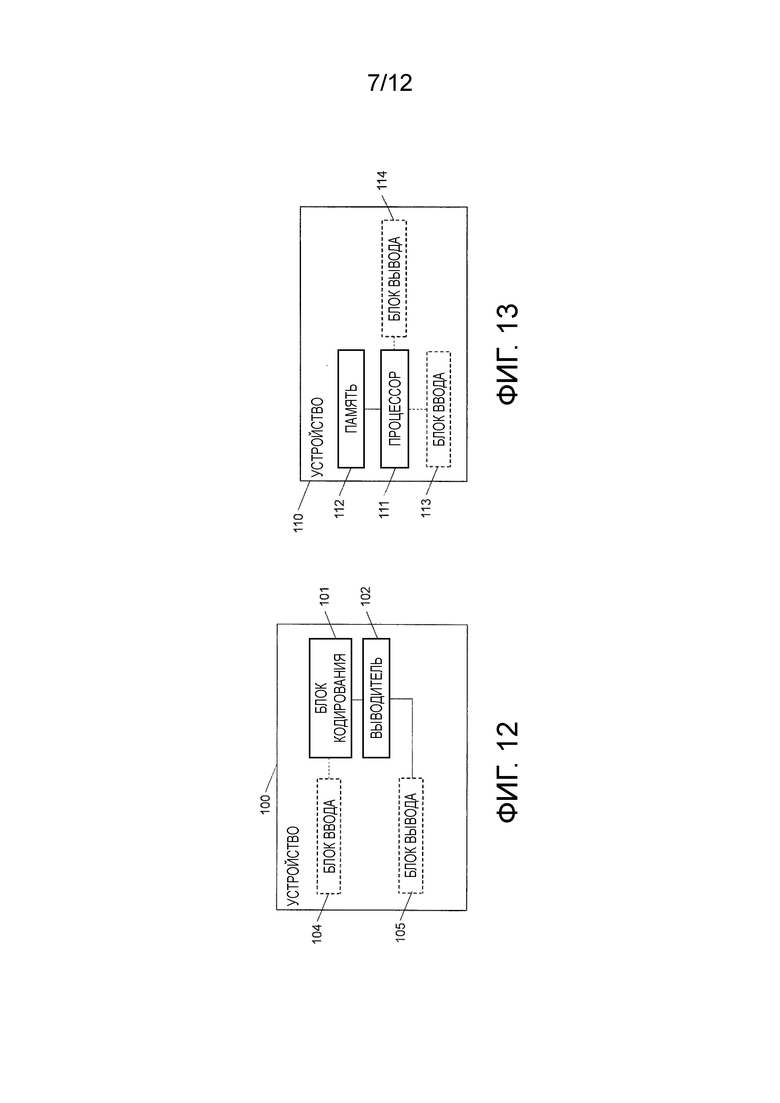

фиг. 12 - схема аппаратной реализации устройства согласно вариантам осуществления;

фиг. 13 - схема реализации устройства согласно вариантам осуществления с процессором и памятью;

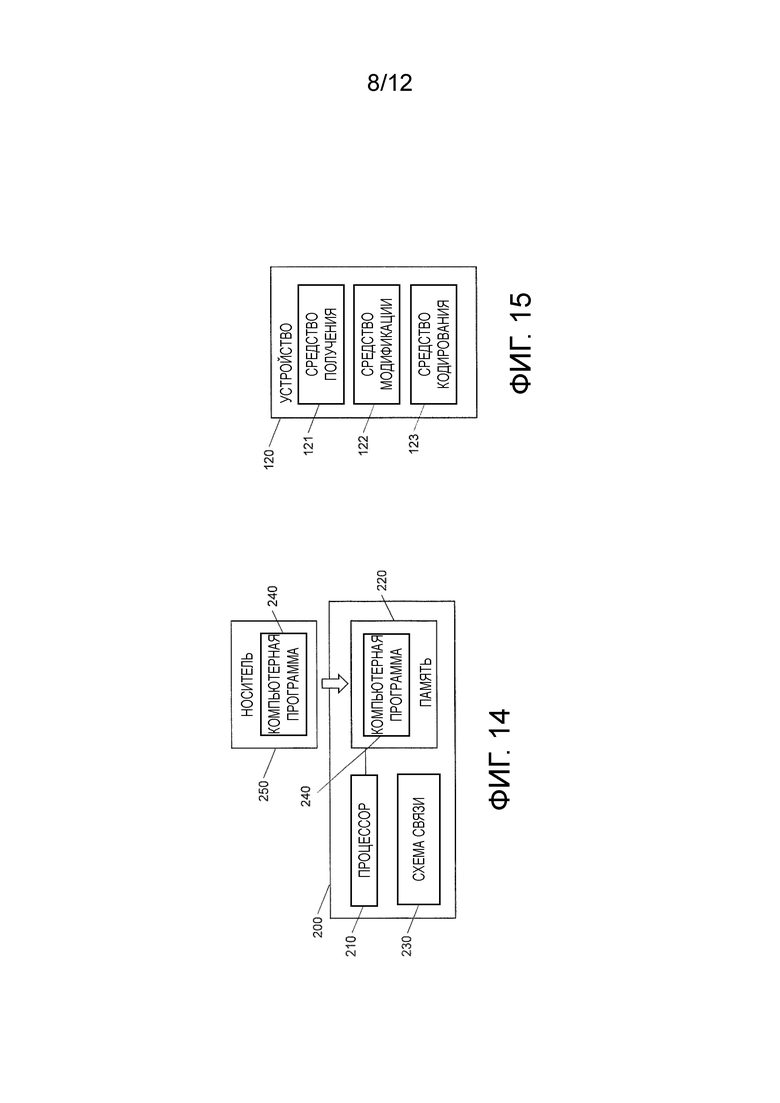

фиг. 14 - схема пользовательского оборудования согласно варианту осуществления;

фиг. 15 - схема реализации устройства согласно вариантам осуществления с функциональными модулями;

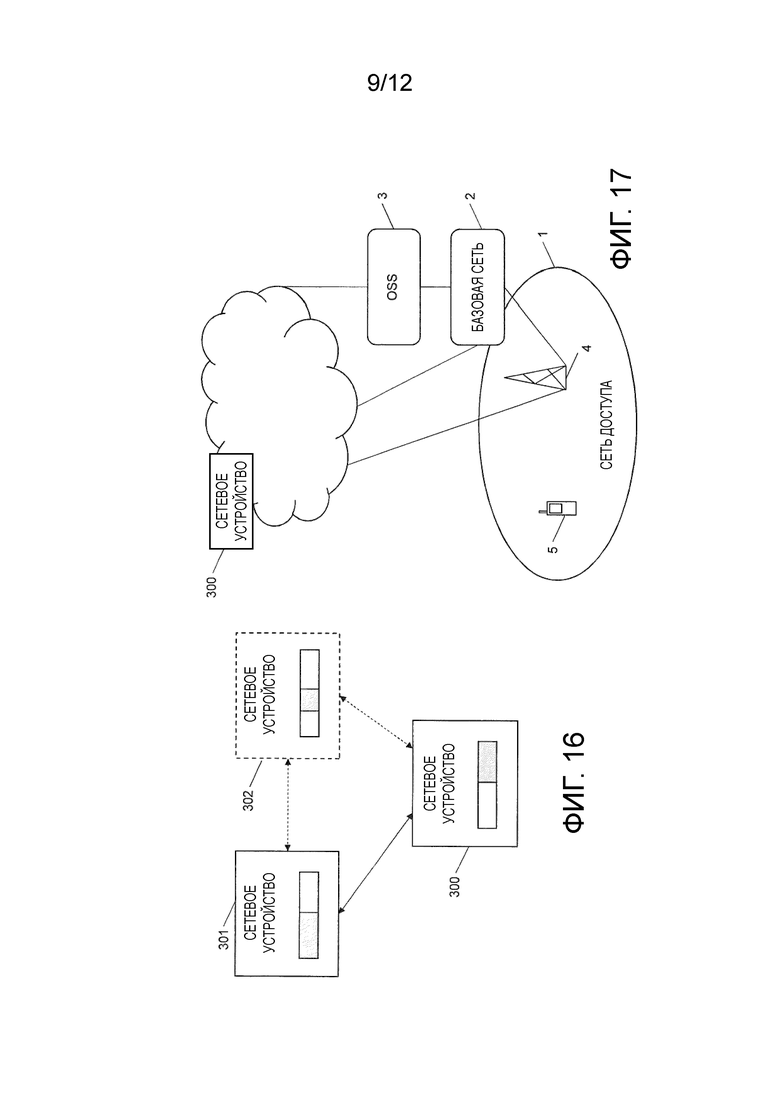

фиг. 16 - схема, демонстрирующая распределенную реализацию вариантов осуществления среди множественных сетевых устройств;

фиг. 17 - схема примера системы беспроводной связи с одним или более облачными сетевыми устройствами согласно варианту осуществления;

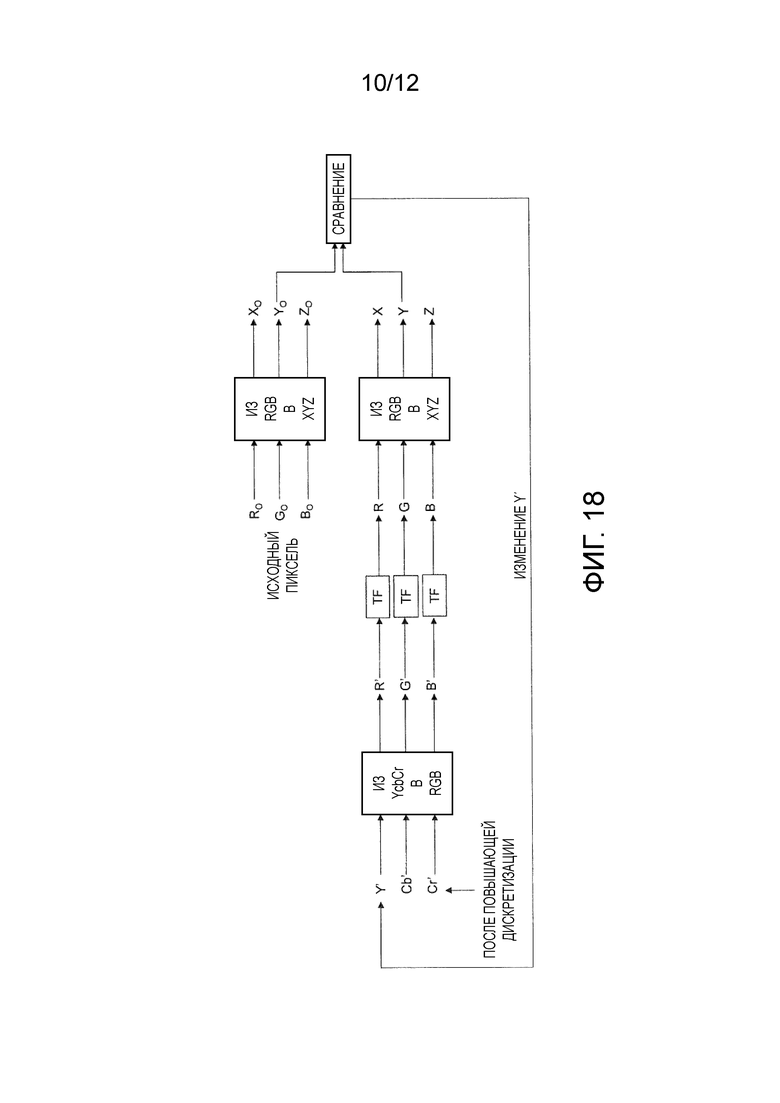

фиг. 18 демонстрирует вариант осуществления вывода скорректированного Y';

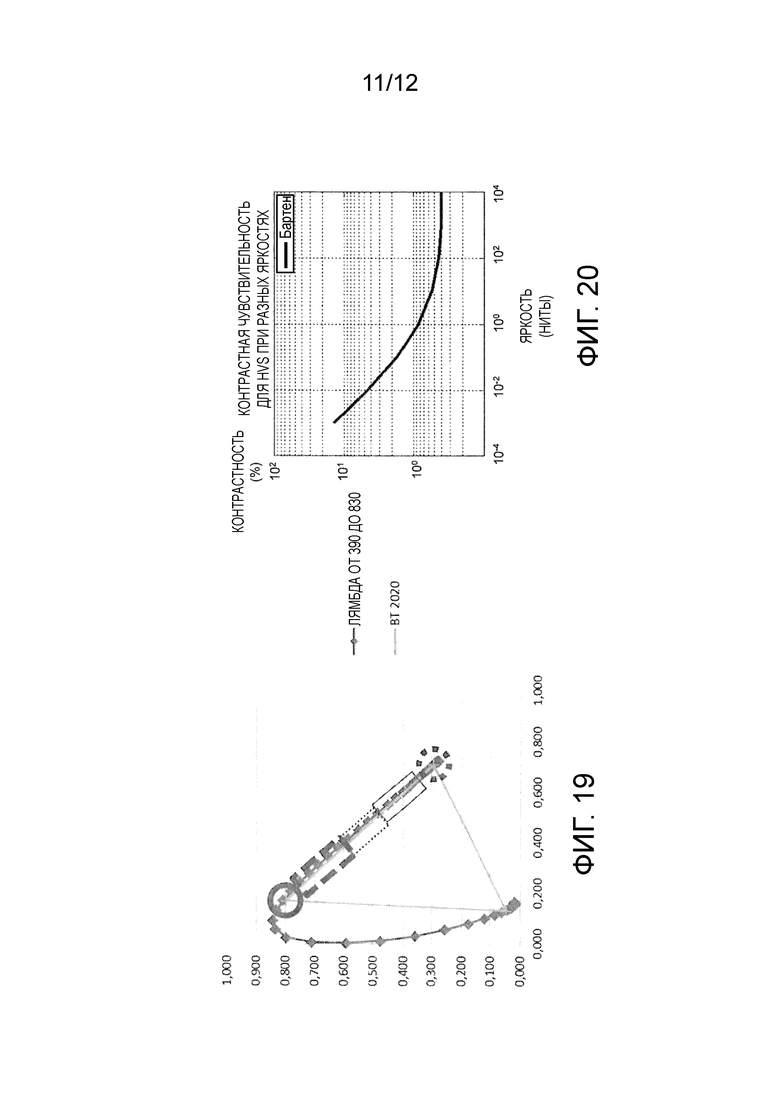

фиг. 19 - схема, демонстрирующая, что могут существовать разные линеаризации в разных цветовых областях;

фиг. 20 демонстрирует кривую Бартена для контрастной чувствительности; и

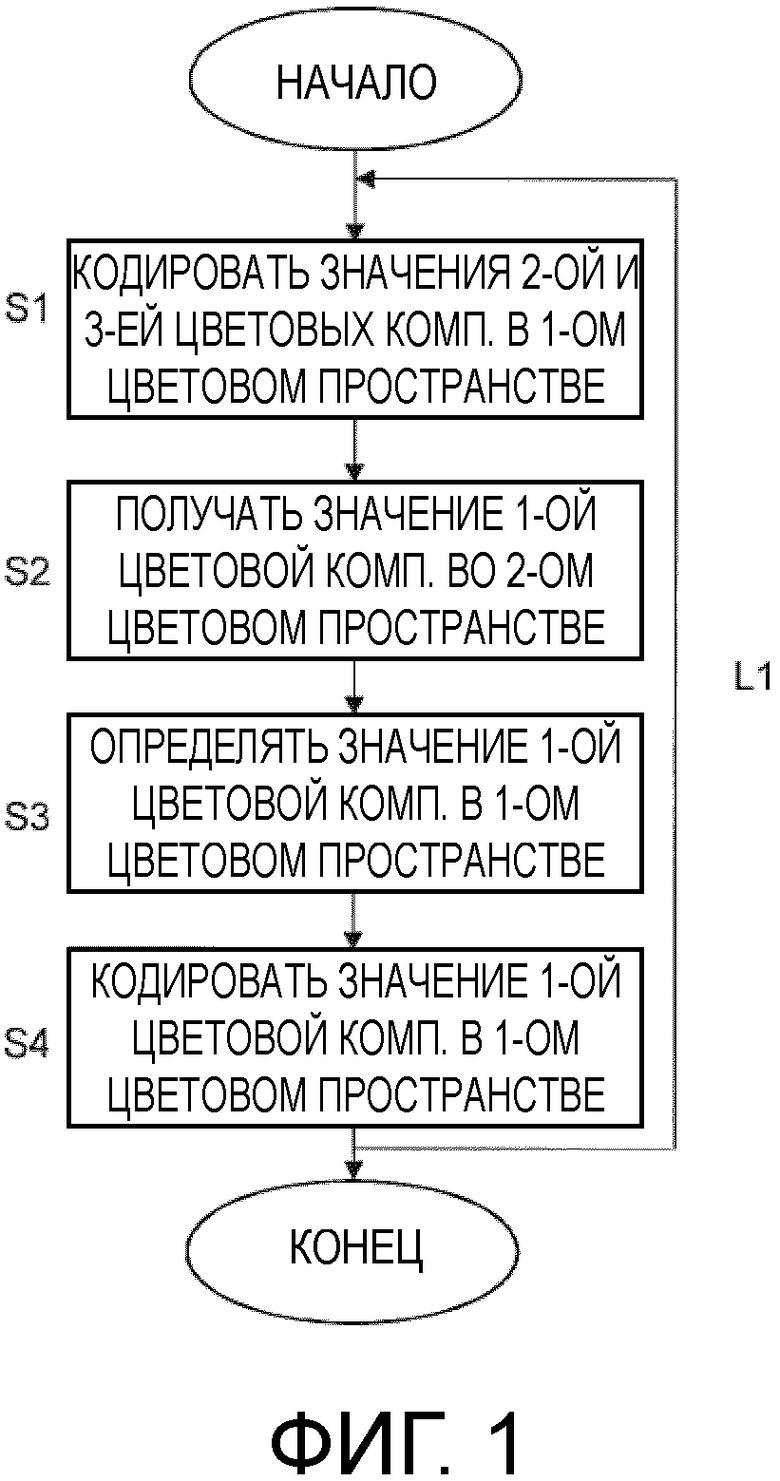

фиг. 21 демонстрирует сравнение между цветовыми гаммами Rec709 и BT.2020.

ПОДРОБНОЕ ОПИСАНИЕ

В чертежах одинаковые ссылочные позиции используются для обозначения аналогичных или соответствующих элементов.

Настоящие варианты осуществления, в целом, относятся к способу, устройствам и компьютерной программе для кодирования пикселя входной видеопоследовательности.

При кодировании видеоданных, несколько разных цветовых пространств или форматов используются для представления значений цвета. В этом документе используется следующая терминология:

RGB: значения линейного RGB, где каждое значение пропорционально кд/м2 (ʺколичество фотоновʺ).

XYZ: значения линейного XYZ в цветовом пространстве CIE 1931, где каждое значение является линейной комбинацией RGB. Y называется ʺяркостьʺ и отражает то, что глаз воспринимает как светлоту. Пространство XYZ важно, поскольку оно отображается в цветовосприятие зрительной системы человека. Согласно варианту осуществления, именно в этом цветовом пространстве желательно минимизировать ошибку, вносимую сжатием или кодированием.

pq(Y)xy: значения нелинейного XYZ, которые наилучшим образом соответствуют цветовосприятию человека. pq(Y) является нелинейным представлением, где нелинейная функция pq(.) применена к линейной яркости Y. xy является нелинейным представлением цветности, поскольку оно было нормировано по ʺсветлотеʺ посредством x=X/(X+Y+Z), y=Y/(X+Y+Z).

pq(Y)u'v': представление цвета, где pq(Y) содержит всю яркость, и u'v' - всю цветность. Из pq(Y) можно извлечь Y, и из Y, u' и v' можно извлечь XYZ, которое может преобразовываться в RGB.

R'G'B': значения нелинейного RGB. R'=pq(R), G'=pq(G), B'=pq(B), где pq(.) является нелинейной функцией.

Y'Cb'Cr': нелинейное представление, где каждое значение является линейной комбинацией R', G' и B'. Y' называется ʺяркостьюʺ, и Cb' и Cr' совместно называются ʺцветностьюʺ. Это делается для того, чтобы отличить Y' от яркости, поскольку Y' также содержит некоторую цветность, и Cb' и Cr' также содержит некоторую яркость. Значения Y'Cb'Cr' обычно кодируются и сжимаются видеокодерами. После декодирования они будут преобразовываться в R'G'B' и затем в RGB, которые могут отображаться.

ICtCp: представление цвета, предназначенное для формирования изображений в режиме HDR и широкой цветовой гаммы (WCG) и призванное быть альтернативой Y'Cb'Cr'. I представляет интенсивность и является представлением информации яркости, тогда как CtCp несет информацию цветности.

Yopt' - оптимальный Y', выведенный с целью минимизации ошибки Y.

4:2:0 - вторая и третья цветовые компоненты, например, цветностные компоненты, были субдискретизированы по горизонтали и по вертикали с коэффициентом два по сравнению с первой цветовой компонентой, например, яркостной компонентой.

4:2:2 - вторая и третья цветовые компоненты, например, цветностные компоненты, были субдискретизированы по горизонтали или по вертикали с коэффициентом два по сравнению с первой цветовой компонентой, например, яркостной компонентой.

4:4:4 - субдискретизации не применялось, или применялась субдискретизация с последующей повышающей дискретизацией, т.е. все компоненты имеют одинаковое разрешение.

Варианты осуществления основаны на адаптации целевого значения для кодирования одной цветовой компоненты при условии сжатия или кодирования, по меньшей мере, одной другой цветовой компоненты и обработки, которая осуществляется на разжатом или декодированном видеосигнале до отображения. С этой целью осуществляется модификация перцепционно квантованного исходного значения первой цветовой компоненты, например, значения Y', на основании реконструированных, т.е. субдискретизированных, кодированных, декодированных и дискретизированных с повышением, значений второй и третьей цветовых компонент, например, значений Cb'Cr', и обработки, которая осуществляется на разжатом или декодированном видеосигнале до отображения для лучшего соответствия исходной линейной яркости, например Y, или исходной перцепционно квантованной линейной яркости, например pq(Y).

На фиг. 1 показана блок-схема последовательности операций, демонстрирующая способ кодирования пикселя входной видеопоследовательности. Способ содержит кодирование, на этапе S1, значения второй цветовой компоненты и значения третьей цветовой компоненты пикселя в первом цветовом пространстве. Способ также содержит получение, на этапе S2, значения первой цветовой компоненты во втором цветовом пространстве для пикселя. Второе цветовое пространство отличается от первого цветового пространства. Затем способ переходит к этапу S3, который содержит определение первой цветовой компоненты пикселя в первом цветовом пространстве. Это значение первой цветовой компоненты определяется на этапе S3 на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве. Пробное значение цветовой компоненты выводится на основании кодированное значение второй цветовой компоненты и кодированное значение третьей цветовой компоненты. Затем, на этапе S4, значение первой цветовой компоненты пикселя в первом цветовом пространстве кодируется.

Таким образом, кодированное представление пикселя содержит кодированное значение первой цветовой компоненты, полученное на этапе S4, и кодированные значения второй и третьей цветовых компонент, полученные на этапе S1.

Этапы S1 - S4 способа, показанные на фиг. 1, осуществляются для, по меньшей мере, одного пикселя входной видеопоследовательности, содержащей множественные, т.е. по меньшей мере, два, изображения, и где каждое изображение содержит множество пикселей. В предпочтительном варианте осуществления, способ применяется к множественным пикселям в изображении входной видеопоследовательности, например, ко всем пикселям в изображении, что схематически проиллюстрировано линией L1 на фиг. 1. Способ также может применяться к пикселям неподвижного изображения.

Таким образом, способ кодирования пикселя на фиг. 1 адаптирует, на этапе S3, значение первой цветовой компоненты для кодирования на основании кодирования значений второй и третьей цветовых компонент на этапе S1 и, предпочтительно, обработки, которая осуществляется на декодированном видеосигнале до отображения. Оптимальное значение первой цветовой компоненты для пикселя в первом цветовом пространстве определяется на основании сравнения значений первой цветовой компоненты и пробной цветовой компоненты во втором цветовом пространстве, которое, предпочтительно, является цветовым пространством, которое воспринимает зрительная система человека. Адаптация оптимального значения первой цветовой компоненты на основании процесса кодирования и декодирования достигается, по меньшей мере, частично, путем вывода пробного значения цветовой компоненты на основании кодированных значений второй и третьей цветовых компонент, полученных на этапе S1.

На фиг. 2 показана блок-схема последовательности операций, демонстрирующая вариант осуществления кодирования на этапе S1 на фиг. 1. В этом варианте осуществления, этапы S10 - S12 осуществляются для каждого значения цветовой компоненты из значения второй цветовой компоненты и значения третьей цветовой компоненты. Этап S10 содержит определение внутреннего или внешнего предсказания значения цветовой компоненты. Затем ошибка предсказания, вычисленная как разность между значением цветовой компоненты и внутренним или внешним предсказанием, преобразуется на этапе S11 для формирования коэффициентов преобразования. Коэффициенты преобразования, полученные на этапе S11, квантуются на этапе S12. В этом случае, квантованные коэффициенты преобразования являются кодированной версией значения цветовой компоненты. В необязательном варианте осуществления, квантованные коэффициенты преобразования поступают на кодер, например, энтропийный кодер, для кодирования. Затем способ переходит к этапу S2 на фиг. 1.

В общем случае, внутреннее предсказание предусматривает отыскание внутреннего (I) предсказания или пространственного предсказания значения цветовой компоненты на основании значений соседних пикселей в том же изображении, что и текущий пиксель. Таким образом, внутреннее предсказание использует данные из соседних предсказательных блоков пикселей, ранее декодированных из того же изображения.

Соответственно, внешнее предсказание предусматривает компенсацию движения, в котором предсказание пикселей в блоке пикселей в текущем изображении выводится на основании пиксельных значений в блоке пикселей в ранее декодированном изображении видеопоследовательности или на основании пиксельных значений в блоках пикселей в двух ранее декодированных изображениях видеопоследовательности. Внешнее предсказание также именуется временным предсказанием и, таким образом, достигается с использованием внешнего (P) или двунаправленного внешнего (B) предсказания из ранее декодированных опорных изображений.

Разность между исходными пиксельными данными и предсказанными пиксельными данными, именуемая ошибкой предсказания или остатком, преобразуется в частотную область и квантуется с использованием параметра квантования (QP).

За дополнительной информацией о внутреннем и внешним предсказании следует обратиться к разделам 8.4 и 8.5 в документе [4]. Раздел 8.6 в документе [4] содержит дополнительную информацию в отношении преобразования ошибок предсказания и квантования коэффициентов преобразования.

Кодирование значений второй и третьей цветовых компонент на этапе S1 может осуществляться в соответствии с известными стандартами кодирования/декодирования видеоданных, например, высокопроизводительного видеокодирования (HEVC), также именуемого H.265; H.264/усовершенствованного кодирования видеоданных (AVC); стандартами кодирования/декодирования видеоданных для HDR или видео широкой цветовой гаммы (WCG); и т.д. В последнем случае, входная видеопоследовательность является видеопоследовательностью HDR или WCG.

На фиг. 3 показана блок-схема последовательности операций, демонстрирующая вариант осуществления этапа S2 на фиг. 1. Способ переходит от этапа S1 на фиг. 1 или этапа S12 на фиг. 2. В этом варианте осуществления, значение второй цветовой компоненты и значение третьей цветовой компоненты в первом цветовом пространстве дискретизируются с повышением на этапе S20 для получения дискретизированного с повышением значения второй цветовой компоненты и дискретизированного с повышением значения третьей цветовой компоненты в первом цветовом пространстве. Затем способ переходит к этапу S21, который содержит преобразование исходного значения первой цветовой компоненты пикселя в первом цветовом пространстве и дискретизированного с повышением значения второй цветовой компоненты и дискретизированного с повышением значения третьей цветовой компоненты в первом цветовом пространстве в значение первой цветовой компоненты во втором цветовом пространстве. Затем способ переходит к этапу S3 на фиг. 1.

Вторая и третья цветовые компоненты, предпочтительно, находятся в субдискретизированной форме, например, в формате 4:2:0 или 4:2:2. Повышающая дискретизация на этапе S20 может осуществляться согласно известным методам повышающей дискретизации. Например, повышающая дискретизация может осуществляться с использованием билинейных или удлиненных фильтров. Пример метода повышающей дискретизации, который можно использовать согласно вариантам осуществления, раскрыт в разделе B.1.5.6 Chroma upsampling from 4:2:0 to 4:4:4 (Y'CbCr domain) в документе [5]. Результатом повышающей дискретизации на этапе S20, является дискретизированные с повышением значения второй и третьей цветовых компонент в формате 4:4:4.

Согласно варианту осуществления, вторая и третья цветовые компоненты являются цветностными компонентами Cb'Cr' 4:2:0 или 4:2:2 в цветовом пространстве Y'Cb'Cr'. Таким образом, повышающая дискретизация на этапе S20, генерирует значения компоненты Cb'Cr' в формате 4:4:4. В этом варианте осуществления, исходным значением первой цветовой компоненты является исходное значение Y' в формате Y'Cb'Cr'. В общем случае, пиксели входной видеопоследовательности, подлежащие кодированию, имеют исходный цвет Y'Cb'Cr' в 4:2:0 или 4:2:2. В таком случае, исходное значение Y' является входным значением яркостной компоненты пикселя, причем значения второй и третьей цветовых компонент являются входными субдискретизированными значениями цветностной компоненты для пикселя. Затем значение Y' 4:4:4 и значения Cb'Cr' 4:4:4 преобразуются в значение первой цветовой компоненты во втором цветовом пространстве. Это значение первой цветовой компоненты во втором цветовом пространстве может быть значением линейной яркости Y в цветовом пространстве XYZ или значением нелинейной яркости pq(Y) в цветовом пространстве pq(Y)xy. Другим примером является pq(Y) в цветовом пространстве pq(Y)u'v'. Поэтому Y=функция(Y', Cb', Cr') или pq(Y)=функция(Y', Cb', Cr').

В первом случае, т.е. Y=функция(Y', Cb', Cr'), преобразование на этапе S21, предпочтительно, содержит применение первого цветового преобразования для получения нелинейного цвета в третьем цветовом пространстве, предпочтительно, цвета R'G'B' в цветовом пространстве RGB, например, с использованием уравнения 1.

R'=Y'+1,47460×Cr

G'=Y'-0,16455×Cb-0,57135×Cr (уравнение 1)

B'=Y'+1,88140×Cb

Первая передаточная функция, например, передаточная функция в уравнении A1 в приложении A, применяется к нелинейному цвету в третьем цветовом пространстве для получения линейного цвета в третьем цветовом пространстве, предпочтительно, цвета RGB в цветовом пространстве RGB.

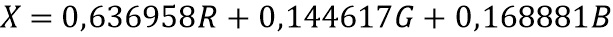

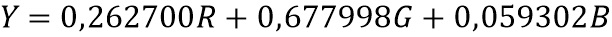

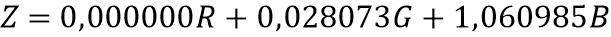

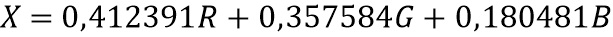

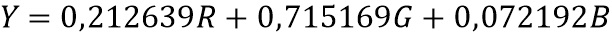

Затем второе цветовое преобразование применяется к линейному цвету в третьем цветовом пространстве для получения первой цветовой компоненты во втором цветовом пространстве, предпочтительно, цветовое преобразование из RGB в XYZ, см. уравнение 2 или 3:

(уравнение 2)

(уравнение 2)

(уравнение 3)

(уравнение 3)

Фактически, необходимо вычислять только вторую линию в уравнении 2 или 3 для получения значения линейной яркостной компоненты Y в цветовом пространстве XYZ, т.е. значения первой цветовой компоненты во втором цветовом пространстве в этом варианте осуществления.

Таким образом, вышеописанный вариант осуществления можно описать как предусматривающий следующие этапы способа: Y'Cb'Cr' 4:2:0 -(повышающая дискретизация)-> Y'Cb'Cr' 4:4:4 -(цветовое преобразование)-> R'G'B' 4:4:4 -(передаточная функция)-> RGB 4:4:4 -(цветовое преобразование)-> XYZ 4:4:4 и затем поддержание Y, или, как показано ниже, преобразование Y в pq(Y).

Во втором случае, т.е. pq(Y)=функция(Y', Cb', Cr'), преобразование на этапе S21 может осуществляться, как описано выше, пока не будет вычислено значение линейной яркостной компоненты Y в цветовом пространстве XYZ. Затем вторая передаточная функция, например, обратная передаточной функции в уравнении A1 в приложении A, применяется к значению линейной яркостной компоненты для получения значения нелинейной яркостной компоненты pq(Y) в цветовом пространстве pq(Y)xy, т.е. значение первой цветовой компоненты во втором цветовом пространстве в этом варианте осуществления.

В этих вариантах осуществления, исходное значение первой цветовой компоненты в первом цветовом пространстве (Y'), предпочтительно, определяется согласно способу Ajusty в приложении A.

В другом варианте осуществления, значение первой цветовой компоненты во втором цветовом пространстве получается на основании линейного цвета пикселя в третьем цветовом пространстве, например, цвета RGB 4:4:4. Этот линейный цвет в третьем цветовом пространстве, согласно варианту осуществления, является исходным цветом пикселя до любой обработки предварительного кодирования. Затем обработка предварительного кодирования предусматривает преобразование линейного цвета в третьем цветовом пространстве (RGB 4:4:4) в значения первой, второй и третьей цветовых компонент в первом цветовом пространстве, т.е. Y'Cb'Cr' 4:2:0. При наличии на кодере линейного цвета в третьем цветовом пространстве, значение первой цветовой компоненты во втором цветовом пространстве можно непосредственно вычислять из него путем применения цветового преобразования, например, показанного в уравнении 2 или 3.

Таким образом, этот вариант осуществления можно описать как предусматривающий следующие этапы способа: RGB 4:4:4 -(цветовое преобразование)-> XYZ 4:4:4 и затем поддержание Y, или преобразование Y в pq(Y).

В еще одном варианте осуществления, кодер может обращаться к значениям второй и третьей цветовых компонент в первом цветовом пространстве в недискретизированной форме, т.е. субдискретизации. В таком случае, значение первой цветовой компоненты можно вычислять из этого цвета Y'Cb'Cr' 4:4:4 согласно следующим этапам способа:

Y'Cb'Cr' 4:4:4 -(цветовое преобразование)-> R'G'B' 4:4:4 -(передаточная функция)-> RGB 4:4:4 -(цветовое преобразование)-> XYZ 4:4:4 и затем поддержание Y, или преобразование Y в pq(Y).

Представленные выше варианты осуществления получения значения первой цветовой компоненты во втором цветовом пространстве могут осуществляться как предварительный этап и не обязательно для каждого блока пикселей. Например, можно определить значение первой цветовой компоненты во втором цветовом пространстве для всего изображения или, по меньшей мере, его части, до начала кодирования.

Можно также отправлять заранее вычисленные значения первой цветовой компоненты во втором цветовом пространстве как дополнительный входной сигнал кодера.

На фиг. 4 показана блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа, показанного на фиг. 1. Способ переходит от этапа S1 на фиг. 1 или этапа S21 на фиг. 3. Следующий этап S30 содержит декодирование кодированного значения второй цветовой компоненты и кодированного значения третьей цветовой компоненты для получения реконструированного значения второй цветовой компоненты и реконструированного значения третьей цветовой компоненты в первом цветовом пространстве. Затем реконструированные значения второй и третьей цветовых компонент дискретизируются с повышением на этапе S31 для получения дискретизированного с повышением реконструированного значения второй цветовой компоненты и дискретизированного с повышением реконструированного значения третьей цветовой компоненты в первом цветовом пространстве. В этом варианте осуществления, пробное значение цветовой компоненты во втором цветовом пространстве выводится на этапе S32 на основании пробного значения цветовой компоненты в первом цветовом пространстве, дискретизированного с повышением реконструированного значения второй цветовой компоненты и дискретизированного с повышением реконструированного значения третьей цветовой компоненты в первом цветовом пространстве. Затем способ переходит к этапу S3 на фиг. 1.

Декодирование на этапе S30 обычно является процессом, обратным кодированию, осуществляемому на этапе S1. Поэтому декодирование, в необязательном порядке, содержит декодирование кодированных, квантованных коэффициентов преобразования, например, с использованием энтропийного декодера. Затем квантованные коэффициенты преобразования, полученные декодированием, подвергаются обратному квантованию и затем обратному преобразованию для получения реконструированного остатка или ошибок предсказания. Затем реконструированные значения второй и третьей цветовых компонент получаются путем прибавления реконструированных остатков к соответствующему внутреннему или внешнему предсказанию для пикселя. Дополнительную информацию о процессе декодирования можно найти в документе [4] и, в частности, разделах 8.4-8.6 и 9.4.3.

Декодирование на этапе S30, предпочтительно, осуществляется в соответствии с известными стандартами кодирования/декодирования видеоданных, например HEVC; H.264/AVC; стандартами кодирования/декодирования видеоданных для видео HDR или WCG; и т.д.

Повышающая дискретизация на этапе S31, предпочтительно, осуществляется аналогично повышающей дискретизации на этапе S20 на фиг. 3, т.е. путем дискретизации с повышением из формата 4:2:0 или 4:2:2 в 4:4:4. Отличие этапа S31 от этапа S20 состоит в том, что этап S20 содержит повышающую дискретизацию исходных или входных значений второй и третьей цветовых компонент, тогда как этап S31 содержит повышающую дискретизацию реконструированных значений второй и третьей цветовых компонент, полученных после кодирования и последующего декодирования исходных или входных значений второй и третьей цветовых компонент.

Затем пробное значение цветовой компоненты (Ytest или pq(Y)test) во втором цветовом пространстве, предпочтительно, цветовом пространстве XYZ или pq(Y)xy, выводится на этапе S32 на основании пробного значение цветовой компоненты (Y'test) и дискретизированных с повышением реконструированных значений второй и третьей цветовых компонент (Cb'Cr') в первом цветовом пространстве, предпочтительно цветовом пространстве Y'Cb'Cr'. Поэтому, Ytest=функция(Y'test, Cb', Cr') или pq(Y)test=функция(Y'test, Cb', Cr').

Этот этап S32, предпочтительно, осуществляется, как описано ранее, совместно с этапом S21 на фиг. 3 с тем отличием, что исходное значение первой цветовой компоненты в первом цветовом пространстве заменено пробным значением цветовой компоненты в первом цветовом пространстве, дискретизированные с повышением значения второй и третьей цветовых компонент в первом цветовом пространстве заменены дискретизированными с повышением реконструированными значениями второй и третьей цветовых компонент в первом цветовом пространстве, и значение первой цветовой компоненты во втором цветовом пространстве заменено пробным значением цветовой компоненты во втором цветовом пространстве.

Таким образом, вышеописанный вариант осуществления можно описать как предусматривающий следующие этапы способа: Y'testCb'Cr' 4:2:0 -(повышающая дискретизация)-> Y'testCb'Cr' 4:4:4 -(цветовое преобразование)-> R'G'B' 4:4:4 -(передаточная функция)-> RGB 4:4:4 -(цветовое преобразование)-> XYtestZ 4:4:4 и затем поддержание Ytest, или, как показано ниже, преобразование Ytest в pq(Ytest).

Пробное значение цветовой компоненты (Ytest или pq(Y)test) во втором цветовом пространстве выводится, как описано выше, согласно варианту осуществления, на основании дискретизированных с повышением реконструированных значений второй и третьей цветовых компонент (Cb'Cr') в первом цветовом пространстве. Эти дискретизированные с повышением реконструированные значения второй и третьей цветовых компонент таким образом отражают и содержат любые ошибки, вносимые в ходе субдискретизации значений второй и третьей цветовых компонент и/или другой обработки предварительного кодирования значений второй и третьей цветовых компонент, и/или кодирования значений второй и третьей цветовых компонент (этап S1 на фиг. 1), и/или в ходе обработки, осуществляемой после декодирования (этап S31 на фиг. 4). Затем значение первой цветовой компоненты (Y') пикселя в первом цветовом пространстве может определяться на этапе S3 на фиг. 1 для компенсации любых ошибок, вносимых в ходе кодирования, декодирования и обработки после декодирования. Таким образом, визуальное качество, например, оцениваемое значением линейной или нелинейной яркости, Y или pq(Y), пикселя, может повышаться.

Согласно варианту осуществления, этап S3 на фиг. 1 содержит выбор пробного значения цветовой компоненты в первом цветовом пространстве, которое минимизирует ошибку, вычисленную на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве, выведенным на основании пробного значения цветовой компоненты в первом цвете и кодированных значений второй и третьей цветовых компонент.

Поэтому, согласно варианту осуществления множественные пробные значения цветовой компоненты в первом цветовом пространстве доступны и тестируются. В таком случае, соответствующее пробное значение цветовой компоненты во втором цветовом пространстве выводится для каждого из множественных пробных значений цветовой компоненты в первом цветовом пространстве, предпочтительно, как описано выше, совместно с этапом S32 на фиг. 4. Затем соответствующая ошибка вычисляется для каждого из множественных пробных значений цветовой компоненты в первом цветовом пространстве на основании разности значения первой цветовой компоненты во втором цветовом пространстве, например, выведенного, как описано выше, совместно с этапом S21 на фиг. 3, и соответствующего значения первой цветовой компоненты во втором цветовом пространстве.

Затем значение первой цветовой компоненты в первом цветовом пространстве среди множественных пробных значений цветовой компоненты в первом цветовом пространстве, которое приводит к наименьшей ошибке, выбирается и используется как оптимальное значение первой цветовой компоненты в первом цветовом пространстве для пикселя на этапе S3. Затем это оптимальное значение первой цветовой компоненты кодируется на этапе S4 на фиг. 1.

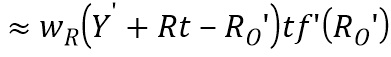

Выбор оптимального значения первой цветовой компоненты в первом цветовом пространстве может осуществляться согласно различным вариантам осуществления аналогично описанному в приложении A. В этом варианте осуществления, значение первой цветовой компоненты в первом цветовом пространстве является значением яркости или Y' в цветовом пространстве Y'Cb'Cr', и значение первой цветовой компоненты во втором цветовом пространстве является значением линейной яркости или Y в цветовом пространстве XYZ или значением нелинейной яркости или pq(Y) в цветовом пространстве pq(Y)xy.

Согласно варианту осуществления, двоичный поиск можно использовать для отыскания оптимального или наилучшего значения Y' в цветовом пространстве Y'Cb'Cr'. Например, сначала проверяется пробное значение Y' в середине доступного диапазона значений Y', например 512, если минимальное значение Y' равно 0, и максимальное значение Y' равно 1023. Если пробное значение Y или pq(Y), выведенное на этапе S32 на основании этого пробного значения Y' и дискретизированных с повышением реконструированных значений Cb'Cr', больше исходного значения Y или pq(Y), полученного на этапе S21, нужно продолжать поиск в интервале [0, 512]. Если же пробное значение Y или pq(Y) больше исходного значения Y или pq(Y), нужно продолжать поиск оптимального пробного значения Y' в интервале [512, 1023]. В продолжение процедуры, новое пробное значение Y' вычисляется в середине выбранного интервала до тех пор, пока пробное значение Y или pq(Y) не сравняется с исходным значением Y или pq(Y), или его отличие от исходного значения Y или pq(Y) не станет меньше заданного значения, или интервал не станет содержать единственное значение или два значения, например [363, 363] или [363, 364]. Это гарантированно занимает только log2(N) шагов, где N - количество возможных пробных значений Y', которое в этом примере равно 1024. Поэтому двоичный поиск занимает только log2(1024)=10 шагов.

Еще один способ вычисления оптимального или наилучшего значения Y' состоит в том, чтобы рассматривать определение на этапе S3 как задачу оптимизации и минимизировать ошибку E=(Ytest-Yo)2 или E=(pq(Ytest)-pq(Yo))2 относительно Y'test, где Yo обозначает исходное значение яркости пикселя, выведенное на этапе S21 на фиг. 3. Это может осуществляться посредством градиентного спуска, посредством вычисления градиента E относительно Y'test, dE/dY'test, и обновления Y'test на малую величину в направлении, противоположном градиенту: Y'test,n+1=Y'test,n-αdE/dY'test, где α - малая постоянная.

Градиентный спуск может быть медленным, поэтому более быстрый путь может представлять собой алгоритм оптимизации второго порядка, который вычисляет или аппроксимирует производные второго порядка d2E/dY'test2, например, Гаусса-Ньютона.

Все вышеупомянутые алгоритмы градиентного спуска и оптимизации второго порядка эквивалентны определению значения первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве.

В ошибку также могут входить другие компоненты. Например, ошибка E может быть задана как E=w1(pq(Ytest)-pq(Yo))2+w2(xtest-xo)2+w3(ytest-yo)2, где xo, yo получаются совместно с pq(Yo) из XYZ 4:4:4 как описано выше, и w1, w2, w3 - различные весовые коэффициенты. Аналогичный подход также можно использовать, заменяя pq(Ytest) и pq(Yo) на Ytest и Yo, соответственно.

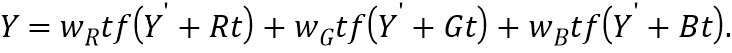

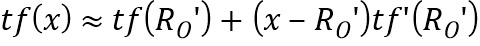

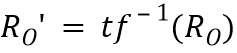

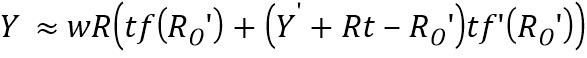

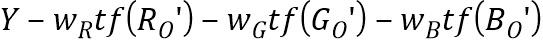

Другой способ отыскания необязательного или наилучшего значения Y' состоит в осуществлении линеаризации, что дополнительно описано в приложении A. Согласно такому подходу, мы имеем Y=f(Y') и хотим, чтобы выходное значение Y этого уравнения совпадало с оптимальным Yo. Поскольку Y зависит от Y' в трех разных местах по нелинейному закону, инверсия функции для получения Y'=f-1(Y) выглядит сложной задачей.

Однако можно линеаризовать нелинейную передаточную функцию tf(x)~kx+m. Делая это в трех разных местах, получаем Y~k1×Y'+m1+k2×Y'+m2+k3×Y'+m3, что эквивалентно Y~(k1+k2+k3)×Y'+(m1+m2+m3). Это можно инвертировать в Y'~Y'k=(Yo- (m1+m2+m3))/(k1+k2+k3).

Таким образом, возможно, что Y'k даст значение Yk, более близкое к YO, чем прежде. Функцию можно снова линеаризовать в этой новой точке Y'k с получением нового значения Y'(k+1) и т.д.

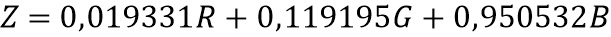

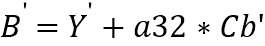

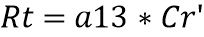

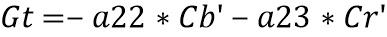

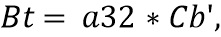

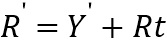

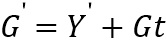

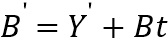

Таким образом, согласно этому подходу, Y', Cb' и Cr' преобразуются в R', G' B' с использованием

где a13, a22, a23 и a32 - положительные постоянные, которые зависят от используемого цветового пространства. Для BT.2020 мы имеем a13=1,4746, a22=0,1646, a23=0,5714, и a32=1,8814. Для упрощения записи будем использовать вспомогательные переменные:

которые позволяют выразить преобразование в виде

.

.

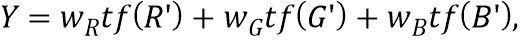

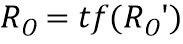

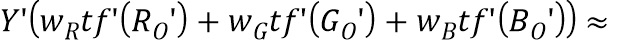

В этом случае яркость можно вычислить как

где  ,

,  и

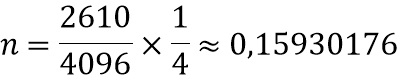

и  - постоянные, например, постоянные XYZ CIE1931 для Y или (аналогичные) постоянные для BT2020, например

- постоянные, например, постоянные XYZ CIE1931 для Y или (аналогичные) постоянные для BT2020, например  =0,2627,

=0,2627,  =0,6780,

=0,6780,  =0,0593. С использованием вышеприведенного уравнения, это можно выразить в виде

=0,0593. С использованием вышеприведенного уравнения, это можно выразить в виде

В этой формуле, только  может изменяться от пикселя к пикселю. В порядке примера,

может изменяться от пикселя к пикселю. В порядке примера,  зависит от

зависит от  , обобществленного между несколькими пикселями. Таким образом,

, обобществленного между несколькими пикселями. Таким образом,  ,

,  и

и  можно рассматривать как постоянные, и идея регулировки яркости состоит в отыскании

можно рассматривать как постоянные, и идея регулировки яркости состоит в отыскании  , который будет генерировать желаемую яркость

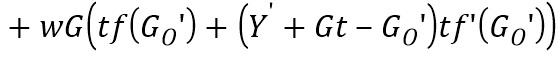

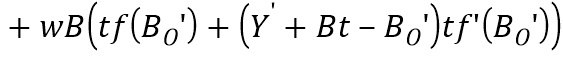

, который будет генерировать желаемую яркость  . Заметим, что поскольку в правой стороне вышеприведенного уравнения присутствуют три нелинейных функции, правую сторону невозможно инвертировать. Поэтому предлагается линейно аппроксимировать

. Заметим, что поскольку в правой стороне вышеприведенного уравнения присутствуют три нелинейных функции, правую сторону невозможно инвертировать. Поэтому предлагается линейно аппроксимировать  относительно красной компоненты.

относительно красной компоненты.

,

,

где  - преобразованная версия линейной компоненты

- преобразованная версия линейной компоненты  исходного пикселя

исходного пикселя  . То же действие для зеленой и синей компонент дает

. То же действие для зеленой и синей компонент дает

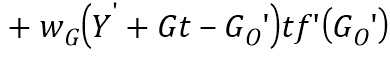

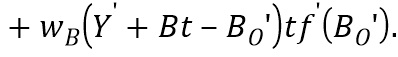

Перенося первый член в каждом выражении влево, получаем

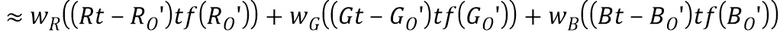

Но поскольку  , отрицательные члены первой строки прибавляются к исходной яркости, и первая строка обнуляется. В этом случае сбор членов для Y' дает

, отрицательные члены первой строки прибавляются к исходной яркости, и первая строка обнуляется. В этом случае сбор членов для Y' дает

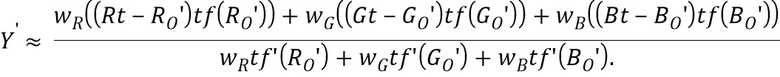

Что позволяет вычислять Y' как

Вышеописанные варианты осуществления указывают, что процесс линеаризации можно использовать для определения значения первой цветовой компоненты пикселя в первом цветовом пространстве, Y', и что такой процесс линеаризации эквивалентен определению Y' на основании минимизации ошибки, как описано выше.

Еще один способ отыскания оптимального или наилучшего значения Y' состоит в использовании поисковой таблицы (LUT). Если известны значения Cb'Cr' и целевое значение Y или pq(Y), т.е. Yo или pq(Yo), можно найти наилучшее значение Y' с использованием любого из вышеупомянутых итерационных методов. Таким образом, можно создать LUT для каждой возможной комбинации Cb'Cr' и Y или pq(Y). Предположим, например, что Cb' и Cr' квантуются до 10 битов, и что Y или pq(Y) также квантуется до 10 битов. Тогда необходима LUT с 210×210×210=230 значениями Y'. Если каждое значение Y' занимает два байта, это означает 231 байтов или 2 ГБ. Однако LUT можно сократить, например, округлив один или более из Cb', Cr' и Yo или pq(Yo) до 6 или 8 битов. Тогда размер LUT будет составлять 218 или 224 значений Y' или 219 или 225 байтов, что эквивалентно 512 кБ или 34 МБ.

Поэтому, в этих вариантах осуществления оптимальное или наилучшее значение Y'=LUT(Cb', Cr', Yo) или LUT(Cb', Cr', pq(Yo)).

На фиг. 5 показана блок-схема последовательности операций, демонстрирующая вариант осуществления этапа S4 на фиг. 1. Способ переходит от этапа S3 на фиг. 1. Следующий этап S40 содержит определение внутреннего или внешнего предсказания значения первой цветовой компоненты в первом цветовом пространстве. Следующий этап S41 содержит преобразование ошибки предсказания, вычисленной как разность между значением первой цветовой компоненты в первом цветовом пространстве и внутренним или внешним предсказанием для формирования коэффициентов преобразования. Затем коэффициенты преобразования квантуются на этапе S42. В необязательном варианте осуществления, квантованные коэффициенты преобразования поступают на кодер, например, энтропийный кодер.

Этапы S40-S42 на фиг. 5, в основном, осуществляется как описано выше со ссылкой на фиг. 2, с тем отличием, что фиг. 2 предусматривает кодирование значений второй и третьей цветовых компонент в первом цветовом пространстве, а фиг. 5 предусматривает кодирование значения первой цветовой компоненты в первом цветовом пространстве.

Как упомянуто выше, кодирование пикселя согласно вариантам осуществления может применяться к множественным пикселям в изображении входной видеопоследовательности. В действительности, возможно применение способа кодирования ко всем пикселям во всех изображениях. В альтернативном варианте осуществления, способ кодирования выбирается только для некоторых пикселей, областей или изображений во входной видеопоследовательности. Причина этого состоит в том, что способ кодирования может вносить дополнительную сложность по сравнению с традиционным способом простого кодирования исходного цвета Y'Cb'Cr' 4:2:0 или 4:2:2 пикселя. Настоящие варианты осуществления предусматривают дополнительный обработка для определения улучшенного или оптимизированного значения яркостной компоненты. Таким образом, повышение качества согласно вариантам осуществления достигается ценой некоторого повышения сложности обработки на стороне кодирования.

Соответственно, преимущество может состоять в применении способа кодирования только к некоторым областям в некоторых изображениях или некоторых ключевых изображениях. Неограничительные примеры таких ключевых изображений могут представлять собой так называемые изображения точки произвольного доступа (RAP), также именуемые изображениями внутреннего произвольного доступа (IRAP), или изображения в самом низком слое в иерархической структуре групп изображений (GOP) или изображения, которые имеют низкие значения QP при кодировании с низкой задержкой. Кодер также может выбирать изображения или области изображений, подлежащие кодированию согласно вариантам осуществления на основании своих возможностей обработки и требований к задержке для текущего видеоприложения.

Согласно варианту осуществления, способ, показанный на фиг. 1, содержит дополнительные этапы, показанные на фиг. 6. Этот вариант осуществления содержит осуществление этапов получения значения первой цветовой компоненты и определение значения первой цветовой компоненты, если пиксель является пикселем изображения RAP входной видеопоследовательности.

В этом варианте осуществления, способ переходит от этапа S1 на фиг. 1, и этап S50 содержит исследование, является ли текущее изображение изображением RAP. Если текущее изображение является изображением RAP, способ переходит к этапу S2 на фиг. 1. Если же текущее изображение не является изображением RAP, способ, альтернативно, переходит к этапу S51. Этот этап S51 содержит кодирование значения первой цветовой компоненты пикселя в первом цветовом пространстве. Это значение первой цветовой компоненты является исходным значением первой цветовой компоненты, вводимым в процесс кодирования. Поэтому, в отчетливом контрасте с изображениями RAP, когда значение первой цветовой компоненты в первом цветовом пространстве определяется на этапе S3, и, как описано выше, для изображений не-RAP исходное и входное значения первой цветовой компоненты используются для пикселя и, таким образом, кодируются на этапе S51. Затем кодированное значение первой цветовой компоненты, полученное на этапе S51, используется совместно с кодированными значениями второй и третьей цветовых компонент, полученных на этапе S1, в качестве кодированного представления пикселя.

Кодирование на этапе S51, предпочтительно, содержит определение внутреннего или внешнего предсказания значения первой цветовой компоненты, преобразование вычисленной ошибки предсказания и квантование коэффициентов преобразования в соответствии с тем, что ранее было описано здесь в связи с фиг. 2 и 5.

В общем случае, качество изображений RAP или IRAP особенно важно в видеопоследовательности. Причина того, что другие изображения не-RAP/IRAP в видеопоследовательности прямо или косвенно кодируются и декодируются с использованием изображений RAP/IRAP в качестве опорных изображений. Поэтому, ошибка, вносимая в изображение RAP/IRAP в ходе кодирования, может распространяться на следующие изображения, которые кодируются с использованием изображения RAP/IRAP в качестве прямого опорного изображения или косвенного опорного изображения, т.е. опорного изображения второго или следующего поколения. Соответственно, в целом, важно кодировать изображения RAP/IRAP с высоким качеством.

На фиг. 7 показана блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа, показанного на фиг. 1. Способ переходит от этапа S1 на фиг. 1. В этом варианте осуществления, способ также содержит осуществление этапов получения значения первой цветовой компоненты и определение значения первой цветовой компоненты, если пиксель является пикселем изображения в самом низком слое входной видеопоследовательности, изображения которой организованы в виде иерархической структуры GOP.

В этом варианте осуществления, способ переходит от этапа S1 на фиг. 1, и этап S60 содержит исследование, принадлежит ли текущее изображение самому низкому слою во входной видеопоследовательности, организующей изображения в виде иерархической структуры GOP.

Фиг. 11 схематически демонстрирует входную видеопоследовательность 1, организующую изображения в виде такой иерархической структуры GOP. На фиг. 11, GOP начинается с изображением RAP/IRAP 2 (номер 0). В типичном подходе, такие изображения RAP/IRAP 2 располагаются с фиксированным интервалом, например, каждое второе. Затем изображения между изображениями RAP/IRAP 2 обычно кодируются структурой GOP, где изображение (номер 8) обычно предсказывается и кодируется за восемь изображений до времени отображения, и затем это изображение (номер 8) и ранее кодированные изображения (номер 0) используются для предсказания и кодирования изображения (номер 4) за четыре изображения до времени отображения. Затем, изображения (номера 2 и 6) за два и шесть изображений до времени отображения предсказываются и кодируются, после чего следует предсказание и кодирование изображений (номера 1, 3, 5, 7) за один, три, пять и семь изображений до времени отображения. Изображения (номера 1, 3, 5, 7) в слое 3 принадлежат наивысшему иерархическому уровню, изображения (номер 2, 6) на уровне 2 принадлежат следующему после наивысшего иерархического уровня, изображение (номер 4) в слое 1 принадлежит следующему после самого низкого иерархического слоя, и изображения (номера 0, 8) в слое 0 принадлежат самому низкому иерархическому слою. Обычно изображения в наивысшем иерархическом слое не используются для предсказания любых других изображений, т.е. так называемых неопорных изображений. Неопорные изображения можно удалять без ущерба возможностям декодирования битового потока видео. Затем структура GOP, показанная на фиг. 11 повторяется до следующего изображения IRAP.

Стрелки на фиг. 11 иллюстрируют направления предсказания для опорных изображений. Например, изображение номер 4 кодируется с использованием изображений за номерами 0, 8 в качестве опорных изображений.

Если текущее изображение является изображением в самом низком слое, т.е. слое 0 на фиг. 11, способ переходит от этапа S60 на фиг. 6 к этапу S2 на фиг. 1. Если же текущее изображение является изображением в слое, более высоком в иерархической структуре GOP, чем самый низкий слой, т.е. слой 1-3 на фиг. 11, способ альтернативно переходит к этапу S61. Этот этап S61 содержит кодирование значения первой цветовой компоненты пикселя в первом цветовом пространстве. Это значение первой цветовой компоненты является исходным значением первой цветовой компоненты, вводимым в процесс кодирования. Поэтому, в отчетливом контрасте с изображениями в самом низком слое, когда значение первой цветовой компоненты в первом цветовом пространстве определяется на этапе S3, и, как описано выше, для изображений в более высоких слоях исходное и входное значения первой цветовой компоненты используются для пикселя и, таким образом, кодируются на этапе S61. Затем кодированное значение первой цветовой компоненты, полученное на этапе S61, используется совместно с кодированными значениями второй и третьей цветовых компонент форма этап S1 в качестве кодированного представления пикселя.

Этот этап S61 соответствует к этапу S51 на фиг. 6.

В общем случае, качество изображений самого низкого слоя особенно важно в иерархической или многослойной видеопоследовательности. Причина в том, что изображения в более высоких слоях в видеопоследовательности прямо или косвенно кодируются и декодируются с использованием изображения в самом низком слое в качестве опорных изображений, см. фиг. 11. Поэтому ошибка, вносимая в изображение в самом низком слое в ходе кодирования может распространяться на следующие изображения, которые кодируются с использованием этого изображения в качестве прямого опорного изображения или косвенного опорного изображения. Соответственно, в целом, важно кодировать изображения в самом низком слое с высоким качеством.

На фиг. 8 показана блок-схема последовательности операций, демонстрирующая дополнительные, необязательные этапы способа, показанного на фиг. 1. Способ переходит от этапа S4 на фиг. 1 или этапа S42 на фиг. 5. Следующий этап S70 содержит декодирование кодированного значения первой цветовой компоненты для получения реконструированного значения первой цветовой компоненты в первом цветовом пространстве. Следующий этап S71 содержит определение адаптивного смещения выборки (SAO), которое минимизирует 1) квадратичную или абсолютную ошибку между значением первой цветовой компоненты в первом цветовом пространстве и суммой реконструированного значения первой цветовой компоненты в первом цветовом пространстве и SAO или 2) издержки скорости-искажения, вычисляемые как функция искажения, представляющего разность между значением первой цветовой компоненты в первом цветовом пространстве и суммой реконструированного значения первой цветовой компоненты в первом цветовом пространстве и SAO и количества битов, потраченных для кодирования SAO.

Одна технология для циклической фильтрации, используемая в HEVC, является SAO. Когда указано, что SAO используется для блока пикселей, в терминологии HEVC, единице дерева кодирования (CTU), оно либо модифицирует пиксельные значения в соседних полосах пиксельных значений, либо модифицирует пиксельные значения, которые имеют определенную краевую характеристику. В первом случае, смещения полосы задаются в четырех полосах или категориях, где указана позиция полосы с наименьшими пиксельными значениями, за которыми следуют другие полосы с увеличивающимися пиксельными значениями. В последнем случае, смещения краев задаются в четырех категориях: максимумы, минимумы, этап увеличения или этап уменьшения, в заданном направлении, т.е. классе смещений края. SAO задаются для каждого блока пикселей, но также могут копироваться из соседнего блока пикселей. SAO можно использовать независимо для соответствующей цветовой компоненты, например, яркостной и цветностных компонент.

Декодирование кодированного значения первой цветовой компоненты на этапе S70, в основном, обратно кодированию, осуществляемому на этапе S4. Поэтому декодирование, в необязательном порядке, содержит декодирование кодированных, квантованных коэффициентов преобразования, например, с использованием энтропийного декодера. На стороне кодера энтропийное декодирование не требуется, поскольку это беспотерьный процесс и поскольку кодер уже имеет квантованные коэффициенты преобразования и т.д. Затем квантованные коэффициенты преобразования, полученные декодированием, подвергаются обратному квантованию и затем обратному преобразованию для получения реконструированного остатка или ошибки предсказания. Затем реконструированное значение первой цветовой компоненты получается путем прибавления реконструированного остатка к внутреннему или внешнему предсказанию для пикселя. Дополнительную информацию о процессе декодирования можно найти в документе [4] и, в частности, разделах 8.4-8.6 и 9.4.3.

В первом варианте осуществления, SAO определяется путем минимизации квадратичной ошибки или абсолютной ошибки между значением первой цветовой компоненты в первом цветовом пространстве, определяемым на этапе S3 на фиг. 1, и суммой SAO и реконструированного значения первой цветовой компоненты, получаемого на этапе S70.

Во втором варианте осуществления, SAO определяется путем минимизации издержек J скорости-искажения (RD), вычисляемых как J=D+λR, где D - искажение, представляющее разность между значением первой цветовой компоненты в первом цветовом пространстве, определяемым на этапе S3 на фиг. 1, и суммой SAO и реконструированного значения первой цветовой компоненты, получаемого на этапе S70, R - количество битов, потраченных для кодирования SAO, и λ - множитель Лагранжа.

Вышеописанный подход можно дополнительно или альтернативно, использовать для определения других смещений или параметров фильтра, традиционно используемых в ходе кодирования и декодирования видеопоследовательностей. Например, внутрицикловые фильтры, например, фильтры устранения блочности и адаптивные циклические фильтры (ALF), которые дополнительно рассмотрены здесь, могут определяться, по существу, как описано выше со ссылкой на смещения SAO.

В некоторых вариантах применения, имеет смысл отключать SAO. Например, в HEVC SAO можно отключать для 64×64 блоков пикселей.

SAO, фильтры устранения блочности, ALF и т.д. также можно определять путем минимизации ошибки или издержек RD во втором цветовом пространстве, например, XYZ или pq(Y)xy, а не в первом цветовом пространстве, например Y'Cb'Cr'. В таком случае, этап S71 предпочтительно содержит определение параметра инструмента кодирования, например SAO, внутрициклового фильтра, фильтра устранения блочности, фильтра ALF и т.д., для, по меньшей мере, одного значения цветовой компоненты в первом цветовом пространстве, которое минимизирует 1) квадратичную ошибку или абсолютную ошибку между значением первой цветовой компоненты во втором цветовом пространстве и суммой реконструированного значения первой цветовой компоненты во втором цветовом пространстве и параметра инструмента кодирования, преобразованного во второе цветовое пространство, или 2) издержки скорости-искажения, вычисляемые как функция искажения, представляющего разность между значением первой цветовой компоненты во втором цветовом пространстве и суммой реконструированного значения первой цветовой компоненты во втором цветовом пространстве и параметра инструмента кодирования, преобразованного во второе цветовое пространство, и количества битов, потраченных для кодирования параметра инструмента кодирования.

В конкретном варианте осуществления, способ кодирования пикселя во входной видеопоследовательности, представленный на фиг. 1, содержит кодирование, на этапе S1, значений цветностной компоненты Cb'Cr' в цветовом пространстве Y'Cb'Cr'. В этом варианте осуществления, этап S2 содержит получение значения яркости Y для пикселя в цветовом пространстве XYZ. Следующий этап S3 содержит определение значения яркостной компоненты Y' пикселя в цветовом пространстве Y'Cb'Cr' на основании минимизации ошибки, вычисленной на основании разности между значением яркости Y в цветовом пространстве XYZ и пробным значением яркости в цветовом пространстве XYZ, причем пробное значение яркости выводится на основании кодированных значений цветностной компоненты Cb'Cr'. Этап S4 содержит, в этом варианте осуществления, кодирование значения яркостной компоненты Y' в цветовом пространстве Y'Cb'Cr'.

В другом конкретном варианте осуществления, способ кодирования пикселя во входной видеопоследовательности, представленный на фиг. 1, содержит кодирование, на этапе S1, значений цветностной компоненты Cb'Cr' в цветовом пространстве Y'Cb'Cr'. В этом варианте осуществления, этап S2 содержит получение значения нелинейной яркости pq(Y) для пикселя в цветовом пространстве pq(Y)xy. Следующий этап S3 содержит определение значения яркостной компоненты Y' пикселя в цветовом пространстве Y'Cb'Cr' на основании минимизации ошибки, вычисленной на основании разности между значением нелинейной яркости pq(Y) в цветовом пространстве pq(Y)xy и пробным значением яркости в цветовом пространстве pq(Y)xy, причем пробное значение яркости выводится на основании кодированных значений цветностной компоненты Cb'Cr'. Этап S4 содержит, в этом варианте осуществления, кодирование значения яркостной компоненты Y' в цветовом пространстве Y'Cb'Cr'.

Выше были представлены варианты осуществления, где значение первой цветовой компоненты в первом цветовом пространстве является значением яркостной компоненты Y' в цветовом пространстве Y'Cb'Cr', и значения второй и третьей цветовых компонент в первом цветовом пространстве являются значениями цветностной компоненты Cb'Cr' в пространстве Y'Cb'Cr'. Это предпочтительный пример реализации варианта осуществления.

Однако варианты осуществления этим не ограничиваются. ICtCp является альтернативным цветовым пространством, в котором значение I несет информацию яркости и значения CtCp несут информацию цветности. В таком примере реализации, значение первой цветовой компоненты в первом цветовом пространстве является значением I в цветовом пространстве IctCp, и значения второй и третьей цветовых компонент в первом цветовом пространстве являются значениями CtCp в цветовом пространстве ICtCp.

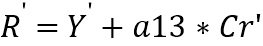

Согласно варианту осуществления, значения LMS в цветовом пространстве LMS можно получать из значений RGB и цветового преобразования согласно уравнению 4:

L=(1688*R+2146*G+262*B)/4096

M=(683*R+2951*G+462*B)/4096 (уравнение 4)

S=(99*R+309*G+3688*B)/4096

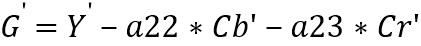

Затем передаточная функция, например, обратная к EOTFPQ, может применяться к значениям LMS для получения значений нелинейного L'M'S'. Наконец, цветовое преобразование применяется к этому значению L'M'S' для получения значений ICtCp:

I=0,5*L'+0,5*M'

Ct=(6610*L'-13613*M'+7003*S')/4096 (уравнение 5)

Cp=(17933*L'-17390*M'-543*S')/4096

Это означает, что можно преобразовывать значения ICtCp в значения RGB, в основном, путем осуществления вышеупомянутых этапов в обратном порядке и затем дополнительно преобразовывать значения RGB в значения XYZ или pq(Y)xy, как описано выше.

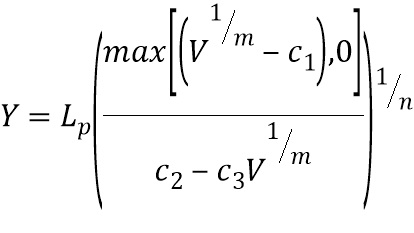

Аспект вариантов осуществления задает способ, проиллюстрированный на фиг. 9, для кодирования, по меньшей мере, одной выборки пикселя входной видеопоследовательности. Входная видеопоследовательность представлена в первом цветовом пространстве. При этом способ содержит:

- получение по меньшей мере, одной выборки входной видеопоследовательности во втором цветовом пространстве, причем второе цветовое пространство отличается от первого цветового пространства,

- кодирование, по меньшей мере, одной выборки одной или двух первых цветовых компонент входной видеопоследовательности в первом цветовом пространстве,

- модификацию, по меньшей мере, одной выборки второй цветовой компоненты входной видеопоследовательности, т.е. первого цветового пространства, на основании минимизации ошибки, вычисленной как разность между, по меньшей мере, одной выборкой входной видеопоследовательности во втором цветовом пространстве и выведенной пробной выборкой во втором цветовом пространстве, причем вывод пробной выборки включает в себя, по меньшей мере, одну кодированную выборку для одной или двух первых цветовых компонент в первом цветовом пространстве, и

- кодирование, по меньшей мере, одной модифицированной выборки второй цветовой компоненты входной видеопоследовательности.

Вышеприведенные варианты осуществления раскрыты, в основном, в связи с кодированием пикселей входной видеопоследовательности, содержащей множественные изображения. Однако варианты осуществления также могут использоваться для кодирования пикселей неподвижного изображения.

Преимущество некоторых вариантов осуществления состоит в том, что кодирование учитывает обработку, которая будет осуществляться над сжатыми данными после декодирования, и ошибку, уже внесенную кодером в один или два цветовых канала. Кодер может изменять сжимаемые данные на другой цветовой канал для генерации сжатых данных, что улучшает результат после осуществления этой обработки.

Кодер предназначен для сжатия блока пикселей в формате Y'Cb'Cr' 4:2:0 или 4:2:2. На первым этапе применяется предсказание внутри выборки или между выборками цветностных компонент Cbpred', Crpred', затем ошибки предсказания Cb'-Cbpred', Cr'-Crpred' преобразуются. Преобразования обычно осуществляются независимо, и квантование полученных коэффициентов преобразования вносит ошибку в окончательные пиксельные значения. Согласно вариантам осуществления, вместо простого преобразования ошибки предсказания для яркостной компоненты, Y'-Y'pred, кодер может пытаться найти новые значения Y' (Yopt') для блока пикселей, которые минимизируют ошибку после их преобразования совместно с декодированными значениями Cb' и Cr' в пространство pq(Y)xy или XYZ, по сравнению с исходными значениями pq(Y)xy или XYZ. Таким образом, согласно такому подходу, альтернативно будет преобразовываться ошибка предсказания для яркостной компоненты, Yopt'-Y'pred.

Подход предполагает воздействие только на яркостную компоненту. В этом случае, кодер сначала определяет исходную яркость. Это делается путем повышающей дискретизации исходного Y'Cb'Cr' 4:2:0 или 4:2:2 до 4:4:4 с последующим преобразованием через RGB в pq(Y)xy или XYZ. Затем применяется процедура оптимизации, в многом аналогичная используемой в способе Ajusty, описанном в приложении A, для отыскания значений Y' в каждом пикселе, которые дают значения pq(Y) или Y, наилучшим образом совпадающие с исходными значениями при аналогичном преобразовании совместно со сжатыми версиями Cb' и Cr'.

Согласно дополнительному варианту осуществления кодер выполнен с возможностью применения предсказания внутри выборки или между выборками к блоку пикселей в формате Y'Cb'Cr' 4:2:0 или 4:2:2. На первым этапе применяется предсказание внутри выборки или между выборками цветностных компонент Cbpred', Crpred'. Предсказания обычно осуществляются независимо. На этот раз, вместо простого применения предсказание яркостной компоненты, кодер будет пытаться найти для блока новые значения Y' (Yopt'), которые минимизируют ошибку после их преобразования совместно с предсказанными значениями Cb' и Cr' в пространство pq(Y)xy или XYZ, по сравнению с исходными значениями pq(Y)xy или XYZ.

Согласно другому варианту осуществления исходная яркость Y и/или исходный xy сообщается кодеру, а не выводится из выборок Y'Cb'Cr' 4:2:0 или 4:2:2.

Согласно другому варианту осуществления, другие фильтры повышающей дискретизации F1 могут использоваться для преобразования, по меньшей мере, одной выборки цветовой компоненты в ходе кодирования и реконструкции, например, Cbrec'Crrec' из 4:2:0 или 4:2:2 в 4:4:4 для вывода оптимального Y', вместо фильтров повышающей дискретизации F2, используемых для повышающей дискретизации Cbrec' Crrec' до полного разрешения при обработке после снятия сжатия, но до отображения. Рассмотрим фиг. 10, где кодер состоит из всех частей до последнего этапа декодирования видеосигнала, т.е. слева от вертикальной пунктирной линии. Однако декодирование на стороне кодера требуется только для реконструкции пиксельных значений. Способ Ajusty, заданный в приложении A, использует реконструированные пиксельные значения для, по меньшей мере, одной выборки цветовой компоненты, например Cbrec'Crrec'. Это делается для снижения сложности повышающей дискретизации и/или снижения чувствительности к шуму при применении способа Ajusty. Снижение влияния шума позволяет уменьшать количество битов, необходимое для сжатия Yopt'. В зависимости от битовой скорости, доступной для кодирования, может иметь смысл применять способ Ajusty несколько более консервативно, чем оптимально на основе от выборки к выборке.

Фильтры повышающей дискретизации F1, используемые для оценивания в способе Ajusty, можно рассматривать как комбинацию предварительной фильтрации Y' до кодирования и повышающей дискретизации Cb' и Cr'. Таким образом, в рамках повышающей дискретизации для оценивания в способе Ajusty шум можно удалить. Один подход к более консервативному применению способа Ajusty состоит в использовании фильтров повышающей дискретизации F1 с более высоким ослаблением более высоких частот. Одним примером такого фильтра является билинейный фильтр, который в большей степени ослабляет более высокие частоты и прост в вычислении. Однако другие более длинные фильтры также могут представлять интерес для использования. Этот подход также можно использовать в качестве предобработки до видеокодера, когда используется способ Ajusty. В этом случае все цветовые компоненты являются несжатыми.

Согласно другому варианту осуществления, другие варианты осуществления используются для модификации ʺисходныхʺ выборок одной цветовой компоненты, подлежащих кодированию, для, по меньшей мере, одной выборки, одного блока или одного изображения видеосигнала. Таким образом, кодирование на основе любого инструмента кодирования может применяться к модифицированному оригиналу, а не к немодифицированному оригиналу. Примерами инструментов кодирования при кодировании видеоданных являются предсказание выборки с компенсацией движения, предсказание внутри выборки, циклическая фильтрация, фильтрация устранения блочности, адаптивные смещения выборки, адаптивная циклическая фильтрация, адаптивное предсказание выборки с компенсацией движения и т.д.

HEVC включает в себя внутрицикловый фильтр устранения блочности, предназначенный для снижения артефактов блочности, обусловленных блочным кодированием. Фильтр устранения блочности применяется для яркостных и цветностных компонент, но только на пикселях или выборках, находящихся на границах блока. Сила фильтра определяется на основании соотношения типов блока на каждой стороне границы, имеет ли любой из блоков коэффициенты преобразования и/или различия в векторах движения и опорных индексах. Из силы фильтра и среднего QP, определяются два значения tC и бета. Смещения к tC и бета могут сигнализироваться на уровне изображения.

В другом варианте осуществления, SAO оптимизируется для модифицированной версии яркостной компоненты, например, относительно Yopt' вместо исходного Y', с использованием реконструированных цветностных компонент Cbrec'Crrec'. Согласно варианту осуществления, предполагается, что в кодер вводится Y'Cb'Cr' 4:2:0 или 4:2:2, и также линейная яркость Y из XYZ, может выводиться из Y'Cb'Cr', см. нижеприведенный вариант осуществления, или является ʺистиннойʺ исходной линейной яркостью, предусмотрены следующие этапы:

1. Дискретизацию с повышением Cbrec'Crecr' до 4:4:4. Она осуществляется на реконструированных пикселях, в том смысле, что после возможного добавления остатков к внутреннему/внешнему предсказанию и также возможного применения фильтрации устранения блочности для вывода Y'Cb'Cr' в 4:2:0 или 4:2:2.

2. Вывод оптимального Y', нового ʺоригиналаʺ, обозначенного здесь Yopt' при условии, что Cbrec'Crrec' находятся в формате 4:4:4, что минимизирует ошибку Y, где Y - правильная линейная яркость. В порядке оптимизации отыскания Yopt', тестируемый в настоящее время Y' обозначенный Ycurr' объединяется с Cbrec'Crrec' в 4:4:4, преобразованным в R'G'B', и затем подвергается обратному перцепционному квантованию для вывода линейного RGB, который затем преобразуется в линейную яркость Ycurr. Наилучшим Ycurr' является тот, который минимизирует отличие от Y, т.е. Yopt'. В необязательном порядке, Y подвергается перцепционному квантованию и обратному квантованию прежде чем его используют для оптимизации.

3. Определение смещений для SAO для минимизации ошибки в реконструированной яркости Yrec' и Yopt', чтобы Yrec'+смещение было как можно ближе к Yopt'. Выбирать смещения либо для смещения полосы или смещения края, также какое направление является наилучшим в этом случае, которые минимизируют квадратичную ошибку или издержки скорости-искажения (RD). Издержки RD вычисляются как функция искажения и количества потраченных битов, где биты масштабируются значением лямбда, масштабным коэффициентом, который зависит от параметра квантования.

Некоторые модификации битового потока можно предусмотреть в случае, когда новые значения смещения для SAO отличаются от используемых при обычном кодировании, например, своими значениями или типом. В этом случае, декодер также должен знать об этих модификациях.

Согласно другому, более общему, варианту осуществления видеокодера, сначала осуществляется кодирование цветности (Cbrec'Crrec'), тогда как кодирование яркости оптимизируется относительно Yopt' вместо исходного Y' для применимых инструментов и/или режимов кодирования видеоданных видеокодека. В частности, следующие этапы могут осуществляться в зависимости от инструментов кодирования видеоданных:

В предсказании с компенсацией движения:

1. Для вывода предсказания цветности Cbpred'Crpred' можно использовать наилучший вектор движения с точностью до полупикселя или пикселя. Затем можно вывести Yopt', который минимизирует ошибку в линейной яркости по сравнению с оригиналом. В порядке оптимизации отыскания Yopt', текущий тестируемый Y', обозначенный Ycurr', совместно с Cbpred'Crpred', в формате 4:4:4, преобразуется в R'G'B' и затем подвергается обратному перцепционному квантованию для вывода линейного RGB, который затем преобразуется в линейную яркость Ycurr. Наилучшим Ycurr' является тот, который минимизирует отличие от Y, например Yopt'.

2. Найти наилучший вектор движения для яркости с точностью до долей пикселя с членом искажения, который включает в себя разность между Yopt' и предсказанием яркости Ypred'. Обычно искажение определяется как сумма абсолютных величин разностей (SAD) или сумма квадратов разностей (SSD). Вычисление издержек RD включает в себя аддитивный член идережек с масштабным коэффициентом лямбда, зависящим от параметра квантования, и количество битов, необходимое для кодирования вектора движения.

Во внутреннем предсказании:

1. Сначала можно определять наилучшие режимы цветности и затем дискретизировать с повышением предсказание цветности Cbpred'Crpred' до 4:4:4 и использовать его для вывода Yopt'.

2. Затем наилучший режим яркости определяется с использованием Yopt' в качестве исходного, например, наилучший режим яркости является режимом, который минимизирует член искажения, который включает в себя разность между Yopt' и предсказанием яркости Ypred'.

В кодировании остатка:

1. Сначала наилучшие коэффициенты преобразования цветности выводятся, подвергаются обратному квантованию и обратному преобразованию и добавляются к предсказанию, в результате чего, генерируется реконструированная цветность Cbrec'Crrec'.

2. Затем Yopt' можно найти путем повышающей дискретизации реконструированной цветности Cbrec'Crrec' до 4:4:4 и тестирования вариантов Y', обозначенных Ycurr', после преобразования Ycurr' и дискретизации с повышением цветности в R'G'B', применения обратного перцептивного квантования для вывода линейного RGB с последующим преобразованием RGB в линейную яркость, например, Y для XYZ. Выбирается тестируемый Ycurr', который дает наименьшую ошибку по сравнению с исходной линейной яркостью, например Yopt'.

3. Затем для яркости остаток Yopt'-Ypred', где Ypred' является внутренним или внешним предсказанием, кодируется вместо исходного Y' - Ypred'.

Другой технологией, которая использовалась для циклической фильтрации в ходе стандартизации HEVC, является адаптивный циклическая фильтрация (ALF). Когда ALF используется для блока, она фильтрует пиксельные значения блока согласно заданным коэффициентам фильтрации и смещению.

В ALF:

1. Дискретизировать с повышением реконструированную цветность Cbrec'Crrec' до 4:4:4 согласно вышеупомянутому этапу 1.

2. Выводить Yopt' согласно способу Ajusty на вышеупомянутом этапе 2.

3. Определять коэффициенты фильтрации и смещения для ALF таким образом, чтобы ошибка между Yrec' и Yopt' была минимальной.

Все описанные здесь этапы являются лишь иллюстрацией некоторых вариантов осуществления. Не требуется, чтобы все варианты осуществления включали в себя все раскрытые этапы, или чтобы этапы осуществлялись именно в том порядке, как изображено или описано здесь. Кроме того, некоторые варианты осуществления могут включать в себя этапы, не проиллюстрированные или не описанные здесь, в том числе, этапы, связанные с одним или более из раскрытых здесь этапов.

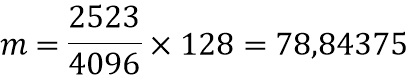

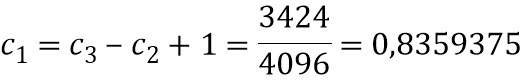

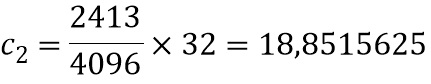

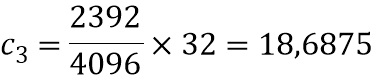

Другой аспект вариантов осуществления относится к устройству для кодирования пикселя входной видеопоследовательности. Устройство выполнено с возможностью кодирования значения второй цветовой компоненты и значения третьей цветовой компоненты пикселя в первом цветовом пространстве. Устройство также выполнено с возможностью получения значения первой цветовой компоненты во втором цветовом пространстве для пикселя, причем второе цветовое пространство отличается от первого цветового пространства. Устройство дополнительно выполнено с возможностью определения значения первой цветовой компоненты пикселя в первом цветовом пространстве на основании минимизации ошибки, вычисленной на основании разности между значением первой цветовой компоненты во втором цветовом пространстве и пробным значением цветовой компоненты во втором цветовом пространстве. Пробное значение цветовой компоненты выводится на основании кодированного значения второй цветовой компоненты и значения кодированной третьей компоненты. Устройство дополнительно выполнено с возможностью кодирования значения первой цветовой компоненты пикселя в первом цветовом пространстве.