ПЕРЕКРЕСТНАЯ ССЫЛКА НА СВЯЗАННЫЕ ЗАЯВКИ

Эта заявка испрашивает приоритет международной патентной заявки PCT/RU2019/000454, поданной 24 июня 2019 г. в Патентное ведомство России, международной патентной заявки PCT/RU2019/000456, поданной 25 июня 2019 г. в Патентное ведомство России, международной патентной заявки PCT/RU2019/000476, поданной 3 июля 2019 г. в Патентное ведомство России, предварительной заявки США 62871200, поданной 7 июля 2019 г. в Патентное ведомство США, и международной патентной заявки PCT/RU2019/000483, поданной 8 июля 2019 г. в Патентном ведомстве России, раскрытия которого полностью включены в настоящий документ посредством ссылки.

ОБЛАСТЬ ТЕХНИКИ, К КОТОРОЙ ОТНОСИТСЯ ИЗОБРЕТЕНИЕ

В общем, настоящее раскрытие относится к области видеокодирования. Более конкретно, настоящее раскрытие относится к фильтру (например, нелинейному внутриконтурному (in-loop) фильтру) для видеокодирования и способу фильтрации восстановленных видеокадров, а также к устройству кодирования и устройству декодирования, содержащему фильтр для видеокодирования.

УРОВЕНЬ ТЕХНИКИ

Видеокодирование (кодирование и декодирование видео) используется в широком диапазоне применений цифрового видео, например, в широковещательном цифровом телевидении, передаче видео через Интернет и мобильные сети, в диалоговых приложениях в реальном времени, таких как видеочат, видеоконференцсвязь, DVD и Blu-Ray диски, системы сбора и редактирования видеоконтента и видеокамеры приложений безопасности.

Объем видеоданных, необходимых для представления даже относительно короткого видео, может быть значительным, что может привести к трудностям, когда эти данные должны передаваться в потоковом режиме или иным образом передаваться по сети связи с ограниченной пропускной способностью. Таким образом, видеоданные, как правило, сжимаются перед тем, как передаваться через современные телекоммуникационные сети. Размер видео также может быть проблемой, когда видео хранится на запоминающем устройстве, поскольку ресурсы памяти могут быть ограничены. Устройства сжатия видео часто используют программное и/или аппаратное обеспечение в источнике для кодирования видеоданных перед передачей или хранением, тем самым уменьшая количество данных, необходимых для представления цифровых видеоизображений. Сжатые данные затем принимаются устройством декомпрессии видео получателя, которое декодирует видеоданные. С ограниченными сетевыми ресурсами и постоянно растущими требованиями к более высокому качеству видео, желательны улучшенные способы сжатия и декомпрессии, которые улучшают степень сжатия с минимальными потерями качества изображения или вообще без таких потерь.

Недавно принятый стандарт ITU-T H.265/HEVC (ISO/IEC 23008-2: 2013, "Информационные технологии - Высокоэффективное кодирование и доставка мультимедиа в гетерогенных средах - Часть 2": Высокоэффективное кодирование видео", ноябрь 2013 г.) объявляет набор современных инструментов кодирования видео, которые обеспечивают разумный компромисс между эффективностью кодирования и вычислительной сложностью.

Обзор стандарта ITU-T H.265/HEVC был дан Гэри Дж. Салливаном, "Обзор стандарта высокоэффективного видеокодирования (HEVC)", в IEEE Transactions on Circuits and Systems for Video Technology, Vol. 22, No. 12 декабря 2012 г., полное содержание которого включено в настоящий документ посредством ссылки.

Одним из инструментов кодирования видео из этого стандарта является адаптивный контурный фильтр, который выполняет фильтрацию восстановленного кадра перед использованием этого кадра для предсказания. Обычный адаптивный контурный фильтр описан в Цянь Чен, Юньфэй Чжэн, Пэн Инь, Сяоан Лу, Джоэл Соле, Цянь Сю, Эдуард Франсуа и Дапенг Ву, "Адаптивный контурный фильтр на основе классифицированного квадродерева", Международная конференция и выставка IEEE по мультимедиа от 2011 г. Мультимедиа и выставка, страницы: 1-6. В этом фильтре каждый пиксель отфильтрованного восстановленного кадра представляет собой взвешенную сумму нескольких пикселей в соединенной области пикселя восстановленного кадра вокруг положения формируемого отфильтрованного пикселя. Соединенная область пикселя обычно определяется как набор соседних пикселей этого пикселя. Набор может быть симметрично расположен вокруг пикселя, при этом модификации могут применяться рядом с границей восстановленного кадра или границей восстановленного блока. Часто используемые наборы могут иметь форму ромба, такую как ромбовидная форма 7×7 для компонента яркости или ромбовидная форма 5×5 для компонентов цветности, как показано на рисунке 12.

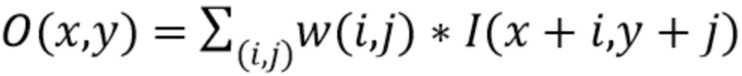

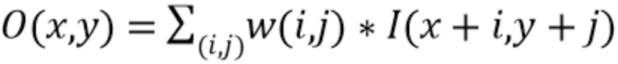

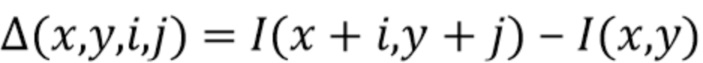

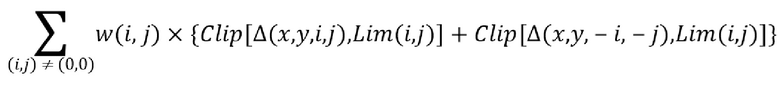

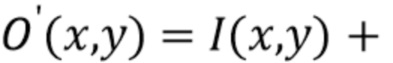

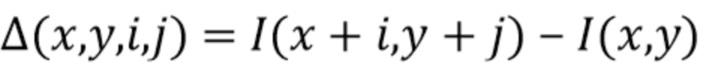

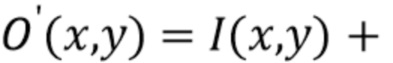

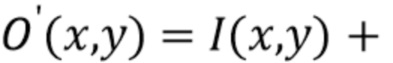

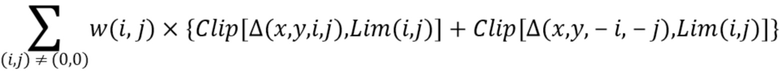

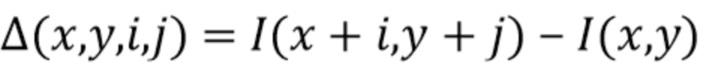

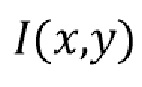

Процесс фильтрации (линейного) адаптивного контурного фильтра выполняется следующим образом:

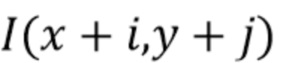

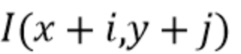

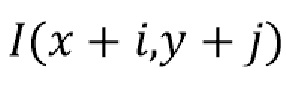

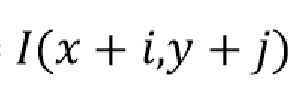

где выборки

- это входные восстановленные выборки из соединенной области пикселя с координатами (x,y),

- это входные восстановленные выборки из соединенной области пикселя с координатами (x,y),

- это отфильтрованная выходная восстановленная выборка (то есть результат фильтрации), и

- это отфильтрованная выходная восстановленная выборка (то есть результат фильтрации), и

обозначает коэффициенты фильтра.

обозначает коэффициенты фильтра.

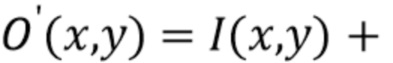

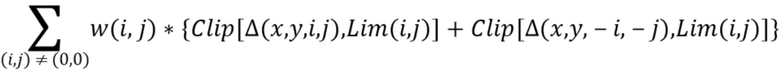

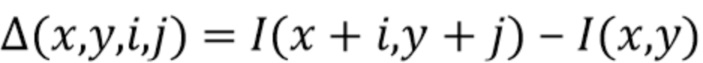

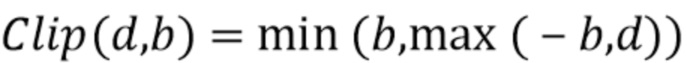

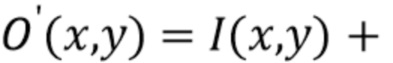

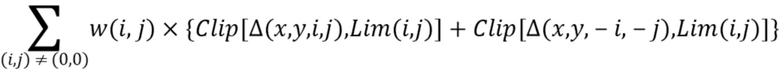

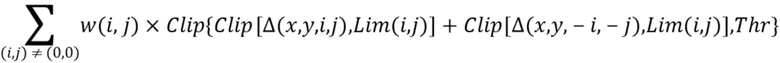

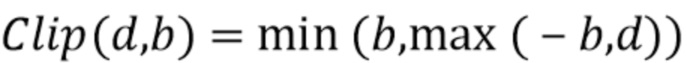

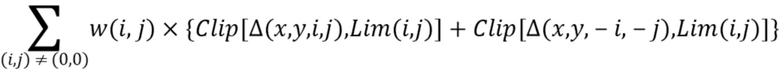

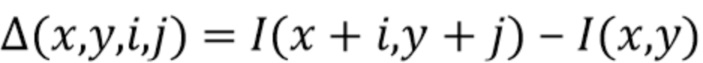

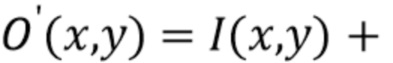

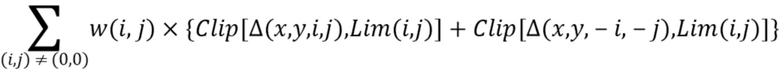

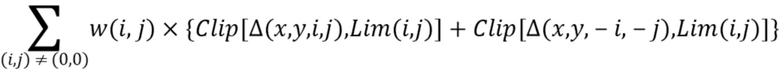

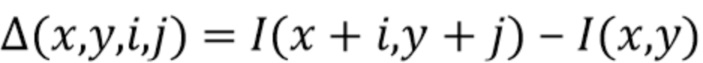

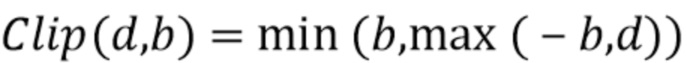

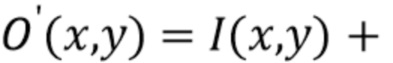

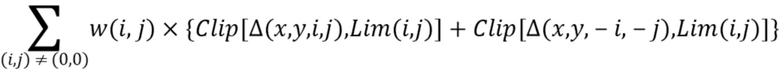

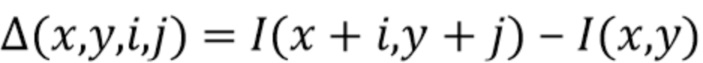

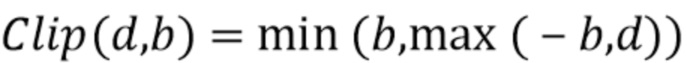

Вышеописанное уравнение может быть изменено (в соответствии со способом нелинейной адаптивной контурной фильтрации, описанным в JVET-M0385, который общедоступен по адресу http://phenix.it-sudparis.eu/jvet/) без влияния на эффективность кодирования, в следующем выражении:

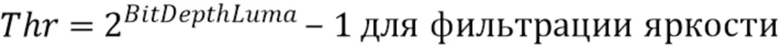

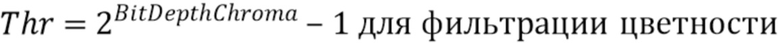

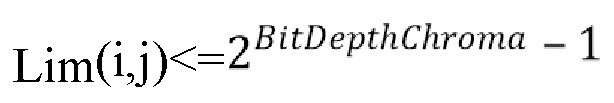

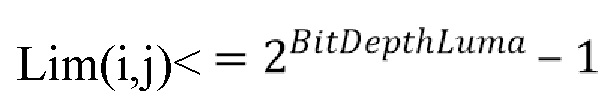

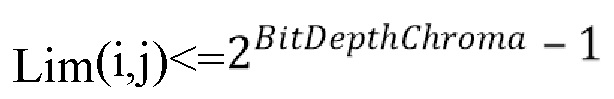

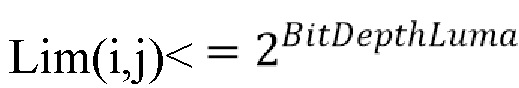

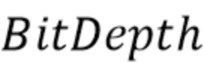

Если максимальный весовой коэффициент w(i,j) представляет собой n-битное целое число, BitDepthLuma - битовая глубина компонента яркости (максимальное количество битов в пикселе яркости), BitDepthChroma - битовая глубина компонента цветности, тогда для реализации фильтра требуется N целочисленных умножений n-битных значений на (BitDepthLuma+3)-битные значения для фильтрации компонентов яркости и на (BitDepthChroma+3)-битные значения для фильтрации компонентов цветности, где N - длина фильтра.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Описанные ниже способы обеспечивают нелинейный внутриконтурный фильтр низкой сложности, который требует N умножений n-битных коэффициентов фильтра на (BitDepthLuma+2)-битные значения вместо N умножений n-битных коэффициентов фильтра на (BitDepthChroma+3)-битные значения в современном решении для компонента яркости. Для компонента цветности способы, описанные ниже, обеспечивают нелинейный внутриконтурный фильтр низкой сложности, который требует N умножений n-битных коэффициентов фильтра на (BitDepthChroma+2)-битные значения вместо N умножений n-битных коэффициентов фильтра на (BitDepthChroma+3)-битные значения в современном решении.

Варианты осуществления настоящего раскрытия обеспечивают улучшенный внутриконтурный фильтр низкой сложности для фильтрации восстановленного кадра.

Варианты осуществления настоящего раскрытия позволяют снизить сложность требуемых умножений без ухудшения качества фильтрации.

Вышеупомянутые и другие цели достигаются изобретением по независимым пунктам формулы изобретения. Дополнительные формы реализации очевидны из зависимых пунктов формулы изобретения, описания и фигур.

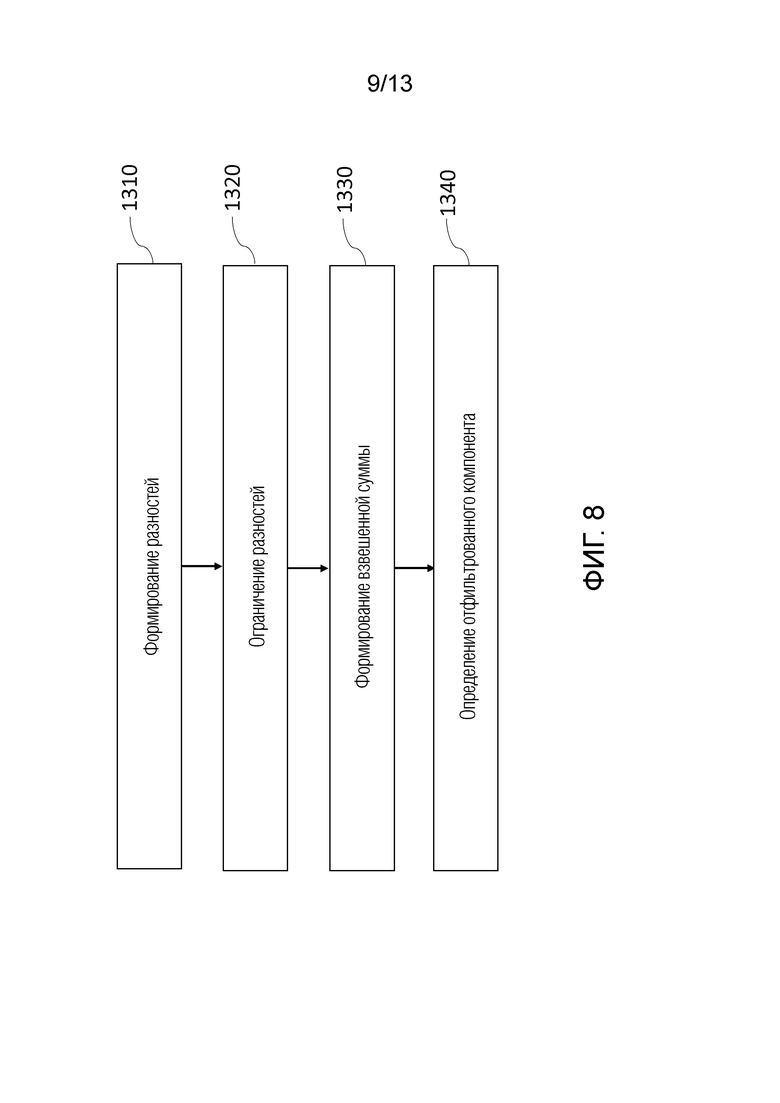

Вариант осуществления настоящего раскрытия обеспечивает способ внутриконтурной фильтрации путем выполнения адаптивной контурной фильтрации на восстановленном кадре видеопотока, реализуемый устройством кодирования или устройством декодирования, причем способ включает в себя формирование/определение разностей между, по меньшей мере, одним компонентов яркости и цветности пикселя восстановленного кадра и по меньшей мере одного из компонентов яркости и цветности соседних пикселей в соединенной области пикселя, ограничение разностей согласно соответствующим уровням ограничения, формирование/определение взвешенной суммы ограниченные разности и добавление взвешенной суммы к по меньшей мере одному из компонентов яркости и цветности пикселя для определения отфильтрованного соответствующего компонента пикселя, при этом соответствующие уровни ограничения выбираются из одного и того же набора уровней ограничения для компонентов яркости и цветности.

Согласно настоящему раскрытию адаптивная контурная фильтрация может применяться к одному или нескольким компонентам яркости и цветности пикселя восстановленного кадра. Если адаптивная контурная фильтрация применяется к двум или более компонентам, в частности ко всем компонентам яркости и цветности пикселя, фильтрация выполняется отдельно для каждого компонента. Другими словами, этапы вышеупомянутого способа, которые более подробно описаны ниже, выполняются отдельно для каждого компонента, который подвергается адаптивной контурной фильтрации.

Адаптивная контурная фильтрация может применяться к одному пикселю восстановленного кадра, группе пикселей, в частности соответствующей блоку, например блоку кодирования, или всем пикселям восстановленного кадра.

Как упомянуто выше, соединенная область пикселя обычно может быть определена как набор соседних пикселей этого пикселя. Набор может быть симметрично расположен вокруг пикселя, при этом модификации могут применяться рядом с границей восстановленного кадра или границей восстановленного блока. Часто используемые наборы могут иметь форму ромба, например форму ромба 7×7 для компонента яркости или форму ромба 5×5 для компонентов цветности.

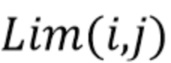

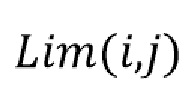

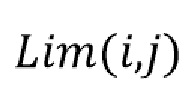

Для каждого соседнего пикселя в соединенной области определяется разность между по меньшей мере одним из компонентов яркости и цветности, то есть компонентом яркости или компонентом цветности, пикселя восстановленного кадра и по меньшей мере одним из компонентов яркости и цветности, т.е. то есть компонентом яркости или соответствующим компонентом цветности, соседнего пикселя. Каждая из результирующих разностей ограничивается в соответствии с соответствующим уровнем ограничения. Другими словами, каждый соседний пиксель в соединенной области имеет связанный соответствующий уровень ограничения для каждого из, по меньшей мере, одного из компонентов яркости и цветности. Соответствующие уровни ограничения, таким образом, зависят от фильтруемого компонента, а также от смещения (i, j) координат (x+i, y+j) соответствующего соседнего пикселя относительно координат (x, y) пиксель, по меньшей мере, один из компонентов яркости и цветности фильтруется.

Независимо от того, какой компонент, то есть компонент яркости или один из двух компонентов цветности, пикселя фильтруется, соответствующие уровни ограничения выбираются из единственного набора уровней ограничения. Один и тот же набор уровней ограничения может, в частности, включать в себя все разрешенные или возможные уровни ограничения как для компонентов яркости, так и для компонентов цветности.

Выбор уровней ограничения для компонентов яркости и цветности из одного и того же набора возможных уровней ограничения может упростить реализацию нелинейного адаптивного контурного фильтра. В частности, можно упростить определение уровней ограничения по формулам или по таблице.

Соответствующие уровни ограничения могут быть выбраны в соответствии с битовой глубиной по меньшей мере одного из компонентов яркости и цветности. Альтернативно или дополнительно, соответствующие уровни ограничения могут быть выбраны согласно соответствующим индексам ограничения для соответствующих соседних пикселей в соединенной области. Другими словами, для каждого соседнего пикселя соответствующий уровень ограничения выбирается согласно индексу ограничения для этого соседнего пикселя, который может быть различным для разных компонентов этого соседнего пикселя.

Выбор соответствующих уровней ограничения из одного и того же набора уровней ограничения для компонентов яркости и цветности может, в частности, означать, что один и тот же уровень ограничения выбран для компонента яркости и компонентов цветности для конкретного индекса ограничения, если компоненты яркости и цветности имеют такая же битовая глубина. Другими словами, битовая глубина и индекс ограничения однозначно идентифицируют уровень ограничения в наборе уровней ограничения независимо от того, выполняется ли фильтрация яркости или фильтрация цветности. Таким образом, набор уровней ограничения может быть унифицирован для компонентов яркости и цветности, поскольку один и тот же уровень ограничения выбирается из набора уровней ограничения для компонентов яркости и цветности одинаковой битовой глубины для одного и того же индекса ограничения. Это не исключает того, что разные уровни ограничения могут быть выбраны для компонентов яркости и цветности соседнего пикселя, если компоненты яркости и цветности соседнего пикселя имеют разные битовые глубины и/или разные индексы ограничения.

Соответствующие индексы ограничения могут передаваться в видеопотоке.

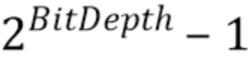

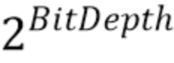

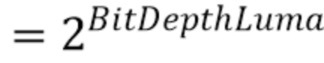

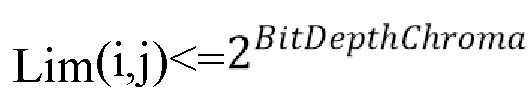

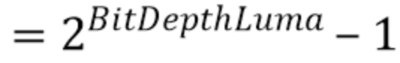

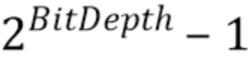

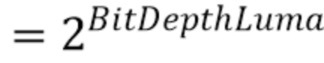

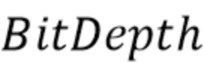

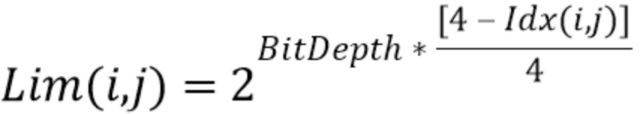

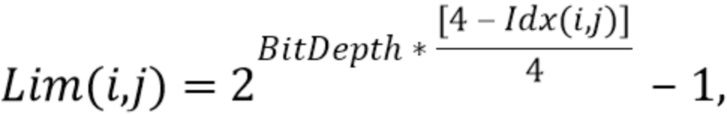

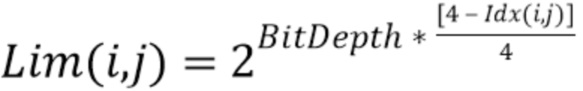

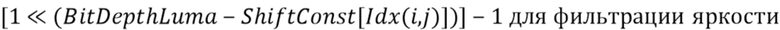

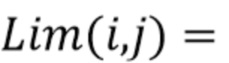

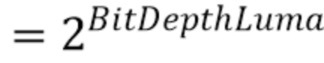

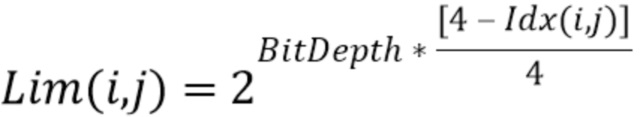

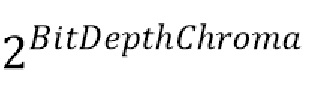

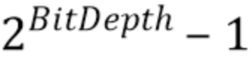

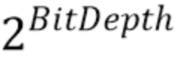

Соответствующие уровни ограничения могут быть положительными значениями ограничения, которые меньше или равны  , где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности. В качестве альтернативы, соответствующие уровни ограничения могут быть положительными значениями ограничения, которые меньше или равны

, где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности. В качестве альтернативы, соответствующие уровни ограничения могут быть положительными значениями ограничения, которые меньше или равны  , где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности.

, где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности.

Первые ограничения для уровней ограничения могут позволить уменьшить битовую глубину фильтрующего умножения на 1 бит по равнению с существующим уровнем техники для каждого умножения, что экономит аппаратную квадратную область.

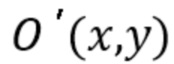

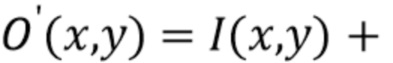

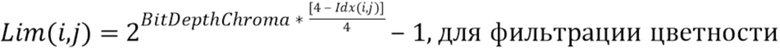

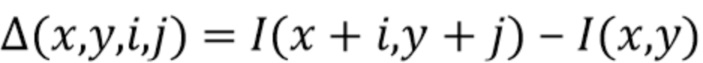

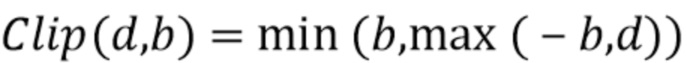

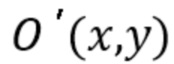

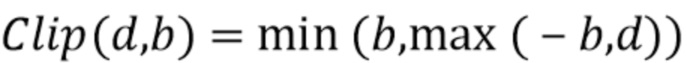

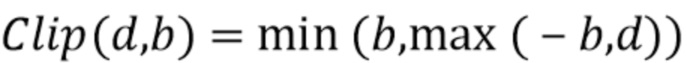

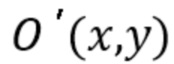

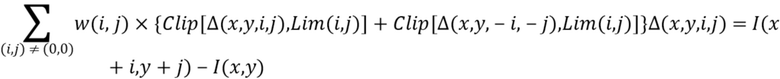

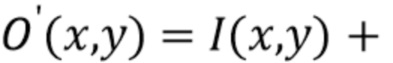

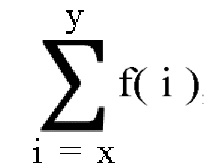

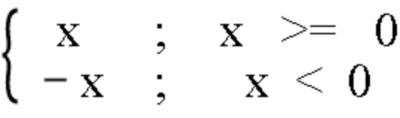

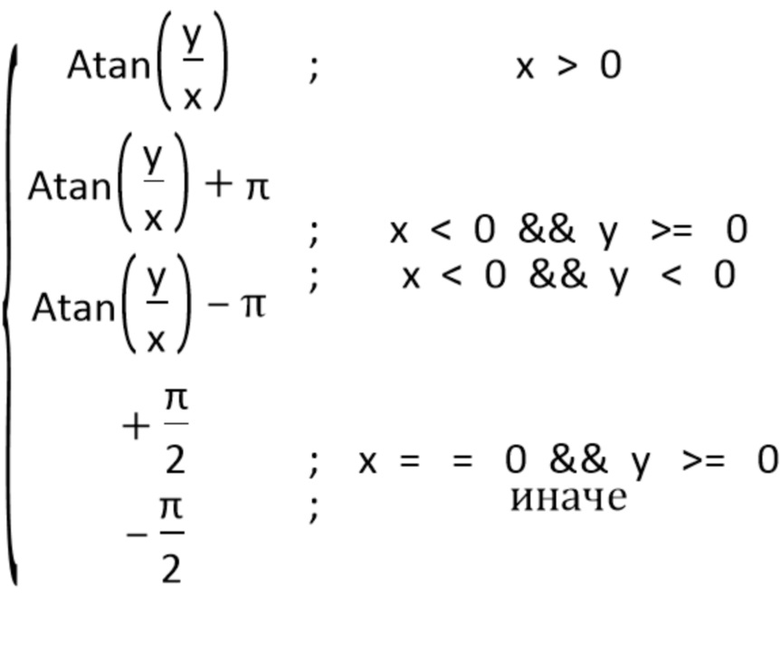

Согласно реализации, отфильтрованный соответствующий компонент  пикселя с координатами (x, y) в восстановленном кадре может быть получен в соответствии со следующим уравнением:

пикселя с координатами (x, y) в восстановленном кадре может быть получен в соответствии со следующим уравнением:

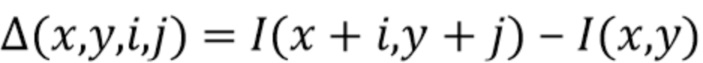

Clip( , Lim)=Clip3(-

, Lim)=Clip3(- ,

, ,

,  ),

),

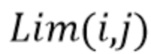

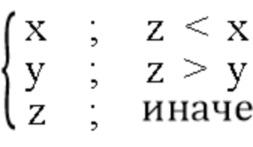

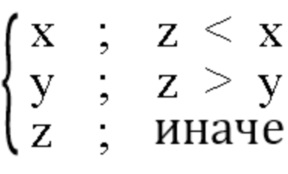

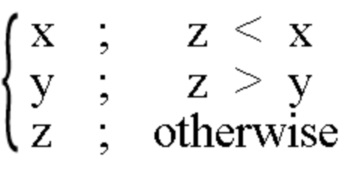

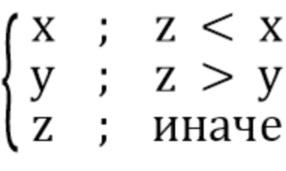

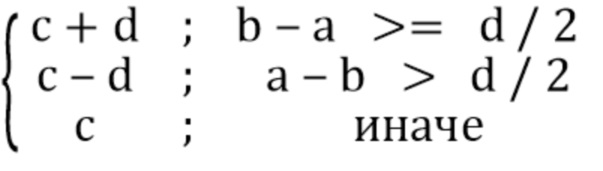

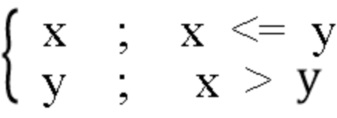

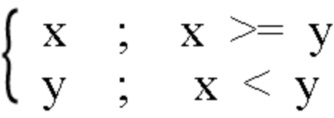

Clip3( x, y, z ) =

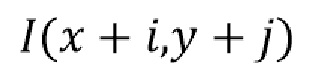

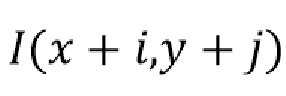

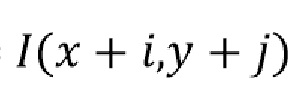

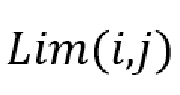

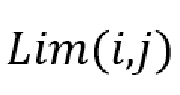

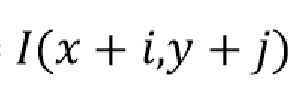

где  - положительные BitDepthLuma-битные значения для компонентов яркости или BitDepthChroma-битные значения для компонентов цветности пикселей с координатами (x+i, y+j) в восстановленном кадре,

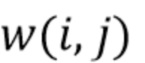

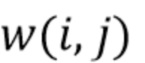

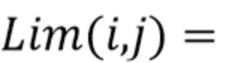

- положительные BitDepthLuma-битные значения для компонентов яркости или BitDepthChroma-битные значения для компонентов цветности пикселей с координатами (x+i, y+j) в восстановленном кадре,  обозначает n-битные целочисленные коэффициенты фильтра, соответствующие соседним пикселям в соединенной области пикселя, положения которого имеют смещения (i, j) относительно отфильтрованного пикселя, а Lim(i,j) обозначает соответствующие уровни ограничения, соответствующие соседним пикселям в соединенной области пикселя со смещениями (i, j).

обозначает n-битные целочисленные коэффициенты фильтра, соответствующие соседним пикселям в соединенной области пикселя, положения которого имеют смещения (i, j) относительно отфильтрованного пикселя, а Lim(i,j) обозначает соответствующие уровни ограничения, соответствующие соседним пикселям в соединенной области пикселя со смещениями (i, j).

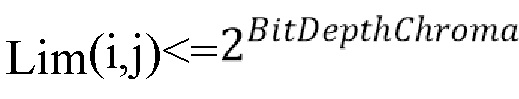

Соответствующие уровни ограничения могут быть положительными k-битными значениями ограничения с k<=BitDepth, где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности.

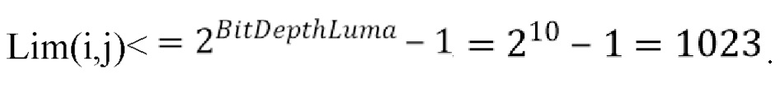

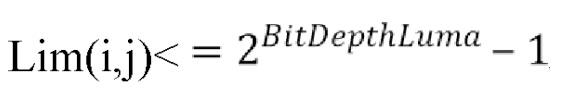

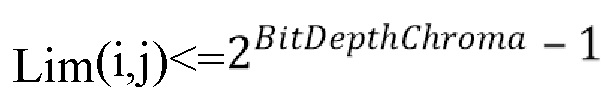

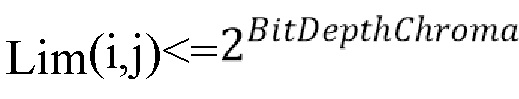

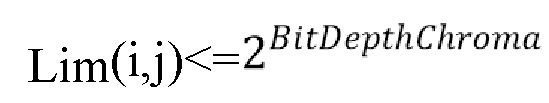

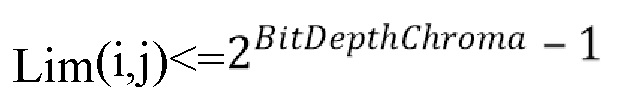

Соответствующие уровни ограничения могут, в частности, быть Lim(i,j)< для компонентов яркости и

для компонентов яркости и  для компонентов цветности. В качестве альтернативы, соответствующие уровни ограничения могут, в частности, быть Lim(i,j)<

для компонентов цветности. В качестве альтернативы, соответствующие уровни ограничения могут, в частности, быть Lim(i,j)< для компонентов яркости и Lim(i,j)<=

для компонентов яркости и Lim(i,j)<= для компонентов цветности.

для компонентов цветности.

Согласно реализации, соответствующие уровни ограничения могут быть выбраны из справочной таблицы (LUT), представляющей набор возможных уровней ограничения для компонентов яркости и цветности.

Предоставление уровней ограничения в форме LUT может дополнительно упростить реализацию нелинейного ALF. Соответствующий уровень ограничения может быть определен на стороне декодера из соответствующей битовой глубины и индекса clipIdx ограничения, который может быть закодирован в и извлечен из битового потока.

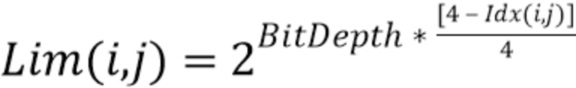

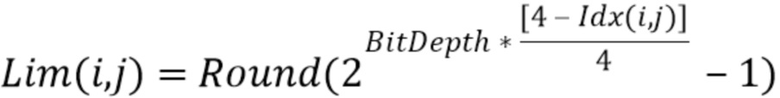

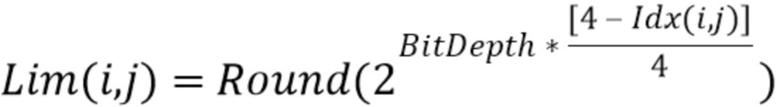

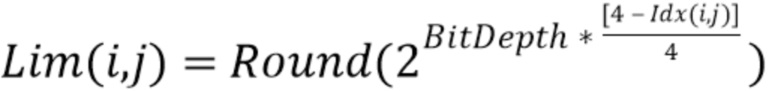

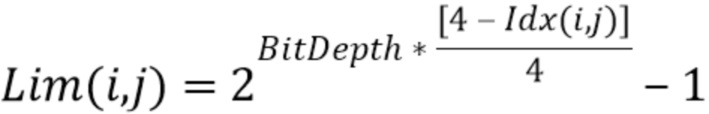

LUT может быть задана следующим образом:

где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности, а clipIdx обозначает индекс ограничения.

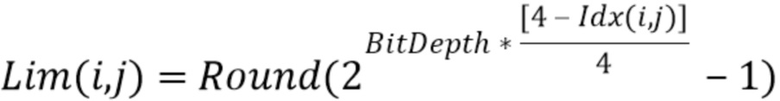

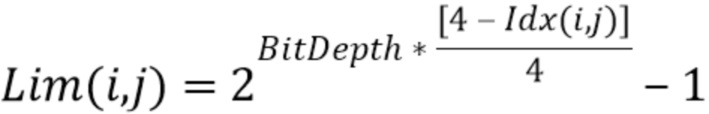

В качестве альтернативы LUT может быть задана следующим образом:

где BitDepth обозначает битовую глубину по меньшей мере одного из компонентов яркости и цветности, а clipIdx обозначает индекс ограничения.

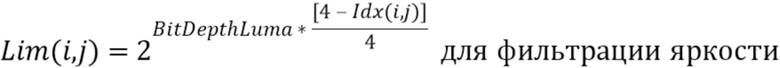

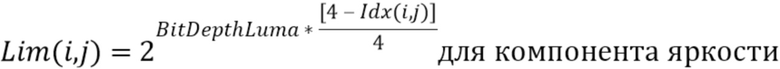

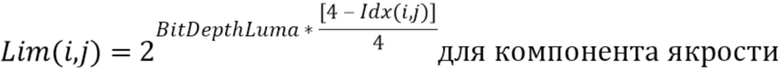

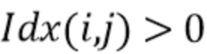

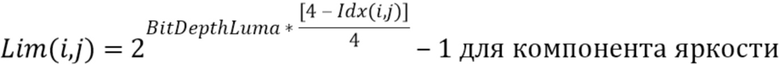

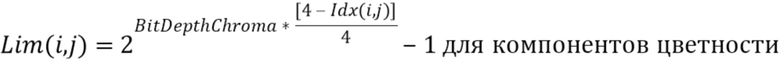

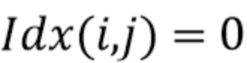

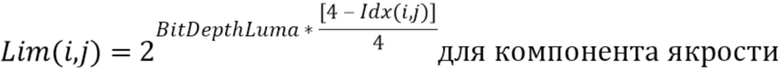

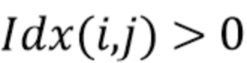

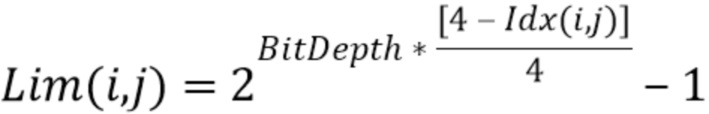

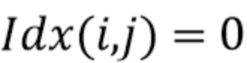

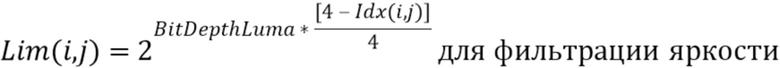

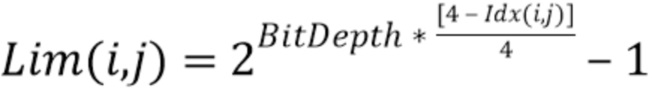

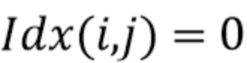

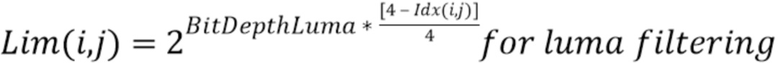

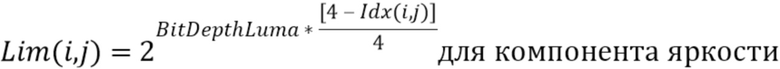

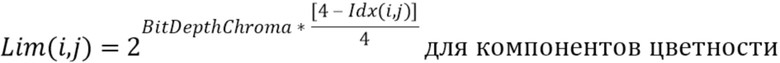

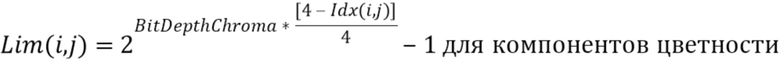

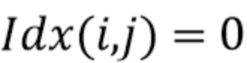

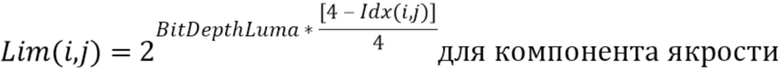

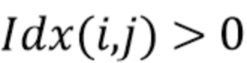

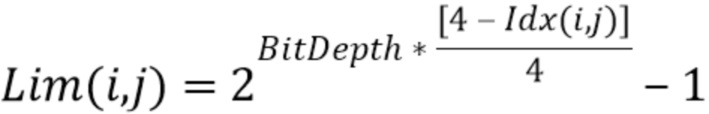

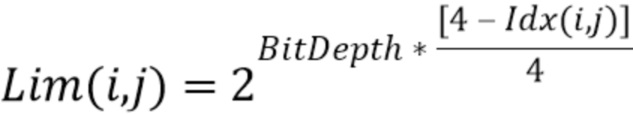

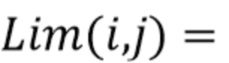

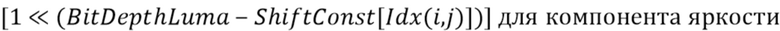

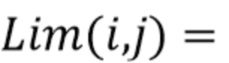

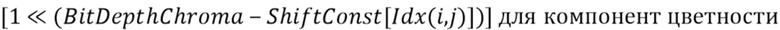

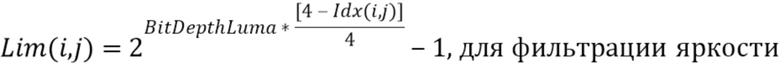

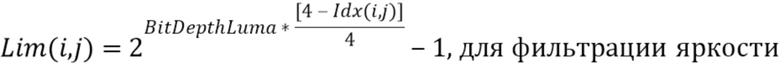

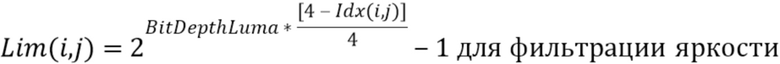

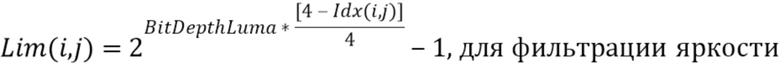

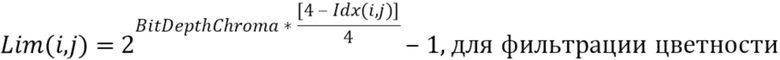

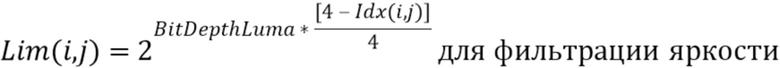

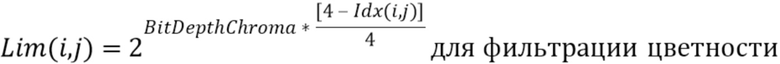

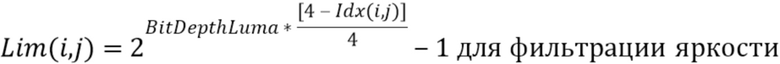

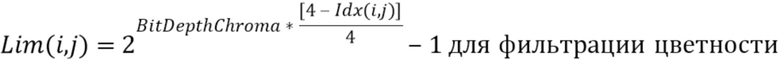

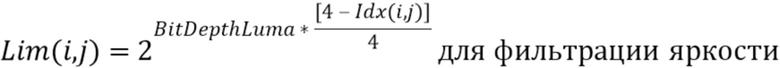

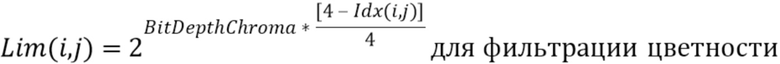

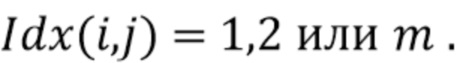

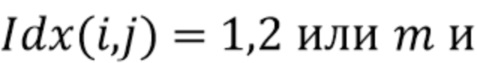

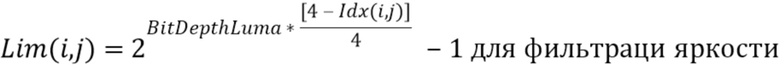

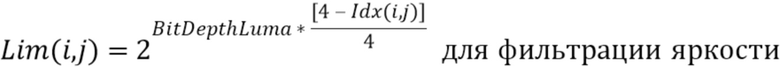

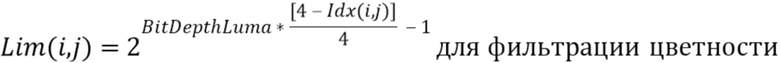

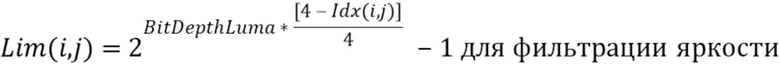

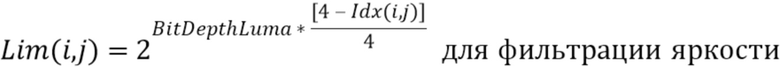

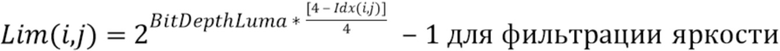

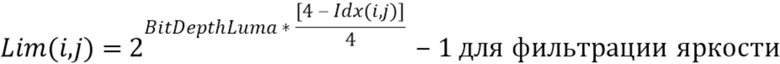

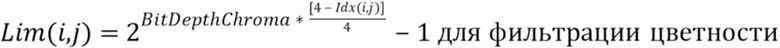

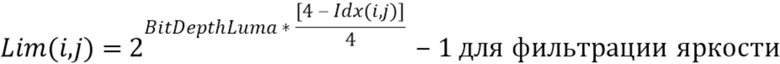

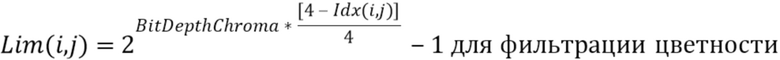

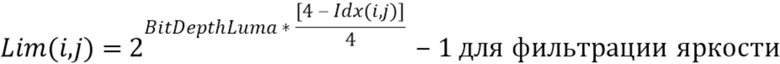

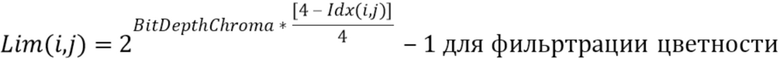

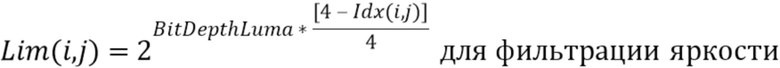

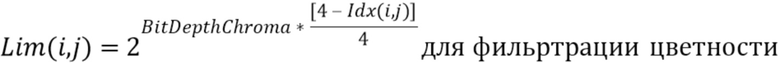

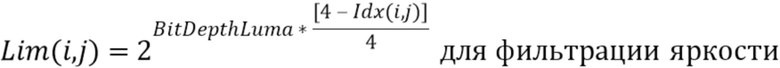

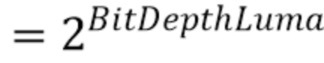

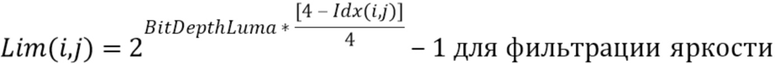

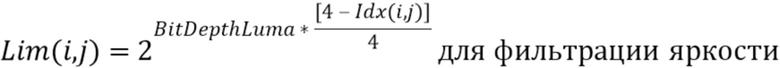

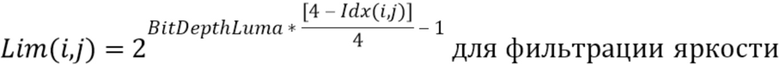

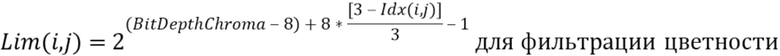

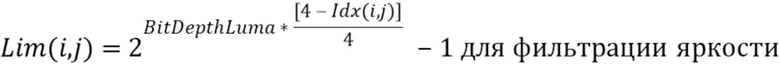

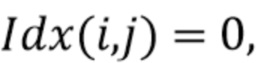

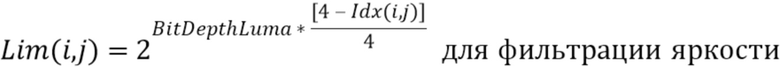

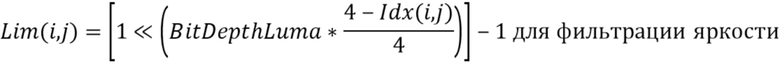

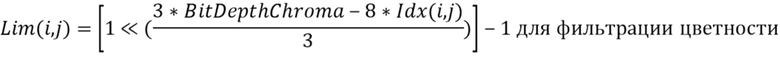

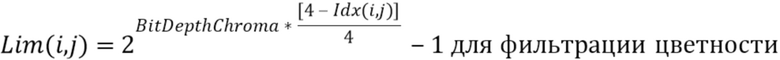

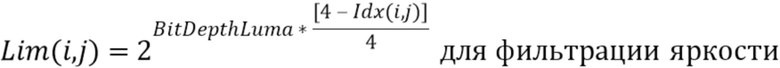

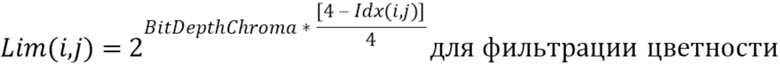

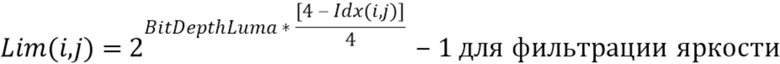

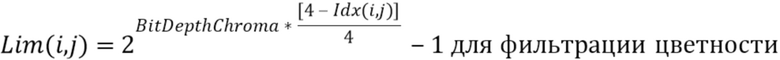

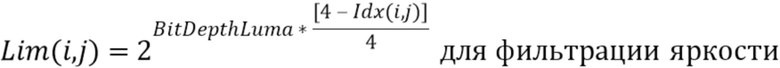

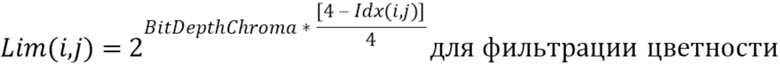

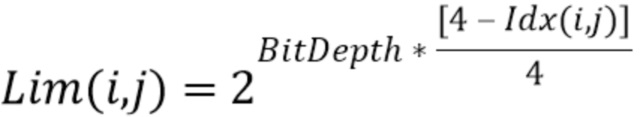

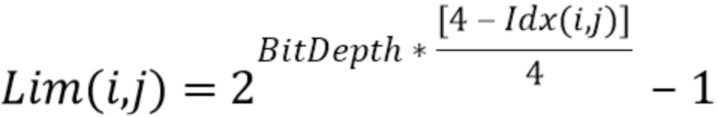

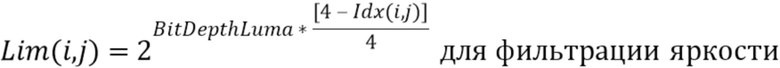

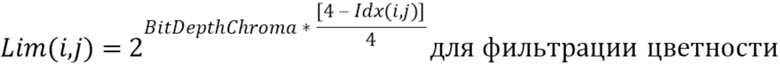

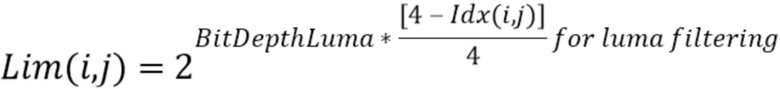

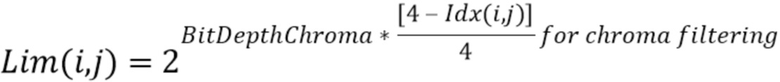

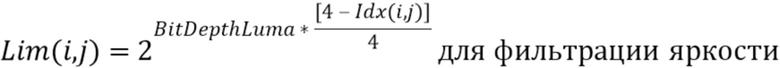

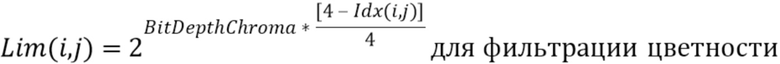

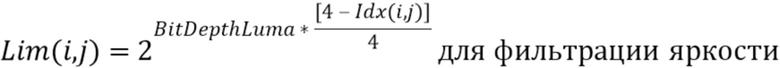

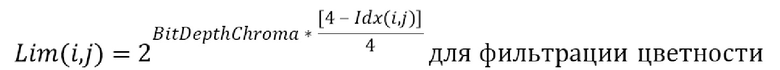

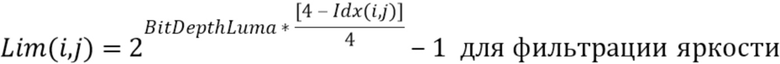

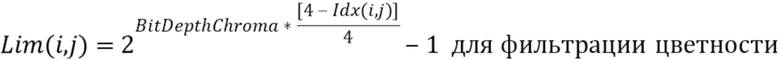

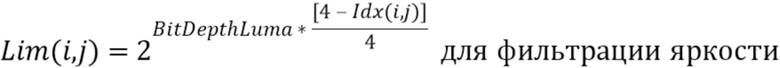

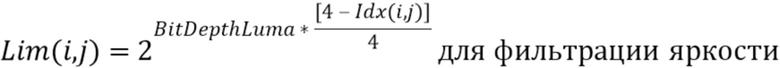

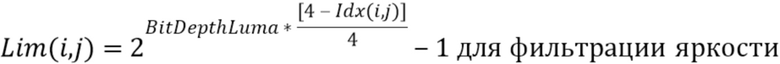

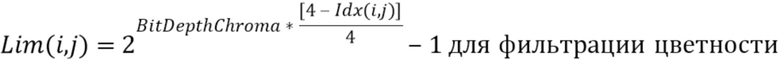

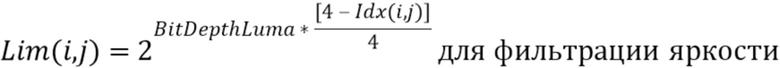

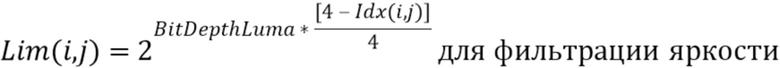

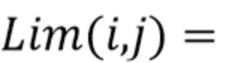

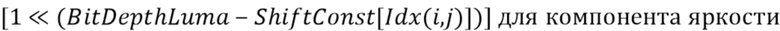

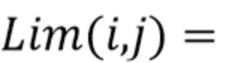

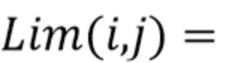

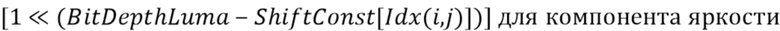

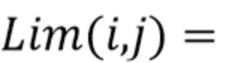

Набор уровней Lim(i,j) ограничения для компонентов яркости и цветности может быть определен в соответствии со следующими уравнениями:

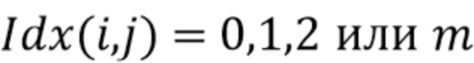

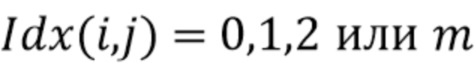

посредством изменения битовой глубины компонента яркости BitDepthLuma и компонентов цветности BitDepthChroma, а также индекса Idx(i,j).

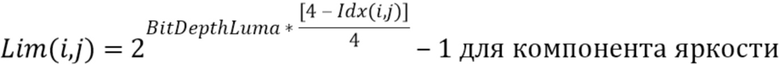

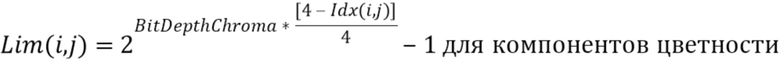

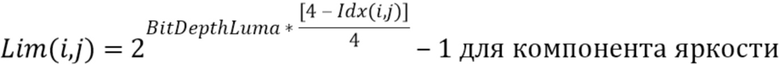

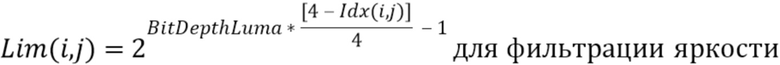

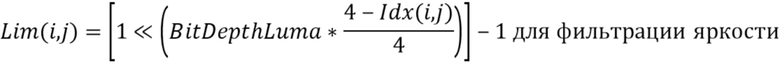

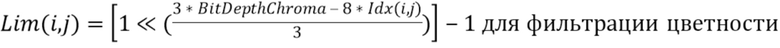

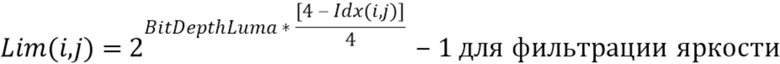

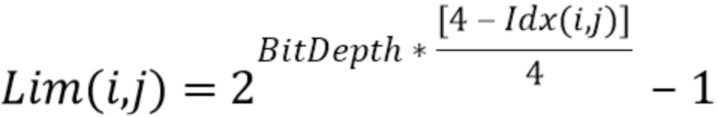

В качестве альтернативы, набор уровней Lim(i,j) ограничения для компонентов яркости и цветности может быть определен в соответствии со следующими уравнениями:

и/или

посредством изменения битовой глубины компонента яркости BitDepthLuma и компонентов цветности BitDepthChroma, а также индекса Idx(i,j).

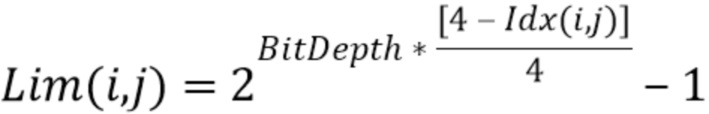

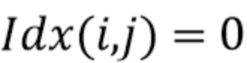

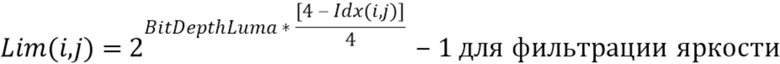

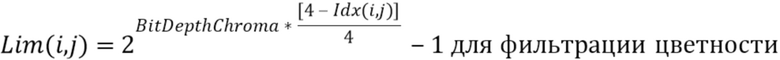

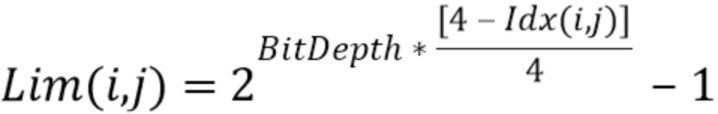

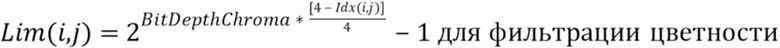

В качестве альтернативы, набор уровней Lim(i,j) ограничения для компонентов яркости и цветности может быть определен в соответствии со следующими уравнениями:

и/или

посредством изменения битовой глубины яркости или компонентов BitDepth, а также индекса Idx(i,j).

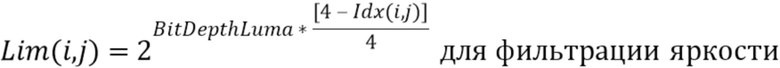

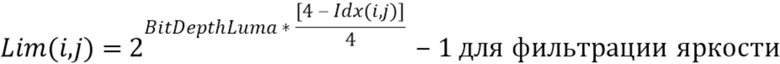

LUT, предоставляющая набор уровней Lim(i,j) ограничения для компонентов яркости и цветности, может быть получена в соответствии со следующими уравнениями:

посредством изменения битовой глубины компонента яркости BitDepthLuma и компонентов цветности BitDepthChroma, а также индекса Idx(i,j).

В качестве альтернативы LUT, представляющая набор уровней Lim(i,j) ограничения для компонентов яркости и цветности, может быть определена в соответствии со следующими уравнениями:

и/или

посредством изменения битовой глубины компонента яркости BitDepthLuma и компонентов цветности BitDepthChroma, а также индекса Idx(i,j).

В качестве альтернативы LUT, представляющая набор уровней Lim(i,j) ограничения для компонентов яркости и цветности, может быть определена в соответствии со следующими уравнениями:

и/или

посредством изменения битовой глубины компонентов яркости или цветности BitDepth, а также индекса Idx(i,j).

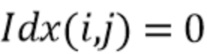

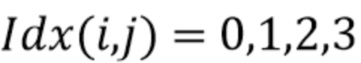

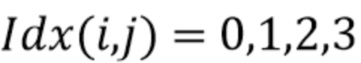

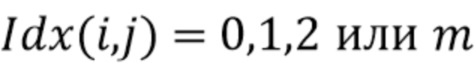

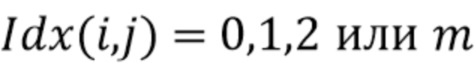

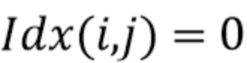

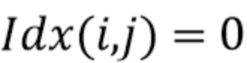

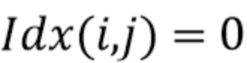

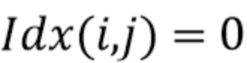

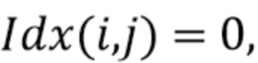

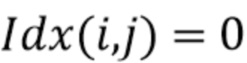

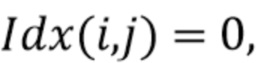

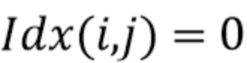

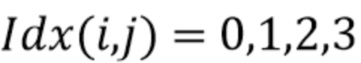

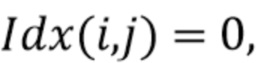

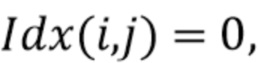

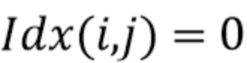

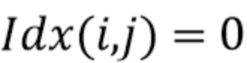

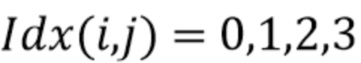

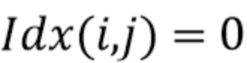

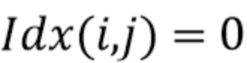

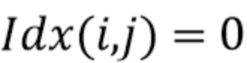

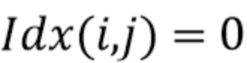

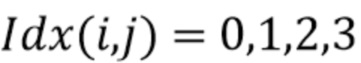

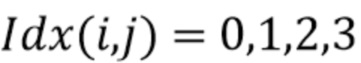

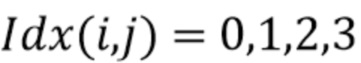

Согласно реализации, индекс Idx(i,j) выбирается из диапазона положительных значений от 0 до m, где m - положительное целочисленное значение, для набора уровней ограничения. Согласно реализации, Idx(i,j)=0, 1, 2, …, m с положительным целым числом m для набора возможных уровней ограничения. m можно принять равным 3.

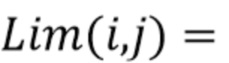

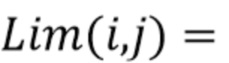

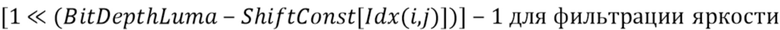

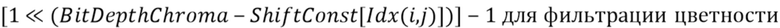

Согласно реализации, набор возможных уровней Lim(i,j) ограничения для компонентов яркости и цветности может быть определен в соответствии со следующими уравнениями:

ShiftConst[0]=0, ShiftConst[1]=3, ShiftConst[2]=5, ShiftConst[3]=7

или

ShiftConst[0]=0, ShiftConst[1]=2, ShiftConst[2]=4, ShiftConst[3]=6

посредством изменения битовой глубины компонента яркости BitDepthLuma и компонентов цветности BitDepthChroma, а также индекса Idx(i,j).

Внутриконтурная фильтрация может применяться к компонентам яркости и цветности восстановленного кадра.

Согласно аспекту варианта осуществления предоставляется устройство внутриконтурной фильтрации для использования в устройстве кодирования видео или устройстве декодирования, при этом устройство внутриконтурной фильтрации выполнено с возможностью обработки восстановленного кадра для формирования отфильтрованного восстановленного кадра, в котором восстановленный кадр содержит множество пикселей, каждый пиксель связан со значением пикселя, и при этом устройство внутриконтурного фильтра содержит одну или несколько схем обработки, выполненных с возможностью выполнения любого из способов согласно варианту осуществления.

Согласно дополнительному аспекту варианта осуществления предоставлен кодер, содержащий схему обработки для выполнения любого из способов согласно варианту осуществления.

Согласно дополнительному аспекту варианта осуществления предоставляется декодер, содержащий схему обработки для выполнения любого из способов согласно варианту осуществления.

Согласно дополнительному аспекту варианта осуществления предоставляется компьютерный программный продукт, содержащий инструкции, которые, когда программа выполняется компьютером, предписывают компьютеру выполнять любой из способов согласно варианту осуществления.

Согласно дополнительному аспекту варианта осуществления предоставляется кодер, содержащий один или несколько процессоров и не кратковременный считываемый компьютером носитель данных, соединенный с одним или несколькими процессорами и хранящий инструкции для выполнения упомянутыми одним или несколькими процессорами, при этом инструкции, когда они выполняются упомянутыми одним или несколькими процессорами, конфигурируют кодер для выполнения любого из способов согласно варианту осуществления.

Согласно дополнительному аспекту варианта осуществления предоставляется декодер, содержащий один или несколько процессоров и не кратковременный считываемый компьютером носитель данных, связанный с одним или несколькими процессорами и хранящий инструкции для выполнения упомянутыми одним или несколькими процессорами, при этом инструкции, когда они выполняются упомянутыми одним или несколькими процессорами, конфигурируют декодер для выполнения любого из способов согласно варианту осуществления.

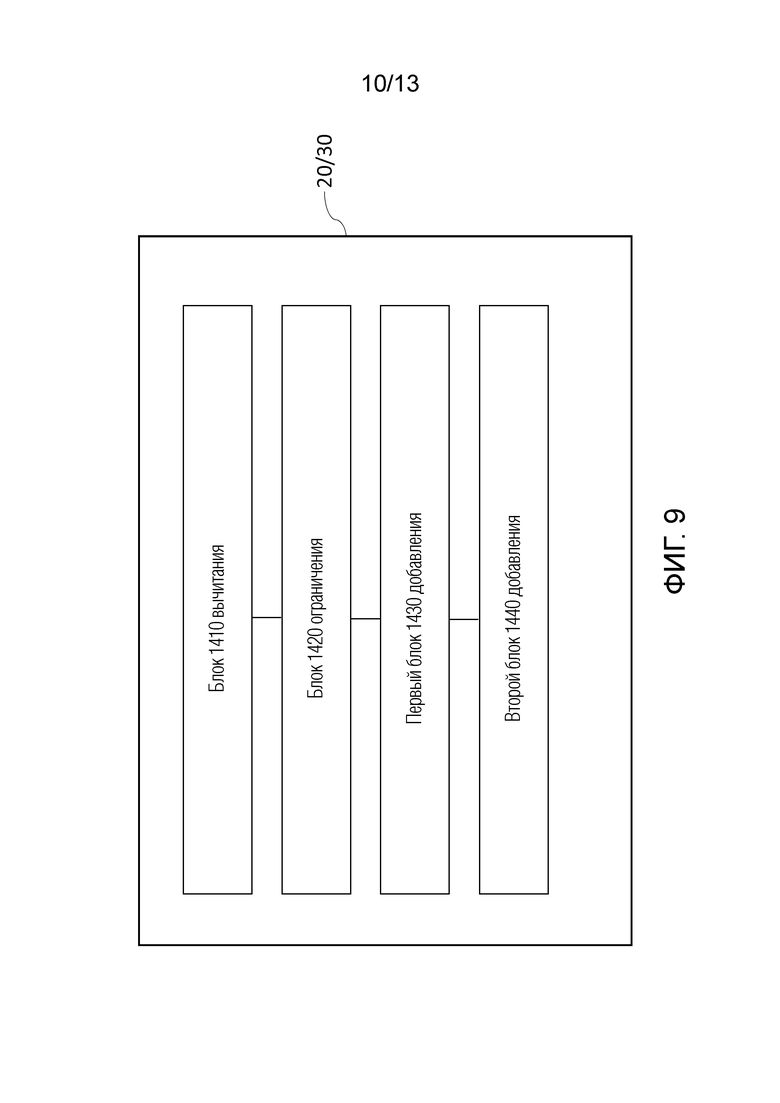

Согласно дополнительному аспекту варианта осуществления, кодер предоставляется для обработки восстановленного кадра для формирования отфильтрованного восстановленного кадра, при этом восстановленный кадр содержит множество пикселей, каждый пиксель связан со значением пикселя, и где кодер содержит блок вычитания, выполненный с возможностью формирования/определения разностей между по меньшей мере одним из компонентов яркости и цветности пикселя восстановленного кадра и, по меньшей мере, одним из компонентов яркости и цветности соседних пикселей в соединенной области пикселя, блок ограничения настроен для ограничения разностей согласно соответствующим уровням ограничения, первый блок добавления, выполненный с возможностью формирования/определения взвешенной суммы ограниченных разностей, и второй блок добавления, выполненный с возможностью прибавления взвешенной суммы к по меньшей мере одному из компонентов яркости и цветности пиксель для определения отфильтрованного соответствующего компонента пикселя, при этом соответствующие уровни ограничения выбираются из одного и того же набора уровней ограничения для компонентов яркости и цветности.

Согласно дополнительному аспекту варианта осуществления, предоставляется декодер для обработки восстановленного кадра для формирования фильтрованного восстановленного кадра, при этом восстановленный кадр содержит множество пикселей, каждый пиксель связан со значением пикселя, и при этом декодер содержит блок вычитания, выполненный с возможностью формирования/определения разностей между по меньшей мере одним из компонентов яркости и цветности пикселя восстановленного кадра и, по меньшей мере, одним из компонентов яркости и цветности соседних пикселей в соединенной области пикселя, блок ограничения настроен для ограничения разностей согласно соответствующим уровням ограничения, первый блок добавления, выполненный с возможностью формирования/определения взвешенной суммы ограниченных разностей, и второй блок добавления, выполненный с возможностью прибавления взвешенной суммы к по меньшей мере одному из компонентов яркости и цветности пиксель для определения отфильтрованного соответствующего компонента пикселя, при этом соответствующие уровни ограничения выбираются из одного и того же набора уровней ограничения для компонентов яркости и цветности.

В вышеописанном варианте осуществления разности формируются между пикселем восстановленного кадра (отфильтрованным пикселем или пикселем, который должен быть отфильтрован) и соседними пикселями в соединенной области пикселя, лежащей на линии вдоль одного направления. Другими словами, формируется взвешенная сумма нескольких пикселей в соединенной области пикселя из восстановленного кадра вокруг положения отфильтрованного пикселя, при этом соседние пиксели относятся к нескольким пикселям вокруг отфильтрованного пикселя в восстановленном кадре или блоке. В примере направление можно понимать как линию, которая проходит через m точек (например, 3 точки) с координатами (x, y), (x+i, x+j), (x-i, x-j). Другими словами, отфильтрованный пиксель соответствует координате (x, y), а соседние пиксели соответствуют координатам (x+i, x+j), (x-i, x-j) соответственно, и одна ограниченная разность между отфильтрованным пикселем (x, y) и соседний пиксель (x+i, x+j) и другая ограниченная разность между фильтрованным пикселем (x, y) и соседним пикселем (x-i, x-j) формируются для каждого направления и смещения (i, j). Для обеспечения симметричной фильтрации можно рассмотреть несколько направлений. Часто используемые примеры представляют собой ромбовидную форму 7×7 для фильтрации яркости и ромбовидную форму 5×5 для фильтрации цветности, как показано на рисунке 12.

Согласно дополнительному аспекту раскрытия вышеописанные способы фильтрации восстановленного кадра могут использоваться на стороне кодера и декодера и для компонентов яркости и цветности.

Согласно дополнительному аспекту раскрытие относится к устройству для декодирования видеопотока, включающему в себя процессор и память. В памяти хранятся инструкции, которые предписывают процессору выполнять любой из способов согласно варианту осуществления.

Согласно дополнительному аспекту раскрытие относится к устройству для кодирования видеопотока, включающему в себя процессор и память. В памяти хранятся инструкции, которые предписывают процессору выполнять любой из способов согласно варианту осуществления.

Согласно дополнительному аспекту предлагается считываемый компьютером носитель данных, на котором хранятся инструкции, которые при исполнении предписывают одному или нескольким процессорам, выполненных с возможностью кодирования видеоданных. Команды предписывают упомянутым одному или нескольким процессорам выполнять любой из способов согласно варианту осуществления.

Согласно дополнительному аспекту раскрытие относится к компьютерной программе, содержащей программный код для выполнения любого из способов согласно варианту осуществления, когда выполняется на компьютере.

Таким образом, описанный внутриконтурный фильтр может потребовать для компонентов яркости N умножений n-битных коэффициентов фильтра на (BitDepthLuma+2)-битные значения суммы двух ограниченных разностей между пикселем, который должен быть отфильтрован, и соседним пикселем, лежащим на линии вдоль одного направления вместо N умножений n-битных коэффициентов фильтра на (BitDepthLuma+3)-битные значения, как в современном решении. Для компонентов цветности внутриконтурный фильтр может потребовать N умножений n-битных коэффициентов фильтра на (BitDepthChroma+2)-битные значения суммы двух ограниченных разностей между пикселем, который нужно отфильтровать, и соседним пикселем, лежащим на линии вдоль в одном направлении вместо N умножений n-битных коэффициентов фильтра на (BitDepthChroma+3)-битные значения, как в современном решении.

Подробности одного или более вариантов осуществления изложены на прилагаемых чертежах и в нижеследующем описании. Другие особенности, цели и преимущества будут очевидны из описания, чертежей и формулы изобретения.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

Далее варианты осуществления изобретения описаны более подробно со ссылкой на прилагаемые фигуры и чертежи, на которых:

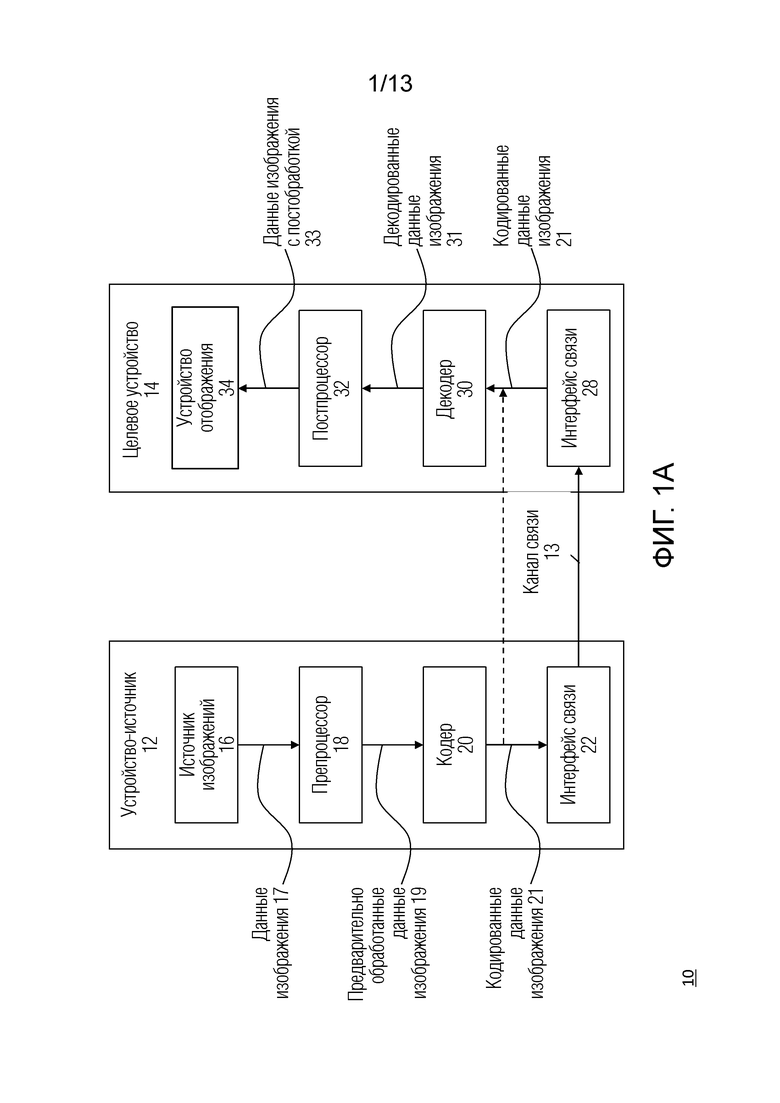

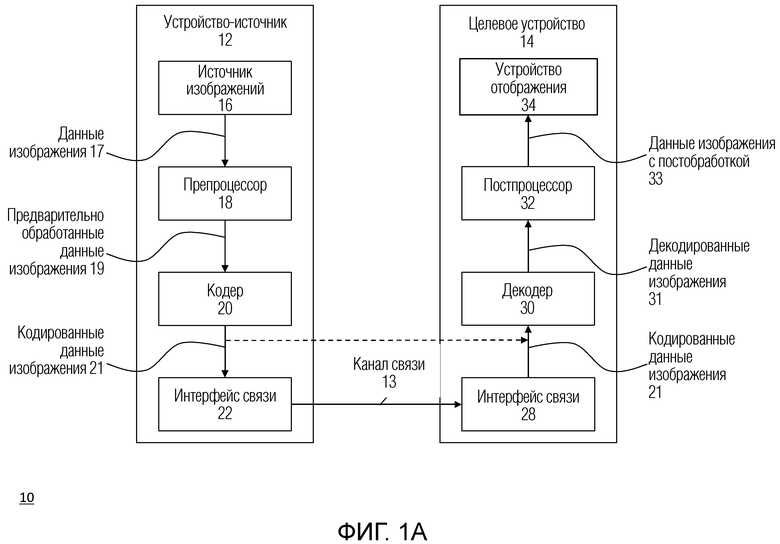

Фиг. 1A является блок-схемой, показывающей пример системы видеокодирования, выполненной с возможностью реализации вариантов осуществления настоящего раскрытия;

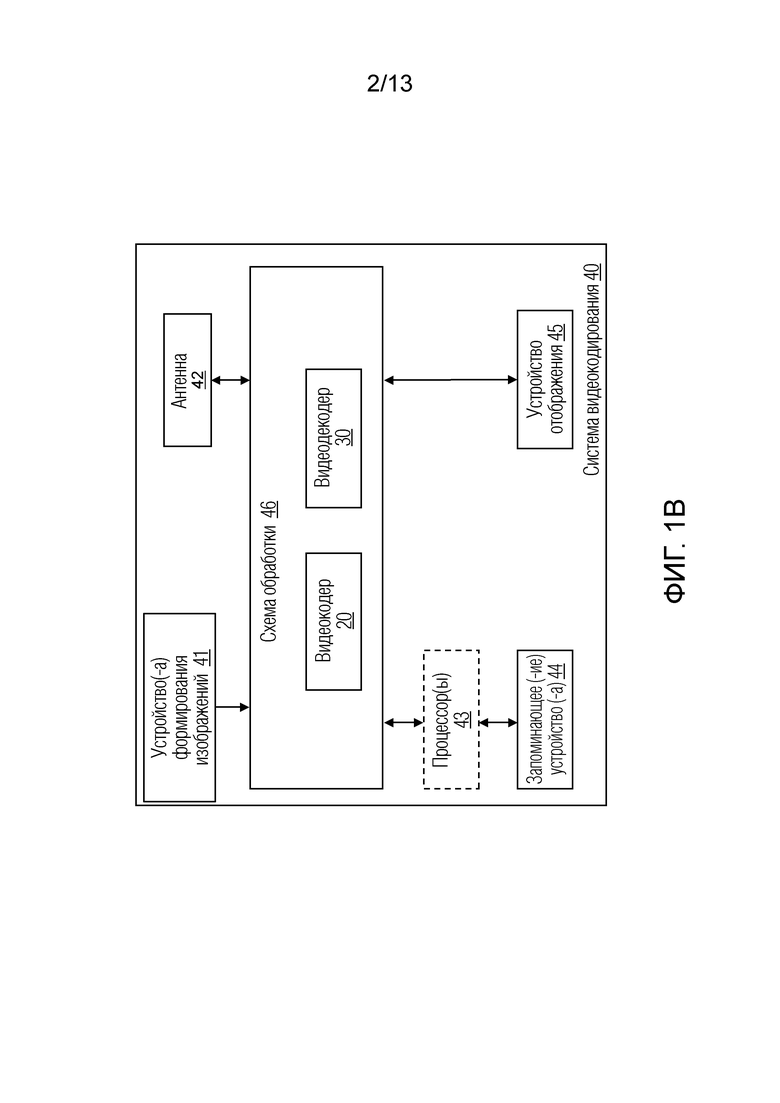

Фиг. 1B является блок-схемой, показывающей другой пример системы видеокодирования, выполненной с возможностью реализации вариантов осуществления настоящего раскрытия;

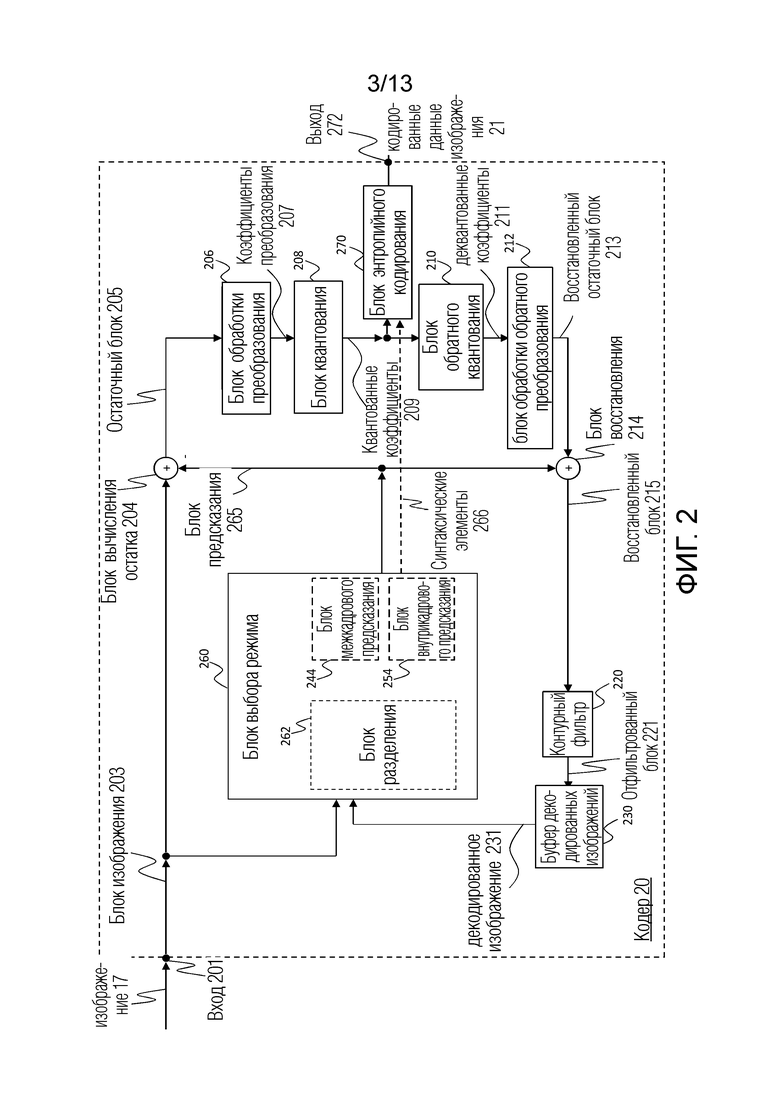

Фиг. 2 показывает схематическую диаграмму, иллюстрирующую устройство кодирования, содержащее фильтр согласно варианту осуществления раскрытия;

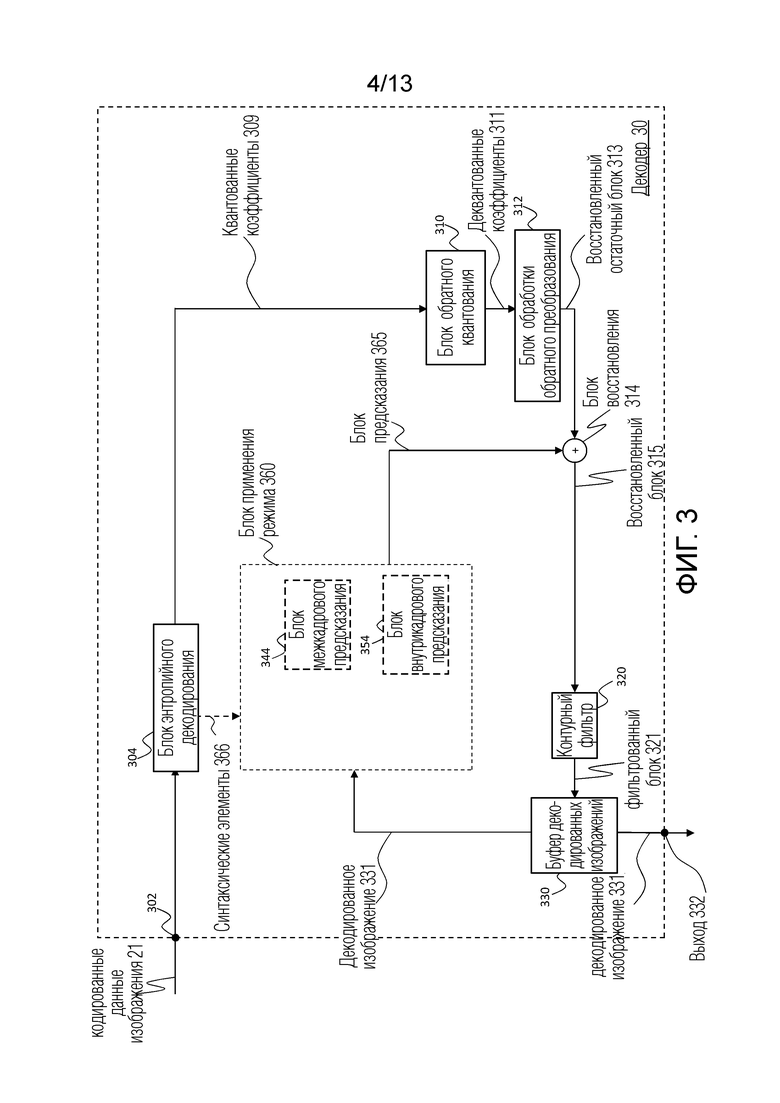

Фиг. 3 показывает схематическую диаграмму, иллюстрирующую устройство декодирования, содержащее фильтр, согласно варианту осуществления раскрытия;

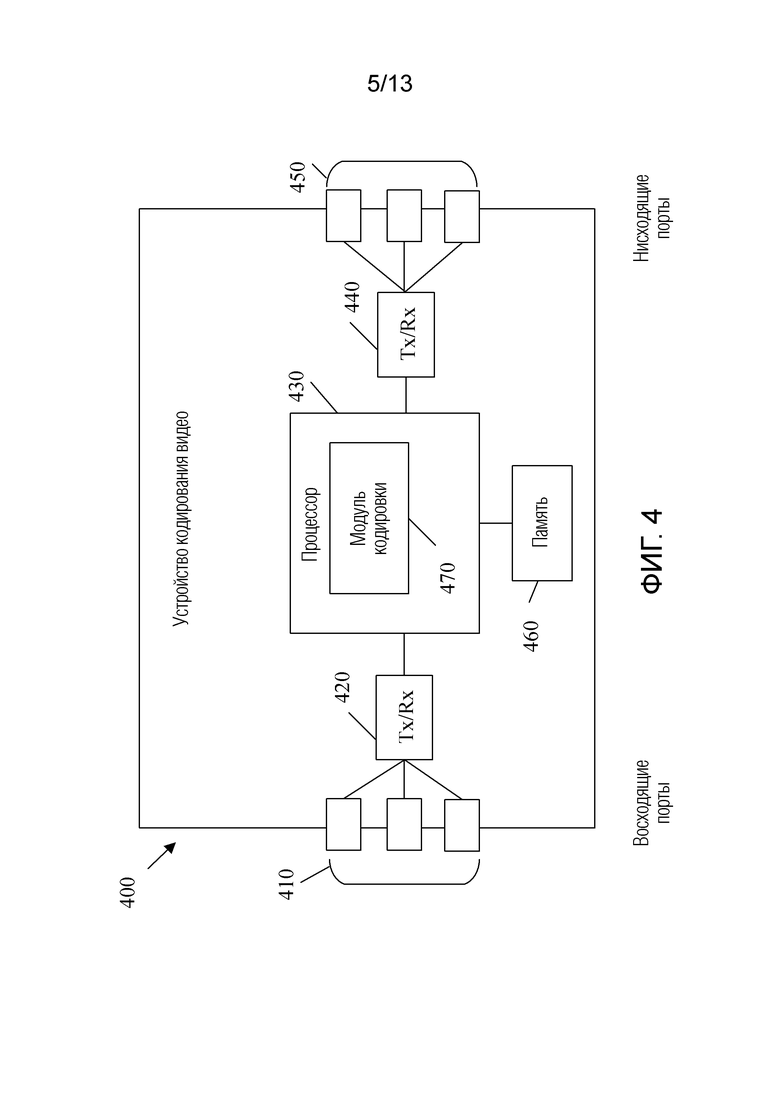

Фиг. 4 является блок-схемой, иллюстрирующей пример устройства кодирования или устройства декодирования;

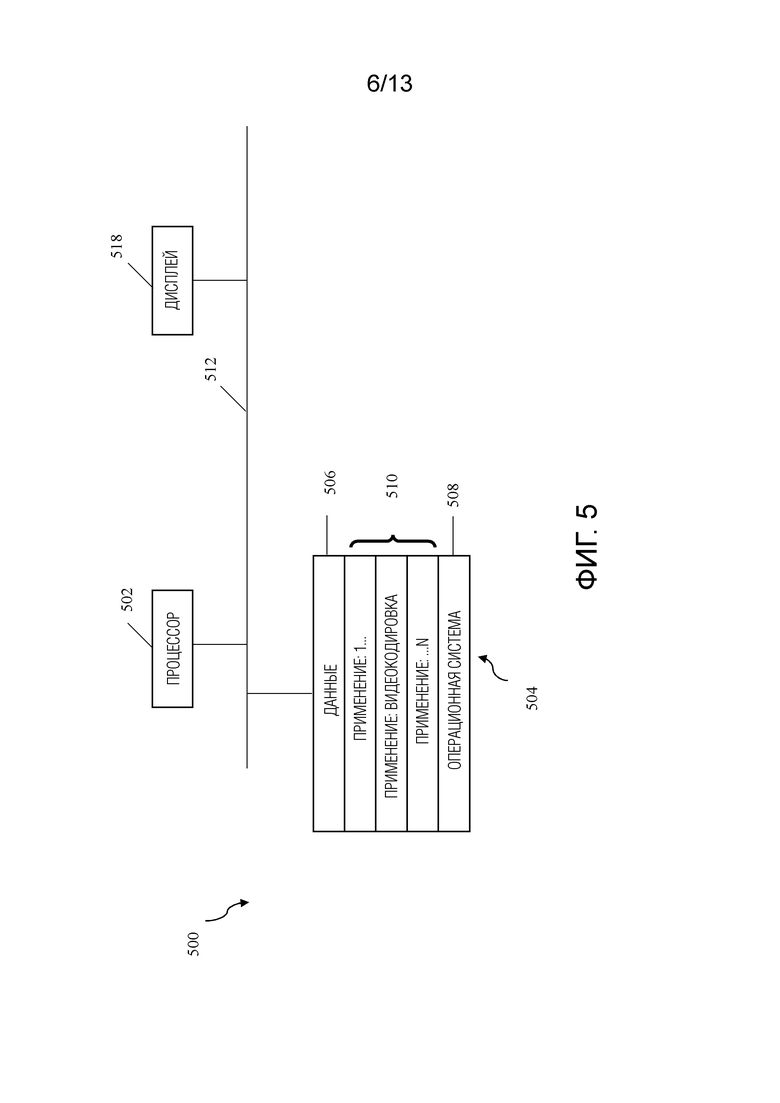

Фиг. 5 является блок-схемой, иллюстрирующей другой пример устройства кодирования или устройства декодирования;

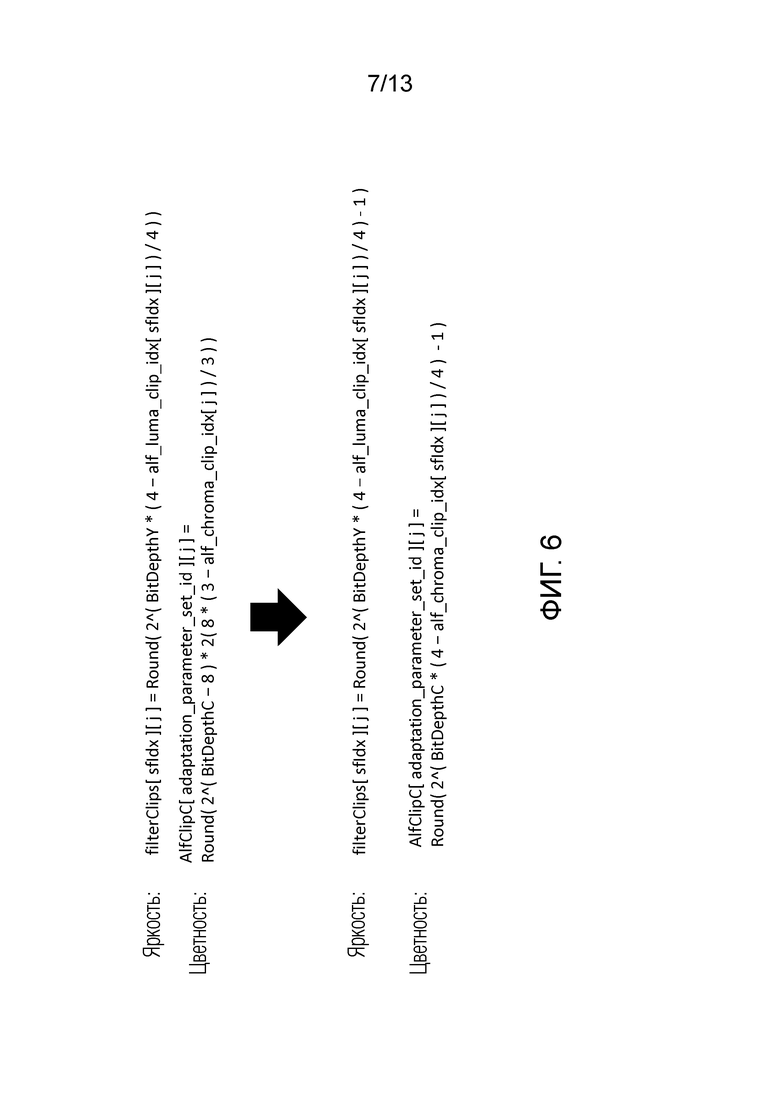

Фиг. 6 - схематическая диаграмма, иллюстрирующая изменение уровней ограничения в соответствии с уровнем техники;

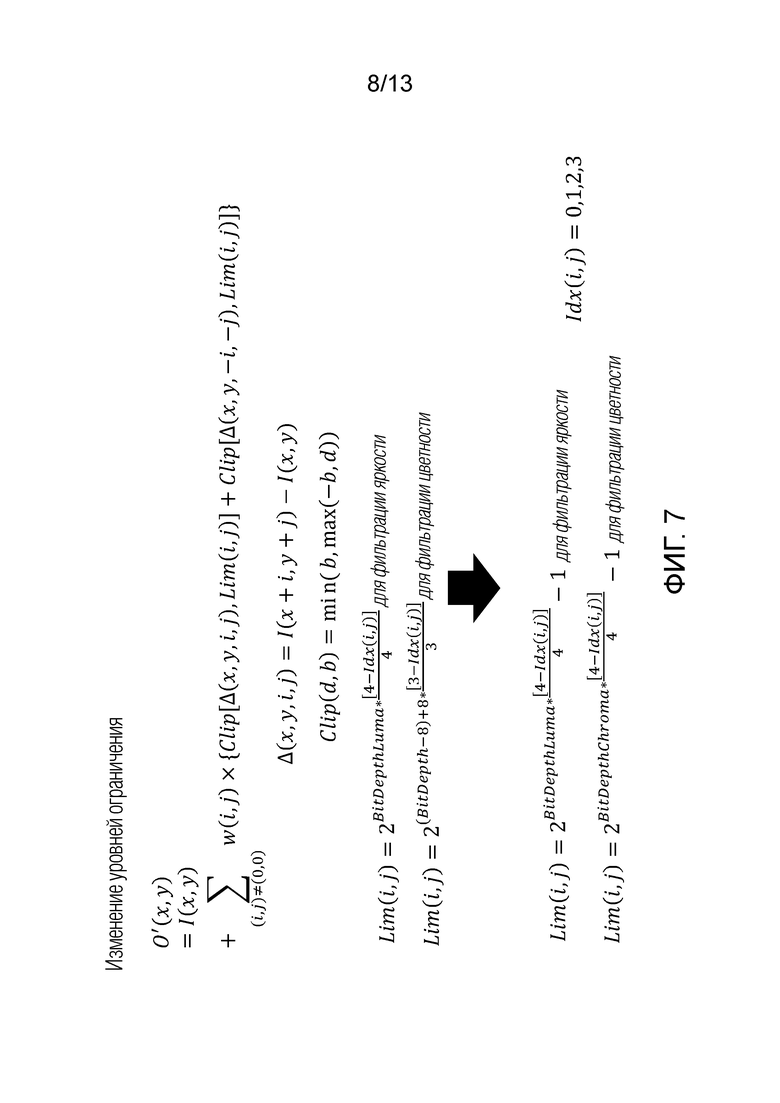

Фиг. 7 - схематическая диаграмма, иллюстрирующая примерный механизм примерного процесса согласно варианту осуществления раскрытия;

Фиг. 8 показывает блок-схему способа кодирования/декодирования видео согласно варианту осуществления раскрытия;

Фиг. 9 показывает блок-схему, иллюстрирующую пример устройства кодирования/декодирования согласно варианту осуществления раскрытия;

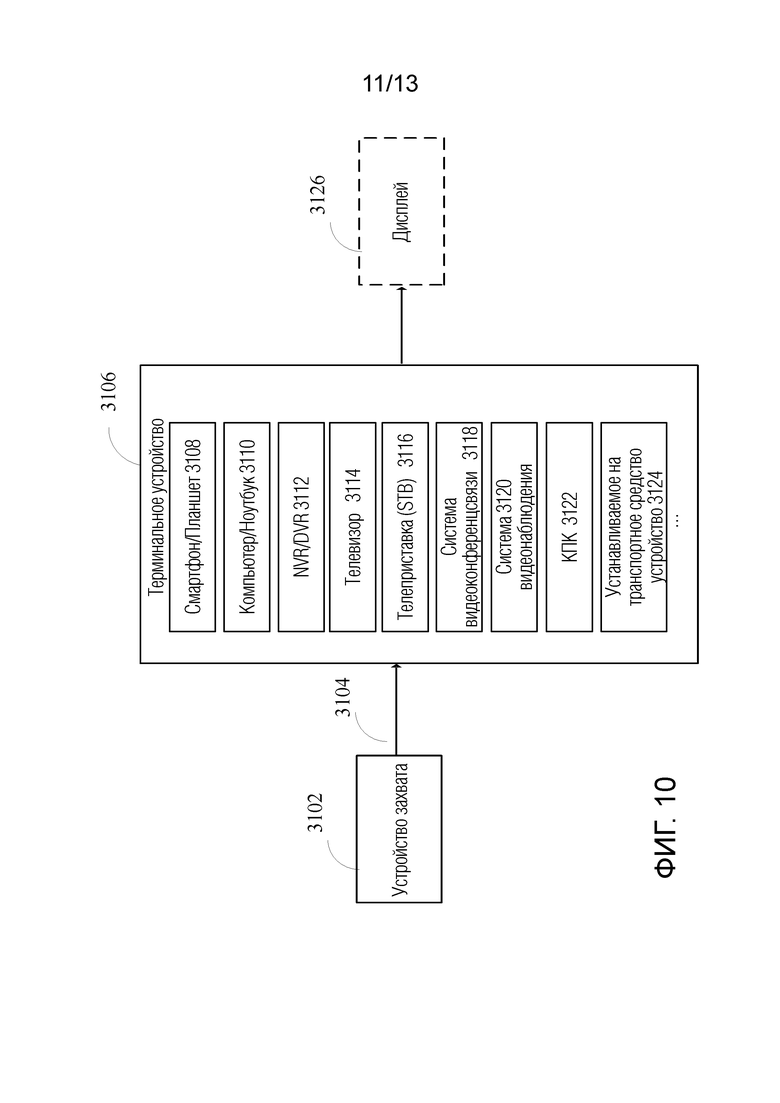

Фиг. 10 является блок-схемой, показывающей примерную структуру системы поставки контента, которая реализует услугу доставки контента; и

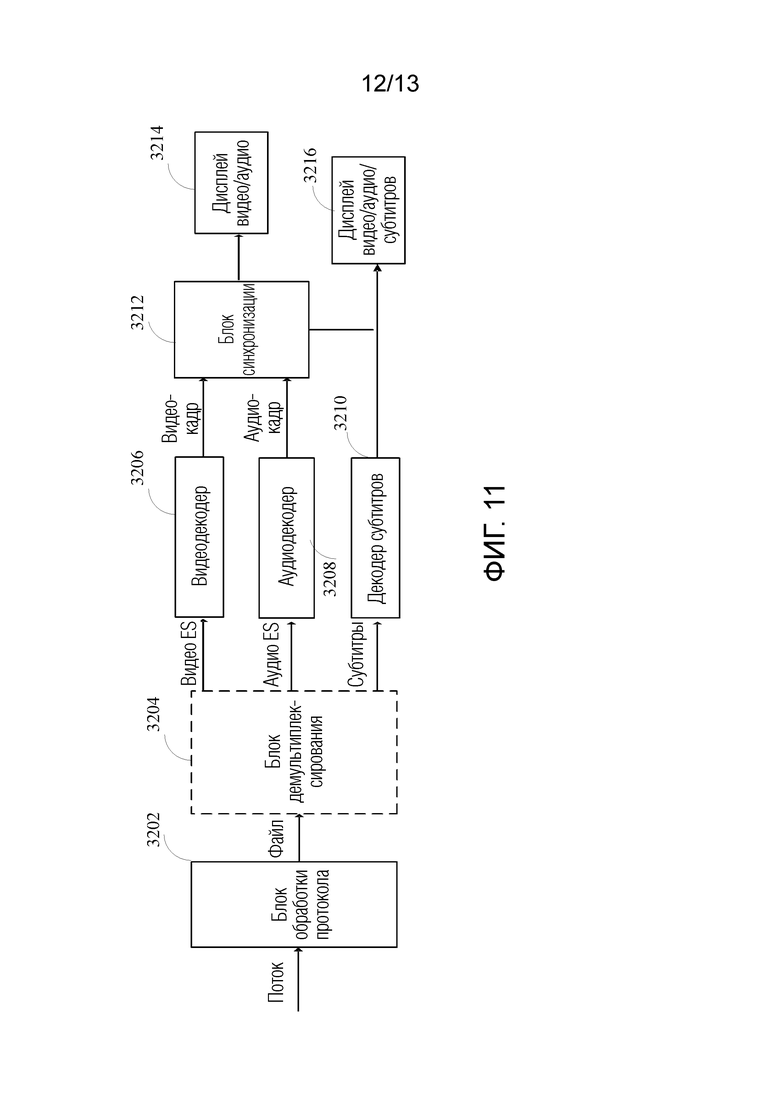

Фиг. 11 является блок-схемой, показывающей структуру примерного терминального устройства;

Фиг. 12 показаны примерные ромбовидные отводы фильтра 7×7 и 5×5 для ALF.

В дальнейшем идентичные ссылочные позиции относятся к идентичным или, по меньшей мере, функционально эквивалентным функциям, если явно не указано иное.

ОСУЩЕСТВЛЕНИЕ ИЗОБРЕТЕНИЯ

В нижеследующем описании делается ссылка на сопроводительные чертежи, которые составляют часть изобретения и показывают в качестве иллюстрации конкретные аспекты вариантов осуществления настоящего изобретения или конкретные аспекты, в которых могут использоваться варианты осуществления настоящего раскрытия. Понятно, что варианты осуществления данного раскрытия могут быть использованы в других аспектах и содержат структурные или логические изменения, не показанные на фигурах. Поэтому нижеследующее подробное описание не следует воспринимать в ограничивающем смысле, и объем настоящего раскрытия определяется прилагаемой формулой изобретения.

Например, понятно, что раскрытие, связанное с описанным способом, также может быть справедливо для соответствующего устройства или системы, выполненных с возможностью выполнения способа, и наоборот. Например, если описан один или множество конкретных этапов способа, соответствующее устройство может включать в себя один или множество блоков, например функциональных блоков, чтобы выполнять описанный один или множество этапов способа (например, один блок, выполняющий один или множество этапов, или множество блоков, каждый из которых выполняет один или более из множества этапов), даже если такой один или более блоков не описаны явным образом или не проиллюстрированы на фигурах. С другой стороны, например, если конкретное устройство описано на основе одного или множества блоков, например функциональных блоков, соответствующий способ может включать в себя один этап для выполнения функциональных возможностей одного или множества блоков (например, один этап, выполняющий функциональные возможности одного или множества блоков, или множество этапов, каждый из которых выполняет функциональные возможности одного или более из множества блоков), даже если такой один или множество этапов не описаны явным образом или не проиллюстрированы на фигурах. фигурах. Кроме того, понятно, что признаки различных примерных вариантов осуществления и/или аспектов, описанных в данном документе, могут быть объединены друг с другом, если специально не указано иное.

В настоящем раскрытии используется следующая терминология:

блок кодирования: Блок MxN выборок для положительных целочисленных значений M и N, в котором разделение блока дерева кодирования (CTB) на блоки кодирования называется разделением.

блок дерева кодирования (CTB): Блок выборок LxL для положительного целочисленного значения L, в котором разделение кадра компонента на CTB называется разделением.

единица дерева кодирования (CTU): содержит CTB выборок яркости и два соответствующих CTB выборок цветности изображения, которое имеет три массива выборок, или CTB выборок монохромного изображения или изображения, которое кодируется с использованием трех отдельных цветовых плоскостей и синтаксиса структуры, используемые для кодирования выборок.

единица кодирования (CU): содержит блок кодирования выборок яркости и два соответствующих блока кодирования выборок цветности изображения, которое имеет три массива выборок, или блок кодирования выборок монохромного изображения или изображения, которое кодируется с использованием трех отдельных цветовых плоскостей и синтаксических структур, используемых для кодирования выборок.

компонент: Массив или одиночная выборка из одного из трех массивов (яркость и две цветности), составляющих изображение в цветовом формате 4: 2: 0, 4: 2: 2 или 4: 4: 4, или массив, или одиночная выборка массива, составляющего картинку в монохромном формате.

рисунок: Массив выборок яркости в монохромном формате или массив выборок яркости и два соответствующих массива выборок цветности в цветовом формате 4: 2: 0, 4: 2: 2 и 4: 4: 4.

Видеокодирование обычно относится к обработке последовательности изображений, которые образуют видео или видеопоследовательность. Вместо термина "изображение" можно использовать термин "кадр" или "изображение" как синонимы в области видеокодирования. Кодирование видео (или кодирование в целом) состоит из двух частей: кодирования видео и декодирования видео. Видеокодирование выполняется на стороне источника и обычно содержит обработку (например, посредством сжатия) исходных видеоизображений для сокращения объема данных, требуемого для представления видеоизображений (для более эффективного хранения и/или передачи). Видеодекодирование выполняется на стороне получателя и обычно содержит обратную обработку по сравнению с кодером для восстановления видеоизображений. Варианты осуществления, относящиеся к "кодированию" видеоизображений (или изображений в целом), должны пониматься как относящиеся к "кодированию" или "декодированию" видеоизображений или соответствующих видеопоследовательностей. Комбинация кодирующей части и декодирующей части также называется CODEC (кодирование и декодирование).

В случае кодирования видео без потерь исходные видеоизображения могут быть восстановлены, т. е. Восстановленные видеоизображения имеют то же качество, что и исходные видеоизображения (при условии, что во время хранения или передачи не происходит потери передачи или других потерь данных). В случае видеокодирования с потерями выполняется дополнительное сжатие, например посредством квантования, для сокращения объема данных, представляющих видеоизображения, которые не могут быть полностью восстановлены на декодере, т.е. качество восстановленных видеоизображений ниже или хуже по сравнению с качеством исходных видеоизображений.

Несколько стандартов видеокодирования принадлежат к группе "гибридных видеокодеков с потерями" (т.е. сочетают пространственное и временное предсказание в области выборки и кодирование с 2D преобразованием для применения квантования в области преобразования). Каждое изображение видеопоследовательности обычно разделяется на набор неперекрывающихся блоков, и кодирование обычно выполняется на уровне блоков. Другими словами, в кодере видео обычно обрабатывается, то есть кодируется, на уровне блока (видеоблока), например с использованием пространственного (внутри изображения) предсказания и/или временного (между изображениями) предсказания для формирования блока предсказания, блок предсказания вычитается из текущего блока (блока, который в настоящее время обрабатывается/подлежит обработке) для получения остаточного блока, остаточный блок преобразуется и этот остаточный блок квантуется в области преобразования для сокращения объема данных (сжатия), которые подлежат передаче, тогда как в декодере обратная обработка по сравнению с кодером применяется к кодированному или сжатому блоку для восстановления текущего блока для представления. Кроме того, кодер дублирует цикл обработки декодера, так что они оба будут формировать идентичные предсказания (например, внутрикадровое и межкадровое предсказания) и/или восстановления для обработки, то есть кодирования, последующих блоков.

В нижеследующих вариантах осуществления системы 10 видеокодирования, видеокодер 20 и видеодекодер 30 описаны на основе Фиг. с 1 по 3.

Фиг. 1A представляет собой блок-схему, иллюстрирующую примерную систему 10 кодирования, например систему 10 видеокодирования (или сокращенно систему 10 кодирования), которая может использовать способы из настоящей заявки. Видеокодер 20 (или сокращенно кодер 20) и видеодекодер 30 (или сокращенно декодер 30) системы 10 видеокодирования представляют примеры устройств, которые могут быть выполнены с возможностью выполнения способов в соответствии с различными примерами, описанными в настоящей заявке.

Как показано на Фиг. 1A, система 10 кодирования содержит устройство-источник 12, выполненное с возможностью предоставления кодированных данных 21 изображения, например в целевое устройство 14 для декодирования кодированных данных 13 изображения.

Устройство-источник 12 содержит кодер 20 и может дополнительно, т.е. опционально, содержать источник 16 изображений, препроцессор (или блок предварительной обработки) 18, например, препроцессор 18 изображений, а также интерфейс связи или блок 22 связи.

Источник 16 изображений может содержать или быть устройством захвата изображений любого типа, например камерой для захвата изображения реального мира, и/или устройством формирования изображений любого типа, например процессором компьютерной графики для формирования компьютерного анимированного изображения, или любым типом другого устройства для получения и/или предоставления изображения реального мира, формируемого компьютером изображения (например, содержимого экрана, изображения виртуальной реальности (VR)) и/или любой их комбинации (например, изображения дополненной реальности (AR)). Источником изображений может быть любой тип памяти или хранилища, в котором хранятся любые из вышеупомянутых изображений.

В отличие от препроцессора 18 и обработки, выполняемой посредством блока 18 предварительной обработки, изображение или данные 17 изображения также могут именоваться необработанным (raw) изображением или необработанными данными 17 изображения.

Препроцессор 18 может быть выполнен с возможностью приема (необработанных) данных 17 изображения и выполнения предварительной обработки данных 17 изображения для получения предварительно обработанного изображения 19 или предварительно обработанных данных 19 изображения. Предварительная обработка, выполняемая препроцессором 18, может, например, содержать обрезку, преобразование цветового формата (например, из RGB в YCbCr), цветокоррекцию или шумоподавление. Можно понять, что блок 18 предварительной обработки может быть необязательным компонентом.

Видеокодер 20 может быть выполнен с возможностью приема предварительно обработанных данных 19 изображения и предоставления кодированных данных 21 изображения (дополнительные подробности будут описаны ниже, например, на основе фиг. 2).

Интерфейс 22 связи устройства-источника 12 может быть выполнен с возможностью приема кодированных данных 21 изображения и передачи этих кодированных данных 21 изображения (или любой их дальнейшей обработанной версии) по каналу 13 связи в другое устройство, например целевое устройство 14 или любое другое устройство, для сохранения или непосредственного восстановления.

Целевое устройство 14 содержит декодер 30 (например, видеодекодер 30) и может дополнительно, т.е., необязательно, содержать интерфейс связи или блок 28 связи, постпроцессор 32 (или блок 32 постобработки) и устройство 34 отображения.

Коммуникационный интерфейс 28 целевого устройства 14 может быть выполнен с возможностью приема кодированных данных 21 изображения (или любой их дальнейшей обработанной версии), например, непосредственно от устройства-источника 12 или из любого другого источника, например запоминающего устройства, такого как устройство хранения кодированных данных изображения и предоставить кодированные данные 21 изображения в декодер 30.

Интерфейс 22 связи и интерфейс 28 связи могут быть выполнены с возможностью передачи или приема кодированных данных 21 изображения или кодированных данных 13 через прямую линию связи между устройством-источником 12 и целевым устройством 14, например прямое проводное или беспроводное соединение, или через сеть любого типа, например проводную или беспроводную сеть или любое их сочетание, или любую частную и общедоступную сеть, или любое их сочетание.

Интерфейс 22 связи может быть выполнен с возможностью упаковки кодированных данных 21 изображения в соответствующий формат, например пакетов, и/или обработки кодированных данных изображения с использованием любого вида кодирования передачи или обработки для передачи по линии связи или сети связи.

Интерфейс 28 связи, образующий аналог интерфейса 22 связи, может быть выполнен с возможностью приема переданных данных и обработки данных передачи с использованием любого вида соответствующего декодирования или обработки передачи и/или деупаковки для получения кодированных данных 21 изображения.

И интерфейс 22 связи, и интерфейс 28 связи могут быть сконфигурированы как однонаправленные интерфейсы связи, как показано стрелкой для канала 13 связи на фиг. 1A, указывающей от устройства-источника 12 к целевому устройству 14, или как двунаправленные интерфейсы связи, и может быть выполнен с возможностью отправки и приема сообщений, например для установки соединения, для подтверждения и обмена любой другой информацией, относящейся к линии связи и/или передаче данных, такой как передача кодированных данных изображения.

Декодер 30 может быть выполнен с возможностью приема кодированных данных 21 изображения и предоставления декодированных данных 31 изображения или декодированного изображения 31 (дополнительные подробности будут описаны ниже, например, на основе фиг. 3 или фиг. 5).

Постпроцессор 32 целевого устройства 14 может быть выполнен с возможностью пост-обработки декодированных данных 31 изображения (также называемых данными восстановленного изображения), например, декодированного изображения 31, для получения данных 33 постобработанного изображения, таких как постобработка изображение 33. Постобработка, выполняемая блоком 32 постобработки, может включать в себя любое одно или несколько преобразований цветового формата (например, из YCbCr в RGB), цветокоррекцию, ограничение или повторную выборку, или любую другую обработку, например, для подготовки декодированных данные 31 изображения для отображения, например, устройством 34 отображения.

Устройство 34 отображения целевого устройства 14 может быть выполнено с возможностью приема данных 33 изображения с постобработкой для отображения изображения, например, пользователю или зрителю. Устройство 34 отображения может быть или содержать любой вид дисплея для представления восстановленного изображения, такой как встроенный или внешний дисплей или монитор. Дисплей может быть жидкокристаллическим дисплеем (LCD), дисплеем на органических светодиодах (OLED), плазменным дисплеем, проектором, дисплеем на микро-светодиодах, жидким кристаллом на кремнии (LCoS), цифровым световым процессором (DLP). или любой другой дисплей.

Хотя фиг. 1A изображает устройство-источник 12 и целевое устройство 14 как отдельные устройства, варианты осуществления устройств также могут содержать оба устройства или обе функции, то есть устройство-источник 12 или соответствующие функции и целевое устройство 14 или соответствующие функции. В таких вариантах осуществления устройство-источник 12 или соответствующая функциональная возможность и целевое устройство 14 или соответствующая функциональная возможность могут быть реализованы с использованием одного и того же аппаратного и/или программного обеспечения или с помощью отдельного аппаратного и/или программного обеспечения или любой их комбинации.

Как будет очевидно для специального элемента на основании описания, наличие и (точное) разделение функциональных возможностей различных блоков или функций в устройстве-источнике 12 и/или целевом устройстве 14, как показано на Фиг. 1A, может варьироваться в зависимости от фактического устройства и применения.

Кодер 20 (например, видеокодер 20) или декодер 30 (например, видеодекодер 30) или оба, кодер 20 и декодер 30 могут быть реализованы с помощью схемы обработки, показанной на фиг. 1B, например, одного или нескольких микропроцессоров, цифровых сигнальные процессоры (DSP), специализированные интегральные схемы (ASIC), программируемые вентильные матрицы (FPGA), дискретная логика, аппаратное обеспечение, выделенное кодирование видео или любые их комбинации. Кодер 20 может быть реализован через схему 46 обработки для воплощения различных модулей, как описано в отношении кодера 20 на фиг. 2 и/или любой другой системы или подсистемы кодера, описанной в данном документе. Декодер 30 может быть реализован через схему 46 обработки для воплощения различных модулей, как обсуждалось в отношении декодера 30 с Фиг. 3 и/или любой другой системы декодера или подсистемы, описанной в данном документе. Схема обработки может быть выполнена с возможностью выполнения различных операций, которые будут описаны ниже. Как показано на Фиг.5, если методики частично реализованы в программном обеспечении, устройство может хранить инструкции для программного обеспечения на подходящем долговременном считываемом компьютером носителе данных и может выполнять инструкции в аппаратных средствах, используя один или более процессоров для выполнения методик этого раскрытия. Видеокодер 20 и видеодекодер 30 могут быть интегрированы как часть комбинированного кодера/декодера (CODEC) в одном устройстве, например, как показано на фиг. 1B.

Система 40 видеокодирования, показанная на фиг. 1B, содержит схему обработки, реализующую как видеокодер 20, так и видеодекодер 30. Кроме того, одно или несколько устройств 41 формирования изображений, таких как камера для захвата изображений реального мира, антенна 42, одно или несколько запоминающих устройств 44, один или несколько процессоров 43 и/или устройство 45 отображения, такое как устройство 34 отображения, описанное выше, может быть предоставлено как часть системы 40 видеокодирования.

Устройство-источник 12 и целевое устройство 14 могут включать в себя любое из широкого диапазона устройств, включая любые виды портативных или стационарных устройств, например портативные или портативные компьютеры, мобильные телефоны, смартфоны, планшеты или планшетные компьютеры, камеры, настольные компьютеры, наборы- приставки, телевизоры, устройства отображения, цифровые медиаплееры, игровые приставки, устройства потокового видео (например, серверы служб контента или серверы доставки контента), устройства приемника вещания, устройства передатчика вещания и т.п. Операционная система. В некоторых случаях устройство-источник 12 и целевое устройство 14 могут быть оборудованы для беспроводной связи. Таким образом, устройство-источник 12 и целевое устройство 14 могут быть устройствами беспроводной связи.

В некоторых случаях система 10 видеокодирования, проиллюстрированная на фиг. 1A, является просто примером, и способы настоящего приложения могут применяться к системам видеокодирования (например, кодирование видео или декодирование видео), которые не обязательно включают в себя какую-либо передачу данных между устройствами кодирования и декодирования. В других примерах данные извлекаются из локальной памяти, передаются в потоковом режиме по сети или подобное. Устройство кодирования видео может кодировать и сохранять данные в памяти, и/или устройство декодирования видео может извлекать и декодировать данные из памяти. В некоторых примерах кодирование и декодирование выполняется устройствами, которые связь друг с другом не осуществляют, а просто кодируют данные в память и/или извлекают и декодируют данные из памяти.

Для удобства описания здесь описаны варианты осуществления данного раскрытия, например, со ссылкой на высокоэффективное видеокодирование (HEVC) или на эталонное программное обеспечение универсального видеокодирования (VVC), стандарт видеокодирования следующего поколения, разрабатываемый объединенной группой сотрудничества по видеокодированию (JCT-VC) экспертной группы по видеокодированию ITU-T (VCEG) и экспертной группы по движущимся изображениям ISO/IEC (MPEG). Обычный специалист в данной области техники поймет, что варианты осуществления данного раскрытия не ограничиваются HEVC или VVC.

Кодер и способ кодирования

Фиг. 2 показывает блок-схему примерного видеокодера 20, который выполнен с возможностью реализации способов настоящей заявки. В примере на фиг.2 видеокодер 20 содержит вход 201 (или входной интерфейс 201), блок 204 вычисления остатка, блок 206 обработки преобразования, блок 208 квантования, блок 210 обратного квантования и блок 212 обработки обратного преобразования, блок 214 восстановления, блок 220 контурного фильтра, буфер декодированных изображений (DPB) 230, блок 260 выбора режима, блок 270 энтропийного кодирования и выход 272 (или выходной интерфейс 272). Блок 260 выбора режима может включать в себя блок 244 межкадрового предсказания, блок 254 внутрикадрового предсказания и блок 262 разделения. Блок 244 межкадрового предсказания может включать в себя блок оценки движения и блок компенсации движения (не показаны). Видеокодер 20, показанный на фиг.2, также может называться гибридным видеокодером или видеокодером согласно гибридному видеокодеку.

Блок 204 вычисления остатка, блок 206 обработки преобразования, блок 208 квантования и блок 260 выбора режима могут упоминаться как формирующие прямой путь сигнала кодера 20, тогда как блок 210 обратного квантования, блок обработки обратного преобразования 212, блок 214 восстановления, контурный фильтр 220, буфер декодированных изображений (DPB) 230, блок 244 межкадрового предсказания и блок 254 внутрикадрового предсказания могут называться формирующими обратный путь сигнала видеокодера 20, при этом обратный путь сигнала видеокодера 20 соответствует пути сигнала декодера (см. видеодекодер 30 на фиг. 3). Блок 210 обратного квантования, блок 212 обработки обратного преобразования, блок 214 восстановления, контурный фильтр 220, буфер декодированных изображений (DPB) 230, блок 244 межкадрового предсказания и блок 254 внутрикадрового предсказания также относятся к формированию "Встроенный декодер" видеокодера 20.

Изображения и разделение изображений (изображения и блоки)

Кодер 20 может быть выполнен с возможностью приема, например, через вход 201, изображения 17 (или данных 17 изображения), например изображения последовательности изображений, образующих видео или видеопоследовательность. Принятое изображение или данные изображения также могут представлять собой предварительно обработанное изображение 19 (или предварительно обработанные данные 19 изображения). Для простоты следующее описание относится к рисунку 17. Изображение 17 также может называться текущим изображением или изображением, которое должно быть кодировано (в частности, при кодировании видео, чтобы отличать текущее изображение от других изображений, например, ранее кодированные и/или декодированные изображения той же видеопоследовательности, т.е. видеопоследовательность, которая также включает в себя текущее изображение).

(Цифровое) изображение является или может рассматриваться как двумерный массив или матрица выборок со значениями интенсивности. Выборка в массиве также может упоминаться как пиксель (сокращенная форма элемента изображения) или пэл (pel). Количество выборок в горизонтальном и вертикальном направлении (или оси) массива или изображения определяет размер и/или разрешение изображения. Для представления цвета обычно используются три цветовых компонента, то есть изображение может быть представлено в виде трех массивов выборок или может включать в себя их. В формате RBG или цветовом пространстве изображение содержит соответствующий массив выборок красного, зеленого и синего цветов. Однако при видеокодировании каждый пиксель обычно представлен в формате яркости и цветности или цветовом пространстве, например YCbCr, которое содержит компоненту яркости, обозначаемую Y (иногда вместо этого также используется L), и две компоненты цветности (цветоразностные компоненты), обозначаемые Cb и Cr. Компонента Y яркости (luminance) (или сокращенно яркость (luma)) представляет яркость (brightness) или интенсивность уровня серого (например, как в полутоновом изображении), в то время как две компоненты Cb и Cr цветности (chrominance) (или сокращенно цветность (chroma)) представляют компоненты информации о цветности (chromaticity) или цвете. Соответственно, изображение в формате YCbCr содержит массив выборок яркости со значениями (Y) выборок яркости и два массива выборок цветности со значениями (Cb и Cr) цветности. Изображения в формате RGB могут быть преобразованы или преобразованы в формат YCbCr и наоборот. Этот процесс также известен как преобразование цвета или преобразование. Если изображение является монохромным, оно может содержать только массив выборок яркости. Соответственно, изображение может быть, например, массивом выборок яркости в монохромном формате или массивом выборок яркости и двумя соответствующими массивами выборок цветности в цветовом формате 4:2:0, 4:2:2 и 4:4:4.

Варианты осуществления видеокодера 20 могут содержать блок разделения изображения (не показан на Фиг. 2), выполненный с возможностью разделения изображения 17 на множество (обычно не перекрывающихся) блоков 203 изображения. Эти блоки также могут называться корневыми блоками, макроблоками (H.264/AVC) или блоками дерева кодирования (CTB) или единицами дерева кодирования (CTU) (согласно H.265/HEVC и VVC). Блок разделения изображения может быть выполнен с возможностью использования одного и того же размера блока для всех изображений в видеопоследовательности и соответствующей сетки, определяющей размер блока, или изменения размера блока между изображениями или подмножествами или группами изображений и разделения каждого изображения на соответствующие блоки.

В дополнительных вариантах осуществления видеокодер может быть выполнен с возможностью приема непосредственно блока 203 изображения 17, например одного, нескольких или всех блоков, формирующих изображение 17. Блок 203 изображения также может именоваться текущим блоком изображения или блоком изображения, подлежащим кодированию.

Подобно изображению 17, блок 203 изображения является или может рассматриваться как двумерный массив или матрица выборок со значениями интенсивности (значениями выборок), хотя и меньшего размера, чем изображение 17. Другими словами, блок 203 может содержать, например, один массив выборок (например, массив яркости в случае монохромного изображения 17 или массив яркости или цветности в случае цветного изображения) или три массива выборок (например, яркость и два массива цветности в случае цветного изображения 17) или любое другое число и/или вид массивов в зависимости от применяемого цветового формата. Количество выборок в горизонтальном и вертикальном направлении (или по оси) блока 203 определяет размер блока 203. Соответственно, блок может, например, содержать массив выборок M × N (M-столбец на N-строк) или массив M × N коэффициентов преобразования.

Варианты осуществления видеокодера 20, показанные на Фиг. 2, могут быть выполнены с возможностью кодирования изображения 17 блок за блоком, например кодирование и предсказание выполняется для каждого блока 203.

Варианты осуществления видеокодера 20, как показано на фиг.2, могут быть дополнительно выполнены с возможностью разбиения и/или кодирования изображения с использованием сегментов (также называемых видеосегментами), при этом изображение может быть разделено или кодировано с использованием одного или более сегментов (обычно без перекрытия), и каждый сегмент может содержать один или более блоков (например, CTU) или одну или более групп блоков (например, клетки (tile) (H.265/HEVC и VVC) или фрагменты (VVC)).

Варианты осуществления видеокодера 20, показанные на фиг.2, могут быть дополнительно выполнены с возможностью разделения и/или кодирования изображения с использованием групп слайсов/мозаичных элементов (также называемых группами мозаичных изображений) и/или мозаичных элементов (также называемых мозаиками видео). ), в котором изображение может быть разделено на или закодировано с использованием одной или нескольких групп слайсов/мозаичных элементов (обычно не перекрывающихся), и каждая группа слайсов/мозаичных элементов может содержать один или несколько блоков (например, CTU) или один или несколько мозаичных элементов, при этом каждый тайл может иметь прямоугольную форму и может содержать один или несколько блоков (например, CTU), например полные или дробные блоки.

Вычисление остатка

Блок 204 вычисления остатка может быть выполнен с возможностью вычисления остаточного блока 205 (также именуемого остатком 205) на основе блока 203 изображения и блока 265 предсказания (дополнительные подробности о блоке 265 предсказания приведены ниже), например, путем вычитания значений выборок блока 265 предсказания из значений выборок блока 203 изображения, выборка за выборкой (пиксель за пикселем), чтобы получить остаточный блок 205 в области выборок.

Преобразование

Блок 206 обработки преобразования может быть выполнен с возможностью применения преобразования, такого как дискретное косинусное преобразование (DCT) или дискретное синусоидальное преобразование (DST), к значениям выборок остаточного блока 205 для получения коэффициентов 207 преобразования в области преобразования. Коэффициенты 207 преобразования могут также именоваться остаточными коэффициентами преобразования и представлять остаточный блок 205 в области преобразования.

Блок 206 обработки преобразования может быть выполнен с возможностью применения целочисленных аппроксимаций DCT/DST, таких как преобразования, определенные для H.265/HEVC. По сравнению с ортогональным преобразованием DCT такие целочисленные аппроксимации обычно масштабируются с определенным коэффициентом. Чтобы сохранить норму остаточного блока, который обрабатывается прямым и обратным преобразованиями, дополнительные коэффициенты масштабирования применяются как часть процесса преобразования. Коэффициенты масштабирования обычно выбираются на основе определенных ограничений, например коэффициенты масштабирования представляют собой степень двойки для операций сдвига, битовая глубина коэффициентов преобразования, компромисс между точностью и затратами на реализацию и т. д. Конкретные коэффициенты масштабирования, например, задаются для обратного преобразования, например блоком 212 обработки обратного преобразования (и соответствующим обратным преобразованием, например блоком 312 обработки обратного преобразования в видеодекодере 30), и соответствующие коэффициенты масштабирования для прямого преобразования, например блоком 206 обработки преобразования, могут быть заданы надлежащим образом в кодере 20.

Варианты осуществления видеокодера 20 (соответственно, блока 206 обработки преобразования) могут быть выполнены с возможностью вывода параметров преобразования, например типа преобразования или преобразований, например, непосредственно или закодированы или сжаты через блок 270 энтропийного кодирования, так что, например, видеодекодер 30 может принимать и использовать параметры преобразования для декодирования.

Квантование

Блок 208 квантования может быть выполнен с возможностью квантования коэффициентов 207 преобразования для получения квантованных коэффициентов 209, например путем применения скалярного квантования или векторного квантования. Квантованные коэффициенты 209 также могут упоминаться как квантованные коэффициенты 209 преобразования или квантованные остаточные коэффициенты 209.

Процесс квантования может уменьшить битовую глубину, связанную с некоторыми или всеми коэффициентами 207 преобразования. Например, n-битный коэффициент преобразования может быть округлен до m-битного коэффициента преобразования во время квантования, где n больше m. Степень квантования может быть изменена посредством регулировки параметра квантования (QP). Например, для скалярного квантования могут применяться различные масштабирования для достижения более тонкого или более грубого квантования. Меньшие размеры шагов квантования соответствуют более тонкому квантованию, тогда как большие размеры шагов квантования соответствуют более грубому квантованию. Применимый размер шага квантования может быть указан параметром квантования (QP). Параметр квантования может, например, быть индексом заранее определенного набора применимых размеров шага квантования. Например, небольшие параметры квантования могут соответствовать тонкому квантованию (небольшим размерам шагов квантования), а большие параметры квантования могут соответствовать грубому квантованию (большим размерам шагов квантования) или наоборот. Квантование может включать в себя деление на размер шага квантования, а соответствующее и/или обратное деквантование, например, блоком 210 обратного квантования, может включать в себя умножение на размер шага квантования. Варианты осуществления в соответствии с некоторыми стандартами, например HEVC, могут быть выполнены с возможностью использования параметра квантования для определения размера шага квантования. Как правило, размер шага квантования может быть вычислен на основе параметра квантования с использованием аппроксимации фиксированной точки уравнения, включающего в себя деление. Дополнительные коэффициенты масштабирования могут быть введены для квантования и деквантования, чтобы восстановить норму остаточного блока, которая могла быть изменена из-за масштабирования, используемого в аппроксимации фиксированной точки упомянутого уравнения для размера шага квантования и параметра квантования. В одной примерной реализации масштабирование обратного преобразования и деквантование могут быть объединены. В качестве альтернативы настроенные таблицы квантования могут использоваться и сигнализироваться от кодера к декодеру, например в битовом потоке. Квантование является операцией с потерями, при которой потери возрастают с увеличением размеров шагов квантования.

Варианты осуществления видеокодера 20 (соответственно, блока 208 квантования) могут быть выполнены с возможностью вывода параметров квантования (QP), например, напрямую или закодированных через блок 270 энтропийного кодирования, так что, например, видеодекодер 30 может принимать и применять параметры квантования для декодирования.

Обратное квантование

Блок 210 обратного квантования выполнен с возможностью применения обратного квантования блока 208 квантования к квантованным коэффициентам для получения деквантованных коэффициентов 211, например путем применения обратной схемы квантования относительно таковой, применяемой блоком 208 квантования, на основе или с использованием того же размера шага квантования, что и блок 208 квантования. Деквантованные коэффициенты 211 также могут упоминаться как деквантованные остаточные коэффициенты 211 и соответствовать - хотя они обычно не идентичны коэффициентам преобразования из-за потери при квантовании - коэффициентам 207 преобразования.

Обратное преобразование

Блок 212 обработки обратного преобразования выполнен с возможностью применения обратного преобразования относительно преобразования, применяемого блоком 206 обработки преобразования, например обратного дискретного косинусного преобразования (DCT) или обратного дискретного синусного преобразования (DST) или других обратных преобразований для получения восстановленного остаточного блока 213 (или соответствующих деквантованных коэффициентов 213) в области выборок. Восстановленный остаточный блок 213 также может упоминаться как блок 213 преобразования.

Восстановление

Блок 214 восстановления (например, блок сложения или сумматор 214) выполнен с возможностью сложения блока 213 преобразования (т. е. восстановленного остаточного блока 213) с блоком 265 предсказания, чтобы получить восстановленный блок 215 в области выборок, например посредством сложения - выборка за выборкой - значений выборок восстановленного остаточного блока 213 и значений выборок блока 265 предсказания.

Фильтрация

Блок 220 контурного фильтра (или сокращенно "контурный фильтр" 220) выполнен с возможностью фильтрации восстановленного блока 215, чтобы получить отфильтрованный блок 221, или, в общем, для фильтрации восстановленных выборок для получения отфильтрованных выборок. Блок контурного фильтра может быть выполнен с возможностью сглаживания переходов пикселей или иного улучшения качества видео. Блок 220 контурного фильтра может содержать один или несколько контурных фильтров, таких как фильтр деблокирования, фильтр с адаптивным к выборке смещением (SAO) или один или несколько других фильтров, таких как адаптивный контурный фильтр (ALF), фильтр подавления шума. (NSF) или любое их сочетание. В одном примере, блок 220 контурного фильтра может содержать деблокирующий фильтр, SAO-фильтр и ALF-фильтр. Порядок процесса фильтрации может быть фильтром удаления блочности, SAO и ALF. В другом примере добавляется процесс, называемый преобразованием яркости с масштабированием цветности (LMCS) (а именно, адаптивным внутриконтурным преобразователем). Этот процесс выполняется перед снятием блокировки. В другом примере процесс фильтрации удаления блочности может также применяться к внутренним краям субблока, например, аффинным краям субблока, краю субблока ATMVP, краям преобразования субблока (SBT) и краям внутреннего субблока (ISP). Хотя блок 220 контурного фильтра показан на фиг. 2 как внутриконтурный фильтр, в других конфигурациях блок 220 контурного фильтра может быть реализован как пост-контурный фильтр. Отфильтрованный блок 221 также может называться отфильтрованным восстановленным блоком 221.

Варианты осуществления видеокодера 20 (соответственно, блока 220 контурного фильтра) могут быть выполнены с возможностью вывода параметров контурного фильтра (таких как параметры фильтра SAO или параметры фильтра ALF или параметры LMCS), например, напрямую или закодированные с помощью блока 270 энтропийного кодирования, так что, например, декодер 30 может принимать и применять одни и те же параметры контурного фильтра или соответствующие контурные фильтры для декодирования.

Буфер декодированных изображений

Буфер 230 декодированных изображений (DPB) может быть памятью, в которой хранятся опорные изображения или, в общем, данные опорных изображений для кодирования видеоданных посредством видеокодера 20. DPB 230 может быть сформирован любым из множества запоминающих устройств, таких как динамическая память с произвольным доступом (DRAM), в том числе синхронная DRAM (SDRAM), магниторезистивная RAM (MRAM), резистивная RAM (RRAM) или запоминающие устройства других типов. Буфер 230 (DPB) декодированных изображений может быть выполнен с возможностью сохранения одного или более отфильтрованных блоков 221. Буфер 230 декодированных изображений может быть дополнительно выполнен с возможностью сохранения других ранее отфильтрованных блоков, например ранее восстановленных и отфильтрованных блоков 221, того же самого текущего изображения или разных изображений, например ранее восстановленных изображений, и может предоставлять полные ранее восстановленные, т.е. декодированные, изображения (и соответствующие опорные блоки и выборки) и/или частично восстановленное текущее изображение (и соответствующие опорные блоки и выборки), например, для межкадрового предсказания. Буфер декодированных изображений (DPB) 230 также может быть выполнен с возможностью хранения одного или нескольких нефильтрованных восстановленных блоков 215 или, в общем, нефильтрованных восстановленных выборок, например, если восстановленный блок 215 не фильтруется блоком 220 контурного фильтра, или любой другой дополнительно обработанной версии восстановленных блоков или выборок.

Выбор режима (разделение и предсказание)

Блок 260 выбора режима содержит блок 262 разделения, блок 244 межкадрового предсказания и блок 254 внутрикадрового предсказания и выполнен с возможностью приема или получения исходных данных изображения, таких как исходный блок 203 (текущий блок 203 текущего изображения 17), и данные восстановленного изображения, такие как отфильтрованные и/или нефильтрованные восстановленные выборки или блоки одного и того же (текущего) изображения и/или из одного или множества ранее декодированных изображений, например, из буфера 230 декодированных изображений или других буферов (например, строкового буфера, не показано). Данные восстановленного изображения используются в качестве данных опорного изображения для предсказания, например межкадрового предсказания или внутрикадрового предсказания, чтобы получить блок 265 предсказания или предиктор 265.

Блок 260 выбора режима может быть выполнен с возможностью определения или выбора разделения для текущего режима предсказания блока (включая отсутствие разделения) и режима предсказания (например, режима внутреннего или межкадрового предсказания) и формирования соответствующего блока 265 предсказания, который используется для вычисления остаточного блока 205 и для восстановления восстановленного блока 215.

Варианты осуществления блока 260 выбора режима могут быть выполнены с возможностью выбора разделения и режима предсказания (например, из тех, которые поддерживаются блоком 260 выбора режима или доступны для него), которые обеспечивают наилучшее совпадение или, другими словами, минимальный остаток (минимальный остаток означает лучшее сжатие для передачи или хранения), или минимальные накладные расходы на сигнализацию (минимальные накладные расходы на сигнализацию означают лучшее сжатие для передачи или хранения), или который учитывает или балансирует оба фактора. Блок 260 выбора режима может быть выполнен с возможностью определения режима разделения и предсказания на основе оптимизации скорость/искажение (RDO), то есть выбора режима предсказания, который обеспечивает минимальное искажение при определенной скорости. Такие термины, как "лучший", "минимальный", "оптимальный" и т. д. в этом контексте не обязательно относятся к всеобъемлющему "лучшему", "минимуму", "оптимальному" и т.д., но также могут относиться к выполнению критерия выбора или прекращения, например когда значение превышает или падает ниже порогового значения, или других ограничений, потенциально ведущих к "субоптимальному выбору", но уменьшающих сложность и время обработки.

Другими словами, блок 262 разделения может быть выполнен с возможностью разделения изображения из видеопоследовательности на последовательность единиц дерева кодирования (CTU), а CTU 203 может быть дополнительно разделена на более мелкие блочные разделы или подблоки (которые снова образуют блоки), например, итеративно с использованием разбиения квадродеревом (QT), разбиения двоичным деревом (BT), разбиения на троичным деревом (TT) или любой их комбинации, и для выполнения предсказания для каждого из блочных разделов или подблоков, при этом выбор режима включает выбор древовидной структуры разделенного блока 203, и режимы предсказания применяются к каждому из разделов или подблоков блока.

Далее более подробно поясняется разделение (например, блоком 262 разделения) и обработка предсказания (блоком 244 межкадрового предсказания и блоком 254 внутрикадрового предсказания), выполняемые примерным видеокодером 20.

Разбиение

Блок 262 разделения может быть выполнен с возможностью разделения изображения из видеопоследовательности на последовательность единиц дерева кодирования (CTU), а блок 262 разделения может разбивать (или разделять) единицу 203 дерева кодирования (CTU) на меньшие разделы, например блоки меньшего размера квадратного или прямоугольного размера. Для изображения, которое имеет три массива выборок, CTU включает в себя блок N × N выборок яркости вместе с двумя соответствующими блоками выборок цветности. Максимально допустимый размер блока яркости в CTU определен как 128×128 в текущей спецификации универсального кодирования видео (VVC), но в будущем может быть указано значение, отличное от 128×128, например 256×256. CTU изображения могут быть сгруппированы/сгруппированы как фрагменты/группы фрагментов, фрагменты или блоки. Плитка покрывает прямоугольную область изображения, и она может быть разделена на один или несколько кирпичей. Кирпич состоит из ряда рядов CTU внутри плитки. Плитку, не разделенную на несколько кирпичей, можно назвать кирпичом. Однако кирпич - это истинное подмножество плитки и не называется плиткой. В VVC поддерживаются два режима групп фрагментов, а именно режим среза/группы фрагментов растрового сканирования и режим прямоугольного фрагмента. В режиме группы мозаичных фрагментов с растровым сканированием группа фрагментов/фрагментов содержит последовательность фрагментов при растровом сканировании изображения. В режиме прямоугольного фрагмента фрагмент содержит несколько блоков изображения, которые вместе образуют прямоугольную область изображения. Кирпичи внутри прямоугольного фрагмента находятся в порядке растрового сканирования фрагмента.

Меньшие блоки (которые также могут называться субблоками) могут быть дополнительно разделены на еще меньшие разделы. Это также называется разделением дерева или иерархическим разделением дерева, в котором корневой блок, например, на уровне корневого дерева 0 (уровень иерархии 0, глубина 0), может быть рекурсивно разделен, например разделен на два или более блоков следующий более низкий уровень дерева, например узлы на уровне дерева 1 (уровень иерархии 1, глубина 1), при этом эти блоки могут быть снова разделены на два или более блоков следующего более низкого уровня, например, уровень дерева 2 (иерархия - уровень 2, глубина 2) и т.д. до тех пор, пока разделение не будет завершено, например, потому что критерий завершения выполняется, например, достигнута максимальная глубина дерева или минимальный размер блока. Блоки, которые далее не разделяются, также называются листовыми блоками или листовыми узлами дерева. Дерево, использующее разделение на два раздела, называется двоичным деревом (BT), дерево, использующее разделение на три раздела, называется троичным деревом (TT), а дерево, использующее разделение на четыре раздела, называется квадродеревом (QT).

Например, единица дерева кодирования (CTU) может быть или содержать CTB выборок яркости и два соответствующих CTB выборок цветности изображения, которое имеет три массива выборок, или CTB выборок монохромного изображения или изображения, которое кодируется с использованием трех отдельных цветовых плоскостей и синтаксических структур, используемых для кодирования выборок. Соответственно, блок дерева кодирования (CTB) может быть N×N блоком выборок для некоторого значения N, так что деление компоненты на CTB является разделением. Единица кодирования (CU) может быть или содержать блок кодирования выборок яркости и два соответствующих блока кодирования выборок цветности изображения, которое имеет три массива выборок, или блок кодирования выборок монохромного изображения или изображения, которое кодируется с использованием три отдельные цветовые плоскости и синтаксические структуры, используемые для кодирования выборок. Соответственно, блок кодирования (CB) может быть M×N блоком выборок для некоторых значений M и N, так что деление CTB на блоки кодирования является разделением.

В некоторых вариантах осуществления, например, согласно HEVC, единица дерева кодирования (CTU) может быть разделена на CU с использованием структуры квадродеревьев, обозначенной как дерево кодирования. Решение о том, кодировать ли область изображения с использованием межкадрового (временного) или внутрикадрового (пространственного) предсказания, принимается на уровне конечных CU. Каждая листовая CU может быть дополнительно разделена на один, два или четыре PU в соответствии с типом разделения PU. Внутри одного PU применяется один и тот же процесс предсказания, а релевантная информация передается в декодер на основе PU. После получения остаточного блока путем применения процесса предсказания на основе типа разделения PU листовая CU может быть разделена на блоки преобразования (TU) в соответствии с другой структурой квадродеревьев, аналогичной дереву кодирования для CU.

В вариантах осуществления, например, в соответствии с последним разрабатываемым в настоящее время стандартом видеокодирования, который называется универсальным кодированием видео (VVC), объединенное вложенное многотиповое дерево Quad-tree с использованием структуры сегментации двоичного и троичного разбиения, например, используется для разделения единицы дерева кодирования. В структуре дерева кодирования внутри единицы дерева кодирования CU может иметь квадратную или прямоугольную форму. Например, единица дерева кодирования (CTU) сначала разделяется четвертичным деревом. Затем листовые узлы четвертичного дерева могут быть дополнительно разделены с помощью многотипной древовидной структуры. В многотипной древовидной структуре есть четыре типа разделения: вертикальное двоичное разделение (SPLIT_BT_VER), горизонтальное двоичное разделение (SPLIT_BT_HOR), вертикальное тройное разделение (SPLIT_TT_VER) и горизонтальное тройное разделение (SPLIT_TT_HOR). Листовые узлы многотипного дерева называются единицами кодирования (CU), и, если CU не слишком велика для максимальной длины преобразования, эта сегментация используется для предсказания и обработки преобразования без какого-либо дальнейшего разделения. Это означает, что в большинстве случаев CU, блоки предсказания (PU) и блоки преобразования (TU) имеют одинаковый размер блока в квадродереве с вложенной структурой блока кодирования дерева нескольких типов. Исключение возникает, когда максимальная поддерживаемая длина преобразования меньше ширины или высоты цветового компонента CU.