Область техники, к которой относится изобретение

Предмет изобретения, раскрытый здесь, относится, в общем, к технологиям для детектирования видеокопий или копий изображений.

Уровень техники

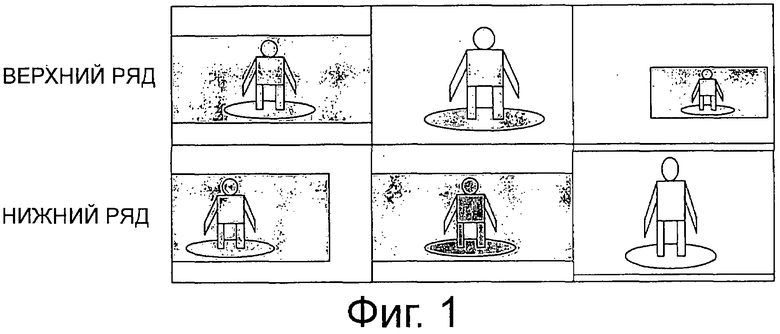

По мере расширения доступности Интернет и персональных видеоданных детектирование видеокопий становится активной областью исследований в области управлении авторским правом, корпоративных, интеллектуальных ресурсов и мониторинга рекламы. Копии видеоданных представляют собой сегмент видеоданных, полученный из других видеоданных, обычно путем различных преобразований, таких как добавление, удаление и модификация, путем сдвига, обрезки, изменения яркости, контраста, записи на камеру (например, изменение отношения ширины/высоты между 16:9 и 4:3) и/или повторной записи. На фиг.1 показаны некоторые примеры видеокопий. В частности, на фиг.1 представлены в верхнем ряду слева направо: первоначальное видеоизображение, версия с уменьшенным/увеличенным масштабом изображения, и обрезанное видеоизображение, и в нижнем ряду слева направо: видеоизображение со сдвигом, контрастное видеоизображение и видеоизображение, записанное на камеру, и повторно кодированное видеоизображение. Повторное кодирование может включать в себя кодирование видеоизображения с использованием другого кодека или другого качества сжатия. Поскольку эти преобразования изменяют аспекты пространственной временной шкалы видеоизображения, детектирование видеокопии становится очень сложной задачей при управлении авторским правом и поиске видеоизображения/изображения.

Существующие работы по детектированию видеокопии могут быть разделены по категориям, основанным на способах кадра и способах клипа. В подходах, основанных на кадре, предполагается, что набор ключевых кадров представляет собой компактное представление видеосодержания. В технологии, описанной в публикации Р.Duygulu, M. Chen, и A. Hauptmann, "Comparison and Combination of Two Novel Commercial Detection Methods," Proc. CIVR'04, (July 2004), набор визуальных свойств (цвет, кромку и свойства масштабированного инвариантного преобразования (SIFT)) выделяют из этих ключевых кадров. Для детектирования клипа видеокопии технология определяет степень схожести видеосегментов с этими ключевыми кадрами. Подходы на основе кадра являются простыми и эффективными, но не достаточно точными, поскольку они теряют пространственно-временную информацию объекта (например, траекторию движения). Кроме того, трудно составить унифицированную схему выбора ключевого кадра для сопоставления двух видеосегментов.

Способы на основе клипа пытаются характеризовать пространственно-временные особенности по последовательности кадров. Технология, описанная в J. Yuan, L. Duan, Q. Tian, и С. Xu, "Fast and Robust Short Video Clip Search Using an Index Structure," Proc. ACM MIR'04 (2004), представляет собой подход, в котором обычную гистограмму структуры и гистограмму распределения кумулятивных цветов выделяют для характеризации пространственно-временной структуры видеоизображения. Хотя в этом подходе используют временную информацию видеокадров, глобальная особенность гистограммы цветов не позволяет детектировать видеокопии с локальными преобразованиями, полученные например, путем вырезания, сдвига и записи на камеру.

В технологии, описанной в публикации J. Law-To, О. Buisson, V. Gouet-Brunet, Nozha Boujemaa, "Robust Voting Algorithm Based on Labels of Behavior for Video Copy Detection," International Conference on Multimedia (2006), пытаются использовать асимметричную технологию для сопоставления особых точек в тестировании видеоизображения с пространственно-временными траекториями точек, представляющих интерес, в базе данных видеоизображения. Такой подход позволяет детектировать множество преобразований видеокопий, таких как сдвиг, яркость и контраст. Однако при этом не дискриминируют ни элемент точки Харриса, ни инвариант масштаба, и его пространственно-временная регистрация не может детектировать соответствующее преобразование масштаба, например, увеличение/уменьшение масштаба изображения и запись на камеру.

Краткое описание чертежей

Варианты осуществления настоящего изобретения представлены в качестве примера, а не для ограничения, на чертежах,на которых одинаковыми номерами ссылочных позиций обозначены аналогичные элементы.

На фиг.1 показаны некоторые примеры видеокопий.

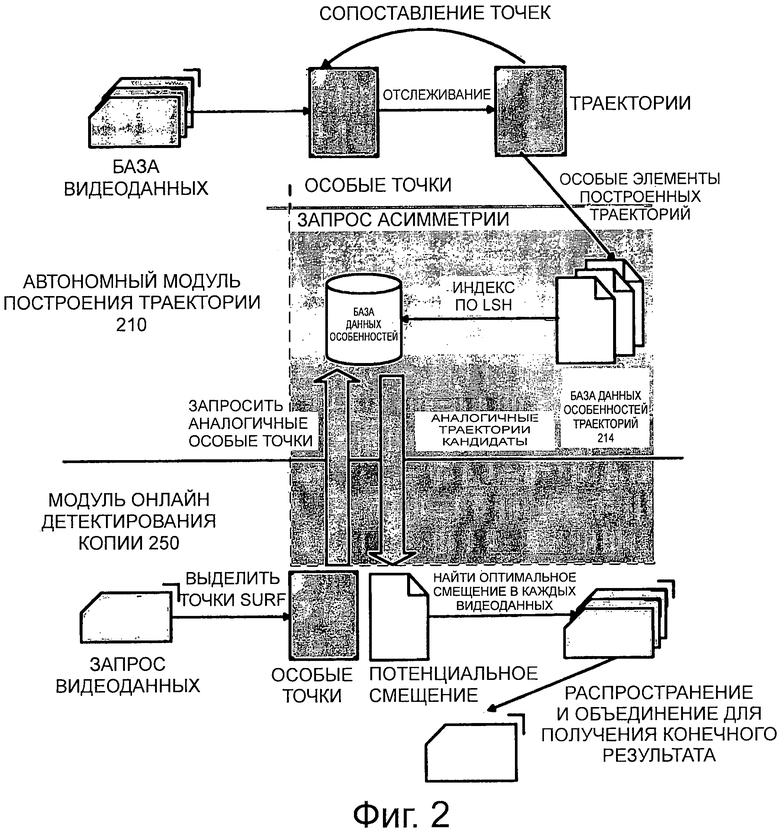

На фиг.2 показана система детектирования видеокопии в соответствии с вариантом осуществления.

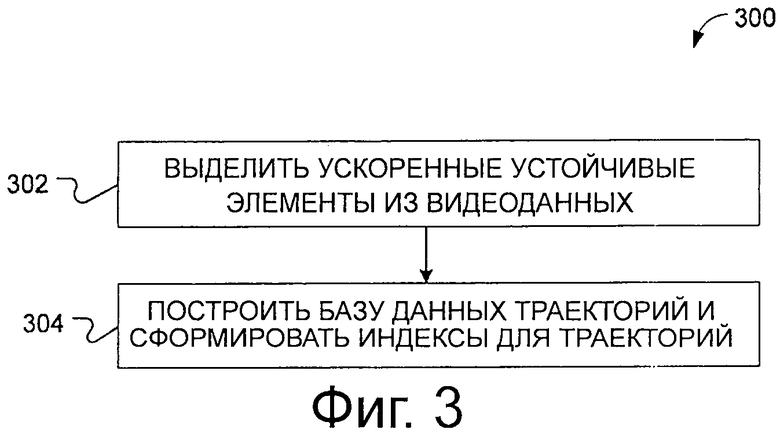

На фиг.3 представлен примерный способ формирования базы данных особых точек и траекторий, в соответствии с вариантом осуществления.

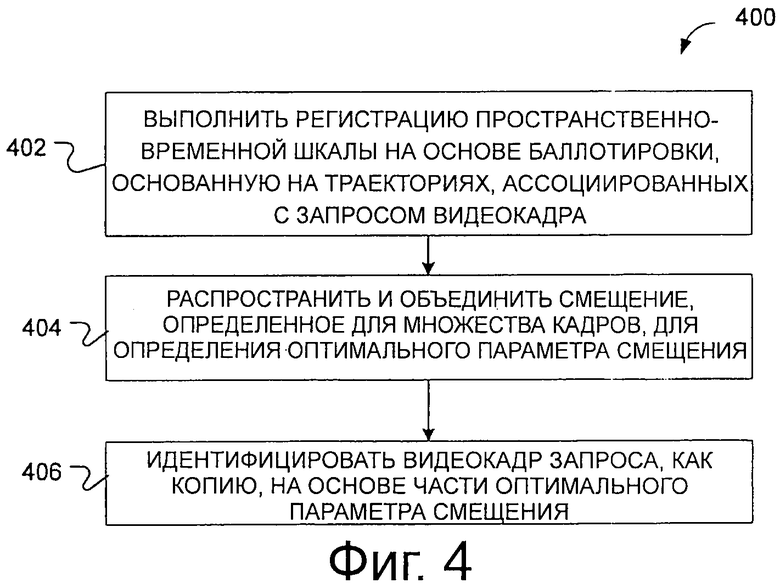

На фиг.4 представлен примерный способ определения копирования видеоданных в соответствии с вариантом осуществления.

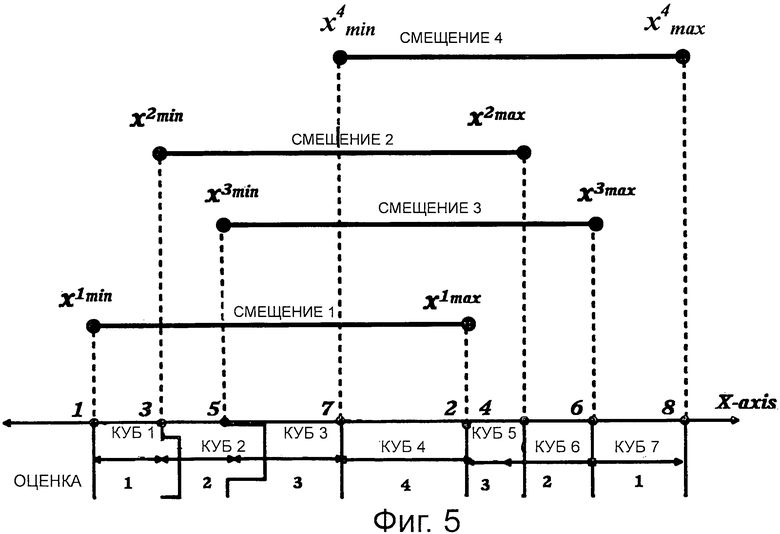

На фиг.5 показан пример для баллотировки оптимального смещения в случае одномерного бина в соответствии с вариантом осуществления.

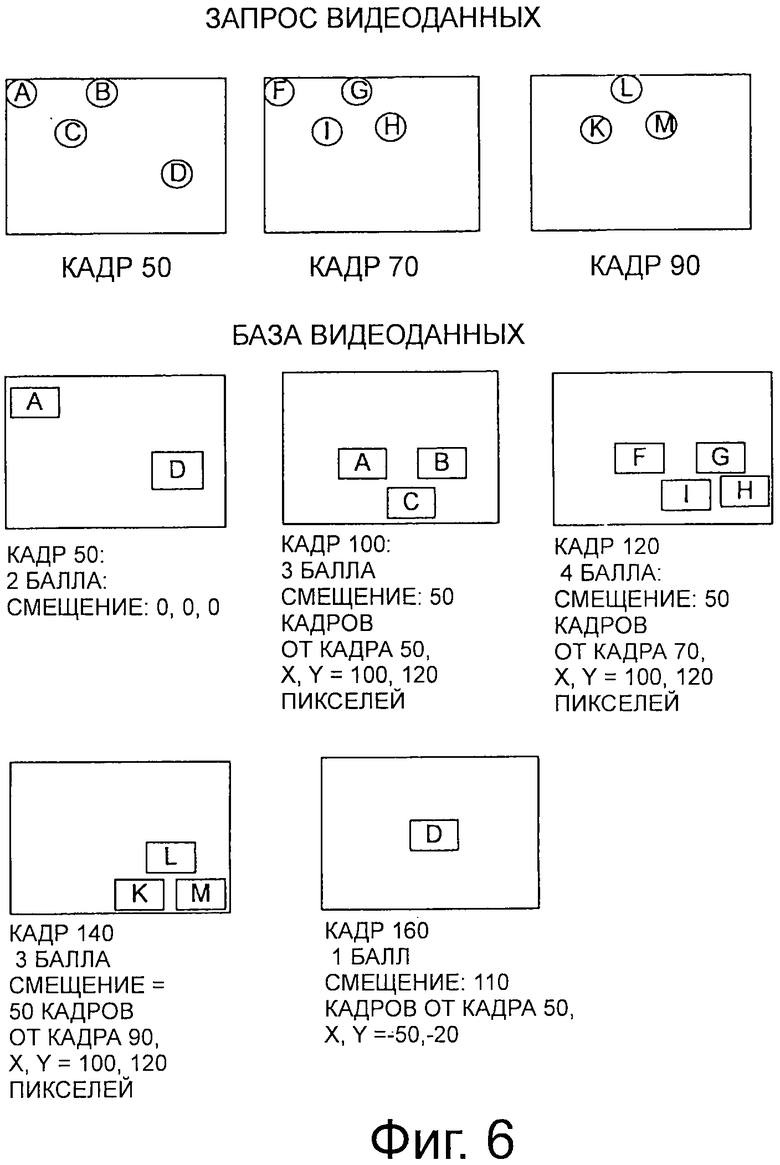

На фиг.6 представлен пример детектирования локальных особенностей от нескольких видеокадров запроса в соответствии с вариантом осуществления.

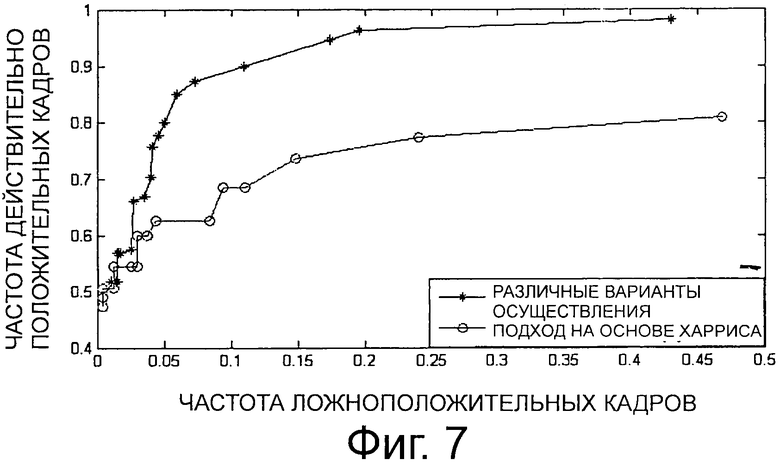

На фиг.7 представлены кривые характеристики операции приема (ROC), которые описывают производительность системы.

Подробное описание изобретения

Ссылка в данном описании на "один вариант осуществления" или "вариант осуществления" означает, что определенное свойство, структура или характеристика, описанная в связи с вариантом осуществления, включена, по меньшей мере, в один вариант осуществления настоящего изобретения. Таким образом, появление фразы "в одном варианте осуществления" или "в варианте осуществления" в различных местах данного описания не обязательно все относятся к одному и тому же варианту осуществления. Кроме того, определенные свойства, структуры или характеристики могут быть скомбинированы в одном или больше вариантах осуществления.

Различные варианты осуществления обеспечивают подход для детектирования видеокопии на основе построения траектории ускоренных устойчивых элементов (SURF), локально чувствительного индексирования хеш-функции (LSH) и регистрации пространственно-временного масштаба на основе баллотировки.

Ускоренные устойчивые элементы (SURF) характеризуют элементы траектории точек, представляющих интерес при детектировании видеокопий. Различные варианты осуществления работают намного лучше, чем подход на основе свойств Харриса, описанный в статье Law-To. Когда частота ложноположительных кадров составляет 10%, частота достоверно положительных кадров в соответствии с подходом Харриса составляет 68%, в то время как различные варианты осуществления могут достигать частоты 90% действительно положительных кадров. Элемент SURF является более дискриминирующим, чем элементы свойств точки Харриса, и выполняют лучшие преобразования, соответствующие масштабу, например, при увеличении/уменьшении масштаба изображения и записи на камеру, по сравнению с результатами, полученными в статье Law-To. Кроме того, выделение элементов SURF выполняется приблизительно в шесть раз быстрее, чем SIFT, но обеспечивает аналогичную скорость, как и при подходе элемента точки Харриса.

Использование локального чувствительного индексирования хеш-функции (LSH) предусматривает быстрый запрос траекторий кандидатов при детектировании видеокопии. В статье Law-To описано использование поиска сходства вероятности, вместо индексирования LSH.

Используя регистрацию пространственно-временной шкалы и распространения и слияния параметров смещения, детектируют соответствующие видеосегменты с максимально накопленной оценкой регистрации. Подход по статье Law-To не позволяет хорошо детектировать преобразования шкалы. Путем использования такой регистрации на основе баллотировки в дискретном пространстве параметров смещения различные варианты осуществления позволяют детектировать как пространственно-временные преобразования, так и преобразования масштаба, например обрезку, увеличение/уменьшение масштаба изображения, шкалу и запись на камеру.

На фиг.2 иллюстрируется система детектирования видеокопии в соответствии с вариантом осуществления. Система детектирования видеокопии включает в себя автономно работающий модуль 210 построения траектории и работающий в режиме онлайн модуль 250 детектирования копии. Любая компьютерная система с процессором и запоминающим устройством, которая соединена с возможностью обмена данными с сетью через кабельные или беспроводные способы соединения, может быть выполнена с возможностью выполнения операций автономно работающего модуля 210 построения траекторий и работающего в режиме онлайн модуля 250 детектирования копии. Например, видеоизображение запроса может быть передано через сеть в компьютерную систему. Например, компьютерная система может выполнять обмен данными, используя технологии в соответствии с версией IEEE 802.3, 802.11 или 802.16, используя кабель или одну или больше антенн. Компьютерная система может отображать видеоизображение, используя устройство дисплея.

Автономно работающий модуль 210 построения траектории выделяет точки SURF из каждого кадра базы видеоданных и сохраняет эти точки SURF в базе 212 данных особенностей. Автономно работающий модуль 210 построения траектории строит базу 214 данных особенностей траекторий, которая включает в себя траектории точек, представляющих интерес. Автономный модуль 210 построения траектории использует LSH для индексации особых точек в базе 212 данных особенностей с траекториями в базе 214 данных особенностей траекторий.

Работающий в режиме онлайн модуль 250 детектирования копии выделяет точки SURF из кадров выборки видеоизображения запроса. Работающий в режиме онлайн модуль 250 детектирования копии запрашивает в базе 212 данных особенностей точки, выделенные SURF для идентификации траекторий-кандидатов с аналогичными локальными особенностями. Траектории-кандидаты из базы 214 данных особенностей траекторий, которые соответствуют аналогичным точкам особенностей, идентифицируют, используя LSH.

Для каждой точки особенностей из запрашиваемых видеоданных, работающий в режиме онлайн модуль 250 детектирования копии использует подход регистрации пространственно-временной шкалы на основе баллотировки для оценки оптимального параметра преобразования пространственно-временной шкалы (то есть смещения) между точками SURF в запрашиваемых видеоданных и траекториях-кандидатах в базе 214 данных особенностей траекторий. Работающий в режиме онлайн модуль 250 детектирования копии распространяет сопоставленные сегменты видеоданных, как в пространственно-временном направлении, так и в направлении масштаба для идентификации видеокопии. Баллотирование представляет собой накопление в пространстве регистрации пространственно-временной шкалы оценок точек, представляющих интерес. Пространство регистрации пространственно-временной шкалы разделяют на кубы, соответствующие сдвигу по x, y, t и параметрам шкалы. Заданные x, y, t и параметры шкалы, количество точек, представляющих интерес, найденных в каждом кубе, подсчитывают как баллы. Куб с наибольшим количеством баллотированных точек, представляющих интерес, рассматривают как копию. Пример подхода регистрации пространственно-временной шкалы на основе баллотировки описан со ссылкой на фиг.6.

Например, для запрашиваемых видеоданных Q, М=100 точек SURF выделяют через каждые Р=20 кадров. Для каждой точки m SURF на выбранном кадре k запрашиваемых видеоданных Q, LSH используют для поиска N=20 ближайших траекторий, в качестве траекторий-кандидатов, в траектории между базой 214 данных особенностей траекторий. На практике M, Р и N можно регулировать как компромисс между скоростью запроса и точностью детектирования копии в режиме онлайн. Каждая из n траекторий кандидатов описана как Rmn=[Id, Tran, Simmn], где Id представляет собой идентификатор видеоданных в базе данных 214 особенностей траекторий, Tran представляет собой элемент траектории, и Simmn представляет степень схожести между точкой SURF в (xm, ym) и особенностью Smean траектории-кандидата.

В соответствии с ассоциированным Id видеоизображения, траектории-кандидаты разделяют на категории по разным поднаборам

Существует множество видов преобразований при детектировании видеокопии. Если видеоданные Q запроса копируют из того же источника, что и видеоданные R в базе данных, будет существовать "постоянное смещение пространственно-временной шкалы" между точками SURF, такими как Q и R. Поэтому в различных вариантах осуществления цель детектирования видеокопии состоит в том, чтобы найти видеосегмент R в базе данных, который имеет приблизительно неизменное смещение с Q.

На фиг.3 представлен примерный процесс для формирования базы данных особых точек и траекторий в соответствии с вариантом осуществления. В некоторых вариантах осуществления автономный модуль 210 построения траектории может выполнять процесс 300. Блок 302 включает в себя выделение ускоренных устойчивых элементов (SURF) из видеоданных. Пример SURF описан в публикации Н. Bay, Т. Tuytelaars, L. Gool, "SURF: Speeded Up Robust Features," ECCV, May, 2006. В различных вариантах осуществления выделенные элементы представляют собой локальные особенности в кадре.

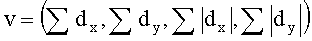

В различных вариантах осуществления, в каждой точке, представляющей интерес, область разделяют равномерно на меньшего размера квадратные подобласти размером 3 на 3. Вейвлет-отклики dx и dy Xaapa суммируют по каждой подобласти, и каждая подобласть имеет четырехмерный вектор дескриптора

SURF основан на оценке гессиановой матрицы для построения детектора на основе гессиановой матрицы. В SURF используются интегральные изображения для ускорения времени расчета. Скорость выделения SURF составляет приблизительно в шесть раз выше, чем у SIFT, и предусматривает скорость, аналогичную преобразованию Харриса. Элемент SURF является устойчивым для преобразований видеокопирования, таких как увеличение/уменьшение масштаба изображения и запись на камеру.

Существует множество свойств, используемых при формировании компьютерных изображений и представлении изображений, включающих в себя глобальные особенности, такие как гистограмма цветов, порядковые элементы и локальные особенности, например Харрис и SIFT. Для детектирования видеокопии глобальные свойства, такие как свойства гистограммы цветов во всем кадре изображения, нельзя использовать для детектирования локальных преобразований, например обрезки и преобразования шкалы. В различных вариантах осуществления выделяют локальные особенности из видеоданных, поскольку локальные особенности не меняются при сдвиге, обрезке или изменении масштаба изображения.

Блок 304 включает в себя построение базы данных траекторий и формирование индексов для траекторий в базе видеоданных. После выделения точек SURF в каждом кадре базы видеоданных эти точки SURF отслеживают для построения траекторий, в качестве пространственно-временных особенностей видеоданных. Каждая траектория

Представлена Tran=[xmin, xmax, ymin, ymax, tin, tout, Smean], n=1,2, … N, where [xmin, xmax, ymin, ymax, tin, tout] представляет куб пространственно-временного ограничения, и Smean представляет собой среднее значение элементов SURF на траекторию.

Для быстро движущихся точек в направлениях x, y куб траектории будет слишком большим для дискриминации пространственного положения траектории от других. Поэтому, в различных вариантах осуществления эти траектории разделяют на несколько сегментов с коротким временем, что делает куб траектории достаточно малым в пространственном положении, из-за его короткого времени длительности.

Для быстрого детектирования видеокопии в режиме онлайн используют локально чувствительное хеширование (LSH) для индексации траекторий по их особенностям Smean. Например, запрос особенности Smean может быть подан в траектории индекса. Используя LSH, минимальное изменение пространства особенности приводит к пропорциональному изменению значения хэш-функции, то есть хеш-функция является локально чувствительной. В различных вариантах осуществления используют точное Евклидово LSH (E2LSH) для индексации траектории. E2LSH описано, например, в публикации А. Andoni, P. Indyk, E2LSH0.1 User manual, June 2000.

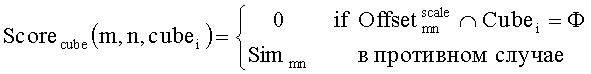

На фиг.4 представлен пример обработки 400 для определения видеокопирования, в соответствии с вариантом осуществления. В некоторых вариантах осуществления, модуль 250 детектирования копии в режиме онлайн может выполнять процесс 400. Блок 402 включает в себя выполнение регистрации пространственно-временной шкалы на основе баллотировки, которая основана на траекториях, ассоциированных с видеокадром запроса. Регистрация пространственно-временной шкалы на основе баллотировки адаптивно разделяет пространство смещения пространственно-временной шкалы на 3-D кубы с разными шкалами и оценками степени схожести Simmn на соответствующие кубы. Адаптивное разделение включает в себя изменение размеров куба. Каждый куб соответствует возможному параметру пространственно-временного смещения. Для запроса кадра k куб с максимально накопленной оценкой (то есть куб с наибольшим количеством зарегистрированных траекторий в точках, представляющих интерес, в кадре k запроса) соответствует его оптимальному параметру смещения.

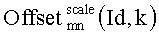

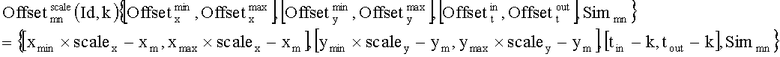

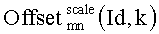

Поскольку куб связывания траектории Tran-кандидат представляет собой данные, оценка которых была произведена по интервалу, параметры пространственно-временной шкалы Offset (Id, k) также оценивают по интервалу. В случае, когда параметр шкалы scale=[scalex, scaley],

Например, scalex=scaley∈[0,6, 0,8, 1,0, 1,2, 1,4], для детектирования общего преобразования шкалы, такого как, например, при увеличении/уменьшении масштаба изображения. Могут использоваться другие показатели шкалы. Поскольку преобразование при записи на видеокамеру имеет другие параметры шкалы scalex≠scaley, параметры шкалы x, y устанавливают как [scalex=0,9, scaley=1,1] и [scalex=1,1, scaley=0,9].

Существуют тысячи потенциальных значений смещений

В некоторых вариантах осуществления ось Х адаптивно разделена на множество одномерных бинов с разными размерами, всеми начальными точками

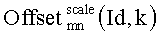

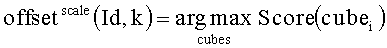

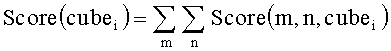

На основе этих кубов оптимальный параметр пространственно-временной регистрации Offsetscale (Id, k) между видеоданными Id и кадром k запроса максимизируют накопленное значение сравнимых оценок (m, n, cube) запроса, как в следующем уравнении:

где

Блок 404 включает в себя распространение и слияние смещений, определенных из множества кадров, для определения оптимального параметра смещения. Описание со ссылкой на фиг.6 представляет пример распространения и слияния смещений, для определения оптимального параметра смещения. После определения параметра Offsetscale(Id, k) пространственно-временной шкалы в разных шкалах выполняют распространение и слияние этих параметров Offsetscale(Id, k) для получения конечного детектирования видеокопирования.

После расширения куба в пространственных направлениях кубы смещения Offset (Id, k) дополнительно распространяют в направлении времени и в направлении шкалы. Поиск осуществляется в [Offsetscale(Id, k-3). Offsetscale(Id, k+3)] для семи выбранных кадров, для накопления пространственного пересечения, и поиск происходит в [scale-0,2, scale+0,2] для трех шкал, для получения надежных результатов, соответствующих разным шкалам. Затем находят оптимальное значение смещения Offset(Id, k), которое имеет максимальное накопленное значение оценки в кубах пересечения этих 3*7 или 21 смещениях. Такой этап распространения сглаживает зазоры между смещениями и удаляет скачкообразные/ошибочные смещения одновременно.

Однако из-за случайных возмущений реальное смещение регистрации может быть расположено в соседних кубах для оценки оптимального значения смещения. Кроме того, траектории, не содержащие движение, вводят определенное смещение для оценки смещения, в связи с тем что интервалы

Блок 406 включает в себя идентификацию видеокадра запроса, в качестве видеокопии, на основе частично оптимального смещения. Идентифицированная видеокопия представляет собой последовательность видеокадров из базы данных с локальными особенностями траектории SURF, которые являются аналогичными кадрам в запросе, и каждый из видеокадров из базы данных имеет смещение (t, x, y), аналогичное запрашиваемым видеоданным. Кроме того, может быть предусмотрено смещение по времени, которое идентифицируют временные сегменты видеоданных, которые могли быть потенциально скопированы.

Различные варианты осуществления позволяют детектировать копии неподвижных изображений. Для детектирования копии изображения отсутствует информация траектории и информация движения во временном направлении и, соответственно, не выполняют учет временного смещения. Однако пространственное значение x, y и значение шкалы учитывают аналогично детектированию видеокопии. Например, для детектирования копии изображения, выделяют точки, представляющие интерес SURF, и индексируют их. Подход на основе баллотировки, описанный в отношении детектирования видеокопии, может использоваться для поиска оптимального смещения (x, y, scale) для детектирования копии изображения.

На фиг.5 иллюстрируется простой пример для оценки оптимального смещения в случае одномерного бина, в соответствии с вариантом осуществления. Ось Х адаптивно разделена на семь бинов (кубов) для четырех потенциальных значений смещения. В этом примере диапазон оси Х представляет собой x1min и x4max. В этом примере каждый куб представляет собой диапазон смещений x. Например, куб 1 представляет первый бин, который охватывает значения смещения от x1min до x2min. Бины для других смещений представляют собой смещение по времени и по у (не показаны).

В этом примере, если предположить, что Sinimn каждого потенциального смещения равен единице, наилучшее смещение представляет собой cube4 [x4min, x1max], и максимальная оценка равна четырем. Путем сравнения этих оптимальных значений смещения Offsetscale(Id, k) в разных масштабах получают оценку оптимального параметра Offset (Id, k) регистрации пространственно-временной шкалы с максимальной оценкой по всем шкалам.

На фиг.6 представлен пример детектирования локальных особенностей из нескольких видеокадров запроса, в соответствии с вариантом осуществления. Круги в видеокадрах запроса представляют точки, представляющие интерес. Прямоугольники в кадрах базы данных видеоданных представляют кубы ограничения в измерениях (t, x, y). Куб по фиг.5 представляет одно измерение (то есть, t, x или y). Для оценки параметров преобразования шкалы применяют пространственно-временную регистрацию в 3-D (x, y, t) пространстве оценки для каждого дискретного значения шкалы по отдельности (scalex=scaley∈[0,6, 0,8, 1,0, 1,2, 1,4]), и результаты детектирования комбинируют.

В этом примере выполняют определение, появляются ли локальные особенности из кадров запроса в моменты времени 50, 70 и 90 в кадрах в базы видеоданных. Кадр запроса в момент времени 50 включает в себя локальная особенность A-D. Кадр в момент времени 50 из базы видеоданных включает в себя локальные особенности А и D. В соответствии с этим, две оценки (то есть по одной оценке для каждой локальной особенности) присваивают для кадра 50 из базы видеоданных. Смещение (t, x, y)=(0, 0, 0), поскольку локальные особенности А и D появляются в одно и то же время и, по существу, в аналогичных положениях.

Кадр запроса в момент времени 70 включает в себя локальные особенности F-I. Кадр в момент времени 120 из базы видеоданных включает в себя локальные особенности F-I. В соответствии с этим, четыре балла присваивают кадру 120 из базы видеоданных. Смещение (t, х, y) представляет собой (50 кадров, 100 пикселей, 120 пикселей), поскольку локальные особенности F-I появляются через 50 кадров позже и сдвинуты вниз и вправо.

Кадр запроса в момент времени 90 включает в себя локальные особенности К-М. Кадр в момент времени 140 из базы видеоданных включает в себя локальные особенности К-М. В соответствии с этим, три балла прикрепляют к кадру 140 из базы видеоданных. Смещение (t, х, y) представляет собой (50 кадров, 100 пикселей, 120 пикселей), поскольку локальные особенности К-М появляются через 50 кадров позже и сдвинуты вниз и вправо.

Кадр запроса в момент времени 50 включает в себя локальную особенность D. Кадр в момент времени 160 из базы видеоданных включает в себя локальную особенность D. В соответствии с этим, один балл присваивают кадру 160 из базы видеоданных. Смещение (t, х, y) представляет собой (110 кадров, -50 пикселей, -20 пикселей), поскольку локальная особенность D появляется через 110 кадров позже и со сдвигом вверх и влево.

Кадры 100, 120 и 140 из базы видеоданных имеют аналогичное смещение (t, х, y). Другими словами, со ссылкой на схему, показанную на фиг.5, смещения от кадров 100, 120 и 140 попадают в пределы того же куба. Оптимальное смещение представляет собой смещение, ассоциированное с множеством кадров.

Для оценки характеристик различных вариантов осуществления были проведены всесторонние эксперименты для 200 часов видеоданных MPEG-1, полученных случайным образом из INA (французский Institut National de 1'Audiovisuel) и набора видеоданных TRECVID2007. Базу видеоданных разделили на две части: опорную базу данных и неопорную базу данных. Опорная база данных содержала 70 часов 100 наборов видеоданных. Неопорная база данных содержала 130 часов 150 наборов видеоданных.

Два эксперимента были выполнены для оценки характеристик системы. Работая на Pentium IV 2.0 ГГц с 1G RAM, опорная база видеоданных имела 1465532 записей траекторий SURF, в автономном режиме, фиксированных по LSH. Работающий в режиме онлайн модуль детектирования видеокопии выделял М=100 SURF точек, самое большее в каждом кадре после выборки запрашиваемых видеоданных. Смещение пространственно-временной шкалы рассчитывали для каждых р=20 кадров. Для каждой точки SURF запроса потребовалось приблизительно 150 мс, для поиска N=20 траекторий-кандидатов с помощью LSH. Стоимость регистрации пространственно-временной шкалы составила приблизительно 130 мс, для оценки оптимального смещения по 7 параметрам шкалы.

В эксперименте 1, характеристики детектирования видеокопии сравнивали для разных преобразований, соответственно, для элемента SURF и элемента Харриса. Двадцать видеоклипов запроса случайным образом выделяли непосредственно из опорной базы данных, и длина каждого видеоклипа составила 1000 кадров. Затем каждый видеоклип преобразовали с использованием разных преобразований для формирования запрашиваемых видеоданных, например аспект сдвига, изменение масштаба изображения.

В Таблице 1 представлено сравнение подхода детектирования видеокопирования для различных преобразований, соответственно, элемента SURF и элемента Харриса.

Из Таблицы 1 можно видеть, что элемент SURF превосходит элемент Харриса приблизительно на 25-50% для преобразований увеличения/уменьшения масштаба изображения и записи на видеокамеру. Кроме того, элемент SURF имеет рабочие характеристики, аналогичные элементам Харриса по преобразованиям сдвига и обрезки. Кроме того, использование элемента SURF позволяет детектировать приблизительно на 21%-27% большее количество скопированных кадров, чем по элементам Харриса.

Для тестирования более сложных данных на практике подход элемента SURF на основе регистрации пространственно-временной шкалы сравнивали с элементом Харриса на основе подхода детектирования видеокопии, описанного в статье J. Law-To. Видеоклипы запроса состоят из 15 преобразованных опорных видеонаборов и 15 неопорных видеонаборов, в сумме до 100 минут (150 000 кадров). Опорные видеоданные преобразовали с помощью разных преобразований с другими параметрами, чем в эксперименте 1.

На фиг.7 представлены кривые характеристики операции приема (ROC), которые описывают рабочие характеристики системы. Можно видеть, что различные варианты осуществления работают намного лучше, чем подход на основе элементов Харриса, описанный в статье J. Law-To. Когда частота ложноположительных кадров равна 10%, частота действительно положительных кадров при подходе Харриса составляет 68%, в то время как способы различных вариантов осуществления позволяют достичь частоты 90% действительно положительных кадров. В отчете, представленном в статье J. Law-To частоты действительно положительных кадров составляют 82%, в то время, как частота ложноположительных кадров составляет 10%. Однако в статье J. Law-To также упомянуто, что преобразование шкалы ограничено в пределах 0,95-1,05. Более высокие характеристики различных вариантов осуществления способствуют получению устойчивого элемента SURF и эффективной регистрации пространственно-временной шкалы. Кроме того, распространение и объединение также являются очень полезными для распространения детектируемых видеоклипов на как можно дольше и для сглаживания/удаления скачкообразных и ошибочных смещений.

Т ехнологии обработки графических изображений и/или видеоизображений, описанные здесь, могут быть воплощены в различных аппаратных архитектурах. Например, функции графических изображений и/или видеоданных могут быть интегрированы в наборе микросхем. В качестве альтернативы, может использоваться отдельный графический процессор и/или видеопроцессор. В еще одном, другом варианте осуществления, графические и/или видеофункции могут быть воплощены с помощью процессора общего назначения, включающего в себя многоядерный процессор. В дополнительном варианте осуществления функции могут быть воплощены в бытовом электронном устройстве.

Варианты осуществления настоящего изобретения могут быть воплощены как любая из или как комбинация из: одной или больше микросхем или интегральных схем, взаимно соединенных с использованием материнской платы, логических схем, воплощенных в виде аппаратного воплощения логических схем, программного обеспечения, сохраненного в запоминающем устройстве, и выполняемого микропроцессором, встроенного программного обеспечения, специализированных интегральных схем (ASIC) и/или программируемой пользователем вентильной матрицы (FPGA). Термин "логический" может включать в себя, в качестве примера, программное обеспечение или аппаратные средства, и/или комбинации программного обеспечения и аппаратных средств.

Варианты осуществления настоящего изобретения могут быть предусмотрены, например, в виде компьютерного программного продукта, который может включать в себя один или больше считываемых устройством носителей информации, на которых сохранены исполняемые устройством инструкции, которые при выполнении их одним или больше устройствами, такими как компьютер, сеть компьютеров или другие электронные устройства, может привести к выполнению одним или больше устройствами операций в соответствии с вариантами осуществления настоящего изобретения. Считываемый устройством носитель информации может включать в себя, но без ограничений, гибкие диски, оптические диски, CD-ROM (постоянные запоминающие устройства на компакт-дисках) и магнитооптические диски, ROM (постоянное запоминающее устройства), RAM (оперативное запоминающее устройство), EPROM (стираемые программируемые постоянные запоминающие устройства), EEPROM (электрически стираемые программируемые постоянные запоминающие устройства), магнитные или оптические карты, запоминающее устройство типа флэш или другие типы носителя информации/ считываемых устройством носителей информации, пригодных для сохранения исполняемых устройством инструкций.

Чертежи и представленное выше описание представляют собой примеры настоящего изобретения. Хотя они описаны здесь как множество отдельных функциональных пунктов, для специалиста в данной области техники будет понятно, что один или больше таких элементов вполне могут быть скомбинированы в единые функциональные элементы. В качестве альтернативы, определенные элементы могут быть разделены на множество функциональных элементов. Элементы из одного варианта осуществления могут быть добавлены в другой вариант осуществления. Например, порядок обработки, описанный здесь, может изменяться и не ограничен представленным здесь описанием. Кроме того, действия, представленные в любой представленной блок-схеме последовательности операций, не обязательно должны быть воплощены в представленном порядке; и при этом не все из этих действий обязательно должны быть выполнены. Кроме того, те действия, которые не зависят от других действий, могут быть выполнены параллельно с другими действиями. Объем настоящего изобретения, однако, ни коим образом не ограничен этими конкретными примерами. При этом возможны различные изменения, представленные явно в описании или нет, такие как различия в конструкции, в размерах и используемых материалах. Объем изобретения имеет, по меньшей мере, такую протяженность, как указано в следующей формуле изобретения.

Изобретение относится к средствам детектирования копий видеоданных. Техническим результатом является повышение точности детектирования копий видеоданных за счет построения траектории представляющих интерес устойчивых точек. В способе выделяют ускоренные надежные элементы (SURF) из опорных видеоданных; сохраняют точки SURF из опорных видеоданных; определяют траектории точек SURF как пространственно-временные особенности опорных видеоданных на основе точки SURF; сохраняют траектории точек SURF и формируют индексы для траекторий точек SURF. 4 н. и 20 з.п. ф-лы, 7 ил., 1 табл.

1. Способ детектирования копий видеоданных, воплощенный в компьютере, содержащий:

выделяют ускоренные надежные элементы (SURF) из опорных видеоданных;

сохраняют точки SURF из опорных видеоданных;

определяют траектории точек SURF как пространственно-временные особенности опорных видеоданных на основе точки SURF;

сохраняют траектории точек SURF; и

формируют индексы для траекторий точек SURF.

2. Способ по п. 1, в котором выделенные SURF содержат локальные особенности опорных видеоданных.

3. Способ по п. 1, в котором при формировании индексов применяют локально чувствительную хеш-функцию (LSH), чтобы определить индекс траекторий с помощью особенностей SURF.

4. Способ по п. 1, дополнительно содержащий:

определяют SURF видеоданных запроса;

определяют смещение, ассоциированное с видеокадрами запроса; и

определяют, содержат ли видеокадры запроса копию видеоклипа, основываясь, частично, на определенном смещении.

5. Способ по п. 4, в котором определение смещения содержит адаптивное разделение пространственно-временного пространства смещения на кубы, в котором каждый куб соответствует возможному пространственно-временному параметру смещения времени, смещению x, или y.

6. Способ по п. 5, в котором определение смещения дополнительно содержит:

определяют траектории опорных видеокадров, ассоциированных с видеокадрами запроса; и

для каждого масштаба пространственно-временного смещения, накапливают множество аналогичных локальных особенностей между видеокадрами запроса и опорными видеокадрами.

7. Способ по п. 4, в котором определение, содержат ли видеокадры запроса копию видеоклипа, содержит:

идентифицируют опорные видеокадры с локальными особенностями, которые аналогичны выделенным SURF из запроса видеоданных, и в котором локальные особенности каждого видеокадра идентифицированных опорных видеокадров имеют аналогичные временные и пространственные смещения от SURF видеоданных запроса.

8. Устройство для детектирования копий видеоданных, содержащее:

базу данных особенностей;

базу данных особенностей траекторий; и

логику построения траектории точек SURF для:

выделения ускоренных устойчивых элементов (SURF) из опорных видеоданных,

сохранения особенностей в базе данных особенностей,

отслеживания точек SURF для формирования траектории пространственно-временных особенностей опорных видеоданных,

сохранения траектории в базе данных особенностей траекторий, и

формирования индексов для базы данных особенностей траекторий.

9. Устройство по п. 8, в котором логика построения траектории точек SURF предназначена для:

приема запроса на получение особенностей запрашиваемых видеоданных, и

предоставления траекторий, ассоциированных с особенностями запрашиваемых видеоданных.

10. Устройство по п. 8, в котором выделенные SURF содержат локальные особенности опорных видеоданных.

11. Устройство по п. 8, в котором для формирования индексов для базы данных особенностей траекторий логика построения траектории точек SURF должна применять локально чувствительную хеш-функцию (LSH) для индексации траектории с помощью особенностей SURF.

12. Устройство по п. 8, дополнительно содержащее:

модуль детектирования копии, предназначенный для:

выделения SURF из запроса видеоданных,

приема траекторий, ассоциированных с особенностями запроса видеоданных из логики построения траектории точек SURF, и

идентификации опорных видеокадров из базы данных особенности, опорные видеокадры, имеющие локальные особенности, которые аналогичны выделенным SURF из видеоданных запроса, и в котором локальные особенности каждого видеокадра идентифицированных опорных видеокадров имеют аналогичные временные и пространственные смещения от SURF из видеоданных запроса.

13. Устройство по п. 12, в котором для идентификации опорных видеокадров модуль детектирования копии выполнен с возможностью:

определять, что смещение ассоциировано с видеокадрами запроса; и

определять, содержат ли видеокадры запроса копию видеоклипа, основываясь, частично, на определенном смещении.

14. Устройство по п. 13, в котором для определения смещения модуль детектирования копии должен адаптивно разделять пространственно-временное пространство смещения на кубы, в котором каждый куб соответствует возможному пространственно-временному параметру смещения времени, смещению x или y.

15. Устройство по п. 14, в котором для определения смещения модуль детектирования копии также выполнен с возможностью:

определять, что траектории опорных видеокадров ассоциированы с видеокадрами запроса; и

для каждого масштаба пространственно-временного смещения накапливать множество аналогичных локальных особенностей между видеокадрами запроса и опорными видеокадрами.

16. Устройство по п. 13, в котором, чтобы определить, содержат ли видеокадры запроса копию видеоклипа, модуль детектирования копии выполнен с возможностью:

идентифицировать опорные видеокадры с локальными особенностями, которые аналогичны выделенным SURF из видеоданных запроса, и в котором локальные особенности каждого видеокадра идентифицированных опорных видеокадров имеют аналогичные временные и пространственные смещения от SURF видеоданных запроса.

17. Система для детектирования копий видеоданных, содержащая:

устройство дисплея и

компьютерную систему, соединенную с возможностью передачи данных с устройством дисплея, и содержащую:

базу данных особенности;

базу данных особенностей траекторий; и

логику построения траектории точек SURF для:

выделения ускоренных устойчивых элементов (SURF) из опорных видеоданных,

сохранения SURF в базе данных особенности,

определения траектории пространственно-временных особенностей опорных видеоданных на основе точек SURF, и

сохранения траектории в базе данных особенности траекторий; и

логику детектирования копии для:

определения, являются ли кадры видеоданных запроса копиями, и

предоставления видеокадров из опорных видеоданных, которые аналогичны кадрам видеоданных запроса.

18. Система по п. 17, в которой выделенные SURF содержат локальные особенности опорных видеоданных.

19. Система по п. 17, в которой логика построения траектории точек SURF должна также формировать индексы для траекторий, ассоциированных с выделенными SURF, нанося локально чувствительную хеш-функцию (LSH), для индексирования траекторий с помощью выделенных SURF.

20. Система по п. 17, в которой, чтобы определить, являются ли кадры видеоданных запроса копиями, логика детектирования копии выполнена с возможностью:

идентифицировать опорные видеокадры с локальными особенностями, которые аналогичны выделенным SURF из видеоданных запроса, и в которой локальные особенности каждого видеокадра идентифицированных опорных видеокадров имеют аналогичные временное и пространственное смещения от SURF видеоданных запроса.

21. Способ детектирования копий видеоданных, содержащий:

извлекают ускоренные устойчивые элементы (SURF) из опорного изображения;

определяют траектории пространственных особенностей опорных видеоданных на основе точек SURF;

сохраняют траектории; и

формируют индексы для сохраненных траекторий.

22. Способ по п. 21, в котором выделенные SURF, содержат локальные особенности опорного изображения.

23. Способ по п. 21, в котором при формировании индексов применяют локально чувствительную хеш-функцию (LSH), для индексирования траектории с помощью особенностей SURF.

24. Способ по п. 21, в котором определение, является ли изображение запроса копией, содержит:

идентифицируют опорные изображения с локальными особенностями, которые аналогичны выделенным SURF из изображения запроса, и в котором локальные особенности каждого идентифицированного опорного изображения имеют аналогичное пространственное смещение от SURF изображения запроса.

| Станок для изготовления деревянных ниточных катушек из цилиндрических, снабженных осевым отверстием, заготовок | 1923 |

|

SU2008A1 |

| CN 101308567 A, 19.11.2008 | |||

| CN 1900970 A, 24.01.2007 | |||

| Печь для непрерывного получения сернистого натрия | 1921 |

|

SU1A1 |

Авторы

Даты

2014-01-27—Публикация

2009-06-26—Подача