УРОВЕНЬ ТЕХНИКИ

Область техники, к которой относится изобретение

Настоящее изобретение относится к устройству съемки изображений, устройству обработки изображений и способу обработки изображений, которые оперируют данными изображения, что дает возможность изменять фокусное расстояние изображения после съемки изображения.

Уровень техники

Среди цифровых камер в последние годы уделено внимание сектору камер, называемых светлопольными камерами. С помощью изображений, снятых этим типом камеры, можно создавать перефокусированное изображение путем изменения фокусного расстояния (плоскость изображения, плоскость перефокусирования) после съемки изображения, и соответственно предполагается возможность выбора различных положений фокуса после съемки изображения и устранения расфокусированных изображений, обусловленные ошибкой пользователя в момент съемки изображения.

Между тем существует функция, называемая отображением предварительного просмотра, которая используется при отображении изображений, снятых цифровой камерой. Это функция для отображения списка уменьшенных изображений, чтобы упростить пользователю поиск намеченного изображения. Однако, хотя изображения, снятые светлопольной камерой, дают возможность поместить фокус куда угодно после съемки изображения, фокус не обязательно помещается на человека или т.п., которого пользователь желает видеть в фокусе в момент съемки изображения. В частности, когда выполняется отображение предварительного просмотра, существуют случаи, например, когда невозможно определить, кто присутствует на изображении, если человек находится не в фокусе, и пользователь испытывает трудность с выбором изображения.

Патентная публикация Японии № 2009-065356 раскрывает способ решения вышеупомянутой проблемы, в котором лицо субъекта нельзя распознать в момент съемки изображения с помощью светлопольной камеры. В этом способе задается настройка для изменения глубины резкости, положение линзы изменяется несколько раз для предварительного съемки изображения, распознавание лиц выполняется на основе результатов предварительного съемки изображения, а затем выполняется съемка изображения.

Однако, хотя патентная публикация Японии № 2009-065356 раскрывает способ выполнения распознавания лиц в момент съемки изображения, отсутствует раскрытие способа для решения вышеупомянутой проблемы в момент воспроизведения изображения.

В связи с вышеупомянутыми проблемами настоящее изобретение обеспечивает устройство съемки изображений, устройство обработки изображений и способ обработки изображений, которые дают возможность простой идентификации субъекта, включенного в данные изображения, которые были сняты светлопольной камерой.

РАСКРЫТИЕ ИЗОБРЕТЕНИЯ

В соответствии с первым аспектом настоящего изобретения предложено устройство съемки изображений, содержащее: формирующую изображение линзу; датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения; множество микролинз, которые размещаются между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заранее установленного количества пикселей; модуль обработки изображений, выполненный с возможностью формирования изображения восстановления в заранее установленной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определения, присутствует ли субъект на изображении восстановления; и модуль записи, выполненный с возможностью записи данных изображения, которые были выведены из датчика изображения, и записи информации о субъекте, присутствие которого было определено с помощью модуля обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

В соответствии со вторым аспектом настоящего изобретения предложено устройство обработки изображений для обработки данных изображения, выведенных из устройства съемки изображений, содержащего формирующую изображение линзу, датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения, и множество микролинз, которые размещаются между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заранее установленного количества пикселей, причем устройство обработки изображений содержит: модуль обработки изображений, выполненный с возможностью формирования изображения восстановления в заранее установленной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определения, присутствует ли субъект на изображении восстановления; и модуль записи, выполненный с возможностью записи данных изображения, которые были выведены из датчика изображения, и записи информации о субъекте, присутствие которого было определено с помощью модуля обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

В соответствии с третьим аспектом настоящего изобретения предложен способ обработки изображений для обработки данных изображения, выведенных из устройства съемки изображений, содержащего формирующую изображение линзу, датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения, и множество микролинз, которые размещаются между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заранее установленного количества пикселей, причем способ обработки изображений содержит: этап обработки изображений, состоящий в формировании изображения восстановления в заранее установленной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определении, присутствует ли субъект на изображении восстановления; и этап записи, состоящий в записи данных изображения, которые были выведены из датчика изображения, и записи информации о субъекте, присутствие которого было определено на этапе обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

Дополнительные признаки настоящего изобретения станут очевидными из нижеследующего описания примерных вариантов осуществления со ссылкой на сопровождающие чертежи.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

Фиг. 1 - блок-схема, показывающая общую конфигурацию устройства съемки изображений в соответствии с вариантами осуществления настоящего изобретения.

Фиг. 2 - схема, иллюстрирующая взаимное расположение пикселей в датчике изображения и массива микролинз в соответствии с вариантами осуществления.

Фиг. 3 - схема, иллюстрирующая взаимное расположение формирующей изображение линзы, пикселей в датчике изображения и массива микролинз в соответствии с вариантами осуществления.

Фиг. 4A и 4B - схемы, иллюстрирующие отношение соответствия между областями зрачка у формирующей изображение линзы и светоприемными пикселями в соответствии с вариантами осуществления.

Фиг. 5 - схема, иллюстрирующая области пропускания у лучей формирования перефокусированного изображения в соответствии с вариантами осуществления.

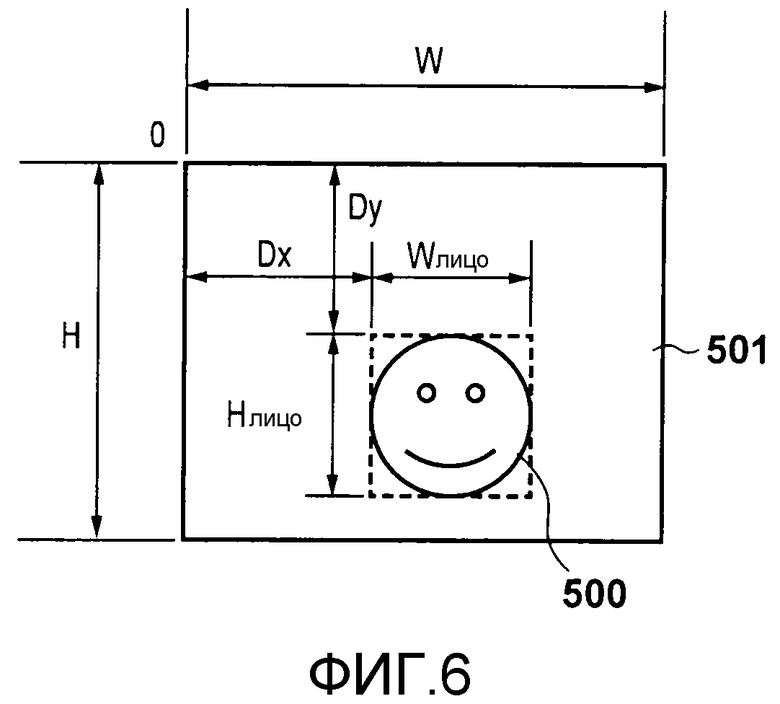

Фиг. 6 - схема, иллюстрирующая информацию о положении лица и информацию об относительном размере лица, служащие в качестве вспомогательной информации, в соответствии с вариантами осуществления.

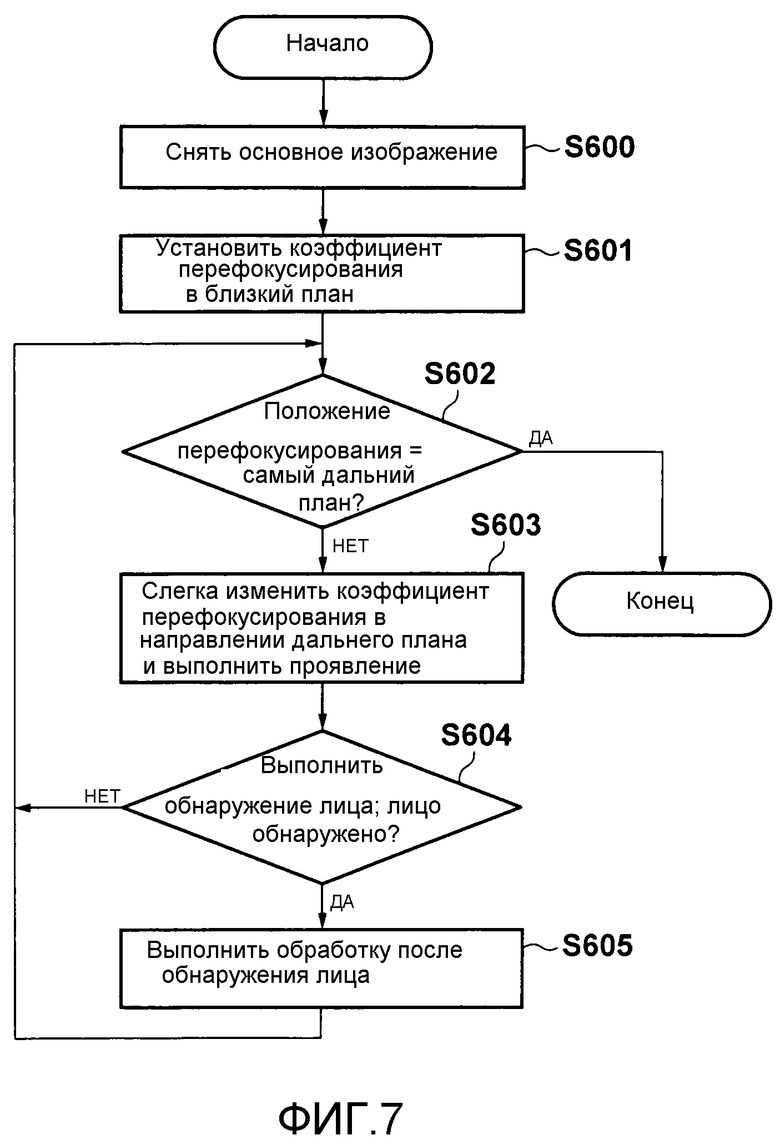

Фиг. 7 - блок-схема алгоритма, показывающая операцию записи, которая выполняется после того, как снято основное изображение, в соответствии с вариантами осуществления.

Фиг. 8 - блок-схема алгоритма, показывающая операцию отображения предварительного просмотра для основного изображения в соответствии с вариантами осуществления.

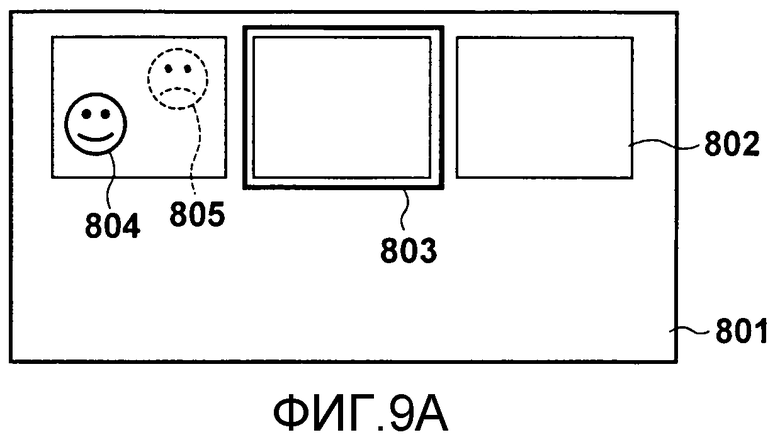

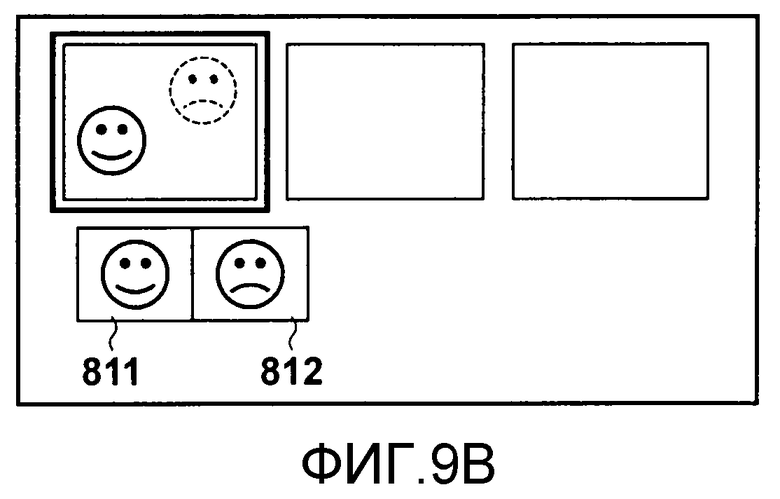

Фиг. 9A - 9D - схемы, показывающие примеры отображений предварительного просмотра в соответствии с вариантами осуществления.

Фиг. 10 - схема, показывающая общую конфигурацию цифровой камеры 1 в соответствии с третьим вариантом осуществления.

Фиг. 11 - схема, иллюстрирующая разделение экрана съемки изображения.

Фиг. 12 - блок-схема алгоритма, показывающая обработку по съемке изображения и обработку по восстановлению в соответствии с третьим вариантом осуществления.

Фиг. 13A - схема, иллюстрирующая изображение видоискателя в случае, когда первый переключатель выключен в режиме съемки изображения.

Фиг. 13B - схема, иллюстрирующая изображение видоискателя в случае, когда первый переключатель включен.

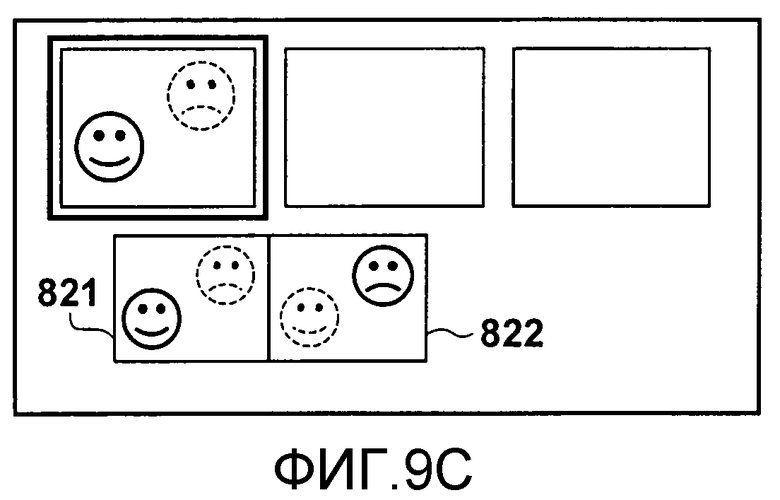

Фиг. 14 - блок-схема алгоритма, показывающая подробности обработки по восстановлению на этапе S110 из фиг. 12.

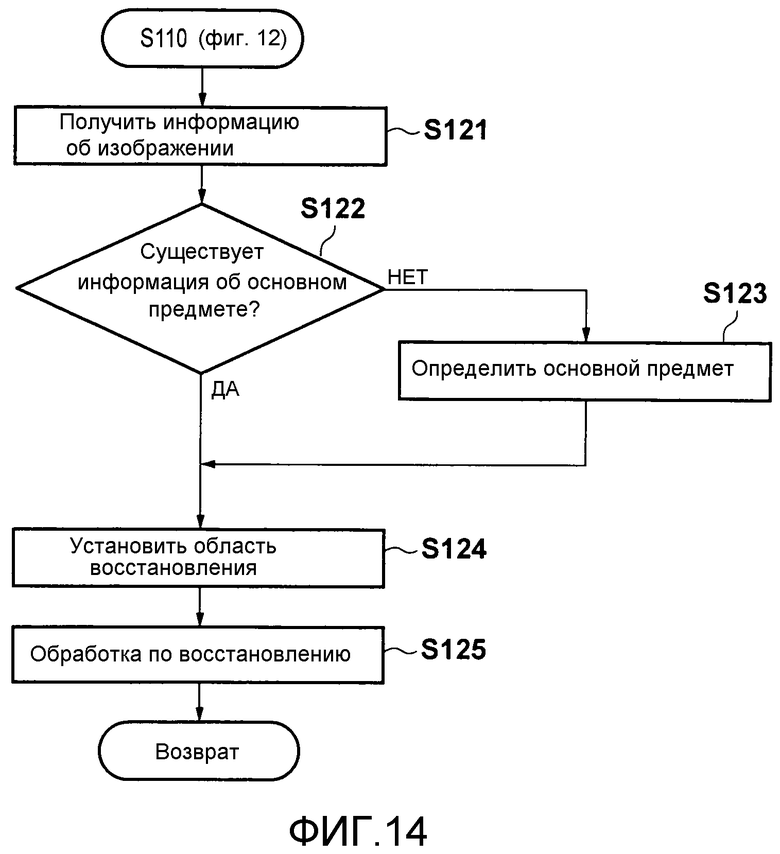

Фиг. 15A - схема, иллюстрирующая изображение, отображенное на модуле 4 отображения в случае, когда первый переключатель выключен в режиме съемки изображения, в соответствии с третьим вариантом осуществления.

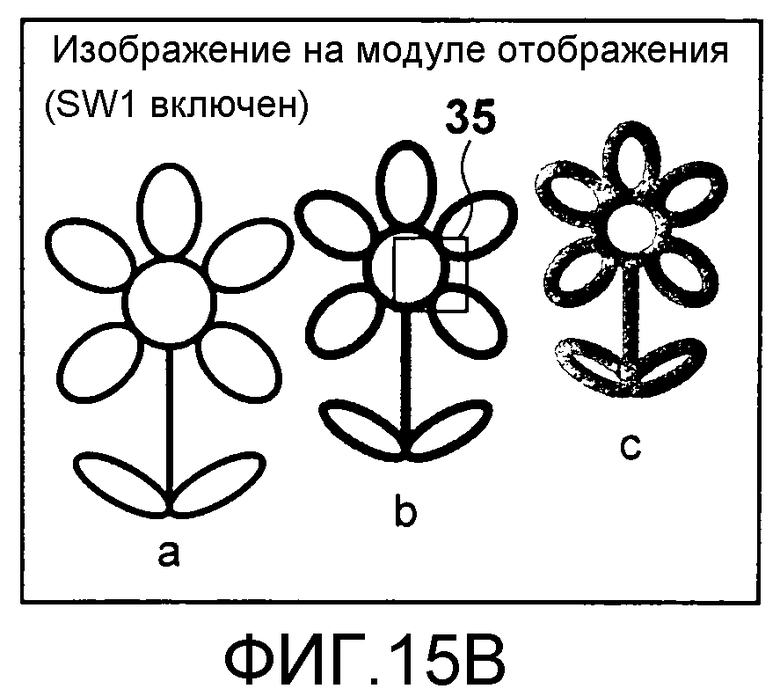

Фиг. 15B - схема, иллюстрирующая изображение, отображенное на модуле 4 отображения в случае, когда первый переключатель включен, в соответствии с третьим вариантом осуществления.

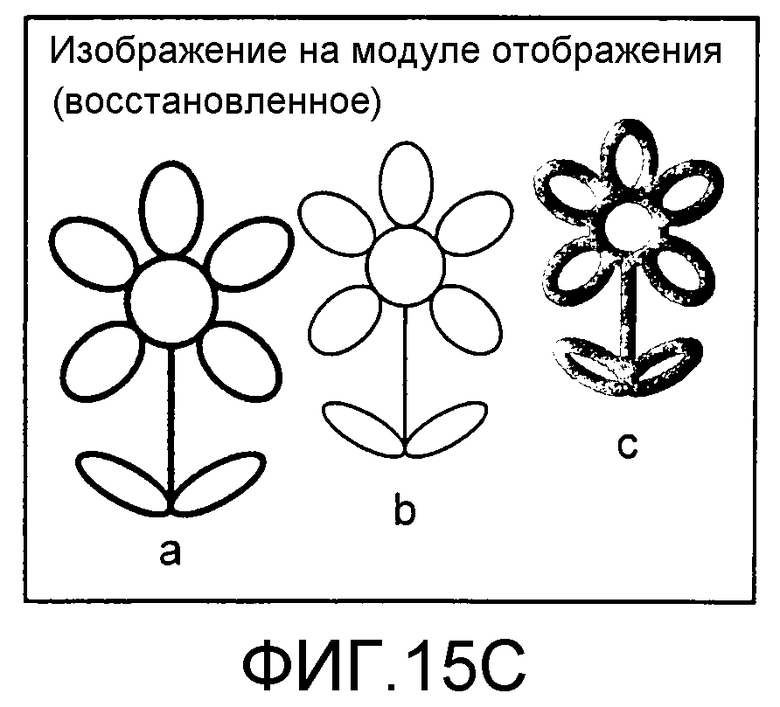

Фиг. 15C - схема, иллюстрирующая восстановленное изображение в соответствии с третьим вариантом осуществления.

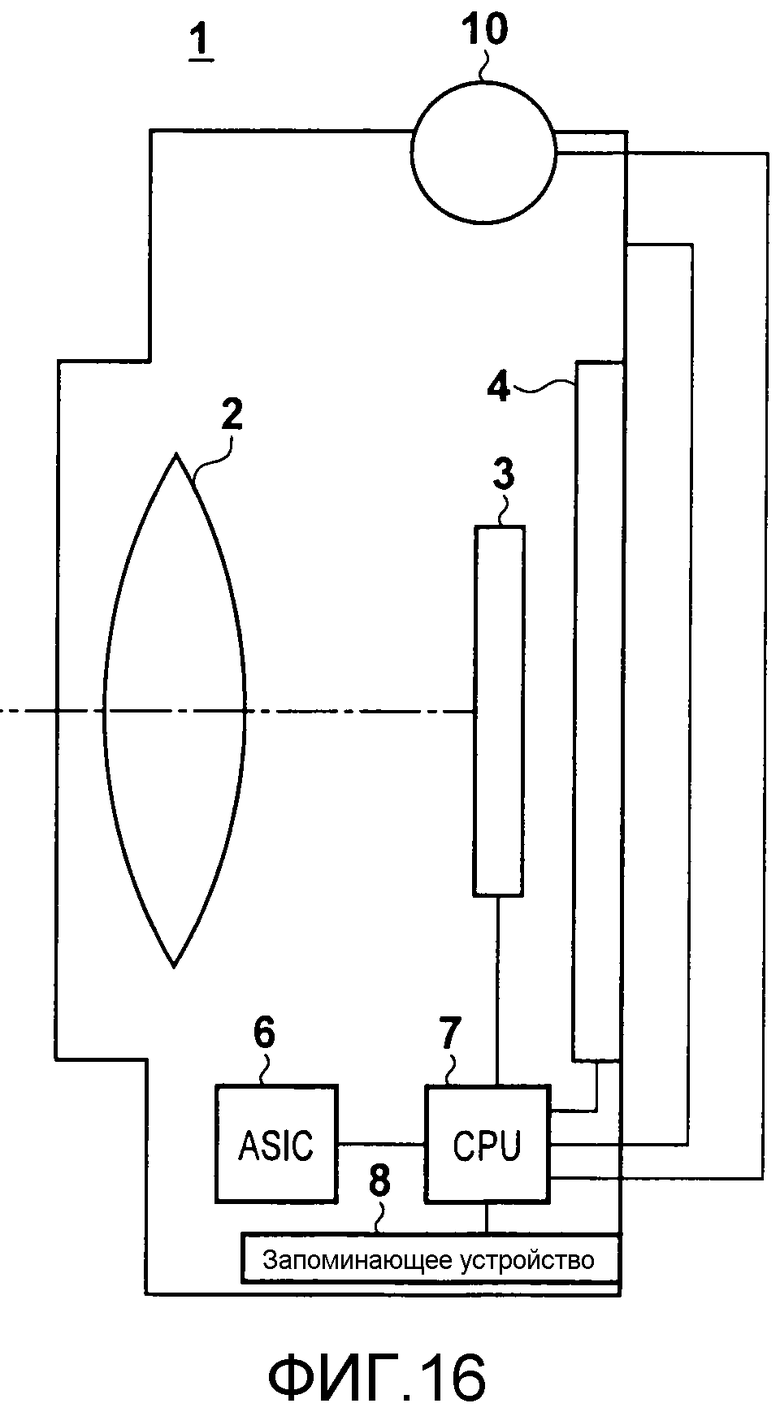

Фиг. 16 - схема, показывающая общую конфигурацию цифровой камеры 1 в соответствии с четвертым вариантом осуществления.

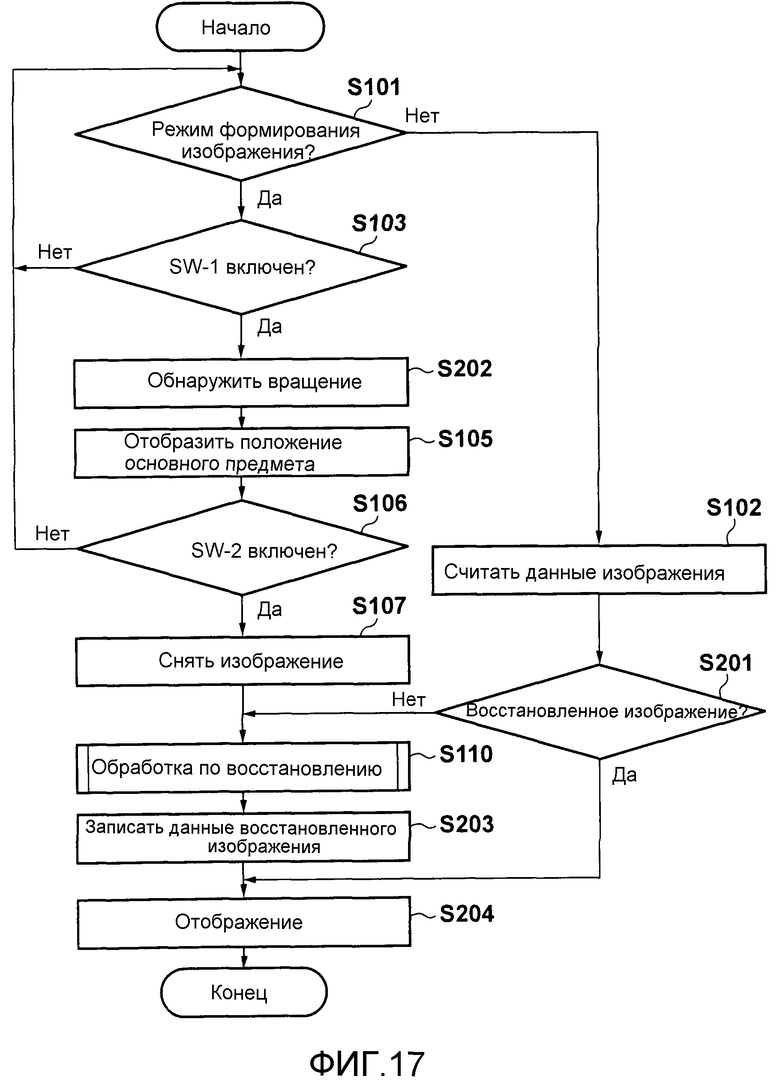

Фиг. 17 - блок-схема алгоритма, показывающая обработку по съемке изображения и обработку по восстановлению в соответствии с четвертым вариантом осуществления.

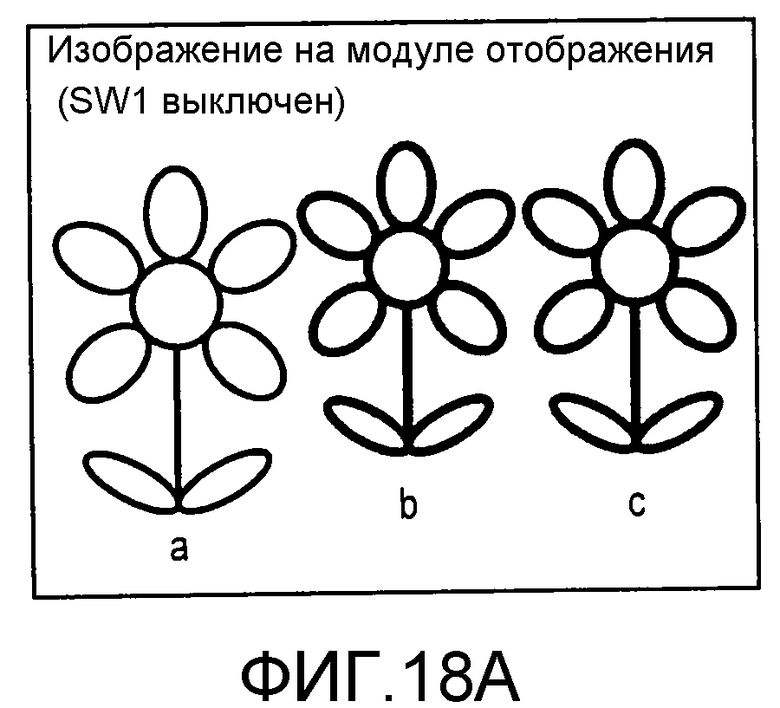

Фиг. 18A - схема, иллюстрирующая изображение, отображенное на модуле 4 отображения в случае, когда первый переключатель выключен в режиме съемки изображения, в соответствии с четвертым вариантом осуществления.

Фиг. 18B - схема, иллюстрирующая изображение, отображенное на модуле 4 отображения в случае, когда первый переключатель включен, в соответствии с четвертым вариантом осуществления.

Фиг. 18C - схема, иллюстрирующая восстановленное изображение в соответствии с четвертым вариантом осуществления.

Фиг. 19 - схема, иллюстрирующая восстановленное изображение в случае, когда основной субъект не был обнаружен, в соответствии с четвертым вариантом осуществления.

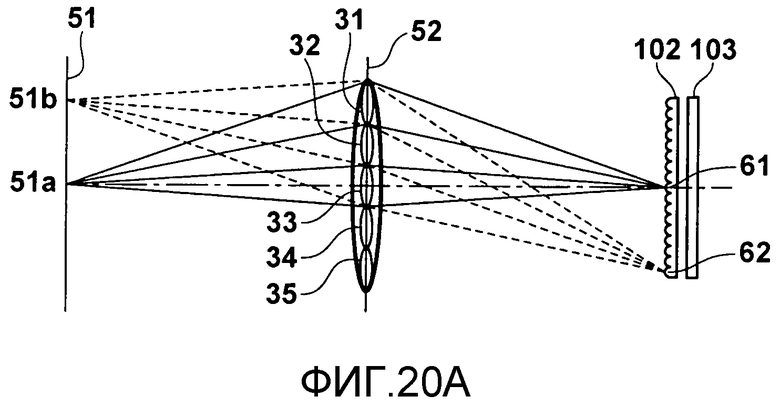

Фиг. 20A - схема, показывающая оптическую систему, к которой может применяться настоящее изобретение.

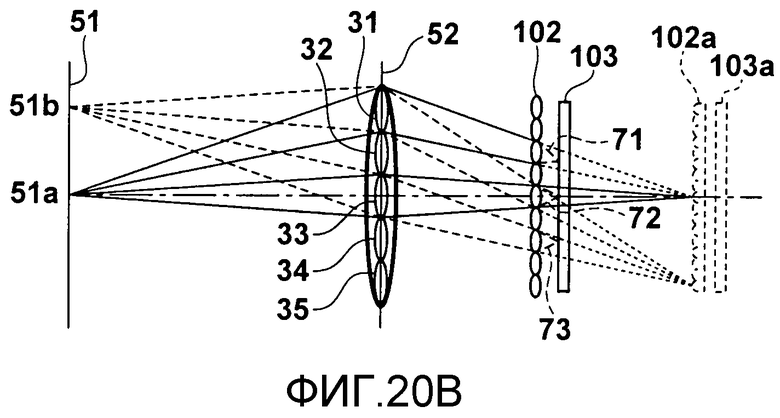

Фиг. 20B - схема, показывающая другую оптическую систему, к которой может применяться настоящее изобретение.

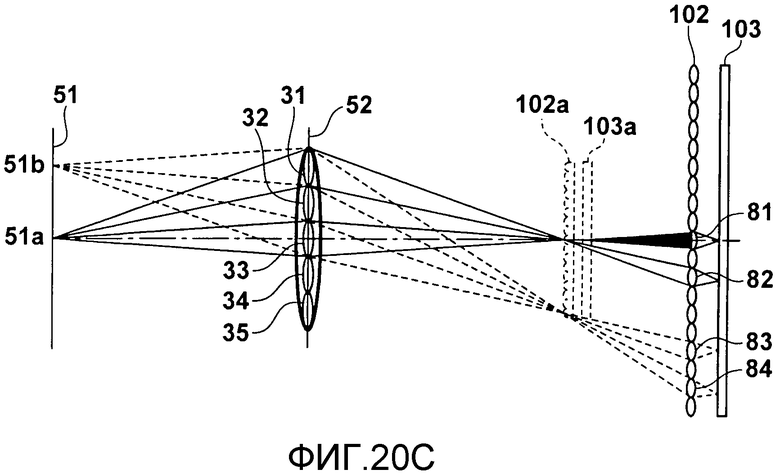

Фиг. 20C - схема, показывающая еще одну оптическую систему, к которой может применяться настоящее изобретение.

ОСУЩЕСТВЛЕНИЕ ИЗОБРЕТЕНИЯ

Нижеследующее является подробным описанием вариантов осуществления для выполнения настоящего изобретения со ссылкой на сопровождающие чертежи.

Первый вариант осуществления

Фиг. 1 - блок-схема, показывающая общую конфигурацию устройства 100 съемки изображений в соответствии с вариантами осуществления настоящего изобретения. В показанной на фиг. 1 конфигурации свет, который прошел через формирующую изображение линзу 101, образует изображение в области положения фокуса формирующей изображение линзы 101. Массив 102 микролинз компонуется несколькими микролинзами 1020, и благодаря расположению в области положения фокуса формирующей изображение линзы 101 массив 102 микролинз функционирует так, что свет, который прошел через разные области зрачка формирующей изображение линзы 101, делится и излучается для каждой области зрачка. Датчик 103 изображения является фотоэлектрическим преобразователем, например датчиком изображения на CMOS или датчиком изображения на CCD, и выводит сигнал изображения, полученный путем подвергания фотоэлектрическому преобразованию падающего света. Несколько микролинз 1020 размещаются двумерно, так что каждая микролинза 1020 соответствует множеству пикселей, и поэтому свет, который разделен и излучен для каждой области зрачка с помощью микролинз 1020, может приниматься наряду с сохранением информации о разделении и может быть преобразован в сигнал изображения, который можно подвергнуть обработке данных.

Схема 104 аналоговой обработки сигналов (AFE) выполняет коррелированную двухступенчатую выборку, усиление сигнала, регулировку контрольного уровня, аналого-цифровое преобразование и т.п. над сигналом изображения, выведенным из датчика 103 изображения. Схема 105 цифровой обработки сигналов (DFE) выполняет цифровую обработку изображений, например регулировку контрольного уровня, над сигналом изображения, выведенным из схемы 104 аналоговой обработки сигналов.

Схема 106 обработки изображений подвергает сигнал изображения, выведенный из схемы 105 цифровой обработки сигналов, заранее установленной обработке изображений, а также операции перефокусировки (проявочной обработке), которая является уникальной для светлопольных камер, для установки фокуса на произвольной виртуальной плоскости изображения. Кроме того, схема 106 обработки изображений содержит функцию обнаружения субъекта для обнаружения субъекта в проявленном изображении и функцию распознавания для распознавания, является ли обнаруженный субъект конкретным субъектом. В настоящем варианте осуществления схема 106 обработки изображений содержит функцию определения лица для идентификации лица человека в качестве примера обнаружения субъекта и функцию распознавания лиц для распознавания, чье лицо было идентифицировано, путем сопоставления с базой данных лиц в позже описанной запоминающей схеме 107, в качестве примера функции распознавания субъекта, однако этим не ограничивается. Схема 106 обработки изображений дополнительно содержит функцию для считывания основного изображения из схемы 108 записи, выполнения проявления с использованием заранее установленного параметра перефокусировки и формирования уменьшенного изображения (миниатюрного изображения), когда нужно выполнить отображение предварительного просмотра в момент воспроизведения. Запоминающая схема 107 является энергонезависимым запоминающим устройством, например флэш-памятью, и хранит информацию из базы данных лиц, в которой хранятся пары лиц и имен людей. Схема 108 записи является носителем записи, например картой памяти, который записывает и хранит сигналы изображения (основные изображения), выведенные из схемы 106 обработки изображений, и позже описанную вспомогательную информацию, которая ассоциируется с основными изображениями.

Схема 109 управления выполняет общее управление устройством 100 съемки изображений, например управление датчиком 103 изображения и схемой 106 обработки изображений. Операционная схема 110 принимает сигналы от операционного элемента, которым снабжается устройство 100 съемки изображений, и вводит команды пользователя в схему 109 управления. Схема 111 отображения отображает снятые изображения, изображения визирования по экрану, различные типы экранов настройки, основные изображения, проявленные изображения, вспомогательную информацию, записанную в схеме 108 записи, и т.п. Кроме того, в описанном далее случае, когда вспомогательная информация является изображением, схема 111 отображения может вырезать и отобразить часть того изображения. Кроме того, в случае, когда вспомогательная информация является символьными данными, схема 111 отображения может отобразить символы наложенными на экран дисплея.

Далее идет описание взаимного расположения формирующей изображение линзы 101, массива 102 микролинз и датчика 103 изображения в устройстве съемки изображений из настоящего варианта осуществления.

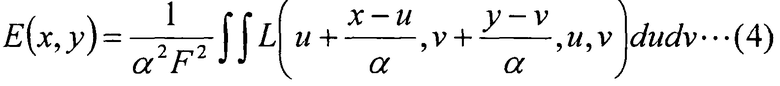

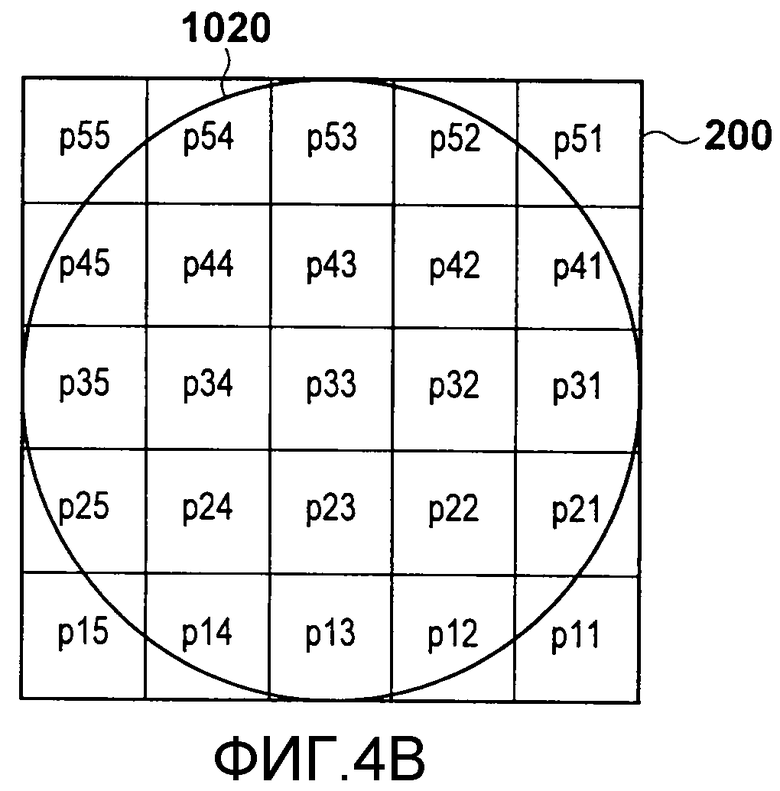

Фиг. 2 - схема, показывающая датчик 103 изображения и массив 102 микролинз из направления оптической оси Z на фиг. 1. Каждая микролинза 1020 располагается так, что одна микролинза 1020 соответствует нескольким пикселям 201 деления. Массив 200 пикселей задается в виде группы пикселей 201 деления за одной микролинзой. Отметим, что в первом варианте осуществления каждый массив 200 пикселей компонуется всего 25 пикселями 201 деления в пяти строках и пяти столбцах.

Фиг. 3 - схема, показывающая, как свет, излученный из формирующей изображение линзы 101, проходит через одну микролинзу 1020 и принимается датчиком 103 изображения, если смотреть из направления, перпендикулярного оптической оси Z. Свет излучается из областей a1 - a5 зрачка формирующей изображение линзы 101, проходит через центральную микролинзу 1020 и образует изображения на соответствующих пикселях p1 - p5 деления за той микролинзой.

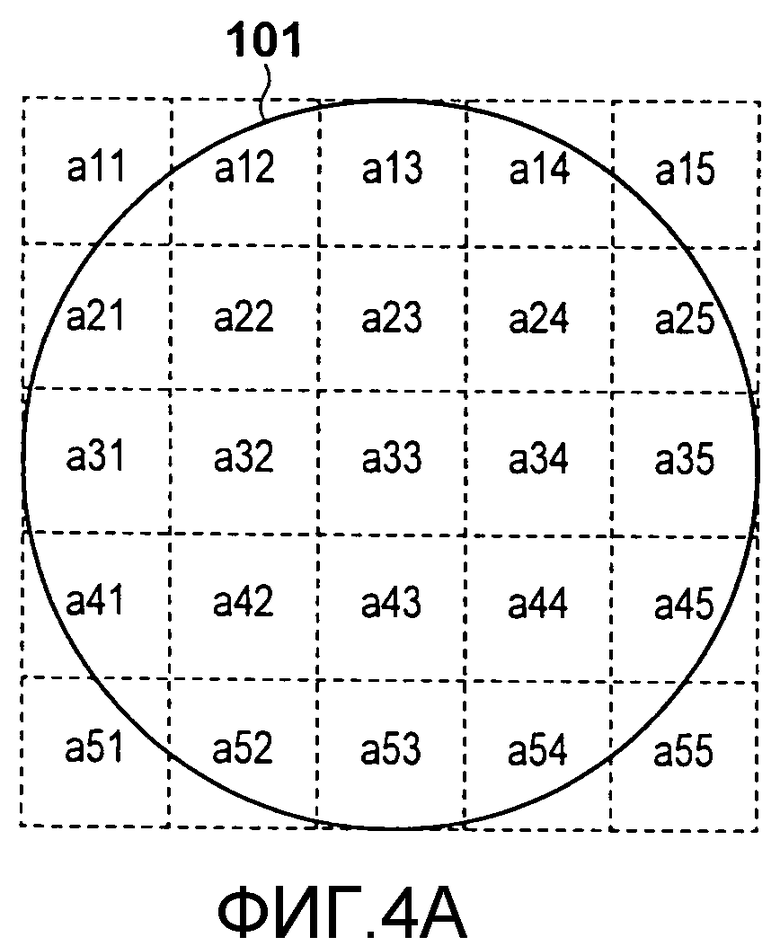

Фиг. 4A - схема для более точного описания областей пропускания света у формирующей изображение линзы 101, показанных на фиг. 3, и областей приема света у датчика 103 изображения, принимая во внимание апертуру формирующей изображение линзы 101 из направления оптической оси Z. Фиг. 4B - схема, показывающая одну микролинзу 1020 и массив 200 пикселей, размещенный за ней, если смотреть из направления оптической оси Z. В случае, когда количество областей зрачка, на которое делится формирующая изображение линза 101, является таким же, как количество пикселей за микролинзой 1020, что показано на фиг. 4A, свет, излученный из одной разделенной области зрачка у формирующей изображение линзы 101, образует изображение на одном пикселе. Отметим, что здесь диафрагменные числа у формирующей изображение линзы 101 и микролинз 1020 практически совпадают друг с другом.

Отношение соответствия между областями a11 - a55 зрачка у формирующей изображение линзы 101, показанными на фиг. 4A, и пикселями p11 - p55, показанными на фиг. 4B, является вершинно-симметрическим отношением, если смотреть из направления оптической оси Z. Соответственно, свет, излученный из области a11 зрачка формирующей изображение линзы 101, образует изображение на пикселе p11 среди пикселей в массиве 200 пикселей за микролинзой 1020. Аналогичным образом свет, который излучается из области a11 зрачка и проходит через другую микролинзу 1020, также образует изображение на пикселе p11 среди пикселей в массиве 200 пикселей за той микролинзой 1020.

Нижеследующее описывает способ вычисления положения фокуса (плоскости перефокусирования), которое соответствует произвольному положению субъекта на экране. Как показано на фиг. 4A и 4B, каждый пиксель в массиве 200 пикселей принимает свет, который прошел через разную область зрачка у формирующей изображение линзы 101. Сигналы пикселей объединяются из этих разделенных сигналов, чтобы сформировать пару сигналов, которые подвергнуты горизонтальному разделению зрачка.

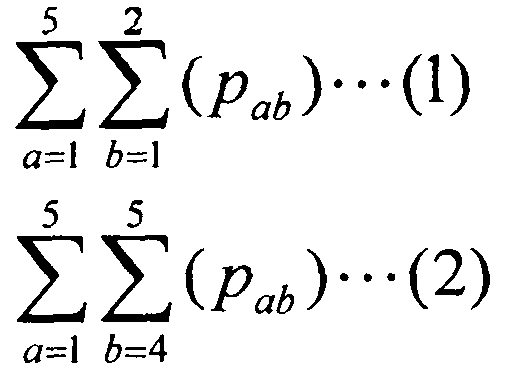

В выражении (1) свет, который прошел через левосторонние области (области зрачка a11-a51 и a12-a52) выходного зрачка у формирующей изображение линзы 101, объединяется для пикселей в некотором массиве 200 пикселей. Это применяется к нескольким массивам 200 пикселей, которые выровнены в горизонтальном направлении, и изображение субъекта, образованное этой группой выходных сигналов, является изображением A. Также в выражении (2) свет, который прошел через правосторонние области (области зрачка a14-a54 и a15-a55) выходного зрачка у формирующей изображение линзы 101, объединяется для пикселей в некотором массиве 200 пикселей. Это применяется к нескольким массивам 200 пикселей, которые выровнены в горизонтальном направлении, и изображение субъекта, образованное этой группой выходных сигналов, является изображением B. Величина несовпадения изображений (разность фаз разделения зрачка) затем обнаруживается путем подвергания изображения A и изображения B операции корреляции. Затем положение фокуса, которое соответствует произвольному положению субъекта на экране, можно вычислить путем умножения величины несовпадения изображений на коэффициент пересчета, который определяется на основании оптической системы и положения фокуса формирующей изображение линзы 101.

Далее идет описание обработки для восстановления изображения для произвольно заданного положения фокуса (плоскости перефокусирования), которая выполняется над снятыми данными, полученными с помощью конфигураций формирующей изображение линзы 101, массива 102 микролинз и датчика 103 изображения.

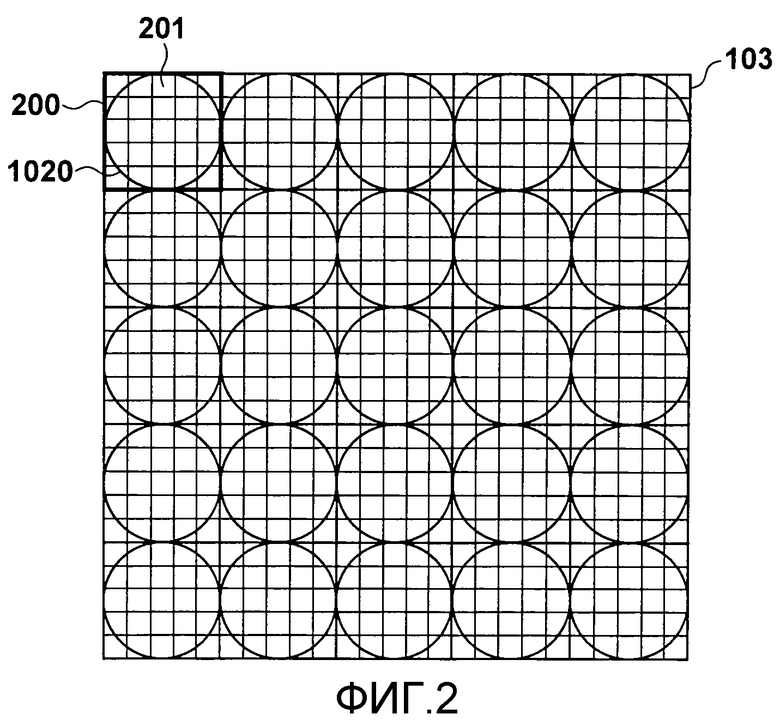

Фиг. 5 - схема, показывающая, из какой области разделения зрачка формирующей изображение линзы 101 выходит свет после прохождения через некоторый пиксель в произвольно заданной плоскости перефокусирования, а также на какую микролинзу 1020 падает тот свет, если смотреть из направления, перпендикулярного оптической оси Z. Здесь положения областей разделения зрачка у формирующей изображение линзы 101 обозначаются координатами (u,v), положения пикселей в плоскости перефокусирования обозначаются координатами (x,y), а положения микролинз 1020 в массиве 102 микролинз обозначаются координатами (x',y'). Кроме того, расстояние от формирующей изображение линзы 101 до массива 102 микролинз обозначается с помощью F, а расстояние от формирующей изображение линзы 101 до плоскости перефокусирования обозначается с помощью αF. Здесь α является коэффициентом перефокусирования для определения положения плоскости перефокусирования и может произвольно задаваться пользователем или задаваться в соответствии с идентификацией сцены, обнаружением субъекта или т.п. Отметим, что фиг. 5 показывает только направления u, x и x', а направления v, y и y' не показаны. Как показано на фиг. 5, свет, который прошел через координаты (u,v) и координаты (x,y), поступает в координаты (x',y') в массиве 102 микролинз. Эти координаты (x',y') могут выражаться, как показано в выражении (3).

Тогда допуская, что L(x',y',u,v) обозначает выход пикселя, который принимает этот свет, выход E(x,y), полученный в координатах (x,y) в плоскости перефокусирования, получается путем интегрирования L(x',y',u,v) для областей зрачка формирующей изображение линзы 101, соответственно приводя к выражению (4).

В выражении (4) задание α, (x,y) и (u,v) дает положение (x',y') микролинзы 1020, на которую падает свет. Затем можно получить пиксель, который соответствует положению (u,v) в массиве 200 пикселей, которое соответствует той микролинзе. Выходом этого пикселя является L(x',y',u,v). E(x,y) затем можно вычислить путем выполнения вышеприведенного вычисления для всех областей разделения зрачка и интегрирования полученного выхода пикселя. Отметим, что интегрирование в выражении (4) может выполняться путем простого сложения, если в качестве (u,v) используются репрезентативные координаты областей разделения зрачка у формирующей изображение линзы.

Нижеследующее описывает формат вспомогательной информации в настоящем варианте осуществления. Когда выполняется съемка изображения, основное изображение из сигнала изображения (светлопольная информация), выведенного из датчика 103 изображения, записывается в схему 108 записи с помощью схемы 106 обработки изображений. В то же время данные изображения (дополнительное изображение) и символьные данные (дополнительная информация) также формируются и используются в качестве вспомогательной информации для основного изображения. Нижеследующее со ссылкой на фиг. 1 и блок-схему алгоритма на фиг. 7 описывает операции для формирования вспомогательной информации, когда выполняется съемка изображения.

Сначала будет приведено описание способа для формирования и записи данных изображения в качестве вспомогательной информации. На этапе S600 выполняется съемка изображения для съемки основного изображения. Когда выполняется съемка изображения, сигнал изображения, выведенный из датчика 103 изображения, подвергается аналоговой обработке сигналов посредством AFE 104, а результирующий сигнал подвергается цифровой обработке сигналов посредством DFE 105. После цифровой обработки сигналов основное изображение записывается в схему 108 записи посредством схемы 106 обработки изображений. Последующая обработка выполняется под управлением схемы 109 управления.

Когда запись основного изображения завершается, формируется и записывается вспомогательная информация. На этапе S601 коэффициент перефокусирования для выполнения перефокусировки посредством схемы 106 обработки изображений устанавливается в начальное значение посредством схемы 109 управления. Начальное значение является значением, в соответствии с которым фокус помещается на близкий план.

На этапе S602 схема 109 управления контролирует, установлен ли коэффициент перефокусирования в значение, в соответствии с которым фокус помещается на самый дальний план, и завершает обработку, если коэффициент перефокусирования достиг значения, указывающего самый дальний план. Если не достигнуто значение, указывающее самый дальний план, то процедура переходит к этапу S603. На этапе S603 схема 109 управления меняет коэффициент перефокусирования в направлении дальнего плана на некоторую величину. Схема 109 управления затем дает команду схеме 106 обработки изображений для выполнения проявления с использованием того коэффициента перефокусирования.

На этапе S604 схема 106 обработки изображений выполняет обработку по определению субъекта (например, обработку по определению лица) над изображением (изображением восстановления), которое было проявлено с использованием обозначенного коэффициента перефокусирования на этапе S603. Процедура переходит к этапу S605, если в результате определения лица определяется, что лицо присутствует на проявленном изображении, и процедура возвращается к обработке этапа S602, если не определено, что лицо присутствует. На этапе S605 схема 109 управления управляет обработкой, выполненной после определения лица. В частности, схема 109 управления дает команду схеме 106 обработки изображений для преобразования проявленного изображения, которое фокусируется на обнаруженном лице, в формат JPEG и сохранения проявленного изображения в схеме 108 записи в качестве дополнительного изображения совместно с основным изображением. Если определяется, что одно и то же лицо присутствует на двух или более проявленных изображениях, то схема 109 управления управляет сохранением проявленного изображения, включающего это лицо, с наиболее сфокусированным состоянием. В качестве способа для идентификации проявленного изображения, которое нужно сохранить, можно использовать способ идентификации коэффициента перефокусирования путем обнаружения положения фокуса на основе вышеописанной операции корреляции для положения обнаруженного лица. В качестве альтернативы также можно идентифицировать наиболее сфокусированное проявленное изображение на основе выделения контуров, степени надежности для обнаружения лица и так далее. В этом случае для последовательно сформированных проявленных изображений выполняется сравнение в отношении значения оценки для контура или степени надежности для обнаружения лица, и проявленное изображение, имеющее большее значение, сохраняется в запоминающей схеме 107. Процедура затем возвращается к обработке этапа S602, и вышеописанная обработка повторяется.

Хотя на фиг. 7 показан пример, в котором в качестве вспомогательной информации сохраняется дополнительное изображение (данные изображения), в качестве вспомогательной информации может сохраняться дополнительная информация. Примеры этой дополнительной информации включают в себя значение коэффициента перефокусирования, которое использовалось при формировании изображения, на котором было обнаружено лицо, информацию, указывающую положение лица на основном изображении, и информацию, указывающую относительный размер лица относительно размера основного изображения.

Информация о положении лица является числовым представлением того, насколько далеко вправо и вниз находится положение, в котором присутствует лицо, используя верхнюю левую точку основного изображения в качестве начала отсчета. Это сейчас будет описываться со ссылкой на фиг. 6. Здесь 501 обозначает основное изображение. Также 500 обозначает лицо, которое было обнаружено. Кроме того, ширина и высота основного изображения обозначаются соответственно с помощью W и H, а ширина и высота лица обозначаются соответственно с помощью Wface и Hface. Кроме того, допуская, что Dx является горизонтальным расстоянием от начала отсчета 0 до начального положения лица, а Dy является вертикальным расстоянием от начала отсчета до начального положения лица, относительная ширина и относительная высота в информации об относительном размере соответственно получаются из Wface/W и Hface/H. Также горизонтальное относительное расстояние и вертикальное относительное расстояние в информации о положении соответственно получаются из Dx/W и Dy/H. Схема 109 управления дает команду для преобразования этой дополнительной информации в файл данных и сохранения файла данных в схеме 108 записи совместно с основным изображением.

Далее со ссылкой на фиг. 8 и 9A-9D будет приведено описание случая, в котором записанное основное изображение и вспомогательная информация (например, дополнительные изображения и дополнительная информация) считываются из схемы 108 записи, и схема 111 отображения выполняет отображение предварительного просмотра светлопольного изображения.

На фиг. 9A 801 обозначает экран дисплея, который является частью схемы 111 отображения. Также прямоугольное изображение, обозначенное цифрой 802, является миниатюрным изображением, полученным путем уменьшения основного изображения. Когда пользователь дает команду операционной схеме 110 для выполнения отображения предварительного просмотра, операционная схема 110 дает схеме 109 управления команду отображения предварительного просмотра. При приеме команды отображения предварительного просмотра схема 106 обработки изображений считывает основное изображение из схемы 108 записи и уменьшает его, чтобы сформировать миниатюрное изображение. Схема 106 обработки изображений затем передает миниатюрное изображение в схему 111 отображения, которая создает экран предварительного просмотра на экране 801 дисплея. Здесь 803 обозначает курсор, когда одно миниатюрное изображение выбирается из нескольких миниатюр, и курсор 803 визуализируется схемой 111 отображения. Также 804 обозначает человека A, записанного на основном изображении, а 805 также обозначает человека B, записанного на основном изображении. Если основное изображение проявляется с использованием определенного коэффициента перефокусирования, то глубина резкости небольшая и не все субъекты находятся в фокусе. В показанном на фиг. 9A примере человек A, показанный сплошной линией, находится в фокусе, а человек B, показанный пунктирной линией, не находится в фокусе, соответственно указывая, что человек B расфокусирован.

На этапе S701 на фиг. 8 пользователь дает команду операционной схеме 110 для перемещения курсора 803 и выбора миниатюрного изображения, которое должно служить в качестве цели. Фиг. 9B показывает состояние, в котором выбрано миниатюрное изображение.

На этапе S702 схема 109 управления дает команду схеме 106 обработки изображений для поиска вспомогательной информации, которая ассоциируется с выбранным миниатюрным изображением. Схема 106 обработки изображений ищет в схеме 108 записи вспомогательную информацию, которая ассоциируется с основным изображением, соответствующим миниатюрному изображению, которое выбирается на фиг. 9B. В случае, когда дополнительная информация (относительное положение лица и относительный размер лица) и дополнительные изображения, на которых человек A и человек B были в фокусе, получаются в результате поиска на этапе S703, схема 109 управления отображает человека A и человека B одновременно в окрестности выбранного миниатюрного изображения. Здесь только области лиц вырезаются из дополнительных изображений, на которых лица были в фокусе, на основе дополнительной информации, указывающей относительные положения лиц, и области лиц отображаются схемой 111 отображения, как показано цифрами 811 и 812. Выполнение отображения таким образом дает возможность пользователю легко проверить, кто присутствует на изображении, даже при просмотре миниатюрного изображения от основного изображения, которое имеет небольшую глубину резкости.

Далее будет приведено описание случая, когда сами дополнительные изображения уменьшаются и отображаются. Этот случай показан на фиг. 9C. Аналогично показанному на фиг. 9B случаю, схема 109 управления дает команду схеме 111 отображения для отображения изображений, обозначенных цифрами 821 и 822, в окрестности выбранного миниатюрного изображения. Изображение 821 является изображением, которое проявлялось с использованием первого коэффициента перефокусирования, и человек A находится в фокусе. Изображение 822 является изображением, которое проявлялось с использованием второго коэффициента перефокусирования, и человек B находится в фокусе. Выполнение этого отображения таким образом дает возможность пользователю просматривать строки с изображениями, на которых лица субъектов находятся в фокусе, вместе с миниатюрным изображением.

Как описано выше, в соответствии с первым вариантом осуществления вспомогательная информация записывается совместно с основным изображением, и изображение, на котором лицо, включенное в основное изображение, находится в фокусе, которое получается на основе записанной вспомогательной информации, отображается в окрестности выбранного миниатюрного изображения. Это дает возможность упростить пользователю выбор намеченного изображения субъекта.

В соответствии с настоящим вариантом осуществления на этапе S603 идентифицируются соответствующие субъекты, присутствующие на экране, и чтобы получить изображения, на которых соответствующие субъекты находятся в фокусе, формируется множество проявленных изображений путем многократного изменения коэффициента перефокусирования от значения, в соответствии с которым фокус помещается на близкий план (широкоугольная сторона), к дальнему плану на некоторую величину. В качестве альтернативы также можно оценить положения фокуса соответствующих субъектов на основе информации о фокусном положении (карта расстояний) у соответствующих положений экрана, выведенной с помощью, например, вышеописанной операции корреляции и т.д., определить множество возможных коэффициентов перефокусирования, при которых соответствующие субъекты становятся сфокусированными, и использовать это множество возможных вариантов в качестве коэффициентов перефокусирования для этапа S603. Также можно определить некоторую величину коэффициента перефокусирования для этапа S603 на основе множества возможных вариантов.

Второй вариант осуществления

Нижеследующее является описанием второго варианта осуществления настоящего изобретения. Во втором варианте осуществления, когда схема 106 обработки изображений из вышеописанного первого варианта осуществления обнаруживает лицо, схема 106 обработки изображений помимо этого осуществляет распознавание лиц с использованием базы данных лиц и имен, которая хранится в запоминающей схеме 107, и записывает имя человека совместно с основным изображением.

По этой причине во втором варианте осуществления база данных, в которой ассоциируются характерные черты лица и имена, заранее сохраняется в запоминающей схеме 107 на фиг. 1. Также, если схема 106 обработки изображений обнаруживает лицо на изображении, проявленном с некоторым коэффициентом перефокусирования на этапе S605 на фиг. 7, то схема 106 обработки изображений затем выполняет распознавание лиц для того лица путем создания запроса к базе данных лиц и имен в запоминающей схеме 107. Имя человека, происходящее из запроса, созданного схемой 106 обработки изображений, тогда рассматривается в качестве вспомогательной информации вместе с дополнительными изображениями и/или дополнительной информацией для лица в основном изображении, которые описаны в первом варианте осуществления, и вспомогательная информация записывается в схеме 108 записи совместно с ранее записанным основным изображением. Описание последующей обработки приведено не будет, поскольку она аналогична обработке, описанной выше в первом варианте осуществления.

Отметим, что в случае, когда в качестве вспомогательной информации доступна информация об имени, полученная из базы данных лиц и имен как во втором варианте осуществления, и информация об относительном положении и относительном размере относительно основного изображения, отображение может выполняться как показано на фиг. 9D. В частности, схема 109 управления дает команду схеме 106 обработки изображений для считывания из схемы 108 записи основного изображения, которое соответствует выбранной пользователем миниатюре, и проявки основного изображения с использованием заранее установленного коэффициента перефокусирования. В этом случае человек A в проявленном изображении находится в фокусе, но человек B не находится в фокусе. По этой причине схема 109 управления получает из дополнительной информации имя 831 для лица человека B, который не находится в фокусе в проявленном изображении, и дает команду схеме 111 отображения для отображения информации об имени, наложенной на изображение. В результате выполнения отображения таким образом в случае лица, которое находится не в фокусе в миниатюрном изображении от основного изображения, которое имеет небольшую глубину резкости, пользователь может просмотреть миниатюрное изображение, на котором имя накладывается в виде символов в приблизительном положении лица. Это дает возможность упростить пользователю выбор намеченного изображения субъекта.

Хотя в первом и втором вариантах осуществления описывается случай, когда определение лица и запись выполняются устройством съемки изображений, настоящее изобретение этим не ограничивается. Например, цели настоящего изобретения можно достичь даже в случае, когда обработка, описанная с использованием фиг. 6 - 9D, выполняется внешним устройством обработки изображений, использующим данные изображения, которые были выведены из устройства съемки изображений, которое формирует данные изображения, с помощью которых может выполняться перефокусирование.

Также в вышеприведенных вариантах осуществления изображения восстановления, полученные с использованием различных коэффициентов перефокусирования, используются в качестве изображений, используемых при обработке по определению субъекта. Однако можно, например, сформировать изображение, имеющее большую глубину резкости, используя изображение, полученное путем сбора некоторых пикселей микролинз, которое является изображением, на котором можно проверить субъекты во всем угле обзора, и использовать то изображение при обнаружении субъекта.

Нижеследующее со ссылкой на фиг. 20A-20C описывает пример оптических систем, к которым может применяться настоящий вариант осуществления. Фиг. 20A-20C являются схемами, которые схематически показывают, как световые лучи от объекта (субъекта) образуют изображение на датчике 103 изображения. Фиг. 20A соответствует оптической системе, проиллюстрированной на фиг. 3, и показывает пример, в котором массив 102 микролинз размещается в окрестности плоскости изображения формирующей изображение линзы 101. Фиг. 20B показывает пример, в котором массив 102 микролинз располагается ближе к объекту, чем плоскость изображения формирующей изображение линзы 101. Фиг. 20C показывает пример, в котором массив 102 микролинз располагается дальше от объекта, чем плоскость изображения формирующей изображение линзы 101.

На фиг. 20A - 20C позиция 103 обозначает датчик изображения, 102 обозначает массив микролинз, 31-35 обозначают области зрачка с a1 по a5, показанные на фиг. 3, 51 обозначает плоскость объекта, 51a и 51b обозначают произвольные точки на объекте, 52 обозначает плоскость зрачка формирующей изображение линзы, и 61, 62, 71, 72, 73, 81, 82, 83 и 84 обозначают конкретные микролинзы в массиве 102 микролинз. На фиг. 20B и 20C 103a обозначает виртуальный датчик изображения, а 102a обозначает виртуальный массив микролинз. Они показаны для справки, чтобы прояснить отношение соответствия с фиг. 20A. Также сплошные линии обозначают световой поток, который выходит из точки 51a на объекте и проходит через области 31 и 33 в плоскости зрачка, а пунктирные линии обозначают световой поток, который выходит из точки 51b на объекте и проходит через области 31 и 33 в плоскости зрачка.

В примере на фиг. 20A массив 102 микролинз с тем же успехом размещается в окрестности плоскости изображения оптической системы формирования изображений, как проиллюстрировано на фиг. 3, и поэтому датчик 103 изображения и плоскость 52 зрачка формирующей изображение линзы 101 находятся в сопряженном отношении. Кроме того, плоскость 51 объекта и массив 102 микролинз находятся в сопряженном отношении. По этой причине световой поток, который выходит из точки 51a на объекте, поступает в микролинзу 61, световой поток, который выходит из точки 51b, поступает в микролинзу 62, и световой поток, который прошел через области 31-35, поступает в соответствующие пиксели, предусмотренные за микролинзами.

В примере на фиг. 20B массив 102 микролинз побуждает световой поток из формирующей изображение линзы 101 образовать изображение, и датчик 103 изображения предусмотрен в плоскости изображения. В соответствии с этим расположением плоскость 51 объекта и датчик 103 изображения находятся в сопряженном отношении. Световой поток, который вышел из точки 51a на объекте и прошел через область 31 плоскости зрачка, поступает на микролинзу 71, а световой поток, который вышел из точки 51a на объекте и прошел через область 33 плоскости зрачка, поступает на микролинзу 72. Световой поток, который вышел из точки 51b на объекте и прошел через область 31 плоскости зрачка, поступает на микролинзу 72, а световой поток, который вышел из точки 51b на объекте и прошел через область 33 плоскости зрачка, поступает на микролинзу 73. Световой поток, который прошел через эти микролинзы, поступает на соответствующие пиксели, предусмотренные за микролинзами. Таким образом, изображения образуются в разных положениях в зависимости от точки на объекте и области пропускания в плоскости зрачка. Информацию, аналогичную таковой на фиг. 20A, можно получить путем повторного выравнивания с положениями на виртуальной плоскости 103a изображения. Другими словами, можно получить информацию, указывающую область зрачка, через которую прошел поток (угол падения), и положение на датчике изображения.

В примере на фиг. 20C массив 102 микролинз побуждает световой поток из формирующей изображение линзы 101 вновь образовать изображение (называется переформированием изображения, поскольку световой поток, который ранее образовал изображение однократно и который находится в рассеянном состоянии, побуждают образовать изображение), и датчик 103 изображения предусмотрен на той плоскости изображения. В соответствии с этим расположением плоскость 51 объекта и датчик 103 изображения находятся в сопряженном отношении. Световой поток, который вышел из точки 51a на объекте и прошел через область 31 плоскости зрачка, поступает на микролинзу 82, а световой поток, который вышел из точки 51a на объекте и прошел через область 33 плоскости зрачка, поступает на микролинзу 81. Световой поток, который вышел из точки 51b на объекте и прошел через область 31 плоскости зрачка, поступает на микролинзу 84, а световой поток, который вышел из точки 51b на объекте и прошел через область 33 плоскости зрачка, поступает на микролинзу 83. Световой поток, который прошел через эти микролинзы, поступает на соответствующие пиксели, предусмотренные за микролинзами. Аналогично фиг. 20B, информацию, аналогичную таковой на фиг. 20A, можно получить путем повторного выравнивания с положениями на виртуальной плоскости 103a изображения. Другими словами, можно получить информацию, указывающую область зрачка, через которую прошел поток (угол падения), и положение на датчике изображения.

Хотя на фиг. 20A-20C показаны примеры, в которых информацию о положении и информацию об угле можно получить с использованием массива микролинз (элемента фазовой модуляции) в качестве единицы разделения зрачка, другая оптическая конфигурация может использоваться при условии, что можно получить информацию о положении и информацию об угле (эквивалентно ограничению областей пропускания зрачка). Например, можно использовать способ, в котором некая маска (элемент модуляции усиления), снабженная подходящим рисунком, вставляется в оптический путь оптической системы формирования изображений.

Третий вариант осуществления

В последнее время обнаружена разработка технологии для восстановления ухудшенного изображения, на котором возникло размывание (отклонение фокуса). В устройстве восстановления изображений, раскрытом в патенте Японии № 2963990, снабженная рисунком диафрагма располагается в оптической системе формирования изображений, и карта дальностей и сфокусированное изображение, которое находится в фокусе, получаются путем получения наблюдаемого изображения и анализа наблюдаемого изображения на основе рисунка диафрагмы.

Также патентная публикация Японии № 2000-020691 раскрывает способ, в соответствии с которым ухудшенное изображение, на котором возникло дрожание или размывание изображения, восстанавливается до высококачественного изображения. Допуская, что f(x,y) является идеальным изображением, g(x,y) является ухудшенным изображением, и функцией ухудшения изображения является h(x,y), ухудшенное изображение g(x,y) выражается как показано ниже.

g(x,y)=∫∫h(x-x',y-y')f(x',y')dx'dy' (5)

Здесь, допуская, что F(u,v) является преобразованием Фурье идеального изображения f(x,y), G(u,v) является преобразованием Фурье ухудшенного изображения g(x,y), а H(u,v) является преобразованием Фурье функции h(x,y) ухудшения изображения, Выражение (5) можно переписать как показано ниже.

G(u,v)=H(u,v)F(u,v) (6)

Изменение выражения (6) дает идеальное изображение, которое показано ниже в переписанном виде.

F(u,v)=G(u,v)/H(u,v) (7)

Таким образом, патентная публикация Японии № 2000-020691 раскрывает способ, в котором функция h(x,y) ухудшения формируется на основе, например, информации о характеристиках устройства съемки изображений, а восстановленное изображение f(x,y) формируется на основе функции ухудшения. Однако, поскольку обработка по восстановлению выполняется над всем снятым изображением, сложно получить изображение с небольшой глубиной резкости, на котором фокус помещается на основной субъект.

В связи с этим технология корректировки отклонения фокуса относительно конкретного субъекта на снятом изображении предложена в третьем варианте осуществления.

Фиг. 10 показывает общую конфигурацию цифровой камеры 1 в соответствии с третьим вариантом осуществления. На фиг. 10 формирующая изображение линза 2 является линзой для преобразования света от субъекта в изображение на датчике 3 изображения, и формирующая изображение линза 2 крепится в заранее установленном положении относительно датчика 3 изображения. Поскольку формирующая изображение линза 2 в настоящем варианте осуществления не имеет механизма регулировки фокальной точки, размер цифровой камеры 1 можно уменьшить. Также, хотя формирующая изображение линза 2 показана на фиг. 10 в виде одиночной линзы, формирующая изображение линза 2 фактически компонуется несколькими линзами, чтобы удовлетворять требованию к характеристике линзы.

Цифровая камера 1 включает в себя CPU 7, который выполняет общее управление цифровой камерой 1, и специализированную интегральную схему 6 (ASIC), которая восстанавливает изображение, которое расфокусировано (сопровождается отклонением фокуса), посредством обработки изображений (то есть исправляет отклонение фокуса). Цифровая камера 1 также включает в себя модуль 4 отображения (жидкокристаллический дисплей или т.п.), который отображает восстановленные изображения, запоминающее устройство 8, которое записывает изображения, снятые датчиком 3 изображения, и пусковой модуль 9, с помощью которого фотограф дает команду выполнения операции съемки изображения.

Пусковой модуль 9 компонуется двухуровневым переключателем, с помощью которого фотограф выполняет операцию съемки изображения, и конфигурирован так, что первый переключатель включается, когда пусковой модуль 9 нажимается до первого уровня, а второй переключатель включается, когда пусковой модуль 9 нажимается до второго уровня.

Цифровая камера 1 также включает в себя модуль 5 видоискателя, который включает в себя дополнительную функцию обозначения основного субъекта. Модуль 5 видоискателя включает в себя оптический видоискатель для оптического наблюдения субъекта через линзу и детектор линии визирования, который обнаруживает положение, наблюдаемое фотографом, который наблюдает за субъектом через оптический видоискатель. Оптический видоискатель является, например, видоискателем действительного изображения, составленным из линзы объектива, окуляра и призмы Порро, которая является модулем преобразования изображения, и жидкокристаллический элемент отображения с диспергированным полимером размещается на плоскости изображения линзы объектива.

Фиг. 11 - схема, иллюстрирующая разделение экрана съемки изображения. Как показано на фиг. 11, экран съемки изображения делится, например, на блоки 8×10. Когда положение, наблюдаемое фотографом, обнаруживается детектором линии визирования, CPU 7 указывает блок, который включает в себя наблюдаемое положение, из числа блоков, на которые поделен экран. Информация, указывающая блок, который включает в себя наблюдаемое положение, записывается затем в запоминающее устройство 8 с помощью CPU 7 в качестве информации, указывающей основной субъект, который фотограф желает получить в фокусе (информация об основном субъекте).

Далее со ссылкой на фиг. 12 будет приведено описание обработки по съемке изображения и обработки по восстановлению по третьему варианту осуществления. Обработка этой блок-схемы алгоритма начинается, когда включается источник питания цифровой камеры 1 с помощью переключателя источника питания (не показан).

На этапе S101 CPU 7 определяет, выбран ли режим съемки изображения в качестве рабочего режима цифровой камеры 1. В случае, когда режим съемки изображения не выбран (выбран режим воспроизведения изображения), процедура переходит к этапу S102, а в случае, когда выбран режим съемки изображения, процедура переходит к этапу S103.

На этапе S102 CPU 7 считывает данные изображения, которые записаны в запоминающем устройстве 8. Затем процедура переходит к этапу S109 (обработка этапа S109 будет описываться позже).

На этапе S103 CPU 7 проверяет состояние первого переключателя у пускового модуля 9. В случае, когда первый переключатель включен, процедура переходит к этапу S104, а в противном случае процедура возвращается к этапу S101.

Нижеследующее со ссылкой на фиг. 13A и 15A описывает состояние отображения у модуля 5 видоискателя и модуля 4 отображения в случае, когда первый переключатель выключен в режиме съемки изображения. Фиг. 13A - схема, иллюстрирующая изображение видоискателя в случае, когда первый переключатель выключен в режиме съемки изображения. Фотограф, смотрящий через модуль 5 видоискателя, наблюдает предмет a, предмет b и предмет c. В случае оптического видоискателя из настоящего варианта осуществления фокусировочный экран не размещается на оптическом пути, и поэтому фотограф может наблюдать четкое и сфокусированное изображение предмета. Одновременно изображение, снятое датчиком 3 изображения через формирующую изображение линзу 2, отображается на модуле 4 отображения, как показано на фиг. 15A. Поскольку формирующая изображение линза 2 из настоящего варианта осуществления крепится в заранее установленном положении относительно датчика 3 изображения и регулировка фокальной точки не выполняется, расфокусированное изображение предмета снимается в случае, когда предмет не находится в положении, которое сопряжено с датчиком 3 изображения относительно формирующей изображение линзы 2. На фиг. 15A предмет a, который удален на кратчайшее расстояние, меньше всего расфокусирован (имеет наименьшую степень отклонения фокуса), а предмет c, который удален на наибольшее расстояние, расфокусирован больше всего.

Когда первый переключатель включен, на этапе S104 CPU 7 побуждает детектор линии визирования, включенный в модуль 5 видоискателя, функционировать для обнаружения положения основного предмета на экране съемки изображения. Детектор линии визирования компонуется осветительным устройством, которое освещает глаз фотографа, и системой линз и датчиком изображения для приема света, который отражен глазом фотографа. Способ обнаружения линии визирования фотографа может быть любым известным способом, одним примером которого является способ, раскрытый в патентной публикации Японии № 2-264632. Когда обнаруживается положение, наблюдаемое фотографом, CPU 7 указывает блок, который включает в себя наблюдаемое положение, из числа блоков, на которые поделен экран. В позже описанной обработке по восстановлению предмет, включенный в этот указанный блок, рассматривается в качестве основного предмета, который фотограф желает получить в фокусе.

На этапе S105 CPU 7 использует элемент отображения, предусмотренный в модуле 5 видоискателя, для отображения изображения, указывающего блок, который включает в себя наблюдаемое положение, которое было обнаружено детектором линии визирования (то есть положение основного предмета), наложенным на изображение видоискателя. Фиг. 13B - схема, иллюстрирующая изображение видоискателя в случае, когда первый переключатель включен, и отображается изображение рамки, указывающее, что блок 35 выбран в качестве положения основного предмета. Одновременно изображение рамки, указывающее положение основного предмета на изображении, которое было снято датчиком 3 изображения через формирующую изображение линзу 2, отображается на модуле 4 отображения наложенным способом, как показано на фиг. 15B. Другими словами, изображение рамки, указывающее, что блок 35 выбран в качестве положения основного предмета, который должен быть в фокусе, отображается на изображении, которое было снято датчиком 3 изображения.

На этапе S106 CPU 7 проверяет состояние второго переключателя у пускового модуля 9. В случае, когда второй переключатель включен, процедура переходит к этапу S107, а в противном случае процедура возвращается к этапу S101.

На этапе S107 CPU 7 снимает изображение с использованием формирующей изображение линзы 2 и датчика 3 изображения. На этапе S108 CPU 7 записывает в запоминающее устройство 8 данные изображения, выражающие снятое изображение, вместе с информацией, которая указывает положение (номер блока) последнего основного предмета, обнаруженного на этапе S104 (информация об основном предмете). Информация об основном предмете может быть сохранена, например, в заголовочной части данных изображения.

На этапе S109 CPU 7 проверяет, установлена ли цифровая камера 1 с помощью кнопки настройки (не показана) в режим, в котором выполняется обработка по восстановлению изображения. В случае, когда цифровая камера 1 установлена в режим, в котором выполняется обработка по восстановлению изображения, процедура переходит к этапу S110, а в противном случае процедура переходит к этапу S111.

На этапе S110 CPU 7 выполняет обработку по восстановлению изображения на основе данных изображения и информации об основном предмете, которые были записаны в запоминающее устройство 8 на этапе S108. В качестве альтернативы в случае, когда выполнялась обработка этапа S102, CPU 7 выполняет обработку по восстановлению изображения на основе данных изображения и информации об основном предмете, которые считывались на этапе S102.

Нижеследующее является подробным описанием обработки по восстановлению на этапе S110 со ссылкой на фиг. 14. На этапе S121 CPU 7 получает информацию об изображении, которая ассоциируется с данными изображения, предназначенными для обработки. На этапе S122 CPU 7 определяет, включается ли информация об основном предмете в полученную информацию об изображении. В случае, когда включается информация об основном предмете, процедура переходит к этапу S124, а в противном случае процедура переходит к этапу S123.

Например, в случае, когда основной предмет не обнаружен на этапе S104 из-за сбоя детектора линии визирования при обнаружении положения, наблюдаемого фотографом, информация об основном предмете не включается в информацию об изображении. В связи с этим на этапе S123 ASIC 6 определяет основной предмет на основе данных изображения, предназначенных для обработки. В одном характерном примере ASIC 6 обнаруживает лицо человека на изображении и задает обнаруженное лицо в качестве основного предмета.

Отметим, что известная технология обнаружения лица может использоваться при обнаружении лица в настоящем варианте осуществления. Примеры известной технологии обнаружения лица включают в себя методику на основе обучения, которая использует нейронную сеть или т.п., и методику, в которой на изображении обнаруживаются участки, которые обладают характеристическими формами (например, глаза, нос и рот), с использованием сравнения с шаблонами, и область считается лицом, если степень подобия высокая. Предложено много других методик, например методика по обнаружению величин признаков изображения, например цвета кожи и формы глаз, и выполнению статистического анализа. Как правило, два или более этих способов объединяются, чтобы повысить точность обнаружения лица. Одним характерным примером является способ, раскрытый в патентной публикации Японии № 2002-251380, в котором обнаружение лица выполняется с использованием вейвлет-преобразования и величин признаков изображения.

На этапах S124 и S125 ASIC 6 выполняет обработку по восстановлению над данными изображения, предназначенными для обработки (то есть ASIC 6 манипулирует данными изображения, чтобы исправить отклонение фокуса относительно предмета, указанного информацией об основном предмете (или основного предмета, который был определен на этапе S123)). В частности, на этапе S124 область, которая сопровождается отклонением фокуса с такой же (практически такой же) степенью, что и у предмета, указанного информацией об основном предмете на изображении, устанавливается посредством ASIC 6 в качестве области восстановления. Затем на этапе S125 ASIC 6 манипулирует данными изображения относительно области восстановления, которая была установлена, чтобы исправить отклонение фокуса.

Функция h(x,y) ухудшения формируется на основе информации об оптических характеристиках цифровой камеры 1 или т.п., и функция ухудшения используется для выполнения обработки по восстановлению на основе вышеупомянутого выражения (7). В то же время область, чья функция ухудшения находится в пределах заранее установленной разницы с функцией h(x,y) ухудшения для основного предмета, задается в качестве области восстановления, которая сопровождается отклонением фокуса с той же степенью, что и основной предмет. Например, в случае, когда функция h(x,y) ухудшения является функцией рассеяния точки, можно определить, что функция ухудшения находится в пределах заранее установленной разницы, если разница полуширины меньше либо равна заранее установленному значению.

В настоящем варианте осуществления информация об основном предмете указывает блок 35, который показан на фиг. 15B. В связи с этим область, которая включает в себя блок 35 и включает в себя предмет b, который расфокусирован с той же степенью (то есть сопровождается отклонением фокуса с той же степенью), что и предмет в области блока 35, устанавливается посредством ASIC 6 в качестве области восстановления. Восстановленное изображение, которое показано, например, на фиг. 15C, является изображением, на котором предмет a и предмет c остаются расфокусированными, и только предмет b находится в фокусе. Также в случае, когда лицо было установлено в качестве основного предмета на этапе S123, считается, что не только лицо, но также все тело человека будет расфокусировано, и поэтому восстановленное изображение будет изображением, на котором весь человек находится в фокусе. Таким образом, в соответствии с настоящим вариантом осуществления исправляется отклонение фокуса относительно конкретного предмета в снятом изображении.

Возвращаясь к фиг. 12, на этапе S111 CPU 7 отображает восстановленное изображение на модуле 4 отображения, как показано, например, на фиг. 15C. В качестве альтернативы в случае, когда процедура перешла от этапа S109 к этапу S111, CPU 7 отображает невосстановленное изображение на модуле 4 отображения.

Как описано выше, в соответствии с настоящим вариантом осуществления цифровая камера 1 записывает информацию об основном субъекте вместе с данными изображения в запоминающее устройство 8, когда снимается изображение. Затем, когда выполняется обработка по восстановлению изображения, цифровая камера 1 манипулирует данными изображения относительно области, которая сопровождается отклонением фокуса с такой же (практически такой же) степенью, что и у субъекта, указанного информацией об основном субъекте, чтобы исправить отклонение фокуса. Это дает возможность корректировки отклонения фокуса относительно конкретного субъекта, включенного в снятое изображение, и дает возможность получения, например, изображения с небольшой глубиной резкости, на котором основной субъект находится в фокусе. Также, поскольку информация об основном субъекте записывается, когда снимается изображение, существует повышенная вероятность получения информации об основном субъекте, которая указывает основной субъект, который фотограф подразумевал на самом деле.

Отметим, что хотя в настоящем изобретении приводится пример, в котором часть модуля 5 видоискателя компонуется оптическим видоискателем, часть модуля 5 видоискателя может быть электронным видоискателем, оснащенным жидкокристаллическим дисплеем, электролюминесцентным (EL) дисплеем или т.п. Также, хотя в настоящем варианте осуществления описывается обработка по восстановлению изображения, которая выполняется над неподвижным изображением, настоящий вариант осуществления может аналогичным образом применяться в случае движущихся изображений.

Четвертый вариант осуществления

В третьем варианте осуществления основной предмет определяется детектором линии визирования. Разновидность, имеющая отношение к определению основного предмета, описывается в четвертом варианте осуществления. Также имеются другие незначительные отличия от третьего варианта осуществления, которые будут подробны описаны ниже.

Фиг. 16 показывает общую конфигурацию цифровой камеры 1 в соответствии с четвертым вариантом осуществления. На фиг. 16 составляющие элементы, которые аналогичны таковым на фиг. 10, обозначаются одинаковыми ссылочными номерами и их описания не будут приведены. Цифровая камера 1 включает в себя шаровой манипулятор 10. Шаровой манипулятор 10 можно нажимать на два уровня в направлении погружения в корпус цифровой камеры 1. Шаровой манипулятор 10 конфигурирован так, что первый переключатель включается, когда шаровой манипулятор 10 нажимается до первого уровня, а второй переключатель включается, когда шаровой манипулятор 10 нажимается до второго уровня. Также шаровой манипулятор 10 может вращаться, когда нажимается до первого уровня, и фотограф путем вращения шарового манипулятора 10 может обозначить положение основного предмета, который должен быть в фокусе.

Фиг. 17 - блок-схема алгоритма, показывающая обработку по съемке изображения и обработку по восстановлению в соответствии с четвертым вариантом осуществления. На фиг. 17 этапы, включающие в себя обработку, которая аналогична таковой на фиг. 12, обозначаются одинаковыми ссылочными номерами и будут описываться только отличия от фиг. 12. Обработка этой блок-схемы алгоритма начинается, когда включается источник питания цифровой камеры 1 с помощью переключателя источника питания (не показан).

Обработка этапов S101 и S103 аналогична таковой в третьем варианте осуществления (фиг. 12). Однако в настоящем варианте осуществления предполагается, что показанное на фиг. 18A изображение отображается на модуле 4 отображения. Поскольку формирующая изображение линза 2 из настоящего варианта осуществления крепится в заранее установленном положении относительно датчика 3 изображения и регулировка фокальной точки не выполняется, расфокусированное изображение предмета снимается в случае, когда предмет не находится в положении, которое сопряжено с датчиком 3 изображения относительно формирующей изображение линзы 2. В примере на фиг. 18A предмет a, который удален на кратчайшее расстояние, меньше всего расфокусирован, а предметы b и c, которые удалены на большее расстояние, расфокусированы больше.

Обработка этапа S102 аналогична таковой в третьем варианте осуществления (фиг. 12). Однако обработка этапа S201 выполняется после этапа S102. На этапе S201 CPU 7 считывает из запоминающего устройства 8 информацию об изображении, которая ассоциируется с данными изображения, которые считывались на этапе S102, и определяет, выполнено ли уже восстановление над данными изображения. В случае, когда восстановление выполнено, процедура переходит к этапу S204, а в противном случае процедура переходит к этапу S110.

С другой стороны, в случае, когда первый переключатель включен в режиме съемки изображения, становится возможным вращение шарового манипулятора 10. На этапе S202 CPU 7 обнаруживает вращение шарового манипулятора 10 и указывает блок в положении, которое соответствует вращению. В настоящем варианте осуществления предмет, включенный в этот указанный блок, рассматривается в качестве основного предмета, который фотограф желает получить в фокусе.

Обработка этапов S105 и S106 аналогична таковой в третьем варианте осуществления (фиг. 12). Однако в настоящем варианте осуществления предполагается, что показанное на фиг. 18B изображение отображается на модуле 4 отображения. Другими словами, в настоящем варианте осуществления предмет, включенный в блок 38, является основным предметом. Способ разделения экрана съемки изображения аналогичен таковому в третьем варианте осуществления (см. фиг. 11). Фотограф может обозначить основной предмет, который должен быть в фокусе, путем вращения шарового манипулятора 10 наряду с просмотром изображения рамки, отображенного на модуле 4 отображения.

Обработка этапов S107 и S110 аналогична таковой в третьем варианте осуществления (фиг. 12 и 14). Однако в отличие от третьего варианта осуществления в случае достижения этапа S110 после выполнения обработки этапа S107 данные изображения и информация об основном предмете не записаны в запоминающее устройство 8 в этот момент (они записаны во временное запоминающее устройство, которое не показано). В связи с этим CPU 7 и ASIC 6 считывают данные изображения и информацию об основном предмете из временного запоминающего устройства и выполняют обработку по восстановлению.

В настоящем варианте осуществления информация об основном предмете указывает блок 38, который показан на фиг. 18B. В связи с этим область, которая включает в себя блок 38 и включает в себя предметы b и c, которые расфокусированы с той же степенью (то есть сопровождаются отклонением фокуса с той же (практически с той же) степенью), что и предмет в области блока 38, устанавливается посредством ASIC 6 в качестве области восстановления. Восстановленное изображение, которое показано на фиг. 18C, является, например, изображением, на котором предмет a расфокусирован, предмет c находится в фокусе, как намечено фотографом, и предмет b, который находится практически на таком же расстоянии до предмета, что и предмет c, находится в фокусе. Выполнение обработки по восстановлению над предметом, который находится на таком же расстоянии до предмета, дает изображение, которое не имеет странности.

Также в случае, например, когда лицо не обнаруживается и основной предмет не определяется на этапе S123 на фиг. 14, ASIC 6 устанавливает всю область изображения в качестве области восстановления. В этом случае восстановленное изображение является изображением, на котором все предметы a, b и c находятся в фокусе, как показано на фиг. 19.

Возвращаясь к фиг. 17, на этапе S203 CPU 7 записывает данные восстановленного изображения и информацию восстановления (информацию, указывающую, что данные изображения подвергнуты обработке по восстановлению) в запоминающее устройство 8. Впоследствии на этапе S204 CPU 7 отображает восстановленное изображение на модуле 4 отображения.

Как описано выше, в соответствии с настоящим вариантом осуществления основной предмет обозначается с использованием шарового манипулятора 10. Также, в отличие от третьего варианта осуществления, данные восстановленного изображения записываются в запоминающее устройство 8. Кроме того, в случае, когда информация об основном предмете не получена и основной предмет не был определен путем обнаружения лица или т.п. по некоторой причине, отклонение фокуса исправляется для всей области изображения.

Отметим, что настоящий вариант осуществления описывает пример, в котором способом обозначения основного предмета является обозначение путем нажатия шарового манипулятора 10 до первого уровня, а затем его вращения. Однако цифровая камера 1 может быть конфигурирована так, что предусмотрен отдельный переключатель для обеспечения вращения шарового манипулятора, и основной предмет может обозначаться без нажатия шарового манипулятора до первого уровня.

Другие варианты осуществления

Аспекты настоящего изобретения также могут быть реализованы с помощью компьютера в системе или устройстве (или устройств, таких как CPU или MPU), который считывает и выполняет программу, записанную в запоминающем устройстве, чтобы выполнить функции вышеописанных вариантов осуществления, и с помощью способа, этапы которого выполняются компьютером в системе или устройстве посредством, например, считывания и выполнения программы, записанной в запоминающем устройстве, чтобы выполнить функции вышеописанных вариантов осуществления. С этой целью программа обеспечивается компьютеру, например, по сети или с носителя записи различных типов, служащего в качестве запоминающего устройства (например, машиночитаемого носителя).

Хотя настоящее изобретение описано со ссылкой на примерные варианты осуществления, нужно понимать, что изобретение не ограничивается раскрытыми примерными вариантами осуществления. Объем нижеследующей формулы изобретения должен соответствовать самой широкой интерпретации, охватывая все подобные модификации и эквивалентные структуры и функции.

Предложено устройство съемки изображений. Устройство содержит формирующую изображение линзу, датчик изображения и множество микролинз. Устройство также содержит модуль обработки изображений, выполненный с возможностью формирования изображения восстановления в заранее установленной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определения, присутствует ли субъект на изображении восстановления. Модуль записи в устройстве записывает данные изображения, которые были выведены из датчика изображения, и записывает информацию о субъекте, присутствие которого было определено с помощью модуля обработки изображений, в качестве вспомогательной информации совместно с данными изображения. Технический результат - идентификация субъекта в изображении, снятом светлопольной камерой при предварительном просмотре. 4 н. и 9 з.п. ф-лы, 31 ил.

1. Устройство съемки изображений, содержащее:

формирующую изображение линзу;

датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения;

множество микролинз, которые размещены между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заданного количества пикселей;

модуль обработки изображений, выполненный с возможностью формирования изображения восстановления в заданной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определения, присутствует ли субъект на изображении восстановления; и

модуль записи, выполненный с возможностью записи данных изображения, которые были выведены из датчика изображения, и записи информации о субъекте, присутствие которого было определено с помощью модуля обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

2. Устройство съемки изображений по п. 1, в котором вспомогательная информация представляет собой данные изображения, выражающие изображение, полученное путем уменьшения изображения восстановления на плоскости перефокусирования, для которого модуль обработки изображений определил наличие субъекта.

3. Устройство съемки изображений по п. 1, в котором вспомогательная информация включает в себя по меньшей мере одно из коэффициента перефокусирования при перефокусировании, который использовался при формировании изображения восстановления, для которого модуль обработки изображений определил присутствие субъекта, информации о положении, указывающей положение обнаруженного лица на изображении, и информации об относительном размере, указывающей относительный размер лица относительно размера изображения.

4. Устройство съемки изображений по п. 2, дополнительно содержащее модуль отображения, выполненный с возможностью отображения миниатюрного изображения на основе данных изображения, которые были выведены из датчика изображения и записаны модулем записи, и отображения миниатюрного изображения из изображения на плоскости перефокусирования, для которого определено присутствие субъекта, на основе вспомогательной информации.

5. Устройство съемки изображений по п. 2, дополнительно содержащее модуль отображения, выполненный с возможностью отображения миниатюрного изображения на основе данных изображения, которые были выведены из датчика изображения и записаны модулем записи, и отображения изображения лица, которое вырезано из изображения на плоскости перефокусирования, для которого определено присутствие субъекта, на основе вспомогательной информации.

6. Устройство съемки изображений по п. 1, дополнительно содержащее:

модуль хранения, выполненный с возможностью хранения информации, которая ассоциирует характерную черту лица и имя,

причем в случае определения присутствия субъекта модуль обработки изображений получает имя, которое соответствует определенному субъекту, из информации, сохраненной в модуле хранения, и

модуль записи к тому же записывает полученное имя в качестве вспомогательной информации совместно с данными изображения.

7. Устройство съемки изображений по п. 6, дополнительно содержащее модуль отображения, выполненный с возможностью отображения миниатюрного изображения на основе данных изображения, которые были выведены датчиком изображения и записаны модулем записи, и имени.

8. Устройство съемки изображений по п. 1, в котором модуль обработки изображений формирует соответствующие изображения восстановления для множества плоскостей перефокусирования и формирует вспомогательную информацию с использованием одного из сформированных изображений восстановления, на котором упомянутый субъект находится в фокусе.

9. Устройство съемки изображений по п. 8, в котором модуль обработки изображений идентифицирует изображение восстановления, на котором упомянутый субъект находится в фокусе, на основе информации о положении фокуса для соответствующих положений на экране данных изображения, выведенных из датчика изображения.

10. Устройство съемки изображений по п. 1, в котором модуль обработки изображений определяет множество плоскостей перефокусирования, для которых нужно сформировать изображение восстановления, на основе информации о положении фокуса для соответствующих положений на экране данных изображения, выведенных из датчика изображения.

11. Устройство обработки изображений для обработки данных изображения, выведенных из устройства съемки изображений, содержащего формирующую изображение линзу, датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения, и множество микролинз, которые размещаются между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заданного количества пикселей, причем устройство обработки изображений содержит:

модуль обработки изображений, выполненный с возможностью формирования изображения восстановления в заданной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определения, присутствует ли субъект на изображении восстановления; и

модуль записи, выполненный с возможностью записи данных изображения, которые были выведены из датчика изображения, и записи информации о субъекте, присутствие которого было определено с помощью модуля обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

12. Способ обработки изображений для обработки данных изображения, выведенных из устройства съемки изображений, содержащего формирующую изображение линзу, датчик изображения, который состоит из множества двумерно размещенных пикселей, причем датчик изображения выполнен с возможностью выполнения фотоэлектрического преобразования над падающим светом и вывода данных изображения, и множество микролинз, которые размещаются между формирующей изображение линзой и датчиком изображения, причем каждая микролинза соответствует соответствующей области из множества областей датчика изображения, причем каждая область состоит из заданного количества пикселей, причем способ обработки изображений содержит:

этап обработки изображений, на котором формируют изображение восстановления в заданной плоскости перефокусирования путем выполнения перефокусирования над данными изображения, которые были выведены из датчика изображения, и определяют, присутствует ли субъект на изображении восстановления; и

этап записи, на котором записывают данные изображения, которые были выведены из датчика изображения, и записывают информацию о субъекте, присутствие которого было определено на этапе обработки изображений, в качестве вспомогательной информации совместно с данными изображения.

13. Машиночитаемый носитель информации, на котором сохранена программа, побуждающая компьютер выполнять способ обработки изображений по п. 12.

| US 2010020191 A1, 28.01.2010 | |||

| US 2010194921 A1, 05.08.2010 | |||

| US 7936392 B2, 03.05.2011 | |||

| JP 2009065356 A, 26.03.2009 |

Авторы

Даты

2014-07-20—Публикация

2012-08-17—Подача