Область техники, к которой относится изобретение

Настоящее изобретение относится к способу кодирования многопроекционного видео и к устройству кодирования многопроекционного видео для кодирования многопроекционного изображения или многопроекционных видеофильмов; к способу декодирования многопроекционного видео и к устройству декодирования многопроекционного видео для декодирования многопроекционного изображения или многопроекционных видеофильмов; и к программе.

Испрашивается приоритет японской патентной заявки № 2010-038680, поданной 24 февраля 2010 г., содержание которой включено в настоящий документ путем ссылки.

Предшествующий уровень техники

Многопроекционные изображения являются множеством изображений, полученных путем фотографирования одного и того же объекта и его фона с помощью множества камер, а многопроекционные видеофильмы являются соответствующими им видеофильмами. При обычном кодировании видео эффективное кодирование осуществляется с помощью прогнозирования с компенсацией движения, которое использует высокую корреляцию между кадрами в разные моменты фотографирования в видео. Прогнозирование с компенсацией движения является техникой, принятой в последних международных стандартах схем кодирования видео, представленных Н.264. То есть прогнозирование с компенсацией движения является способом генерирования изображения путем компенсации движения объекта между целевым кадром кодирования и уже закодированным базовым кадром, вычисления межкадровой разницы между генерированным изображением и закодированным целевым кадром и кодирования сигнала разницы и вектора движения.

При кодировании многопроекционного видео высокая корреляция существует не только между кадрами в различные моменты фотографирования, но также и между кадрами с разных проекций. Таким образом, используется техника, называемая как прогнозирование с компенсацией расхождения, в которой вычисляется межкадровая разница между закодированным целевым кадром и изображением (кадром), генерированным путем компенсации расхождения между проекциями, а не движения, и кодируются сигнал разницы и вектор расхождения. Прогнозирование с компенсацией расхождения принято в международном стандарте как Приложение Н к Н.264 (см., например, непатентный документ 1).

Расхождение, используемое в настоящем документе, является разницей между местоположениями, в которых одно и то же местоположение объекта проецируется на плоскости изображения камер, установленных в различных местоположениях и направлениях. При прогнозировании с компенсацией расхождения кодирование выполняется путем представления его в качестве двухмерного вектора. Так как расхождение является информацией, генерированной в зависимости от местоположений проекции камер и расстояний (глубин) от камер до объекта, как изображено на фиг.7, то есть схема, использующая этот принцип, называемый как прогнозирование с синтезированием проекций (прогнозирование с интерполяцией проекций).

Прогнозирование с синтезированием проекций (прогнозирование интерполяцией проекций) является схемой, которая в качестве спрогнозированного изображения использует изображение, полученное путем синтезирования (интерполяции) кадра в другой проекции, которая подлежит процессу кодирования или декодирования с использованием части многопроекционного видео, которое уже было обработано и для которого получен результат декодирования, на основании трехмерного соотношения местоположения между камерами и объектом (например, см. непатентный документ 2). Обычно, чтобы представить трехмерное местоположение объекта, используется карта глубин (также называемая как образ дальностей, образ расхождений или карта расхождений), которая представляет расстояния (глубины) от камер до объекта для каждого пиксела. Дополнительно информация полигонов к карте глубин может быть использована соответствующая объекту, либо информация вокселов, соответствующая пространству объекта.

Необходимо отметить, что способы получения карты глубин приблизительно классифицированы как способ генерирования карты глубин путем измерения с помощью инфракрасных импульсов или тому подобного и способ генерирования карты глубин путем расчета глубины исходя из точек на многопроекционном видео, в которых сфотографирован один и тот же объект, с помощью принципа триангуляции. При прогнозировании с синтезированием проекций не является серьезной проблемой, какая именно из карт глубин, полученная этими способами, используется. Дополнительно, также не является серьезной проблемой, где был выполнен расчет, если при этом можно получить карту глубин.

Однако, в общем, когда выполняется предиктивное кодирование, если карта глубин, используемая на стороне кодирования, не равна карте глубин, используемой на стороне декодирования, происходит искажение кодирования, называемое отклонением. Таким образом, карта глубин, используемая на стороне кодирования, передается на сторону декодирования, либо используется способ, при котором сторона кодирования и сторона декодирования рассчитывают карты глубин с помощью полностью одних и тех же данных и методов.

При прогнозировании с компенсацией расхождения и прогнозировании с синтезированием проекций, если есть индивидуальная разница между откликами устройств формирования изображений из состава камер, если для каждой камеры выполняется регулировка усиления и/или коррекция градации яркости (гамма-корреляция), или если есть зависящий от направления эффект освещения в сцене, то эффективность кодирования снижается. Это происходит из-за того, что прогнозирование выполняется в предположении о том, что цвет объекта в закодированном целевом кадре совпадает с его цветом в базовом кадре.

В качестве схем, изученных для работы с такими изменениями в освещении и цвете объекта, используются компенсация освещения и коррекция цвета. Они являются схемами сохранения остатка прогнозирования, который должен быть закодирован, на низком уровне путем определения кадра, полученного путем коррекции освещения и цвета базового кадра в качестве кадра, используемого для прогнозирования. Н.264, раскрытый в непатентном документе 1, применяет взвешенное прогнозирование для выполнения коррекции с помощью линейной функции. Более того, также предложена другая схема для выполнения коррекции с помощью цветовой таблицы (например, см. непатентный документ 3).

Дополнительно, так как несоответствия в освещении и цвете объекта между камерами являются локальными и зависят от объекта, то существенно предпочтительно выполнять коррекцию с помощью локально различных параметров коррекции (параметров для коррекции). Более того, эти несоответствия генерируются вследствие не только одной лишь разницы в усилении или тому подобном, но также и более сложной модели, такой как разница в фокусе. Таким образом, предпочтительно использовать сложную модель коррекции, полученную путем моделирования процесса проекции или тому подобного, а не простую модель коррекции.

Дополнительно, чтобы справиться с локальными изменениями, необходимо подготовить множество наборов параметров коррекции. В общем, сложная модель коррекции представлена в качестве модели, имеющей большое число параметров. Таким образом, при подходе к передаваемым параметрам коррекции, хотя и возможно будет улучшить несоответствия, невозможно будет достигнуть высокой эффективности кодирования, потому что требуется высокий расход передачи битов (битрейт).

В качестве способа разрешения проблемы местного и сложного несоответствия без увеличения битрейта параметров коррекции существует техника расчета и применения параметров коррекции на стороне декодирования. Например, существует техника, которая предполагает, что один и тот же объект фотографируется в участке, соседнем с целевым блоком обработки, оцениваются параметры коррекции, которые минимизируют разницу между синтезированным из проекций изображением в соседнем участке и декодированным изображении, и используются рассчитанные параметры коррекции в качестве параметров коррекции для блока (например, см. непатентный документ 4). При такой схеме, так как не требуется передавать никакие параметры коррекции, даже когда общее число параметров коррекции увеличено, формируемый битрейт не увеличивается, если несоответствие можно сократить.

Документы уровня техники

Непатентные документы

Непатентный документ 1: Записан ITU-T H.264 "Advanced video coding for generic audiovisual services", Март 2009.

Непатентный документ 2: S. Shimizu, M. Kitahara, H. Kimata, K. Kamikura, и Y. Yashima, "View Scalable Multiview Video Coding Using 3-D Warping with Depth Map", Работа Института Инженеров по Электротехнике и Радиоэлектронике США по Интегральным схемам и Системе Видео Технологий, изд. 17, № 11, стр. 1485-1495, Ноябрь, 2007.

Непатентный документ 3: K. Yamamoto, M. Kitahara, H. Kimata, T. Yendo, T. Fujii, M. Tanimoto, S. Shimizu, K. Kamikura, и Y. Yashima, "Multiview Video Coding Using View Interpolation and Color Correction", Работа Института Инженеров по Электротехнике и Радиоэлектронике США по Интегральным схемам и Системе Видео Технологий, изд. 17, № 11, стр. 1436-1449, Ноябрь, 2007.

Непатентный документ 4: S. Shimizu, H. Kimata, и Y. Ohtani, "Adaptive Appearance Compensated View Synthesis Prediction for Multiview Video Coding", Труды Международной Конференции по обработке информации ICIP2009, стр. 2949-2952, Ноябрь 2009.

Раскрытие изобретения

Проблемы, решаемые с помощью изобретения

При вышеописанном уровне техники возможно корректировать несоответствие между камерами без кодирования параметров коррекции путем расчета параметров коррекции с помощью информации о соседнем блоке, на который можно ссылаться во время декодирования. Таким образом, возможно реализовать эффективное кодирование со сжатием многопроекционного видео.

Однако существует проблема, состоящая в том, что когда объект, отличный от такового в целевом блоке обработки, фотографируется в соседнем блоке, невозможно правильно скорректировать несоответствие для объекта, сфотографированного в целевом блоке обработки с помощью полученных параметров коррекции. Более того, дополнительно к проблеме, состоящей в том, что несоответствие не может быть скорректировано правильно, также существует вероятность того, что несоответствие, наоборот, увеличивается, а эффективность кодирования уменьшается.

В качестве решения этой проблемы, возможно легко придумать способ кодирования флагового индикатора, указывающего, следует ли выполнять коррекцию для каждого блока. Однако, хотя этот способ может предотвратить увеличение в несоответствии, невозможно значительно улучшить эффективность кодирования, так как необходимо кодировать флаговый индикатор.

Настоящее изобретение было создано с учетом этих обстоятельств и его задачей является обеспечение способа кодирования многопроекционного видео, способа декодирования многопроекционного видео, устройства кодирования многопроекционного видео, устройства декодирования многопроекционного видео и программы, которые могут реализовать эффективное кодирование/декодирование многопроекционного изображения и многопроекционного видеофильма без дополнительного кодирования/декодирования параметров коррекции даже для многопроекционного видео, имеющего локальные несоответствия в освещении и цвете между камерами.

Средство решения проблемы

Чтобы решить вышеописанные проблемы, первым аспектом настоящего изобретения является способ кодирования многопроекционного видео для кодирования многопроекционного видео, который включает в себя: этап генерирования синтезированного из проекций изображения для синтезирования из уже закодированного базового проекционного кадра, снятого с базовой проекции, отличной от целевой проекции кодирования многопроекционного видео, одновременно с целевым кадром кодирования в целевой проекции кодирования, синтезированного из проекций изображения, соответствующего целевому кадру кодирования в целевой проекции кодирования; этап расчета базового участка для поиска базового участка на уже закодированном базовом кадре в целевой проекции кодирования, соответствующего синтезированному из проекций изображению, для каждого участка элемента обработки, имеющего заранее определенный размер; этап расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка; этап коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и этап кодирования изображения для выполнения предиктивного кодирования видео в целевой проекции кодирования с помощью скорректированного синтезированного из проекций изображения.

Дополнительно, чтобы решить вышеописанные проблемы, вторым аспектом настоящего изобретения является способ кодирования многопроекционного видео для выполнения прогнозируемого кодирования, когда кодируется видео в целевой проекции кодирования многопроекционного видео, с помощью уже закодированного базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции кодирования, одновременно с целевым кадром кодирования в целевой проекции кодирования, и уже закодированного базового кадра в целевой проекции кодирования, при этом способ включает в себя: этап генерирования синтезированного из проекций изображения для синтезирования из базового проекционного кадра синтезированного из проекций изображения для целевого кадра кодирования в целевой проекции кодирования синтезированного из проекций изображения для базового кадра; этап расчета базового участка для поиска базового участка на синтезированном из проекций изображении для базового кадра, соответствующего синтезированному из проекций изображению для целевого кадра кодирования, для каждого участка элемента обработки, имеющего заранее определенный размер; этап расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра в той же позиции, что и базовый участок; этап коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и этап кодирования изображения для выполнения предиктивного кодирования видео в целевой проекции кодирования с помощью скорректированного синтезированного из проекций изображения.

Первый или второй аспект настоящего изобретения может дополнительно включать в себя этап настройки степени надежности для настройки степени надежности, указывающей определенность синтезированного из проекций изображения для каждого пиксела синтезированного из проекций изображения, и этап расчета базового участка может назначать вес затрате соответствия каждого пиксела, когда ищется базовый участок на базовом кадре, соответствующем синтезированному из проекций изображению, на основании степени надежности.

В первом или во втором аспекте настоящего изобретения, этап расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитывается параметр коррекции, на основании степени надежности.

Первый или второй аспект настоящего изобретения может дополнительно включать в себя этап настройки точности расчета для настройки точности расчета, указывающей, правильно ли был рассчитан базовый участок для каждого пиксела синтезированного из проекций изображения, и этап расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитывается параметр коррекции, на основании точности расчета и/или степени надежности.

Дополнительно, чтобы решить вышеописанные проблемы, третьим аспектом настоящего изобретения является способ декодирования многопроекционного видео для декодирования многопроекционного видео, который включает в себя: этап генерирования синтезированного из проекций изображения для синтезирования, из базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции декодирования многопроекционного видео, одновременно с целевым кадром декодирования в целевой проекции декодирования, синтезированного из проекций изображения, соответствующего целевому кадру декодирования в целевой проекции декодирования; этап расчета базового участка для поиска базового участка на уже декодированном базовом кадре в целевой проекции декодирования, соответствующего синтезированному из проекций изображению, для каждого участка элемента обработки, имеющего заранее определенный размер; этап расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка; этап коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и этап декодирования изображения для декодирования целевого кадра, который подлежал предиктивному кодированию в целевой проекции декодирования, из закодированных данных видео в целевой проекции декодирования, с использованием скорректированного синтезированного из проекций изображения в качестве сигнала прогнозирования.

Дополнительно, чтобы решить вышеописанные проблемы, четвертым аспектом настоящего изобретения является способ декодирования многопроекционного видео для декодирования многопроекционного видео, когда декодируется видео в целевой проекции декодирования многопроекционного видео, с помощью уже декодированного базового проекционного кадра, снятого в базовой проекции, отличной от целевой позиции декодирования, одновременно с целевым кадром декодирования в целевой проекции декодирования, и уже декодированного базового кадра в целевой проекции декодирования; при этом способ включает в себя: этап генерирования синтезированного из проекций изображения для синтезирования из базового проекционного кадра синтезированного из проекций изображения для целевого кадра декодирования в целевой проекции декодирования и синтезированного из проекций изображения для базового кадра; этап расчета базового участка для поиска базового участка на синтезированном из проекций изображении для базового кадра, соответствующего синтезированному из проекций изображению для целевого кадра декодирования, для каждого участка элемента обработки, имеющего заранее определенный размер; этап расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра в той же позиции, что и базовый участок; этап коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и этап декодирования изображения для декодирования целевого кадра, который подлежал предиктивному кодированию в целевой проекции декодирования, из закодированных данных видео в целевой проекции декодирования, с использованием скорректированного синтезированного из проекций изображения в качестве сигнала прогнозирования.

Третий или четвертый аспект настоящего изобретения может дополнительно включать в себя этап настройки степени надежности для настройки степени надежности, указывающей определенность синтезированного из проекций изображения для каждого пиксела синтезированного из проекций изображения, а этап расчета базового участка может назначать вес затрате соответствия каждого пиксела, когда ищется базовый участок на базовом кадре, соответствующем синтезированному из проекций изображению, на основании степени надежности.

В третьем или четвертом аспекте настоящего изобретения, этап расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитывается параметр коррекции, на основании степени надежности.

Третий или четвертый аспект настоящего изобретения может дополнительно включать в себя этап настройки точности расчета для настройки точности расчета, указывающей, правильно ли был рассчитан базовый участок для каждого пиксела синтезированного из проекций изображения, а этап расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитывается параметр коррекции, на основании точности расчета и/или степени надежности.

Чтобы решить вышеописанные проблемы, пятым аспектом настоящего изобретения является устройство кодирования многопроекционного видео для кодирования многопроекционного видео, которое включает в себя: средство генерирования синтезированного из проекций изображения для синтезирования из уже закодированного базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции кодирования многопроекционного видео, одновременно с целевым кадром кодирования в целевой проекции кодирования, синтезированного из проекций изображения, соответствующего целевому кадру кодирования в целевой проекции кодирования; средство расчета базового участка для поиска базового участка на уже закодированном базовом кадре в целевой проекции кодирования, соответствующего синтезированному из проекций изображению, синтезированному средством генерирования синтезированного из проекций изображения для каждого участка элемента обработки, имеющего заранее определенный размер; средство расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка, который искало средство расчета базового участка; средство коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции, рассчитанного средством расчета параметра коррекции; и средство кодирования изображения для выполнения предиктивного кодирования видео в целевой проекции кодирования с помощью синтезированного из проекций изображения, скорректированного средством коррекции синтезированного из проекций изображения.

Пятый аспект настоящего изобретения может дополнительно включать в себя средство настройки степени надежности для настройки степени надежности, указывающей определенность синтезированного из проекций изображения для каждого пиксела синтезированного из проекций изображения, синтезированного средством генерирования синтезированного из проекций изображения, а средство расчета базового участка может назначать вес затрате соответствия каждого пиксела, когда ищется базовый участок на базовом кадре, соответствующем синтезированному из проекций изображению, на основании степени надежности, настроенной средством настройки степени надежности.

В пятом аспекте настоящего изобретения, средство расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитан параметр коррекции, на основании степени надежности, настроенной средством настройки степени надежности.

Пятый аспект настоящего изобретения может дополнительно включать в себя средство настройки точности расчета для настройки точности расчета, указывающей, правильно ли был рассчитан базовый участок для каждого пиксела синтезированного из проекций изображения, синтезированного средством генерирования синтезированного из проекций изображения, а средство расчета параметра коррекции может назначать вес затрате соответствия каждого пиксела, когда рассчитан параметр коррекции, на основании точности расчета, настроенной средством настройки точности расчета, и/или степени надежности, настроенной средством настройки степени надежности.

Чтобы решить вышеописанные проблемы, шестым аспектом настоящего изобретения является устройство декодирования многопроекционного видео для декодирования многопроекционного видео, которое включает в себя: средство генерирования синтезированного из проекций изображения для синтезирования из базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции декодирования многопроекционного видео, одновременно с целевым кадром декодирования в целевой проекции декодирования, синтезированного из проекций изображения, соответствующего целевому кадру декодирования в целевой проекции декодирования; средство расчета базового участка для поиска базового участка на уже декодированном базовом кадре в целевой проекции кодирования, соответствующего синтезированному из проекций изображению, синтезированному средством генерирования синтезированного из проекций изображения, для каждого участка элемента обработки, имеющего заранее определенный размер; средство расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка, который искало средство расчета базового участка; средство коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции, рассчитанного средством расчета параметра коррекции; и средство декодирования изображения для декодирования целевого кадра декодирования, который подлежал предиктивному кодированию в целевой проекции декодирования, с использованием синтезированного из проекций изображения, скорректированного средством коррекции синтезированного из проекций изображения, в качестве сигнала прогнозирования.

Чтобы решить вышеописанные проблемы, седьмым аспектом настоящего изобретения является программа, побуждающая компьютер устройства кодирования многопроекционного видео для кодирования многопроекционного видео выполнять: функцию генерирования синтезированного из проекций изображения для синтезирования из уже закодированного базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции кодирования многопроекционного видео, одновременно с целевым кадром кодирования в целевой проекции кодирования, синтезированного из проекций изображения, соответствующего целевому кадру кодирования в целевой проекции кодирования; функцию расчета базового участка для поиска базового участка на уже закодированном базовом кадре в целевой проекции кодирования, соответствующего синтезированному из проекций изображению для каждого участка элемента обработки, имеющего заранее определенный размер; функцию расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка; функцию коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и функцию кодирования изображения для выполнения предиктивного кодирования видео в целевой проекции кодирования с помощью скорректированного синтезированного из проекций изображения.

Чтобы решить вышеописанные проблемы, восьмым аспектом настоящего изобретения является программа, побуждающая компьютер устройства декодирования многопроекционного видео для декодирования многопроекционного видео выполнять: функцию генерирования синтезированного из проекций изображения для синтезирования, из базового проекционного кадра, снятого в базовой проекции, отличной от целевой проекции декодирования многопроекционного видео, одновременно с целевым кадром декодирования в целевой проекции декодирования, синтезированного из проекций изображения, соответствующего целевому кадру декодирования в целевой проекции декодирования; функцию расчета базового участка для поиска базового участка на уже декодированном базовом кадре в целевой проекции декодирования, соответствующего синтезированному из проекций изображению для каждого участка элемента обработки, имеющего заранее определенный размер; функцию расчета параметра коррекции для расчета параметра коррекции для коррекции несоответствия между камерами исходя из синтезированного из проекций изображения для участка элемента обработки и базового кадра для базового участка; функцию коррекции синтезированного из проекций изображения для коррекции синтезированного из проекций изображения для участка элемента обработки с помощью рассчитанного параметра коррекции; и функцию декодирования изображения для декодирования целевого кадра декодирования, который подлежал прогнозируемому кодированию в целевой проекции декодирования, из уже закодированных данных видео в целевой проекции декодирования с использованием скорректированного синтезированного из проекций изображения в качестве сигнала прогнозирования.

Преимущественные эффекты настоящего изобретения

Благодаря настоящему изобретению возможно осуществить эффективное кодирование/декодирование многопроекционного изображения и многопроекционного видеофильма без дополнительного кодирования/декодирования параметров коррекции, даже когда локально образуются несоответствия в освещении и/или цвете между камерами.

Краткое описание чертежей

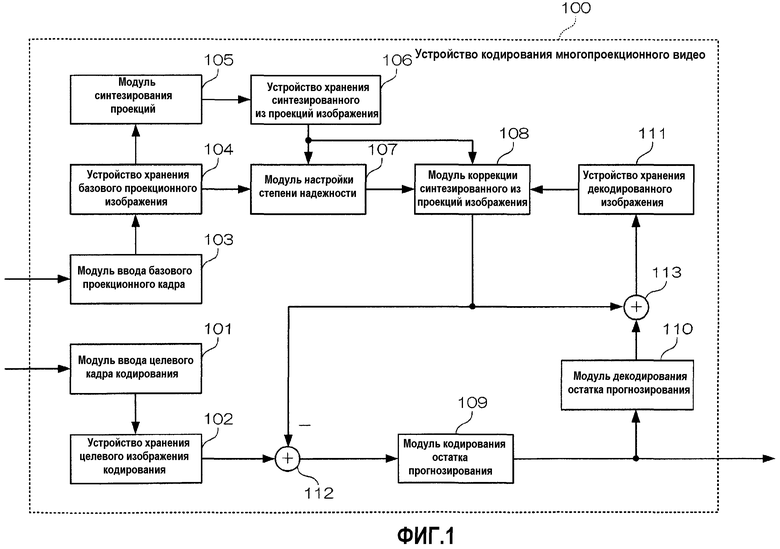

Фиг.1 является структурной схемой, изображающей конфигурацию устройства кодирования многопроекционного видео в первом воплощении настоящего изобретения.

Фиг.2 является структурной схемой, изображающей конфигурацию модуля 108 коррекции синтезированного из проекций изображения из состава устройства 100 кодирования многопроекционного видео в первом воплощении.

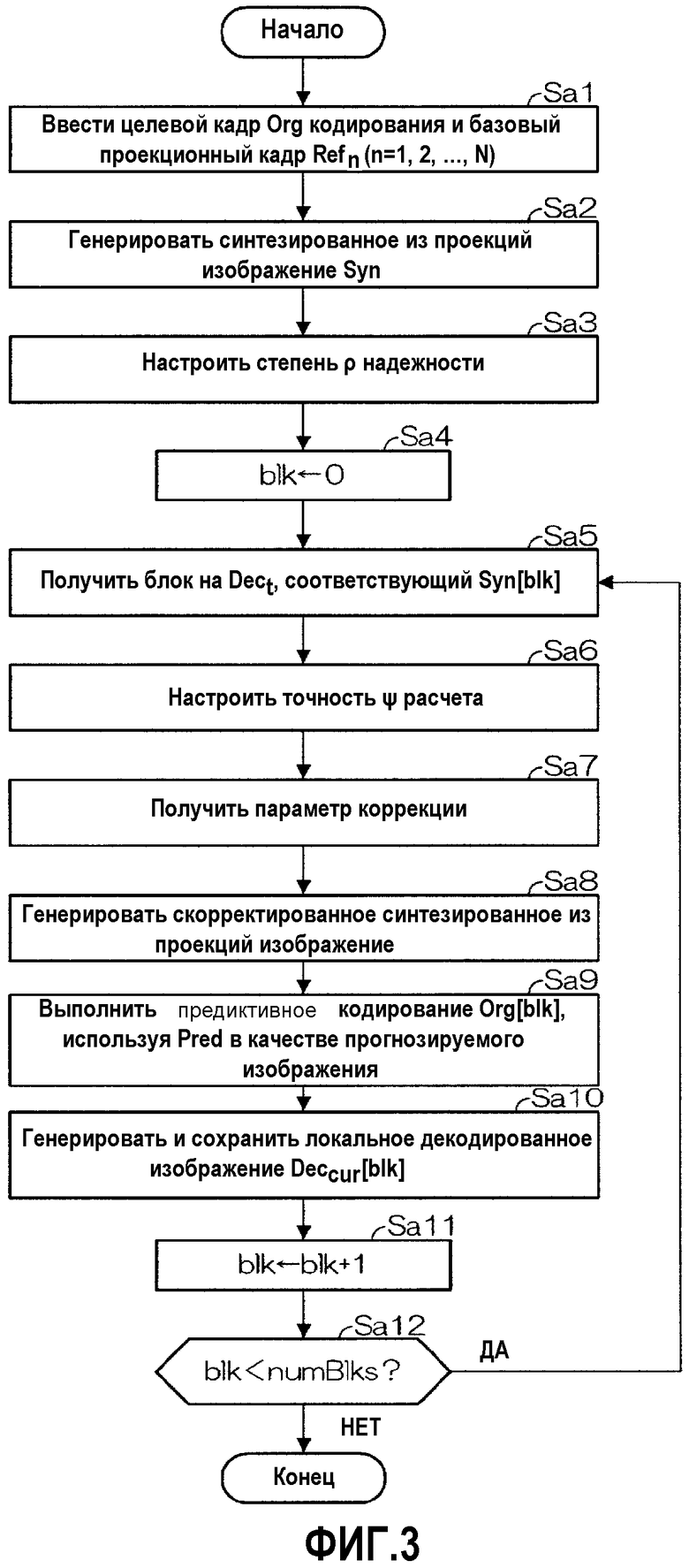

Фиг.3 является логической блок-схемой, описывающей работу устройства 100 кодирования многопроекционного видео в первом воплощении.

Фиг.4 является структурной схемой, изображающей конфигурацию устройства декодирования многопроекционного видео во втором воплощении настоящего изобретения.

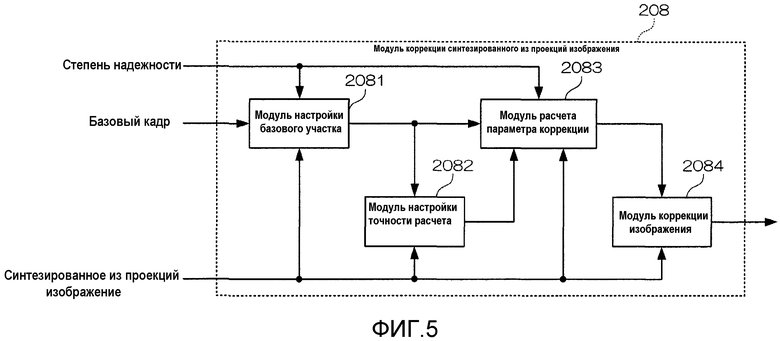

Фиг.5 является структурной схемой, изображающей конфигурацию модуля 208 коррекции синтезированного из проекций изображения из способа устройства 200 декодирования многопроекционного видео во втором воплощении.

Фиг.6 является логической блок-схемой, описывающей работу устройства 200 декодирования многопроекционного видео во втором воплощении.

Фиг.7 является концептуальной диаграммой, изображающей расхождение, образованное между камерами согласно предшествующему уровню техники.

Осуществление изобретения

В воплощениях настоящего изобретения, соответствующий участок на уже закодированном кадре, соответствующий обрабатываемому в данный момент участку, получают с помощью сгенерированного синтезированного из проекций изображения, и яркость и/или цвет синтезированного из проекций изображения корректируют, используя в качестве эталона видеосигнал соответствующего участка в закодированном кадре. В воплощениях настоящего изобретения, параметр коррекции получают исходя из предположения, что несоответствия в цвете и яркости, которые зависят от объекта, не имеют большого изменения во времени, а не из используемого в предшествующем уровне техники предположения о том, что один и тот же объект фотографируется в соседнем участке. В общем, обязательно есть участок, где традиционное предположение не работает, так как кадр включает в себя множество объектов. Наоборот, воплощения настоящего изобретения эффективно работают, так как несоответствие не изменяется со временем до тех пор, пока сцена внезапно не изменится вследствие смены сцены или тому подобного. То есть, возможно выполнять коррекцию по сокращению несоответствия даже для участка, для которого традиционная методика не может выполнить коррекцию, и возможно осуществить эффективное кодирование многопроекционного видео.

Здесь и далее, воплощения настоящего изобретения будут описаны со ссылкой на чертежи.

Необходимо отметить, что в последующем описании информация (значение координаты или индекс, который можно отнести к значению координаты) которая может задавать положение, и которая вставлена между символами [], прикрепляется к видео (кадру), тем самым представляя видеосигнал, дискретизованный по отношению к пикселу в этом положении.

А. Первое воплощение

Во-первых, будет описано первое воплощение настоящего изобретения.

Фиг.1 является структурной схемой, изображающей конфигурацию устройства кодирования многопроекционного видео в первом воплощении настоящего изобретения. На фиг.1 устройство 100 кодирования многопроекционного видео оснащено модулем 101 ввода целевого кадра кодирования, устройством 102 хранения (памятью) целевого изображения кодирования, модулем 103 ввода базового проекционного изображения, устройством 104 хранения базового проекционного изображения, модулем 105 синтезирования проекций, устройством 106 хранения синтезированного из проекций изображения, модулем 107 настройки степени надежности, модулем 108 коррекции синтезированного из проекций изображения, модулем 109 кодирования остатка прогнозирования, модулем 110 декодирования остатка прогнозирования, устройством 111 хранения декодированного изображения, модулем 112 вычисления остатка прогнозирования и модулем 113 вычисления декодированного изображения.

Модуль 101 ввода целевого кадра кодирования вводит видео кадр (целевой кадр кодирования), служащий в качестве цели (т.е. целевого объекта) кодирования. Устройство 102 хранения целевого изображения кодирования хранит введенный целевой кадр кодирования. Модуль 103 ввода базового проекционного изображения вводит базовый видео кадр (базовый проекционный кадр) для проекции (базовой проекции), отличной от проекции целевого кадра кодирования. Устройство 104 хранения базового проекционного изображения хранит введенный базовый проекционный кадр. Модуль 105 синтезирования проекций генерирует синтезированное из проекций изображение, соответствующее целевому кадру кодирования, с использованием базового проекционного кадра. Устройство 106 хранения синтезированного из проекций изображения хранит сгенерированное синтезированное из проекций изображение.

Модуль 107 настройки степени надежности настраивает степень надежности каждого пиксела сгенерированного синтезированного из проекций изображения. Модуль 108 коррекции синтезированного из проекций изображения корректирует несоответствие между камерами синтезированного из проекций изображения и выводит скорректированное синтезированное из проекций изображение. Модуль 112 вычисления остатка прогнозирования генерирует разницу (сигнал остатка прогнозирования) между целевым кадром кодирования и скорректированным синтезированным из проекций изображением. Модуль 109 кодирования остатка прогнозирования кодирует сгенерированный сигнал остатка прогнозирования и выводит закодированные данные. Модуль 110 декодирования остатка прогнозирования выполняет декодирование закодированных данных сигнала остатка прогнозирования. Модуль 113 вычисления декодированного изображения генерирует декодированное изображение целевого кадра кодирования путем сложения декодированного сигнала остатка прогнозирования и скорректированного синтезированного из проекций изображения. Устройство 111 хранения декодированного изображения сохраняя сгенерированное декодированное изображение.

Фиг.2 является структурной схемой, изображающей конфигурацию модуля 108 коррекции синтезированного из проекций изображения из состава устройства 100 кодирования многопроекционного видео в первом воплощении. На фиг.2 модуль 108 коррекции синтезированного из проекций изображения оснащен модулем 1081 настройки базового участка, который ищет блок на базовом кадре, соответствующий целевому блоку кодирования, используя синтезированное из проекций изображение в качестве базового участка; модулем 1082 настройки точности расчета, который настраивает точность расчета, указывающую, точно ли был настроен соответствующий участок для каждого пиксела базового участка; модулем 1083 расчета параметра коррекции, который рассчитывает параметр коррекции несоответствия между камерами в синтезированном из проекций изображении; и модулем 1084 коррекции изображения, который корректирует синтезированное из проекций изображение на основании полученного параметра коррекции.

Фиг.3 является логической блок-схемой, описывающей работу устройства 100 кодирования многопроекционного видео в первом воплощении. Процесс, выполняемый устройством 100 кодирования многопроекционного видео, будет описан более подробно на основании этой логической блок-схемы.

Во-первых, целевой кадр Org кодирования вводится модулем 101 ввода целевого кадра кодирования и сохраняется в устройстве 102 хранения целевого изображения кодирования (этап Sa1). Дополнительно, базовый целевой кадр Ref n (n=1, 2, …, N), снятый с базовой проекции одновременно с целевым кадром Org кодирования, вводится модулем 103 ввода базового проекционного кадра и сохраняется в устройстве 104 хранения базового проекционного изображения (этап Sa1). Здесь предполагается, что введенный базовый проекционный кадр получен путем декодирования уже закодированного изображения. Это делается для того, чтобы предотвратить генерирование шума кодирования, такого как дрейф, используя одну и ту же информацию в качестве информации, которая может быть получена в устройстве декодирования. Однако, когда генерирование шума кодирования разрешено, еще до кодирования может быть введено оригинальное изображение. Необходимо отметить, что n является индексом, указывающим базовую проекцию, а N является количеством доступных базовых проекций.

Далее, модуль 105 синтезирования проекций синтезирует изображение, снятое с той же проекции, одновременно с целевым кадром кодирования, из информации базового проекционного кадра и сохраняя сгенерированное синтезированное из проекций изображение Syn в устройстве 106 хранения синтезированного из проекций изображения (этап Sa2). Любой способ может быть использован в качестве способа генерирования синтезированного из проекций изображения Syn. Например, если информация глубин для базового проекционного кадра дается в дополнение к видео информации базового проекционного кадра, то возможно использовать технику, раскрытую в непатентном документе 2, описанном выше, непатентном документе 5 (Y. Mori, N. Fukushima, T. Fujii, и M. Tanimoto, "View Generation with 3D Warping Using Depth Information for FTV", Труды 3DTV-CON2008, стр. 229-232, Май 2008) или тому подобном.

Дополнительно, если получена информация глубин для целевого кадра кодирования, то также возможно использовать технику, раскрытую в непатентном документе 6 (S.Yea и A. Vetro, "View Synthesis Prediction for Rate-Overhead Reduction in FTV", Труды 3DTV-CON2008, стр. 145-148, Май 2008) или тому подобном. Если информация глубин не получена, то можно генерировать синтезированное из проекций изображение путем применения вышеописанной техники после создания информации глубин для базового проекционного кадра или целевого кадра кодирования, используя технику, называемую также стерео способом или способом расчета глубин, раскрытую в непатентном документе 7 (J. Sun, N. Zheng и H. Shum, "Stereo Matching Using Belief Propagation", Работы Института Инженеров по Электротехнике и Радиоэлектронике США по Анализу Конфигурации и Искусственному интеллекту, изд. 25, № 7, с. 787-800, Июль 2003) или тому подобном (непатентный документ 8: S. Shimizu, Y. Tonomura, H. Kimata and Y. Ohtani, "Improved View Interpolation Prediction for Side Information in Multiview Distributed Video Coding", Труды ICDSC2009, Август 2009). Также, есть способ для прямого генерирования синтезированного из проекций изображения из базового кадра без явного генерирования информации глубин (непатентный документ 3, описанный выше).

Также необходимо отметить, что при применении этих техник, как правило, требуются параметры камер, которые представляют позиционное отношение между камерами и процессами проекции камер. Эти параметры камеры могут также быть рассчитаны из базового проекционного кадра.

Далее, модуль 107 настройки степени надежности генерирует степень ρ надежности, указывающую определенность того, что можно было осуществить синтезирование для каждого пиксела синтезированного из проекций изображения (Sa3). В первом воплощении предполагается, что степень ρ надежности является действительным числом от 0 до 1; однако, степень надежности может быть представлена любым образом, при условии, что чем выше значение, тем выше степень надежности. Например, степень надежности может быть представлена в качестве 8-битного целого числа, которое больше или равно 1.

Как и степень ρ надежности, любая степень надежности может быть использована, лишь бы она могла указывать, насколько точно было выполнено синтезирование, как описано выше. Например, самый простой способ включает в себя применение значения дисперсии значений пикселов, соответствующих пикселам на базовом проекционном кадре, от соответствующих пикселов на синтезированном из проекций изображении. Чем ближе значения пикселов к соответствующим пикселам, тем выше точность того, что синтезирование было выполнено, так как можно было идентифицировать один и тот же объект, и, тем самым, чем меньше дисперсия, тем выше степень надежности. То есть степень надежности представлена обратным значением дисперсии. Когда пиксел каждого базового проекционного кадра, используемый для синтезирования синтезированного из проекций изображения Syn[p], обозначается как Ref n[p n], то возможно представить степень надежности с помощью следующих уравнений (1) или (2).

[Формула 1]

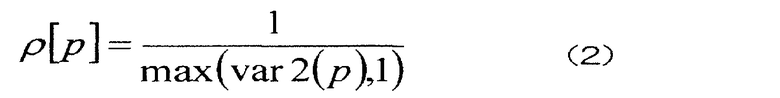

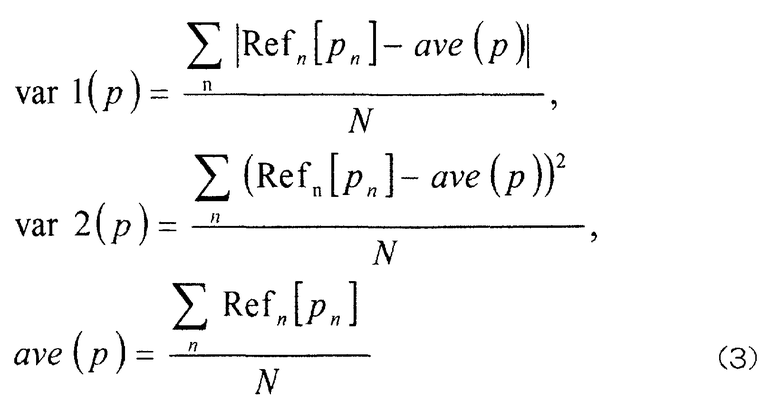

[Формула 2]

Так как минимальное значение дисперсии равно 0, то необходимо определить степень надежности с помощью функции max. Необходимо отметить, что max является функцией, которая возвращает максимальное значение для заданного множества. Дополнительно, другие функции также представлены следующими уравнениями (3).

[Формула 3]

Дополнительно к дисперсии также есть способ с использованием разницы diff(p) между максимальным значением и минимальным значением пикселов соответствующего базового проекционного кадра, представленной следующим уравнением (4). Дополнительно, степень надежности может быть определена с помощью экспоненциальной функции, как изображено в следующем уравнении (4)', вместо обратного значения дисперсии. Необходимо отметить, что функция f может быть любой из var 1, var 2 и diff, описанных выше. В таком случае, возможно определить степень надежности даже тогда, когда 0 включен в диапазон функции f.

[Формула 4]

Хотя эти способы просты, оптимальная степень надежности не получается постоянно, так как формирование освещенности не учитывается. Соответственно, при учете формирования освещенности базовый проекционный кадр может быть кластеризован на основании значения пикселов соответствующих пикселов, и значение дисперсии или разницы между максимальным значением и минимальным значением может быть вычислено и использовано для значений пикселов соответствующих пикселов базового проекционного кадра, которые принадлежат к самому большому кластеру.

Дополнительно, в качестве другого способа, степень надежности может быть определена с помощью значения вероятности, соответствующего величине ошибки каждого пиксела, полученного с помощью diff уравнения (4), описанного выше, или тому подобного, предполагая, что ошибки между соответствующими точками проекций следуют нормальному распределению или распределению Лапласа, и используя среднее значение или значение дисперсии распределения в качестве параметра. В таком случае, модель распределения, его среднее значение и его значение дисперсии, которые заранее определены, могут быть использованы либо информация об используемой модели может быть закодирована и передана. В общем, если объект имеет однородное диффузное отражение, то среднее значение распределения может быть теоретически рассмотрено как 0 и, таким образом, модель может быть упрощена.

Дополнительно, если предположить, что величина ошибки значения пиксела соответствующего пиксела минимизирована в окрестности глубины, на которой получена соответствующая точка при генерировании синтезированного из проекций изображения, то возможно использовать способ для расчета модели распределения ошибки исходя из изменения в величине ошибки, когда глубина ежеминутно меняется, и для определения степени надежности с помощью самой модели распределения ошибки либо значения, основанного на модели распределения ошибки, и значения пиксела соответствующего пиксела на базовом проекционном кадре, когда генерируется синтезированное из проекций изображение.

В качестве определения с применением только модели распределения ошибки, есть способ определения степени надежности как вероятности того, что ошибка будет в заданном диапазоне, когда вероятность того, что ошибка генерируется, следует распределению ошибки. В качестве определения с применением модели распределения ошибки и значения пиксела соответствующего пиксела на базовом проекционном кадре, когда генерируется синтезированное из проекций изображение, есть способ для предположения, что вероятность того, что ошибка генерируется, следует рассчитанному распределению ошибки, и для определения степени надежности в качестве вероятности того, что происходит ситуация, представленная значением пиксела соответствующего пиксела на базовом проекционном кадре, когда генерируется синтезированное из проекций изображение.

Дополнительно, в качестве другого способа, значение вероятности для расхождения (глубины), полученное с помощью техники (непатентный документ 7, описанный выше), называемой предположительное распространение, когда рассчитывается расхождение (глубина), которое необходимо для выполнения синтезирования проекций и может быть использовано в качестве степени надежности. Дополнительно к предположительному распространению, в случае алгоритма расчета глубин, который внутренне вычисляет определенность решения для каждого пиксела синтезированного из проекций изображения, возможно использовать эту информацию в качестве степени надежности.

Если выполняется соответствующий поиск точки, стерео способ или расчет глубин, когда генерируется синтезированное из проекций изображение, то часть процесса получения информации соответствующей точки или информации глубин может быть такой же, что и часть вычисления степеней надежности. В таких случаях, возможно сократить объем вычислений путем одновременного выполнения генерирования синтезированного из проекций изображения и вычисления степени надежности.

Когда вычисление степеней надежности завершается, целевой кадр кодирования разделяется на блоки и кодируется видеосигнал целевого кадра кодирования, при этом выполняется коррекция несоответствия между камерами синтезированного из проекций изображения с помощью модуля 108 коррекции синтезированного из проекций изображения для каждого участка (этапы от Sa4 до Sa12). То есть, когда индекс целевого блока кодирования обозначается как blk, а общее число целевых блоков кодирования обозначается как numBlks, то после того, как blk инициализирован в 0 (этап Sa4), то следующий процесс (этапы от Sa5 до Sa10) итерационно повторяется до тех пор, пока blk не станет равно numBlks (этап Sa12), при этом blk увеличивается на 1 (этап Sa11).

Необходимо отметить, что если возможно выполнить генерирование синтезированного из проекций изображения и вычисление степени надежности, описанное выше, для каждого целевого блока кодирования, то эти процессы могут также быть выполнены как часть процесса, итерационно повторяемого для каждого целевого блока кодирования. Например, это включает в себя случай, когда дана информация глубины для целевого блока кодирования.

При процессе, повторяемом для каждого целевого блока кодирования, во-первых, модуль 1081 настройки базового участка находит базовый участок, который является блоком на базовом кадре, соответствующим блоку blk, с помощью генерирования синтезированного из проекций изображения (этап Sa5). Здесь, базовый кадр является локальным декодированным изображением, полученным путем выполнения декодирования данных, которые уже закодированы. Данные локального декодированного изображения являются данными, хранящимися в устройстве 111 хранения декодированного изображения.

Необходимо отметить, что локальное декодированное изображение используется для того, чтобы предотвратить генерирование искажения кодирования, называемого дрейфом, с помощью тех же данных, что и данные, которые можно получить в то же время на стороне декодирования. Если формирование искажения кодирования разрешено, то возможно использовать введенный кадр, закодированный до целевого кадра кодирования, вместо локального декодированного изображения.

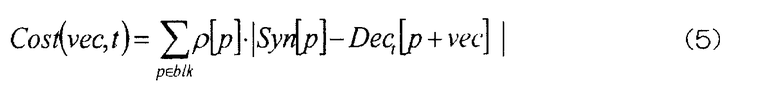

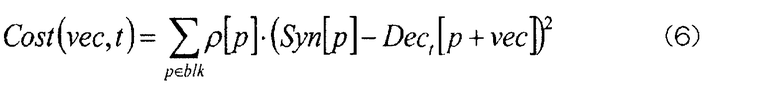

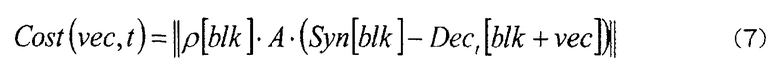

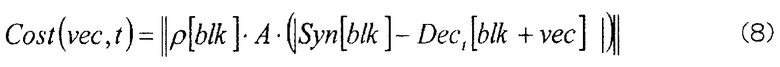

Процесс получения базового участка является процессом получения соответствующего блока, который максимизирует критерий согласия либо минимизирует степень отклонения на локальном декодированном изображении, хранящемся в устройстве 11 хранения декодированного изображения, используя синтезированное из проекций изображение Syn[blk] в качестве шаблона. В первом воплощении, используется затрата соответствия, указывающая степень отклонения. Следующие уравнения (5) и (6) являются конкретными примерами затраты соответствия, указывающей степень отклонения.

[Формула 5]

[Формула 6]

Здесь, vec является вектором между соответствующими блоками, а t является значением индекса, указывающим одно из локальных декодированных изображений Dec, хранящихся в устройстве 111 хранения декодированного изображения. Дополнительно к этому, есть способ, использующий значение, полученное путем преобразования значения разницы между синтезированным из проекций изображением и локальным декодированным изображением с помощью дискретного косинусного преобразования (DCT), преобразования Адамара или тому подобного. Когда преобразование обозначается матрицей А, оно может быть представлено следующим уравнением (7) или (8). Также необходимо отметить, что ||X|| обозначает норму Х.

[Формула 7]

[Формула 8]

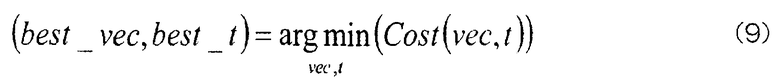

То есть пара (best_vec, best_t), представленная следующим уравнением (9), получена с помощью этих процессов получения блока, который минимизирует затраты соответствия. Здесь, argmin обозначает процесс получения параметра, который минимизирует заданную функцию. Набор параметров, который надо извлечь, является набором, изображенным под argmin.

[Формула 9]

Любой способ может быть использован в качестве способа определения количества кадров для поиска, диапазона поиска, порядка поиска и завершения поиска. Однако необходимо использовать те же, что и на стороне декодирования, что выполнить декодирование точно. Необходимо отметить, что способ диапазона поиска и завершения существенно влияют на издержки вычисления. В качестве способа, обеспечивающего высокую точность соответствия с использованием меньшего диапазона поиска, есть способ правильной настройки центра поиска. В качестве примера, есть способ настройки, в качестве центра поиска, соответствующей точки, представленной вектором движения, который используется в соответствующем участке на базовом проекционном кадре.

Дополнительно, в качестве другого способа сокращения издержек вычисления, требуемого для поиска на стороне декодирования, есть способ ограничения целевого кадра для поиска. Способ определения целевого кадра для поиска может быть определен заранее. Например, это включает в себя способ определения кадра, для которого кодирование недавно завершилось, в качестве цели поиска. Дополнительно, в качестве другого способа ограничения целевого кадра поиска, есть способ для кодирования информации, указывающей, какой кадр является целью, и для уведомления стороны декодирования о закодированной информации. В таком случае, необходимо, чтобы сторона для декодирования имела механизм для декодирования информации, такой как значение индекса, указывающего целевой кадр поиска, и для определения на его основе целевого кадра поиска.

В первом воплощении, получается один блок, соответствующий целевому блоку blk кодирования. Однако необходимые данные - это значение прогнозирования видеосигнала целевого блока кодирования, представленного с помощью видеосигнала кадра, отличного во временном отношении. Таким образом, видеосигнал, созданный путем получения пикселов, соответствующих соответственным пикселам в целевом блоке blk кодирования, и их расположения так, чтобы сформировать блок, может быть использован в качестве базового участка. Дополнительно, множество блоков, соответствующих целевому блоку blk кодирования, могут быть установлены, и видеосигнал, представленный средним значением видеосигналов множества блоков, может быть использован в качестве базового участка. При этом, когда шум наложен на целевой кадр поиска и когда точность поиска низка, возможно сократить их влияние и настроить базовый участок более точно.

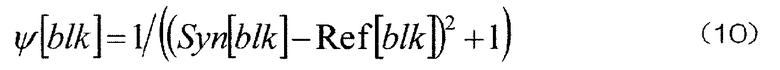

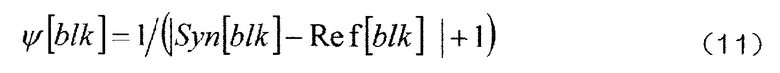

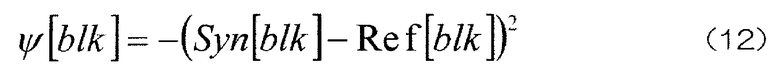

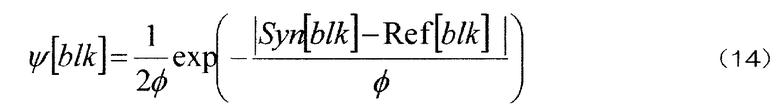

Когда базовый участок Ref[blk] (Dec t[blk+vec]) определен, модуль 1082 настройки точности расчета настраивает точность ψ расчета, указывающую, насколько точно базовый участок был получен для каждого базового участка Ref[blk] (этап Sa6). Хотя любое значение может быть использовано для точности расчета, можно использовать значение, зависящее от величины ошибки между соответствующими пикселами в синтезированном из проекций изображении и базовом кадре. Например, есть обратное значение среднеквадратичной ошибки или обратное значение абсолютного значения ошибки, представленное уравнением (10) или (11), и отрицательное значение среднеквадратичной ошибки или отрицательное значение абсолютного значения ошибки, представленное уравнением (12) или (13). Дополнительно, в качестве другого примера, вероятность, соответствующая разнице между сигналами изображения полученных соответствующих пикселов, может быть использована в качестве точности расчета, при этом предполагается, что ошибка следует распределению Лапласа или тому подобному. Параметры распределения Лапласа или тому подобного могут быть даны отдельно, либо они могут быть рассчитаны из распределения ошибок, вычисленного, когда рассчитывается базовый участок. Уравнение (14) является примером, в котором используется распределение Лапласа, имеющее среднее значение 0, а ϕ является параметром.

[Формула 10]

[Формула 11]

[Формула 12]

[Формула 13]

[Формула 14]

Когда настройка точности расчета завершена, модуль 1083 расчета параметра коррекции рассчитывает параметры коррекции для коррекции синтезированного из проекций изображения Syn[blk] (этап Sa7). Хотя может быть использован любой способ коррекции и любой способ расчета параметров коррекции, необходимо использовать те же способы, что и способы, которые используются на стороне кодирования.

Примерами способов коррекции являются коррекция с помощью значения смещения, коррекция с помощью линейной функции и гамма коррекция. Когда значение до коррекции обозначается как in, а значение после коррекции обозначается как out, то они могут быть представлены следующими уравнениями (15), (16) и (17).

[Формула 15]

[Формула 16]

[Формула 17]

В этих примерах, offset, (α, β) и (γ, a, b) являются параметрами коррекции.

Если предположить, что сигнал изображения объекта, сфотографированного в целевом блоке blk кодирования, не изменяется со временем, то значение до коррекции является сигналом изображения синтезированного из проекций изображения, а идеальное значение после коррекции является сигналом изображения базового участка. То есть высокоточная коррекция может быть выполнена путем получения параметров коррекции, так что затраты соответствия, представленные степенью отклонения между этими двумя сигналами изображения, малы. Необходимо отметить, что когда затраты соответствия представлены качеством соответствия между двумя сигналами изображения, параметры получаются так, чтобы максимизировать затраты соответствия.

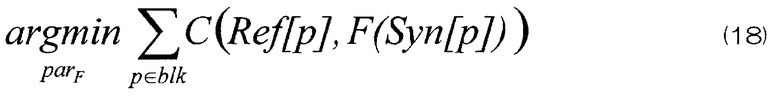

То есть когда функция, представляющая процесс коррекции, обозначается как F, и функция затрат соответствия, представляющая степень отклонения между двумя сигналами изображения, обозначена как С, то процесс получения параметров коррекции может быть представлен следующим уравнением (18).

[Формула 18]

Здесь, par обозначает набор параметров коррекции способа F коррекции, а argmin обозначает процесс получения параметров, которые минимизируют заданную функцию. Набором параметров, который должен быть получен, является набор, который показан под argmin.

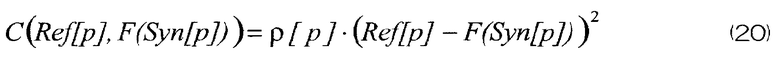

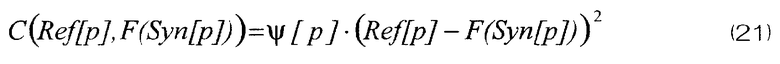

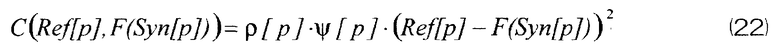

Хотя могут быть использованы любые затраты соответствия, например, можно использовать квадрат разницы между двумя сигналами. Дополнительно, в затратах соответствия взвешивание может быть выполнено для каждого пиксела с помощью степеней надежности синтезированного из проекций изображения, точности расчета базового участка или и того, и другого. В случае, когда квадрат разницы между двумя сигналами используется в качестве степени отклонения, то следующие уравнения (19), (20), (21) и (22) представляют примеры функции затрат соответствия, когда взвешивание не выполняется, когда взвешивание выполняется с помощью степени надежности синтезированного из проекций изображения, когда взвешивание выполняется с помощью точности расчета базового участка, и когда взвешивание выполняется с помощью как степени надежности синтезированного из проекций изображения, так и с помощью точности расчета базового участка, соответственно.

[Формула 19]

[Формула 20]

[Формула 21]

[Формула 22]

Например, когда уравнение (22) используется в качестве функции затрат соответствия в коррекции с помощью значения смещения, можно получить offset с помощью следующего уравнения (23).

[Формула 23]

Когда коррекция выполняется с помощью линейной функции, можно получить параметры, которые минимизируют среднеквадратичную ошибку, с помощью метода наименьших квадратов.

Необходимо отметить, что эти параметры коррекции могут быть определены для каждого сигнала яркости и для каждого сигнала цветности, либо они могут быть определены для каждого канала цвета, такого как RGB (красный-зеленый-синий). Дополнительно, можно подразделить каждый канал и выполнить другую коррекцию для каждого фиксированного диапазона (например, коррекция выполняется с помощью других параметров коррекции в диапазоне от 0 до 127 и диапазоне от 128 до 255 красного (R) канала).

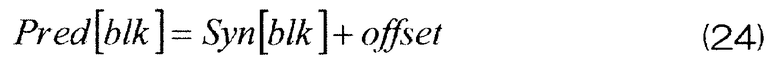

Когда расчет параметров коррекции завершен, модуль 1084 коррекции параметров корректирует синтезированное из проекций изображение для блока blk, на основании параметров коррекции, и генерирует скорректированное синтезированное из проекций изображение Pred (этап Sa8). При таком процессе синтезированное из проекций изображение является вводом в модель коррекции, которой предназначены параметры коррекции. Например, когда коррекция выполняется с использованием значения смещения, скорректированное синтезированное из проекций изображение Pred генерируется с помощью следующего уравнения (24).

[Формула 24]

Когда коррекция синтезированного из проекций изображения блока blk завершена, целевой кадр Org[blk] кодирования подлежит предиктивному кодированию с использованием скорректированного синтезированного из проекций изображения Pred в качестве прогнозируемого изображения (этап Sa9). То есть модуль 112 расчета остатка прогнозирования генерирует разницу между целевым кадром Org[blk] кодирования и скорректированным синтезированным из проекций изображением Pred в качестве остатка прогнозирования, а модуль 109 кодирования остатка прогнозирования кодирует остаток прогнозирования. Хотя любой способ кодирования может быть использован, при обычной технике кодирования, такой как Н.264, кодирование выполняется путем применения DCT, квантования, бинаризации и энтропийного кодирования к остатку прогнозирования.

Битовый поток результата кодирования становится выводом устройства 100 кодирования многопроекционного видео, он декодируется модулем 110 декодирования остатка прогнозирования для каждого блока, а модуль 113 вычисления декодированного изображения строит локальное декодированное изображение Dec cur[blk] путем сложения результата декодирования и скорректированного синтезированного из проекций изображения Pred. Построенное локальное декодированное изображение хранится в устройстве 111 хранения декодированного изображения для использования в последующем прогнозировании (этап Sa10).

В. Второе воплощение

Далее, будет описано второе воплощение настоящего изобретения.

Фиг.4 является структурной схемой, изображающей конфигурацию устройства декодирования многопроекционного видео во втором воплощении настоящего изобретения. На фиг.4 устройство 200 декодирования многопроекционного видео оснащено модулем 201 ввода закодированных данных, устройством 202 хранения закодированных данных, модулем 203 ввода базового проекционного кадра, устройством 204 хранения базового проекционного изображения, модулем 205 синтезирования проекций, устройством 206 хранения синтезированного из проекций изображения, модулем 207 настройки степени надежности, элементом 208 коррекции синтезированного из проекций изображения, модулем 210 декодирования остатка прогнозирования, устройством 211 хранения декодированного изображения и модулем 212 вычисления декодированного изображения.

Модуль 201 ввода закодированных данных вводит закодированные данные видео кадра (целевого кадра декодирования), служащего в качестве цели декодирования. Устройство 202 хранения закодированных данных сохраняет ввод закодированных данных. Модуль 203 ввода базового проекционного кадра вводит базовый проекционный кадр, который является видео кадром для проекции, отличной от проекции целевого кадра декодирования. Устройство 204 хранения базового проекционного изображения сохраняет базовый проекционный кадр. Модуль 205 синтезирования проекций генерирует синтезированное из проекций изображение для целевого кадра декодирования с помощью базового проекционного кадра. Устройство 206 хранения синтезированного из проекций изображения сохраняет синтезированное из проекций изображение.

Модуль 207 настройки степени надежности настраивает степень надежности для каждого пиксела сгенерированного синтезированного из проекций изображения. Модуль 208 коррекции синтезированного из проекций изображения корректирует несоответствие между камерами синтезированного из проекций изображения и выводит скорректированное синтезированное из проекций изображение. Модуль 210 декодирования остатка прогнозирования декодирует разницу между целевым кадром декодирования и скорректированным синтезированным из проекций изображением из закодированных данных в качестве сигнала остатка прогнозирования. Устройство 211 хранения декодированного изображения сохраняет декодированное изображение для целевого кадра декодирования, полученного путем сложения сигнала декодированного остатка прогнозирования и скорректированного синтезированного из проекций изображения, в модуле 212 вычисления декодированного изображения.

Необходимо отметить, что в конфигурации устройства 200 декодирования многопроекционного видео, описанного выше, модуль 203 ввода базового проекционного кадра, устройство 204 хранения базового проекционного изображения, модуль 205 синтезирования проекций, устройство 206 хранения синтезированного из проекций изображения, модуль 207 настройки степени надежности, модуль 208 коррекции синтезированного из проекций изображения, модуль 210 декодирования остатка прогнозирования и устройство 211 хранения декодированного изображения являются теми же, что и модуль 103 ввода базового проекционного кадра, устройство 104 хранения базового проекционного изображения, модуль 105 синтезирования проекций, устройство 106 хранения синтезированного из проекций изображения, модуль 107 настройки степени надежности, модуль 108 коррекции синтезированного из проекций изображения, модуль 110 декодирования остатка прогнозирования и устройство 111 хранения декодированного изображения в устройстве 100 кодирования многопроекционного видео, соответственно, в первом воплощении.

Дополнительно, конфигурация модуля 208 коррекции синтезированного из проекций изображения та же, что и у модуля 108 коррекции синтезированного из проекций изображения (фиг.2) из состава устройства 100 кодирования многопроекционного видео, описанного выше в первом воплощении. Однако, далее, описание будет сделано со ссылкой на элемент 2081 настройки базового участка, модуль 2082 настройки точности расчета, модуль 2083 расчета параметра коррекции и модуль 2084 коррекции изображения, изображенные на фиг.5.

Фиг.6 является логической блок-схемой, описывающей работу устройства 200 декодирования многопроекционного видео во втором воплощении. Процесс, выполняемый устройством 200 декодирования многопроекционного видео, будет описан подробно на основании этой блок-схемы.

Во-первых, закодированные данные целевого кадра кодирования вводятся модулем 201 ввода закодированных данных и сохраняются в устройстве 202 хранения закодированных данных (этап Sb1). Дополнительно, базовый проекционный кадр Ref n (n=1, 2, …, N), снятый одновременно с целевым кадром декодирования, вводится модулем 203 ввода базового проекционного кадра и сохраняется в устройстве 204 хранения базового проекционного изображения (этап Sb1).

Здесь предполагается, что введенный базовый проекционный кадр является изображением, которое было декодировано отдельно. Чтобы предотвратить генерирование шума кодирования, называемого дрейфом, необходимо ввести тот же базовый проекционный кадр, который использовался в устройстве кодирования. Однако, если генерирование шума кодирования разрешено, может быть введен базовый проекционный кадр, отличный от используемого в устройстве кодирования. Необходимо отметить, что n является индексом, указывающим базовую проекцию, а N является количеством доступных базовых проекций.

Далее, модуль 205 синтезирования проекций синтезирует изображение, снятое в той же проекции одновременно с целевым кадром декодирования, из информации базового проекционного кадра и сохраняется сгенерированное синтезированное из проекций изображение Syn в устройстве 206 хранения синтезированного из проекций изображения (этап Sb2). Затем модуль 207 настройки степени надежности генерирует степень ρ надежности, указывающую определенность того, что возможно было осуществить синтезирование каждого пиксела синтезированного из проекций изображения (этап Sb3). Эти процессы являются теми же, что и этапы Sb2 и Sb3 первого воплощения, соответственно.

Когда вычисление степени надежности завершено, видеосигнал целевого кадра декодирования декодируется, а модуль 208 коррекции синтезированного из проекций изображения корректирует несоответствие между камерами синтезированного из проекций изображения для каждого заранее определенного блока (этапы от Sb4 до Sb12). То есть, когда индекс целевого блока декодирования обозначается как blk, а общее число целевых блоков декодирования обозначается как numBlks, то, после того, как blk инициализирован в 0 (этап Sb4), следующий процесс (этапы от Sb5 до Sb10) итерационно повторяется до тех пор, пока blk не станет равно numBkls (этап Sb12), причем blk увеличивается на 1 (этап Sb11).

Необходимо отметить, что если возможно выполнять генерирование синтезированного из проекций изображения и вычисление степеней надежности для каждого целевого блока декодирования, то эти процессы могут также быть выполнены в качестве процесса, повторяемого для каждого целевого блока декодирования. Например, это включает в себя случай, когда дана информация глубин для целевого блока декодирования. Дополнительно, этап Sb9, как будет описано далее, может быть выполнен заранее для всех блоков, а не для отдельного блока, и его результат можно сохранить и использовать. Однако, в таких случаях, требуется устройство памяти, чтобы хранить сигналы декодированных остатков прогнозирования.

В процессе, итерационно повторяемом для каждого целевого блока декодирования, во-первых, модуль 2081 настройки базового участка (примерно эквивалентный модулю 1081 настройки базового участка) находит базовый участок Ref[blk], который является блоком базового кадра, соответствующего блоку blk, с использованием синтезированного из проекций изображения (этап Sb5). Необходимо отметить, что базовый кадр - это данные, для которых процесс декодирования уже завершен и которые хранятся в устройстве 211 хранения декодированного изображения.

Этот процесс является тем же, что и этап Sa5 в первом воплощении. Возможно предотвратить генерирование шума с помощью применения затрат соответствия для поиска, способа определения целевого кадра поиска и способа генерирования видеосигнала для базового участка, которые являются теми же, что и используемые в устройстве кодирования.

Когда базовый участок Ref[blk] (=Dec t[blk+vec]) определен, модуль 2082 настройки точности расчета (примерно эквивалентный модулю 1082 настройки точности расчета) настраивает точность ψ расчета, указывающую, насколько точно был получен базовый участок для каждого пиксела базового участка Ref[blk] (этап Sb6). Затем, модуль 2083 расчета параметра коррекции (примерно эквивалентный модулю 1083 расчета параметра коррекции) рассчитывает параметры коррекции для коррекции синтезированного из проекций изображения Syn[blk] (этап Sb7). Далее, модуль 2084 коррекции изображения (примерно эквивалентный модулю 1084 коррекции изображения) корректирует синтезированное из проекций изображение для блока blk на основании параметров коррекции и генерирует скорректированное синтезированное из проекций изображение Pred (этап Sb8). Эти процессы являются теми же, что и этапы Sb6, Sb7 и Sb8 первого воплощения, соответственно.

Когда коррекция синтезированного из проекций изображения блока blk завершена, модуль 210 декодирования ошибки прогнозирования декодирует сигнал остатка прогнозирования для блока blk из закодированных данных (этап Sa9). Здесь, процесс декодирования является процессом, соответствующим технике кодирования. Например, когда кодирование выполняется с помощью обычной техники, такой как Н.264, то декодирование выполняется путем применения обратного дискретного косинусного преобразования (IDCT), обратного квантования, обработки множества значений, энтропийного декодирования и тому подобного.

Наконец, модуль 212 вычисления декодированного изображения строит целевой кадр Dec cur[blk] декодирования путем сложения полученного сигнала декодированного остатка DecRes прогнозирования и скорректированного синтезированного из проекций изображения Pred. Построенный целевой кадр декодирования сохраняется в устройстве 211 хранения декодированного изображения для использования в последующем прогнозировании и становится выводом устройства 200 декодирования многопроекционного видео (этап Sb10).

При вышеописанных первом и втором воплощениях, соответствующий участок на уже закодированном кадре для обрабатываемого в данный момент участка получается с использованием генерированного синтезированного из проекций изображения, а яркость и/или цвет синтезированного из проекций изображения корректируется с использованием видеосигнала соответствующего участка в закодированном кадре в качестве ссылки. Тем самым, возможно выполнить коррекцию для сокращения несоответствия и реализовать эффективное кодирование многопроекционного видео. Дополнительно, степень надежности, указывающая определенность процесса синтезирования, устанавливается для каждого пиксела синтезированного из проекций изображения, и вес назначается затратам соответствия для каждого пиксела на основании степени надежности. Тем самым, правильно синтезированный пиксел считается важным, и правильный соответствующий участок может быть настроен, причем на него не влияет ошибка синтезирования проекций.

Дополнительно, на этапе Sa5 первого воплощения и этапе Sb5 второго воплощения, описанных выше, соответствующий блок на базовом кадре, соответствующий синтезированному из проекций изображению Syn[blk] целевого кадра обработки (целевого кадра кодирования или целевого кадра декодирования), получают с помощью базового кадра Dec. Однако если синтезированное из проекций изображение RefSyn базового кадра может быть получено, то соответствующий блок может быть получен с помощью синтезированного из проекций изображения RefSyn, а не базового кадра Dec. То есть соответствующий блок на базовом кадре может быть получен путем получения пары (best_vec, best_t), представленной уравнением (9), с помощью затрат соответствия, в которых Dec в уравнениях от (5) до (8) замещается на RefSyn. Однако даже в этом случае, базовый участок Ref генерируется с помощью базового кадра Dec. Если процесс синтезирования проекций выполняется с высокой точностью, то синтезированное из проекций изображение RefSyn и базовый кадр Dec считаются равными, и, таким образом, преимущественные эффекты воплощений настоящего изобретения могут быть равно получены даже тогда, когда соответствующий блок ищется с помощью синтезированного из проекций изображения RefSyn.

Когда используется синтезированное из проекций изображение RefSyn, то необходимо ввести базовый проекционный кадр, снятый одновременно с базовым кадром, и генерировать и сохранить синтезированное из проекций изображение для базового кадра. Однако, когда процессы кодирования и декодирования в вышеописанных воплощениях применяются непрерывно ко множеству кадров, то возможно предотвратить повторное синтезирование синтезированного из проекций изображения для базового кадра для каждого целевого кадра обработки с помощью непрерывного сохранения синтезированного из проекций изображения в устройстве хранения синтезированного из проекций изображения, причем кадр, который обработан, сохраняется в устройстве хранения декодированного изображения.

Необходимо отметить, что так как обработанный кадр, хранящийся в устройстве хранения декодированного изображения, не требуется в поиске соответствующего участка (этап Sa5 первого воплощения и этап Sb5 второго воплощения), когда используется синтезированное из проекций изображение RefSyn, то не нужно выполнять процесс поиска соответствующего участка в синхронизации с процессом кодирования или процессом декодирования. В результате, можно получить такой преимущественный эффект, что можно выполнить параллельное вычисление или тому подобное, а общее время вычисления можно сократить.

В вышеописанных первом и втором воплощениях используются само синтезированное из проекций изображение и сам базовый кадр. Однако точность поиска соответствующего участка ухудшается вследствие влияния шума, такого как зернистость пленки и искажение кодирования, формируемого в синтезированном из проекций изображении и/или базовом кадре. Из-за того, что шум является конкретной частотной составляющей (в частности, высокочастотной составляющей), возможно сократить влияние шума путем применения полосного фильтра (низкочастотного фильтра, когда шум является высокочастотным) к кадру (изображению), используемому в поиске соответствующего участка, и затем выполнения поиска.

Дополнительно, если точность поиска соответствующего участка ухудшилась вследствие влияния шума или того подобного, то и пространственная корреляция между векторами, обозначающими соответствующие участки, ухудшилась. Однако так как один и тот же объект фотографируется в соседнем участке в нормальном видео, то можно считать, что векторы между участками,по существу,одинаковы и пространственная корреляция между векторами, обозначающими соответствующие участки, очень высока. Следовательно, фильтр среднего значения или медианный фильтр можно применять к векторам движения, рассчитанным для соответственных блоков, чтобы увеличить пространственную корреляцию, и, следовательно, улучшить точность поиска соответствующего участка.

Хотя вышеописанные первое и второе воплощения описывают случай, когда целевой блок обработки и блок поиска соответствующего участка имеют один и тот же размер, очевидно, что эти блоки не обязательно должны иметь одинаковый размер. Так как временное изменение видео нелинейное, возможно более точно спрогнозировать изменение видеосигнала с помощью нахождения соответствующего участка для каждого малого блока. Однако, когда используется малый блок, объем вычислений увеличивается, и влияние шума, включенного в видеосигнал, становится больше. Чтобы решить эту проблему, также легко добавить процесс, когда ищется соответствующий участок для малого участка, с использованием нескольких пикселов вокруг малого участка для поиска, чтобы сократить влияние шума.

Необходимо отметить, что хотя вышеописанные первое и второе воплощения описывают процесс кодирования или декодирования одного кадра камеры, возможно реализовать кодирование или декодирование многопроекционного фильма путем повторения этого процесса для каждого кадра. Дополнительно, возможно реализовать кодирование или декодирование многопроекционного фильма множества камер путем итерационного повторения этого процесса для каждой камеры.

Как описано выше в воплощениях настоящего изобретения, параметры коррекции получаюся с использованием предположения о том, что несоответствия в цвете и яркости, которые зависят от объекта, не изменяются со временем значительно. Таким образом, когда сцена внезапно меняется вследствие смены сцены или тому подобного, то несоответствие меняется во времени. В таком случае, в воплощениях настоящего изобретения существует вероятность того, что правильный параметр коррекции нельзя вычислить, и разница между синтезированным из проекций изображением и целевым кадром обработки увеличивается в результате коррекции. Следовательно, синтезированное из проекций изображение может быть скорректировано только,если определено, что нет внезапного изменения в видео, путем определения присутствия или отсутствия внезапного изменения, такого как смена сцены. Необходимо отметить, что в качестве способа для определения такого внезапного изменения в видео можно использовать способ проверки значения степени отклонения соответствующего участка, полученного в результате поиска соответствующего участка, и для определения того, что произошло внезапное изменение в видео, если степень отклонения больше или равна постоянной степени.

Вышеописанный процесс также может быть реализован компьютером и программным обеспечением. Дополнительно, также можно обеспечить программу путем записи программы на машиночитаемом носителе информации и обеспечить программу через сеть.

Дополнительно, вышеописанные воплощения описывают в основном устройство кодирования многопроекционного видео и устройство декодирования многопроекционного видео. Однако способ кодирования многопроекционного видео и способ декодирования многопроекционного видео согласно настоящему изобретению могут быть реализованы путем этапов, соответствующих операциям соответственных модулей устройства кодирования многопроекционного видео и устройства декодирования многопроекционного видео.

Хотя воплощения настоящего изобретения описаны выше со ссылкой на сопровождающие чертежи, эти воплощения являются иллюстрациями настоящего изобретения, и очевидно, что настоящее изобретение не ограничено этими воплощениями. Следовательно, дополнения, пропуски, замены и другие изменения составляющих элементов могут быть сделаны без отхода от сути и объема настоящего изобретения.

Промышленное применение

Например, настоящее изобретение используется для кодирования и декодирования многопроекционного изображения и многопроекционного видео. С помощью настоящего изобретения, можно осуществлять эффективное кодирование/декодирование параметров коррекции даже тогда, когда несоответствия в яркости и/или цвете между камерами генерируются локально.

Описание ссылочных позиций

100 Устройство кодирования многопроекционного видео

101 Модуль ввода целевого кадра кодирования

102 Устройство хранения целевого изображения кодирования

103 Модуль ввода базового проекционного кадра

104 Устройство хранения базового проекционного изображения

105 Модуль синтезирования проекции

106 Устройство хранения синтезированного из проекций изображения