Уровень техники

По мере того, как цифровые камеры становятся все более распространенными, а цифровые накопители становятся все более дешевыми, число фотографий ("фото") и видео в коллекции (или библиотеке) пользователя будет также экспоненциально расти.

Категоризация этих фотографий занимает много времени, и для пользователей быстрый поиск изображений конкретных моментов их жизни является сложной проблемой. В настоящее время теги используются для помощи в сортировке, хранении и поиске цифровых фотографий. Тегирование относится к процессу присвоения ключевых слов цифровым данным. Цифровые данные могут тогда быть организованы в соответствии с ключевыми словами или 'тегами'. Например, содержание цифровой фотографии может использоваться для создания ключевых слов, которые затем ассоциируются с этой цифровой фотографией в качестве одного или нескольких тегов.

Хотя теги к конкретной цифровой фотографии могут добавляться вручную для помощи в категоризации и поиске фотографий, в настоящее время есть лишь несколько автоматических тегов, которые добавляются к фотографиям. Например, большинство камер присваивает автоматические теги даты и времени цифровым фотографиям. Кроме того, все больше камер включает в себя географическое местоположение как часть автоматических тегов фотографии. В последнее время были разработаны программные продукты для обеспечения автоматического распознавания людей на фотографиях (и отождествления с конкретной личностью).

Однако пользователи в настоящее время ограничены запросами фотографий по времени, географическому местоположению, тегами людей и тегами, которые добавляются вручную.

Краткая сущность изобретения

Обеспечены способы для автоматического присвоения тегов цифровым фотографиям и видео. Вместо того чтобы иметь только теги из метаданных, обеспечивающих дату, время и географическое местоположение, которые могут быть автоматически присвоены фотографии камерой, из фотографии или видео может быть автоматически извлечена дополнительная информация и ключевые слова или код, ассоциированные с этой дополнительной информацией, могут быть автоматически присвоены как теги этой фотографии или видео. Эта дополнительная информация может включать в себя информацию, не доступную непосредственно из изображения и метаданных, ассоциированных с изображением.

Например, из изображения может быть извлечена информация относительно определенных условий, в том числе, но не ограничиваясь только этим, погода, географические наземные ориентиры, архитектурные наземные ориентиры и характерные окружающие признаки. В одном варианте воплощения используются метаданные о времени и географическом местоположении фотографии для извлечения погоды для этого конкретного местоположения и времени. Извлечение может быть выполнено путем запроса базы данных погоды для определения погоды для конкретного местоположения и времени, в котором была сделана фотография. В другом варианте воплощения используются метаданные географического местоположения фотографии и распознавание изображений для извлечения географических и архитектурных наземных ориентиров. В еще одном варианте воплощения используется распознавание изображений для извлечения характерных окружающих признаков (в том числе фона, цвета, оттенка и интенсивности) и известных физических объектов на изображении, а теги автоматически присваиваются фотографии на основании извлеченных признаков и объектов.

В соответствии с одним вариантом воплощения может быть обеспечена база данных ключевых слов или идентификаторов объектов для использования в качестве тегов, когда на фотографии распознаны одно или несколько некоторых условий. Когда конкретное условие распознано, один или несколько ключевых слов или идентификаторов объектов, ассоциированных с этим конкретным условием, автоматически присваиваются как теги для фотографии.

Теги, ранее ассоциированные с конкретной фотографией, могут использоваться для генерации дополнительных тегов. Например, информация о дате может использоваться для генерации тегов с ключевыми словами, ассоциированными с этой датой, такими как время года, школьный семестр, праздник и мероприятие событийной значимости.

В дополнительном варианте воплощения распознанные объекты могут быть упорядочены по заметности, и рейтинг отражается как дополнительный тег. Кроме того, база данных, используемая при идентификации распознанных объектов, может включать в себя различные уровни конкретности/детализации.

Это краткое изложение сущности изобретения приведено для ознакомления с подборкой концепций в упрощенной форме, которые дополнительно описаны ниже в подробном описании. Данное краткое изложение сущности изобретения не предназначено ни для идентификации ключевых или существенных признаков заявленного изобретения, ни для ограничения объема заявленного изобретения.

Краткое описание чертежей

Фиг. 1 изображает процесс автоматической генерации тегов в соответствии с некоторыми вариантами воплощения изобретения.

Фиг. 2 изображает процесс распознавания изображений в соответствии с некоторыми вариантами воплощения изобретения.

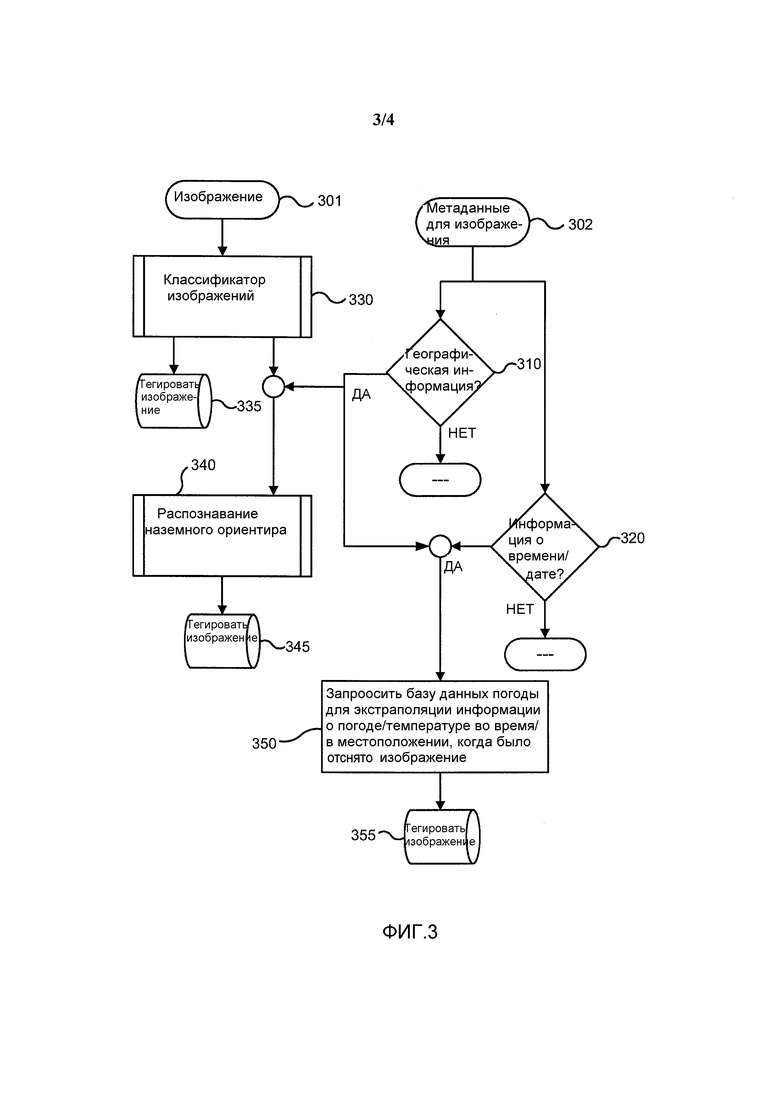

Фиг. 3 показывает последовательность операций процесса автоматической генерации тегов в соответствии с некоторыми вариантами воплощения изобретения.

Фиг. 4 изображает процесс генерации тега путем извлечения архитектурного наземного ориентира из фотографии для процесса автоматической генерации тегов в соответствии с вариантом воплощения изобретения.

Фиг. 5 изображает процесс генерации тега путем извлечения географического наземного ориентира из фотографии для процесса автоматической генерации тегов в соответствии с вариантом воплощения изобретения.

Подробное описание

Описаны технические приемы для выполнения автоматической генерации одного или нескольких тегов, ассоциированных с фотографией. Автоматическое тегирование может происходить, когда цифровая фотография (или видео) загружается или иным образом передается в фотоколлекцию, которая может храниться в локальной, удаленной или распределенной базе данных. В других вариантах воплощения автоматическое тегирование может происходить при инициировании пользователем тегирования существующих фотографий.

Изображение может включать в себя, но не ограничивается только этим, визуальное представление объектов, форм и признаков того, что представлено на фотографии или в видеокадре. В соответствии с некоторыми вариантами воплощения изображение может быть захвачено цифровой камерой (в виде фотографии или как часть видео) и может быть реализовано в виде пикселей, определенных светочувствительной матрицей цифровой камеры. В некоторых вариантах воплощения термин "фотоизображение" используется здесь для обозначения изображения цифровой фотографии в противоположность метаданным или другим элементам, ассоциированным с фотографией, и оно может использоваться взаимозаменяемо с термином "изображение", не отступая от объема некоторых вариантов воплощения изобретения. Значение терминов "фотография", "изображение" и "фотоизображение" будет легко понятно по их контексту.

В некоторых вариантах воплощения изображение, как это используется здесь, может обозначать визуальное представление электрических величин, полученных светочувствительной матрицей цифровой камеры. Файл изображения (и файл цифровой фотографии) может обозначать форму изображения, которая является машиночитаемой и имеет возможность сохранения в устройстве хранения. В некоторых вариантах воплощения файл изображения может включать в себя, но не ограничивается только этим, .jpg, .gif и .bmp. Файл изображения может быть реконструирован для обеспечения визуального представления ("изображения"), например, на устройстве отображения или основе (например, путем печати на бумагу).

Хотя некоторые иллюстративные варианты воплощения могут быть описаны в отношении фотографии, следует понимать, что то же самое может быть применимо к любому изображению (даже не захваченному камерой). Кроме того, заявленные технологии применимы и к неподвижным изображениям (например, фотографии) и динамическим изображениям (например, видео) и могут включать в себя аудио компоненты в файле.

Метаданные, записанные в файл цифровой фотографии, часто включают в себя информацию, указывающую, кому принадлежит фотография (включая информацию об авторских правах и контактную информацию) и камеру (и настройки), которая создала файл, а также пояснительную информацию, такую как ключевые слова о фотографии для того, чтобы сделать файл доступным для поиска на компьютере пользователя и/или через Интернет. Некоторые метаданные записываются камерой, в то время как другие метаданные вводятся пользователем или вручную, или автоматически программным обеспечением после передачи файла цифровой фотографии на компьютер (или сервер) из камеры, запоминающего устройства или другого компьютера.

В соответствии с некоторыми вариантами воплощения изобретения изображение и его метаданные используются для генерации дополнительных метаданных. Дополнительные метаданные генерируются путем извлечения или получения из изображения и метаданных для изображения. Метаданные для изображения могут включать в себя географическое местоположение и дату, когда было сделано изображение, и любую другую доступную информацию, ассоциированную с изображением. Метаданные для изображения могут быть частью самого изображения или могут предоставляться отдельно. Когда метаданные являются частью самого изображения, данные сначала извлекаются из цифрового файла изображения, перед использованием для генерации дополнительных метаданных. После генерации дополнительные метаданные могут быть ассоциированы обратно с исходным изображением или использоваться для других целей. Извлеченные и/или созданные метаданные и дополнительные метаданные могут быть ассоциированы с исходным изображением в качестве тега.

Одним типом тегов является тег ключевого слова. Тег ключевого слова может использоваться в связи с выполнением операций над одним или несколькими изображениями, таких как, например, сортировка, поиск и/или извлечение файлов изображений на основании тегов, имеющих ключевые слова, соответствующие заданному критерию.

Фиг. 1 изображает процесс автоматической генерации тегов в соответствии с некоторыми вариантами воплощения изобретения.

На фиг. 1 принимается 100 фотография, имеющая изображение и соответствующие метаданные. Процесс автоматического тегирования варианта воплощения изобретения может начаться автоматически после получения фотографии. Например, процесс может начаться после того, как пользователь загрузил файл фотоизображения на сайт для обмена фотографиями. В качестве другого примера, процесс может начаться после загрузки пользователем фотографии с камеры на компьютер пользователя. В качестве еще одного примера, мобильный телефон пользователя может включать в себя приложение для автоматической генерации тегов, где после съемки изображения с использованием камеры мобильного телефона или выбора приложения может начаться процесс тегирования.

После приема фотографии извлекаются 110 метаданные, ассоциированные с фотографией. Извлечение метаданных может включать в себя чтение и синтаксический анализ конкретного типа(ов) метаданных, ассоциированных с фотографией. Типы метаданных, которые могут быть извлечены, могут включать в себя, но не ограничиваются только этим, Взаимозаменяемый формат файла изображения (EXIF), Международный совет по прессе и телекоммуникациям (IPTC) и Расширяемую платформу метаданных (XMP).

В дополнение к извлечению 110 метаданных выполняется 120 распознавание изображений для распознания и идентификации форм и объектов на фотоизображении. Конкретный алгоритм распознавания изображений, используемый во время выполнения распознавания изображений, может быть любым подходящим алгоритмом распознавания изображений или образов, доступным для конкретного приложения или требований обработки. Алгоритм распознавания изображений может быть ограничен доступными базами данных, обеспечивающими нахождения соответствия объектов на фотографии с известными объектами. В качестве одного примера, алгоритм распознавания изображений может включать в себя предварительную обработку изображения. Предварительная обработка может включать в себя, но не ограничивается только этим, настройку контраста изображения, преобразование в оттенки серого и/или черно-белое, обрезку, изменение размеров, вращение и комбинации всего этого.

В соответствии с некоторыми алгоритмами распознавания изображений отличительный признак, такой как (но не ограничивающийся только этим) цвет, размер или форма, может быть выбран для использования при обнаружении конкретного объекта. Конечно, может использоваться множество признаков, обеспечивающих отличительные характеристики объекта. Может выполняться выделение контуров (или распознавание границ) для определения контуров (или границ) объектов на изображении. В алгоритме распознавания изображений может выполняться морфология для выполнения действий над наборами пикселей, в том числе удаление нежелательных компонентов. Кроме того, может выполняться шумоподавление и/или заполнение областей.

Как часть одного варианта воплощения алгоритма распознавания изображений, когда один или несколько объектов (и их соответствующих свойств) найдены/обнаружены на изображении, местоположение каждого из одного или нескольких объектов может быть определено на изображении, а затем они могут быть классифицированы. Обнаруженный объект(ы) может быть классифицирован (то есть идентифицирован как конкретная форма или объект) путем оценки обнаруженного объекта(ов) в соответствии с конкретными характеристиками, связанными с отличительным признаком(ами). Конкретные характеристики могут включать в себя математические вычисления (или соотношения). В качестве другого примера, вместо (или в дополнение к) определения местоположения распознаваемых объектов на изображении может выполняться сопоставление с образцом. Сопоставление может выполняться путем сравнения элементов и/или объектов на изображении с "известными" (ранее идентифицированными или классифицированными) объектами и элементами. Результаты (например, значения) вычислений и/или сравнений могут быть нормированы, чтобы представлять наилучшее соответствие для классификаций, где большее число (например, 0,9) обозначает более высокую вероятность правильной классификации как конкретной формы или объекта, чем меньший нормированный результат (например, 0,2). Для присвоения обозначения идентифицированному объекту может использоваться пороговое значение. В соответствии с различными вариантами воплощения алгоритмы распознавания изображений могут использовать нейронные сети (NN) и другие алгоритмы обучения.

Следует понимать, что хотя некоторые из описанных вариантов воплощения и примеров могут ссылаться на фотографию, это не должно толковаться как ограничение описанных вариантов воплощения и примеров лишь фотографией. Например, некоторыми системами, описанными здесь, может быть принят видеосигнал и подвергнут процессу автоматической генерации тегов, как описано в соответствии с некоторыми вариантами воплощения изобретения. В одном варианте воплощения могут быть приняты один или несколько видеокадров видеосигнала, где видеокадр может включать в себя изображение и метаданные, и может быть выполнено распознавание изображений и извлечение метаданных.

В одном варианте воплощения первый проход этапа распознавания может быть выполнен для изображения для идентификации того, что на изображении присутствует базовая форма или объект. После того как базовая форма или объект идентифицирован, выполняется второй прохода этапа распознавания для получения более конкретной идентификации формы или объекта. Например, первый проход этапа распознавания может идентифицировать, что на фотографии присутствует здание, а второй проход этапа распознавания может идентифицировать конкретное здание. В одном варианте воплощения этап идентификации, что здание присутствует на фотографии, может быть выполнен путем сопоставления с образцом между фотографией и набором изображений или шаблонов, доступных машине/устройству, выполняющему распознавание изображений. В некоторых вариантах воплощения результат сопоставления с образцом для первого прохода этапа распознавания может быть достаточным для идентификации формы или объекта с достаточной конкретностью, в результате чего никакие дополнительные этапы распознавания не выполняются.

В некоторых вариантах воплощения во время процесса распознавания изображений извлеченные метаданные могут использоваться для облегчения распознавания изображения, например, обеспечивая подсказки относительно того, какова может быть форма или объект на фотографии. В примере здания для процесса первого прохода/второго прохода может использоваться географическая информация, извлеченная из метаданных, для облегчения идентификации конкретного здания. В одном варианте воплощения выполнение распознавания 120 изображений может выполняться с использованием процесса распознавания изображений, изображенного на фиг. 2. На фиг. 2 базовый алгоритм распознавания изображений может использоваться для идентификации объекта на изображении 221. Этот алгоритм распознавания изображений называется "базовым", чтобы указать, что процесс распознавания изображений на этапе 221 не использует извлеченные метаданные и не должен толковаться как указывающий только упрощенный или иным образом ограниченный процесс. Алгоритм распознавания изображений может быть любым подходящим алгоритмом распознавания изображений или образов, доступным для конкретного приложения или требований обработки, и может также включать в себя предварительную обработку изображения. Как только объект идентифицирован на изображении, извлеченные метаданные 211 могут использоваться для получения названия или обозначения для идентифицированного объекта путем запроса базы данных (например, "БД (DB) идентификации") 222. База данных может быть любой подходящей базой данных, содержащей названия и/или обозначения, обеспечивающие идентификацию для объекта с учетом ограничений, установленных запросом. Названия и/или обозначения, полученные в результате запроса БД (DB) идентификации, могут затем использоваться для запроса базы данных (например, "БД (DB) изображений"), содержащей изображения, для поиска изображений, ассоциированных с названиями и/или обозначениями 223. Изображения, полученные в результате поиска по БД (DB) изображений, могут затем использоваться для выполнения сопоставления 224 с образцом для более конкретной идентификации объекта на изображении. В некоторых вариантах воплощения может быть обеспечен показатель, насколько изображения объектов, полученные в результате поиска по БД (DB) изображений, подобны идентифицированному объекту на изображении, подвергающемуся процессу распознавания изображений.

Используя пример здания выше и процесс распознавания изображений в соответствии с вариантом воплощения процесса распознавания изображений, описанного относительно фиг. 2, базовое распознавание 221 изображений может использоваться для идентификации ОБЪЕКТА "здание" и алгоритм может выдать, например, "здание", "серое здание" или "высокое здание". Когда извлеченные метаданные 211 являются долготой и широтой, на которых была сделана фотография (может быть в пределах диапазона порядка ~31 м (102 фута)), запрос БД (DB) идентификации 222 может иметь вид "найти все здания вблизи этого географического местоположения" (где географическое местоположение идентифицировано с использованием долготы и широты, обеспеченных извлеченными метаданными). Затем 223 БД (DB) изображений может быть запрошена на предмет "найти все известные изображения для каждого из этих конкретных зданий" (где конкретные здания являются идентифицированными зданиями из запроса БД (DB) идентификации). Затем может быть выполнено сопоставление 224 с образцом для сравнения изображения, полученного с помощью запроса БД (DB) изображений, с изображением, подвергающимся процессу распознавания изображений, для определения того, имеется ли особенно очевидное или близкое соответствие.

В дополнительном варианте воплощения, когда на одном изображении идентифицировано множество объектов, может также быть распознано относительное местоположение объектов друг к другу. Например, может быть выполнен дополнительный этап распознавания для распознавания, что идентифицированное судно находится на идентифицированной реке или идентифицированный человек находится в идентифицированном бассейне.

Возвращаясь к фиг. 1, извлеченные метаданные и распознанные/идентифицированные объекты на фотографии могут затем использоваться для получения дополнительной информации для фотографии путем использования в запросах баз данных для соответствующей информации 130. Может выполняться сопоставление слов для получения результатов запроса. Этот этап может включать в себя использование географической информации, информации о дате/времени, идентифицированные объекты на изображении или различные комбинации всего этого для запроса множества баз данных для получения соответствующей информации об объектах на фотографии и событиях, происходящих на или вблизи фотографии. Результаты запросов баз данных могут быть приняты 140 и использоваться в качестве тегов для фотографии 150. Например, фотография, имеющая извлеченную дату 24 ноября 2011, извлеченное местоположение в Соединенных Штатах и распознанный объект приготовленную индейку на столе, может привести к тегу дополнительной информации "День благодарения", тогда как извлеченное местоположение за пределами Соединенных Штатов не обязательно приведет к тегу дополнительной информации "День благодарения" для того же самого изображения. В качестве другого примера, фотография, имеющая извлеченную дату президентских выборов 2008 в Соединенных Штатах и распознанное изображение президента Обамы может привести к тегу дополнительной информации "президентские выборы" или, если время также соответствует, тег дополнительной информации может включать в себя "речь после избрания".

Фиг. 3 изображает процесс автоматического тегирования в соответствии с некоторыми вариантами воплощения изобретения. Аналогично процессу, описанному относительно фиг. 1, принята фотография, имеющая изображение 301 и соответствующие метаданные 302. Извлекается любая географическая информация (310) и информация (320) о дате/времени, доступная из метаданных 202. Если географическая информация и информация о дате/времени не доступна, может быть возвращен нулевой результат (как конечный процесс). Кроме того, изображение 301 вводится в классификатор 330 изображений, который сканирует на наличие известных объектов (то есть объектов, определенных и/или каталогизированных в базе данных, используемой классификатором изображений), и идентифицирует и извлекает любые известные физические объекты на изображении.

Классификатор изображений использует базу данных форм и элементов (объектов) для извлечения как можно большего количества данных из изображения. Классификатор изображений может искать и распознавать множество объектов, форм и/или признаков (например, цвет). Объекты включают в себя, но не ограничиваются только этим, лица, людей, продукты, символы, животных, растения, отображаемый текст и другое различимое содержание на изображении. База данных может включать в себя идентификаторы объектов (метаданные) в сочетании с распознаваемыми формами и элементами (объектами). В некоторых вариантах воплощения чувствительность классификатора изображений может позволить идентификацию объекта даже там, где на изображении доступны только частичные формы или часть объекта. Метаданные, полученные от процесса классификатора изображений, могут использоваться в качестве тегов для фотографии. Метаданные могут быть записаны обратно в фотографию или иным образом ассоциированы с фотографией и сохранены (335).

Из извлеченных метаданных и метаданных, полученных от процесса классификатора изображения, могут автоматически генерироваться дополнительные теги с использованием комбинации метаданных. Например, изображение может подвергнуться одному или нескольким проходам для идентификации и извлечения множества распознанных признаков. Во время идентификации и извлечения множества распознанных признаков показатель достоверности, представляющий собой вероятность того, что распознанный признак был идентифицирован правильно, может быть обеспечен как часть тега, ассоциированного с фотографией. Показатель достоверности может генерироваться как часть алгоритма распознавания изображений. В некоторых вариантах воплощения показатель достоверности является соответствующим весовым коэффициентом (который может быть нормированным), генерируемый алгоритмом распознавания изображений, когда сопоставляются признак/объект на изображении с базовым признаком (или конкретной характеристикой). Например, когда отличительной характеристикой, которая ищется на изображении, является то, что все изображение является синим, но в алгоритме сопоставления используется изображение, имеющее другой оттенок синего, генерируемый показатель достоверности будет зависеть от используемого алгоритма и различия между изображениями. В одном случае результат может указывать на 90%-ое соответствие, если алгоритм распознает контуры и цвета, а в другом случае результат может указывать на 100%-ое соответствие, если алгоритм направлен только на контуры, а не цвет.

В некоторых вариантах воплощения показатели достоверности могут быть в форме таблицы с уровнями достоверности. Таблица может быть сохранена как часть самих тегов. В одном варианте воплощения таблица может включать в себя атрибут и соответствующую достоверность. Например, если имеется фотография платана (на которой не ясно, платан является платаном или бананом), фотография (после прохождения процесса автоматической генерации тегов в соответствии с вариантом воплощения изобретения) может быть тегирована с помощью Таблицы 1 ниже. Следует понимать, что таблица обеспечена лишь для иллюстративных целей и не должна толковаться как ограничение формы, организации или выбора атрибутов.

Для вышеупомянутого примера, когда пользователь ищет фотографии банана, фотография платана может быть получена наряду с Таблицей 1. Пользователь может в некоторых случаях иметь возможность удалить любые атрибуты в таблице, о которых пользователь знает, что они являются неправильными, и изменить показатель достоверности (или достоверность) атрибута, о котором пользователь знает, что он является правильным, на 100% (или 1). В некоторых вариантах воплощения исправленная таблица и фотография могут использоваться в алгоритме сопоставления изображений, чтобы алгоритм распознавания изображений был более точным.

Возвращаясь к фиг. 3, в одном варианте воплощения извлеченная географическая информация используется для облегчения прохода (340) по распознаванию наземных ориентиров, через который вводится изображение, для идентификации и извлечения любых распознанных наземных ориентиров (географических или архитектурных). Показатели достоверности могут также быть ассоциированы с тегами, генерируемыми проходом по распознаванию наземных ориентиров. Теги, генерируемые проходом по распознаванию наземных ориентиров, могут быть записаны обратно в файл фотоизображения или иным образом ассоциированы с изображением и сохранены (345).

В дополнительном варианте воплощения обеспечивается доступ к базе данных погоды, чтобы экстраполировать информацию о погоде/температуре в то время/местоположение, в которое было захвачено изображение, путем использования извлеченных метаданных географической информации и информации о дате/времени (350). Погодная/температурная информация может быть записана обратно в фотографию или иным образом ассоциирована с фотографией и сохранена (355). Автоматические теги, генерируемые каждым процессом, могут быть сохранены в том же самом или отдельном месте хранения.

Автоматической системой генерации тега могут использоваться множество баз данных. Базы данных, используемые системой генерации тега, могут быть локальными базами данных или базами данных, ассоциированными с другими системами. В одном варианте воплощения может быть включена база данных, имеющая ключевые слова или идентификаторы объектов для использования в качестве тегов, когда определено, что один или несколько конкретных условий, таких как (но не ограничивающихся только этим) погода, географические наземные ориентиры и архитектурные наземные ориентиры, присутствуют на фотографии. Эта база данных может быть частью или отдельной базой данных, которая используется и/или к которой осуществляется доступ классификатором изображений. Базы данных, к которым осуществляется доступ и которые используются для некоторых вариантов воплощения заявленных процессов автоматической генерации тегов, могут включать в себя любые подходящие базы данных, доступные для поисковых систем, которые позволяют определять соответствие между изображениями и тегами.

Процесс добавления географической идентификационной информации (в качестве метаданных) к фотографии может называться "геотегирование". В целом геотеги включают в себя информацию о географическом местоположении, такую как координаты широты и долготы местоположения, где была сделана фотография. Автоматическое геотегирование обычно обозначает использование устройства (например, цифровой фотокамеры, цифровой видеокамеры, мобильного устройства со светочувствительной матрицей), имеющего систему географического позиционирования (GPS), при захвате изображения для фотографии так, что координаты GPS ассоциируются с захваченным изображением при локальном сохранении на устройстве захвата изображения (и/или загружаются в удаленную базу данных). В других случаях может использоваться CellID (также называемый CID и который является идентификационным номером соты сотовой сети для конкретной станции или сектора сотового оператора) для указания местоположения. В соответствии с некоторыми вариантами воплощения изобретения может быть выполнено специализированное автоматическое геотегирование для географических и архитектурных наземных ориентиров.

В качестве первого примера может быть извлечена информация о дате/времени и местоположении цифровой фотографии из метаданных цифровой фотографии, и произведен поиск в базе данных с использованием даты/времени и кодов местоположения. База данных может быть базой данных погоды, где запрос о погоде в местоположении и во время даты/времени, извлеченных из цифровой фотографии, выдает информацию (или код), связанный с погодой для этого конкретного местоположения и времени. Например, результат запроса может предоставить код погоды и/или описания, которые могут использоваться в качестве тега, такие как "Преимущественно солнечно", "Солнечно", "Ясно", "Безоблачно", "Переменная облачность", "Облачно", "Преимущественно облачно", "Дождь", "Ливни", "Небольшие дожди" и "Грозы". Конечно, могут быть доступны или использоваться другие описания погоды, в зависимости от базы данных, в которой осуществляется поиск. Например, погодный код может включать в себя другие связанные с погодой описания, такие как "Холодно", "Жарко", "Сухо" и "Влажно". Также может быть включена сезонная информация.

В некоторых случаях база данных погоды, в которой осуществляется поиск, может не хранить информацию о погоде в точности для этого местоположения и времени, используемого в запросе. В одном варианте воплощения такого случая может быть выполнен поиск наилучшего соответствия, и информация о погоде (наряду с показателем достоверности) может быть обеспечена для возможных наилучших соответствий местоположению и дате/времени. Например, база данных погоды может содержать информацию о погоде, обновляемую в течение каждого часа в соответствии с городом. Запрос этой базы данных погоды может тогда выдать информацию о погоде для города, в который попадает местоположение или который является ближайшим (например, местоположение может быть за пределами городских границ) для ближайшего времени(ен) к определенному времени, для которого осуществляется поиск.

После того как фотография тегирована с помощью информации о погоде от базы данных погоды, запрос "найти для меня снимки, которые делались в то время, когда шел снег" будет включать в себя фотографии, имеющие автоматически сгенерированный погодный тег "Снег".

Как было описано выше, в дополнение к использованию метаданных (и других тегов), ассоциированных с фотографией, для фотоизображения выполняется распознавание изображений, чтобы извлечь информацию о признаке и тег, ассоциированный с распознанным объектом, или признак, автоматически присвоенный фотографии.

В качестве одного примера, из фотографий могут быть извлечены характерные окружающие признаки путем использования распознавания изображений (или образов). Могут быть идентифицированы преобладающие цвета и использоваться в качестве тега. Алгоритмы распознавания изображений могут осуществлять поиск того, является ли небо характерным признаком на фотографии и какие цвета или другие ключевые особенности имеются на фотографии. Например, распознавание изображений может автоматически идентифицировать "голубое небо" или "красное небо" или "зеленую траву" и фотография может быть тегирована с помощью этих терминов.

В качестве второго примера, используя распознавание изображений, могут быть автоматически извлечены известные физические объекты и фотографии, на которых эти известные физические объекты найдены, автоматически тегируются с помощью названий известных физических объектов. В некоторых вариантах воплощения распознавание изображений может использоваться для поиска как можно большего количества объектов и соответственного автоматического тегирования фотографии. Если алгоритмом распознавания изображений обнаружена бейсбольная бита, или футбольный мяч, или гольф-клуб, или собака теги с этими терминами могут быть автоматически добавлены в качестве тегов к фотографии. Кроме того, объекты могут быть автоматически упорядочены по заметности. Если определено, что большая часть изображения является креслом, но также распознан небольшой бейсбольный мяч, находящийся на столе (с небольшой частью стола, видной на изображении), фотография может быть тегирована "кресло", "бейсбольный мяч" и "стол". В дополнительных вариантах воплощения может быть включен дополнительный тег с индикатором, что основным предметом является (или вероятнее всего является) кресло.

В зависимости от конкретной базы данных распознаваемых объектов может совершенствоваться детализация тегов. Например, база данных может иметь увеличивающуюся детализацию распознаваемых объектов, например, от "автомобиль" к "автомобиль марки BMW" к "автомобиль BMW Z4."

В качестве третьего примера могут быть определены известные географические наземные ориентиры, и информация извлечена из фотографии с использованием комбинации распознавания изображений и геотегирования. Данные из самого фотоизображения могут быть извлечены с помощью распознавания изображений, и распознанные на изображении формы или объекты могут сравниваться с известными географическими наземными ориентирами в или около местоположения, соответствующего информации о местоположении, извлеченной из метаданных или геотега фотографии. Это может быть выполнено путем запроса базы данных, содержащей информацию о географических наземных ориентирах. Например, база данных может быть связана с картой, имеющей названия и географические местоположения известных рек, озер, гор и долин. После распознания, что географический наземный ориентир присутствует на фотографии, и определения названия географического наземного ориентира, фотография может быть автоматически тегирована с помощью названия географического наземного ориентира.

Например, на фотоизображении может быть распознано присутствие водной поверхности с использованием распознавания изображений. Комбинируя распознание того, что на фотографии присутствует вода, с геотегом, ассоциированным с фотографией, который указывает, что местоположение, в котором было захвачено фотоизображение, находится на или около конкретной известной водной поверхности, может привести к автоматическому генерированию тегов для фотографии с названием известной акватории. Например, фотография с большой водной поверхностью и геотегом, указывающим местоположение в Англии вдоль реки Темзы, может быть автоматически тегирована как "Река Темза" и "Река". Фиг. 4 изображает один такой процесс. На фиг. 4 результатом распознавания изображений для фотоизображения 401, показывающего восход солнца над рекой, может быть определение, что на изображении 401 имеется река 402. После определения того, что на фотоизображении есть река, эта информация может затем быть извлечена из изображения и применена в качестве тега и/или использована в генерации дополнительных метаданных. Например, более конкретной идентификации для "реки" 402 можно достичь, используя соответствующие метаданные 403 фотографии. Метаданные 403 могут включать в себя множество информации, такой как метаданные местоположения и метаданные времени и даты.

Для генерации тега географического наземного ориентира используется комбинация метаданных местоположения (из метаданных 403) и распознанного на изображении идентифицированного объекта (402) для генерации дополнительных метаданных. Здесь метаданные 403 указывают местоположение (не показано) около реки Миссисипи, а распознанным на изображении объектом является река. Результатом этого является генерация идентификатора "Река Миссисипи", который может использоваться в качестве тега для фотографии.

В некоторых вариантах воплощения, таких как когда нет никакой географической информации, предоставляющей название конкретного географического наземного ориентира, форма или объект, распознанный как река, может быть тегирован как "Река". Аналогично форма или объект, который распознан как пляж, может быть тегирован как "Пляж" или "Побережье".

В качестве четвертого примера, на фотографии также могут быть определены известные архитектурные наземные ориентиры путем использования комбинации распознавания изображений и геотегирования. Данные из самого фотоизображения могут быть извлечены с помощью распознавания изображений, а распознанные на изображении формы или объекты могут сравниваться с известными архитектурными наземными ориентирами в или около местоположения, соответствующего информации о местоположении, извлеченной из метаданных или геотега фотографии. Это может быть выполнено путем запроса базы данных, содержащей информацию об архитектурных наземных ориентирах. После распознания, что архитектурный наземный ориентир присутствует на фотографии, и определения названия архитектурного наземного ориентира, фотография может быть автоматически тегирована с помощью названия архитектурного наземного ориентира. Архитектурные наземные ориентиры, в том числе Эйфелева башня, Великая китайская стена или Пирамида Хеопса, могут быть распознаны благодаря их отличительным формам и/или признакам. Наличие конкретной структуры на фотографии может быть распознано с использованием распознавания изображений, и фотография тегируется с помощью слова, ассоциированного с этой структурой или признаком. Название конкретной структуры, определенной путем поиска базы данных, может быть дополнительным тегом.

Например, если результатом распознавания изображений является определение, что на фотографии присутствует пирамида, и геотегирование фотографии указывает, что фотография была сделана около пирамиды Гизы, тогда фотография может быть тегирована как "Пирамида Гизы" (или "Пирамида Хеопса") в дополнение к "Пирамиде". Фиг. 5 изображает один такой процесс. На фиг. 5 результатом распознавания изображений для фотоизображения 501, показывающего человека перед основанием Эйфелевой башни, может быть определение, что на изображении 501 присутствует строительное сооружение 502. Путем определения, что на фотоизображении присутствует строительное сооружение, эта информация может затем быть извлечена из изображения и применена как тег и/или использована при генерации дополнительных метаданных. В некоторых вариантах воплощения, где эта информация извлекается (например, что есть строительное сооружение на фотоизображении), фотография может быть тегирована с помощью слова или слов, ассоциированных с распознанным на изображении объектом "строительного сооружения". Более конкретная идентификация "строительного сооружения" может быть достигнута с использованием соответствующих метаданных фотографии 503. Метаданные 503 могут включать в себя множество информации, такой как метаданные местоположения и метаданные времени и даты. В некоторых вариантах воплощения метаданные 503 фотографии могут также включать в себя метаданные конкретной камеры и любые сгенерированные пользователем или другие автоматически сгенерированные теги. Этот список метаданных 503, ассоциированный с фотографией, не должен толковаться как ограничивающий или требующий конкретную информацию, ассоциированную с фотографией, и предназначен просто для иллюстрации некоторых обычных метаданных.

Для генерации тега архитектурного наземного ориентира используется комбинация метаданных местоположения (из метаданных 503) и распознанный на изображении идентифицированный объект (502) для генерации дополнительных метаданных. Здесь метаданные 503 указывают местоположение (не показано) около Эйфелевой башни, а распознанный на изображении объект является строительным сооружением. Результатом этого является генерация идентификатора "Эйфелева башня", который может использоваться в качестве тега для фотографии.

Аналогичные процессы могут выполняться для автоматической генерации тегов распознанных объектов. Например, если на фотографии распознана автомагистраль, фотография может быть тегирована как "автомагистраль". Если распознано известное произведение искусства, то фотография может быть тегирована с помощью названия произведения искусства. Например, фотография скульптуры Родена, Мыслитель, может быть тегирована как "Мыслитель" и "Роден". База данных известных объектов может быть одной базой данных или множеством баз данных, которые могут быть доступны для программы распознавания изображений.

В одном варианте воплощения обработка путем распознавания изображений может проводиться после доступа к базе данных изображений, тегированных или ассоциированных с местоположением, в котором была сделана фотография, что обеспечивает дополнительные наборы данных для сравнения.

В примере, включающем в себя динамические изображения (например, видео), видеопоток в реальном времени (имеющий аудио и визуальные компоненты) может быть импортирован и автоматически тегирован в соответствии с распознанными на изображении и извлеченными данными из назначенных кадров. Окружающий звук может также подвергнуться обработке с помощью алгоритмов распознавания для присоединения признаков звука в качестве тега к видео. Как некоторые примеры, могут выполняться распознавание речи и тонов, распознавание музыки и распознавание звуков (например, сигналов автомобилей, колоколов башни с часами, аплодисментов). Путем идентификации тональных аспектов речи на видео видео может быть автоматически тегировано с помощью терминов на основании эмоций, таких как "сердитый".

В дополнение к представленным здесь примерам следует понимать, что любое число технических приемов может использоваться для обнаружения объекта в пределах изображения и поиска базы данных для нахождения информации, связанной с этим обнаруженным объектом, которая затем может быть ассоциирована с изображением как тег.

Вышеупомянутые примеры не предназначены для какого-либо ограничения объема использования или функциональности технических приемов, описанных здесь применительно к автоматической генерации одного или нескольких типов тегов, ассоциированных с изображением.

В некоторых вариантах воплощения среда, в которой происходит автоматическое тегирование, включает в себя пользовательское устройство и поставщика услуг по генерации тегов, который осуществляет связь с пользовательским устройством по сети. Сеть может быть, но не ограничивается только этим, сотовой (например, беспроводной телефонной) сетью, Интернетом, локальной сетью (LAN), глобальной сетью (WAN), сетью WiFi или их комбинацией. Пользовательское устройство может включать в себя, но не ограничивается только этим, компьютер, мобильный телефон или другое устройство, которое может хранить и/или отображать фотографии или видео и отправлять и осуществлять доступ к контенту (включая фотографии или видео) через сеть. Поставщик услуг по генерации тегов сконфигурирован принимать контент от пользовательского устройства и выполнять автоматическую генерацию тегов. В некоторых вариантах воплощения поставщик услуг по генерации тегов осуществляет связь или является частью поставщика услуг по совместному доступу к файлам, такого как поставщик услуг по обмену фотографиями. Поставщик услуг по генерации тегов может включать в себя компоненты, обеспечивающие и исполняющие программные модули. Эти компоненты (которые могут быть локальными или распределенными) могут включать в себя, но не ограничиваются только этим, процессор (например, центральный процессор (CPU)) и память.

В одном варианте воплощения автоматическое тегирование может быть выполнено посредством программных модулей непосредственно как часть пользовательского устройства (которое включает в себя компоненты, такие как процессор и память, способные исполнять программные модули). В некоторых из таких вариантов воплощения не используется никакой поставщик услуг по генерации тегов. Вместо этого пользовательское устройство осуществляет связь с поставщиками баз данных (или другими устройствами пользователей или поставщиков, хранящих на них базы данных) по сети или осуществляет доступ к базам данных, сохраненным или соединенным с пользовательским устройством.

Некоторые технические приемы, изложенные здесь, могут быть описаны в общем контексте исполняемых компьютером инструкций, таких как программные модули, исполняемые одним или несколькими компьютерами или другими устройствами. В общем случае программные модули включают в себя процедуры, программы, объекты, компоненты и структуры данных, которые выполняют конкретные задачи или реализуют конкретные абстрактные типы данных. В различных вариантах воплощения функциональность программных модулей может быть объединена или распределена, как это требуется, по вычислительной системе или среде. Специалистам в области техники будет понятно, что технические приемы, описанные здесь, могут быть пригодны для использования с другими универсальными и специализированными вычислительными средами и конфигурациями. Примеры вычислительных систем, сред, и/или конфигураций включают в себя, но не ограничиваются только этим, персональные компьютеры, серверные компьютеры, переносные или портативные ЭВМ, многопроцессорные системы, микропроцессорные системы, программируемую бытовую электронику и распределенные вычислительные среды, которые включают в себя любую из вышеупомянутых систем или устройств.

Специалисты в области техники должны принять во внимание, что машиночитаемые носители включают в себя съемные и несъемные структуры/устройства, которые могут использоваться для хранения информации, такой как машиночитаемые инструкции, структуры данных, программные модули и другие данные, используемые вычислительной системой/средой, в виде энергозависимой и энергонезависимой памяти, магнитных структур/устройств и оптических структур/устройств, и могут быть любыми доступными медиаданными, к которым может получить доступ пользовательское устройство. Машиночитаемые носители не должны толковаться или интерпретироваться как включающие в себя любые распространяющиеся сигналы.

Любая ссылка в этом описании на "один вариант воплощения", "вариант воплощения", "иллюстративный вариант воплощения" и т.д. означает, что конкретный признак, структура или характеристика, описанная применительно к варианту воплощения, содержится по меньшей мере в одном варианте воплощения изобретения. Появление таких фраз в различных местах описания не обязательно ссылается на один и тот же вариант воплощения. Кроме того, любые элементы или ограничения любого изобретения или его варианта воплощения, раскрытого здесь, могут быть объединены с любым и/или всеми другими элементами или ограничениями (по отдельности или в любой комбинации) или любым другим изобретением или его вариантом воплощения, раскрытым здесь, и все такие комбинации находятся в пределах объема этого изобретения, не ограничивая его.

Следует понимать, что примеры и варианты воплощения, описанные здесь, предназначены только для иллюстративных целей и что различные модификации или изменения в свете этого, предложенные специалистами в области техники, должны быть включены в сущность и объем этой заявки.

| название | год | авторы | номер документа |

|---|---|---|---|

| ПОИСК ИЗОБРАЖЕНИЙ НА ЕСТЕСТВЕННОМ ЯЗЫКЕ | 2015 |

|

RU2688271C2 |

| СИСТЕМА И СПОСОБ ДЛЯ ИСПОЛЬЗОВАНИЯ ВОЗМОЖНОСТЕЙ КОНТЕНТА И МЕТАДАННЫХ ЦИФРОВЫХ ИЗОБРАЖЕНИЙ ДЛЯ НАХОЖДЕНИЯ СООТВЕТСТВУЮЩЕГО ЗВУКОВОГО СОПРОВОЖДЕНИЯ | 2006 |

|

RU2444072C2 |

| ПЕРСОНАЛИЗИРОВАННЫЙ РЕПОЗИТОРИЙ ОБЪЕКТОВ | 2016 |

|

RU2696225C1 |

| СИСТЕМА И СПОСОБ ФОРМИРОВАНИЯ ОТЧЕТОВ НА ОСНОВАНИИ АНАЛИЗА МЕСТОПОЛОЖЕНИЯ И ВЗАИМОДЕЙСТВИЯ СОТРУДНИКОВ И ПОСЕТИТЕЛЕЙ | 2020 |

|

RU2756780C1 |

| ИДЕНТИФИКАЦИЯ МЕДИАДАННЫХ | 2006 |

|

RU2408067C2 |

| РАСПОЗНАВАНИЕ СОБЫТИЙ НА ФОТОГРАФИЯХ С АВТОМАТИЧЕСКИМ ВЫДЕЛЕНИЕМ АЛЬБОМОВ | 2020 |

|

RU2742602C1 |

| АВТОМАТИЧЕСКОЕ РАСПОЗНАВАНИЕ И СЪЕМКА ОБЪЕКТА | 2012 |

|

RU2533445C2 |

| АНАЛИТИЧЕСКАЯ СИСТЕМА РАСПОЗНАВАНИЯ | 2014 |

|

RU2760211C2 |

| АВТОМАТИЗАЦИЯ ПРОВЕРКИ ДОСТОВЕРНОСТИ ИЗОБРАЖЕНИЯ | 2017 |

|

RU2740702C2 |

| УПРАВЛЕНИЕ ДАННЫМИ ДЛЯ СОЕДИНЕННЫХ УСТРОЙСТВ | 2014 |

|

RU2670573C2 |

Изобретение относится к автоматическому извлечению данных и тегированию фотографии или видео, имеющих изображение идентифицируемых объектов. Технический результат заключается в обеспечении идентификации изображения за счет формирования дополнительных тегов, которые описывают изображения объектов на фотографии. Указанный результат достигается за счет извлечения метаданных из файла изображения о географическом положении, информации о дате и времени, когда изображение было отснято. Выполняют распознавание изображений для идентификации одного или нескольких объектов, форм, признаков или текстур на изображении. Тегируют изображение с помощью информации или кода, относящегося к этим одному или нескольким объектам, формам, признакам или текстурам. Определяют соответствующие подробности касательно идентифицированного объекта или формы упомянутых одного или нескольких объектов, форм, признаков или текстур путем использования информации или кода, связанного с идентифицированным объектом или формой, и географической информации для запроса по меньшей мере одной базы данных для сопоставления идентифицированного объекта или формы и местоположения. 3 н. и 7 з.п. ф-лы, 5 ил., 1 табл.

1. Способ автоматической генерации тегов, содержащий этапы, на которых:

извлекают метаданные из файла изображения, ассоциированного с изображением, включающие в себя географическую информацию, относящуюся к местоположению, в котором изображение было отснято, и, опционально, информацию о дате и времени, относящихся к тому, когда изображение было отснято;

выполняют распознавание изображений для идентификации одного или нескольких объектов, форм, признаков или текстур на изображении;

автоматически тегируют изображение с помощью информации или кода, относящегося к этим одному или нескольким объектам, формам, признакам или текстурам;

определяют соответствующие подробности касательно идентифицированного объекта или формы упомянутых одного или нескольких объектов, форм, признаков или текстур путем:

использования информации или кода, связанного с идентифицированным объектом или формой, и географической информации для запроса по меньшей мере одной базы данных для сопоставления идентифицированного объекта или формы и местоположения, в котором изображение было отснято, с соответствующими подробностями, связанными с объектом или формой и местоположением, в котором изображение было отснято, или

использования информации или кода, связанного с идентифицированным объектом или формой, и информации о дате и времени для запроса по меньшей мере одной базы данных для сопоставления идентифицированного объекта или формы и того, когда изображение было отснято, с соответствующими подробностями, связанными с объектом или формой и тем, когда изображение было отснято, или

использования информации или кода, связанного с идентифицированным объектом или формой, и географической информации и информации о дате и времени для запроса по меньшей мере одной базы данных для сопоставления идентифицированного объекта или формы и местоположения, в котором было отснято изображение, и того, когда изображение было отснято, с соответствующими подробностями, связанными с объектом или формой, и местоположением, в котором было отснято изображение, и тем, когда изображение было отснято; и

автоматически тегируют изображение с помощью информации или кода, связанного с соответствующими подробностями.

2. Способ по п. 1, в котором при выполнении распознавания изображений для идентификации одного или нескольких объектов, форм, признаков или текстур на изображении используют географическую информацию, извлеченную из файла изображения.

3. Способ по п. 1, содержащий этапы, на которых:

выполняют распознавание наземного ориентира для идентификации одного или нескольких наземных ориентиров на изображении; и

автоматически тегируют изображение с помощью информации или кода, связанного с этими одним или несколькими наземными ориентирами.

4. Способ по п. 3, в котором при выполнении распознавания наземного ориентира запрашивают базу данных архитектурных или географических наземных ориентиров с использованием информации или кода, связанного с выбранными одним или несколькими объектами на изображении, идентифицированными во время выполнения распознавания изображений, и географической информации, извлеченной из файла изображения.

5. Способ по п. 1, дополнительно содержащий этапы, на которых:

определяют соответствующее условие для события, которое происходило в местоположении, в котором изображение было отснято, и во время даты и времени, когда изображение было отснято, путем использования географической информации и информации о дате и времени, извлеченных из файла изображения, ассоциированного с изображением, для запроса по меньшей мере одной базы данных; и

автоматически тегируют изображение с помощью информации или кода, связанного с этим соответствующим условием для события.

6. Считываемый компьютером носитель, на котором сохранены инструкции, которыми при их исполнении выполняется способ по любому из пп. 1-5.

7. Считываемый компьютером носитель, на котором сохранены машиночитаемые инструкции для выполнения автоматической генерации тегов, причем этими инструкциями реализуются этапы для:

извлечения метаданных из файла изображения, ассоциированного с изображением, в том числе любой географической информации, связанной с местоположением, в котором изображение было отснято, причем изображение содержит фотографию или кадр видео;

выполнения распознавания изображений для идентификации объекта на изображении;

определения по меньшей мере одного конкретного условия, соответствующего объекту и местоположению, в котором изображение было отснято, путем:

запроса базы данных на предмет по меньшей мере одного конкретного условия, соотносящего объект и местоположение, в котором изображение было отснято, и

приема информации или кода, ассоциированного с этим по меньшей мере одним конкретным условием, из базы данных; и

автоматического тегирования изображения с помощью информации или кода, ассоциированного с упомянутым по меньшей мере одним конкретным условием.

8. Считываемый компьютером носитель по п. 7, в котором инструкции дополнительно содержат этапы для автоматического тегирования изображения с помощью слова или кода, ассоциированного с объектом на изображении, после выполнения распознавания изображений для идентификации объекта на изображении.

9. Считываемый компьютером носитель по п. 7 или 8, в котором выполнение распознавания изображений дополнительно содержит использование метаданных, извлеченных из файла изображения, для обеспечения идентификации объекта.

10. Считываемый компьютером носитель по п. 7, при этом

метаданные, извлеченные из файла изображения, включают в себя информацию о дате и времени, связанную с тем, когда изображение было отснято; и при этом информация или код, ассоциированный с упомянутым по меньшей мере одним конкретным условием, содержит код или информацию о событии, код или информацию о погоде, код или информацию о географическом наземном ориентире, код или информацию об архитектурном наземном ориентире, либо их комбинацию.

| WO 2010102515 A1, 16.09.2010 | |||

| US 2009222432 A1, 03.09.2009 | |||

| KR 20090041750 A, 29.04.2009 | |||

| US 2006251338 A1, 09.11.2006 | |||

| RU 2005105339 A, 27.01.2006. |

Авторы

Даты

2017-01-17—Публикация

2012-11-16—Подача