Область техники, к которой относится изобретение

Настоящее раскрываемое изобретение относится к устройству обработки информации и способу обработки информации, а более конкретно, к устройству обработки информации и способу обработки информации, которые способны повысить эффективность получения предварительно заданного типа аудиоданных из числа множества типов аудиоданных.

Уровень техники

Одним из недавно появившихся самых популярных новых сервисов потоковой передачи данных является "избыточные" видеоданные (OTT-V), передаваемые через сеть "Интернет". В качестве лежащей в основе этого технологии используется (смотри, например, непатентный документ 1) стадия стандарта экспертной группы по вопросам движущегося изображения - динамическая адаптивная потоковая передача данных посредством HTTP-протокола (MPEG-DASH).

В стандарте MPEG-DASH, поставляющий сервер подготавливает группу видеоданных, имеющих различные размеры экранного изображения и скорости кодирования, для одного элемента контента (информационно значимого содержимого), и воспроизводящее оконечное устройство запрашивает, в зависимости от условий линии передачи данных, группу видеоданных, имеющих оптимальный размер экрана и скорость кодирования, таким образом, достигается адаптивная потоковая поставка данных.

Список упоминаемых документов

Непатентный документ

Непатентный документ 1: MPEG-DASH (Dynamic Adaptive Streaming over HTTP) (MPEG-DASH (Динамическая адаптивная потоковая передача данных посредством HTTP-протокола (Протокола передачи гипертекста))) (URL: http://mpeg.chiariglione.org/standards/mpeg-dash/media-presentation-description-and-segment-formats/text-isoiec-23009-12012-dam-1)

Сущность изобретения

Задачи, решаемые изобретением

Однако никакого внимания не уделяется повышению эффективности получения предварительно задаваемого типа аудиоданных из числа множества типов аудиоданных видеоконтента.

Настоящее раскрываемое изобретение было сделано ввиду вышеупомянутых обстоятельств и способно повысить эффективность получения предварительно задаваемого типа аудиоданных из числа множества типов аудиоданных.

Решения задач

Устройство обработки информации, соответствующее некоторому первому аспекту настоящего раскрываемого изобретения, представляет собой устройство обработки информации, включающее в себя получающий блок, который получает аудиоданные на предварительно заданной дорожке файла, в котором множество типов аудиоданных разделены на множество дорожек в зависимости от этих типов, и эти дорожки упорядочены.

Способ обработки информации, соответствующий первому аспекту настоящего раскрываемого изобретения, корреспондирует устройству обработки информации, соответствующему первому аспекту настоящего раскрываемого изобретения.

В первом аспекте настоящего раскрываемого изобретения, получают аудиоданные предварительно заданной дорожки в файле, в котором множество типов аудиоданных разделены на множество дорожек в зависимости от этих типов, и эти дорожки упорядочены.

Устройство обработки информации, соответствующее некоторому второму аспекту настоящего раскрываемого изобретения, представляет собой устройство обработки информации, включающее в себя генерирующий блок, который генерирует файл, в котором множество типов аудиоданных разделены на множество дорожек в зависимости от этих типов, и эти дорожки упорядочены.

Способ обработки информации, соответствующий второму аспекту настоящего раскрываемого изобретения, корреспондирует устройству обработки информации, соответствующему второму аспекту настоящего раскрываемого изобретения.

Во втором аспекте настоящего раскрываемого изобретения, генерируется файл, в котором множество типов аудиоданных разделены на множество дорожек в зависимости от этих типов и эти дорожки упорядочены.

Отметим, что устройства обработки информации, соответствующие первому и второму аспектам, можно реализовать, заставляя компьютер исполнять некоторую программу.

Кроме того, для реализации устройств обработки информации, соответствующих первому и второму аспектам, программа, исполняемая компьютером, может быть предоставлена посредством передачи этой программы через передающую среду, или посредством записи этой программы на носитель записи.

Результаты изобретения

В соответствии с первым аспектом настоящего раскрываемого изобретения, могут быть получены аудиоданные. Кроме того, в соответствии с первым аспектом настоящего раскрываемого изобретения, предварительно заданный тип аудиоданных из числа множества типов аудиоданных может быть получен эффективным образом.

В соответствии со вторым аспектом настоящего раскрываемого изобретения, может быть сгенерирован файл. Кроме того, в соответствии со вторым аспектом настоящего раскрываемого изобретения, может быть сгенерирован файл, который повышает эффективность получения предварительно заданного типа аудиоданных из числа множества типов аудиоданных.

Краткое описание чертежей

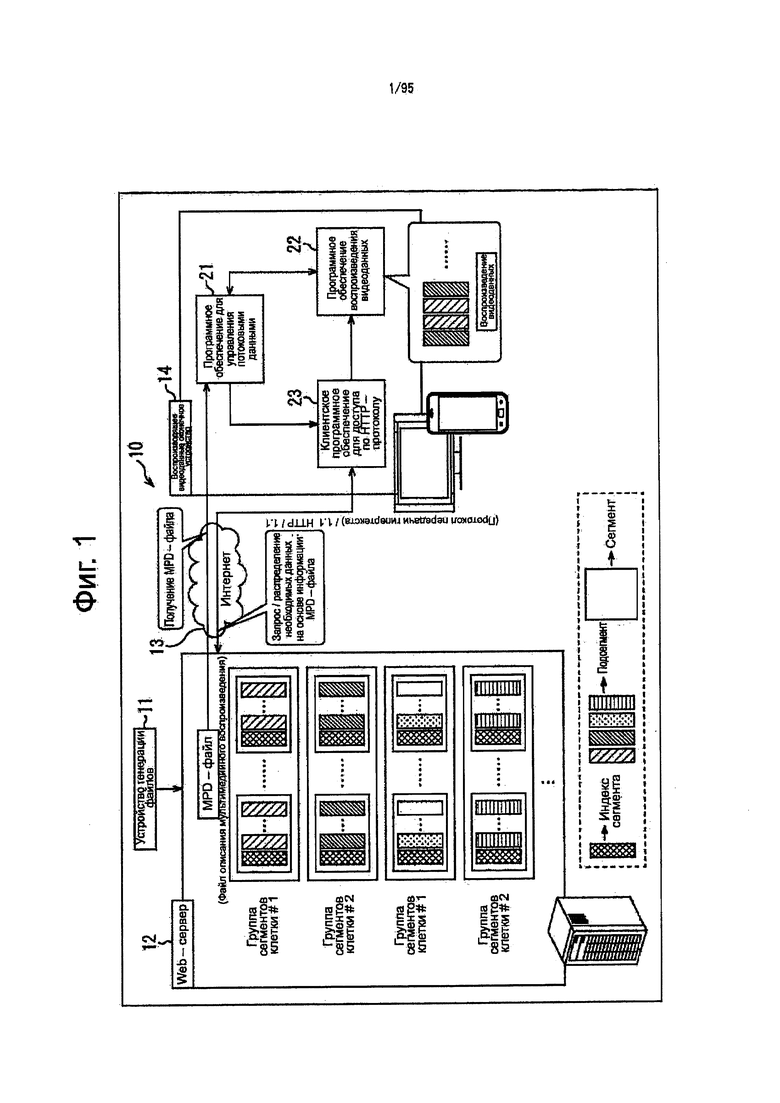

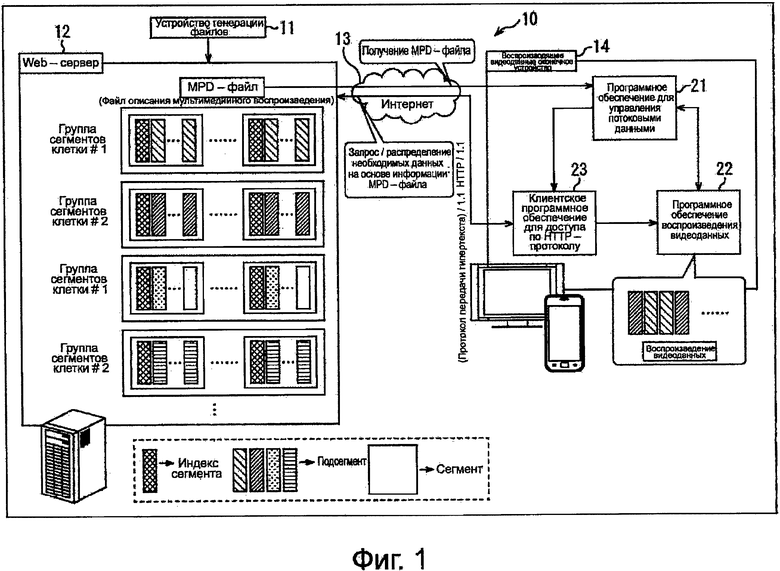

Фиг. 1 представляет собой схему, на которой проиллюстрирован план некоторого первого примера системы обработки информации, в которой применено настоящее раскрываемое изобретение.

Фиг. 2 представляет собой схему, на которой показан пример файла.

Фиг. 3 представляет собой схему, на которой проиллюстрирован объект.

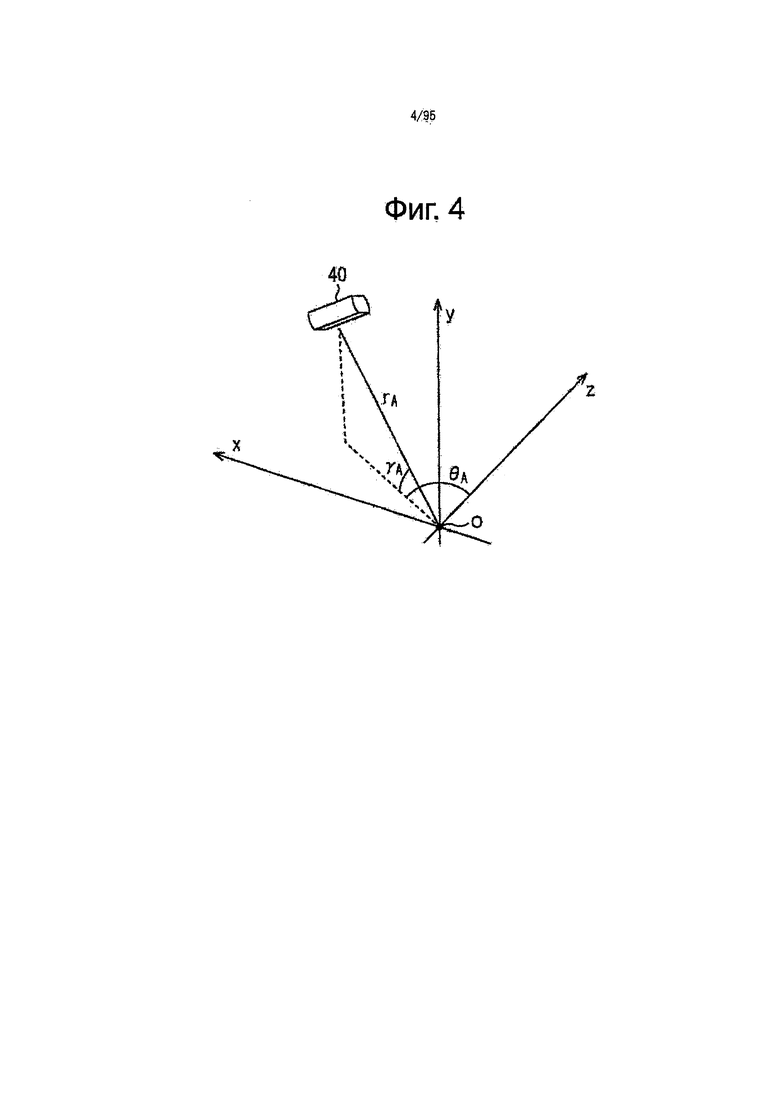

Фиг. 4 представляет собой схему, на которой проиллюстрирована информация о месте расположения объекта.

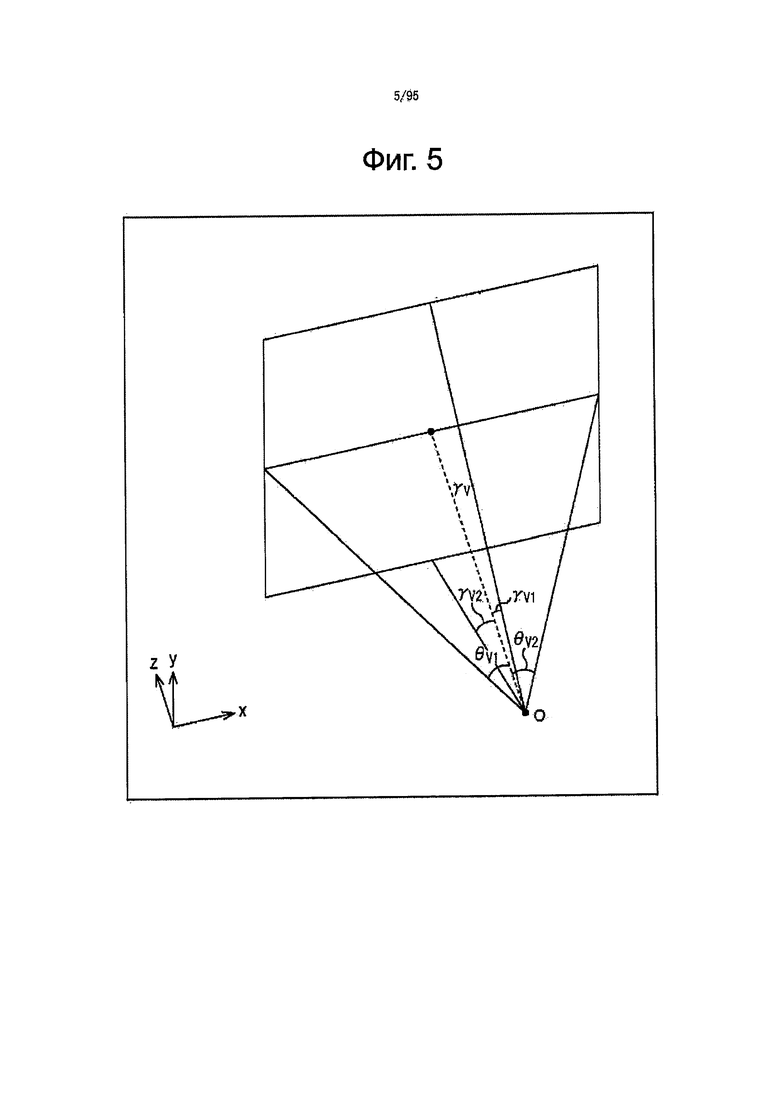

Фиг. 5 представляет собой схему, на которой проиллюстрирована информация о размере кадра изображения.

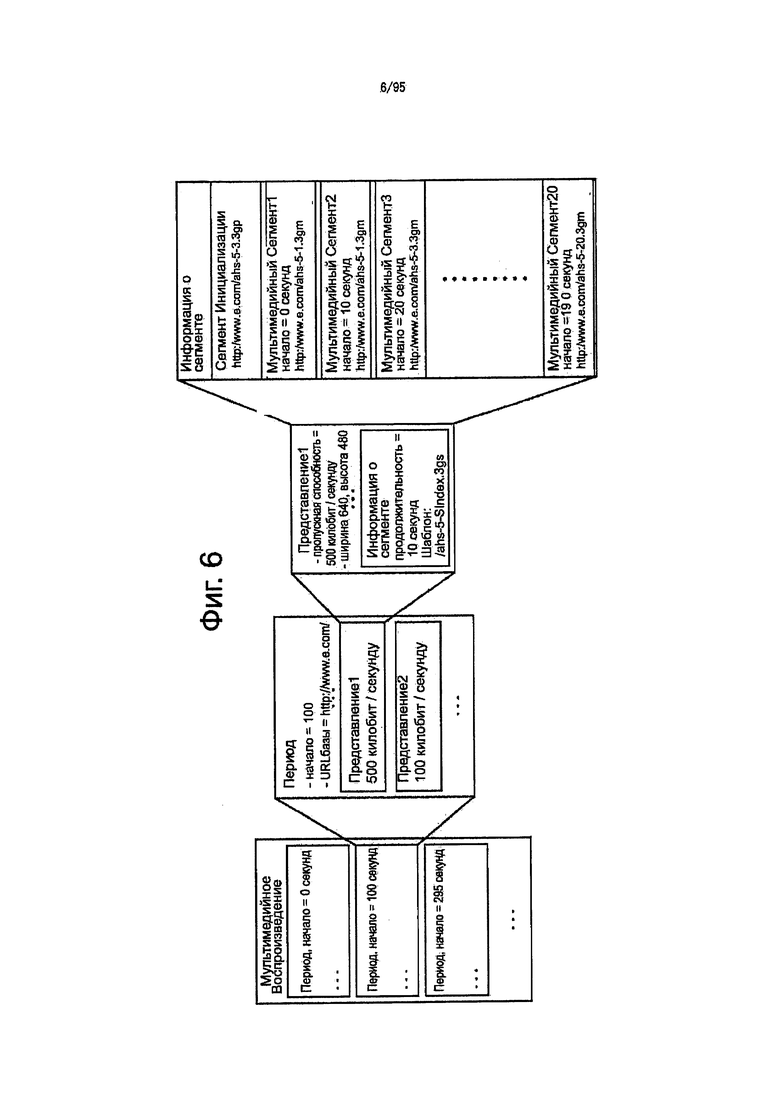

Фиг. 6 представляет собой схему, на которой показана структура MPD-файла.

Фиг. 7 представляет собой схему, на которой показано соотношение между "Period" ("Периодом"), "Representation" ("Представлением") и "Segment" ("Сегментом").

Фиг. 8 представляет собой схему, на которой показана иерархическая структура MPD-файла.

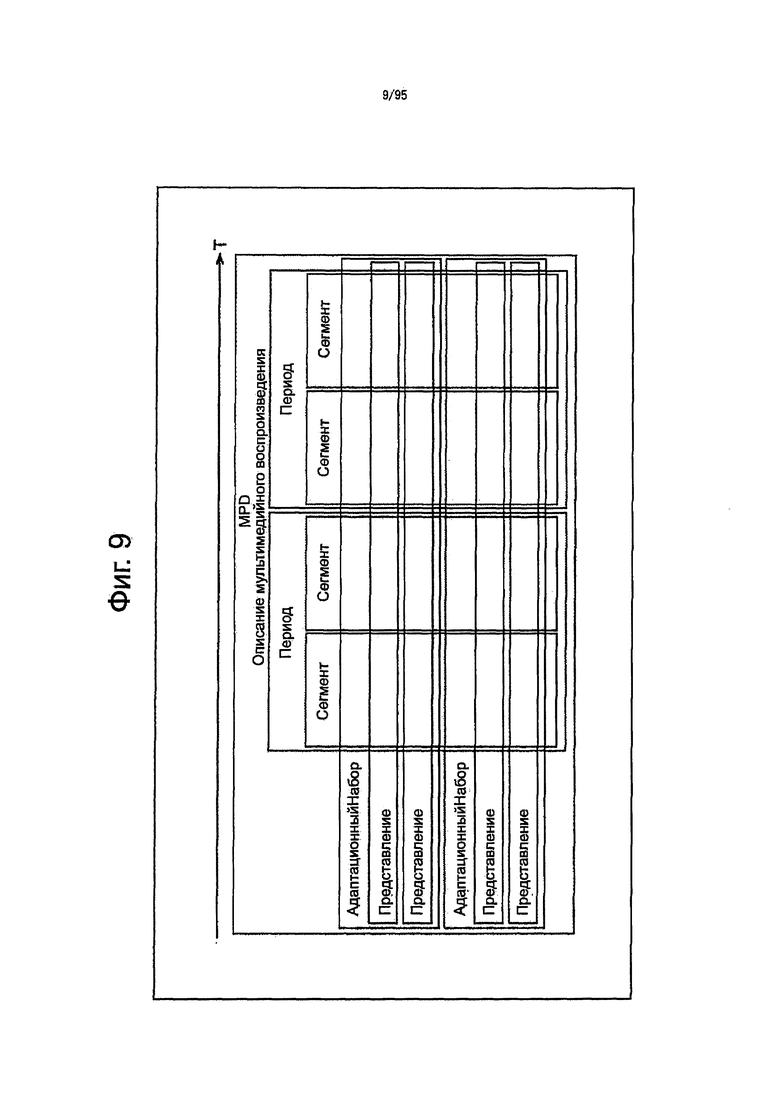

Фиг. 9 представляет собой схему, на которой показано соотношение между структурой MPD-файл и осью времени.

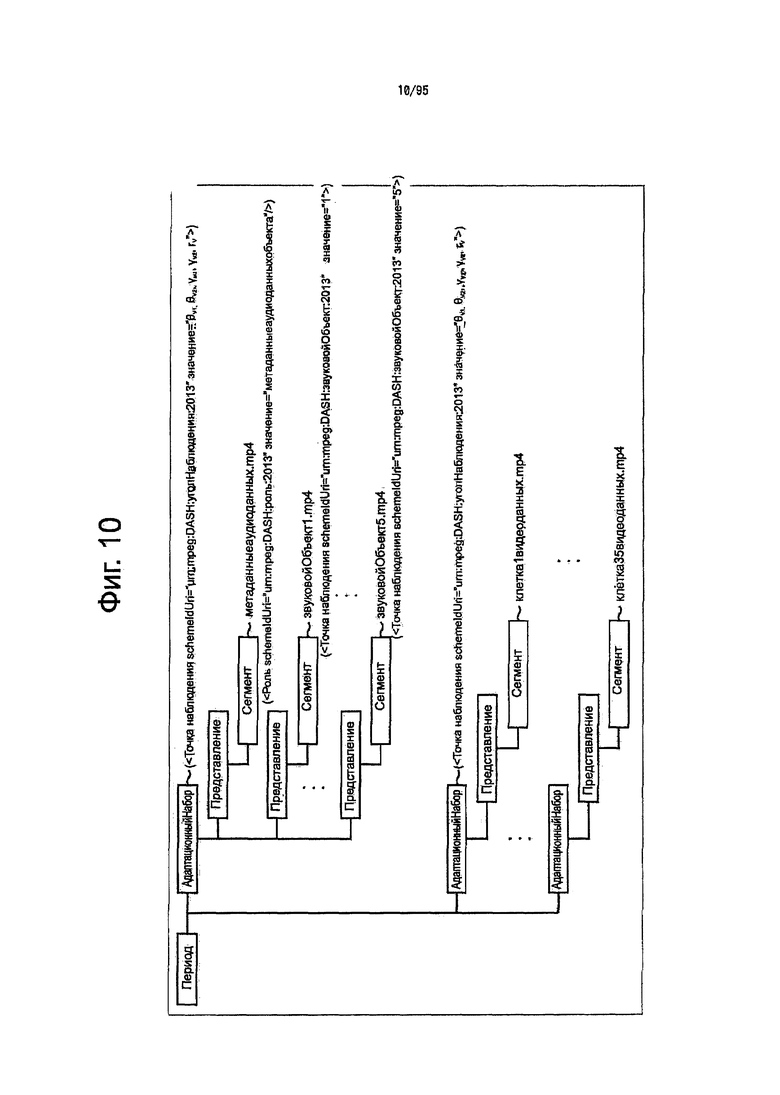

Фиг. 10 представляет собой схему, на которой проиллюстрировано приводимое в качестве примера описание MPD-файла.

Фиг. 11 представляет собой структурную схему, на которой показан пример конфигурации устройства генерации файлов.

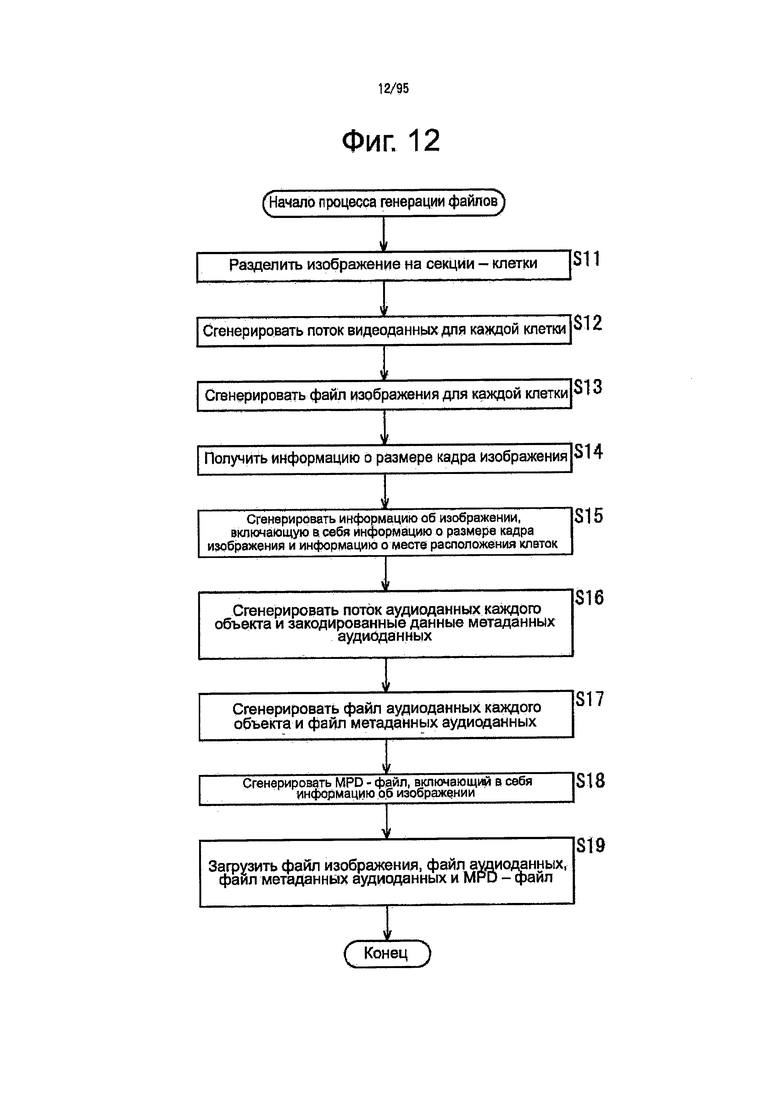

Фиг. 12 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс генерации файлов в устройстве генерации файлов.

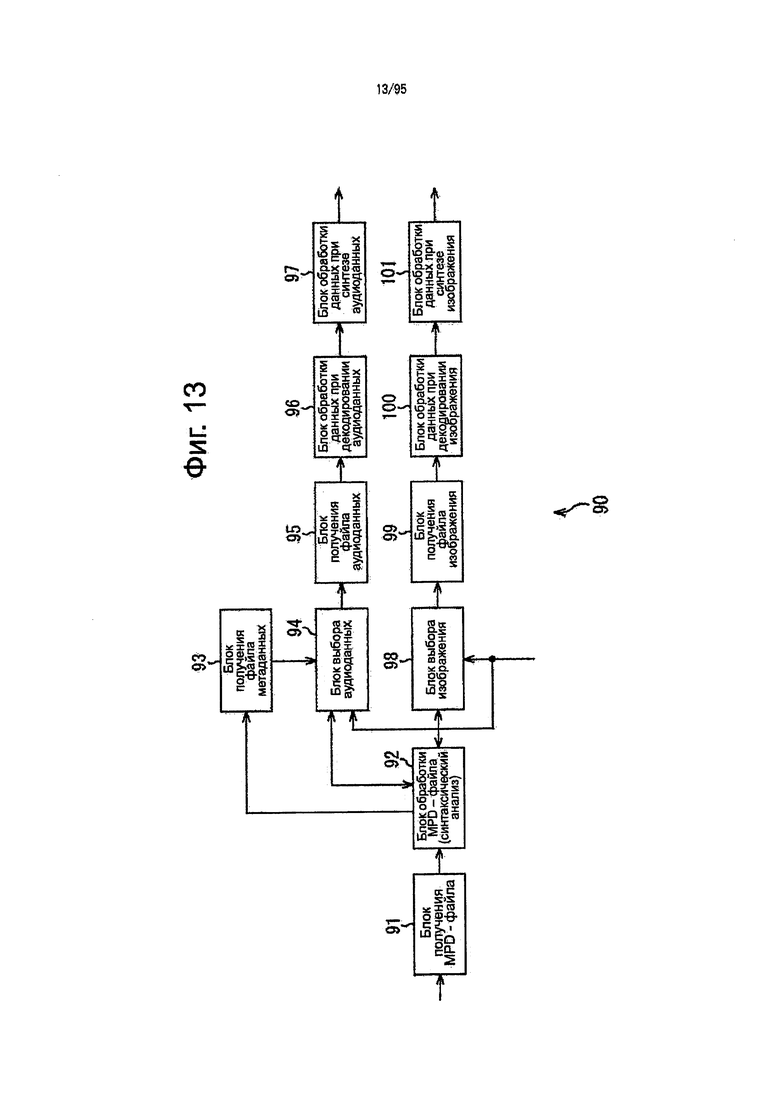

Фиг. 13 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения.

Фиг. 14 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс потокового воспроизведения в блоке потокового воспроизведения.

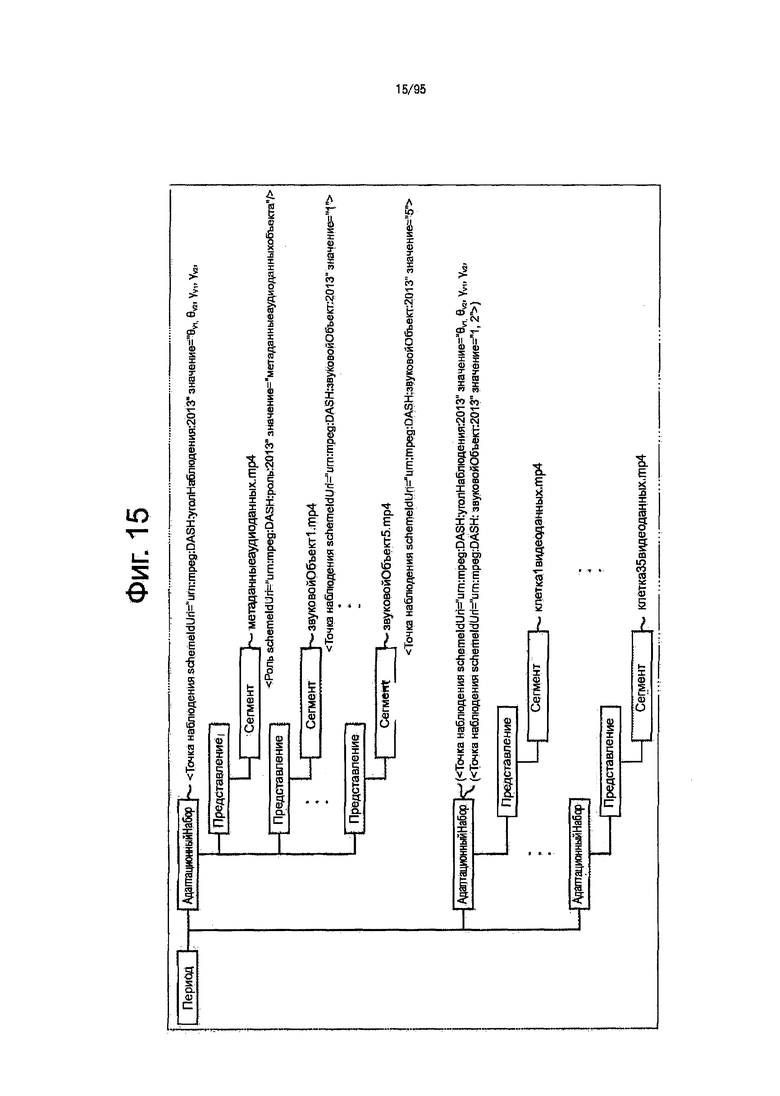

Фиг. 15 представляет собой схему, на которой проиллюстрировано приводимое в качестве примера описание MPD-файла.

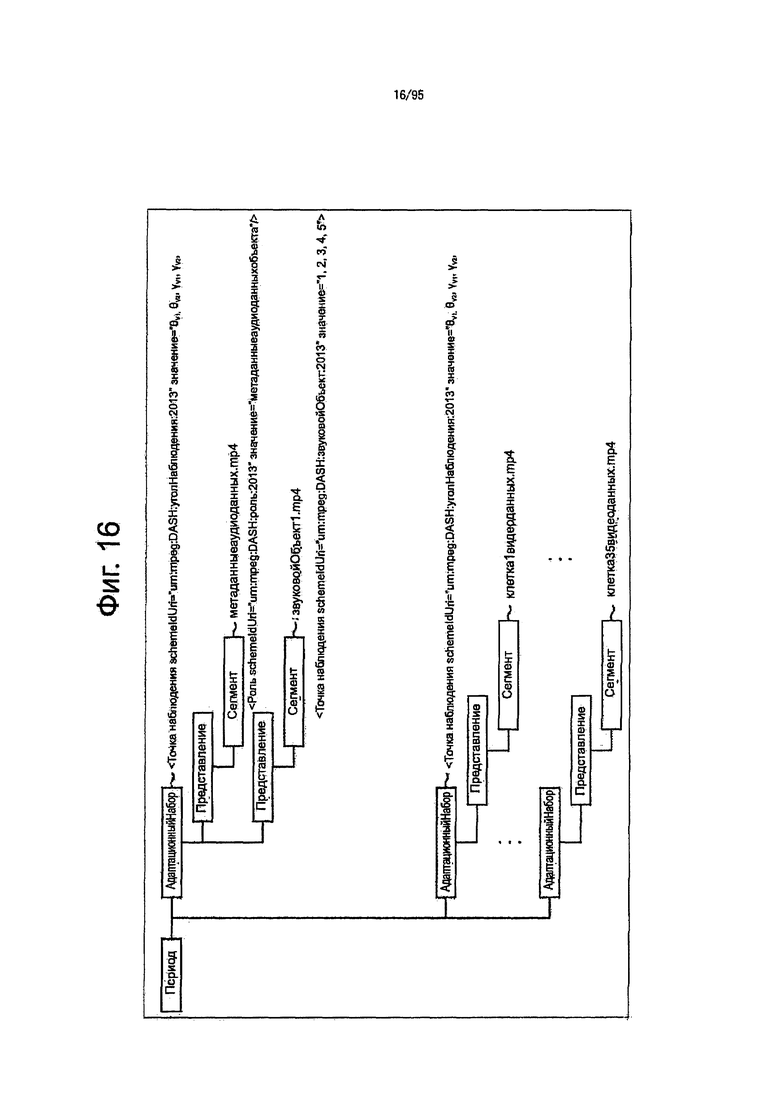

Фиг. 16 представляет собой схему, на которой проиллюстрировано другое приводимое в качестве примера описание MPD-файла.

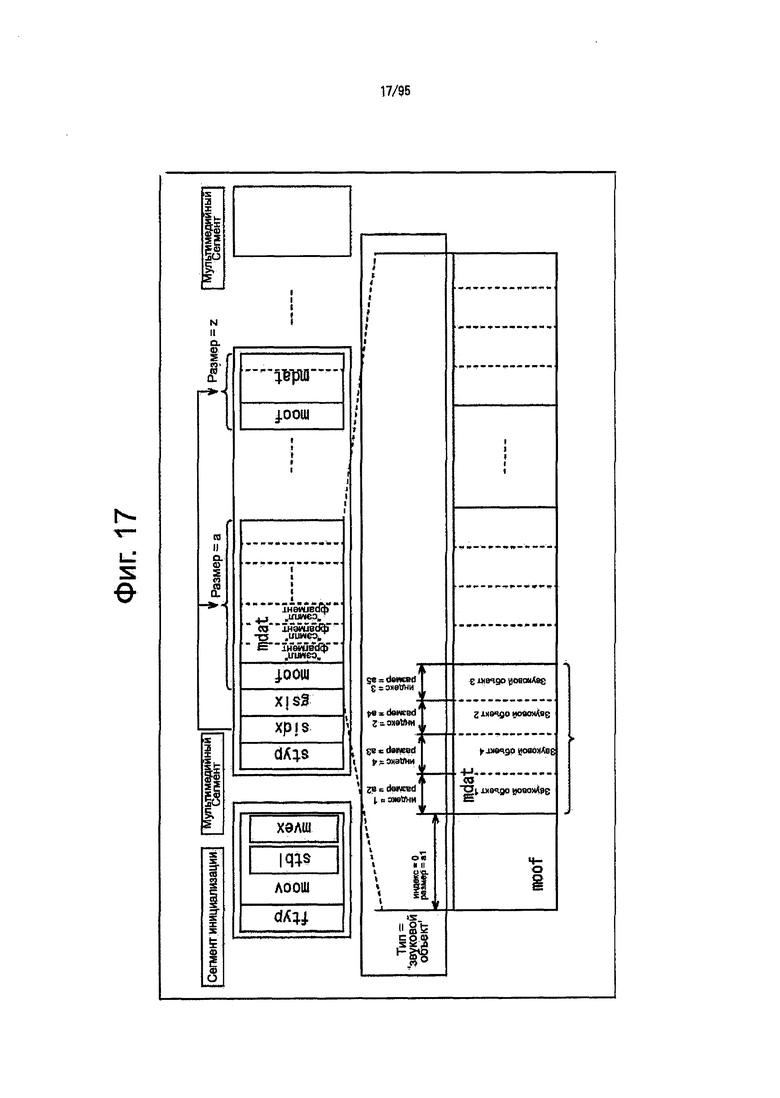

Фиг. 17 представляет собой схему, на которой показан пример организации потока аудиоданных.

Фиг. 18 представляет собой схему, на которой показано приводимое в качестве примера описание поля gsix.

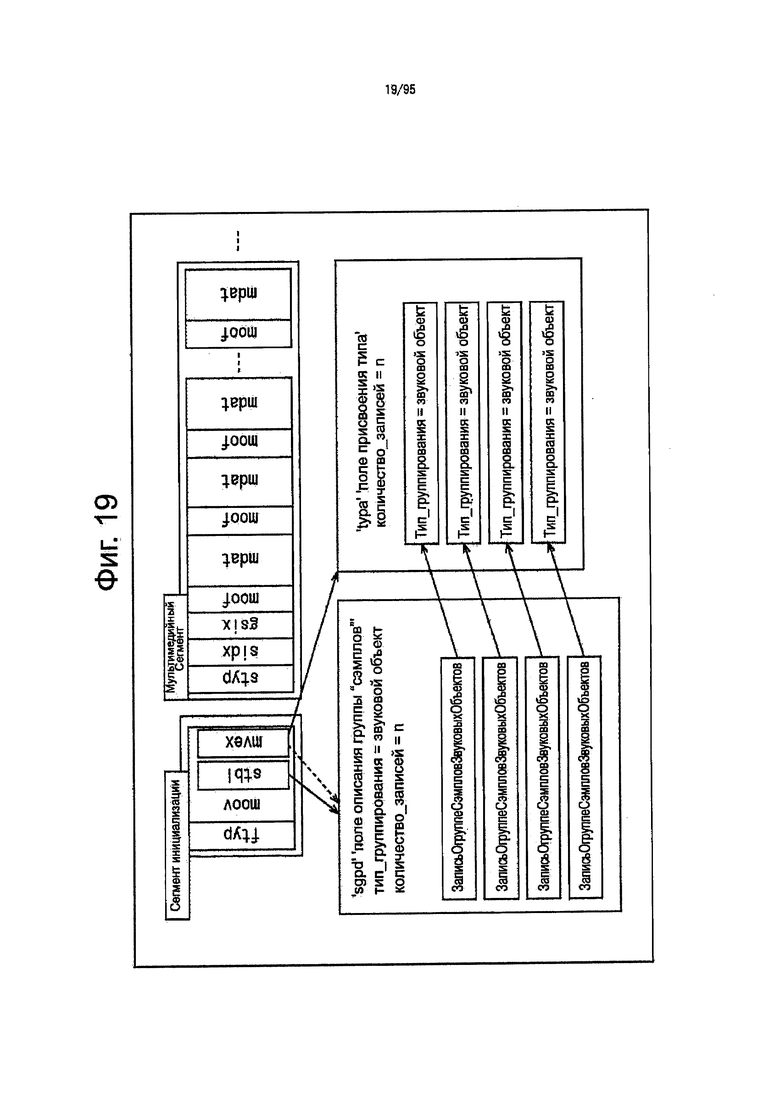

Фиг. 19 представляет собой схему, на которой показан пример информации, указывающей отношение соответствия между записью о группе "сэмплов" и идентификатором объекта.

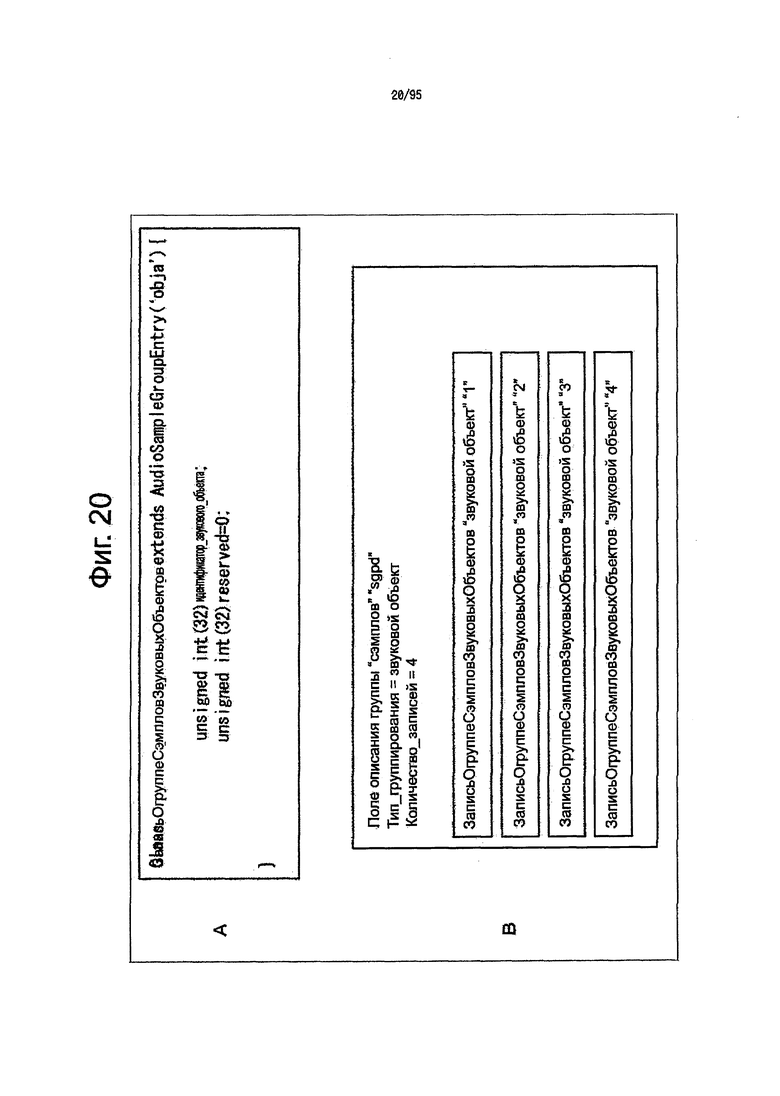

Фиг. 20 представляет собой схему, на которой показано приводимое в качестве примера описание поля AudioObjectSampleGroupEntry (ЗаписьОгруппеСэмпловЗвуковыхОбъектов).

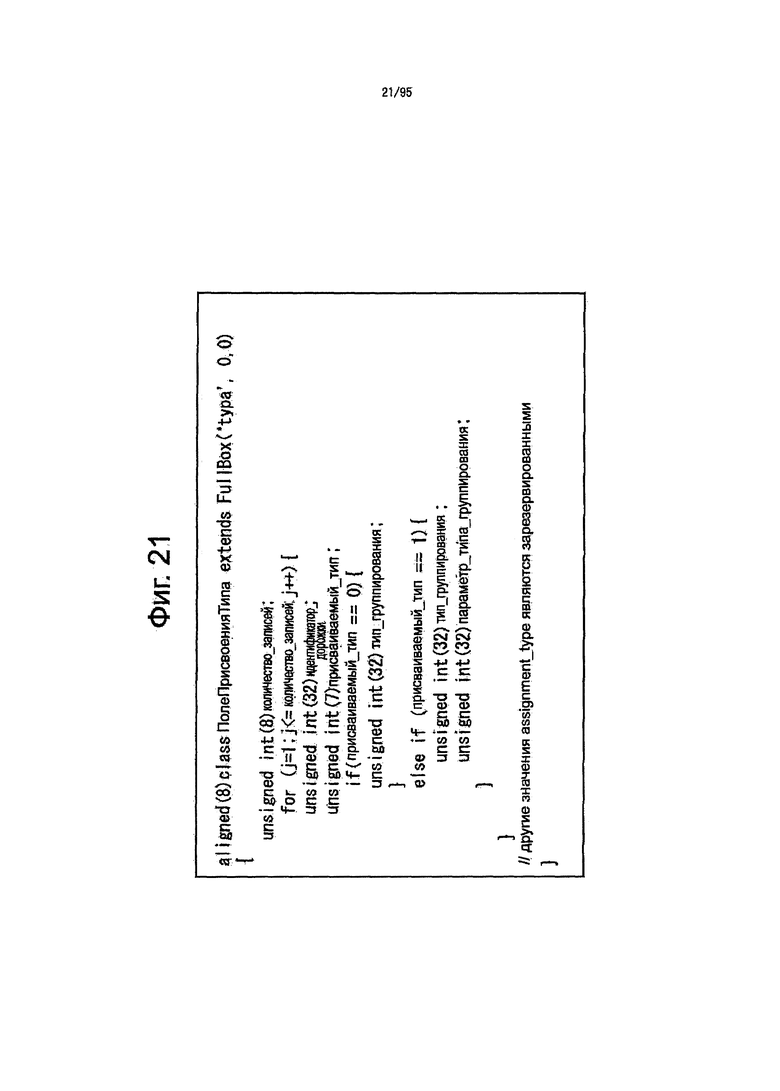

Фиг. 21 представляет собой схему, на которой показано приводимое в качестве примера описание поля присвоения типа.

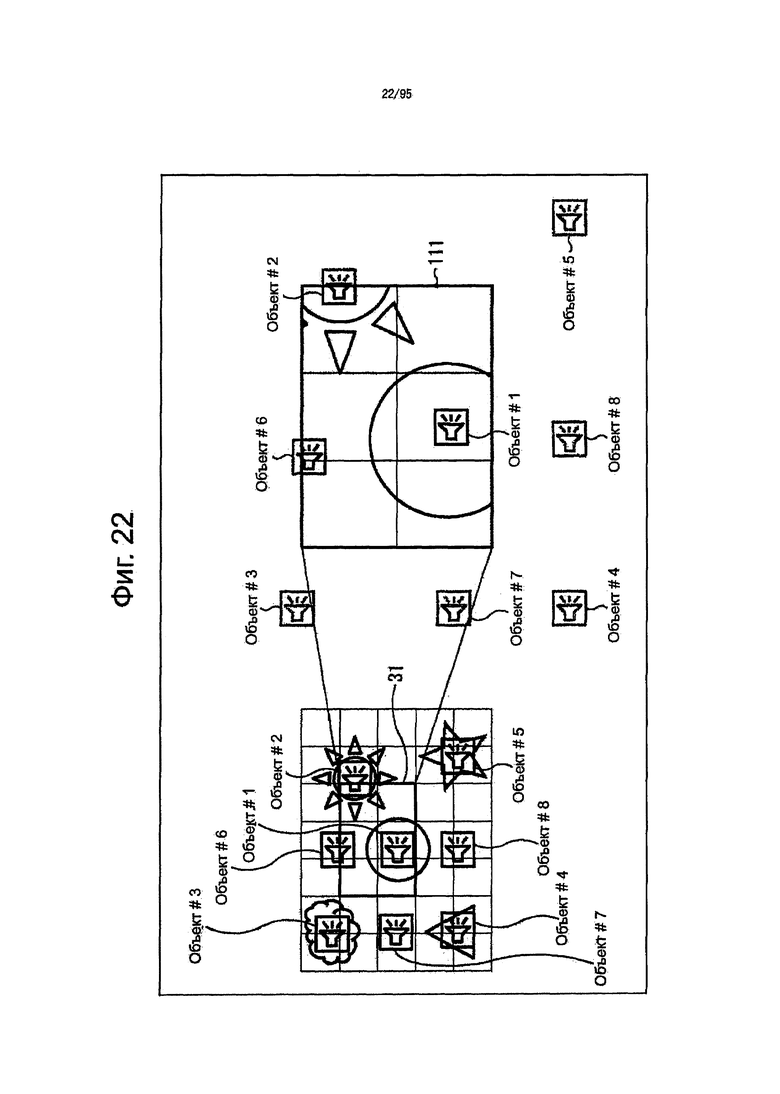

Фиг. 22 представляет собой схему, на которой проиллюстрирован план некоторого второго примера системы обработки информации, в которой применено настоящее раскрываемое изобретение.

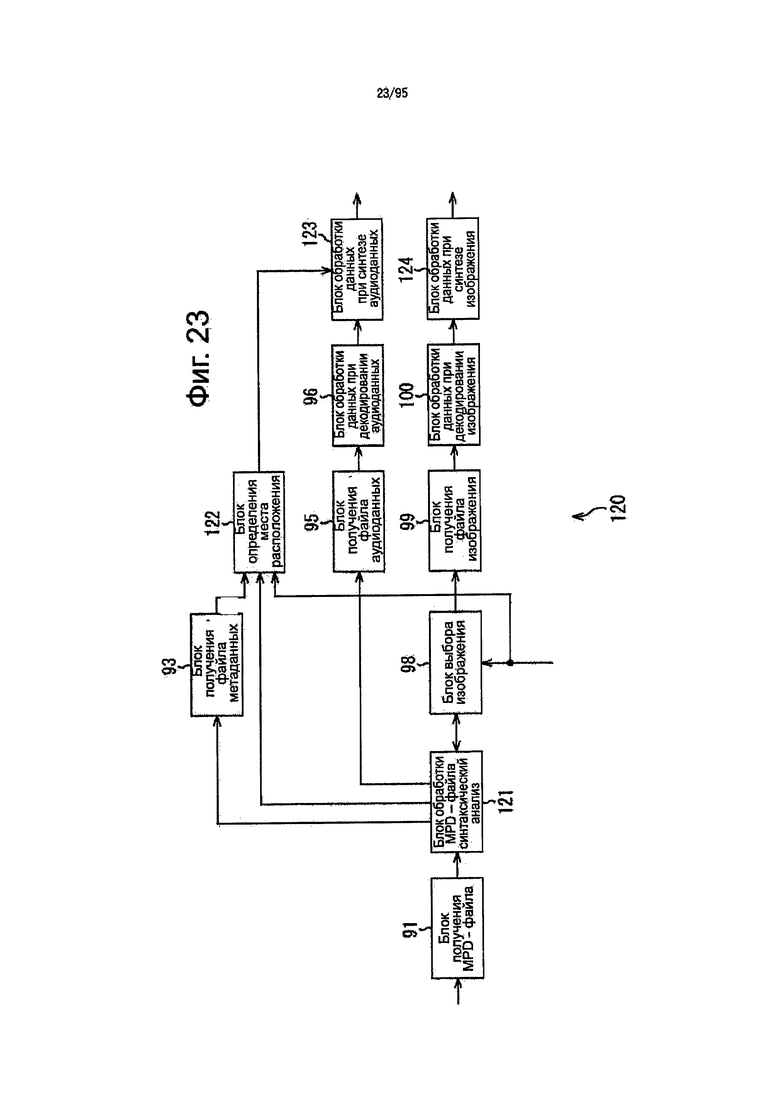

Фиг. 23 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения в системе обработки информации, в которой применено настоящее раскрываемое изобретение.

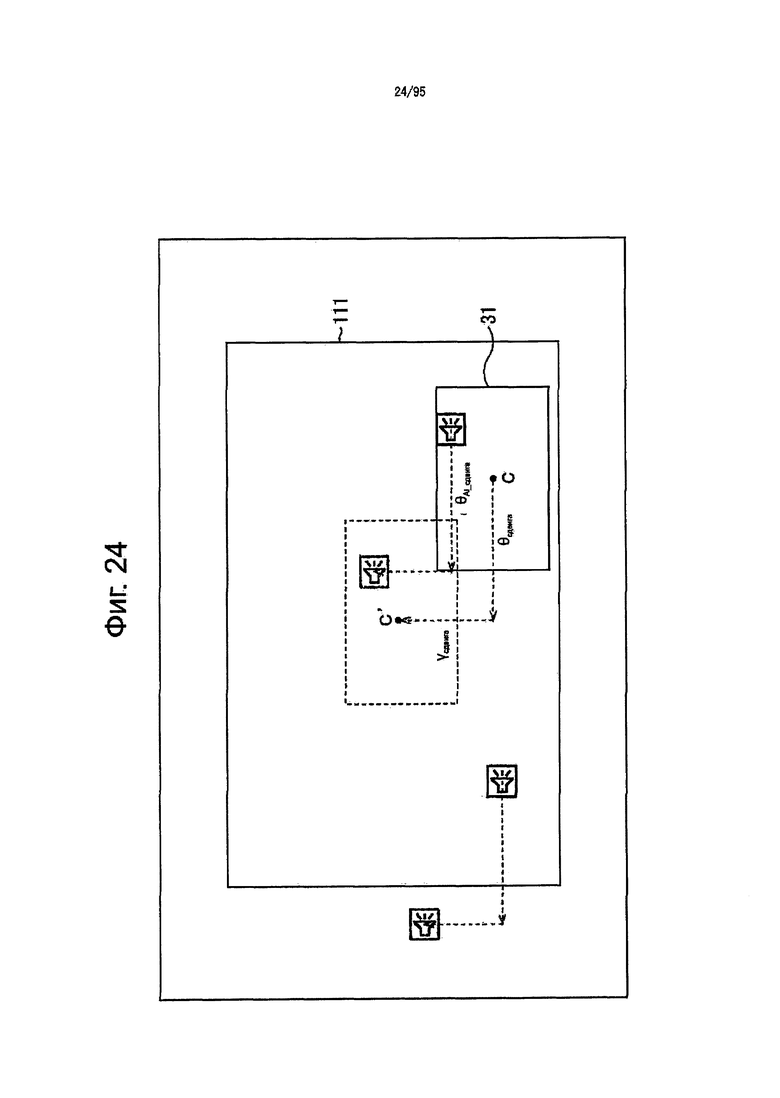

Фиг. 24 представляет собой схему, на которой проиллюстрирован способ определения места расположения объекта.

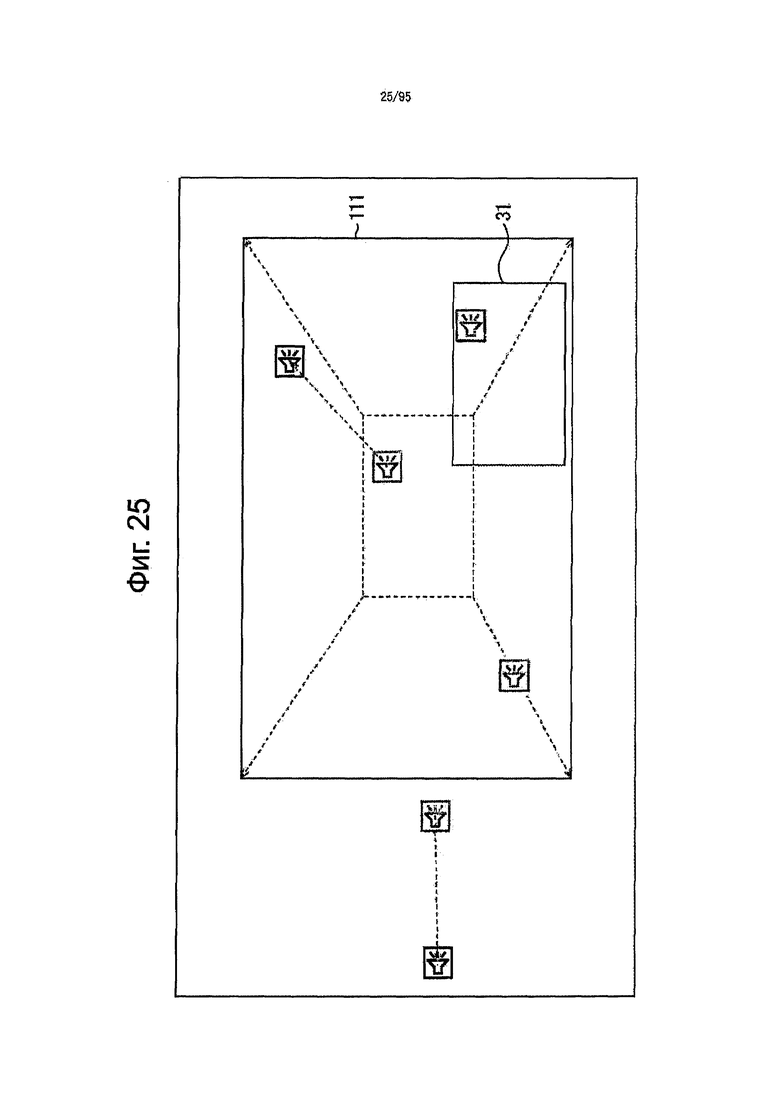

Фиг. 25 представляет собой схему, на которой проиллюстрирован способ определения места расположения объекта.

Фиг. 26 представляет собой схему, на которой проиллюстрирован способ определения места расположения объекта.

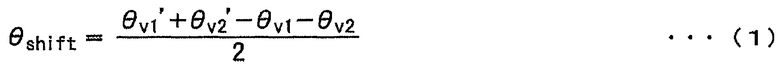

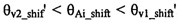

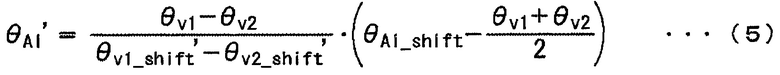

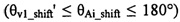

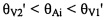

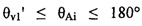

Фиг. 27 представляет собой схему, на которой показана зависимость между горизонтальным углом θAi и горизонтальным углом  .

.

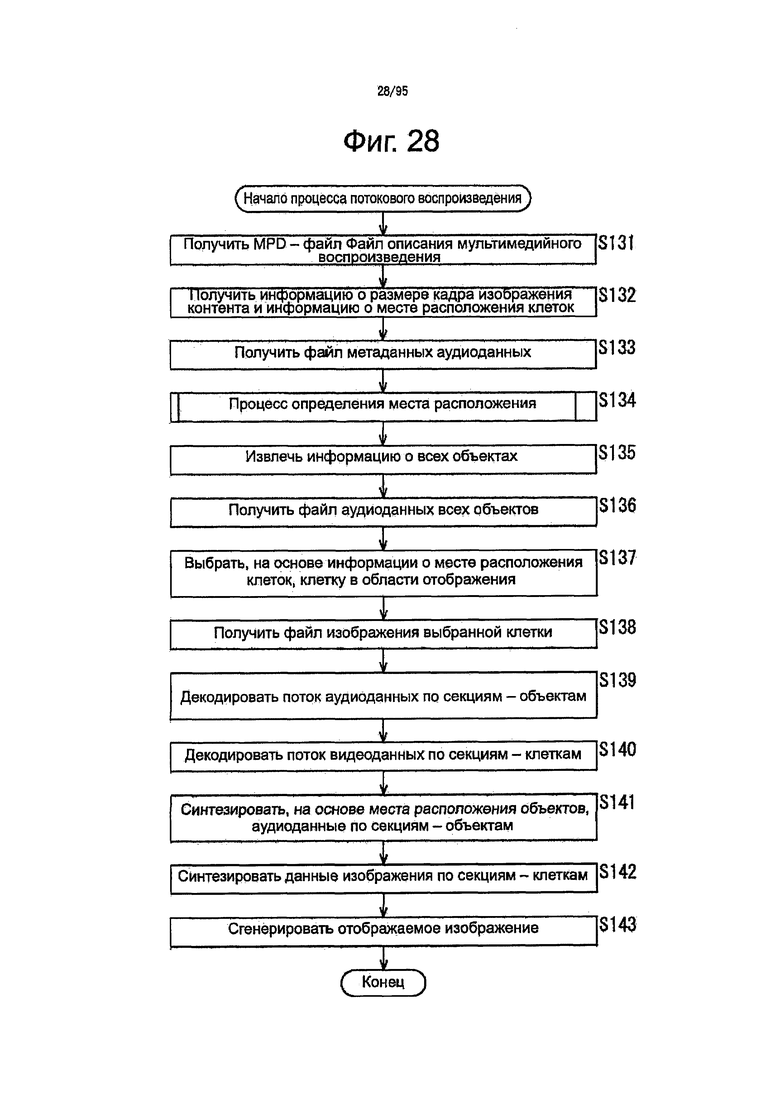

Фиг. 28 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс потокового воспроизведения в блоке потокового воспроизведения, показанном на фиг. 23.

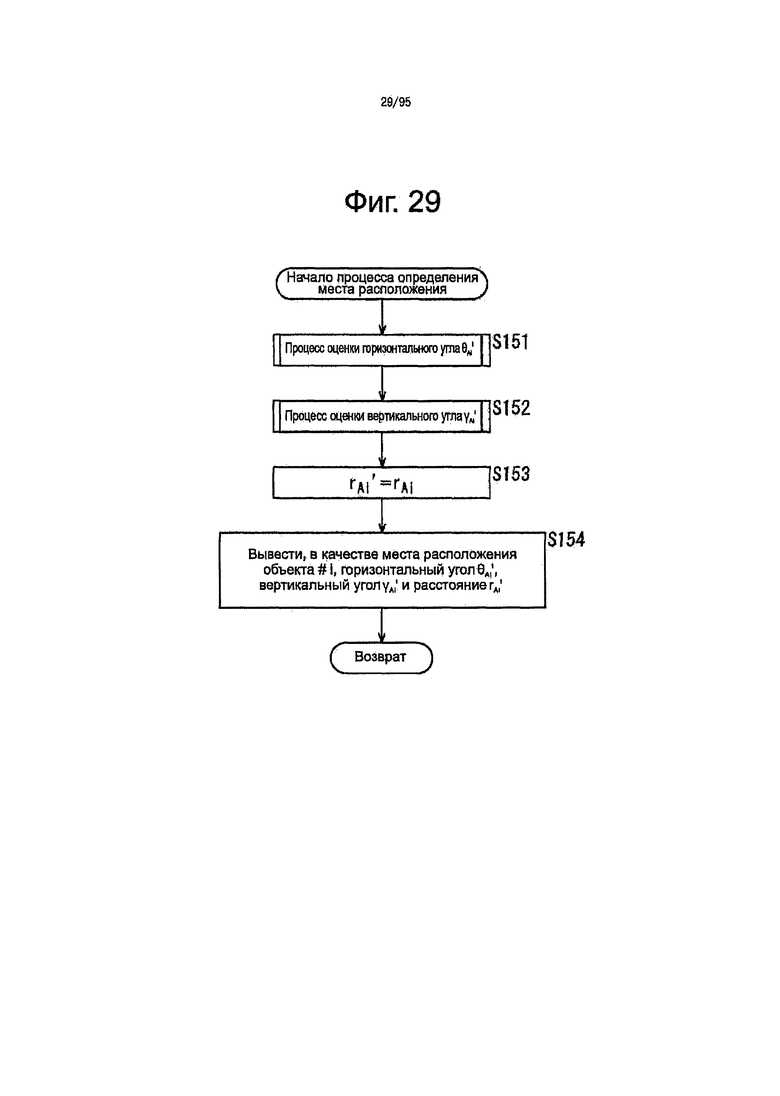

Фиг. 29 представляет собой блок-схему алгоритма, на которой проиллюстрированы подробности процесса определения места расположения, который показан на фиг. 28.

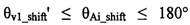

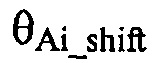

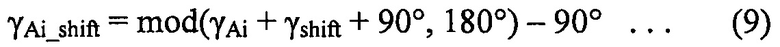

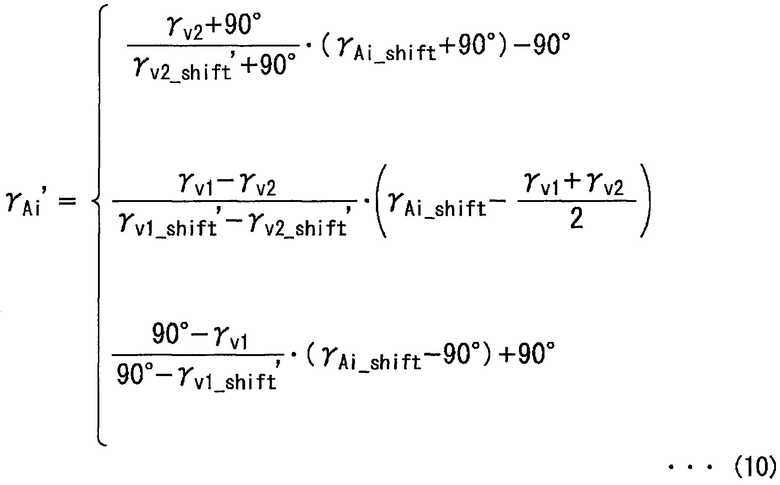

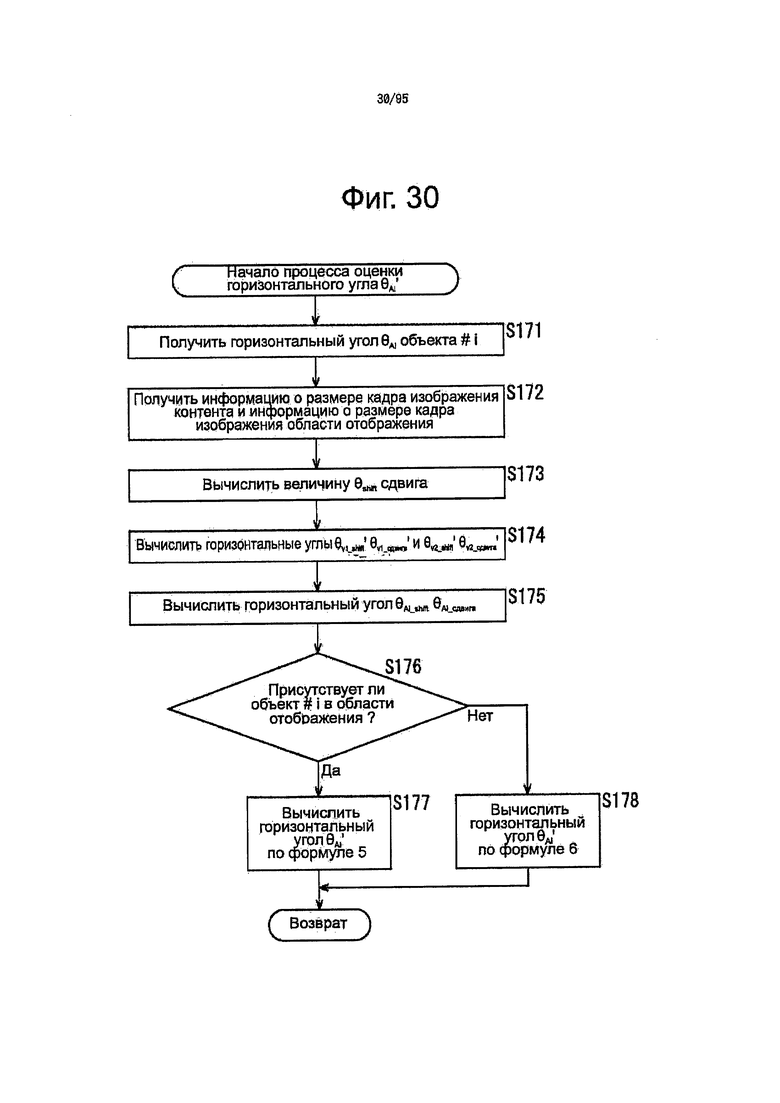

Фиг. 30 представляет собой блок-схему алгоритма, на которой проиллюстрированы подробности процесса оценки горизонтального угла  , который (процесс) показан на фиг. 29.

, который (процесс) показан на фиг. 29.

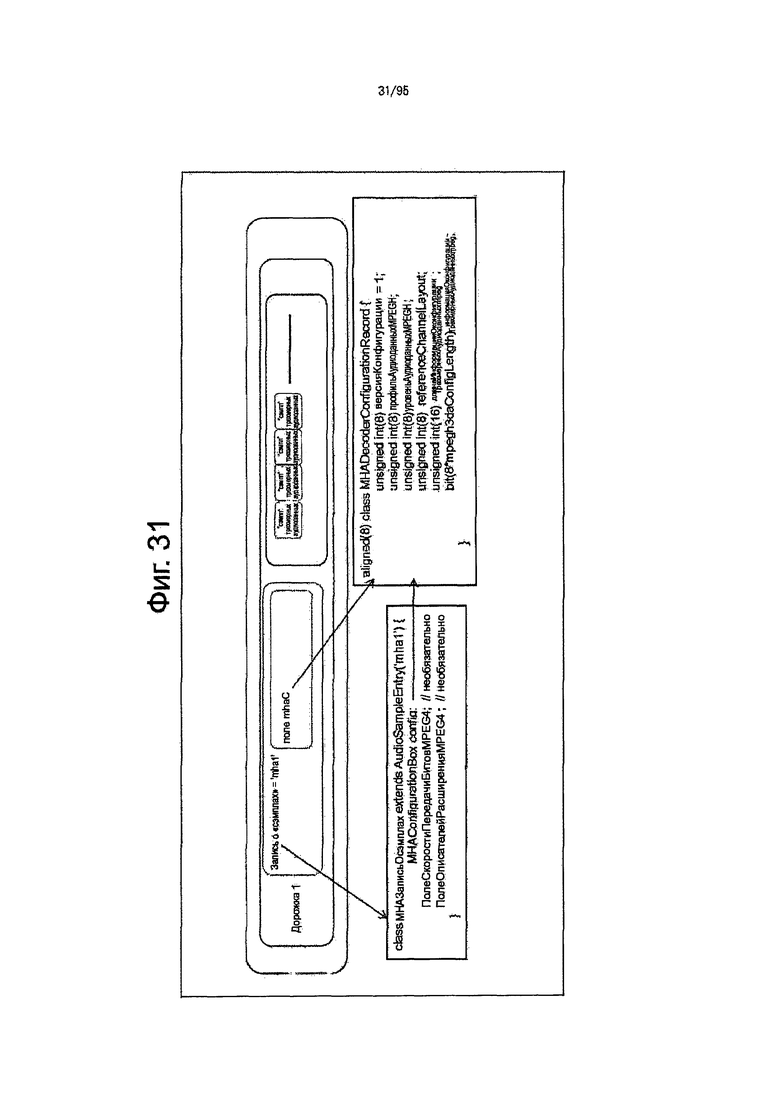

Фиг. 31 представляет собой схему, на которой проиллюстрирован план дорожек формата МР4 файла трехмерных аудиоданных.

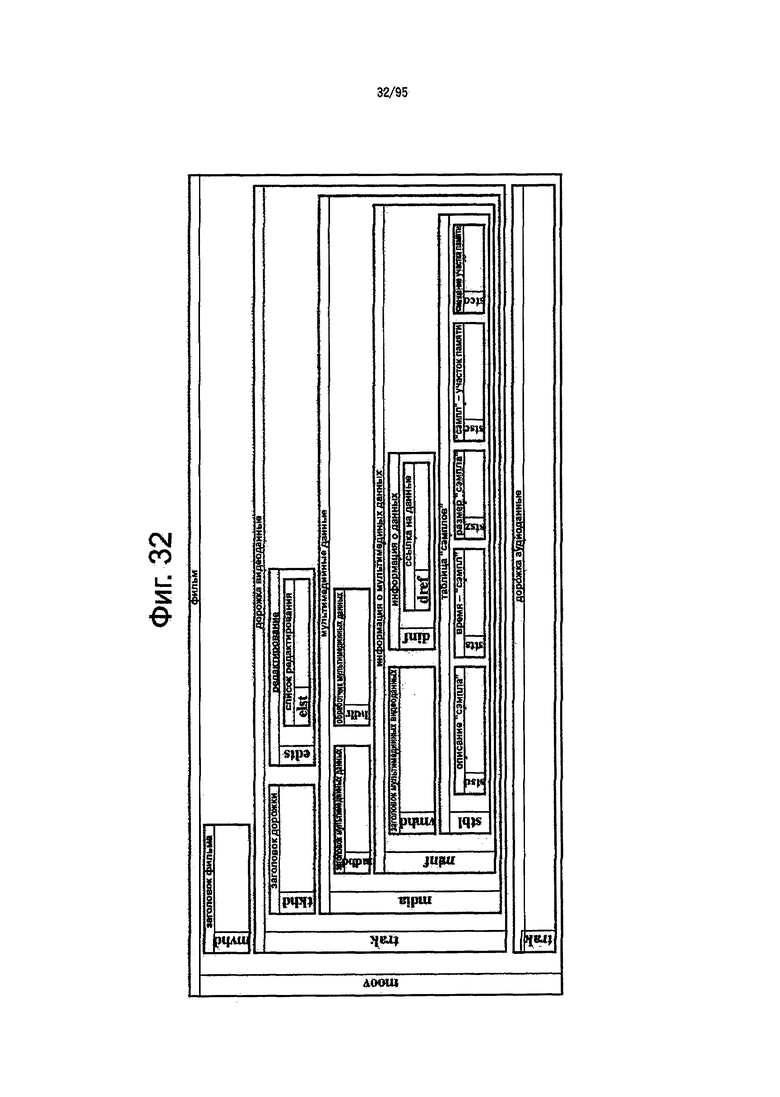

Фиг. 32 представляет собой схему, на которой показана структура поля moov.

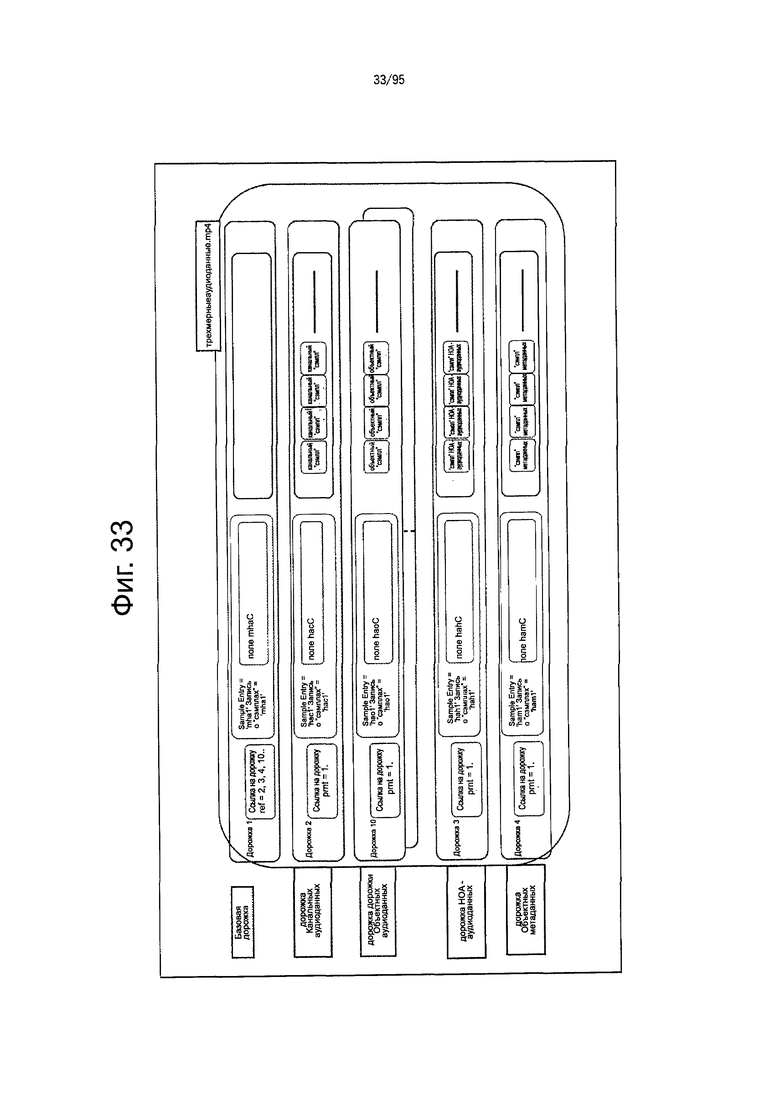

Фиг. 33 представляет собой схему, на которой проиллюстрирован план дорожек в соответствии с некоторым первым вариантом воплощения, в котором применено настоящее раскрываемое изобретение.

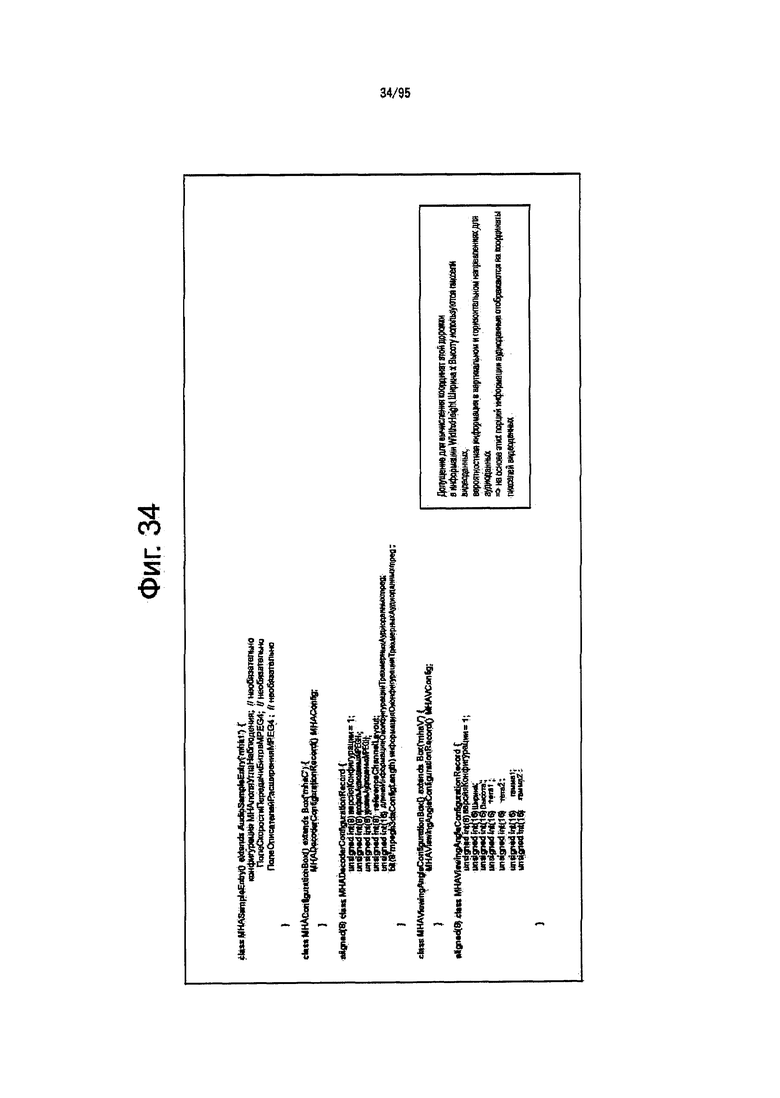

Фиг. 34 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" базовой дорожки.

Фиг. 35 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" дорожки канальных аудиоданных, показанной на фиг. 33.

Фиг. 36 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" дорожки объектных аудиоданных, показанной на фиг. 33.

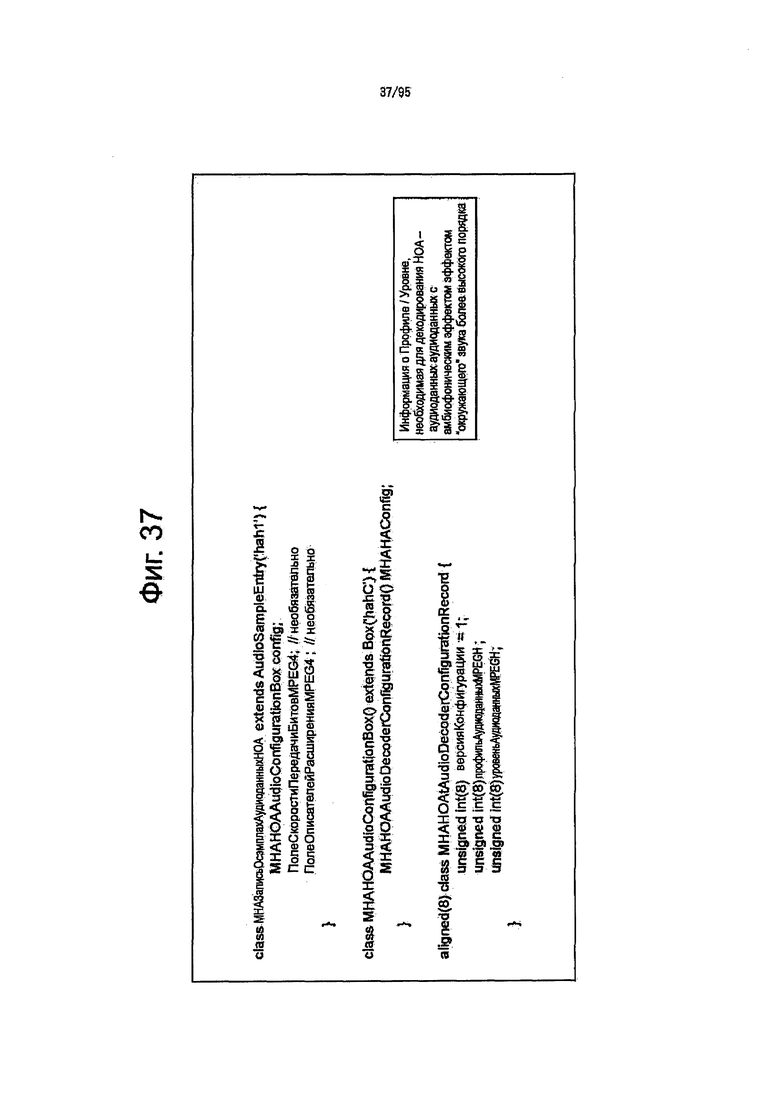

Фиг. 37 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" дорожки HOA-аудиоданных, показанной на фиг. 33.

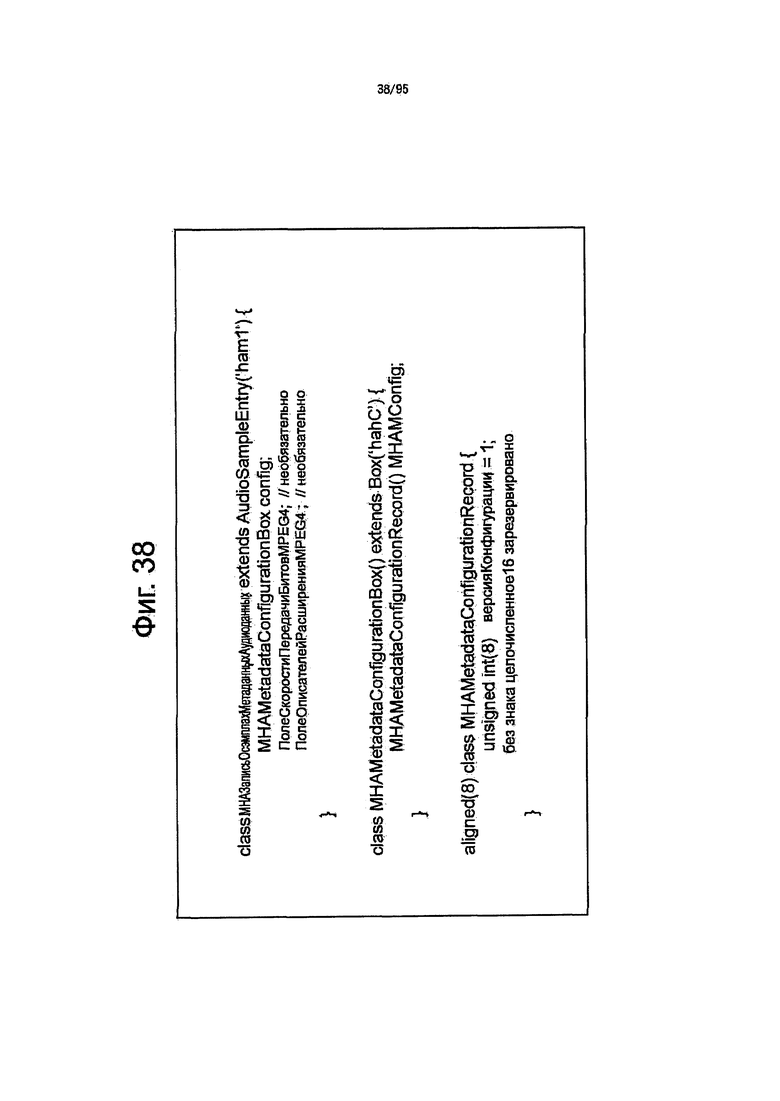

Фиг. 38 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" дорожки объектных метаданных, показанной на фиг. 33.

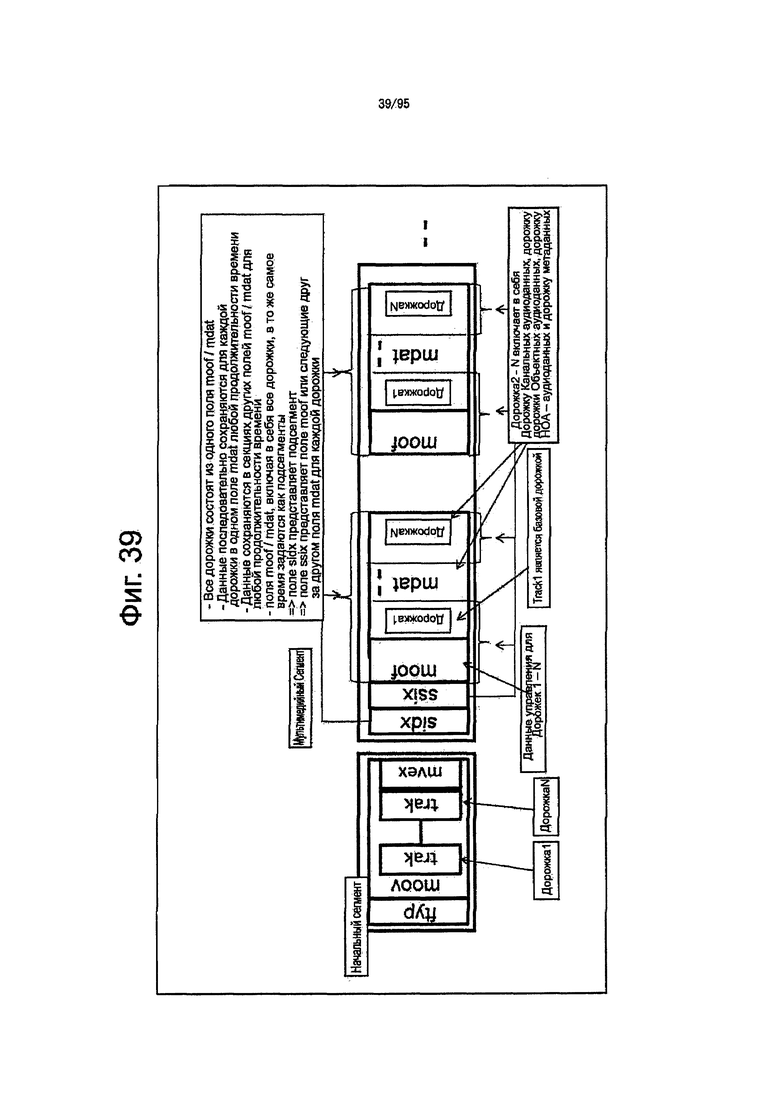

Фиг. 39 представляет собой схему, на которой показан некоторый первый пример структуры сегмента.

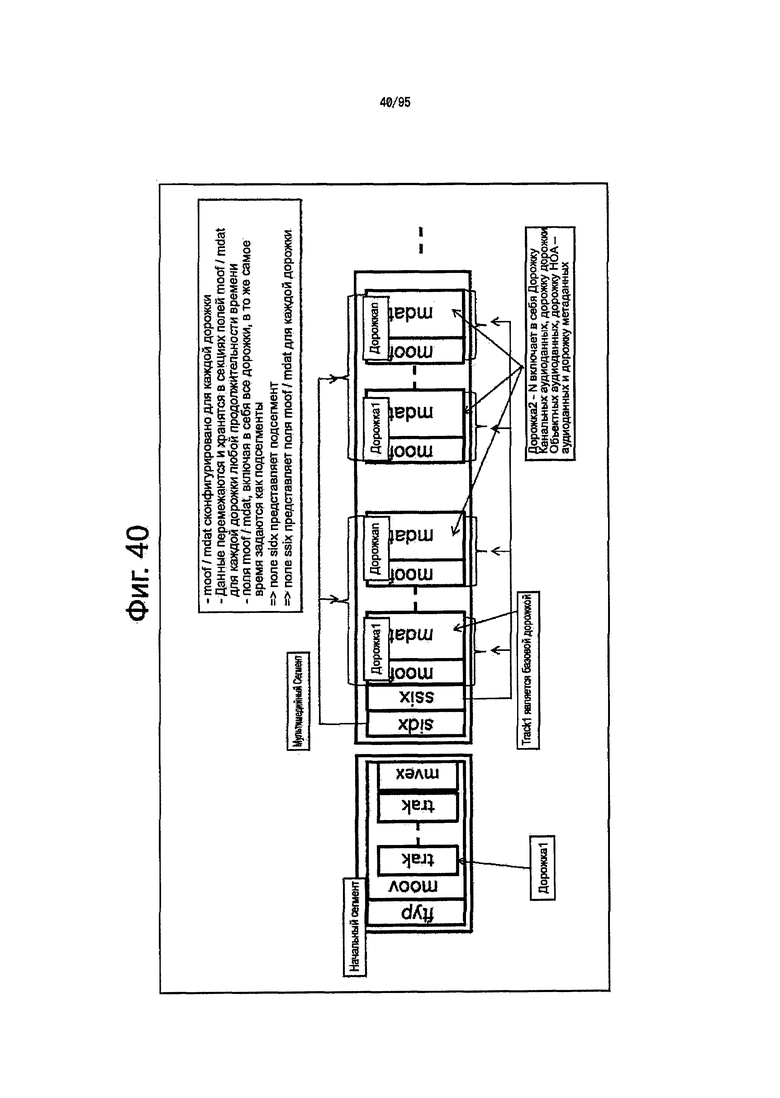

Фиг. 40 представляет собой схему, на которой показан некоторый второй пример структуры сегмента.

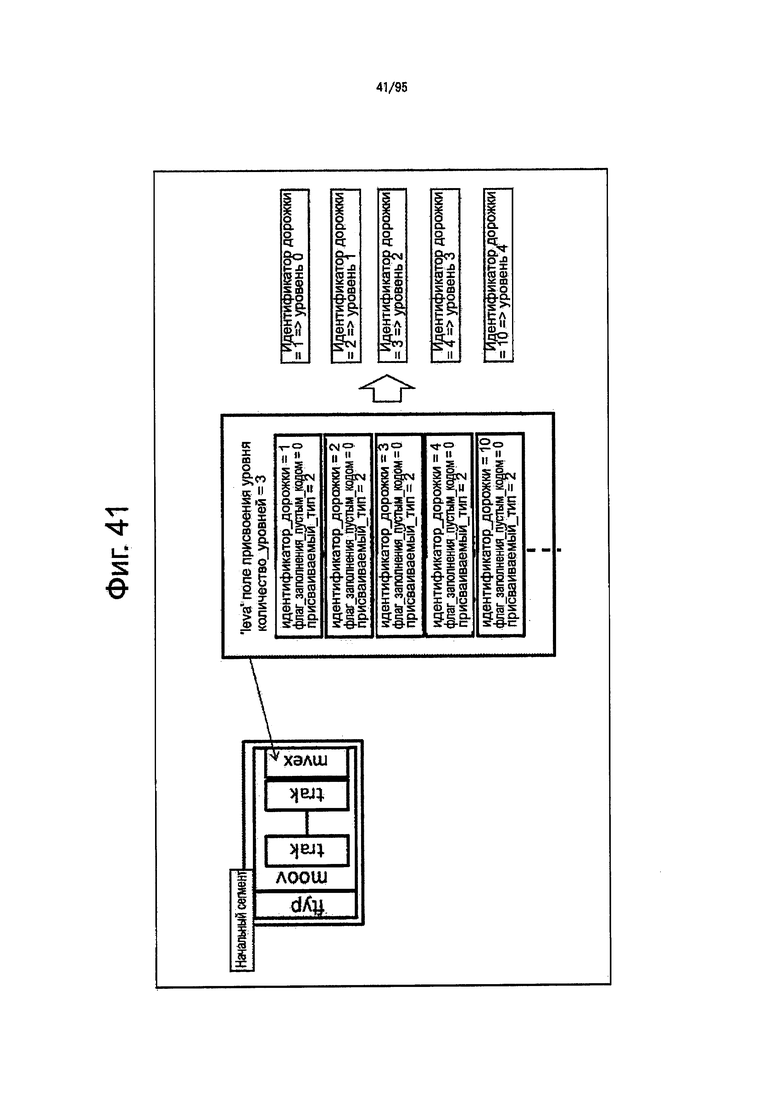

Фиг. 41 представляет собой схему, на которой показано приводимое в качестве примера описание поля присвоения уровня.

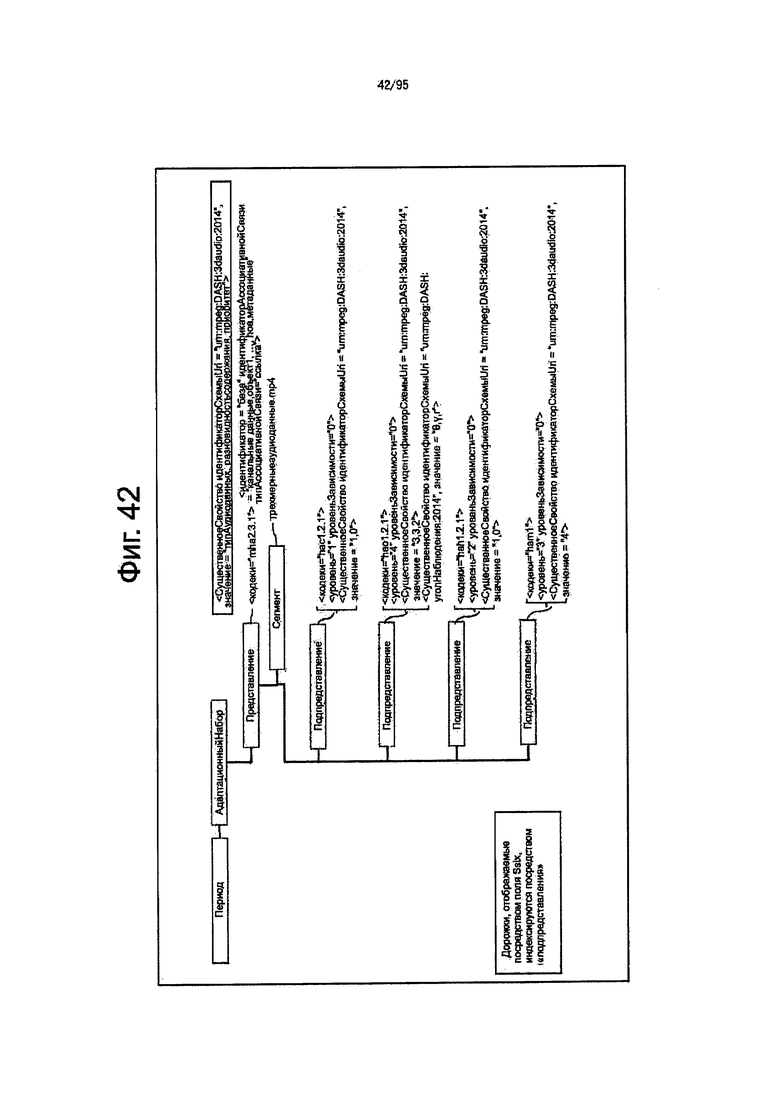

Фиг. 42 представляет собой схему, на которой показано приводимое в качестве примера описание MPD-файла в первом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

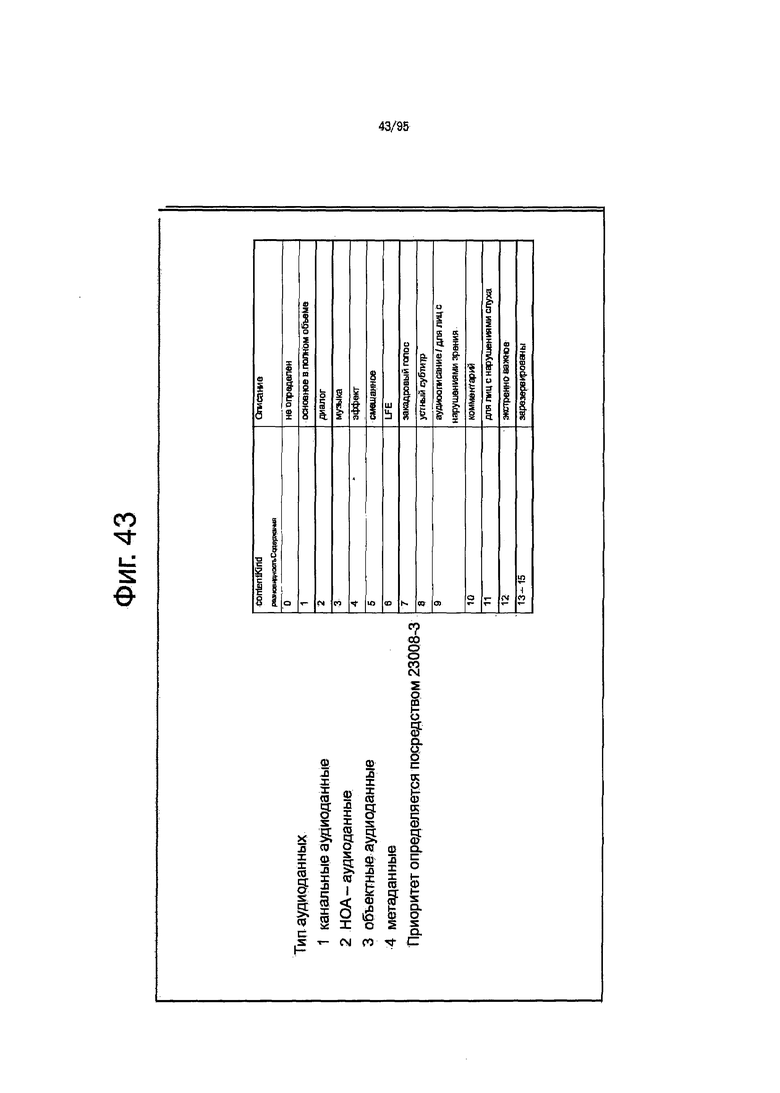

Фиг. 43 представляет собой схему, на которой показано определение Существенного Свойства.

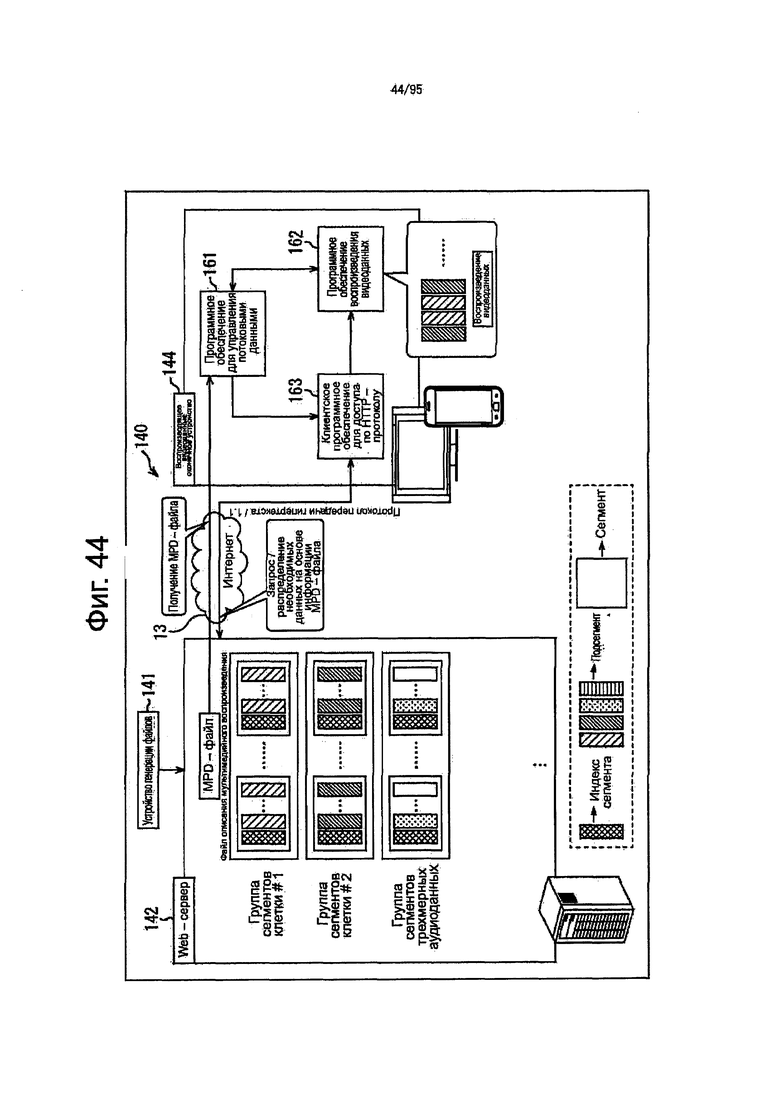

Фиг. 44 представляет собой схему, на которой проиллюстрирован план системы обработки информации в первом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

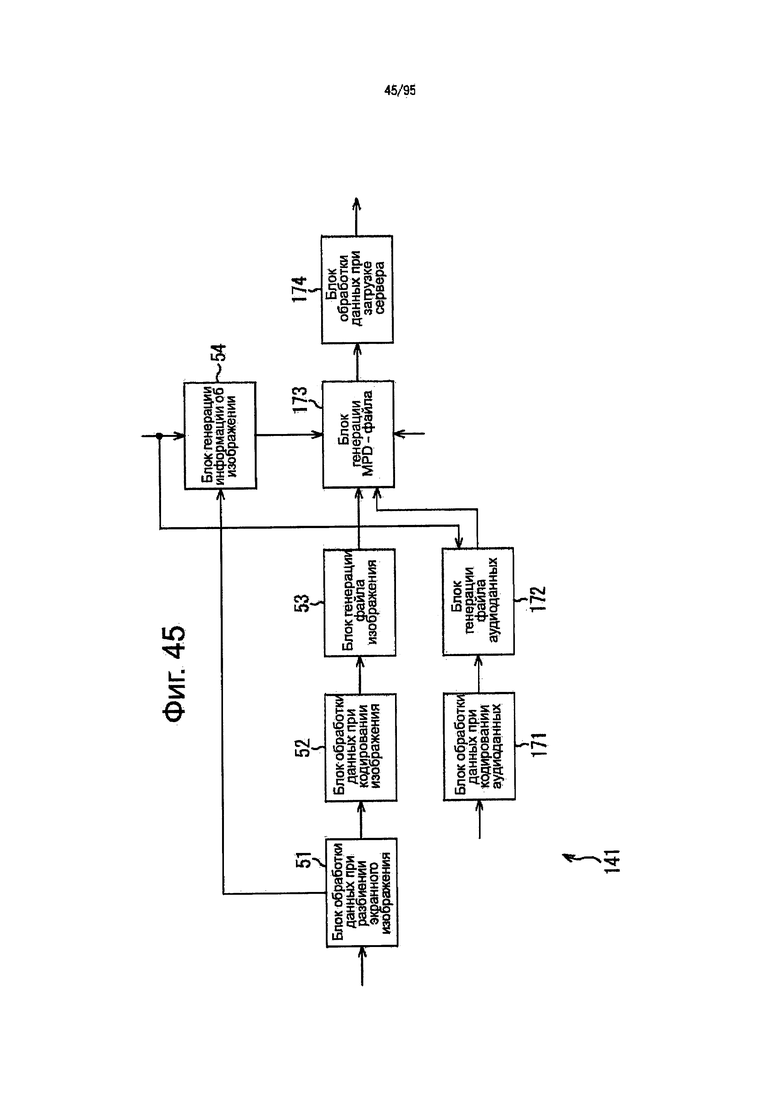

Фиг. 45 представляет собой структурную схему, на которой показан пример конфигурации устройства генерации файлов, показанного на фиг. 44.

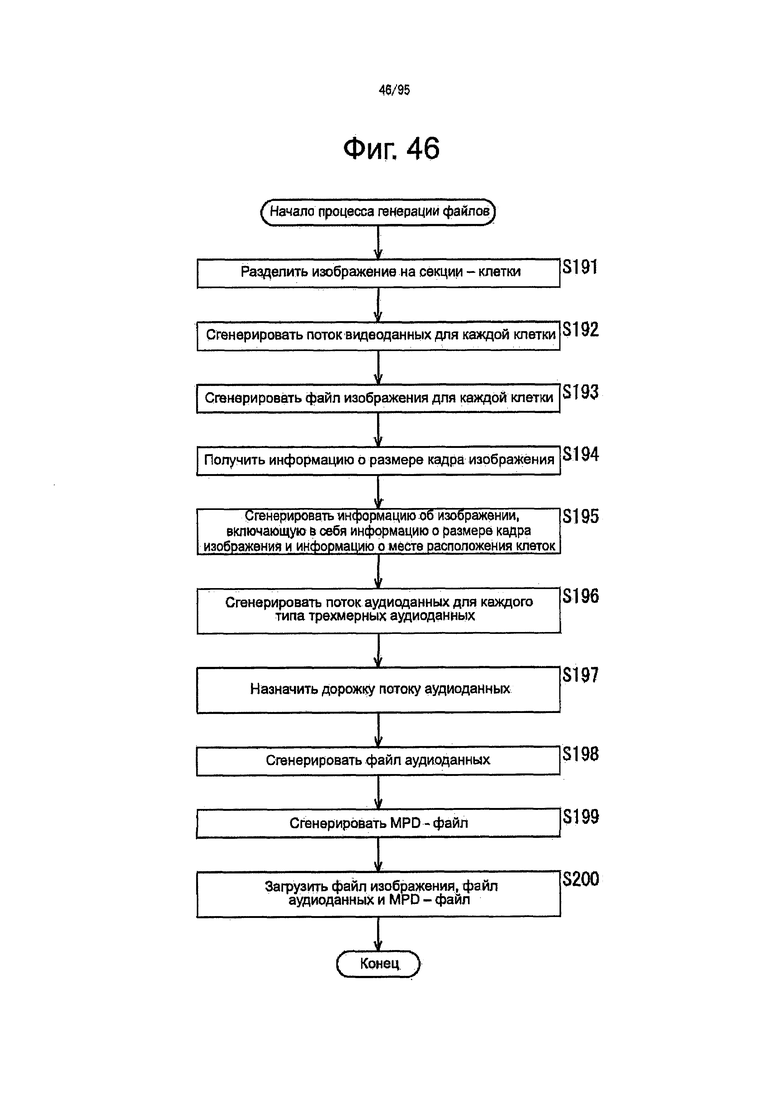

Фиг. 46 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс генерации файлов в устройстве генерации файлов, показанном на фиг. 45.

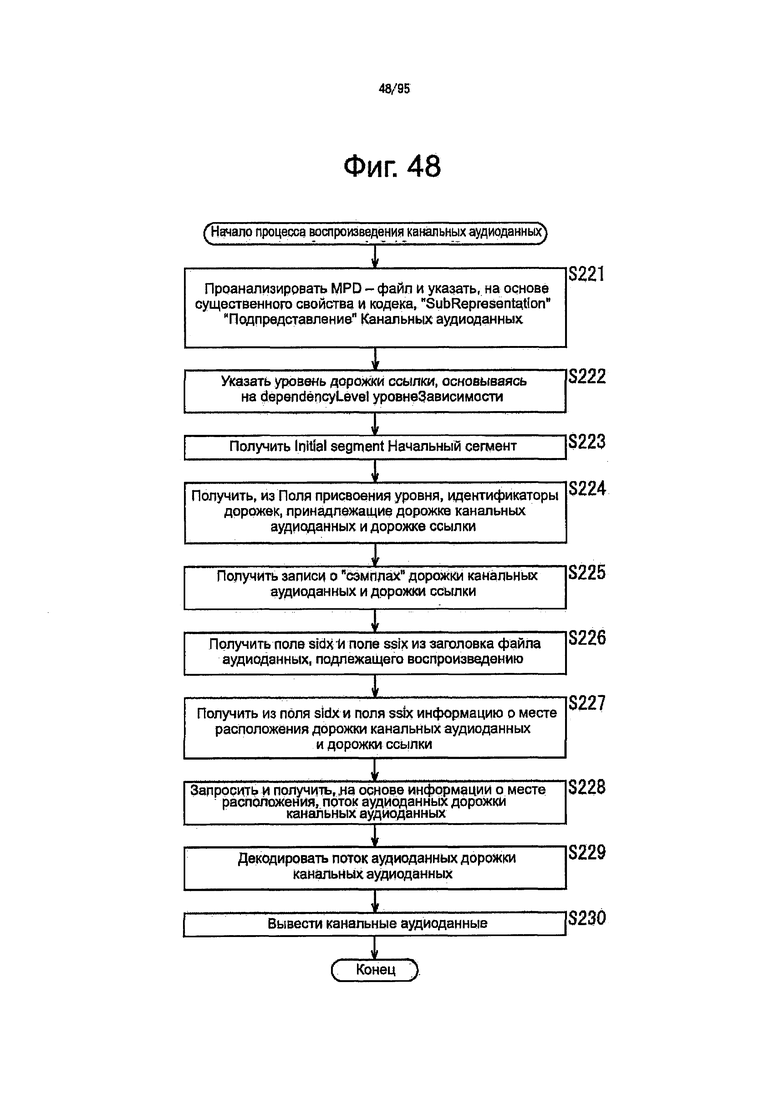

Фиг. 47 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения, реализованного в воспроизводящем видеоданные оконечном устройстве, показанном на фиг. 44.

Фиг. 48 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс воспроизведения канальных аудиоданных, выполняемый в блоке потокового воспроизведения, показанном на фиг. 47.

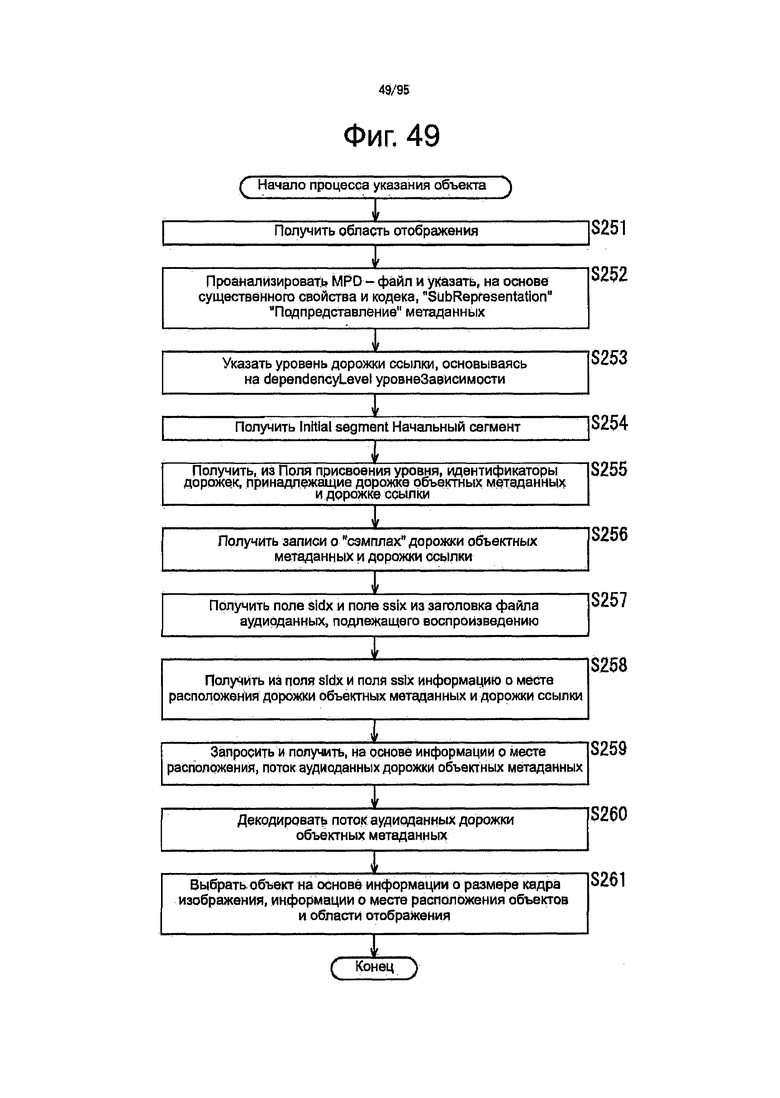

Фиг. 49 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс указания объекта, выполняемый в блоке потокового воспроизведения, показанном на фиг. 47.

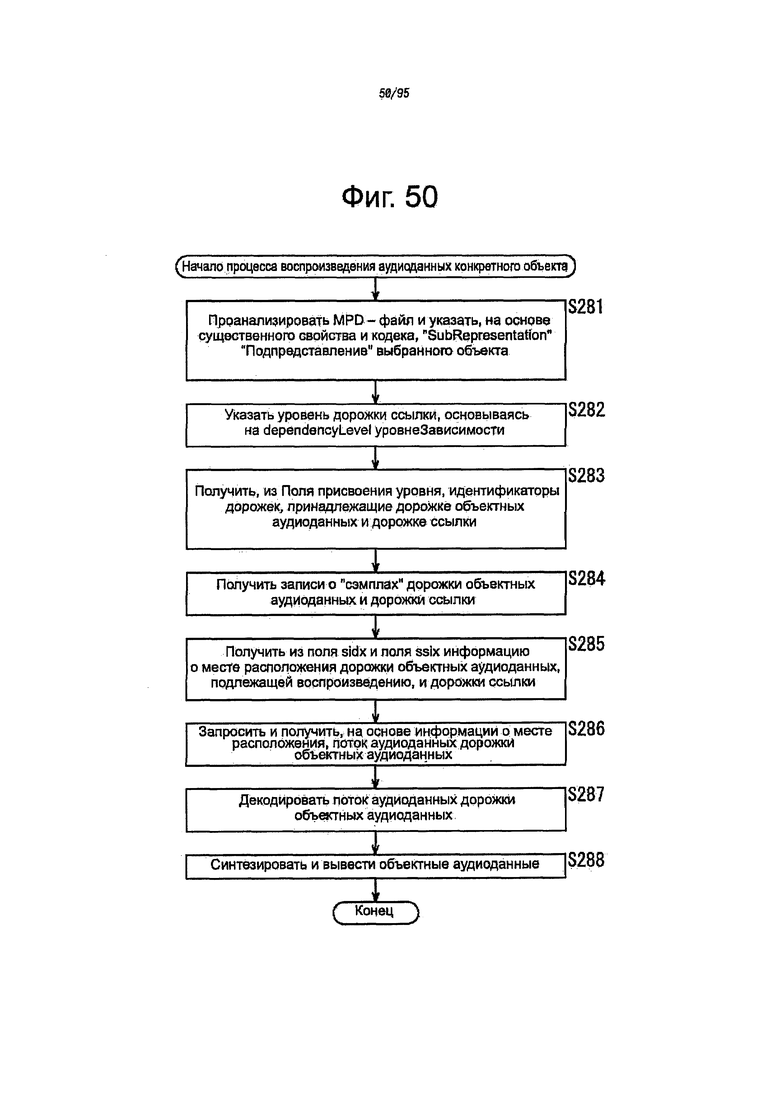

Фиг. 50 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс воспроизведения аудиоданных конкретного объекта, выполняемый в блоке потокового воспроизведения, показанном на фиг. 47.

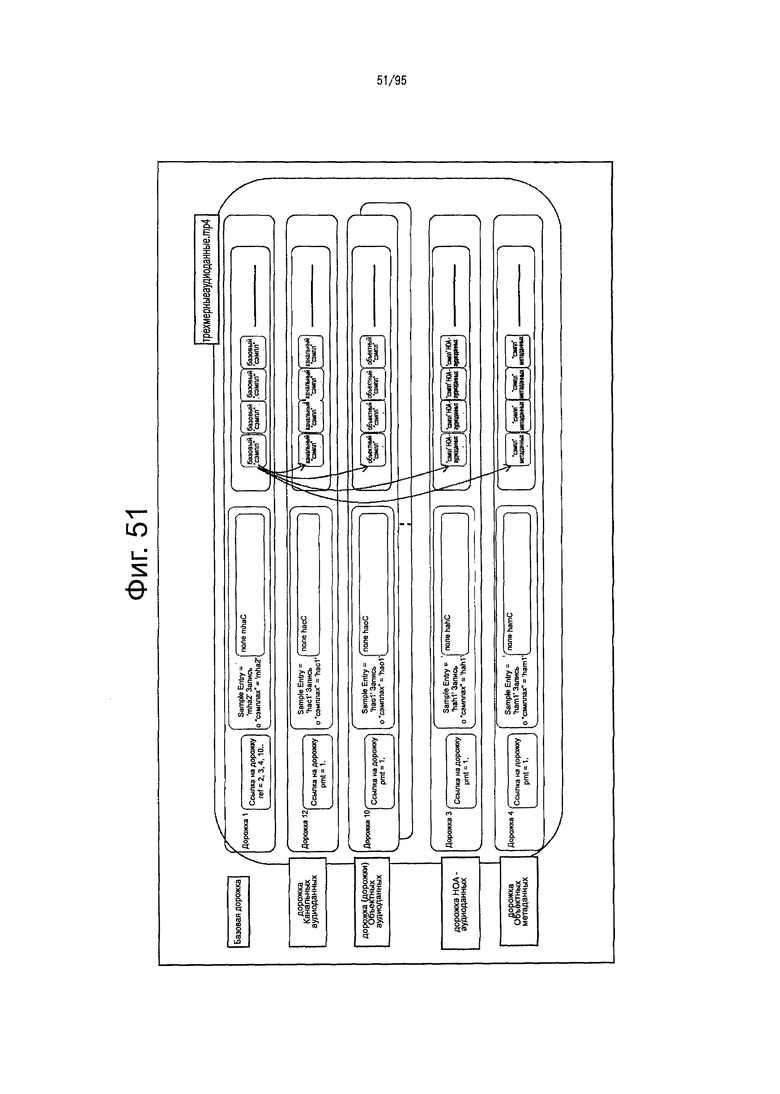

Фиг. 51 представляет собой схему, на которой проиллюстрирован план дорожек в некотором втором варианте воплощения, в котором применено настоящее раскрываемое изобретение.

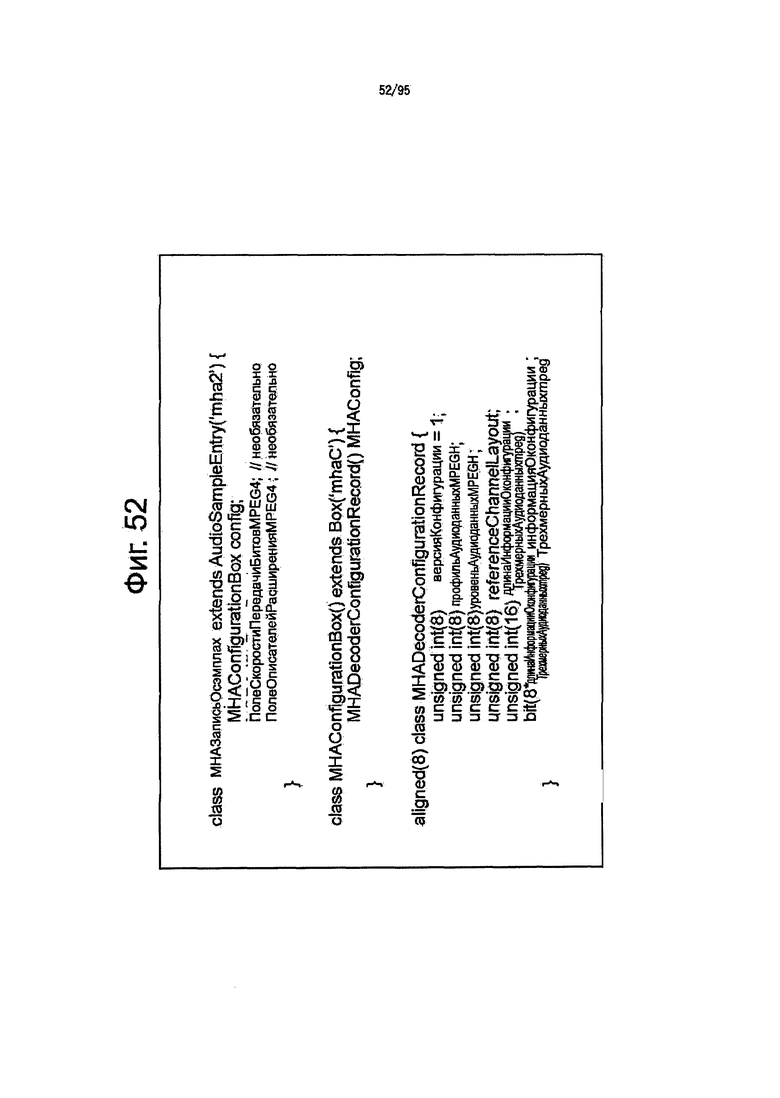

Фиг. 52 представляет собой схему, на которой показан приводимый в качестве примера синтаксис записи о "сэмплах" базовой дорожки, показанной на фиг. 51.

Фиг. 53 представляет собой схему, на которой показана структура базового "сэмпла".

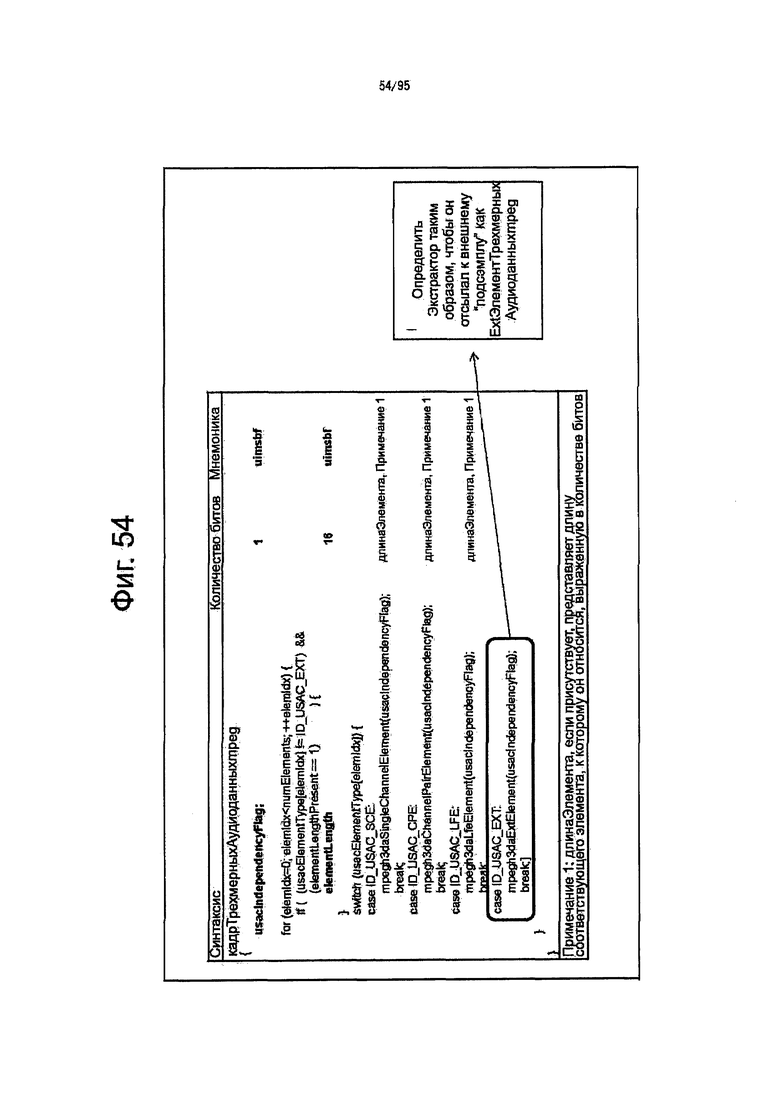

Фиг. 54 представляет собой схему, на которой показан приводимый в качестве примера синтаксис базового "сэмпла".

Фиг. 55 представляет собой схему, на которой показан пример данных экстрактора.

Фиг. 56 представляет собой схему, на которой проиллюстрирован план дорожек в некотором третьем варианте воплощения, в котором применено настоящее раскрываемое изобретение.

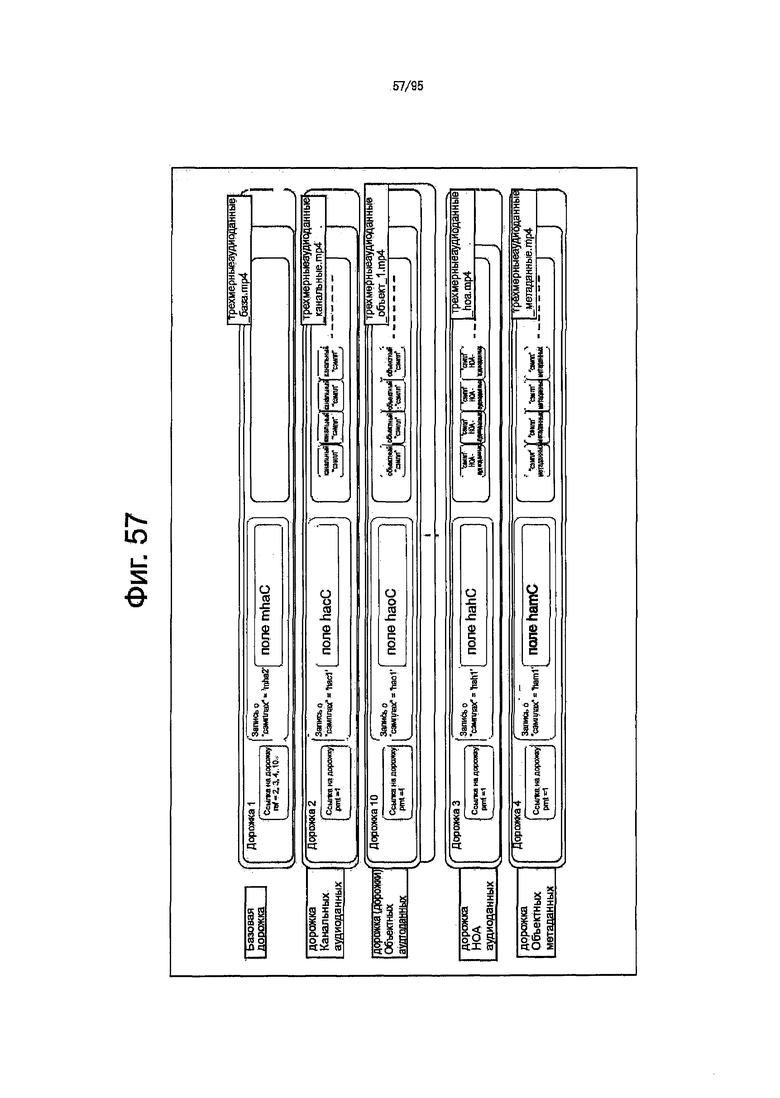

Фиг. 57 представляет собой схему, на которой проиллюстрирован план дорожек в четвертом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

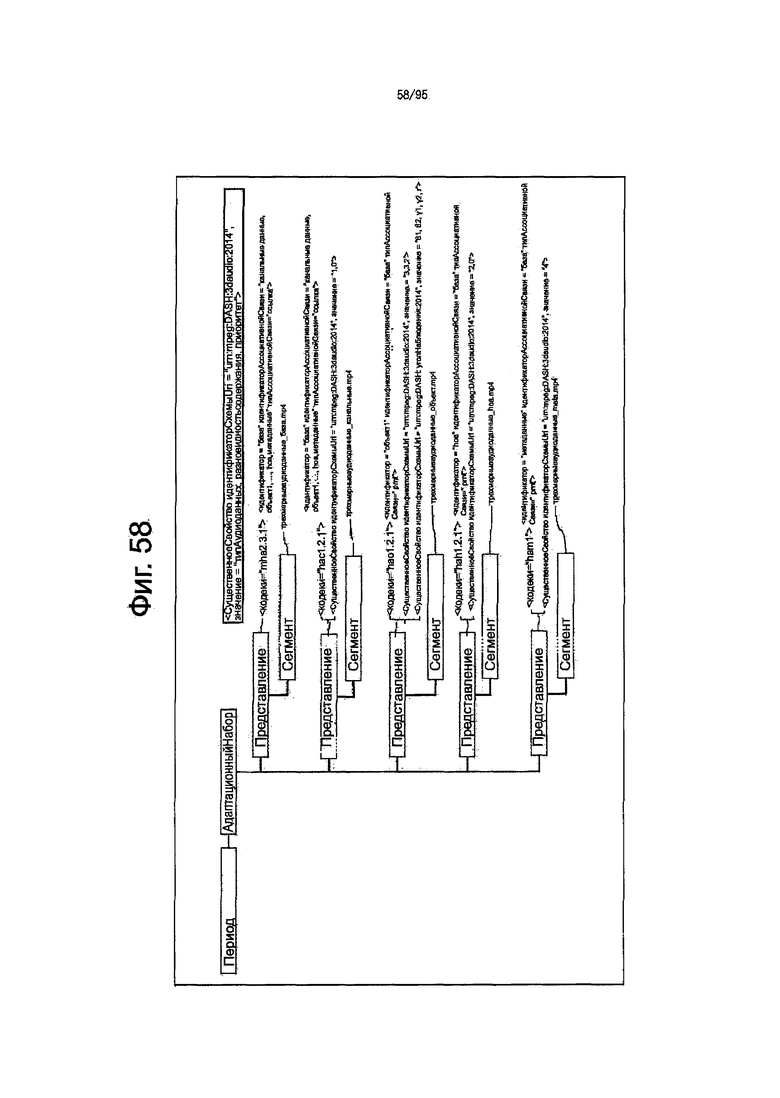

Фиг. 58 представляет собой схему, на которой показано приводимое в качестве примера описание MPD-файла в четвертом варианте воплощения, в которому применено настоящее раскрываемое изобретение.

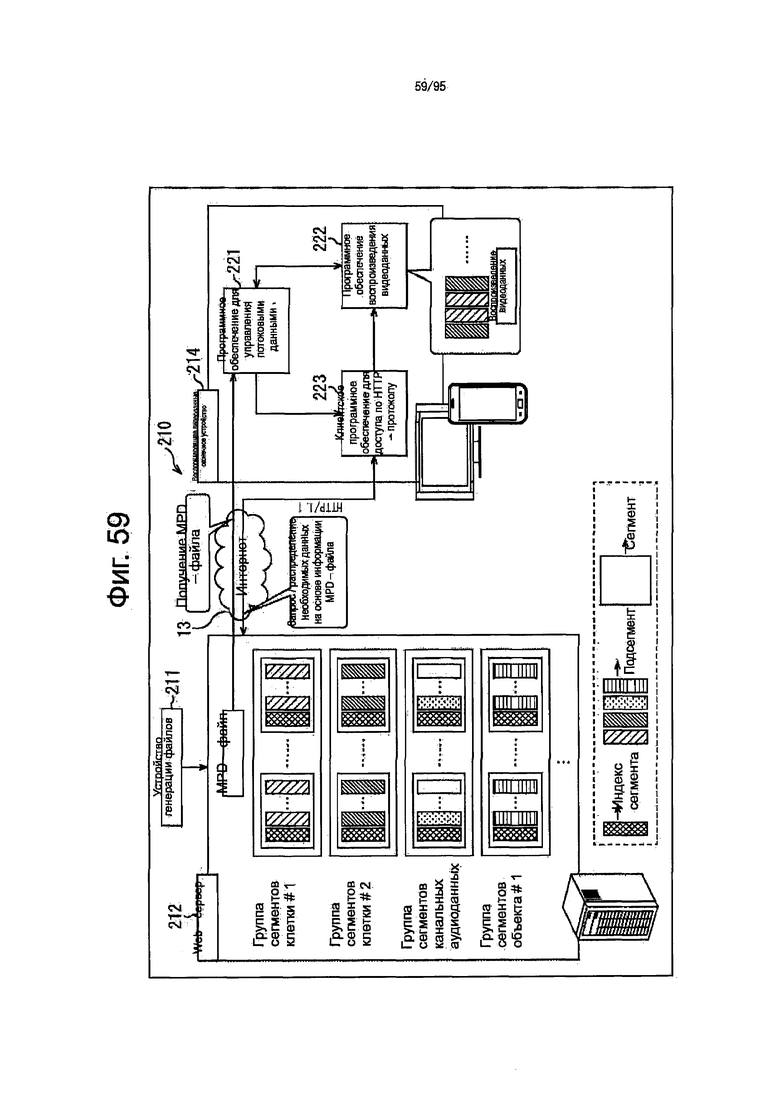

Фиг. 59 представляет собой схему, на которой проиллюстрирован план системы обработки информации в четвертом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

Фиг. 60 представляет собой структурную схему, на которой показан пример конфигурации устройства генерации файлов, показанного на фиг. 59.

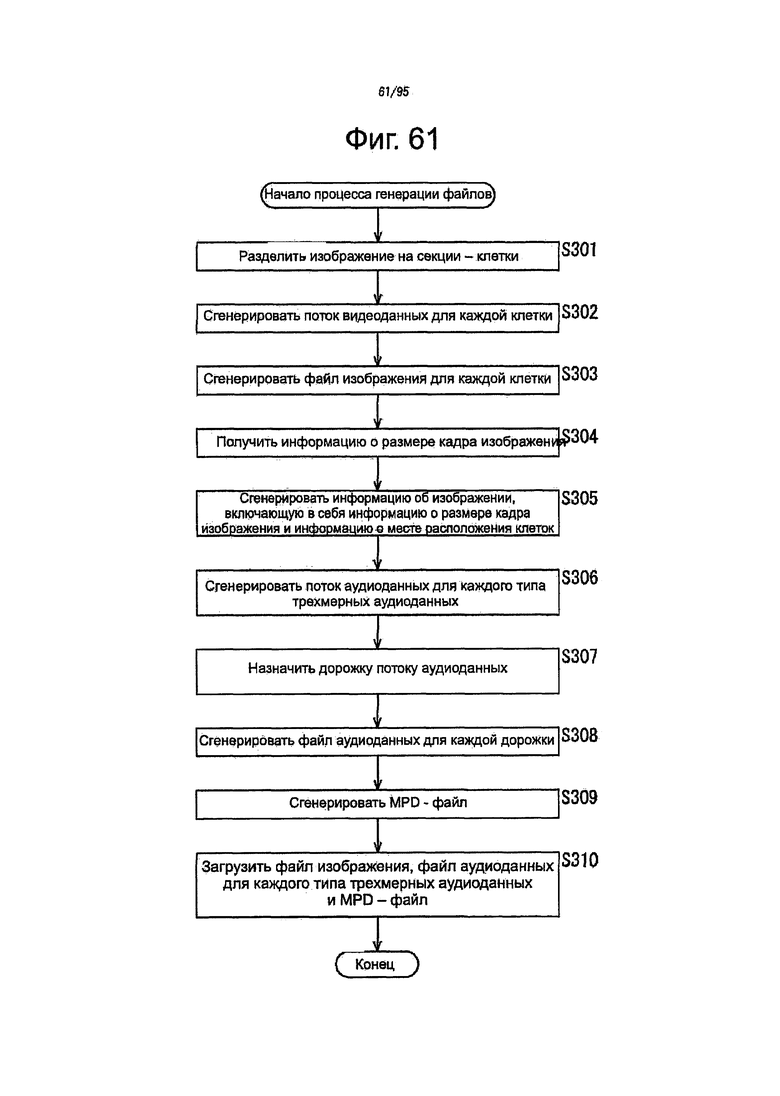

Фиг. 61 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс генерации файлов в устройстве генерации файлов, показанном на фиг. 60.

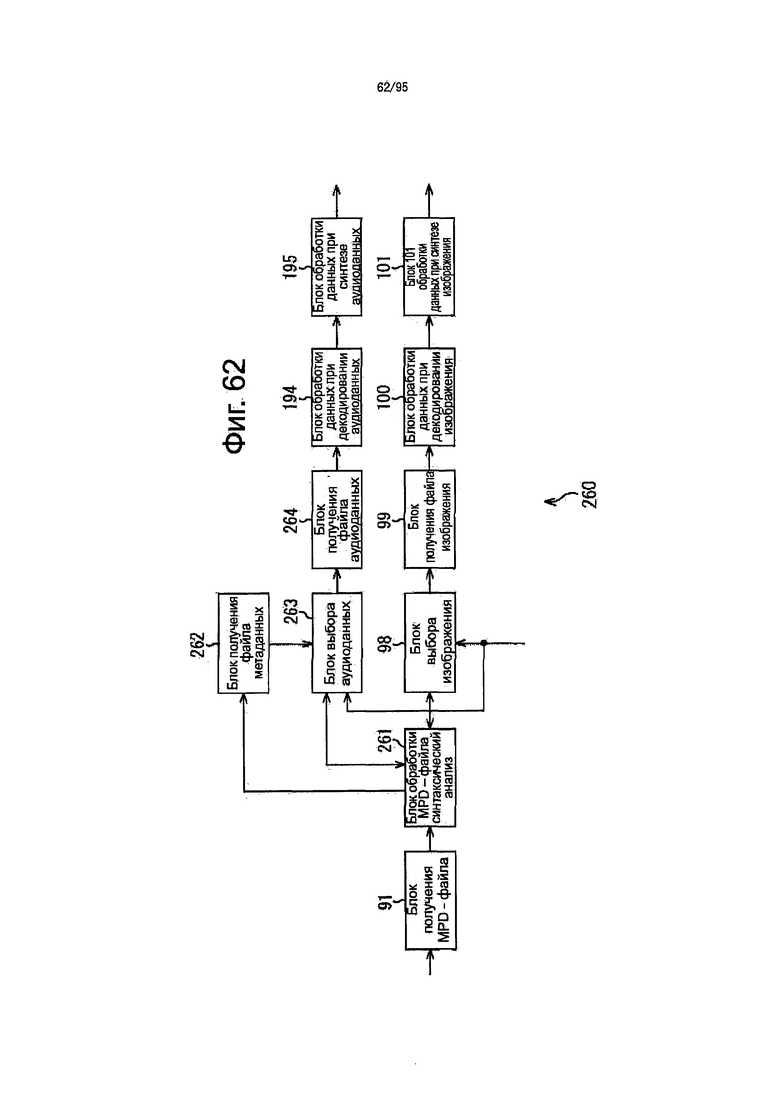

Фиг. 62 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения, реализованного в воспроизводящем видеоданные оконечном устройстве, показанном на фиг. 59.

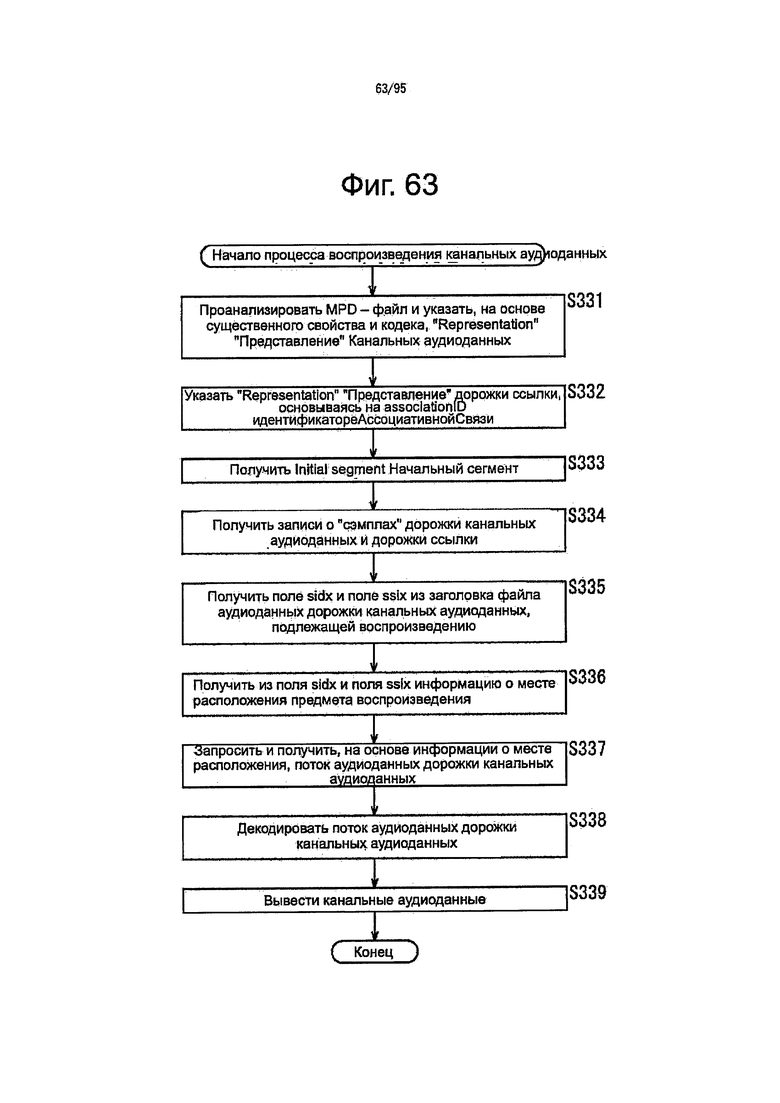

Фиг. 63 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример процесса воспроизведения канальных аудиоданных, выполняемый в блоке потокового воспроизведения, показанном на фиг. 62.

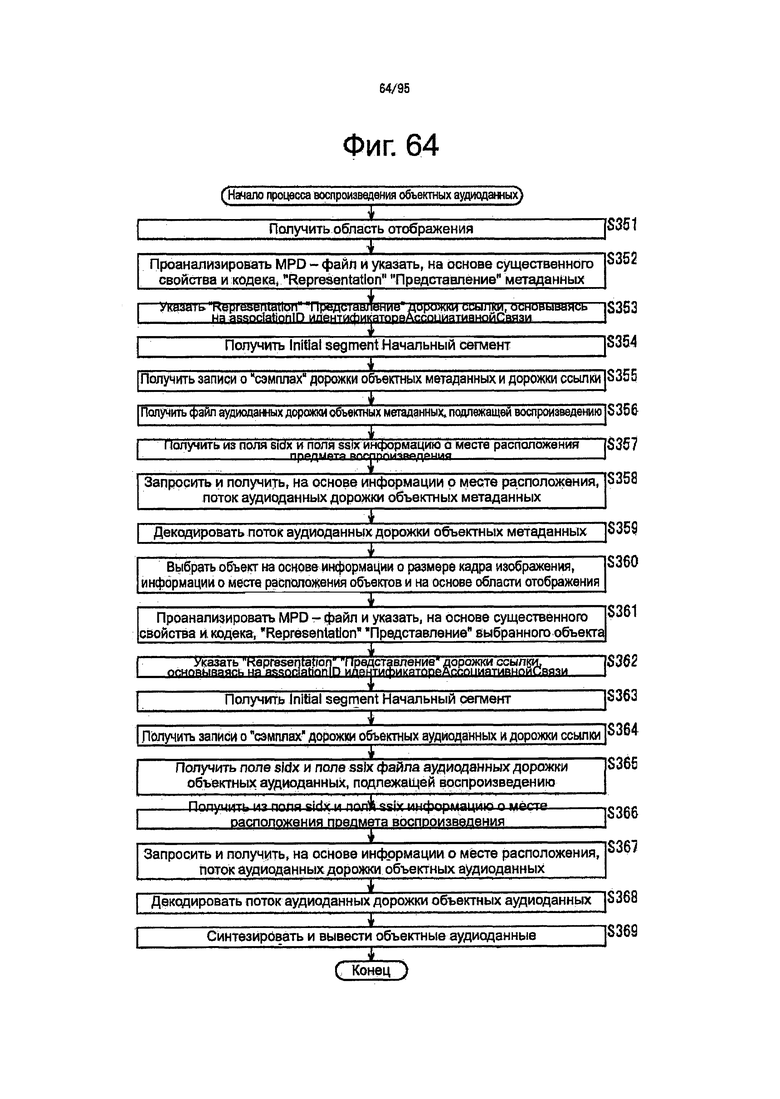

Фиг. 64 представляет собой блок-схему алгоритма, на которой проиллюстрирован некоторый первый пример процесса воспроизведения объектных аудиоданных, выполняемый в блоке потокового воспроизведения, показанном на фиг. 62.

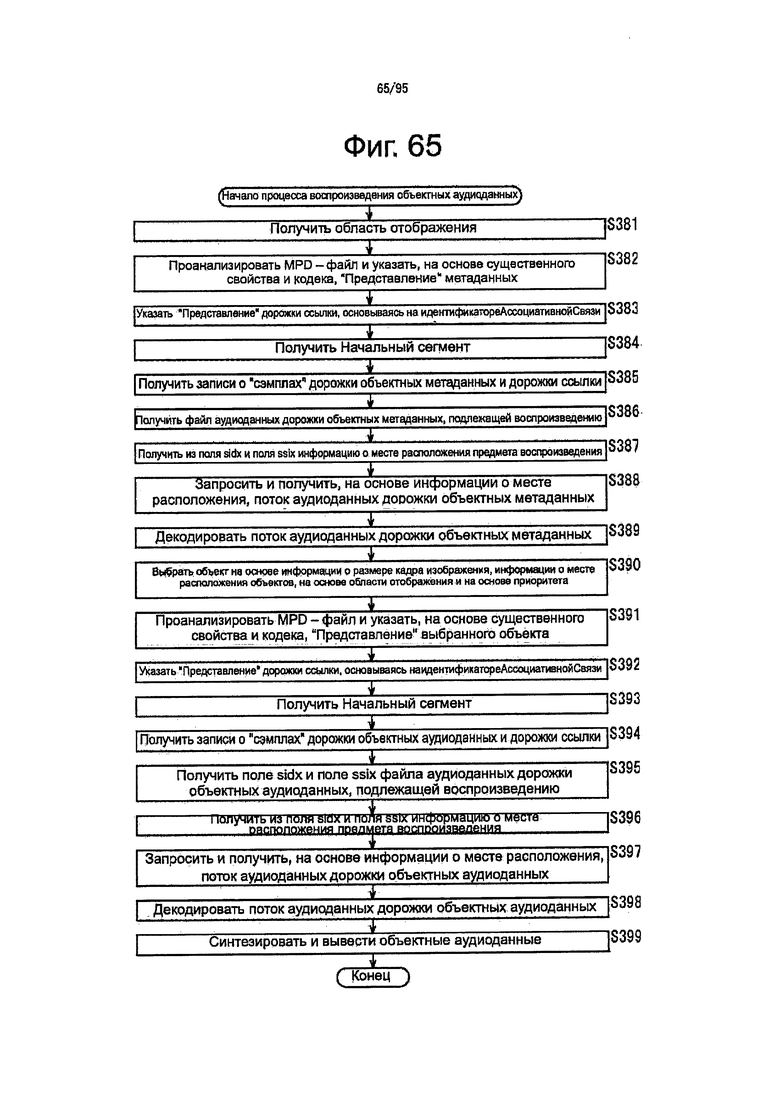

Фиг. 65 представляет собой блок-схему алгоритма, на которой проиллюстрирован некоторый второй пример процесса воспроизведения объектных аудиоданных, выполняемый в блоке потокового воспроизведения, показанном на фиг. 62.

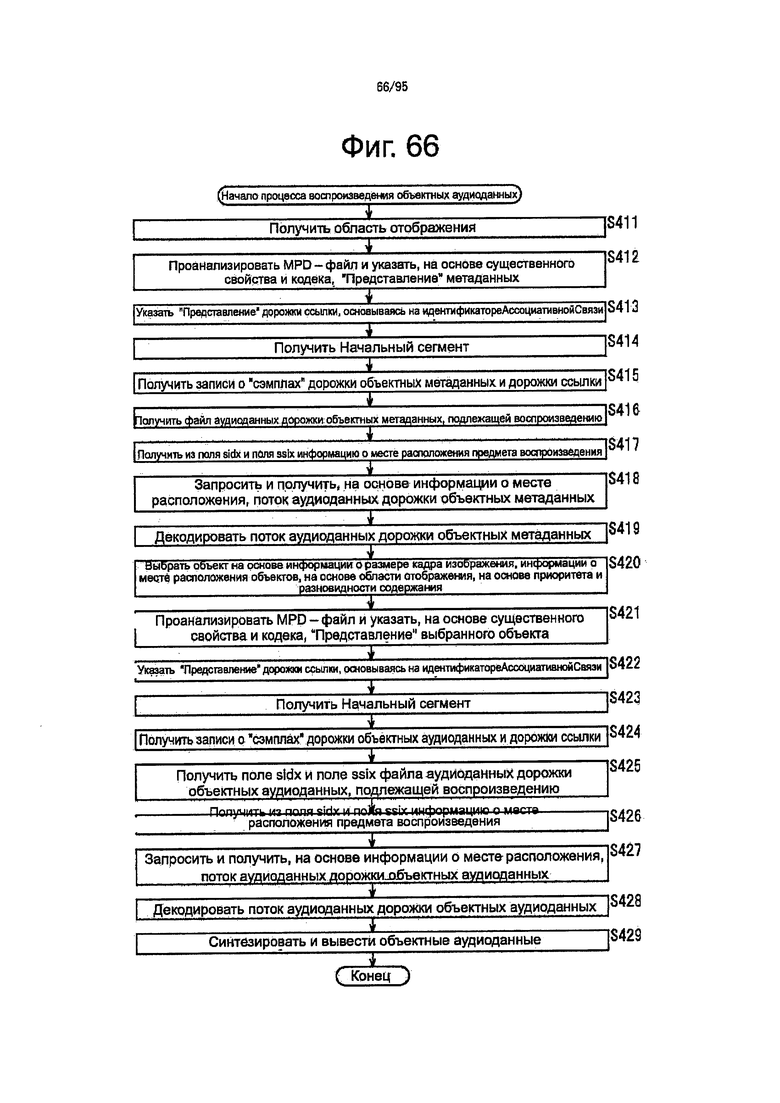

Фиг. 66 представляет собой блок-схему алгоритма, на которой проиллюстрирован некоторый третий пример процесса воспроизведения объектных аудиоданных, выполняемый в блоке потокового воспроизведения, показанном на фиг. 62.

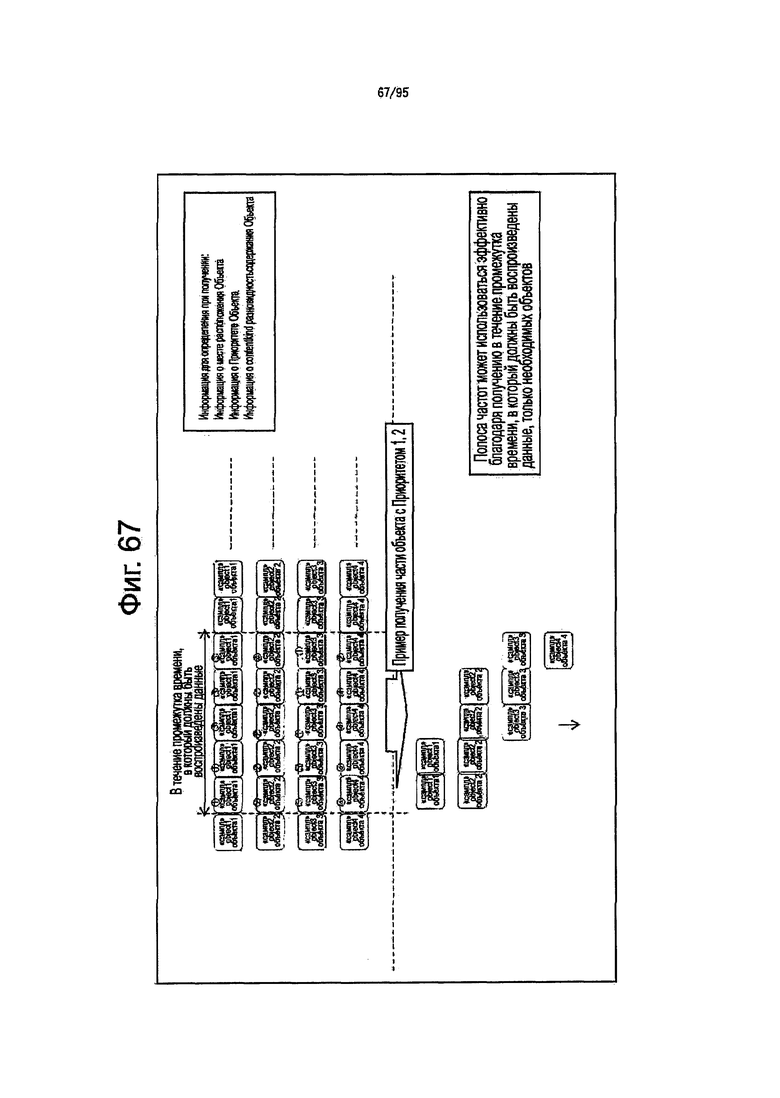

Фиг. 67 представляет собой схему, на которой показан пример объекта, выбираемого на основе приоритета.

Фиг. 68 представляет собой схему, на которой проиллюстрирован план дорожек в некотором пятом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

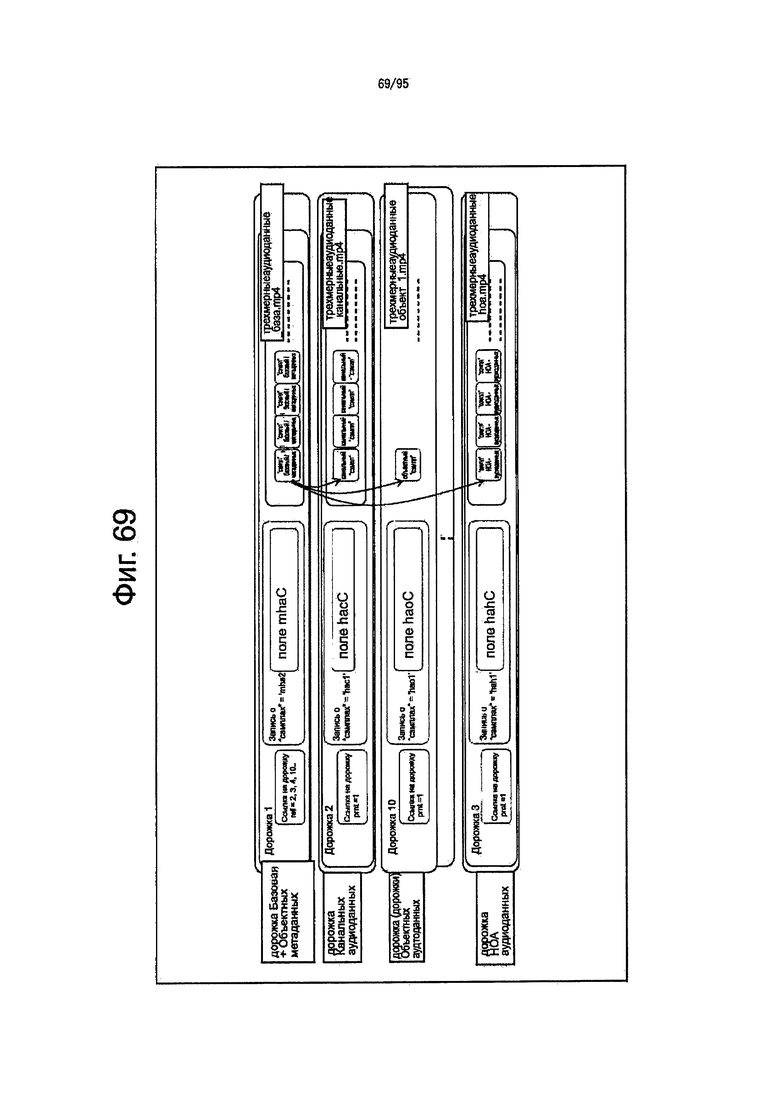

Фиг. 69 представляет собой схему, на которой проиллюстрирован план дорожек в некотором шестом варианте воплощения, в котором применено настоящее раскрываемое изобретение.

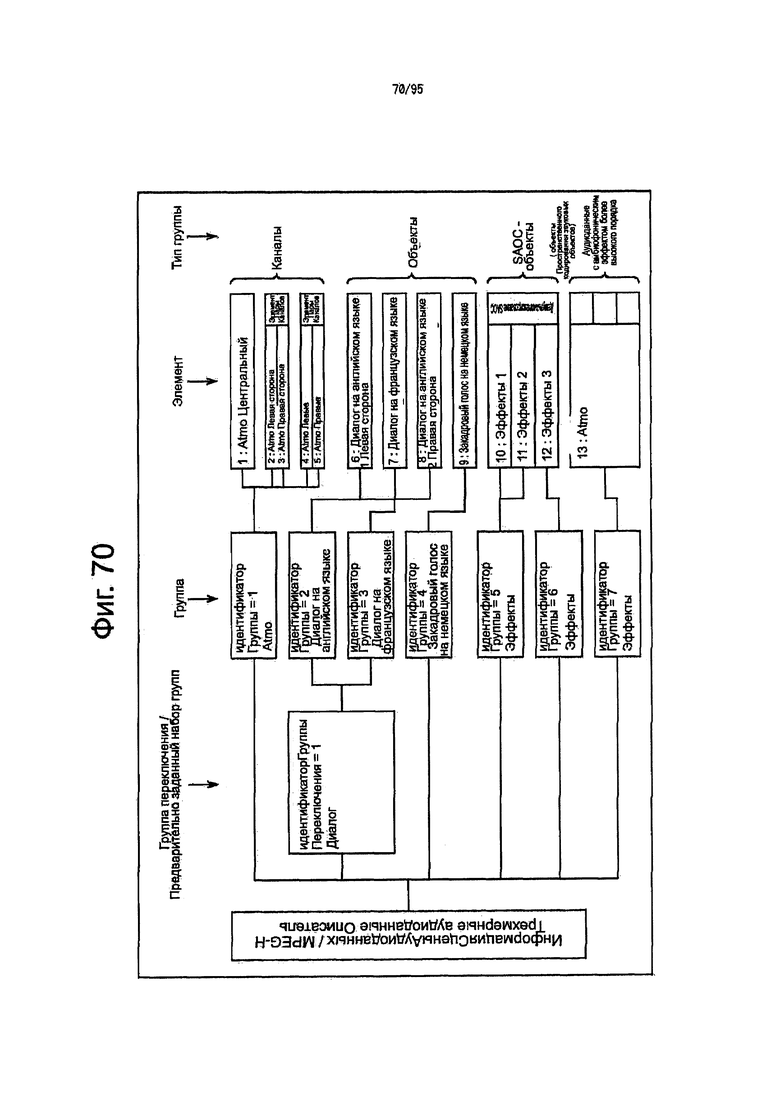

Фиг. 70 представляет собой схему, на которой показана иерархическая структура трехмерных аудиоданных.

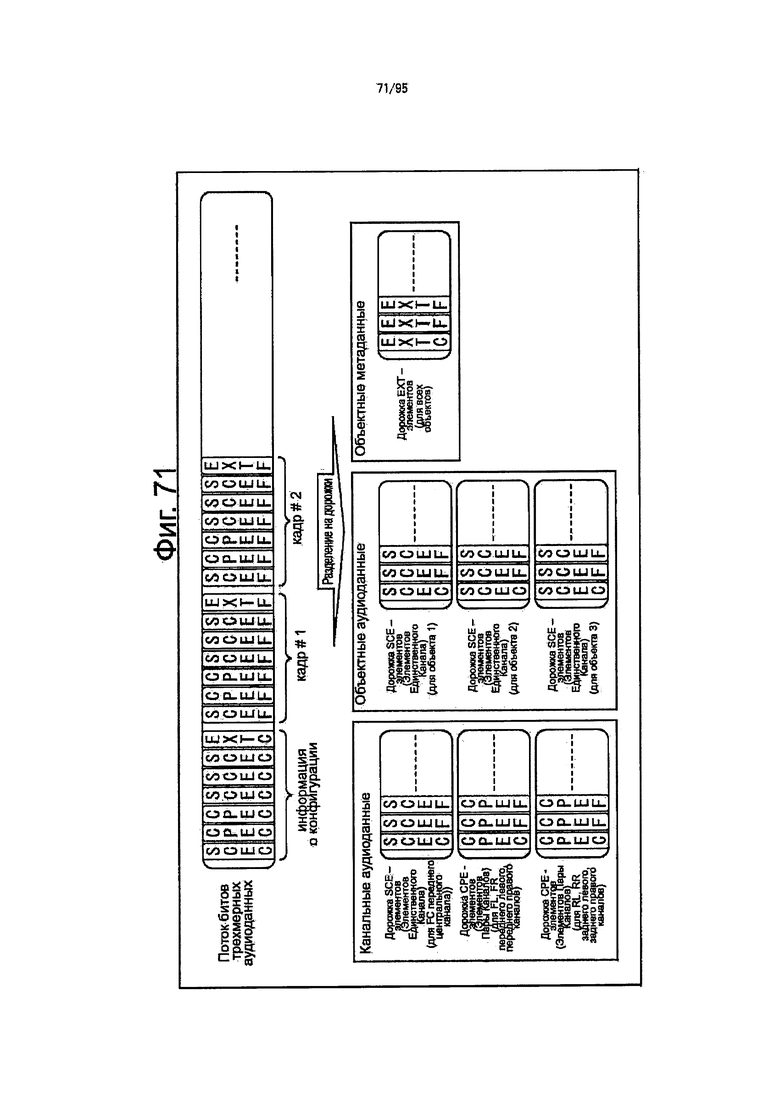

Фиг. 71 представляет собой схему, на которой проиллюстрирован некоторый первый пример процесса на Web-сервере.

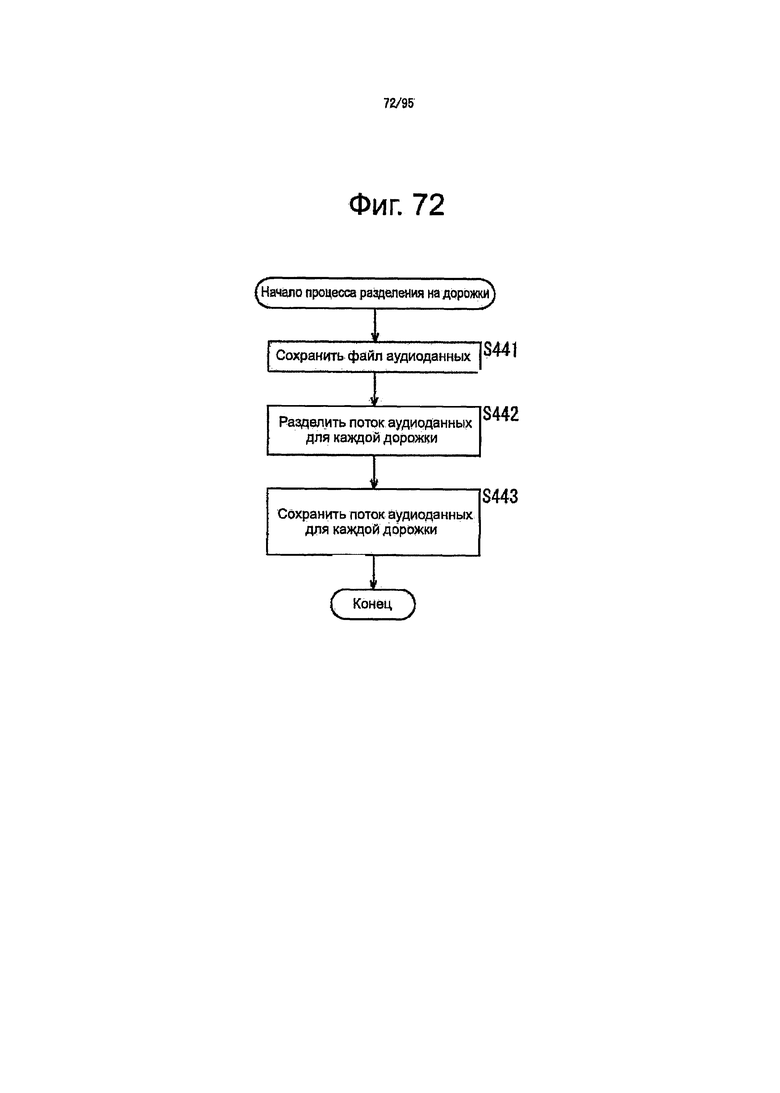

Фиг. 72 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс разделения на дорожки, выполняемый на Web-сервере.

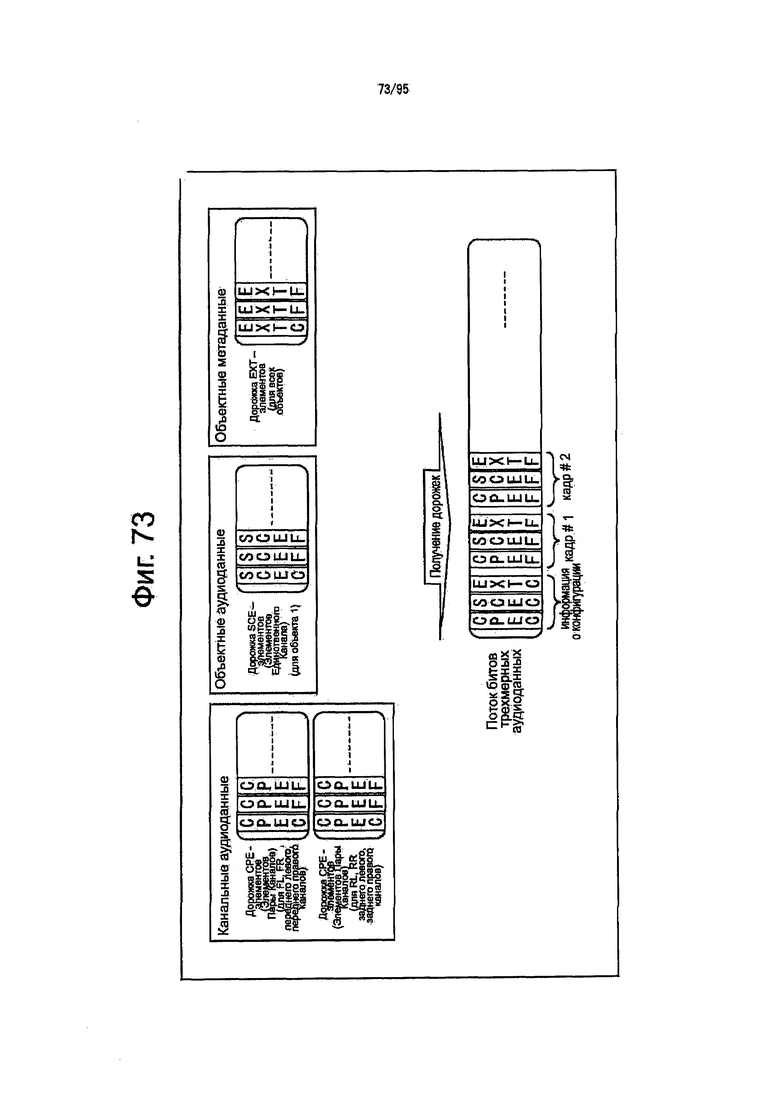

Фиг. 73 представляет собой схему, на которой проиллюстрирован некоторый первый пример процесса в блоке обработки данных при декодировании аудиоданных.

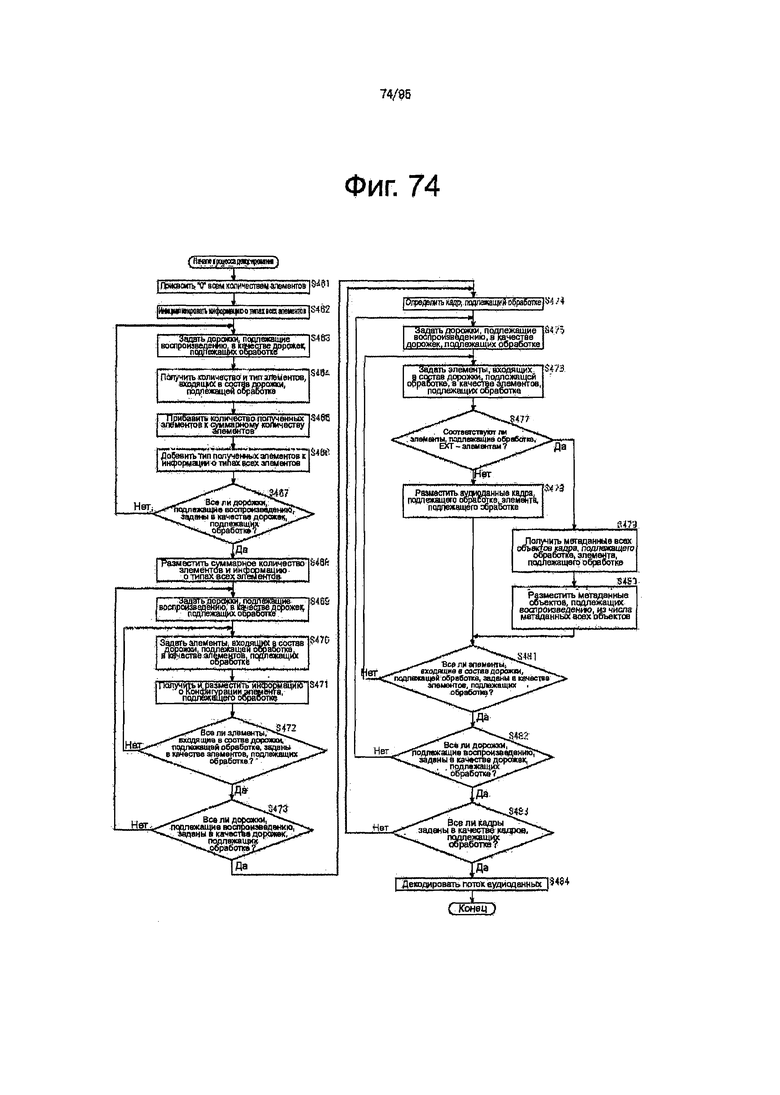

Фиг. 74 представляет собой блок-схему алгоритма, на которой проиллюстрированы подробности первого примера процесса декодирования в блоке обработки данных при декодировании аудиоданных.

Фиг. 75 представляет собой схему, на которой проиллюстрирован некоторый второй пример процесса в блоке обработки данных при декодировании аудиоданных.

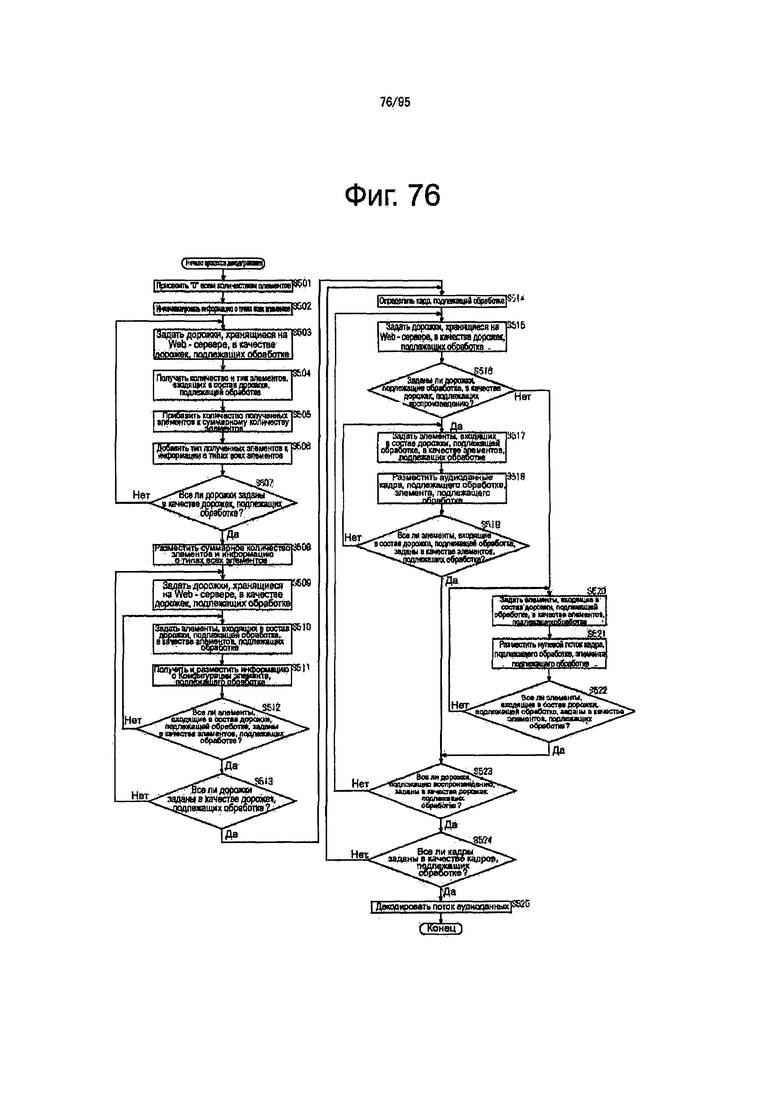

Фиг. 76 представляет собой блок-схему алгоритма, на которой проиллюстрированы подробности второго примера процесса декодирования в блоке обработки данных при декодировании аудиоданных.

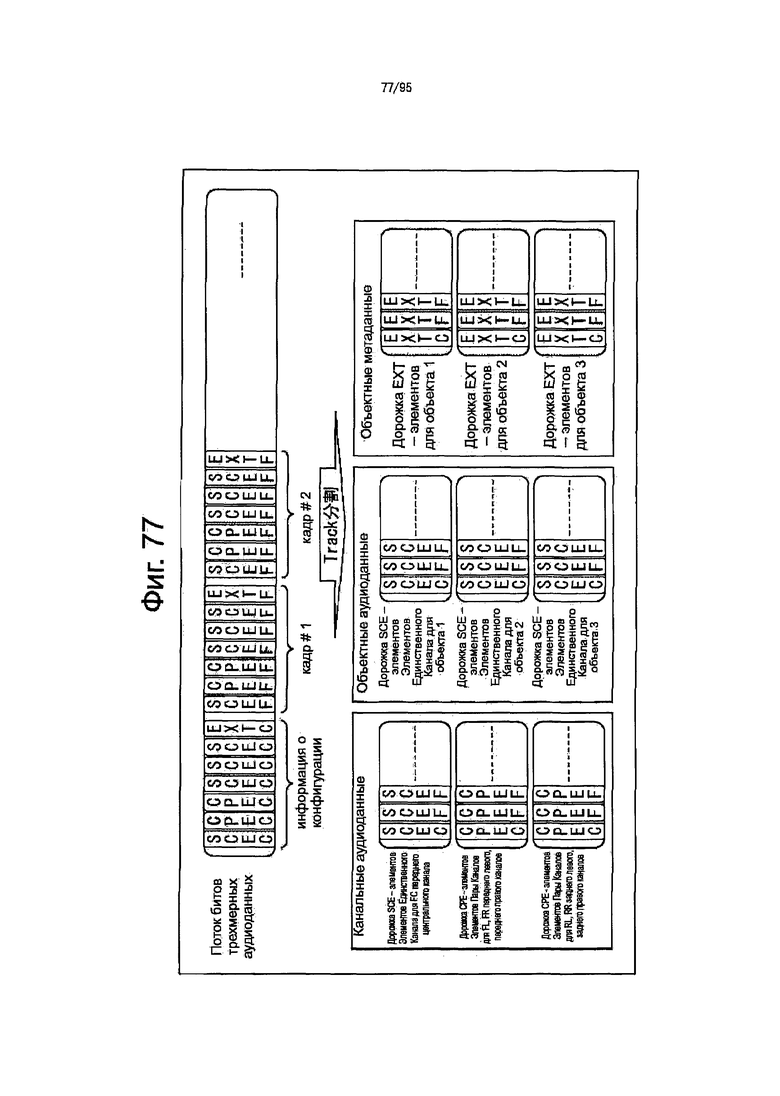

Фиг. 77 представляет собой схему, на которой проиллюстрирован некоторый второй пример процесса на Web-сервере.

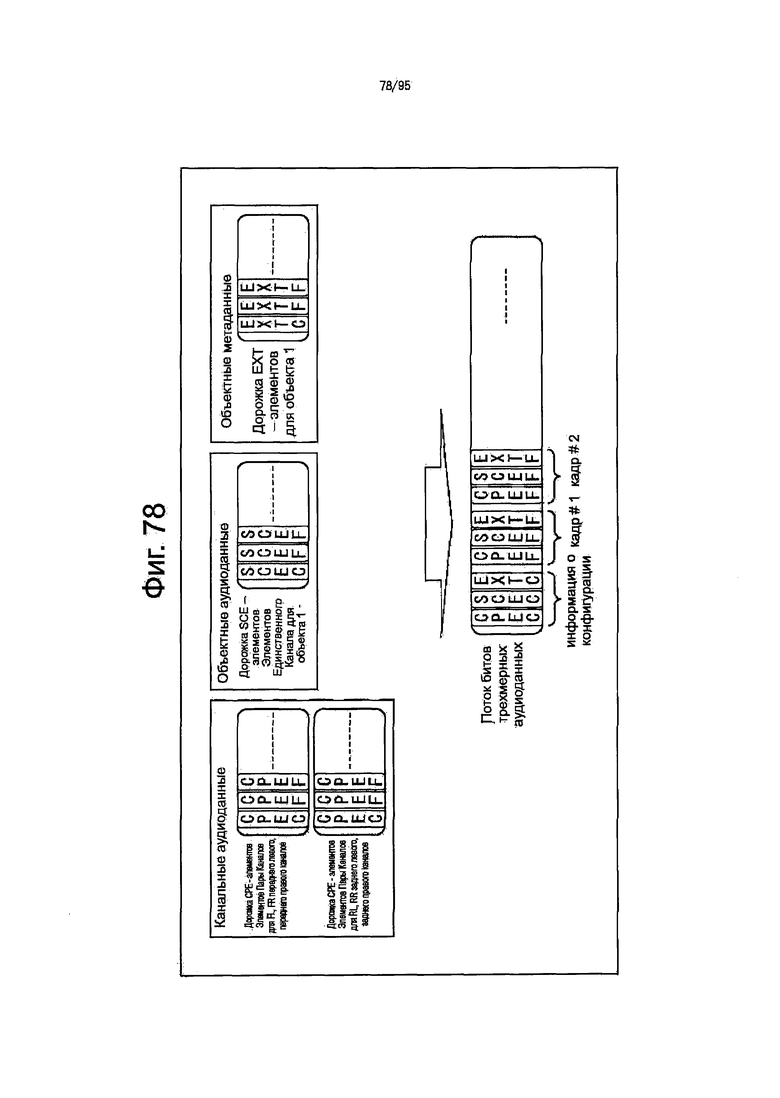

Фиг. 78 представляет собой схему, на которой проиллюстрирован некоторый третий пример процесса в блоке обработки данных при декодировании аудиоданных.

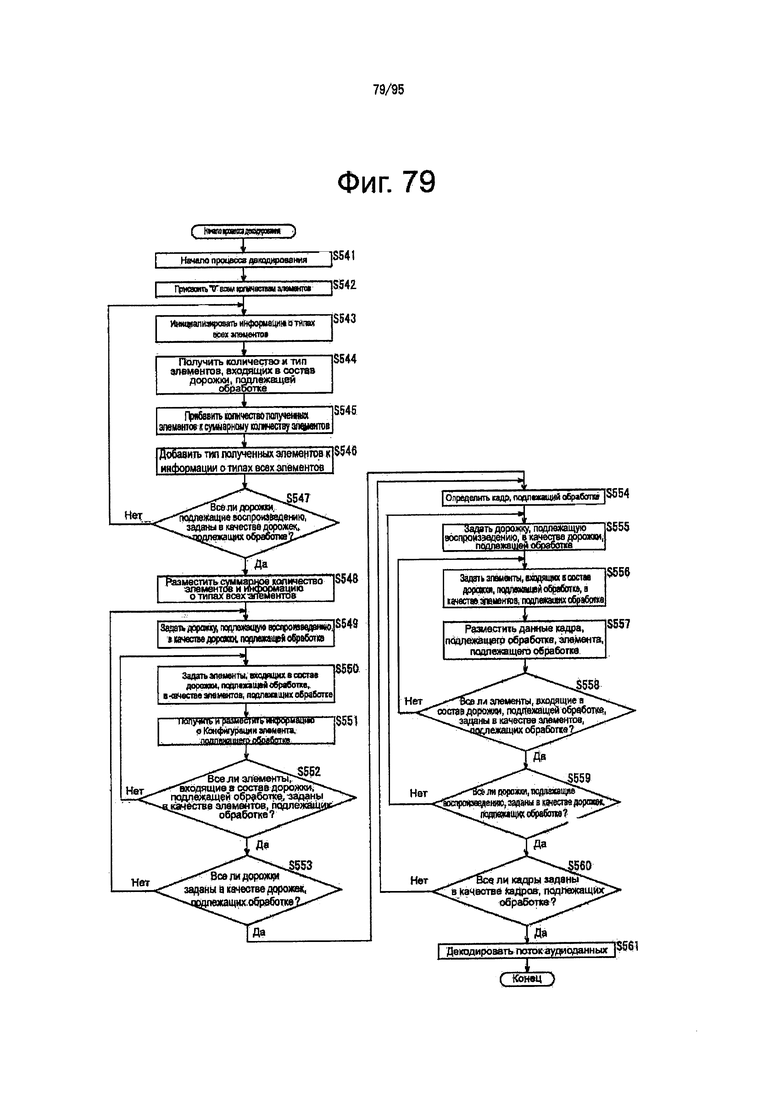

Фиг. 79 представляет собой блок-схему алгоритма, на которой проиллюстрированы подробности третьего примера процесса декодирования в блоке обработки данных при декодировании аудиоданных.

Фиг. 80 представляет собой схему, на которой показан некоторый второй пример синтаксиса информации о конфигурации, расположенной в базовом "сэмпле".

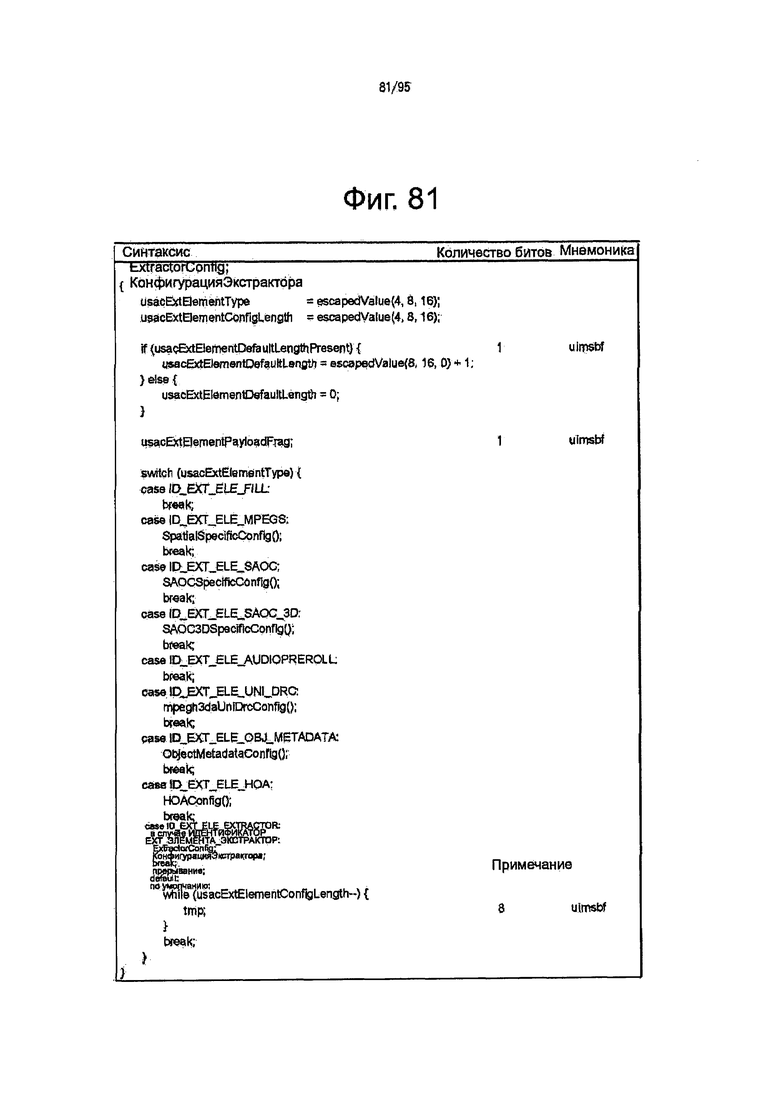

Фиг. 81 представляет собой приводимый в качестве примера синтаксис информации о Конфигурации для ЕХТ-элемента, показанной на фиг. 80.

Фиг. 82 представляет собой схему, на которой показан приводимый в качестве примера синтаксис информации о Конфигурации для Экстрактора, показанной на фиг. 81.

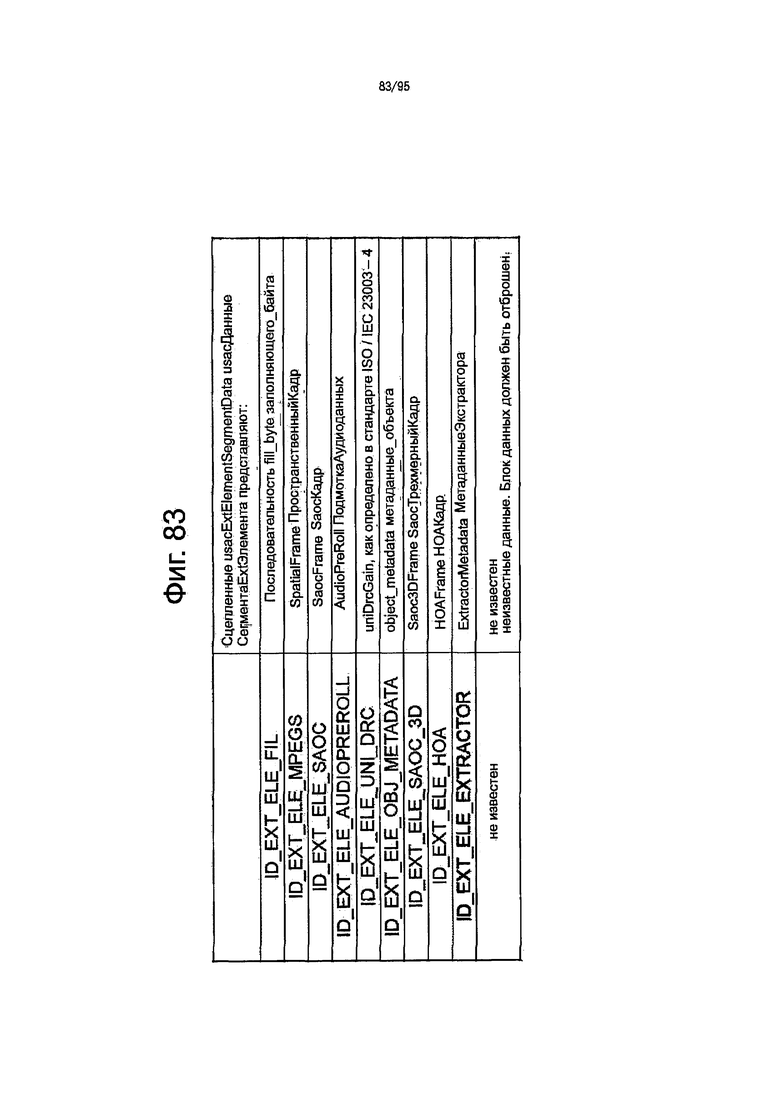

Фиг. 83 представляет собой схему, на которой показан некоторый второй пример синтаксиса данных секции-кадра, расположенной в базовом "сэмпле".

Фиг. 84 представляет собой схему, на которой показан приводимый в качестве примера синтаксис данных Экстрактора, показанных на фиг. 83.

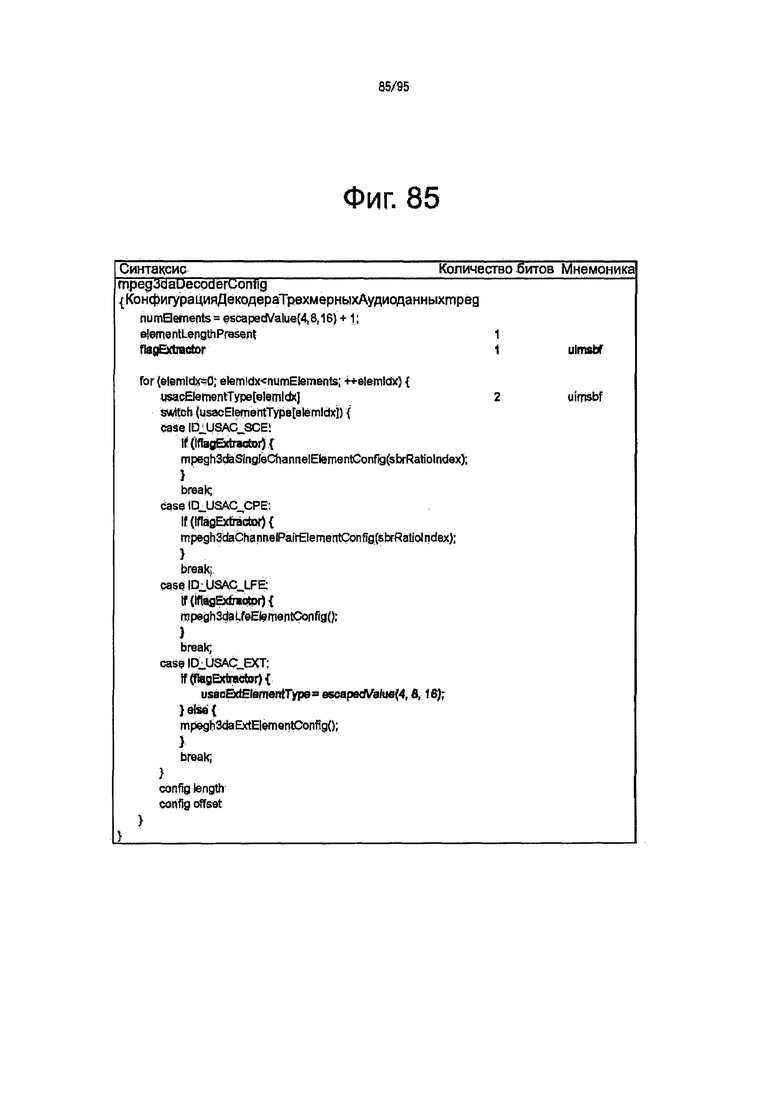

Фиг. 85 представляет собой схему, на которой показан некоторый третий пример синтаксиса информации о Конфигурации, расположенной в базовом "сэмпле".

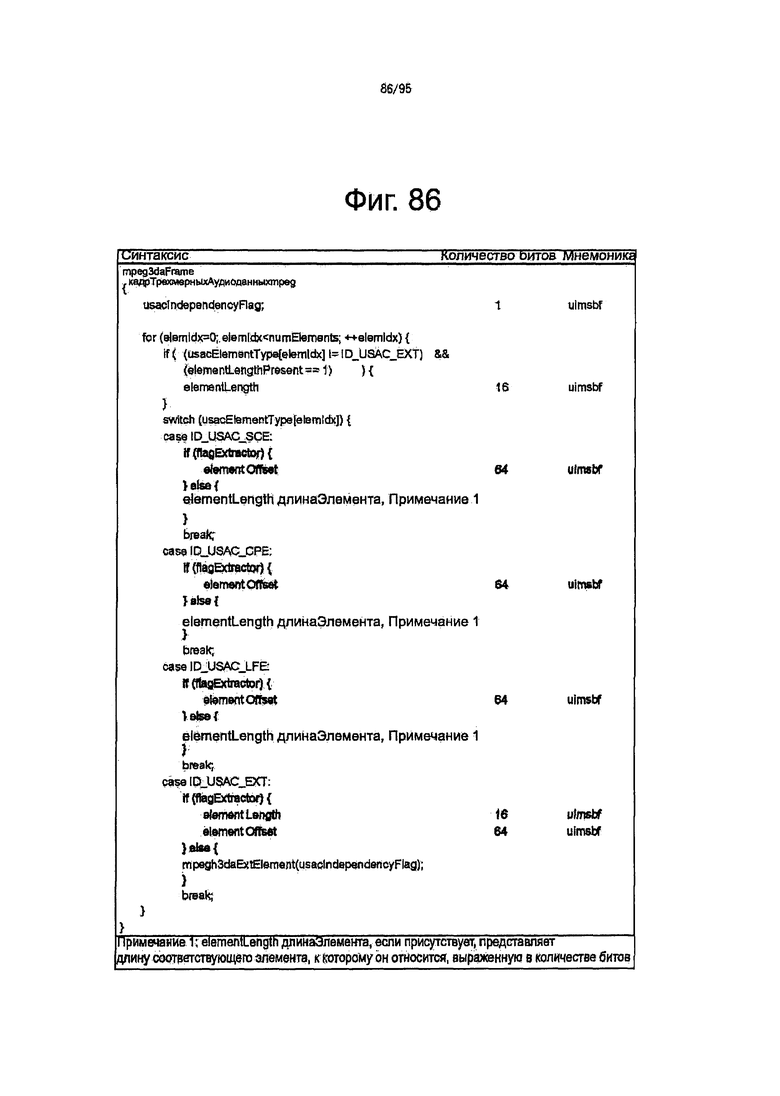

Фиг. 86 представляет собой схему, на которой показан некоторый третий пример синтаксиса данных секции-кадра, расположенной в базовом "сэмпле".

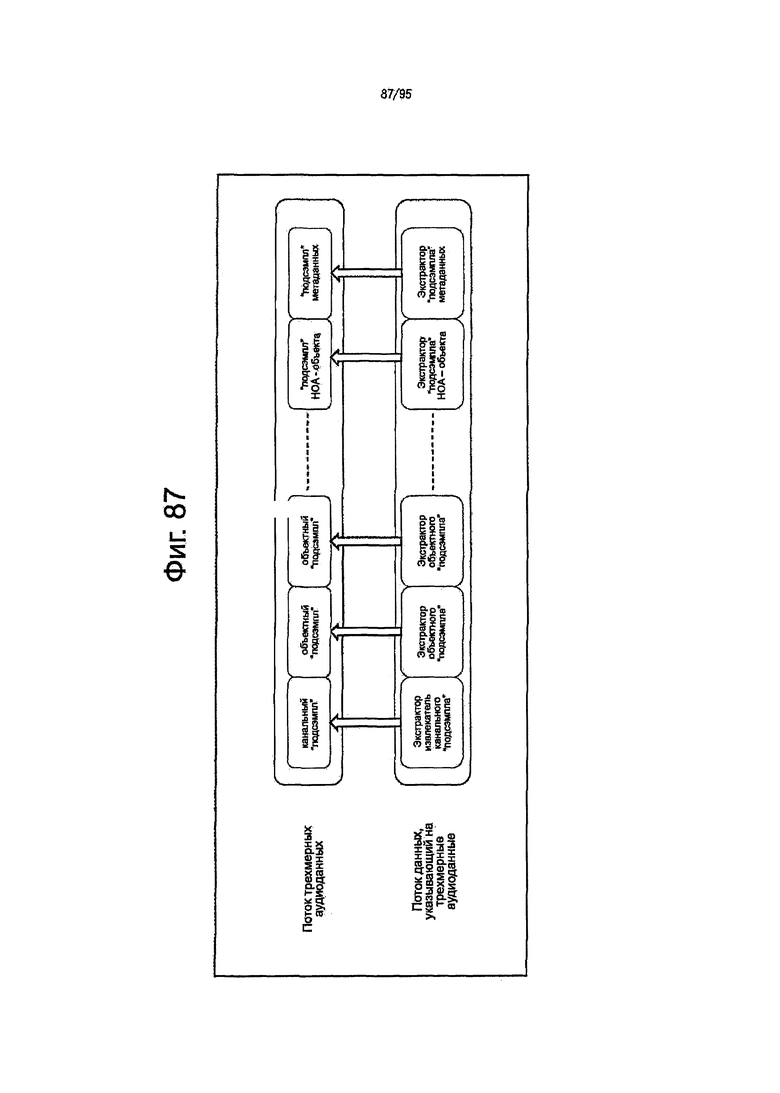

Фиг. 87 представляет собой схему, на которой показан пример конфигурации потока аудиоданных в некотором седьмом варианте воплощения системы обработки информации, в которой (системе) применено настоящее раскрываемое изобретение.

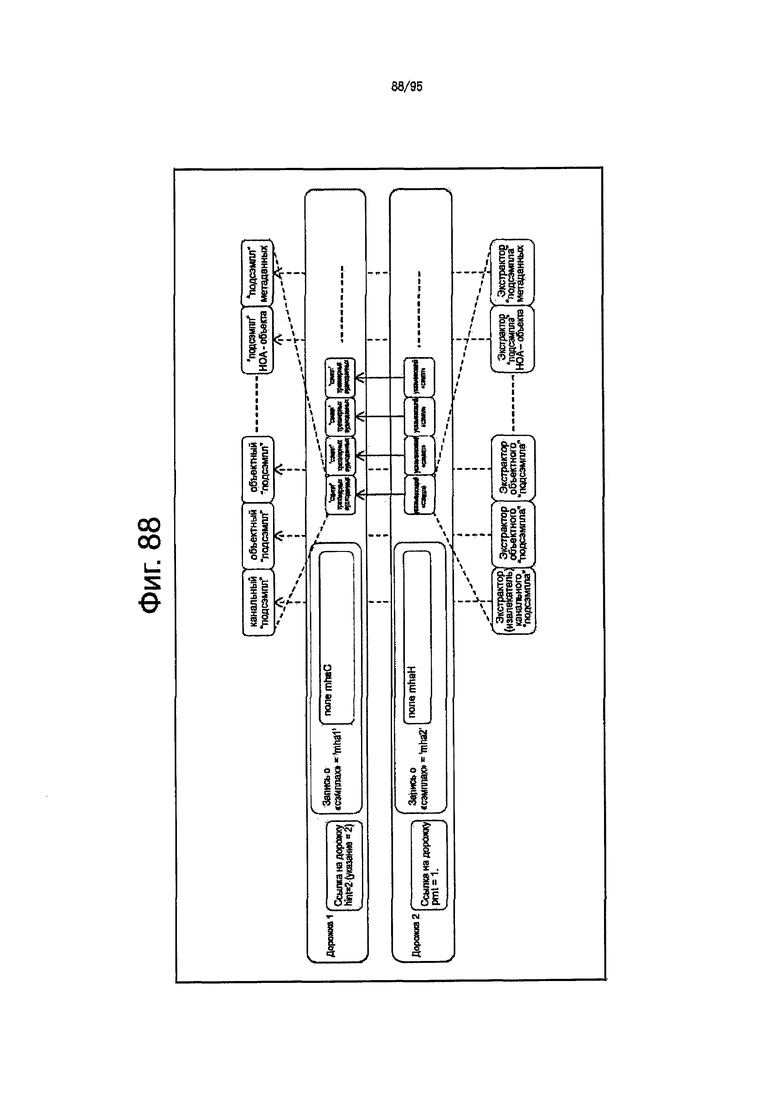

Фиг. 88 представляет собой схему, на которой проиллюстрирован план дорожек в седьмом варианте воплощения изобретения.

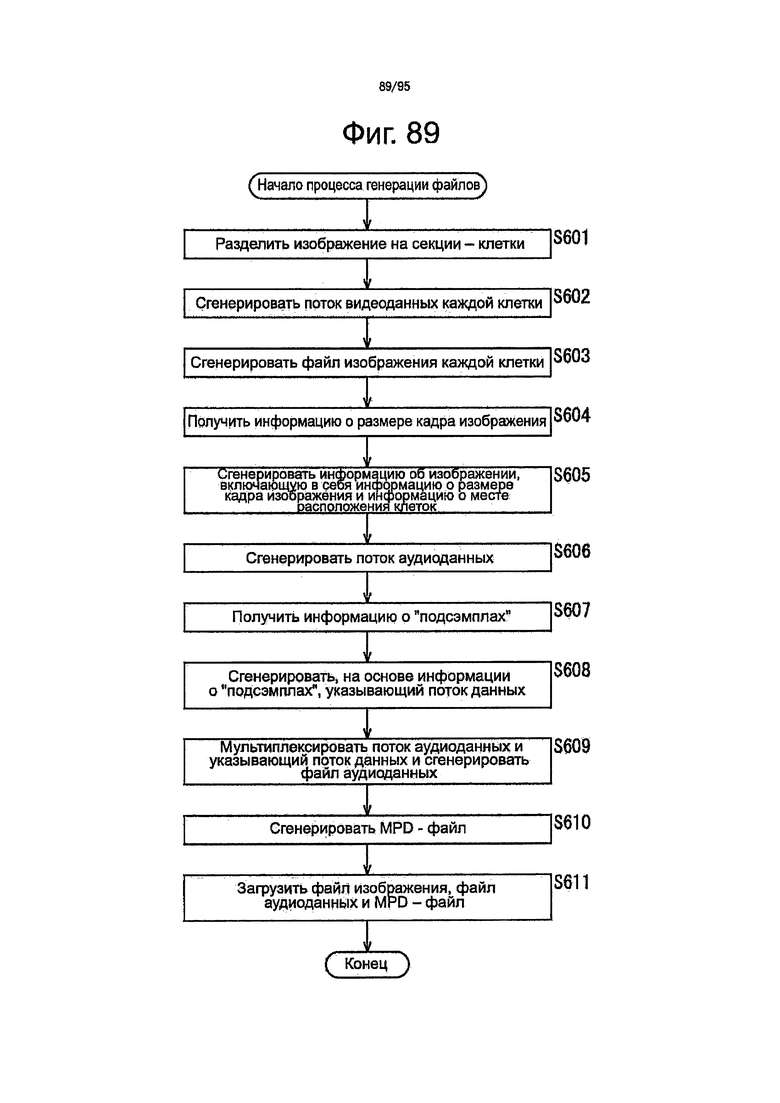

Фиг. 89 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс генерации файла в седьмом варианте воплощения изобретения.

Фиг. 90 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс воспроизведения аудиоданных в седьмом варианте воплощения изобретения.

Фиг. 91 представляет собой схему, на которой проиллюстрирован план дорожек в некотором восьмом варианте воплощения системы обработки информации, в которой (системе) применено настоящее раскрываемое изобретение.

Фиг. 92 представляет собой схему, на которой показан пример конфигурации файла аудиоданных.

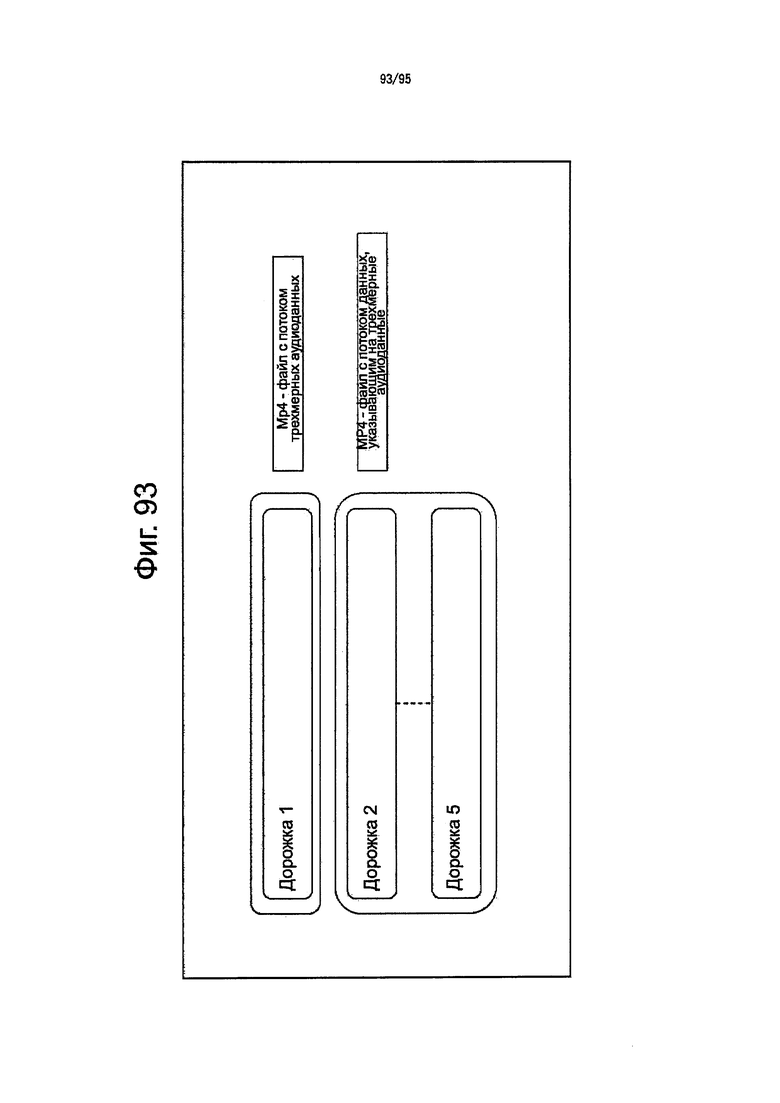

Фиг. 93 представляет собой схему, на которой показан другой пример конфигурации файла аудиоданных.

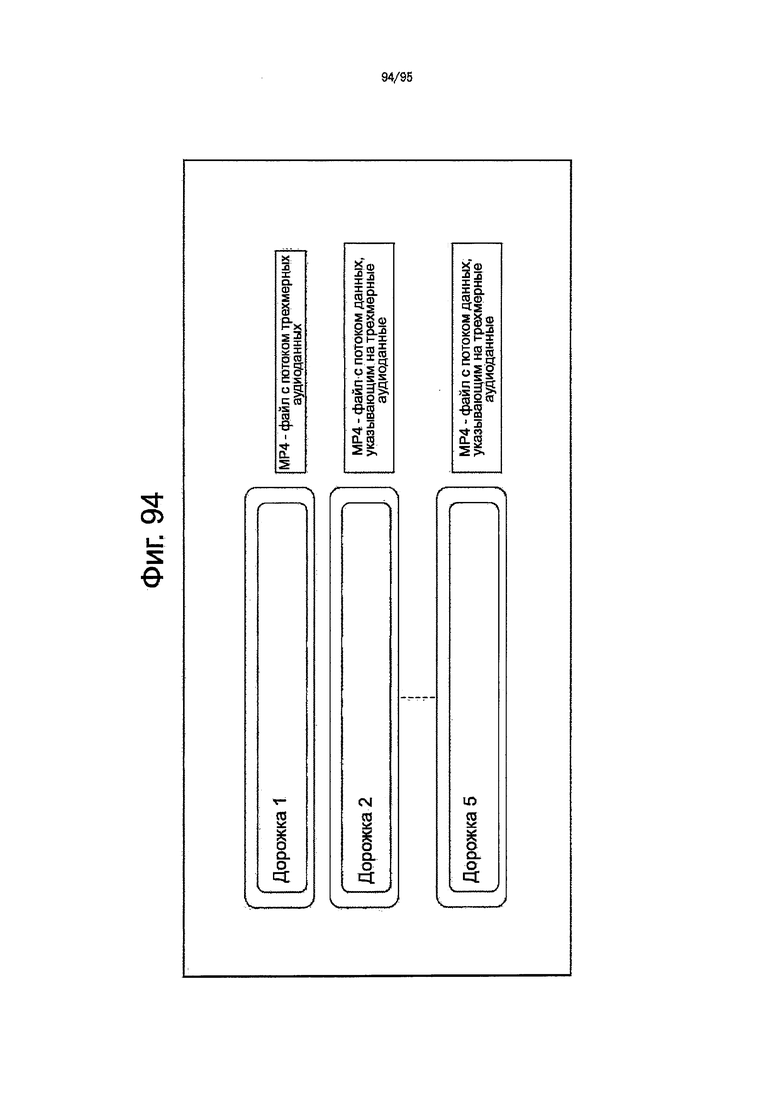

Фиг. 94 представляет собой схему, на которой показан еще один другой пример конфигурации файла аудиоданных.

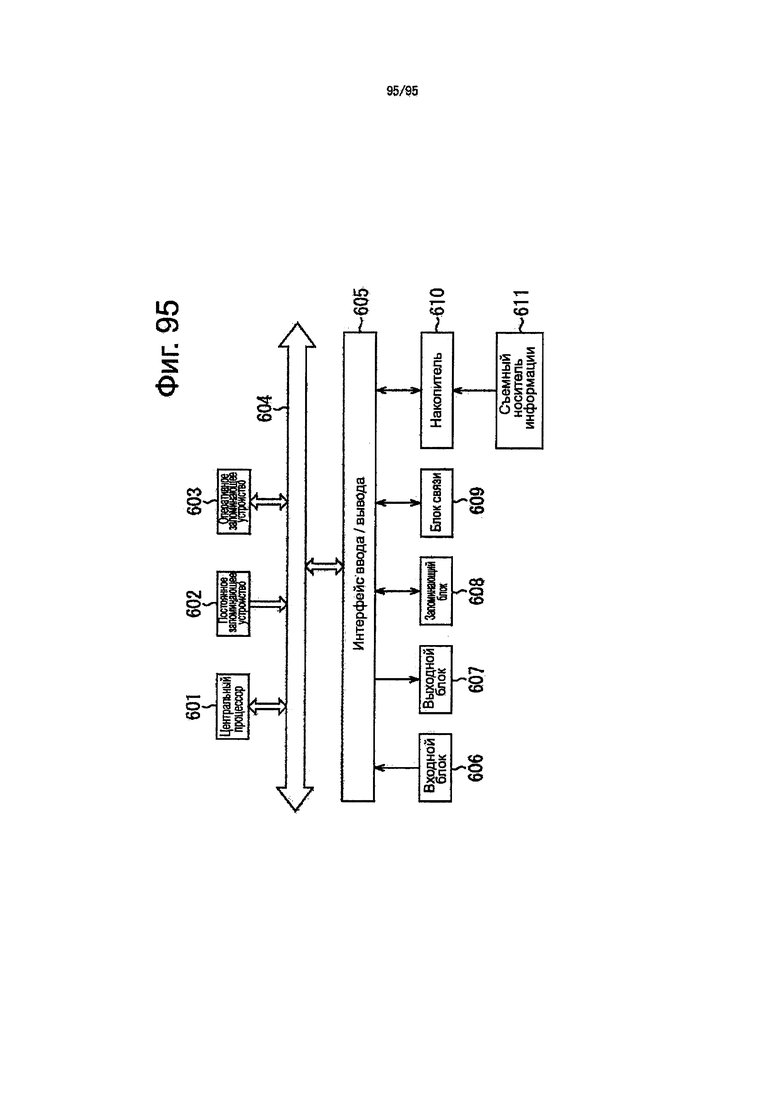

Фиг. 95 представляет собой структурную схему, на которой показан пример конфигурации аппаратного обеспечения компьютера.

Способ для осуществления изобретения

Способы для осуществления настоящего раскрываемого изобретения (в дальнейшем именуемые вариантами его воплощения) будут описаны ниже в следующем порядке.

0. Предпосылка настоящего раскрываемого изобретения (фиг. 1-30)

1. Первый вариант воплощения изобретения (фиг. 31-50)

2. Второй вариант воплощения изобретения (фиг. 51-55)

3. Третий вариант воплощения изобретения (фиг. 56)

4. Четвертый вариант воплощения изобретения (фиг. 57-67)

5. Пятый вариант воплощения изобретения (фиг. 68)

6. Шестой вариант воплощения изобретения (фиг. 69)

7. Объяснение иерархической структуры трехмерных аудиоданных (фиг. 70)

8. Объяснение первого примера процесса на Web-сервере (фиг. 71 и 72)

9. Объяснение первого примера процесса в блоке обработки данных при декодировании аудиоданных (фиг. 73 и 74)

10. Объяснение второго примера процесса в блоке обработки данных при декодировании аудиоданных (фиг. 75 и 76)

11. Объяснение второго примера процесса на Web-сервере (фиг. 77)

12. Объяснение третьего примера процесса в блоке обработки данных при декодировании аудиоданных (фиг. 78 и 79)

13. Второй пример синтаксиса базового "сэмпла" (фиг. 80-84)

14. Третий пример синтаксиса базового "сэмпла" (фиг. 85 и 86)

15. Седьмой вариант воплощения изобретения (фиг. 87-90)

16. Восьмой вариант воплощения изобретения (фиг. 91-94)

17. Девятый вариант воплощения изобретения (фиг. 95)

Предпосылка настоящего раскрываемого изобретения

План первого примера системы обработки информации

Фиг. 1 представляет собой схему, на которой проиллюстрирован план некоторого первого примера системы обработки информации, в которой применено настоящее раскрываемое изобретение.

Система (10) обработки информации, показанная на фиг. 1, имеет конфигурацию, в который Web-сервер (12), который соединен с устройством (11) генерации файлов, и воспроизводящее видеоданные оконечное устройство (14) соединены посредством сети "Интернет" (13).

В системе (10) обработки информации, Web-сервер (12) поставляет (поклеточные потоковые) данные изображения видеоконтента воспроизводящему видеоданные оконечному устройству (14) секциями-клетками способом, соответствующим стандарту MPEG-DASH.

В частности, устройство (11) генерации файлов получает данные изображения видеоконтента и кодирует эти данные изображения по секциям-клеткам для того, чтобы сгенерировать поток видеоданных. Устройство (11) генерации файлов обрабатывает поток видеоданных каждой клетки, преобразуя в файловый формат с интервалами времени в пределах от нескольких секунд до приблизительно десяти секунд, который именуется сегментом. Устройство (11) генерации файлов загружает полученный в результате этого файл изображения каждой клетки на Web-сервер (12).

Кроме того, устройство (11) генерации файлов получает аудиоданные видеоконтента для каждого объекта (который будет описан подробно позже) и кодирует данные изображения по секциям-объектам для того, чтобы сгенерировать поток аудиоданных. Устройство (11) генерации файлов обрабатывает поток аудиоданных каждого объекта, преобразуя его в файловый формат с секциями-сегментами, и загружает полученный в результате этого файл аудиоданных каждого объекта на Web-сервер (12).

Отметим, что объект представляет собой источник звука. Аудиоданные каждого объекта получаются посредством микрофона или тому подобного, прикрепленного к объекту. Объект может представлять собой такой объект, как неподвижная микрофонная стойка, или может представлять собой некоторое движущееся тело, такой как человек.

Устройство (11) генерации файлов кодирует метаданные аудиоданных, включающие в себя информацию о месте расположения объектов (информацию о месте расположения звука), указывающую место расположения каждого объекта (место, в котором получены аудиоданные), и идентификатор объекта, который является идентификатором, уникальным для объекта. Устройство (11) генерации файлов обрабатывает закодированные данные, полученные посредством кодирования метаданных аудиоданных, преобразуя в файловый формат, организованный посегментно, и загружает полученный в результате этого файл метаданных аудиоданных на Web-сервер (12).

Кроме того, устройство (11) генерации файлов генерирует файл описания мультимедийного воспроизведения (MPD-файл) (управляющую информацию), управляющий файлом изображения и файлом аудиоданных и включающий в себя информацию о размере кадра изображения, которая указывает размер кадра изображений видеоконтента, и информацию о месте расположения клеток, которая указывает место расположение каждой клетки на изображении. Устройство (11) генерации файлов загружает MPD-файл на Web-сервер (12).

Web-сервер (12) хранит файл изображения, файл аудиоданных, файл метаданных аудиоданных, и MPD-файл, которые загружены из устройства (11) генерации файлов.

В примере, показанном на фиг. 1, Web-сервер (12) хранит группу сегментов, состоящую из множества сегментов, состоящих из файлов изображения клетки с идентификатором клетки, имеющим значение "1", и группу сегментов, состоящую из множества сегментов, состоящих из файлов изображения клетки с идентификатором клетки, имеющим значение "2". Web-сервер (12) также хранит группу сегментов, состоящую из множества сегментов, состоящих из файлов аудиоданных объекта с идентификатором объекта, имеющим значение "1", и группу сегментов, состоящую из множества сегментов, состоящих из файлов аудиоданных объекта с идентификатором объекта, имеющим значение "2". Хотя это и не показано на фигуре, группа сегментов, состоящая из файлов метаданных аудиоданных, хранится аналогичным образом.

Отметим, что файл с идентификатором клетки, имеющим значение "I", в дальнейшем именуется как "клетка #i", а объект с идентификатором объекта, имеющим значение "I", в дальнейшем именуется как "объект #i".

Web-сервер (12) функционирует в качестве передатчика и передает хранящиеся на нем файл изображения, файл аудиоданных, файл метаданных аудиоданных, MPD-файл и тому подобное на воспроизводящее видеоданные оконечное устройство (14) в ответ на запрос от этого воспроизводящего видеоданные оконечного устройства (14).

Воспроизводящее видеоданные оконечное устройство (14) исполняет, например, программное обеспечение для управления потоковой передачей данных (в дальнейшем именуемое как управляющее программное обеспечение) (21), программное обеспечение (22) воспроизведения видеоданных и клиентское программное обеспечение для доступа к Протоколу передачи гипертекста (HTTP-протоколу) (в дальнейшем, именуемое как программное обеспечение доступа) (23).

Управляющее программное обеспечение (21) представляет собой программное обеспечение для управления данными, поставляемыми посредством потоковой передачи с Web-сервера (12). В частности, управляющее программное обеспечение (21) позволяет воспроизводящему видеоданные оконечному устройству (14) получать MPD-файл с Web-сервера (12).

Кроме того, управляющее программное обеспечение (21) указывает клетку в области отображения на основе области отображения, которая представляет собой область на изображении, используемую для отображения видеоконтента, указанного программным обеспечением (22) воспроизведения видеоданных, и информации о месте расположения клеток, входящей в состав MPD-файла. Управляющее программное обеспечение (21) отдает программному обеспечению (23) доступа команду выдать запрос на передачу файла изображения указанной клетки.

Кроме того, управляющее программное обеспечение (21) отдает программному обеспечению (23) доступа команду выдать запрос на передачу файла метаданных аудиоданных. Управляющее программное обеспечение (21) указывает объект, соответствующий изображению в области отображения, на основе области отображения, информации о размере кадра изображения, входящей в состав MPD-файла, и информации о месте расположения объектов, входящей в состав файла метаданных аудиоданных. Управляющее программное обеспечение (21) отдает программному обеспечению (23) доступа команду выдать запрос на передачу файла аудиоданных указанного объекта.

Программное обеспечение (22) воспроизведения видеоданных представляет собой программное обеспечение для воспроизведения файла изображения и файла аудиоданных, полученных от Web-сервера (12). В частности, когда пользователь указывает область отображения, программное обеспечение (22) воспроизведения видеоданных указывает эту указанную область отображения управляющему программному обеспечению (21). Программное обеспечение (22) воспроизведения видеоданных декодирует, в ответ на это указание, файл изображения и файл аудиоданных, полученные от Web-сервера (12), и программное обеспечение (22) воспроизведения видеоданных синтезирует и выводит декодированные файлы.

Программное обеспечение (23) доступа представляет собой программное обеспечение для управления связью с Web-сервером (12) через сеть "Интернет" (13) с использованием HTTP (Протокола передачи гипертекста). В частности, программное обеспечение (23) доступа позволяет воспроизводящему видеоданные оконечному устройству (14), в ответ на команду от управляющего программного обеспечения (21), передать запрос на передачу файла изображения, файла аудиоданных и файла метаданных аудиоданных. Кроме того, программное обеспечение (23) доступа позволяет воспроизводящему видеоданные оконечному устройству (14) принимать файл изображения, файл аудиоданных и файл метаданных аудиоданных, передаваемые с Web-сервера (12) в ответ на запрос о передаче.

Пример клетки

Фиг. 2 представляет собой схему, на которой показан пример клетки.

Как показано на фиг. 2, изображение видеоконтента разделено на множество клеток. Каждой клетке присваивается идентификатор клетки, который представляет собой ее порядковый номер, начиная с 1. В примере, показанном на фиг. 2, изображение видеоконтента разделено на четыре клетки: с #1 по #4.

Объяснение объекта

Фиг. 3 представляет собой схему, на которой проиллюстрирован объект.

В примере, показанном на фиг. 3, проиллюстрировано восемь звуковых объектов на изображении, полученные как аудиоданные видеоконтента. Каждому объекту присвоен идентификатор объекта, который является порядковым номером, начинающимся от 1. Объекты: с #1 по #5, представляют собой движущиеся тела, а объекты: с #6 по #8, представляют собой неподвижные материальные тела. Кроме того, в примере, показанном на фиг. 3, изображение видеоконтента разделено на 7 (по ширине) × 5 (по высоте) клеток.

В этом случае, как показано на фиг. 3, когда пользователь указывает область (31) отображения, состоящую из 3 (по ширине) × 2 (по высоте) клетки, область (31) отображения включает в себя только объекты #1, #2 и #6. Таким образом, воспроизводящее видеоданные оконечное устройство (14) получает и воспроизводит, например, только файлы аудиоданных объектов #1, #2 и #6 с Web-сервера (12).

Объекты в области (31) отображения могут быть указаны на основе информации о размере кадра изображения и информации о месте расположения объектов, как описывается ниже.

Объяснение информации о месте расположения объекта

Фиг. 4 представляет собой схему, на которой проиллюстрирована информация о месте расположения объекта.

Как показано на фиг. 4, информация о месте расположения объекта включает в себя горизонтальный угол θA (-180°≤θA≤180°), вертикальный угол γA (-90°≤γA≤90°) и расстояние rA (0<rA) до объекта (40). Горизонтальный угол θA представляет собой угол в горизонтальном направлении, образованный прямой линией, соединяющей объект (40) и начало (О) координат, и плоскостью YZ, например, в случае, когда позиция съемки в центре изображения может быть задано как начало (О) координат (исходная координата); горизонтальное направление изображения задается как направление X; вертикальное направление изображения задается как направление Y; а направление глубины XY, задается как направление Z. Вертикальный угол γA представляет собой угол в вертикальном направлении, образованный прямой линией, соединяющей объект (40) и начало (О) координат, и плоскостью XZ. Расстояние rA представляет собой расстояние между объектом (40) и началом (О) координат.

Помимо этого, предположим здесь, что угол поворота влево и вверх задается как положительный угол, а угол поворота вправо и вниз задается как отрицательный угол.

Объяснение информации о размера кадра изображения

Фиг. 5 представляет собой схему, на которой проиллюстрирована информация размере кадра изображения.

Как показано на фиг. 5, информация о размере кадра изображения включает в себя горизонтальный угол θv1 левого края, горизонтальный угол θv2 правого края, вертикальный угол γv1 верхнего края, вертикальный угол γv2 нижнего края, и расстояние rv в кадре изображения.

Горизонтальный угол θv1 представляет собой угол в горизонтальном направлении, образованном прямой линией, соединяющей левый край кадра изображения и начало (О) координат, и плоскостью YZ, например, в случае, когда позиция съемки в центре изображения задается как начало (О) координат (исходная координата); горизонтальное направление изображения задается как направление X; вертикальное направление изображения задается как направление Y; а направление глубины, перпендикулярное плоскости XY, задается как направление Z. Горизонтальный угол θv2 представляет собой угол в горизонтальном направлении, образованный прямой линией, соединяющей правый край кадра изображения и начало (О) координат, и плоскостью YZ. Таким образом, угол, полученный посредством объединения горизонтального угла θv1 и горизонтального угла θv2 представляет собой горизонтальный угол зрения.

Вертикальный угол γv1 представляет собой угол, образованный плоскостью XZ и прямой линией, соединяющей верхний край кадра изображения и начало (О) координат, а вертикальный угол γv2 представляет собой угол, образованный плоскостью XZ и прямой линией, соединяющей нижний край кадра изображения и начало (О) координат. Угол, полученный посредством объединения вертикальных углов γv1 и γv2 становится вертикальным углом зрения. Расстояние rv представляет собой расстояние между началом (О) координат и плоскостью изображения.

Как было описано выше, информация о месте расположения объекта представляет относительное положение объекта (40) и начала (О) координат, а информация о размере кадра изображения представляет относительное положение кадра изображения и начала (О) координат. Таким образом, имеется возможность определить (распознать) место расположения каждого объекта на изображении на основе информации о месте расположения объекта и информации о размере кадра изображения. В результате, имеется возможность определить указать объект в области (31) отображения.

Объяснение структуры MPD-файла

Фиг. 6 представляет собой схему, на которой проиллюстрирована структура MPD-файла.

В ходе анализа (синтаксического анализа) MPD-файла, воспроизводящее видеоданные оконечное устройство (14) выбирает оптимальный атрибут среди атрибутов "Представления", входящего в состав "Периода" MPD-файла (мультимедийное воспроизведение на фиг. 6).

Воспроизводящее видеоданные оконечное устройство (14) получает файл, обращаясь к URL (Унифицированному указателю ресурса) или тому подобному из "Initialization Segment" ("Сегмента инициализации") в заголовке выбранного "Representation" ("Представления"), и обрабатывает полученный файл. После этого, воспроизводящее видеоданные оконечное устройство (14) получает файл, обращаясь к URL-указателю или тому подобному последующего "Media Segment" ("Мультимедийного сегмента") и воспроизводит полученный файл.

Отметим, что в MPD-файле, соотношение между "Period" ("Периодом"), "Representation" ("Представлением") и "Segment" ("Сегментом") становится таким, как показано на фиг. 7. Другими словами, одним элементом видеоконтента можно управлять в более длинной единице времени, чем сегмент, посредством "Периода", и можно управлять в секциях-сегментах посредством "Сегмента" в каждом "Периоде". Кроме того, в каждый "Период", имеется возможность управлять видеоконтентом в секциях-атрибутах потока данных посредством "Представления".

Таким образом, MPD-файл имеет иерархическую структуру, показанную на фиг. 8, начинающуюся с "Period" ("Периода"). Кроме того, структура MPD-файла, упорядоченная по оси времени, превращается в конфигурацию, которая показана на фиг. 9. Как ясно из Фиг. 9, в одном и том же сегменте имеется множество элементов "Representation" ("Представление"). Воспроизводящее видеоданные оконечное устройство (14) выбирает адаптивным образом любой из числа этих элементов, и, таким образом, имеется возможность получить файл изображения и файл аудиоданных в области отображения, выбранной пользователем, и воспроизвести полученный файл.

Объяснение описания MPD-файла

Фиг. 10 представляет собой схему, на которой проиллюстрировано описание MPD-файла.

Как было описано выше, в системе (10) обработки информации, информация о размере кадра изображения включена в состав MPD-файла, позволяя воспроизводящему видеоданные оконечному устройству (14) указывать объект в области отображения. Как показано на фиг. 10, Схема (urn:mpeg:DASH:viewingAngle:2013 (um:mpeg:DASH:уголНаблюдения:2013)), используемая для определения новой информации о размере кадра изображения (угле наблюдения), расширена за счет использования элемента DescriptorType (ДескрипторногоТипа), представляющего собой Viewpoint (Точка наблюдения), и таким образом информация о размере кадра изображения располагается в "Адаптационном наборе" ("Adaptation Set") для аудиоданных и "Adaptation Set" для изображения. Информация о размере кадра изображения может быть расположена только в "Адаптационном наборе" для изображения.

Кроме того, в "Адаптационном Наборе" для аудиоданных в MPD-файле описывается "Представление" для файла метаданных аудиоданных. В "Segment" ("Сегменте") из этого "Representation" ("Представления") описывается URL (Унифицированный указатель ресурса) или тому подобное, как информация для указания файла метаданных аудиоданных (audiometadata.mp4 (метаданныеаудиоданных.mp4)). В этом случае, описывается, что файл, указываемый в "Segment" ("Сегменте"), является файлом метаданных аудиоданных (objectaudiometadata (метаданныеобъектныхаудиоданных)), используя элемент Role (Роль).

"Representation" ("Представление") для файла аудиоданных каждого объекта также описывается в "Адаптационном Наборе" для аудиоданных, входящем в состав MPD-файла. В "Segment" ("Сегменте") из этого "Representation" ("Представления") описывается URL-указатель или тому подобное, как информация для указания файла аудиоданных (audioObje1.mp4 (звуковойОбъект1.mp4), audioObje5.mp4 (звуковойОбъект5.mp4)) каждого объекта. В этом случае, идентификаторы (1 и 5) объекта для объектов, соответствующих файлу аудиоданных, также описываются посредством расширения Viewpoint (Точка наблюдения).

Отметим, хотя это и не показано на фигуре, что информация о месте расположения клеток располагается в "Адаптационном Наборе" для изображения.

Пример конфигурации устройства генерации файлов

Фиг. 11 представляет собой структурную схему, на которой показан пример конфигурации устройства (11) генерации файлов.

Устройство (11) генерации файлов, показанное на фиг. 11, включает в себя блок (51) обработки данных при разбиении экранного изображения, блок (52) обработки данных при кодировании изображения, блок (53) генерации файла изображения, блок (54) генерации информации об изображении, блок (55) обработки данных при кодировании аудиоданных, блок (56) генерации файла аудиоданных, блок (57) генерации MPD-файла и блок (58) обработки данных при загрузке сервера.

Блок (51) обработки данных при разбиении экранного изображения, входящий в состав устройства (11) генерации файлов, разбивает данные изображения видеоконтента, вводимого извне, на клеточные элементы. Блок (51) обработки данных при разбиении экранного изображения снабжает блок (54) генерации информации об изображении информацией о месте расположения клеток. Кроме того, блок (51) обработки данных при разбиении экранного изображения снабжает блок (52) обработки данных при кодировании изображения данными изображения, сконфигурированными в секции-клетки.

Блок (52) обработки данных при кодировании изображения кодирует данные изображения, которые сконфигурированы в секции-клетки, и подаются из блока (51) обработки данных при разбиении экранного изображения, для каждой клетки для того, чтобы сгенерировать поток видеоданных. Блок (52) обработки данных при кодировании изображения снабжения блок (53) генерации файла изображения потоком видеоданных каждой клетки.

Блок (53) генерации файла изображения обрабатывает поток видеоданных каждой клетки, подаваемый из блока (52) обработки данных при кодировании изображения, преобразуя их в файловый формат с секциями-сегментами, и снабжает блок (57) генерации MPD-файла полученным в результате этого файлом изображения каждой клетки.

Блок (54) генерации информации об изображении снабжает блок (57) генерации MPD-файла информацией о месте расположения клеток, подаваемой из блока (51) обработки данных при разбиении экранного изображения, и информацией о размере кадра изображения, введенной извне, как информацией об изображении.

Блок (55) обработки данных при кодировании аудиоданных кодирует аудиоданные, которые сконфигурированы в секции-клетки видеоконтента, вводимого извне, для каждого объекта, и генерирует поток аудиоданных. Кроме того, блок (55) обработки данных при кодировании аудиоданных кодирует информацию о месте расположения объекта по каждому объекту, вводимую извне, и метаданные аудиоданных, включающие в себя идентификатор объекта и тому подобное, генерируя закодированные данные. Блок (55) обработки данных при кодировании аудиоданных снабжает блок (56) генерации файла аудиоданных потоком аудиоданных каждого объекта и закодированными данными метаданных аудиоданных.

Блок (56) генерации файла аудиоданных функционирует в качестве блока генерации файла аудиоданных, обрабатывает поток аудиоданных каждого объекта, подаваемый из блока (55) обработки данных при кодировании аудиоданных, преобразуя его в файловый формат с секциями-сегментами, и снабжает блок (57) генерации MPD-файла полученным в результате этого файлом аудиоданных каждого объекта.

Кроме того, блок (56) генерации файла аудиоданных функционирует в качестве блока генерации метафайла, обрабатывает закодированные данные звуковых метаданных, подаваемые из блока (55) обработки данных при кодировании аудиоданных, преобразуя их в файловый формат с секциями-сегментами, и снабжает блок (57) генерации MPD-файла полученным в результате этого файлом метаданных аудиоданных.

Блок (57) генерации MPD-файла определяет URL-указатель или тому подобное Web-сервера (12) для хранения файла изображения каждой клетки, подаваемого из блока (53) генерации файла изображения. Кроме того, блок (57) генерации MPD-файла определяет URL-указатель или тому подобное Web-сервера (12) для хранения файл аудиоданных каждого объекта и файла метаданных аудиоданных, каковые файлы подаются из блока (56) генерации файла аудиоданных.

Блок (57) генерации MPD-файла располагает информацию об изображении, подаваемую из блока (54) генерации информации об изображении, в "AdaptationSet" ("АдаптационномНаборе") для изображения, имеющемся в MPD-файле. Кроме того, блок (57) генерации MPD-файла располагает информацию о размере кадра изображения среди порций информации об изображении в "AdaptationSet" ("АдаптационномНаборе") для аудиоданных, имеющемся в MPD-файле. Блок (57) генерации MPD-файла располагает URL-указатель или тому подобное файла изображения каждой клетки в "Segment" ("Сегменте"), входящем в состав "Representation" ("Представления") для файла изображения этой клетки.

Блок (57) генерации MPD-файла располагает URL-указатель или тому подобное файла аудиоданных каждого объекта в "Segment" ("Сегменте"), входящем в состав "Representation" ("Представления") для файла аудиоданных этого объекта. Кроме того, блок (57) генерации MPD-файла функционирует в качестве блока генерации информации и располагает URL-указатель или тому подобное, как информацию для указания файла метаданных аудиоданных, в "Сегменте", входящем в состав "Представления" для файла метаданных аудиоданных. Блок (57) генерации MPD-файла снабжает блок (58) обработки данных при загрузке сервера MPD-файлом, в котором разнообразные типы информации располагаются так, как это описано выше, файлом изображения, файлом аудиоданных и файлом метаданных аудиоданных.

Блок (58) обработки данных при загрузке сервера загружает файл изображения каждой клетки, файл аудиоданных каждого объекта, файл метаданных аудиоданных и MPD-файл, которые подаются из блока (57) генерации MPD-файла, на Web-сервер (12).

Объяснение процесса в устройстве генерации файлов

Фиг. 12 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс генерации файлов в устройстве (11) генерации файлов, показанном на фиг. 11.

На этапе S11, показанном на фиг. 12, блок (51) обработки данных при разбиении экранного изображения, входящий в состав устройства (11) генерации файлов данных изображения, разбивает данные изображения видеоконтента, вводимого извне, на клеточные элементы. Блок (51) обработки данных при разбиении экранного изображения снабжает блок (54) генерации информации об изображении информацией о месте расположения этих клеток. Кроме того, блок (51) обработки данных при разбиении экранного изображения снабжает блок (52) обработки данных при кодировании изображения данными изображения, сконфигурированными в секции-клетки.

На этапе S12, блок (52) обработки данных при кодировании изображения кодирует данные изображения, которые сконфигурированы в секции-клетки и подаются из блока (51) обработки данных при разбиении экранного изображения, для каждой клетки для того, чтобы сгенерировать поток видеоданных каждой клетки. Блок (52) обработки данных при кодировании изображения снабжает блок (53) генерации файла изображения потоком видеоданных каждой клетки.

На этапе S13, блок (53) генерации файла изображения обрабатывает поток видеоданных каждой клетки, подаваемые из блока (52) обработки данных при кодировании изображения, преобразуя его в файловый формат с секциями-сегментами, для того, чтобы сгенерировать файл изображения каждой клетки. Блок (53) генерации файла изображения, снабжает блок (57) генерации MPD-файла файлом изображения каждой клетки.

На этапе S14, блок (54) генерации информации об изображении получает извне информацию о размере кадра изображения. На Этапе S15, блок (54) генерации информации об изображении генерирует информацию об изображении, включающую в себя информацию о месте расположения клеток, подаваемую из блока (51) обработки данных при разбиении экранного изображения, и информацию о размере кадра изображения, и снабжает блок (57) генерации MPD-файла этой информацией об изображении.

На этапе S16, блок (55) обработки данных при кодировании аудиоданных кодирует аудиоданные, которые сконфигурированы в секции-объекты видеоконтента, вводимого извне, для каждого объекта, и генерирует поток аудиоданных каждого объекта. Кроме того, блок (55) обработки данных при кодировании аудиоданных кодирует информацию о месте расположения объекта по каждому объекту, вводимую извне, и метаданные аудиоданных, включающие в себя идентификатор объекта, для того, чтобы сгенерировать закодированные данные. Блок (55) обработки данных при кодировании аудиоданных снабжает этим потоком аудиоданных каждого объекта и закодированными данными метаданных аудиоданных блок (56) генерации файла аудиоданных.

На этапе S17, блок (56) генерации файла аудиоданных обрабатывает поток аудиоданных каждого объекта, подаваемый из блока (55) обработки данных при кодировании аудиоданных, преобразуя его в файловый формат, с секциями-сегментами, для того, чтобы сгенерировать файл аудиоданных каждого объекта. Кроме того, блок (56) генерации файла аудиоданных обрабатывает закодированные данные метаданных аудиоданных, подаваемые из блока (55) обработки данных при кодировании аудиоданных, преобразуя их в файловый формат с секциями-сегментами, для того, чтобы сгенерировать файл метаданных аудиоданных. Блок (56) генерации файла аудиоданных снабжает блок (57) генерации MPD-файла файлом аудиоданных каждого объекта и файлом метаданных аудиоданных.

На этапе S18, блок (57) генерации MPD-файла генерирует MPD-файл, включающий в себя информацию об изображении, подаваемую из блока (54) генерации информации об изображении, URL-указатель или тому подобное каждого файла. Блок (57) генерации MPD-файла снабжает блок (58) обработки данных при загрузке сервера, MPD-файлом, файлом изображения каждой клетки, файлом аудиоданных каждого объекта и файлом метаданных аудиоданных.

На этапе S19, блок (58) обработки данных при загрузке сервера загружает файл изображения каждой клетки, файл аудиоданных каждого объекта, файла метаданных аудиоданных и MPD-файл, которые подаются из блока (57) генерации MPD-файла, на Web-сервер (12). После этого, процесс завершен.

Пример функциональной конфигурации воспроизводящего видеоданные оконечного устройства

Фиг. 13 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения, который реализован таким образом, что воспроизводящее видеоданные оконечное устройство (14), показанное на фиг. 1, исполняет управляющее программное обеспечение (21), программное обеспечение (22) воспроизведения видеоданных и программное обеспечение (23) доступа.

Блок (90) потокового воспроизведения, показанный на фиг. 13, включает в себя блок (91) получения MPD-файла, блок (92) обработки MPD-файла, блок (93) получения файла метаданных, блок (94) выбора аудиоданных, блок (95) получения файла аудиоданных, блок (96) обработки данных при декодировании аудиоданных, блок (97) обработки данных при синтезе аудиоданных, блок (98) выбора изображения, блок (99) получения файла изображения, блок (100) обработки данных при декодировании изображения, и блок (101) обработки данных при синтезе изображения.

Блок (91) получения MPD-файла, входящий в состав блока (90) потокового воспроизведения, функционирует в качестве приемника, получает MPD-файл от Web-сервера (12) и снабжает этим MPD-файлом блок (92) обработки MPD-файла.

Блок (92) обработки MPD-файла извлекает из MPD-файла, подаваемого из блока (91) получения MPD-файла, информацию, такую как URL-указатель, которая описана в "Segment" ("Сегменте") для файла метаданных аудиоданных, и снабжает этой извлеченной информацией блок (93) получения файла метаданных. Кроме того, блок (92) обработки MPD-файла извлекает из MPD-файла информацию о размере кадра изображения, которая описана в "AdaptationSet" ("АдатационномНаборе") для изображения, и снабжает этой извлеченной информацией блок (94) выбора аудиоданных. Блок (92) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Сегменте" для файла аудиоданных, по объекту, запрашиваемому из блока (94) выбора аудиоданных, и снабжает этой извлеченной информацией блок (94) выбора аудиоданных.

Блок (92) обработки MPD-файла извлекает из MPD-файла информацию о месте расположения клеток, описанную в "AdaptationSet" ("АдаптационномНаборе") для изображения и снабжает этой извлеченной информацией блок (98) выбора изображения. Блок (92) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Segment" ("Сегменте") для файла изображения клетки, запрашиваемой из блока (98) выбора изображения, и снабжает этой извлеченной информацией блок (98) выбора изображения.

На основе информации, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла, блок (93) получения файла метаданных запрашивает Web-сервер (12), чтобы тот прислал файл метаданных аудиоданных, указанный этим URL-указателем, и получает этот файл метаданных аудиоданных. Блок (93) получения файла метаданных снабжает блок (94) выбора аудиоданных информацией о месте расположения объектов, включенной в состав файла метаданных аудиоданных.

Блок (94) выбора аудиоданных функционирует в качестве блока определения места расположения, и вычисляет место расположения каждого объекта на изображении, основываясь на информации о размере кадра изображения, подаваемой из блока (92) обработки MPD-файла, и информации о месте расположения объектов, подаваемой из блока (93) получения файла метаданных. Блок (94) выбора аудиоданных выбирает, на основе места расположения каждого объекта на изображении, объект в области отображения, указанной пользователем. Блок (94) выбора аудиоданных запрашивает блок (92) обработки MPD-файла, чтобы тот прислал информацию, такую как URL-указатель файла аудиоданных выбранного объекта. Блок (94) выбора аудиоданных снабжает информацией, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла в ответ на этот запрос, блок (95) получения файла аудиоданных.

Блок (95) получения файла аудиоданных функционирует в качестве приемника. На основе информации, такой как URL-указатель, подаваемой из блока (94) выбора аудиоданных, блок (95) получения файла аудиоданных запрашивает Web-сервер (12), чтобы тот прислал файл аудиоданных, который указан этим URL-указателем и сконфигурирован в секции-объекты, и получает этот файл аудиоданных. Блок (95) получения файла аудиоданных снабжает полученным файлом аудиоданных, сконфигурированным в секции-объекты, блок (96) обработки данных при декодировании аудиоданных.

Блок (96) обработки данных при декодировании аудиоданных декодирует поток аудиоданных, входящий в состав файла аудиоданных, который подается из блока (95) получения файла аудиоданных и сконфигурирован в секции-объекты, для того, чтобы сгенерировать аудиоданные по секциям-объектам. Блок (96) обработки данных при декодировании аудиоданных снабжает этими аудиоданными в секциях-объектах блок (97) обработки данных при синтезе аудиоданных.

Блок (97) обработки данных при синтезе аудиоданных синтезирует аудиоданные, которые подаются из блока (96) обработки данных при декодировании аудиоданных и сконфигурированы по секциям-объектам, и выводит синтезированные данные.

Блок (98) выбора изображения выбирает клетку в области отображения, указанной пользователем, на основе информации о месте расположения клеток, подаваемой из блока (92) обработки MPD-файла. Блок (98) выбора изображения запрашивает блок (92) обработки MPD-файла, чтобы тот прислал информацию, такую как URL-указатель для файла изображения выбранной клетки. Блок (98) выбора изображения снабжает информацией, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла в ответ на этот запрос, блок (99) получения файла изображения.

На основе информации, такой как URL-указатель, подаваемой из блока (98) выбора изображения, блок (99) получения файла изображения запрашивает Web-сервер (12), чтобы тот прислал файл изображения, который указан этим URL-указателем и сконфигурирован в секции-клетки, и получает этот файл изображения. Блок (99) получения файла изображения снабжает полученным файлом изображения с секциями-клетками блок (100) обработки данных при декодировании изображения.

Блок (100) обработки данных при декодировании изображения декодирует поток видеоданных, входящий в состав файла изображения, который подается из блока (99) получения файла изображения и сконфигурирован в секции-клетки, для генерирования данных изображения в секциях-клетках. Блок (100) обработки данных при декодировании изображения снабжает этими данными изображения в секциях-клетках блок (101) обработки данных при синтезе изображения.

Блок (101) обработки данных при синтезе изображения осуществляет синтез данных изображения, которые подаются из блока (100) обработки данных при декодировании изображения и сконфигурированы в секции-клетки, и выводит эти синтезированные данные.

Объяснение процесса в оконечном устройстве воспроизведения движущегося изображения

Фиг. 14 представляет собой блок-схему алгоритма, на которой проиллюстрирован процесс потокового воспроизведения в блоке (90) потокового воспроизведения (смотри фиг. 13) в воспроизводящем видеоданные оконечном устройстве (14).

На этапе S31, показанном на фиг. 14, блок (91) получения MPD-файла, входящий в состав блока (90) потокового воспроизведения, получает MPD-файл от Web-сервера (12) и снабжает этим MPD-файлом блок (92) обработки MPD-файла.

На этапе S32, блок (92) обработки MPD-файла получает из MPD-файла, подаваемого из блока (91) получения MPD-файла, информацию о размере кадра изображения и информацию о месте расположения клеток, которые описаны в "AdaptationSet" ("АдаптационномНаборе") для изображения. Блок (92) обработки MPD-файла снабжает информацией о размере кадра изображения блок (94) выбора аудиоданных и снабжает информацией о месте расположения клеток блок (98) выбора изображения. Кроме того, блок (92) обработки MPD-файла извлекает информацию, такую как URL-указатель, описанную в "Segment" ("Сегменте") для файла метаданных аудиоданных, и снабжает этой извлеченной информацией блок (93) получения файла метаданных.

На этапе S33, на основе информации, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла, блок (93) получения файла метаданных запрашивает Web-сервер (12), чтобы тот прислал файл метаданных аудиоданных, указанный этим URL-указателем, и получает этот файл метаданных аудиоданных. Блок (93) получения файла метаданных снабжает блок (94) выбора аудиоданных информацией о месте расположения объектов, включенной в состав файла метаданных аудиоданных.

На этапе S34, блок (94) выбора аудиоданных выбирает, на основе информации о размере кадра изображения, подаваемой из блока (92) обработки MPD-файла, и информации о месте расположения объектов, подаваемой из блока (93) получения файла метаданных, объект в области отображения, указанной пользователем. Блок (94) выбора аудиоданных запрашивает блок (92) обработки MPD-файла, чтобы тот прислал информацию, такую как URL-указатель, для файла аудиоданных выбранного объекта.

Блок (92) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Segment" ("Сегменте") для файла аудиоданных, по объекту, запрашиваемому из блока (94) выбора аудиоданных, и снабжает этой извлеченной информацией блок (94) выбора аудиоданных. Блок (94) выбора аудиоданных снабжает информацией, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла, блок (95) получения файла аудиоданных.

На этапе S35, на основе информации, такой как URL-указатель, подаваемой из блока (94) выбора аудиоданных, блок (95) получения файла аудиоданных запрашивает Web-сервер (12), чтобы тот прислал файл аудиоданных выбранного объекта, который указан этим URL-указателем, и получает этот файл аудиоданных. Блок (95) получения файла аудиоданных снабжает полученным файлом аудиоданных с секциями-объектами блок (96) обработки данных при декодировании аудиоданных.

На этапе S36, блок (98) выбора изображения выбирает, на основе информации о месте расположения клеток, подаваемой из блока (92) обработки MPD-файла, клетку в области отображения, указанной пользователем. Блок (98) выбора изображения запрашивает блок (92) обработки MPD-файла, чтобы тот прислал информацию, такую как URL-указатель, для файла изображения выбранной клетки.

Блок (92) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Segment" ("Сегменте") для файла изображения объекта, запрашиваемого из блока (98) выбора изображения, и снабжает этой извлеченной информацией блок (98) выбора изображения. Блок (98) выбора изображения снабжает информацией, такой как URL-указатель, подаваемой из блока (92) обработки MPD-файла, блок (99) получения файла изображения.

На этапе S37, на основе информации, такой как URL-указатель, подаваемой из блока (98) выбора изображения, блок (99) получения файла изображения запрашивает Web-сервер (12), чтобы тот прислал файл изображения выбранной клетки, который указан этим URL-указателем, и получает этот файл изображения. Блок (99) получения файла изображения снабжает полученным файлом изображения с секциями-клетками, блок (100) обработки данных при декодировании изображения.

На этапе S38, блок (96) обработки данных при декодировании аудиоданных декодирует поток аудиоданных, входящий в состав файла аудиоданных, который подается из блока (95) получения файла аудиоданных и сконфигурирован в секции-объекты, для того, чтобы сгенерировать аудиоданные в секциях-объектах. Блок (96) обработки данных при декодировании аудиоданных снабжает этими аудиоданными в секциях-объектах, блок (97) обработки данных при синтезе аудиоданных.

На этапе S39, блок (100) обработки данных при декодировании изображения декодирует поток видеоданных, входящий в состав файла изображения, который подается из блока (99) получения файла изображения и сконфигурирован в секции-клетки, для генерирования данных изображения в секциях-клетках. Блок (100) обработки данных при декодировании изображения снабжает данными изображения в секциях-клетках блок (101) обработки данных при синтезе изображения.

На этапе S40, блок (97) обработки данных при синтезе аудиоданных синтезирует аудиоданные, которые подаются из блока (96) обработки данных при декодировании аудиоданных и сконфигурированы в секции-объекты, и выводит синтезированные данные. На этапе S41, блок (101) обработки данных при синтезе изображения осуществляет синтез данных изображения, которые подаются из блока (100) обработки данных при декодировании изображения и сконфигурированы в секции-клетки, и выводит синтезированные данные. После этого процесс завершен.

Как было описано выше, Web-сервер (12) передает информацию о размере кадра изображения и информацию о месте расположения объектов. Таким образом, воспроизводящее видеоданные оконечное устройство (14) может указать, например, объект в области отображения для того, чтобы избирательно получить файл аудиоданных указанного объекта так, чтобы файл аудиоданных соответствовал изображению в области отображения. Это позволяет воспроизводящему видеоданные оконечному устройству (14) получать только необходимый файл аудиоданных, что ведет к повышению эффективности передачи.

Отметим, что, как показано на фиг. 15, идентификатор объекта (информация, указывающая объект) может быть описан в "AdaptationSet" ("АдаптационномНаборе") для изображения, входящем в состав MPD-файла, как информация для указания объекта, соответствующего аудиоданным, подлежащим воспроизведению одновременно с этим изображением. Идентификатор объекта можно описать, расширяя Scheme (Схему) (urn:mpeg:DASH:audioObj:2013) для определения новой информации идентификатора объекта (audioObj (звуковойОбъект)), используя элемент DescriptorType (ДескрипторногоТипа), представляющий собой Viewpoint (Точка наблюдения). В этом случае, воспроизводящее видеоданные оконечное устройство (14) выбирает файл аудиоданных объекта, соответствующего идентификатору объекта, описанному в "AdaptationSet" ("АдаптационномНаборе") для изображения, и получает этот файл аудиоданных для воспроизведения.

Вместо того, чтобы генерировать файл аудиоданных по секциям-объектам, закодированные данные всех объектов можно мультиплексировать в единый поток аудиоданных для того, чтобы сгенерировать единый файл аудиоданных.

В этом случае, как показано на фиг. 16, в "AdaptationSet" ("АдаптационномНаборе") для аудиоданных, входящем в состав MPD-файла, предусматривается одно "Representation" ("Представление") для файла аудиоданных, и URL-указатель или тому подобное для файла аудиоданных (audioObje.mp4 (звуковойОбъект.mp4)), включающего в себя закодированные данные всех объектов описан в "Segment" ("Сегменте"). При этом, идентификаторы объектов (1, 2, 3, 4 и 5) для всех объектов, соответствующих этому файлу аудиоданных, описываются посредством расширения Viewpoint ("Точки наблюдения").

В дополнение к этому, в этом случае, как показано на фиг. 17, закодированные данные (Звуковой объект) для каждого объекта располагаются, как некоторый "подсэмпл" (подфрагмент фрагмента данных), в поле mdat файла аудиоданных (в дальнейшем, когда это уместно, также именуемого как мультимедийный файл аудиоданных), получаемого при обращении к "Media Segment" ("Мультимедийному сегменту") MPD-файла.

В частности, данные располагаются в мультимедийном файле аудиоданных в секциях-подсегментах, которые всегда короче чем сегмент. Место расположения данных в секциях-подсегментах определяется полем sidx. Кроме того, данные в секциях-подсегментах состоят из поля moof и поля mdat. Поле mdat состоит из множества "сэмплов" (фрагментов данных), а закодированные данные каждого объекта располагаются как каждый "подсэмпл" (подфрагмент) "сэмпла".

Кроме того, рядом с полем sidx мультимедийного файла аудиоданных располагается поле gsix, в котором описывается информация о "сэмпле". Таким образом, поле gsix, в котором описывается информация о "сэмпле", предусмотрено отдельно от поля moof, и, таким образом, воспроизводящее видеоданные оконечное устройство (14) может быстро получать информацию о "сэмпле".

Как показано на фиг. 18, в поле gsix описывается grouping_type (тип_группирования), представляющий типы записей о группах "сэмплов", каждая из которых состоит из одного или более "сэмплов" или "подсэмплов", которыми управляет это поле gsix. Например, в случае, когда тип записи о группе "сэмплов" представляет собой "подсэмпл" закодированных данных в секциях-объектах, тип записи о группе "сэмплов" представляет собой "obja", как это показано на фиг. 17. В мультимедийном файле аудиоданных располагается множество полей gsix с grouping_type (типом_группирования).

Кроме того, как показано на фиг. 18, в поле gsix описываются индекс (entry_index (индекс_записи)) каждой записи о группе "сэмплов" и байтовый диапазон (range_size (размер_диапазона)), как информация о месте расположения данных, указывающая место расположения в мультимедийном файле аудиоданных. Отметим, что в случае, когда индекс (entry_index) представляет собой 0, соответствующий байтовый диапазон указывает байтовый диапазон поля moof (a1 в примере, показанном на фиг. 17).

Информация, указывающая то, какой объект используется, для предоставления каждой записи о группе "сэмплов" возможности соответствовать "подсэмплу" закодированных данных, описывается в файле аудиоданных, получаемом посредством обращения к "Initialization Segment" ("Сегменту инициализации") MPD-файла (в дальнейшем, когда это уместно, также именуемого как файл инициализации аудиоданных).

В частности, как показано на фиг. 19, эта информация указывается посредством использования поля (typa) присвоения типа в поле mvex, которое связано с полем AudioObjectSampleGroupEntry (ЗаписьОгруппеСэмпловЗвуковыхОбъектов) в поле описания группы "сэмплов" (поле sgpd) в поле sbtl файла инициализации аудиоданных.

Другими словами, как показано в разделе А на фиг. 20, в каждом поле AudioObjectSampleGroupEntry описывается идентификатор объекта (audio_object_id (идентификатор_звукового_объекта)), соответствующий закодированным данным, входящим в состав этого "сэмпла". Например, как показано в разделе В на фиг. 20, в каждом из четырех полей AudioObjectSampleGroupEntry описываются идентификаторы объектов, представляющие собой 1, 2, 3 и 4.

С другой стороны, как показано на фиг. 21, в поле присвоения типа, для каждого AudioObjectSampleGroupEntry описывается некоторый индекс, как параметр (grouping_type_parameter (параметр_типа_группирования)) Записи о группе "сэмплов", соответствующей этому полю AudioObjectSampleGroupEntry.

Мультимедийный файл аудиоданных и файл инициализации аудиоданных сконфигурированы так, как описано выше. Таким образом, когда воспроизводящее видеоданные оконечное устройство (14) получает закодированные данные объекта, выбранного как объект в области отображения, из поля stbl файла инициализации аудиоданных извлекается AudioObjectSampleGroupEntry, в котором описан идентификатор объекта для этого выбранного объекта. После этого, из поля mvex считывается индекс Записи о группе "сэмплов", соответствующий этой извлеченной AudioObjectSampleGroupEntry. После этого, из поля sidx файла аудиоданных считывается место расположения данных в секциях-подсегментах, и из поля gsix считывается байтовый диапазон Записи о группе "сэмплов", относящейся к считанному индексу. После этого, на основе места расположения данных в секциях-подсегментах и байтового диапазона получают закодированные данные, расположенные в поле mdat. Таким образом, получают закодированные данные выбранного объекта.

Хотя, в вышеприведенном описании, индекс Записи о группе "сэмплов" и идентификатор объекта в поле AudioObjectSampleGroupEntry связаны друг с другом через поле mvex, они могут быть связаны друг с другом напрямую. В этом случае, индекс Записи о группе "сэмплов" описывается в поле AudioObjectSampleGroupEntry.

Кроме того, в случае когда файл аудиоданных состоит из множества дорожек, поле sgpd может храниться в поле mvex, что позволяет дорожкам совместно использовать поле sgpd.

План второго примера системы обработки информации

Фиг. 22 представляет собой схему, на которой проиллюстрирован план некоторого второго примера системы обработки информации, в которой применено настоящее раскрываемое изобретение.

Отметим, что элементы, показанные на фиг. 22, которые являются одинаковыми с элементами, показанными на фиг. 3, обозначены теми же самыми ссылочными позициями.

В примере, показанном на фиг. 22, как и в случае с фиг. 3, изображение видеоконтента разделено на 7 (по ширине) × 5 (по высоте) клеток, и, в качестве аудиоданных видеоконтента, получены аудиоданные объектов: с #1 по #8.

В этом случае, когда пользователь указывает область (31) отображения, состоящую из 3 (по ширине) × 2 (по высоте) клетки, область (31) отображения преобразована (расширенная) в область, имеющую тот же самый размер, что и размер изображения видеоконтента, благодаря чему получают отображаемое изображение (111) в некотором втором примере, как это показано на фиг. 22. аудиоданные объектов: с #1 по #8, синтезируются на основе мест расположения объектов: с #1 по #8, на отображаемом изображении (111) и выводятся вместе с отображаемым изображением (111). Другими словами, в дополнение к аудиоданным объектов #1, #2 и #6, которые находятся внутри области (31) отображения, выводятся аудиоданные объектов: с #3 по #5, #7 и #8, которые находятся вне области (31) отображения.

Пример конфигурации блока потокового воспроизведения

Конфигурация второго примера системы обработки информации, в которой применено настоящее раскрываемое изобретение, является той же самой, что и конфигурация системы (10) обработки информации, показанной на фиг. 1, за исключением конфигурации блока потокового воспроизведения, и, таким образом, ниже будет описываться только блок потокового воспроизведения.

Фиг. 23 представляет собой структурную схему, на которой показан пример конфигурации блока потокового воспроизведения в системе обработки информации, в которой применено настоящее раскрываемое изобретение.

Компоненты, показанные на фиг. 23, которые являются одинаковыми с компонентами, показанными на фиг. 13, обозначены теми же самыми ссылочными позициями, и повторное объяснение опускается, когда это уместно.

Конфигурация блока (120) потокового воспроизведения, показанная на фиг. 23, отличается от конфигурации блока (90) потокового воспроизведения, показанной на фиг. 13, тем, что вместо блока (92) обработки MPD-файла, блока (97) обработки данных при синтезе аудиоданных и блока (101) обработки данных при синтезе изображения, соответственно, предусматриваются новые блок (121) обработки MPD-файла, блок (123) обработки данных при синтезе аудиоданных и блок (124) обработки данных при синтезе изображения, и дополнительно предусматривается блок (122) определения места расположения.

Блок (121) обработки MPD-файла, входящий в состав блока (120) потокового воспроизведения, извлекает из MPD-файла, подаваемого из блока (91) получения MPD-файла, информацию, такую как URL (Унифицированный указатель ресурса), которая описана в "Segment" ("Сегменте") для файла метаданных аудиоданных, и снабжает этой извлеченной информацией блок (93) получения файла метаданных. Кроме того, блок (121) обработки MPD-файла извлекает из MPD-файла информацию о размере кадра изображения видеоконтента (далее именуемую как информация о размере кадра изображения контента), которая описана в "AdaptationSet" ("АдатационномНаборе") для изображения, и снабжает этой извлеченной информацией блок (122) определения места расположения. Блок (121) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Сегменте" для файла аудиоданных, по всем объектам, и снабжает этой извлеченной информацией блок (95) получения файла аудиоданных.

Блок (121) обработки MPD-файла извлекает из MPD-файла информацию о месте расположения клеток, описанную в "AdaptationSet" ("АдаптационномНаборе") для изображения и снабжает этой извлеченной информацией блок (98) выбора изображения. Блок (121) обработки MPD-файла извлекает из MPD-файла информацию, такую как URL-указатель, которая описана в "Segment" ("Сегменте") для файла изображения клетки, запрашиваемой из блока (98) выбора изображения, и снабжает этой извлеченной информацией блок (98) выбора изображения.

Блок (122) определения места расположения получает информацию о месте расположения объектов, которая входит в состав файла метаданных аудиоданных, полученного блоком (93) получения файла метаданных, и информацию о размере кадра изображения контента, которая подается из блока (121) обработки MPD-файла. Кроме того, блок (122) определения места расположения получает информацию о размере кадра изображения области отображения, которая представляет собой информацию о размере кадра изображения области отображения, указанной пользователем. Блок (122) определения места расположения, основываясь на информации о месте расположения объектов, информации о размере кадра изображения контента и информации о размере кадра изображения области отображения определяет (распознает) место расположения каждого объекта в области отображения. Блок (122) определения места расположения сообщает это определенное место расположения каждого объекта блоку (123) обработки данных при синтезе аудиоданных.

Блок (97) обработки данных при синтезе аудиоданных синтезирует аудиоданные в секциях-объектах, подаваемые из блока (96) обработки данных при декодировании аудиоданных, основываясь на месте расположения объекта, сообщенном из блока (122) определения места расположения. В частности, блок (123) обработки данных при синтезе аудиоданных определяет аудиоданные, подлежащие распределению каждому громкоговорителю для каждого объекта на основе места расположения объекта и места расположения каждого громкоговорителя, который выводит звук. Блок (123) обработки данных при синтезе аудиоданных синтезирует аудиоданные каждого объекта для каждого громкоговорителя и выводит эти синтезированные аудиоданные в качестве аудиоданных для каждого громкоговорителя. Детализированное описание способа синтезирования аудиоданных каждого объекта на основе места расположения объекта раскрыто, например, в работе: Ville Pulkki, "Virtual Sound Source Positioning Using Vector Base Amplitude Panning", Journal of AES, vol. 45, no. 6, pp. 456.466, 1997 (Вилли Пулкки, "Виртуальное позиционирование источника звука с использованием амплитудного панорамирование на основе вектора", журнал Общества инженеров-звукотехников, том 45, номер 6, страницы 456-466, 1997 г.

Блок (124) обработки данных при синтезе изображения синтезирует данные изображения в секциях-клетках, подаваемые из блока (100) обработки данных при декодировании изображения. Блок (124) обработки данных при синтезе изображения функционирует в качестве преобразователя, и преобразует размер изображения, соответствующего синтезированным данным изображения, в размер видеоконтента для того, чтобы сгенерировать отображаемое изображение. Блок (124) обработки данных при синтезе изображения выводит это отображаемое изображение.

Объяснение способа определения места расположения объекта

Фиг. 24-26, представляют собой схемы, на каждой из которых проиллюстрирован способ определения места расположения объекта, выполняемый блоком (122) определения места расположения, показанным на фиг. 23.

Из видеоконтента извлекается область (31) отображения, и размер области (31) отображения преобразовывается к размеру видеоконтента, так, чтобы было сгенерировано отображаемое изображение (111). Таким образом, отображаемое изображение (111) имеет размер, эквивалентный размеру, полученному посредством сдвига центра (С) области (31) отображения в центр (С') отображаемого изображения (111), как это показано на фиг. 24, и посредством преобразования размера области (31) отображения к размеру видеоконтента, как это показано на фиг. 25.

Таким образом, блок (122) определения места расположения вычисляет, по нижеследующей Формуле (1), величину (θshift) сдвига в горизонтальном направлении, когда центр (О) области (31) отображения сдвигается в центр (О') отображаемого изображения (111).

Математическая формула 1

В Формуле (1),  представляет горизонтальный угол на левом краю области (31) отображения, входящий в состав информации о размере кадра изображения области отображения, а

представляет горизонтальный угол на левом краю области (31) отображения, входящий в состав информации о размере кадра изображения области отображения, а  представляет горизонтальный угол на правом конце области (31) отображения, входящий в состав информации о размере кадра изображения области отображения. Кроме того, θv1 представляет горизонтальный угол на левом краю в информации о размере кадра изображения контента, a θv2 представляет горизонтальный угол на правом краю в информации о размере кадра изображения контента.

представляет горизонтальный угол на правом конце области (31) отображения, входящий в состав информации о размере кадра изображения области отображения. Кроме того, θv1 представляет горизонтальный угол на левом краю в информации о размере кадра изображения контента, a θv2 представляет горизонтальный угол на правом краю в информации о размере кадра изображения контента.

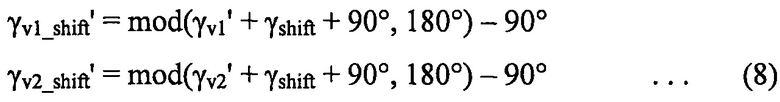

Затем, блок (122) определения места расположения вычисляет, по нижеследующей Формуле (2), горизонтальный угол  на левом краю области (31) отображения и горизонтальный угол

на левом краю области (31) отображения и горизонтальный угол  на правом ее краю после того, как центр (О) области (31) отображения был сдвинут в центр (О') отображаемого изображения (111) с использованием величины (θshift) сдвига. Математическая формула 2

на правом ее краю после того, как центр (О) области (31) отображения был сдвинут в центр (О') отображаемого изображения (111) с использованием величины (θshift) сдвига. Математическая формула 2

В соответствии с Формулой (2), горизонтальный угол  и горизонтальный угол

и горизонтальный угол  вычисляются таким образом, чтобы не выходить за рамки диапазона: от -180° до 180°.

вычисляются таким образом, чтобы не выходить за рамки диапазона: от -180° до 180°.

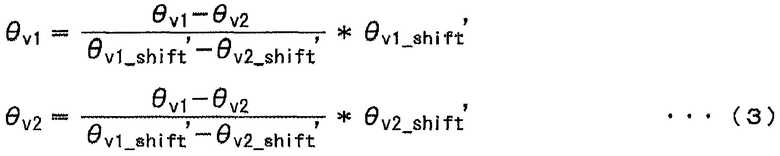

Отметим, что, как было описано выше, отображаемое изображение (111) имеет размер, эквивалентный размеру, полученному посредством сдвига центра (О) области (31) отображения в центр (О') отображаемого изображения (111) и посредством преобразования размера области (31) отображения к размеру видеоконтента. Таким образом, для горизонтальных углов θV1 и θV2 удовлетворяется нижеследующая Формула (3).

Математическая формула 3

Блок (122) определения места расположения вычисляет величину (θshift) сдвига, горизонтальный угол  и горизонтальный угол

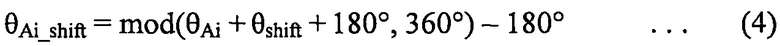

и горизонтальный угол  способом, который описан выше, и затем вычисляет горизонтальный угол каждого объекта на отображаемом изображении (111). В частности, блок (122) определения места расположения вычисляет, по нижеследующей Формуле (4), горизонтальный угол

способом, который описан выше, и затем вычисляет горизонтальный угол каждого объекта на отображаемом изображении (111). В частности, блок (122) определения места расположения вычисляет, по нижеследующей Формуле (4), горизонтальный угол