ОБЛАСТЬ ТЕХНИКИ, К КОТОРОЙ ОТНОСИТСЯ ИЗОБРЕТЕНИЕ

Данные раскрытие относится к хранению и транспортировке кодированных видеоданных.

УРОВЕНЬ ТЕХНИКИ

Возможности цифрового видео могут быть встроены в разнообразные устройства, включая цифровые телевизоры, системы непосредственного цифрового вещания, системы беспроводного вещания, персональные цифровые помощники (PDA), портативные или настольные компьютеры, цифровые камеры, цифровые записывающие устройства, цифровые медиапроигрыватели, видеоигровые устройства, видеоигровые приставки, сотовые или спутниковые радиотелефоны, устройства для видеотелеконференций и т.п. Цифровые видеоустройства осуществляют методы сжатия видео, такие как те, которые описаны в стандартах, определенных в MPEG-2, MPEG-4, ITU-T H.263 или ITU-T H.264/MPEG-4, Part 10, усовершенствованное видеокодирование (AVC) и расширениях таких стандартов, для более эффективной передачи и приема цифровой видеоинформации.

Методы сжатия видео выполняют пространственное предсказание и/или временное предсказание для уменьшения или удаления избыточности, присущей видеопоследовательностям. Для видеокодирования на основе блоков видеокадр или слайс может разделяться на макроблоки. Каждый макроблок может дополнительно разделяться. Макроблоки во внутренне кодированном (I) кадре или слайсе кодируются с использованием пространственного предсказания в отношении соседних макроблоков. Макроблоки во внешне кодированном (P или B) кадре или слайсе могут использовать пространственное предсказание в отношении соседних макроблоков в этом же кадре или слайсе или временное предсказание в отношении других опорных кадров.

После того как видеоданные будут кодированы, видеоданные могут пакетироваться для передачи или хранения. Видеоданные могут собираться в видеофайл, соответствующий любому из многочисленных стандартов, такому как базовый формат медиафайлов Международной организации по стандартизации (ISO) и его расширений, такого как AVC.

Были предприняты попытки разработать новые стандарты видеокодирования, основанные на H.264/AVC. Одним таким стандартом является стандарт масштабируемого видеокодирования (SVC), который представляет собой масштабируемое расширение H.264/AVC. Другим стандартом является многовидовое видеокодирование (MVC), которое становится многовидовым расширением H.264/AVC. Совместный проект MVC описан в JVT-AB204, «Joint Draft 8.0 on Multiview Video Coding,» 28th JVT meeting, Hannover, Germany, July 2008, доступном по адресу http://wftp3.itu.int/av-arch/jvt-site/2008_07_Hannover/JVT-AB204.zip. Версия, встроенная в стандарт AVC, описана в JVT-AD007, «Editors' draft revision to ITU-T Rec. H.264 | ISO/IEC 14496-10 Advanced Video Coding - in preparation for ITU-T SG 16 AAP Consent (in integrated form)», 30th JVT meeting, Geneva, CH, Feb. 2009, доступном по адресу http://wftp3.itu.int/av-arch/jvt-site/2009_01_Geneva/JVT-AD007.zip.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

В общем, данное раскрытие описывает методы для создания фрагментов субтрека видеофайлов для поддержки потоковой передачи видеоданных. Вместо организации кодированных видеоизображений во фрагменте видео видеофайла в порядке декодирования, методы данного раскрытия включают в себя размещение кодированных видеоизображений в порядке, соответствующем иерархическому уровню или слою, к которому принадлежат кодированные изображения. Каждый иерархический слой внутри фрагмента видео может соответствовать соответствующему фрагменту субтрека. Т.е. каждый фрагмент субтрека может включать в себя все кодированные видеоизображения соответствующего иерархического слоя для конкретного фрагмента фильма в непрерывном байтовом диапазоне фрагмента фильма. Видеоизображения во фрагменте субтрека могут по-прежнему следовать порядку декодирования. Таким образом, устройство назначения может представить единственный запрос на извлечение всех изображений фрагмента субтрека фрагмента фильма. В контексте видеофайла и транспортировки инкапсулированные кодированные видеоизображения также могут упоминаться как сэмплы видео.

В одном примере способ включает в себя сборку кодированных видеоданных в множество фрагментов субтрека, причем каждый из фрагментов субтрека содержит множество иерархически связанных видеоизображений кодированных видеоданных, причем каждое из множества иерархически связанных видеоизображений соответствует общему иерархическому слою, прием запроса в соответствии с протоколом потоковой передачи, причем запрос задает по меньшей мере один из множества фрагментов субтрека, и, в ответ на запрос, вывод множества иерархически связанных видеоизображений по меньшей мере одного из множества фрагментов субтрека.

В другом примере устройство включает в себя интерфейс, выполненный с возможностью вывода данных в соответствии с протоколом потоковой передачи, и блок управления, выполненный с возможностью сборки кодированных видеоданных в множество фрагментов субтрека, причем каждый из фрагментов субтрека содержит множество иерархически связанных видеоизображений кодированных видеоданных, причем каждое из множества иерархически связанных видеоизображений соответствует общему иерархическому слою, приема запроса в соответствии с протоколом потоковой передачи, причем запрос задает по меньшей мере один из множества фрагментов субтрека, и, в ответ на запрос, предписания интерфейсу выводить множество иерархически связанных видеоизображений по меньшей мере одного из множества фрагментов субтрека.

В другом примере устройство включает в себя средство для сборки кодированных видеоданных в множество фрагментов субтрека, причем каждый из фрагментов субтрека содержит множество иерархически связанных видеоизображений кодированных видеоданных, причем каждое из множества иерархически связанных видеоизображений соответствует общему иерархическому уровню, средство для приема запроса в соответствии с протоколом потоковой передачи, причем запрос задает по меньшей мере один из множества фрагментов субтрека, и средство для вывода множества иерархически связанных видеоизображений по меньшей мере одного из множества фрагментов субтрека в ответ на запрос.

В другом примере компьютерный программный продукт включает в себя считываемый компьютером запоминающий носитель, который содержит инструкции, которые, при исполнении, предписывают процессору устройства источника собирать кодированные видеоданные в множество фрагментов субтрека, причем каждый из фрагментов субтрека содержит множество иерархически связанных видеоизображений кодированных видеоданных, причем каждое из множества иерархически связанных видеоизображений соответствует общему иерархическому слою, принимать запрос в соответствии с протоколом потоковой передачи, причем запрос задает по меньшей мере один из множества фрагментов субтрека, и, в ответ на запрос, выводить множество иерархически связанных видеоизображений по меньшей мере одного из множества фрагментов субтрека.

В другом примере способ включает в себя прием информации от устройства источника, которая описывает иерархические уровни видеоданных для фрагмента фильма, и определение поднабора иерархических уровней видеоданных для запроса. Для каждого из иерархических уровней поднабора способ включает в себя посылку не более одного запроса на устройство источника на извлечение всех видеоданных фрагмента фильма на иерархическом уровне. Способ дополнительно включает в себя прием видеоданных определенного поднабора иерархических уровней и декодирование и отображение принятых видеоданных.

В другом примере устройство включает в себя интерфейс, выполненный с возможностью приема информации от устройства источника, которая описывает иерархические уровни видеоданных для фрагмента фильма; и блок управления, выполненный с возможностью определения поднабора иерархических уровней видеоданных для запроса, причем для каждого из иерархических уровней поднабора блок управления выполнен с возможностью посылки не более одного запроса на устройство источника на извлечение всех видеоданных фрагмента фильма на иерархическом уровне. Интерфейс дополнительно выполнен с возможностью приема видеоданных определенного поднабора иерархических уровней в ответ на запросы.

В другом примере устройство включает в себя средство для приема информации от устройства источника, которая описывает иерархические уровни видеоданных для фрагмента фильма, средство для определения поднабора иерархических уровней видеоданных для запроса, средство для посылки, для каждого из иерархических уровней поднабора, не более одного запроса на устройство источника для извлечения всех видеоданных фрагмента фильма на иерархическом уровне, средство для приема видеоданных определенного поднабора иерархических уровней и средство для декодирования и отображения принятых видеоданных.

В другом примере компьютерный программный продукт включает в себя считываемый компьютером запоминающий носитель, содержащий инструкции, которые предписывают процессору устройства назначения принимать информацию от устройства источника, которая описывает иерархические уровни видеоданных для фрагмента фильма, определять поднабор иерархических уровней видеоданных для запроса для каждого из иерархических уровней поднабора, посылать не более одного запроса на устройство источника на извлечение всех видеоданных фрагмента фильма на иерархическом уровне, принимать видеоданные определенного поднабора иерархических уровней, и декодировать и отображать принятые видеоданные.

Подробности одного или более примеров излагаются на прилагаемых чертежах и в описании ниже. Другие признаки, задачи и преимущества станут понятны из описания и чертежей, и из формулы изобретения.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

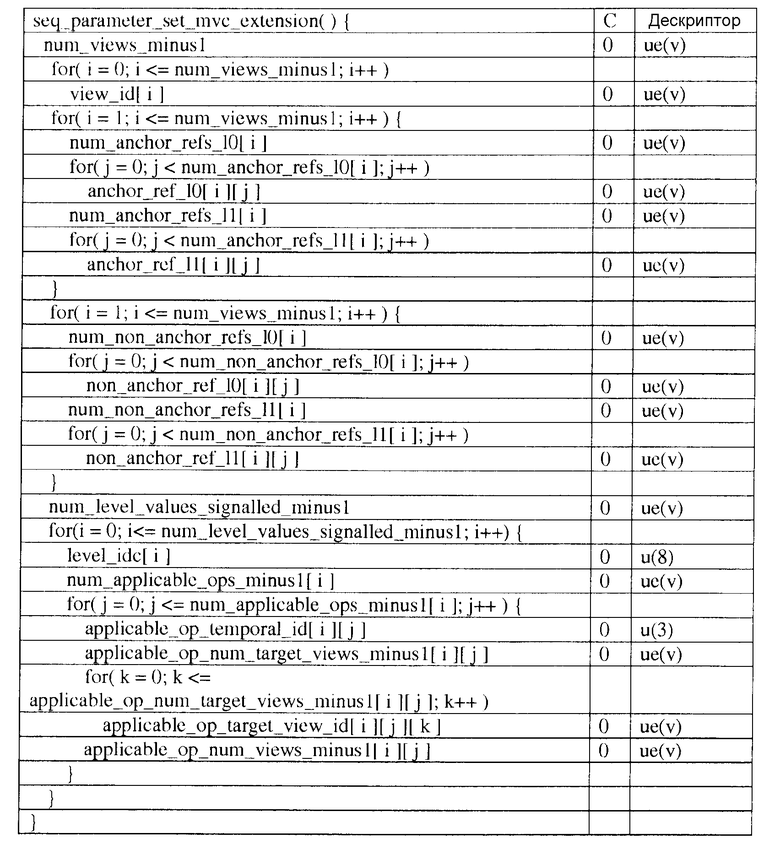

Фиг.1 представляет собой блок-схему, иллюстрирующую примерную систему, в которой устройство источника аудио/видео (A/V) посылает аудио- и видеоданные на устройство назначения A/V.

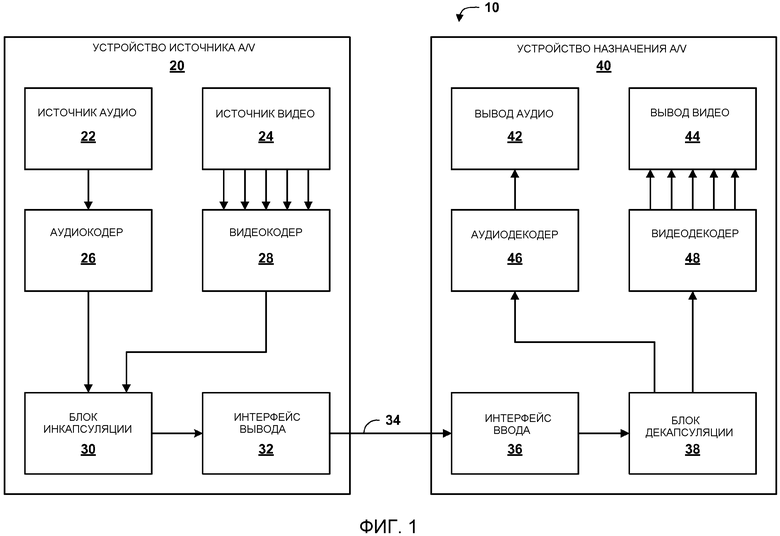

Фиг.2 представляет собой блок-схему, иллюстрирующую компоненты примерного блока инкапсуляции.

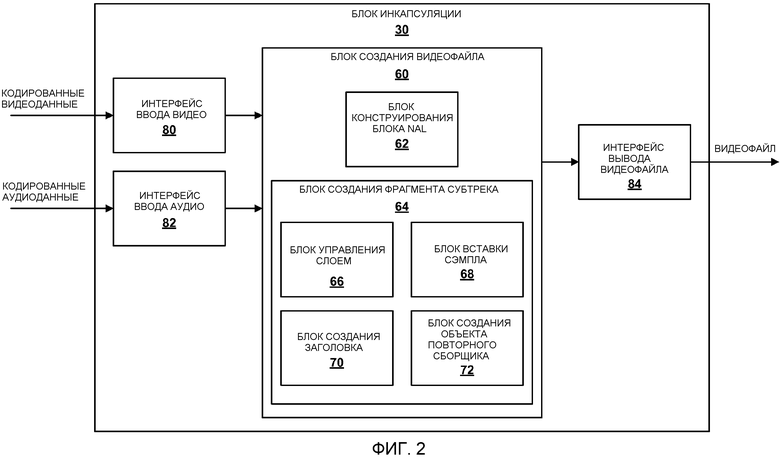

Фиг.3 представляет собой блок-схему, иллюстрирующую элементы примерного видеофайла, имеющего фрагменты видео, причем каждый включает в себя фрагменты субтрека, имеющие кодированные видеоизображения общего иерархического уровня.

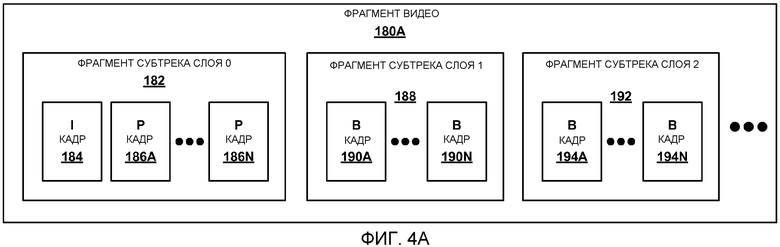

Фиг.4A представляет собой блок-схему, иллюстрирующую примерный фрагмент фильма.

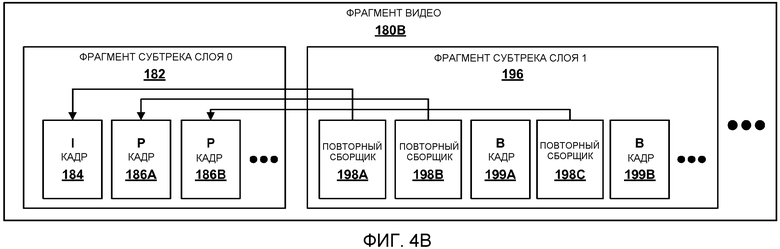

Фиг.4B представляет собой блок-схему, иллюстрирующую примерный фрагмент фильма, который включает в себя объекты повторного сборщика.

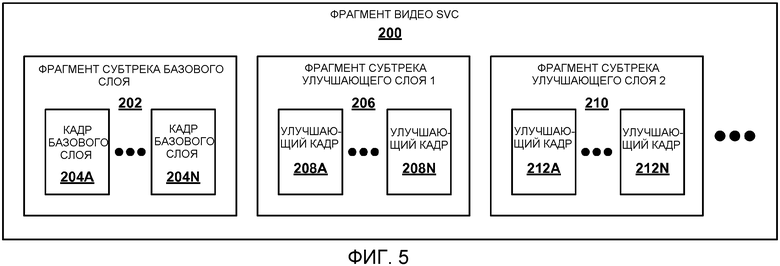

Фиг.5 представляет собой блок-схему, иллюстрирующую примерный фрагмент видео SVC, включающий в себя видеоизображения, организованные в соответствии с иерархическими слоями.

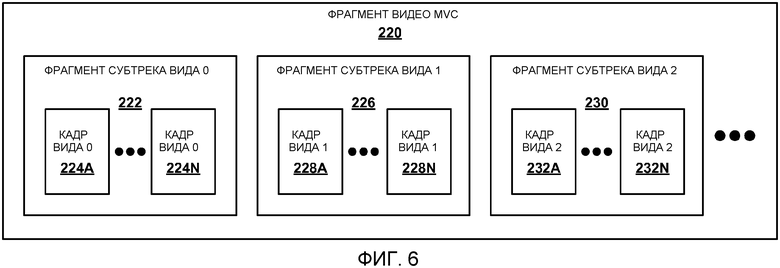

Фиг.6 представляет собой блок-схему, иллюстрирующую примерный фрагмент видео MVC, включающий в себя видеоизображения, организованные в соответствии с иерархическими слоями.

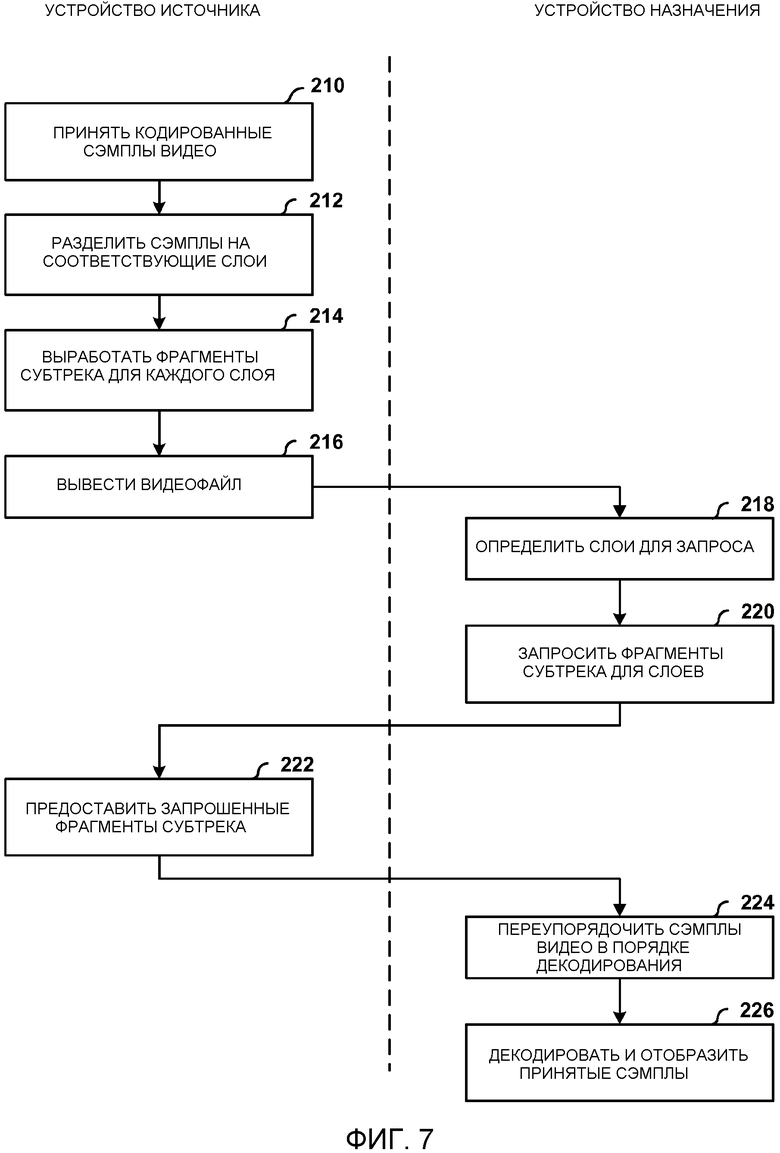

Фиг.7 представляет собой блок-схему последовательности операций, иллюстрирующую примерный способ инкапсуляции видеоданных общих иерархических уровней в соответствующих фрагментах субтрека фрагмента фильма в видеофайле и передачи видеофайла от устройства источника на устройство назначения.

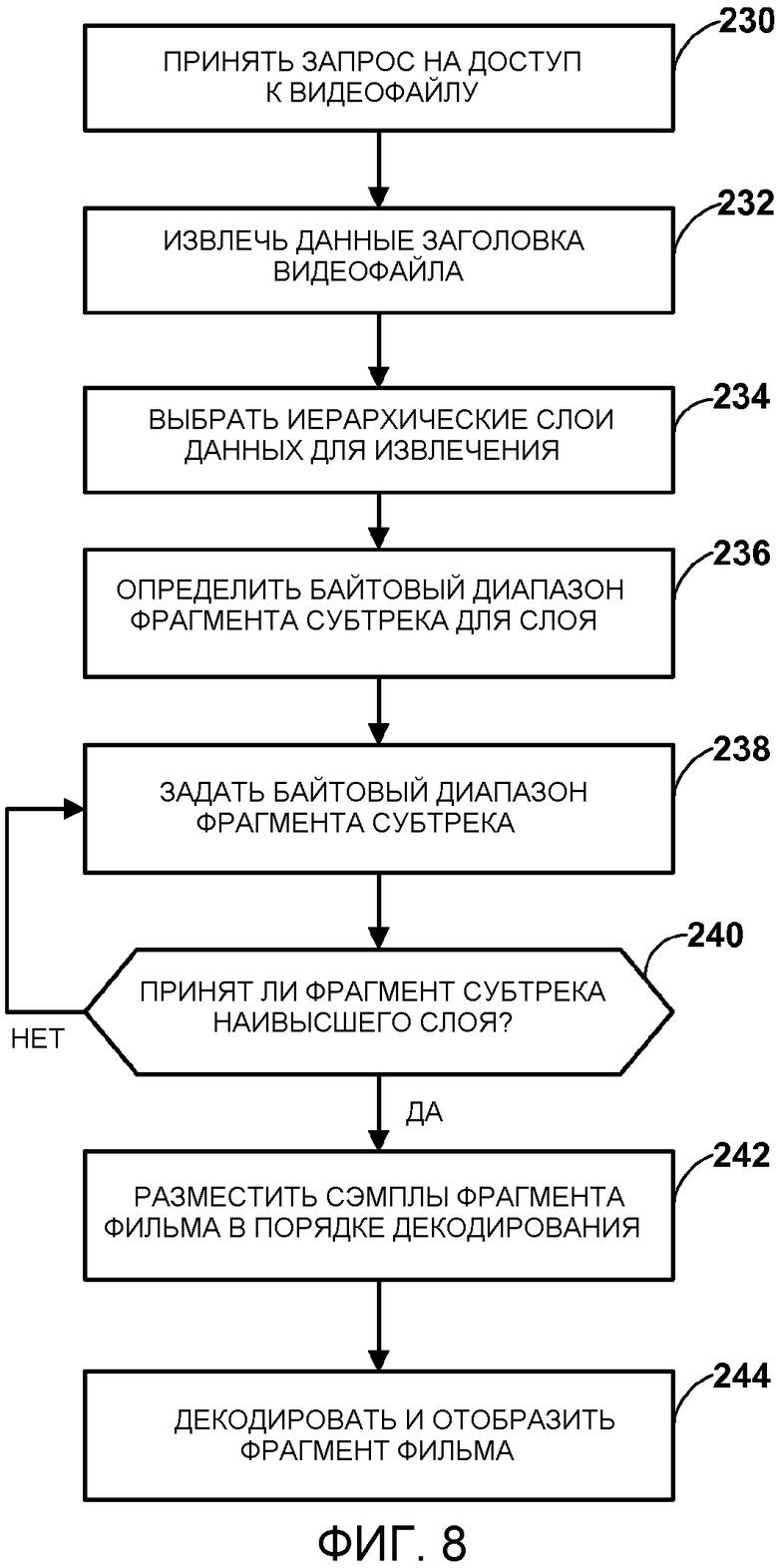

Фиг.8 представляет собой блок-схему последовательности операций, иллюстрирующую примерный способ извлечения фрагментов субтрека фрагмента фильма с использованием протокола потоковой передачи.

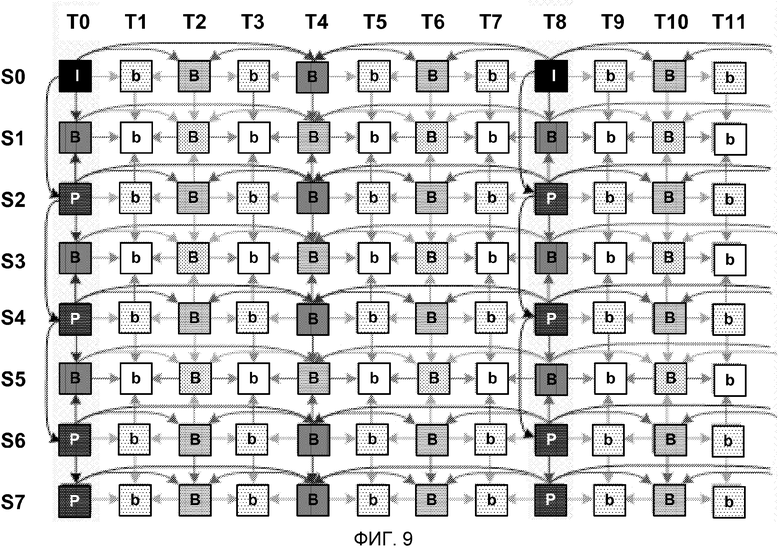

Фиг.9 представляет собой схему концептуального представления, иллюстрирующую примерный шаблон предсказания MVC.

ПОДРОБНОЕ ОПИСАНИЕ

В общем, данное раскрытие описывает методы для размещения фрагментов субтрека (субдорожки) видеофайлов для поддержки потоковой передачи видеоданных. В частности, кодированные видеоизображения фрагмента трека (дорожки) могут размещаться в соответствии с иерархическим слоем, к которому принадлежат кодированные видеоизображения. В данном раскрытии, кодированные видеоизображения также могут упоминаться как кодированные сэмплы (выборки) видео, или просто как «сэмплы» или «изображения». Таким образом, кодированные видеоизображения общего слоя могут размещаться рядом в видеофайле. Следовательно, устройство назначения может извлекать кодированные изображения конкретного иерархического слоя во фрагменте фильма, используя единственный запрос. Для примера потоковой передачи протокола передачи гипертекста (HTTP), единственный запрос может содержать запрос частичного GET HTTP, задающий байтовый диапазон кодированных видеоизображений до требуемого иерархического слоя.

Фрагмент трека может представлять собой фрагмент представления видео базового формата медиафайлов ISO или фрагмент системного потока MPEG-2, который может быть любого вида из следующих: пакетированный элементарный поток (PES), программный поток (PS) или транспортный поток (TS). В транспортном потоке (TS) MPEG-2 пакеты, соответствующие блокам доступа, обычно упорядочиваются по порядку декодирования. Блок доступа может сегментироваться на многочисленные транспортные пакеты в потоке TS. В случае, если фрагмент трека определяется как непрерывная часть системного потока MPEG-2, фрагмент трека может быть представлен как файловый блок, например, файл или сегмент файла. Методы данного раскрытия могут включать в себя переупорядочение блока доступа во фрагменте в несколько фрагментов субтрека, каждый из которых может соответствовать соответствующему иерархическому слою блоков доступа (кодированных изображений), так что и кодированные изображения общего иерархического слоя представляются непрерывно в части потока. Фрагменты субтрека во фрагменте трека могут размещаться в соответствии с порядком декодирования. Таким образом, кодированные видеоизображения общего слоя могут размещаться рядом в видеофайле. Следовательно, устройство назначения может извлекать все кодированные изображения до конкретного иерархического слоя во фрагменте фильма, используя единственный запрос, например, запрос частичного GET HTTP, задающий байтовый диапазон кодированных видеоизображений до требуемого иерархического слоя.

В качестве примера, формат файлов усовершенствованного видеокодирования (AVC) определяет, что кодированные видеоизображения размещаются в порядке декодирования в любом фрагменте трека или фрагменте фильма. Группа изображений (GOP) может иметь некоторое количество изображений, кодированных с использованием различных схем предсказания, например, внутреннее предсказание (I-изображения) и внешнее предсказание (P-изображения и B-изображения). I-изображения могут кодироваться без ссылки на другие изображения, P-изображения могут кодироваться относительно одного или более опорных изображений в одном направлении, и B-изображения могут кодироваться относительно одного или более изображения в обоих направлениях (вперед и назад в видеопоследовательности).

Внешне кодированное изображение может иметь иерархический уровень, равный или больший иерархического уровня опорного изображения для внешне кодированного изображения. Примерная последовательность изображений в порядке отображения может быть I0B3B2B3B1B3B2B3P0, где буква обозначает тип кодирования для каждого изображения, и номер, в данном случае, обозначает иерархический уровень, которому соответствует изображение. Предположим с целью иллюстрации, что каждое изображение ассоциируется с числовым указателем, соответствующим позиции изображения в порядке отображения. Как указано выше, примерная последовательность расставляется в порядке отображения. Чтобы декодировать изображение, кодированное с внешним предсказанием, сначала может декодироваться опорное изображение для кодированного изображения. Таблица 1 ниже приводит примерный порядок декодирования для данной примерной последовательности, где число нижнего индекса ссылается на порядок отображения изображения:

Следовательно, обычное устройство источника может размещать данную примерную последовательность кодированных изображений в соответствии с их порядком декодирования. Обычно, изображения внутри GOP (в примере таблицы 1 размер GOP равен 4) с одинаковым временным иерархическим уровнем могут отделяться от изображений в других GOP этого же иерархического уровня. Например, B2 и B6 оба представляют собой изображения временного иерархического уровня 1 в примере таблицы 1, но разделяться изображениями с другими временными уровнями, если будут размещены в порядке декодирования. Даже изображения с одним и тем же временным уровнем в одной GOP могут разделяться изображениями с разными временными уровнями. Предположим в отношении фрагмента, который содержит, например, 10 GOP, что изображения с идентичным временным уровнем могут распределяться в этом фрагменте как многочисленные отдельные экземпляры.

Методы данного раскрытия, с другой стороны, обеспечивают упорядочение в отношении иерархического уровня последовательности кодированных изображений. В качестве примера, устройство источника согласно методам данного раскрытия может размещать примерную последовательность выше так, как показано в таблице 2:

Таким образом, кодированные видеоизображения в последовательности могут размещаться согласно иерархическому уровню во фрагменте видеофайла. Т.е. изображения общего иерархического уровня во фрагменте могут группироваться вместе рядом во фрагменте. Каждый фрагмент субтрека (соответствующий конкретному иерархическому уровню) может доставляться на устройство в ответ на единственный запрос. Таким образом, устройство назначения может выдавать единственный запрос на извлечение изображений до конкретного иерархического уровня. Байтовый диапазон каждого фрагмента субтрека может передаваться на устройство назначения перед тем, как будут запрошены любые видеоизображения, так что устройство назначения может формировать запрос для одного или более иерархических уровней.

Например, устройство назначения может быть выполнено с возможностью извлечения изображений до иерархического уровня один, который может соответствовать двум фрагментам субтрека: 0 и 1. Устройство назначения может выдавать запрос, основанный на байтовых диапазонах фрагментов субтрека 0 и 1. В ответ на этот примерный запрос устройство источника может предоставить изображения во фрагменте 0 и 1 субтрека, имеющем порядок отображения 0, 8, 4, 2, 6 и т.д.

Посредством упорядочения изображений в соответствии с иерархическим уровнем устройство источника может упрощать процесс, посредством которого устройство назначения может извлекать кодированные видеоизображения общего иерархического уровня. Устройству назначения нет необходимости, например, определять расположения каждого из изображений, соответствующих требуемому иерархическому уровню, и индивидуально выдавать многочисленные запросы на такие изображения, но, вместо этого, может представить единственный запрос на извлечение только изображений до требуемого иерархического уровня.

При приеме фрагментов субтрека, основываясь на сигнализации во фрагментах субтрека, устройство назначения может переупорядочить принятые видеоизображения до иерархического уровня, образуя правильный порядок декодирования, перед посылкой видеоизображений на видеодекодер. Кроме того, информация, описывающая иерархию каждого фрагмента субтрека может сигнализироваться, например, временная масштабируемость, частота кадров и скорость воспроизведения при использовании в качестве ускоренной перемотки вперед.

Устройство назначения может быть выполнено с возможностью извлечения изображений только до конкретного иерархического уровня по многочисленным причинам. Например, устройство назначения может поддерживать максимальную частоту кадров, которая меньше максимальной доступной частоты кадров видеофайла. В качестве другого примера, устройство назначения может поддерживать «режим спецэффектов», такой как воспроизведение с ускоренной перемоткой вперед со скоростью в два раза больше, четыре раза больше, восемь раз больше или с другой скоростью, кратной нормальной скорости воспроизведения. Таким образом, методы данного раскрытия могут поддерживать временную масштабируемость.

Методы данного раскрытия могут применяться к видеофайлам, соответствующим любому из базового формата медиафайлов ISO, формата файлов усовершенствованного видеокодирования (AVC), формата файлов Проекта партнерства по созданию системы третьего поколения (3GPP), формата файлов масштабируемого видеокодирования (SVC) и/или формата файлов многовидового видеокодирования (MVC), или других подобных форматов видеофайлов. Кроме того, иерархический уровень может представлять собой любой иерархический уровень в соответствии с этими или другими форматами видеофайлов. Например, что касается SVC, иерархические уровни могут соответствовать различным слоям кодирования, например, базовому слою и одному или более улучшающим слоям. В качестве другого примера, что касается MVC, иерархические уровни могут соответствовать различным видам.

Базовый формат медиафайлов ISO разработан для того, чтобы содержать информацию о временных медиа для представления в гибком, расширяемом формате, который способствует обмену, управлению, редактированию и представлению медиа. Базовый формат медиафайлов ISO (ISO/IEC 14496-12:2004) определен в MPEG-4 Part-12, который определяет общую структуру для основанных на времени медиафайлов. Он используется в качестве основы для других форматов файлов в семействе, таких как формат файлов AVC (ISO/IEC 14496-15), который определяет поддержку сжатия видео H.264/MPEG-4 AVC, формат файлов 3GPP, формат файлов SVC и формат файлов MVC. Формат файлов 3GPP и формат файлов MVC представляют собой расширения формата файлов AVC. Базовый формат медиафайлов ISO содержит временную информацию, информацию о структуре и медиа для временных последовательностей медиаданных, таких как аудиовизуальные представления. Структура файлов может быть объектно-ориентированной. Файл может быть разбит на базовые объекты очень просто, и структура объектов предполагается из их типа.

В примерах MPEG-1 и MPEG-2 B-кодированные изображения обеспечивают естественную временную масштабируемость. Трек видеофайла, соответствующего MPEG-1 или MPEG-2, может включать в себя полный набор I-кодированных изображений, P-кодированных изображений и B-кодированных изображений. Отбрасывая B-кодированные изображения, видеофайл может получать соответствующие представления видео с половинным разрешением. MPEG-1 и MPEG-2 также обеспечивают понятие базового слоя и улучшающего слоя для кодирования двух временных слоев, причем изображения улучшающего слоя могут выбирать для каждого направления предсказания изображение или из базового слоя, или из улучшающего слоя в качестве опорного. Следовательно, устройство назначения может запрашивать, и устройство источника может обеспечивать, меньшее количество кодированных изображений, чем полный набор I-, P- и B-кодированных изображений, включенных в видеофайл. Видеоданные, представляемые устройством источника на устройство назначения, тем не менее, могут соответствовать MPEG-1 и MPEG-2 и могут иметь половинное (или меньшее) разрешение кроме исходного, полного набора кодированных изображений.

В качестве другого примера, H.264/AVC использует иерархические B-кодированные изображения для поддержки временной масштабируемости. Первое изображение видеопоследовательности в H.264/AVC может упоминаться как изображение мгновенного обновления декодера (IDR), также известное как ключевое изображение. Ключевые изображения обычно кодируются в регулярных или нерегулярных интервалах, которые являются или внутренне кодированными, или внешне кодированными, с использованием предыдущего ключевого изображения в качестве опорного для предсказания с компенсацией движения. Группа изображений (GOP) обычно включает в себя ключевое изображение и все изображения, которые временно располагаются между ключевым изображением и предыдущим ключевым изображением. GOP может быть разделена на две части, одна представляет собой ключевое изображение, и другая включает в себя неключевые изображения. Неключевые изображения иерархически предсказываются посредством 2 опорных изображений, которыми являются ближайшие изображения более низкого временного уровня из прошлого и будущего времени.

Значение временного идентификатора может назначаться каждому изображению для указания иерархического положения изображения, т.е. иерархического слоя, которому соответствует изображение. Таким образом, изображения со значениями временного идентификатора до N могут образовывать сегмент видео с частотой кадров, которая в два раза больше частоты сегмента видео, образованного изображениями со значениями временного идентификатора до N-1. Следовательно, методы данного раскрытия также могут использоваться для достижения временной масштабируемости в H.264/AVC посредством размещения кодированных видеоизображений во фрагменты субтрека, так что устройство назначения может запрашивать один или более фрагментов субтрека, но может запрашивать меньшее количество, чем полный набор фрагментов субтрека фрагмента фильма. Т.е. устройство назначения может запрашивать фрагменты субтрека, имеющие временные идентификаторы, меньшие или равные N.

Файлы, соответствующие базовому формату медиафайлов ISO (и их расширениям), могут быть образованы в виде последовательностей объектов, называемых «боксами». Данные в базовом формате медиафайлов ISO содержатся в боксах, так что нет необходимости другим данным содержаться в файле вне боксов. Он включает в себя любую начальную сигнатуру, требуемую конкретным форматом файлов. «Бокс» может представлять собой объектно-ориентированный стандартный блок, определенный уникальным идентификатором типа и длиной. Обычно, представление содержится в одном файле, и представление медиа является автономным. Контейнер фильма (бокс фильма) может содержать метаданные медиа, и кадры видео и аудио могут содержаться в контейнере медиаданных и могут быть в других файлах.

Представление (последовательность движения) может содержаться в нескольких файлах. Временная информация и информация о формировании кадров (положение и размер), в основном, находятся в базовом медиафайле ISO, и вспомогательные файлы могут, по существу, использовать любой формат. Это представление может быть «локальным» для системы, содержащей представление, или может предоставляться при помощи сети или другого механизма доставки потока.

Файлы могут иметь логическую структуру, временную структуру и физическую структуру, и не требуется, чтобы эти структуры были связаны. Логическая структура файла может быть фильма, который, в свою очередь, содержит набор параллельных во времени треков. Временная структура файла может быть такой, что треки содержат последовательности изображений во времени, и эти последовательности отображаются на временную шкалу всего фильма необязательными монтажными листами. Физическая структура файла может отделять данные, необходимые для логического, временного и структурного разбиения, от самих сэмплов медиаданных. Эта структурная информация может концентрироваться в боксе фильма, возможно расширенном во времени посредством боксов фрагментов фильма. Бокс фильма может документировать логические и временные зависимости сэмплов и также может содержать указатели на то, где они расположены. Эти указатели могут быть на этот же файл или другой, например, могут ссылаться посредством унифицированного указателя ресурса (URL).

Каждый медиапоток может содержаться в треке, специализированном для этого типа медиа (аудио, видео и т.д.) и может дополнительно параметризоваться элементом сэмпла. Элемент сэмпла может содержать «имя» точного типа медиа (тип декодера, необходимый для декодирования потока) и любую параметризацию этого необходимого декодера. Имя также может принимать вид четырехсимвольного кода, например, «moov» или «trak». Определяются форматы элементов сэмпла не только для медиа MPEG-4, но также для типов медиа, используемых другими организациями, использующими это семейство форматов файлов.

Поддержка метаданных, в основном, принимает два вида. Во-первых, временные метаданные могут храниться в соответствующем треке, синхронизироваться, когда требуется, с медиаданными, которые они описывают. Во-вторых, может быть общая поддержка невременных метаданных, присоединяемых к фильму или к индивидуальному треку. Структурная поддержка является общей и позволяет, как в медиаданных, выполнять хранение ресурсов метаданных где-то в другом месте в файле или в другом файле. Кроме того, эти ресурсы могут именоваться и могут защищаться.

В базовом формате медиафайлов ISO группирование сэмплов представляет собой назначение каждого из сэмплов в треке членом одной группы сэмплов. Не требуется, чтобы сэмплы в группе сэмплов были рядом. Например, при представлении H.264/AVC в формате файлов AVC сэмплы видео на одном временном уровне могут отбираться в одну группу сэмплов. Группы сэмплов могут представляться двумя структурами данных: боксом SampleToGroup (sbdp) и боксом SampleGroupDescription. Бокс SampleToGroup представляет назначение сэмплов группам сэмплов. Может быть один экземпляр бокса SampleGroupDescription для каждого элемента группы сэмплов для описания свойств соответствующей группы.

Необязательный трек метаданных может использоваться для пометки каждого трека «интересующей характеристикой», которую он имеет, для которой его значение может отличаться от других членов группы (например, его скорость передачи битов, размер экрана или язык). Некоторые сэмплы в треке могут иметь специальные характеристики или могут идентифицироваться индивидуально. Одним примером характеристики является точка синхронизации (часто I-кадр видео). Эти точки могут идентифицироваться специальной таблицей в каждом треке. Обычно, сущность зависимостей между сэмплами трека также может документироваться с использованием метаданных. Метаданные могут структурироваться в виде последовательности сэмплов формата файлов, как трек видео. Такой трек может упоминаться как трек метаданных. Каждый сэмпл метаданных может структурироваться как оператор метаданных. Имеются различные виды оператора, соответствующие различным вопросам, которые могут быть заданы о соответствующем сэмпле формата файла или его составляющих сэмплов.

Когда медиа доставляется по протоколу потоковой передачи, может потребоваться преобразование медиа из того вида, в котором оно представлено в файле. Одним примером этого является то, когда медиа передается по протоколу реального времени (RTP). В файле, например, каждый кадр видео хранится рядом в виде сэмпла формата файла. В RTP правила пакетирования, характерные для используемого кодека, должны подчиняться размещению этих кадров в пакетах RTP. Сервер потоковой передачи может быть выполнен с возможностью вычисления динамически такого пакетирования. Однако имеется поддержка содействию серверов потоковой передачи. Специальные треки, называемые треками подсказок, могут размещаться в файлах.

Треки подсказок содержат общие инструкции для серверов потоковой передачи в отношении того, как формировать потоки пакетов из треков медиа для конкретного протокола. Так как форма этих инструкций является независимой от медиа, может не потребоваться модифицирование серверов, когда вводятся новые кодеки. Кроме того, программное обеспечение кодирования и редактирования может не иметь сведений о серверах потоковой передачи. Если редактирование закончено над файлом, часть программного обеспечения, называемая подсказчиком, может использоваться для добавления треков подсказок к файлу перед размещением его на сервере потоковой передачи. В качестве примера, имеется определенный формат трека подсказок для потоков RTP в спецификации формата файлов MP4.

3GP (формат файлов 3GPP) представляет собой формат мультимедийного контейнера, определенный Проектом партнерства по созданию системы 3-го поколения (3GPP) для мультимедийных услуг универсальной системы мобильной связи (UMTS) третьего поколения (3G). Он обычно используется на мобильных телефонах 3G и других устройствах с возможностями 3G, но также может воспроизводиться на некоторых телефонах и устройствах 2G и 4G. Формат файлов 3GPP основывается на базовом формате медиафайлов ISO. Самый последний 3GP определяется в 3GPP TS26.244 «Transparent end-to-end packet switched streaming service (PSS); 3GPP file format (3GP)». Формат файлов 3GPP хранит видеопотоки в виде MPEG-4 Part 2, или H.263, или MPEG-4 Part 10 (AVC/H.264). 3GPP позволяет использовать кодеки AMR и H.263 в базовом формате медиафайлов ISO (MPEG-4 Part 12), так как 3GPP определяет использование полей Элемент сэмпла и полей шаблона в базовом формате медиафайлов ISO, а также определяет новые боксы, на которые ссылаются кодеки. Для хранения характерной для медиа MPEG-4 информации в файлах 3GP, спецификация 3GP ссылается на формат файлов MP4 и AVC, которые также основываются на базовом формате медиафайлов ISO. Спецификации форматов файлов MP4 и AVC описывают использование контента MPEG-4 в базовом формате медиафайлов ISO.

Спецификация базового формата медиафайлов ISO определяет альтернативную группу треков. Альтернативная группа включает в себя поднабор всех доступных треков, и каждый трек может соответствовать одной альтернативной группе. В общем, устройство назначения может выбирать один трек из каждой альтернативной группы за исключением других треков в альтернативных группах. Спецификация формата файлов 3GPP определяет группу переключения треков, которая подобна альтернативной группе. Во время потоковой передачи загрузки и воспроизведения устройство назначения может переключать между разными треками группы переключения. Т.е. треки в одной и той же группе переключения доступны для переключения во время сеанса, тогда как треки в разных группах переключения обычно недоступны для переключения.

Формат файлов SVC, как расширение формата файлов AVC, обеспечивает структуры экстрактора и слоя. Экстракторы представляют собой указатели, которые предоставляют информацию о положении и размере данных видеокодирования в сэмпле с равным временем декодирования в другом треке. Это позволяет составлять иерархию трека непосредственно в области кодирования. Трек экстрактора в SVC связан с одним или более базовыми треками, из которых он извлекает данные во время выполнения. Экстрактор представляет собой указатель с возможностью отмены ссылки с заголовком блока NAL с расширениями SVC. Если трек, используемый для извлечения, содержит данные видеокодирования с другой частотой кадров, тогда экстрактор также содержит смещение времени декодирования, чтобы обеспечить синхронность между треками. Во время выполнения экстрактор должен быть заменен данными, на которые он указывает, перед тем как поток будет передан на видеодекодер.

Так как треки экстрактора в SVC структурируются подобно треками видеокодирования, они могут представлять поднабор, который им нужен, разным образом. Трек экстрактора SVC содержит только инструкции о том, как извлечь данные с другого трека. В формате файлов SVC имеются также агрегаторы, которые могут агрегировать блок NAL в сэмпле вместе как один блок NAL, включая агрегирование блоков NAL в одном слое в агрегатор. Экстрактор в SVC разработан для извлечения некоторого диапазона байтов из сэмпла или агрегатора, или просто одного целого блока NAL, но не многочисленных блоков NAL, особенно тех, которые не являются последовательными в сэмпле. В формате файлов SVC могут быть многочисленные рабочие точки видео. Слои разработаны для группирования сэмплов в одном или более треках для рабочей точки.

Формат файлов MVC также поддерживает трек экстрактора, который извлекает блоки NAL из разных видов, образуя рабочую точку, которая представляет собой поднабор видов с некоторой частотой кадров. Конструкция трека экстрактора MVC аналогична экстрактору в формате файлов SVC. Однако не поддерживается использование треков экстрактора MVC для формирования альтернативной группы. Для поддержки выбора треков предлагается следующее предложение MPEG для MPEG: P. Frojdh, A. Norkin, and C. Priddle, «File format sub-track selection and switching,» ISO/IEC JTC1/SC29/WG11 MPEG M16665, London UK. Это предложение пытается сделать возможным принцип альтернативной группы / группы переключения на уровне субтрека.

Группа сэмплов отображения представляет собой расширение для группы сэмплов. В группе сэмплов отображения каждый элемент группы (сэмплов) имеет свое описание «groupID» (идентификатор группы), которое фактически представляет собой отображение на view_id (идентификатор вида), после возможного агрегирования блоков NAL в виде в один блок NAL. Другими словами, каждый элемент группы сэмплов имеет свои содержащиеся в нем виды, перечисленные в значении ScalableNALUMapEntry (масштабируемый элемент отображения блока NAL). grouping_type (тип группирования) этого элемента группы сэмплов является «scnm».

Термин «прогрессивная загрузка» используется для описания переноса цифровых медиафайлов с сервера на клиента, обычно с использованием протокола HTTP. При инициировании с компьютера компьютер может начать воспроизведение медиа, до того как будет завершена загрузка. Одно различие между потоковым медиа и прогрессивной загрузкой заключается в том, как цифровые медиаданные принимаются и хранятся устройством конечного пользователя, которое выполняет доступ к цифровым медиа. Медиапроигрыватель, который способен выполнять воспроизведение с прогрессивной загрузкой, основывается на метаданных, расположенных в заголовке файла, которые являются неповрежденными, и локальном буфере цифрового медиафайла, когда он загружается с веб-сервера. В момент времени, при котором заданное количество данных становится доступным для локального устройства воспроизведения, устройство может начать воспроизведение медиа. Это заданная величина буфера может быть встроена в файл производителем контента в установках декодера и может быть подкреплена дополнительными установками буфера, назначаемыми медиапроигрываетем клиентского компьютера.

AVC и 3GPP являются расширениями базового формата медиафайлов ISO, тогда как SVC и MVC являются расширениями формата файлов AVC. Следовательно, методы данного раскрытия могут быть применены в отношении видеофайлов, соответствующих базовому формату медиафайлов ISO, формату файлов AVC и его расширениям, например, SVC и MVC, и/или формату файлов 3GPP. Методы дополнительно могут применяться к этим и другим расширениям этих форматов и дополнительно могут применяться для расширения других форматов файлов для обеспечения фрагментов субтрека сборкой сэмплов видео в различных форматах файлов для потоковой передачи HTTP.

В отношении 3GPP в качестве другого примера, транспорт HTTP/TCP/IP поддерживается для файлов 3GPP для загрузки и прогрессивной загрузки. Кроме того, использование HTTP для потоковой передачи видео может обеспечивать некоторые преимущества, и становятся популярными услуги потоковой передачи видео, основанные на HTTP. Потоковая передача HTTP может обеспечивать некоторые преимущества, включая то, что могут использоваться существующие компоненты и протоколы Интернета, так что не требуются новые усилия для разработки новых методов для транспортировки видеоданных по сети. Другие транспортные протоколы, например, формат полезной нагрузки RTP, требуют, чтобы промежуточные сетевые устройства, например, средние боксы, имели сведения о формате медиа и контексте сигнализации. Также, потоковая передача HTTP может управляться клиентом, что может избежать вопросов управления.

Например, чтобы использовать признаки для получения оптимальных характеристик, сервер может отслеживать размер и контент пакетов, прием которых еще не подтвержден. Сервер также может анализировать файловую структуру и восстанавливать состояние клиентского буфера, чтобы принять RD-оптимальные решения о переключении/прореживании. Кроме того, могут выполняться ограничения на изменения битового потока, чтобы оставаться совместимым с согласованными профилями. HTTP необязательно необходимы новые аппаратные или программные реализации на веб-сервере, который реализовал HTTP 1.1. Потоковая передача HTTP также обеспечивает дружественность TCP и прослеживание брандмауэром.

При потоковой передаче HTTP часто используемые операции включают в себя GET и частичный GET. Операция GET извлекает весь файл, ассоциированный с данным унифицированным указателем ресурса (URL) или унифицированным именем ресурса (URN). Операция частичный GET принимает байтовый диапазон в качестве входного параметра и извлекает непрерывное количество байтов файла, соответствующее принятому байтовому диапазону. Таким образом, фрагменты фильма могут обеспечиваться для потоковой передачи HTTP, так как операция частичный GET может получать один или более индивидуальных фрагментов фильма. Отметьте, что во фрагменте фильма может быть несколько фрагментов трека разных треков. При потоковой передаче HTTP представлением медиа может быть структурированная коллекция данных, которая доступна для клиента. Клиент может запросить и загрузить информацию о медиаданных, чтобы представить услугу потоковой передачи пользователю.

Фиг.1 представляет собой блок-схему, иллюстрирующую примерную систему 10, в которой устройство 20 источника аудио/видео (A/V) посылает аудио- и видеоданные на устройство 40 назначения A/V. Система 10 на фиг.1 может соответствовать системе видеоконференции, системе сервер/клиент, системе вещатель/приемник или любой другой системе, в которой видеоданные посылаются с устройства источника, такого как устройство 20 источника A/V, на устройство назначения, такое как устройство 40 назначения A/V. В некоторых примерах устройство 20 источника A/V и устройство 40 назначения A/V могут выполнять двунаправленный обмен информацией. Т.е. устройство 20 источника A/V и устройство 40 назначения A/V могут быть способны как кодировать, так и декодировать (и передавать и принимать) аудио- и видеоданные. В некоторых примерах аудиокодер 26 может содержать речевой кодер, также упоминаемый как вокодер.

Устройство 20 источника A/V в примере на фиг.1 содержит источник 22 аудио и источник 24 видео. Источник 22 аудио может содержать, например, микрофон, который вырабатывает электрические сигналы, представляющие захваченные аудиоданные, подлежащие кодированию аудиокодером 26. Альтернативно, источник 22 аудио может содержать запоминающий носитель, хранящий ранее записанные аудиоданные, генератор аудиоданных, такой как компьютеризованный синтезатор, или любой другой источник аудиоданных. Источник 24 видео может содержать видеокамеру, которая вырабатывает видеоданные, подлежащие кодированию видеокодером 28, запоминающий носитель, кодированный ранее записанными видеоданными, блок генерирования видеоданных или любой другой источник видеоданных.

Необработанные аудио- и видеоданные могут содержать аналоговые или цифровые данные. Аналоговые данные могут оцифровываться перед кодированием аудиокодером 26 и/или видеокодером 28. Источник 22 аудио может получать аудиоданные от говорящего участника, в то время как говорящий участник говорит, и источник 24 видео может одновременно получать видеоданные говорящего участника. В других примерах источник 22 аудио может содержать считываемый компьютером запоминающий носитель, содержащий хранимые аудиоданные, и источник 24 видео может содержать считываемый компьютером запоминающий носитель, содержащий хранимые видеоданные. Таким образом, методы, описанные в данном раскрытии, могут применяться к реальным, потоковым аудио- и видеоданным или аудио- и видеоданным в реальном масштабе времени или архивированным, предварительно записанным аудио- и видеоданным.

Аудиокадры, которые соответствуют видеокадрам, представляют собой, в основном, аудиокадры, содержащие аудиоданные, которые были захвачены источником 22 аудио одновременно с видеоданными, захваченными источником 24 видео, которые содержатся в видеокадрах. Например, в то время как говорящий участник, в целом, вырабатывает аудиоданные посредством того, что он говорит, источник 22 аудио захватывает эти аудиоданные, и источник 24 видео одновременно захватывает видеоданные говорящего участника, т.е. в то время как источник 22 аудио захватывает аудиоданные. Следовательно, аудиокадр может временно соответствовать одному или более конкретным видеокадрам. Следовательно, аудиокадр, соответствующий видеокадру, в основном, соответствует ситуации, в которой аудиоданные и видеоданные были захвачены одновременно, и для которой аудиокадр и видеокадр содержат соответственно аудиоданные и видеоданные, которые были захвачены одновременно.

В некоторых примерах аудиокодер 26 может кодировать временную метку в каждом кодированном аудиокадре, которая представляет момент времени, при котором были записаны аудиоданные для кодированного аудиокадра, и, аналогично, видеокодер 28 может кодировать временную метку в каждом кодированном видеокадре, который представляет момент времени, при котором были записаны видеоданные для кодированного видеокадра. В таких примерах аудиокадр, соответствующий видеокадру, может содержать аудиокадр, содержащий временную метку, и видеокадр, содержащий такую же временную метку. Устройство 20 источника A/V может включать в себя внутренний тактовый сигнал, из которого аудиокодер 26 и/или видеокодер 28 могут генерировать временные метки, или который источник 22 аудио и источник 24 видео могут использовать, чтобы ассоциировать аудио- и видеоданные соответственно с временной меткой.

В некоторых примерах источник 22 аудио может посылать данные на аудиокодер 26, соответствующий моменту времени, при котором были записаны аудиоданные, и источник 24 видео может посылать данные на видеокодер 28, соответствующий моменту времени, при котором были записаны видеоданные. В некоторых примерах аудиокодер 26 может кодировать идентификатор последовательности в кодированных аудиоданных для указания относительного временного упорядочения кодированных аудиоданных, но без необходимости указания абсолютного времени, при котором были записаны аудиоданные, и, аналогично, видеокодер 28 также может использовать идентификаторы последовательности для указания относительного временного упорядочения кодированных видеоданных. Аналогично, в некоторых примерах идентификатор последовательности может отображаться или иным образом сопоставляться с временной меткой.

Методы данного раскрытия, в основном, относятся к хранению и транспортировке кодированных мультимедийных (например, аудио и видео) данных, и приему и последующей интерпретации и декодированию транспортируемых мультимедийных данных. Как показано в примере на фиг.1, источник 24 видео может подавать множество видов сцены на видеокодер 28.

Устройство 20 источника A/V может предоставлять «услугу» устройству 40 назначения A/V. Услуга, в основном, соответствует поднабору доступных видов данных MVC. Например, данные MVC могут быть доступны для восьми видов, упорядоченных от нуля до семи. Одна услуга может соответствовать стереовидео, имеющему два вида, в то время как другая услуга может соответствовать четырем видам, и еще другая услуга может соответствовать всем восьми видам. В общем, услуга соответствует любой комбинации (т.е. любому поднабору) доступных видов. Услуга также может соответствовать комбинации доступных видов, а также аудиоданных. Рабочая точка может соответствовать услуге, так что устройство 20 источника A/V может дополнительно обеспечивать дескриптор рабочей точки для каждой услуги, предоставляемой устройством 20 источника A/V.

Каждый индивидуальный поток данных (или аудио, или видео) упоминается как элементарный поток. Элементарный поток представляет собой единственный, кодированный цифровым образом (возможно сжатый) компонент программы. Например, часть кодированного видео или аудио программы может представлять собой элементарный поток. Элементарный поток может преобразовываться в пакетированный элементарный поток (PES) перед инкапсуляцией в видеофайл. В одной и той же программе ID потока используется для того, чтобы отличать пакеты PES, принадлежащие одному элементарному потоку, от других. Базовой единицей данных элементарного потока является пакет пакетированного элементарного потока (PES). Таким образом, каждый вид видеоданных MVC соответствует соответствующим элементарным потокам. Аналогично, аудиоданные соответствуют одному или более соответствующим элементарным потокам.

Кодированная видеопоследовательность MVC может разделяться на несколько битовых подпотоков, каждый из которых является элементарным потоком. Каждый битовый подпоток может идентифицироваться с использованием поднабора view_id MVC. Основываясь на принципе каждого поднабора view_id MVC, определяется битовый подпоток видео MVC. Битовый подпоток видео MVC содержит блоки NAL видов, перечисленных в поднаборе view_id MVC. Программный поток, в основном, содержит только блоки NAL, которые представляют собой те, которые из элементарных потоков. Также разработано, что любые два элементарных потока не могут содержать идентичный вид, но, вместо этого, могут содержать виды, например, разные ракурсы сцены для создания трехмерного эффекта.

В примере на фиг.1 блок 30 инкапсуляции принимает элементарные потоки, содержащие видеоданные от видеокодера 28, и элементарные потоки, содержащие аудиоданные от аудиокодера 26. В некоторых примерах каждый из видеокодера 28 и аудиокодера 26 может включать в себя формирователи пакетов для формирования пакетов PES из кодированных данных. В других примерах каждый из видеокодера 28 и аудиокодера 26 может сопрягаться с соответствующими формирователями пакетов для формирования пакетов PES из кодированных данных. В еще других примерах блок 30 инкапсуляции может включать в себя формирователи пакетов для формирования пакетов PES из кодированных аудио- и видеоданных.

«Программа», используемая в данном раскрытии, может содержать комбинацию аудиоданных и видеоданных, например, элементарный поток аудио и поднабор доступных видов, доставляемых услугой устройства 20 источника A/V. Каждый пакет PES включает в себя stream_id, который идентифицирует элементарный поток, к которому принадлежит пакет PES. Блок 30 инкапсуляции отвечает за сборку элементарных потоков в видеофайл.

Блок 30 инкапсуляции принимает пакеты PES для элементарных потоков программы от аудиокодера 26 и видеокодера 28 и формирует соответствующие блоки уровня сетевой абстракции (NAL) из пакетов PES. В примере H.264/AVC (усовершенствованное видеокодирование) кодированные сегменты видео организуются в блоки NAL, которые обеспечивают видеопредставления с «дружественностью к сетям», обращающиеся к приложениям, таким как видеотелефония, хранение, широковещание или потоковая передача. Блоки NAL могут категоризироваться на блоки NAL уровня видеокодирования (VCL) и блоки NAL не-VCL. Блоки VCL могут содержать механизм сжатия ядра и может включать в себя данные уровня блока, макроблока и/или слайса (вырезки). Другими блоками NAL могут быть блоки NAL не-VCL. В некоторых примерах кодированное изображение в одном моменте времени, обычно представленное как главное кодированное изображение, может содержаться в блоке доступа, который может включать в себя один или более блоков NAL.

Блоки NAL не-VCL могут включать в себя блоки NAL набора параметров и блоки NAL SEI в числе прочих. Наборы параметров могут содержать информацию заголовка уровня последовательности (в наборах параметров последовательности (SPS)) и редко изменяющуюся информацию заголовка уровня изображения (в наборах параметров изображения (PPS)). С наборами параметров (например, PPS и SPS) редко изменяющуюся информацию нет необходимости повторять для каждой последовательности или изображения, следовательно, может быть повышена эффективность кодирования. Кроме того, использование наборов параметров может предоставить возможность выполнять внеполосную передачу важной информации заголовка, избегая необходимости избыточных передач для устойчивости к ошибкам. В примерах внеполосной передачи блоки NAL набора параметров могут передаваться по другому каналу, чем другие блоки NAL, такие как блоки NAL SEI.

В соответствии с методами данного раскрытия блок 30 инкапсуляции может собирать сэмплы видео во фрагменты субтрека, каждый из которых может соответствовать конкретному иерархическому слою, например, временному слою. Блок 30 инкапсуляции также может представлять каждый фрагмент субтрека в видеофайле в виде набора последовательных байтов. В некоторых примерах фрагмент субтрека может содержать только нормальные кодированные сэмплы. В некоторых примерах фрагмент субтрека может содержать нормальные сэмплы, а также сэмплы повторного сборщика, указывающие на сэмплы в одном или более предшествующих фрагментов субтрека в текущем фрагменте фильма. Кроме того, в некоторых примерах фрагмент субтрека может содержать только сэмплы повторного сборщика.

В общем, сэмплы фрагментов субтрека более высокого слоя могут кодироваться с ссылкой на сэмплы фрагментов субтрека более низкого слоя. Блок 30 инкапсуляции может обеспечивать, что сэмплы фрагментов субтрека более низкого слоя не зависят от сэмплов более высокого слоя, так что устройство 40 назначения может извлекать сэмплы до требуемого слоя без необходимости извлечения более высоких слоев, чем требуемый слой. Таким образом, устройство 40 назначения может представлять один раз запрос частичного GET HTTP для извлечения одного или более фрагментов субтрека. Например, устройство 40 назначения может представлять один запрос для каждого требуемого слоя. Когда слои размещены рядом в файле, устройство 40 назначения может представлять запрос на извлечение данных для многих слоев.

В некоторых примерах блок 30 инкапсуляции может сигнализировать информацию переупорядочения в видеофайле, которая указывает, как переупорядочить кодированные видеоизображения более одного фрагмента субтрека в порядок декодирования. Например, как описано выше, блок 30 инкапсуляции может включать в себя объекты повторного сборщика во фрагменте субтрека. В общем, объект повторного сборщика может действовать в качестве указателя на кодированный сэмпл видео в предыдущем, например, в этом же фрагменте субтрека или фрагменте субтрека более низкого уровня. Устройство 40 назначения может использовать объекты повторного сборщика для повторного размещения сэмплов, после того как будут приняты фрагменты субтрека. Например, после использования одного или более запросов на извлечение фрагментов субтрека видеофайла блок 38 декапсуляции устройства 40 назначения может использовать объекты повторного сборщика для сборки кодированных сэмплов видео в порядок декодирования, перед тем как видеодекодер 48 декодирует сэмплы. Блок 38 декапсуляции может использовать самый последний фрагмент субтрека в байтовом порядке в качестве начальной точки для мультиплексирования сэмплов посредством ссылки на сэмплы в предыдущих фрагментах субтрека. Объект повторного сборщика может включать в себя положение опорного сэмпла и индекс фрагмента субтрека, включающего в себя сэмпл, на который ссылается объект повторного сборщика.

Кроме того, если блок 30 инкапсуляции включает в себя объекты повторного сборщика во фрагментах субтрека, блок 30 инкапсуляции может дополнительно включать в себя заголовки демультиплексирования (которые могут, альтернативно, упоминаться как «заголовки повторной сборки»), которые описывают характеристики одного или более фрагментов субтрека. Блок 30 инкапсуляции может включать в себя заголовки демультиплексирования в различных расположениях, таких как, например, бокс фильма, заголовок фрагмента фильма и/или заголовок фрагмента трека. Заголовки демультиплексирования могут задавать уникальные идентификаторы для каждого фрагмента субтрека, байтовые диапазоны для соответствующих фрагментов субтрека, количество изображений в каждом фрагменте субтрека и временную информацию фрагментов субтрека. Временная информация может описываться как относительная временная информация в виде сэмплов или всемирное координированное время (UTC). Блоку 30 инкапсуляции нет необходимости включать в себя такую временную информацию, когда фрагменты субтрека не соответствуют слоям с разными частотами кадров или временными уровнями.

В некоторых примерах, например, в отношении SVC и MVC, многочисленные слои кодированных сэмплов видео могут включаться в общий трек. Например, многочисленные слои кодирования (например, в SVC) и многочисленные виды (например, в MVC) могут включаться в трек видеофайла. Блок 30 инкапсуляции может разделять связанные иерархические слои на соответствующие фрагменты субтрека. Каждый фрагмент субтрека может соответствовать общему слою, например, размерность, временной слой, слой отношения сигнал-шум, пространственный слой или вид. Как отмечено, данные для каждого фрагмента субтрека могут быть включены в видеофайл в качестве последовательных байтов данных.

Блок 30 инкапсуляции может дополнительно определять рабочие точки как включающие конкретные фрагменты субтрека. В частности, блок 30 инкапсуляции может определять характеристики рабочих точек, включая временной уровень (temporal_id (временной идентификатор)), quality_id (идентификатор качества), dependency_id (идентификатор зависимости) и/или view_id. В примерах, соответствующих SVC, характеристики могут соответствовать значениям в заголовке блока NAL блоков NAL SVC. В примерах, соответствующих MVC, характеристики могут соответствовать значениям в заголовке блока NAL блоков NAL MVC. В некоторых примерах только временной уровень может присутствовать в качестве характеристики рабочей точки. В контексте SVC могут присутствовать temporal_id (временной уровень), quality_id и dependency_id. В контексте MVC могут присутствовать temporal_id и view_id.

В некоторых примерах характеристики рабочих точек могут дополнительно включать в себя отображение вышеупомянутых характеристик на индекс фрагмента субтрека. Кроме того, характеристики рабочей точки могут включать в себя информацию о кодеке, индикатор профиля (profile_idc), индикатор уровня (level_idc), частоту кадров для рабочей точки, среднюю скорость передачи битов для рабочей точки, максимальную скорость передачи битов для рабочей точки, пространственное разрешение для рабочей точки, количество видов для вывода для рабочей точки и/или количество видов для декодирования для рабочей точки. Эти характеристики могут объединяться с существующими рабочими точками, как определено соответствующим форматов файлов.

Блок 30 инкапсуляции может формировать блоки NAL, содержащие заголовок, который идентифицирует программу, к которой принадлежит NAL, а также полезную нагрузку, например, аудиоданные, видеоданные или данные, которые описывают транспортный или программный поток, которому соответствует блок NAL. Например, в H.264/AVC блок NAL включает в себя 1-байтовый заголовок и полезную нагрузку изменяющегося размера. В одном примере заголовок блока NAL содержит элемент priority_id, элемент temporal_id, элемент anchor_pic_flag (флаг опорного изображения), элемент view_id, элемент non_idr_flag (флаг не-IDR) и элемент inter_view_flag (флаг межвидового предсказания). В обычном MVC сохраняется блок NAL, определенный в H.264, за исключением блоков NAL префикса и блоков NAL кодированного слайса MVC, которые включают в себя 4-байтовый заголовок блока NAL MVC и полезную нагрузку блока NAL.

Элемент priority_id (идентификатор приоритета) заголовка NAL может использоваться для процесса адаптации простого одномаршрутного битового потока. Элемент temporal_id может использоваться для задания временного уровня соответствующего блока NAL, где разные временные уровни соответствуют разным частотам кадров.

Элемент anchor_pic_flag может обозначать, является ли изображение опорным изображением или неопорным изображением. Опорные изображения и все изображения, следующие за ними в порядке вывода (т.е. в порядке отображения), могут правильно декодироваться без декодирования предыдущих изображений в порядке декодирования (т.е. в порядке битового потока), и, таким образом, могут использоваться в качестве точек случайного доступа. Опорные изображения и неопорные изображения могут иметь разные зависимости, обе из которых сигнализируются в наборе параметров последовательности. Другие флаги будут обсуждаться и использоваться в следующих разделах данной главы. Такое опорное изображение также может упоминаться как точка доступа открытой группы изображений (GOP), в то же время поддерживается точка доступа закрытой GOP, когда элемент non_idr_flag равен нулю. Элемент non_idr_flag обозначает, является ли изображение мгновенным обновлением декодера (IDR) или изображением IDR вида (V-IDR). В общем, изображение IDR и все изображения, следующие за ним в порядке вывода или порядке битового потока, могут правильно декодироваться без декодирования предыдущих изображений или в порядке декодирования, или в порядке отображения.

Элемент view_id может содержать синтаксическую информацию, которая может использоваться для идентификации вида, который может использоваться для интерактивности данных внутри декодера MVC, например, для межвидового предсказания, и вне декодера, например, для визуализации. Элемент inter_view_flag может задавать, используется ли соответствующий блок NAL другими видами для межвидового предсказания. Чтобы передать 4-байтовую информацию заголовка блока NAL для базового вида, который может быть совместимым с AVC, в MVC определяется блок NAL префикса. В контексте MVC блок доступа базового вида включает в себя блоки NAL VCL текущего момента времени вида, а также его блок NAL префикса, который содержит только заголовок блока NAL. Декодер H.264/AVC может игнорировать блок NAL префикса.

Блок NAL, включающий в себя видеоданные в его полезной нагрузке, может содержать различные уровни гранулярности видеоданных. Например, блок NAL может содержать блок видеоданных, макроблок, множество макроблоков, слайс видеоданных или весь кадр видеоданных. Блок 30 инкапсуляции может принимать кодированные видеоданные от видеокодера 28 в виде пакетов PES элементарных потоков. Блок 30 инкапсуляции может ассоциировать каждый элементарный поток с соответствующей программой.

Блок 30 инкапсуляции также может собирать блоки доступа от множества блоков NAL. В общем, блок доступа может содержать один или более блоков NAL для представления кадра видеоданных, а также аудиоданные, соответствующие кадру, когда такие аудиоданные являются доступными. Блок доступа, в основном, включает в себя все блоки NAL для одного момента времени вывода, например, все аудио- и видеоданные для одного момента времени. Например, если каждый вид имеет частоту кадров 20 кадров в секунду (fps), тогда каждый момент времени может соответствовать интервалу времени 0,05 секунд. Во время этого интервала времени конкретные кадры для всех видов одного и того же блока доступа (одного и того же момента времени) могут визуализироваться одновременно. В примере, соответствующем H.264/AVC, блок доступа может содержать кодированное изображение в одном моменте времени, который может быть представлен как главное кодированное изображение. Следовательно, блок доступа может содержать все аудио- и видеокадры общего временного момента, например, все виды, соответствующие времени X. Данное раскрытие также ссылается на кодированное изображение конкретного вида в качестве «составляющей вида». Т.е. составляющая вида может содержать кодированное изображение (или кадр) для конкретного вида в конкретное время. Следовательно, блок доступа может определяться как содержащий все составляющие вида общего временного момента. Порядку декодирования блоков доступа нет необходимости обязательно быть таким же, что и порядок вывода или отображения.

H.264/AVC определяет синтаксис, семантику и процесс декодирования для битовых потоков без ошибок, любой из которых согласуется с некоторым профилем или уровнем. H.264/AVC не задает кодер, но кодеру ставится задача с гарантированием, что сгенерированные битовые потоки будут совместимыми со стандартом для декодера. В контексте стандарта видеокодирования, «профиль» соответствует поднабору алгоритмов, признаков или инструментальных средств и ограничений, которые применяются к ним. Как определено в стандарте H.264, например, «профиль» представляет собой поднабор всего синтаксиса битового потока, который задается стандартом H.264. «Уровень» соответствует ограничениям потребления ресурсов декодера, таких как, например, память декодера и вычисления, которые относятся к разрешению изображений, скорость передачи битов и скорость обработки макроблоков (MB). Профиль может сигнализироваться посредством значения profile_idc (индикатор профиля), тогда как уровень может сигнализироваться посредством значения level_idc (индикатор уровня).

Стандарт H.264, например, признает, что, в пределах границ, налагаемых синтаксисом данного профиля, все же возможно потребовать большое изменение в характеристиках кодеров и декодеров в зависимости от значений, принимаемых элементами синтаксиса в битовом потоке, такими как заданный размер декодируемых изображений. Стандарт H.264 дополнительно признает, что во многих применениях ни практически, ни экономически не реализовать декодер, способный иметь дело со всеми гипотетическими использованиями синтаксиса в конкретном профиле. Следовательно, стандарт H.264 определяет «уровень» в качестве заданного набора ограничений, налагаемых на значения элементов синтаксиса в битовом потоке. Этими ограничениями могут быть простые пределы на значения. Альтернативно, эти ограничения могут принимать вид ограничений на арифметические комбинации значений (например, ширина изображения, умноженная на высоту изображения, умноженная на количество изображений, декодируемых в секунду). Стандарт H.264 дополнительно обеспечивает, что индивидуальные реализации могут поддерживать разный уровень для каждого поддерживаемого профиля.

Декодер, соответствующий профилю, обычно поддерживает все признаки, определенные в профиле. Например, в качестве признака кодирования, кодирование B-изображения не поддерживается в базовом профиле H.264/AVC, но поддерживается в других профилях H.264/AVC. Декодер, соответствующий уровню, должен быть способен декодировать любой битовый поток, который не требует ресурсов вне ограничений, определенных в уровне. Определения профилей и уровней может быть полезным для интерпретируемости. Например, во время передачи видео пара определений профиля и уровня может обсуждаться и устанавливаться для всего сеанса передачи. Более конкретно, в H.264/AVC уровень может определять, например, ограничения на количество макроблоков, которые необходимо обработать, размер буфера декодируемых изображений (DPB), размер буфера кодируемых изображений (CPB), диапазон вектора движения по вертикали, максимальное количество векторов движения на два последовательных MB и, может ли B-блок иметь разделения на субмакроблоки менее 8×8 пикселей. Таким образом, декодер может определять, является ли декодер способным надлежащим образом декодировать битовый поток.

Стандарты сжатия видео, такие как ITU-T H.261, H.262, H.263, MPEG-1, MPEG-2 и H.264/MPEG-4 part 10 используют временное предсказание с компенсацией движения для уменьшения временной избыточности. Кодер использует предсказание с компенсацией движения из некоторых ранее кодированных изображений (также упоминаемых в данном документе как кадры) для предсказания текущих кодируемых изображений в соответствии с векторами движения. Имеется три главных типа изображений в типовом видеокодировании. Ими являются внутренне кодированные изображения («I-изображения» или «I-кадры»), изображения с предсказанием («P-изображения» или «P-кадры») и изображения с двунаправленным предсказанием («B-изображения» или «B-кадры»). P-изображения используют только опорное изображение перед текущим изображением во временном порядке. В B-изображении каждый блок B-изображения может предсказываться из одного или двух опорных изображений. Эти опорные изображения могут располагаться перед и после текущего изображения во временном порядке.

В соответствии со стандартом кодирования H.264, в качестве примера, B-изображения используют два списка ранее кодированных опорных изображений, список 0 и список 1. Каждый из этих двух списков может содержать прошлые и/или будущие кодируемые изображения во временном порядке. Блоки в B-изображении могут предсказываться одним способом из нескольких: предсказание с компенсацией движения из опорного изображения списка 0, предсказание с компенсацией движения из опорного изображения списка 1 или предсказание с компенсацией движения из комбинации опорных изображений как списка 0, так и списка 1. Чтобы получить комбинацию опорных изображений как списка 0, так и списка 1, две опорные области с компенсацией движения получаются из опорного изображения списка 0 и списка 1 соответственно. Их комбинация используется для предсказания текущего блока.

Стандарт ITU-T H.264 поддерживает внутреннее предсказание в различных размеров блока, таких как 16 на 16, 8 на 8 или 4 на 4 для составляющей яркости, и 8×8 для составляющих цветности, а также внешнее предсказание в различных размерах блока, таких как 16×16, 16×8, 8×16, 8×8, 8×4, 4×8 и 4×4 для составляющих яркости и соответствующие масштабированные размеры для составляющих цветности. В данном раскрытии «N×N» и «N на N» могут использоваться попеременно для ссылки на пиксельные размеры блока в смысле размеров по вертикали и по горизонтали, например, 16×16 пикселей или 16 на 16 пикселей. Обычно, блок 16×16 имеет 16 пикселей в вертикальном направлении (y=16) и 16 пикселей в горизонтальном направлении (x=16). Аналогично, блок N×N, как правило, имеет N пикселей в вертикальном направлении и N пикселей в горизонтальном направлении, где N представляет неотрицательное целое число. Пиксели в блоке могут размещаться рядами и столбцами. Блоки могут иметь разное количество пикселей в размерах по горизонтали и по вертикали. Т.е. блоки могут включать в себя N×M пикселей, где N необязательно равно M.

Размеры блока, которые меньше 16 на 16, могут упоминаться как разделения макроблока 16 на 16. Видеоблоки могут содержать блоки пиксельных данных в пиксельной области или блоки коэффициентов преобразования в области преобразования, например, следуя применению преобразования, такого как дискретное косинусное преобразование (DCT), целочисленное преобразование, вейвлет-преобразование или концептуально подобное преобразование в данные остаточного видеоблока, представляющие пиксельные различия между кодированными видеоблоками и видеоблоками предсказания. В некоторых случаях видеоблок может содержать блоки квантованных коэффициентов преобразования в области преобразования.

Меньшие видеоблоки могут обеспечивать лучшее разрешение и могут использоваться для расположений видеокадра, которые включают в себя высокие уровни детализации. В общем, макроблоки и различные разделения, иногда упоминаемые как субблоки, могут считаться видеоблоками. Кроме того, слайс может считаться множеством видеоблоков, таких как макроблоки и/или субблоки. Каждый слайс может представлять собой независимо декодируемый блок видеокадра. Альтернативно, сами кадры могут быть декодируемыми блоками, или другие части кадра могут определяться как декодируемые блоки. Термин «кодированный блок» или «блок кодирования» может ссылаться на любой независимо декодируемый блок видеокадра, такой как весь кадр, слайс кадра, группу изображений (GOP), также упоминаемую как последовательность, или другой независимо декодируемый блок, определенный в соответствии с применимыми методами кодирования.

Термин «макроблок» ссылается на структуру данных для кодирования изображения и/или видеоданных в соответствии с двумерным массивом пикселей, который содержит 16×16 пикселей. Каждый пиксель содержит составляющую цветности и составляющую яркости. Следовательно, макроблок может определять четыре блока яркости, причем каждый содержит двумерный массив 8×8 пикселей, два блока цветности, причем каждый содержит двумерный массив 16×16 пикселей, и заголовок, содержащий информацию синтаксиса, такую как структура кодированного блока (CBP), режим кодирования (например, режим внутреннего (I) или внешнего (P или B) кодирования), размер разделения для разделений внутренне кодированного блока (например, 16×16, 16×8, 8×16, 8×8, 8×4, 4×8 или 4×4), или один или более векторов движения для внешне кодированного макроблока.

Каждый из видеокодера 28, видеодекодера 48, аудиокодера 26, аудиодекодера 46, блока 30 инкапсуляции и блока 38 декапсуляции может быть реализован как любая из многочисленных подходящих схем обработки при соответствующих условиях, таких как один или более микропроцессоров, процессоры цифровой обработки сигналов (DSP), специализированные интегральные схемы (ASIC), программируемые вентильные матрицы (FPGA), дискретные логические схемы, программное обеспечение, аппаратное обеспечение, программно-аппаратное обеспечение или любая их комбинация. Каждый из видеокодера 28 и видеодекодера 48 может быть включен в один или более кодеров или декодеров, любой из которых может быть интегрирован как часть объединенного видео кодера/декодера (кодека). Аналогично, каждый из аудиокодера 26 и аудиодекодера 46 может быть включен в один или более кодеров или декодеров, любой из которых может быть интегрирован как часть объединенного кодека. Устройство, включающее в себя видеокодер 28, видеодекодер 48, аудиокодер 26, аудиодекодер 46, блок 30 инкапсуляции и/или блок 38 декапсуляции, может содержать интегральную схему, микропроцессор и/или устройство беспроводной связи, такое как сотовый телефон.

После того как блок 30 инкапсуляции соберет блоки NAL и/или блоки доступа в видеофайл, основанный на принятых данных, блок 30 инкапсуляции передает видеофайл на интерфейс 32 вывода для вывода. В некоторых примерах блок 30 инкапсуляции может хранить видеофайл локально или посылать видеофайл на удаленный сервер при помощи интерфейса 32 вывода, вместо посылки видеофайла непосредственно на устройство 40 назначения. Интерфейс 32 вывода может содержать, например, передатчик, приемопередатчик, устройство для записи данных на считываемый компьютером носитель, такой как, например, накопитель на оптических дисках, накопитель на магнитных носителях (например, накопитель на гибких магнитных дисках), порт универсальной последовательной шины (USB), сетевой интерфейс или другой интерфейс вывода. Интерфейс 32 вывода выводит видеофайл на считываемый компьютером носитель 34, такой как, например, сигнал передачи, магнитный носитель, оптический носитель, память, флеш-накопитель или другой считываемый компьютером носитель.

В конечном счете, интерфейс 36 ввода извлекает данные со считываемого компьютером носителя 34. Интерфейс 36 ввода может содержать, например, накопитель на оптических дисках, накопитель на магнитных носителях, порт USB, приемник, приемопередатчик или другой интерфейс считываемого компьютером носителя. Интерфейс 36 ввода может подавать блок NAL или блок доступа на блок 38 декапсуляции. Блок 38 декапсуляции может декапсулировать элементы видеофайла в составляющие потоков PES, депакетировать потоки PES для извлечения кодированных данных, и посылать кодированные данные или на аудиодекодер 46, или на видеодекодер 48 в зависимости от того, являются ли кодированные данные частью аудио- или видеопотока, например, как обозначено заголовками пакета PES потока. Аудиодекодер 46 декодирует кодированные аудиоданные и посылает декодированные аудиоданные на вывод 42 аудио, тогда как видеодекодер 48 декодирует кодированные видеоданные и посылает декодированные видеоданные, которые могут включать в себя множество видов потока, на вывод 44 видео.

Блок 38 декапсуляции может взаимодействовать с интерфейсом 36 ввода для первоначального запроса данных заголовка для видеофайла, где данные заголовка могут описывать характеристики видеофайла. Например, данные заголовка могут описывать характеристики фрагментов субтрека, включенных во фрагменты трека фрагментов фильма в видеофайле. Данные заголовка могут описывать, например, байтовые диапазоны индивидуальных фрагментов субтрека фрагмента фильма. Данные заголовка также могут описывать другие характеристики, которые могут способствовать блоку 38 декапсуляции при выборе поднабора доступных фрагментов субтрека видеофайла. После выбора конкретного набора доступных фрагментов субтрека блок 38 декапсуляции может представить один или более запросов для выбранных фрагментов субтрека каждого фрагмента фильма видеофайла.

Например, блок 38 декапсуляции может выбирать конкретную рабочую точку, которая может соответствовать поднабору доступных иерархических слоев. Затем блок 38 декапсуляции может определить для каждого фрагмента фильма, какие фрагменты субтрека фрагмента фильма соответствуют иерархическим слоям рабочей точки. Кроме того, блок 38 декапсуляции может определить байтовые диапазоны в каждом фрагменте фильма для соответствующих фрагментов субтрека. Основываясь на этих определенных байтовых диапазонах, блок 38 декапсуляции может генерировать запросы частичного GET HTTP, которые задают определенные байтовые диапазоны для фрагментов фильма для извлечения фрагментов субтрека. В некоторых примерах блок 38 декапсуляции может генерировать индивидуальные запросы для каждого требуемого слоя. В некоторых примерах блок 38 декапсуляции может генерировать единственный запрос для фрагментов субтрека, охватывающий многочисленные слои. Блок 38 декапсуляции затем может повторно размещать кодированные сэмплы видео фрагментов субтрека в порядке декодирования, используя объекты повторного сборщика фрагментов субтрека и передать размещенные кодированные сэмплы видео на видеодекодер 48, который может декодировать сэмплы видео. В конечном счете, вывод 44 видео может отображать декодированные сэмплы видео.

Фиг.2 представляет собой блок-схему, иллюстрирующую компоненты примерного блока инкапсуляции. В примере на фиг.2 блок 30 инкапсуляции включает в себя интерфейс 80 ввода видео, интерфейс 82 ввода аудио, блок 60 создания видеофайла и интерфейс 84 вывода видеофайла. Блок 60 создания видеофайла в данном примере включает в себя блок 62 конструирования блока уровня сетевой абстракции (NAL) и блок 64 создания фрагмента субтрека, который дополнительно включает в себя блок 66 управления слоем, блок 68 вставки сэмпла, блок 70 создания заголовка и блок 72 создания объекта повторного сборщика.

Интерфейс 80 ввода видео и интерфейс 82 ввода аудио принимают кодированные видео- и аудиоданные соответственно. Интерфейс 80 ввода видео и интерфейс 82 ввода аудио могут принимать кодированные видео- и аудиоданные, когда данные кодируются, или могут извлекать кодированные видео- и аудиоданные со считываемого компьютером носителя. При приеме кодированных видео- и аудиоданных интерфейс 80 ввода видео и интерфейс 82 ввода аудио передают кодированные видео- и аудиоданные на блок 60 создания видеофайла для сборки в видеофайл.

Блок 60 создания видеофайла может соответствовать блоку управления, включающему в себя аппаратное обеспечение, программное обеспечение и/или программно-аппаратное обеспечение, выполненное с возможностью выполнения функций и процедур, приписываемых им. Каждый из субблоков блока 60 создания видеофайла (блок 62 конструирования блока NAL, блок 64 создания фрагмента субтрека, блок 66 управления слоем, блок 68 вставки сэмпла, блок 70 создания заголовка и блок 72 создания объекта повторного сборщика в данном примере) может быть реализован в виде индивидуальных аппаратных блоков и/или программных модулей, и/или может быть функционально интегрирован или дополнительно разделен на дополнительные субблоки.

Блок 60 создания видеофайла может соответствовать любому подходящему блоку обработки или схеме обработки, такой как, например, один или более микропроцессоров, специализированные интегральные схемы (ASIC), программируемые вентильные матрицы (FPGA), процессоры цифровой обработки сигналов (DSP) или любая их комбинация. Блок 60 создания видеофайла может дополнительно включать в себя считываемый компьютером носитель, содержащий инструкции для любого или для всех из блока 62 конструирования блока NAL, блока 64 создания фрагмента субтрека, блока 66 управления слоем, блока 68 вставки сэмпла, блока 70 создания заголовка и блока 72 создания объекта повторного сборщика, а также процессор для исполнения инструкций.