[0001] Эта заявка испрашивает приоритет патентной заявке Китая № 201710421333.5, поданной 7 июня 2017 года, которая включается в данную заявку по этой ссылке в своей полноте.

Область техники, к которой относится изобретение

[0002] Настоящее изобретение относится к области технологий компьютерного программного обеспечения, и, в частности, к способу, оборудованию и электронному устройству для обнаружения витальности лица.

Уровень техники

[0003] Технология обнаружения витальности лица используется, чтобы определять, является ли текущий пользователь аутентичным пользователем, с помощью методов распознавания лиц, с тем, чтобы пресекать злонамеренные действия нарушителя под видом законного пользователя, такие как атака с повторением отображения, атака с печатным фото и атака с трехмерным моделированием.

[0004] В настоящее время, технология обнаружения витальности лица может быть классифицирована в технологию интрузивного обнаружения витальности лица и технологию неинтрузивного обнаружения витальности лица. В технологии интрузивного обнаружения витальности лица пользователь должен совместно совершать некоторые особые реальные действия, такие как моргание, поворот головы или открытие рта. При выполнении распознавания лица на основе предоставленных инструкций, модуль обнаружения витальности может определять, точно ли оператор выполняет реальное действие, и является ли оператор аутентичным пользователем. В технологии неинтрузивного обнаружения витальности лица пользователь не должен совместно совершать реальное действие, так что пользовательское восприятие является более хорошим, но техническая сложность является более высокой. Кроме того, обнаружение витальности выполняется, главным образом, в зависимости от информации о входном изображении единственного кадра или информации о других датчиках устройства.

[0005] В описанной технологии неинтрузивного обнаружения витальности лица в существующей технологии контролируемое обучение обычно выполняется по единой модели глубинного обучения с помощью изображений живых и неживых лиц, и затем прогноз витальности выполняется по входному изображению единственного кадра с помощью обученной модели.

[0006] Однако, такое техническое решение сильно зависит от типа атаки с подменой лица для обучающих данных и ограничивается объективным состоянием недостаточных обучающих данных. Трудно полностью извлекать отличительный признак изображения живого лица. В результате, эта модель не может полностью выражать отличительный признак живого лица, и точность результата обнаружения витальности лица снижается.

Сущность изобретения

[0007] Варианты осуществления настоящей заявки предоставляют способ обнаружения витальности лица, оборудование и электронное устройство, чтобы разрешать последующие технические проблемы в существующей технологии. В техническом решении, основанном на единой модели глубокого обучения, трудно полностью извлекать отличительный признак изображения живого лица. В результате, эта модель не может полностью выражать отличительный признак живого лица, и точность результата обнаружения витальности лица снижается.

[0008] Чтобы решать описанные технические проблемы, варианты осуществления настоящей заявки реализуются следующим образом:

[0009] Вариант осуществления настоящей заявки предоставляет способ обнаружения витальности лица, включающий в себя: обучение первой модели глубокого обучения на основе общих изображений лиц; обучение второй модели глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц; и выполнение обнаружения витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0010] Вариант осуществления настоящей заявки предоставляет оборудование для обнаружения витальности лица, включающее в себя: модуль обучения, сконфигурированный, чтобы: обучать первую модель глубокого обучения на основе общих изображений лиц; и обучать вторую модель глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц; и модуль обнаружения, сконфигурированный, чтобы выполнять обнаружение витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0011] По меньшей мере, одно техническое решение, используемое в вариантах осуществления настоящей заявки, может добиваться следующих полезных результатов. Одним таким преимуществом может быть то, что извлекается большее количество отличительных признаков изображения живого лица. По сравнению с моделью в существующей технологии обученная первая модель глубокого обучения и обученная вторая модель глубокого обучения совместно лучше выражают отличительный признак живого лица, тем самым, улучшая точность результата обнаружения витальности лица. Следовательно, часть или все проблемы в существующей технологии могут быть решены.

Краткое описание чертежей

[0012] Чтобы описывать технические решения в вариантах осуществления настоящей заявки или в существующей технологии более ясно, последующее кратко вводит сопровождающие чертежи, требуемые для описания вариантов осуществления или существующей технологии. Очевидно, сопровождающие чертежи в последующем описании просто показывают некоторые варианты осуществления настоящего изобретения, и обычный специалист в области техники может, однако же, теоретически получать другие чертежи из этих сопровождающих чертежей без творческих усилий.

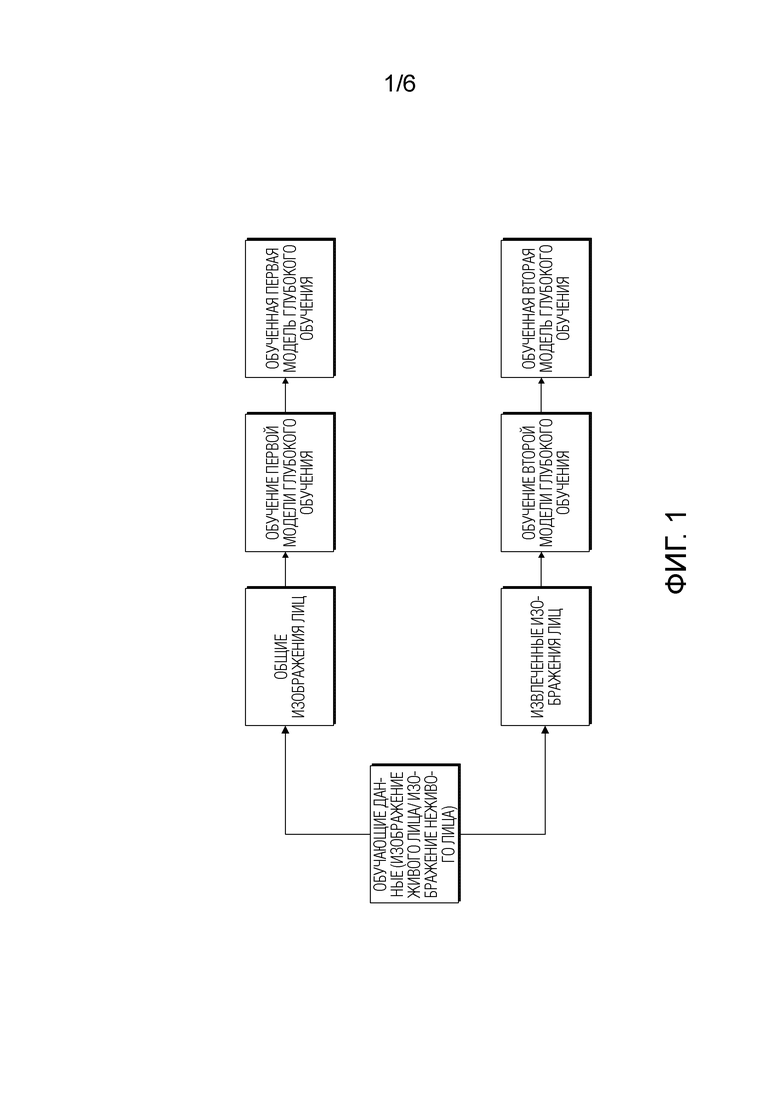

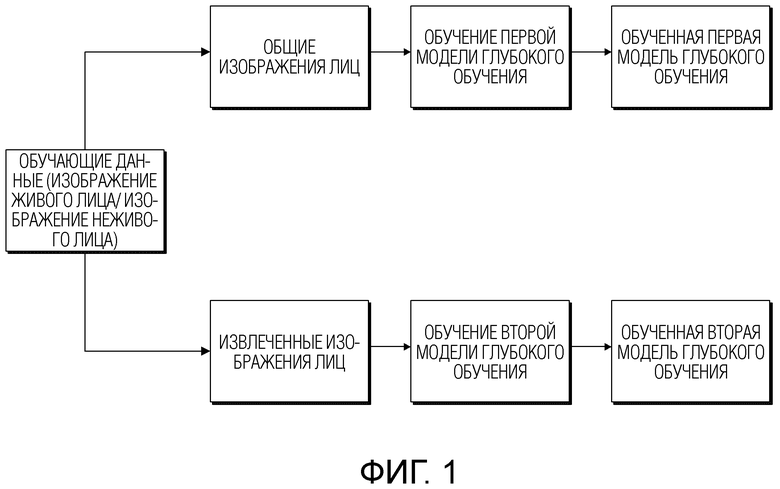

[0013] Фиг. 1 - это схематичная блок-схема последовательности операций, иллюстрирующая пример стадии обучения модели в решении настоящего изобретения;

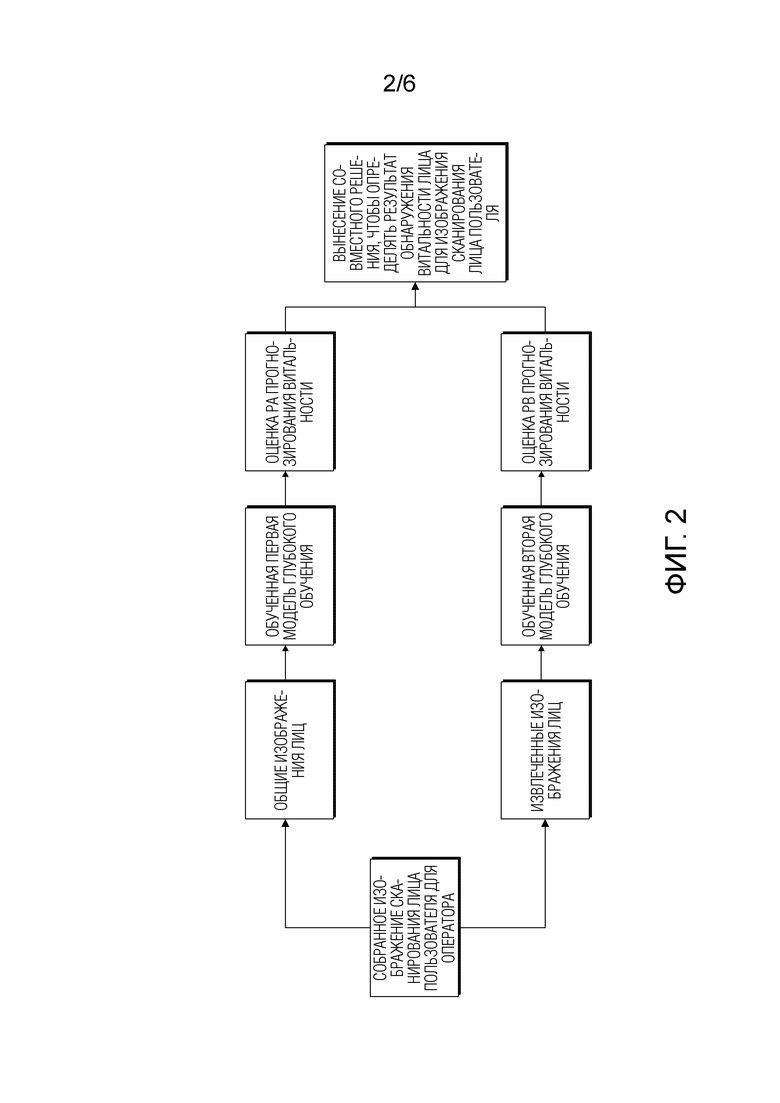

[0014] Фиг. 2 - это схематичная блок-схема последовательности операций, иллюстрирующая пример стадии обнаружения витальности в решении настоящего изобретения;

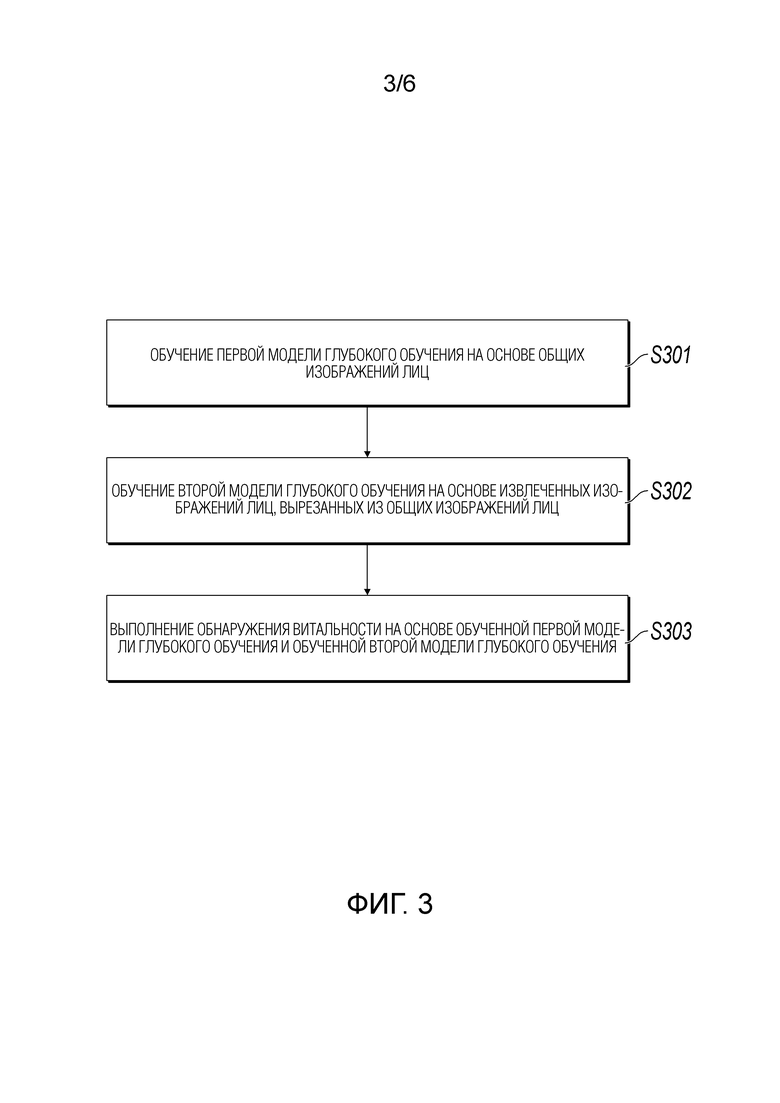

[0015] Фиг. 3 - это схематичная блок-схема последовательности операций, иллюстрирующая способ обнаружения витальности лица согласно варианту осуществления настоящего изобретения;

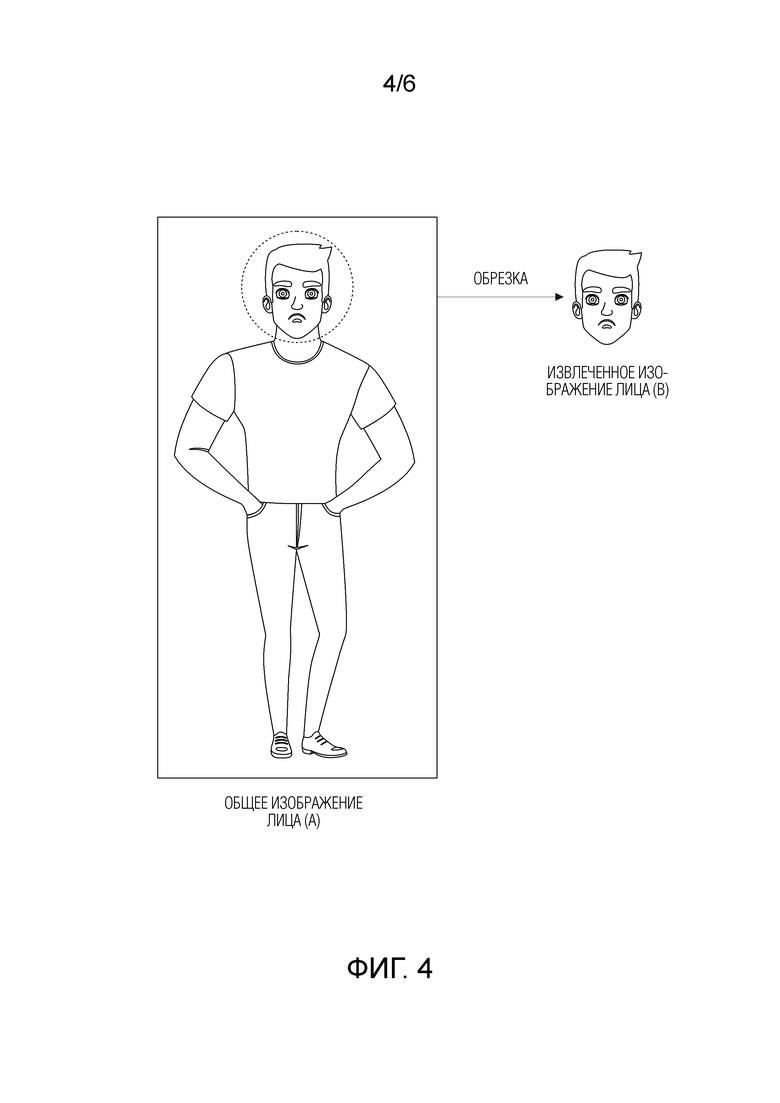

[0016] Фиг. 4 - это схематичный чертеж, иллюстрирующий сравнение между общим изображением лица и извлеченным изображением лица согласно варианту осуществления настоящего изобретения;

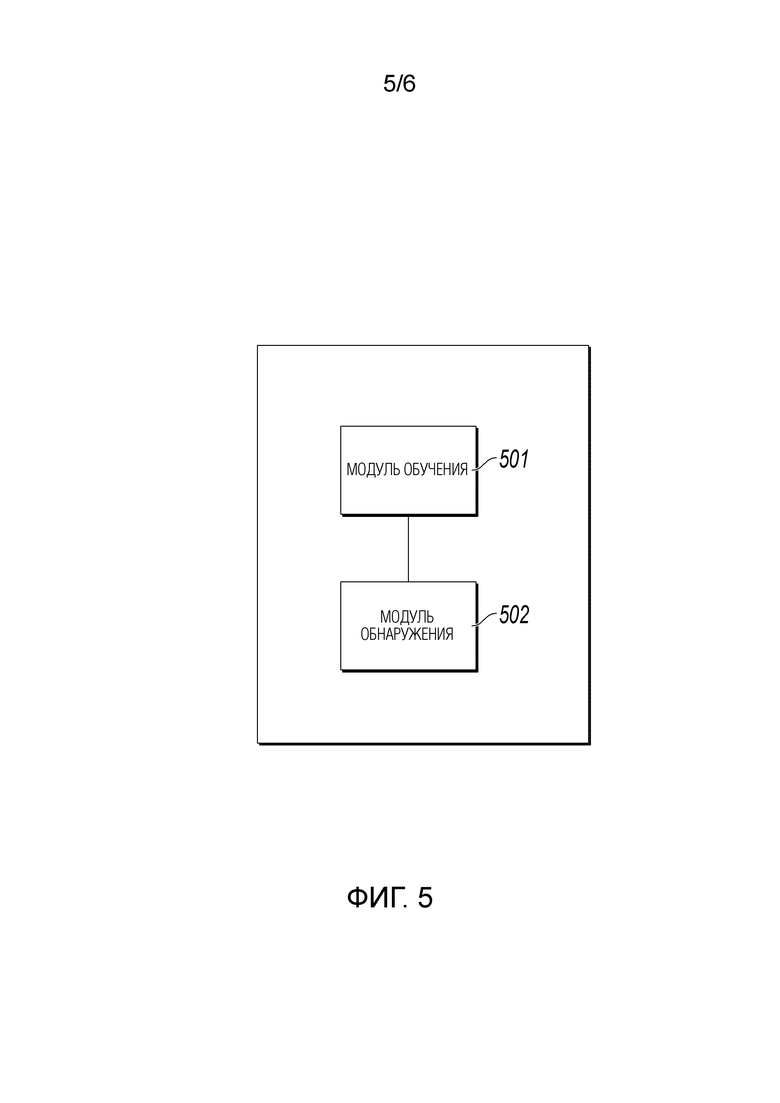

[0017] Фиг. 5 - это схематичный структурный чертеж, иллюстрирующий оборудование для обнаружения витальности лица, соответствующее фиг. 3, согласно варианту осуществления настоящего изобретения; и

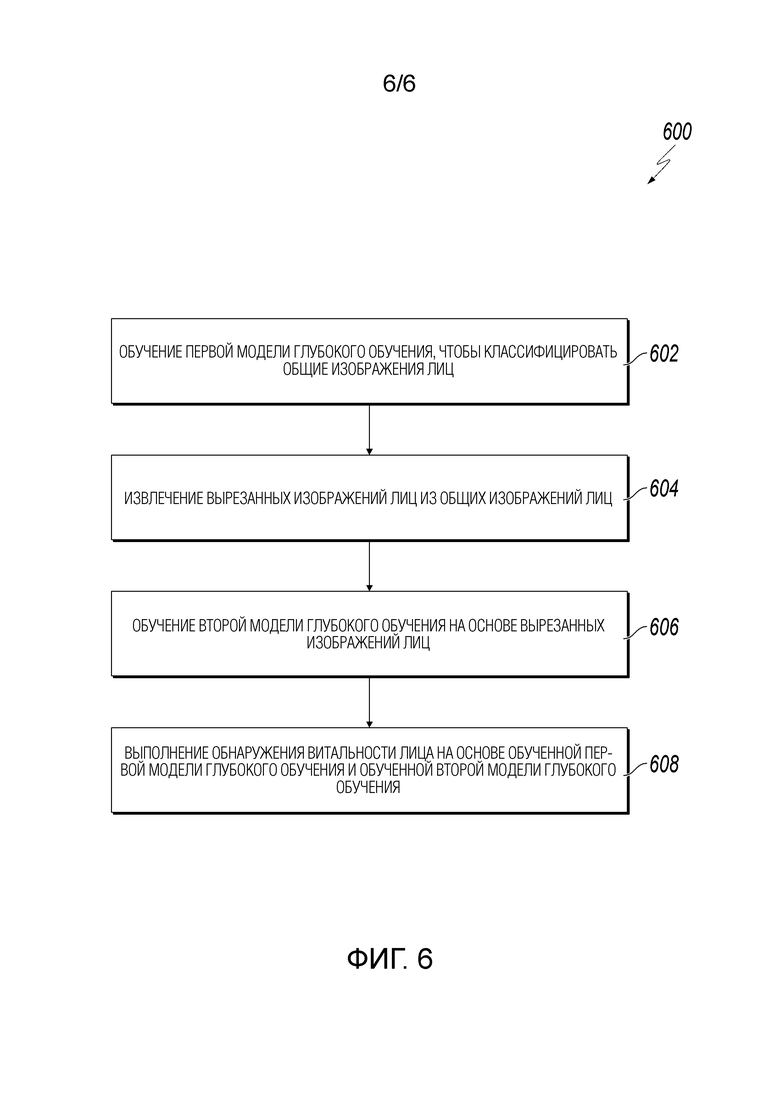

[0018] Фиг. 6 - это блок-схема последовательности операций, иллюстрирующая пример компьютерно-реализованного способа для определения аутентичности пользователя с помощью обнаружения витальности лица, согласно реализации настоящего изобретения.

Описание вариантов осуществления

[0019] Варианты осуществления настоящего изобретения предоставляют способ обнаружения витальности лица, оборудование и электронное устройство.

[0020] Для того, чтобы способствовать лучшему пониманию специалистом в области техники технических решений в настоящем изобретении, последующее ясно и полностью описывает технические решения в вариантах осуществления настоящего изобретения со ссылкой на сопровождающие чертежи в вариантах осуществления настоящего изобретения. Очевидно, что описанные варианты осуществления являются просто частью, а не всеми вариантами осуществления настоящего изобретения. Все другие варианты осуществления, полученные обычным специалистом в области техники на основе вариантов осуществления настоящего изобретения без творческих усилий, попадают в рамки защиты настоящего изобретения.

[0021] Все модели глубокого обучения в решении настоящего изобретения основываются на нейронной сети. Для легкости описания основная идея решения настоящего изобретения сначала описывается на основе примера и со ссылкой на фиг. 1 и фиг. 2.

[0022] В этом примере решение настоящего изобретения может быть классифицировано на стадию обучения модели и стадию обнаружения витальности.

[0023] Фиг. 1 - это схематичная блок-схема последовательности операций, иллюстрирующая пример стадии обучения модели в решении настоящего изобретения. На стадии обучения модели две независимые модели глубокого обучения обучаются с помощью живых и неживых образцов (принадлежащих к набору обучающих данных) в изображении лица: первая модель глубокого обучения и вторая модель глубокого обучения. Входное изображение для первой модели глубокого обучения является собранным общим изображением лица, а входное изображение для второй модели глубокого обучения может быть извлеченным изображением лица, вырезанным из общего изображения лица. Первая модель глубокого обучения и вторая модель глубокого обучения могут использовать различные структуры сетей глубокого обучения (например, структуру нейронной сети, на которой основывается модель). Различные структуры сетей по-разному являются чувствительными к различным признакам изображения. Живые и неживые наборы обучающих данных используются для выполнения обучения первой модели глубокого обучения и второй модели глубокого обучения на основе способа глубокого обучения.

[0024] Фиг. 2 - это схематичная блок-схема последовательности операций, иллюстрирующая пример стадии обнаружения витальности в решении настоящего изобретения. На стадии обнаружения витальности изображение сканирования лица пользователя собирается в качестве общего изображения лица пользователя, и первая модель глубокого обучения вводится, чтобы получать оценку PA прогнозирования. Кроме того, обнаружение лица выполняется по изображению сканирования лица пользователя, извлеченное изображение лица обрезается из изображения сканирования лица пользователя на основе результата обнаружения, и вторая модель глубокого обучения вводится в извлеченное изображение лица, чтобы получать оценку PB прогнозирования. Впоследствии, например, результат оценки прогнозирования (PA+PB) может быть сравнен с определенным пороговым значением (например, пороговое значение может быть равно 1), чтобы выносить совместное решение, чтобы определять результат обнаружения витальности лица для изображения сканирования лица пользователя.

[0025] На основе описанной основной идеи последующее описывает решение настоящего изобретения подробно.

[0026] Фиг. 3 - это схематичная блок-схема последовательности операций, иллюстрирующая способ обнаружения витальности лица согласно варианту осуществления настоящего изобретения. С точки зрения программы, процедура может выполняться посредством программы на сервере или терминале, например, программы аутентификации личности или приложения электронной торговли. С точки зрения устройства, процедура выполняется посредством по меньшей мере одного из следующих устройств, которые могут быть использованы в качестве сервера или терминала: устройство управления доступом, персональный компьютер, компьютер со средней производительностью, компьютерный кластер, мобильный телефон, планшетный компьютер, интеллектуальное носимое устройство, легковой автомобиль или точка продаж (POS).

[0027] Процедура на фиг. 3 может включать в себя следующие этапы.

[0028] S301. Обучение первой модели глубокого обучения на основе общих изображений лиц.

[0029] В этом варианте осуществления настоящего изобретения общие изображения лиц, используемые для обучения первой модели глубокого обучения, могут включать в себя множество образцов. Во множестве образцов некоторые являются изображениями живых лиц, которые собираются посредством съемки живого лица и которые могут быть использованы в качестве положительных образцов, а некоторые являются изображениями живых лиц, которые собираются посредством съемки живого лица, такого как изображение лица или модель лица, и которые могут быть использованы в качестве отрицательных образцов.

[0030] В этом варианте осуществления настоящего изобретения первая модель глубокого обучения является моделью классификации, а общие изображения лиц используются в качестве входных данных для модели классификации. После обработки модели, общие изображения лиц могут быть классифицированы, по меньшей мере, на категорию изображения живого лица или категорию изображения неживого лица. Целью обучения первой модели глубокого обучения является улучшение точности классификации первой модели глубокого обучения.

[0031] S302. Обучение второй модели глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц.

[0032] В этом варианте осуществления настоящего изобретения, в дополнение ко всей области лица, общее изображение лица, как правило, включает в себя некоторые не связанные области, такие как фоновая область и тело человека помимо лица. Извлеченное изображение лица может исключать не связанные области и может включать в себя, по меньшей мере, извлеченную область лица, например, всю область лица, область глаза или носовую область. Могут быть одна или более вторых моделей глубокого обучения, и каждая вторая модель глубокого обучения может соответствовать типу областей лица.

[0033] Фиг. 4 - это схематичный чертеж, иллюстрирующий сравнение между общим изображением лица и извлеченным изображением лица согласно варианту осуществления настоящего изобретения.

[0034] На фиг. 4, (a) является общим изображением лица. Для легкости понимания, извлеченное изображение лица помечается в (a) с помощью штриховых линий, и (a) может быть соответственно обрезаны, чтобы получать извлеченное изображение лица, показанное в (b).

[0035] Кроме того, когда извлеченное изображение лица является изображением, включающим в себя только частичную область лица, общее изображение лица может также быть изображением, включающим в себя всю область лица и, в основном, исключающим не связанную область.

[0036] В этом варианте осуществления настоящего изобретения извлеченное изображение лица, используемое для обучения второй модели глубокого обучения, может также включать в себя множество образцов. Во множестве образцов некоторые являются изображениями живых лиц, которые могут быть использованы в качестве положительных образцов, и некоторые являются изображениями неживых лиц (не изображениями живых лиц), которые могут быть использованы в качестве отрицательных образцов.

[0037] В этом варианте осуществления настоящего изобретения вторая модель глубокого обучения является также моделью классификации, а извлеченные изображения лиц используются в качестве входных данных для модели классификации. После обработки модели, извлеченные изображения лиц могут быть классифицированы, по меньшей мере, на категорию изображения живого лица или категорию изображения неживого лица. Целью обучения второй модели глубокого обучения является улучшение точности классификации второй модели глубокого обучения.

[0038] Помимо обрезки общего изображения лица, извлеченное изображение лица может быть получено посредством специального сбора независимо от общего изображения лица.

[0039] В этом варианте осуществления настоящего изобретения первая модель глубокого обучения и вторая модель глубокого обучения могут быть различными моделями или одной и той же моделью перед обучением.

[0040] Последовательность выполнения этапа S301 и этапа S302 не ограничивается в настоящем изобретении, и этап S301 и этап S302 могут быть одновременно или последовательно выполнены.

[0041] S303. Выполнение обнаружения витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0042] Каждый этап на фиг. 3 может быть выполнен посредством одного и того же устройства или одной и той же программы или может быть выполнен посредством различных устройств или различных программ. Например, этапы S301-S303 выполняются посредством устройства 1. В качестве другого примера, и этап S301, и этап S302 выполняются посредством устройства 1, а этап S303 выполняется посредством устройства 2; и т.д.

[0043] Согласно способу на фиг. 3, извлекается больше признаков изображения живого лица. По сравнению с моделью в существующей технологии, обученная первая модель глубокого обучения и обученная вторая модель глубокого обучения совместно лучше выражают отличительный признак живого лица, тем самым, улучшая точность результата обнаружения витальности лица. Следовательно, часть или все проблемы в существующей технологии могут быть решены.

[0044] На основе способа на фиг. 3 этот вариант осуществления настоящего изобретения дополнительно предоставляет некоторые конкретные решения по реализации способа и решение расширения, которые описываются ниже.

[0045] В этом варианте осуществления настоящего изобретения, чтобы реализовывать различие между чувствительностью первой модели глубокого обучения к отличительному признаку изображения, и чувствительностью второй модели глубокого обучения к отличительному признаку изображения, первая модель глубокого обучения и вторая модель глубокого обучения могут предпочтительно использовать различные структуры сети глубокого обучения.

[0046] Различные структуры сетей двух моделей глубокого обучения могут указывать, что две модели глубокого обучения включают в себя один или более различных параметров сетевой структуры. Параметр сетевой структуры может включать в себя, например, количество слоев скрытых переменных, тип слоя скрытых переменных, количество нейронных узлов, количество узлов входного слоя или количество узлов выходного слоя.

[0047] Конечно, некоторые конкретные модели глубокого обучения могут также включать в себя соответствующие конкретные параметры. Например, для модели глубокого обучения на основе традиционной нейронной сети, широко используемой в области изображений в настоящее время, размер ядра свертки блока свертки также является конкретным параметром сетевой структуры этой модели глубокого обучения.

[0048] Для решения настоящего изобретения, в целом, различные структуры сетей глубокого обучения включают в себя по меньшей мере один из следующих параметров: количество слоев скрытых переменных, тип слоя скрытых переменных, количество нейронных узлов или размер ядра свертки блока свертки.

[0049] В этом варианте осуществления настоящего изобретения, чтобы улучшать эффективность обучения модели и надежность обучения модели, обучение модели может выполняться способом контролируемого обучения.

[0050] Например, в способе контролируемого обучения, что касается этапа S301, общее изображение лица включает в себя первую метку, и первая метка указывает, является ли общее изображение лица, соответствующее первой метке, изображением живого лица.

[0051] Обучение первой модели глубокого обучения на основе общего изображения лица может включать в себя: ввод первой модели глубокого обучения в общее изображение лица, когда первая модель глубокого обучения извлекает отличительный признак общего изображения лица и прогнозирует, на основе извлеченного признака, является ли общее изображение лица изображением живого лица; и корректировку первой модели глубокого обучения на основе результата прогнозирования и первой метки общего изображения лица. В целом, когда результат прогнозирования является несогласованным с первой меткой, первая модель глубокого обучения корректируется, так что скорректированная первая модель глубокого обучения может получать, посредством повторного прогнозирования, результат прогнозирования, согласующийся с первой меткой.

[0052] Отличительный признак, извлеченный посредством первой модели глубокого обучения в процессе обучения, может предпочтительно включать в себя отличительный признак структуры изображения для общего изображения лица, например, границу фотографии на экране или искажение лица в общем изображении лица.

[0053] В качестве другого примера, аналогично, в способе управляемого обучения, для этапа S302, извлеченное изображение лица включает в себя вторую метку, и вторая метка указывает, является ли извлеченное изображение лица, соответствующее второй метке, изображением живого лица.

[0054] Обучение второй модели глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц, может включать в себя: получение извлеченных изображений лиц, вырезанных из общих изображений лиц; применение второй модели глубокого обучения к полученному извлеченному изображению лица, когда вторая модель глубокого обучения извлекает отличительный признак извлеченного изображения лица и прогнозирует, на основе извлеченного признака, является ли извлеченное изображение лица изображением живого лица; и корректировку второй модели глубокого обучения на основе результата прогнозирования и второй метки извлеченного изображения лица. В целом, когда результат прогнозирования не согласуется со второй меткой, вторая модель глубокого обучения корректируется, так что скорректированная вторая модель глубокого обучения может получать результат прогнозирования, согласующийся со второй меткой, посредством повторного прогнозирования.

[0055] Отличительный признак, извлеченный посредством второй модели глубокого обучения в процессе обучения, может предпочтительно включать в себя отличительный признак материала изображения для извлеченного изображения лица, например, размытость, текстура или цветовое искажение в извлеченном изображении лица.

[0056] В двух примерах, описанных выше, первая модель глубокого обучения и вторая модель глубокого обучения по-разному являются чувствительными к различным отличительным признакам изображения. Первая модель глубокого обучения является более чувствительной к отличительному признаку структуры изображения, а вторая модель глубокого обучения является более чувствительной к отличительному признаку материала изображения. Для изображения лица отличительный признак структуры изображения является относительно глобальным и обобщенным признаком, а отличительный признак материала изображения является относительно локальным и уточненным признаком.

[0057] Следовательно, обученная первая модель глубокого обучения и обученная вторая модель глубокого обучения могут совместно извлекать отличительный признак изображения лица более иерархически и в большем количестве, с тем, чтобы выносить совместное решение, чтобы получать более точный результат обнаружения витальности лица.

[0058] В этом варианте осуществления настоящей заявки соответствующие наборы обучающих данных и/или соответствующие структуры сетей глубокого обучения являются различными, так что первая модель глубокого обучения и вторая модель глубокого обучения могут быть по-разному чувствительными к различным отличительным признакам изображения.

[0059] Например, если первая модель глубокого обучения и вторая модель глубокого обучения основываются на сверточной нейронной сети, ядро свертки блока свертки в сверточной нейронной сети, на которой основывается первая модель глубокого обучения, может быть относительно большим, так что первая модель глубокого обучения извлекает отличительный признак структуры изображения для общего изображения лица. Соответственно, ядро свертки блока свертки в сверточной нейронной сети, на которой основывается вторая модель глубокого обучения, может быть относительно небольшим, так что вторая модель глубокого обучения извлекает отличительный признак материала изображения для извлеченного изображения лица. Следовательно, в этом примере, ядро свертки блока свертки в сверточной нейронной сети, на которой основывается первая модель глубокого обучения, больше по сравнению с ядром свертки блока свертки в сверточной нейронной сети, на которой основывается вторая модель глубокого обучения.

[0060] Следует отметить, что размер ядра свертки является просто примером параметра, который может влиять на чувствительность, и другой параметр сетевой структуры может также влиять на чувствительность.

[0061] В этом варианте осуществления настоящего изобретения, что касается этапа S303, обученная первая модель глубокого обучения и обученная вторая модель глубокого обучения совместно выносят решение, чтобы выполнять обнаружение витальности лица. Существует множество специальных способов решения. Например, отдельное решение выносится посредством отдельного использования первой модели глубокого обучения и второй модели глубокого обучения, и затем окончательный результат решения определяется посредством соединения всех отдельных результатов решения. В качестве другого примера, отдельное решение может быть сначала вынесено с помощью одной из первой модели глубокого обучения и второй модели глубокого обучения. Когда отдельный результат решения удовлетворяет особому условию, отдельный результат решения может быть непосредственно использован в качестве окончательного результата решения; иначе, решение всесторонне выносится в соединении с другой оставшейся моделью, чтобы получать окончательный результат решения; и т.д.

[0062] Если первый способ, описанный в предыдущем параграфе, используется, пример является следующим:

[0063] Например, что касается этапа S303, выполнение обнаружения витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения может включать в себя: получение общего изображения лица (которое, в целом, является изображением сканирования лица пользователя), собранного для обнаружения витальности лица; ввод обученной первой модели глубокого обучения в собранное обобщенное изображение лица для обработки, чтобы получать соответствующие первые данные прогнозирования; получение извлеченного изображения лица, вырезанного из собранного обобщенного изображения лица, и ввод обученной второй модели глубокого обучения для обработки, чтобы получать соответствующие вторые данные прогнозирования; и вынесение совместного решения на основе первых данных прогнозирования и вторых данных прогнозирования, чтобы получать результат обнаружения витальности лица для изображения сканирования лица пользователя.

[0064] Первые данные прогнозирования могут быть, например, описанной оценкой PA прогнозирования, а вторые данные прогнозирования могут быть, например, описанной оценкой PB прогнозирования. Несомненно, оценка прогнозирования является просто примером формы выражения первых данных прогнозирования и вторых данных прогнозирования, или может быть другая форма прогнозирования, например, значение вероятности или булево значение.

[0065] Вышеописанное является способом обнаружения витальности лица, предоставленным в этом варианте осуществления настоящего изобретения. Как показано на фиг. 5, на основе той же идеи изобретения, вариант осуществления настоящего изобретения дополнительно предоставляет соответствующее оборудование.

[0066] Фиг. 5 - это схематичный структурный чертеж, иллюстрирующий оборудование для обнаружения витальности лица, соответствующее фиг. 3, согласно варианту осуществления настоящего изобретения. Оборудование может быть расположено на объекте выполнения процедуры на фиг. 3, включающем в себя: модуль 501 обучения, сконфигурированный, чтобы: обучать первую модель глубокого обучения на основе общих изображений лиц; и обучать вторую модель глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц; и модуль 502 обнаружения, сконфигурированный, чтобы выполнять обнаружение витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0067] Необязательно, первая модель глубокого обучения и вторая модель глубокого обучения используют различные структуры сетей глубокого обучения.

[0068] Необязательно, различные структуры сетей глубокого обучения включают в себя по меньшей мере один из следующих параметров: количество слоев скрытых переменных, тип слоя скрытых переменных, количество нейронных узлов или размер ядра свертки блока свертки.

[0069] Необязательно, общее изображение лица включает в себя первую метку, и первая метка указывает, является ли общее изображение лица, соответствующее первой метке, изображением живого лица.

[0070] Обучение, посредством модуля 501 обучения, первой модели глубокого обучения на основе общих изображений лиц включает в себя: ввод, посредством модуля 501 обучения, первой модели глубокого обучения в общее изображение лица, когда первая модель глубокого обучения прогнозирует, на основе отличительного признака структуры изображения для общего изображения лица, является ли общее изображение лица изображением живого лица; и корректировку первой модели глубокого обучения на основе результата прогнозирования и первой метки общего изображения лица.

[0071] Необязательно, извлеченное изображение лица включает в себя вторую метку, и вторая метка указывает, является ли извлеченное изображение лица, соответствующее второй метке, изображением живого лица.

[0072] Обучение, посредством модуля 501 обучения, второй модели глубокого обучения на основе извлеченных изображений лиц, вырезанных из общих изображений лиц, включает в себя: получение, посредством модуля 501 обучения, извлеченного изображения лица, вырезанного из общего изображения лица; и ввод второй модели глубокого обучения в извлеченное изображение лица, когда вторая модель глубокого обучения прогнозирует, на основе отличительного признака материала изображения для извлеченного изображения лица, является ли извлеченное изображение лица изображением живого лица; и корректировку второй модели глубокого обучения на основе результата прогнозирования и второй модели извлеченного изображения лица.

[0073] Необязательно, первая модель глубокого обучения и вторая модель глубокого обучения основываются на сверточной нейронной сети.

[0074] Ядро свертки блока свертки в сверточной нейронной сети, на которой основывается первая модель глубокого обучения, больше ядра свертки блока свертки в сверточной нейронной сети, на которой основывается вторая модель глубокого обучения, так что первая модель глубокого обучения извлекает отличительный признак структуры изображения для общего изображения лица, а вторая модель глубокого обучения извлекает отличительный признак материала изображения для извлеченного изображения лица.

[0075] Необязательно, выполнение, посредством модуля 502 обнаружения, обнаружения витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения включает в себя: получение, посредством модуля 502 обнаружения, общего изображения лица, собранного для обнаружения витальности лица; ввод обученной первой модели глубокого обучения в собранное общее изображение лица для обработки, чтобы получать соответствующие первые данные прогнозирования; получение извлеченного изображения лица, вырезанного из собранного общего изображения лица, и ввод обученной второй модели глубокого обучения для обработки, чтобы получать соответствующие вторые данные прогнозирования; и вынесение совместного решения на основе первых данных прогнозирования и вторых данных прогнозирования, чтобы получать результат обнаружения витальности лица для изображения сканирования лица пользователя.

[0076] На основе той же идеи изобретения вариант осуществления настоящего изобретения дополнительно предоставляет соответствующее электронное устройство, включающее в себя: по меньшей мере, один процессор; и память, функционально соединенную с по меньшей мере одним процессором.

[0077] Память хранит инструкцию, которая может исполняться посредством по меньшей мере одного процессора, и инструкция исполняется посредством по меньшей мере одного процессора, чтобы предоставлять возможность по меньшей мере одному процессору: обучать первую модель глубокого обучения на основе общих изображений лица; обучать вторую модель глубокого обучения на основе извлеченных изображений лица, вырезанных из общих изображений лица; и выполнять обнаружение витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0078] На основе той же идеи изобретения вариант осуществления настоящего изобретения дополнительно предоставляет соответствующий энергонезависимый компьютерный носитель хранения, где энергонезависимый компьютерный носитель хранения хранит компьютерную исполняемую инструкцию, и компьютерная исполняемая инструкция задается, чтобы: обучать первую модель глубокого обучения на основе общих изображений лица; обучать вторую модель глубокого обучения на основе извлеченных изображений лица, вырезанных из общих изображений лица; и выполнять обнаружение витальности лица на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения.

[0079] Варианты осуществления в этой спецификации, все описываются постепенным образом, что касается одинаковых или аналогичных частей в вариантах осуществления, ссылка может быть выполнена на эти варианты осуществления, и каждый вариант осуществления фокусируется на отличии от других вариантов осуществления. В частности, вариант осуществления оборудования, вариант осуществления электронного устройства, вариант осуществления энергонезависимого компьютерного носителя хранения, в основном являются аналогичными варианту осуществления способа, и, следовательно, описывается вкратце; что касается связанных частей, ссылка выполняется на частичные описания в варианте осуществления способа.

[0080] Оборудование, электронное устройство и энергонезависимый компьютерный носитель хранения, предоставленные в вариантах осуществления настоящего изобретения, соответствуют способу. Следовательно, оборудование, электронное устройство и энергонезависимый компьютерный носитель хранения также имеют полезные технические эффекты, аналогичные полезному техническому эффекту соответствующего способа. Полезный технический эффект способа описывается подробно выше, так что полезные технические эффекты соответствующего оборудования, электронного устройства и энергонезависимого компьютерного носителя хранения не описываются здесь снова.

[0081] В 1990-ых годах то, является ли улучшение технологии улучшением аппаратных средств (например, улучшением схемной структуры, такой как диод, транзистор или переключатель) или улучшением программного обеспечения (улучшением процедуры способа), могло очевидно различаться. Однако, поскольку технологии развиваются, улучшение множества текущих процедур способа может считаться непосредственным улучшением структуры схемы аппаратных средств. Разработчик обычно программирует улучшенную процедуру способа в аппаратную схему, чтобы получать соответствующую структуру аппаратной схемы. Следовательно, процедура способа может быть улучшена посредством объектных модулей аппаратных средств. Например, программируемое логическое устройство (PLD) (например, программируемая пользователем вентильная матрица (FPGA)) является такой интегральной схемой, и логическая функция программируемого логического устройства определяется пользователем посредством программирования устройства. Разработчик выполняет программирование, чтобы "интегрировать" цифровую систему в PLD без необходимости производителю микросхемы проектировать и создавать кристалл специализированной интегральной схемы. Кроме того, программирование, главным образом, реализуется посредством модификации программного обеспечения "логического компилятора" вместо ручного создания кристалла интегральной схемы. Это является аналогичным программному компилятору, используемому для разработки и составления программы. Однако, исходный код, полученный перед компиляцией, также пишется на специальном языке программирования, и это называется языком описания аппаратных средств (языком описания аппаратных средств, HDL). Однако, существуют различные HDL, такие как ABEL (усовершенствованный язык булевых выражений), AHDL (язык описания аппаратных средств фирмы Altera), Confluence, CUPL (язык программирования Корнелльского университета), HDCal, JHDL (язык программирования аппаратных средств Java), Lava, Lola, MyHDL, PALASM и RHDL (язык описания аппаратных средств Ruby). В настоящее время, VHDL (язык описания аппаратных средств на быстродействующих интегральных схемах) и Verilog являются наиболее популярными. Специалист в области техники должен также понимать, что только логическое программирование должно выполняться по процедуре способа с помощью описанных нескольких языков описания аппаратных средств, и несколько языков описания аппаратных средств программируются в интегральную схему, так что аппаратная схема, которая реализует логическую процедуру способа, может быть легко получена.

[0082] Контроллер может быть реализован любым подходящим образом. Например, контроллер может использовать микропроцессор или процессор и может хранить формы компьютерно-читаемого носителя, логического вентиля, переключателя, специализированной интегральной схемы (ASIC), программируемого логического контроллера и встроенного микроконтроллера, которые существуют для компьютерного читаемого программного кода (например, программного обеспечения или аппаратных средств), который может исполняться посредством (микро) процессора. Примеры контроллера включают в себя, но не только, следующие микроконтроллеры: ARC 625D, Atmel AT91SAM, Microchip PIC18F26K20, или Silicone Labs C8051F320. Контроллер памяти может также быть реализован как часть логики управления памяти. Специалист в области техники также знает, что, в дополнение к реализации контроллера чисто в виде компьютерного исполняемого программного кода, логическое программирование может полностью выполняться с помощью этапа способа, так что контроллер реализует ту же функцию в форме логического вентиля, переключателя, специализированной интегральной схемы, программируемого логического контроллера, встроенного микроконтроллера и т.д. Следовательно, контроллер может считаться компонентом аппаратных средств, и оборудование для реализации различных функций в контроллере может также считаться структурой в компоненте аппаратных средств. Альтернативно, оборудование, сконфигурированное для реализации различных функций, может считаться программным модулем или структурой в компоненте аппаратных средств, которые могут реализовывать способ.

[0083] Система, оборудование, модуль или блок, описанные в описанных вариантах осуществления, могут быть реализованы посредством компьютерной микросхемы или объекта или реализованы посредством продукта с функцией. Типичное устройство для реализации является компьютером. В частности, компьютер может быть, например, персональным компьютером, портативным компьютером, сотовым телефоном, камерофоном, смартфоном, персональным цифровым помощником, мультимедийным проигрывателем, навигационным устройством, устройством электронной почты, игровой консолью, планшетным компьютером или носимым устройством или сочетанием любых из этих устройств.

[0084] Для легкости описания, описанное оборудование описывается посредством разделения функций на различные блоки. Несомненно, когда настоящая заявка реализуется, функции каждого блока могут быть реализованы в одной или более частях программного обеспечения и/или аппаратных средств.

[0085] Специалист в области техники должен понимать, что варианты осуществления настоящего изобретения могут быть предоставлены как способ, система или компьютерный программный продукт. Следовательно, настоящее изобретение может использовать форму только аппаратных вариантов осуществления, только программных вариантов осуществления или вариантом осуществления с сочетанием программного обеспечения и аппаратных средств. Кроме того, настоящее изобретение может использовать форму компьютерного программного продукта, который реализуется на одном или более компьютерно-используемых носителях хранения (включающих в себя, но не только, память на дисках, CD-ROM, оптическую память и т.д.), которые включают в себя компьютерно-используемый программный код.

[0086] Настоящее изобретение описывается со ссылкой на блок-схемы последовательности операций и/или блок-схемы способа, устройство (систему) и компьютерный программный продукт согласно вариантам осуществления настоящего изобретения. Следует понимать, что компьютерные программные инструкции могут быть использованы, чтобы реализовывать каждый процесс и/или каждый блок в блок-схемах последовательности операций и/или блок-схемах и сочетание процесса и/или блока в блок-схемах последовательности операций и/или блок-схемах. Эти компьютерные программные инструкции могут быть предоставлены для компьютера общего назначения, специализированного компьютера, встроенного процессора или процессора любого другого программируемого устройства обработки данных, чтобы создавать автомат, так что инструкции, исполняемые компьютером или процессором любого другого программируемого устройства обработки данных, создавать оборудование для реализации конкретной функции в одном или более процессах в блок-схемах последовательности операций или в одном или более блоках в блок-схемах.

[0087] Эти компьютерные программные инструкции могут быть сохранены в компьютерно-читаемой памяти, которые может инструктировать компьютеру или любому другому программируемому устройству обработки данных работать особым образом, так что инструкции, сохраненные в компьютерно-читаемой памяти, создают изделие, которое включает в себя инструктирующее оборудование. Инструктирующее оборудование реализует особую функцию в одном или более процессах в блок-схемах последовательности операций и/или в одном или более блоках в блок-схемах.

[0088] Эти компьютерные программные инструкции могут быть загружены в компьютер или другое программируемое устройство обработки данных, так что последовательности операций и этапов выполняются на компьютере или другом программируемом устройстве, таким образом, создавая компьютерно-реализованную обработку. Следовательно, инструкции, исполняемые на компьютере или другом программируемом устройстве, предоставляют этапы для реализации особой функции в одном или более процессах в блок-схемах последовательности операций или в одном или более блоках в блок-схемах.

[0089] В типичной конфигурации вычислительное устройство включает в себя один или более процессоров (CPU), интерфейс ввода/вывода, сетевой интерфейс и память.

[0090] Память может включать в себя форму энергозависимой памяти, оперативного запоминающего устройства (RAM), и/или энергонезависимой памяти и т.д. на компьютерно-читаемом носителе, такой как постоянное запоминающее устройство (ROM) или флеш-память (flash RAM). Память является примером компьютерно-читаемого носителя.

[0091] Компьютерно-читаемый носитель включает в себя энергозависимые и энергонезависимые, съемные и несъемные носители и может хранить информацию с помощью любого способа или технологии. Информация может быть компьютерно-читаемой инструкцией, структурой данных, программным модулем или другими данными. Примеры компьютерно-читаемого носителя включают в себя, но не только, оперативное запоминающее устройство с фазовым переходом (PRAM), статическое оперативное запоминающее устройство (SRAM), динамическое оперативное запоминающее устройство (DRAM), оперативное запоминающее устройство (RAM) другого типа, постоянное запоминающее устройство (ROM), электрически стираемое программируемое постоянное запоминающее устройство (EEPROM), флеш-память или другую технологию памяти, постоянное запоминающее устройство на компакт-дисках (CD-ROM), цифровой универсальный диск (DVD) или другой оптический накопитель, магнитную ленту, накопитель на магнитном диске, другое магнитное запоминающее устройство или любой другой носитель не для передачи сигналов. Компьютерный носитель хранения может быть использован для хранения информации, к которой может быть осуществлен доступ посредством вычислительного устройства. Как описано в этой спецификации, компьютерно-читаемый носитель не включает в себя временную среду передачи (временную среду передачи), например, модулированный информационный сигнал и несущую частоту.

[0092] Следует дополнительно отметить, что выражения "включает в себя", "содержит" или их любой другой вариант предназначен, чтобы охватывать неисключающее включение, так что процесс, способ, изделие или устройство, которое включает в себя последовательность элементов, не только включает в себя эти каждый из элементов, но также включает в себя другие элементы, которые явно не перечислены, или дополнительно включает в себя элементы, присущие такому процессу, способу, изделию или устройству. Элемент, которому предшествует "включает в себя…", не исключает заранее, без большего числа ограничений, существование дополнительных идентичных элементов в процессе, способе, изделии или устройстве, которое включает в себя элемент.

[0093] Настоящее изобретение может быть описано в общих контекстах компьютерных исполняемых инструкций, исполняемых компьютером, таким как программный модуль. Как правило, программный модуль включает в себя алгоритм, программу, объект, компонент, структуру данных и т.д., исполняющие конкретную задачу или реализующие конкретный абстрактный тип данных. Настоящее изобретение может также быть применено на практике в распределенных вычислительных окружениях. В этих распределенных вычислительных окружениях задачи исполняются посредством удаленных устройств обработки, которые соединяются с помощью сети передачи данных. В распределенных вычислительных средах программный модуль может находиться на локальных и удаленных компьютерных носителях хранения, которые включают в себя запоминающие устройства.

[0094] Варианты осуществления в этой спецификации, все описываются постепенным образом, что касается одинаковых или аналогичных частей в вариантах осуществления, ссылка может быть выполнена на эти варианты осуществления, и каждый вариант осуществления фокусируется на отличии от других вариантов осуществления. В частности, вариант осуществления системы, в основном, является аналогичным варианту осуществления способа и, следовательно, описывается кратко; что касается связанных частей, ссылка может быть выполнена на частичные описания в варианте осуществления способа.

[0095] Предыдущие описания являются просто вариантами осуществления настоящего изобретения и не предназначены, чтобы ограничивать настоящее изобретение. Для специалиста в области техники настоящее изобретение может иметь различные модификации и изменения. Любые модификации, эквивалентные замены, улучшения и т.д., выполненные в духе и принципе настоящего изобретения, должны попадать в рамки защиты настоящего изобретения.

[0096] Фиг. 6 - это блок-схема последовательности операций, иллюстрирующая пример компьютерно-реализованного способа 600 для определения аутентичности пользователя с помощью обнаружения витальности лица, согласно реализации настоящего изобретения. Для ясности представления, нижеприведенное описание, в общем, описывает способ 600 в контексте других чертежей в этом описании. Тем не менее, следует понимать, что способ 600 может осуществляться, например, посредством любой системы, окружения, программного обеспечения и аппаратных средств либо комбинации систем, окружений, программного обеспечения и аппаратных средств, надлежащим образом. В некоторых реализациях, различные этапы способа 600 могут выполняться параллельно, в комбинации, циклически или в любом порядке.

[0097] На этапе 602 первая модель глубокого обучения обучается, чтобы классифицировать общие изображения лиц. Общие изображения лиц классифицируются, по меньшей мере, на изображения живых лиц и изображения неживых лиц. В некоторых реализациях изображения живых лиц считаются положительными образцами, а изображения неживых лиц считаются отрицательными образцами. В некоторых реализациях первая модель глубокого обучения является моделью классификации, и общие изображения лиц используются в качестве входных данных для первой модели глубокого обучения. Обучение первой модели глубокого обучения улучшает точность классификации относительно общих изображений лиц.

[0098] В некоторых реализациях конкретное общее изображение лица включает в себя первую метку, указывающую, является ли конкретное общее изображение лица, соответствующее первой метке, изображению живого лица. В некоторых реализациях обучение первой модели глубокого обучения включает в себя: 1) ввод конкретного общего изображения лица в первую модель глубокого обучения, чтобы формировать первый результат прогнозирования, на основе отличительного признака структуры изображения для конкретного общего изображения лица, является ли конкретное общее изображение лица изображением живого лица, и 2) корректировку первой модели глубокого обучения на основе первого результата прогнозирования и первой метки. От 602, способ 600 переходит к 604.

[0099] На этапе 604 вырезанные изображения лиц извлекаются из общих изображений лиц. В некоторых реализациях конкретное вырезанное изображение лица включает в себя вторую метку, и вторая метка указывает, является ли конкретное вырезанное изображение лица, соответствующее второй метке, изображением живого лица. В некоторых реализациях обучение второй модели глубокого обучения на основе вырезанного изображения лица включает в себя: 1) получение конкретного вырезанного изображения лица; 2) ввод конкретного вырезанного изображения лица во вторую модель глубокого обучения, чтобы формировать второй результат прогнозирования, на основе отличительного признака материала изображения для конкретного вырезанного изображения лица, того, является ли конкретное вырезанное изображение лица изображением живого лица; и 3) корректировку второй модели глубокого обучения на основе второго результата прогнозирования и второй метки. От 604, способ 600 переходит к 606.

[00100] На этапе 606 вторая модель глубокого обучения обучается на основе вырезанных изображений лиц. От 606, способ 600 переходит к 608.

[00101] На этапе 608 обнаружение витальности лица выполняется на основе обученной первой модели глубокого обучения и обученной второй модели глубокого обучения. В некоторых реализациях первая модель глубокого обучения и вторая модель глубокого обучения основываются на сверточной нейронной сети, и при этом ядро свертки блока свертки в сверточной нейронной сети первой модели глубокого обучения больше ядра свертки блока свертки в сверточной нейронной сети второй модели глубокого обучения. После этапа 608 способ 600 останавливается.

[00102] В некоторых реализациях обнаружение витальности лица включает в себя: 1) получение общего изображения лица; 2) ввод общего изображения лица в обученную первую модель глубокого обучения, чтобы получать соответствующие первые данные прогнозирования; 3) получение вырезанного изображения лица из общего изображения лица; 4) ввод вырезанного изображения лица в обученную вторую модель глубокого обучения, чтобы получать соответствующие вторые данные прогнозирования; и 5) вынесение совместного решения на основе первых данных прогнозирования и вторых данных прогнозирования, чтобы получать результат обнаружения витальности лица. От 608, способ 600 переходит к 610.

[00103] Реализации предмета изобретения, описанного в этом подробном описании, могут реализовываться таким образом, чтобы реализовывать конкретные преимущества или технические эффекты. Описанное обнаружение витальности лица может быть использовано, чтобы улучшать процессы аутентификации и обеспечивать защиту данных. Например, описанный способ может быть использован, чтобы различать между изображениями живого и неживого лица человека, чтобы помогать избегать мошенничества и злонамеренного поведения относительно защищенных данных. Описанный способ может быть встроен в вычислительные устройства (такие как мобильные вычислительные устройства и цифровые устройства формирования изображений).

[00104] Результат витальности лица может быть отображен на графическом пользовательском интерфейсе. На основе результата витальности лица определение того, выполнять ли последующие действия (например, разблокировку защищенных данных, работу приложения системы программного обеспечения, сохранение данных, отправку данных по сети или отображение данных на графическом пользовательском интерфейсе).

[00105] Описанная методология предоставляет возможность улучшения различных транзакций мобильного вычислительного устройства и общую безопасность транзакции/данных. Участники транзакции, использующие мобильные вычислительные устройства, могут быть уверены, что изображения, используемые для разблокировки мобильного вычислительного устройства или авторизации транзакции, являются действительными, и что они не будут жертвой мошенничества.

[00106] Описанная технология может обеспечивать эффективное использование компьютерных ресурсов (например, циклов обработки, использования полосы пропускания сети и запоминающего устройства), посредством эффективного подтверждения данных/транзакции. По меньшей мере, эти действия могут минимизировать или предотвращать трату доступных компьютерных ресурсов относительно множества участников в мобильных вычислительных транзакциях, предотвращая нежелательные/мошеннические транзакции. Вместо необходимости пользователям проверять данные с помощью дополнительного поиска или транзакций, транзакции могут быть в зависимости от действительности.

[00107] В некоторых реализациях графический пользовательский интерфейс может быть проанализирован, чтобы гарантировать, что графические элементы, используемые в операциях обнаружения витальности лица (например, сканирование и подтверждение витальности человеческого лица с помощью мобильного вычислительного устройства), могут быть расположены на графических пользовательских интерфейсах, чтобы быть наименее назойливыми для пользователя (например, чтобы перекрывать наименьший объем данных и избегать покрытия каких-либо критических или часто используемых элементов графического пользовательского интерфейса).

[00108] Варианты осуществления и операции, описанные в этом подробном описании, могут реализовываться в цифровой электронной схеме или в компьютерном программном обеспечении, микропрограммном обеспечении или аппаратных средствах, включающих в себя структуры, раскрытые в этом подробном описании, либо в комбинациях одного или более из означенного. Операции могут реализовываться как операции, выполняемые посредством оборудования обработки данных для данных, сохраненных на одном или более машиночитаемых устройств хранения данных или принимаемых из других источников. Оборудование обработки данных, компьютер или вычислительное устройство может охватывать оборудование, устройства и машины для обработки данных, включающие в себя в качестве примера программируемый процессор, компьютер, систему на кристалле либо несколько вышеприведенных компонентов, либо комбинации из них. Оборудование может включать в себя логическую схему специального назначения, например, центральный процессор (CPU), программируемую пользователем вентильную матрицу (FPGA) или специализированную интегральную схему (ASIC). Оборудование также может включать в себя код, который создает окружение выполнения для рассматриваемой компьютерной программы, например, код, который составляет микропрограммное обеспечение процессора, стек протоколов, систему управления базами данных, операционную систему (например, операционную систему или комбинацию операционных систем), кросс-платформенное окружение выполнения, виртуальную машину либо комбинацию одного или более из означенного. Оборудование и окружение выполнения могут реализовывать всевозможные инфраструктуры вычислительных моделей, такие как веб-услуги, распределенные вычислительные и сетевые параллельные вычислительные инфраструктуры.

[00109] Компьютерная программа (также известная, например, в качестве программы, программного обеспечения, приложения, программного модуля, программного блока, сценария или кода) может быть написана на любой форме языка программирования, включающей в себя компилированные или интерпретируемые языки, декларативные или процедурные языки, и она может развертываться в любой форме, в том числе в качестве автономной программы или в качестве модуля, компонента, вложенной процедуры, объекта либо другого блока, подходящего для использования в вычислительном окружении. Программа может сохраняться в части файла, который хранит другие программы или данные (например, один или более сценариев, сохраненных в документе на языке разметки), в одном файле, выделенном для рассматриваемой программы, либо в нескольких координированных файлах (например, в файлах, которые сохраняют один или более модулей, подпрограмм или частей кода). Компьютерная программа может выполняться на одном компьютере или на нескольких компьютерах, которые расположены на одном веб-узле или распределены по нескольким веб-узлам и взаимно соединяются посредством сети связи.

[00110] Процессоры для выполнения компьютерной программы включают в себя, в качестве примера, микропроцессоры общего и специального назначения и любые один или более процессоров любого вида цифрового компьютера. В общем, процессор принимает инструкции и данные из постоянного запоминающего устройства или оперативного запоминающего устройства, или из того и из другого. Существенные элементы компьютера представляют собой процессор для выполнения действий в соответствии с инструкциями и одно или более запоминающих устройств для сохранения инструкций и данных. Обычно, компьютер также должен включать в себя или функционально соединяться с возможностью принимать данные или передавать данные либо выполнять и то, и другое из/в одно или более устройств хранения данных большой емкости для сохранения данных. Компьютер может встраиваться в другое устройство, например, в мобильное устройство, персональное цифровое устройство (PDA), игровую приставку, приемное устройство на основе глобальной системы позиционирования (GPS) или портативное устройство хранения данных. Устройства, подходящие для сохранения компьютерных программных инструкций и данных, включают в себя энергонезависимое запоминающее устройство, носители и запоминающие устройства, включающие в себя, в качестве примера, полупроводниковые запоминающие устройства, магнитные диски и магнитооптические диски. Процессор и запоминающее устройство могут дополняться посредством или включаться в логическую схему специального назначения.

[00111] Мобильные устройства могут включать в себя переносные телефоны, абонентские устройства (UE), мобильные телефоны (например, смартфоны), планшетные компьютеры, носимые устройства (например, интеллектуальные часы и интеллектуальные очки), имплантируемые устройства в человеческом теле (например, биодатчики, кохлеарные имплантаты) либо другие типы мобильных устройств. Мобильные устройства могут обмениваться данными в беспроводном режиме (например, с использованием радиочастотных (RF) сигналов) с различными сетями связи (описаны ниже). Мобильные устройства могут включать в себя датчики для определения характеристик текущего окружения мобильного устройства. Датчики могут включать в себя камеры, микрофоны, бесконтактные датчики, GPS-датчики, датчики движения, акселерометры, датчики окружающего света, датчики содержания влаги, гироскопы, компасы, барометры, датчики отпечатков пальцев, системы распознавания лиц, RF-датчики (например, Wi-Fi- и сотовые радиомодули), тепловые датчики или другие типы датчиков. Например, камеры могут включать в себя обращенную по ходу движения или против движения камеру с подвижными или неподвижными линзами, флэш-памятью, датчиком изображений и процессором изображений. Камера может представлять собой мегапикселную камеру, допускающую захват деталей для распознавания лиц и/или радужной оболочки глаз. Камера наряду с процессором данных и аутентификационной информацией, сохраненной в запоминающем устройстве или доступной удаленно, может формировать систему распознавания лиц. Система распознавания лиц либо один или более датчиков, например, микрофонов, датчиков движения, акселерометров, GPS-датчиков или RF-датчиков, могут использоваться для аутентификации пользователя.

[00112] Чтобы предоставлять взаимодействие с пользователем, варианты осуществления могут реализовываться на компьютере, имеющем устройство отображения и устройство ввода, например, жидкокристаллический дисплей (ЖК-дисплей) или дисплей на органических светоизлучающих диодах (OLED)/в стиле виртуальной реальности (VR)/в стиле дополненной реальности (AR) для отображения информации пользователю и сенсорный экран, клавиатуру и указательное устройство, посредством которых пользователь может предоставлять ввод в компьютер. Другие виды устройств также могут использоваться для того, чтобы предоставлять взаимодействие с пользователем; например, обратная связь, предоставленная пользователю, может представлять собой любую форму сенсорной обратной связи, например, визуальную обратную связь, акустическую обратную связь или тактильную обратную связь; и ввод от пользователя может приниматься в любой форме, включающей в себя акустический, речевой или тактильный ввод. Помимо этого, компьютер может взаимодействовать с пользователем посредством отправки документов и приема документов из устройства, которое используется пользователем; например, посредством отправки веб-страниц в веб-браузер на клиентском устройстве пользователя в ответ на запросы, принимаемые из веб-браузера.

[00113] Варианты осуществления могут реализовываться с использованием вычислительных устройств, взаимно соединенных посредством любой формы или среды для проводной или беспроводной цифровой передачи данных (либо комбинации вышеозначенного), например, сети связи. Примеры взаимно соединенных устройств представляют собой клиент и сервер, в общем, удаленные друг от друга, которые типично взаимодействуют через сеть связи. Клиент, например, мобильное устройство, может выполнять транзакции непосредственно, с сервером или через сервер, например, выполнять транзакции покупки, продажи, оплаты, выдачи, отправки или ссуды либо авторизовать их. Такие транзакции могут выполняться в реальном времени таким образом, что действие и ответ являются близкими по времени; например, человек воспринимает действие и ответ как возникающие практически одновременно, разность времен для ответа после действия человека составляет меньше 1 миллисекунды (мс) или меньше 1 секунды (с), либо ответ осуществляется без намеренной задержки с учетом ограничений обработки системы.

[00114] Примеры сетей связи включают в себя локальную вычислительную сеть (LAN), сеть радиодоступа (RAN), общегородскую вычислительную сеть (MAN) и глобальную вычислительную сеть (WAN). Сеть связи может включать в себя все или часть из Интернета, другой сети связи либо комбинации сетей связи. Информация может передаваться по сети связи согласно различным протоколам и стандартам, включающим в себя стандарт долгосрочного развития (LTE), 5G, IEEE 802, Интернет-протокол (IP) либо другие протоколы или комбинации протоколов. Сеть связи может передавать голосовые, видео-, биометрические данные или аутентификационные данные или другую информацию между соединенными вычислительными устройствами.

Признаки, описанные в качестве отдельных реализаций, могут реализовываться, в комбинации, в одной реализации, в то время как признаки, описанные в качестве одной реализации, могут реализовываться в нескольких реализациях, отдельно или в любой подходящей субкомбинации. Операции, описанные и заявленные в конкретном порядке, не должны пониматься ни как требующие этого конкретного порядка, ни как то, что все проиллюстрированные операции должны выполняться (некоторые операции могут быть необязательными). Надлежащим образом, могут выполняться многозадачность или параллельная обработка (или комбинация многозадачности и параллельной обработки).

| название | год | авторы | номер документа |

|---|---|---|---|

| СПОСОБ ОПРЕДЕЛЕНИЯ ПОДЛИННОСТИ ЛИЦА ПО МАСКАМ СЕГМЕНТАЦИИ | 2021 |

|

RU2758966C1 |

| СПОСОБ, ТЕРМИНАЛ И СИСТЕМА ДЛЯ БИОМЕТРИЧЕСКОЙ ИДЕНТИФИКАЦИИ | 2023 |

|

RU2815689C1 |

| СПОСОБ ОТОБРАЖЕНИЯ ИНФОРМАЦИИ, УСТРОЙСТВО И НОСИТЕЛЬ ИНФОРМАЦИИ | 2021 |

|

RU2817182C1 |

| СЕГМЕНТАЦИЯ И ПРОГНОЗИРОВАНИЕ ВРЕМЕННЫХ ПАТТЕРНОВ ШЛЕЙФОВ НИЗКОГО УРОВНЯ | 2020 |

|

RU2783420C1 |

| СПОСОБ, ТЕРМИНАЛ И СИСТЕМА ДЛЯ БИОМЕТРИЧЕСКОЙ ИДЕНТИФИКАЦИИ | 2022 |

|

RU2798179C1 |

| СПОСОБ И УСТРОЙСТВО ДЛЯ АВТОНОМНОЙ АУТЕНТИФИКАЦИИ ЛИЧНОСТИ | 2017 |

|

RU2697638C1 |

| СИСТЕМА И СПОСОБ ОБРАБОТКИ ИЗОБРАЖЕНИЙ С ИСПОЛЬЗОВАНИЕМ ГЛУБИННЫХ НЕЙРОННЫХ СЕТЕЙ | 2018 |

|

RU2743931C1 |

| СИСТЕМЫ И СПОСОБЫ ОЦЕНКИ ЖИЗНЕСПОСОБНОСТИ ЭМБРИОНОВ | 2018 |

|

RU2800079C2 |

| СИСТЕМА ДЛЯ ИДЕНТИФИКАЦИИ ПОЛЬЗОВАТЕЛЯ | 2024 |

|

RU2835760C1 |

| БЫСТРОЕ ВЫЧИСЛЕНИЕ СВЕРТОЧНОЙ НЕЙРОННОЙ СЕТИ | 2018 |

|

RU2722473C1 |

Настоящее изобретение относится к области вычислительной техники. Технический результат заключается в улучшении точности результата обнаружения витальности лица. Первая модель глубокого обучения обучается на основе общих изображений лиц. Вторая модель глубокого обучения обучается на основе извлеченных изображений лиц, вырезанных из общих изображений лиц. Обнаружение витальности лица выполняется на основе обученной первой модели глубокого обучения, чтобы получать первую оценку прогнозирования, и обученной второй модели глубокого обучения, чтобы получать вторую оценку прогнозирования. Результат оценки прогнозирования формируется на основе первой оценки прогнозирования и второй оценки прогнозирования, и результат оценки прогнозирования сравнивается с пороговым значением, чтобы определять результат обнаружения витальности лица для извлеченных изображений лиц. 3 н. и 5 з.п. ф-лы, 6 ил.

1. Способ распознавания лица для определения того, является ли изображение, которое включает в себя лицо, живым изображением или неживым изображением, способ содержит этапы, на которых:

обучают первую модель глубокого обучения посредством контролируемого обучения по множеству общих изображений лиц (S301), общие изображения лиц содержат изображения живых лиц, собранные посредством съемки живого лица и помеченные как положительные образцы, и изображения неживых лиц, собранные посредством съемки неживого лица, которое является изображением лица или моделью лица, и помеченные как отрицательные образцы;

обучают множество вторых моделей глубокого обучения посредством контролируемого обучения по множеству извлеченных изображений лиц, вырезанных из общих изображений лиц (S302), вторые модели глубокого обучения содержат модель глубокого обучения для глаза и модель глубокого обучения для носа, соответствующие глазному и носовому типу области лица соответственно, извлеченные изображения лиц содержат изображения живых лиц, помеченные как положительные образцы, и изображения неживых лиц и помеченные как отрицательные образцы, при этом первая модель глубокого обучения и каждая из вторых моделей глубокого обучения являются моделями классификации, и при этом после обучения модели классифицируют изображения лиц на категорию изображения живого лица или категорию изображения неживого лица;

выполняют обнаружение витальности лица по первому общему изображению лица с помощью обученной первой модели глубокого обучения, чтобы получать первую оценку прогнозирования, и множества обученных вторых моделей глубокого обучения, чтобы получать вторые оценки прогнозирования (S303), причем данный этап содержит этапы, на которых:

получают первое общее изображение лица, собранное для обнаружения витальности лица,

вводят первое общее изображение лица в обученную первую модель глубокого обучения для обработки, чтобы получать первую оценку прогнозирования,

получают множество извлеченных изображений лиц, вырезанных из первого общего изображения лица, причем извлеченные изображения лиц содержат изображение области с изображением глаза и изображение области с изображением носа, и вводят извлеченные изображения лиц в соответствующие обученные вторые модели глубокого обучения для обработки, причем вторые модели глубокого обучения содержат модель глубокого обучения для глаза и модель глубокого обучения для носа, чтобы получать вторые оценки прогнозирования,

формируют результат оценки прогнозирования на основе первой оценки прогнозирования и вторых оценок прогнозирования и

сравнивают результат оценки прогнозирования с пороговым значением, чтобы определять, является ли первое общее изображение лица живым изображением или неживым изображением.

2. Способ по п. 1, при этом первая модель глубокого обучения и вторая модель глубокого обучения используют различные структуры сетей глубокого обучения.

3. Способ по п. 2, при этом различные структуры сетей глубокого обучения содержат по меньшей мере один из следующих параметров: количество слоев скрытых переменных, тип слоя скрытых переменных, количество нейронных узлов или размер ядра свертки блока свертки.

4. Способ по любому из пп. 1-3, при этом формирование результата оценки прогнозирования на основе первой оценки прогнозирования и вторых оценок прогнозирования содержит этап, на котором формируют результат оценки прогнозирования как сумму первой оценки прогнозирования и вторых оценок прогнозирования.

5. Способ по любому из пп. 1-3, при этом первая модель глубокого обучения и вторая модель глубокого обучения основываются на сверточной нейронной сети; и

ядро свертки блока свертки в сверточной нейронной сети, на которой основывается первая модель глубокого обучения, является относительно большим, так что первая модель глубокого обучения извлекает отличительный признак структуры изображения для общего изображения лица, а ядро свертки блока свертки в сверточной нейронной сети, на которой основывается вторая модель глубокого обучения, является относительно небольшим, так что вторая модель глубокого обучения извлекает отличительный признак материала изображения для извлеченного изображения лица.

6. Способ по любому из пп. 1-7, при этом все оценки прогнозирования являются значением вероятности или булевым значением.

7. Оборудование для распознавания лица, содержащее множество модулей, сконфигурированных, чтобы выполнять способ по любому из пп. 1-6.

8. Электронное устройство для распознавания лица, содержащее:

по меньшей мере один процессор и

память, функционально соединенную с по меньшей мере одним процессором, при этом память хранит инструкцию, которая может быть выполнена по меньшей мере одним процессором, и инструкция исполняется по меньшей мере одним процессором, чтобы инструктировать по меньшей мере одному процессору выполнять способ по любому из пп. 1-6.

| US 2017053174 A1, 23.02.2017 | |||

| CN 105874474 A, 17.08.2016 | |||

| US 2016062456 A1, 03.03.2016 | |||

| CN 103440479 B, 28.12.2016 | |||

| KR 20150128510 A, 18.11.2015. |

Авторы

Даты

2020-02-11—Публикация

2018-06-07—Подача