[0001] Данная заявка притязает на приоритет заявки на патент (Европа) номер 20178044.2; и предварительной заявки (США) номер 63/034,006, обе из которых поданы 3 июня 2020 года, каждая из которых полностью содержится в данном документе по ссылке.

Уровень техники

1. Область техники, к которой относится изобретение

[0002] Данная заявка, в общем, относится к изображениям; более конкретно, данная заявка относится к формированию метаданных для управления отображением в связи с видеоконтентом.

2. Описание предшествующего уровня техники

[0003] При использовании в данном документе, термин "динамический диапазон (DR)" может относиться к способности зрительной системы человека (HVS) воспринимать диапазон интенсивности (например, яркость, сигнал яркости) в изображении, например, от самых темно-черных цветов (наиболее темные участки) до самых ярких белых цветов (ярких участков изображений). В этом смысле, DR относится к "связанной со сценой" интенсивности. DR также может относиться к способности устройства отображения адекватно или приблизительно подготавливать посредством рендеринга диапазон интенсивности конкретной широты. В этом смысле, DR относится к "связанной со отображением" интенсивности. Если конкретный смысл явно не указывается как имеющий конкретную значимость в любой точке в описании в данном документе, необходимо сделать вывод, что термин может использоваться в любом смысле, например, взаимозаменяемо.

[0004] При использовании в данном документе, термин "расширенный динамический диапазон (HDR)" относится к DR-широте, которая охватывает приблизительно 14-15 или более порядков величины HVS. На практике, DR, по которому человек может одновременно воспринимать обширную широту в диапазоне интенсивности, может в определенной степени усекаться, относительно HDR. При использовании в данном документе, термины "улучшенный динамический диапазон (EDR)" или "визуальный динамический диапазон (VDR)" могут отдельно или взаимозаменяемо относиться к DR, который является воспринимаемым в сцене или изображении посредством HVS, который включает в себя перемещения глаз, обеспечивая некоторые изменения адаптации к свету в сцене или изображении. При использовании в данном документе, EDR может относиться к DR, который охватывает 5-6 порядков величины. Таким образом, хотя возможно и является в определенной степени более узким относительно отнесенного HDR истинной сцены, тем не менее, EDR представляет существенную DR-широту и также может называться "HDR".

[0005] На практике, изображения содержат один или более цветовых компонентов (например, RGB, сигнал Y яркости и сигнал Cb и Cr цветности), причем в квантованной цифровой системе каждый цветовой компонент представляется посредством точности в n битов в расчете на пиксел (например, n=8). Битовая глубина n≤8 (например, цветные 24-битовые JPEG-изображения) может использоваться с изображениями со стандартным динамическим диапазоном (SDR), тогда как битовая глубина n>8 может рассматриваться для изображений с улучшенным динамическим диапазоном (EDR), чтобы не допускать артефактов оконтуривания и лестницы. В дополнение к целочисленным типам данных, EDR-изображения и изображения с расширенным динамическим диапазоном (HDR) также могут сохраняться и распространяться с использованием высокоточных (например, 16-битовых) форматов с плавающей запятой, таких как OpenEXR-формат файлов, разработанный компанией Industrial Light and Magic.

[0006] Опорная электрооптическая передаточная функция (EOTF) для данного дисплея характеризует взаимосвязь между значениями цветов (например, яркостью) входного видеосигнала, чтобы выводить значения цветов экрана (например, яркость экрана), сформированные посредством дисплея. Например, ITU Rec. ITU-R BT.1886 "Reference electro-optical transfer function for flat panel displays used in HDTV studio production" (март 2011 года), которая полностью содержится в данном документе по ссылке, задает опорную EOTF для плоскопанельных дисплеев на основе измеренных характеристик электронно-лучевой трубки (CRT). С учетом видеопотока, информация относительно его EOTF типично встраивается в поток битов в качестве метаданных.

[0007] Многие бытовые настольные дисплеи подготавливают посредством рендеринга не-HDR-контент при максимальной яркости в 200-300 кд/см2 ("нит"), а бытовые телевизионные приемники высокой четкости и сверхвысокой четкости ("HDTV" и "телевизор UHD TV") - от 300 до 500 нит. Такой отображаемый вывод в силу этого наглядно показывает узкий динамический диапазон (LDR), также называемый "SDR", относительно HDR или EDR. По мере того, как доступность HDR- или EDR-контента растет вследствие усовершенствований как в оборудовании захвата изображений (например, в камерах), так и в HDR-дисплеях (например, в профессиональном опорном мониторе PRM-4200 компании Dolby Laboratories или в главном 4K HDR-мониторе Sony Trimaster HX 31''), HDR-контент может цветокорректироваться и отображаться на HDR-дисплеях, которые поддерживают более широкие динамические диапазоны (например, от 700 нит до 5000 нит или больше). Такие дисплеи могут задаваться с использованием альтернативных EOTF, которые поддерживают высокие характеристики яркости (например, от 0 до 10000 нит). Пример такой EOTF задается в работе SMPTE ST 2084:2014 "High Dynamic Range EOTF of Mastering Reference Displays", которая полностью содержится в данном документе по ссылке.

[0008] При использовании в данном документе, термин "управление отображением" обозначает обработку (например, преобразование тона и гаммы), требуемую для того, чтобы преобразовывать входной видеосигнал с первым динамическим диапазоном (например, 1000 нит) в дисплей со вторым динамическим диапазоном (например, 500 нит). Примеры процессов управления отображением описываются в PCT-заявке порядковый номер PCT/US2014/016304 (заявке '304), поданной 13 февраля 2014 года, "Display management for high dynamic range video", авторов R. El Atkins и другие, которая полностью содержится в данном документе по ссылке. Управление отображением может выполняться с помощью или управляться посредством входных метаданных, сформированных посредством источника входящего контента и мультиплексированных в кодированный поток битов.

[0009] Подходы, описанные в этом разделе, представляют собой подходы, которые могут рассматриваться, но не обязательно представляют собой подходы, которые заранее задуманы или рассмотрены. Следовательно, если не указано иное, не следует предполагать, что какой-либо из описанных в этом разделе подходов относится к предшествующему уровню техники просто в силу своего включения в этот раздел. Аналогично, проблемы, идентифицированные относительно одного или более подходов, не должны предполагаться как выявленные в предшествующем уровне техники на основе этого раздела, если не указано иное.

Краткая сущность изобретения

[0010] Различные аспекты настоящего раскрытия сущности относятся к устройствам, системам и способам для формирования метаданных, которые могут использоваться для того, чтобы предоставлять повышенное качество видео, повышенную временную стабильность, низкие требования по объему вычислений и уменьшенную задержку.

[0011] В одном аспекте настоящего раскрытия сущности, предусмотрен способ редактирования видеоконтента, содержащий: прием входных видеоданных; преобразование входных видеоданных в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные; формирование множества начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента, при этом первое значение метаданных, второе значение метаданных и третье значение метаданных включают в себя информацию, используемую посредством декодера для того, чтобы подготавливать посредством рендеринга декодированное изображение на дисплее.

[0012] В другом аспекте настоящего раскрытия сущности, предусмотрена система редактирования видео, содержащая: запоминающее устройство; и процессор, выполненный с возможностью инструктировать системе редактирования видео: принимать входные видеоданные, преобразовывать входные видеоданные в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные, формировать множество начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента.

[0013] В другом аспекте настоящего раскрытия сущности, предусмотрен способ редактирования видеоконтента, содержащий: прием входных видеоданных; преобразование входных видеоданных в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные; формирование первого значения метаданных для кадра преобразованных видеоданных, причем первое значение метаданных соответствует среднему значению яркости кадра; определение временного окна, включающего в себя кадр, причем временное окно имеет предварительно определенную длину во времени; вычисление максимального диапазона метаданных и минимального диапазона метаданных за временное окно, чтобы за счет этого формировать первое фильтрованное значение метаданных и второе фильтрованное значение метаданных; и сглаживание первого фильтрованного значения метаданных и второго фильтрованного значения метаданных, чтобы за счет этого формировать первое сглаженное и фильтрованное значение метаданных и второе сглаженное и фильтрованное значение метаданных.

[0014] Таким образом, различные аспекты настоящего раскрытия сущности осуществляют улучшения, по меньшей мере, областей техники захвата, редактирования видео и обработки сигналов, а также смежных областей техники доставки видео и другого контента.

Краткое описание чертежей

[0015] Эти и другие более подробные и конкретные признаки различных вариантов осуществления более полно раскрываются в нижеприведенном описании, со ссылкой на прилагаемые чертежи, на которых:

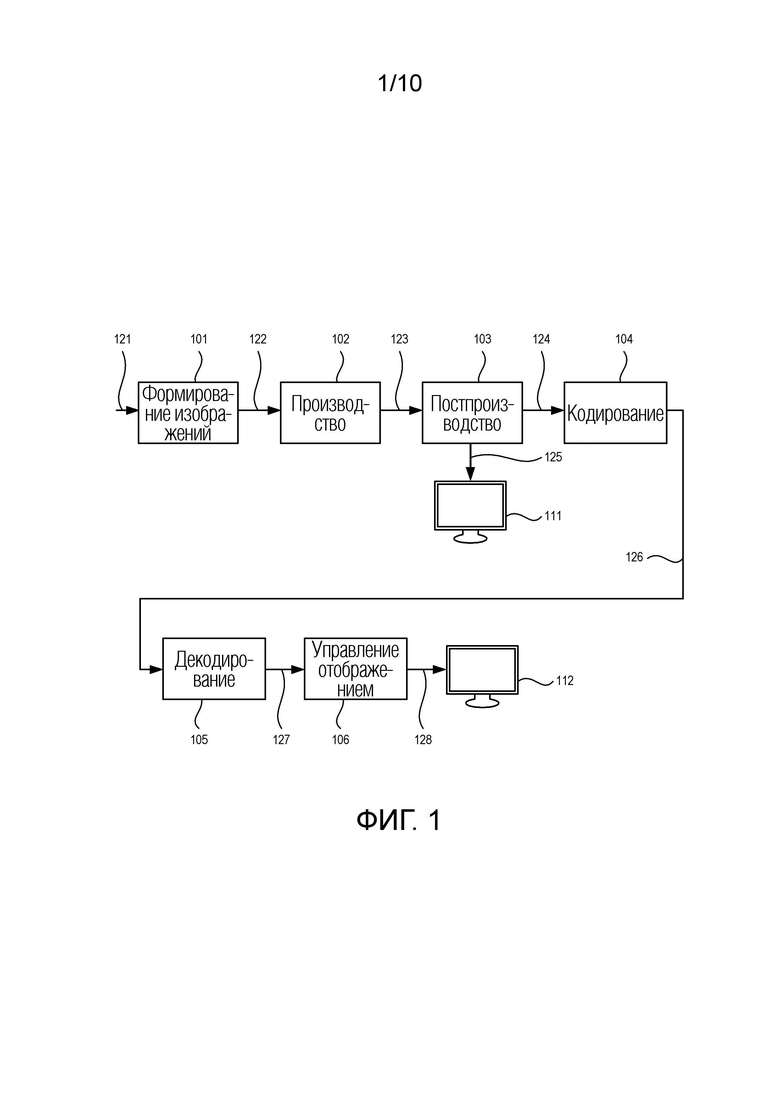

[0016] Фиг. 1 иллюстрирует примерный конвейер доставки видео в соответствии с различными аспектами настоящего раскрытия сущности;

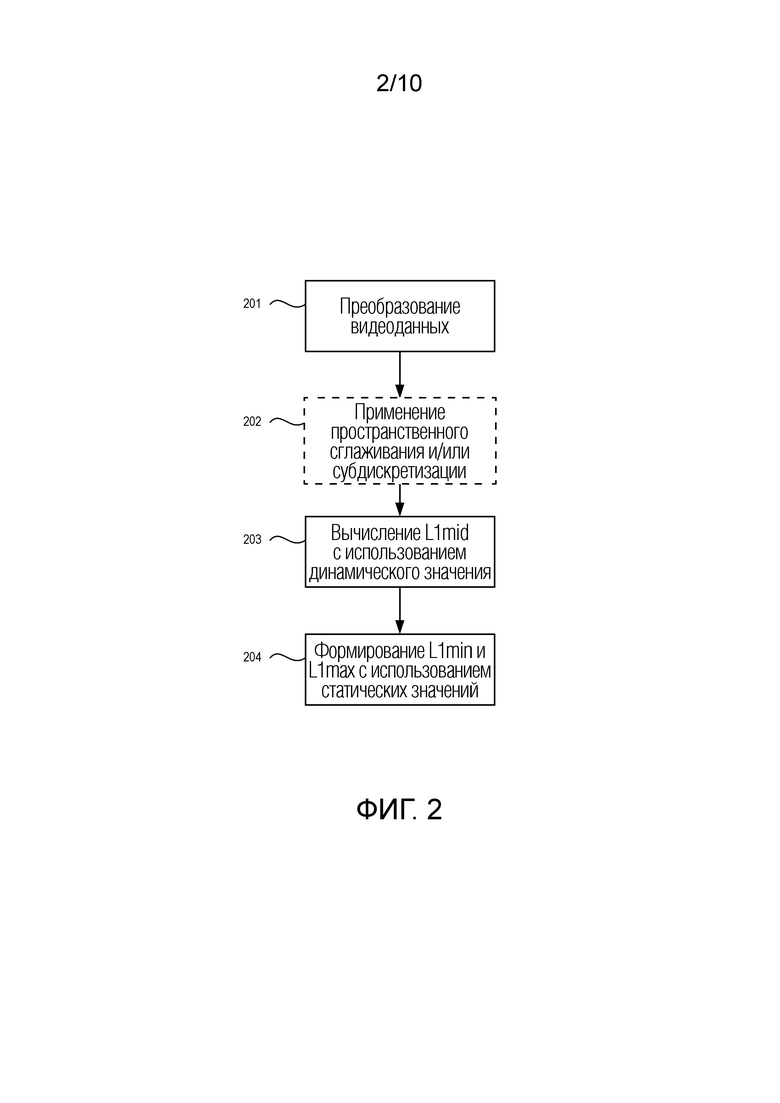

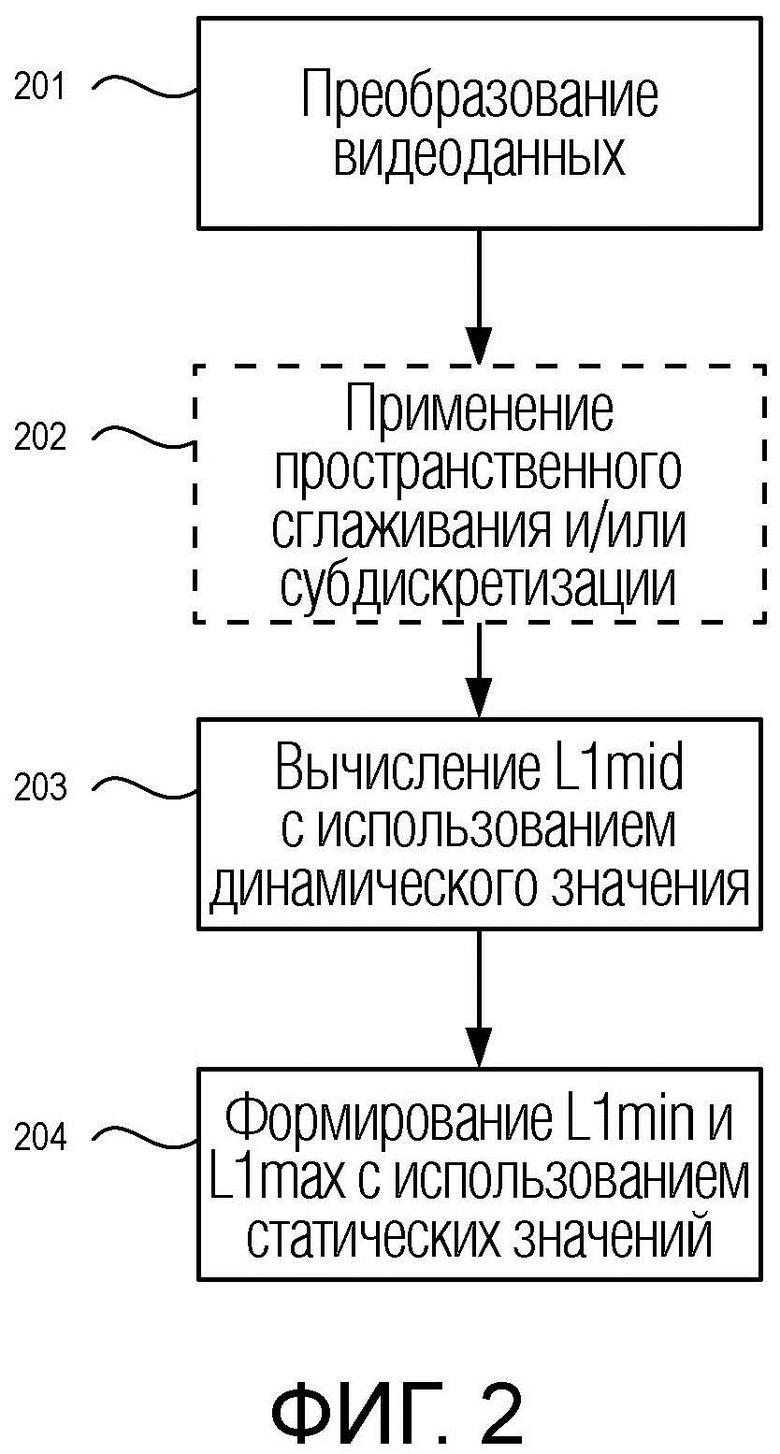

[0017] Фиг. 2 иллюстрирует последовательность операций обработки для примерного способа формирования метаданных согласно различным аспектам настоящего раскрытия сущности;

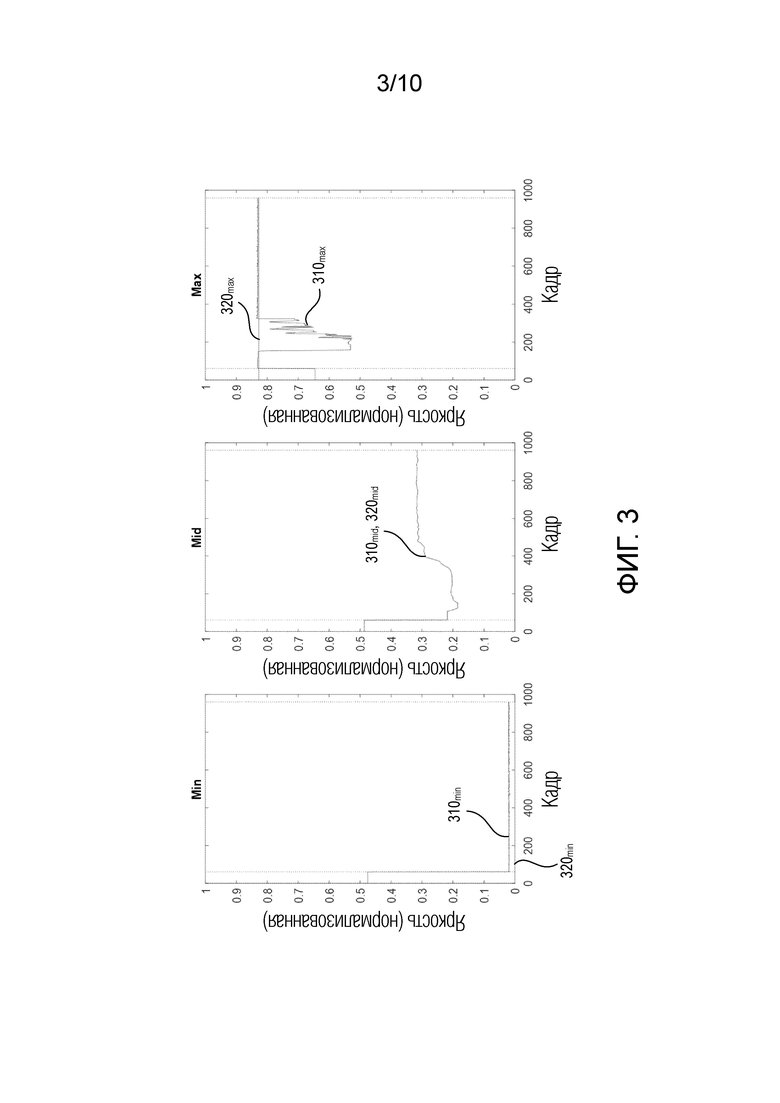

[0018] Фиг. 3 иллюстрирует примерные метаданные, сформированные посредством способа по фиг. 2;

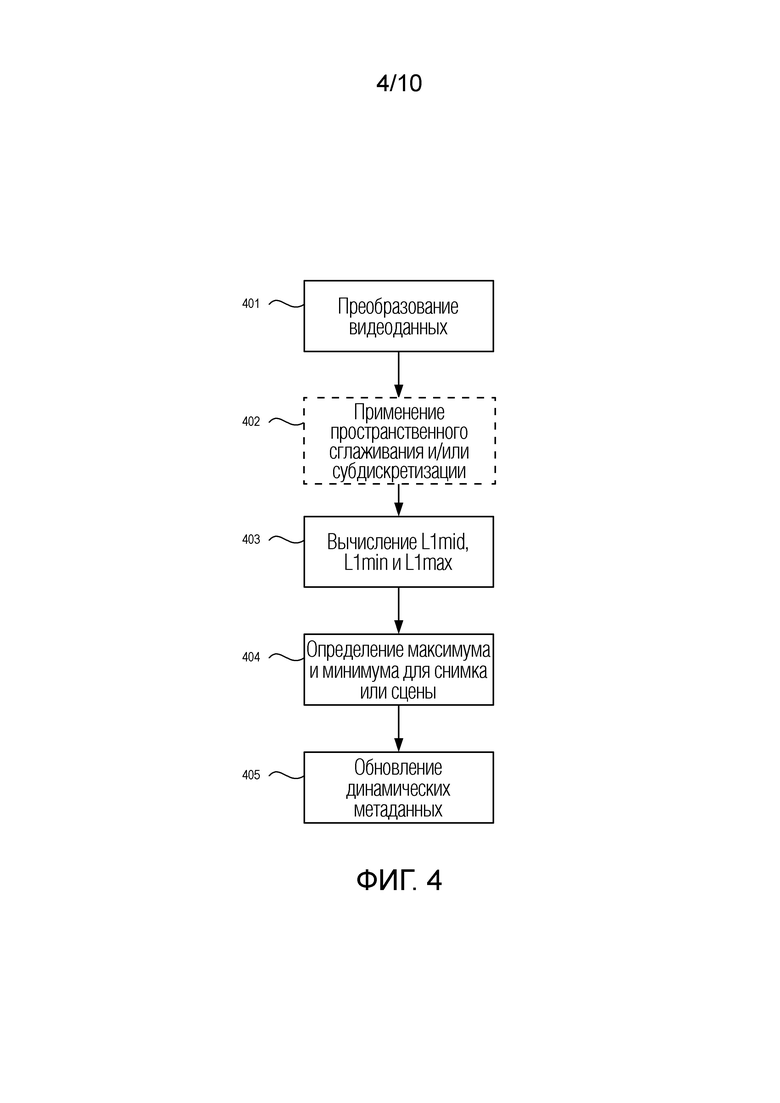

[0019] Фиг. 4 иллюстрирует последовательность операций обработки для другого примерного способа формирования метаданных согласно различным аспектам настоящего раскрытия сущности;

[0020] Фиг. 5 иллюстрирует примерные метаданные, сформированные посредством способа по фиг. 2;

[0021] Фиг. 6 иллюстрирует последовательность операций обработки для другого примерного способа формирования метаданных согласно различным аспектам настоящего раскрытия сущности;

[0022] Фиг. 7A-7C, соответственно, иллюстрируют примерные метаданные, сформированные посредством способа по фиг. 6; и

[0023] Фиг. 8 иллюстрирует примерную систему в соответствии с различными аспектами настоящего раскрытия сущности.

Подробное описание изобретения

[0024] Это раскрытие сущности и его аспекты могут осуществляться в различных формах, включающих в себя аппаратные средства, устройства или схемы, управляемые посредством машинореализованных способов, компьютерных программных продуктов, компьютерных систем и сетей, пользовательских интерфейсов и интерфейсов прикладного программирования; а также аппаратно-реализованные способы, схемы обработки сигналов, матрицы запоминающего устройства, специализированные интегральные схемы (ASIC), программируемые пользователем вентильные матрицы (FPGA) и т.п. Вышеприведенная сущность изобретения предназначена только для того, чтобы выдавать общую идею относительно различных аспектов настоящего раскрытия сущности, и не ограничивает объем раскрытия сущности каким-либо образом.

[0025] В нижеприведенном описании, изложено множество подробностей, таких как конфигурации оптических устройств, временные синхронизации, операции и т.п., с тем чтобы предоставлять понимание одного или более аспектов настоящего раскрытия сущности. Специалистам в данной области техники должно быть очевидным, что эти конкретные подробности являются просто примерными и не имеют намерение ограничивать объем этой заявки.

[0026] Кроме того, хотя настоящее раскрытие сущности фокусируется главным образом на примерах, в которых различные схемы используются при формировании контента, следует понимать, что это представляет собой просто один пример реализации. Дополнительно следует понимать, что раскрытые системы и способы могут использоваться в любом устройстве, в котором существует потребность в том, чтобы формировать, модифицировать или отображать данные изображений и/или ассоциированные метаданные; например, в кино-, бытовых и других коммерческих проекционных системах, смартфоне и других бытовых электронных устройствах, дисплеях на лобовом стекле, дисплеях в стиле виртуальной реальности и т.п.

[0027] Метаданные

[0028] При использовании в данном документе, термин "метаданные" относится к любой вспомогательной информации, которая передается как часть кодированного потока битов и помогает декодеру подготавливать посредством рендеринга декодированное изображение. Такие метаданные могут включать в себя, но не только, информацию цветового пространства или гаммы, параметры опорного дисплея и вспомогательные параметры сигналов, к примеру, как описано в данном документе, и могут совместно называться "метаданными формирования изображений".

[0029] Такие метаданные могут разделяться или классифицироваться на различные уровни метаданных. В одном конкретном примере, в котором настоящее раскрытие сущности реализуется в Dolby Vision-архитектуре, метаданные преобразования могут включать в себя L0-метаданные, L1-метаданные, L2/L8-метаданные, L3-параметры, L4-метаданные, L11-метаданные и т.п. В некоторых примерах, L0-метаданные предоставляют или описывают информацию относительно динамического диапазона видеоданных для всего видеоконтента (т.е. для нескольких снимков и/или сцен). Например, L0-метаданные могут включать в себя L0min и L0max, которые, соответственно, представляют минимальную яркость и максимальную яркость для видеоконтента, соответственно. В одном конкретном примере, в котором видеоконтент представляет собой HDR-контент, L0min и L0max могут соответствовать 0,01 нит и 1000 нит, соответственно.

[0030] В некоторых примерах, L1-метаданные предоставляют или описывают информацию относительно распределения значений яркости в исходном изображении, исходной сцене, исходной группе кинокадров (GOP) и т.д., как представлено в видеоданных. Распределение значений яркости может представляться посредством гистограмм, извлекаемых на основе контента изображений (например, пиксельных значений, значений сигнала яркости, значений сигнала цветности, Y-значений, Cb/Cr-значений, RGB-значений и т.д.) для изображения, сцены, GOP и т.д. L1-метаданные могут включать в себя параметры L1min, L1mid и L1max, которые, соответственно, представляют минимальную яркость ("сминание"), полутоновую яркость ("середина") и максимальную яркость ("клип") для одного или более изображений, сцен, GOP и т.д., в видеоконтенте, соответственно.

[0031] Другие уровни метаданных также могут задаваться. Например, L2 предоставляет или описывает информацию относительно регулирований характеристик видео, которые инициируются или обратно прослеживаются в отношении регулирований, осуществляемых режиссером, цветокорректировщиком, специалистом по обработке видео и т.д., в производственной студии и/или во время постпроизводства. L8-метаданные являются аналогичными L2-метаданным и в некоторых случаях могут быть эквивалентными L2-метаданным (например, в зависимости от соответствующих тональных кривых). L2- и L8-метаданные могут называться "параметрами "обрезки" и могут указывать или относиться к усилению/смещению/мощности данных изображений. L2-метаданные могут соответствовать первому опорному дисплею, имеющему первый опорный динамический диапазон.

[0032] L3-метаданные предоставляют или описывают информацию относительно регулирований характеристик видео, которые инициируются или обратно прослеживаются в отношении регулирований, осуществляемых режиссером, цветокорректировщиком, специалистом по обработке видео и т.п. По сравнению с L2-метаданными, L3-метаданные могут соответствовать второму опорному дисплею с опорным динамическим диапазоном, отличающимся от опорного динамического диапазона первого опорного дисплея. L3-метаданные могут включать в себя, например, смещения или регулирования из L1-метаданных, включающие в себя смещения или регулирования для значений яркости "сминание", "середина" и/или "клип".

[0033] L4-метаданные предоставляют или описывают информацию относительно операций глобального регулирования яркости. L4-метаданные могут вычисляться посредством кодера во время предварительной обработки и могут вычисляться с использованием первичных RGB-цветов. В одном примере, L4-метаданные могут включать в себя данные, которые диктуют глобальный уровень яркости задней подсветки панели отображения на покадровой основе. Другие сформированные метаданные, к примеру, L11-метаданные, могут предоставлять или описывать информацию, которая должна использоваться для того, чтобы идентифицировать источник видеоданных, к примеру, кинематографический контент, контент компьютерных игр, спортивный контент и т.п. Такие метаданные дополнительно могут предоставлять или описывать намеченные настройки кинокадра, такие как намеченная белая точка, резкость и т.п.

[0034] При совместном рассмотрении, метаданные формирования изображений могут включать в себя данные преобразования для преобразования из первого динамического диапазона во второй динамический диапазон, который отличается от первого динамического диапазона. В некоторых аспектах настоящего раскрытия сущности, первый динамический диапазон может быть шире второго динамического диапазона (например, при преобразовании из HDR в SDR). В других аспектах настоящего раскрытия сущности, второй динамический диапазон может быть шире первого динамического диапазона (например, при преобразовании из SDR в HDR).

[0035] Сравнительные способы формирования метаданных формирования изображений могут включать в себя вычисление метаданных в расчете на кадр (например, L1-метаданных в расчете на кадр) и либо применение IIR-фильтрации (например, для широковещательной передачи вживую или игры), либо комбинирование метаданных в сцены посредством вычисления минимума, середины и максимума сцены (например, для студийного или профессионального оффлайнового контента). Тем не менее, ни один из этих способов не предоставляет возможность мгновенного предварительного просмотра контента во время редактирования. Например, пользователь может хотеть делать HDR-кинокадр более ярким и предварительно просматривать результат на SDR-мониторе в качестве опорного дисплея. Для этого, осуществляются следующие этапы: регулирование применяется к HDR-кинокадру; L1-метаданные повторно вычисляются для отрегулированного HDR-кинокадра; операции тонального преобразования модифицируются; и отрегулированное тональное преобразование применяется к отрегулированному HDR-кинокадру, чтобы формировать SDR-кинокадр для предварительного просмотра.

[0036] Этот набор операций может быть удовлетворительным, если применяется к одному изображению, поскольку одно изображение может целесообразно сохраняться в запоминающем устройстве, так что операции могут применяться подряд. Тем не менее, L1-метаданные (и в силу этого результирующая тональная кривая) могут значительно варьироваться между кадрами, вызывая мерцание преобразованного изображения. Это может называться "временной нестабильностью". Чтобы обеспечивать временную стабильность тональной кривой, может выполняться некоторая фильтрация. Тем не менее, если операция повторного вычисления метаданных зависит от нескольких изображений, то операция регулирования и операция повторного вычисления метаданных должна применяться ко множеству изображений, что может быть непрактичным или невозможным на высоких скоростях передачи видео.

[0037] Таким образом, сравнительные способы формирования метаданных формирования изображений могут приводить к замедлению в итеративном цикле регулирования, обновления и предварительного просмотра результатов. Кроме того, сравнительный способ IIR-фильтрации может требовать очень большого числа кадров, которые должны анализироваться до текущего кадра, поскольку текущий кадр требует всех предыдущих кадров для IIR-фильтра. Студийный или профессиональный сравнительный способ требует всех кадров сцены, которая в некоторых случаях может иметь длину порядка минут или даже часов.

[0038] С учетом этого, различные аспекты настоящего раскрытия сущности предоставляют способы формирования метаданных для эффективного редактирования; т.е. для редактирования, которое приводит к высокому качеству изображений и высокой временной стабильности. Различные аспекты настоящего раскрытия сущности могут выполнять такое редактирование с низкими требованиями по объему вычислений и низкой или нулевой задержкой. В некоторых аспектах, способы формирования метаданных включаются или используются в/с конвейером доставки видео.

[0039] Конвейер доставки видео

[0040] Фиг. 1 иллюстрирует примерный конвейер доставки видео и показывает различные стадии от видеозахвата до отображения видеоконтента. Кроме того, хотя нижеприведенное описание предоставляется с точки зрения видео (т.е. движущихся изображений), настоящее раскрытие сущности не ограничено этим. В некоторых примерах, контент изображений может представлять собой неподвижные изображения либо комбинации видео и неподвижных изображений. Контент изображений может представляться посредством растровой (или пиксельной) графики, посредством векторной графики либо посредством комбинаций растровой и векторной графики. Фиг. 1 иллюстрирует блок 101 формирования изображений, блок 102 производства, блок 103 постпроизводства, блок 104 кодирования, блок 105 декодирования и блок 106 управления отображением. Различные блоки, проиллюстрированные на фиг. 1, могут реализовываться как/через аппаратные средства, программное обеспечение, микропрограммное обеспечение либо комбинации вышеозначенного. Кроме того, различные группы проиллюстрированных блоков могут иметь комбинированные соответствующие функции и/или могут выполняться в различных устройствах и/или в различные моменты времени. Отдельные из или группы проиллюстрированных блоков могут реализовываться с помощью схемы, в том числе, но не только, с помощью центральных процессоров (CPU), графических процессоров (GPU), ASIC, FPGA и комбинаций вышеозначенного. Операции, выполняемые посредством одного или более блоков, могут обрабатываться локально, удаленно (например, облачно) либо как комбинация локально и удаленно.

[0041] Как проиллюстрировано на фиг. 1, конвейер доставки видео дополнительно включает в себя опорный дисплей 111, который может предоставляться для того, чтобы помогать или отслеживать операции, проводимые в блоке 103 постпроизводства и на целевом дисплее 112. Для целей пояснения, блок 101 формирования изображений, блок 102 производства, блок 103 постпроизводства и блок 104 кодирования могут называться "вышележащими блоками или компонентами", тогда как блок 105 декодирования и блок 106 управления отображением могут называться "нижележащими блоками или компонентами".

[0042] В примере, проиллюстрированном на фиг. 1, видеоконтент в форме последовательности видеокадров 121 захватывается или формируется в блоке 101 формирования изображений. Видеокадры 121 могут захватываться в цифровой форме (например, посредством цифровой камеры) или формироваться посредством компьютера (например, с использованием компьютерной анимации), с тем чтобы формировать видеоданные 122. Альтернативно, видеокадры 121 могут захватываться на пленке посредством пленочной камеры и затем преобразовываться в цифровой формат, с тем чтобы предоставлять видеоданные 122. В любом случае, видеоданные 122 предоставляются в блок 102 производства, в котором они редактируются для того, чтобы предоставлять производственный поток 123. Видеокадры 121 могут группироваться в последовательности, такие как снимки и сцены. Снимок, например, представляет собой набор временно соединенных кадров. Снимки могут разделяться посредством "переключений снимков" (например, моментов времени, в которые весь контент изображения изменяется вместо только его части). Сцена, например, представляет собой последовательность снимков, которые описывают повествующий сегмент большего контента. В одном конкретном примере, в котором видеоконтент представляет собой боевик, видеоконтент может включать в себя (в числе других) сцену погони, которая в свою очередь включает в себя последовательность снимков (например, снимок водителя преследующего транспортного средства, снимок водителя преследуемого транспортного средства, снимок улицы, на которой проводится погоня, и т.д.).

[0043] Видеоданные в производственном потоке 123 затем предоставляются в процессор или процессоры в блоке 103 постпроизводства для постпроизводственного редактирования. Редактирование, выполняемое в блоке 103 постпроизводства, может включать в себя регулирование либо модификацию цветов или яркости в конкретных зонах изображения, с тем чтобы повышать качество изображений или достигать конкретного внешнего вида для изображения в соответствии с творческим намерением создателя (или редактора) видео. Это может называться "цветовой синхронизацией" или "цветокоррекцией". Другое редактирование (например, выбор и упорядочение сцен, обрезка изображений, добавление машиногенерируемых визуальных спецэффектов или наложений и т.д.) может выполняться в блоке 103 постпроизводства, чтобы давать в результате распространяемый поток 124. В некоторых примерах, блок 103 постпроизводства может предоставлять промежуточный поток 125 в опорный дисплей 111, чтобы обеспечивать возможность просмотра изображений на его экране, например, с тем чтобы помогать в процессе редактирования. Одно, два или все из блока 102 производства, блока 103 постпроизводства и блока 104 кодирования дополнительно могут включать в себя обработку для того, чтобы добавлять метаданные в видеоданные. Эта последующая обработка может включать в себя, но не только, статистический анализ свойств контента. Последующая обработка может выполняться локально или удаленно (например, как облачная обработка).

[0044] После операций постпроизводства, распространяемый поток 124 может доставляться в блок 104 кодирования для доставки в нисходящем направлении в устройства декодирования и воспроизведения, такие как телевизионные приемники, абонентские приставки, кинотеатры, переносные компьютеры, планшетные компьютеры и т.п. В некоторых примерах, блок 104 кодирования может включать в себя аудио- и видеокодеры, к примеру, кодеры, заданные посредством стандарта Комитета по перспективным телевизионным системам (ATSC), стандарта цифровой широковещательной передачи видео (DVB), универсального цифрового диска (DVD), Blu-Ray и других форматов доставки, чтобы за счет этого формировать кодированный поток 126 битов. В приемнике, кодированный поток 126 битов декодируется посредством модуля 105 декодирования, чтобы формировать декодированный сигнал 127, представляющий идентичную или хорошую аппроксимацию распространяемого потока 124. Приемник может присоединяться к целевому дисплею 112, который может иметь характеристики, которые отличаются от опорного дисплея 111. Если опорный дисплей 111 и целевой дисплей 112 имеют различные характеристики, блок 106 управления отображением может использоваться для того, чтобы преобразовывать динамический диапазон или другие характеристики декодированного сигнала 127 в характеристики целевого дисплея 112 посредством формирования преобразованного для отображения сигнала 128. Блок 106 управления отображением дополнительно или альтернативно может использоваться для того, чтобы предоставлять управление мощностью целевого дисплея 112.

[0045] Целевой дисплей 112 формирует изображение с использованием матрицы пикселов. Конкретная матричная структура зависит от архитектуры и разрешения дисплея. Например, если целевой дисплей 112 работает в жидкокристаллической архитектуре, он может включать в себя матрицу задней подсветки сравнительно низкого разрешения (например, матрицу светодиодов или других светоизлучающих элементов) и жидкокристаллическую матрицу и матрицу цветных светофильтров сравнительно высокого разрешения для того, чтобы избирательно ослаблять белый свет из матрицы задней подсветки и предоставлять окрашенный свет (зачастую называется "технологией отображения на основе двойной модуляции"). Если целевой дисплей 112 работает в OLED-архитектуре, он может включать в себя матрицу высокого разрешения самоэмиссионных цветных пикселов.

[0046] Линия связи между вышележащими блоками и нижележащими блоками (т.е. тракт, по которому предоставляется кодированный поток 126 битов) может осуществляться посредством передачи вживую или в реальном времени, к примеру, посредством широковещательной передачи по радиоинтерфейсу с использованием электромагнитных волн либо через линию доставки контента, к примеру, через оптоволокно, витую пару (Ethernet) и/или коаксиальные кабели. В других примерах, линия связи может осуществляться посредством независимой от времени передачи, к примеру, посредством записи кодированного потока битов на физический носитель (например, DVD-диск или жесткий диск) для физической доставки в конечное пользовательское устройство (например, DVD-проигрыватель). Блок 105 декодера и блок 106 управления отображением могут быть включены в устройство, ассоциированное с целевым дисплеем 112; например, в форме интеллектуального телевизора, который включает в себя функции декодирования, управления отображением, управления мощностью и отображения. В некоторых примерах, блок 105 декодера и/или блок 106 управления отображением могут быть включены в устройство, отдельное от целевого дисплея 112; например, в форме абонентской приставки или мультимедийного проигрывателя.

[0047] Блок 105 декодера и/или блок 106 управления отображением могут быть выполнены с возможностью принимать, анализировать и работать в ответ на метаданные, включенные или добавленные в вышележащие блоки. Такие метаданные в силу этого могут использоваться для того, чтобы предоставлять дополнительное регулирование или управление целевым дисплеем 112. Метаданные могут включать в себя метаданные формирования изображений, описанные выше (например, метаданные Dolby Vision). Метаданные могут формироваться в блоке 103 постпроизводства с использованием опорного дисплея 111 и производственного потока 123 и/или промежуточного потока 125.

[0048] Полудинамическое формирование метаданных

[0049] Метаданные формирования изображений могут формироваться с использованием "полудинамического" способа, пример которого проиллюстрирован на фиг. 2. Этапы, проиллюстрированные на фиг. 2, могут выполняться автоматически с помощью аппаратных средств, программного обеспечения, микропрограммного обеспечения либо комбинаций вышеозначенного, ассоциированных с блоком 103 постпроизводства по фиг. 1.

[0050] Как проиллюстрировано на фиг. 2, процесс полудинамического формирования метаданных может начинаться на этапе 201, на котором видеосигнал преобразуется в предварительно определенный формат (например, конкретную EOTF). Например, видеосигнал может преобразовываться из гибридного логарифмического гамма-распределения (HLG) или SLOG-3 HDR в HDR на основе перцепционного RGB-квантователя (PQ), например, как описано в Rec. ITU-R BT.2100-1 (06/2017). В некоторых реализациях, на этапе 202, могут применяться пространственное сглаживание и/или субдискретизация. Этап 202 может реализовываться с использованием ядра двумерного сглаживания (например, [1 1]/2 или [1 3 3 1]/8). Это уменьшает чувствительность к отдельным пикселам. В некоторых примерах, изображение может прореживаться до меньшего размера (например, до половины размера) после фильтрации. В других реализациях, этап 202 может опускаться, и процесс полудинамического формирования метаданных может переходить непосредственно от этапа 201 к этапу 203. На этапе 203, начальные значения L1mid вычисляются (например, на покадровой основе). Например, L1mid может представлять среднее значение максимальной RGB-яркости. Другими словами, L1mid может представлять среднее значение максимума значений R, G, B цветовых компонентов для каждого пиксела. Значения L1min и L1max не вычисляются из контента, вместо этого, на этапе 204 используются фиксированные значения, которые соответствуют минимально и максимально допустимому диапазону контента изображений, как представлено в L0-метаданных (например, Level0.Smin и Level0.Smax). Например, L1mid может представлять среднее значение яркости значений Y-компонента, когда используется YCbCr-представление.

[0051] В качестве одного конкретного примера этапов по фиг. 2, следующий псевдокод представляется с использованием MATLAB-формата:

if strcmpi(SEOTF,'HLG')

imPQ=L2PQ(HLG2L(im, SMax,Smin));

else

imPQ=im;

end

% Субдискретизация на 50% (пример этапа 202)

imPQHalf=Half(imPQ);

% Вычисление метаданных в расчете на пиксел (пример этапа 203, 204)

maxRGB=max(imPQHalf, [],3);

L1Min=L2PQ(MD{n}.Level0.Smin);

L1Mid=mean(MAXRGB(:));

L1Max=L2PQ(MD{n}.Level0.Smax);

[0052] Фиг. 3 иллюстрирует примерный вывод вышеуказанных этапов для метаданных, соответствующих значениям "сминание", "середина" и "клип". Каждый график иллюстрирует нормализованный сигнал яркости в качестве функции номера кадра. Линии 310min, 310mid и 310max иллюстрируют минимальные, средние и максимальные значения яркости данного кадра, соответственно. Линии 320min, 320mid и 320max иллюстрируют значения L1min, L1mid и L1max для данного кадра.

[0053] Поскольку L1min и L1max задаются равными значениям L0min и L0max, соответственно, значения метаданных "сминание" и "клип" не совпадают строго с фактическими значениями яркости для всех кадров. В конкретном примере, проиллюстрированном на фиг. 3, минимальное значение яркости в расчете на кадр (линия 310min) варьируется приблизительно между 0,01 и 0.48, тогда как значение L1min (линия 320min) задается равным приблизительно 0. Максимальное значение яркости в расчете на кадр (линия 310max) варьируется приблизительно между 0,53 и 0,82, тогда как значение L1max (линия 320max) задается равным приблизительно 0,82. Тем не менее, поскольку L1mid определяется посредством динамического значения, значение метаданных "середина" близко совпадает с фактическим значением яркости для всех кадров. Как проиллюстрировано на фиг. 3, среднее значение яркости в расчете на кадр (линия 310mid) и значение L1mid (линия 320mid) имеют высокое соответствие.

[0054] Полудинамическое формирование метаданных требует обработки только одного кадра. Этот способ приводит к высокой эффективности; тем не менее, как видно из фиг. 3, использование статических значений для значений метаданных "сминание" и "клип" приводит к немного более низкой контрастности преобразованного изображения для изображений, которые не используют полный динамический диапазон контейнера.

[0055] Динамическое формирование метаданных

[0056] Метаданные формирования изображений могут формироваться с использованием "динамического" способа, пример которого проиллюстрирован на фиг. 4. Этапы, проиллюстрированные на фиг. 4, могут выполняться автоматически с помощью аппаратных средств, программного обеспечения, микропрограммного обеспечения либо комбинаций вышеозначенного, ассоциированных с блоком 103 постпроизводства по фиг. 1.

[0057] Как проиллюстрировано на фиг. 4, процесс динамического формирования метаданных может начинаться на этапе 401, на котором видеосигнал преобразуется в предварительно определенный формат (например, конкретную EOTF). Например, видеосигнал может преобразовываться из HLG или SLOG-3 HDR в RGB PQ HDR, например, как описано в Rec. ITU-R BT.2100-1 (06/2017). В некоторых реализациях, на этапе 402, могут применяться пространственное сглаживание и/или субдискретизация. Этап 402 может реализовываться с использованием ядра двумерного сглаживания (например, [1 1]/2 или [1 3 3 1]/8). Это уменьшает чувствительность к отдельным пикселам. В некоторых примерах, изображение может прореживаться до меньшего размера (например, до половины размера) после фильтрации. В других реализациях, этап 402 может опускаться, и процесс полудинамического формирования метаданных может переходить непосредственно от этапа 401 к этапу 403. На этапе 403, начальные значения L1min, L1mid и L1max вычисляются (например, на покадровой основе). Например, L1min может представлять минимальное значение RGB-яркости, L1mid может представлять среднее значение максимальной RGB-яркости, и L1max может представлять максимальное значение RGB-яркости.

[0058] Затем, на этапе 404, значения L1min и L1max повторно вычисляются с использованием динамических значений для данного снимка или сцены. Например, каждый кадр снимка или сцены может анализироваться, чтобы определять минимальную и максимальную RGB-яркость для данного снимка или сцены. На этапе 405, значения L1min и L1max повторно вычисляются с использованием значения, которое соответствует минимуму и максимуму для всего "клипа", определенным на этапе 404. По сравнению с полудинамическим способом, описанным выше, динамический способ может более близко соответствовать данным изображений, поскольку L1min и L1max определяются относительно фактической минимальной и максимальной RGB-яркости контента, а не допустимой (т.е. возможной) минимальной и максимальной RGB-яркости контента.

[0059] В качестве одного конкретного примера этапов по фиг. 4, следующий псевдокод представляется с использованием MATLAB-формата:

if strcmpi(SEOTF,'HLG')

imPQ=L2PQ(HLG2L(im, SMax,Smin));

else

imPQ=im;

end

% Субдискретизация на 50% (пример этапа 402)

imPQHalf=Half(imPQ);

% Вычисление метаданных в расчете на пиксел (пример этапа 403)

maxRGB=max(imPQHalf, [],3);

L1Min=min(imPQHalf(:));

L1Mid=mean(MAXRGB(:));

L1Max=max(imPQHalf(:));

% Определение минимума и максимума всего "клипа" (пример этапа 404)

minPQ=1;

maxPQ=0;

for n=1:N

if L1Min(n)<minPQ

minPQ=L1Min(n)

end

if L1Max(n)>maxPQ

maxPQ=L1Max(n)

end

end

% Обновление динамических метаданных (пример этапа 405)

for n=1:N

fprintf ("Обновление метаданных для кадра%d%d/n", n, N);

NewMinF(n)=minPQ;

NewMidF(n)=L1Mid(n);

NewMaxF(n)=maxPQ;

end

[0060]а

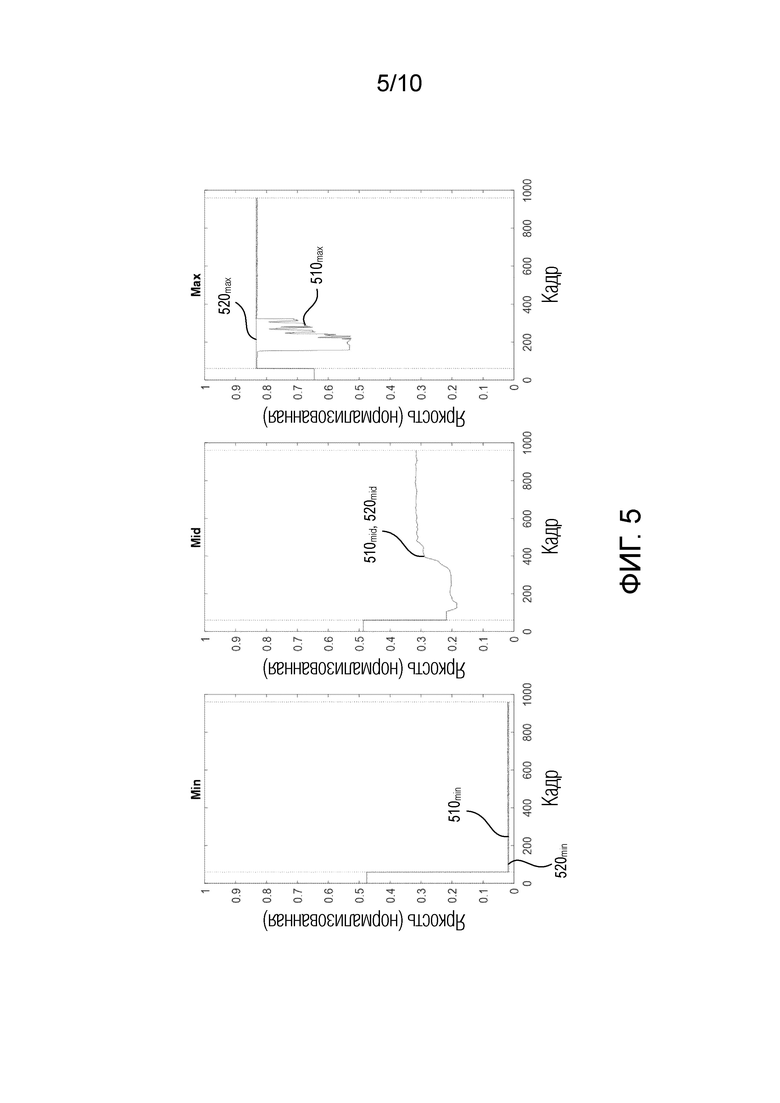

Фиг. 5 иллюстрирует примерный вывод вышеуказанных этапов для метаданных, соответствующих вышеуказанным этапам для метаданных, соответствующих значениям "сминание", "середина" и "клип". Каждый график иллюстрирует нормализованный сигнал яркости в качестве функции номера кадра. Линии 510min, 510mid и 510max иллюстрируют минимальные, средние и максимальные значения яркости данного кадра, соответственно. Линии 520min, 520mid и 520max иллюстрируют значения L1min, L1mid и L1max для данного кадра.

[0061] Поскольку L1min и L1max задаются равными минимальным значениям для всего кадра клипа, значения метаданных "сминание" и "клип" не совпадают строго с фактическими значениями яркости для всех кадров. Тем не менее, по сравнению с полудинамическим способом, описанным выше, значения метаданных "сминание" и "клип" более близко совпадают с фактическими значениями яркости. В конкретном примере, проиллюстрированном на фиг. 5, минимальное значение яркости в расчете на кадр (линия 510min) варьируется приблизительно между 0,02 и 0.48, тогда как значение L1min (линия 510min) задается равным приблизительно 0,02. Для сравнения, в полудинамическом способе, как проиллюстрировано на фиг. 3, значение L1min (линия 310min) задано равным 0. Максимальное значение яркости в расчете на кадр (линия 510max) варьируется приблизительно между 0,53 и 0,82, тогда как значение L1max (линия 520max) задается равным приблизительно 0,82. Как описано выше, поскольку L1mid определяется посредством динамического значения, значение метаданных "середина" близко совпадает с фактическим значением яркости для всех кадров. Как проиллюстрировано на фиг. 5, среднее значение яркости в расчете на кадр (линия 510mid) и значение L1mid (линия 520mid) имеют высокое соответствие.

[0062] Динамическое формирование метаданных требует обработки всех кадров в данном снимке или сцене и в силу этого может приводить к более высоким требованиям по объему вычислений по сравнению с полудинамическим формированием метаданных. Тем не менее, как видно из фиг. 5, использование динамических значений для значений метаданных "сминание" и "клип" не страдает от идентичного типа снижения контрастности преобразованных изображений для изображений, которые не используют полный динамический диапазон контейнера.

[0063] Оконное формирование FIR-метаданных

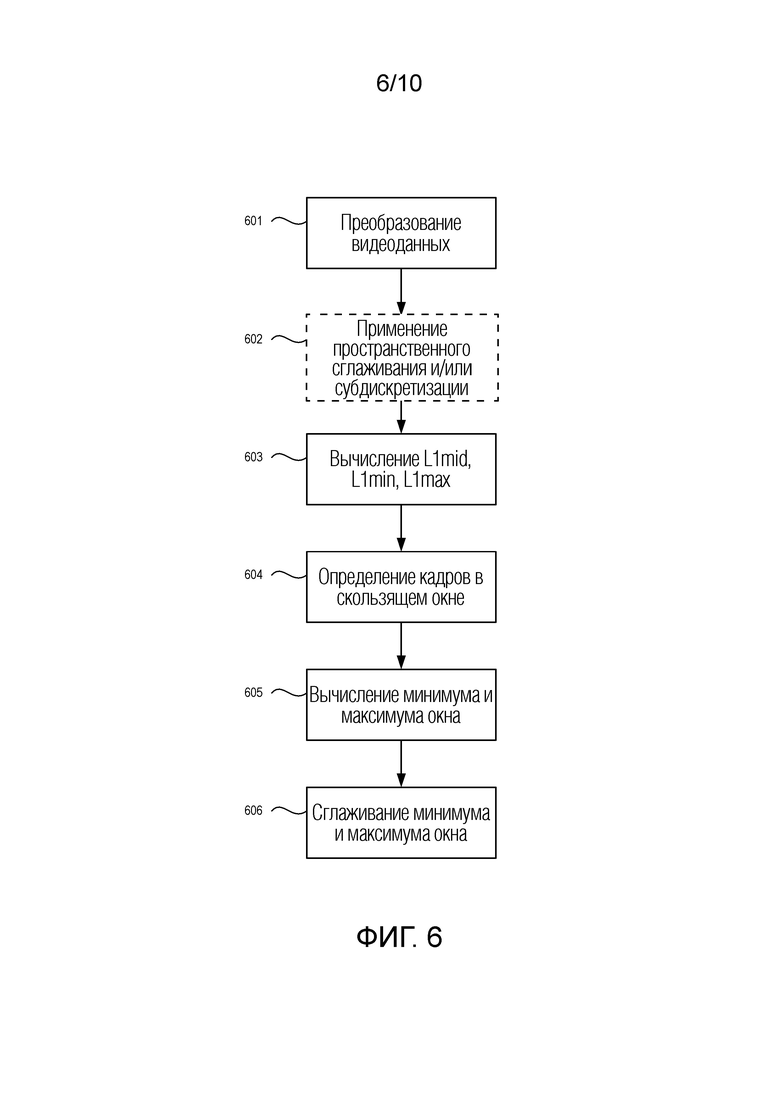

[0064] Метаданные формирования изображений могут формироваться с использованием "оконного" способа, пример которого проиллюстрирован на фиг. 6. Этапы, проиллюстрированные на фиг. 6, могут выполняться автоматически с помощью аппаратных средств, программного обеспечения, микропрограммного обеспечения либо комбинаций вышеозначенного, ассоциированных с блоком 103 постпроизводства по фиг. 1.

[0065] Как проиллюстрировано на фиг. 6, процесс оконного формирования метаданных может начинаться на этапе 601, на котором AV-видеосигнал преобразуется в предварительно определенный формат (например, конкретную EOTF). Например, видеосигнал может преобразовываться из HLG или SLOG-3 HDR в RGB PQ HDR, например, как описано в Rec. ITU-R BT.2100-1 (06/2017). После этого, на этапе 602, применяются пространственное сглаживание и/или субдискретизация. Этап 402 может реализовываться с использованием ядра двумерного сглаживания (например, [1 1]/2 или [1 3 3 1]/8). Это уменьшает чувствительность к отдельным пикселам. В некоторых примерах, изображение может прореживаться до меньшего размера (например, до половины размера) после фильтрации. На этапе 603, начальные значения L1min, L1mid и L1max вычисляются (например, в расчете на пиксел). Например, L1min может представлять минимальное значение минимальной RGB-яркости, L1mid может представлять среднее значение максимальной RGB-яркости, и L1max может представлять максимальное значение максимальной RGB-яркости.

[0066] Затем, на этапе 604, список кадров в скользящем окне (k) определяется. Это может указываться в качестве максимальной длины T во времени, умноженной на частоту кадров. Временное окно T (также называемое "временным окном") может быть конфигурируемым оператором. В некоторых примерах, временное окно T является конфигурируемым между 0,4 секундами и 8 секундами. В одном конкретном примере, временное окно T равно 4 секундам. Как подробнее описано ниже, конкретное значение временного окна T выбирается с возможностью балансировать временную стабильность и качество кинокадров; например, меньшие окна могут вводить определенную степень мерцания, тогда как большие окна могут приводить к более статическому процессу. Тем не менее, непосредственно окно имеет такую конфигурацию, в которой оно не пересекает быстрые переключения сцены и в силу этого ограничивается посредством первого и последнего кадра текущей сцены.

[0067] Этап 605 представляет собой первый проход, на котором вычисляются минимум и максимум окна. Например, для каждого кадра f в скользящем окне k, этап 605 может сглаживать метаданные с использованием ядра одномерного сглаживания, к примеру, [1 1]/2, [1 2 1]/4, [1 3 3 1]/8 или [1 3 8 3 1]/16, чтобы за счет этого получать сглаженные метаданные L1minS(f) и L1maxS(f). Это уменьшает чувствительность к отдельным кадрам. После этого, этап 605 может определять максимальный диапазон метаданных по скользящему окну k; например, посредством вычисления L1minM(f)=min(L1minS(k)) (т.е. минимально сглаженного минимального значения метаданных) и L1maxM(f)=max(L1max(S(k)) (т.е. максимально сглаженного максимального значения метаданных).

[0068] Этап 606 представляет собой второй проход, на котором сглаживаются минимум и максимум окна. Например, этап 606 может вычислять сглаживающий фильтр F в качестве гауссовой формы с L отводов и среднеквадратическим отклонением s=L/6 и затем для каждого кадра f в скользящем окне k может сглаживать фильтрованные метаданные, вычисленные на этапе 605, с помощью сглаживающего фильтра F, чтобы получать сглаженные и фильтрованные значения L1minF и L1maxF метаданных. Этап 606 также может, для каждого кадра f, задавать L1min и L1max равными сглаженным и фильтрованным значениям метаданных и задавать L1mid равным своему начальному значению, определенному на этапе 603.

[0069] Поскольку этапы 605 и 606 применяются к скользящему окну кадров, этапы 604, 605 и 606 могут повторяться таким образом, что все возможные окна в данной сцене обрабатываются.

[0070] В качестве одного конкретного примера этапов по фиг. 6, следующий псевдокод представляется с использованием MATLAB-формата:

if strcmpi(SEOTF,'HLG')

imPQ=L2PQ(HLG2L(im, SMax,Smin));

else

imPQ=im;

end

% Субдискретизация на 50% (пример этапа 602)

imPQHalf=Half(imPQ);

% Вычисление метаданных в расчете на пиксел (пример этапа 603)

maxRGB=max(imPQHalf, [],3);

L1Min=min(imPQHalf(:));

L1Mid=mean(MAXRGB(:));

L1Max=max(imPQHalf(:));

% Модификация для оконных метаданных (пример этапов 604, 605)

for n=1:N

fprintf ("Обновление метаданных для кадра%d%d/n", n, N);

% Извлечение локального окна (пример этапа 604)

kmin=n-FIRWindow/2;

kmax=n+FIRwindow/2;

klastscenecut=SceneCuts(find(n>=SceneCuts,1,'last'));

kmin=max(kmin, klastscenecut);

knextscenecut=SceneCuts(find(n<SceneCuts,1,'first'));

if ~isempty(knextscenecut)

kmax=min(kmax, knextscenecut-1);

end

%Вычисление середины и максимума сцены (пример этапа 605)

padding=[[1 1]*k(1) k[1 1]*k(end)];

L1MinF=conv(L1Min(padding), [1 3 8 3 1]/16,'valid');

L1MaxF=conv(L1Max(padding), [1 3 8 3 1]/16,'valid');

WindowedMin(n)=min(L1MinF);

WindowedMax(n)=max(L1MaxF);

end

% Сглаживание (примерный этап 606)

for n=1:N

fprintf ("Обновление метаданных для кадра%d%d/n", n, N);

% Извлечение локального окна (пример этапа 604)

kmin=n-FIRWindow/2;

kmax=n+FIRwindow/2;

klastscenecut=SceneCuts(find(n>=SceneCuts,1,'last'));

kmin=max(kmin, klastscenecut);

knextscenecut=SceneCuts(find(n<SceneCuts,1,'first'));

if ~isempty(knextscenecut)

kmax=min(kmax, knextscenecut-1);

end

% Фильтрация (пример этапа 605)

H=exp(-(k-n).hathathat2/(2*(1/6*FIRWindow)hathathat2))';

H=H/sum(H);

NewMinF(n)=WindowedMin(k)*H;

NewMidF(n)=L1Mid(n);

NewMaxF(n)=WindowedMax(k)*H;

end

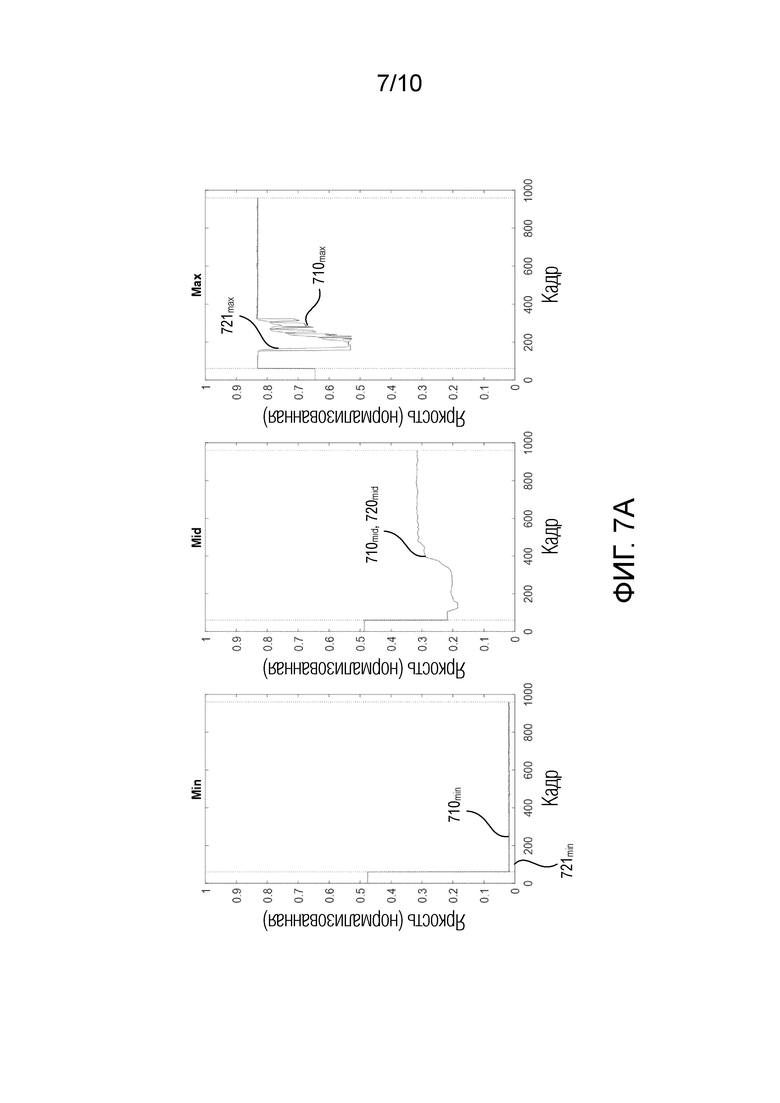

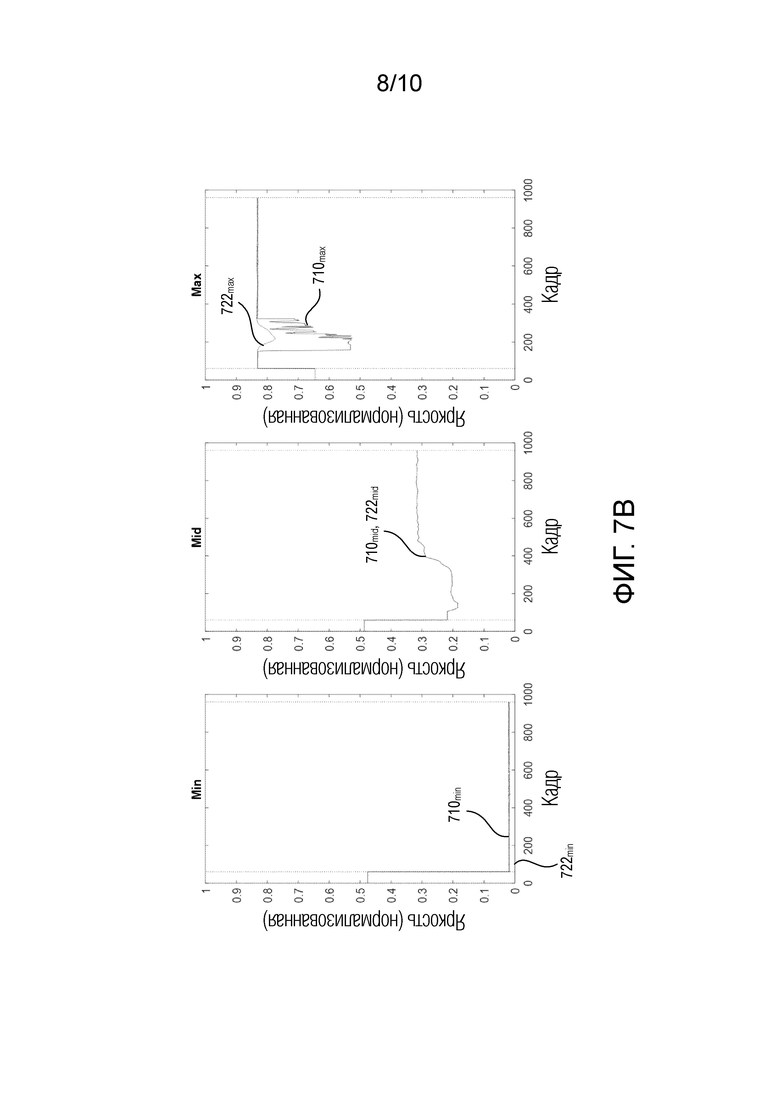

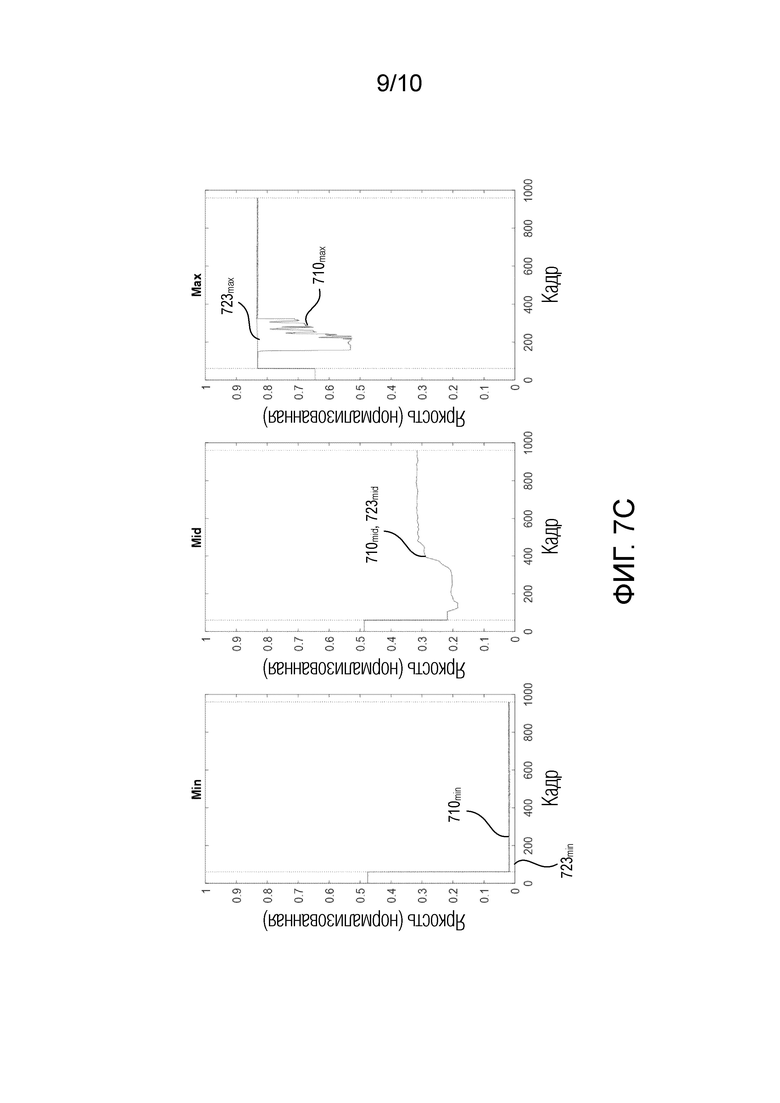

[0071] Фиг. 7A-7C иллюстрируют примерный вывод вышеуказанных этапов для метаданных, соответствующих значениям "сминание", "середина" и "клип" для различных длин окна. Каждый график иллюстрирует нормализованный сигнал яркости в качестве функции номера кадра. На каждом из фиг. 7A-7C, линии 710min, 710mid и 710max иллюстрируют минимальные, средние и максимальные значения яркости данного кадра, соответственно. На фиг. 7A, линии 721min, 721mid и 721max иллюстрируют значения L1min, L1mid, L1max для данного кадра, вычисленные согласно вышеописанным способам с длиной T окна в 1 секунду. На фиг. 7B, линии 722min, 722mid и 722max иллюстрируют значения L1min, L1mid, L1max для данного кадра, вычисленные согласно вышеописанным способам с длиной T окна в 4 секунды. На фиг. 7C, линии 723min, 723mid и 723max иллюстрируют значения L1min, L1mid, L1max для данного кадра, вычисленные согласно вышеописанным способам с длиной T окна в 8 секунд.

[0072] Посредством сравнения фиг. 7A-7C друг с другом, можно видеть, что меньшие длины окна приводят к увеличенному качеству кинокадров (например, линия 721max более близко отслеживает линию 710max); тем не менее, более длинные длины окна приводят к повышенной временной стабильности (например, линия 723max демонстрирует большую степень вариабильности). В одной конкретной реализации настоящего раскрытия сущности, длина окна предпочтительно составляет 4 секунды, как проиллюстрировано на фиг. 7B.

[0073] Оконное формирование метаданных формирует метаданные, которые представляют собой наружную огибающую "сминание" и "клип" скользящего окна. По сравнению с полудинамическим формированием метаданных, оно требует большего числа кадров для вычисления, но является конечным по числу кадров, требуемых для того, чтобы вычислять метаданные для любого одного кадра, в отличие от сравнительных способов, описанных выше. Посредством применения фильтра дважды последовательно, результирующий фильтр по существу утраивает длину указанного окна. Последовательные операции могут комбинироваться в одну операцию или поток, например, с использованием псевдокода, проиллюстрированного выше.

[0074] Примерная реализация компьютерной системы

[0075] Различные аспекты настоящего раскрытия сущности могут реализовываться с помощью компьютерной системы, систем, сконфигурированных в электронных схемах и компонентах, устройства на интегральных схемах (IC), такого как микроконтроллер, FPGA либо другого конфигурируемого программируемого логического устройства (PLD), дискретной временной схемы или процессора цифровых сигналов (DSP), ASIC и/или оборудования, которое включает в себя одну или более таких систем, устройств и компонентов. Компьютер и/или IC могут выполнять, управлять или выполнять инструкции, относящиеся к вышеописанным процессам и операциям. Компьютер и/или IC могут вычислять любое множество параметров или значений, которые относятся к вышеописанным процессам и операциям.

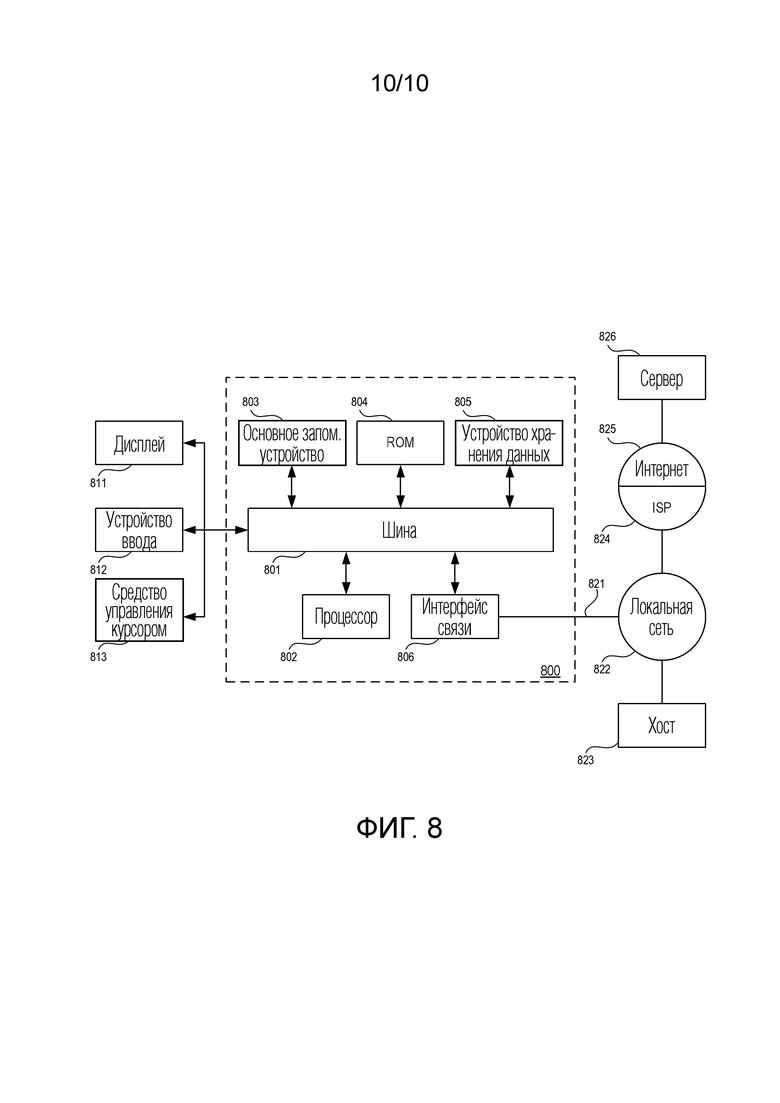

[0076] Фиг. 8 иллюстрирует один пример компьютерной системы 800, в которой могут реализовываться один или более аспектов настоящего раскрытия сущности. Как проиллюстрировано, компьютерная система 800 включает в себя шину 801 или другой механизм связи для передачи информации и аппаратный процессор 802, соединенный с шиной 801 для обработки информации. Процессор 802, например, может представлять собой микропроцессор общего назначения.

[0077] Компьютерная система 800 также включает в себя основное запоминающее устройство 803, такое как оперативное запоминающее устройство (RAM) или другое устройство динамического хранения данных, соединенное с шиной 801 для сохранения информации и инструкций, которые должны выполняться посредством процессора 802. Основное запоминающее устройство 803 также может использоваться для сохранения временных переменных или другой промежуточной информации во время выполнения инструкций, которые должны выполняться посредством процессора 802. Такие инструкции, когда сохраняются на энергонезависимых носителях хранения данных, доступных для процессора 802, превращают компьютерную систему 800 в машину специального назначения, которая индивидуально настраивается с возможностью выполнять операции, указываемые в инструкциях.

[0078] Компьютерная система 800 дополнительно включает в себя постоянное запоминающее устройство 804 (ROM) или другое устройство статического хранения данных, соединенное с шиной 801 для сохранения статической информации и инструкций для процессора 802. Устройство 805 хранения данных, такое как магнитный диск или оптический диск, может предоставляться и соединяться с шиной 801 для сохранения информации и инструкций. Компьютерная система 800 может соединяться через шину 801 с дисплеем 811, таким как жидкокристаллический дисплей, для отображения информации пользователю компьютера. Устройство 812 ввода, включающее в себя буквенно-цифровые и другие клавиши, соединяется с шиной 801 для передачи информации и выборов команд в процессор 802. Компьютерная система 800 дополнительно может соединяться через шину 801 со средством 813 управления курсором, таким как мышь, шаровой манипулятор или клавиши управления курсором, для передачи информации направления и выборов команд в процессор 802 и для управления перемещением курсора на дисплее 811.

[0079] Компьютерная система 800 может реализовывать технологии, описанные в данном документе, с использованием настраиваемой аппаратно-реализованной логики, одной или более ASIC или FPGA, микропрограммного обеспечения и/или программной логики, которая в комбинации с компьютерной системой инструктирует или программирует компьютерную систему 800 таким образом, что она представляет собой машину специального назначения. Согласно одному варианту осуществления, технологии, описанные в данном документе, выполняются посредством компьютерной системы 800 в ответ на выполнение, посредством процессора 802, одной или более последовательностей из одной или более инструкций, содержащихся в основном запоминающем устройстве 803. Такие инструкции могут считываться в основное запоминающее устройство 803 из другого носителя хранения данных, к примеру, из устройства 805 хранения данных. Выполнение последовательностей инструкций, содержащихся в основном запоминающем устройстве 803, инструктирует процессору 802 выполнять этапы процесса, описанные в данном документе. В альтернативных вариантах осуществления, аппаратно-реализованная схема может использоваться вместо или в комбинации с программными инструкциями.

[0080] Термин "носители хранения данных" при использовании в данном документе означает любые энергонезависимые носители, которые сохраняют данные и/или инструкции, которые инструктируют машине работать конкретным способом. Такие носители хранения данных могут содержать энергонезависимые носители и/или энергозависимые носители. Энергонезависимые носители включают в себя, например, оптические или магнитные диски, такие как устройство 805 хранения данных. Энергозависимые носители включают в себя динамическое запоминающее устройство, такое как основное запоминающее устройство 803. Общие формы носителей хранения данных включают в себя, например, гибкий диск, дискету, жесткий диск, полупроводниковый накопитель, магнитную ленту или любой другой магнитный носитель хранения данных, CD-ROM, любой другой оптический носитель хранения данных, любой физический носитель с шаблонами отверстий, RAM, PROM и EPROM, флэш-EPROM, NVRAM, любую другую микросхему или картридж запоминающего устройства.

[0081] Носители хранения данных являются отличающимися от, но могут использоваться в сочетании с передающими средами. Передающие среды участвуют в передаче информации между носителями хранения данных. Например, передающие среды включают в себя коаксиальные кабели, медный провод и оптоволокно, включающие в себя провода, которые содержат шину 801. Передающие среды также могут принимать форму акустических или световых волн, таких как волны, сформированные во время радиоволнового и инфракрасного обмена данными.

[0082] Различные формы носителей могут быть предусмотрены в переносе одной или более последовательностей из одной или более инструкций в процессор 802 для выполнения. Например, инструкции могут первоначально переноситься на магнитном диске или на полупроводниковом накопителе удаленного компьютера. Удаленный компьютер может загружать инструкции в свое динамическое запоминающее устройство и отправлять инструкции по линии связи, такой как коаксиальный кабель, оптические волокна и т.д. Интерфейс 806 связи, локальный для компьютерной системы 800, может принимать данные по линии связи, и соответствующая схема может размещать данные по шине 801. Шина 801 переносит данные в основное запоминающее устройство 803, из которых процессор 802 извлекает и выполняет инструкции. Инструкции, принимаемые посредством основного запоминающего устройства 803, необязательно могут сохраняться на устройстве 805 хранения данных до или после выполнения посредством процессора 802.

[0083] Интерфейс 806 связи предоставляет двунаправленное соединение для обмена данными с сетевой линией 821 связи, которая соединяется с локальной сетью 822. Например, интерфейс 806 связи может представлять собой карту по стандарту цифровой сети с интегрированными услугами (ISDN), кабельный модем, спутниковый модем или модем для того, чтобы предоставлять соединение для передачи данных с соответствующим типом телефонной линии. В качестве другого примера, интерфейс 806 связи может представлять собой карту локальной вычислительной сети (LAN), которая предоставляет соединение для передачи данных с совместимой LAN. Также могут реализовываться линии беспроводной связи. В любой такой реализации, интерфейс 806 связи отправляет и принимает электрические, электромагнитные или оптические сигналы, которые переносят потоки цифровых данных, представляющие различные типы информации.

[0084] Сетевая линия 821 связи типично предоставляет обмен данными через одну или более сетей с другими устройствами передачи данных. Например, сетевая линия 821 связи может предоставлять соединение через локальную сеть 822 с хост-компьютером 823 или с оборудованием передачи данных, управляемым посредством поставщика 824 Интернет-услуг (ISP). ISP 824 в свою очередь предоставляет услуги обмена данными через всемирную сеть передачи пакетных данных, теперь обычно называемую "Интернетом 825". Локальная сеть 822 и Интернет 825 используют электрические, электромагнитные или оптические сигналы, которые переносят потоки цифровых данных. Сигналы через различные сети и сигналы в сетевой линии 821 связи и через интерфейс 806 связи, которые переносят цифровые данные в/из компьютерной системы 800, представляют собой примерные формы передающих сред.

[0085] Компьютерная система 800 может отправлять сообщения и принимать данные, включающие в себя программный код, через сеть(и), сетевую линию 821 связи и интерфейс 806 связи. В Интернет-примере, сервер 826 может передавать запрашиваемый код для прикладной программы через Интернет 825, ISP 824, локальную сеть 822 и интерфейс 806 связи. Принимаемый код может выполняться посредством процессора 802 по мере того, как он принимается, и/или сохраняться в устройстве 805 хранения данных или другом энергонезависимом устройстве хранения данных для последующего выполнения.

[0086] Варианты применения и преимущества

[0087] Вышеприведенные аспекты настоящего раскрытия сущности могут предоставлять формирование метаданных, которые могут использоваться для того, чтобы предоставлять повышенное качество видео, повышенную временную стабильность, низкие требования по объему вычислений и уменьшенную задержку.

[0088] Системы, способы и устройства в соответствии с настоящим раскрытием сущности могут принимать любую одну или более следующих конфигураций.

[0089] (1) Способ редактирования видеоконтента, содержащий: прием входных видеоданных; преобразование входных видеоданных в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные; формирование множества начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента, при этом первое значение метаданных, второе значение метаданных и третье значение метаданных включают в себя информацию, используемую посредством декодера для того, чтобы подготавливать посредством рендеринга декодированное изображение на дисплее.

[0090] (2) Способ согласно (1), дополнительно содержащий применение операции пространственного сглаживания к преобразованным видеоданным до формирования множества начальных значений метаданных.

[0091] (3) Способ согласно (2), в котором применение операции пространственного сглаживания включает в себя субдискретизацию преобразованных видеоданных.

[0092] (4) Способ согласно (2) или (3), в котором применение операции пространственного сглаживания включает в себя прореживание преобразованных видеоданных до меньшего размера.

[0093] (5) Способ согласно любому из (1)-(4), дополнительно содержащий: вывод распространяемых видеоданных, включающих в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.

[0094] (6) Способ согласно любому из (1)-(5), в котором первое фиксированное значение соответствует минимально допустимому значению яркости контента, и второе фиксированное значение соответствует максимально допустимому значению яркости контента.

[0095] (7) Способ согласно любому из (1)-(6), в котором предварительно определенный формат представляет собой формат с расширенным динамическим диапазоном на основе перцепционного квантователя.

[0096] (8) Энергонезависимый машиночитаемый носитель, сохраняющий инструкции, которые, при выполнении посредством процессора компьютерной системы, инструктируют компьютерной системе выполнять операции, содержащие способ согласно любому из (1)-(7).

[0097] (9) Система редактирования видео, содержащая: запоминающее устройство; и процессор, выполненный с возможностью инструктировать системе редактирования видео: принимать входные видеоданные, преобразовывать входные видеоданные в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные, формировать множество начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента.

[0098] (10) Система редактирования видео согласно (9), в которой процессор выполнен с возможностью инструктировать системе редактирования видео: применять операцию пространственного сглаживания к преобразованным видеоданным до формирования множества начальных значений метаданных.

[0099] (11) Система редактирования видео согласно (10), в которой операция пространственного сглаживания включает в себя субдискретизацию преобразованных видеоданных.

[0100] (12) Система редактирования видео согласно (10) или (11), в которой операция пространственного сглаживания включает в себя прореживание преобразованных видеоданных до меньшего размера.

[0101] (13) Система редактирования видео согласно любому из (9)-(12), в которой процессор выполнен с возможностью дополнительно инструктировать системе редактирования видео: выводить распространяемые видеоданные, включающие в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.

[0102] (14) Система редактирования видео согласно любому из (9)-(13), в которой первое фиксированное значение соответствует минимально допустимому значению яркости контента, и второе фиксированное значение соответствует максимально допустимому значению яркости контента.

[0103] (15) Система редактирования видео согласно любому из (9)-(14), в которой предварительно определенный формат представляет собой формат с расширенным динамическим диапазоном на основе перцепционного квантователя.

[0104] (16) Способ редактирования видеоконтента, содержащий: прием входных видеоданных; преобразование входных видеоданных в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные; формирование первого значения метаданных для кадра преобразованных видеоданных, причем первое значение метаданных соответствует среднему значению яркости кадра; определение временного окна, включающего в себя кадр, причем временное окно имеет предварительно определенную длину во времени; вычисление максимального диапазона метаданных и минимального диапазона метаданных за временное окно, чтобы за счет этого формировать первое фильтрованное значение метаданных и второе фильтрованное значение метаданных; и сглаживание первого фильтрованного значения метаданных и второго фильтрованного значения метаданных, чтобы за счет этого формировать первое сглаженное и фильтрованное значение метаданных и второе сглаженное и фильтрованное значение метаданных.

[0105] (17) Способ согласно (16), в котором предварительно определенная длина во времени составляет четыре секунды.

[0106] (18) Способ согласно (16) или (17), в котором окно сконфигурировано таким образом, чтобы не пересекать быстрое переключение сцены во входных видеоданных.

[0107] (19) Способ согласно любому из (16)-(18), дополнительно содержащий применение операции пространственного сглаживания к преобразованным видеоданным до формирования первого значения метаданных.

[0108] (20) Энергонезависимый машиночитаемый носитель, сохраняющий инструкции, которые, при выполнении посредством процессора компьютерной системы, инструктируют компьютерной системе выполнять операции, содержащие способ согласно любому из (16)-(19).

[0109] Относительно процессов, систем, способов, эвристических процедур и т.д., описанных в данном документе, следует понимать, что хотя этапы таких процессов и т.д. описаны как осуществляемые согласно некоторой упорядоченной последовательности, такие процессы могут осуществляться на практике с описанными этапами, выполняемыми в порядке, отличном от порядка, описанного в данном документе. Дополнительно следует понимать, что некоторые этапы могут выполняться одновременно, что другие этапы могут добавляться, или что некоторые этапы, описанные в данном документе, могут опускаться. Другими словами, описания процессов в данном документе предоставляются для целей иллюстрации некоторых вариантов осуществления и никоим образом не должны истолковываться как ограничивающие формулу изобретения.

[0110] Соответственно, следует понимать, что вышеприведенное описание имеет намерение быть иллюстративным, а не ограничивающим. Множество вариантов осуществления и вариантов применения, отличных от предоставленных примеров, должны становиться очевидными после прочтения вышеприведенного описания. Объем должен определяться не со ссылкой на вышеприведенное описание, а вместо этого должен определяться со ссылкой на прилагаемую формулу изобретения, наряду с полным объемом эквивалентов, на которые уполномочена такая формула изобретения. Предполагается и подразумевается, что будущие разработки должны осуществляться в технологиях, поясненных в данном документе, и что раскрытые системы и способы должны быть включены в такие будущие варианты осуществления. В общем, следует понимать, что заявка допускает модификацию и варьирование.

[0111] Все термины, используемые в формуле изобретения, должны получать свои самые широкие обоснованные конструкции и свои обычные смысловые значения, как должны понимать специалисты в областях техники, описанных в данном документе, если иное явно не указывается в данном документе. В частности, использование артиклей единственного числа, таких как "a", "the", "said" и т.д., должно рассматриваться как перечисление одного или более указываемых элементов, если только пункт формулы изобретения не перечисляет иное явное ограничение.

[0112] Реферат раскрытия сущности предоставляется для того, чтобы обеспечивать возможность читателю быстро выявлять характер технического раскрытия сущности. Он представляется с пониманием того, что он не должен использоваться для того, чтобы интерпретировать или ограничивать объем или смысловое значение формулы изобретения. Помимо этого, в вышеприведенном подробном описании можно видеть, что различные признаки группируются в различных вариантах осуществления с целью упрощения раскрытия сущности. Этот способ раскрытия сущности не должен интерпретироваться как отражающий намерение того, что заявленные варианты осуществления включают большее число признаков, чем явно изложено в каждом пункте формуле изобретения. Наоборот, как отражает прилагаемая формула изобретения, предмет изобретения заключается не во всех признаках одного раскрытого варианта осуществления. Таким образом, прилагаемая формула изобретения в силу этого включается в подробное описание, причем каждый пункт является независимым как отдельно заявленный предмет изобретения.

Различные аспекты настоящего изобретения могут приниматься во внимание из следующих перечислимых примерных вариантов осуществления (EEE):

1. Способ редактирования видеоконтента, содержащий:

- прием входных видеоданных;

- преобразование входных видеоданных в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные;

- формирование множества начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента,

- при этом первое значение метаданных, второе значение метаданных и третье значение метаданных включают в себя информацию, используемую посредством декодера для того, чтобы подготавливать посредством рендеринга декодированное изображение на дисплее.

2. Способ согласно EEE 1, дополнительно содержащий применение операции пространственного сглаживания к преобразованным видеоданным до формирования множества начальных значений метаданных.

3. Способ согласно EEE 2, в котором применение операции пространственного сглаживания включает в себя субдискретизацию преобразованных видеоданных.

4. Способ согласно EEE 2 или EEE 3, в котором применение операции пространственного сглаживания включает в себя прореживание преобразованных видеоданных до меньшего размера.

5. Способ согласно любому из EEE 1-4, дополнительно содержащий:

- вывод распространяемых видеоданных, включающих в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.

6. Способ согласно любому из EEE 1-5, в котором первое фиксированное значение соответствует минимально допустимому значению яркости контента, и второе фиксированное значение соответствует максимально допустимому значению яркости контента.

7. Способ согласно любому из EEE 1-6, в котором предварительно определенный формат представляет собой формат с расширенным динамическим диапазоном на основе перцепционного квантователя.

8. Энергонезависимый машиночитаемый носитель, сохраняющий инструкции, которые, при выполнении посредством процессора компьютерной системы, инструктируют компьютерной системе выполнять операции, содержащие способ согласно любому из EEE 1-7.

9. Система редактирования видео, содержащая:

- запоминающее устройство; и

- процессор, выполненный с возможностью инструктировать системе редактирования видео:

- принимать входные видеоданные,

- преобразовывать входные видеоданные в предварительно определенный формат, чтобы за счет этого формировать преобразованные видеоданные,

- формировать множество начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включают в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента.

10. Система редактирования видео согласно EEE 9, в которой процессор выполнен с возможностью инструктировать системе редактирования видео:

- применять операцию пространственного сглаживания к преобразованным видеоданным до формирования множества начальных значений метаданных.

11. Система редактирования видео согласно EEE 10, в которой операция пространственного сглаживания включает в себя субдискретизацию преобразованных видеоданных.

12. Система редактирования видео согласно EEE 10 или EEE 11, в которой операция пространственного сглаживания включает в себя прореживание преобразованных видеоданных до меньшего размера.

13. Система редактирования видео согласно любому из EEE 9-12, в которой процессор выполнен с возможностью дополнительно инструктировать системе редактирования видео:

- выводить распространяемые видеоданные, включающие в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.

14. Система редактирования видео согласно любому из EEE 9-13, в которой первое фиксированное значение соответствует минимально допустимому значению яркости контента, и второе фиксированное значение соответствует максимально допустимому значению яркости контента.

15. Система редактирования видео согласно любому из EEE 9-14, в которой предварительно определенный формат представляет собой формат с расширенным динамическим диапазоном на основе перцепционного квантователя.

Изобретение относится к системе и способу редактирования видеоконтента. Технический результат заключается в повышении качества обработки видеоконтента. Решение включает в себя прием входных видеоданных; преобразование входных видеоданных в предварительно определенный формат; формирование множества начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включает в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента, при этом первое значение метаданных, второе значение метаданных и третье значение метаданных включают в себя информацию, используемую посредством декодера для того, чтобы подготавливать посредством рендеринга декодированное изображение на дисплее. 5 н. и 12 з.п. ф-лы, 10 ил.

1. Способ редактирования видеоконтента, содержащий этапы, на которых:

принимают входные видеоданные;

преобразуют входные видеоданные в предварительно определенный формат, отличающийся от формата входных видеоданных относительно динамического диапазона, чтобы за счет этого формировать преобразованные видеоданные;

применяют операцию пространственного сглаживания к преобразованным видеоданным;

формируют множество начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включает в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, при этом первое фиксированное значение соответствует минимально допустимому значению яркости контента, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента, при этом второе фиксированное значение соответствует максимально допустимому значению яркости контента,

при этом первое значение метаданных, второе значение метаданных и третье значение метаданных включают в себя информацию, используемую посредством декодера для того, чтобы подготавливать посредством рендеринга декодированное изображение на дисплее.

2. Способ по п. 1, в котором предварительно определенный формат представляет собой формат со стандартным динамическим диапазоном, при этом необязательно входные видеоданные находятся в формате с расширенным динамическим диапазоном.

3. Способ по п. 1, в котором применение операции пространственного сглаживания включает в себя этап, на котором субдискретизируют преобразованные видеоданные.

4. Способ по п. 1 или 3, в котором применение операции пространственного сглаживания включает в себя этап, на котором прореживают преобразованные видеоданные до меньшего размера.

5. Способ по любому из пп. 1-4, содержащий также этап, на котором:

выводят распространяемые видеоданные, включающие в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.

6. Способ по любому из пп. 1-5, в котором предварительно определенный формат представляет собой формат с расширенным динамическим диапазоном на основе перцепционного квантователя.

7. Энергонезависимый машиночитаемый носитель, сохраняющий инструкции, которые, при выполнении посредством процессора компьютерной системы, инструктируют компьютерной системе выполнять операции, содержащие способ по любому из пп. 1-6.

8. Система редактирования видео, содержащая:

запоминающее устройство; и

процессор, выполненный с возможностью инструктировать системе редактирования видео:

принимать входные видеоданные,

преобразовывать входные видеоданные в предварительно определенный формат, отличающийся от формата входных видеоданных относительно динамического диапазона, чтобы за счет этого формировать преобразованные видеоданные,

применять операцию пространственного сглаживания к преобразованным видеоданным,

формировать множество начальных значений метаданных для кадра преобразованных видеоданных, причем множество начальных значений метаданных включает в себя первое значение метаданных, соответствующее первому фиксированному значению, не вычисленному из контента, включающего в себя кадр, при этом первое фиксированное значение соответствует минимально допустимому значению яркости контента, второе значение метаданных, соответствующее среднему значению яркости кадра, и третье значение метаданных, соответствующее второму фиксированному значению, не вычисленному из контента, при этом второе фиксированное значение соответствует максимально допустимому значению яркости контента,

9. Система редактирования видео по п. 8, в которой предварительно определенный формат представляет собой формат со стандартным динамическим диапазоном, при этом необязательно входные видеоданные находятся в формате с расширенным динамическим диапазоном.

10. Система редактирования видео по п. 8, в которой операция пространственного сглаживания включает в себя субдискретизацию преобразованных видеоданных.

11. Система редактирования видео по п. 8 или 10, в которой операция пространственного сглаживания включает в себя прореживание преобразованных видеоданных до меньшего размера.

12. Система редактирования видео по любому из пп. 8-11, в которой процессор также выполнен с возможностью инструктировать системе редактирования видео:

выводить распространяемые видеоданные, включающие в себя часть видеоданных, соответствующую кадру, первое значение метаданных, второе значение метаданных и третье значение метаданных.