Настоящая заявка относится к способу и устройству для воспроизведения автостереоскопических изображений. В некоторых вариантах выполнения настоящего изобретения эти способ и устройство относятся к автостереоскопическим дисплеям и, в частности, но не исключительно, некоторые дополнительные варианты выполнения настоящего изобретения относятся к автостереоскопическому дисплею для мобильного устройства.

Автостереоскопические дисплеи способны значительно улучшить работу и взаимодействие пользователя с современными электронными устройствами. Так называемая технология 3D-изображения или технология стереоскопического отображения дисплея обеспечивает создание изображений для левого и правого глаз по отдельности, некоторым образом обманывая пользователя и заставляя его поверить, что он видит трехмерное изображение. Традиционные стереоскопические дисплеи создают изображения для левого и правого глаз, а затем используют фильтры, размещенные на каждом глазу, так, чтобы левый глаз видел только изображение для левого глаза, а правый глаз видел изображение только для правого глаза. Примером использования такой технологии служат поляризационные фильтры, в которых изображения для левого и правого глаз модулированы с различной поляризацией. В настоящее время эта технология широко используется в 3D-кинотеатрах. Однако такая технология, хотя и способна создавать 3D-изображения объектов, требует, чтобы для просмотра изображения каждый пользователь имел необходимые фильтры, обычно в виде пары очков.

Автостереоскопические дисплеи, которые не требуют от пользователя ношения какого-либо устройства для фильтрации левого и правого изображений, но вместо этого фильтруют или направляют изображения непосредственно в правильный глаз, быстро становятся коммерчески осуществимыми. Эти автостереоскопические устройства устраняют существенное препятствие для каждодневного использования 3D дисплеев. В таких дисплеях в дополнение к нему используется множество оптических элементов для фокусировки или направления левого и правого изображений в левый и правый глаза соответственно.

Однако такие автостереоскопические системы могут создавать изображения, которые кажутся поверхностными, а не глубокими, и часто не обеспечивают визуальных индикаторов, которые ожидает зрительная система человека, например отражения и заслонения.

Кроме того, взаимодействие с отображаемым изображением обычно весьма ограничено. У автостереоскопических дисплеев обычно имеется ограниченный диапазон углов наблюдения, за пределами которого автостереоскопическое отображение становится плохим. Например, положение пользователя относительно дисплея и перемещение пользователя относительно дисплея обычно приводят к тому, что пользователь видит неоптимальное изображение вследствие того, что выходит за диапазон углов наблюдения, необходимых для отображения трехмерного изображения.

Таким образом, взаимодействие с изображением, отображаемым на экране трехмерного дисплея, и иллюзия трехмерного изображения в отношении взаимодействия обычно реализованы плохо.

Настоящее изобретение исходит из того, что несмотря на возможность автостереоскопических панелей создавать нужное представление, предпочтительно усовершенствовать такие дисплеи с помощью дополнительных дисплеев и управляющих интерфейсов.

Варианты выполнения настоящего изобретения призваны решить вышеуказанные проблемы.

Согласно первому аспекту настоящего изобретения, предложен способ, включающий:

обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея;

определение поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и

генерирование изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от указанной поверхности, видимой из точки наблюдения пользователя.

Обнаружение положения и ориентации пользователя может включать:

захват по меньшей мере одного изображения пользователя;

определение положения и ориентации глаз пользователя относительно автостереоскопического дисплея.

Захват по меньшей мере одного изображения пользователя может включать захват по меньшей мере одного изображения пользователя из каждой по меньшей мере из двух камер, а обнаружение положения и ориентации может включать обнаружение разницы по меньшей мере между одним изображением пользователя из каждой из этих по меньшей мере двух камер.

Определение поверхности, видимой из точки наблюдения пользователя, может включать: определение модели по меньшей мере одного трехмерного объекта; определение ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя; и генерирование поверхности по меньшей мере одного трехмерного объекта в зависимости от модели по меньшей мере одного трехмерного объекта и ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя.

Кроме того, способ может включать: определение расстояния между зрачками пользователя и управление параллаксным барьером, зависящим по меньшей мере от одного из следующего: положения точки наблюдения пользователя; ориентации точки наблюдения пользователя и расстояния между зрачками пользователя.

Способ может дополнительно включать: определение поверхности проекции, видимой из точки наблюдения пользователя, по меньшей мере одного трехмерного объекта на втором дисплее и генерирование указанной проекции для отображения на втором дисплее в зависимости от поверхности проекции, видимой из точки наблюдения пользователя.

Способ может дополнительно включать определение поверхности проекции, видимой из точки наблюдения пользователя, в зависимости по меньшей мере от одного из следующего: по меньшей мере одного угла освещения и положения трехмерного объекта; модели поверхности для второго дисплея; и по меньшей мере одной модели поверхности трехмерного объекта.

Поверхность проекции может содержать по меньшей мере одно из следующего: частичную тень по меньшей мере от одного трехмерного объекта; полную тень по меньшей мере от одного трехмерного объекта; и отражение по меньшей мере от одного трехмерного объекта.

Способ может дополнительно включать: обнаружение положения объекта относительно автостереоскопического дисплея и/или второго дисплея и определение взаимодействия с обнаруженным объектом.

Обнаружение положения объекта может включать по меньшей мере одно из следующего: обнаружение значения емкости в емкостном датчике объекта и обнаружение видимого изображения объекта.

Определение взаимодействия с обнаруженным объектом может включать определение пересечения между обнаруженным изображением и отображенным изображением.

Отображенное изображение может включать по меньшей мере одно из следующего: виртуальное изображение по меньшей мере одного трехмерного объекта и двумерное изображение, отображаемое на втором дисплее.

Согласно второму аспекту настоящего изобретения, предложено устройство, содержащее по меньшей мере один процессор и по меньшей мере одну память, содержащую компьютерный программный код, при этом указанная память с указанным компьютерным кодом выполнены с возможностью, при его выполнении по меньшей мере одним процессором, заставлять устройство выполнить по меньшей мере следующее:

обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея;

определение поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и

генерирование изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от указанной поверхности, видимой из точки наблюдения пользователя.

Обнаружение положения и ориентации пользователя может заставить устройство выполнить по меньшей мере следующее: захват по меньшей мере одного изображения пользователя; определение положения и ориентации глаз пользователя относительно автостереоскопического дисплея.

Захват по меньшей мере одного изображения пользователя может заставить устройство выполнить по меньшей мере захват по меньшей мере одного изображения пользователя из каждой по меньшей мере двух камер, а обнаружение положения и ориентации может заставить устройство выполнить по меньшей мере обнаружение разницы по меньшей мере между одним изображением пользователя из каждой из этих по меньшей мере двух камер.

Определение поверхности, видимой из точки наблюдения пользователя, может заставить устройство выполнить по меньшей мере следующее: определение модели по меньшей мере одного трехмерного объекта; определение ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя; и генерирование поверхности по меньшей мере одного трехмерного объекта в зависимости от модели по меньшей мере одного трехмерного объекта и ориентации и расстояния по меньшей мере от указанной одной модели трехмерного объекта до точки наблюдения пользователя.

Компьютерный программный код также выполнен с возможностью, при выполнении его по меньшей мере одним процессором, заставлять устройство выполнить по меньшей мере следующее: определение расстояния между зрачками пользователя; и управление параллаксным барьером в зависимости по меньшей мере от одного из следующего:

положения точки наблюдения пользователя;

ориентации точки наблюдения пользователя; и

расстояния между зрачками пользователя.

Компьютерный программный код также выполнен с возможностью, при выполнении его по меньшей мере одним процессором, заставлять устройство выполнить по меньшей мере следующее: определение поверхности проекции, видимой из точки наблюдения пользователя, по меньшей мере одного трехмерного объекта на втором дисплее; и генерирование изображения указанной проекции для отображения на втором дисплее в зависимости от поверхности проекции, видимой из точки наблюдения пользователя.

Компьютерный программный код также выполнен с возможностью, при выполнении его по меньшей мере одним процессором, заставлять устройство выполнить по меньшей мере определение поверхности проекции, видимой из точки наблюдения пользователя, в зависимости по меньшей мере от одного из следующего: по меньшей мере одного угла освещения и положения трехмерного объекта; модели поверхности второго дисплея; и по меньшей мере одной модели поверхности трехмерного объекта.

Поверхность проекции может включать по меньшей мере одно из следующего: частичную тень по меньшей мере от одного трехмерного объекта; полную тень по меньшей мере от одного трехмерного объекта; и отражение по меньшей мере от одного трехмерного объекта.

Компьютерный программный код также выполнен с возможностью, при выполнении его по меньшей мере одним процессором, заставлять устройство выполнить по меньшей мере обнаружение положения объекта относительно автостереоскопического дисплея и/или второго дисплея; и определение взаимодействия с обнаруженным объектом.

При обнаружении положения объекта устройство может по меньшей мере выполнить обнаружение значения емкости в емкостном датчике объекта; и обнаружение видимого изображения объекта.

При определении взаимодействия с обнаруженным объектом устройство может по меньшей мере выполнить определение пересечения между обнаруженным изображением и отображенным изображением.

Отображаемое изображение может включать по меньшей мере одно из следующего: виртуальное изображение по меньшей мере одного трехмерного объекта; и двумерное изображение, отображаемое на втором дисплее.

Согласно третьему аспекту настоящего изобретения, предложено устройство, содержащее: датчик, выполненный с возможностью обнаружения положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея; процессор, выполненный с возможностью определения поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и генератор изображения, предназначенный для генерирования изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от поверхности, видимой из точки наблюдения пользователя.

Указанный датчик может содержать камеру, выполненную с возможностью получения по меньшей мере одного изображения пользователя, и устройство распознавания лица, выполненное с возможностью для определения положения и ориентации глаз пользователя относительно автостереоскопического дисплея.

Могут быть использованы по меньшей мере две камеры, при этом каждая принимает по меньшей мере одно изображение пользователя, а устройство распознавания лица может сравнивать разницу по меньшей мере между одним изображением пользователя от каждой из этих по меньшей мере двух камер.

Процессор может определить модель по меньшей мере одного трехмерного объекта; определить ориентацию и расстояние по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя; и генерировать поверхность по меньшей мере одного трехмерного объекта в зависимости от модели по меньшей мере одного трехмерного объекта, ориентации и расстояния по меньшей мере от модели одного трехмерного объекта до точки наблюдения пользователя.

Кроме того, процессор также способен определять расстояние между зрачками пользователя; и осуществлять управление параллаксным барьером в зависимости по меньшей мере от одного из следующего:

положения точки наблюдения пользователя;

ориентации точки наблюдения пользователя; и

расстояния между зрачками пользователя.

Кроме того, процессор также способен определять поверхность проекции по меньшей мере одного трехмерного объекта на втором дисплее, видимой из точки наблюдения пользователя; и генератор изображения может генерировать изображение проекции для отображения на втором дисплее в зависимости от поверхности проекции, видимой из точки наблюдения пользователя.

Процессор может определить поверхность проекции, видимую из точки наблюдения пользователя, в зависимости по меньшей мере от одного из следующего: по меньшей мере одного трехмерного угла освещения объекта и положения; модели поверхности второго дисплея; и по меньшей мере одной модели поверхности трехмерного объекта.

Поверхность проекции может включать по меньшей мере одно из следующего: частичную тень по меньшей мере от одного трехмерного объекта; полную тень по меньшей мере от одного трехмерного объекта; и отражение по меньшей мере от одного трехмерного объекта.

Кроме того, датчик может быть также выполнен с возможностью обнаружения положения объекта относительно автостереоскопического дисплея и/или второго дисплея и определения взаимодействия с обнаруженным объектом.

Датчик может быть также выполнен с возможностью обнаружения положения объекта путем обнаружения по меньшей мере значения емкости в емкостном датчике объекта и обнаружения видимого изображения объекта.

Процессор может также определять пересечение между обнаруженным изображением и отображаемым изображением.

Отображаемое изображение может включать виртуальное изображение по меньшей мере одного трехмерного объекта.

Отображаемое изображение может включать двумерное изображение, отображаемое на втором дисплее.

Согласно четвертому аспекту настоящего изобретения, предлагается машиночитаемый носитель с закодированными на нем командами, которые при их выполнении компьютером обеспечивают: обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея; определение поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и генерирование изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от указанной поверхности, видимой из точки наблюдения пользователя.

Согласно пятому аспекту настоящего изобретения, предлагается устройство, содержащее: средства обнаружения для обнаружения положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея; средства моделирования для определения поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и средства генерирования изображения для генерирования изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от указанной поверхности, видимой из точки наблюдения пользователя.

Описанное выше устройство может входить в состав некоторого электронного устройства.

Описанное выше устройство может входить в состав набора микросхем.

Для лучшего понимания настоящего изобретения и его практической реализации ниже описаны примеры со ссылками на сопровождающие чертежи, где:

на фиг.1 схематично показано устройство, подходящее для реализации некоторых вариантов выполнения настоящего изобретения;

на фиг.2 схематично показано физическое представление устройства, изображенного на фиг.1, которое подходит для реализации некоторых вариантов выполнения настоящего изобретения;

на фиг.3 схематично показаны компоненты обработки в устройстве согласно некоторым вариантам выполнения настоящего изобретения;

на фиг.4A схематично показано отслеживание положения головы в некоторых вариантах выполнения настоящего изобретения;

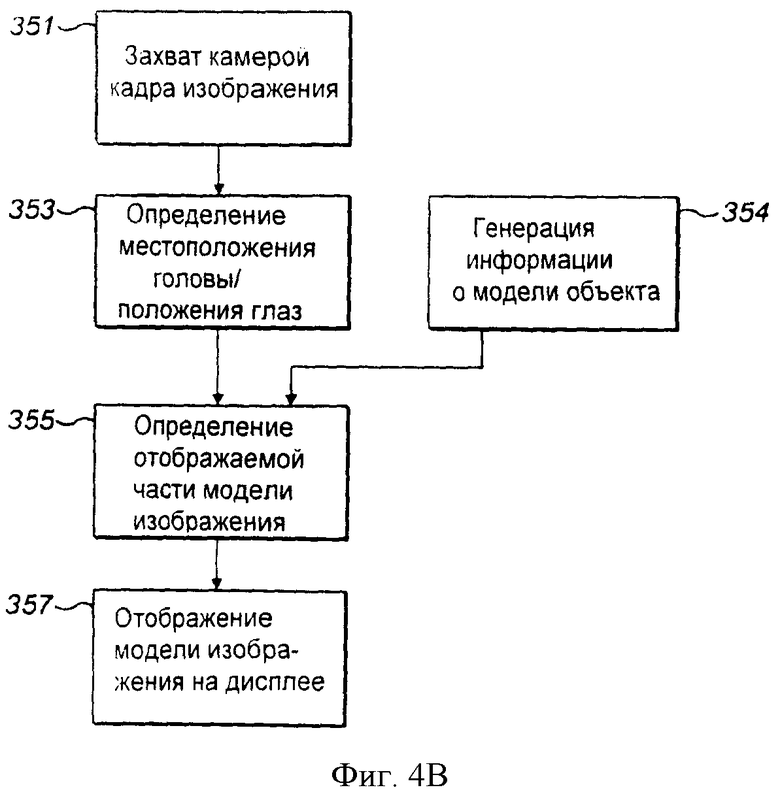

на фиг.4B показана последовательность операций, выполняемых при отслеживании положения головы согласно некоторым вариантам выполнения настоящего изобретения;

на фиг.5A схематично показано генерирование отражения/тени для изображений согласно некоторым вариантам выполнения настоящего изобретения;

на фиг.5B показана последовательность операций, выполняемых при генерировании отражения/тени для изображений согласно некоторым вариантам выполнения настоящего изобретения;

на фиг.6A схематично показано физическое представление взаимодействия с пользовательским интерфейсом согласно некоторым вариантам выполнения настоящего изобретения;

на фиг.6B схематично показано дополнительное физическое представление взаимодействия с пользовательским интерфейсом согласно некоторым вариантам выполнения настоящего изобретения;

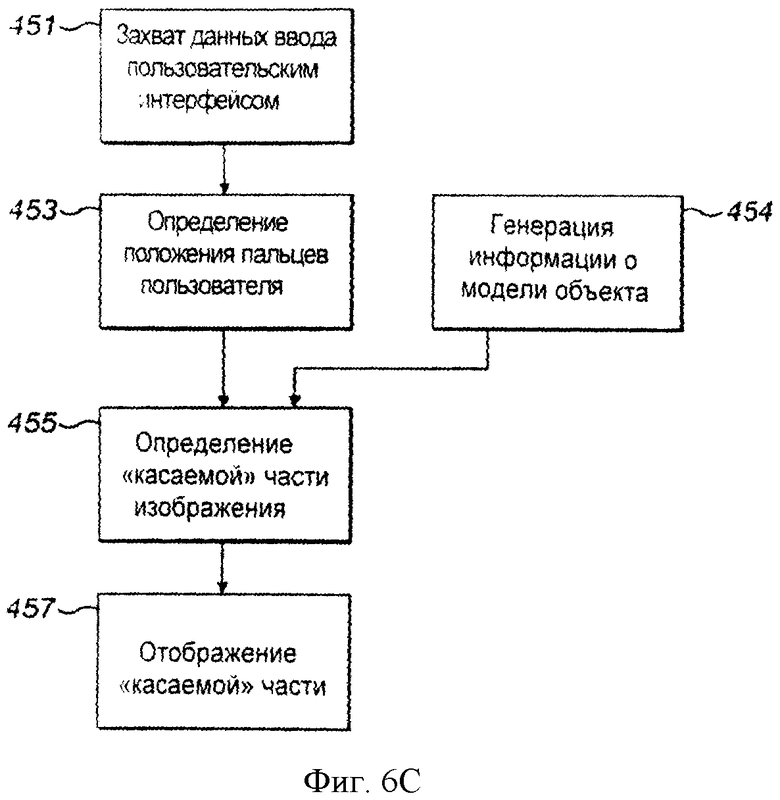

на фиг.6C показана последовательность операций, выполняемых при взаимодействии с пользовательским интерфейсом согласно некоторым вариантам выполнения настоящего изобретения; и

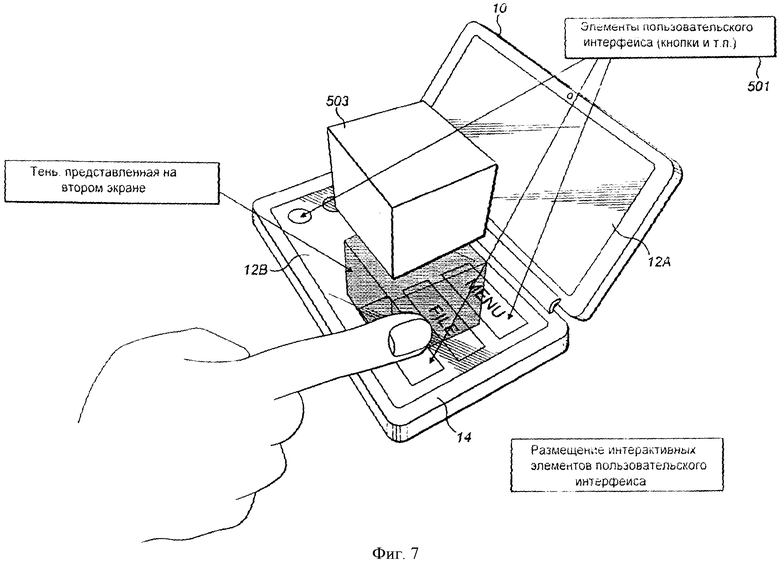

на фиг.7 схематично показано дополнительное физическое представление взаимодействия с пользовательским интерфейсом согласно некоторым вариантам выполнения настоящего изобретения.

В настоящем документе описаны устройство и способы создания более реалистичного и интерактивного трехмерного дисплея и, таким образом, создания более многонаправленного и интерактивного восприятия для пользователя, чем то, которое может быть получено с использованием только одного стереоскопического дисплея. Таким образом, как описано ниже в вариантах выполнения настоящего изобретения, комбинация двух дисплеев в складном электронном приборе или устройстве с соответствующими датчиками, контролирующими положение пользователя, позволяет выполнять это устройство так, что восприятие отображаемого трехмерного изображения значительно улучшается. Кроме того, в некоторых вариантах выполнения настоящего изобретения использование слежения за головой может быть реализовано с двойными дисплеями, что позволяет дополнительно улучшить отображаемые изображения. В некоторых дополнительных вариантах выполнения настоящего изобретения конфигурация устройства пользовательского интерфейса с двойным дисплеем дополнительно улучшает восприятие и взаимодействие с отображаемыми изображениями.

Ниже описано устройство и способы создания улучшенного дисплея для автостереоскопического изображения и взаимодействия. На фиг.1 схематично показана блок-схема данного в качестве примера электронного прибора 10 или устройства, в котором могут быть реализованы варианты выполнения настоящего изобретения. Электронное устройство 10 обеспечивает улучшенный дисплей для автостереоскопического изображения и взаимодействия.

В некоторых вариантах выполнения настоящего изобретения электронное устройство 10 представляет собой мобильный терминал, мобильный телефон или пользовательское оборудование для работы в системе беспроводной связи. В других вариантах выполнения настоящего изобретения электронное устройство представляет собой любое подходящее электронное устройство, выполненной с возможностью отображения изображения, например цифровой фотоаппарат, переносной аудиоплеер (mр3-плеер), переносной видеоплеер (mр4-плеер).

Электронное устройство 10 содержит интегрированный модуль 11 камеры, который соединен с процессором 15. Кроме того, процессор 15 связан с первым дисплеем (дисплей А) 12A и вторым дисплеем (дисплей В) 12B. Кроме того, процессор 15 также соединен с приемопередатчиком (TX/RX) 13, пользовательским интерфейсом (UI) 14 и памятью 16. В некоторых вариантах выполнения настоящего изобретения модуль 11 камеры и/или дисплеи 12A и 12B являются отдельными или съемными относительно электронного устройства, а процессор принимает сигналы из модуля 11 камеры и/или передает сигналы в дисплеи 12A и 12B через приемопередатчик 13 или другой подходящий интерфейс.

Процессор 15 может быть выполнен с возможностью выполнения различных программных кодов 17. В некоторых вариантах выполнения настоящего изобретения реализованные программные коды 17 содержат коды цифрового преобразования захваченного изображения или коды конфигурации. Реализованные программные коды 17 в некоторых вариантах выполнения настоящего изобретения содержат дополнительный код для дальнейшей обработки изображений. Реализованные программные коды 17 в некоторых вариантах выполнения настоящего изобретения могут храниться, например, в памяти 16 и извлекаться из нее процессором 15 при необходимости. В некоторых вариантах выполнения настоящего изобретения память 15 может иметь раздел 18 для хранения данных, например данных, которые были обработаны в соответствии с настоящим изобретением.

Модуль 11 камеры содержит камеру 19, имеющую линзы для фокусировки изображения на цифровых средствах захвата изображения, например устройстве с зарядовой связью (ПЗС или CCD). В других вариантах выполнения настоящего изобретения цифровые средства захвата изображения могут быть любым подходящим устройством получения изображения, таким как датчик изображения на основе структуры КМОП (комплементарный металло-оксидный полупроводник или CMOS). Кроме того, модуль 11 камеры также содержит импульсную лампу 20 для освещения объекта до получения его изображения. Импульсная лампа 20 соединена с процессором 21 камеры. Камера 19 также соединена с процессором 21 камеры для обработки сигналов, принятых из камеры. Процессор 21 камеры соединен с памятью 22 камеры, которая может хранить программные коды для процессора 21 камеры, которые выполняются после захвата изображения. В некоторых вариантах выполнения настоящего изобретения реализованные программные коды (не показаны) могут храниться, например, в памяти 22 камеры и извлекаться процессором 21 камеры при необходимости. В некоторых вариантах выполнения настоящего изобретения процессор 21 камеры и память 22 камеры реализованы в пределах устройства 10, процессора 15 и памяти 16 соответственно.

В некоторых вариантах выполнения настоящего изобретения пользователь электронного устройства 10 использует модуль 11 камеры для захвата изображений, которые будут использоваться для управления дисплеями 12A и 12B, как описано ниже при рассмотрении фиг.4A, 4B, 5A и 5B. В некоторых других вариантах выполнения настоящего изобретения модуль камеры может захватывать изображения, которые могут быть переданы в некоторое другое электронное устройство для обработки, и выдавать информацию, необходимую для взаимодействия с дисплеем. Например, если вычислительная мощность устройства недостаточна, некоторые операции обработки могут быть реализованы в дополнительном устройстве. Для этого соответствующие приложения в некоторых вариантах выполнения настоящего изобретения могут быть активированы пользователем посредством пользовательского интерфейса 14.

В некоторых вариантах выполнения настоящего изобретения модуль камеры содержит по меньшей мере две камеры, при этом каждая камера расположена на той же стороне устройства.

В некоторых вариантах выполнения настоящего изобретения процессор 21 камеры или процессор 15 может быть выполнен с возможностью принимать данные изображения из камеры или множества камер и затем обрабатывать данные изображения для идентификации объекта, размещенного перед камерой. К таким объектам, которые могут быть идентифицированы процессором 21 камеры или процессором 15, могут относиться, например, лицо или голова пользователя, глаза пользователя, палец или указательное устройство, используемое пользователем. Кроме того, в некоторых вариантах выполнения настоящего изобретения процессор 21 камеры или процессор 15 могут определить или оценить положение идентифицированного объекта перед устройством. Использование этого процесса идентификации и процесса оценки положения подробно описано ниже.

В вариантах выполнения настоящего изобретения устройство 10 может использовать технику обработки по меньшей мере частично в рамках аппаратных средств, другими словами, обработка, выполняемая процессором 15 и процессором 21 камеры, может быть реализована по меньшей мере частично в аппаратных средствах без потребности в программном обеспечении или встроенном микропрограммном обеспечении, управляющем аппаратными средствами.

В некоторых вариантах выполнения настоящего изобретения пользовательский интерфейс 14 позволяет пользователю вводить команды в электронное устройство 10. В некоторых вариантах выполнения настоящего изобретения пользовательский интерфейс 14 может быть реализован, например, как клавиатура, кнопка, которой манипулирует пользователь, переключатели или сенсорный интерфейс, реализованный на одном или обоих дисплеях 12A и 12B. Кроме того, в некоторых вариантах выполнения настоящего изобретения часть функций пользовательского интерфейса может быть получена из камеры 19, захватывающей информацию об изображении, в результате чего информация об идентификации объекта и его положении может использоваться для ввода данных в устройство.

Приемопередатчик 13 обеспечивает связь с другими электронными устройствами, например, в некоторых вариантах выполнения настоящего изобретения посредством беспроводной сети.

На фиг.2 более подробно показано физическое воплощение устройства, показанного на фиг.1, в некоторых вариантах выполнения настоящего изобретения. Как показано на фиг.2, устройство 10 может быть реализовано в складной конфигурации. В таких вариантах выполнения настоящего изобретения в складной конфигурации, как показано на фиг.2, устройство содержит первую часть 203 корпуса и вторую часть 201 корпуса, которые соединены шарниром 205. В некоторых вариантах выполнения настоящего изобретения шарнир 205 действует не только как механическое соединение между первой частью 203 корпуса и второй частью 201 корпуса, но и обеспечивает электрическое соединение между компонентами первой части 203 корпуса и второй части 201 корпуса. В других вариантах выполнения настоящего изобретения шарнир представляет собой только механическое соединение, а электрическое соединение выполнено отдельно. В некоторых вариантах выполнения настоящего изобретения электрическое соединение может быть проводным соединением и выполнено, например, гибким ленточным кабелем, а в некоторых других вариантах выполнения настоящего изобретения соединение между первой и второй частями корпуса может быть беспроводным соединением.

Хотя последующие варианты выполнения настоящего изобретения описаны в отношении складной конфигурации с шарнирным соединением первой части 203 корпуса и второй части 201 корпуса, в некоторых других вариантах выполнения настоящего изобретения может применяться скользящее соединение, при котором первая часть 203 корпуса скользит по второй части 201 корпуса; в некоторых таких вариантах выполнения настоящего изобретения первая часть 203 корпуса дополнительно способна поворачиваться и быть повернутой относительно второй части 201 корпуса на некоторый угол, образуя конфигурацию, аналогичную конфигурации дисплея. Этот скользящий/поворотный шарнир может быть аналогичен тому, который используется в настоящее время в таком пользовательском оборудовании, как Nokia N97.

Кроме того, в некоторых вариантах выполнения настоящего изобретения первая часть 203 корпуса и вторая часть 201 корпуса могут быть соединены шарниром, допускающим поворот в двух направлениях, аналогично используемому в планшетных компьютерах, при этом шарнир соединяет первую часть 203 корпуса и вторую часть 201 корпуса так, что их можно сложить и разложить, чтобы открыть устройство, но можно также повернуть, чтобы защитить или вывести на передний план внутренние поверхности, если шарнир вновь сложить.

Как показано на фиг.2, первая часть 203 корпуса содержит на одной поверхности первый дисплей 12A, который может быть автостереоскопическим дисплеем (также известным как 3D дисплей), и камеру 19. 3D дисплей 12A может быть любым подходящим автостереоскопическим дисплеем. Например, 3D дисплей 12A в некоторых вариантах выполнения настоящего изобретения может быть выполнен в виде жидкокристаллического дисплея с параллаксными барьерами. Принцип работы параллаксных барьеров известен, при этом оптическая апертура выровнена со столбцами пикселей жидкокристаллического дисплея (LCD), чтобы чередующиеся столбцы жидкокристаллических пикселей можно было видеть левым и правым глазами по отдельности. Другими словами, параллаксные барьеры действуют так, чтобы в некоторых вариантах выполнения настоящего изобретения четные столбцы жидкокристаллических пикселей можно было видеть левым глазом, а нечетные столбцы жидкокристаллических пикселей можно было видеть правым глазом. В некоторых вариантах выполнения настоящего изобретения параллаксные барьеры могут быть управляемыми и способными управлять углом представления изображения.

В некоторых других вариантах выполнения настоящего изобретения автостереоскопический (3D) дисплей 12A может быть реализован как линзообразный оптический жидкокристаллический дисплей, в котором цилиндрические линзы выровнены со столбцами жидкокристаллических пикселей, для создания эффекта, аналогичного создаваемому параллаксными барьерами. Другими словами, чередующиеся столбцы жидкокристаллических пикселей создают чередующиеся изображения для левого и правого глаз, которые направляются только к левому и правому глазам. В других вариантах выполнения настоящего изобретения 3D дисплей может быть реализован с использованием микрополяризаторов. В других вариантах выполнения настоящего изобретения 3D дисплей может содержать голографический дисплей для создания действительного изображения с использованием источника рассеянного света.

В некоторых вариантах выполнения настоящего изобретения первый дисплей, 3D дисплей 12A, может дополнительно содержать сенсорный интерфейс ввода. В некоторых вариантах выполнения настоящего изобретения сенсорный интерфейс ввода может быть емкостным сенсорным интерфейсом, подходящим для обнаружения непосредственного касания поверхности дисплея или для обнаружения емкостного эффекта между поверхностью дисплея и другим объектом, таким как палец, что позволяет определить его положение относительно плоскости дисплея и, в некоторых вариантах выполнения настоящего изобретения, от поверхности дисплея.

Хотя первый дисплей 12A, описанный выше, может быть выполнен в виде жидкокристаллического дисплея, очевидно, что можно использовать дисплей, созданный с использованием любой технологии создания дисплея. Например, в некоторых вариантах выполнения настоящего изобретения первый дисплей 12A может быть выполнен с использованием светодиодов (LED) или органических светодиодов (OLED) с такой системой апертур или линз, которые обеспечивают генерацию двух отдельных изображений, направляемых в левый и правый глаза пользователя.

В некоторых вариантах выполнения настоящего изобретения первый дисплей 12A может работать в двумерном (2D) режиме. Например, в вариантах выполнения настоящего изобретения, в которых для направления чередующихся слоев пикселей к левому и правому глазам используется параллаксный барьер, при выключении слоя параллаксного барьера все строки пикселей станут видимы обоими глазами.

Вторая часть 201 корпуса, показанная на фиг.2, содержит на одной своей поверхности второй дисплей 12B, который может быть 2D дисплеем 12B. 2D дисплей может быть выполнен с использованием любой подходящей технологии создания дисплея, например это может быть жидкокристаллический дисплей (LCD), дисплей из светодиодов (LED) или органических светодиодов (OLED).

В других вариантах выполнения настоящего изобретения второй дисплей 12B может содержать второй автостереоскопический (3D) дисплей, способный работать в 2D режиме, например, при выключении слоя параллаксного барьера способом, подобным описанному выше.

В некоторых вариантах выполнения настоящего изобретения второй, или 2D, дисплей 12B содержит сенсорный интерфейс, аналогичный сенсорному интерфейсу, описанному выше в отношении первого дисплея, и позволяющий определить положение объекта как на поверхности дисплея, так и в направлении от поверхности дисплея. Таким образом, в некоторых вариантах выполнения настоящего изобретения сенсорный интерфейс содержит емкостный сенсорный интерфейс, подходящий для определения положения объекта на и от поверхности дисплея путем определения значения емкости поверхности дисплея.

Ниже со ссылками на фиг.6A, 6B и 6C описана работа сенсорного интерфейса.

Следует понимать, что конструкция электронного устройства 10 может быть осуществлена и модифицирована разными способами.

Очевидно, что схемы, показанные на фиг.4A, 5A, 6A, 6B и 7, и шаги способа, проиллюстрированные на фиг.4B, 5B и 6C, показывают только часть работы всей системы, включающей некоторые варианты выполнения настоящего изобретения, реализованные в электронном устройстве, показанном на фиг.1.

Схематическое представление конфигурации процессора 15 для некоторых вариантов выполнения настоящего изобретения более подробно показано на фиг.3. Процессор 15 содержит процессор 101 камеры/местоположения головы, который принимает информацию об изображении из камеры и на основании этой информации из камеры 19 идентифицирует объекты и их положение/ориентацию. В некоторых вариантах выполнения настоящего изобретения процессор 101 камеры по информации об изображении из камеры может определить местоположение и ориентацию головы пользователя. Процессор 101 камеры в некоторых вариантах выполнения настоящего изобретения принимает изображение головы, захваченное камерой 19, и проецирует данные 2D изображения на поверхность, например цилиндр, чтобы обеспечить устойчивое представление лица независимо от текущей ориентации, положения и масштаба модели поверхности. По этой проекции можно оценить ориентацию и положение. Однако подразумевается, что может использоваться любой подходящий алгоритм слежения за головой, например алгоритмы слежения и регистрации глаз, описанные в документе «fast, reliable head tracking under varying illumination: an approach based on registration of texture mapped 3D models», авторы Kaskia и др., опубликованном в Computer Science Technical Report, в мае 1999 г. В некоторых других вариантах выполнения настоящего изобретения, в которых два изображения захватываются двумя камерами, расположенными или ориентированными по-разному, разницу между изображениями можно использовать для оценки положения и ориентации лица на основе знания о различии между камерами.

В некоторых дальнейших вариантах выполнения настоящего изобретения процессор 101 камеры может дополнительно определять расстояние между глазами пользователя.

В некоторых дальнейших вариантах выполнения настоящего изобретения процессор 101 камеры может идентифицировать палец или другой указательный объект, а кроме того, относительное положение пальца (или указательного объекта) и передавать эти данные в автостереоскопический дисплей.

Процессор 101 камеры/положения головы выдает индикацию идентифицированного объекта, а кроме того, положение и/или ориентацию идентифицированного объекта относительно дисплея в процессор 105 изображения.

Процессор 15 может дополнительно содержать процессор касания/процессор 103 пользовательского интерфейса, предназначенный для приема данных, вводимых пользователем, например, из интерфейса 14 пользователя, такого как сенсорный интерфейс, выполненный, согласно некоторым вариантам выполнения настоящего изобретения, или в пределах первого дисплея 12A, или в пределах второго дисплея 12B. В других вариантах выполнения настоящего изобретения интерфейс 14 пользователя может содержать другие средства ввода, такие как «мышь», клавиатуру, группу клавиш или любое другое подходящее устройство для ввода данных пользователем. Процессор 103 пользовательского интерфейса обрабатывает данные, вводимые пользователем, чтобы определить, были ли приняты релевантные данные ввода для дисплея изображения. Например, процессор пользовательского интерфейса может принять значения емкости из сенсорного интерфейса поверхности дисплея и по этому значению емкости определить местоположение области, где было произведено касание. В других вариантах выполнения настоящего изобретения процессор 103 пользовательского интерфейса может по значению емкости определить расстояние от «касающегося» объекта до поверхности дисплея. Таким образом, чтобы обнаружить объект в диапазоне распознавания сенсорного интерфейса для сенсорного интерфейса может не требоваться непосредственный контакт. Кроме того, хотя выше и ниже касание описано в отношении обнаруживаемого физического объекта, такого как палец пользователя, подразумевается, что в некоторых вариантах выполнения настоящего изобретения процессор пользовательского интерфейса обнаруживает и обрабатывает данные о виртуальном объекте, таком как изображение указателя, отображаемого на экране дисплея и которым можно управлять при помощи мыши, шарового манипулятора, клавиш или любых подходящих средств управления.

Процессор 103 пользовательского интерфейса может выдавать в процессор 105 изображения индикацию того, чем является объект и в каком месте этот объект (который, как описано выше, может быть физическим объектом или отображаемым виртуальным объектом), используемый пользователем, касается экрана или указывает на него.

Процессор 15 может дополнительно содержать процессор 107 модели изображения. Процессор модели изображения в некоторых вариантах выполнения настоящего изобретения хранит ряд моделей изображения, которые могут использоваться процессором 105 изображения. Например, процессор модели изображения может хранить модели данных трехмерного изображения для создания на дисплее трехмерного изображения, сгенерированного процессором 105 изображения. Таким образом в некоторых вариантах выполнения настоящего изобретения процессор модели изображения хранит ряд моделей геометрических форм или ячеек, описывающих элементы, которые составляют среду, отображаемую на экране процессором изображения.

Процессор 15 может дополнительно содержать процессор 105 изображения, предназначенный для приема информации из камеры, пользовательского интерфейса и модели изображения и генерации изображения, выводимого на оба дисплея. Дополнительные примеры описаны ниже. Процессор 105 изображения выводит изображения, которые будут отображены на дисплее, в драйвер 109 3D дисплея и драйвер 111 2D дисплея.

Драйвер 108 3D дисплея принимает из процессора 105 изображения данные изображения для первого дисплея и генерирует данные, выдаваемые в первый (3D) дисплей 12A в форме данных изображения для левого глаза и данных изображения для правого глаза, предназначенных для создания трехмерного изображения. Кроме того, в некоторых вариантах выполнения настоящего изобретения работа драйвера 3D дисплея может зависеть от расстояния между глазами и/или положения головы пользователя, которые определяют параллаксный барьер (или аналогичное средство управления разделением изображения для левого и правого глаз) для оптимизации изображения на 3D дисплее.

Аналогично, драйвер 2D дисплея принимает из процессора 105 изображения данные изображения для второго дисплея 12B и генерирует данные для второго (2D) дисплея 12B.

На фиг.4A и 4B более подробно иллюстрируется взаимодействие между процессором 101 камеры, процессором 105 изображения, процессором 107 модели изображения и драйвером 109 3D дисплея в некоторых вариантах выполнения настоящего изобретения. На фиг.4A показано устройство 10, которое генерирует 3D изображение с использованием 3D дисплея 12B. 3D изображение, сгенерированное в этом примере, является прямоугольным параллелепипедом, который кажется пользователю плавающим перед 3D дисплеем.

В некоторых вариантах выполнения настоящего изобретения камера 19 захватывает кадр изображения и передает данные кадра изображения в процессор 101 камеры. Работа камеры по захвату данных кадра изображения иллюстрируется на фиг.4B шагом 351.

Как описано выше, процессор 101 камеры может обрабатывать данные кадра изображения и из этих данных определять положение и ориентацию головы, а в некоторых вариантах выполнения настоящего изобретения положение глаз пользователя. Определение положения/ориентации головы и положения глаз происходит в рамках любого подходящего процесса моделирования головы, например, описанного выше. Эта информация о голове и глазах затем может быть передана в процессор 105 изображения. Определение расположения головы и положения глаз показано на фиг.4B шагом 353.

Процессор 107 модели изображения при определении объекта, отображаемого на экране, может извлекать или генерировать информацию о модели объекта и передавать эту информацию о модели объекта в процессор 105 изображения. Например, как показано на фиг.4A, изображение, отображаемое на экране, может быть прямоугольным параллелепипедом с нетекстурированными плоскими гранями. Таким образом, процессор 107 модели изображения может выдавать размеры и ориентацию прямоугольного параллелепипеда в процессор 105 изображения. Генерация информации о модели объекта показана на фиг.4B шагом 354.

Процессор 105 изображения, приняв информацию о голове/глазах и информацию о модели объекта (например, размерах и ориентации объекта или объектов, которые будут отображены на экране), в некоторых вариантах выполнения настоящего изобретения может затем определить область или поверхность 3D объекта, которая может быть видна пользователю. Процессор 105 изображения может использовать геометрические соотношения между положением и ориентацией головы пользователя и положением и ориентацией отображаемого объекта, чтобы, таким образом, определить область, которая может быть уведена из обнаруженной точки наблюдения. Операция определения поверхности модели изображения, которая будет отображена на экране, показана на фиг.4B шагом 355.

Затем процессор 105 изображения может вывести в драйвер 109 3D дисплея данные для генерации изображений для левого и правого глаз, которые будут выведены в 3D дисплей 12A, и, таким образом, генерирует изображения для левого и правого глаз, в результате чего создается изображение, которое кажется плывущим перед 3D дисплеем. Операция вывода на экран изображения из драйвера 109 3D дисплея показана на фиг.4B шагом 357.

Таким образом, в некоторых вариантах выполнения настоящего изобретения, и как показано в фиг.4A, когда обнаружено, что пользователь смотрит прямо и обращен лицом к прямоугольному параллелепипеду, пользователю предоставляют изображения для левого и правого глаз, которые представляют собой только изображения лицевой грани прямоугольного параллелепипеда. Другими словами, процессор 105 изображения выдает в драйвер 109 3D дисплея информацию, позволяющую драйверу 109 3D дисплея генерировать изображения для левого и правого глаз, обеспечивая 3D дисплей данными для представления только лицевой грани прямоугольного параллелепипеда 301A. Однако, когда пользователь перемещается к одной из сторон прямоугольного параллелепипеда, как показано в правой части фиг.4A, движение головы/глаз и, таким образом, смещение положения определяется процессором 101 камеры, который передает эту информацию в процессор 105 изображения. Процессор изображения в некоторых вариантах выполнения настоящего изобретения может принять решение, что пользователь из обнаруженной точки наблюдения может видеть по меньшей мере две грани прямоугольного параллелепипеда, и, таким образом, процессор изображения отправляет в драйвер 109 3D дисплея информацию, разрешающую генерацию изображений для левого и правого глаз, которая позволяет 3D дисплею 12A представить поверхность прямоугольного параллелепипеда с двумя гранями, которые могут быть увидены пользователем 301B.

Хотя в приведенном выше описании подробно описано только взаимодействие камеры и 3D изображения единственного объекта, очевидно, что то же самое устройство посредством тех же операций может отобразить на экране более одного объекта, а кроме того, обнаружение положения головы позволяет рассматривать различные объекты под разными углами. Таким образом, например, если из первой точки наблюдения моделируются два объекта, процессор изображения может решить, что один объект полностью заслоняет второй объект, другими словами, из обнаруженной точки наблюдения второй объект находится в тени первого, при этом, когда процессор 105 изображения принимает информацию о том, что голова значительно переместилась, процессор 105 изображения в некоторых вариантах выполнения настоящего изобретения может передать в драйвер 109 3D дисплея информацию, обеспечивающий рендеринг (построение изображения) обоих объектов.

Таким образом, в этих вариантах выполнения настоящего изобретения имеет место более высокая степень интерактивности дисплея, чем в стандартных автостереоскопических дисплеях, которые не реагируют на движение пользователя.

Таким образом, в некоторых вариантах выполнения настоящего изобретения предложен способ, включающий обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея, определение поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя, и генерирование на автостереоскопическом дисплее изображений для левого и правого глаз, зависящих от указанной поверхности, видимой из точки наблюдения пользователя.

Кроме того, в рамках таких вариантов выполнения способ согласно настоящему изобретению может включать обнаружение положения и ориентации пользователя путем захвата по меньшей мере одного изображения пользователя и определения положения и ориентации глаз пользователя относительно автостереоскопического дисплея.

Также в некоторых вариантах выполнения настоящего изобретения захват по меньшей мере одного изображения пользователя может включать захват по меньшей мере одного изображения пользователя из каждой по меньшей мере из двух камер, а обнаружение положения и ориентации включает обнаружение разницы по меньшей мере между одним изображением пользователя из каждой из этих по меньшей мере двух камер.

В некоторых вариантах выполнения настоящего изобретения определение поверхности, видимой из точки наблюдения пользователя, включает определение модели по меньшей мере одного трехмерного объекта, определение ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя и генерирование поверхности по меньшей мере одного трехмерного объекта в зависимости от модели по меньшей мере одного трехмерного объекта и ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя.

В некоторых вариантах выполнения настоящего изобретения процессор 105 изображения также определяет ситуацию, когда расположение и ориентация пользователя изменились так, что фильтры автостереоскопического изображения (например, параллаксные барьеры) оказываются не оптимальными. В таких вариантах выполнения настоящего изобретения процессор 105 изображения может генерировать сообщение, которое будет отображено на экране, указывая, что пользователь выходит из оптимального диапазона наблюдения. В других вариантах выполнения настоящего изобретения процессор изображения может генерировать информацию, которая передается в драйвер 109 3D дисплея для изменения фильтров. Например, если в 3D дисплее 12B имеются управляемые параллаксные барьеры для фильтрации изображений для левого и правого глаз, процессор изображения может передать в драйвер 3D дисплея информацию, разрешающую смещение параллаксного барьера для сохранения возможности поддерживать трехмерное изображение. В некоторых других вариантах выполнения настоящего изобретения, например в случае, когда сам дисплей является позиционируемым, процессор 105 изображения может генерировать информацию, позволяющую позиционировать дисплей и поддерживать объемное представление объекта. Например, если дисплей выполнен на поворотном шарнире, этот шарнир может поворачиваться, позволяя пользователю перемещаться вокруг устройства при сохранении трехмерного отображения.

Кроме того, в некоторых вариантах выполнения настоящего изобретения процессор 101 камеры может определять расстояние между зрачками и передавать эту информацию в процессор изображения. Кроме того, в некоторых вариантах выполнения настоящего изобретения эта информация может позволить процессору 105 изображения передавать информацию в драйвер 3D дисплея, разрешая такую оптимизацию параллаксного барьера, при которой изображения для левого и правого глаз и операции фильтрации изображения лучше оптимизированы для конкретного пользователя. Например, поскольку у детей расстояние между зрачками меньше, процессор изображения может оптимизировать использование устройства для детей или взрослых, поскольку настройки, используемые для взрослых, привели бы к плохим результатам по выдаче объемного изображения для детей, и наоборот.

На фиг.5A и 5B показаны дополнительные варианты выполнения настоящего изобретения, более подробно иллюстрирующие взаимодействие между камерой 19, 3D дисплеем 12A и 2D дисплеем 12B. Работа элемента 3D дисплея в некоторых вариантах выполнения настоящего изобретения аналогична описанной выше, при этом камера контролирует положение головы/глаз пользователя и с учетом знаний об объекте, отображаемом на экране, генерирует изображения для левого и правого глаз с формированием трехмерного изображение объекта с точки зрения пользователя. Такие изображения можно дополнительно улучшить путем добавления и внедрения по меньшей мере одного 2D дисплея 12B, как описано ниже.

Как описано в вариантах выполнения настоящего изобретения, в которых раскрыто взаимодействие камеры и 3D дисплея 12A, камера 19 в некоторых вариантах выполнения настоящего изобретения захватывает данные кадра изображения и передает их в процессор 101 камеры. Работа камеры по захвату данных кадра изображения показана на фиг.5B шагом 351. Подразумевается, что те же данные изображения, захваченные и обработанные в вариантах выполнения настоящего изобретения с 3D взаимодействием, описанных выше, могут также использоваться в вариантах выполнения настоящего изобретения с 2D взаимодействием, описанных ниже. При описании сходных или одинаковых процессов используются одинаковые позиции.

Процессор 101 камеры, как описано выше, может также обрабатывать данные кадра изображения и по этим данным определять положение и ориентацию головы, а в некоторых вариантах выполнения настоящего изобретения - положение глаз пользователя. Определение положения головы/ориентации и положения глаз выполняется в рамках любого подходящего процесса моделирования головы, описанного выше. В некоторых вариантах выполнения настоящего изобретения эта информация о глазах может включать определение уровня глаз пользователя относительно дисплея. Эта информация о голове и глазах может быть затем передана в процессор 105 изображения. Определение местоположения головы и местоположения глаз также показано на фиг.5B шагом 353.

Процессор 107 модели изображения при определении объекта, отображаемого на экране, может извлекать или генерировать информацию о модели объекта, а кроме того, передавать эту информацию о модели объекта в процессор 105 изображения. Например, как показано на фиг.5A, изображение, отображаемое на экране, может быть прямоугольным параллелепипедом с нетекстурированными плоскими гранями. Кроме того, в некоторых вариантах выполнения настоящего изобретения модель объекта может также включить информацию об освещении, информацию о коэффициенте отражения поверхности, информацию о расположении объекта, а кроме того, информацию о фоне, такую как текстура, и коэффициенте отражения поверхности, над которой «плавает» объект. Таким образом, процессор 107 модели изображения может выдать эту информацию в процессор 105 изображения. Генерация информации о модели объекта показана на фиг.5B шагом 354.

Процессор 105 изображения, приняв информацию о голове/глазах и информацию о модели объекта (например, о размерах и ориентации объекта или объектов, которые будут отображены на экране), в некоторых вариантах выполнения настоящего изобретения может затем определить область или поверхность 3D объекта, которая может быть видна пользователю в пределах 2D поверхности под 3D объектом. Другими словами, процессор изображения может определить поверхность проекции 3D объекта на 2D дисплей. В некоторых вариантах выполнения настоящего изобретения объект или определяемая поверхность могут быть тенью, отбрасываемый 3D объектом на основание, при этом основание не отражает свет, а источник, освещающий объект, находится выше объекта. В некоторых других вариантах выполнения настоящего изобретения определяемая спроецированная область или поверхность могут быть отражением 3D объекта, видимым на основании и представленным 2D дисплеем 12B.

Операция определения поверхности модели изображения, отображаемой на экране 2D дисплея, показана на фиг.5B шагом 655.

Затем процессор 105 изображения может вывести в драйвер 111 2D дисплея данные для генерации изображения, выводимого на 2D дисплей 12B, и, таким образом, генерирует изображение поверхности (такой как тень или отражение) на основании света от объекта, который кажется плавающим перед 3D дисплеем. Операция отображения изображения из драйвера 111 2D дисплея показана на фиг.5B шагом 657.

Например, как показано с левой стороны фиг.5A, отображаемый на экране объект представляет собой прямоугольный параллелепипед 608, аналогичный показанному в примере, рассмотренном выше. Процессор 101 камеры, приняв данные кадра изображения из камеры 19, в некоторых вариантах выполнения настоящего изобретения может определить первый уровень 601 глаз и передать эту информацию в процессор изображения. Процессор изображения, приняв информацию о модели объекта и информацию об основании, может определить первую поверхность 603, которая будет видна из первого уровня 601 глаз, например тень и/или отражение. Процессор 105 изображения может определить эту поверхность с помощью процесса моделирования виртуального изображения. Эту информацию о поверхности можно затем передать в драйвер 111 2D дисплея для представления изображения в 2D дисплей 12B.

Кроме того, как показано в правой части фиг.5A, камера может захватывать последующие изображения, которые будут обработаны процессором 101 камеры. Таким образом, процессор камеры может предоставить в процессор 105 изображения обновленную информацию, например, об изменении уровня глаз на второй уровень 602 глаз. Это изменение уровня глаз на второй уровень глаз зависит от объекта, и информация о модели основания обрабатывается процессором изображения с генерацией обновленной поверхности 604, видимой со второго уровня 602 глаз. Таким образом, эту информацию о поверхности можно передать в драйвер 111 2D дисплея для представления изображения в 2D дисплее 12B. Виртуальное изображение 603, 604 затем может быть выведено в драйвер 111 дисплея и показано на 2D дисплее 12B.

Реализация камеры, отслеживающей уровень глаз и отображение изображений отражения и/или тени на 2D дисплее вместе с изображениями на 3D дисплее, в некоторых вариантах выполнения настоящего изобретения предоставляет больший интерактивный эффект, поскольку облегчается представление таких параметров, как глубина.

Таким образом, в вариантах выполнения настоящего изобретения предложен способ, который включает обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея, определение поверхности проекции по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя, на втором дисплее; и генерирование изображения проекции для отображения на втором дисплее в зависимости от поверхности проекции, видимой из точки наблюдения пользователя.

В таких вариантах выполнения настоящего изобретения способ может дополнительно включать определение поверхности проекции, видимой из точки наблюдения пользователя, в зависимости по меньшей мере от одного из следующего: положения угла освещения по меньшей мере одного трехмерного объекта, модели поверхности второго дисплея и по меньшей мере одной модели поверхности трехмерного объекта.

В таких вариантах выполнения настоящего изобретения поверхность проекции может включать по меньшей мере одно из следующего: частичную тень по меньшей мере одного трехмерного объекта, полную тень по меньшей мере одного трехмерного объекта и отражение по меньшей мере одного трехмерного объекта.

Варианты выполнения настоящего изобретения позволяют усовершенствовать стандартный 3D дисплей, обеспечивая дополнительную интерактивность изображения. На фиг.6A, 6B и 6C интерактивность пользователь-изображение описана на примерах некоторых вариантов выполнения настоящего изобретения, в которых пользовательский интерфейс 14, процессор 103 пользовательского интерфейса, процессор 107 модели изображения и процессор 105 изображения обеспечивают лучшее восприятие изображения 3D объекта.

Работа пользовательского интерфейса 14, в некоторых вариантах выполнения настоящего изобретения реализованного в виде сенсорного интерфейса на 2D дисплее 12B, иллюстрируется на фиг.6A. На фиг.6A показано устройство 10, аналогичное устройству, показанному на предыдущих чертежах, при этом устройство 10 содержит 3D дисплей 12A, 2D дисплей 12B и камеру 19. В этих вариантах выполнения настоящего изобретения 2D дисплей 12B также содержит емкостный пользовательский интерфейс 14. Емкостный пользовательский интерфейс 14 может обнаруживать присутствие объекта около дисплея или касание объектом дисплея. Таким образом, как показано на фиг.6A, пользовательский интерфейс может обнаружить присутствие пальца, а кроме того, генерировать информацию, которая может указывать, что кончик пальца находится в некотором положении относительно 2D дисплея 12B с относительным смещением 401 по оси Х и относительным смещением 403 по оси Y, при этом обе оси лежат в плоскости 2D дисплея 12B. Кроме того, в некоторых вариантах выполнения настоящего изобретения пользовательский интерфейс может обнаружить присутствие кончика пальца на некотором расстоянии от поверхности 2D дисплея 12B или, другими словами, определить, что кончик пальца имеет относительное смещение 405 вдоль оси Z над 2D дисплеем 12B. Затем пользовательский интерфейс 14 может вывести обнаруженные значения, такие как массив значений емкостей, в процессор 103 пользовательского интерфейса.

Захват данных, вводимых в пользовательский интерфейс, показан на фиг.6C шагом 451.

Процессор 103 пользовательского интерфейса в некоторых вариантах выполнения настоящего изобретения может принимать данные пользовательского интерфейса и определять положение обнаруженного объекта или кончика обнаруженного объекта (например, пальца пользователя). Понятно, что в некоторых вариантах выполнения настоящего изобретения палец может быть заменен любым подходящим манипулятором, например стилусом.

Хотя операции, рассмотренные выше и ниже, описаны в отношении данных или информации, принятой из пользовательского интерфейса 14 и процессора 103 пользовательского интерфейса, очевидно, что аналогичная информация может быть получена из камеры 19 и процессора 101 камеры, при этом в некоторых вариантах выполнения настоящего изобретения камера обнаруживает присутствие пользователя, пытающегося взаимодействовать с устройством с помощью интерфейса. Таким образом, например, в некоторых вариантах выполнения настоящего изобретения, в которых используется множество камер, разница в изображениях, полученных различными камерами, может использоваться для определения координат смещения обнаруженного объекта по осям X, Y Z относительно поверхности 2D дисплея.

Таким образом, процессор 103 пользовательского интерфейса может вывести данные о положении обнаруженного объекта в процессор 105 изображения.

Определение присутствия объекта показано на фиг.6C шагом 453.

В некоторых вариантах выполнения настоящего изобретения обнаружение присутствия объекта и определение положения объекта в трехмерном пространстве относительно устройства может использоваться для взаимодействия с моделированным изображением объекта. Например, обнаружение пальца, «касающегося» отображаемого объекта, может использоваться для модификации этого отображаемого объекта.

Процессор 105 изображения в некоторых вариантах выполнения настоящего изобретения может, как описано выше, принимать данные модели изображения из процессора 107 модели изображения. Как описано выше, процессор 107 модели изображения может содержать данные, такие как расположение, ориентация и форма отображаемого, на экране объекта. Генерация и предоставление информации о моделируемом объекте показаны на фиг.6C шагом 454.

Эта информация может быть передана в процессор 105 изображения, при этом в некоторых вариантах выполнения настоящего изобретения процессор 105 изображения может сопоставлять обнаруженное положение объекта со смоделированным объектом, отображаемым на экране. Например, процессор 105 изображения может обнаружить, что положение смоделированного объекта и обнаруженного объекта совпадают или, другими словами, обнаруженный объект «касается» объекта, отображаемого на экране. В некоторых вариантах выполнения настоящего изобретения тип касания может дополнительно определять, как следует модифицировать отображаемый на экране объект. Например, «касание» может соответствовать единичному нажатию, подобному единичному щелчку мыши или единичному касанию кнопки на сенсорной панели, и, таким образом, активировать функцию, связанную с поверхностью касания. В других вариантах выполнения настоящего изобретения «касание» может соответствовать перетаскиванию или импульсному воздействию и заставить объект вращаться или перемещаться согласно этому «касанию».

Определение части изображения, к которой произошло «касание», и действия, соответствующего этому «касанию», показано на фиг.6C шагом 455.

В некоторых вариантах выполнения настоящего изобретения процессор 105 изображения может обрабатывать взаимодействие между обнаруженным объектом и трехмерным объектом. Например, в некотором варианте выполнения настоящего изобретения процессор 105 изображения может выдать в драйвер 109 3D дисплея данные, указывающие место касания, путем передачи информации для отображения на экране объекта с другим цветом в точке касания. В другом варианте выполнения настоящего изобретения процессор изображения может выдать такие данные о взаимодействии при касании, чтобы обеспечить перемещение, смещение или вращение, создавая эффект, как будто пользователь переместил объект. В других вариантах выполнения настоящего изобретения процессор изображения может обработать взаимодействие так, чтобы обеспечить деформацию объекта в точке контакта. В таких вариантах выполнения настоящего изобретения процессор 105 изображения может, таким образом, применить подходящую физическую модель для взаимодействия обнаруженного объекта и отображаемого на экране объекта и вывести результат такого взаимодействия в драйвер 109 3D дисплея, обеспечивая, таким образом, рендеринг модифицированного отображаемого на экране объекта.

Очевидно, что в некоторых вариантах выполнения настоящего изобретения взаимодействие с автостереоскопическим 3D изображением, другими словами, между 3D объектом и обнаруженным объектом (таким как кончик пальца или виртуальный кончик пальца), может быть выполнено независимо от обнаружения головы или глаз и манипулирования 3D объектом на основе обнаруженного положения головы или глаз. Поэтому в таких вариантах выполнения настоящего изобретения, например вариантах выполнения настоящего изобретения, реализованных в устройствах без модулей камеры или достаточного объема обработки для обнаружения головы, способ все еще может быть реализован, обеспечивая пользователю лучшее ощущение от взаимодействия с изображением.

Отображение части, к которой осуществляется прикосновение, или отображение операции взаимодействия при касании показано на фиг.6C шагом 457.

Таким образом, в некоторых вариантах выполнения настоящего изобретения взаимодействие с изображением, зарегистрированным пользовательским интерфейсом 14 или камерой 19, обнаруживается процессором 103 пользовательского интерфейса или интерфейсом 101 камеры и используется процессором 105 изображения для улучшения степени интерактивности отображаемого на экране 3D объекта.

Например, на фиг.6B показано, что палец пользователя перемещается по 3D изображению и демонстрируется на 3D изображении 400.

На фиг.7 также показан вариант выполнения элементов пользовательского интерфейса в 2D дисплее некоторых дополнительных вариантов выполнения настоящего изобретения. В этих вариантах выполнения настоящего изобретения 2D дисплей 12B может создавать изображения, такие как кнопки пользовательского интерфейса, которые пользователь может «нажимать». В некоторых вариантах выполнения настоящего изобретения элементы 501 пользовательского интерфейса могут быть выполнены в виде дополнительных трехмерных объектов и отображаться в таком виде на экране с использованием трехмерного дисплея 12A. Такой вариант выполнения настоящего изобретения показан на фиг.7, где кнопки 2D пользовательского интерфейса 501 показаны отображенными на экране двумерного дисплея 12B, причем пользователь может их касаться, и показан дополнительный 3D объект 503 пользовательского интерфейса, посредством которого пользовательский интерфейс может обнаружить взаимодействие, выполнить надлежащие действия и отобразить на экране изменения.

Поэтому в некоторых вариантах выполнения настоящего изобретения предложен способ, включающий обнаружение положения объекта относительно или автостереоскопического дисплея и/или второго дисплея и определение взаимодействия с обнаруженным объектом.

В таких вариантах выполнения настоящего изобретения обнаружение положения объекта может, таким образом, включать по меньшей мере одно из следующего: обнаружение значения емкости в датчике емкости объекта и обнаружение видимого изображения объекта.

Кроме того, в некоторых вариантах выполнения настоящего изобретения определение взаимодействия с обнаруженным объектом включает определение пересечения между обнаруженным изображением и отображаемым на экране изображением.

В таких вариантах выполнения настоящего изобретения отображаемое на экране изображение содержит виртуальное изображение по меньшей мере одного трехмерного объекта или двумерное изображение, отображаемое на экране на втором дисплее.

Таким образом, варианты выполнения настоящего изобретения позволяют с помощью двух дисплеев создавать намного более реалистическую или правдоподобную трехмерную проекцию изображения. Кроме того, одновременное использование обнаруженного местоположения глаз и/или положения/ориентации головы и проецируемого объекта обеспечивает более эффективное взаимодействие с отображаемым на экране объектом или объектами. Кроме того, в дополнительных вариантах выполнения настоящего изобретения, как описано выше, реализация элементов пользовательского интерфейса на дисплее обеспечивает больше интерактивных трехмерных конфигураций отображения и улучшает восприятие пользователя.

Очевидно, что термин «пользовательское оборудование» охватывает любой подходящий тип беспроводного пользовательского оборудования, такого как мобильные телефоны, портативные устройства обработки данных или портативные средства веб-просмотра. Кроме того, пользовательское оборудование, средства универсальной последовательной шины (USB) и модемные карты данных могут включать устройство, аналогичное устройству, описанному выше в вариантах выполнения настоящего изобретения.

В общем случае различные варианты выполнения настоящего изобретения могут быть реализованы в аппаратных средствах или схемах особого назначения, программном обеспечении, логике или любой их комбинации. Например, некоторые аспекты могут быть реализованы в аппаратных средствах, в то время как другие аспекты могут быть реализованы во встроенном микропрограммном обеспечении или программном обеспечении, которое может выполняться контроллером, микропроцессором или другим вычислительным устройством, хотя изобретение этим не ограничено. Несмотря на то, что различные аспекты изобретения были иллюстрированы и описаны в виде блок-схем, последовательности операций или с использованием какого-либо другого графического представления, подразумевается, что эти блоки, устройства, системы, технические решения или способы, описанные здесь, могут быть реализованы, без ограничения указанным списком, например, в виде аппаратных средств, программного обеспечения, встроенного микропрограммного обеспечения, схем особого назначения или логики, аппаратных средств общего назначения или контроллера или других вычислительных устройств или некоторой их комбинации.

Таким образом, некоторые варианты выполнения настоящего изобретения могут быть реализованы в виде устройства, содержащего:

датчик для обнаружения положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея;

процессор для определения поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и

генератор изображения для генерирования изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от поверхности, видимой из точки наблюдения пользователя.

В некоторых вариантах выполнения настоящего изобретения датчик содержит камеру для захвата по меньшей мере одного изображения пользователя и устройство распознавания лица для определения местоположения и ориентации глаз пользователя относительно автостереоскопического дисплея.

В некоторых вариантах выполнения настоящего изобретения может использоваться по меньшей мере две камеры, каждая из которых захватывает по меньшей мере одно изображение пользователя, а устройство распознавания лица выполнено с возможностью выявления разницы по меньшей мере между одним изображением пользователя, полученным из каждой из этих по меньшей мере двух камер.

В некоторых вариантах выполнения настоящего изобретения процессор может определить модель по меньшей мере одного трехмерного объекта; определить ориентацию и расстояние по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя; и генерировать поверхность по меньшей мере одного трехмерного объекта в зависимости от модели по меньшей мере одного трехмерного объекта и ориентации и расстояния по меньшей мере от одной модели трехмерного объекта до точки наблюдения пользователя.

В некоторых вариантах выполнения настоящего изобретения процессор может также обнаруживать расстояние между зрачками пользователя и выдавать информацию для управления параллаксным барьером в зависимости по меньшей мере от одного из следующих параметров: положения точки наблюдения пользователя; ориентации точки наблюдения пользователя и расстояния между зрачками пользователя.

В некоторых вариантах выполнения настоящего изобретения процессор может также определять поверхность проекции по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя, на втором дисплее; а генератор изображения может генерировать изображение проекции для отображения на втором дисплее в зависимости от поверхности проекции, видимой из точки наблюдения пользователя.

В некоторых вариантах выполнения настоящего изобретения процессор может определять поверхность проекции, видимую из точки наблюдения пользователя, в зависимости по меньшей мере от одного из следующих параметров: по меньшей мере одного угла освещения и положения трехмерного объекта, модели поверхности второго дисплея и по меньшей мере одной модели поверхности трехмерного объекта.

Поверхность проекции может содержать по меньшей мере одно из следующего: частичную тень по меньшей мере от одного трехмерного объекта; полную тень по меньшей мере от одного трехмерного объекта; и отражение по меньшей мере от одного трехмерного объекта.

Датчик может также обнаруживать положение объекта относительно автостереоскопического дисплея и/или второго дисплея; и определять взаимодействие с обнаруженным объектом.

В некоторых вариантах выполнения настоящего изобретения датчик может обнаруживать положение объекта путем обнаружения по меньшей мере одного из следующего: значения емкости в датчике емкости объекта; и видимого изображения объекта.

Процессор может также определять пересечение между обнаруженным изображением и отображаемым на экране изображением.

Отображаемое изображение может содержать виртуальное изображение по меньшей мере одного трехмерного объекта.

Отображаемое изображение может включать двумерное изображение, отображаемое на втором дисплее.

Варианты выполнения настоящего изобретения могут быть реализованы компьютерной программой, исполняемой процессором мобильного устройства, например, процессорным объектом, аппаратными средствами или комбинацией программного и аппаратного обеспечения. Кроме того, в этом отношении следует отметить, что любые блоки логического потока на чертежах могут представлять собой шаги программы, связанные логические цепи, блоки и функции или комбинацию команд и логических схем, блоков и функций. Программное обеспечение может храниться на таком физическом носителе, как микросхемы памяти или блоки памяти, реализованные в процессоре, магнитные носители, такие как жесткий диск или гибкие диски, и оптические носители, такие как, например, диски DVD и их разновидности, диски CD и их разновидности.

Таким образом некоторые варианты выполнения настоящего изобретения могут быть реализованы с использованием машиночитаемого носителя, содержащего инструкции, которые при выполнении их компьютером осуществляют:

обнаружение положения и ориентации точки наблюдения пользователя относительно автостереоскопического дисплея;

определение поверхности по меньшей мере одного трехмерного объекта, видимой из точки наблюдения пользователя; и

генерирование изображений для левого и правого глаз для отображения на автостереоскопическом дисплее в зависимости от этой поверхности, видимой из точки наблюдения пользователя.

Память может быть любого типа, подходящего для локального технического окружения, и может быть реализована с использованием любой подходящей технологии хранения данных, например на основе полупроводниковых запоминающих устройств, устройств и систем с магнитной памятью, устройств и систем с оптической памятью, стационарной памятью и съемной памятью. Процессоры могут быть любого типа, подходящего для локального технического окружения, и, в качестве неограничивающих примеров, могут содержать один или большее количество компьютеров общего назначения, специализированных компьютеров, микропроцессоров, цифровые сигнальных процессоров (DSP), специализированных интегральных схем (ASIC), логических элементов и процессоров на основе архитектуры многоядерного процессора.

Варианты выполнения настоящего изобретения могут быть осуществлены в различных компонентах, таких как интегральные модули. Проектирование интегральных схем в общем случае представляет собой высокоавтоматизированный процесс. В настоящее время имеются сложные и мощные программные инструменты для преобразования логической схемы в полупроводниковую схему, которую путем травления можно выполнить на полупроводниковой подложке.

Такие программы, как предлагаемые компаниями Synopsys, Inc. из Маунтин-Вью, Калифорния и Cadence Design из Сан-Хосе, Калифорния, автоматически прокладывают соединения и определяют местоположение компонентов на полупроводниковом кристалле с использованием хорошо известных принципов проектирования, а также библиотек ранее сохраненных проектных модулей. Как только проектирование полупроводниковой схемы завершено, результирующий проект в стандартном электронном формате (например, Opus, GDSII и т.п.) может быть передан на полупроводниковый завод для организации производства.

В предыдущем описании в виде неограничивающих примеров раскрыты варианты выполнения настоящего изобретения. Однако из предыдущего описания, формулы изобретения и чертежей специалистам будут очевидны различные модификации и адаптации. Однако все такие и аналогичные модификации настоящего изобретения находятся в объеме изобретения, определяемом пунктами формулы изобретения.

В контексте настоящего документа термин «электрическая схема» может относиться к любому из следующего: (а) реализация схемы только на основе аппаратных средств (например, реализация в виде только аналоговой и/или цифровой электрической схемы) и (б) комбинация схем и программного обеспечения (и/или встроенного микропрограммного обеспечения) самих по себе и применяемых: (i) в комбинации с процессором (процессорами) или (ii) частями процессора (процессоров)/программного обеспечения (включая цифровой сигнальный процессор (процессоры), программного обеспечения и памяти, которые взаимодействуют, заставляя устройство, такое как мобильный телефон или сервер, выполнять различные функции) и (в) схема, такая как микропроцессор (микропроцессоры) или часть микропроцессора (микропроцессоров), для работы которого необходимо программное обеспечение или встроенное микропрограммное обеспечение, даже если это программное обеспечение или встроенное микропрограммное обеспечение физически не присутствует.

Такое определение электрической схемы применимо ко всему использованию этого термина в настоящем документе, включая любой пункт формулы изобретения. В качестве еще одного примера используемого в настоящем документе, термин «электрическая схема» охватывает также использование только процессора (или множества процессоров) или части процессора и его (или их) соответствующего программного обеспечения и/или встроенного микропрограммного обеспечения. Термин «электрическая схема» применим также, например, к определенному элементу в пункте формулы изобретения, интегральной схеме основной полосы частот или прикладной интегральной схеме для мобильного телефона или аналогичной интегральной схеме в сервере, устройстве сотовой связи или другом сетевом устройстве.