ОБЛАСТЬ ТЕХНИКИ, К КОТОРОЙ ОТНОСИТСЯ ИЗОБРЕТЕНИЕ

[0001] Настоящее изобретение относится к способу управления в системе захвата изображения, содержащей первое устройство захвата изображения и второе устройство захвата изображения, а также к устройству управления, соединенному с первым устройством захвата изображения и вторым устройством захвата изображения.

ОПИСАНИЕ ПРЕДШЕСТВУЮЩЕГО УРОВНЯ ТЕХНИКИ

[0002] За последнее время возросла численность систем наблюдения, имеющих форму, в которой совместно используется множество камер. Учитывая цифровое кодирование и усовершенствование функциональных возможностей устройства, а также благодаря совместному использованию камер, имеющих различные характеристики, например, камер, имеющих функцию широкоугольного увеличения масштаба изображения, а также камер, способных осуществлять захват во всех направлениях, предоставляется возможность формирования системы, использующей преимущества сильных сторон каждой из камер.

[0003] Ранее были предложены подходы к захвату одного целевого объекта с использованием множества камер. В выложенной патентной публикации Японии № 2002-290962 предлагается способ, согласно которому, посредством передачи информации о шаблоне, используемой для распознавания целевого объекта в первой камере, на вторую камеру, координируются операции отслеживания.

[0004] Кроме того, в публикации «Tracking Camera Systems Using Master-Slaving for Real Space» (Ogawa Yuzo, Fujiyoshi Hironobu, 9th Image Sensing Symposium, 2003) предложен способ расчета координат ног в трехмерном пространстве после обнаружения ног человека, являющегося целевым объектом для визуального представления, на основе изображения, захваченного посредством монокулярной камеры, и выполнения захвата изображения с обновленными величинами панорамирования/наклона/увеличения масштаба на второй камере, позиционная информация для которой калибруется заблаговременно.

[0005] Общеизвестные методы, например, обработки изображений, обнаружения символов, распознавания и т.п., необходимые для реализации такого рода системы, описаны в публикации «Computer Vision: Algorithms and Applications» (Richard Szeliski, Springer, New York, 2010).

[0006] За последнее время были проведены усовершенствования функциональных возможностей камер, и благодаря объединению элементов захвата изображения, способных записывать множество пикселей с использованием широкоугольных объективов, область, которая может быть захвачена посредством одной камеры, стала более широкой. Для согласования камер необходимо осуществлять поиск аналогичного целевого объекта для визуального представления в пространстве, более широком по сравнению с предварительно предполагаемым, и это приводит к возникновению больших проблем, заключающихся в наличии времени поиска перед началом захвата изображения, а также в рассогласовании угла обзора. В ранее предложенных способах, ввиду того, что расширение области визуального представления камеры приводит к расширению области, в которой должен осуществляться поиск, требуется длительное время до момента нахождения аналогичного целевого объекта для захвата изображения.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

[0007] В настоящем изобретении идентичные целевые объекты для визуального представления эффективно захватываются посредством множества устройств захвата изображения.

[0008] Кроме того, особенность настоящего изобретения заключается в создании способа управления в системе захвата изображения, содержащей первое устройство захвата изображения и второе устройство захвата изображения, причем способ содержит этапы, на которых: определяют, удовлетворяет ли результат анализа процесса анализа изображения, захваченного посредством первого устройства захвата изображения, предварительно определенному условию; и в случае, когда результат анализа не удовлетворяет предварительно определенному условию, управляют областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала шире, чем в случае, когда результат анализа удовлетворяет предварительно определенному условию.

[0009] Также особенность настоящего изобретения заключается в создании способа управления в системе захвата изображения, содержащей первое устройство захвата изображения и второе устройство захвата изображения, причем способ содержит этапы, на которых: задают область визуального представления второго устройства захвата изображения в соответствии со скоростью перемещения целевого объекта, анализируемого в процессе анализа изображения, захваченного посредством первого устройства захвата изображения, и управляют вторым устройством захвата изображения таким образом, чтобы осуществить захват заданной области визуального представления.

[0010] Дополнительные признаки настоящего изобретения станут очевидными после изучения следующего описания иллюстративных вариантов осуществления, представленного со ссылкой на сопроводительные чертежи.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

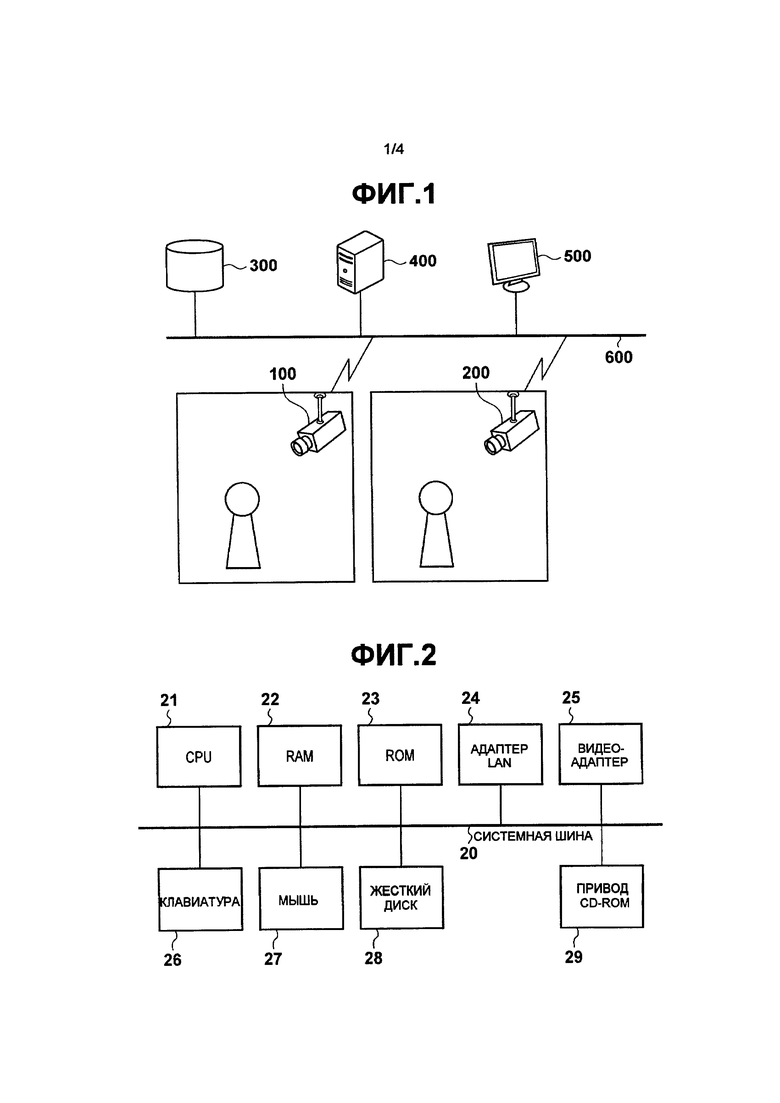

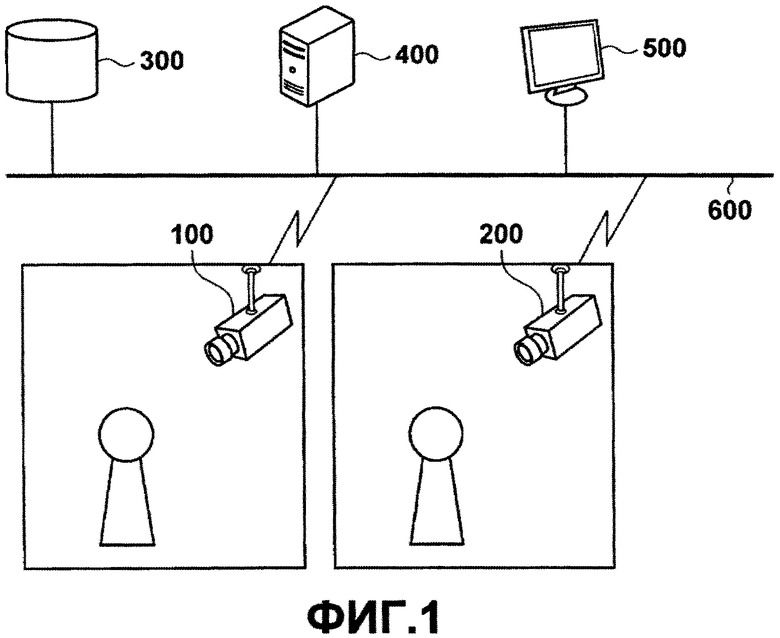

[0011] Фиг. 1 - графическое представление конфигурации системы управления камерами согласно первому варианту осуществления.

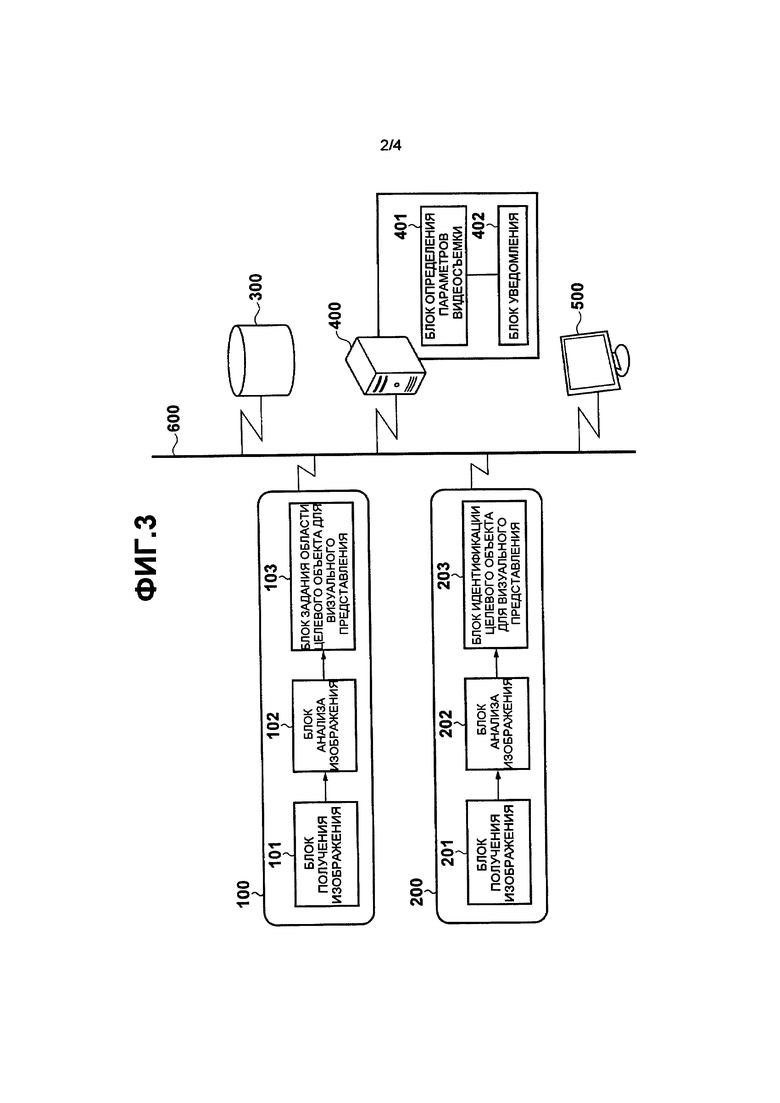

[0012] Фиг. 2 - графическое представление для демонстрации конфигурации аппаратных средств устройства, которое реализует систему управления камерами согласно первому варианту осуществления.

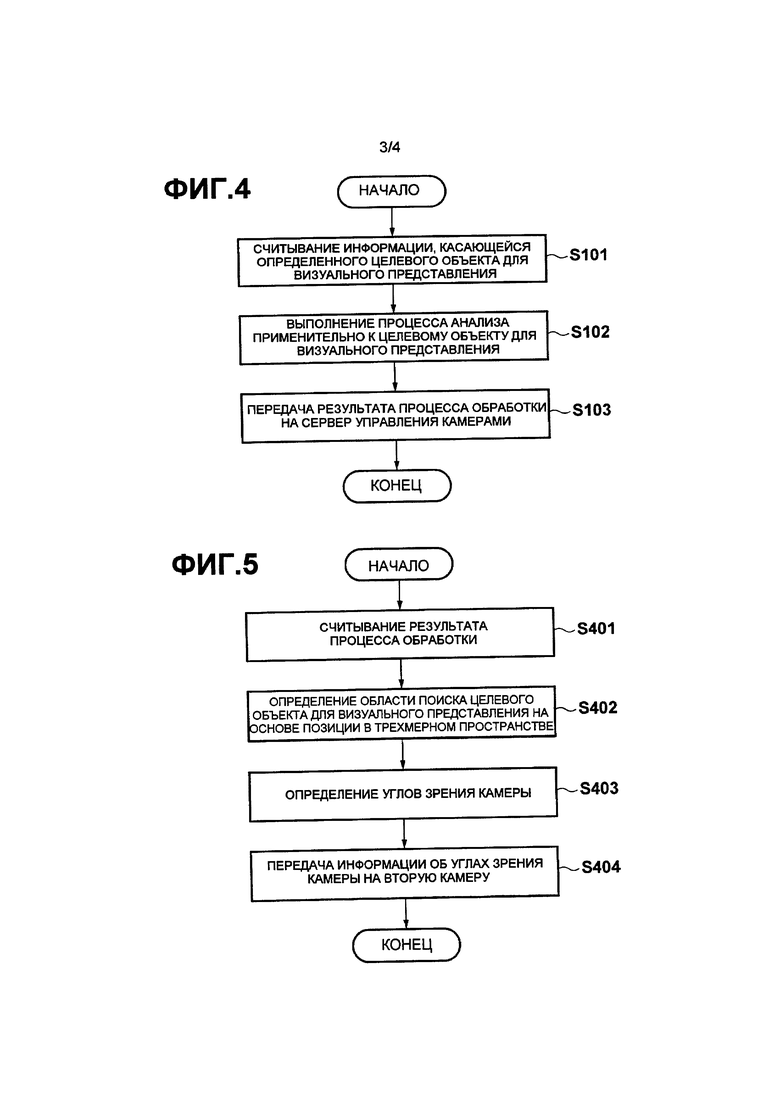

[0013] Фиг. 3 - блок-схема для демонстрации основной функциональной конфигурации в устройстве, которое реализует систему управления камерами согласно первому варианту осуществления.

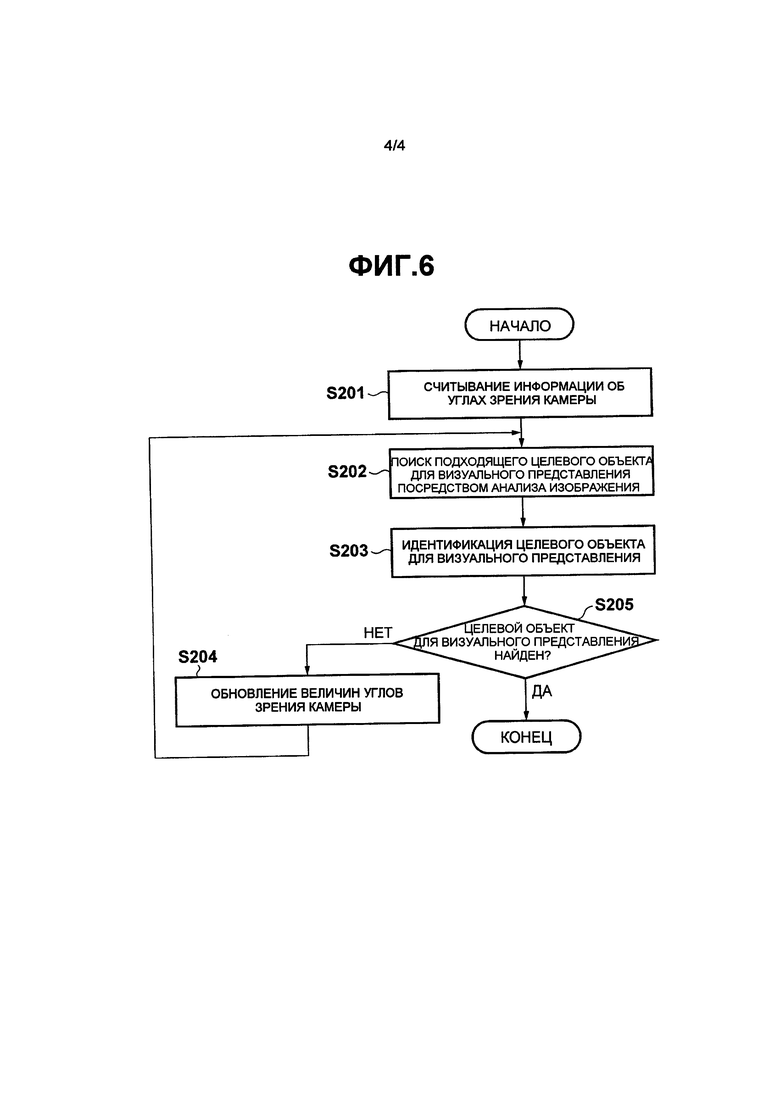

[0014] Фиг. 4 – логическая блок-схема для демонстрации процесса обработки, выполняемого посредством камеры 100.

[0015] Фиг. 5 - логическая блок-схема для демонстрации процесса обработки, выполняемого посредством серверного устройства управления камерами.

[0016] Фиг. 6 – логическая блок-схема для демонстрации процесса обработки, выполняемого посредством камеры 200.

ОПИСАНИЕ ВАРИАНТОВ ОСУЩЕСТВЛЕНИЯ

[0017] Далее, с использованием сопроводительных чертежей, в настоящем документе будут подробно описаны варианты осуществления настоящего изобретения.

[0018] Фиг. 1 дает графическое представление конфигурации сетевых соединений, иллюстрирующее операционную среду системы управления камерами согласно первому варианту осуществления. В системе управления камерами (системе управления захватом изображения), при захвате одного целевого объекта для визуального представления посредством множества камер, реализовывается высокоскоростная идентификация целевого объекта для визуального представления.

[0019] Система управления камерами формируется на основе камеры 100, камеры 200, сетевого устройства 300 хранения данных, серверного устройства 400 управления камерами (далее в настоящем документе именуемого сервером 400) и устройства 500 визуального представления изображения, соединенных друг с другом посредством сети 600 LAN, которая является сетевой линией связи. Камеры 100 и 200, которые являются устройствами захвата изображения, имеют функциональные возможности обработки изображения, предназначенные для выполнения анализа изображения, такого как обнаружение перемещения объекта, обнаружение объекта, обнаружение человеческого тела, распознавание черт лица и т.п., на основе захваченных данных изображения, в дополнение к функциональным возможностям визуального представления, предназначенным для захвата целевого объекта для визуального представления. Сетевое устройство 300 хранения данных, которое является записывающим устройством, записывает захваченные данные изображения, полученные с камеры 100 и камеры 200, а также результаты анализа изображения, проводимого применительно к захваченным данным изображения, через сеть 600 LAN.

[0020] Сервер 400, который является устройством управления захватом изображения, накапливает захваченные данные изображения, полученные с множества камер, установленных во всей области мониторинга (в данном случае используются камеры 100 и 200), результаты анализа изображения, проводимого применительно к этим захваченным данным изображения, прошлые данные изображения, записанные в сетевом устройстве 300 хранения данных, и результаты анализа изображения. Сервер 400 выполняет управление графической информацией во всей области мониторинга посредством использования накопленных данных изображения и результатов анализа изображения. Кроме того, сервер 400 является устройством управления, предназначенным для управления областью визуального представления камеры 200.

[0021] Устройство 500 визуального представления изображения выполняет наложение и отображение данных изображения, записанных в сетевом устройстве 300 хранения данных, и результатов анализа изображения. Кроме того, устройство 500 визуального представления изображения выполняет отображение графической информации, управление которой осуществляется на сервере 400 во всей области мониторинга, в которой работают камеры 100 и 200. Кроме того, устройство 500 визуального представления изображения дополнительно имеет функцию ввода, предназначенную для выполнения операции по поиску изображения, например, для сцены события с результатом анализа изображения на основе графической информации. Устройство 500 визуального представления изображения реализовывается в качестве устройства обработки информации, такого как, например, персональный компьютер (PC). Камера 100 и камера 200 могут быть сконфигурированы в качестве двух или более (множества) камер, и, в случае наличия двух или более камер, не существует никакого предела, касающегося количества камер. Другими словами, может присутствовать множество камер, выполненных с возможностью идентификации целевого объекта для визуального представления в случае, когда множество камер захватывают один целевой объект.

[0022] Далее, со ссылкой на Фиг. 2, будет представлено разъяснение конфигурации аппаратных средств устройства обработки информации, предназначенной для реализации сервера 400 и устройства 500 визуального представления изображения.

[0023] Фиг. 2 дает графическое представление, предназначенное для демонстрации конфигурации аппаратных средств устройства обработки информации согласно первому варианту осуществления настоящего изобретения.

[0024] Как изображено на Фиг. 2, процессор 21 CPU, память 22 RAM, память 23 ROM, адаптер 24 LAN, видеоадаптер 25, клавиатура 26, мышь 27, жесткий диск 28 и привод 29 CD-ROM соединяются друг с другом посредством системной шины 20. Системная шина 20 может иметь различные типы шин, такие как, например, шина PCI, шина AGP, шины памяти и т.п. Кроме того, на Фиг. 2 не изображаются микросхемы соединения, клавишный интерфейс и интерфейсы ввода/вывода, такие как так называемые интерфейсы SCSI или ATAPI между шинами.

[0025] Процессор 21 CPU выполняет различные операции, такие как основные арифметические операции и сравнительные операции, а также управляет аппаратными средствами на основе программы операционной системы, прикладных программ и т.п. В памяти 22 RAM хранится программа операционной системы, прикладные программы и т.п., считываемые с носителя данных, такого как жесткий диск 28 или компакт-диск CD-ROM, вставляемый в привод 29 CD-ROM, и эти программы выполняются под управлением процессора 21 CPU. В памяти 23 ROM хранятся программы, такие как так называемая система BIOS, которая взаимодействует с операционной системой и осуществляет управление вводом и выходом на жесткий диск 28.

[0026] Адаптер 24 LAN осуществляет связь с внешним блоком через сеть, взаимодействующую с коммуникационной программой операционной системы, управление которой осуществляется посредством процессора 21 CPU. Видеоадаптер 25 генерирует сигнал изображения, который выводится на устройство отображения, соединенное через видеоадаптер 25. Клавиатура 26 и мышь 27 используются для ввода команд на устройство обработки информации.

[0027] Жесткий диск 28 хранит операционную систему, прикладные программы и т.п. Привод 29 CD-ROM используется для установки прикладных программ на жесткий диск 28 посредством вставки носителя данных, такого как диск CD-ROM, диск CD-R, диск CD-R/W и т.п. Следует отметить совершенно очевидный факт возможности использования вместо привода 29 CD-ROM другого приводного устройства, такого как привод CD-R, привод CD-R/W или привод МО.

[0028] Фиг. 3 изображает блок-схему, предназначенную для демонстрации основной функциональной конфигурации в устройстве, которое реализовывает систему управления камерами согласно первому варианту осуществления.

[0029] Как изображено на Фиг. 3, блоки 101 и 201 получения изображения, соответственно расположенные в камерах 100 и 200, выполняют предопределенную интерполяцию пикселей, процесс преобразования цветов и т.п. применительно к цифровым электрическим сигналам, полученным из элемента захвата изображения, такого как элемент захвата изображения CMOS, а также создают/генерируют данные изображения, такие как данные изображения RGB или YUV (цифровые данные изображения). Кроме того, блоки 101 и 201 получения изображения выполняют процесс коррекции изображения, такой как коррекция баланса белого, резкости, контраста, преобразование цветов и т.п., применительно к данным изображения после выполнения создания.

[0030] Блоки 102 и 202 анализа изображения выполняют процесс анализа изображения, такой как обнаружение перемещения объекта, обнаружение объекта, обнаружение человеческого тела, распознавание черт лица и т.п., применительно к цифровому изображению, полученному от блоков 101 и 201 получения изображения. В дополнение к процессу анализа изображения, область целевого объекта для визуального представления задается посредством задающего блока 103 в камере 100 (первой камере), при этом идентификация целевого объекта для визуального представления выполняется посредством блока 203 идентификации в камере 200 (второй камере). Обе камеры 100 и 200 также могут быть снабжены задающим блоком 103 или блоком 203 идентификации. Задающий блок 103 камеры 100 используется для управления областью целевого объекта для визуального представления, полученного посредством блока 201 получения изображения камеры 200. Блок 203 идентификации камеры 200 определяет, является ли целевой объект для визуального представления, включенный в изображение, полученное посредством блока 101 получения изображения камеры 100, эквивалентным по отношению к целевому объекту для визуального представления, включенному в изображение, полученное посредством блока 201 получения изображения камеры 200.

[0031] Данные изображения, применительно к которым были выполнены различные процессы обработки изображения, сжимаются/кодируются. В данном случае форматы сжатия для дистрибутива основываются на стандартах, таких как MPEG4, H.264, MJPEG или JPEG. Кроме того, изображения преобразовываются в файлы данных изображения, имеющие форматы, такие как mp4, mov и т.п. Графическая информация, полученная из результатов анализа изображения и сжатых файлов данных изображения, передается на сетевое устройство 300 хранения данных или сервер 400 через сеть 600 LAN. На этих устройствах запись данных изображения и результатов анализа изображения выполняется в сетевой файловой системе, такой как, например, NFS, CIFS и т.п.

[0032] Блок 401 определения параметров видеосъемки сервера 400 определяет режимы работы камер (панорамирование/наклон/увеличение масштаба изображения и т.п.) в системе управления камерами на основе принятых данных изображения и результатов анализа изображения. В частности, блок 401 определения параметров видеосъемки определяет, по меньшей мере, одну начальную величину панорамирования, наклона или увеличения масштаба изображения для камеры или определяет способ обновления панорамирования, наклона и увеличения масштаба изображения. Конфигурация может быть построена таким образом, чтобы процессор 21 CPU, изображенный на Фиг. 2, реализовывал блок 401 определения параметров видеосъемки посредством выполнения программы, считываемой из памяти 22 RAM. Блок 402 уведомления уведомляет камеру 200 о режиме работы камеры для управления камерой 200, чтобы осуществлять захват в режиме работы камеры, который определяет блок 401 определения параметров видеосъемки.

[0033] Далее будет представлено подробное разъяснение процесса обработки для выполнения высокоскоростной идентификации целевого объекта для визуального представления в случае захвата одного целевого объекта с множества камер в вышеописанной конфигурации. Следует отметить, что перед выполнением нижеизложенного процесса позиционная информация каждой камеры заблаговременно оценивается и записывается. Позиционная информация может представлять относительную позицию на основе каждой из камер, и в случае, когда предварительно определенная установочная позиция камеры определяется в качестве исходной, позиционная информация может не представлять фактическую позицию. Позиционная информация используется в качестве основной информации при вычислении величин панорамирования/наклона/увеличения масштаба изображения на второй камере. Управление позиционной информацией осуществляется на сервере 400 или сетевом устройстве 300 хранения данных. Другими словами, позиционная информация камер 100 и 200 хранится на сервере 400 или в памяти 22 RAM сетевого устройства 300 хранения данных.

[0034] Сначала пользователь выбирает конкретный целевой объект на захваченном изображении камеры 100 (первой камеры), отображаемом на устройстве 500 визуального представления изображения. В данном случае целевой объект (предмет), который определяет пользователь, может являться любым человеком, перемещающимся объектом или объектом. Следует отметить, что в дополнение к тому, что устройство 500 визуального представления изображения соединяется с камерой 100 и отображает захваченные изображения, принятые от камеры 100, возможен режим, в котором с устройства 500 визуального представления изображения можно задавать информацию для камеры 100.

[0035] Устройство 500 визуального представления изображения передает информацию целевого объекта, связанную с определенным целевым объектом, на камеру 100 через сервер 400. Переданная информация целевого объекта является координатной информацией, когда верхняя левая позиция на захваченном изображении камеры 100 определяется в качестве исходной.

[0036] Далее, со ссылкой на Фиг. 4, будет представлено разъяснение процесса обработки, который выполняет камера 100, являющаяся первой камерой.

[0037] Изначально на этапе S101 камера 100 считывает информацию, касающуюся целевого объекта для визуального представления, определенного на захваченном изображении на устройстве 500 визуального представления изображения. Для целевого объекта для визуального представления на захваченном изображении, которое отображается на экранном изображении, определяется координата области, включающей в себя целевой объект для визуального представления. Например, посредством использования указующего устройства, такого как мышь, определяется область, включающая в себя целевой объект для визуального представления в пределах захваченного изображения, отображаемого на экранном изображении.

[0038] Затем на этапе S102 камера 100 выполняет анализ изображения, посредством использования блока 102 анализа изображения, области, включающей в себя периферию определенного целевого объекта для визуального представления. При изучении итоговых данных машины информация, используемая для анализа изображения блока 102 анализа изображения, заблаговременно подготавливается на сервере 400 и считывается до начала процесса обработки, при этом применяется задание. Другими словами, блок 102 анализа изображения камеры 100 заблаговременно получает данные, необходимые для анализа изображения, от сервера 400. Следует отметить, что анализ изображения может быть выполнен на сервере 400.

[0039] Кроме того, человеческое тело, обнаруженное на изображении, полученном посредством блока 101 получения изображения (или объект определенного типа, такой как автомобиль), может быть отображено на устройстве 500 визуального представления изображения, при этом целевой объект для визуального представления может быть определен на отображенном человеческом теле и т.п. с использованием указующего устройства. Человеческое тело, включенное в изображение, полученное посредством блока 101 получения изображения, обнаруживается посредством блока 102 анализа изображения, выполняющего процесс анализа изображения.

[0040] В ходе анализа изображения, выполняемого посредством блока 102 анализа изображения, выполняется как процесс анализа применительно к человеческому телу, так и процесс анализа применительно к объекту. Блок 102 анализа изображения выполняет применительно к человеческому телу один или более процессов обнаружения человеческого тела, обнаружения лица, распознавания черт лица, обнаружения ориентации лица, обнаружения лица как части тела или частичное распознавание человеческого тела, такое как возраст, пол, выражение лица, плечо, ноги или рост (распознавание характеристик человеческого тела). Кроме того, блок 102 анализа изображения выполняет анализ размера или формы объекта или выполняет обнаружение типа объекта, например, стул, автомобиль и т.п. Блок 102 анализа изображения выполняет процесс общего анализа человеческого тела/объекта в качестве процесса обработки, характерного как для человеческих тел, так и для объектов. В этот процесс общего анализа включается, по меньшей мере, либо оценка (расчет) расстояния до целевого объекта, либо оценка (расчет) позиции в трехмерном пространстве, либо анализ направления перемещения и скорости перемещения целевого объекта. Вышеописанный процесс анализа изображения, выполняемый посредством блока 102 анализа изображения, может быть выполнен целиком, или же может быть выполнена только его часть в соответствии с функциональными возможностями камеры, настройками системы и т.п.

[0041] Далее будет представлено разъяснение процесса обработки информационного содержания и результатов анализа изображения, полученных для каждого типа анализа изображения.

[0042] Для обнаружения человеческого тела, в частности, в процессе обнаружения лица обнаруживается позиция лица. По отношению к позиции лица используется последующая обработка, такая как распознавание черт лица, обнаружение ориентации лица, обнаружение лица как части тела и т.п. Этот процесс обработки получает сходимость по вероятности результата процесса обработки (правдоподобность, оценку), в соответствии с позицией и классификационной информацией распознанного целевого объекта, для вычисления результата посредством устройства со средствами самообучения. Высота/ширина ног/плеча человеческого тела используется для повышения точности расчета позиции в трехмерном пространстве, которая будет разъясняться ниже.

[0043] Для обнаружения объекта, в частности, различия с фоном, как размер, так и форма объекта оцениваются с использованием устройства со средствами самообучения. Кроме того, благодаря разбору категории того, какой объект использует устройство со средствами самообучения, приблизительный размер для каждой категории получают в качестве ссылочной информации. Кроме того, получают сходимость по вероятности категории, которой принадлежит объект (правдоподобность, оценку). Например, в случае с автомобилем, приблизительный размер может быть задан равным 5 метрам в длину и 2 метрам в высоту, и подобным образом для ширины/высоты плеча используется повышение точности оценки позиции в трехмерном пространстве, которая будет разъясняться ниже.

[0044] В заключение, направление перемещения и скорость перемещения целевого объекта получают с использованием обнаружения движущегося человека, выполняемого посредством использования множества кадров изображений. Кроме того, направление перемещения целевого объекта может быть получено посредством проверки того, увеличивается/уменьшается ли размер целевого объекта для визуального представления в направлении перемещения, перпендикулярном по отношению к камере.

[0045] На этапе S103 камера 100 задает область целевого объекта для визуального представления при помощи задающего блока 103. Задающий блок 103 делит захваченное изображение на частичные области в форме плитки, подготавливает позиционную взаимосвязь фактических областей в трехмерном пространстве, соответствующих каждой из частичных областей (области в трехмерном пространстве, определяющие пространство захвата изображения), в качестве таблицы соответствия и получает область целевого объекта для визуального представления на основе взаимосвязи соответствия. Область целевого объекта для визуального представления используется для управления областью целевого объекта для визуального представления изображения, которое получает блок 201 получения изображения камеры 200. Кроме того, задающий блок 103 способен задать область целевого объекта для визуального представления посредством оценки позиции целевого объекта для визуального представления в трехмерном пространстве без использования таблицы соответствия. Следует отметить, что оценка позиции в трехмерном пространстве является оценкой позиции человеческого тела, для которого был осуществлен захват ног, в трехмерном пространстве. Кроме того, позиция объекта в трехмерном пространстве поддается вычислению. В случае, когда ноги человеческого тела не были захвачены, можно вычислить приблизительную позицию ноги человека посредством оценки позиции ноги человека путем заблаговременного определения величины роста целевого объекта для визуального представления.

[0046] В процессе оценки позиции в трехмерном пространстве одна координата вычисляется под условием, что только одно решение вычисляется по вектору луча света, который проходит в пространстве в направлении целевого объекта для визуального представления от центральной точки камеры (центральной позиции). Поскольку несовпадения с фактической позицией нельзя избежать в процессе вычисления точки, в которой высота равна нулю от поверхности земли, являющейся условием, ширина или высота плеч могут быть оценены в отношении человеческого тела, при этом, посредством сравнения со средней величиной, может быть вычислено приблизительное расстояние до человека, а также оно может быть использовано в качестве условия в процессе оценки позиции в трехмерном пространстве. То же самое относится к размеру или форме объекта, при этом средний размер для каждой категории объекта, такой как автомобили или стулья, может быть подготовлен заблаговременно, и посредством сравнения со средним размером приблизительное расстояние может быть оценено и использовано в качестве информации о вычислении координат.

[0047] Результаты, полученные на этапах S102 и S103, накапливаются и передаются на сервер 400 в качестве результатов процесса обработки, после чего процесс обработки на камере 100 завершается. Результаты процесса обработки, переданные на сервер 400, включают в себя координаты области целевого объекта для визуального представления, величины характеристик, полученные посредством распознавания черт лиц, правдоподобие обнаружения человеческого тела или обнаружения объекта, правдоподобие заданной области целевого объекта для визуального представления и т.п.

[0048] Фиг. 5 – логическая блок-схема для демонстрации процесса обработки, выполняемого посредством серверного устройства 400 управления камерами.

[0049] Изначально, на этапе S401 блок 401 определения параметров видеосъемки сервера 400 считывает позицию целевого объекта для визуального представления в трехмерном пространстве, оцененную посредством камеры 100, а также результат процесса обработки, включающего в себя процесс анализа. Следует отметить, что этот процесс обработки может быть выполнен на сервере 400 вместо камеры 100.

[0050] Затем на этапе S402 блок 401 определения параметров видеосъемки сервера 400 задает начальную область поиска в пределах предварительно определенного расстояния (в пределах предварительно определенной области), которое содержит позицию целевого объекта для визуального представления в трехмерном пространстве, оцененную посредством камеры 100, в качестве центральной позиции, и определяет область поиска на основе результатов анализа изображения. Область целевого объекта для визуального представления, которую задает задающий блок 103 камеры 100, является областью, в которой целевой объект для визуального представления оценивается в качестве присутствующего, при этом область поиска, которую сервер 400 определяет на этапе S402, включает в себя область целевого объекта для визуального представления и является областью, которую захватывает камера 200. Расширение области поиска выполняется посредством многократного умножения предварительно определенного коэффициента расширения, посредством чего условие расширения (правило определения) удовлетворяется на основе правила определения результата анализа изображения, которое будет разъясняться ниже. Другими словами, нижеперечисленные условия расширения (правила определения) задаются заблаговременно. Кроме того, коэффициент расширения задается таким образом, чтобы предварительно определенный коэффициент расширения был умножен большее количество раз для удовлетворения условию, при этом коэффициент расширения увеличивается. Правила определения каждого результата анализа изображения разъясняются ниже.

[0051] Изначально, в случае, когда правдоподобие, полученное из результата анализа, меньше предварительно определенного порога, вследствие высокой вероятности того, что захват изображения может быть выполнен неудачно, или целевой объект для визуального представления находится в удаленном местоположении, область поиска расширяется (увеличивается) (это является общим условием для всего анализа изображения).

[0052] Кроме того, в случае невозможности обнаружения ног целевого объекта для визуального представления область поиска расширяется. Кроме того, в случае невозможности обнаружения характеристической информации, такой как плечо/рост и т.п., и характеристическая информация не используется для оценки позиции в трехмерном пространстве, область поиска расширяется. Позиция в трехмерном пространстве используется для определения области визуального представления или области поиска, при этом область поиска используется для определения углов зрения камеры (условий захвата изображения).

[0053] Кроме того, в случае, когда скорость перемещения целевого объекта для визуального представления превышает или равна предварительно определенной скорости, область перемещения вычисляется с учетом скорости перемещения, направления перемещения и периода времени, необходимого до выполнения идентификации посредством камеры 200, при этом область поиска задается в соответствии с областью дальности перемещения. Помимо всего прочего, даже в случае, когда скорость перемещения является невысокой и целевой объект для визуального представления приближается к камере 200, область визуального представления расширяется вследствие вероятности того, что целевой объект для визуального представления выйдет из кадра, когда будет задано увеличение масштаба изображения в телефотографическом направлении.

[0054] После определения области поиска, выполняемого на этапе S402, блок 401 определения параметров видеосъемки сервера 400, на основе информации устройства захвата изображения, такой как установочная позиция камеры 200, соответствующий коэффициент масштабирования и т.п., на этапе S403 определяет углы зрения камеры (условия захвата изображения, такие как коэффициент масштабирования, панорамирование/наклон) на блоке 401 определения параметров видеосъемки. В данном случае коэффициент масштабирования и т.п. задается таким образом, чтобы область поиска была включена. В данном случае, на этапе S402 после определения области поиска на основе начальной области поиска, основанной на результате анализа изображения, углы зрения камеры задаются таким образом, чтобы определенная область поиска была включена. Однако конфигурация может быть построена таким образом, чтобы после определения углов зрения камеры на основе начальной области поиска определенные углы зрения камеры корректировались на основе результата анализа изображения.

[0055] В заключение, на этапе S404 блок 402 уведомления сервера 400 передает информации об углах зрения камеры, указывающую определенные углы зрения камеры, на камеру 200, после чего процесс завершается. В данном случае, на основе результата процесса обработки, принятого от камеры 100, передача может быть выполнена в соответствии с типом анализа изображения, используемым в процессе идентификации целевого объекта для визуального представления, выполняемом на камере 200, при этом может быть определено, какой результат анализа изображения используется для идентификации целевого объекта для визуального представления. В случае, когда целевой объект для визуального представления идентифицируется с использованием характеристического значения, полученного посредством процесса распознавания черт лица, выполняемого на этапе S404, характеристическое значение, полученное посредством блока 102 анализа изображения, выполняющего процесс распознавания черт лица на захваченном изображении камеры 100, передается на камеру 200.

[0056] В довершение всего, со ссылкой на Фиг. 6, будет представлено разъяснение процесса обработки, который выполняет камера 200, являющаяся первой камерой.

[0057] Изначально, на этапе S201 камера 200 выполняет считывание информации об углах зрения камеры, которую передает сервер 400, и использует величины углов зрения камеры (коэффициент масштабирования, панорамирование/наклон) на основе информации об углах зрения камеры. Другими словами, камера 200 управляет линзой масштабирования на основе информации об углах зрения камеры таким образом, чтобы коэффициент масштабирования, с которым работает камера 200, стал равен коэффициенту масштабирования, включенному в информацию об углах зрения камеры. Кроме того, камера 200 управляет панорамированием/наклоном приводного блока на основе информации об углах зрения камеры таким образом, чтобы направление камеры 200 являлось направлением, соответствующим величинам панорамирования/наклона, включенным в информацию об углах зрения камеры. Камера 200 периодически получает информацию об углах зрения камеры от сервера 400.

[0058] Затем, на этапе S202 камера 200 выполняет поиск вероятного целевого объекта для визуального представления посредством выполнения процесса анализа изображения, аналогичного процессу анализа изображения, выполняемого на камере 100. Вследствие вероятности существования на этапе S202 множества вероятных целевых объектов для визуального представления, на этапе S203 камера 200 выполняет идентификацию целевого объекта для визуального представления при помощи блока 203 идентификации.

[0059] На этапе S205 камера 200 сравнивает целевой объект для визуального представления, полученный из результата анализа камеры 100, с вероятным целевым объектом для визуального представления, полученным на этапе S202, и на основе результата сравнения определяет наличие или отсутствие аналогичного целевого объекта для визуального представления. К примеру, такое определение использует характеристическое значение подобного уровня, полученное посредством процесса распознавания черт лица, применяемого к сравниваемым целевым объектам для визуального представления, например.

[0060] В случае нахождения аналогичного целевого объекта для визуального представления (положительный результат определения, выполняемого на этапе S205), процесс обработки завершается. Тем временем, в случае, если идентичный целевой объект для визуального представления найден не был (отрицательный результат определения, выполняемого на этапе S205), то камера 200 на этапе S204 повторно обновляет величины углов зрения камеры на основе результата анализа изображения, полученного на этапе S202. В данном случае поиск выполняется повторно, постепенно увеличивая коэффициент масштабирования наряду с сохранением области так, чтобы вероятный целевой объект для визуального представления полностью поместился в области. На этапе S204 углы зрения камер (коэффициент масштабирования, панорамирование/наклон) обновляются новыми величинами, при этом обновляются величины панорамирования/наклона/увеличения масштаба камеры 200. Этот процесс обработки многократно выполняется до тех пор, пока не будет выполнена идентификация целевого объекта для визуального представления.

[0061] Как было описано выше, сервер 400 идентифицирует целевой объект для визуального представления посредством управления совместной работой множества камер.

[0062] Следует отметить, что начало этого процесса обработки побуждает обозначение целевого объекта для визуального представления посредством пользователя устройства 500 визуального представления изображения, но это не является ограничением. Например, конфигурация может быть построена таким образом, чтобы процесс обработки начинался автоматически в случае обнаружения перемещающегося объекта посредством камеры, при этом конфигурация может быть построена таким образом, чтобы процесс обработки начинался в случае распознавания конкретного человека или объекта.

[0063] Кроме того, предполагалось, что анализ изображения выполняется посредством камеры, но конфигурация может быть построена таким образом, чтобы камера выполняла только захват изображения, а анализ изображения выполнялся на сервере 400.

[0064] Как разъяснялось выше, в соответствии с настоящим вариантом осуществления, в случае захвата аналогичного целевого объекта для визуального представления, наряду с отслеживанием целевого объекта для визуального представления посредством множества камер, выполняется анализ изображения, являющийся общим для камер, при этом поиск и идентификация целевого объекта для визуального представления (отслеживание целевого объекта) выполняются с согласованным использованием результатов анализа изображения. В частности, посредством расширения области поиска целевого объекта для визуального представления на основе результата анализа изображения можно эффективно идентифицировать и отследить целевой объект для визуального представления при подходящих условиях. В таком случае идентификация целевого объекта для визуального представления может быть выполнена с высокой скоростью.

[0065] Во втором варианте осуществления будет представлено разъяснение конфигурации, в которой в процессе оценки области наличия целевого объекта для визуального представления, выполняемом на этапе S402 на сервере 400, область наличия целевого объекта для визуального представления корректируется на основе результатов анализа изображения.

[0066] Другими словами, во втором варианте осуществления, вследствие того, что в случае, когда правдоподобие, полученное из результата анализа, превышает или равно предварительно определенному порогу, существует высокая вероятность того, что визуальное представление будет удачным, или того, что целевой объект находится поблизости и область поиска сократится (сузится) (это является общим условием для всего анализа изображения).

[0067] Кроме того, в случае возможности обнаружения ног целевого объекта для визуального представления область поиска сокращается. Кроме того, в случае возможности обнаружения характеристической информации, такой как плечо/рост и т.п., или характеристическая информация используется для оценки позиции в трехмерном пространстве, область поиска сокращается.

[0068] Кроме того, в случае, когда скорость перемещения целевого объекта для визуального представления меньше предварительно определенной скорости, область перемещения вычисляется с учетом скорости перемещения и периода времени, необходимого до выполнения идентификации посредством камеры 200, при этом область поиска задается в соответствии с областью дальности перемещения. Помимо всего прочего, даже в случае, когда скорость перемещения не является малой и целевой объект для визуального представления удаляется от камеры 200, область поиска сокращается вследствие вероятности того, что целевой объект для визуального представления будет лишь ненадолго захвачен в случае задания увеличения масштаба в широкоугольном направлении. Сокращение области поиска выполняется посредством многократного умножения предварительно определенного коэффициента масштабирования, посредством чего удовлетворяется условие сокращения (правило определения).

[0069] Кроме того, в процессе оценки области наличия целевого объекта для визуального представления, выполняемом на этапе S402 на сервере 400, может быть выполнено как расширение, так и сокращение области, в которой присутствует целевой объект для визуального представления, а также может быть выполнена коррекция (масштабирование) области поиска в сочетании со структурой первого варианта осуществления. Коррекция области выполняется посредством умножения предварительно определенного коэффициента масштабирования на основе вышеописанного правила определения.

[0070] Как разъяснялось выше во втором варианте осуществления, подобно первому варианту осуществления, посредством сокращения области поиска целевого объекта для визуального представления на основе результата анализа изображения можно эффективно идентифицировать и отследить целевой объект для визуального представления с более подходящими условиями. В таком случае идентификация целевого объекта для визуального представления может быть выполнена с высокой скоростью.

[0071] В третьем варианте осуществления блок 401 определения параметров видеосъемки оценивает область, в которой может находиться целевой объект для визуального представления, на основе скорости перемещения и направления перемещения целевого объекта для визуального представления, полученных посредством блока 102 анализа изображения на основе позиционной информации, полученной посредством оценки позиции в трехмерном пространстве, и прогнозируемого времени до завершения процесса идентификации целевого объекта для визуального представления на камере 200. Затем режимы работы (углы зрения) камеры 200, которые являются условиями захвата изображения, определяются таким образом, чтобы целевой объект для визуального представления был включен в оцененную область.

[0072] Как разъяснялось выше в третьем варианте осуществления, в дополнение к эффектам, разъясненным в первом и втором вариантах осуществления, могут быть заданы более подходящие условия захвата изображения.

[0073] В четвертом варианте осуществления будет представлено разъяснение конфигурации, в которой в процессе оценки области наличия целевого объекта для визуального представления, выполняемом на этапе S402 (Фиг. 5) на сервере 400, область наличия целевого объекта корректируется на основе создания вероятности наличия человеческого тела/объекта, генерируемого на основе информации, связанной с прошлым целевым объектом для визуального представления (информации об области целевого объекта для визуального представления).

[0074] Другими словами, в четвертом варианте осуществления область целевого объекта для визуального представления, определенная в прошлом, записывается на устройстве 500 визуального представления изображения в качестве области для обнаружения целевого объекта для визуального представления на сетевом устройстве 300 хранения данных или сервере 400. Затем, посредством сервера 400, ссылающегося на записанную в прошлом область целевого объекта для визуального представления, можно использовать записанную в прошлом область целевого объекта для визуального представления в качестве стандарта определения для области визуального представления, в которой, вероятно, будет расположено человеческое тело или объект. Если текущий целевой объект для визуального представления присутствует в области, в которой в прошлом присутствовало человеческое тело или объект, с вероятностью, превышающей предварительно определенный порог, то на этапе S402 сервер 400 сокращает область целевого объекта для визуального представления. В противоположном случае, посредством расширения области целевого объекта для визуального представления поиск может быть выполнен эффективно.

[0075] Кроме того, конфигурация может быть построена таким образом, чтобы она сохраняла то, был ли найден целевой объект для визуального представления на этапе S205, изображенном на Фиг. 6, с углами зрения камеры, определенными на основе области целевого объекта для визуального представления, определенной посредством устройства 500 визуального представления изображения, и на это ссылаются при последующем определении углов зрения камеры. Другими словами, в случае, если область целевого объекта для визуального представления, определяемая на устройстве 500 визуального представления изображения, была определена в прошлом, то область целевого объекта для визуального представления задается следующим образом. В случае если область целевого объекта для визуального представления была определена в прошлом, целевой объект для визуального представления не был найден с использованием углов зрения камеры на основе области целевого объекта для визуального представления, и область целевого объекта для визуального представления была расширена, а на этапе S204 выполняется повторный поиск вероятных целевых объектов для визуального представления, то на сей раз поиск вероятных целевых объектов для визуального представления заблаговременно расширяет область целевого объекта для визуального представления. В случае если в прошлом область А1 целевого объекта для визуального представления расширялась до области А2 целевого объекта для визуального представления и проводился повторный поиск вероятных целевых объектов для визуального представления, то на сей раз поиск вероятных целевых объектов для визуального представления в области А1 целевого объекта для визуального представления не выполняется, при этом поиск вероятных целевых объектов для визуального представления выполняется в области А2 целевого объекта для визуального представления. Следует отметить, что поиск вероятных целевых объектов для визуального представления на сей раз может быть выполнен в области А3 целевого объекта для визуального представления, которая является более узкой сравнительно с областью A2 и шире области A1. Информация о нахождении целевого объекта для визуального представления на этапе S205 сохраняется на сетевом устройстве 300 хранения данных или сервере 400.

[0076] Как разъяснялось выше в четвертом варианте осуществления, в дополнение к эффектам первого и второго вариантов осуществления, поиск целевого объекта для визуального представления может быть эффективно выполнен посредством использования прошлой информации об области целевого объекта для визуального представления.

[0077] Варианты осуществления настоящего изобретения также могут быть реализованы посредством компьютера системы или устройства, которое считывает и исполняет машинно-исполнимые команды, записанные на носителе данных (например, на невременном машиночитаемом носителе данных) для выполнения функций одного или более вышеописанных вариантов осуществления настоящего изобретения, а также посредством способа, выполняемого посредством компьютера системы или устройства, посредством, например, считывания и запуска машинно-исполнимых команд с носителя данных для выполнения функций одного или более вышеописанных вариантов осуществления. Компьютер может содержать один или более центральных процессоров (CPU), микропроцессоров (MPU) или другие схемы, а также может включать в себя сеть из отдельных компьютеров или отдельных компьютерных процессоров. Машинно-исполнимые команды могут быть предоставлены компьютеру, например, из сети или с носителя данных. Носитель данных может включать в себя, например, один или более жестких дисков, оперативных запоминающих устройств (RAM), постоянных запоминающих устройств (ROM), хранилищ распределенных вычислительных систем, оптических дисков (таких как компакт-диск (CD), цифровой универсальный диск (DVD) или диск стандарта Blu-ray (BD)™), устройств флэш-памяти, карт памяти и т.п.

[0078] Наряду с тем, что настоящее изобретение было описано со ссылкой на иллюстративные варианты осуществления, следует понимать, что изобретение не ограничивается раскрытыми иллюстративными вариантами осуществления. Объем, определяемый нижеследующей формулой изобретения, должен получить самую широкую интерпретацию, чтобы охватить все подобные модификации и эквивалентные структуры и функции.

| название | год | авторы | номер документа |

|---|---|---|---|

| СПОСОБ УПРАВЛЕНИЯ ТРАНСПОРТНЫМ СРЕДСТВОМ И УСТРОЙСТВО УПРАВЛЕНИЯ ТРАНСПОРТНЫМ СРЕДСТВОМ | 2019 |

|

RU2788556C1 |

| СПОСОБ УПРАВЛЕНИЯ ОСВЕТИТЕЛЬНОЙ СИСТЕМОЙ, КОМПЬЮТЕРНЫЙ ПРОГРАММНЫЙ ПРОДУКТ, НОСИМОЕ ВЫЧИСЛИТЕЛЬНОЕ УСТРОЙСТВО И НАБОР ОСВЕТИТЕЛЬНОЙ СИСТЕМЫ | 2015 |

|

RU2707183C2 |

| АВТОМАТИЧЕСКОЕ ГЕНЕРИРОВАНИЕ ВИЗУАЛЬНОГО ПРЕДСТАВЛЕНИЯ | 2010 |

|

RU2560340C2 |

| ВЫРАЖЕНИЕ ВИЗУАЛЬНОГО ПРЕДСТАВЛЕНИЯ, ОСНОВАННОЕ НА ВЫРАЖЕНИИ ИГРОКА | 2010 |

|

RU2560794C2 |

| РОБОТ-УБОРЩИК И СПОСОБ УПРАВЛЕНИЯ ТАКОВЫМ | 2013 |

|

RU2540058C2 |

| СПОСОБ, ТЕРМИНАЛ И СИСТЕМА ДЛЯ БИОМЕТРИЧЕСКОЙ ИДЕНТИФИКАЦИИ | 2023 |

|

RU2815689C1 |

| АНАЛИТИЧЕСКАЯ СИСТЕМА РАСПОЗНАВАНИЯ И ВИДЕОИДЕНТИФИКАЦИИ | 2016 |

|

RU2720947C2 |

| СПОСОБ, ТЕРМИНАЛ И СИСТЕМА ДЛЯ БИОМЕТРИЧЕСКОЙ ИДЕНТИФИКАЦИИ | 2022 |

|

RU2798179C1 |

| УСТРОЙСТВО УПРАВЛЕНИЯ, СПОСОБ УПРАВЛЕНИЯ И НОСИТЕЛЬ ДАННЫХ | 2017 |

|

RU2704608C1 |

| ОБРАБОТКА ПОЛЬЗОВАТЕЛЬСКОЙ ВХОДНОЙ ИНФОРМАЦИИ С ОТСЛЕЖИВАНИЕМ ГЛАЗ | 2013 |

|

RU2608462C2 |

Изобретение относится к области получения изображений и касается способа управления в системе захвата изображения, содержащей первое и второе устройства захвата изображения. Способ включает в себя определение, превышает ли правдоподобие распознанного объекта в захваченном посредством первого устройства захвата изображении предварительно определенное правдоподобие. В случае, если правдоподобие распознанного объекта не превышает предварительно определенное правдоподобие, то управляют областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала шире, чем в случае, когда правдоподобие распознанного объекта в захваченном посредством первого устройства захвата изображении превышает предварительно определенное правдоподобие. Технический результат заключается в сокращении времени поиска целевого объекта. 3 н. и 9 з.п. ф-лы, 6 ил.

1. Способ управления в системе захвата изображения, содержащей первое устройство захвата изображения и второе устройство захвата изображения, содержащий этапы, на которых:

определяют, превышает ли правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, предварительно определенное правдоподобие; и

в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, не превышает предварительно определенное правдоподобие, управляют областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала шире, чем в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, превышает предварительно определенное правдоподобие.

2. Способ по п. 1, в котором в случае, когда объект с предварительно определенной частью не обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения, управляют областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала более широкой, чем в случае, когда объект с предварительно определенной частью обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения.

3. Способ по п. 1, в котором областью визуального представления второго устройства захвата изображения управляют таким образом, чтобы захватить распознанный объект, включенный в захваченное изображение, захваченное посредством первого устройства захвата изображения.

4. Способ по п. 1, в котором распознанный объект, включенный в захваченное изображение, захваченное посредством первого устройства захвата изображения, обнаруживается на захваченном изображении, захваченном посредством второго устройства захвата изображения.

5. Способ по п. 1, в котором областью визуального представления второго устройства захвата изображения управляют на основе прошлого процесса распознавания.

6. Устройство управления, соединенное с первым устройством захвата изображения и вторым устройством захвата изображения, содержащее:

блок определения, выполненный с возможностью определения того, превышает ли правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, предварительно определенное правдоподобие; и

блок управления, выполненный с возможностью управления, в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, не превышает предварительно определенное правдоподобие, областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала шире, чем в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, превышает предварительно определенное правдоподобие.

7. Устройство управления по п. 6, в котором блок управления, в случае, когда объект с предварительно определенной частью не обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения, управляет областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала более широкой, чем в случае, когда объект с предварительно определенной частью обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения.

8. Устройство управления по п. 6, в котором блок управления управляет областью визуального представления второго устройства захвата изображения таким образом, чтобы захватить распознанный объект, включенный в захваченное изображение, захваченное посредством первого устройства захвата изображения.

9. Устройство управления по п. 6, в котором блок управления передает информацию для обнаружения распознанного объекта, включенного в захваченное изображение, захваченное посредством первого устройства захвата изображения, на захваченном изображении, захваченном посредством второго устройства захвата изображения, на второе устройство захвата изображения.

10. Машиночитаемый носитель данных, на котором сохранена компьютерная программа для компьютера, соединенного с первым устройством захвата изображения и вторым устройством захвата изображения, при этом компьютерная программа содержит:

определение того, превышает ли правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, предварительно определенное правдоподобие; и

в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, не превышает предварительно определенное правдоподобие, управление областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала шире, чем в случае, когда правдоподобие распознанного объекта, распознанного в захваченном изображении, захваченном посредством первого устройства захвата изображения, превышает предварительно определенное правдоподобие.

11. Носитель данных по п. 10, при этом в случае, когда объект с предварительно определенной частью не обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения, осуществляется управление областью визуального представления второго устройства захвата изображения таким образом, чтобы область визуального представления второго устройства захвата изображения стала более широкой, чем в случае, когда объект с предварительно определенной частью обнаружен в захваченном изображении, захваченном посредством первого устройства захвата изображения.

12. Носитель данных по п. 10, при этом управление областью визуального представления второго устройства захвата изображения осуществляется таким образом, чтобы захватить распознанный объект, включенный в захваченное изображение, захваченное посредством первого устройства захвата изображения.

| US 6404455 B1, 11.06.2002 | |||

| US 8284254 B2, 09.10.2012 | |||

| US 8154578 B2, 10.04.2012 | |||

| УСТРОЙСТВО ДЛЯ ЮСТИРОВКИ НАПРАВЛЕНИЯ ВИЗИРНОЙ ОСИ ДВУХКАМЕРНОЙ ТЕЛЕВИЗИОННОЙ СИСТЕМЫ | 2005 |

|

RU2298883C2 |

Авторы

Даты

2017-01-10—Публикация

2014-09-12—Подача