Изобретение относится к бионике, моделированию функциональных аспектов человека и может найти применение в вычислительной технике при построении интеллектуальных машин и систем.

Известны способы интеллектуальной многоуровневой обработки информации в одномерных, двумерных и трехмерных сверточных нейронных сетях (Хайкин С. Нейронные сети: полный курс, 2-е издание.: Пер. с англ. М.: Издательский дом «Вильямс», 2006. – 1104 с.; Сикорский О. С. Обзор сверточных нейронных сетей для задачи классификации изображений. Новые информационные технологии в автоматизированных системах. 2017, № 20, С. 37 – 42; Shuiwang Ji., Wei Xu, Ming Yang, Kai Yu. 3D Convolutional Neural Networks for Human Action Recognition. IEEE Transactions on Pattern Analysis and Machine Intelligence. 2010, 35 (1), pp. 495 – 502.). К недостаткам этих способов следует отнести их направленность только на распознавание статических и динамических образов после обучения с учителем. В них отсутствует самообучение, нет запоминания предыдущего опыта, учета обратных результатов при распознавании. Нет возможности синтезировать новые динамические сигналы на различных уровнях обработки.

Известны способы интеллектуальной многоуровневой обработки информации в иерархической темпоральной памяти (Иерархическая темпоральная память (ИТМ) и ее кортикальные алгоритмы обучения. Версия 0.2.1 от 12 сентября 2011 г. (с) Numenta, Inc. 2011; Джефф Хокинс, Сандра Блейкели. Об интеллекте. Издательский дом «Вильямс», 2007). К несовершенствам этих способов относятся трудности обработки непрерывных потоков информации, необходимость выделения времени на самоорганизацию памяти. Они направлены лишь на многоуровневое запоминание сигналов, а не на их полноценную интеллектуальную обработку. Имеются сложности извлечения из памяти сигналов в исходной форме.

Известны способы интеллектуальной многоуровневой обработки информации в самообучающихся рекуррентных нейронных сетях с управляемыми элементами (Osipov V., Osipova M. Space-time signal binding in recurrent neural networks with controlled elements. Neurocomputing, 2018, 308, pp. 194–204; Осипов В.Ю. Ассоциативная интеллектуальная машина с тремя сигнальными системами. Информационно-управляющие системы. 2014, №5, С. 12 – 17; Патенты на изобретения RU 2413304 (С1), 27.02. 2011; RU 2502133 (С1), 20.12.2013; RU 2514931 (С1), 10.05.2014; RU 2446463 (С1), 27.03.2012; RU 2427914 (С1), 27.08.2011; 2483356 (С1), 27.05.2013). К общим недостаткам этих способов относятся ограниченные функциональные возможности по интеллектуальной многоуровневой пространственно-временной обработке информации в нейронных сетях.

Наиболее близким аналогом изобретения является способ интеллектуальной многоуровневой обработки информации в многослойной нейронной сети с обратными связями, замыкающими двухслойные контуры с временем задержки единичных образов меньше времени невосприимчивости нейронов сети после их возбуждения. Согласно ему сигнал подают в сеть после разложения на составляющие в базисе, согласованном с входным слоем сети. При этом каждую составляющую перед подачей в сеть преобразуют в последовательность единичных образов с частотой повторения как предварительно заданной функцией от амплитуды составляющей. Сигнал представляют в сети в виде последовательных совокупностей единичных образов (СЕО) в соответствии с предварительно заданными правилами его распознавания с учетом обратных результатов распознавания. При передаче совокупностей единичных образов от слоя к слою их сдвигают вдоль слоев и изменяют параметры расходимости и сходимости этих образов с учетом текущих состояний слоев. Результаты распознавания запоминают на элементах сети. Для реализации многоуровневой обработки сигналов в нейронной сети она разделяется на сигнальные системы, отвечающие за уровни обработки. Наличие возможностей изменять параметры расходящихся и сходящихся единичных образов в нейронной сети обеспечивает не только развязку между сигнальными системами, но и изменение в широких пределах направлений ассоциативного взаимодействия сигналов в сети. Предусматривается копирование сигналов из одной сигнальной системы нейронной сети в другую. В качестве результатов обработки используют последовательные совокупности единичных образов на выходном слое сети после обратного преобразования в соответствующие им исходные сигналы (Osipov V., Osipova M. Space-time signal binding in recurrent neural networks with controlled elements. Neurocomputing. 2018. No 308, pp. 194 – 204).

Недостатками этого способа выступают:

- ограниченные возможности по распознаванию и запоминанию продолжительных сигналов, формированию новых полезных сигналов;

- не большая глубина пространственно-временной ассоциативной обработки информации;

- обработка сигналов на различных уровнях осуществляется в существенно ограниченном пространстве сигналов.

Задачей изобретения является расширение функциональных возможностей по интеллектуальной обработке информации в нейронной сети.

Технический результат от использования изобретения заключается в повышении интеллектуальности обработки информации в нейронной сети, улучшении распознавания, запоминания, формирования новых полезных сигналов и извлечения их из памяти сети.

Поставленная задача решается тем, что в известном способе интеллектуальной многоуровневой обработки информации в нейронной сети, заключающемся в подаче в многослойную рекуррентную сеть с K уровнями обработки и с обратными связями, замыкающими двухслойные контуры с временем задержки единичных образов меньше времени невосприимчивости нейронов сети после их возбуждения, сигнала, разложенного на составляющие в базисе, согласованном с входным слоем сети, с каждой составляющей, преобразованной в последовательность единичных образов с частотой повторения как предварительно заданной функцией от амплитуды составляющей, представлении сигнала в виде последовательных совокупностей единичных образов в соответствии с предварительно заданными правилами его распознавания с учетом обратных результатов распознавания, сдвигах совокупностей единичных образов вдоль слоев и изменении параметров расходимости и сходимости этих образов с учетом текущих состояний слоев, запоминании результатов распознавания на элементах сети, использовании в качестве результатов обработки последовательных совокупностей единичных образов на выходном слое сети после обратного преобразования в соответствующие им исходные сигналы, согласно изобретению сигнал подают в нейронную сеть, в которой на каждом k+1 (k =0, 1, …., K-1) уровне обработки пороги возбуждения нейронов и амплитуды формируемых ими единичных образов больше их значений на k-м уровне, дополнительно пересекающиеся предварительно заданной длины выборки из последовательности совокупностей единичных образов k-го уровня преобразуют в совокупности единичных образов k+1 уровня, каждую из которых связывают с соответствующей ей выборкой, обрабатывают дополнительно сформированные совокупности единичных образов на k+1 уровне аналогично обработке сигнала на k-м уровне и связывают их в пространстве и во времени через запоминание связей на элементах сети, используют эти связи для извлечения сигналов из памяти, обработанные совокупности единичных образов k+1 уровня преобразуют обратно в соответствующие им объединенные выборки последовательностей совокупностей единичных образов k-го уровня, используют эти выборки для формирования результатов обработки сигналов в сети.

Новым существенным признаком изобретения является то, что сигнал подают в нейронную сеть, в которой на каждом k+1 (k =0, 1, …., K-1) уровне обработки пороги возбуждения нейронов и амплитуды формируемых ими единичных образов больше их значений на k-м уровне. Без выполнения этого условия невозможно обеспечить успешные прямые и обратные преобразования сигналов в импульсной нейронной сети для переходов от одного уровня обработки к другому уровню. Это позволяет формировать и обрабатывать в нейронной сети на различных уровнях разномасштабные по информационному содержанию сигналы в виде последовательных совокупностей единичных образов.

К новому существенному признаку изобретения относится также то, что дополнительно пересекающиеся предварительно заданной длины выборки из последовательности совокупностей единичных образов k-го уровня преобразуют в совокупности единичных образов k+1 уровня, каждую из которых связывают с соответствующей ей выборкой. С учетом первого признака изобретения на k+1 уровне формируют совокупности единичных образов (СЕО) с амплитудами больше, чем амплитуды единичных образов на k-м уровне. За счет этого на основе сигналов k-го уровня можно формировать широкое множество других связанных сигналов k+1 уровня. Эти сигналы могут использоваться как «строительные блоки» для формирования различных не противоречащих новых сигнальных конструкций. При этом предоставляются возможности быстрой и глубокой пространственно-временной ассоциативной обработки информации.

Другим новым существенным признаком изобретения выступает то, что на элементах сети связывают в пространстве и во времени совокупности единичных образов (СЕО) k+1 уровня, несущие информацию о пересекающихся выборках из последовательности СЕО k уровня и используют запомненные связи для извлечения сигналов из памяти. При таком связывании существенно расширяются возможности формирования из этих совокупностей различных вариантов новых сигналов и извлечения их из памяти. При связывании только непересекающихся выборок возможности получения новых сигналов существенно ниже.

Новым существенным признаком изобретения выступает и то, что обработанные СЕО k+1 уровня преобразуют обратно в соответствующие им объединенные выборки последовательностей СЕО k-го уровня, используют эти выборки для формирования результатов обработки сигналов в сети. Это позволяет переходить с верхнего уровня обработки сигналов на нижестоящий уровень, преобразовывать данные об обработанных выборках в сами выборки из соответствующих им последовательностей СЕО. Объединение пересекающихся выборок с одной стороны позволяет устранять избыточность в порождаемых сигналах, а с другой стороны предоставляет возможность получения новых связанных сигналов в виде последовательных СЕО. Сформированные таким образом выборки могут использоваться совместно и раздельно по времени с сигналами прямой обработки для формирования выходных результатов, что также расширяет возможности интеллектуальной обработки сигналов в нейронной сети.

В целом все это существенно расширяет функциональные возможности по интеллектуальной обработке информации в нейронной сети, улучшает распознавание, запоминание, формирование новых полезных сигналов и извлечение их из памяти сети.

Сущность изобретения поясняется фиг. 1-4.

На фиг. 1 приведена структурная схема двухслойной рекуррентной нейронной сети, реализующей предложенный способ.

На фиг. 2а, б, в показаны виды спереди, сверху и с боку на пример структуры этой нейронной сети, в которой каждый слой разбит на 30 логических полей по 4×2 нейронов и реализовано три уровня обработки сигналов. На каждом уровне обрабатываемые СЕО продвигаются вдоль слоев по маршруту в виде полувитка спирали. На фиг. 2а (вид спереди) показаны нейроны 1 первого и второго слоев, разбитых на логические поля, и направления 2 передачи между слоями на третьем уровне обработки совокупностей единичных образов. На виде сверху (фиг. 2б) показано разбиение первого слоя сети на 30 логических полей. Линии разбивки этого слоя обозначены цифрой 4. Второй слой имеет такое же разбиение. Направления продвижения СЕО вдоль слоев для первого уровня обработки обозначено как 1, второго уровня – 2, третьего уровня – 3. На виде структуры сети сбоку (фиг. 2в) показано, что на каждом уровне обработки используют нейроны 1, 2, 3, различные по порогам возбуждения и амплитудам формируемых единичных образов. Чем выше уровень обработки, тем выше сила воздействия нейронов этого уровня на взаимодействующие нейроны. Эти факты формально отражены на фиг. 2в различными по размерам кружками - нейронами и толщиной стрелок 4, 5, 6 - направлений передачи совокупностей единичных образов между слоями. На фиг. 2г показано представление структуры сети на уровне нейросетевых каналов, где 1, 2, 3 – номера каналов; 4 – ассоциативные взаимодействия между элементами одних и тех же каналов; 5 – ассоциативные взаимодействия между взаимодействующими каналами; 6 – направления продвижения совокупностей единичных образов по нейросетевым каналам.

На фиг. 3 показана схема преобразования пересекающихся выборок из последовательности СЕО k-го уровня в СЕО k+1 уровня. В основе этого формирования лежит избирательная свертка этих выборок. Когда результат свертки превышает порог возбуждения соответствующего нейрона k+1 уровня на выходе его формируется единичный образ. При этом на синапсах запоминаются результаты связывания возбужденного нейрона k+1 уровня с нейронами k-го уровня, попадающими в заданное ядро свертки. Длина Z сворачиваемых выборок в примере равна трем. В правой части фиг. 3 показано обратное преобразование за счет развертки ранее свернутых выборок. Направление синхронного продвижения обрабатываемых СЕО вдоль слоев в этом примере только вправо. Заметим, что единичные образы на k+1 уровне по амплитуде должны быть всегда больше, чем на k-м уровне.

Согласно фиг. 4 приведен формальный пример преобразования пересекающихся предварительно заданной длины выборок из последовательности СЕО, составляющих фразу «Прилетела ласточка», во множество СЕО вышестоящего уровня. В данном случае на исходном уровне каждой букве из этой фразы соответствует своя СЕО. На вышестоящем уровне каждой СЕО А1, А2,…., А13 соответствует своя тройка букв. На этом уровне фразу «Прилетела ласточка» можно представить не семнадцатью исходными СЕО, а всего лишь шестью СЕО этого уровня. Все эти СЕО могут связываться в сети и образовывать различные сигналы. Примеры такого связывания приведены в нижней части фиг. 4. Формально связывание может предусматривать все операции над множествами единичных образов в совокупностях и над множествами самих этих совокупностей. Оперируя со свернутыми выборками СЕО, сеть может глубже ассоциативно обрабатывать сигналы и быстрее получать результаты такой обработки.

Способ осуществляется следующим образом.

Рассмотрим его на примере нейронной сети, структурная схема которой представлена на фиг. 1. Входной сигнал, разложенный на составляющие в базисе, согласованном с первым слоем сети, при этом каждая его составляющая преобразована в последовательность единичных образов с частотой повторения, как предварительно заданной функцией от амплитуды составляющей, подают на этот слой. После подачи на первый вход первого слоя нейронов такого сигнала на его выходе имеют место последовательные СЕО, несущие всю информацию о входном сигнале.

После задержки в первом блоке единичных задержек последовательные СЕО поступают на первый блок синапсов. Каждый единичный образ из текущей совокупности подается одновременно в первом блоке синапсов на совокупность своих синапсов, обеспечивающих связь каждого нейрона породившего единичный образ с нейронами второго слоя нейронов. За счет такого разветвления каждый единичный образ преобразуется в расходящийся пучок.

Особенность синапсов сети в следующем. Амплитуда единичного образа на выходе каждого синапса равна амплитуде входного единичного образа, умноженной на вес  синапса. Веса

синапса. Веса  синапсов определяются через произведение их весовых коэффициентов

синапсов определяются через произведение их весовых коэффициентов  (t), функций ослабления

(t), функций ослабления  расходящихся и функций ослабления

расходящихся и функций ослабления  сходящихся единичных образов,

сходящихся единичных образов,

.

.

Весовые коэффициенты,  , изменяются в зависимости от воздействий на синапсы единичных образов и выступают в качестве элементов долговременной памяти сети. При прохождении единичных образов через синапсы они снимают с них информацию о предыдущих воздействиях и оставляют информацию о своем появлении через изменения весовых коэффициентов. Значения весовых коэффициентов могут быть определены по известным правилам (Осипов В.Ю. Ассоциативная интеллектуальная машина / Информационные технологии и вычислительные системы. №2, 2010, С. 59 – 67.; Осипов В.Ю. Стирание устаревшей информации в ассоциативных интеллектуальных системах / Мехатроника, автоматизация, управление. № 3, 2012, С. 16 – 20).

, изменяются в зависимости от воздействий на синапсы единичных образов и выступают в качестве элементов долговременной памяти сети. При прохождении единичных образов через синапсы они снимают с них информацию о предыдущих воздействиях и оставляют информацию о своем появлении через изменения весовых коэффициентов. Значения весовых коэффициентов могут быть определены по известным правилам (Осипов В.Ю. Ассоциативная интеллектуальная машина / Информационные технологии и вычислительные системы. №2, 2010, С. 59 – 67.; Осипов В.Ю. Стирание устаревшей информации в ассоциативных интеллектуальных системах / Мехатроника, автоматизация, управление. № 3, 2012, С. 16 – 20).

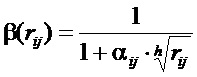

Каждая из связей (синапсов) имеет свои значения функций  ,

,  ослабления единичных образов, зависящих от

ослабления единичных образов, зависящих от  - удаленности связываемых через синапсы нейронов (расстояний между ними на плоскости X, Y). Полагая, что расстояние между взаимодействующими слоями нейронной сети стремится к нулю, функцию

- удаленности связываемых через синапсы нейронов (расстояний между ними на плоскости X, Y). Полагая, что расстояние между взаимодействующими слоями нейронной сети стремится к нулю, функцию  можно определить как:

можно определить как:

;

;  ;

;  ;

;

где h – степень корня, чем она выше, тем шире ассоциативное пространственное взаимодействие в сети;  – положительные коэффициенты, через которые можно задавать параметры расходимости единичных образов ; N – число нейронов в каждом слое сети.

– положительные коэффициенты, через которые можно задавать параметры расходимости единичных образов ; N – число нейронов в каждом слое сети.

Величину  в единицах нейронов для определения значения

в единицах нейронов для определения значения  с учетом возможных пространственных сдвигов СЕО вдоль слоев сети можно выразить в виде:

с учетом возможных пространственных сдвигов СЕО вдоль слоев сети можно выразить в виде:

;

;  ;

;  ;

;

,

,  - проекции связи j–го нейрона с i–м на оси X, Y без учета пространственных сдвигов; d , q – величины единичных сдвигов, соответственно, по координатам X, Y;

- проекции связи j–го нейрона с i–м на оси X, Y без учета пространственных сдвигов; d , q – величины единичных сдвигов, соответственно, по координатам X, Y;  , M – число, соответственно, столбцов и строк, на которые разбивается каждый слой нейронной сети за счет сдвигов. Изменяя

, M – число, соответственно, столбцов и строк, на которые разбивается каждый слой нейронной сети за счет сдвигов. Изменяя  ,

,  на соответствующие значения

на соответствующие значения  и

и  можно менять

можно менять  и направление потока СЕО вдоль слоев сети.

и направление потока СЕО вдоль слоев сети.

Такие сдвиги СЕО вдоль слоев реализуются через управление синапсами с блока управления. В общем случае смещенные СЕО с выхода первого блока синапсов поступают на вход второго слоя нейронов.

Заметим, что все единичные образы, поступившие на один и тот же нейрон по различным синапсам, суммируются. При превышении этой суммы заданного порога возбуждения нейрона он возбуждается и на его выходе формируется единичный образ. Затем имеемая сумма обнуляется, а сам нейрон затем переходит в состояние невосприимчивости входных сигналов. В нем он находится заданное время, которое больше суммарной задержки единичных образов в блоках входящих в двухслойный многопучковый контур нейронной сети.

Последовательные СЕО с выхода второго слоя после задержки поступают на второй блок синапсов. В этом блоке они аналогичным образом, как и в первом блоке синапсов, обрабатываются и, сдвинутые вдоль первого слоя в зависимости от состояний первого и второго слоев, поступают на второй вход первого слоя нейронов.

С учетом этого поступающие на первый слой нейронов прямые и обратные СЕО в нем корректно связываются, распознаются и порождают на его выходе новые СЕО, несущие в себе информацию как о текущих, так и ранее запомненных сетью сигналах, связанных с первыми. При этом за счет соответствующих сдвигов СЕО вдоль слоев исключается наложение обратных результатов распознавания на прямые совокупности.

За счет приоритетности коротких связей в нейронной сети между входом и выходом сети легко устанавливается однозначное соответствие между составляющими входных и выходных сигналов.

С учетом этого соответствия по номерам нейронов, формируемых последовательности единичных образов на выходе устройства, определяют частотные и пространственные характеристики составляющих исходного сигнала. По частотам следования и относительным задержкам единичных образов, соответственно, устанавливают амплитуды и фазы составляющих исходного сигнала. Затем воспроизводят составляющие исходных сигналов и путем их сложения восстанавливают исходные, например речевые, зрительные и другие сигналы. Для определения амплитуд составляющих исходного сигнала определяют текущее число единичных образов, попадающих в предварительно заданный интервал времени. Для воспроизведения составляющих исходных сигналов применим, например их цифровой синтез по известным параметрам.

За счет пространственных сдвигов СЕО, передаваемых от слоя к слою в нейронной сети может реализовываться N связанных нейросетевых каналов передачи и обработки этих СЕО. Каждый из этих каналов отвечает за свой уровень обработки сигналов.

Согласно изобретению предлагается сигнал подавать в нейронную сеть, в которой на каждом k+1 (k =0, 1, …., K-1) уровне обработки пороги возбуждения нейронов и амплитуды формируемых ими единичных образов больше их значений на k-м уровне. Это позволяет по-новому обрабатывать этот сигнал, реализовывать над ним другие действия, позволяющие расширить возможности его интеллектуальной обработки в нейронной сети.

Особенности структуры нейронной сети с такими свойствами отражены на фиг. 2а, б, в, г. Наличие увеличенного порога возбуждения у нейронов вышестоящего уровня позволяет обеспечивать свертки выборок СЕО k-го уровня в отдельные СЕО k+1 уровня. Наличие более высокой амплитуды единичных образов, формируемых нейронами k+1 уровня, по сравнению с порогами возбуждения нейронов k-го уровня и амплитудами формируемых ими единичных образов обеспечивает развертку отдельных СЕО k+1 уровня в выборки, состоящие из нескольких СЕО k-го уровня.

Также согласно изобретению предлагается дополнительно пересекающиеся предварительно заданной длины выборки из последовательности СЕО k-го уровня преобразовывать в совокупности единичных образов k+1 уровня, каждую из которых связывать с соответствующей ей выборкой.

Длину таких выборок предлагается выбирать так, чтобы она была больше реализуемых пространственных сдвигов СЕО при передаче их от слоя к слою. Схема, поясняющая такое преобразование показана на фиг. 3. В основе такого преобразования лежит свертка с заданными размерами ядра (матрицы). В простом примере на фиг. 3 это ядро с размерами 9×1. Формирование размеров таких ядер в нейронной сети осуществимо через задание соответствующих значений функций  ослабления сходящихся единичных образов. Предлагается для синапсов, связывающих принимающие нейроны с передающими нейронами одного и того же уровня обработки принимать

ослабления сходящихся единичных образов. Предлагается для синапсов, связывающих принимающие нейроны с передающими нейронами одного и того же уровня обработки принимать  . Однако, для синапсов, связывающих принимающий j-й нейрон k+1 уровня обработки с передающими i-ми нейронами k-го уровня, предлагается задавать значение

. Однако, для синапсов, связывающих принимающий j-й нейрон k+1 уровня обработки с передающими i-ми нейронами k-го уровня, предлагается задавать значение  , только если эти передающие нейроны попадают в ядро свертки. Если они не попадают в это ядро, то

, только если эти передающие нейроны попадают в ядро свертки. Если они не попадают в это ядро, то  .

.

В результате такого формирования получают на k+1 уровне множество более емких по информационному содержанию СЕО (фиг. 4). Даже по двум таким совокупностям k+1 уровня в зависимости от их информационного содержания при обратном преобразовании можно получать различные по длине и, естественно, по содержанию последовательности СЕО k-го уровня. Это существенно облегчает процессы распознавания известных и формирования новых сигналов в нейронной сети.

В изобретении также предлагается связывать на элементах сети в пространстве и во времени СЕО k+1 уровня, несущие информацию о пересекающихся выборках из последовательности СЕО k уровня и использовать запомненные связи для извлечения сигналов из памяти. В результате такого связывания в памяти сети сохраняется информация о временных и пространственных отношениях обработанных совокупностей. При этом объемы необходимой памяти для запоминания одной и той же информации на k+1 уровне существенно меньше, чем на k-м уровне. Также обработка сигналов на уровне свернутых пересекающихся выборок СЕО позволяет существенно упростить корректный синтез информационных структур из объективно вытекающих условий.

Также согласно изобретению обработанные СЕО k+1 уровня предлагается преобразовывать обратно в соответствующие им объединенные выборки последовательностей СЕО k-го уровня. Это осуществимо путем разверток соответствующих совокупностей k+1 уровня в соответствующие им выборки из последовательностей СЕО k-го уровня. Эта развертка осуществляется путем передачи с каждого возбужденного нейрона k+1 уровня соответствующего ему по амплитуде единичного образа только на принимающие нейроны k-го уровня, попадающие в заданное ядро развертки, которое по размерам совпадает с ядром свертки. Схема такого обратного преобразования приведена в правой части фиг. 3.

При этом заметим, что однозначное соответствие между входом каждого уровня обработки в нейронной сети и его выходом обеспечивается за счет приоритетности коротких связей (синапсов). Для исключения конфликтов в сети между СЕО k-го уровня с обработанными на k+1 уровне и восстановленными выборками СЕО предлагается временно блокировать прямое продвижение СЕО с входа на выход. Это осуществимо, например, повышением порогов возбуждения нейронов на одном из логических полей в зависимости от состояний слоев сети.

Таким образом, предлагаемый способ по сравнению с аналогами обладает более широкими функциональными возможностями по интеллектуальной обработке информации в нейронной сети. Он позволяет повысить интеллектуальность обработки информации в нейронной сети, улучшить распознавание, запоминание, формирования новых полезных сигналов и извлечение их из памяти сети.

Для доказательства преимущества предлагаемого способа по сравнению с известными решениями исследовались возможности нейронной сети (фиг. 1) с предлагаемой многоуровневой обработкой информации.

Была разработана программная модель нейронной сети, реализующей предлагаемый способ. Для разработки этой модели использовалась среда MatLab. Каждый слой нейронной сети состоял из 2100 нейронов. За счет пространственных сдвигов передаваемых совокупностей единичных образов от слоя к слою, каждый слой разбивался на 100 логических полей по 7×3 нейрона в каждом. Реализовывалось два параллельных взаимосвязанных нейросетевых канала (уровня) передачи и ассоциативной обработки информации. Последовательные совокупности единичных образов вводились в сеть через первое логическое поле первого канала, а снимались с последнего поля этого канала. Совокупности единичных образов продвигались вдоль слоев в обоих каналах синхронно по спирали, как на фиг. 2б. Только на рис. 2б показано три уровня обработки, а в эксперименте реализовывалось лишь два уровня, однако с существенно большим числом нейронов в слоях и более длинными нейросетевыми каналами обработки. На каждый нейросетевой канал приходилось в каждом слое по 50 логических полей размером 7×3 нейронов. Каждая сворачиваемая выборка СЕО, пересекающаяся с соседними выборками, состояла из трех СЕО. Использовались одинаковые ядра свертки и развертки размером 15×1.

Исследование сводилось к оценке возможностей преобразования пересекающихся выборок из последовательности СЕО первого уровня (k=0) в отдельные СЕО второго уровня (k=1), обработки их и обратного преобразования в соответствующие им объединенные выборки СЕО. За счет того, что нейроны второго уровня имели порог возбуждения выше, чем нейроны первого уровня, исключалась возможность их ложного срабатывания от единичных образов отдельно взятой СЕО. Наличие повышенного уровня амплитуды у единичных образов второго уровня позволяло отдельно взятым нейроном этого уровня возбуждать сразу несколько нейронов первого уровня. Результаты эксперимента показали, что за счет предлагаемых новых технических решений существенно расширяются возможности нейронной сети по интеллектуальной обработке информации.

Способ интеллектуальной обработки информации в нейронной сети может быть реализован с использованием известной элементной базы. В качестве нейронов слоев и элементов единичных задержек в блоках единичных задержек нейронной сети, реализующей способ применимы ждущие мультивибраторы. Блоки синапсов могут быть реализованы с применением управляемых аттенюаторов и мемристоров (резисторов с памятью). Блок управления синапсами может быть реализован специализированным процессором, программируемыми интегральными схемами, функционирующими в соответствии с рассмотренными выше правилами.

Способ можно реализовать также путем эмулирования двухслойной рекуррентной нейронной сети с управляемыми элементами на современных вычислительных машинах.

Изобретение относится к бионике, моделированию функциональных аспектов человека и может найти применение в вычислительной технике при построении интеллектуальных машин и систем. Техническим результатом является повышение интеллектуальности обработки информации в нейронной сети, улучшение распознавания, запоминания, формирования новых полезных сигналов и извлечения их из памяти сети. Сущность способа в том, что сигнал подают в многослойную рекуррентную нейронную сеть, в которой на каждом k+1 уровне обработки пороги возбуждения нейронов и амплитуды формируемых ими единичных образов больше их значений на k-м уровне. Дополнительно пересекающиеся предварительно заданной длины выборки из последовательности обрабатываемых совокупностей единичных образов k-го уровня преобразуют в совокупности единичных образов k+1 уровня и каждую из них связывают с соответствующей ей выборкой. Обрабатывают дополнительно сформированные совокупности единичных образов на k+1 уровне аналогично обработке сигнала на k-м уровне и связывают их в пространстве и во времени через запоминание связей на элементах сети. Используют эти связи для извлечения сигналов из памяти. Обработанные совокупности единичных образов k+1 уровня преобразуют обратно в соответствующие им объединенные выборки последовательностей совокупностей единичных образов k-го уровня. Используют эти выборки для формирования результатов обработки сигналов в сети. 7 ил.

Способ интеллектуальной многоуровневой обработки информации в нейронной сети, заключающийся в подаче в многослойную рекуррентную сеть с K уровнями обработки и с обратными связями, замыкающими двухслойные контуры с временем задержки единичных образов меньше времени невосприимчивости нейронов сети после их возбуждения, сигнала, разложенного на составляющие в базисе, согласованном с входным слоем сети, с каждой составляющей, преобразованной в последовательность единичных образов с частотой повторения как предварительно заданной функцией от амплитуды составляющей, представлении сигнала в виде последовательных совокупностей единичных образов в соответствии с предварительно заданными правилами его распознавания с учетом обратных результатов распознавания, сдвигах совокупностей единичных образов вдоль слоев и изменении параметров расходимости и сходимости этих образов с учетом текущих состояний слоев, запоминании результатов распознавания на элементах сети, использовании в качестве результатов обработки последовательных совокупностей единичных образов на выходном слое сети после обратного преобразования в соответствующие им исходные сигналы, отличающийся тем, что сигнал подают в нейронную сеть, в которой на каждом k+1 (k =0, 1, …., K-1) уровне обработки пороги возбуждения нейронов и амплитуды формируемых ими единичных образов больше их значений на k-м уровне, дополнительно пересекающиеся предварительно заданной длины выборки из последовательности совокупностей единичных образов k-го уровня преобразуют в совокупности единичных образов k+1 уровня, каждую из которых связывают с соответствующей ей выборкой, обрабатывают дополнительно сформированные совокупности единичных образов на k+1 уровне аналогично обработке сигнала на k-м уровне и связывают их в пространстве и во времени через запоминание связей на элементах сети, используют эти связи для извлечения сигналов из памяти, обработанные совокупности единичных образов k+1 уровня преобразуют обратно в соответствующие им объединенные выборки последовательностей совокупностей единичных образов k-го уровня, используют эти выборки для формирования результатов обработки сигналов в сети.

| СПОСОБ ИНТЕЛЛЕКТУАЛЬНОЙ ОБРАБОТКИ ИНФОРМАЦИИ В НЕЙРОННОЙ СЕТИ | 2013 |

|

RU2514931C1 |

| СПОСОБ ИНТЕЛЛЕКТУАЛЬНОЙ ОБРАБОТКИ ИНФОРМАЦИИ В НЕЙРОННОЙ СЕТИ | 2011 |

|

RU2483356C1 |

| СПОСОБ И УСТРОЙСТВО ИНТЕЛЛЕКТУАЛЬНОЙ ОБРАБОТКИ ИНФОРМАЦИИ В НЕЙРОННОЙ СЕТИ | 2011 |

|

RU2446463C1 |

| СПОСОБ И УСТРОЙСТВО ИНТЕЛЛЕКТУАЛЬНОЙ ОБРАБОТКИ ИНФОРМАЦИИ В НЕЙРОННОЙ СЕТИ | 2009 |

|

RU2413304C1 |

| Колосоуборка | 1923 |

|

SU2009A1 |

| Способ и приспособление для нагревания хлебопекарных камер | 1923 |

|

SU2003A1 |

Авторы

Даты

2020-11-26—Публикация

2020-04-20—Подача