ОБЛАСТЬ ТЕХНИКИ

Настоящее техническое решение относится к вычислительной технике, а в частности к способам и системам распознавания лиц и эмоций на основе видеопотока и может быть использовано для мониторинга эмоционального состояния сотрудников в организациях.

УРОВЕНЬ ТЕХНИКИ

Наиболее близким аналогом является источник информации US 10,496,947 B1, опубликованный 03.12.2019 г., раскрывающий способ и систему распознавания эмоций для аналитики персонала. Способ включает в себя этапы приема видео потока, включающего последовательность изображений, обнаружения человека на одном или нескольких изображениях, определения опорных точек характерных черт человека, выравнивания сетки виртуального лица по отношению к человеку на одном или нескольких изображениях, основанного, по меньшей мере частично, на контрольных точках, динамического определения по последовательности изображений по крайней мере одной деформации сетки виртуального лица, определение того, что по крайней мере одна деформация относится по крайней мере к одной лицевой эмоции, выбранной из множества эталонных лицевых эмоций.

Предлагаемое решение отличается от известного из уровня техники решения тем, что не требует нахождения человека вблизи камеры для более точного распознавания эмоционального состояния сотрудника.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Технической задачей, на решение которой направлено заявленное решение, является разработка способа и системы распознавания эмоционального состояния сотрудников, охарактеризованных в независимых пунктах формулы изобретения. Дополнительные варианты реализации настоящего изобретения представлены в зависимых пунктах формулы изобретения.

Технический результат заключается в повышении точности распознавания эмоционального состояния сотрудников. Дополнительным техническим результатом является увеличение производительности вычислительной системы при решении поставленной задачи (т.е. позволяет производить обработку с получением результата (продукта) за меньшее количество времени), тем самым снижая нагрузку на центральный процессор вычислительного устройства, за счет уменьшения количества обрабатываемых запросов.

Заявленный технический результат достигается за счет работы компьютерно-реализуемого способа распознавания эмоционального состояния сотрудников, выполняющийся на вычислительном устройстве, который содержит процессор и память, хранящую инструкции, исполняемые процессором и включающие следующие этапы:

на вычислительное устройство, в подсистему распознавания, передают по меньшей мере один кадр из видеопотока с по меньшей мере одной видеокамеры;

осуществляют распознавание по меньшей мере одного лица на кадрах, полученных из видеопотока, посредством модуля распознавания лиц подсистемы распознавания, применяя линейный классификатор, работающий на основе входных извлеченных признаков кадра;

осуществляют классификацию эмоций по меньшей мере одного лица, распознанного на предыдущем этапе, посредством модуля классификации эмоций подсистемы распознавания, используя первую нейронную сеть;

осуществляют сопоставление изображения лица, распознанного с помощью модуля распознавания, с базой данных сотрудников, посредством модуля идентификации подсистемы распознавания, на основе дескрипторов, вычисляемых с помощью второй нейронной сети и передают полученные данные на сервер;

посредством сервера осуществляют определение коэффициента эмоционального состояния сотрудников путем подсчета агрегированных по установленным интервалам времени метрикам эмоций сотрудников, распознанных с помощью модуля классификации эмоций, и показателей работы сотрудников, и передают полученные данные на клиентский сервер;

посредством клиентского сервера выводят полученный коэффициент эмоционального состояния сотрудников на информационный медиа-экран.

В частном варианте реализации предлагаемого способа, входные извлеченные признаки кадра представляют собой дескриптор области кадра размером 80×80, вычисленный по методу гистограмм ориентированных градиентов (HOG).

В другом частном варианте реализации предлагаемого способа, эмоциональное состояние сотрудника определяется как положительное или нейтральное.

В другом частном варианте реализации предлагаемого способа, положительное эмоциональное состояние сотрудника распознается, когда сотрудник в кадре улыбается.

В другом частном варианте реализации предлагаемого способа, при классификации эмоций по меньше мере одного лица, при работе первой нейронной сети осуществляют разделение операции свертки на свертку по ширине и по глубине.

В другом частном варианте реализации предлагаемого способа, в качестве меры схожести при сопоставлении распознанного лица с базой данных сотрудников используют евклидово расстояние межу дескрипторами изображений лиц.

Заявленный технический результат также достигается за счет осуществления системы распознавания эмоционального состояния сотрудников, содержащей:

по меньшей мере одну видеокамеру, выполненную с возможностью записи видеопотока и передачи по меньшей мере одного кадра из видеопотока на вычислительное устройство;

подсистему распознавания, включающую:

модуль распознавания лиц, выполненный с возможностью распознавания по меньшей мере одного лица на кадрах, полученных из видеопотока, и передачи распознанного лица в модуль классификации эмоций и в модуль идентификации,

модуль классификации эмоций, выполненный с возможностью классификации эмоций по меньшей мере одного лица, распознанного на кадре, на предыдущем этапе,

модуль идентификации, выполненный с возможностью сопоставления изображения лица, распознанного с помощью модуля распознавания лиц, с базой данных сотрудников;

базу данных;

сервер, выполненный с возможностью записи результатов классификации эмоций по меньшей мере одного распознанного лица в базу данных, определения коэффициента эмоционального состояния сотрудников и передачи коэффициента эмоционального состояния сотрудников на клиентский сервер;

клиентский сервер, выполненный с возможностью передачи коэффициента эмоционального состояния сотрудников на информационный медиа-экран;

информационный медиа-экран, выполненный с возможностью отображения коэффициента эмоционального состояния сотрудников.

ОПИСАНИЕ ЧЕРТЕЖЕЙ

Реализация изобретения будет описана в дальнейшем в соответствии с прилагаемыми чертежами, которые представлены для пояснения сути изобретения и никоим образом не ограничивают область изобретения. К заявке прилагаются следующие чертежи:

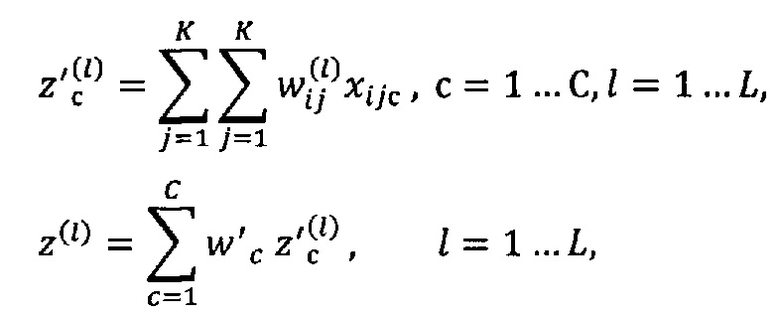

Фиг. 1 иллюстрирует блок-схему работы предлагаемого компьютерно-реализуемого способа распознавания эмоционального состояния сотрудников.

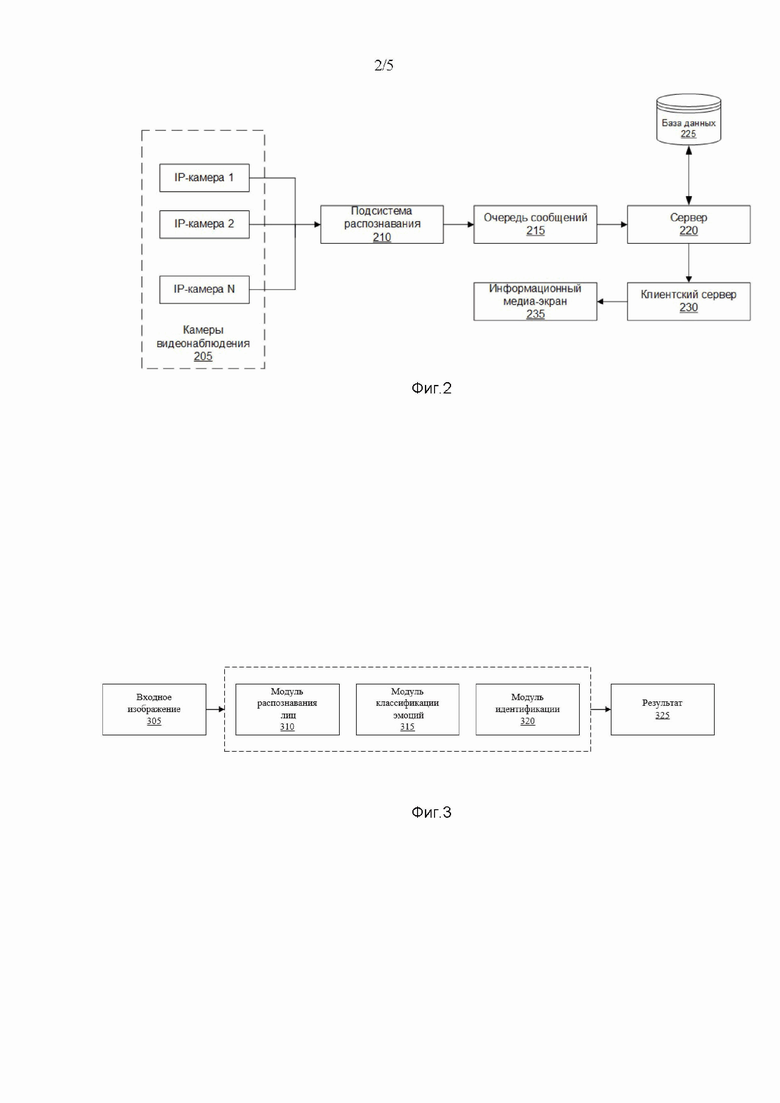

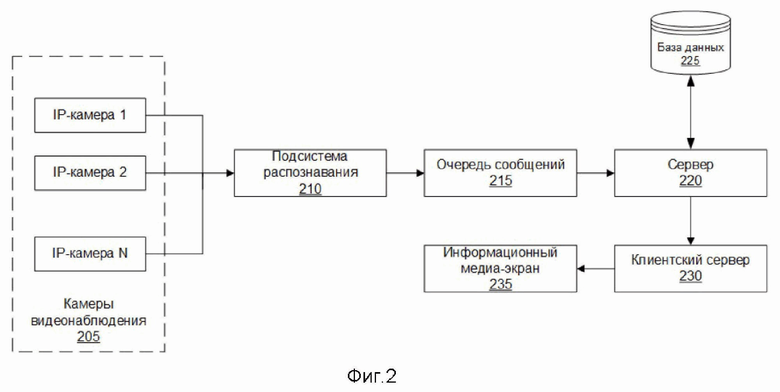

Фиг. 2 иллюстрирует архитектурную схему варианта реализации системы распознавания эмоционального состояния сотрудников.

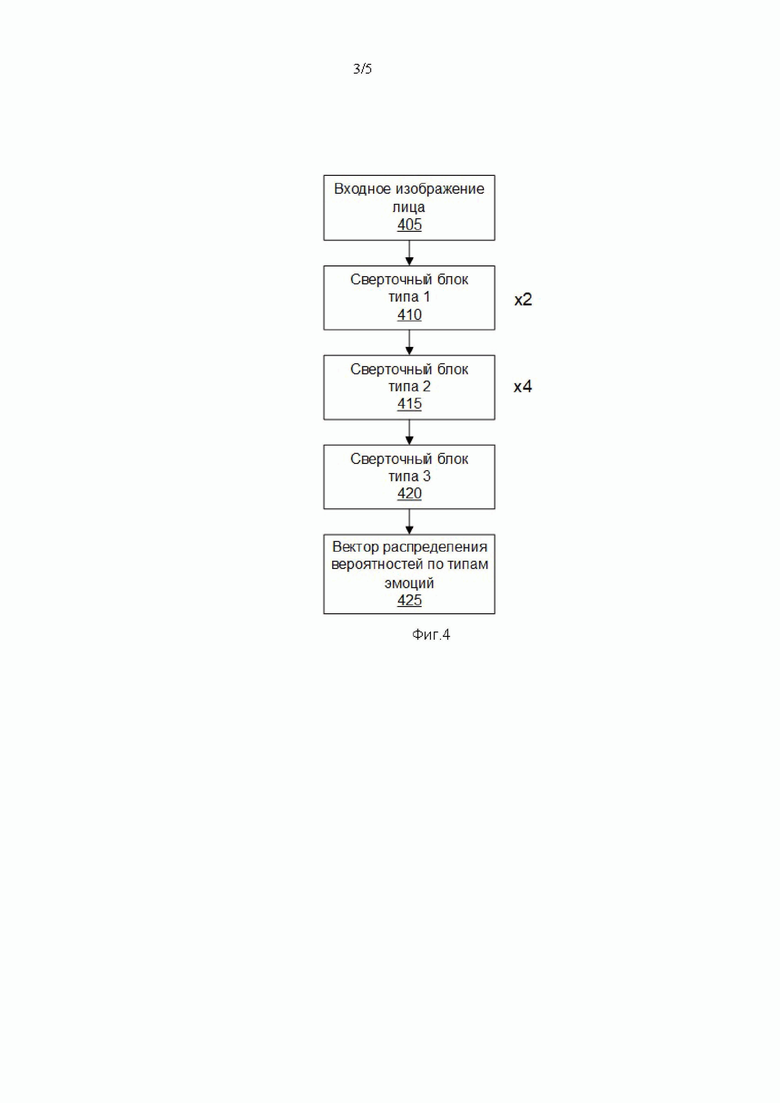

Фиг. 3 иллюстрирует архитектурную схему варианта реализации подсистемы распознавания.

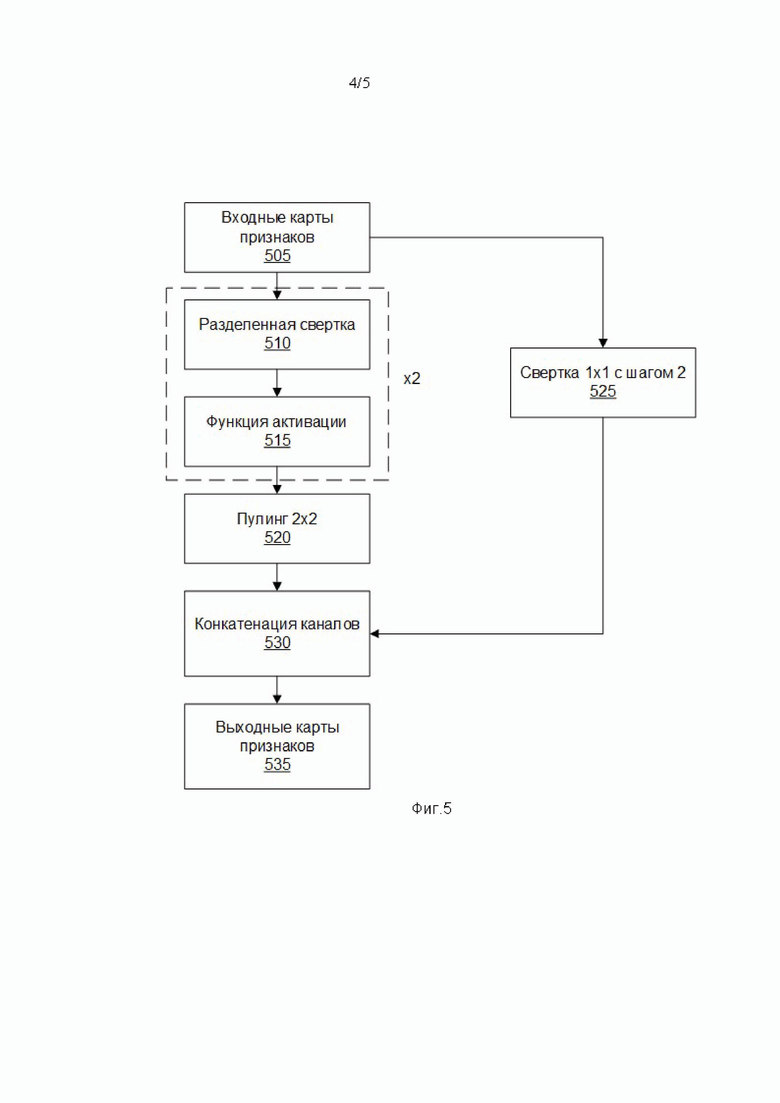

Фиг. 4 иллюстрирует блок-схему операций нейронной сети для классификации типа эмоций.

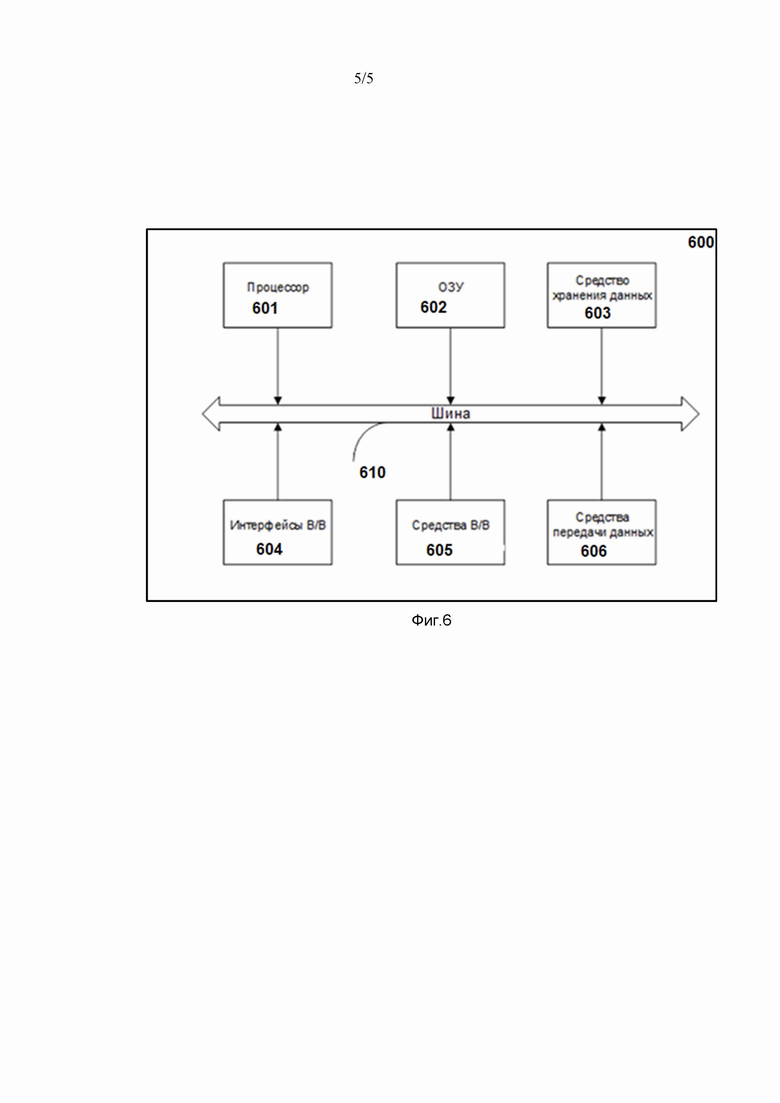

Фиг. 5 иллюстрирует блок-схему сверточного блока типа 2 нейронной сети для классификации типа эмоций.

Фиг. 6, иллюстрирует схему работы вычислительного устройства.

ДЕТАЛЬНОЕ ОПИСАНИЕ ИЗОБРЕТЕНИЯ

В приведенном ниже подробном описании реализации изобретения приведены многочисленные детали реализации, призванные обеспечить отчетливое понимание настоящего изобретения. Однако, квалифицированному в предметной области специалисту, будет очевидно каким образом можно использовать настоящее изобретение, как с данными деталями реализации, так и без них. В других случаях хорошо известные методы, процедуры и компоненты не были описаны подробно, чтобы не затруднять излишне понимание особенностей настоящего изобретения.

Кроме того, из приведенного изложения будет ясно, что изобретение не ограничивается приведенной реализацией. Многочисленные возможные модификации, изменения, вариации и замены, сохраняющие суть и форму настоящего изобретения, будут очевидными для квалифицированных в предметной области специалистов.

Нижеуказанные термины и определения применяются в данной заявке, если иное явно не указано. Ссылки на методики, используемые при описании данного изобретения, относятся к хорошо известным методам, включая изменения этих методов и замену их эквивалентными методами, известными специалистам в данной области техники.

На Фиг. 1 проиллюстрирована блок-схема работы предлагаемого компьютерно-реализуемого способа распознавания эмоционального состояния сотрудников.

С по меньшей мере одной камеры видеонаблюдения, на вычислительное устройство, поступает видеопоток, посредством средств сетевого взаимодействия. Рекомендуемое качество изображений не ниже 720р (размер кадра 1280×720 пикселей). Кадровая частота может составлять 20 кадров в секунды и выше, в зависимости от вычислительных возможностей аппаратного обеспечения для обработки данных.

Из полученного видеопотока получают по меньшей мере один текущий кадр с камеры видеонаблюдения в форме цветного изображения в формате RGB (этап 105) и передают текущий кадр в подсистему распознавания (210).

На этапе 110 осуществляют распознавание по меньшей мере одного лица на кадрах, полученных из видеопотока, посредством модуля распознавания лиц (310) подсистемы распознавания (210), применяя линейный классификатор, работающий на основе входных извлеченных признаков кадра.

Распознавание по меньшей мере одного лица заключается в выделении прямоугольных областей изображения минимального размера на кадрах, содержащих полностью лицо человека. Распознавание по меньшей мере одного лица осуществляется с применением линейного классификатора опорных векторов (SVM) обученного на размеченном наборе примеров, а именно осуществляют применение ко входному изображению скользящего окна. Входной информацией для модели классификатора являются, вычисленные на основе изображения, вектора числовых признаков. В одном варианте реализации для вычисления числовых признаков применяется метод гистограмм ориентированных градиентов (HOG), содержащий следующие шаги.

1. Полученное цветное изображение кадра преобразуют в изображение в оттенках серого, посредством известных методов.

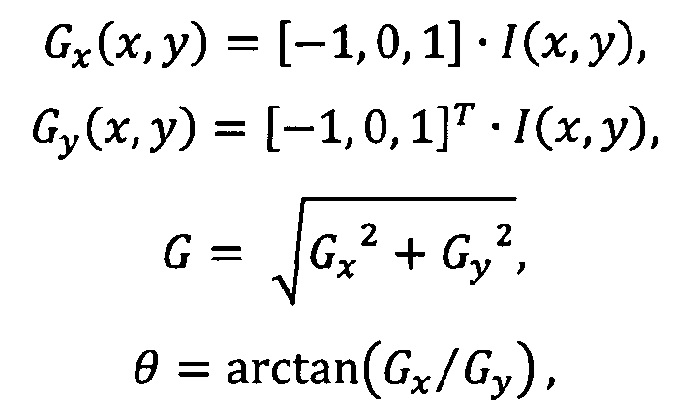

2. Вычисляют горизонтальные и вертикальные градиенты по формулам

где I(x,y) - значение интенсивности пикселя изображения с координатами х, у, G - длина вектора градиента, θ - угол направления вектора.

3. Окно изображения размером 80×80 пикселей делится на ячейки величиной 8×8 пикселей.

4. Для каждой ячейки вычисляется гистограмма из 9-ти элементов. Элементы гистограммы обозначают углы направления векторов градиента с шагом  Длины векторов градиента, сгруппированные по направлению, суммируются.

Длины векторов градиента, сгруппированные по направлению, суммируются.

5. Выполняется конкатенация гистограмм в блоках соседних ячеек размером 2×2. Полученный для каждого блока вектор, размером 36 элементов, нормализуется: выполняется операция деления элементов вектора на норму вектора.

6. Выполняется конкатенация векторов по всем блокам окна. Полученный таким образом результирующий вектор является дескриптором - вектором признаков, описывающим фрагмент изображения кадра.

Дескриптор подается на вход линейного классификатора SVM, на выходе получается вероятность нахождения лица человека в рассматриваемом окне, а именно: бинарный признак наличия лица на изображении.

7. Шаги 3-7 повторяются для следующего окна, полученного сдвигом на 1 пиксель по горизонтали и вертикали.

8. В качестве областей, содержащих лица, выбираются окна с вероятностью, превышающей экспериментально подобранное пороговое значение.

В одном варианте реализации для обучения линейного классификатора SVM используются примеры из датасета LFW, описанного в статье Huang G. Labeled Faces in the Wild: A Database for Studying Face Recognition in Unconstrained Environments, 2008.

Кроме того, может использоваться одна из открытых реализаций алгоритма распознавания лиц, например, из библиотеки Dlib, описанной в статье King D. Dlib-ml: A Machine Learning Toolkit. Journal of Machine Learning Research 10 (2009).

Обучающие примеры представляют собой пары: дескриптор области изображения размером 80×80, вычисленный по методу HOG и бинарный признак наличия лица.

Полученный результат модуля распознавания лица передают в модуль классификации эмоций, посредством средств сетевого взаимодействия.

После того как на кадре было распознано по меньшей мере одно лицо, на этапе 115, осуществляют классификацию эмоций по меньшей мере одного лица, распознанного посредством модуля классификации эмоций (315) подсистемы распознавания (210), используя первую сверточную нейронную сеть.

Выделяются два типа эмоционального состояния: положительное, в случае, когда человек в кадре улыбается, и нейтральное в противном случае. Определение улыбки человека в кадре, как уже было описано выше, осуществляется посредством использования первой нейронной сети, которая определяет на изображении лица расположение ключевых точек в области глаз, щек, губ и движения лицевых мышц. Когда человек улыбается, данный процесс сопровождается характерной мимикой лица: уголки губ поднимаются и вместе с этим поднимаются щеки, смещаются точки вокруг глаз. При определении эмоции, нейронная сеть анализирует область лица на изображении на выявление вышеуказанных признаков, а именно, но не ограничиваясь: высота уголков губ, подъем щек, сужение глаз.

Для классификации эмоций по меньшей мере одного распознанного лица, в кадре видеопотока, применяется первая нейронная сеть сверточного типа. В целях сокращения количества обучаемых параметров модели для снижения требований к объему обучающей выборки и ускорения работы сети в режиме эксплуатации, при выборе архитектуры модели может применяться подход с разделением операции свертки на свертку по ширине и глубине, например, аналогичный описанному в статье Chollet F. Xception: Deep Learning with Depthwise Separable Convolutions. 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR) (2017).

Классификация типа эмоционального состояния человека по изображению лица с помощью первой нейронной сети сверточного типа включает следующие шаги:

1. Преобразование цветного RGB изображения кадра в изображение в оттенках серого, посредством известных методов.

2. Масштабирование изображения к целевому размеру 64×64.

3. Нормализация изображения с математическим ожиданием и среднеквадратичным отклонением, подсчитанным для обучающей выборки.

4. Выполнение преобразования нормализованного одноканального изображения размером 64×64 первой сверточной нейронной сетью.

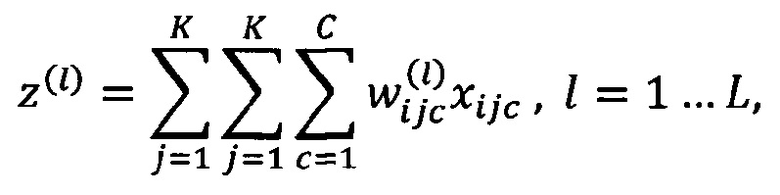

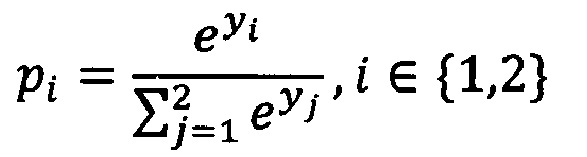

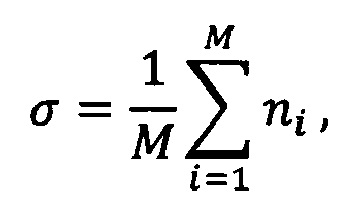

Схема осуществляемых операций для одного варианта реализации показана на Фиг. 4. Первая сверточная нейронная сеть получает на вход одноканальное изображение лица (405). К изображению, последовательно, применяются сверточные блоки (410), (415), (420). Сверточный блок типа 1 применяется два раза и состоит из 8-ми сверточных фильтров размера 3×3 пикселя, применяемых ко входным каналам карт признаков с шагом в 1 пиксель. Операция свертки описывается формулой:

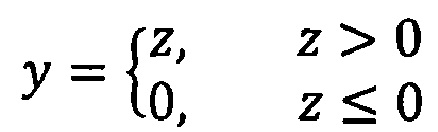

где K - размер фильтра, С - количество входных каналов признаков, L - количество выходных каналов, xijc - значения признака в позиции (i, j) в канале с,  - вес фильтра I в позиции (i, j) для канала с. К выходным значениям признаков применяется функция активации вида

- вес фильтра I в позиции (i, j) для канала с. К выходным значениям признаков применяется функция активации вида

Сверточный блок типа 2 применяется 4 раза с различным числом фильтров. В одном варианте реализации используется 16, 32, 64, 128 фильтров, однако специалисту должно быть ясно, что могут использоваться и другие фильтры.

Схема сверточного блока типа 2 для одного варианта реализации показана на Фиг. 5. Ко входным картам признаков параллельно применяется 2 типа преобразований.

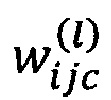

Преобразование типа 1 включается в себя последовательное двукратное применение Р фильтров (где Р - архитектурный параметр блока) разделенной свертки (510) и функции активации (515), которая была описана выше, применение пулинга (520) для областей размером 2×2 с шагом 2 пикселя. Разделенная операция свертки представляет собой последовательное применение свертки с размером фильтра 3×3 для каждого канала и свертки с размером фильтра 1×1 между каналами:

где  веса I-го плоского фильтра, w'c - веса фильтра свертки каналов 1×1. Пулинг выполняется как замена области 2×2 пикселя на максимальное значение в этой области. В результате применения операции пулинга с шагом 2 размер карты признаков уменьшается в 2 раза. Преобразование типа 2 представляет собой применение свертки с Р фильтрами размера 1×1 с шагом 2 пикселя (525), полученные в результате карты признаков имеют вдвое меньший размер относительно исходных. Выполняется конкатенация каналов (530) для карт признаков, полученных в результате применения преобразований типа 1 и 2. Результирующие карты признаков (535) содержат 2Р каналов.

веса I-го плоского фильтра, w'c - веса фильтра свертки каналов 1×1. Пулинг выполняется как замена области 2×2 пикселя на максимальное значение в этой области. В результате применения операции пулинга с шагом 2 размер карты признаков уменьшается в 2 раза. Преобразование типа 2 представляет собой применение свертки с Р фильтрами размера 1×1 с шагом 2 пикселя (525), полученные в результате карты признаков имеют вдвое меньший размер относительно исходных. Выполняется конкатенация каналов (530) для карт признаков, полученных в результате применения преобразований типа 1 и 2. Результирующие карты признаков (535) содержат 2Р каналов.

Сверточный блок типа 3 применяется однократно и представляет собой выполнение операций свертки с 2-мя фильтрами размера 3×3, пулинга с выбором среднего значения в каждой из карт признаков, применение функции

для получения элементов pi вектора распределения вероятностей типа эмоционального состояния (425). Веса всех фильтров свертки являются обучаемыми параметрами модели и подбираются с применением алгоритмов стохастического градиентного спуска и обратного распространения ошибки с минимизацией функции потерь типа перекрестной энтропии.

5. В качестве результата алгоритма выбирается наиболее вероятный тип эмоционального состояния, на основе полученного на шаге 4 вектора распределения вероятностей. Данный результат представлен как коэффициент распознавания эмоций - бинарный признак положительной эмоции или нейтральной эмоции.

Например, для распознанного лица получили вектор распределения вероятностей по типам эмоционального состояния с элементами 0.8 и 0.2. Принимается положительное эмоциональное состояние: бинарный признак положительной эмоции устанавливается в значение 1. Коэффициент уверенности распознавания эмоции принимается равным наибольшей вероятности 0.8.

На шаге 120 осуществляют сопоставление изображения лица, распознанного с помощью модуля распознавания (310) подсистемы распознавания (210), с базой данных сотрудников (225), посредством модуля идентификации (320) подсистемы распознавания (210), на основе дескрипторов, вычисляемых с помощью второй нейронной сети.

Результатом сопоставления изображения распознанного лица и изображения из базы данных сотрудников является получение коэффициента идентификации сотрудника, для уверенности того, что сотрудник распознан корректно. Данный коэффициент представлен в качестве бинарного признака.

Для сопоставления могут применяться дескрипторы - представление изображения в виде вектора вещественных чисел признаков. Для вычисления дескриптора размером 128 элементов в качестве кодировщика применяется вторая нейронная сеть сверточного типа, обученная на открытом наборе примеров фотографий известных людей. В одном варианте реализации используется архитектура нейронной сети ResNet, описанная в статье Kaiming Не et al. Deep Residual Learning for Image Recognition. 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 2016.

В качестве меры схожести при сравнении изображений распознанных лиц, с помощью модуля распознавания лиц (310) подсистемы распознавания (210) и лиц, находящихся в базе данных сотрудников (225) используется евклидово расстояние межу дескрипторами изображений распознанных лиц и лиц, находящихся в базе данных сотрудников (225). Наименьшее из вычисленных расстояний, между входным объектом (распознанным лицом) и изображениями лиц, находящимися в базе данных сотрудников (225), сравнивается с заданным, в качестве параметра, пороговым значением. В случае, когда наименьшее расстояние не превышает пороговое значение, текущее изображение распознанного лица принимается идентифицированным по базе изображений сотрудников, в противном случае лицо считается не идентифицированным.

В нижеуказанном примере, пороговое значение устанавливается как расстояние между дескрипторами равным 0,6, однако специалисту должно быть понятно, что данный порог может быть изменен в большую или меньшую сторону. В базе данных сотрудников содержится 2 изображения сотрудника, для одного изображения распознанного лица получили расстояния между дескрипторами 0.2 и 0.5, наименьшее расстояние 0.2 (до изображения сотрудника 1) не превышает порог 0.6, в этом случае принимается, что изображение распознанного лица соответствует изображению сотрудника 1.

Для другого изображения распознанного лица получили расстояния 0.9 и 0.7, наименьшее расстояние 0.7 (по отношению к изображению сотрудника 2) выше порога 0.6, поэтому распознанное лицо считается не идентифицированным: не удалось подобрать достаточно похожий пример в базе данных сотрудников.

Полученные результаты в определенном формате передается на сервер. Полученные результаты передаются в виде текстового сообщения, содержащего структуру данных со следующими полями: идентификатор сообщения, идентификатор камеры, отметка времени, количество распознанных лиц, количество положительных эмоций, а также поле «подробности по сотрудникам». Поле «подробности по сотрудникам» представляет собой массив структур с полями: идентификатор сотрудника, бинарный признак положительной эмоции, коэффициент идентификации сотрудника, коэффициент распознавания эмоций.

Результат, в виде текстового сообщения, передается по сети, посредством средств сетевого взаимодействия, на сервер, в виде текста в формате JSON. Могут также применяться другие текстовые форматы, например, XML, или бинарное представление данных с целью сжатия.

Передача данных осуществляется в синхронном режиме по протоколу HTTP или асинхронно с помощью сервера очередей сообщений, который может использовать протоколы, но не ограничиваясь, AMQP, Kafka, OpenWire, STOMP, MQTT.

На шаге 125, посредством сервера (220), осуществляют определение коэффициента эмоционального состояния сотрудников путем подсчета агрегированных по установленным интервалам времени метрикам эмоций сотрудников, распознанных с помощью модуля классификации эмоций (315) подсистемы распознавания (210), и показателей работы сотрудников, и передают полученные данные на клиентский сервер (230).

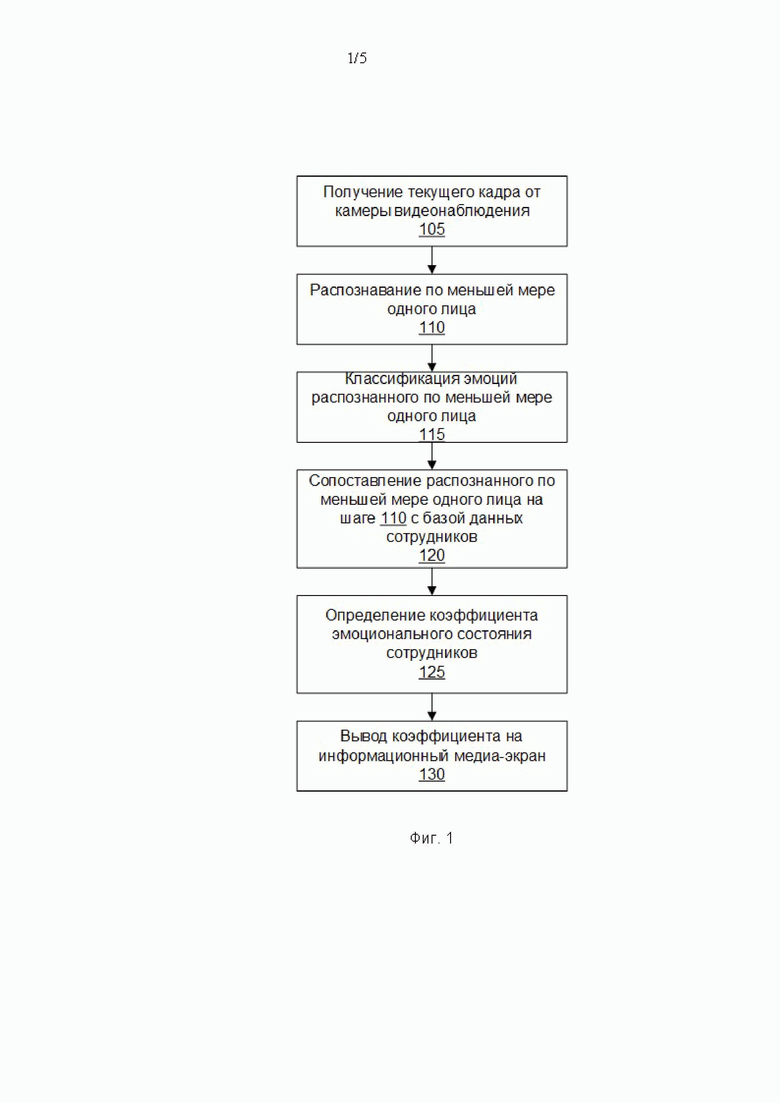

Показателем работы сотрудников является рабочая активность в течение рабочего дня. Показатель рабочей активности определяется как количество людей, проходящих в области обзора камеры за минуту при осреднении за последний час.

Положительный уровень эмоционального состояния сотрудников вычисляется как отношение выявленных случаев положительных эмоций к общему количеству выделенных в видеопотоке лиц людей за последний час. Например, за интервал времени T=1 час было получено N=100 наблюдений из них в Р=20 случаях классифицирован положительный тип эмоций, уровень положительного эмоционального состояния за интервал времени T вычисляется как r=P/N=20%. В одном варианте реализации метрика рабочей активности сотрудников определяется как результат осреднения числа наблюдений ni за интервалы времени ti в течение периода времени Т

где М число интервалов, на которые разбивается период времени Т. Например может выполняться осреднение числа наблюдений по минутам в течение часа.

Посредством клиентского сервера (230) выводят полученный коэффициент эмоционального состояния сотрудников на информационный медиа-экран (235) посредством средств сетевого взаимодействия.

Вышеописанный способ выполняется за счет осуществления системы распознавания эмоционального состояния сотрудников, представленной на Фиг. 2, которая включает: по меньшей мере одну видеокамеру (205); подсистему распознавания (210), содержащую модуль распознавания лиц (310), модуль классификации эмоций (315), модуль идентификации (320); базу данных (225); сервер (220); клиентский сервер (230); информационный медиа-экран (235).

Подсистема распознавания (210) включает:

модуль распознавания лиц (310), выполненный с возможностью распознавания по меньшей мере одного лица на кадрах, полученных из видеопотока, и передачи распознанного лица в модуль классификации эмоций и в модуль идентификации;

модуль классификации эмоций (315), выполненный с возможностью классификации эмоций по меньшей мере одного лица, распознанного на кадре, на предыдущем этапе;

модуль идентификации (320), выполненный с возможностью сопоставления изображения лица, распознанного с помощью модуля распознавания лиц, с базой данных сотрудников.

База данных (225) является средством хранения данных распознавания, а также содержит данные, которые используются для сопоставления изображения лица, распознанного с помощью модуля распознавания подсистемы распознавания, с изображениями сотрудников.

Сервер (220), выполненный с возможностью записи результатов классификации эмоций по меньшей мере одного распознанного лица в базу данных, а также определения коэффициента эмоционального состояния сотрудников и передачи коэффициента эмоционального состояния сотрудников на клиентский сервер по протоколу HTTP.

Клиентский сервер (230), выполненный с возможностью передачи коэффициента эмоционального состояния сотрудников на информационный медиа-экран.

Информационный медиа-экран (235), выполненный с возможностью отображения коэффициента эмоционального состояния сотрудников. Информационный медиа-экран представляет собой экран, на котором отображается общее количество наблюдений (лиц), доля положительных эмоций от общего числа наблюдений, уровень рабочей активности за последний час, который отображается в виде температуры в диапазоне 0-30 градусов, уровень положительного эмоционального состояния за последний час, который отображается в форме облачности с тремя градациями: солнечно (высокий уровень положительных эмоций), преимущественно облачно (средний уровень), грозовой фронт (низкий уровень), а также изменение уровня рабочей активности по часам в течение дня.

На Фиг. 6 далее будет представлена общая схема вычислительного устройства (600), обеспечивающего обработку данных, необходимую для реализации заявленного решения.

В общем случае устройство (600) содержит такие компоненты, как: один или более процессоров (601), по меньшей мере одну память (602), средство хранения данных (603), интерфейсы ввода/вывода (604), средство В/В (605), средства сетевого взаимодействия (606).

Процессор (601) устройства выполняет основные вычислительные операции, необходимые для функционирования устройства (600) или функциональности одного или более его компонентов. Процессор (601) исполняет необходимые машиночитаемые команды, содержащиеся в оперативной памяти (602).

Память (602), как правило, выполнена в виде ОЗУ и содержит необходимую программную логику, обеспечивающую требуемый функционал.

Средство хранения данных (603) может выполняться в виде HDD, SSD дисков, рейд массива, сетевого хранилища, флэш-памяти, оптических накопителей информации (CD, DVD, MD, Blue-Ray дисков) и т.п. Средство (603) позволяет выполнять долгосрочное хранение различного вида информации, например, вышеупомянутых файлов с наборами данных пользователей, базы данных, содержащих записи измеренных для каждого пользователя временных интервалов, идентификаторов пользователей и т.п.

Интерфейсы (604) представляют собой стандартные средства для подключения и работы с серверной частью, например, USB, RS232, RJ45, LPT, COM, HDMI, PS/2, Lightning, FireWire и т.п.

Выбор интерфейсов (604) зависит от конкретного исполнения устройства (600), которое может представлять собой персональный компьютер, мейнфрейм, серверный кластер, тонкий клиент, смартфон, ноутбук и т.п.

В качестве средств В/В данных (605) в любом воплощении системы, реализующей описываемый способ, может использоваться клавиатура. Аппаратное исполнение клавиатуры может быть любым известным: это может быть, как встроенная клавиатура, используемая на ноутбуке или нетбуке, так и обособленное устройство, подключенное к настольному компьютеру, серверу или иному компьютерному устройству. Подключение при этом может быть, как проводным, при котором соединительный кабель клавиатуры подключен к порту PS/2 или USB, расположенному на системном блоке настольного компьютера, так и беспроводным, при котором клавиатура осуществляет обмен данными по каналу беспроводной связи, например, радиоканалу, с базовой станцией, которая, в свою очередь, непосредственно подключена к системному блоку, например, к одному из USB-портов. Помимо клавиатуры, в составе средств В/В данных также может использоваться: джойстик, дисплей (сенсорный дисплей), проектор, тачпад, манипулятор мышь, трекбол, световое перо, динамики, микрофон и т.п.

Средства сетевого взаимодействия (606) выбираются из устройства, обеспечивающий сетевой прием и передачу данных, например, Ethernet карту, WLAN/Wi-Fi модуль, Bluetooth модуль, BLE модуль, NFC модуль, IrDa, RFID модуль, GSM модем и т.п. С помощью средств (605) обеспечивается организация обмена данными по проводному или беспроводному каналу передачи данных, например, WAN, PAN, ЛВС (LAN), Интранет, Интернет, WLAN, WMAN или GSM.

Компоненты устройства (600) сопряжены посредством общей шины передачи данных (610).

В настоящих материалах заявки было представлено предпочтительное раскрытие осуществление заявленного технического решения, которое не должно использоваться как ограничивающее иные, частные воплощения его реализации, которые не выходят за рамки испрашиваемого объема правовой охраны и являются очевидными для специалистов в соответствующей области техники.

Изобретение относится к области вычислительной техники, в частности, к способам и системам распознавания лиц и эмоций на основе видеопотока, и может быть использовано для мониторинга эмоционального состояния сотрудников в организациях. Техническим результатом является повышение точности распознавания эмоционального состояния сотрудников. Технический результат заявляемого технического решения достигается тем, что осуществляют распознавание лица на кадрах, полученных из видеопотока, осуществляют классификацию эмоций, используя первую нейронную сеть; осуществляют сопоставление изображения лица с базой данных сотрудников, для получения коэффициента идентификации сотрудника на основе дескрипторов, определяют коэффициент эмоционального состояния сотрудников путем подсчета агрегированных эмоций сотрудников и показателей работы сотрудников, выводят полученный коэффициент эмоционального состояния сотрудников на информационный медиа-экран. 2 н. и 5 з.п. ф-лы, 6 ил.

1. Компьютерно-реализуемый способ распознавания эмоционального состояния сотрудников, включающий следующие этапы:

на вычислительное устройство, в подсистему распознавания передают по меньшей мере один кадр из видеопотока с по меньшей мере одной камеры видеонаблюдения;

осуществляют распознавание по меньшей мере одного лица на кадрах, полученных из видеопотока, посредством модуля распознавания лиц, применяя линейный классификатор, работающий на основе входных извлеченных признаков кадра;

осуществляют классификацию эмоций по меньшей мере одного лица, распознанного на предыдущем этапе, посредством модуля классификации эмоций, используя первую нейронную сеть;

осуществляют сопоставление изображения лица, распознанного с помощью модуля распознавания, с базой данных сотрудников, для получения коэффициента идентификации сотрудника, посредством модуля идентификации, на основе дескрипторов, вычисляемых с помощью второй нейронной сети, и передают полученные результаты на сервер;

посредством сервера осуществляют определение коэффициента эмоционального состояния сотрудников путем подсчета агрегированных, по установленным интервалам времени метрикам, эмоций сотрудников, распознанных с помощью модуля классификации эмоций, и показателей работы сотрудников и передают полученные данные на клиентский сервер;

посредством клиентского сервера выводят полученный коэффициент эмоционального состояния сотрудников на информационный медиа-экран.

2. Способ по п. 1, отличающийся тем, что входные извлеченные признаки кадра представляют собой дескриптор области кадра размером 80×80, вычисленный по методу гистограмм ориентированных градиентов (HOG).

3. Способ по п. 1, отличающийся тем, что эмоциональное состояние сотрудника определяется как положительное или нейтральное.

4. Способ по п. 3, отличающийся тем, что положительное эмоциональное состояние сотрудника распознается, когда сотрудник в кадре улыбается.

5. Способ по п. 1, отличающийся тем, что при классификации эмоций по меньшей мере одного лица, при работе первой нейронной сети осуществляют разделение операции свертки на свертку по ширине и по глубине.

6. Способ по п. 1, отличающийся тем, что в качестве меры схожести при сопоставлении распознанного лица с базой данных сотрудников используют евклидово расстояние межу дескрипторами изображений лиц.

7. Система распознавания эмоционального состояния сотрудников, содержащая:

по меньшей мере одну камеру видеонаблюдения, выполненную с возможностью записи видеопотока и передачи по меньшей мере одного кадра из видеопотока на вычислительное устройство в подсистему распознавания;

подсистему распознавания, включающую:

- модуль распознавания лиц, выполненный с возможностью распознавания по меньшей мере одного лица на кадрах, полученных из видеопотока, и передачи распознанного лица в модуль классификации эмоций и в модуль идентификации,

- модуль классификации эмоций, выполненный с возможностью классификации эмоций по меньшей мере одного лица, распознанного на кадре, на предыдущем этапе,

- модуль идентификации, выполненный с возможностью сопоставления изображения лица, распознанного с помощью модуля распознавания лиц, с базой данных сотрудников, для получения коэффициента идентификации сотрудника;

базу данных;

сервер, выполненный с возможностью записи результатов распознавания в базу данных, определения коэффициента эмоционального состояния сотрудников и передачи коэффициента эмоционального состояния сотрудников на клиентский сервер;

клиентский сервер, выполненный с возможностью передачи коэффициента эмоционального состояния сотрудников на информационный медиа-экран;

информационный медиа-экран, выполненный с возможностью отображения коэффициента эмоционального состояния сотрудников.

| Устройство для закрепления лыж на раме мотоциклов и велосипедов взамен переднего колеса | 1924 |

|

SU2015A1 |

| US 20180278988 A1, 27.09.2018 | |||

| ANTON ERICSON: "Object Recognition Using Digitally Generated Images as Training Data", April 2013, [найдено: 01.10.2021] | |||

| Аппарат для очищения воды при помощи химических реактивов | 1917 |

|

SU2A1 |

| ANBANG YAO et al: "HoloNet: Towards Robust Emotion Recognition in the Wild", 2016 | |||

Авторы

Даты

2022-03-24—Публикация

2021-07-19—Подача