Ссылки на родственные заявки

Данная заявка испрашивает на приоритет находящейся одновременно на рассмотрении временной заявки на патент США №60/296189, поданной 5 июня 2001 с названием "Интерактивная видеодисплейная система, которая использует видеовход", полное содержание которой включается в данное описание для всех целей.

Область техники, к которой относится изобретение

Данное изобретение относится в целом к системам обработки изображения и, в частности, к системе для приема и обработки изображения человека-пользователя для обеспечения взаимодействия с видеодисплеем.

Обработку изображения используют во многих областях анализа, образования, торговли и развлечений. Один аспект обработки изображения включает взаимодействие человек-компьютер посредством обнаружения форм и движений человека для обеспечения взаимодействия с изображениями. Прикладные программы такой обработки могут использовать эффективные или занимательные пути взаимодействия с изображениями для задания цифровых форм или других данных, анимации объектов, создания выразительных форм и т.д.

Обнаружение положения и движения человеческого тела называют "захватом движения". С помощью технологии захвата движения подают математические описания движений человека на вход компьютера или другой обрабатывающей системы. Естественные движения человека можно использовать в качестве входных сигналов компьютера для изучения атлетического движения, сбора данных для последующего воспроизведения или моделирования, углубленного анализа для медицинских целей и т.д.

Хотя захват движения обеспечивает преимущества и недостатки, технология захвата движения имеет тенденцию к сложности. Некоторые технологии требуют от актера ношение специальных костюмов с сильно заметными точками в нескольких местах. В других подходах используют радиочастотные или другие типы излучателей, множество датчиков и детекторов, голубые фильтры, сложную последующую обработку и т.д. Технологии, которые основаны на простом изображении в видимом свете, обычно являются недостаточно точными для обеспечения хорошо заданного и точного захвата движения.

Некоторые прикладные программы захвата движения позволяют актеру, или пользователю, взаимодействовать с изображениями, которые создаются и отображаются компьютерной системой. Например, актер может перемещать, или по-другому создавать, модифицировать и манипулировать объектами с использованием движений тела. Различные эффекты, основанные на движениях актера, можно вычислять с помощью компьютерной системы и отображать на экране дисплея. Например, компьютерная система может отслеживать путь актера перед экраном дисплея и выдавать приближение или артистическую интерпретацию пути на экране дисплея. Изображения, с которыми актер может взаимодействовать, могут быть, например, на полу, на стене или на другой поверхности; подвешенными в трехмерном пространстве, отображенными на одном или нескольких мониторах, проекционных экранах или других устройствах. Можно использовать любой тип дисплейного устройства или технологию для представления изображений, которыми может управлять или с которыми может взаимодействовать пользователь.

В некоторых применениях, таких как торговая точка, реклама, организация продаж, диалоговые развлечения и т.д., желательно захватывать движения нетренированного пользователя (например, проходящего человека) очень незаметным образом. В идеальном случае пользователь не нуждается в специальной подготовке или тренировке, а система не использует неоправданно дорогое оборудование. Кроме того, система и способ, используемые для захвата движения актера, должны быть предпочтительно невидимыми или незаметными для пользователя. Многие реальные прикладные программы должны работать в условиях, где имеется сложный и изменяющийся фон и объекты переднего плана, короткие интервалы времени для захвата движения, изменяющиеся условия освещения и другие факторы, которые могут затруднять захват движения.

Сущность изобретения

Данное изобретение обеспечивает взаимодействие между пользователем и дисплейной системой компьютера, использующей движение и положение пользователя (или другого объекта) в качестве входного сигнала компьютера. Компьютер генерирует отображение, которое реагирует на положение и движение пользователя. Создаваемое изображение может содержать объекты или формы, которые можно перемещать, модифицировать или управлять ими с помощью движений тела пользователя.

В предпочтительном варианте выполнения изобретения на отображаемые изображения оказывают влияния действия пользователя в реальном времени. Отображение можно проецировать вокруг пользователя, так что действия пользователя создают эффекты, которые исходят от пользователя и воздействуют на зоны отображения вблизи пользователя. Или же пользователь может воздействовать на видеообъекты посредством ударов, толкания, перемещения, деформации элементов видеоизображений, прикосновения к ним и т.д. Помехи между светом, используемым для отображения интерактивных изображений, и светом, используемым для обнаружения пользователя, являются минимальными за счет использования света по существу с разными длинами волн.

В одном варианте выполнения пользователя освещают инфракрасным светом, который невидим для человеческого глаза. Для захвата изображения пользователя с целью анализа его положения и движения используют камеру, которая чувствительна к инфракрасному свету. Видимый свет проецируют с помощью проектора на экран, стекло или другую поверхность для отображения интерактивных изображений, объектов, узоров или других форм и эффектов. Поверхность дисплея может быть размещена вокруг пользователя, так что его физическое присутствие внутри дисплея соответствует его виртуальному присутствию, давая чувство физического прикосновения и взаимодействия с виртуальными объектами.

Согласно одному аспекту изобретения можно использовать узорчатое освещение вместо простого, невидимого, однородного "прожекторного света". С помощью узорчатого освещения проецируют рисунок, такой как шахматная доска, случайный точечный узор и т.д. Узор используют с помощью обработки, выполняемой компьютером, для интерпретации изображения камеры и для обнаружения объекта на заднем фоне и/или на фоне других элементов сцены. Узор можно генерировать в виде фона (так что он не падает на объект, подлежащий обнаружению) или же узор можно проецировать на всю видимую камере сцену, так что он освещает фон, передний план и объекты, подлежащие обнаружению и захвату движения.

Один путь обеспечения узорчатого освещения включает использование группы инфракрасных светоизлучающих диодов или другого источника невидимого света в проекторе слайдов. В другом подходе можно использовать инфракрасный лазерный луч, который отклоняют, закрывают, сканируют и т.д. для получения узора.

Другим путем обеспечения узорчатого освещения является использование обычного "прожекторного освещения", но с маркировкой указанного узора на видимой зоне камеры с использованием чернил, красителя или краски, которая является темной или сильно отражающей на частоте чувствительности камеры. Эти чернила, краситель или краска могут быть сделаны невидимыми для глаза человека для улучшения внешнего вида дисплея.

Согласно другому аспекту изобретения используют градиентный подход для определения взаимодействия объекта и изображения. "Изображение влияния" создают посредством создания градиентного ореола или серого перехода вокруг обнаруженного объекта. При движении обнаруженного объекта градиентный ореол вычисляют в реальном времени. При столкновении градиентного ореола с видеоизображением или элементом, вычисляют интенсивность и градиент в зоне элемента сталкивания. Сила и направление взаимодействия (например, толкания элемента) является функцией интенсивности и градиента соответственно зоны сталкивания.

Согласно одному варианту выполнения изобретения создана система для обнаружения объекта и генерирования в ответ изображения, при этом система содержит первый источник для выдачи электромагнитной энергии в первом диапазоне длин волн, детектор для обнаружения отражения электромагнитной энергии первого источника от объекта, процессор, соединенный с детектором для использования обнаруженного отражения для генерирования сигнала обнаружения, второй источник для выдачи электромагнитной энергии во втором диапазоне длин волн, при этом второй источник генерирует видимое отображение в ответ на сигнал отображения, причем первый и второй диапазоны длин волн являются различными.

Согласно другому варианту выполнения изобретения создан способ обнаружения объекта в изображении, захваченном камерой, при этом способ содержит использование узорчатого освещения для освещения фона отлично от объекта; и использование системы обработки для определения объекта отдельно от фона.

Согласно другому варианту выполнения изобретения создан способ вычисления взаимодействия объекта с видеоэлементом, при этом способ содержит процессор для определения градиента для объекта; использование процессора для определения границы видеоэлемента и идентификацию взаимодействия с использованием градиента и границы.

Краткое описание чертежей

На чертежах изображено:

фиг.1 - первая конфигурация предпочтительного варианта выполнения с расположенными в одном месте проектором и камерой;

фиг.2 - конфигурация с верхней проекцией;

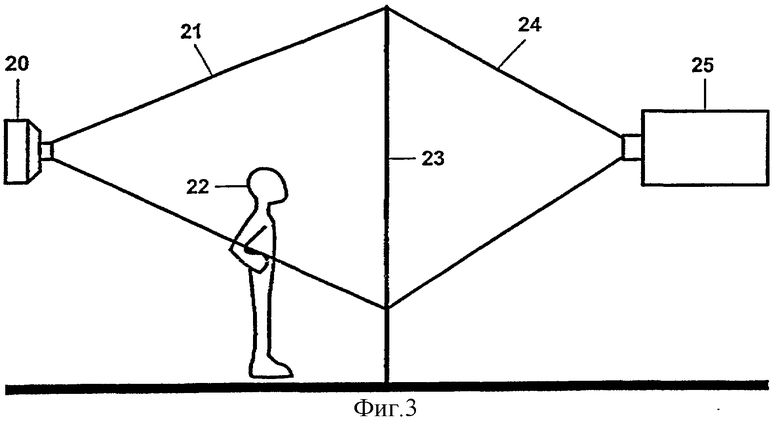

фиг.3 - конфигурация с задней проекцией;

фиг.4 - конфигурация с боковой проекцией;

фиг.5А - субъект при равномерном освещении;

фиг.5В - фон при освещении в виде случайного точечного узора;

фиг.5С - субъект и фон при освещении в виде случайного точечного узора;

фиг.5D - результат обнаружения объекта на фоне при использовании освещения в виде случайного точечного узора;

фиг.6А - пользователь, воздействующий с видеообъектом; и

фиг.6В - изображение влияния.

Подробное описание изобретения

Ниже приводится описание нескольких вариантов осуществления изобретения. В целом, в данном изобретении используют первый источник света для освещения пользователя или другого объекта. Первый источник света использует свет, невидимый для человека. Например, можно использовать инфракрасный или ультрафиолетовый свет. Для обнаружения пользователя, освещаемого первым источником света, используют камеру, которая чувствительна к свету в диапазоне длин волн первого источника света. Для обработки изображения обнаруженного объекта и для генерирования изображений для дисплея используют процессор (или другую систему обработки). Второй источник света (например, проектор, видеоэкран и т.д.) используют для отображения генерированных дисплейных изображений пользователю или зрителям. Отображаемые изображения выполняются на длинах волн, которые минимизируют помехи для обнаружения камерой объекта. Для отображения изображений обычно используют видимый спектр света.

Согласно предпочтительному варианту выполнения дисплей окружает пользователя, так что виртуальное присутствие пользователя совмещается с физическим присутствием пользователя. Таким образом, виртуальная сцена на дисплее имеет физическое местоположение вокруг пользователя, и движения пользователя внутри дисплея приводят к идентичному движению представления пользователя внутри виртуальной схемы. Например, пользователь может сталкиваться с физическим местоположением виртуального объекта и знать, что это приведет к тому, что его виртуальное представление коснется виртуального объекта в компьютерной системе. Использование понятия "прикосновение" или "прикоснуться" в данном описании не означает физического контакта с объектом, таким как человек или элемент изображения. Вместо этого упоминание соприкосновения означает, что положение объекта и действие в физическом пространстве переводится в эффект в генерированном изображении, включая эффекты движения элементов в генерированных изображениях.

Отображенные изображения или элементы могут включать объекты, узоры, формы или любые видимые узоры, эффекты и т.д. Некоторые аспекты изобретения можно использовать для прикладных программ, таких как интерактивные эффекты освещения людей в клубах или событиях, интерактивные рекламные дисплеи, знаки и виртуальные объекты, которые реагируют на движения прохожих, интерактивное освещение окружения для общественных помещений, таких как рестораны, ярмарки, спортивные арены, магазины, фойе и парки, видеоигровые системы и интерактивные информационные дисплеи. Возможны другие прикладные программы и они входят в объем изобретения.

На фиг.1 показан вариант выполнения изобретения с проекцией спереди с использованием расположенных в одном месте камерой и проектором. Как показано на фиг.1, человек 1 освещается инфракрасной лампой 2 (или другим невидимым светом). Изображение человека фотографируется инфракрасной (или работающей в другом диапазоне невидимого света) камерой 3. Этот сигнал 4 передается в реальном времени в компьютер 5. Компьютер выполняет алгоритм обнаружения объекта и генерирует видеоэффект в реальном времени. Эффект 6 передается в реальном времени в видеопроектор 7. Проектор проецирует результирующее изображение на экран в реальном времени и в совмещении с человеком.

На фиг.2 показана конфигурация системы с верхней проекцией. Компонент 10 включает указанную выше систему. В данном случае компонент 10 показан установленным вертикально, однако камера, проектор и источник света внутри компонента 10 могут быть установлены также горизонтально и затем направлены вниз с помощью зеркала. Человек, движущийся на полу 11, может иметь видеосигнал 12, проецируемый на пол вокруг него. Собственная тень человека затмевает минимальную часть изображения, когда проектор находится непосредственно над головой.

На фиг.2 и 3 показаны еще две альтернативные конфигурации для камеры и проектора. На обеих фигурах камера 20 захватывает объект, такой как человек 22 перед экраном 23. Угол зрения камеры обозначен позицией 21. На фиг.3 проектор 25 расположен позади экрана. Исходящий из проектора свет 24 можно видеть на экране с обеих сторон. На фиг.4 проектор 25 расположен с наклоном к экрану; показан его конус 24 света. Обе эти конфигурации увеличивают вероятность отсутствия теней, искажающих проецируемое изображение.

Как указывалось в приведенных выше конфигурациях, видеокамера используется для захвата сцены в частном положении для ввода в компьютер. В большинстве конфигураций устройства камера видит часть выходного видеодисплея. Для предотвращения не желательной обратной видеосвязи камера может работать на длине волны, которая не используется видеодисплеем. В большинстве случаев дисплей использует видимый спектр света. В этом случае камера должна фотографировать в невидимом диапазоне длин волн, таком как инфракрасный, так что выход видеодисплея не обнаруживается.

Сцена, снимаемая на видео, должна освещаться светом с длиной волны камеры. В случае инфракрасного света можно использовать источники, включая солнечный свет, тепловую лампу или инфракрасные светоизлучающие диоды, для освещения сцены. Эти источники света могут быть расположены в любом месте; однако попадание ложных теней в поле зрения камеры от этих источников света можно минимизировать за счет расположения источников света вблизи камеры. Источник света, такой как одна или более ламп, может освещать объекты равномерным светом в противоположность узорчатому освещению, которое будет описано ниже. В предпочтительном варианте выполнения видеосигнал передается в реальном времени в компьютер. Однако в других вариантах выполнения не обязательно обеспечивать обработку в реальном или близком к реальному времени и можно обрабатывать объект или видеоизображения (т.е. изображения дисплея) во время, значительно предшествующее отображению изображений.

Этот компонент выполнен модульным; в нем можно использовать любое программное обеспечение компьютера, которое использует входной видеосигнал от предшествующего компонента и выдает результат в виде видеоотображения.

Большинство примеров выполнения этого компонента имеет две части: первая часть осуществляет обнаружение мобильных объектов на неподвижном фоне, в то время как вторая часть использует информацию об объекте для генерирования выходного видеосигнала. Описание нескольких примеров выполнения будет приведено ниже; эти примеры выполнения являются лишь примерами и никак не являются всеобъемлющими.

В первой части живое изображение из видеокамеры обрабатывается в реальном времени с целью отделения подвижных объектов (например, людей) от неподвижного фона, независимо от характера фона. Обработку можно выполнять следующим образом.

Сначала входные кадры из видеокамеры преобразуются в полутоновое изображение для уменьшения количества данных и упрощения процесса обнаружения. Затем их можно слегка размыть для уменьшения шума.

Любой объект, который не движется в течение длительного времени, считается фоном; поэтому при необходимости система способна адаптироваться к изменению освещения или состоянию фона. Модельное изображение фона можно генерировать с помощью различных способов, в каждом из которых проверяют входные кадры в течение некоторого времени. В одном способе проверяют последние несколько кадров (или их подмножество) для генерирования модели фона посредством усреднения, генерирования срединного значения выборки, обнаружения периодов постоянной яркости или других эвристических процедур. Длительность времени, в течение которого проверяют входные кадры, определяет скорость, с которой модель фона адаптируется к изменениям входного изображения.

В другом способе модель фона генерируют в каждой временной стадии (или реже) посредством вычисления взвешенного среднего значения текущего кадра и модели фона из предыдущей стадии. Вес текущего кадра в этом вычислении является относительно небольшим; таким образом, изменения в действительном фоне постепенно ассимилируются в модель фона. Этот вес можно настраивать для изменения скорости, с которой модель фона адаптируется к изменениям во входном изображении.

Считается, что представляющий интерес объект отличается по яркости от фона. С целью нахождения объектов в каждой стадии времени текущий видеосигнал вычитают из модельного изображения фона. Если абсолютная величина этой разницы в конкретном месте больше конкретного порогового значения, то это место классифицируется как объект; в противном случае оно классифицируется как фон.

Вторая часть может быть любой программой, которая воспринимает классификацию объект/фон изображения (возможно, дополнительно к другим данным) в качестве входного сигнала и выдает видеоизображение на основе этого входного сигнала, возможно, в реальном времени. Эта программа может принимать бесконечное число форм и таким образом определяется в широком смысле как компьютерная прикладная программа. Например, этот компонент может быть простым и создавать направленную освещенность в форме обнаруженных объектов или сложным в виде рисующей программы, управляемой с помощью жестов людей, обнаруженных в качестве объектов. Дополнительно к этому, прикладные программы могут использовать другие формы входного сигнала, такие как звуковой, температурный, клавиатурный входной сигнал и т.д., а также дополнительные формы выходного сигнала, такие как звуковой, тактильный, виртуальной действительности, ароматический и т.д.

Один большой класс прикладных программ включает специальные эффекты, которые используют классификацию объект/фон в качестве входного сигнала. Например, звезды, линии или другие формы можно рисовать в выходном видеоизображении в случайной части мест, которые были классифицированы как объект. Затем эти формы могут со временем постепенно исчезать, так что люди оставляют промежуточные следы форм за собой при их движении. Ниже приводятся примеры других эффектов того же класса:

- контуры и рябь, окружающие объекты,

- сетка, деформированная присутствием объектов,

- имитация пламени или ветра или другие матричные конволюции, применяемые к объектам,

- специальные эффекты, которые пульсируют в так музыки, которая обнаруживается отдельно.

Другой большой класс прикладных программ позволяет реальным объектам взаимодействовать с виртуальными объектами или знаками. Например, изображение, показывающее группу утят, можно запрограммировать для прохождения позади любого реального объекта (например, человека), который идет перед дисплеем.

Дополнительно к этому, компьютерные игры, в которые могут играть люди, движущиеся перед камерой, образуют другой класс прикладных программ.

Однако этот список не является исчерпывающим; этот компонент выполнен с возможностью программирования и тем самым может выполнять любую прикладную программу.

Выходной сигнал программного обеспечения обработки из предыдущего компонента отображается визуально. Возможные дисплеи включают, но не ограничиваясь этим, видеопроекторы, телевизионные, плазменные дисплеи и лазерные стенды. Отображаемое изображение можно выравнивать с входной областью камеры, так что видеоэффекты выравниваются с местоположением людей, вызывающих их. Поскольку некоторые конфигурации видеокамеры могут обнаруживать объекты в невидимом свете, исключается проблема создания дисплеем помех для камеры.

Имеются различные возможные конфигурации для различных компонентов. Например, камера и видеопроектор могут быть в одном и том же месте и направлены в одном направлении. Затем камера и проектор могут быть направлены на стену, как показано на фиг.1, направлены на пол, отклонены с помощью зеркала, как показано на фиг.2, или направлены на любую другую поверхность. В качестве альтернативного решения проектор может быть расположен позади экрана, как показано на фиг.3, так что экран является идентичным экрану на фиг.1, но человек больше не находится на пути проекции, так что он не отбрасывает тени. Тень можно также исключить за счет расположения проектора под наклоном к экрану, как показано на фиг.4. Видеодисплей может быть также телевизионным большим экраном, плазменным дисплеем или видеостеной. Хотя во всех указанных выше конфигурациях видеодисплей находится на одной линии с видеовходом, это не является обязательным; видеодисплей может быть расположен в любом месте. Предшествующий список не является исчерпывающим; имеются многочисленные возможные дополнительные конфигурации.

Вся система может быть включена в информационную сеть для обеспечения обмена между системами визуальной информацией и информацией о состоянии программного обеспечения обработки. Таким образом, объект, обнаруженный в сигнале зрения одной системы, может воздействовать на программное обеспечение в другой системе. Дополнительно к этому, виртуальный элемент в дисплее одной системы можно перемещать в другие системы. Если дисплеи нескольких систем выровнены друг с другом, так что они образуют единый большой дисплей, то в этом случае несколько систем могут действовать как одна очень большая система, при этом объекты и взаимодействия бесшовно перемещаются через границы дисплеев.

Общая проблема системы зрения состоит в том, что в случаях, когда имеется неконтролируемое окружающее освещение (например, солнечный свет) видимой камерой зоны под значительно отличным углом, чем камера, то объекты отбрасывают тени на фон. Если эти тени являются достаточно сильными, то система зрения может ошибочно принимать их за объекты. Эти тени могут быть обнаружены и удалены посредством стробирования источника света камеры. Посредством вычитания входного изображения камеры с одним окружающим светом из входного изображения камеры как с окружающим светом, так и со светом камеры система получает изображение, которое захватывает сцену, как если бы использовался лишь свет камеры, за счет чего исключаются обнаруживаемые тени из окружающего света.

Дополнительную точность обнаружения объектов с помощью изображений, захваченных камерой, можно обеспечить посредством использования узорчатого освещения или узорчатых маркировок.

Один недостаток использования системы простого прожекторного освещения для компьютерного зрения состоит в том, что если цвета объектов, наблюдаемых камерой, являются очень похожими, то может быть очень трудно обнаруживать объекты. Если камера работает в монохромном режиме, то еще больше повышается вероятность того, что объект и фон выглядят одинаково.

Использование узорчатого объекта для закрывания видимой камерой зоны может улучшить обнаружение объекта. Если используется узор, который содержит два или более цветов, смешанных в тесной близости, то вероятность того, что другие объекты имеют похожий вид, очень мала, поскольку по меньшей мере один цвет узора будет выглядеть отлично от цвета окружающих объектов. Если используется узорчатый объект, такой как экран, в качестве фона, перед которым необходимо обнаруживать объекты, то объекты, которые проходят перед узорчатым экраном, можно обнаруживать более просто с помощью алгоритма зрения.

Например, в инфракрасной прикладной программе зрения узорчатый объект может быть фоном, который кажется белым для глаза человека, однако он содержит покрытие в виде черно-белого шахматного узора, который невидим для глаза человека, но видим для камеры. За счет использования узора, который невидим в видимом спектре света, узорчатое покрытие не нарушает приятного внешнего вида системы. Дисплейная система (например, видеопроектор) может проецировать выходные изображения на покрытия, как указывалось выше. В процесс, выполняемый обрабатывающей системой, такой как компьютерная система, можно вводить узор фона, что упрощает обнаружение объекта перед покрытием, хотя система может обучаться узорчатому фону тем же образом, каким алгоритм зрения обучается любому другому фону. Кроме того, способность системы приспосабливаться к изменениям яркости фона также не испытывает отрицательного взаимодействия.

Узорчатое освещение можно также проецировать из источника света на видимую камерой зону. Пока камера и источник невидимого света находятся в различных, разнесенных местах, эффекты параллакса приводят к нарушению вида проецируемого узора для камеры при движении объектов в видимой камере зоне. Это нарушение помогает объектам, имеющим сходные цвета, выделяться друг из друга. Если взять различие между двумя изображениями, видимые камерой, то результат показывает форму любого объекта, который появляется, исчезает или перемещается между двумя изображениями. Если изображение одного объекта перед фоном вычесть из изображения одного фона, то результатом является изображение, которое равно нулю, когда имеется фон, и не равно нулю, когда имеются другие объекты. Эту технологию можно использовать в комбинации с другими описываемыми здесь аспектами изобретения.

В качестве источника узорчатого света используется различные средства. Один метод состоит в использовании группы инфракрасных светоизлучающих диодов или другого источника невидимого света в проекторе слайдов. Используется комплект линз для фокусировки света источника через слайд, содержащий желаемый узор, за счет чего проецируется изображение узора на видимую камере зону. В другом способе инфракрасным лазерным лучом можно освещать генератор лазерного узора или другое рассеивающее устройство для создания светового узора на видимой камере зоне. Для создания узора свет можно отражать, затенять, сканировать и т.д. Возможны также многие другие подходы.

Источник узорчатого света является также полезным для трехмерного компьютерного зрения. Технология трехмерного компьютерного зрения, такая как алгоритм Марр-Поггио, принимает в качестве входного сигнала два изображения одной и той же сцены, снятой под слегка разными углами. Узоры на изображениях совмещают для определения величины сдвига и тем самым расстояние до камеры в каждой точке изображения. Действие этого алгоритма ухудшается, когда объекты имеют однородный цвет, поскольку однородный цвет затрудняет совмещение соответствующих частей в паре изображений. Таким образом, источник узорчатого света может улучшить оценку расстояния некоторых алгоритмов трехмерного компьютерного зрения.

Два входных изображения для этих алгоритмов трехмерного зрения обычно генерируют с использованием пары камер, направленных на сцену. Однако можно использовать также лишь одну камеру. Второе изображение может быть полностью неискаженной версией проецируемого узора, которая известна заранее. Это изображение узора по существу идентично тому, что видела бы вторая камера, если ее разместить точно в том же месте, что и источник узорчатого света. Таким образом, можно использовать совместно вид единственной камеры и проецируемый узор в качестве входного сигнала для алгоритма трехмерного зрения. В качестве альтернативного решения вторым изображением может быть изображение только фона, снятое той же камерой.

Хотя можно использовать различные типы узоров, узор случайных точек высокого разрешения имеет определенные преимущества для двухмерного и трехмерного зрения. За счет случайности точечного узора каждая имеющая значительный размер часть точечного узора с очень малой вероятностью выглядит как любая другая часть узора. Таким образом, смещенный узор, обусловленный присутствием объекта в рассматриваемой зоне с очень низкой вероятностью выглядит сходно с узором при отсутствии здесь объекта. Это делает максимальной способность алгоритма зрения обнаруживать смещения в узоре и тем самым объекты. Использование регулярного узора, такого как решетка, может создавать некоторые трудности, поскольку разные части узора являются идентичными, что приводит к тому, что часто смещенные части выглядят как несмещенные части.

На фиг.5А-D показана полезность узора случайных точек для обнаружения объекта. На фиг.5А показано изображение человека при нормальном освещении. Изображение человека имеет яркость, сходную с яркостью фона, что затрудняет обнаружение. На фиг.5В на фон проецируется узор из случайных точек из источника света вблизи камеры. Когда человек стоит перед этим узором, то узор, отражаемый от человека, смещен, как показано на фиг.5С. За счет определения разницы между изображениями на фиг.5А и 5С, получают изображение на фиг.5D, которое задает зону изображения человека с помощью сильного сигнала.

Можно использовать другие подходы для улучшения обнаружения объекта. Например, источник света можно "стробировать" или периодически включать и выключать, так что легче обнаруживать тени, обусловленные другими источниками света (например, окружающим светом).

После обнаружения и определения объекта в предпочтительных вариантах выполнения используют градиентный ореол для определения степени и направления взаимодействия объекта с отображенным элементом изображения.

На фиг.6 показан пользователь, взаимодействующий с видеообъектом.

На фиг.6 объект 304 обнаружен и показан в виде контура. Одно представление объекта процессор компьютера может использовать определение контура, показанного на фиг.6А. Видеоэкран 302 отображает несколько элементом изображения, таких как изображение 306 мяча.

На фиг.6В показано изображение влияния для зоны 308 на фиг.6А.

На фиг.6В контурное изображение ноги 320 пользователя используется для генерирования последовательных более крупных контурных зон. Области исходной контурной зоны 320 присваивается большая величина яркости пикселей, соответствующая белому цвету. Каждой последующей контурной зоне 322, 324, 326, 328, 380 присваивается прогрессивно уменьшающаяся величина, так что точка, более удаленная от исходной контурной (белой) зоны, будет иметь более низкую величину яркости пикселей. Следует отметить, что можно использовать любое число контурных зон. Кроме того, по желанию можно изменять размер и приращения контурных зон. Например, можно использовать непрерывный градиент, а не дискретные зоны. Совокупность всех контурных зон называется "изображением влияния".

Изображение влияния сравнивают для различных элементов изображения. На фиг.6В элемент мяч 306 сталкивается с градиентными зонами 326, 328 и 330. Как известно из уровня техники, линии направления определяются в направлении градиента поля величин пикселей для зон сталкивания. На фиг.6В показаны три примера линий направления внутри элемента 306. Линии направления можно комбинировать, например, посредством усреднения или же можно использовать выбранную единственную линию. С помощью обработки также обнаруживают, что наиболее яркой контурной зоной, толкаемой элементом, является контурная зона 326. Возможны другие подходы. Например, можно усреднять яркость и градиент в каждой точке зоны элемента изображения или подмножества этих точек. Кроме того, некоторые варианты выполнения могут включать длительность контакта в качестве фактора в дополнение к яркости и градиенту.

Взаимодействие между объектом, таким как человек, и элементом на экране вычисляют с использованием как яркости соударяемой контурной зоны, так и направления, вычисленного с использованием одной или более линий направления. Яркость соударения соответствует силе, с которой пользователь соприкасается с элементом. Градиент соответствует направлению, в котором (или из которого в зависимости от знака вычисления) произошло соприкосновение с элементом.

Хотя изобретение было описано применительно к конкретным вариантам его выполнения, эти варианты выполнения являются иллюстрацией и не ограничивают данное изобретение. Например, хотя в предпочтительных вариантах выполнения используется камера в качестве детектора, можно использовать различные типы обнаружения. Камера может быть цифровой или аналоговой. Можно использовать стереокамеру для обеспечения информации о глубине, а также о положении. В случаях, когда обработка и отображение выполняются не в реальном времени, можно использовать пленку или другие типы носителей с последующим цифровым преобразованием перед вводом данных в процессор. Можно использовать световые чувствительные элементы или детекторы. Например, вместо камеры можно использовать матрицу из фотодетекторов. Можно использовать другие детекторы, не рассматриваемые здесь, с подходящими результатами.

В целом можно в данном изобретении использовать любой тип дисплейного устройства. Например, хотя были описаны видеоустройства в различных вариантах выполнения и конфигурациях, можно использовать другие устройства визуальной презентации. Можно использовать матрицу из светоизлучающих диодов, органических светоизлучающих диодов, электромагнитные, катодно-лучевые, плазменные, механические или другие дисплейные системы.

Можно использовать дисплеи виртуальной реальности, трехмерные и другие типы дисплеев. Например, пользователь может носить формирующие изображение очки или колпак, так что он погружается внутрь созданного окружения. В этом подходе создаваемое отображение может выравниваться с воспринимаемым им окружением для создания увеличенной или улучшенной реальности. В одном варианте выполнения пользователь может взаимодействовать с изображением знака. Знак может создаваться компьютером, изображаться актером и т.д. Знак может реагировать на действия пользователя и положения его тела. Взаимодействие может включать речь, взаимную манипуляцию объектами и т.д.

Несколько систем могут быть соединены друг с другом через, например, цифровую сеть. Например, можно использовать локальную сеть Ethernet, универсальную последовательную шину (USB), IEEE 1394 (Firewire) и т.д.

Можно использовать беспроводные линии связи, такие как 802.11b. За счет использования множества систем пользователи в разных географических местах могут кооперировать, соревноваться или взаимодействовать друг с другом другим образом с помощью созданных изображений. Изображения, созданные двумя или более системами, можно объединять друг с другом в мозаику или комбинировать другим образом для создания многокомпонентного изображения.

Можно использовать другие типы освещения, отличные от света. Например, можно использовать радарные сигналы, микроволновые или другие электромагнитные волны с получением преимуществ в ситуациях, где подлежащий обнаружению объект (например, металлический объект) имеет сильную отражательную способность для таких волн. Можно приспособить аспекты данного изобретения для других видов обнаружения, таких как с использованием акустических волн в воздухе или в воде.

Хотя для приема и обработки сигналов изображения объекта и для создания сигналов отображения описаны компьютерные системы, можно использовать любые другие типы системы обработки. Например, можно использовать систему обработки, которая не использует компьютер общего назначения. Системы обработки, использующие конструкции, основанные на заказных или полузаказных схемах или кристаллах, специальных прикладных интегральных схемах (ASIC), программируемых пользователем вентильных матриц (FPGA), мультипроцессорах, асинхронные или любых другие типы конструкции или методологии могут подходить для использования в данном изобретении.

Таким образом, объем изобретения определяется лишь прилагаемой формулой изобретения.

| название | год | авторы | номер документа |

|---|---|---|---|

| СИСТЕМА ДИСТАНЦИОННОГО ПРИСУТСТВИЯ, СПОСОБ ДИСТАНЦИОННОГО ПРИСУТСТВИЯ И УСТРОЙСТВО СБОРА ВИДЕОДАННЫХ | 2009 |

|

RU2518218C2 |

| УСТРОЙСТВА, СИСТЕМЫ И СПОСОБЫ ВИРТУАЛИЗАЦИИ ЗЕРКАЛА | 2014 |

|

RU2668408C2 |

| СИСТЕМА УСТРОЙСТВА ПРОСМОТРА СМЕШАННОЙ РЕАЛЬНОСТИ И СПОСОБ ДЛЯ НЕГО | 2018 |

|

RU2754991C2 |

| УСТРОЙСТВО ДЛЯ АВТОСТЕРЕОСКОПИЧЕСКОГО РЕНДЕРИНГА И ОТОБРАЖЕНИЯ | 2009 |

|

RU2524834C2 |

| СИСТЕМА НАБЛЮДЕНИЯ И СПОСОБ ОБНАРУЖЕНИЯ ЗАСОРЕНИЯ ИЛИ ПОВРЕЖДЕНИЯ АЭРОДРОМА ПОСТОРОННИМИ ПРЕДМЕТАМИ | 2012 |

|

RU2596246C2 |

| УНИВЕРСАЛЬНОЕ КОМПЬЮТЕРНОЕ УСТРОЙСТВО | 2004 |

|

RU2392656C2 |

| СИСТЕМА И СПОСОБ РЕГИСТРАЦИИ ДВУХМЕРНЫХ ИЗОБРАЖЕНИЙ | 2005 |

|

RU2365995C2 |

| СИСТЕМА И СПОСОБ ДЛЯ ДОПОЛНЕННОЙ И ВИРТУАЛЬНОЙ РЕАЛЬНОСТИ | 2012 |

|

RU2621633C2 |

| Устройство для формирования объёмного изображения в трёхмерном пространстве с реальными объектами | 2017 |

|

RU2664781C1 |

| РЕКЛАМНО-ВЫСТАВОЧНАЯ СТЕНДОВАЯ ВИЗУАЛЬНАЯ СИСТЕМА УПРАВЛЕНИЯ ДВИЖЕНИЕМ ПОТОКОВ ЛЮДЕЙ В ПУБЛИЧНЫХ МЕСТАХ | 2009 |

|

RU2378713C1 |

Устройство обеспечивает простое и необременительное взаимодействие между человеком и компьютерной дисплейной системой, использующей движение и положение человека (или другого объекта) в качестве входного сигнала компьютера. В некоторых конфигурациях отображение можно проецировать вокруг пользователя, так что действия человека отображаются вокруг него. Видеокамера и проектор работают на разных длинах волн, так что они не создают помех друг другу. Использование такого устройства включает, но не ограничивается этим, интерактивные эффекты освещения для людей в клубах или в событиях, интерактивное отображение рекламы и т.д. Созданные компьютером знаки и виртуальные объекты могут реагировать на движения прохожих, генерировать интерактивное окружающее освещение для помещений общего пользования, таких как рестораны, фойе и парки, системы видеоигр и создавать интерактивные информационные системы и художественные инсталляции. Можно использовать узорчатое освещение и яркость и градиент для улучшения способности обнаруживать объект на фоне видеоизображений. 5 н. и 71 з.п. ф-лы, 6 ил.

первый источник для выдачи электромагнитной энергии в невидимом диапазоне длин волн в направлении местоположения, содержащего указанный объект;

детектор для обнаружения отражения электромагнитной энергии первого источника от указанного местоположения;

процессор, соединенный с детектором и предназначенный для выполнения процесса обнаружения изображения объекта в обнаруженном отражении, определения изображения влияния объекта, при этом изображение влияния включает в себя область вокруг обнаруженного изображения объекта, генерирования сигнала отображения включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом; и второй источник для выдачи электромагнитной энергии в диапазоне длин волн видимого спектра, при этом второй источник создает видимое отображение в ответ на сигнал отображения.

генерирования сигнала отображения, включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом; и использование второго источника света в диапазоне длины волны видимого спектра для генерирования отображенного изображения из сигнала отображения.

часть системы проекции сверху, часть системы проекции сзади, часть системы проекции спереди.

обнаружения изображения объекта в обнаруженном отражении,

определения изображения влияния объекта, при этом изображение влияния включает в себя область вокруг обнаруженного изображения объекта,

генерирования сигнала отображения, включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом.

систему камеры, предназначенную для обеспечения изображения объекта отдельно от фона; систему отображения, предназначенную для отображения видеоизображений на поверхности; и процессор, предназначенный для получения указанных изображений от указанной системы камеры и вывода на указанную систему отображения, при этом указанный процессор предназначен для генерирования адаптивной модели указанного фона путем анализа изменений на протяжении всего времени, кадров изображений, вводимых из указанной системы камеры.

Приоритет по пунктам:

| US 5923380 А, 13.07.1999 | |||

| СПОСОБ ОТСЛЕЖИВАНИЯ И ОТОБРАЖЕНИЯ ПОЛОЖЕНИЯ И ОРИЕНТАЦИИ ПОЛЬЗОВАТЕЛЯ В ПРОСТРАНСТВЕ И СИСТЕМА ДЛЯ ОСУЩЕСТВЛЕНИЯ СПОСОБА | 1996 |

|

RU2107328C1 |

| ИНФОРМАЦИОННАЯ СИСТЕМА | 1998 |

|

RU2133508C1 |

| RU 2058043 С1, 10.04.1996 | |||

| ПУЛЬСИРУЮЩИЙ ВОЗДУШНО-РЕАКТИВНЫЙ ДВИГАТЕЛЬ | 1928 |

|

SU79482A1 |

| Захватное устройство для колонн | 1982 |

|

SU1051031A1 |

Авторы

Даты

2007-04-27—Публикация

2002-06-04—Подача