Уровень техники

Настоящее изобретение относится к устройствам обработки видеоинформации системы охранной сигнализации и, в частности, относится к устройству обработки видеоинформации системы охранной сигнализации, которое обнаруживает нарушителя посредством обработки видео, снятого монокулярной камерой.

Обычная система тревожной сигнализации не является удовлетворительной в отношении частых сигналов ложной тревоги, недостатка универсальности, т.е. необходимости тонкой и трудоемкой корректировки настроек, соответствующих станциям мониторинга. Когда классические задачи по обработке изображения, такие как сегментация, скелетизация, распознавание и обнаружение, должны быть реализованы, очевидно, что трудности в разработке типичной системы тревожной сигнализации в значительной степени обусловлены наличием различных шумов из-за различных видов источников.

Недорогие датчики CMOS используются почти во всех камерах видеонаблюдения. Тем не менее, даже в самом высокопроизводительном датчике из этих датчиков определенный аппаратный шум подмешивается в данные изображений. Имеется обратная корреляция между уровнем сигнала яркости и уровнем шума датчика. Вследствие этого шума не могут быть сняты два одинаковых изображения, даже если камера и среда, изображение которой должно быть сформировано, неподвижны. Фактически значение сигнала яркости или RGB-значение пиксела наблюдаются как случайные величины. Соответственно, значение пиксела, наблюдаемого как случайная величина, должно быть смоделировано с помощью соответствующего способа. Экспериментально доказано, что шум датчика может быть надлежащим образом смоделирован как белый шум.

В качестве предшествующего уровня техники, лежащего в основе настоящего изобретения, известен способ обнаружения движущегося транспортного средства автора Eremin S.N. (см. Патент RU (Россия) 2262661). Этот способ содержит этапы получения кадра, вычисления межкадровой разности, преобразования в двоичную форму с помощью порогового значения, выполнения морфологической операции, вычисления оператора Sobel, сохранения начального кадра и обновления фона на основе специального уравнения, обнаружение разности между кадром и фоном, вычисления гистограммы изображений, обнаружения сигнала максимальной яркости, проверки посредством сравнения с существующим объектом, отделения смешанного объекта, определения местоположения транспортного средства и формирования прямоугольника, который выражает координату, в которой транспортное средство может быть выделено с помощью обрамления

Кроме того, в качестве предшествующего уровня техники, связанного с настоящим изобретением, известен способ распознавания изображений с помощью инвариантного момента Hu (см. Ming-Kuei HU, "Visual Pattern Recognition by Moment Invariants", IRE Transactions on information theory, 1962, стр.179-187).

Также известен способ, в котором используется преобразование Фурье-Мелина или фильтр Габора в качестве значения инвариантного к изменению масштаба, и они сравниваются со словарем, чтобы распознать объект (см. Park, H. J., Yang H. S, "Invariant object detection based on evidence accumulation and Gabor features", Pattern recognition letters 22, стр.869-882, и Kyrki, V., Kamarainen J. K, "Simple Gabor feature space for invariant object recognition", Pattern recognition letters 25, No.3, 2004, стр.311-318).

Кроме того, известен способ углового детектора Харриса (см. C. Harris and M. Stephens, "A combined corner and edge detector", Proc. Alvey Vision Conf., Univ. Manchester, 1988, стр.147-151). В этом подходе обнаруженный угол используется в качестве характерного признака. У любого объекта есть уникальный набор угловых точек. Обработка с целью распознавания выполняется посредством сравнения с взаимным расположением углов, которое объект имеет в стандартном изображении.

Кроме того, известен способ многократного последовательного применения Гауссова фильтра к изображению и подготовки групп разностных изображений (пирамида Лапласа) (см. Патент US 6141459) и SIFT (преобразование масштабно-инвариантных признаков), который выделяет величину масштабно-инвариантного признака, к примеру, ключевую точку, из максимального значения этих групп изображений (см. David G. Lowe, "Distinctive image features from scale-invariant key points, Journal of Computer Vision, 60, 2, 2004, стр.91-110).

Сущность изобретения

Недостатки вышеописанных соответствующих способов заключаются в ошибочном обнаружении тени как объекта (нарушителя, транспортного средства и т.п.) и неспособности определить фактический размер объекта. Другой недостаток состоит в том, что, когда объект (или его позиция), который появился в поле зрения и оставлен в нем, ошибочно обнаружен, обновление фоновой модели в соответствующем пикселе полностью останавливается, и в результате статический объект не может быть автоматически интегрирован в фон. По этой причине ложная тревога или пропуск обнаружения происходят при наличии возмущения, вызванного непрерывными изменениями или временным изменением в освещении, движением листьев и движением водной поверхности или осадками (дождем, снегом и т.п.). Кроме того, достаточное внимание не уделялось периодическому изменению фона, такому как мерцание, или слежению в пределах области, где освещенность сильно изменяется в различных местах.

Цель настоящего изобретения состоит в том, чтобы сократить количество ложных срабатываний и улучшить точность обнаружения границы движущегося объекта, тем самым улучшая качество системы безопасности на базе телевизионного наблюдения при сложных климатических условиях и изменяющемся фоне и, помимо этого, расширяя функциональные возможности или удобство использования.

Устройство охранной сигнализации на базе обработки видеоинформации настоящего изобретения использует разностный (по отношению к фону) метод, основанный на параметрической модели. То есть, каждый раз, когда кадр изображения вводится, абсолютное значение разности между входным изображением текущего кадра и фоновым изображением вычисляется и затем преобразуется в двоичную форму с помощью порогового изображения. Для порогового изображения используется дисперсия σ2 в каждом значении пиксела входного изображения, умноженная на предварительно определенный коэффициент k1. Хотя дисперсия σ2 усредняется во времени на основе коэффициента обновления ρ для каждого пиксела, коэффициент обновления ρ выбирается по-разному, в зависимости от того, принадлежит соответствующий пиксел фону или принадлежит объекту.

Впоследствии зона начального обнаружения формируется из двоичного изображения и для нее выполняется процесс пространственной фильтрации. Процесс пространственной фильтрации включает в себя, по меньшей мере, одно из следующих преобразований: скелетизация, обработка объектной маски, морфологические операции, сегментация. Скелетизация включает в себя процесс получения уточнения формы зоны начального обнаружения посредством утончения или скелетизации бинарного изображения, процесс выделения главных осей по информации о форме, и процесс выделения осей объекта из выделенных осей.

Обработка объектной маски включает в себя процесс выделения области окантовки, которая не является смежной с границей зоны начального обнаружения двоичного изображения. Морфологическая обработка включает в себя процесс расширения путем преобразования пиксела, смежного с белым пикселем двоичного изображения, в белый пиксел, и процесс сокращения путем преобразования пиксела, смежного с черным пикселем двоичного изображения, в черный пиксел. Сегментирование включает в себя процесс разделения зоны начального обнаружения на сегменты, процесс анализирования относительной пропорции белых пикселов в бинарных пикселах каждого сегмента и процесс выбора сегментов на основе пропорции белых пикселов. Далее формируется зона слежения, которая выражает независимую часть объекта.

Для зоны слежения изменение позиции интересующей зоны слежения во времени отслеживается с помощью, по меньшей мере, одного из следующих способов: способ слежения, основанный на информации о характерных признаках, таких как априорно известные позиция и размер, центр тяжести, характерный контур изображения и момент; и способ слежения, основанный на методе выделения линейных компонентов, представленном посредством преобразования Хафа и т.п., в котором линейный компонент выделяется из упорядоченных по времени бинарных пространственно-временных данных, полученных в каждой временной точке. Результат отслеживания подвергается, по меньшей мере, одному из методов сглаживающей фильтрации, фильтрации скользящего среднего значения и фильтрации Калмана, и таким образом уменьшается вклад компонента, обусловленного шумом в результат вычисленния изменения метпоположения.

Некоторые из зон слежения отбраковываются, а остающиеся зоны интегрируются в кластер, и помимо этого, выполняется отбор кластера. Отбор кластера выполняется на основе анализа размера кластера, координаты позиции кластера, смещения от области, имеющей указанную форму, смещение от области, расположенной не далее, чем на предварительно заданном расстоянии от некоторого известного кластера. Это определение делается после преобразования к размерам в реальном пространстве с помощью координатного преобразования. Это преобразование вычисляется с использованием значений параметров видеодатчика камеры и параметров установки камеры при ее монтаже. В конечном счете, кластер, оставшийся после отбора оценивается как объект, который должен быть обнаружен.

Кроме устройств обработки видеоинформации системы охранной сигнализации, как описано выше, устройства обработки видеоинформации системы охранной сигнализации с некоторыми из составляющих элементов, замененными на элементы из другой известной области техники, могут быть включены в настоящее изобретение.

Устройство обработки видеоинформации системы охранной сигнализации настоящего изобретения может точно обнаруживать объект, по которому ведется мониторинг, из видео, даже если есть различные виды регулярных, временных или периодических возмущений, таких как климатические условия, неактивное (абиологическое) движение или искусственные флуктуации изображении.

Другие цели, признаки и преимущества изобретения должны стать очевидными из нижеследующего описания вариантов осуществления изобретения, взятых вместе с прилагаемыми чертежами.

Краткое описание чертежей

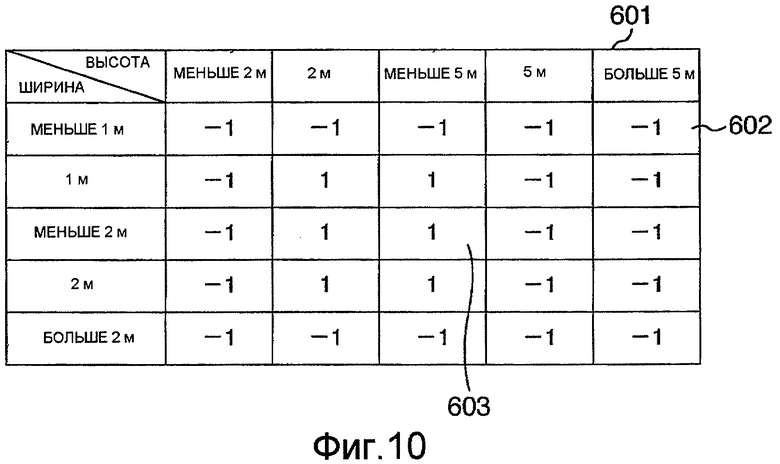

Фиг.1 показывает блок-схему основного алгоритма устройства обработки видеоинформации системы охранной сигнализации (вариант осуществления 1).

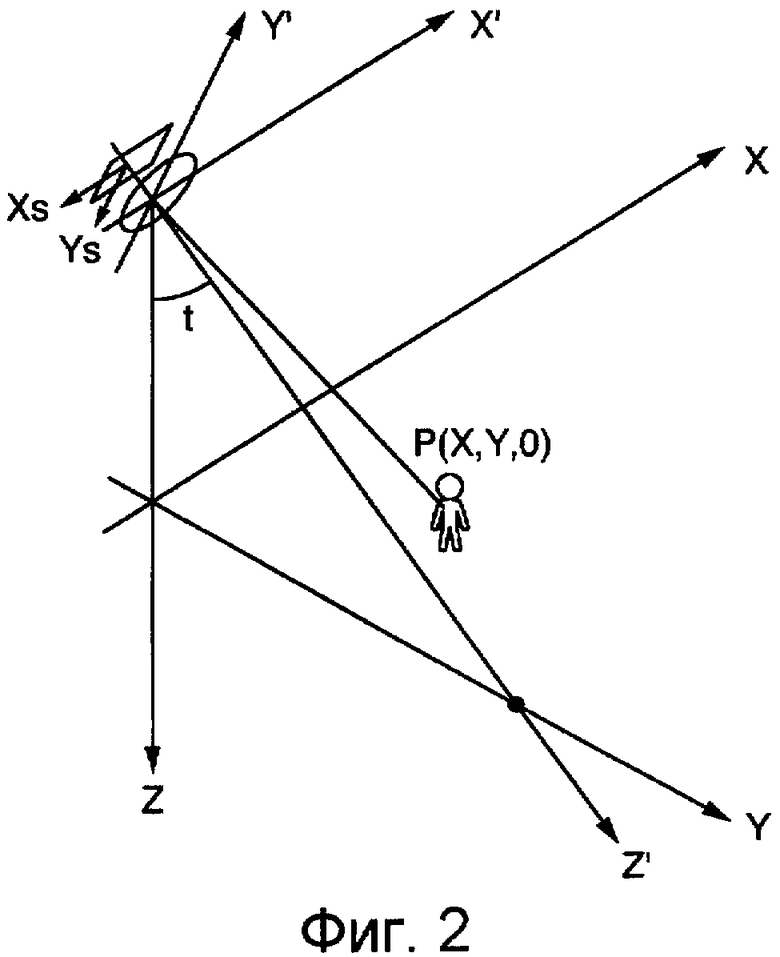

Фиг.2 - вид, иллюстрирующий координаты сцены, координаты камеры, и экранные координаты (вариант осуществления 1).

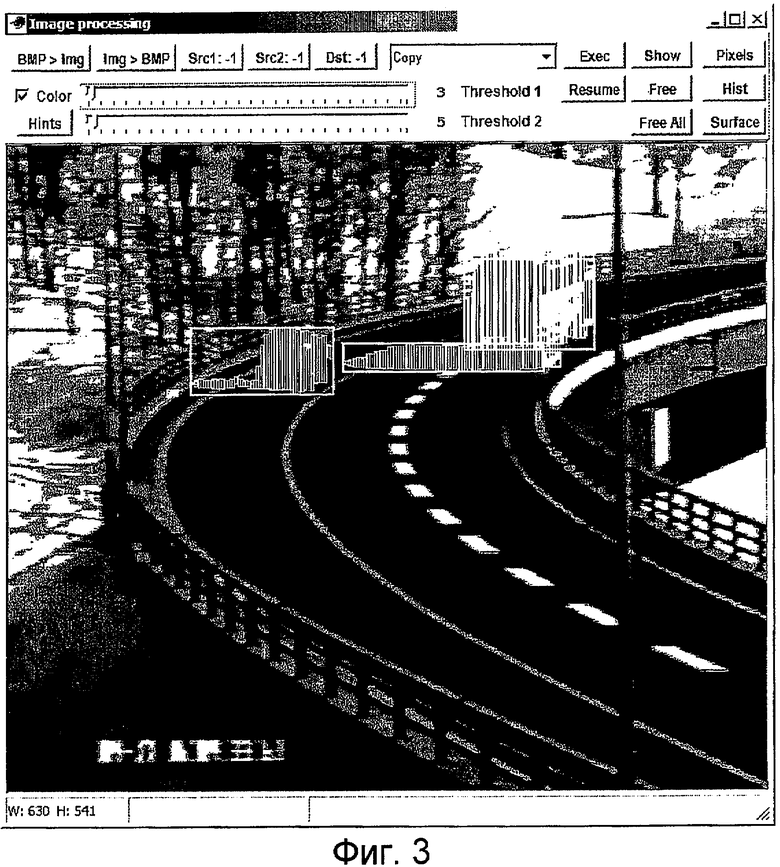

Фиг.3 - изображение, показывающее пример процесса разделения (S118) (вариант осуществления 1).

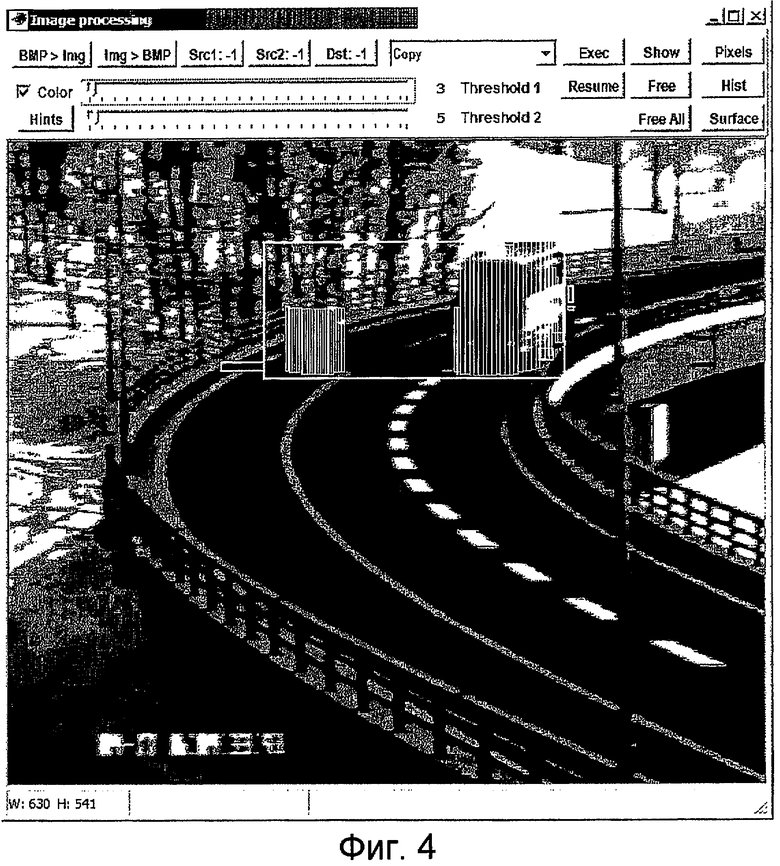

Фиг.4 - изображение, показывающее пример обработки с целью объединения (S119) (вариант осуществления 1).

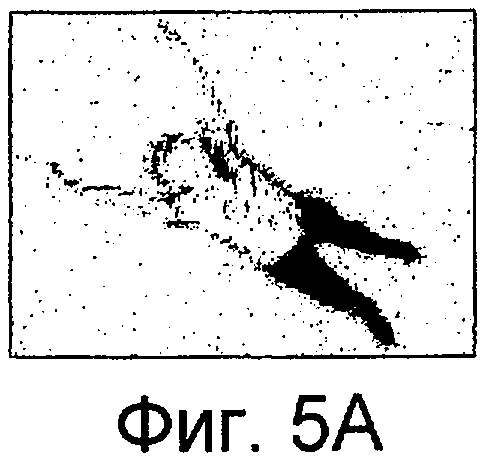

Фиг.5A-5F - изображения, показывающие пример скелетизации (вариант осуществления 3).

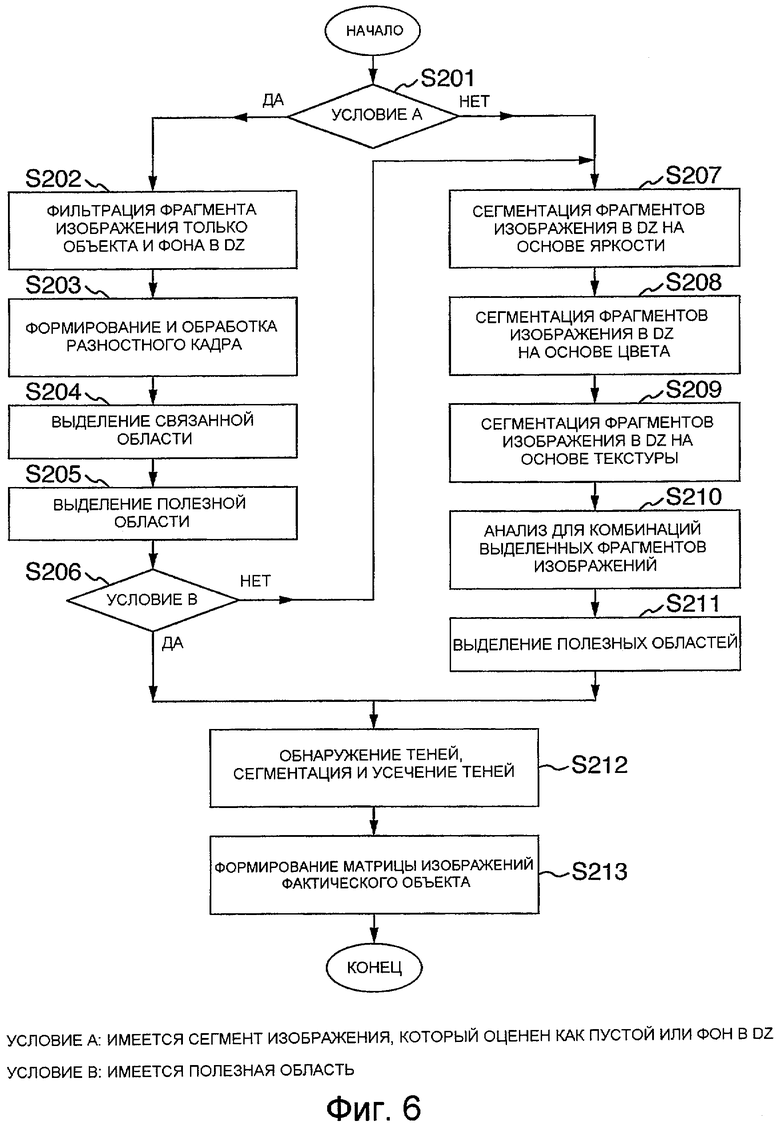

Фиг.6 - блок-схема последовательности операций процесса сегментации объекта (OS) (вариант осуществления 4).

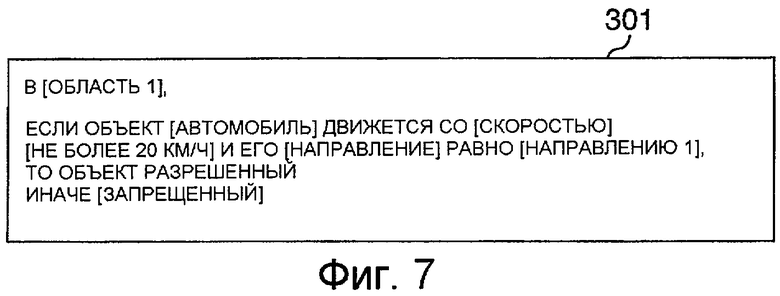

Фиг.7 - пример условий мониторинга (вариант осуществления 5).

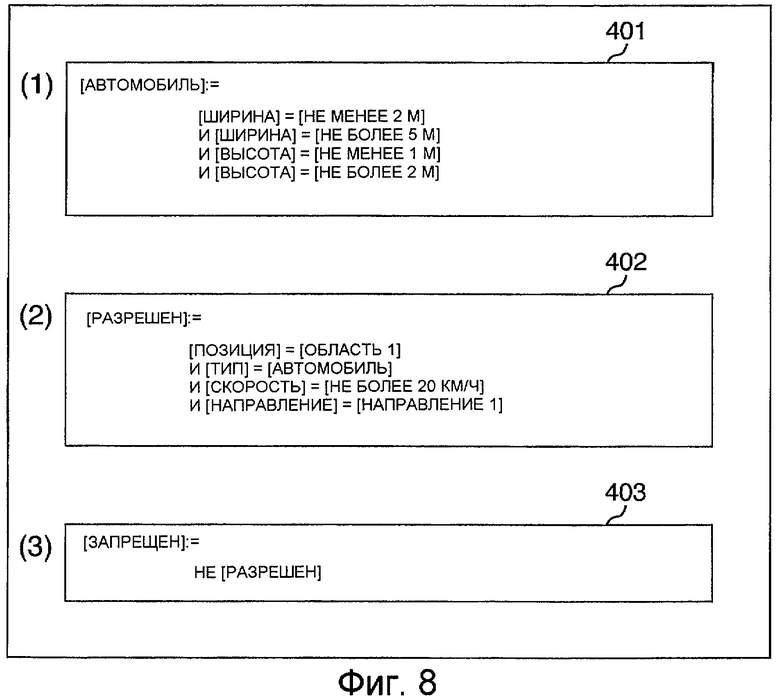

Фиг.8 - пример условий мониторинга (вариант осуществления 5).

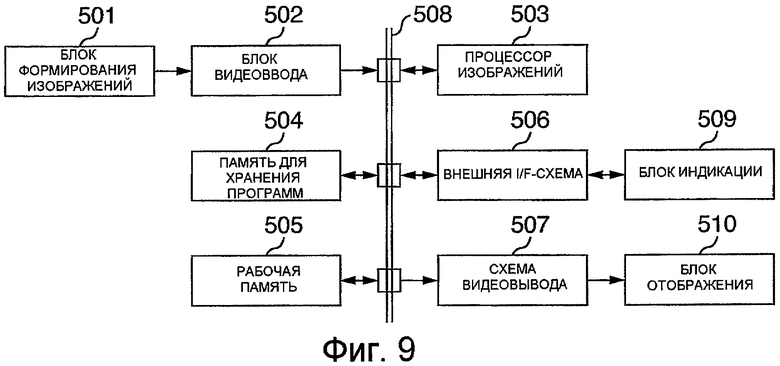

Фиг.9 - пример конфигурации оборудования (вариант осуществления 5).

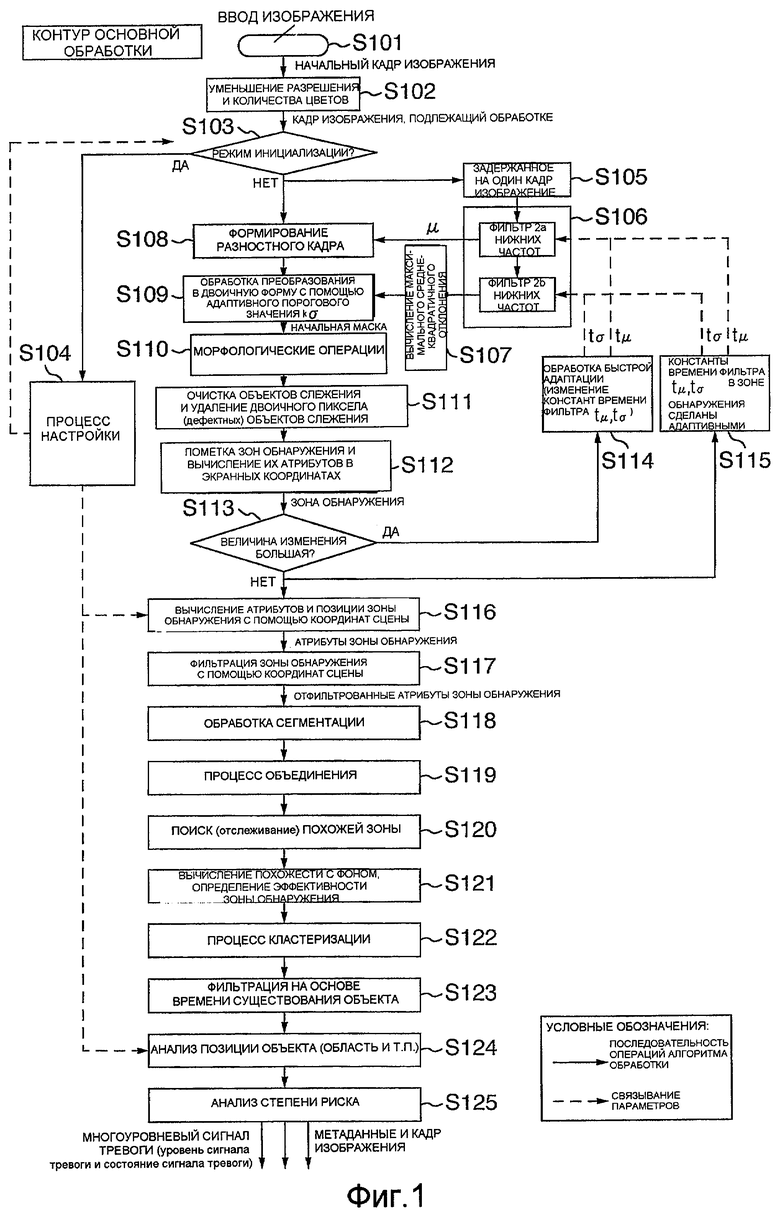

Фиг.10 - пример таблицы решений (вариант осуществления 5).

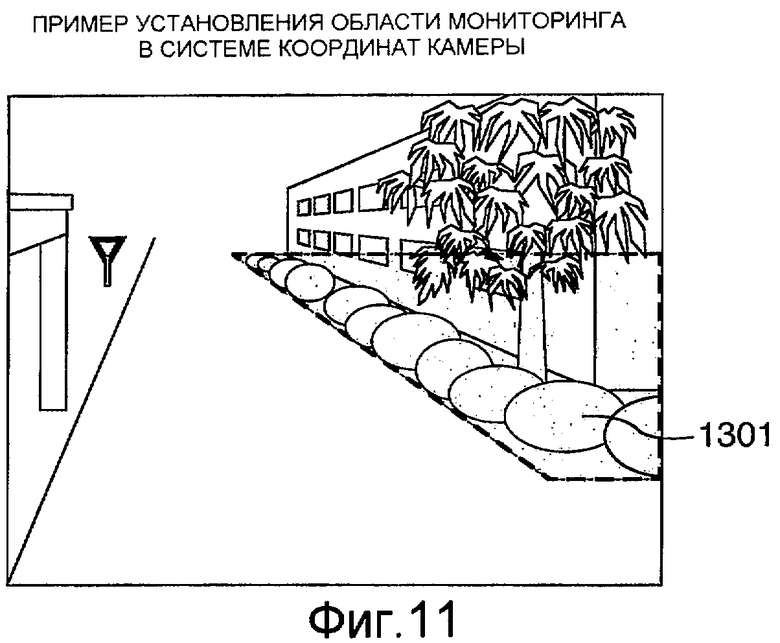

Фиг.11 - пример задания области мониторинга в системе координат камеры (вариант осуществления 6).

Фиг.12 - пример задания области мониторинга в системе координат сцены (вариант осуществления 6).

Фиг.13 - пример формирования обработанной области с учетом высоты области мониторинга (вариант осуществления 6).

Фиг.14 - пример формирования изображений целевого объекта, который должен подвергаться мониторингу (вариант осуществления 6).

Подробное описание вариантов осуществления

<Общая логика системной функции видеомониторинга>

Чтобы реализовать основные цели, во-первых, должна быть определена общая логика для работы устройства обработки видеоинформации системы охранной сигнализации согласно варианту осуществления настоящего изобретения.

Чтобы разрешить проблемы техники в данной предметной области, требуются оценка наблюдаемых изменений окружающей среды и анализ данных на уровне прогнозирования. В соответствии с таким результатом анализа наблюдаемая ситуация оценивается как ситуация, по которой следует подавать сигнал тревоги (возможная угроза). В зависимости от степени риска в ситуации (также с учетом прогнозирования) формируется сигнал срабатывания одной системы видеомониторинга или любой одной из других систем видеомониторинга. Характерной особенностью этой системы является то, что ее реакция на угрозу аналогична реакции оператора-человека.

В результате, логика функционирования системы видеонаблюдения - это, в первую очередь, логика обнаружения, прогнозирования и парирования угроз охраняемому объекту. Разработка логики функционирования основана на формализации тревожных и опасных ситуаций. В реальных условиях для формализации ситуаций количество сигналов ложной тревоги может быть сокращено посредством анализа возможности объединения и группировки текущих ситуаций в один из классов ("проблематичные", "опасные", "очень опасные"). Это естественный способ разработать логику функционирования на базе оценки человеком, который имеет опыт в выполнении задач мониторинга. При просмотре множества сложных сцен, в которых происходят изменения окружающей среды, он/она обращает внимание на объект, который может быть прямой угрозой защищаемому предмету, и пытается предсказать изменение обстановки, обращая внимание на скорость или направление вызывающего сомнения объекта.

Идентификация движущегося объекта (или оставленного объекта) при наличии сложного фона на сцене, в которой существует естественный шум, должна выполняться перед оцениванием текущей ситуации.

В таком случае составная функция этой системы может быть разделена на четыре основных нижеприведенных этапа:

1) Настройка

2) Начальное обнаружение (предварительное обнаружение)

3) Анализ состояния с учетом объекта обнаружения

4) Выдача сигнала тревоги и анализ метаданных.

"Настройка" включает в себя следующие элементы:

1) Настройка алгоритма (задание параметров для обработки видеоданных)

2) Регулировка настроек камеры (задание и корректировка парметров установки камеры)

3) Настройка зон (выбор и индикация различных " зон интереса", соответствующих сцене наблюдения).

"Начальное обнаружение" означает оценку отличия между "фоном" и текущим видеокадром. Основная цель этого этапа состоит в том, чтобы обнаружить все отличия в максимально возможной степени на основе выбранных критериев (порогового значения). Качество обнаружения (обнаружение отличия от фона) обуславливается на этапе начального обнаружения. Хотя при этом может быть множество ложных обнаружений, их количество уменьшится на следующем этапе. Алгоритм начального обнаружения - это обработка с учетом значения сигнала яркости (имеющего значения 0-255 для каждого из трех каналов RGB-цветов) пиксела.

"Анализ состояния" требуется для того, чтобы уменьшать количество ложных обнаружений. Первый этап анализа состояния состоит в том, чтобы не принимать во внимание объект, который не требует выдачи сигнала тревоги и не требует слежения. Реализация этого этапа в данной системе включает в себя следующие пункты:

1) Оценка размера первоначально обнаруженного объекта

2) Оценка формы первоначально обнаруженного объекта

3) Оценка значения величины "сходства при сопоставлении с фоном" первоначально обнаруженного объекта (т.е. выполняется не обработка значения сигнала яркости одного пиксела, а обработка характеристик целых групп пикселов, соответствующих объекту обнаружения)

4) Оценка времени существования первоначально обнаруженного объекта

5) Оценка скорости первоначально обнаруженного объекта.

С целью дальнейшей оценки поведения объекта, распознавания состояния и формирования соответствующего сигнала срабатывания используются следующие области определенной формы в пределах диапазона формирования изображений камеры:

1) Многоугольная область

2) Цилиндрическая область

3) Область перпендикулярной плоскости.

Индивидуальная степень опасности может быть установлена для каждой из зон, соответственно.

<Вариант осуществления 1>

Во-первых, задаются основные термины, использованные в описании этого варианта осуществления.

Текущий кадр (изображение): один кадр изображения, полученного из видеоввода в текущем цикле обработки.

Фоновый кадр (изображение): изображение, полученное посредством последовательного усреднения (сглаживания) значения сигнала яркости каждого пиксела в пределах кадра изображения. Эти вычисления выполняются с помощью фильтра 106a нижних частот (описан позже).

Кадр среднеквадратичного отклонения: изображение, полученное посредством последовательного усреднения (сглаживания) дисперсии значения сигнала яркости каждого пиксела в пределах кадра изображения. Эти вычисления выполняются с помощью фильтра 106b нижних частот (описан позже).

Межкадровая разность (изображение): изображение, вытекающее из разности изображения между текущим кадром и фоновым кадром.

Бинарный кадр (изображение): изображение, получающееся в результате преобразования в бинарную форму кадра разностного изображения, и оно получается посредством сравнения разностного кадра с кадром среднеквадратичного отклонения для каждого пиксела.

Пиксел переднего плана: пиксел, находящийся в пределах текущего кадра и содержащийся в ненулевой зоне (зоне, имеющей значение пиксела в нуль или больше) в бинарном кадре.

Фоновый пиксел: Пиксел, находящийся в пределах текущего кадра и содержащийся в нулевой зоне (зоне, имеющей значение пиксела 0) в бинарном кадре.

Отметим, что, хотя кадр является единицей, составляющей одно изображение, он может использоваться синонимично с изображением.

Фиг.1 показывает блок-схему основного алгоритма обработки варианта осуществления 1. Фаза начального обнаружения охватывает диапазон от ввода кадра изображения (этап 101) до процесса преобразования в бинарную (этап 108).

На этапе 101 вводится входной кадр, только что снятый с помощью камеры. Этап 101 активируется через обработчик событий посредством события таймера, тем самым запуская основной алгоритм обработки. Входное изображение имеет, к примеру, формат YUV 4:2:2.

На этапе 102 разрешение и/или число цветов входного изображения уменьшается до формата, подходящего для обработки в режиме реального времени. В этом варианте осуществления входное изображение преобразуется в один байт полутонового изображения на пиксел, поскольку описанные ниже несколько функций поддерживают только RBG или одноканальную шкалу яркости. YUV, HSB (HSV) или другой формат так же может быть подходящим. Разрешение соответствует ряду форматов и уменьшено до 360×240 пикселов, например. На этом этапе 102 до или после сокращения разрешения и/или числа цветов также выполняется процесс адекватного уменьшения резкости изображения с помощью низкочастотного пространственного фильтра. Например, Гауссов фильтр является подходящим для высокоскоростной обработки, поскольку он может выполнять вычисления в направлении x и в направлении y раздельно. Или может использоваться медианный фильтр, который использует медиану в рамках 3×3 пикселов. Наконец, усиление регулируется таким образом, чтобы выровнять яркость (среднюю) в предварительно определенной области в пределах изображения.

На этапе 103, если он является начальной операцией основного алгоритма обработки, в алгоритме выполняется переход к процессу настройки (установки) (этап 104). На этапе 104 устанавливаются нижеописанные различные константы (параметры), а также осуществляется настройка для задания того, какой сигнал тревоги выдается, когда объект соответствующего размера, скорости и местоположения обнаруживается в области обнаружения соответствующей типа формы и позиции. Некоторые из этих установок выполняются с использованием значений реальных пространственных координат (системы координат сцены) вместо экранных координат. Подробности описываются на этапах 124, 125.

На этапе 105 подготовленный (уменьшенный) кадр сохраняется, чтобы быть использованным в качестве задержанного на один кадр изображения.

На этапе 106 две низкочастотные фильтрации выполняются с использованием подготовленного текущего изображения и задержанного на один кадр изображения. В этом варианте осуществления фоновое изображение моделируется как вероятностный процесс, имеющий неизвестное среднее и неизвестное среднеквадратичное отклонение. Временной фильтр нижних частот используется для того, чтобы оценить (приблизительно вычислить) моменты этого процесса.

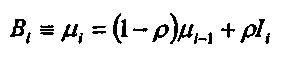

Фильтр 106a нижних частот регулярно обновляет оценку среднего значения каждого пиксела. Скользящее среднее значение вычисляется (как в нижеприведенном уравнении (1)) каждый раз, когда вводится новый кадр:

где Ii обозначает текущее изображение, ρ обозначает константу фильтра (0<ρ<1), а i обозначает индекс кадра. Результат фильтра 106a нижних частот упоминается как фоновый кадр.

Константа фильтра имеет следующий смысл. Рассмотрим число кадров изображения, требуемое для того, чтобы новый объект полностью встроился в фон (стал частью фона). Если это встраивание выполняется слишком быстро, можно пропустить объект (который должен быть обнаружен), который перемещается не слишком быстро. Например, в случае p=1 текущий (новый) кадр изображения немедленно становится новым фоновым кадром изображения, тогда как в случае p=0 первый кадр изображения остается как фоновый кадр изображения, и фоновый кадр изображения не обновляется больше. Фактически требуется реализовать (последовательно) умеренное обновление фона и процесс сглаживания резких изменений в значении сигнала яркости. Во-первых, T задается как предпочтительный цикл (интервал) правильного обновления фонового кадра изображения. Если T задано как число кадров обработки (не в единицах секунд), ρ задается посредством ρ=5/T. Например, если правильное обновление фона выполняется в пределах 1000 кадров обработки, константа фильтров устанавливается как ρ=0,005.

Фильтр 106b нижних частот последовательно вычисляет предполагаемое среднеквадратичное отклонение каждого пиксела с использованием аналогичного способа.

Отметим, что фоновый кадр или текущий кадр может быть предыдущим (кадр с индексом i-1). Как описано далее, ρ переключается для каждого пиксела в зависимости от типов зоны или различных видов условий (к примеру, сигнала яркости), ρ может быть разным для фильтров 106a и 106b нижних частот и обозначаться как ρa и ρb в этом случае, соответственно.

Фактически, оцениваемое среднеквадратичное отклонение σ сохраняется в запоминающем устройстве как σ2 (т.е. дисперсия), чтобы избежать вычисления квадратного корня, и обрабатывается как возведенное в квадрат значение до процедуры бинаризации.

На этапе 107 временное максимальное значение σ' среднеквадратичного отклонения σ (или дисперсии), которое вычислил фильтр 106b нижних частот, вычисляется и сохраняется для каждого пиксела. Хотя максимальное значение σ' может быть успешно найдено из предварительно определенного числа предыдущих кадров, оно может быть вычислено также из нижеприведенного уравнения (3).

На этапе 108 разностный кадр формируется с помощью подготовленного текущего изображения и фонового изображения. Алгоритм обнаружения изменения по данному варианту осуществления основан на абсолютном значении разностного кадра изображения между уменьшенным входным изображением Ii и фоновым изображением μi (или μi-1), сформированным посредством фильтра 106a нижних частот.

На этапе 109 этот разностный кадр преобразуется в бинарную форму с помощью адаптивного порогового значения k1σ. Среднеквадратичное отклонение здесь используется как адаптивная часть порога бинаризации.

где k - это константа, выбранная на этапе установки (этап 104). Рекомендуемое значение колеблется от 3 до 4 и определяется в зависимости от качества шума. Результат процедуры бинаризации получается как бинарное изображение, где 0 (ложь) означает, что ничего не обнаружено, а 255 (истина) обозначает обнаруженный пиксел. Если изображение передавалось как цветное изображение до этого этапа, здесь также выполняется интеграция цветовых каналов. Для интеграции цветовые каналы могут быть подвергнуты взвешенному суммированию до бинаризации или цветовые каналы могут быть комбинированы посредством логического суммирования (дизъюнкции) (OR) после бинаризации. Бинарное изображение (или область значений “истина” в бинарном изображении), полученное на этапе 109, также упоминается как начальная маска объекта.

Этапы 110-123 являются фазами "анализа состояния".

На этапе 110 морфологические операции применяются к начальной маске объекта. Морфологические операции включают в себя четыре следующие основные операции: процесс расширения, чтобы вычислять логическое ИЛИ при сдвиге изображения в пределах предварительно определенного диапазона, процесс размыва, чтобы вычислять логическое И, процесс открытия, чтобы выполнять процесс размыва после процесса масштабного преобразования, и процесс закрытия, чтобы выполнять процесс масштабного преобразования после процесса размыва. Процесс открытия имеет эффект для того, чтобы связывать смежные “255” (истина) пикселов, тогда как процесс закрытия имеет эффект того, чтобы удалять точечные “255” (истина) пикселов. Любой из них используется в этом варианте осуществления.

В начальной маске объекта морфологические операции не могут в достаточной степени исключить случай, когда область ложного значения возникает в связанной области истинных значений. Поэтому может быть выполнена обработка “заполнения”, при которой котором выявляется область ложных значений, окруженная областью истинныых значений, и затем эта выявленная область заполняется истинными значениями.

На этапе 111 дефектные зоны трассировки (слежения) очищаются, и (бинарные пикселы) фонового изображения (породившие эти дефектные зоны трассировки) удаляются. Таким образом, если найдена ошибочно обнаруженная зона слежения на этапе 120, 122 и т.п. из предшествующего цикла обработки, пикселы в пределах этой зоны слежения в начальной маске объекта блокируются (им присваиваются значения, отличные от 255), и в то же время внутренняя часть этой зоны слежения в текущем кадре заменяется на внутреннюю часть фонового изображения и корректируется. После этого шага маска объекта готова. Кроме того, исходный текущий кадр также сохраняется отдельно.

На этапе 112 выполняется пометка предварительных зон обнаружения и вычисление их атрибутов. Пометка - это способ для того, чтобы найти и отметить (пометить) все связанные области в пределах изображения. На этом этапе уникальный номер присваивается связанной области, содержащей пикселы, имеющие значения “истина” в бинарном изображении, и эта связанная область далее обрабатывается как предварительная зона обнаружения DetZones (Dz0, Dz1, …), имеющая координаты описанного прямоугольника (четыре координаты верх, низ, левая и правая) и площадь (площадь внутренней части связанной области или число связанных пикселов).

На этапе 113, когда сигнал яркости резко изменяется из-за любого отраженного света (облачности, освещения уличного фонаря и т.п.), в основном алгоритме обработки выполняется переход к режиму быстрой адаптации (этап 114). В этом примере, переход в алгоритме выполняется когда сумма общих площадей зон обнаружения во всем кадре изображения или сумма общих площадей зон обнаружения в "зоне быстрой адаптации" становится больше предварительно установленного порогового значения. В этом примере режим быстрой адаптации поддерживается в течение нескольких периодов. Этот период (заданный посредством числа кадров, а не посредством интервала времени) также предварительно задается.

На этапе 114, если процесс обработки находится в фазе быстрой адаптации, константа фильтра принимает такое значение, при котором достигается полная замена фонового изображения к концу периода быстрой адаптации. Например, если период быстрой адаптации задается величиной 50 кадров, константа фильтра ρ становится равной 0,1.

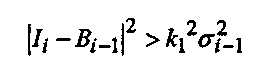

Таким образом, быстрая адаптация позволяет избежать ошибочного обнаружения, вызванного резким изменением в фоне. Обнаружение вызывающего сомнение объекта во время быстрой адаптивной обработки (на этапе 116 и после того) не выполняется.

На этапе 115 константы фильтра, используемые для зон обнаружения, делаются адаптивными. Бинарное изображение используется для того, чтобы отделять пиксел (имеющий значение 255 в бинарных изображениях и упоминаемый как пиксел переднего плана), в котором вызывающий сомнение объект может быть обнаружен, от пиксела (имеющего значение нуль в бинарных изображениях), в котором обнаружен только фон. Константы фильтров 106a, 106b нижних частот для пиксела переднего плана изменяются так, чтобы скорость, с которой пиксел переднего плана становится фоном, могла стать в 10 раз медленнее по сравнению с другими пикселами кадра изображения. Таким образом, вышеупомянутое описание ρ применяется к ρ1, и ρ переопределяется следующим образом.

В этом варианте осуществления k=0,1. Соответственно, система может препятствовать тому, чтобы фактически обнаруженный объект отражался на фоновом изображении в течение долгого времени по сравнению со вариантом, когда такой адаптации нет. По сравнению с методом быстрой адаптации эта обработка позволяет избежать потери объекта, который останавливается или двигается на низкой скорости.

На этапе 116 вычисляются геометрические атрибуты предварительной зоны обнаружения (зоны анализа). Геометрические атрибуты включают в себя позицию и размер (ширину и высоту) зоны обнаружения, выраженные в системе координат сцены. Рассмотрим следующую систему координат (фиг.2).

X, Y, Z: система координат сцены (внешняя система координат). Плоскость X-Y параллельна поверхности пола (земле), и уровень колеблется от 0,5 до 0,7 м.

X', Y', Z': система координат камеры. Оси X', Y' параллельны целевой фокальной плоскости, X' параллельна оси X, а Z' равна оптической оси камеры.

Xs, Ys: координаты изображения (экрана), которые аналогичны плоскости X'-Y', но их единицы выражаются в пикселах, не в метрах.

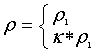

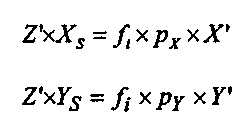

Высота камеры обозначена как h, а угол наклона оптической оси камеры относительно плоскости X-Y обозначен как t. Объект P, позиционированный в сцене, обозначенной посредством координат X, Y и Z (Z=0), преобразуется к системе координат камеры посредством нижеприведенного уравнения (6):

X'=X

Y'=Y·cos(t)-h·sin(t) (6)

Z'=Y·sin(t)+h·cos(t)

Экранные координаты объекта задаются посредством нижеприведенного уравнения (7) с помощью уравнений проекционной оптики:

где f1 обозначает фокусное расстояние, а px [m-1] и py [m-1] обозначают плотность элемента изображения в направлениях Xs и Ys, соответственно, и f=f1·px=f1·py задается. Эти параметры установки камеры предоставлены на этапе 104. Посредством замены переменной Z' получается

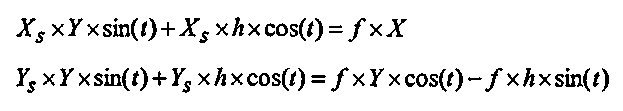

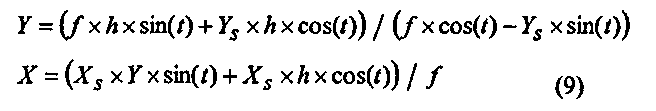

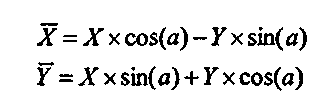

где уравнение преобразования - это нижеприведенное уравнение (9):

Поскольку камера, возможно, установлена с помощью способа, отличного от способа по фиг.2, угол поворота камеры, возможно, должен рассматриваться относительно оси Z и оси Z'. В этом случае новые координаты выражаются с помощью нижеприведенного уравнения (10):

где a обозначает угол поворота относительно оси Z. Аналогично, экранные координаты выражаются с помощью нижеприведенного уравнения (11):

Здесь a' обозначает угол поворота относительно оси Z.

На этапе 117 предварительная зона обнаружения (зона анализа), которая не удовлетворяет предварительно определенному размеру, отбраковывается (чтобы не подвергаться дальнейшей обработке). Для каждой зоны обнаружения геометрические атрибуты (например, ширина и высота в реальном пространстве) в этой системе координат сцены (X, Y, Z) сравниваются с предварительно определенными значениями (например, wmin=0,1, wmax=2, hmin=0,1, hmax=3, которые задают соответствующий верхний предел и нижний предел), и затем только та зона, которая удовлетворяет вышеупомянутым значениям, проходит отбраковку и сохраняется в массиве SelZone. Кроме того, пиксел предварительной зоны обнаружения в текущем кадре, пиксел, не удовлетворяющий вышеупомянутому, перезаписывается пикселом из фонового кадра.

На этапе 118 выполняется сегментация предварительной зоны обнаружения, прошедшей этап 117. Сегментация требуется для анализа на уровне "заполненность в области обнаружения". Чтобы вычислить новую границу каждой зоны, прошедшей предудущую фильтрацию, все зоны, прошедшие предыдущую фильтрацию (прямоугольные зоны интереса), разделяются на полосы с равной шириной. Верхняя граница и нижняя граница этих полос зоны разделения переопределяются с учетом маски объекта, а ширина полосы сегментации задается при настройке как значение в метрах в системе координат сцены. Фактически, ширина точно корректируется так, чтобы разделяться на целое число полос с равной шириной. Далее полосы сегментации сохраняются как Sz0, Sz1, …, и так далее.

Фиг.3 показывает результат этой сегментации. Прямоугольники, нарисованные с помощью толстой белой линии, и вертикально вытянутые прямоугольники в пределах белого прямоугольника отражают результат сегментации и пересчета границ, соответственно. Это показывает, что сегментация выявляет контур фактического транспортного средства и контур фактической тени посредством установления ширины полосы деления, например, в 0,2 м.

На этапе 119 выполняется объединение сегментов с использованием степени заполнения удлиненной зоны (зоны анализа). Объединение достигается за счет повторения следующих подэтапов с первого по третий до тех пор, пока не останется непроверенных сегментов.

Во-первых, для проверки находится опорная зона. Опорная зона - это одна из вышеописанных сегментирующих зон удовлетворяющая следующим условиям. Это зона (1), ближайшая к центру базы (нижней границы) кадра изображения, (2) не содержащаяся ни в одной из групп объединеннения, и (3) не проверенная ранее.

Во-вторых, удлиненная зона, выступающая в качестве кандидата на зону объединения, вычисляется с учетом атрибутов найденной опорной зоны. Удлиненная зона - это прямоугольник, имеющий большую высоту, чем предварительно определенная высота (например, 0,8 м. для человека) в системе координат сцены. Высота в метрических единицах вычисляется из высоты фильтрованной зоны (зоны до сегментирования) на основе пропорциональных соотношений.

В-третьих, если соотношение SCross/Stotal>Merge area overlapping ratio (Соотношение перекрытия области объединения) удовлетворяется, удлиненная зона включается в группу объединения. Здесь, Scross - это площадь пересекающейся области (общей области) между зоной объединения (описанным прямоугольником зоны объединения) и удлиненной зоной, а Stotal - это площадь самой удлиненной зоны. Если пересекающаяся область равна 0, вышеописанная норма перекрытия вычисляется относительно самой опорной зоны как зоны объединения , и если вышеупомянутое условие удовлетворено, создается новая группа объединения, которая рассматривает удлиненную зону в качестве своего первого члена.

Наконец, группа объединения, которая удовлетворительна в достаточной степени, регистрируется в массиве “Merge” (Объединение) как зона объединения. Это условие выражается как Ssum/Smerge>Merge area filling ratio (Соотношение заполнения области объединения), где Ssum - это сумма отдельной площади удлиненной зоны, включенной в объединенную группу, а Smerge - это площадь (описанный прямоугольник) объединенной зоны. “Merge area filling ratio” составляет, например, 60%. Группа объединения, которая не является удовлетворительной в достаточной степени, не регистрируется в массиве “Merge”.

Фиг.4 показывает результат объединения. Прямоугольник с тонкими линиями отображает сегмент, который подвергнут объединению. Очевидно, что только высокая часть обнаруженного объекта проходит обработку объединения.

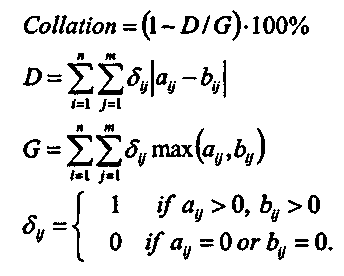

На этапе 120, с учетом предыдущего кадра вычисляются: местоположение, зоны, сходной с зоной слежения, зарегистрированной в массиве Merge, и степень сходства, на основании которых обновляется массив Trace (Трассировка, сопровождение). Зоны слежения, сохранившиеся с предыдущего момента времени, регистрируются в массиве Trace, и эта процедукра предназначена для проверки, существуют ли эти зоны стабильно в последовательности кадров, и уменьшать ошибочное обнаружение. На этом этапе для каждой зоны слежения, сохраненной в массиве Merge, зона слежения (шаблон) выделяется из предыдущего кадра (или предыдущего разностного кадра) и из текущего кадра, выделяется область поиска, причем область поиска получается посредством расширения зоны слежения на заданную величину, и затем в пределах этой области поиска следующее вычисление выполняется для того, чтобы искать максимальную степень совпадения:

где aij обозначает элемент матрицы сигнала яркости (фрагмент изображения) шаблона, и bij обозначает элемент матрицы сигнала яркости (фрагмент изображения) области поиска. Если каждый элемент имеет множество цветовых каналов, используется сумма абсолютного значения разности для каждого цветового канала.

Для каждой конкретной зоны слежения, если максимальная степень совпадения больше чем значение “Trace zone correlation coef” (Коэффициент корреляции зоны трассировки), вычисленная позиция зоны слежения в пределах области поиска используется для обновления массива Trace как новая позиция зоны слежения. Если максимальная степень совпадения меньше чем значение “Trace zone correlation coef” по числу кадров (iMissedFrameCnt), эта зона слежения удаляется из массива Trace (и из массива Merge).

На этапе 121 предусматривается, чтобы зона слежения, аналогичная фону, не добавлялась к зонам слежения массива Trace. Таким образом, новая зона добавляется в массив Trace, только если значение сопоставления с фоном меньше чем “Trace zone correlation to backgr” (Корреляция зоны трассировки с фоном). Кроме того, также если перекрытие между новой зоной и существующей зоной больше, чем значение iTRZoneOvrCoef, то эта новая зона не добавляется в массив Trace. Сопоставление на этом этапе может быть выполнено на основе степени совпадения как в (сопоставлении) в уравнении (11) (этап 117), или может использоваться другая величина признака.

Для обработки на этапах 120, 121 резко увеличивается объем вычислений по мере того, как зона становится больше. По этой причине верхний предел может быть задан равным размеру зоны, посредством чего выделенное изображение может быть сжато с тем, чтобы не превысить этот верхний предел. После этапа 121 массив Merge высвобождается из памяти.

На этапе 122 каждая зона слежения массива Trace интегрируется в кластер, чтобы создать массив Cluster. Допустимое время существования и размер задаются для кластера, и элемент, удовлетворяющий им, регистрируется в массиве Cluster. Процесс интегрирования выполняется посредством следующих шагов с первого по пятый.

Во-первых, кластер создается как прямоугольная область, которая содержит группу зон слежения, которые расположены относительно близко друг от друг. Максимальный допустимый интервал между зонами слежения, интегрированными в кластер, обозначается множителем Clustering (Кластеризация) и составляет, например, 5 пикселов.

Во-вторых, процесс сопоставления кластеров, которые созданы в текущем цикле обработки и в предыдущем цикле обработки (Cluster и ClustPre, в дальнейшем упоминаемый как текущий кластер и предыдущий кластер), выполняется, чтобы создать следующие массивы.

MinT0Cur: обозначает предыдущий кластер, пересекающий определенный текущий кластер Cluster[i] и имеющий минимальное значение T0 (время обнаружения)

CrQPre: число текущих кластеров, пересекающих определенный предыдущий кластер ClustPre[j]

CrQCur: число предыдущих кластеров, пересекающих определенный текущий кластер Cluster[i].

В-третьих, данные массива Cluster создаются из вышеописанных CrQCur, CrQPre, и MinT0Cur на основе следующих правил.

- Если только один предыдущий кластер и один текущий кластер пересекаются друг с другом, то идентификатор, T0 и позиция обнаружения предыдущего кластера наследуется текущим кластером.

- Если определенный текущий кластер пересекается с одним или более предыдущих кластеров, то новый идентификатор присваивается этому текущему кластеру, и T0 предыдущего кластера, имеющего наименьшее значение T0, наследуется, и в качестве позиции обнаружения используется позиция текущего кластера.

- Если определенный текущий кластер не пересекается ни с какими предыдущими кластерами, то новый идентификатор присваивается этому текущему кластеру, текущего времени задается как T0, и в качестве позиции обнаружения используется позиция текущего кластера.

В-четвертых, геометрическое место точек, скорость (которая должна быть использована в последующем этапе) и т.п. кластера вычисляются и сохраняются в массиве Cluster.

В-пятых, массив Cluster текущего кластера перезаписывается и сохраняется в массив ClustPre предыдущего кластера.

На этапе 123 выбирается каждый кластер массива Cluster, время существования которого (который является разностью между T0 и текущим временем и измеряется в единицах числа кадров) превышает предварительно определенное значение (например, 40), и каждый кластер, время существования которого не превышает предварительно определенное значение, отклоняется (не должен быть передан в следующий процесс).

На этапе 124 на основе области обнаружения, установленной на этапе 104, и относительной позиции для каждого кластера определяется то, находится ли кластер внутри или снаружи каждой области обнаружения. Области обнаружения включают в себя область многоугольника (цилиндра) (задаваемую экранными координатами или координатами сцены), область цилиндра (задаваемую координатами сцены, а основанием столбика является земля (плоскость X-Y), область окружности (задаваемую координатами сцены на земле (плоскость X-Y)) и область, перпендикулярную плоскости (задаваемую координатами сцены и предпочтительную для стены или окна). В качестве позиции каждого кластера используются координатные значения (экранные координаты или координаты сцены) в центре основания кластера (в части земли, к примеру, нога человека). Известный алгоритм используется при определении того, находится ли кластер внутри или снаружи каждой области обнаружения.

На этапе 125, если результаты анализа и сопоставления атрибутов (постоянные значения и т.п. изображения переднего плана кластера в дополнение к позиции и движению) кластера, определяемые как находящиеся в пределах области обнаружения, удовлетворяют решающим правилам, заданным для соответствующей области обнаружения, то выдается предварительно определенный сигнал тревоги. Хотя использование неизменяемого значения (величины признака) необязательно, HOG (гистограммы ориентированных градиентов) и т.п. могут использоваться, кроме, например, тех, которые показаны в Ming-Kuei HU, "Visual Pattern Recognition by Moment Invariants", IRE Transactions on information theory 1962, стр.179-187; Park, H.J., Yang H.S, "Invariant object detection based on evidence accumulation and Gabor features", Pattern recognition letters 22, стр.869-882; Kyrki, V., Kamarainen J.K, "Simple Gabor feature space for invariant object recognition", Pattern recognition letters 25, No.3, 2004, стр.311-318; C. Harris and M. Stephens, "A combined corner and edge detector", Proc. Alvey Vision Conf., Univ. Manchester, 1988, стр.147-151; и David G. Lowe, "Distinctive image features from scale-invariant key points, Journal of Computer Vision, 60, 2, 2004, стр.91-110, как описано выше.

Примеры решающего правила включают в себя следующие.

[Название решающего правила: Транспортные средства в области "въезд транспортным средствам запрещен"]

Объект обнаруживается как транспортное средство, и когда он присутствует в области предупреждения "въезд транспортным средствам запрещен" (области, где только разрешен доступ только человеку), этот объект оценивается как объект-нарушитель.

[Название решающего правила: Человек в предназначенной для транспортных средств области]

Если объект обнаруживается как человек и существует в области предупреждения "только для транспортных средств", этот объект оценивается как объект-нарушитель.

[Название решающего правила: Разворот]

Во всех кадрах обработки расстояние между позицией геометрического места точек объекта и позицией текущего объекта уже вычислено, и если это расстояние становится меньшим чем расстояние предыдущего кадра обработки, то "счетчик разворотов" этого объекта увеличивается, тогда как, если это расстояние становится большим, то счетчик уменьшается. Если это значение счетчика превышает пороговое значение ("объект почти останавливается в пороговом числе кадров обработки"), определяется то, что этот объект выполняет разворот. Более предпочтительно, используется геометрическое место точек, к которому применен сглаживающий фильтр, фильтр скользящего среднего значения, фильтр Калмана и т.п., и изменение направления вектора скорости на обратное оценивается с промежутками от нескольких десятых долей секунд до нескольких секунд.

[Название решающего правила: Фиксированная временная зона]

После обнаружения объекта в пределах фиксированной временной зоны счетчик k3 временной зоны объекта увеличивается. Счетчик временной зоны объекта никогда не уменьшается. Если счетчик превышает пороговое значение k3max, объект оценивается как остававшийся около транспортного средства в течение долгого времени, и издается сигнал тревоги.

[Название решающего правила: Остановка транспортного средства (непостоянная временная зона)]

Если объект обнаружен как транспортное средство и дополнительно обнаружен как остановившийся, то непостоянная временная зона создается вокруг объекта (внешняя окружность объектного кластера расширяется в направлениях вверх, вниз, влево и вправо на величину половины размера объекта). Во временной зоне это занимает некоторое время для транспортного средства, чтобы стать фоном (этот период упоминается как период адаптации временной зоны). Впоследствии зона становится полезной и начинается операция оценки. Если объект обнаружен как человек во временной зоне, счетчик k3 временной зоны объекта увеличивается. Счетчики временной зоны объекта никогда не уменьшаются. Если счетчик превышает пороговое значение k3max, объект оценивается как остававшийся около остановившегося транспортного средства в течение долгого времени, и издается сигнал тревоги. Если транспортное средство обнаружено во временной зоне, начинается процесс удаления временной зоны. Это требует времени, пока фон в пределах зоны не будет обновлен. В течение этого периода в пределах данной временной зоны сигнал тревоги не выдается. После завершения "периода адаптации для возвращения" временная зона удаляется. В кадре обработки, в котором скорость остановившегося объекта/объекта, движущегося на низкой скорости, падает ниже порогового значения, счетчик k2 движения на низкой скорости увеличивается. В кадре обработки, в котором скорость объекта превышает порог, счетчик k2 движения на низкой скорости уменьшается. Если это значение счетчика превышает пороговое значение ("объект почти останавливается в пороговом числе кадров обработки"), определяется то, что этот объект остановился.

[Название решающего правила: Обездвиженный/извлеченный объект]

Если разделение объекта обнаружено (хотя был один объект в предыдущем кадре обработки, объект теперь наблюдается как два или больше объектов в соответствующей позиции), все "флажки разделения" этих объектов включены. Если определено, что один из объектов остановился, и флажок разделения включается, то этот объект оценивается как "обездвиженный или извлеченный объект".

<Вариант осуществления 2>

Устройство обработки видеоинформации системы охранной сигнализации варианта осуществления 2 отличается от варианта осуществления 1 в том, что преобразование TSV (пространственно-временная скорость) и т.п. используется для слежения за объектом. Устройство варианта осуществления 1 предпочтительно, чтобы обнаруживать проникновение определенного объекта (транспортного средства, лодки, человека) в место, где обычно нет людей, тогда как устройство варианта осуществления 2 имеет намерением обнаруживать объект с вызывающим сомнение поведением среди обычных проходящих мимо объектов.

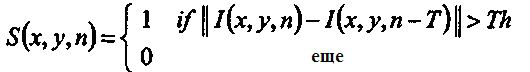

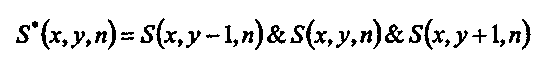

Преобразование TSV основано на трехмерном преобразовании Хафа в отношении пространственно-временных изображений, таких как следующие друг за другом кадры временной последовательности. В этом варианте осуществления, имеющем намерение получить геометрическое место точек объекта, используется линейное преобразование Хафа. Таким образом, линии обнаруживаются из пространства значений пикселов, заданного для трех измерений из двух пространственных измерений (вертикальное направление и горизонтальное направление исходного изображения) и временного измерения. В качестве изображения, которое должно быть подвергнуто TSV-преобразованию (упоминаемого как изображение начального обнаружения), следующая последовательность разностных изображений между смежными кадрами используется:

где S (x, y, n) обозначает изображение начального обнаружения n-ного кадра, I (x, y, n) обозначает входное изображение n-ного кадра, T обозначает константу времени, а Th обозначает пороговое значение (константу). Кроме уравнения (13), изображение обнаружения контура или фоновое разностное изображение варианта осуществления 1 могут использоваться как изображение начального обнаружения.

Чтобы улучшить качество, оператор 1x3 И используется относительно всех пикселов S (x, y, n), чтобы получить S*(x, y, n).

Представление преобразования TSV задается следующим образом:

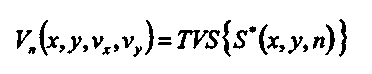

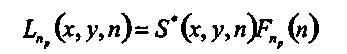

В преобразовании Хафа этого варианта осуществления фильтрация экспоненциального затухания применяется к S* (x, y, n) заранее так, чтобы вес мажоритарной выборки мог уменьшаться по мере того, как кадр устаревает:

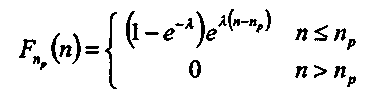

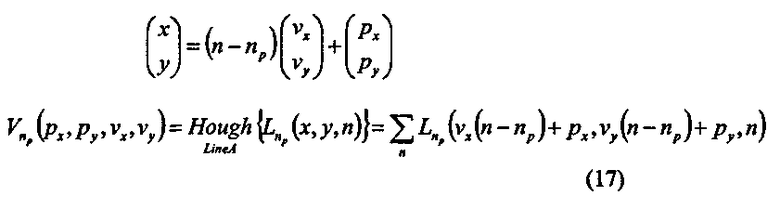

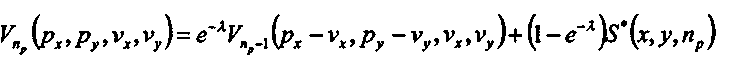

где S* (x, y, n) обозначает двоичное изображение n-ного кадра изображения, np обозначает индекс текущего кадра изображения, Fnp (n) обозначает фильтр, выраженный с помощью нижеприведенного уравнения (16), где n <=np:

Преобразование Хафа относительно LineA в пространственно-временной области выражается посредством нижеприведенного уравнения (17):

где (x, y) обозначает координату, (vx, vy) обозначает скорость, (px, py) обозначает опорную позицию (например, позицию в текущем кадре известного объекта), LineA обозначает линию, проходящую через точку (px, py) и имеющую градиент (vx, vy). Значение Vnp обозначает вероятность соответствующей линии во временную точку np.

В случае выражения экспоненциальной функции, Vnp может быть описана с помощью нижеприведенного уравнения регрессии:

px, py, vx и vy дискретизируются для того, чтобы задать ячейку, и уравнение (18) суммируется в пределах каждой ячейки, а затем преобразуется в двоичную форму как истина или ложь с помощью соответствующего порогового значения, и преобразованное в двоичную форму задается как V*np(px, py, vx, vy).

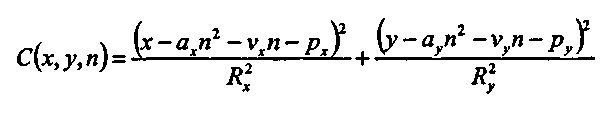

Здесь, наклонное цилиндрическое уравнение нижеприведенной модели движения вводится:

где центр цилиндрических координат - это (axn2+vxn+px, ayn2+vyn+py), и горизонтальный радиус и вертикальный радиус обозначены как Rx, Ry, соответственно. Параметры цилиндрических координат задаются посредством нижеприведенного уравнения (20):

где σk2 обозначает дисперсию на оси k, tk,1 обозначает ковариацию k и 1, а k со штрихом обозначает среднее значение k.

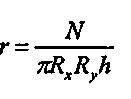

Цилиндрическая плотность, обозначающая действительность цилиндра, задается посредством нижеприведенного уравнения (21):

где h - это высота (т.е. наблюдаемое время) цилиндра, а N - это число ячеек TSV с истинным значением внутри цилиндра.

В этом варианте осуществления начальное обнаружение на основе межкадровой разности, описанной выше, выполняется параллельно с начальным обнаружением на основе фоновой разности по этапам 106-115 из варианта осуществления 1. Кроме того, этапы 120-121 из варианта осуществления 1 удалены, с тем чтобы перейти от этапа 119 к этапу 122, и параллельно с этим выполняется преобразование TSV. На этапе 122 информация о геометрическом месте точек, полученная посредством преобразования TSV, сравнивается с массивом “Merge”, полученным на этапе 119, и выполняется та же обработка, что и в варианте осуществления 1.

<Вариант осуществления 3>

Устройство обработки видеоинформации системы охранной сигнализации варианта осуществления 3 отличается от варианта осуществления 1 тем, что обработка скелета выполняется вместо или в дополнение к обработке сегментации и объединения по этапам 118, 119 из варианта осуществления 1. Обработка скелета включает в себя процесс получения информации о форме зоны начального обнаружения посредством процесса прореживания или обработки скелета относительно двоичного изображения, процесс выделения основных осей из информации о форме и процесс выделения осей объекта из выделенных осей.

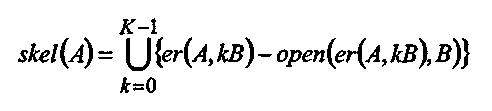

Изображение skel(A), полученное посредством обработки скелета для произвольного изображения A, выражается посредством нижеприведенного уравнения (22):

где B обозначает элемент структурирования (который предпочтительно является окружностью), er(A, kB) обозначает операцию размыва A K раз с помощью B, open(A, B) обозначает операцию открытия A с помощью B.

В этом варианте осуществления в качестве изображения A используется двоичное изображение, которое усечено с зоной предварительного обнаружения (описанный прямоугольник), полученной на этапе 117.

Фиг.5A-5F являются изображениями, показывающими пример обработки скелета этого варианта осуществления. Фиг.5A показывает изображение текущего кадра, усеченного с зоной предварительного обнаружения, содержащей объект (человека), фиг.5B показывает разностное изображение, соответствующее фиг.5A, фиг.5C показывает двоичное изображение по фиг.5B, а фиг.5D показывает прореженное (истонченное) изображение посредством обработки скелета по фиг.5C. На фиг.5D короткие тонкие линии очищены (удалены), и остающиеся базовые тонкие линии аппроксимированы с помощью двух полос, имеющих постоянную ширину.

Фиг.5E является результатом этой аппроксимации, показывая связанную границу полосы. Используя эту полосу, ее человек и основные оси тени могут быть определены, и более того, угол относительно ее вертикального направления этого может быть вычислен. Если один из углов полосы является приблизительно нулевым (почти вертикальным), а другой угол находится в пределах предварительно определенного диапазона, то определяется, что другой угол является тенью. Посредством заполнения двоичных изображений на стороне тени ложным значением, причем двоичные изображения разделены посредством связанной границы, получается изображение, в котором извлечен только человек, как показано в фиг.5F.

После того, как объектная маска исправлена, процессы после этапа 120 могут быть продолжены так, как в варианте осуществления 1.

<Вариант осуществления 4>

Устройство обработки видеоинформации системы охранной сигнализации варианта осуществления 4 выполняет процесс (далее упоминаемый как OS-обработка) выделения более чистого объекта из зоны предварительного обнаружения, вместо обработки сегментации и объединения по этапам 118, 119 из варианта осуществления 1.

В этом варианте осуществления зона предварительного обнаружения - это прямоугольная область, которая содержит объект-кандидат в пределах двоичных изображений, полученных начальным обнаружением объекта, причем прямоугольная область содержит горизонтальную или перпендикулярную сторону. Далее эта зона предварительного обнаружения упоминается как DZ. Цель процесса сегментации в DZ состоит в том, чтобы выразить пиксел "чистого" объекта, т.е. объектного изображения без пиксела фона, как изображение распознавания. Математически матрица изображений в DZ является входом для процесса разделения объектных областей DZ, а матрица объектных изображений DZ без фона является выходом процесса разделения объектных областей. Матрица изображений в типичном варианте выступает в качестве матрицы трехмерных векторов пиксела, содержащего RGB-компоненты, которая соответствует матрице пикселов в пределах DZ в исходном изображении.

Процесс OS по этому варианту осуществления является комбинацией следующих трех способов:

(1) Способ разностного анализа, выполняющий разностный анализ для фрагмента изображения, в котором объект обнаруживается, и изображения, в котором объект отсутствует (фоновое изображение), в DZ.

(2) Способ выделения фрагмента изображения на основе яркости, цвета, текстуры и т.п.

(3) Способ сегментации и усечения теней.

Фиг.6 - это блок-схема последовательности операций вышеуказанного способа (1), который выполняется для каждой DZ.

В качестве этапа 201 определяется то, содержится ли фон (точнее говоря, фон, который может быть разделен на этапах 202-206) в целевой DZ. Если фон не содержится, последовательность операций переходит к этапу 207, поскольку этапы 202-206 не имеют смысла.

В качестве этапа 202 выполняется обработка фильтрации текущего изображения и фонового изображения в DZ. Этот процесс включает в себя обработку медианного фильтра, так называемую обработку дискретизации ячеек (далее упоминаемую как обработка CD (ячеистое масштабное преобразование)) посредством обработки расширения изображения, и обработку фильтра нижних частот (процесс сглаживания).

Обработка CD содержит процесс преобразования каждого пиксела исходного изображения во фрагмент квадратного изображения, содержащий похожие пикселы, включая внешние пикселы от двух до трех или более соответствующего пиксела. Этот процесс полезен для того, чтобы поддерживать размер DZ как можно меньшим.

Если комбинация обработки медианного фильтра (которая должна быть выполнена перед CD) и обработки фильтра нижних частот (которая должна быть выполнена после CD) используется в обработке CD, укрупнение изображения в DZ и реконструкция маленького и низкокачественного изображения до определенного уровня может быть выполнена одновременно. Эти процессы одновременно осуществляются для кадра текущего изображения и кадра фонового изображения (опорного изображения) в каждой DZ, соответственно.

В качестве этапа 203 создается и обрабатывается разностный кадр (DF) в DZ. Это выполняется посредством двух отдельных процессов: процесса создания DF в каждой DZ из фильтрованного текущего изображения (содержащего объект) и фонового изображения (не содержащего объект) посредством этапа 202; и процесс преобразования в двоичную форму DF с помощью соответствующей пороговой величины значения пиксела. Процесс создания DF является простой обработкой вычитания каждого элемента фильтрованной матрицы изображения относительно текущего изображения и фонового изображения в DZ. При обработке цветного изображения разность между векторами определяется результатом вычисления величины вектора. В обработке преобразования в двоичную форму такая же обработка, что и на этапе 109 варианта осуществления 1, выполняется с помощью предварительно определенного порогового значения.

В качестве этапа 204 выполняется процесс выделения связанной области. Процесс выделения связанной (интегрированной) области - это процесс выделения области, связанной как один блок в пределах каждой DZ и имеющей предварительно определенный размер (число пикселов) или размер, больший чем предварительно определенный размер. Этот процесс является таким же, что и процесс из этапа 112 варианта осуществления 1.

В качестве этапа 205 полезная область выделяется из множества связанных областей, которые выделены на этапе 203. В качестве кандидата для полезной области выбирается наибольшая (оцененная на основе числа пикселов) связанная область, и она обозначается как ArM. Затем осуществляется процесс заполнения бреши, существующей в пределах ArM.

Чтобы выполнить его, сначала создается обратное изображение, имеющее только ArM.

Далее связанная область, которая не является смежной с границей DZ, выделяется из созданного обратного изображения. Поскольку эта область является брешью, ArM корректируется посредством заполнения этой области "истиной".

С учетом заполняющей брешь области, полезная геометрическая информация об объекте может быть получена для распознавания или удаления. Тем не менее, несмотря на это простая связанная объектная область все еще должна получать полезный признак (в частности, информацию о скелете в объектной области).

В качестве этапа 206 определяется то, может ли полезная область быть выделена на этапе 204, и если полезная область может быть выделена, то последовательность операций переходит к этапу 212, иначе переходит к этапу 206.

В качестве этапа 207 выполняется сегментация на основе яркости (сигнала яркости). Например, значение Y формата YUV или V из HUV дискретизируется, и все пикселы в пределах DZ сортируются в группы этих дискретных значений. Сортированные пикселы преобразуются в пикселы связанной области посредством пространственной фильтрации.

В качестве этапа 208 выполняется сегментация на основе цвета, как на этапе 205.

В качестве этапа 209, DZ сегментируется в блоки из нескольких пикселов в квадрате и вычисляется значение текстуры для каждого блока, а после этого области формируются посредством группировки блоков с помощью значения текстуры.

В качестве этапа 210, из комбинации сегментаций на этапах 205-207, множество кандидатов для полезной области создается на основе предварительно определенного правила.

В качестве этапа 211, из множества кандидатов для полезной области, одна полезная область выделяется на основе предварительно определенного масштаба (например, размера области).

В качестве этапа 212 теневое обнаружение и сегментация и теневое отсечение выполняются с помощью, например, той же обработки скелета, как и в варианте осуществления 3.

В качестве этапа 213 откорректированная объектная маска применяется к текущему изображению, чтобы получить матрицу изображения только фактического объекта.

<Вариант осуществления 5>

В устройстве обработки видеоинформации системы охранной сигнализации варианта осуществления 5 улучшен процесс установки из этапа 104 варианта осуществления 1.

(1) Конфигурация оборудования этого варианта осуществления

Конфигурация устройства обработки изображения показана на фиг.9. Это устройство мониторинга включает в себя блок 501 формирования изображений, блок 502 видеоввода, процессор 503 изображений, память 504 для хранения программ, рабочую память 505, внешнюю I/F-схему 506, схему 507 видеовывода, шину 508 данных, блок 509 индикации и блок 510 отображения.

(2) Способ для указания условий мониторинга согласно этому варианту осуществления

Примеры условий мониторинга в этом варианте осуществления показаны на фиг.7, фиг.8. Фиг.7 - это сценарий для того, чтобы выполнять мониторинг нарушений по скорости движения и направлению движения транспортного средства, причем если транспортное средство движется на скорости не больше чем предварительно определенная скорость и в предварительно определенном направлении, транспортное средство разрешено (т.е. транспортное средство не является как объектом, по которому необходимо выдавать сигнал тревоги, так и объектом, по которому должен выполняться мониторинг), иначе транспортное средство запрещено (т.е. транспортное средство является объектом, по которому необходимо выдавать сигнал тревоги и должен выполняться мониторинг). Фиг.8 показывает промежуточный сценарий, с помощью которого условия мониторинга, указанные в формате сценария, подвергаются лексическому анализу в процессоре 503 изображений. В промежуточном сценарии, ": =" - это оператор, обозначающий описание, левая сторона (значение с левой стороны) из ": =" обозначает целевое описание, а правая сторона (значение с правой стороны) из ": =" обозначает условия описания. Более того, "=" - это оператор, обозначающий сравнение, значение с левой стороны из "=" обозначает информацию об объекте, а значение с правой стороны из "=" обозначает значение условия, которое устанавливает пользователь.

(Примеры списка операторов и списка информации об объекте и пример процедуры преобразования из сценария в промежуточный сценарий должны быть дополнены).

(3) Формирование таблицы решений и оценка с помощью таблицы решений

Фиг.10 показывает пример таблицы решений. В этом варианте осуществления, поскольку условие оценки содержит комбинацию множества условий, удовлетворяет ли обнаруженный объект условиям мониторинга, определяется с помощью таблицы решений, как показано в фиг.10. Здесь для простоты описания продемонстрирован случай, в котором таблица решений создана с помощью двух фрагментов информации по ширине и высоте обнаруженного объекта, посредством чего может быть определено удовлетворяет ли обнаруженный объект (к примеру, объект 3 м в ширину и 1,5 м в высоту) условию 401, другими словами, может ли обнаруженный объект быть определен как [АВТОМОБИЛЬ]. Во-первых, на фиг.8, поскольку условия относительно высоты условия 401 - это [ШИРИНА] = [не меньше чем 2 м] и [ШИРИНА] = [меньше чем 5 м], ось [ШИРИНА] таблицы решений, т.е. горизонтальная ось одинаково разделена на пять, которые в таком случае помечаются как [меньше чем 2 м], [2 м], [меньше чем 5 м], [5 м], и [больше чем 5 м], соответственно. При этом причина, по которой есть пять меток, заключается в том, что условия [ШИРИНЫ] состоят из двух значений условия [не меньше чем 2 м] и [меньше чем 5 м], и таким образом граничные части для различения "не меньше чем" и "меньше чем" от других, обязательно должны быть включены. Кроме того, если одно значение условия [ШИРИНА] = [не меньше чем 2 м] достаточно хорошее, предоставляются три подразделения. Соответственно, максимальное число подразделений - это число, в два раза превышающее число значений условия плюс 1. Далее часть, удовлетворяющая этому условию, заполняется 1 (например, ссылка с номером 603), а часть, не удовлетворяющая этому условию, заполняется -1 (например, ссылка с номером 602). Если это также выполнено для оси [ВЫСОТА], получается таблица 601 решений, показанная в фиг.10. Затем, поскольку обнаруженный объект составляет 3 м по ширине и 1,5 м по высоте, то часть, обозначенная ссылкой с номером 603, заполнена 1 согласно данной таблице решений, и можно оценить то, что обнаруженный объект удовлетворяет условию. Даже если число условий возрастает, только число осей этой таблицы решений и число подразделений каждой оси должно быть изменено, и на практике размер данных до такой степени, которая может быть сохранена в рабочей памяти, может быть обработан. Кроме того, в этом способе то, удовлетворяется условие или нет, выражается с помощью значений, таких как -1 и 1, тем не менее, условие, при котором решение не принимается (все равно), может быть выражено с помощью другого значения (например, 0 и т.п.).

Согласно этому варианту осуществления условия мониторинга могут быть указаны с помощью читаемого простого предложения (сценария), и кроме того, множество условий выполнены с возможностью быть логически оценены, тем самым предоставляя возможность указания сложных условий в сравнении с предшествующим уровнем техники, и дополнительно предоставляя возможность выполнения простой и правильной спецификации.

(Если специальные условия мониторинга конфигурированы заранее, с тем чтобы загружаться через сеть, службы, гибко соответствующие различным средам мониторинга, могут быть реализованы, тем самым также предоставляя возможность составления бизнес-модели).

<Вариант осуществления 6>

(1) Конфигурация оборудования этого варианта осуществления

Конфигурация оборудования и основные операции варианта осуществления 6 являются такими же, как и в варианте осуществления 5.

(2) Установка области мониторинга в этом варианте осуществления

В области 1301 мониторинга, в системе координат сцены (второй системе координат, параллельной земле и похожей на карту), информация о карте области, по которой должен выполняться мониторинг, указывается с помощью блока индикации (фиг.12). Информация о высоте области, по которой должен выполняться мониторинг, предоставляется с помощью числового значения и т.п. Поскольку информация о высоте соответствует координате оси z системы координат сцены (когда высота плоскости xy равна 0), информация о высоте может быть предоставлена как фактическое значение (2 м, 3 фута и т.п.) без базирования на видимой высоте.

Индикация относительно области 1301 мониторинга может быть сделана непосредственно в системе координат камеры, такой как входное изображение и т.п. (фиг.11). Высота области, по которой должен выполняться мониторинг, может быть предварительно установлена заранее. Область мониторинга может быть указана с помощью круга или линии в дополнение к многоугольнику, и обработанная область может быть указана с помощью различных шаблонов, таких как цилиндрическая форма, сферическая форма, перпендикулярная плоскость.

(3) Способ вычисления расстояния между камерой и точкой в области мониторинга в этом варианте осуществления

Позиция (x', y') в системе координат камеры преобразуется в позицию (x, y) в системе координат сцены.

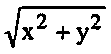

Поскольку система координат сцены подобна карте, расстояние между камерой и точкой в области мониторинга составляет  , когда начало координат 0 системы координат сцены является позицией камеры.

, когда начало координат 0 системы координат сцены является позицией камеры.

(4) Способ вычисления видимой высоты целевого объекта, для которого должен выполняться мониторинг, в вышеописанной точке

Координата камеры на верхней стороне целевого объекта обозначена как (x'_head, y'_head), а координата камеры на нижней стороне целевого объекта обозначена как (x'_legs, y'_legs).

Во-первых, следующие координаты вычисляются в соответствии с уравнением преобразования в координаты сцены с помощью условия установки камеры:

Координата сцены верхней стороны целевого объекта - (x_head, y_head)

Угол падения для формирования изображения верхней стороны - θy_head

Координата сцены нижней стороны целевого объекта - (x_legs, y_legs)

Угол падения для формирования изображения нижней стороны - θy_legs

Угол поворота - θx = θ x_head = θ x_legs

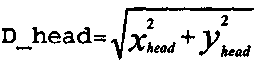

Расстояние между камерой и верхней стороной целевого объекта -

Расстояние между камерой и нижней стороной целевого объекта в координатах сцене -

Фиг.14 показывает пример формирования изображений целевого объекта, для которого должен выполняться мониторинг 1601.

Согласно фиг.14 высота целевого объекта (Height) геометрически вычисляется посредством нижеприведенного уравнения (1-1):

Height = (D_head-D_legs)/tan(90°-θy_head) (1-1)

(5) Способ вычисления видимой высоты посредством преобразования в систему координат сцены

[Видимая высота] вычисляется (т.е. обратное вычисление для вышеупомянутого (4)), чтобы посмотреть, какая позиция (x_head, y_head) в координатах сцены для информации высоты (Height) в точке (x_legs, y_legs) области мониторинга появляется.

θy_head может быть выражено следующим образом с помощью высоты установки H блока формирования изображений:

tan(θy_head)=(H-Height)/D_legs (1-2)

[tan(90°-θy_head)=D_legs/(H-Height)]

Уравнение (1-1) преобразуется, а затем уравнение (1-2) подставляется.

D_head=(Height-D_legs)/(H-Height)+D_legs

Соответственно, координата (x_head, y_head) верхней стороны области мониторинга может быть вычислена следующим образом:

x_head=D_head·cos(θx)

y_head=-D_head·sin(θx)

Кроме того, координата (x '_head, y '_head) камеры также может быть вычислена в соответствии с преобразованием координат, и видимая высота в координате камеры также может быть легко выражена.

(6) Способ формирования обработанной области из области мониторинга на основе видимой высоты

Соответствующие видимые высоты вычисляются из каждой координаты области 1301 мониторинга, указанной в (2), и информации о высоте области мониторинга. Посредством установления каждой координаты, которую имеет видимая высота, и каждой координаты, которую имеет обозначенная область мониторинга, для обработанной области (фиг.13) может быть создана трехмерная обработанная область 1401 с учетом высоты области 1301 мониторинга.

В этом варианте осуществления посредством установления области мониторинга (на карте) трехмерная обработанная область, учитывающая высоту области мониторинга, может быть автоматически установлена, и поэтому может быть реализовано простое установление области без базирования на видимом размере. Более того, поскольку установление области посредством фактического измерения высоты объекта, отраженного во входном изображении, не требуется, сложность установления может быть уменьшена.

Кроме того, область мониторинга может быть установлена в системе координат сцены и координата на карте может использоваться, как оно есть, при установлении области. Помимо этого, возможны установление полезной области и мониторинг нарушителя в комбинации с предыдущими вариантами применения, такими как совместное использование областей мониторинга между несколькими устройствами мониторинга.

Специалистам в данной области техники следует понимать, что хотя предшествующее описание сделано по вариантам осуществления изобретения, изобретение не ограничено ими, и различные изменения и модификации могут быть сделаны без отступления от сущности изобретения и объема прилагаемой формулы изобретения.

| название | год | авторы | номер документа |

|---|---|---|---|

| СПОСОБ ОБНАРУЖЕНИЯ ОБЪЕКТОВ | 2008 |

|

RU2395787C2 |

| СПОСОБ ОБРАБОТКИ ПОСЛЕДОВАТЕЛЬНОСТИ ИЗОБРАЖЕНИИ ДЛЯ ОПРЕДЕЛЕНИЯ КООРДИНАТ ОБЪЕКТОВ НА ОСНОВЕ КОМПЛЕКСИРОВАНИЯ БАЗОВЫХ АЛГОРИТМОВ | 2014 |

|

RU2575401C1 |

| СПОСОБ ОБРАБОТКИ ПОСЛЕДОВАТЕЛЬНОСТИ ИЗОБРАЖЕНИЙ ДЛЯ ОБНАРУЖЕНИЯ И СЛЕЖЕНИЯ ЗА ВОЗДУШНЫМИ ОБЪЕКТАМИ | 2010 |

|

RU2419150C1 |

| Способ оптического обнаружения слабоконтрастных динамических объектов на сложном атмосферном фоне | 2015 |

|

RU2634374C2 |

| СПОСОБ ОБРАБОТКИ ПОСЛЕДОВАТЕЛЬНОСТИ ИЗОБРАЖЕНИЙ ДЛЯ АВТОМАТИЧЕСКОГО ОБНАРУЖЕНИЯ ТАНКЕРА И ОЦЕНИВАНИЯ ЕГО ТРАЕКТОРНЫХ ПАРАМЕТРОВ ПРИ ДОЗАПРАВКЕ В ВОЗДУХЕ НА ФОНЕ ЗВЕЗДНОГО НЕБА | 2016 |

|

RU2624828C1 |

| СПОСОБ ОБНАРУЖЕНИЯ И АВТОСОПРОВОЖДЕНИЯ ОБЪЕКТОВ ЦЕЛЕУКАЗАНИЯ ОПТИКО-ЭЛЕКТРОННОЙ СИСТЕМОЙ БЕСПИЛОТНОГО ЛЕТАТЕЛЬНОГО АППАРАТА | 2020 |

|

RU2748763C1 |

| СПОСОБ И СИСТЕМА ВЫДЕЛЕНИЯ ДАННЫХ ОБ ИЗОБРАЖЕНИИ ОБЪЕКТА ПЕРЕДНЕГО ПЛАНА НА ОСНОВЕ ДАННЫХ О ЦВЕТЕ И ГЛУБИНЕ | 2010 |

|

RU2426172C1 |

| Устройство для удаления логотипов и субтитров с видеопоследовательностей | 2017 |

|

RU2669470C1 |

| Способ анализа видеопотока | 2018 |

|

RU2676026C1 |

| Способ контроля пространственного положения участников спортивного события на игровом поле | 2016 |

|

RU2616152C1 |

Изобретение относится к устройствам обработки информации системы охранной сигнализации. Техническим результатом является расширение функциональных возможностей за счет сокращения количества ложных срабатываний и улучшения точности обнаружения границы движущегося объекта. Способ для точного обнаружения объекта из видео, содержащего природные явления и искусственные возмущения, в котором на основе вычисления разности с фоном выполняется преобразование в двоичную форму с помощью порогового изображения, которое получено посредством умножения изменения в каждом значении пиксела входного изображения на коэффициент. Изменение усредняется во времени на основе коэффициента обновления для каждого пиксела, коэффициент обновления переключается в зависимости от того, принадлежит ли соответствующий пиксел объекту. Далее из двоичного изображения формируется начальная зона обнаружения и для нее выполняется процесс пространственной фильтрации. 3 з.п. ф-лы, 19 ил.

1. Способ обнаружения объекта для обнаружения объекта в видеоизображении, содержащий этапы, на которых:

- вычисляют среднее значение во временной области для каждого пиксела в изображении;

- вычисляют дисперсию или среднеквадратичное отклонение во временной области для каждого пиксела в изображении с помощью константы времени, которая является переменной для каждого пиксела;

- вычисляют максимальное значение во временной области для дисперсии или среднеквадратичного отклонения для каждого пиксела в изображении;

- преобразуют в бинарную форму текущее изображение с помощью порогового значения на основе значения, полученного посредством умножения максимального значения на предварительно определенный коэффициент, для каждого пиксела в изображении;

- помечают преобразованное в бинарную форму изображение и обрабатывают таким образом найденное множество связанных областей как зоны предварительного обнаружения;

- управляют регулируемой константой времени в зависимости от того, классифицирован ли пиксел на фон или объект, для каждого пиксела в изображении;

- вычисляют геометрические атрибуты в реальном пространстве множества зон предварительного обнаружения и демонстрируют на экране зоны предварительного обнаружения на основе геометрических атрибутов;

- выполняют пространственную фильтрацию, включающую в себя, по меньшей мере, однин из следующих видов обработки: скелетизация, обработки маски объекта, морфологические операции и сегментирование, для преобразованного в бинарную форму изображения или изображения, извлеченного из преобразования в бинарную форму;

- регистрируют зону предварительного обнаружения, которая подвергнута этапу пространственной фильтрации или этапу демонстрации на экране, как зону слежения, и обновляют зарегистрированную зону слежения в соответствии со степенью совпадения с сохраненной предшествующей зоной слежения, либо отслеживают временное позиционное изменение интересующей зоны слежения посредством выделения линейного компонента во времени и пространстве;

- группируют соседние зоны слежения в кластер на основе предварительно определенного правила; и

- определяют кластер на основе размера кластера или множества условий, определяющих, по меньшей мере, одно из изменения относительной позиции для предварительно определенной области мониторинга и изменения относительной позиции для другого кластера.

2. Способ обнаружения объекта по п.1, в котором этап определения использует предварительно определенную область мониторинга, при этом предварительно определенная область мониторинга определяется или многоугольной призмой, или цилиндром, перпендикулярным к земле, или плоской областью с помощью системы координат, имеющей две ортогональные оси, параллельные земле.

3. Способ обнаружения объекта по п.1, в котором обработка скелетного анализа содержит этапы, на которых:

- получают информацию о форме относительно зоны предварительного обнаружения посредством выполнения процесса прореживания или скелетизации для преобразованного в бинарную форму изображения;

- выделяют основные оси из информации о форме и

- выделяют оси объекта посредством исключения осей тени из выделенных осей.

4. Способ обнаружения объекта по п.1, дополнительно содержащий этапы, на которых:

- вводят множество условий, описанных в формате сценария, в качестве сценария условий мониторинга, допускающего указание приоритетов для соответствующих условий и указание отключения или включения обнаружения; и

- анализируют логику сценария условий мониторинга и формируют таблицу решений, при этом: