Область техники, к которой относится изобретение

Обладающий признаками изобретения объект в общем относится к распределенным приложениям, и, более конкретно, к распределенным мультимодальным приложениям, реализуемым в системной среде "клиент - сервер".

Уровень техники

"Модальность" пользовательского интерфейса может быть определена как режим взаимодействия между пользователем и электронным устройством, где взаимодействие реализовано через пользовательский интерфейс устройства. Модальность пользовательского интерфейса может быть реализована через комбинацию аппаратного обеспечения и программного обеспечения, связанных с конкретным типом воспринимаемой человеком информации (например, информации, воспринимаемой с помощью зрения, звука или касания) и/или генерируемой человеком информации (например, информации, производимой через речь или другое физическое действие). Например, один тип модальности пользовательского интерфейса представляет собой "визуальную модальность", которая может быть реализована через экран дисплея, и связанное аппаратное обеспечение, и программное обеспечение для генерирования визуальных отображений на экране дисплея. Визуальная модальность также может быть реализована с использованием различных устройств ввода, которые облегчают взаимодействие пользователя с визуальным отображением, таких как устройства ввода, которые дают возможность пользователю выбирать информацию, воспроизводимую в визуальном отображении (например, с использованием механизма прокрутки, сенсорного экрана или клавиш со стрелкой), чтобы вводить информацию в области визуального отображения (например, с использованием клавишной панели) и/или изменять фокусирование визуального отображения от одной области к другой. Другой тип модальности пользовательского интерфейса представляет собой "голосовую модальность", которая может быть реализована с использованием микрофона, динамика и связанных аппаратного обеспечения и программного обеспечения, адаптированных так, чтобы принимать и оцифровывать человеческую речь и/или выводить звуковые данные (например, звуковые подсказки или другую звуковую информацию). Другие типы модальностей пользовательского интерфейса включают в себя, например, жестикуляционные модальности и перьевые модальности, из которых указаны только две.

В интересах обеспечения улучшенного удобства и простоты использования, по сравнению с устройствами "единственной модальности", многие электронные устройства включают в себя "мультимодальный" пользовательский интерфейс, который представляет собой пользовательский интерфейс, обеспечивающий более, чем одну модальность пользовательского интерфейса. Например, электронное устройство может обеспечивать и визуальную модальность, и голосовую модальность. Такое устройство может, например, одновременно выводить визуальную информацию (например, отображаемую на дисплее информацию) и связанную звуковую информацию (например, звуковые подсказки), и/или устройство может обеспечивать возможность пользователю вводить информацию через речь, клавишную панель или через то и другое, по желанию пользователя. В общем, устройство, имеющее мультимодальный пользовательский интерфейс, обеспечивает улучшенное впечатление пользователя, потому что пользователь может выбирать модальность, с помощью которой он или она будет взаимодействовать с устройством. Взаимодействие с использованием голосовой модальности может быть желательным, например, в ситуациях, в которых пользователь желает взаимодействовать без помощи рук, в таких, например, как в случае, когда печатание отнимает слишком много времени, и/или когда пользователь имеет нарушение здоровья, либо постоянное (например, из-за артрита или некоторой другой физической нетрудоспособности), либо ситуационное (например, когда на руках пользователя надеты перчатки и/или когда руки пользователя заняты другими работами). Напротив, взаимодействие с использованием визуальной модальности может быть желательным, например, в ситуациях, в которых должна быть воспроизведена комплексная информация, когда желательна слуховая конфиденциальность, когда существуют шумовые ограничения и/или когда имеются слуховые ограничения, либо постоянные (например, когда пользователь имеет сильный акцент, дефект речи и/или снижение слуха), либо ситуационные (например, когда имеется существенный фоновый шум или шумовые ограничения).

Мультимодальный пользовательский интерфейс может быть реализован в связи с приложением, которое работает в сетевой среде (например, в системной среде "клиент - сервер"). В таком случае, пользователь взаимодействует с мультимодальным пользовательским интерфейсом на клиентском устройстве (например, на телефоне для сотовой связи или на компьютере), и клиентское устройство устанавливает связь с одним или более другими устройствами или платформами (например, с сервером) через сеть. В такой сетевой среде были реализованы две основные методики, чтобы конструировать системные элементы "клиент - сервер", которые поддерживают мультимодальный пользовательский интерфейс, и, более конкретно, системные элементы, которые поддерживают пользовательский интерфейс, адаптированный так, чтобы обеспечивать по меньшей мере визуальную и голосовую модальности. При использовании "внедренной" методики, по существу все необходимые аппаратное обеспечение и программное обеспечение, связанные с множеством модальностей, включены непосредственно в клиентское устройство. Например, клиентское устройство может включать в себя программное обеспечение и аппаратное обеспечение, адаптированные так, чтобы выполнять связанные со звуком задачи, такие как обработка речи, распознавание речи и/или синтез речи, помимо всего прочего. В общем, такие связанные со звуком задачи вызывают необходимость в специальных процессорах или механизмах обработки данных (например, процессорах цифровых сигналов) и существенных объемах памяти (например, для сохранения таблиц и программного обеспечения, относящегося к связанным со звуком задачами). При использовании "распределенной" методики некоторая часть обработки, связанная с одной или более модальностями, может быть перемещена на другой обрабатывающий элемент, такой как удаленный сервер. Например, когда пользователь говорит, звуковые данные могут быть посланы из клиентского устройства на удаленный сервер, и удаленный сервер может выполнять некоторые или все связанные со звуком задачи и возвращать данные, сообщения об ошибке и/или результаты обработки на клиентское устройство.

Каждая методика имеет свои преимущества и недостатки. Например, преимущество некоторых общепринятых распределенных методик состоит в том, что некоторые из интенсивных в вычислительном отношении процессов, связанных с мультимодальным пользовательским интерфейсом (например, связанные со звуком задачи) могут быть перемещены с клиентского устройства на другой обрабатывающий элемент (например, удаленный сервер), как только что было упомянуто. Соответственно, клиентское устройство может не включать в себя специальные процессоры или механизмы обработки данных (например, процессоры цифровых сигналов) и дополнительную память для реализации задач, которые перемещены из клиентского устройства. Это означает, что клиентское устройство может быть разработано более рентабельным способом (например, устройство может быть разработано в виде "тонкого" клиента), чем клиентские устройства, которые реализуют внедренную методику.

Однако, при использовании общепринятых распределенных методик, состояния различных модальностей должны быть синхронизированы между клиентом и сервером. Трудно достигать единообразной синхронизации между состояниями множества модальностей через сеть. Более конкретно, при использовании общепринятых распределенных методик синхронизация между визуальной модальностью и голосовой модальностью может быть ненадежной, помимо всего прочего, из-за задержек, свойственных сетевой связи. Например, когда пользователь обеспечивает на словах ввод для поля ввода данных, клиентское устройство посылает данные, отражающие устный ввод, на сервер и ждет результат распознавания речи, который сервер должен возвратить прежде, чем может быть обновлено визуальное отображение, чтобы отобразить результат распознавания речи. В некоторых случаях обновление визуального отображения так, чтобы отразить обеспечиваемый на словах ввод, не может происходить достаточно своевременным образом, и визуальная и голосовая модальности могут оказываться не синхронизированными. Кроме того, реализацию мультимодального пользовательского интерфейса при использовании общепринятых распределенных методик обычно выполняют с использованием нестандартных протоколов и авторских методик нетрадиционного содержания. Соответственно, такие методики нелегко охватывать большой частью несущих или программных средств создания прикладных пакетов.

Соответственно, существует необходимость в способах и устройствах мультимодальных пользовательских интерфейсов, которые могут облегчать проектирование "тонких" клиентов и использование стандартных протоколов и авторских методик общепринятого содержания, и которые могут преодолевать проблемы синхронизации, свойственные общепринятым распределенным методикам. Другие признаки и характеристики обладающего признаками изобретения объекта станут очевидными из последующего подробного описания и прилагаемой формулы изобретения при рассмотрении их совместно с прилагаемыми чертежами и данным Предшествующим уровнем техники.

Краткое описание чертежей

В дальнейшем обладающий признаками изобретения объект будет описан вместе со следующими чертежами, на которых подобные ссылочные позиции обозначают подобные элементы, и где

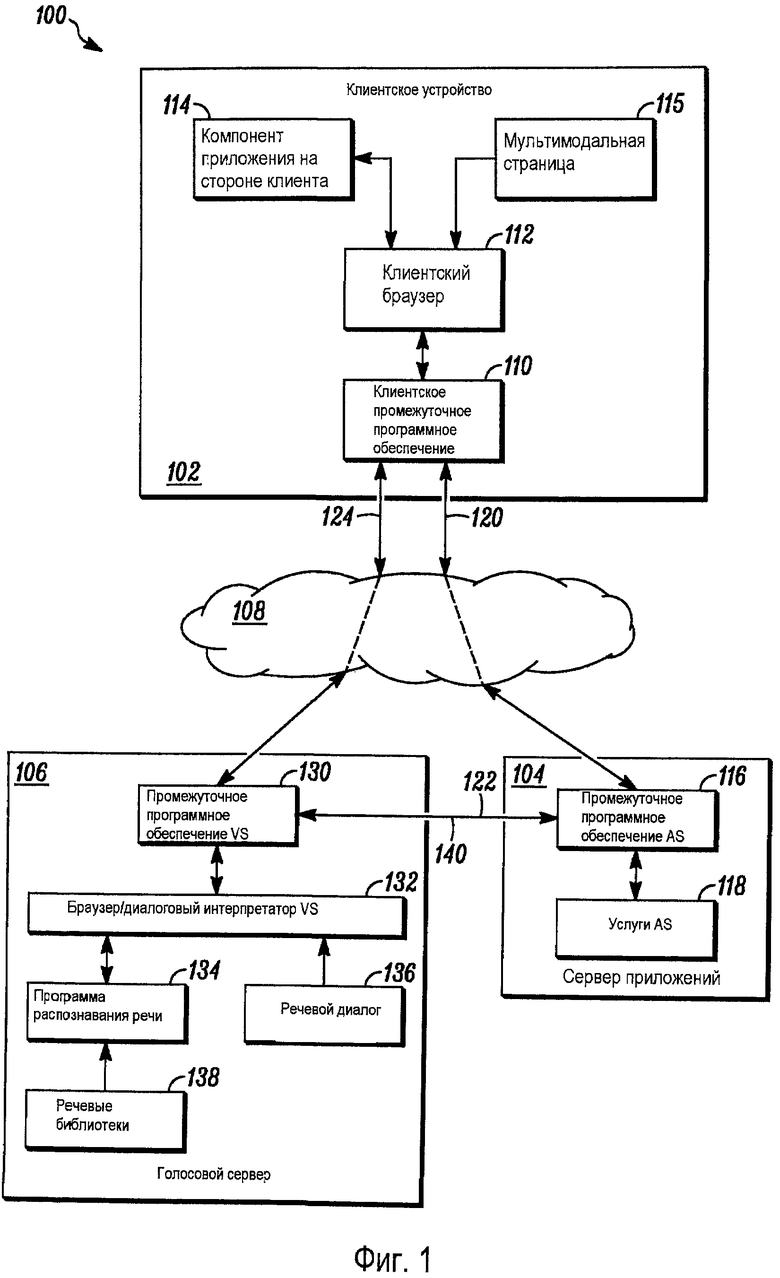

фиг. 1 - упрощенная схема системы, адаптированной для реализации распределенных мультимодальных приложений, в соответствии с примерным вариантом осуществления;

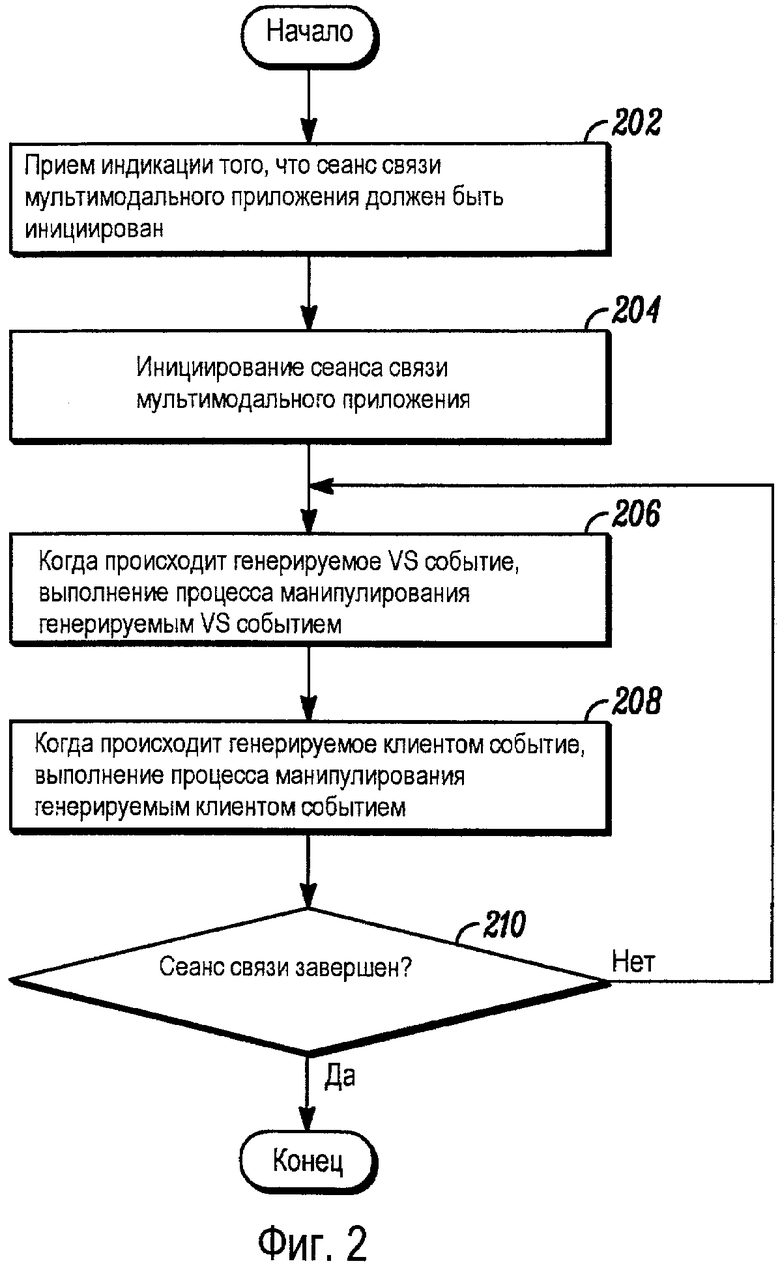

фиг. 2 - блок-схема способа инициирования и проведения сеанса связи мультимодального приложения, в соответствии с примерным вариантом осуществления;

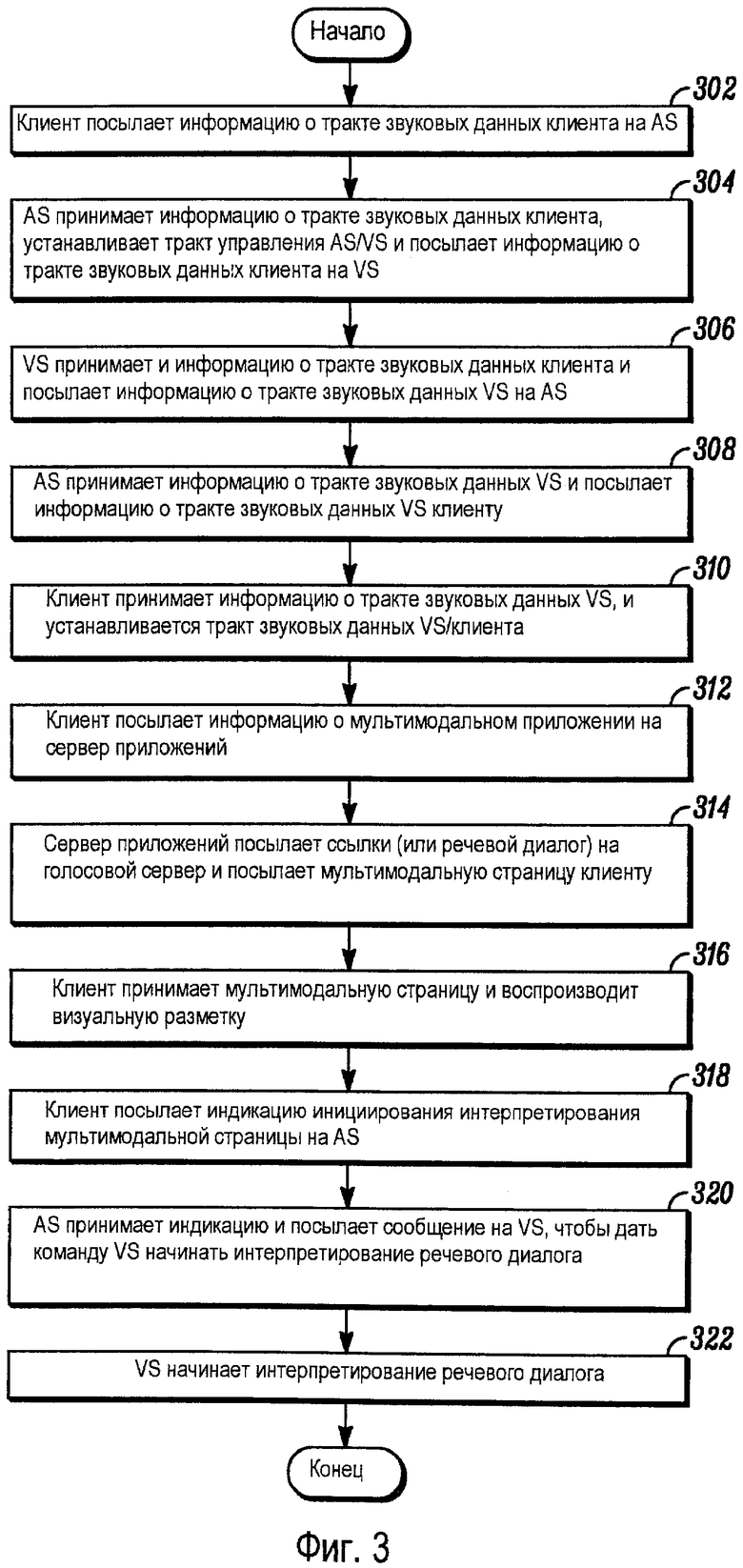

фиг. 3 - блок-схема способа выполнения инициирования сеанса связи мультимодального приложения, в соответствии с примерным вариантом осуществления;

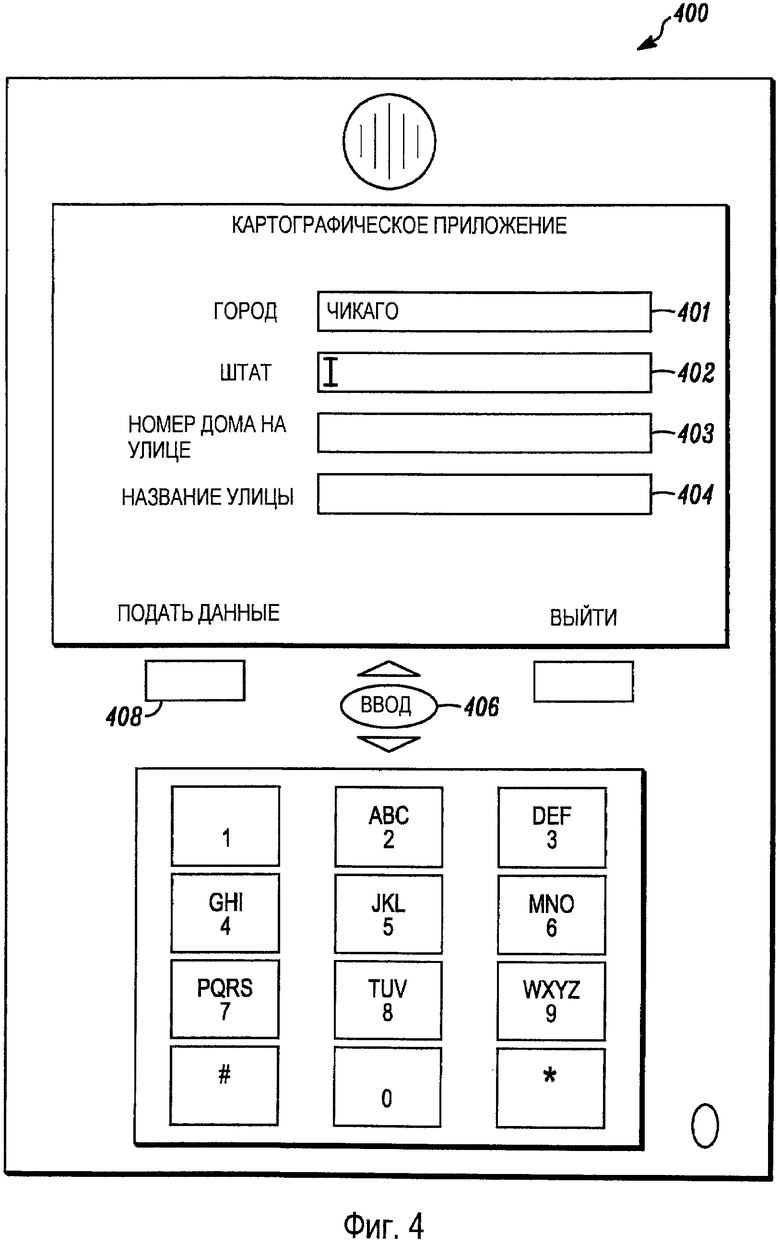

фиг. 4 - пример визуальной разметки, воспроизводимой на клиентском устройстве, в соответствии с примерным вариантом осуществления;

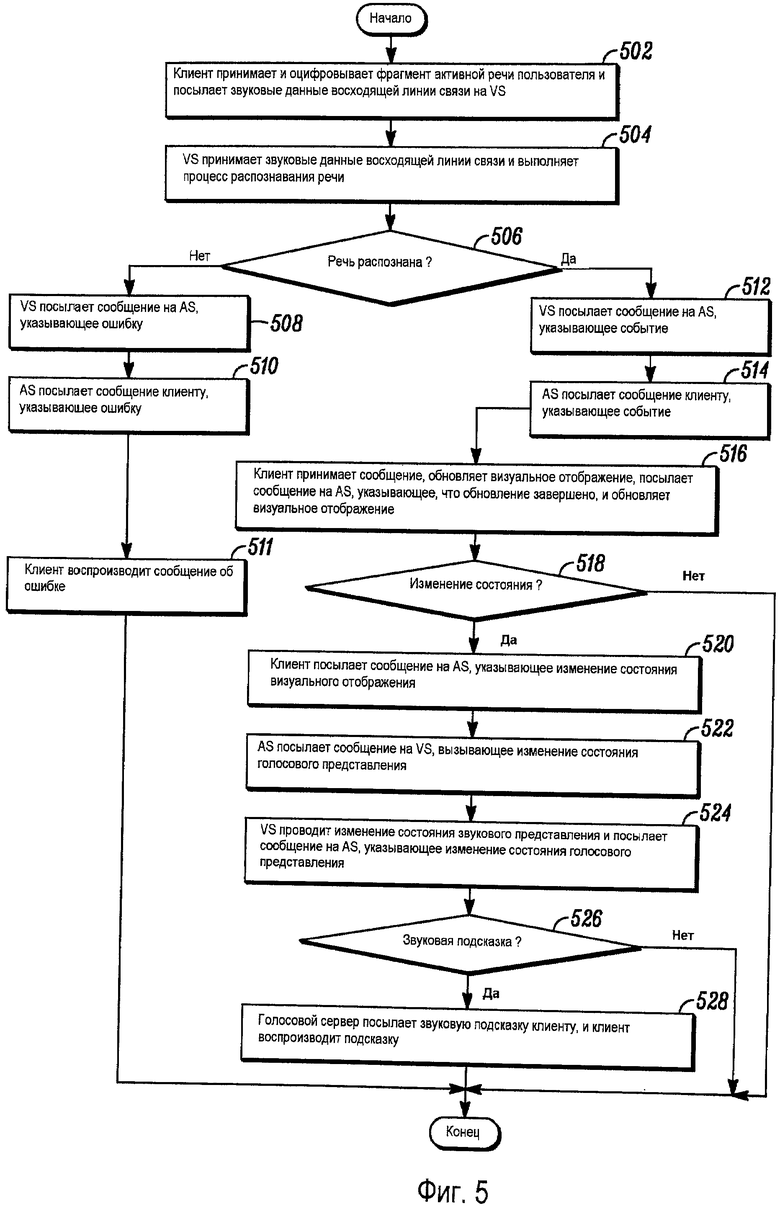

фиг. 5 - блок-схема способа выполнения процесса манипулирования генерируемым голосовым сервером событием, в соответствии с примерным вариантом осуществления; и

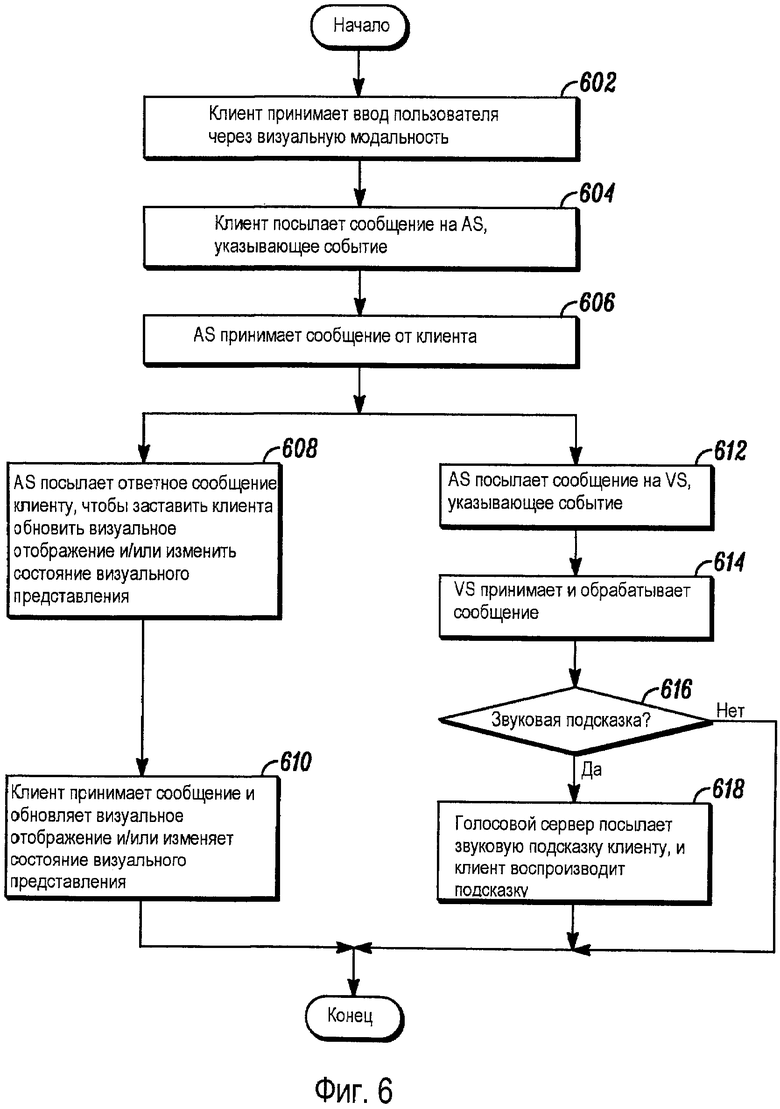

фиг. 6 - блок-схема способа выполнения процесса манипулирования генерируемым клиентом событием, в соответствии с примерным вариантом осуществления.

Подробное описание

Варианты осуществления включают в себя способы и устройство для реализации распределенных мультимодальных приложений. Эти варианты осуществления могут облегчать использование стандартных протоколов и авторских методик общепринятого содержания, а также могут преодолевать проблемы синхронизации, свойственные некоторым общепринятым распределенным методикам. Кроме того, эти варианты осуществления можно использовать вместе с устройствами типа "тонкий клиент".

Как используется в данном описании, термин "мультимодальный" означает "адаптированный для реализации множества модальностей пользовательского интерфейса". Термины "распределенное мультимодальное приложение", "мультимодальное приложение" и "распределенное приложение" могут использоваться взаимозаменяемым образом, чтобы обозначать программное приложение, которое обеспечивает мультимодальный пользовательский интерфейс в клиентском устройстве (например, в клиентском устройстве 102, фиг. 1), и которое включает в себя отдельные компоненты, выполняемые в отдельных оперативных средствах на различных платформах (например, клиентское устройство 102, сервер 104 приложений и/или голосовой сервер 106, фиг. 1), где различные платформы взаимосвязаны через сеть (например, через сеть 108, фиг. 1).

В варианте осуществления, распределенные мультимодальные приложения адаптированы для выполнения в системе, имеющей архитектуру системы "клиент - сервер" (например, в системе 100, фиг. 1). Как используются в данном описании, термины "клиент" или "клиентское устройство" могут использоваться взаимозаменяемым образом, чтобы обозначать объект обработки данных, электронное устройство или приложение, которое адаптировано так, чтобы выполнять программное обеспечение, связанное с распределенным мультимодальным приложением (например, клиентский браузер и/или компонент приложения на стороне клиента). Кроме того, клиентское устройство адаптировано так, чтобы получать доступ через сеть к одной или более услугам, которые связаны с распределенным мультимодальным приложением и которые обеспечиваются одним или более удаленными серверами.

Термин "сервер" означает объект обработки данных, электронное устройство или приложение, которое выполняет услуги для одного или более связанных с сетью клиентов или других серверов в ответ на выданные клиентом или выданные сервером запросы. Термины "сервер приложений" и "AS" означают сервер, адаптированный так, чтобы инициировать установление линий связи данных и управления, связанных с сеансом связи распределенного мультимодального приложения, и управлять синхронизацией между различными "представлениями", связанными с сеансом связи приложения. Термин "сервер модальности" означает сервер, адаптированный так, чтобы выполнять компонент приложения на стороне сервера, который связан с одной или более модальностями пользовательского интерфейса. Термины "голосовой сервер" и "VS" означают сервер модальности, который специально адаптирован так, чтобы выполнять компонент приложения на стороне сервера, связанный с голосовой модальностью. Хотя представленное ниже описание включает в себя подробные описания системы, в которой голосовой сервер включен для поддерживания голосовой модальности, должно быть понятно, что в других вариантах осуществления, дополнительно или в качестве альтернативы в систему могут быть включены другие типы серверов модальностей, которые поддерживают другие типы модальностей пользовательского интерфейса (например, жестикуляционную модальность, перьевую модальность и так далее).

На протяжении всего этого описания будет использоваться конкретный пример распределенного мультимодального приложения для того, чтобы облегчать понимание примерных вариантов осуществления. Должно быть понятно, что иллюстративный пример не следует воспринимать как ограничение объема вариантов осуществления только этим примером. В примерном варианте осуществления, распределенное мультимодальное приложение адаптировано так, чтобы поддерживать визуальную модальность и голосовую модальность. Клиентское устройство включает в себя "допускаемый мультимодальностью" браузер и/или компонент приложения на стороне клиента, любой или оба из которых адаптированы так, чтобы интерпретировать машинный код, который заставляет клиентское устройство воспроизводить визуальное отображение, включающее в себя по меньшей мере один элемент отображения, для которого входные данные подлежат приему клиентским устройством через визуальную модальность или голосовую модальность. В варианте осуществления включен - и/или на него делается ссылка в мультимодальной странице - машинный код, который, когда интерпретируется, заставляет клиентское устройство воспроизводить множество интерактивных элементов отображения (например, поля ввода данных для города, штата, номера дома на улице и названия улицы).

Как используется в данном описании, термин "интерпретировать" означает "интерпретировать" и/или "выполнять", как эти термины понимаются специалистами в данной области техники. Термин "машинный код", как используется в данном описании, означает разметку (например, разметку, производимую на стандартном обобщенном языке разметки (SGML), расширяемом языке разметки (XML), языке гипертекстовой разметки (HTML), расширяемом HTML (XHTML), динамическом HTML (DHTML), VoiceXML, языке тегов речевых приложений (SALT), масштабируемой векторной графике (SVG) и/или различных других языках разметок), сценарии (например, код JavaScript), оттранслированную программу (например, откомпилированную C/C++, Java, Lisp, Fortran, Pascal и так далее), и/или другую информацию, которая может быть без труда выполнена или интерпретирована компьютерным процессором (например, клиентским устройством 102, сервером 104 приложений и/или голосовым сервером 106, фиг. 1).

Обращаясь снова к примерному мультимодальному приложению, обсуждаемому в данном описании, отметим, что пользователь клиентского устройства может вводить информацию для элемента отображения, на котором в настоящее время "сфокусировано" приложение (например, для элемента, который выбран или в котором мигает курсор), и/или может изменять фокусирование (например, выбирая другой элемент). В варианте осуществления пользователь может вводить информацию для элемента отображения с использованием либо визуальной модальности, либо голосовой модальности, по желанию пользователя. Когда пользователь вводит информацию, используя, например, клавишную панель клиентского устройства, это действие соответствует вводу данных с использованием визуальной модальности, и информация будет воспроизведена как текст в поле ввода данных, на котором сфокусировано визуальное представление. После предъявления на рассмотрение информации (например, посредством нажатия "enter" (ввод) или перемещения курсора), визуальное отображение может быть обновлено так, чтобы отразить другое фокусирование.

В качестве альтернативы, пользователь может вводить информацию с использованием голосовой модальности (например, пользователь может сказать название города). Когда это происходит, в варианте осуществления, клиентское устройство посылает звуковые данные, представляющие речь, в голосовой сервер по тракту звуковых данных. Голосовой сервер адаптирован так, чтобы выполнять, в варианте осуществления, программу распознавания речи, которая оценивает принимаемые звуковые данные в свете речевого диалога, который соответствует машинному коду (например, мультимодальной странице или коду, связанному с компонентом приложения на стороне клиента), интерпретируемого клиентским устройством. Программа распознавания речи может генерировать результат распознавания речи (или ошибку), который, в варианте осуществления, голосовой сервер может передавать на клиентское устройство через сервер приложений. Затем клиентское устройство может воспроизводить результат распознавания речи как текст в соответствующем поле данных, и состояния голосового представления и визуального представления могут обновляться и синхронизироваться в соответствии с различными вариантами осуществления. Когда состояния голосового представления и визуального представления синхронизированы, часть речевого диалога, интерпретируемого голосовым сервером, соответствует части машинного кода, интерпретируемого клиентским устройством.

Как будет подробно описано ниже, варианты осуществления включают в себя способы синхронизации визуального представления и голосового представления в свете возможности пользователя вводить информацию с использованием любой модальности. Это может быть последовательно достигнуто, в различных вариантах осуществления, даже притом, что состояние визуального представления поддерживается на клиентском устройстве, а состояние голосового представления поддерживается на голосовом сервере. Синхронизация может быть достигнута с использованием стандартных протоколов и авторских методик общепринятого содержания, хотя и новыми способами, таким образом, облегчая и поощряя разработку большого разнообразия распределенных мультимодальных приложений.

Фиг. 1 представляет упрощенную схему системы 100, адаптированной для реализации распределенных мультимодальных приложений, в соответствии с примерным вариантом осуществления. Система 100 включает в себя множество системных объектов, которые включают в себя, в варианте осуществления, по меньшей мере одно клиентское устройство 102, сервер 104 приложений (AS) и голосовой сервер 106 (VS). Как будет подробно объясняться ниже, между этими системными объектами устанавливаются различные тракты данных и управления, и системные объекты соблюдают различные коммуникационные протоколы, чтобы поддерживать реализацию сеанса связи распределенного мультимодального приложения в пределах системы 100. Как используется в данном описании, термин "сеанс связи мультимодального приложения" может быть определен как образец распределенного мультимодального приложения. В варианте осуществления сеанс связи мультимодального приложения включает в себя интерпретирование (например, выполнение и/или интерпретирование) машинного кода (например, машинного кода, связанного с компонентом 114 приложения на стороне клиента и/или с группой из одной или более связанных мультимодальных страниц 115) клиентским устройством 102 в связи с интерпретированием группы из одного или более соответствующих речевых диалогов голосовым сервером 106.

Хотя иллюстрируется только одно клиентское устройство 102, система 100 может включать в себя множество подобных или различных типов клиентских устройств. Например, клиентское устройство 102 может формировать часть электронного устройства, выбираемого из группы устройств, которые включают в себя, но не ограничиваясь этим, телефон для сотовой связи, радиоприемник, пейджер, персонального цифрового секретаря (PDA), персональное навигационное устройство (PND), портативную компьютерную систему (например, автомобильную или самолетную компьютерную систему), компьютер (например, дорожный компьютер, портативный компьютер или настольный компьютер) и телефон передачи голоса по межсетевому протоколу (VoIP), реализованный в компьютере, где указаны только несколько.

Клиентское устройство 102 включает в себя подсистему обработки данных и подсистему хранения данных и может быть переносным или стационарным электронным устройством. Для любого типа устройства, клиентское устройство 102 может включать в себя подсистему батареи, адаптированную так, чтобы обеспечивать энергию, когда мощность линии электропитания для питания клиентского устройства 102 не используется. Клиентское устройство 102 может быть адаптировано так, чтобы устанавливать связь через одну или более сетей 108, используя различные технологии проводной и/или беспроводной связи. Соответственно, клиентское устройство 102 может включать в себя любой или оба из проводного и беспроводного сетевых интерфейсов. Клиентское устройство 102 также может включать в себя ряд устройств ввода пользовательского интерфейса (например, клавишную панель, клавиши, дисковые номеронабиратели, сенсорный экран, микрофон, координатно-указательное устройство (например, мышь или сенсорную панель) и бесчернильное пишущее перо) и ряд устройств вывода пользовательского интерфейса (например, экран дисплея, динамик, гнездо для подключения наушников, наушники, наушники-пуговки, устройство механических вибраций). В варианте осуществления, устройства пользовательского интерфейса, связанные с визуальной модальностью, включают в себя какое-либо одно или более устройств, выбираемых из группы устройств, которая включает в себя визуальный дисплей, сенсорный экран, клавишную панель, клавиши, дисковый номеронабиратель, координатно-указательное устройство и бесчернильное пишущее перо. Устройства пользовательского интерфейса, связанные с голосовой модальностью, включают в себя какое-либо одно или более устройств, выбираемых из группы устройств, которая включает в себя, в варианте осуществления, микрофон, динамик, гнездо для подключения наушников, наушники и наушники-пуговки.

В варианте осуществления клиентское устройство 102 адаптировано так, чтобы выполнять один или более экземпляров клиентского промежуточного программного обеспечения 110, клиентского браузера 112 и/или компонента 114 приложения на стороне клиента. Как используется в данном описании, термин "промежуточное программное обеспечение" означает программное обеспечение для компьютеров, которое обеспечивает сопряжение между программными компонентами и/или приложениями, выполняемыми на отдельных объектах обработки данных (например, на клиентах, серверах или других объектах обработки данных). В варианте осуществления клиентское промежуточное программное обеспечение 110 адаптировано так, чтобы обеспечивать сопряжение между клиентским браузером 112 и/или компонентом 114 приложения на стороне клиента и одним или более серверами (например, сервером 104 приложений и голосовым сервером 106) через сеть 108.

Клиентский браузер 112 адаптирован так, чтобы обращаться к машинному коду (например, к мультимодальной странице 115) в клиентском устройстве 102 в связи с компонентом 114 приложения на стороне клиента и дополнительно интерпретировать машинный код. В конкретном варианте осуществления клиентский браузер 112 адаптирован так, чтобы обращаться, по меньшей мере, к одной мультимодальной странице 115 и интерпретировать машинный код (например, разметку, сценарии и другую информацию) в пределах мультимодальной страницы 115. Как используется в данном описании, термин "мультимодальная страница" означает информационный набор, представляющий по меньшей мере один взаимодействующий с пользователем элемент отображения, который может быть визуально представлен на клиентском устройстве 102 и для которого пользователь может вводить информацию и/или указывать выбранный элемент через любую из множества модальностей (например, голосовую модальность и визуальную модальность). Мультимодальная страница 115 может включать в себя, в качестве примера, но не посредством ограничения, web-страницу, документ, файл, форму, перечень или другой тип информационного набора. При ее интерпретировании, мультимодальная страница 115 может заставлять клиентское устройство 102 воспроизводить один или более взаимодействующих с пользователем элементов отображения. Как используется в данном описании, "взаимодействующий с пользователем элемент отображения" может включать в себя, в качестве примера, но не посредством ограничения, помимо всего прочего, поле ввода текста, выбираемый элемент (например, кнопку или экранную кнопку) и/или интерактивный текст. Наряду с одним или более взаимодействующими с пользователем элементами отображения, мультимодальная страница также может включать в себя другую информацию и/или элементы, например, такие как текстовая информация, изображения (например, статические или динамические изображения), звуковые данные, видеоизображение, гипертекстовые связи, метаданные и сценарии.

В варианте осуществления мультимодальная страница 115 включает в себя разметку, которая может заставлять клиентский браузер 112 и/или компонент 114 приложения на стороне клиента (или другое программное обеспечение синтаксического анализа) выполнять один или более внедренных или указанных ссылкой сценариев (например, код JavaScript). Сценарий может быть внедрен в мультимодальную страницу 115, или сценарий может упоминаться в мультимодальной странице 115, и клиентский браузер 112 и/или компонент 114 приложения на стороне клиента может обращаться к сценарию из внешнего источника (например, из сервера) или из локального запоминающего устройства (например, из кэш-памяти в клиентском устройстве 102). В альтернативном варианте осуществления сценарий может быть внедрен или может упоминаться скорее в компоненте 114 приложения на стороне клиента, чем на мультимодальной странице 115. В варианте осуществления сценарий может быть адаптирован так, чтобы заставлять клиентское устройство 102 выдавать асинхронный запрос на сервер 104 приложений для ряда целей, как будет подробно описано ниже в связи с фиг. 2-6. В представленном ниже описании, когда клиентское устройство 102, как говорят, посылает управляющее сообщение на сервер 104 приложений, во многих случаях это можно интерпретировать как клиентское устройство 102, выдающее асинхронный запрос на сервер 104 приложений. Точно так же, когда сервер 104 приложений, как говорят, посылает управляющее сообщение на клиентское устройство 102, это можно интерпретировать как сервер 104 приложений, выдающий ответ на асинхронный запрос, предварительно посланный клиентским устройством 102. В варианте осуществления асинхронные запросы посылаются как асинхронные запросы протокола передачи гипертекста (HTTP), а ответы представляют собой ответы HTTP.

Компонент 114 приложения на стороне клиента и/или мультимодальная страница 115 могут быть разработаны с использованием методик AJAX (Асинхронного JavaScript и расширяемого языка разметки (XML)), и, в варианте осуществления, соответственно, могут включать в себя разметку XML и JavaScript, адаптированные так, чтобы посылать асинхронные запросы (например, асинхронные запросы HTTP) и обрабатывать ответы (например, ответы HTTP) на эти запросы. В других вариантах осуществления компонент 114 приложения на стороне клиента и/или мультимодальная страница 115 могут быть разработаны с использованием других типов программирования, создания сценариев и/или языков разметок.

Как используется в данном описании, термин "язык разметки" означает определенный набор правил синтаксиса для информации (например, разметку или другой машинный код), который можно вкладывать в информационный набор (например, в мультимодальную страницу 115 или другой машинный код), и который указывает, для программного обеспечения синтаксического анализа (например, для клиентского браузера 112 и/или компонента 114 приложения на стороне клиента), структуру, размещение и/или другие характеристики элементов отображения (например, текста или другого содержимого), когда элементы воспроизводятся на электронном устройстве, помимо всего прочего. В качестве примера, но не посредством ограничения, разметка, связанная с языком разметки, может включать в себя разметку представления, процедурную разметку и/или описательную разметку (также упоминаемую как "семантическая" разметка). Языки разметок, которые могут использоваться в различных вариантах осуществления, включают в себя, но не ограничиваясь этим, SGML, XML, HTML, XHTML, DHTML, VoiceXML, SALT, SVG и различные другие языки разметок.

Клиентский браузер 112 включает в себя программу программного обеспечения, которая адаптирована так, чтобы выполнять синтаксический анализ машинного кода (например, разметки) в пределах мультимодальной страницы (например, мультимодальной страницы 115) и/или обеспечивать сопряжение с компонентом 114 приложения на стороне клиента способом, который дает возможность клиентскому устройству 102 воспроизводить текст, изображения, видеоизображения, музыку и/или другую информацию, представленную или упомянутую в машинном коде и/или компоненте 114 приложения на стороне клиента. В различных вариантах осуществления клиентский браузер 112 может включать в себя, но не ограничиваясь этим, браузер HTML/XHTML, браузер протокола приложений для беспроводной связи (WAP), заказное приложение и/или коммерчески доступный браузер (например, Internet Explorer (Интернет-эксплорер), Mozilla Firefox, Safari, Opera и Netscape, где указаны только несколько). В конкретном варианте осуществления клиентский браузер 112 представляет собой браузер XHTML, который поддерживает выполнение JavaScript и сетевую передачу информации HTTP, и который также имеет возможности манипулирования звуком. Клиентский браузер 112 является "мультимодально активизируемым", в варианте осуществления, и это означает, что клиентский браузер 112 адаптирован так, чтобы интерпретировать машинный код, связанный с мультимодальными приложениями.

Компонент 114 приложения на стороне клиента включает в себя приложение программного обеспечения для компьютеров. В варианте осуществления компонент приложения на стороне клиента закодирован на поддерживаемом браузером языке (например, на SGML, XML, HTML, XHTML, DHTML или других языках разметки) и полагается на клиентский браузер 112, чтобы воспроизводить выполняемый компонент приложения. В других вариантах осуществления компонент 114 приложения на стороне клиента может не полагаться на клиентский браузер 112, чтобы воспроизводить выполняемый компонент приложения. Может быть разработано множество различных типов компонентов 114 приложения на стороне клиента, включая, например, компоненты приложения, связанные с приложениями картографирования, навигационными приложениями и поисковыми приложениями, где указаны только несколько.

Клиентское устройство 102 может устанавливать связь с сервером 104 приложений и голосовым сервером 106 через одну или более сетей 108. Сеть 108 может включать в себя, например, сеть с коммутацией пакетов и/или сеть с коммутацией каналов, и, более конкретно, может включать в себя одну или более из Интернета, персональной сети (PAN), локальной сети (LAN), глобальной сети (WAN), широкополосной LAN (WLAN), телефонной сети сотовой связи, радиосети, сети спутниковой связи, коммутируемой телефонной сети общего пользования (PSTN) и/или любой из ряда других типов сетей, адаптированных так, чтобы допускать обмен информацией между различными системными объектами. Сеть 108 может быть адаптирована для обмена информацией между системными объектами, использующими любой из ряда протоколов проводной или беспроводной связи.

Сервер 104 приложений (AS) адаптирован так, чтобы выполнять различные услуги для клиентского устройства 102. В варианте осуществления сервер 104 приложений адаптирован так, чтобы выполнять один или более экземпляров из промежуточного программного обеспечения 116 AS и услуг 118 AS, как будет более подробно описано ниже. В варианте осуществления промежуточное программное обеспечение 116 AS адаптировано так, чтобы обеспечивать сопряжение с голосовым сервером 106 и клиентским устройством 102 через подключение 140 сервера к серверу и сеть 108, соответственно.

В варианте осуществления, услуги 118 AS включают в себя программное обеспечение установления сеанса связи, которое адаптировано так, чтобы инициировать установление различных трактов 120, 122, 124 передачи данных и управления между клиентским устройством 102, сервером 104 приложений и голосовым сервером 106, в связи с сеансом связи мультимодального приложения. Тракты передачи данных и управления, связанные с сеансом связи мультимодального приложения, могут включать в себя, например, тракт 120 управления AS/клиента, тракт 122 управления AS/VS и тракт 124 звуковых данных VS/клиента. В варианте осуществления клиентское устройство 102 и сервер 104 приложений могут обмениваться информацией по тракту 120 управления AS/клиента, а клиентское устройство 102 и голосовой сервер 106 могут обмениваться информацией по тракту 124 звуковых данных VS/клиента, где по меньшей мере части тракта 120 управления AS/клиента и тракта 124 звуковых данных VS/клиента установлены через одну или более сетей 108. Сервер 104 приложений и голосовой сервер 106 могут обмениваться информацией по тракту 122 управления AS/VS, по меньшей мере часть которого установлена через подключение 140 сервера к серверу, которое может включать в себя прямые, аппаратные линии связи или которое может быть воплощено через одну или более проводных или беспроводных сетей или других промежуточных объектов.

В варианте осуществления управляющие сообщения, обмениваемые между клиентским устройством 102 и сервером 104 приложений в связи с сеансом связи мультимодального приложения, обмениваются через сеть 108 с использованием коммуникационного протокола передачи сообщений, подходящего для сети 108. Соответственно, сеть 108 функционирует как тракт управления между клиентским устройством 102 и сервером 104 приложений. Этот тракт управления упоминается в данном описании в сингулярном смысле как тракт 120 управления AS/клиента, даже при том, что определенный тракт маршрутизации через сеть 108 для сеанса связи может быть не выделен, и физическая маршрутизация, через сеть 108, каждого сообщения, обмениваемого между клиентским устройством 102 и сервером 104 приложений, от сообщения к сообщению может различаться. Соответственно, как используется в данном описании, "тракт управления AS/клиента" может быть определен так, чтобы обозначать какой-либо один или более из трактов через сеть 108 (или некоторую другую коммуникационную среду), по которому может производиться обменен сообщениями между IP-адресом и/или портом, связанным с клиентским устройством 102, и IP-адресом и/или портом, связанным с сервером 104 приложений. Точно так же "тракт управления AS/VS" может быть определен так, чтобы обозначать какой-либо один или более из трактов (которые могут пересекать или не пересекать сеть) между IP-адресом и/или портом, связанным с сервером 104 приложений, и IP-адресом и/или портом, связанным с голосовым сервером 106. Дополнительно, "тракт звуковых данных VS/клиента" может быть определен так, чтобы обозначать какой-либо один или более из трактов через сеть 108 (или некоторую другую коммуникационную среду), по которому может производиться обмен звуковыми данными между IP-адресом и/или портом, связанным с голосовым сервером 106, и IP-адресом и/или портом, связанным с клиентским устройством 102. В варианте осуществления тракт 120 управления AS/клиента и тракт 124 звуковых данных VS/клиента отличаются друг от друга тем, что IP-адрес клиента и/или выделенный порт, в течение сеанса связи, для тракта 120 управления AS/клиента отличается от IP-адреса клиента и/или выделенного порта, в течение сеанса связи, для тракта 124 звуковых данных VS/клиента. Кроме того, IP-адрес и/или порт сервера приложений, выделенный для тракта 120 управления AS/клиента, отличается от IP-адреса и/или порта голосового сервера, выделенного для тракта 124 звуковых данных VS/клиента, что происходит из-за того, что сервер 104 приложений и голосовой сервер 106 отличаются друг от друга.

Как было предварительно упомянуто, машинный код, связанный с мультимодальными страницами, представленными в клиентском устройстве 102, и/или с компонентами приложения на стороне клиента, выполняемыми в клиентском устройстве 102, адаптирован так, чтобы посылать асинхронные запросы (например, асинхронные запросы HTTP), которые принимаются сервером 104 приложений, по тракту 120 управления AS/клиента. Услуги AS 118 адаптированы так, чтобы выполнять обработку и/или другие задачи в соответствии с запросами и возвращать ответы (например, ответы HTTP) на клиентское устройство 102 по тракту 120 управления AS/клиента, соответственно. Кроме того, через управляющие сообщения, передаваемые по тракту 120 управления AS/клиента и тракту 122 управления AS/VS, услуги 118 AS адаптированы так, чтобы управлять синхронизацией между состояниями визуального представления, поддерживаемыми на клиентском устройстве 102, и голосового представления, поддерживаемыми на голосовом сервере 106. По существу, синхронизация визуального представления и голосового представления включает в себя обеспечение информации для клиентского устройства 102 и голосового сервера 106, которая обеспечивает возможность, чтобы интерпретирование машинного кода на клиентском устройстве 102 было синхронизировано с интерпретированием машинного кода для соответствующего речевого диалога 136 на голосовом сервере 106. Упоминается другой путь, при котором синхронизация визуального представления и голосового представления включает в себя обеспечение информации для клиентского устройства 102 и для голосового сервера 106, что дает возможность синхронизировать состояние выполнения визуального представления на клиентском устройстве 102 с состоянием выполнения голосового представления на голосовом сервере 106. Варианты осуществления способов выполнения этой синхронизации более подробно будут описаны позже.

Голосовой сервер 106 представляет собой сервер модальности, который, в частности, адаптирован так, чтобы выполнять обработку речи, связанную с задачами, находящимися в связи с сеансом связи распределенного мультимодального приложения. Как было предварительно упомянуто, в других вариантах осуществления в систему могут быть встроены другие типы серверов модальностей. Голосовой сервер 106 адаптирован так, чтобы выполнять один или более экземпляров промежуточного программного обеспечения 130 VS, браузера/диалогового интерпретатора 132 VS (упоминаемого ниже как браузер 132 VS) и программы 134 распознавания речи. Программа 134 распознавания речи может рассматриваться как компонент приложения на стороне VS, поскольку она формирует серверную часть распределенного приложения. В других вариантах осуществления могут быть реализованы другие типы компонентов приложения на стороне VS.

Промежуточное программное обеспечение 130 VS адаптировано так, чтобы обеспечивать сопряжение между браузером 132 VS и другими серверами (например, сервером 104 приложений) и/или клиентским устройством 102 через подключение 140 сервера к серверу и/или сеть 108, соответственно. Браузер 132 VS представляет собой программу, которая дает возможность голосовому серверу 106 обращаться и интерпретировать речевые диалоги (например, речевой диалог 136), посылать и принимать звуковые данные в связи с интерпретацией речевых диалогов, выдавать асинхронные запросы (например, асинхронные запросы HTTP) и принимать и обрабатывать ответы (например, ответы HTTP) в контексте сеанса связи мультимодального приложения. В различных вариантах осуществления браузер 106 VS может включать в себя, но не ограничиваясь этим, заказной или коммерчески доступный браузер или другое приложение, адаптированное так, чтобы интерпретировать разметку, связанную с обеспечением голосовой модальности (например, VoiceXML, SALT и/или различные другие языки разметки).

Как только что было упомянуто, браузер 132 VS может обращаться к речевому диалогу 136 и интерпретировать его. Как используется в данном описании, "речевой диалог" может интерпретироваться так, чтобы обозначать информационный набор, связанный с набором возможных результатов распознавания речи и/или звуковых подсказок. Речевой диалог может включать в себя машинный код, адаптированный так, чтобы собирать и/или обеспечивать звуковые данные (например, речевые подсказки) на одной или более стадиях, в соответствии с различными вариантами осуществления. Речевой диалог может включать в себя, в качестве примера, но не посредством ограничения, web-страницу, документ, файл, перечень или другой тип информационного набора. Речевой диалог также может включать в себя другую информацию и/или элементы, такие, например, как текстовая информация, метаданные, машинный код и сценарии. Хотя описанные ниже варианты осуществления включают в себя речевые диалоги, к которым получает доступ (например, при загрузке) голосовой сервер 106, должно быть понятно, что, в других вариантах осуществления, речевой диалог может быть реализован в виде машинного кода, который является резидентной программой на голосовом сервере 106 и который не должен загружаться, или доступ к которому должен быть получен иначе.

В варианте осуществления речевой диалог 136 включает в себя машинный код, где машинный код может включать в себя оттранслированную программу, разметку и/или другую информацию, которая может без труда интерпретироваться голосовым сервером 106. В конкретном варианте осуществления, речевой диалог 136 может включать в себя разметку, которая заставляет браузер 132 VS обращаться и/или выполнять один или более внедренных или ссылочных сценариев (например, код JavaScript). Сценарий может быть внедрен в речевой диалог 136, или браузер 132 VS может обращаться к сценарию из внешнего источника (например, из сервера), или из локального запоминающего устройства (например, из кэш-памяти на голосовом сервере 106). Сценарии могут включать в себя сценарии, адаптированные так, чтобы вызывать программу 134 распознавания речи, чтобы пытаться определить результат распознавания речи на основании принятых звуковых данных, отыскивать или генерировать звуковую подсказку и/или выдавать асинхронные запросы (например, асинхронные запросы HTTP относительно речевых диалогов или другие типы запросов), помимо всего прочего. Речевой диалог 136 может быть разработан с использованием методик AJAX и, соответственно, в варианте осуществления, может включать в себя разметку (например, разметку VoiceXML и/или SALT) и JavaScript, адаптированные так, чтобы посылать асинхронные запросы. В других вариантах осуществления речевой диалог 136 может быть разработан с использованием других типов языков программирования, языков сценариев и/или языков разметок.

Программа 134 распознавания речи представляет собой приложение, которое может быть вызвано браузером 132 VS, и она адаптирована так, чтобы принимать звуковые данные (например, в сжатом, распакованном, закодированном, незакодированном или декодированном формате), выполнять алгоритм распознавания речи с использованием звуковых данных, чтобы пытаться определить результат распознавания речи (например, индикацию распознанной речи) и возвращать результат распознавания речи или указывать, что результат не был определен. Как используется в данном описании, термин "звуковые данные" означает оцифрованное представление речи или других слышимых звуков (в общем, "звуковые данные"), где оцифрованное звуковое представление может включать в себя выборочную речь или другие слышимые звуки в сжатом, распаковываемом, закодированном, незакодированном и/или декодированном формате. Звуковые данные также могут включать в себя указатели в таблицах или других структурах данных, которые включают в себя звуковые данные, где таблицы могут быть доступны для сервера 102 приложений, голосового сервера 106 и/или клиентского устройства 102. Программа 134 распознавания речи может выполняться в связи с одной или более речевыми библиотеками 138 или с другими ресурсами распознавания речи (например, с грамматиками, последовательностями n-грамм, статистическими моделями языка или другими ресурсами распознавания речи), где доступ к ресурсам распознавания речи может быть получен на основании конкретного речевого диалога 136, подлежащего интерпретированию.

В варианте осуществления голосовой сервер 106 устанавливает связь с сервером 104 приложений по тракту 122 управления AS/VS. Кроме того, голосовой сервер 106 и клиентское устройство 102 могут непосредственно обмениваться звуковыми данными по тракту 124 звуковых данных VS/клиента. В варианте осуществления звуковые данные могут течь потоковым образом по тракту 124 звуковых данных VS/клиента с использованием коммуникационного протокола передачи пакетированных данных. В качестве альтернативы, может производиться обмен звуковыми данными по тракту 124 звуковых данных VS/клиента с использованием способов связи с коммутацией каналов или в режиме "нажал - говори" (PTT). В варианте осуществления, звуковые данные передаются по тракту 124 звуковых данных VS/клиента с использованием версии транспортного протокола реального времени/протокола управления передачей в реальном времени (RTP/RTCP), хотя в других вариантах осуществления могут быть реализованы другие протоколы (например, протокол управления передачей (TCP) или другие).

Сервер 104 приложений и голосовой сервер 106 отличаются друг от друга тем, что сервер 104 приложений и голосовой сервер 106 выполняют отдельные процессы и обмениваются управляющими сообщениями, которые влияют на эффективность этих процессов, по тракту 122 управления AS/VS. Кроме того, тракт 120 управления AS/клиента между клиентским устройством 102 и сервером 104 приложений отличается от тракта 124 звуковых данных VS/клиента между клиентским устройством 102 и голосовым сервером 106 по меньшей мере тем, что клиентское устройство 102 обращается к серверу приложения 104 и голосовому серверу 106, используя различные адреса (например, различные IP-адреса). Кроме того, клиентское устройство 102 может обмениваться управляющими сообщениями с сервером 104 приложений с использованием коммуникационного протокола, отличающегося от протокола, используемого для обмена звуковыми данными с голосовым сервером 106. В варианте осуществления сервер 104 приложений и голосовой сервер 106 могут быть реализованы на физически раздельном аппаратном обеспечении, которое может быть размещено совместно или раздельно. В другом варианте осуществления сервер 104 приложений и голосовой сервер 106 могут быть реализованы, по меньшей мере частично, на совместно используемом аппаратном обеспечении, хотя между этими двумя серверами все еще производится обмен различными управляющими сообщениями по тракту 122 управления AS/VS, как подробно описано ниже.

Как предварительно было упомянуто, варианты осуществления обладающего признаками изобретения объекта адаптированы так, чтобы синхронизировать визуальное представление и звуковое представление, связанные с сеансом связи распределенного мультимодального приложения. Состояние "визуального представления" поддерживается клиентским устройством 102, в связи с интерпретацией мультимодальной страницы (например, мультимодальной страницы 115), а состояние "звукового представления" поддерживается голосовым сервером 106, в связи с интерпретацией речевого диалога (например, речевого диалога 136), связанного с мультимодальной страницей. Термины "визуальное представление" и "состояние визуального представления" могут быть определены как являющиеся машинным кодом, который включен или к которому обращаются в пределах мультимодальной страницы, которую браузер (например, клиентский браузер 112) в настоящее время интерпретирует или ожидает, чтобы интерпретировать, и/или машинным кодом, который включен или к которому обращаются в пределах компонента приложения на стороне клиента, который в настоящее время выполняется. Например, текущее состояние визуального представления может соответствовать машинному коду, связанному с единственным элементом страницы, на котором в настоящее время сфокусировано визуальное отображение, которое может быть представлено на визуальном отображении как элемент страницы, который подсвечен, в котором мигает курсор или в котором установлена некоторая другая индикация фокусирования. Термины "звуковое представление" и "состояние звукового представления" могут быть определены как являющиеся машинным кодом, который включен или к которому обращаются в пределах речевого диалога, который браузер (например, браузер 132 VS) в настоящее время выполняет или ожидает, чтобы выполнять. Например, текущее состояние звукового представления может соответствовать машинному коду, который заставляет голосовой сервер ожидать приема звуковых данных в качестве ввода для элемента отображения, который представлен на клиентском устройстве 102.

Варианты осуществления способов инициирования и проведения сеанса связи мультимодального приложения теперь будут описаны в связи с фиг. 2-6. Эти варианты осуществления будут описаны в контексте примера определенного типа распределенного мультимодального приложения, чтобы облегчить объяснение и понимание различных вариантов осуществления. Примерное приложение представляет собой приложение картографирования, которое включает в себя компонент приложения на стороне клиента, адаптированный так, чтобы заставлять элементы, представленные в пределах мультимодальной страницы, воспроизводиться на клиентском устройстве через интерпретирование посредством клиентского браузера. Компонент приложения на стороне клиента (например, приложение картографирования) и клиентский браузер являются "мультимодально активизируемыми", и это означает, что каждый из них адаптирован так, чтобы поддерживать пользовательский интерфейс, который распознает и/или обеспечивает взаимодействие пользователя с использованием множества модальностей, а клиентский браузер, в частности, адаптирован так, чтобы понимать и обмениваться сообщениями с одним или более удаленными серверами в поддержке сеанса связи распределенного мультимодального приложения. В альтернативном варианте осуществления, клиентский браузер может быть адаптирован так, чтобы интерпретировать мультимодальную страницу без инициирования от компонента приложения на стороне клиента (например, когда пользователь непосредственно инициирует экземпляр клиентского браузера и заставляет клиентский браузер загружать и интерпретировать мультимодальную страницу). В еще одном альтернативном варианте осуществления, компонент приложения на стороне клиента может выполнять некоторые или все задачи клиентского браузера, и/или компонент приложения на стороне клиента может включать в себя некоторую часть или весь машинный код, который в противном случае может быть включен в мультимодальную страницу. Соответственно, варианты осуществления могут быть выполнены с помощью мультимодальной страницы или без нее. Эти варианты осуществления в данном описании подробно не обсуждаются, хотя должно быть понятно, что они находятся в пределах обладающего признаками изобретения объекта.

Пример будет включать в себя клиентское устройство, отображающее мультимодальную страницу в виде формы ввода данных, где форма ввода данных включает в себя множество заполняемых полей ввода данных (например, название города, штата, номер дома и название улицы), в которые пользователь может вводить информацию об адресе для определения местоположения с использованием любой или обоих из визуальной модальности и голосовой модальности. После предъявления на рассмотрение введенной информации система может обеспечивать информацию картографирования, дающую возможность клиентскому устройству отображать карту, которая включает в себя целевое определение местоположения. Должно быть понятно, что варианты осуществления также могут использоваться в связи с другими типами распределенных мультимодальных приложений (например, среди прочих, с поисковыми и навигационными приложениями).

В данном примере множество модальностей включает в себя визуальную модальность и голосовую модальность. На клиентском устройстве визуальная модальность может быть реализована с использованием экрана дисплея и связанных аппаратного обеспечения и программного обеспечения для генерирования визуальных отображений. Визуальная модальность также может быть реализована на клиентском устройстве с использованием клавишной панели и/или одного или более других устройств ввода пользовательского интерфейса, которые дают возможность пользователю делать выборы, вводить информацию и/или выполнять другие действия (например, изменять фокусирование) через взаимодействие с визуальным дисплеем и/или другими устройствами ввода пользовательского интерфейса. Голосовая модальность может быть реализована на клиентском устройстве с использованием микрофона, динамика и связанных аппаратного обеспечения и программного обеспечения, адаптированных так, чтобы принимать и оцифровывать человеческую речь и/или выводить звуковые данные.

В данном примере, пользователь может взаимодействовать с визуальной модальностью пользовательского интерфейса (например, с визуальным дисплеем), рассматривая визуальный дисплей и вводя информацию в поля визуального дисплея (или делая выборы) с использованием клавишной панели или других устройств ввода. Кроме того, пользователь может взаимодействовать с голосовой модальностью пользовательского интерфейса, слушая звуковые подсказки и/или говоря, чтобы обеспечивать информацию, связанную с элементами страницы, на которых установлено фокусирование визуального отображения. Должно быть понятно, что, в альтернативных вариантах осуществления, распределенное мультимодальное приложение может быть адаптировано так, чтобы допускать набор модальностей, отличающийся от визуальной модальности и голосовой модальности.

Фиг. 2, которая будет описана ниже, иллюстрирует полный процесс инициирования и проведения сеанса связи мультимодального приложения, в соответствии с вариантом осуществления. Фиг. 2 не предназначена для того, чтобы ограничивать объем обладающего признаками изобретения объекта, а вместо этого предназначена для того, чтобы обеспечить полный контекст для понимания более подробных описаний процессов, иллюстрируемых и описываемых в связи с фиг. 3, 5 и 6.

Фиг. 2 представляет блок-схему способа инициирования и проведения сеанса связи мультимодального приложения, в соответствии с примерным вариантом осуществления. Способ может начинаться, в блоке 202, когда клиентское устройство принимает индикацию того, что сеанс связи мультимодального приложения должен быть инициирован. В различных вариантах осуществления сеанс связи мультимодального приложения может быть инициирован экземпляром компонента приложения на стороне клиента (например, клиентской частью приложения отображения) и/или клиентского браузера. Например, пользователь клиентского устройства может инициировать экземпляр компонента приложения на стороне клиента, который адаптирован так, чтобы воспроизводить, либо отдельно, либо в связи с клиентским браузером, визуальное отображение, которое включает в себя по меньшей мере один элемент отображения, для которого могут быть введены данные с использованием визуальной модальности или голосовой модальности. В качестве альтернативы, пользователь может инициировать экземпляр клиентского браузера и может указывать, для клиентского браузера, желание пользователя для браузера, чтобы обратиться или загрузить мультимодальную страницу, которая, при интерпретировании, заставляет клиентское устройство воспроизводить визуальное отображение. Например, пользователь может обеспечивать вводы пользователя так, чтобы передвигаться к мультимодальной странице.

Когда клиентское устройство принимает индикацию того, что сеанс связи мультимодального приложения должен быть инициирован, сеанс связи мультимодального приложения инициируется, в блоке 204, через взаимодействие между клиентским устройством, сервером приложений и голосовым сервером, как будет описано более подробно в связи с фиг. 3. Инициализация сеанса связи мультимодального приложения включает в себя установление тракта звуковых данных (например, тракта 124 звуковых данных VS/клиента, фиг. 1) между клиентским устройством и голосовым сервером, через который будет производиться обменен звуковыми данными во время сеанса связи мультимодального приложения. Кроме того, и в варианте осуществления, инициализация сеанса связи мультимодального приложения включает в себя обмен информацией между клиентским устройством и сервером приложений по первому тракту управления между клиентским устройством и сервером приложений (например, по тракту 120 управления AS/клиента, фиг. 1), и обмен информации между сервером приложений и голосовым сервером по второму тракту управления между сервером приложений и голосовым сервером (например, по тракту 122 управления AS/VS, фиг. 1).

Как будет описано более подробно в связи с фиг. 5 и 6, во время сеанса связи мультимодального приложения будет производиться обмен звуковыми данными между клиентским устройством и голосовым сервером по тракту звуковых данных, и будет производиться обмен информацией управления между клиентским устройством, сервером приложений и голосовым сервером по первому и второму трактам управления. Информация управления дает возможность последовательно поддерживать синхронизацию между состояниями визуального представления и голосового представления на протяжении всего сеанса связи.

В ответ на события, генерируемые голосовым сервером и клиентским устройством, производится обмен звуковыми данными и информацией управления между различными системными объектами, и эти события упоминаются, соответственно, как "генерируемые VS события" и "генерируемые клиентом события". Генерируемые VS события и генерируемые клиентом события могут воздействовать на состояния голосового представления и/или визуального представления. Генерируемые VS события и генерируемые клиентом события могут происходить в различные моменты времени, когда проводится сеанс связи мультимодального приложения. Как будет описано более подробно в связи с фиг. 5, когда происходит генерируемое VS событие, в блоке 206 выполняется процесс манипулирования генерируемым VS событием. Кроме того, как будет описано более подробно в связи с фиг. 6, когда происходит генерируемое клиентом событие, в блоке 208 выполняется процесс манипулирования генерируемым клиентом событием. Хотя блоки 206 и 208 иллюстрируются как происходящие последовательно, эти процессы также могут происходить параллельно или в противоположной последовательности, и, в то время как проводится сеанс связи мультимодального приложения, любой или оба процесса могут происходить множество раз. До тех пор, пока сеанс связи мультимодального приложения не закончен, как изображено блоком 210, процессы манипулирования генерируемыми VS событиями и генерируемыми клиентом событиями продолжают выполняться, как проиллюстрировано на фиг. 2.

Фиг. 3 представляет блок-схему способа выполнения инициирования сеанса связи мультимодального приложения (например, процесса 204, фиг. 2) в соответствии с примерным вариантом осуществления. Как предварительно было описано в связи с процессом 202 на фиг. 2, в варианте осуществления сеанс связи мультимодального приложения может быть инициирован, когда клиентское устройство принимает индикацию того, что сеанс связи мультимодального приложения должен быть инициирован. Например, сеанс связи мультимодального приложения может быть инициирован, когда пользователь инициирует компонент приложения на стороне клиента или браузер, адаптированный так, чтобы интерпретировать или выполнять машинный код, заставляющий клиентское устройство воспроизводить один или более элементов отображения, для которых могут быть введены данные с использованием визуальной модальности, голосовой модальности или их обеих. В варианте осуществления сеанс связи мультимодального приложения может быть инициирован, когда пользователь инициирует компонент приложения на стороне клиента или браузер, адаптированный так, чтобы интерпретировать мультимодальную страницу, и/или когда пользователь выбирает гипертекстовые связи с мультимодальной страницей среди других действий.

В блоке 302 клиентское устройство посылает по тракту управления AS/клиента (например, по тракту 120 управления AS/клиента, фиг. 1) одно или более управляющих сообщений на сервер приложений, которые включают в себя информацию о тракте звуковых данных клиента, где информация о тракте звуковых данных клиента определяет описательные характеристики, относящиеся к тракту звуковых данных (например, к тракту 124 звуковых данных VS/клиента, фиг. 1), который клиентское устройство хотело бы установить с голосовым сервером. Например, информация о тракте звуковых данных клиента может включать в себя, но не ограничиваясь этим, информацию, описывающую формат (форматы) звуковых данных, скорость (скорости) передачи данных и/или тип (типы) звуковых данных, поддерживаемые компонентом приложения на стороне клиента и/или клиентским браузером, желательный звуковой кодек (кодеки) и/или информацию об адресе звуковых данных на стороне клиента, такую как IP-адрес клиентского устройства и номер порта, подлежащий использованию для звуковых данных, загружаемых на клиентское устройство по тракту звуковых данных во время сеанса связи мультимодального приложения (упоминаемых в данном описании как "звуковые данные нисходящей линии связи"). В другом варианте осуществления, до отправки информации о тракте звуковых данных клиента на сервер приложений, клиентское устройство может посылать сообщение об инициировании приложения на сервер приложений по тракту управления AS/клиента. Сообщение об инициировании приложения может включать в себя, например, идентификатор приложения, мандат клиента и/или другую информацию.

В блоке 304 сервер приложений принимает информацию о тракте звуковых данных клиента, посланную клиентским устройством, и инициирует установление тракта звуковых данных (например, тракта 124 звуковых данных VS/клиента, фиг. 1) между клиентским устройством и голосовым сервером. В варианте осуществления это включает в себя сервер приложений, устанавливающий тракт управления AS/VS (например, тракт 122 управления AS/VS, фиг. 1) с голосовым сервером. Затем сервер приложений посылает, по тракту управления AS/VS, одно или более управляющих сообщений в голосовой сервер, которые включают в себя некоторую часть или всю информацию о тракте звуковых данных клиента.

В блоке 306 голосовой сервер принимает и сохраняет информацию о тракте звуковых данных клиента, посланную сервером приложений. Затем голосовой сервер посылает, по тракту управления AS/VS, одно или более управляющих сообщений на сервер приложений, которые включают в себя информацию о тракте звуковых данных VS. В варианте осуществления информация о тракте звуковых данных VS определяет дополнительные описательные характеристики, относящиеся к тракту звуковых данных VS/клиента. Например, информация о тракте звуковых данных VS может включать в себя, но не ограничиваясь этим, формат (форматы) звуковых данных, скорость (скорости) передачи данных и/или тип (типы) звуковых данных, поддерживаемые голосовым сервером, желательный звуковой кодек (кодеки) и/или информацию об адресе звуковых данных на стороне VS, такую как IP-адрес голосового сервера и номер порта, подлежащий использованию для звуковых данных, загружаемых в голосовой сервер по тракту звуковых данных VS/клиента во время сеанса связи мультимодального приложения (упоминаемые в данном описании как "звуковые данные восходящей линии связи").

В блоке 308 сервер приложений принимает информацию о тракте звуковых данных VS, посылаемую голосовым сервером. Затем сервер приложений посылает, по тракту управления AS/клиента, одно или более управляющих сообщений на клиентское устройство, которые включают в себя некоторую часть или всю информацию о тракте звуковых данных VS. В блоке 310 клиентское устройство принимает и сохраняет информацию о тракте звуковых данных VS, посланную сервером приложений. На этой стадии и клиентское устройство, и голосовой сервер имеют знание относительно IP-адреса и порта, на который следует посылать друг другу звуковые данные. Другими словами, голосовой сервер знает, на который адрес посылать звуковые данные нисходящей линии связи, а клиентское устройство знает, на который адрес посылать звуковые данные восходящей линии связи. Соответственно, на этой стадии устанавливается двунаправленный тракт звуковых данных между голосовым сервером и клиентским устройством. В альтернативном варианте осуществления, между голосовым сервером и клиентским устройством может быть установлен односторонний тракт звуковых данных. Например, может быть установлен тракт звуковых данных, в котором посылаются только звуковые данные восходящей линии связи от клиентского устройства на голосовой сервер, когда информация о тракте звуковых данных клиента для голосового сервера может не обеспечиваться. В другом варианте осуществления может быть установлен канал в режиме "нажал - говори" (PTT), который дает возможность в любое данное время посылать звуковые данные по тракту звуковых данных VS/клиента либо клиентскому устройству, либо голосовому серверу.

В блоке 312 клиентское устройство посылает управляющее сообщение на сервер приложений, по тракту управления AS/клиента, которое включает в себя информацию о мультимодальном приложении. В варианте осуществления информация о мультимодальном приложении включает в себя информацию, которая идентифицирует мультимодальное приложение, которое клиентское устройство готовится выполнять. В другом варианте осуществления, информация о мультимодальном приложении включает в себя ссылку (например, унифицированный указатель информационного ресурса (URL)) по меньшей мере для одной мультимодальной страницы (например, для мультимодальной страницы 115, фиг. 1) и/или по меньшей мере для одного речевого диалога (например, для речевого диалога 136, фиг. 1), связанного с мультимодальным приложением, которое клиентское устройство готовится выполнять.

В блоке 314 сервер приложений принимает информацию о мультимодальном приложении. Затем сервер приложений может определить, из информации о мультимодальном приложении, ссылки (например, указатели URL) по меньшей мере для одной мультимодальной страницы и по меньшей мере для одного речевого диалога. В варианте осуществления сервер приложений может затем посылать на голосовой сервер, по тракту управления AS/VS, ссылки (например, указатели URL) для речевого диалога. Голосовой сервер может затем загружать или обращаться к речевому диалогу (речевым диалогам), соответствующему ссылкам (ссылкам). В альтернативном варианте осуществления сервер приложений может выбирать речевой диалог (речевые диалоги), основываясь на ссылке (ссылках), и может посылать речевой диалог (речевые диалоги) на голосовой сервер по тракту управления AS/VS. Кроме того, сервер приложений может выбирать и посылать, по тракту управления AS/клиента, мультимодальную страницу (страницы) на клиентское устройство.

В блоке 316 клиентское устройство принимает и инициирует интерпретирование мультимодальной страницы и воспроизводит визуальную разметку, включенную в мультимодальную страницу на клиентском устройстве. Например, клиентский браузер или компонент приложения на стороне клиента может интерпретировать визуальную разметку, включенную в мультимодальную страницу, и может отображать один или более элементов страницы на устройстве отображения, связанном с клиентским устройством, в соответствии с визуальной разметкой.

Фиг. 4 представляет пример визуальной разметки, воспроизводимой на клиентском устройстве 400, в соответствии с примерным вариантом осуществления. В иллюстрируемом примере часть визуальной разметки воспроизведена в форме четырех мультимодальных элементов 401, 402, 403, 404 отображения, каждый из которых включает в себя текстовую метку (например, "ГОРОД", "ШТАТ", "НОМЕР ДОМА НА УЛИЦЕ" и "НАЗВАНИЕ УЛИЦЫ") и поле ввода данных.

Обращаясь снова к фиг. 3, отметим, что в блоке 318 клиентское устройство посылает управляющее сообщение, по тракту управления AS/клиента, которое указывает, что клиентское устройство инициировало интерпретирование мультимодальной страницы (например, клиентское устройство инициировало выполнение мультимодального приложения) и/или инициировало выполнение другого машинного кода, связанного с мультимодальным сеансом связи. На этой стадии визуальное представление находится в исходном состоянии. В этом исходном состоянии визуального представления клиентское устройство может ожидать приема и оцифровывания звукового сигнала, соответствующего речи, и отправки звуковых данных восходящей линии связи по тракту звуковых данных VS/клиента на голосовой сервер, соответствующих оцифрованному звуковому сигналу. Кроме того или в качестве альтернативы, в исходном состоянии визуального представления, клиентское устройство может ожидать приема дополнительных управляющих сообщений от сервера приложений, и/или звуковых данных нисходящей линии связи от голосового сервера по тракту звуковых данных VS/клиента, и воспроизводить звуковые данные нисходящей линии связи, используя устройство вывода звукового сигнала (например, динамик, наушники или головной телефон), связанное с клиентским устройством.

В блоке 320 сервер приложений принимает управляющее сообщение, указывающее, что клиентское устройство инициировало интерпретирование мультимодальной страницы или другого машинного кода, связанного с сеансом связи мультимодального приложения, и сервер приложений посылает управляющее сообщение на голосовой сервер, по тракту управления AS/VS, которое дает команду голосовому серверу начинать интерпретирование речевого диалога. Тогда, в блоке 322, голосовой сервер начинает интерпретировать речевой диалог. На этой стадии звуковое представление находится в исходном состоянии, которое синхронизировано с исходным состоянием визуального представления. В исходном состоянии голосового представления голосовой сервер может ожидать приема дополнительных управляющих сообщений от сервера приложений, и/или в нем он может ожидать приема звуковых данных восходящей линии связи от клиентского устройства по тракту звуковых данных VS/клиента.

Затем процесс инициализации и запуска сеанса связи мультимодального приложения завершается. На этой стадии визуальное представление находится в первом состоянии, в котором клиентское устройство достигло позиции, в своем интерпретировании машинного кода, связанной с мультимодальным сеансом связи (например, мультимодальной страницей и/или компонентом приложения на стороне клиента), в которой он ожидает ввода от пользователя через визуальную модальность или голосовую модальность, или в которой он ожидает звуковые данные нисходящей линии связи от голосового сервера. Кроме того, звуковое представление находится в первом состоянии, в котором голосовой сервер достиг позиции, в своем интерпретировании машинного кода, связанной с мультимодальным сеансом связи (например, речевого диалога), в которой он ожидает ввода управляющего сигнала от сервера приложений, или в котором он ожидает звуковые данные восходящей линии связи от клиентского устройства.

Фиг. 3 иллюстрирует конкретный вариант осуществления способа выполнения инициирования сеанса связи мультимодального приложения. Как и с другими способами, описанными в данном описании (например, на фиг. 5 и 6), иллюстрируемая последовательность процессов может отличаться от той, которая иллюстрируется и описывается в других вариантах осуществления, некоторые процессы и/или сообщения могут быть объединены вместе, и/или некоторые процессы или сообщения могут быть совершенно исключены. Например, в альтернативном варианте осуществления способа выполнения инициирования сеанса связи мультимодального приложения, этапы 302 и 312 на фиг. 3 могут быть объединены вместе (например, клиентское устройство может посылать информацию о тракте звуковых данных на голосовой сервер наряду с информацией о мультимодальном приложении). В других альтернативных вариантах осуществления весь или части процесса 314 могут быть исключены, например, такие, как когда клиентское устройство и/или голосовой сервер уже загрузил машинный код, связанный сеансом связи мультимодального приложения (например, делая загрузку машинного кода ненужной). В еще одном, другом альтернативном варианте осуществления клиентское устройство и голосовой сервер могут связываться непосредственно, чтобы устанавливать тракт звуковых данных VS/клиента (например, клиентское устройство может инициировать участок вызова к голосовому серверу, и тракт звуковых данных VS/клиента может быть установлен с помощью идентификатора сеанса связи, который посылается на сервер приложений).

Как предварительно обсуждалось в связи с блоками 206 и 208 на фиг. 2, после инициирования сеанса связи мультимодального приложения могут происходить по меньшей мере два типа событий, которые могут воздействовать на состояния голосового представления и/или визуального представления. Эти типы событий включают в себя генерируемое VS событие и генерируемое клиентом событие. Фиг. 5 и 6 иллюстрируют варианты осуществления процесса манипулирования генерируемым VS событием и процесса манипулирования генерируемым клиентом событием, соответственно.

Фиг. 5 представляет блок-схему способа выполнения процесса манипулирования генерируемым VS событием (например, процесса 206, фиг. 2), в соответствии с примерным вариантом осуществления. Термин "генерируемое VS событие" может быть определен как событие, которое происходит на голосовом сервере и которое может служить основанием изменения состояния для голосового представления. Например, различные генерируемые VS события могут включать в себя, но не ограничиваясь этим, событие распознавания речи, событие простоя и загрузки или обращение к другому звуковому диалогу, помимо всего прочего.

В варианте осуществления способ может начинаться, в блоке 502, когда клиентское устройство принимает, через свой пользовательский интерфейс, сигнал, который может представлять фрагмент активной речи пользователя (например, речь пользователя). Затем клиентское устройство может отцифровывать и обрабатывать сигнал так, чтобы генерировать звуковые данные восходящей линии связи, которые представляют сигнал, и может посылать звуковые данные восходящей линии связи на голосовой сервер по тракту звуковых данных (например, по тракту 124 звуковых данных VS/клиента, фиг. 1). Речь пользователя может соответствовать единственному элементу отображения (например, речь может быть фрагментом активной речи "Иллинойс", соответствующим элементу 402 отображения, фиг. 4) или более чем одному элементу отображения (например, речь может быть фрагментом активной речи "Чикаго, Иллинойс", соответствующим элементам 401 и 402 отображения). В различных вариантах осуществления тракт звуковых данных может быть установлен через сеть с пакетной коммутацией или сеть с коммутацией каналов. В варианте осуществления, в котором тракт звуковых данных установлен через сеть с пакетной коммутацией, клиентское устройство пакетирует звуковые данные и посылает звуковые данные в одном или более сообщениях, которые адресованы для IP-адреса голосового сервера и порта, которые клиентское устройство приняло во время процесса инициирования сеанса связи мультимодального приложения (например, процесса фиг. 3).

В блоке 504 голосовой сервер принимает звуковые данные восходящей линии связи. В ответ на прием звуковых данных восходящей линии связи голосовой сервер может выполнять процесс распознавания речи, в котором голосовой сервер пытается распознать речь (например, фрагмент активной речи), представленную звуковыми данными восходящей линии связи. В варианте осуществления это включает в себя обработку звуковых данных восходящей линии связи с помощью программы распознавания речи (например, программы 134 распознавания речи, фиг. 1). В варианте осуществления программа распознавания речи может обращаться к ресурсу распознавания речи, связанному с текущим состоянием голосового представления, где ресурс распознавания речи может включать в себя данные, связанные с набором фрагментов активной речи, которые связаны с текущим состоянием голосового представления. Например, обращаясь снова к фиг. 4, отметим, что поле ввода данных для первого элемента 401 отображения было заполнено данными "ЧИКАГО" (например, для элемента отображения "ГОРОД"). Курсор показан в поле ввода данных для второго элемента 402 отображения (то есть для элемента отображения "ШТАТ"), который указывает текущее фокусирование визуального представления, или состояние визуального представления. Когда визуальное представление и звуковое представление синхронизированы, состояние голосового представления будет соответствовать голосовому серверу, ожидающему приема звуковых данных, соответствующих фрагменту активной речи пользователя с названием штата. Поскольку существует конечное множество названий штатов, надежность программы распознавания речи может быть усовершенствована, когда программа распознавания речи обращается к ресурсу распознавания речи, связанному с набором фрагментов активной речи, соответствующим конечному множеству названий штатов. Ресурс распознавания речи может быть адаптирован так, чтобы распознавать речь с множеством различных произношений названий штатов и/или репрезентативных данных для охватываемых и охватывающих речевых характеристик, среди других переменных.