Область техники

[0001] Настоящее изобретение относится к области корректировки освещенности объектов на изображениях, и более конкретно к способу корректировки освещенности объекта на изображении в последовательности изображений и вычислительному устройству пользователя, реализующему упомянутый способ.

Уровень техники

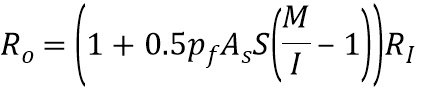

[0002] В уровне техники известны различные способы корректировки освещенности объекта на изображении. Такие способы, как правило, включают в себя этапы (см. фигуру 1), на которых: вводят изображение объекта, обнаруживают ключевые точки объекта, извлекают текстуру и освещение объекта, корректируют освещение объекта, смешивают текстуру и скорректированное освещение объекта, применяют смешанные текстуру и скорректированное освещение объекта к изображению объекта.

[0003] В патенте США US 7,324,688 B2 (29.01.2008, MITSUBISHI ELECTRIC RESEARCH LABORATORIES, INC), озаглавленном «Face relighting for normalization of directional lighting», раскрыт способ корректировки освещенности, использующий алгоритм поблочной оптимизации для извлечения карт текстуры и освещенности для дальнейшей нормализации освещенности лица. Главным недостатком раскрытого в патенте `688 подхода является изменение уникальных лицевых особенностей в результате применения такого способа корректировки освещенности к изображению лица. В силу этого лицо на изображении, которое подвергнуто такому способу корректировки освещенности, начинает походить на среднестатистическое лицо, использованное для такой корректировки освещенности.

[0004] Другой патент США US 8,582,896 B2 (12.11.2013, DIGITALOPTICS CORPORATION EUROPE LIMIT и др.), озаглавленный «Separating directional lighting variability in statistical face modelling based on texture space decomposition», раскрывает способ разложения изображения на текстуру и освещенность с использованием базовой лицевой модели, созданной проекциями метода главных компонент (PCA) в подпространство с равномерным распределением света, обученное на базе данных произвольных изображений. Данный документ может быть рассмотрен в качестве документа ближайшего уровня техники. Согласно тексту самого патента `896 раскрытый в нем подход способен удалять освещенность лишь до некоторой степени. Кроме того, раскрытый в патенте `896 подход не в состоянии удалить цветную освещенность и не предназначен для обработки лицевых изображений в высоком разрешении.

[0005] Другой патент США US 7,433,807 B2 (07.10.2008, MICROSOFT CORPORATION), озаглавленный «Facial image processing», раскрывает способ обработки лицевых изображений, который использует несколько вспышек для создания трехмерной лицевой модели и отделения текстуры от освещенности на основе нормалей этой трехмерной модели. Раскрытый в патенте `807 подход требует большого количества оборудования, которое внедрить в вычислительное устройство пользователя не представляется возможным. Кроме того, описанный в патенте `807 алгоритм вынужден анализировать несколько разных изображений, что приводит в результате к интенсивным вычислениям, реализация которых не может быть осуществлена в реальном масштабе времени.

[0006] Еще один патент США US 9,858,654 B2 (02.01.2018, ANTHROPICS TECHNOLOGY LIMITED), озаглавленный «Image manipulation», раскрывает способ обработки изображений, который формирует основанную на PCA двумерную модель, которая сливается с исходным лицевым изображением, для получения в результате изображения с новой освещенностью, которой управляют на основе PCA-коэффициентов. Раскрытый в патенте `654 подход не в состоянии удалять резкие тени и приводит в результате своей работы к изменению уникальных лицевых особенностей лица на изображении. Кроме того, предложенный в патенте `654 подход является достаточно медленным (согласно работе соответствующей программы PortraitPro) и не может быть осуществлен в реальном масштабе времени.

[0007] Различные другие реализации известны в данной области техники, но, насколько можно разумно установить из их доступной документации, эти реализации не могут адекватно решить все вышеуказанные проблемы, решаемые описанным в данной заявке изобретением.

Проблемы, решаемые настоящим изобретением

[0008] Таким образом, в решениях уровня техники существует ряд следующих проблем, требующих эффективного решения: отсутствие возможности обработки изображений высокого разрешения в реальном масштабе времени, отсутствие дополнительной стабилизации для видеообработки, отсутствие возможности обработки цветной освещенности, непреднамеренное изменение уникальных особенностей объекта на изображении и отсутствие обработки резких теней на изображении.

Средства решения проблем

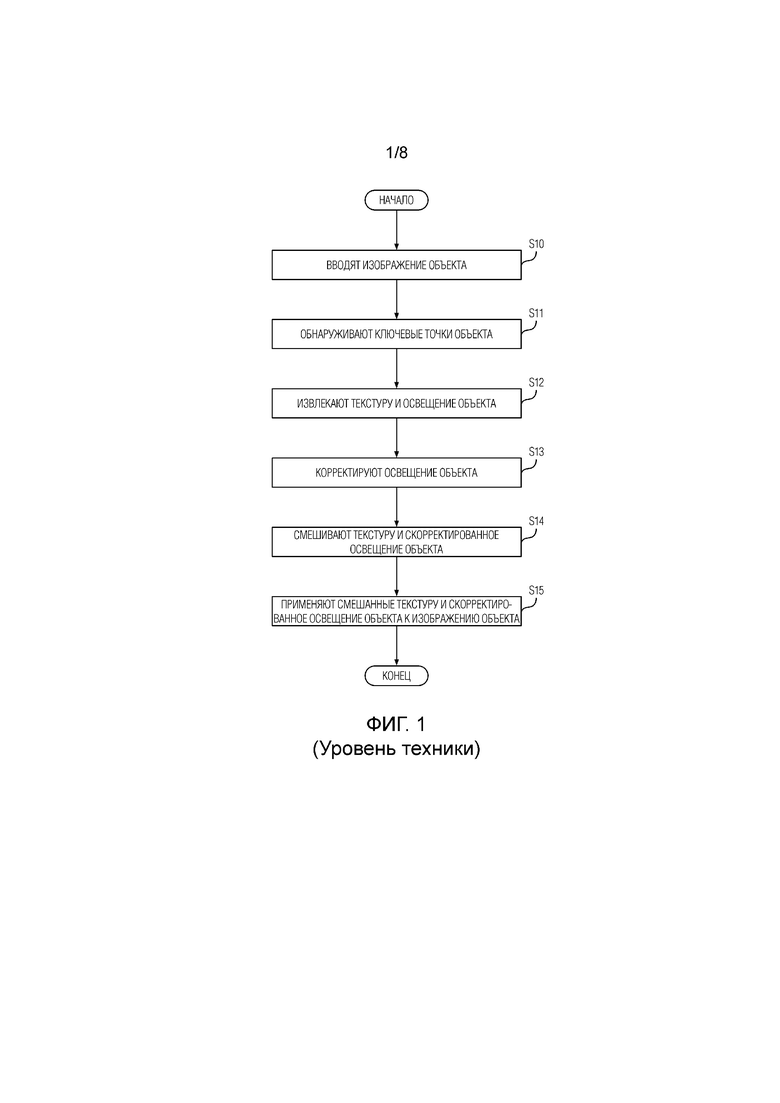

[0009] В первом аспекте настоящего изобретения обеспечен способ корректировки освещенности объекта на изображении в последовательности изображений, содержащий этапы, на которых: вводят изображение и получают заданный вектор направления света; обнаруживают ключевые точки объекта и особенности изображения; обрезают изображение по ключевым точкам объекта для получения изображения объекта; преобразуют изображение объекта в формат с яркостной и цветоразностными компонентами (YUV); создают модель освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, в которой освещенность определена заданным вектором направления света; формируют модель адаптированной освещенности объекта; извлекают фактическую освещенность объекта на изображении; заменяют фактическую освещенность объекта на изображении адаптированной освещенностью объекта, определенной моделью адаптированной освещенности объекта; и выводят изображение в последовательности изображений, в котором фактическая освещенность объекта заменена адаптированной освещенностью объекта.

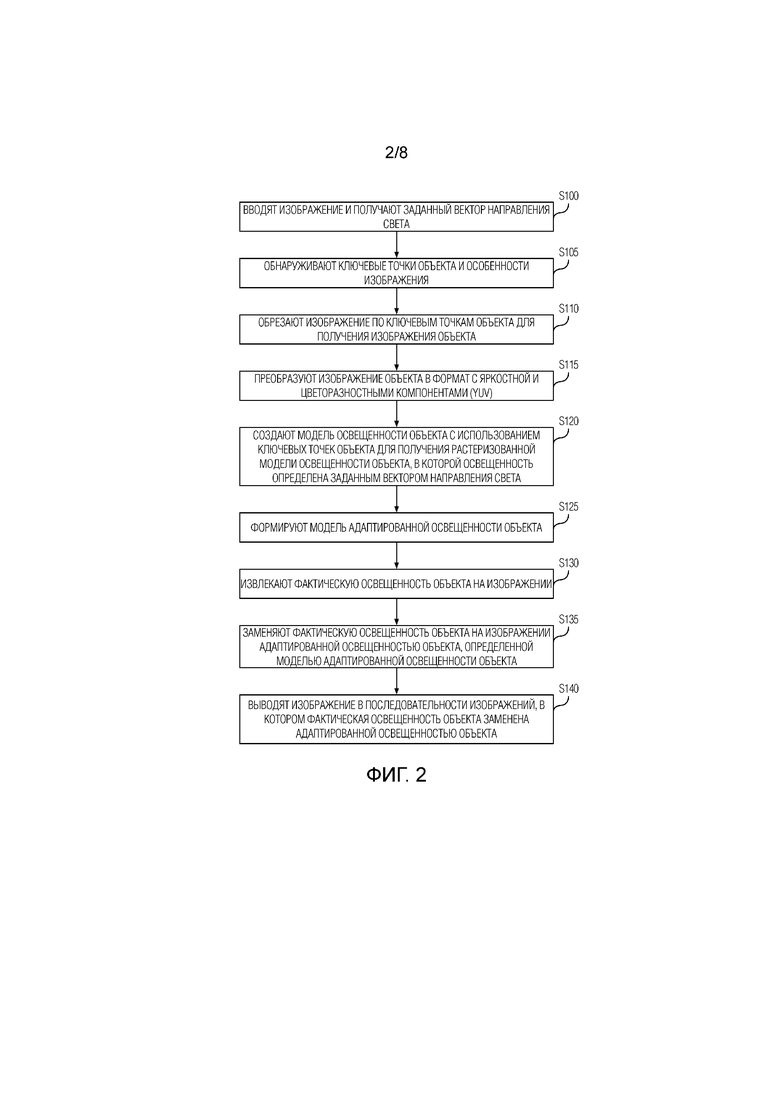

[0010] В упомянутом способе этап формирования модели адаптированной освещенности объекта содержит этапы, на которых: растягивают края растеризованной модели освещенности объекта до краев обрезанного изображения объекта; вычисляют Y-, U- и V-гистограммы растеризованной модели освещенности объекта с растянутыми краями; вычисляют Y-, U- и V-гистограммы обрезанного изображения объекта; корректируют предопределенную маску поверхности объекта под обрезанное изображение объекта путем удаления из маски поверхности объекта светлых и темных участков обрезанного изображения объекта, которые определяются соответствующими пороговыми значениями яркости; удаляют из полученных U- и V- гистограмм растеризованной модели освещенности объекта с растянутыми краями и U- и V-гистограмм обрезанного изображения объекта значения, которые попали в удаленные светлые и темные участки обрезанного изображения объекта, и осуществляют эквализацию упомянутых U- и V- гистограмм; корректируют яркость, контраст и цвет растеризованной модели освещенности объекта с растянутыми краями посредством оценки Y-гистограмм обрезанного изображения объекта и растеризованной модели освещенности объекта с растянутыми краями и применения подвергнутых эквализации U- и V-гистограмм для формирования модели адаптированной освещенности объекта; и сглаживают на сформированной модели адаптированной освещенности объекта участки, заданные предопределенными blobs-компонентами объекта.

[0011] В упомянутом способе маску поверхности объекта формируют на основе ключевых точек объекта посредством создания маски лицевой поверхности объекта, оценки цветового коэффициента по обрезанному изображению объекта и нахождения области поверхности объекта.

[0012] В упомянутом способе заданным вектором направления света является вектор направления света по умолчанию или предопределенный пользователем вектор направления света; объектом является лицо; поверхностью объекта является кожа лица; blobs-компоненты содержат брови, глаза, нос и рот.

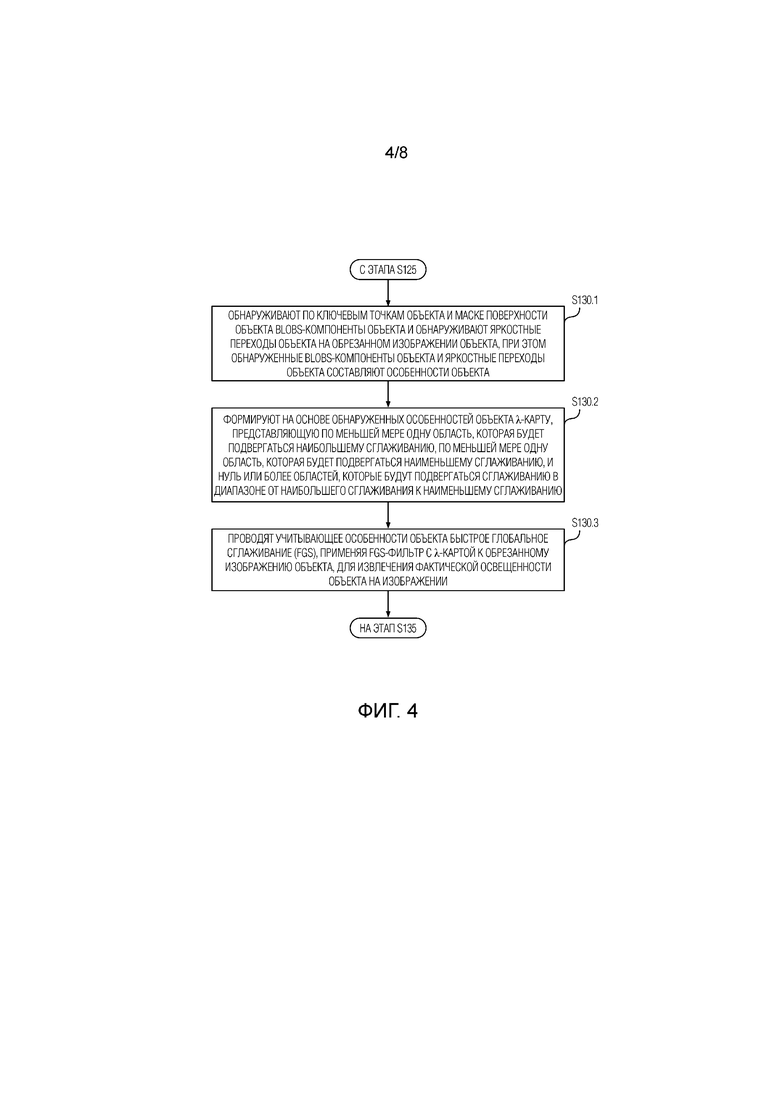

[0013] В упомянутом способе этап извлечения фактической освещенности объекта на изображении содержит этапы, на которых: обнаруживают по ключевым точкам объекта и маске поверхности объекта blobs-компоненты объекта и обнаруживают яркостные переходы объекта на обрезанном изображении объекта, при этом обнаруженные blobs-компоненты объекта и яркостные переходы объекта составляют особенности объекта; формируют на основе обнаруженных особенностей объекта λ-карту, представляющую по меньшей мере одну область, которая будет подвергаться наибольшему сглаживанию, по меньшей мере одну область, которая будет подвергаться наименьшему сглаживанию, и нуль или более областей, которые будут подвергаться сглаживанию в диапазоне от наибольшего сглаживания к наименьшему сглаживанию; и проводят учитывающее особенности объекта быстрое глобальное сглаживание (FGS), применяя FGS-фильтр с λ-картой к обрезанному изображению объекта, для извлечения фактической освещенности объекта на изображении. Проведение учитывающего особенности объекта быстрого глобального сглаживания (FGS) позволяет удалить/сгладить резкие тени на изображении с сохранением уникальных особенностей объекта.

[0014] В упомянутом способе этап замены фактической освещенности объекта на изображении адаптированной освещенностью объекта содержит этапы, на которых: принимают сформированную маску поверхности объекта; проводят стабилизированное FGS, применяя фильтр стабилизированного FGS к сформированной маске поверхности объекта путем решения обратной задачи с регуляризатором, причем решение обратной задачи с регуляризатором содержит следующие подэтапы, на которых: вычисляют значения регуляризатора с использованием сохраненных данных о сглаженной маске поверхности объекта, полученной для предыдущего изображения в последовательности изображений, и разностной карты; применяют фильтр стабилизированного FGS к сформированной маске поверхности объекта с использованием регуляризатора, значения которого равны вычисленным значениям регуляризатора; обновляют разностную карту путем попиксельного применения рекурсивного фильтра; сохраняют сглаженную маску поверхности объекта для текущего изображения; и нормализуют значения сглаженной маски поверхности объекта для текущего изображения в диапазоне 0..1; оценивают вероятности некорректного обнаружения ключевых точек объекта с помощью признаков объекта, представленного в текущем изображении в последовательности изображений, причем оценка содержит проверку этих выделенных признаков объекта машиной опорных векторов, предварительно обученной на выборке, состоящей из признаков произвольных изображений и соответствующих этим признакам вероятностей некорректного обнаружения ключевых точек; и врисовывают адаптированную освещенность объекта, определенную моделью адаптированной освещенности объекта, в текущее изображение в последовательности изображений с применением сглаженной маски поверхности объекта и учетом вероятности некорректного обнаружения ключевых точек объекта.

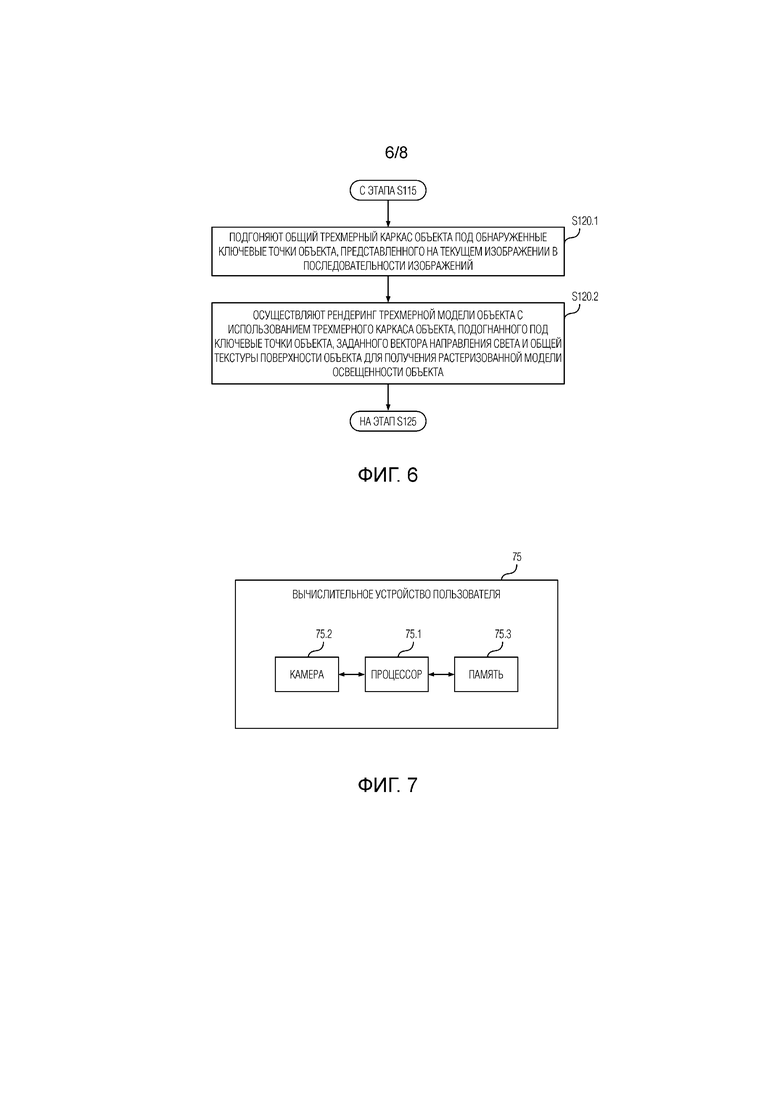

[0015] В упомянутом способе этап создания модели освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, в которой освещенность определена заданным вектором направления света, содержит этапы, на которых: подгоняют общий трехмерный каркас объекта под обнаруженные ключевые точки объекта, представленного на текущем изображении в последовательности изображений; и осуществляют рендеринг трехмерной модели объекта c использованием трехмерного каркаса объекта, подогнанного под ключевые точки объекта, заданного вектора направления света и общей текстуры поверхности объекта для получения растеризованной модели освещенности объекта.

[0016] Во втором аспекте настоящего изобретения обеспечено вычислительное устройство пользователя или мобильное устройство, содержащее процессор, камеру и память, хранящую исполняемые процессором инструкции, которые, при исполнении процессором, дают команду процессору на выполнение способа корректировки освещенности объекта на изображении в последовательности изображений согласно вышеупомянутому первому аспекту настоящего изобретения.

Благоприятные эффекты настоящего изобретения

[0017] Предложенный в настоящей заявке способ позволяет сохранить уникальные особенности объекта на изображении и удалить резкие тени вследствие использования в нем учитывающего особенности объекта быстрого глобального сглаживания (FGS). Кроме того, предложенный в настоящей заявке способ позволяет осуществлять обработку цветной освещенности объектов и сохраняет уникальный цвет объекта за счет использования в нем модели адаптированной освещенности объекта. Дополнительно, предложенный в настоящей заявке способ выполнен с возможностью непрерывной видеообработки в реальном масштабе времени за счет использования в нем фильтра стабилизированного FGS. Таким образом, настоящим изобретением достигается повышение общей эффективности и качества обработки изображений в последовательности изображений в реальном масштабе времени, а сама обработка является пригодной для реализации на вычислительном устройстве пользователя или мобильном устройстве.

Краткое описание чертежей

[0018] Другие достоинства настоящего изобретения станут очевидны специалисту в данной области техники после ознакомления с нижеследующим подробным описанием различных вариантов его осуществления, а также с чертежами, на которых:

[Фиг. 1] Фигура 1 иллюстрирует общую схему способа корректировки освещенности объекта на изображении согласно решению в уровне техники.

[Фиг. 2] Фигура 2 иллюстрирует схему последовательности операций варианта осуществления способ корректировки освещенности объекта на изображении в последовательности изображений согласно настоящему изобретению.

[Фиг. 3] Фигура 3 иллюстрирует схему последовательности операций варианта осуществления этапа формирования модели (40) адаптированной освещенности объекта согласно настоящему изобретению.

[Фиг. 4] Фигура 4 иллюстрирует схему последовательности операций варианта осуществления этапа извлечения фактической освещенности объекта на изображении согласно настоящему изобретению.

[Фиг. 5] Фигура 5 иллюстрирует схему последовательности операций варианта осуществления этапа замены фактической освещенности объекта на изображении адаптированной освещенностью объекта согласно настоящему изобретению.

[Фиг. 6] Фигура 6 иллюстрирует схему последовательности операций варианта осуществления этапа создания модели освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, в которой освещенность определена заданным вектором направления света, согласно настоящему изобретению.

[Фиг. 7] Фигура 7 иллюстрирует блок-схему варианта осуществления вычислительного устройства пользователя, реализующего способ корректировки освещенности объекта на изображении согласно настоящему изобретению.

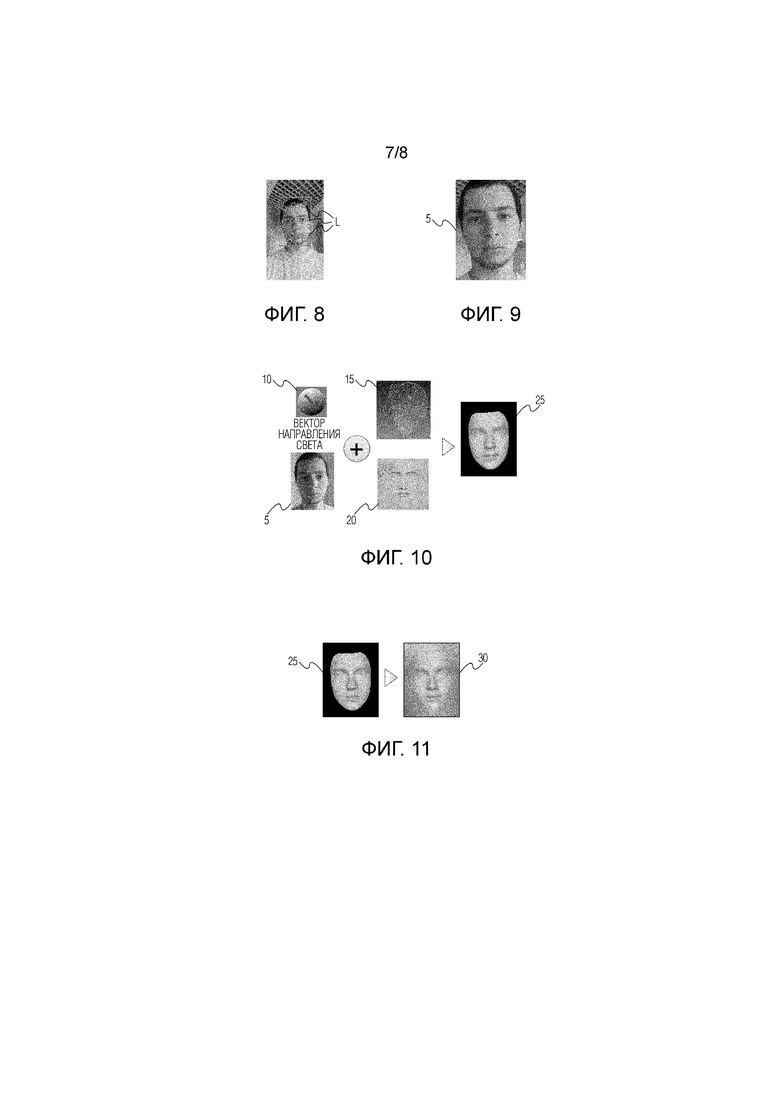

[Фиг. 8] Фигура 8 иллюстрирует пример обнаружения ключевых точек L на входном изображении.

[Фиг. 9] Фигура 9 иллюстрирует пример обрезанного по ключевым точкам изображения.

[Фиг. 10] Фигура 10 иллюстрирует пример создания растеризованной модели (25) освещенности объекта.

[Фиг. 11] Фигура 11 иллюстрирует пример выполнения растяжения растеризованной модели (25) освещенности объекта.

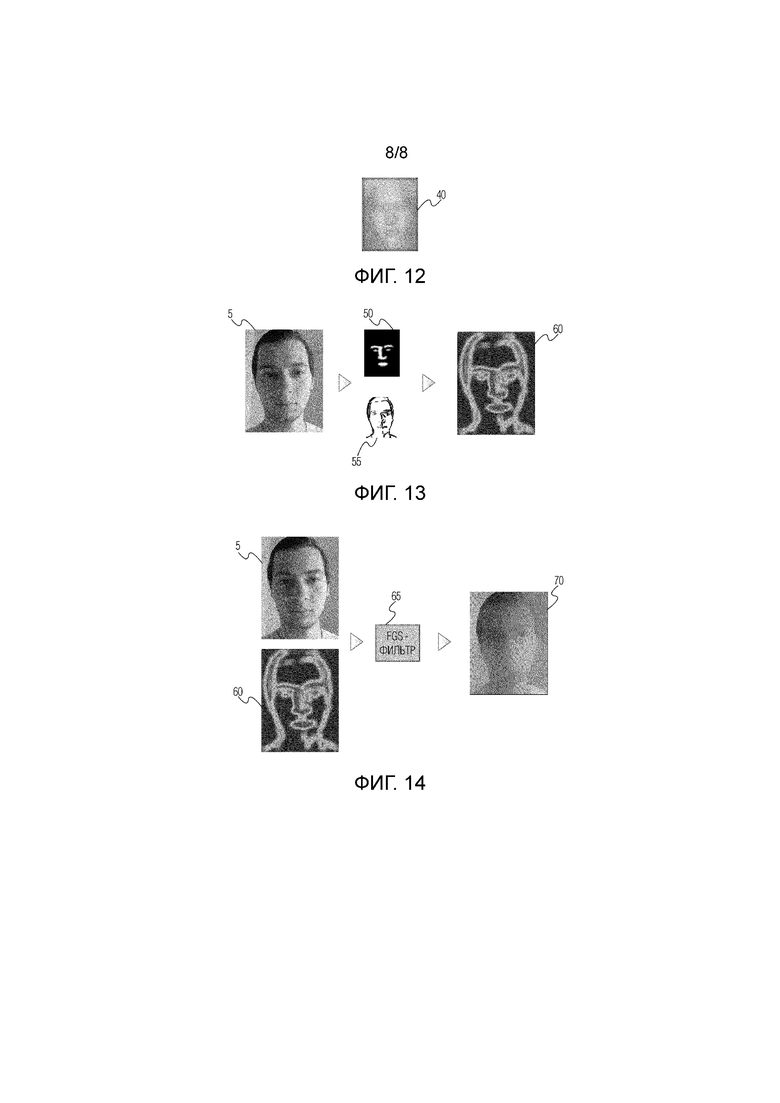

[Фиг. 12] Фигура 12 иллюстрирует пример сформированной модели (40) адаптированной освещенности объекта со сглаженными участками, заданными предопределенными blobs-компонентами объекта.

[Фиг. 13] Фигура 13 иллюстрирует пример обнаруженных особенностей (45) объекта, т.е. blobs-компонентов (50) объекта и яркостных переходов (55) объекта, а также формируемой на их основе λ-карты (60) для обрезанного изображения (5) объекта.

[Фиг. 14] Фигура 14 иллюстрирует пример результатов проведения быстрого глобального сглаживания (FGS), учитывающего особенности (45) объекта.

Подробное описание вариантов осуществления изобретения

[0019] Предпочтительные варианты осуществления настоящего изобретения теперь будут описаны более подробно со ссылкой на чертежи, на которых идентичные элементы на разных фигурах, по возможности, идентифицируются одинаковыми ссылочными позициями. Эти варианты осуществления представлены посредством пояснения настоящего изобретения, которое, однако, не следует ими ограничивать. Специалисты в данной области техники поймут после ознакомления с настоящим подробным описанием и чертежами, что могут быть сделаны различные модификации и варианты.

[0020] Фигура 2 иллюстрирует схему последовательности операций варианта осуществления способ корректировки освещенности объекта на изображении в последовательности изображений согласно настоящему изобретению. На этапе S100 может быть введено изображение и может быть получен заданный вектор направления света. Заданным вектором направления света может быть вектор направления света по умолчанию или предопределенный пользователем вектор направления света. В предпочтительном варианте настоящего изобретения объектом на вводимом изображении является, но без ограничения упомянутым, лицо, а поверхностью объекта является кожа лица. Тем не менее следует понимать, что раскрытый способ корректировки освещенности также может быть успешно применен к изображениям, на которых содержится любой другой объект(ы). Для этого, алгоритм нахождения ключевых точек, использующий, например, машину опорных векторов (SVM) или любой другой алгоритм машинного обучения, может быть обучен на ключевых точках объекта, корректировка освещенности которого раскрытым способом представляет интерес. Затем, может быть подготовлен трехмерный каркас этого объекта, и ключевые точки, относящиеся к blobs-компонентам этого объекта, могут быть помечены.

[0021] Настоящее изобретение основано на законе диффузного отражения Ламберта  , где

, где  - получаемое в результате изображение,

- получаемое в результате изображение,  - освещенность,

- освещенность,  - текстура (альбедо), а

- текстура (альбедо), а  число пикселей изображения. Таким образом, целью является отделение текстуры от освещенности и замена карты исходной освещенности картой желаемой освещенности. На этапе S105 во входном изображении могут быть обнаружены ключевые точки объекта

число пикселей изображения. Таким образом, целью является отделение текстуры от освещенности и замена карты исходной освещенности картой желаемой освещенности. На этапе S105 во входном изображении могут быть обнаружены ключевые точки объекта  и особенности изображения. Пример обнаружения ключевых точек проиллюстрирован на фигуре 8. Значение n отражает число ключевых точек и может быть предопределенно равным, но без ограничения упомянутым конкретным значением, 68. Под ключевыми точками объекта в настоящей заявке следует понимать спроецированные на плоскость изображения объекта точки, соответствующие центрам опорных областей объекта, предопределенных в соответствии с обобщенным трехмерным представлением последнего, например, кончик носа, уголки губ и глаз, центры зрачков и т.д. Под особенностями изображения в настоящей заявке следует понимать уникальные свойства текстуры объекта, которые отсутствуют у обобщенной модели объекта.

и особенности изображения. Пример обнаружения ключевых точек проиллюстрирован на фигуре 8. Значение n отражает число ключевых точек и может быть предопределенно равным, но без ограничения упомянутым конкретным значением, 68. Под ключевыми точками объекта в настоящей заявке следует понимать спроецированные на плоскость изображения объекта точки, соответствующие центрам опорных областей объекта, предопределенных в соответствии с обобщенным трехмерным представлением последнего, например, кончик носа, уголки губ и глаз, центры зрачков и т.д. Под особенностями изображения в настоящей заявке следует понимать уникальные свойства текстуры объекта, которые отсутствуют у обобщенной модели объекта.

[0022] На этапе S110 изображение может быть обрезано  по ключевым точкам объекта для получения изображения объекта так, чтобы обрезанное изображение (5) включало в себя весь объект и его ключевые точки. Пример обрезанного по ключевым точкам изображения (5) проиллюстрирован на фигуре 9. Данный этап позволяет снизить вычислительную сложность способа на последующих этапах, исключая из входного изображения области, которые обрабатывать не следует. На этапе S115 изображение (5) объекта может быть преобразовано в формат с яркостной и цветоразностными компонентами, например, но без ограничения упомянутым, YUV NV21.

по ключевым точкам объекта для получения изображения объекта так, чтобы обрезанное изображение (5) включало в себя весь объект и его ключевые точки. Пример обрезанного по ключевым точкам изображения (5) проиллюстрирован на фигуре 9. Данный этап позволяет снизить вычислительную сложность способа на последующих этапах, исключая из входного изображения области, которые обрабатывать не следует. На этапе S115 изображение (5) объекта может быть преобразовано в формат с яркостной и цветоразностными компонентами, например, но без ограничения упомянутым, YUV NV21.

[0023] На этапе S120 модель освещенности объекта может быть создана с использованием ключевых точек объекта для получения растеризованной модели (25) освещенности объекта, в которой освещенность определена заданным вектором (10) направления света. Для этого получают базовый трехмерный каркас (15) объекта  и подгоняют его под обнаруженные ключевые точки L объекта. Значение m отражает число вершин трехмерного каркаса и может быть предопределенно равным, но без ограничения упомянутым конкретным значением, 3448. К подогнанному трехмерному каркасу (15) объекта может быть применена освещенность, определенная заданным вектором

и подгоняют его под обнаруженные ключевые точки L объекта. Значение m отражает число вершин трехмерного каркаса и может быть предопределенно равным, но без ограничения упомянутым конкретным значением, 3448. К подогнанному трехмерному каркасу (15) объекта может быть применена освещенность, определенная заданным вектором  (10) направления света. Затем, могут быть осуществлены рендеринг с применением базовой текстуры

(10) направления света. Затем, могут быть осуществлены рендеринг с применением базовой текстуры  объекта (20) и растеризация скорректированного трехмерного каркаса (15) объекта для получения растеризованной модели (25) освещенности объекта. Другими словами, при обработке последовательности изображений, подгоняют

объекта (20) и растеризация скорректированного трехмерного каркаса (15) объекта для получения растеризованной модели (25) освещенности объекта. Другими словами, при обработке последовательности изображений, подгоняют  под L и осуществляют рендеринг каждого tого (может быть 1, 2 или 4) изображения трехмерного каркаса (15) объекта, используя

под L и осуществляют рендеринг каждого tого (может быть 1, 2 или 4) изображения трехмерного каркаса (15) объекта, используя  и

и  , для получения модели

, для получения модели  (25) освещенности объекта. Таким образом, при обработке видео рендеринг нового изображения трехмерной модели может быть осуществлен не на каждом кадре, а с пропусками некоторого числа кадров, используя одно и то же изображение для промежуточных кадров, что экономит вычислительные ресурсы, требуемые для реализации способа. Пример создания растеризованной модели (25) освещенности объекта проиллюстрирован на фигуре 10. На примере с фигуры 10 объектом на изображении является лицо, трехмерным каркасом (15) объекта является трехмерный каркас головы, базовой текстурой объекта (20) является базовая текстура лица, растеризованной моделью (25) освещенности объекта является растеризованная модель освещенности лица.

(25) освещенности объекта. Таким образом, при обработке видео рендеринг нового изображения трехмерной модели может быть осуществлен не на каждом кадре, а с пропусками некоторого числа кадров, используя одно и то же изображение для промежуточных кадров, что экономит вычислительные ресурсы, требуемые для реализации способа. Пример создания растеризованной модели (25) освещенности объекта проиллюстрирован на фигуре 10. На примере с фигуры 10 объектом на изображении является лицо, трехмерным каркасом (15) объекта является трехмерный каркас головы, базовой текстурой объекта (20) является базовая текстура лица, растеризованной моделью (25) освещенности объекта является растеризованная модель освещенности лица.

[0024] На этапе S125 может быть сформирована модель  (40) адаптированной освещенности объекта. Подробности данного этапа S125 проиллюстрированы на фигуре 3. Целью этапов S120 и S125 является рендеринг целевой модели освещенности объекта на основе созданного трехмерного каркаса объекта, форма и цвет которого подгоняются под входное изображение объекта. На этапе S125.1 края растеризованной модели (25) освещенности объекта могут быть растянуты до краев обрезанного изображения объекта, т.е. растягивают изображение

(40) адаптированной освещенности объекта. Подробности данного этапа S125 проиллюстрированы на фигуре 3. Целью этапов S120 и S125 является рендеринг целевой модели освещенности объекта на основе созданного трехмерного каркаса объекта, форма и цвет которого подгоняются под входное изображение объекта. На этапе S125.1 края растеризованной модели (25) освещенности объекта могут быть растянуты до краев обрезанного изображения объекта, т.е. растягивают изображение  для получения изображения

для получения изображения  . Для этого, в одном варианте осуществления настоящего изобретения, для каждого пикселя

. Для этого, в одном варианте осуществления настоящего изобретения, для каждого пикселя  некоторого края изображения

некоторого края изображения  находят первый ненулевой пиксель

находят первый ненулевой пиксель  на линии, представляющей строку пикселей или столбец пикселей изображения

на линии, представляющей строку пикселей или столбец пикселей изображения  , которая ортогональна упомянутому краю. Если пиксель

, которая ортогональна упомянутому краю. Если пиксель  существует, проходят по некоторому количеству ненулевых пикселей (вплоть до 9 пикселей) в направлении

существует, проходят по некоторому количеству ненулевых пикселей (вплоть до 9 пикселей) в направлении  для получения внутреннего пикселя

для получения внутреннего пикселя  и осуществляют интерполяцию

и осуществляют интерполяцию  пикселей в

пикселей в  пиксели. Данный этап выполняется для того, чтобы исключить из изображения растеризованной модели (25) освещенности объекта черную область за пределами объекта, полученную в результате рендеринга модели (25) освещенности объекта, и обеспечить более легкую врисовку изображения объекта со скорректированной освещенностью, получаемого в результате выполнения раскрытого способа, в соответствующее изображение в исходной последовательности изображений. Этот этап S125.1 также обеспечивает возможность обрабатывать видеопоток высокого разрешения посредством раскрытого способа в режиме реального времени, поскольку сложность врисовки изображения объекта со скорректированной освещенностью, получаемого в результате выполнения раскрытого способа, в соответствующее изображение в исходной последовательности изображений существенно снижена в сравнении с решениями, известными из уровня техники. Пример выполнения растяжения растеризованной модели (25) освещенности объекта для получения растеризованной модели (30) освещенности объекта с растянутыми краями проиллюстрирован на фигуре 11.

пиксели. Данный этап выполняется для того, чтобы исключить из изображения растеризованной модели (25) освещенности объекта черную область за пределами объекта, полученную в результате рендеринга модели (25) освещенности объекта, и обеспечить более легкую врисовку изображения объекта со скорректированной освещенностью, получаемого в результате выполнения раскрытого способа, в соответствующее изображение в исходной последовательности изображений. Этот этап S125.1 также обеспечивает возможность обрабатывать видеопоток высокого разрешения посредством раскрытого способа в режиме реального времени, поскольку сложность врисовки изображения объекта со скорректированной освещенностью, получаемого в результате выполнения раскрытого способа, в соответствующее изображение в исходной последовательности изображений существенно снижена в сравнении с решениями, известными из уровня техники. Пример выполнения растяжения растеризованной модели (25) освещенности объекта для получения растеризованной модели (30) освещенности объекта с растянутыми краями проиллюстрирован на фигуре 11.

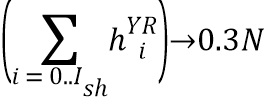

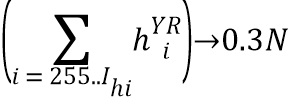

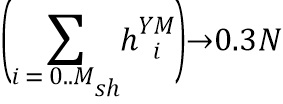

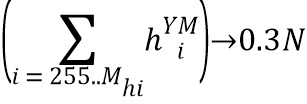

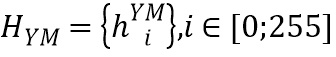

[0025] На этапах S125.2 и S125.3 могут быть вычислены, соответственно, Y-, U- и V-гистограммы ( ) растеризованной модели

) растеризованной модели  (30) освещенности объекта с растянутыми краями и Y-, U- и V-гистограммы (

(30) освещенности объекта с растянутыми краями и Y-, U- и V-гистограммы ( ) обрезанного изображения

) обрезанного изображения  (5) объекта. Вычисление данных гистограмм может быть выполнено любым из известных в уровне техники способов. На этапе S125.4 предопределенная маска

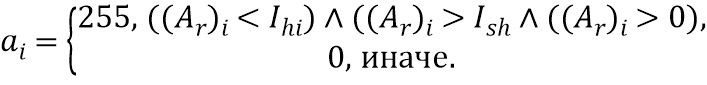

(5) объекта. Вычисление данных гистограмм может быть выполнено любым из известных в уровне техники способов. На этапе S125.4 предопределенная маска  (35) поверхности объекта может быть скорректирована под обрезанное изображение (5) объекта путем удаления из маски (35) поверхности объекта светлых и темных участков обрезанного изображения (5) объекта, которые определяются соответствующими пороговыми значениями яркости. Для этого, в одном варианте осуществления настоящего изобретения, корректируют маску

(35) поверхности объекта может быть скорректирована под обрезанное изображение (5) объекта путем удаления из маски (35) поверхности объекта светлых и темных участков обрезанного изображения (5) объекта, которые определяются соответствующими пороговыми значениями яркости. Для этого, в одном варианте осуществления настоящего изобретения, корректируют маску  поверхности объекта для получения скорректированной маски

поверхности объекта для получения скорректированной маски  поверхности объекта, при этом:

поверхности объекта, при этом:

,

,  ,

,

Предопределенная маска (35) поверхности объекта представляет собой бинарную маску поверхности объекта, построенную путем закрашивания всех областей, находящихся внутри выпуклого многоугольника, образованного ключевыми точками объекта. Предопределенная маска (35) поверхности объекта используется для нахождения области изображения, содержащей поверхность объекта. Удаление светлых и темных участков обрезанного изображения (5) объекта из маски (35) поверхности объекта выполняют для того, чтобы исключить участки поверхности объекта, содержащие недостоверную информацию об освещенности и цвете объекта. Соответствующие пороговые значениями яркости для удаления из маски (35) поверхности объекта светлых и темных участков могут быть определены эмпирически.

[0026] В одном варианте осуществления настоящего изобретения маска  (35) поверхности объекта может быть сформирована на основе ключевых точек L объекта посредством создания маски

(35) поверхности объекта может быть сформирована на основе ключевых точек L объекта посредством создания маски  лицевой поверхности объекта с использованием ключевых точек L объекта за исключением ключевых точек, которые соответствуют бровям, рту и носу. Затем по сформированной маске

лицевой поверхности объекта с использованием ключевых точек L объекта за исключением ключевых точек, которые соответствуют бровям, рту и носу. Затем по сформированной маске  лицевой поверхности и обрезанному изображению (5) объекта может выть проведена оценка цветового коэффициента. Эта оценка может быть проведена посредством создания пробной маски

лицевой поверхности и обрезанному изображению (5) объекта может выть проведена оценка цветового коэффициента. Эта оценка может быть проведена посредством создания пробной маски  поверхности объекта, которая является маской лицевой поверхности, из которой удалено все, что находится ниже носа и выше бровей, сглаживания изображения лицевой поверхности объекта

поверхности объекта, которая является маской лицевой поверхности, из которой удалено все, что находится ниже носа и выше бровей, сглаживания изображения лицевой поверхности объекта  с помощью усредняющего квадратного фильтра, имеющего размер 5, но без ограничения этим конкретным значением, и вычисления цветового коэффициента согласно следующему:

с помощью усредняющего квадратного фильтра, имеющего размер 5, но без ограничения этим конкретным значением, и вычисления цветового коэффициента согласно следующему:

,

,

где  может быть равно 1,1.

может быть равно 1,1.

Область  поверхности объекта, определяющая искомую маску

поверхности объекта, определяющая искомую маску  (35) поверхности объекта, в результате может быть найдена следующим образом:

(35) поверхности объекта, в результате может быть найдена следующим образом:  .

.

В варианте осуществления настоящего изобретения, когда объектом является произвольный объект, а не лицо, маска (35) поверхности такого объекта, т.е. бинарная маска поверхности объекта, может быть предопределена путем закрашивания всех областей, находящихся внутри выпуклого многоугольника, образованного ключевыми точками, предопределенными для такого произвольного объекта, представляющего интерес.

[0027] На этапе S125.5 из полученных U- и V- гистограмм растеризованной модели (30) освещенности объекта с растянутыми краями и U- и V-гистограмм обрезанного изображения (5) объекта могут быть удалены значения, которые попали в удаленные светлые и темные участки обрезанного изображения (5) объекта, определяемые скорректированной маской  поверхности объекта. Другими словами, на данном этапе S125.5 из UV-гистограмм удаляют нулевые пиксели в

поверхности объекта. Другими словами, на данном этапе S125.5 из UV-гистограмм удаляют нулевые пиксели в  и осуществляют эквализацию

и осуществляют эквализацию  гистограмм. Удаление значении, которые попали в удаленные светлые и темные участки обрезанного изображения (5) объекта, из полученных Y-, U- и V- гистограмм выполняют для того, чтобы исключить области поверхности объекта, содержащие недостоверную информацию об освещенности и цвете объекта.

гистограмм. Удаление значении, которые попали в удаленные светлые и темные участки обрезанного изображения (5) объекта, из полученных Y-, U- и V- гистограмм выполняют для того, чтобы исключить области поверхности объекта, содержащие недостоверную информацию об освещенности и цвете объекта.

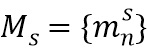

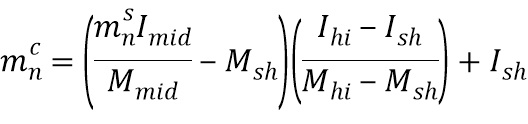

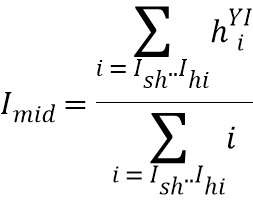

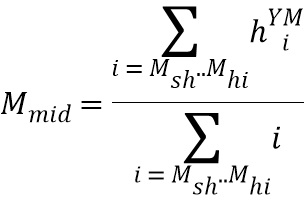

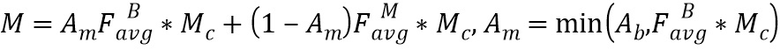

[0028] На этапе S125.6 яркость, контраст и цвет растеризованной модели (30) освещенности объекта с растянутыми краями могут быть скорректированы посредством оценки Y-гистограмм обрезанного изображения (5) объекта и растеризованной модели (30) освещенности объекта с растянутыми краями и применения подвергнутых эквализации U- и V-гистограмм тех же самых изображений, т.е. изображения растеризованной модели (30) освещенности объекта с растянутыми краями и обрезанного изображения (5) объекта, для формирования модели (40) адаптированной освещенности объекта, обеспечивающей перекрашенную освещенность. Вышеупомянутое применение подвергнутых эквализации U- и V-гистограмм для формирования модели (40) адаптированной освещенности объекта содержит использование их значений для модификации цветов изображения модели освещенности. Другими словами, для формирования модели  (40) адаптированной освещенности объекта, в одном варианте осуществления настоящего изобретения яркость

(40) адаптированной освещенности объекта, в одном варианте осуществления настоящего изобретения яркость  регулируют и подвергнутые эквализации U- и V-гистограммы применяют согласно следующему:

регулируют и подвергнутые эквализации U- и V-гистограммы применяют согласно следующему:

,

,  ,

,  ,

,  ,

,  ,

,  .

.

[0029] Этапы S125.2-S125.6 также обеспечивают более легкую врисовку изображения объекта со скорректированной освещенностью, получаемого в результате выполнения раскрытого способа, в соответствующее изображение в исходной последовательности изображений. Кроме того, этапы S125.2-S125.6 адаптируют целевую модель освещенности под яркость и цвет конкретного входного изображения объекта, что позволяет получить модель (40) адаптированной освещенности объекта, которая обеспечивает реалистичную скорректированную освещенность, при которой уникальные особенности объекта будут сохранены на изображении объекта, получаемом в результате выполнения раскрытого способа, которое будет врисовываться в соответствующее изображение в последовательности изображений.

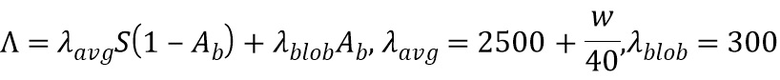

[0030] На этапе S125.7 на сформированной модели (40) адаптированной освещенности объекта участки, заданные предопределенными blobs-компонентами объекта, могут быть сглажены. Другими словами, в одном варианте осуществления настоящего изобретения blobs-компоненты объекта могут быть сглажены на данном этапе S125.7 согласно следующему:

,

,

представляет собой модель (40) адаптированной освещенности объекта со сглаженными blobs-компонентами объекта.

представляет собой модель (40) адаптированной освещенности объекта со сглаженными blobs-компонентами объекта.  представляют собой усредняющие квадратные фильтры, имеющие размеры

представляют собой усредняющие квадратные фильтры, имеющие размеры  , соответственно. Под blobs-компонентами объекта в настоящей заявке понимаются области определенные заранее размеченными ключевыми точками объекта, соответствующие высоко текстурированным областям, например, глаза, рот, брови, кончик носа и т.д. В варианте осуществления настоящего изобретения, в котором объектом является лицо, blobs-компоненты содержат, но без ограничения упомянутым, брови, глаза, нос и рот. Упомянутое сглаживание выполняется для того, чтобы предотвратить удаление blobs-компонентов на последующем этапе врисовки изображения со скорректированной освещенностью в исходную последовательность изображений. Пример сформированной модели (40) адаптированной освещенности объекта со сглаженными участками, заданными предопределенными blobs-компонентами объекта, проиллюстрирован на фигуре 12.

, соответственно. Под blobs-компонентами объекта в настоящей заявке понимаются области определенные заранее размеченными ключевыми точками объекта, соответствующие высоко текстурированным областям, например, глаза, рот, брови, кончик носа и т.д. В варианте осуществления настоящего изобретения, в котором объектом является лицо, blobs-компоненты содержат, но без ограничения упомянутым, брови, глаза, нос и рот. Упомянутое сглаживание выполняется для того, чтобы предотвратить удаление blobs-компонентов на последующем этапе врисовки изображения со скорректированной освещенностью в исходную последовательность изображений. Пример сформированной модели (40) адаптированной освещенности объекта со сглаженными участками, заданными предопределенными blobs-компонентами объекта, проиллюстрирован на фигуре 12.

[0031] На этапе S130 фактическая I (70) освещенность объекта на изображении может быть извлечена. Подробности данного этапа S130 проиллюстрированы на фигуре 4. Целью этапа S130 является извлечение фактической освещенности объекта, используя фильтр быстрого глобального сглаживания (FGS), сохраняющий края объекта, который выявляет низкочастотные яркостные переходы и сохраняет резкие тени, подлежащие последующему удалению на этапе врисовки изображения со скорректированной освещенностью в исходную последовательность изображений. На этапе S130.1 по ключевым точкам L объекта и маске  (35) поверхности объекта могут быть обнаружены blobs-компоненты (50) объекта и на обрезанном изображении (5) объекта могут быть обнаружены яркостные переходы (55) объекта, при этом обнаруженные blobs-компоненты (50) объекта и яркостные переходы (55) объекта составляют особенности (45) объекта. Яркостные переходы (55) объекта определяют уникальные свойства объекта. В варианте осуществления, в котором объектом является лицо, blobs-компоненты (50) содержат, но без ограничения упомянутым, брови, глаза, нос и рот. Для удобства и ускорения дальнейшей обработки blobs-компонентов (50) объекта, на данном этапе S130.1 из blobs-компонентов (50) объекта может быть дополнительно сформирована маска

(35) поверхности объекта могут быть обнаружены blobs-компоненты (50) объекта и на обрезанном изображении (5) объекта могут быть обнаружены яркостные переходы (55) объекта, при этом обнаруженные blobs-компоненты (50) объекта и яркостные переходы (55) объекта составляют особенности (45) объекта. Яркостные переходы (55) объекта определяют уникальные свойства объекта. В варианте осуществления, в котором объектом является лицо, blobs-компоненты (50) содержат, но без ограничения упомянутым, брови, глаза, нос и рот. Для удобства и ускорения дальнейшей обработки blobs-компонентов (50) объекта, на данном этапе S130.1 из blobs-компонентов (50) объекта может быть дополнительно сформирована маска  blobs-компонентов объекта. В варианте осуществления настоящего изобретения, в котором дополнительно формируют маску blobs-компонентов объекта, получаемая в результате маска blobs-компонентов объекта может содержать по аналогии с самими blobs-компонентами (50) объекта, но без ограничения упомянутым, брови, глаза, нос и рот. Обнаружение яркостных переходов (55) объекта на данном этапе S130.1 может быть выполнено согласно следующему:

blobs-компонентов объекта. В варианте осуществления настоящего изобретения, в котором дополнительно формируют маску blobs-компонентов объекта, получаемая в результате маска blobs-компонентов объекта может содержать по аналогии с самими blobs-компонентами (50) объекта, но без ограничения упомянутым, брови, глаза, нос и рот. Обнаружение яркостных переходов (55) объекта на данном этапе S130.1 может быть выполнено согласно следующему:

,

,

где

- карта яркостных переходов объекта, представляющая уникальные особенности данного объекта;

- карта яркостных переходов объекта, представляющая уникальные особенности данного объекта;

представляет собой Y канал обрезанного изображения

представляет собой Y канал обрезанного изображения  (5) объекта;

(5) объекта;

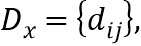

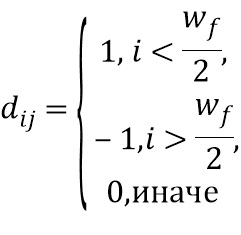

представляет собой усредняющий квадратный фильтр, имеющий размер

представляет собой усредняющий квадратный фильтр, имеющий размер  ,

,  представляет собой ширину лица;

представляет собой ширину лица;

представляют собой разностные операторы

представляют собой разностные операторы

имеющие размер

имеющие размер  .

.

Затем, могут быть выполнены насыщение значений  до

до  и нормализация в интервале [0; 1].

и нормализация в интервале [0; 1].

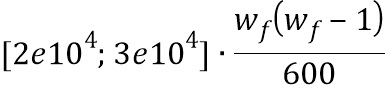

[0032] На этапе S130.2 на основе обнаруженных особенностей (45) объекта может быть сформирована λ-карта (60), представляющая по меньшей мере одну область, которая будет подвергаться наибольшему сглаживанию, по меньшей мере одну область, которая будет подвергаться наименьшему сглаживанию, и нуль или более областей, которые будут подвергаться сглаживанию в диапазоне от наибольшего сглаживания к наименьшему сглаживанию. Формирование λ-карты (60) на данном этапе S130.2 может быть выполнено следующим образом:

.

.

Пример обнаруженных особенностей (45) объекта, т.е. blobs-компонентов (50) объекта и яркостных переходов (55) объекта, а также формируемой на их основе λ-карты (60) для обрезанного изображения (5) объекта проиллюстрирован на фигуре 13.

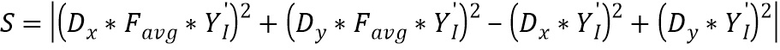

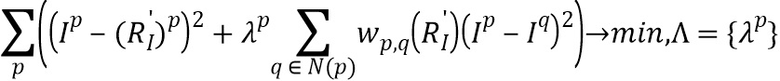

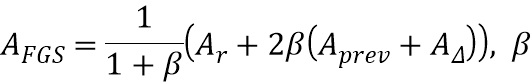

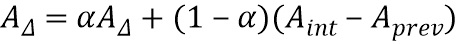

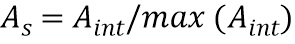

[0033] На этапе S130.3 быстрое глобальное сглаживание (FGS), учитывающее особенности (45) объекта, может быть проведено посредством применения FGS-фильтра (65) с λ-картой (60) к обрезанному изображению (5) объекта для извлечения фактической освещенности (70) объекта на изображении. Фактическая освещенность (70) объекта может быть представлена в форме отдельного изображения I фактической освещенности объекта. На данном этапе S130.3 быстрое глобальное сглаживание (FGS), учитывающее особенности (45) объекта, может быть проведено посредством решения проблемы оптимизации с использованием подхода с, но без ограничения упомянутым, FGS-фильтром (или аналогичным) для извлечения фактической I (70) освещенность объекта:

.

.

В качестве примера, реализация данного этапа описана в документе [1] Min et al. "Fast global image smoothing based on weighted least squares." IEEE Transactions on Image Processing 23.12 (2014): 5638-5653. Пример результатов проведения быстрого глобального сглаживания (FGS), учитывающего особенности (45) объекта, проиллюстрирован на фигуре 14.

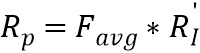

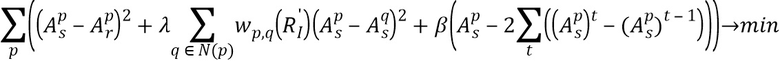

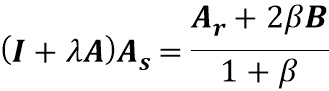

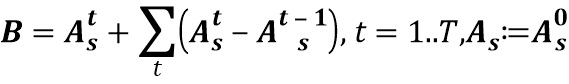

[0034] На этапе S135 фактическая освещенность I (70) объекта на изображении (5) может быть заменена адаптированной освещенностью объекта, определенной моделью (40) адаптированной освещенности объекта. Подробности данного этапа S135 проиллюстрированы на фигуре 5. Целью данного этапа является корректировка освещенности объекта на изображении и врисовка переосвещенного объекта в текущее изображение (кадр) в последовательности изображений (видео) с применением сглаженной маски поверхности объекта и учетом вероятности некорректного обнаружения ключевых точек объекта. Данный этап позволяет провести стабилизированную врисовку переосвещенного изображения объекта в исходный видеокадр на основе сформированной маски (35) поверхности объекта, фильтра стабилизированного FGS и блока проверки на ошибки. Этот этап S135 обеспечивает возможность беспрерывной видеообработки в режиме реального времен без заметного мерцания и артефактов, связанных с критическими углами поворота лицевой поверхности объекта на изображении. Кроме того, этот этап S135 обеспечивает улучшенную производительность раскрытого способа корректировки освещенности вследствие легковесного алгоритма врисовки, который позволяет использовать раскрытый в заявке способ даже на мобильном устройстве с ограниченными вычислительными мощностями для обработки видео в режиме реального времени.

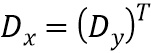

[0035] На этапе S135.1 cформированная маска  (35) поверхности объекта, определяемая областью

(35) поверхности объекта, определяемая областью  поверхности объекта, может быть принята/введена. На этапе S135.2 стабилизированное FGS может быть проведено посредством применения фильтра стабилизированного FGS к маске

поверхности объекта, может быть принята/введена. На этапе S135.2 стабилизированное FGS может быть проведено посредством применения фильтра стабилизированного FGS к маске  (35) поверхности объекта путем решения следующей проблемы оптимизации (обратной задачи) с регуляризатором:

(35) поверхности объекта путем решения следующей проблемы оптимизации (обратной задачи) с регуляризатором:

для нахождения  , решение которой может быть найдено в замкнутой матричной форме (см. вышеуказанный документ [1]):

, решение которой может быть найдено в замкнутой матричной форме (см. вышеуказанный документ [1]):

(1), где

(1), где

представляет собой матрицу Лапласа,

представляет собой матрицу Лапласа,  .

.

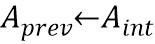

[0036] Более конкретно, решение проблемы оптимизации с регуляризатором может содержать: добавление регуляризатора к маске поверхности объекта -  может быть равно 0,8, но без ограничения данным конкретным значением; применение фильтра стабилизированного FGS посредством решения вышеуказанной проблемы (1) для получения

может быть равно 0,8, но без ограничения данным конкретным значением; применение фильтра стабилизированного FGS посредством решения вышеуказанной проблемы (1) для получения  ; обновление разностной карты -

; обновление разностной карты -  ; обновление маски поверхности объекта

; обновление маски поверхности объекта  ; нормализацию маски

; нормализацию маски  для получения сглаженной маски

для получения сглаженной маски  .

.

[0037] На этапе S135.3 вероятность некорректного обнаружения ключевых точек объекта может быть оценена с помощью признаков объекта, представленного в текущем обрабатываемом изображении в последовательности изображений, причем оценка содержит проверку этих выделенных признаков объекта машиной опорных векторов, предварительно обученной на выборке, состоящей из признаков произвольных изображений и соответствующих этим признакам вероятностей некорректного обнаружения ключевых точек. Этап обучения машины опорных векторов (SVM) на выборке, состоящей из признаков произвольных изображений и соответствующих этим признакам вероятностей некорректного обнаружения ключевых точек, может быть проведен заблаговременно. Обучение SVM может быть проведено любым известным из уровня техники способом. Вероятность  некорректного обнаружения ключевых точек объекта может быть оценена посредством применения к некоторым особенностям X текущего изображения предварительно обученной SVM.

некорректного обнаружения ключевых точек объекта может быть оценена посредством применения к некоторым особенностям X текущего изображения предварительно обученной SVM.

[0038] На этапе S135.4 адаптированная освещенность объекта, определенная моделью адаптированной освещенности объекта, может врисовываться в текущее изображение в последовательности изображений с применением сглаженной маски поверхности объекта и учетом вероятности  некорректного обнаружения ключевых точек объекта. В одном варианте осуществления данная врисовка может быть осуществлена согласно следующему:

некорректного обнаружения ключевых точек объекта. В одном варианте осуществления данная врисовка может быть осуществлена согласно следующему:

,

,

где

представляет собой результат врисовки изображения адаптированная освещенность объекта в исходное изображение

представляет собой результат врисовки изображения адаптированная освещенность объекта в исходное изображение  ,

,

представляет собой область поверхности объекта,

представляет собой область поверхности объекта,

представляет собой карту яркостных переходов объекта, представляющую уникальные особенности данного объекта;

представляет собой карту яркостных переходов объекта, представляющую уникальные особенности данного объекта;

представляет собой модель (40) адаптированной освещенности объекта со сглаженными blobs-компонентами объекта;

представляет собой модель (40) адаптированной освещенности объекта со сглаженными blobs-компонентами объекта;

I представляет собой изображение фактической освещенности объекта.

Данный этап врисовки выполняется для удаления резких теней объекта с сохранением уникальных особенностей объекта. Резкие тени удаляются за счет применения Ламбертовской модели с заменой  фактической освещенности объекта адаптированной освещенностью, при этом уникальные особенности объекта сохраняются за счет применения на данном этапе карты яркостных переходов объекта, которые должны быть сохранены. На этапе S140 изображение в последовательности изображений, в котором фактическая освещенность объекта заменена адаптированной освещенностью объекта, может быть выведено.

фактической освещенности объекта адаптированной освещенностью, при этом уникальные особенности объекта сохраняются за счет применения на данном этапе карты яркостных переходов объекта, которые должны быть сохранены. На этапе S140 изображение в последовательности изображений, в котором фактическая освещенность объекта заменена адаптированной освещенностью объекта, может быть выведено.

[0039] На фигуре 7 проиллюстрирована блок-схема вычислительного устройства/мобильного устройства (75) пользователя. Устройство (75), на котором может быть реализован раскрытый выше способ, может содержать, но без ограничения упомянутым, процессор (75.1), камеру (75.2) и память (75.3), хранящую исполняемые процессором инструкции, которые, при исполнении процессором, дают команду процессору на выполнение любого этапа(этапов) раскрытого способа корректировки освещенности объекта. Устройство (75) может содержать другие не показанные на фигуре 15 компоненты и представлять собой, например, смартфон, планшет, очки виртуальной реальности, очки дополненной реальности, ПК, ноутбук, умные часы и т.д. В альтернативном варианте осуществления вычислительного устройства/мобильного устройства (75) пользователя, упомянутое устройство может содержать отдельные аппаратные блоки. В этом варианте осуществления, каждый аппаратный блок может отвечать за выполнение соответствующего этапа или подэтапа способа и именоваться соответствующим образом, например, аппаратный блок устройства, ответственный за введение изображения (см. этап S100) может именоваться блок ввода изображения и т.д. Однако, заявленное изобретение не следует ограничивать только такой структурой блоков, поскольку специалисту будут понятны другие возможные структуры блоков в устройстве, при которых, в качестве примера, один аппаратный блок может отвечать за выполнение нескольких этапов или подэтапов раскрытого способа, или выполнение нескольких этапов или подэтапов раскрытого способа может быть разделено между двумя или более блоками. Кроме того, способ, раскрытый в данной заявке, может быть реализован посредством процессора, интегральной схемы специального назначения (ASIC), программируемой пользователем вентильной матрицы (FPGA), или - в некоторых вариантах осуществления - как система на кристалле (SoC). Кроме того, способ, раскрытый в данной заявке, может быть реализован посредством считываемого компьютером носителя, на котором хранятся исполняемые компьютером инструкции, которые, при исполнении процессором компьютера, побуждают компьютер к выполнению раскрытого способа.

[0040] Используемые в данной заявке ссылочные позиции не следует интерпретировать как однозначно определяющие последовательность этапов, поскольку, после ознакомления с вышеуказанным раскрытием, специалисту станут понятны другие модифицированные последовательности вышеописанных этапов. Ссылочные позиции использовались в этом описании и используются в нижеследующей формуле лишь в качестве сквозного указателя на соответствующий элемент заявки, который облегчает ее восприятие и гарантирует соблюдение единства терминологии.

[0041] Хотя данное изобретение было описано с определенной степенью детализации, следует понимать, что настоящее раскрытие было сделано только в качестве иллюстрации и что к многочисленным изменениям в деталях конструкций, компоновке частей устройства или этапов и содержания способов можно прибегать, не выходя за рамки объема изобретения, который определяется нижеследующей формулой изобретения.

Промышленная применимость

[0042] Настоящее изобретение может применяться в промышленности для корректировки освещенности объекта на изображении в видеопоследовательности. Могут быть созданы различные устройства, средства, блоки, микросхемы, которые эту корректировку реализуют. Кроме того, упомянутая корректировка может быть обеспечена как новая функциональная возможность существующих на данный момент приложений/устройств.

Список позиционных обозначений

10 - заданный вектор направления света

15 - трехмерный каркас объекта

20 - базовая текстура объекта

25 - растеризованная модель освещенности объекта

30 - растеризованная модель освещенности объекта с растянутыми краями

35 - маска поверхности объекта

40 - модель адаптированной освещенности объекта

45 - особенности объекта

50 - blobs-компоненты

55 - яркостные переходы объекта

60 - λ-карта объекта

65 - FGS-фильтр

70 - фактическая освещенность объекта

| название | год | авторы | номер документа |

|---|---|---|---|

| СПОСОБ ВИЗУАЛИЗАЦИИ 3D ПОРТРЕТА ЧЕЛОВЕКА С ИЗМЕНЕННЫМ ОСВЕЩЕНИЕМ И ВЫЧИСЛИТЕЛЬНОЕ УСТРОЙСТВО ДЛЯ НЕГО | 2021 |

|

RU2757563C1 |

| СПОСОБ И СИСТЕМА ОПРЕДЕЛЕНИЯ ПОДЛИННОСТИ ЛИЦА НА ИЗОБРАЖЕНИИ | 2024 |

|

RU2840316C1 |

| ИНТЕРАКТИВНАЯ СЕГМЕНТАЦИЯ ИЗОБРАЖЕНИЙ | 2023 |

|

RU2833268C1 |

| УСТРОЙСТВО И СПОСОБ ПРОГНОЗИРУЕМОЙ АВТОФОКУСИРОВКИ ДЛЯ ОБЪЕКТА | 2021 |

|

RU2778355C1 |

| СПОСОБ И СИСТЕМА ДЛЯ ОБНАРУЖЕНИЯ НЕБОЛЬШИХ ИЛИ ТОНКИХ ОБЪЕКТОВ НА ИЗОБРАЖЕНИИ (ВАРИАНТЫ) | 2013 |

|

RU2546600C2 |

| Способ получения информации о форме и размерах трехмерного объекта по его двухмерному изображению | 2022 |

|

RU2816504C1 |

| СПОСОБ АДАПТИВНОГО СГЛАЖИВАНИЯ ДЛЯ ПОДАВЛЕНИЯ РАСТРОВОЙ СТРУКТУРЫ ИЗОБРАЖЕНИЙ | 2008 |

|

RU2411584C2 |

| СПОСОБ ПОВЫШЕНИЯ КАЧЕСТВА ЦИФРОВОГО ФОТОИЗОБРАЖЕНИЯ | 2006 |

|

RU2400815C2 |

| СПОСОБ РАСЧЕТА ДВИЖЕНИЯ С КОРРЕКЦИЕЙ ОККЛЮЗИЙ | 2012 |

|

RU2517727C2 |

| СПОСОБ И УСТРОЙСТВО ДЛЯ ФОТОРЕАЛИСТИЧЕСКОГО ТРЕХМЕРНОГО МОДЕЛИРОВАНИЯ ЛИЦА НА ОСНОВЕ ИЗОБРАЖЕНИЯ | 2004 |

|

RU2358319C2 |

Изобретение относится к вычислительной технике. Технический результат – повышение эффективности и качества обработки изображений в последовательности изображений в реальном масштабе времени. Способ корректировки освещенности объекта на изображении в последовательности изображений содержит ввод изображения, получение заданного вектора направления света, обнаружение ключевых точек объекта и особенностей изображения, обрезание изображения по ключевым точкам объекта для получения изображения объекта, преобразование изображения объекта в формат с яркостной и цветоразностными компонентами (YUV), создание модели освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, формирование модели адаптированной освещенности объекта, извлечение фактической освещенности объекта на изображении, замену фактической освещенности объекта на изображении адаптированной освещенностью объекта и вывод изображения в последовательности изображений. 2 н. и 6 з.п. ф-лы, 14 ил.

1. Способ корректировки освещенности объекта на изображении в последовательности изображений, содержащий этапы, на которых:

вводят (S100) изображение и получают заданный вектор направления света;

обнаруживают (S105) ключевые точки объекта и особенности изображения;

обрезают изображение (S110) по ключевым точкам объекта для получения изображения объекта;

преобразуют (S115) изображение объекта в формат с яркостной и цветоразностными компонентами (YUV);

создают (S120) модель освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, в которой освещенность определена заданным вектором направления света;

формируют (S125) модель адаптированной освещенности объекта;

извлекают (S130) фактическую освещенность объекта на изображении;

заменяют (S135) фактическую освещенность объекта на изображении адаптированной освещенностью объекта, определенной моделью адаптированной освещенности объекта; и

выводят (S140) изображение в последовательности изображений, в котором фактическая освещенность объекта заменена адаптированной освещенностью объекта.

2. Способ по п. 1, в котором этап формирования (S125) модели адаптированной освещенности объекта содержит этапы, на которых:

растягивают (S125.1) края растеризованной модели освещенности объекта до краев обрезанного изображения объекта;

вычисляют (S125.2) Y-, U- и V-гистограммы растеризованной модели освещенности объекта с растянутыми краями;

вычисляют (S125.3) Y-, U- и V-гистограммы обрезанного изображения объекта;

корректируют (S125.4) предопределенную маску поверхности объекта под обрезанное изображение объекта путем удаления из маски поверхности объекта светлых и темных участков обрезанного изображения объекта, которые определяются соответствующими пороговыми значениями яркости;

удаляют (S125.5) из полученных U- и V-гистограмм растеризованной модели освещенности объекта с растянутыми краями и U- и V-гистограмм обрезанного изображения объекта значения, которые попали в удалённые светлые и темные участки обрезанного изображения объекта, и осуществляют эквализацию упомянутых U- и V-гистограмм;

корректируют (S125.6) яркость, контраст и цвет растеризованной модели освещенности объекта с растянутыми краями посредством оценки Y-гистограмм обрезанного изображения объекта и растеризованной модели освещенности объекта с растянутыми краями и применения подвергнутых эквализации U- и V-гистограмм для формирования модели адаптированной освещенности объекта и

сглаживают (S125.7) на сформированной модели адаптированной освещенности объекта участки, заданные предопределенными blobs-компонентами объекта.

3. Способ по п. 2, в котором маску поверхности объекта формируют на основе ключевых точек объекта посредством создания маски лицевой поверхности объекта, оценки цветового коэффициента по обрезанному изображению объекта и нахождения области поверхности объекта.

4. Способ по любому из пп. 1-3, в котором заданным вектором направления света является вектор направления света по умолчанию или предопределенный пользователем вектор направления света;

объектом является лицо;

поверхностью объекта является кожа лица;

blobs-компоненты содержат брови, глаза, нос и рот.

5. Способ по п. 1, в котором этап извлечения (S130) фактической освещенности объекта на изображении содержит этапы, на которых:

обнаруживают (S130.1) по ключевым точкам объекта и маске поверхности объекта blobs-компоненты объекта и обнаруживают яркостные переходы объекта на обрезанном изображении объекта, при этом обнаруженные blobs-компоненты объекта и яркостные переходы объекта составляют особенности объекта;

формируют (S130.2) на основе обнаруженных особенностей объекта λ-карту, представляющую по меньшей мере одну область, которая будет подвергаться наибольшему сглаживанию, по меньшей мере одну область, которая будет подвергаться наименьшему сглаживанию, и нуль или более областей, которые будут подвергаться сглаживанию в диапазоне от наибольшего сглаживания к наименьшему сглаживанию; и

проводят (S130.3) учитывающее особенности объекта быстрое глобальное сглаживание (FGS), применяя FGS-фильтр с λ-картой к обрезанному изображению объекта, для извлечения фактической освещенности объекта на изображении.

6. Способ по п. 1 или 3, в котором этап замены (S135) фактической освещенности объекта на изображении адаптированной освещенностью объекта содержит этапы, на которых:

принимают (S135.1) сформированную маску поверхности объекта;

проводят (S135.2) стабилизированное FGS, применяя фильтр стабилизированного FGS к сформированной маске поверхности объекта путем решения обратной задачи с регуляризатором, причем решение обратной задачи с регуляризатором содержит следующие подэтапы, на которых:

вычисляют значения регуляризатора с использованием сохранённых данных о сглаженной маске поверхности объекта, полученной для предыдущего изображения в последовательности изображений, и разностной карты;

применяют фильтр стабилизированного FGS к сформированной маске поверхности объекта с использованием регуляризатора, значения которого равны вычисленным значениям регуляризатора;

обновляют разностную карту путём попиксельного применения рекурсивного фильтра;

сохраняют сглаженную маску поверхности объекта для текущего изображения и

нормализуют значения сглаженной маски поверхности объекта для текущего изображения в диапазоне 0..1;

оценивают (S135.3) вероятности некорректного обнаружения ключевых точек объекта с помощью признаков объекта, представленного в текущем изображении в последовательности изображений, причем оценка содержит проверку этих выделенных признаков объекта машиной опорных векторов, предварительно обученной на выборке, состоящей из признаков произвольных изображений и соответствующих этим признакам вероятностей некорректного обнаружения ключевых точек; и

врисовывают (S135.4) адаптированную освещенность объекта, определенную моделью адаптированной освещенности объекта, в текущее изображение в последовательности изображений с применением сглаженной маски поверхности объекта и учетом вероятности некорректного обнаружения ключевых точек объекта.

7. Способ по п. 1, в котором этап создания (S120) модели освещенности объекта с использованием ключевых точек объекта для получения растеризованной модели освещенности объекта, в которой освещенность определена заданным вектором направления света, содержит этапы, на которых:

подгоняют (S120.1) общий трехмерный каркас объекта под обнаруженные ключевые точки объекта, представленного на текущем изображении в последовательности изображений; и

осуществляют рендеринг (S120.2) трехмерной модели объекта c использованием трехмерного каркаса объекта, подогнанного под ключевые точки объекта, заданного вектора направления света и общей текстуры поверхности объекта для получения растеризованной модели освещенности объекта.

8. Вычислительное устройство (75) пользователя для корректировки освещенности объекта на изображении в последовательности изображений, содержащее процессор (75.1), камеру (75.2) и память (75.3), хранящую исполняемые процессором инструкции, которые, при исполнении процессором, дают команду процессору на выполнение способа корректировки освещенности объекта на изображении в последовательности изображений по любому из пп. 1-7.

| CN 101425179 A, 06.05.2009 | |||

| US 9858654 B2, 02.01.2018 | |||

| US 7433807 B2, 07.10.2008 | |||

| US 8582896 B2, 12.11.2013 | |||

| US 7324688 B2, 29.01.2008 | |||

| Способ и приспособление для нагревания хлебопекарных камер | 1923 |

|

SU2003A1 |

| Колосоуборка | 1923 |

|

SU2009A1 |

| US 7227977 B1, 05.06.2007 | |||

| ОБРАБОТКА ИЗОБРАЖЕНИЙ С ПОМОЩЬЮ ЛИНЕЙНЫХ ПАРАМЕТРОВ СВЕТОУСТАНОВКИ И ДРУГИХ УСОВЕРШЕНСТВОВАНИЙ ОБРАБОТКИ ИЗОБРАЖЕНИЙ | 2005 |

|

RU2402811C2 |

Авторы

Даты

2019-08-15—Публикация

2018-08-01—Подача