ОБЛАСТЬ ТЕХНИКИ

Изобретение относится к средствам автоматической классификации транспортных средств,

УРОВЕНЬ ТЕХНИКИ

Из описаний к опубликованным заявкам и патентам US 5446291 A, US 5750069, US 3748443, WO 2005017853 A1, US 2002140924 A1, US 6195019 B1, US 5107250 A, WO 03052457 A2, WO 03094128 A2, FR 2903519 A1, US 2010231720 Al, EP 0807914 A1, US 5809161 A, DE 4300650 A1, EP 2026246 A1, US 6185314 B1, WO 2008088409 A2, WO 2011000677 A1, WO 9516252 A1 и WO 03096300 A1, известны различные по своим функциональным возможностям и техническим особенностям системы, реализующие отдельные подходы к автоматической классификации транспортных средств, а также компоненты этих систем.

При этом вышеупомянутые системы, известные из публикаций US 5446291 A, US 5750069 A, US 3748443 A, WO 2005017853 A1, US 2002140924 A1, US 6195019 B1, US 5107250 A, WO 03052457 A2, WO 03094128 A2, FR 2903519 A1, основаны па использовании технически сложного оборудования, - оптопар и дальномеров, датчиков давления шин, электрических датчиков, оптопар и растрового сканера профиля, лазерного сканера, сейсмодатчиков, датчиков температуры, - и притом, с помощью этих систем, как правило, невозможно определить число осей и высоту транспортных средств.

Упомянутые системы US 2010231720 A1, EP 0807914 A1, US 5809161 A, DE 4300650 A1, EP 2026246 A1, US 6185314 B1, WO 2008088409 A2, WO 2011000677 A1, WO 9516252 A1, WO 03096300 A1 не позволяют подсчитать количество осей транспортного средства, либо не определяют его высоту, либо неприменимы для автоматической классификации по иным причинам.

Наиболее близким к изобретению аналогом, с точки зрения применяемых подходов, является классификатор, известный из международной публикации WO 03096300 А1. Он опирается, в основном, на соотношения радиусов шин и дисков. Однако, как было экспериментально установлено, для типичных транспортных средств, используемых на территории Российской Федерации, отсутствует достоверная корреляция между классами транспортных средств и радиусами шин и дисков, что не позволяет применять этот классификатор для автоматической классификации транспортных средств.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Задача настоящего изобретения состоит в том, чтобы автоматически классифицировать транспортные средства с учетом критериев, принятых на территории Российской Федерации, с использованием типовых видеокамер, без необходимости применения сложного и нестандартного сенсорного оборудования.

Техническим результатом является высокоточная, полностью автономная (без участия человека) многокритериальная классификация транспортных средств (по высоте и количеству осей), а точнее - способ, обеспечивающий получение указанных результатов при его осуществлении.

В соответствии с настоящим изобретением в предлагаемом способе автоматической классификации транспортных средств (далее - способ, если из контекста не следует иное) используют цифровые оптико-электронные преобразователи на основе видеокамеры и средства цифровой обработки данных, непрерывно получают видеопоток с камеры, установленной сбоку от зоны наблюдения, компенсируют радиальную дисторсию кадров видеопотока, получая множество значений элементов видеопотока Pxyt где x - горизонтальная координата, y - вертикальная координата, t - временная координата; вычисляют экспоненциальное скользящее среднее (по времени) элементов видеопотока Bxyt; вычисляют коэффициент корреляции по координатам x, y D1(t) между Pxyt и Bxyt и определяют такие моменты времени tin, когда D1(t) становится больше предварительно заданного порогового значения L1, после чего определяют такие моменты времени tout, когда D1(t) становится меньше L1; вычисляют интегрированные и/или усредненные по времени Pxyt за период времени Т4 (период нахождения транспортного средства в поле зрения камеры) между моментами tin и tout для множества постоянных у, получая множество PT4(y); вычисляют разность D2(y, t) между Pxyt(y, t) и PT4(y) и находят такое ytop(t) (соответствующее профилю транспортного средства), при котором значения D2(y, t) превышают предварительно заданное пороговое значение L2; распознают эллиптические контуры на отдельных кадрах (подмножества Pxyt вида Pt(x, y)) видеопотока, соответствующих периоду Т4, определяют координаты центров эллипсов (Xc(t), Yc(t)), отбрасывают значения, вертикальная координата Yc(t) которых отличается на величину больше порогового значения L3 от усредненных значений, получая множество фильтрованных значений координат центров эллипсов (Xcf(t), Ycf(t)); применяют преобразование Хафа к Xcf(t), и по количеству максимумов в пространстве Хафа определяют количество осей транспортного средства; по значениям Ycf(t) и максимальному значению ytop за период Т4 определяют высоту транспортного средства.

Таким образом, предлагаемый способ позволяет без участия человека и использования сложной техники определить все критерии, необходимые для отнесения транспортного средства к тому или иному классу, предусмотренного классификацией, принятой на территории Российской Федерации.

В одной из предпочтительных форм воплощения положение образов колес транспортных средств на изображении определяют с использованием метода Виолы-Джонса.

В другой предпочтительной форме воплощения дополнительную фильтрацию значений вертикальной координаты с учетом допустимого размера колес транспортных средств.

В частной форме воплощения упомянутые камеры установлены на разном уровне по вертикали.

В еще одной частной форме воплощения используют, по меньшей мере, две камеры, поля зрения которых, по меньшей мере, частично перекрываются.

В предпочтительной форме воплощения используют, по меньшей мере, две камеры, имеющие различную чувствительность сенсоров.

В одной из предпочтительных форм воплощения используют, по меньшей мере, две камеры, при этом ориентируют их в продольной плоскости таким образом, чтобы оптические оси были направлены под углом навстречу друг другу, а боковые границы полей зрения камер пересекались вблизи границ зоны детекции, не выходя за ее пределы. Пересечение полей зрения камер формирует комбинированную зону детекции с такими параметрами, что видеопоток, получаемый отдельными камерами от объектов, находящихся ближе и дальше от зоны детекции, может быть отфильтрован в зависимости от того присутствует ли объект в комбинированной зоне детекции, или нет.

В альтернативной предпочтительной форме воплощения используют, по меньшей мере, две камеры, при этом ориентируют одну из них под углом к горизонтали таким образом, чтобы граница поля зрения этой камеры располагалась вблизи границы зоны детекции, не выходя за ее пределы.

В одной из частных форм воплощения используют осветительный прибор для увеличения освещенности зоны детекции при недостатке освещенности.

Предлагаемый способ позволяет автоматически определять класс транспортных средств (ТС), проезжающих контрольный участок дорожной полосы, основываясь на измерении высоты и количества колесных осей ТС, при этом используются исключительно данные, полученные с видеокамер.

ОСУЩЕСТВЛЕНИЕ ИЗОБРЕТЕНИЯ

Как следует из вышеизложенного, предлагаемый способ состоит из семи основных этапов: (1) исправление радиальной дисторсии; (2) детекции въездов и/или выездов; (3) определение высоты транспортного средства; (4) детекции осей транспортного средства; (5) предварительный подсчет количества осей транспортного средства; (6) фильтрация результатов предварительного подсчета (статистическая обработка) и (7) окончательный подсчет количества осей транспортного средства. Вспомогательными этапами способа являются: сбор информации, модулирование-демодулирование сигналов, хранение данных, передача данных между узлами системы. Основные этапы будут более подробно описаны ниже, на примере частных форм воплощения, а особенности вспомогательных - хорошо известны средним специалистам в данной области техники и в пояснениях не нуждаются.

ИСПРАВЛЕНИЕ РАДИАЛЬНОЙ ДИСТОРСИИ

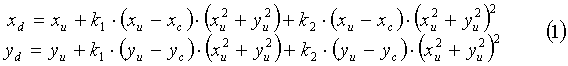

Модель камеры с радиальным искажением будем задавать уравнениями, описывающими искажения двумерного изображения, получаемого ею, относительно двумерного изображения, которое было бы получено в тех же условиях идеальной камерой-обскурой. Модель радиальной дисторсии (см., например, Zhang Z. A Flexible New Technique for Camera Calibration // IEEE Trans. Pattern Anal. Mach. Intell. Washington, DC, USA: IEEE Computer Society, 2000. Vol.22, №11. P. 1330-1334) описывается следующей зависимостью координат точки на реальном снимке с дисторсией (xd, yd) от координат на

идеальном снимке (xu,.yu):

В формуле (1) (xc, yv) - координаты центра радиального искажения, a ki - параметры дисторсии.

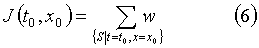

При известных параметрах дисторсии для каждого пикселя идеального изображения известны его координаты на регистрируемом (искаженном) изображении. Последовательно копируя соответствующие пикселы, получим восстановленное идеальное изображение, за исключением областей, в которых соответствующие координаты выходят за пределы искаженного изображения (Фиг.1).

ДЕТЕКЦИЯ ВЪЕЗДОВ/ВЫЕЗДОВ

Задача детекции въездов и выездов транспортных средств заключается в определении наличия ТС в поле зрения камеры на исследуемой (ближайшей, далее называем ее первой) полосе дороги.

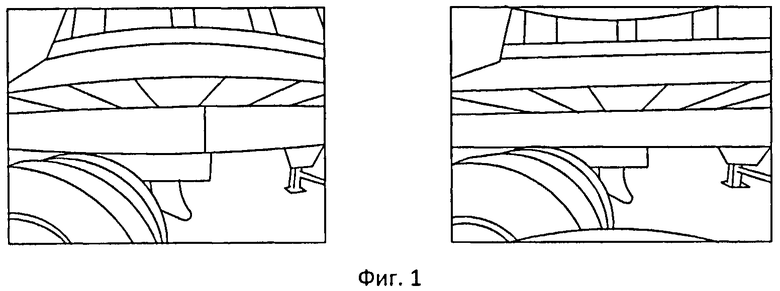

Используемый в предлагаемом способе подход к детекции въезда-выезда базируется на геометрической модели сцены, представленной на Фиг.2 (буквами обозначены компоненты сцены: a - контрольная прямая, по пересечению которой определяем события; b - область дальних полос дороги; c - контрольная зона обнаружения прицепа, d - контрольная зона определения въезда-выезда, e - область первой полосы дороги). Событием (въездом или выездом) считается пересечение ТС воображаемой прямой, проходящей по центру кадра. Кадр разбивается на 2 части - область первой полосы (е) и область дальних полос (b). Для детекции события используегся только область первой полосы, поскольку в области дальних полос могут находиться ТС, проезжающие по любой другой (не интересующей нас) полосе.

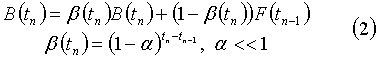

Применяется подход определения наличия ТС с использованием изображения фона, которое вычисляется путем применения к видеопотоку рекуррентного экспоненциального фильтра:

В формуле (2) B(tn) - значение пиксела изображения фона в момент времени tn, F(tn) - значение соответствующего пиксела изображения с камеры в момент времени tn; α оценивается, исходя из длины максимального допустимого временного промежутка, а также из представлении о временном масштабе изменений истинного изображения фона.

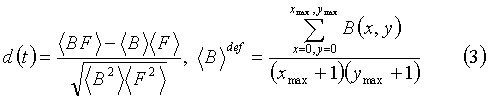

Полученное таким образом изображение фона B(t, x, y) сравнивается с изображением с камеры F(t, x, y) по коэффициенту корреляции Пирсона;

В результате с помощью формулы (3) получаем временной ряд d(t), который далее анализируем на предмет наличия особенностей (т.е. интересующих нас событий), предварительно выполнив сглаживание для уменьшения уровня шума. Наличие объекта в данном случае соответствует низкому значению d(t).

При определении въезда-выезда по значению d(t) используется пороговый детектор с гистерезисом: въезд регистрируется при d(t)<h2, а выезд - при d(t)>h1, причем h2>h1.

Чтобы избежать нежелательного разрыва ТС на тягач и прицеп алгоритм определения въезда-выезда опирается на дополнительную контрольную зону (см. Фиг.2). В предположении о движении слева направо наличие объекта в этой контрольной зоне означает, что через некоторое время объект появится и в основной контрольной зоне (см. Фиг.2). Комбинируя данные с двух контрольных зон, получаем более устойчивые к прицепам критерии въезда и выезда: въезд регистрируется при появлении объекта в основной контрольной зоне, а выезд - при отсутствии объекта в обеих контрольных зонах.

ОПРЕДЕЛЕНИЕ ВЫСОТЫ

Высота ТС определяется как расстояние от плоскости дороги до наивысшей точки ТС, принадлежащей корпусу либо жестко закрепленной на корпусе детали.

Задача определения высоты распадается на 2 части: определение вертикальных границ ТС на изображении и вычисление фактической высоты ТС на основании вертикальных границ.

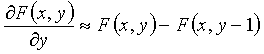

Способ измерения высоты основан на сравнении текущего изображения с камеры с изображением, усредненным за время проезда ТС с предварительной фильтрацией градиентным фильтром. Перед обработкой из исходного видеопотока выделяется прямоугольный фрагмент, имеющий ширину порядка 1/5 полной ширины кадра. Поскольку каждое ТС обязательно проезжает через весь кадр, выделение фрагмента не влияет на качество результатов, но сокращает необходимый объем вычислений пропорционально отношению площади фрагмента к площади полного кадра. Градиентный фильтр работает по следующей схеме: на основе исходного изображения F(x, у) вычисляется аппроксимация вертикального градиента

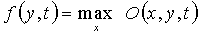

В качестве поля индикатора наличия объекта O(x, y, t) используется модуль разности усредненного за время проезда (преобразованного градиентным фильтром) изображения и (преобразованного) изображения в текущий момент времени. При этом O(x, y, t) обновляется на каждом кадре, что позволяет в дальнейшем интегрировать пространственный сигнал f(y,t) во времени. Сам пространственный сигнал вычисляется как построчный максимум:

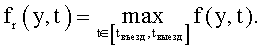

Вертикальные границы ТС на изображении вычисляются путем применения ранее описанного в данном разделе порогового детектора к fr(y).

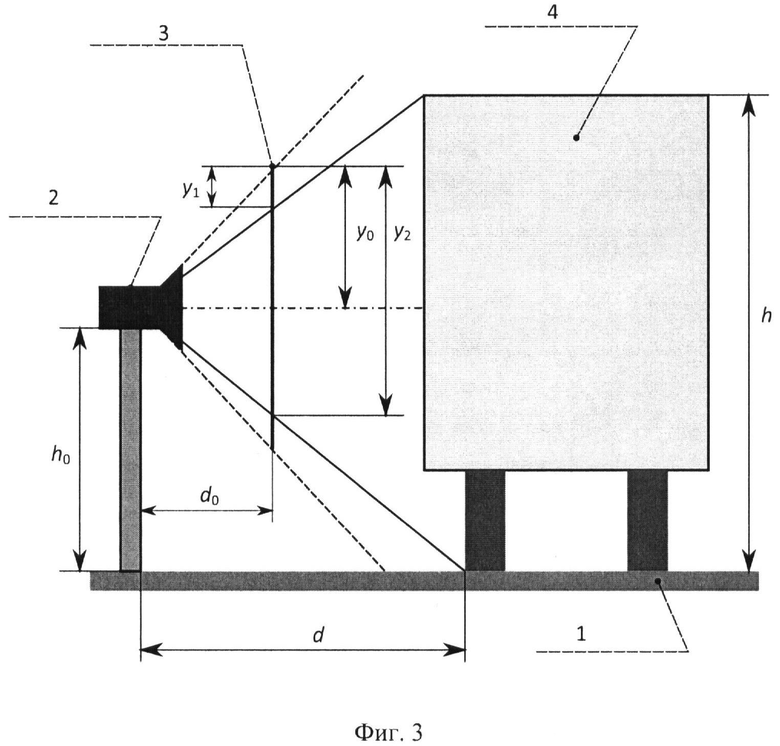

Для получения высоты ТС в метрах по вертикальным границам на изображении используется геометрическая модель сцены, предполагающая горизонтальность оптической оси камеры и перпендикулярность ТС оптической оси. Схематически эта модель изображена на Фиг.3 (где 1 - дорога, 2 - камера, 3 - проективная плоскость, 4 - транспортное средство).

Пусть h0 - высота оптической оси камеры над землей (известный параметр), y1 и y2 - вертикальные границы ТС на изображении, h - искомая высота ТС. Положим также, что регистрируемое камерой изображение эквивалентно центральной проекции сцены на плоскость, перпендикулярную оптической оси камеры и находящуюся на расстоянии d0 от камеры. Получается следующая формула для h:

В формуле (4) y0 - вертикальная координата линии горизонта на изображении.

Необходимо отметить, что определение нижней границы ТС происходит на основе координат колес, найденных на изображении методом Виолы-Джонса (Viola P., Jones М. Robust Real-time Object Detection // International Journal of Computer Vision. 2002).

ДЕТЕКЦИЯ ОСЕЙ ТРАНСПОРТНОГО СРЕДСТВА

Задача определения количества осей ТС непосредственно сводится к задаче поиска (или распознавания) всевозможных колес на каждом кадре видеопоследовательности между въездом и выездом ТС с последующим интегрированием результатов. Для увеличения надежности используются несколько методов поиска колес.

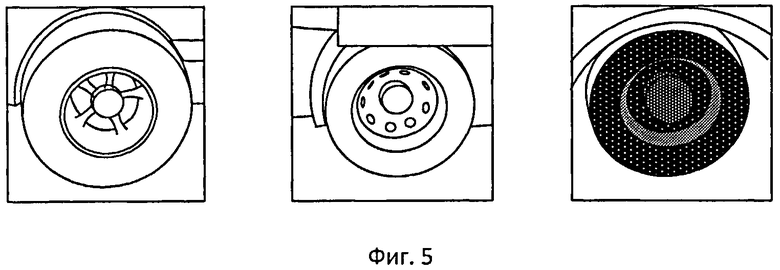

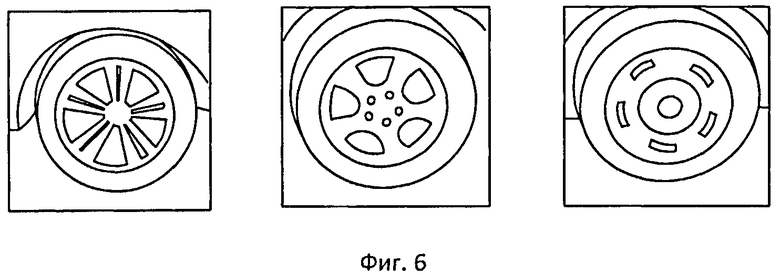

На Фиг.4, Фиг.5 и Фиг.6 проиллюстрировано несколько примеров изображений колес грузовых и легковых ТС. Примеры свидетельствуют о возможности статистически (при автоматическом режиме при наличии достаточно большой обучающей выборке) обучить детекторы колес для грузовых и легковых автомобилей, способных работать в достаточно широком диапазоне. Для построения статистических детекторов используется схема Виолы и Джонса (см. указ. соч.).

Альтернативно, для распознавания осей транспортного средства может быть использован подход, основанный на фильтрации эллиптических краев.

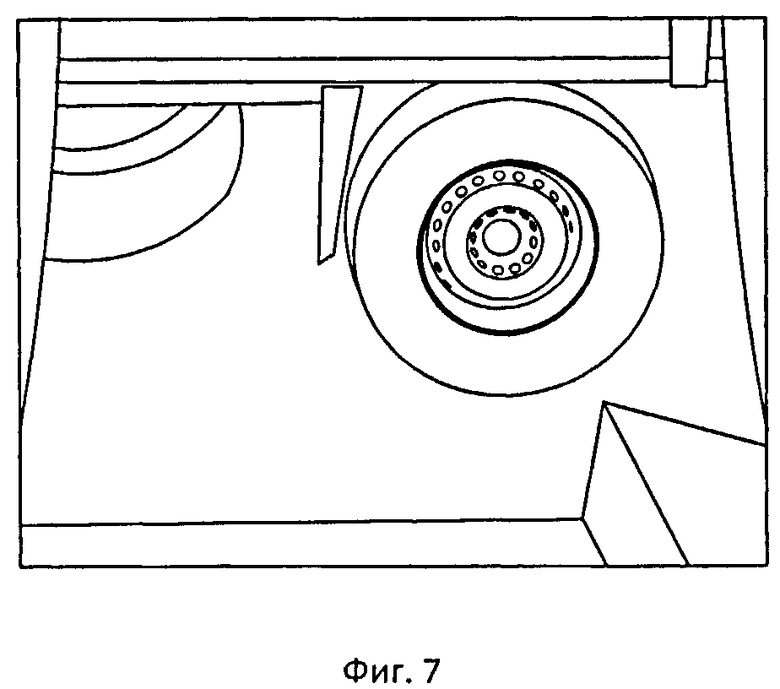

На Фиг.7 представлено исходное изображение зоны интереса поиска осей ТС.

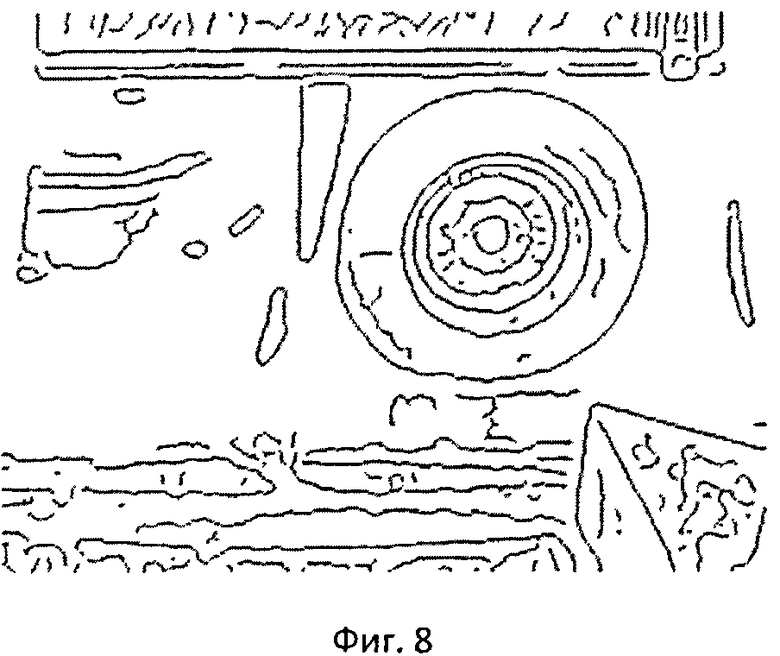

Шаг 1. Найдем края на изображении, согласно подходу_Канни (Фиг.8).

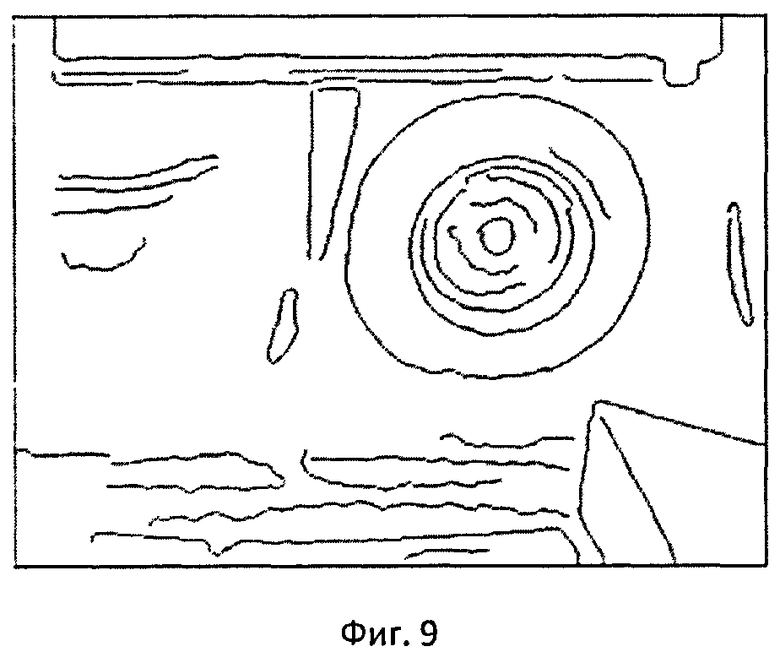

Шаг 2. Удалим все ветвления на карте границ, после чего сегменты границ отфильтруем по размеру (удалим как слишком короткие, так и слишком длинные сегменты) (Фиг.9).

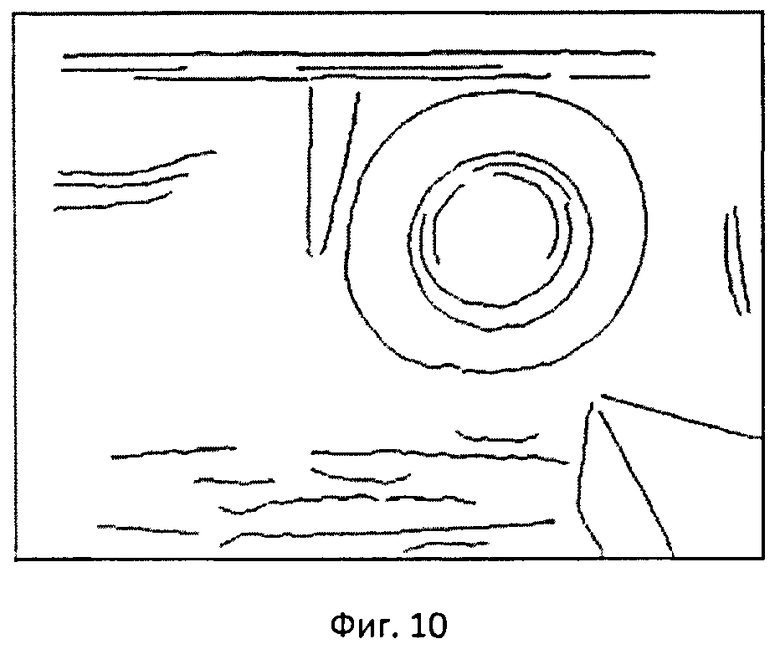

Шаг 3. Удалим точки сегментов краев, в окрестности которых кривизна сегмента выше порога. В качестве оценивателя кривизны будем использовать угол, образованный двухзвенной ломаной, состоящей из текущей точки, и двух точек, с порядковым номером по сегменту, отличающемся на небольшую константу. Повторно проведем фильтрацию по длине сегментов (Фиг.10).

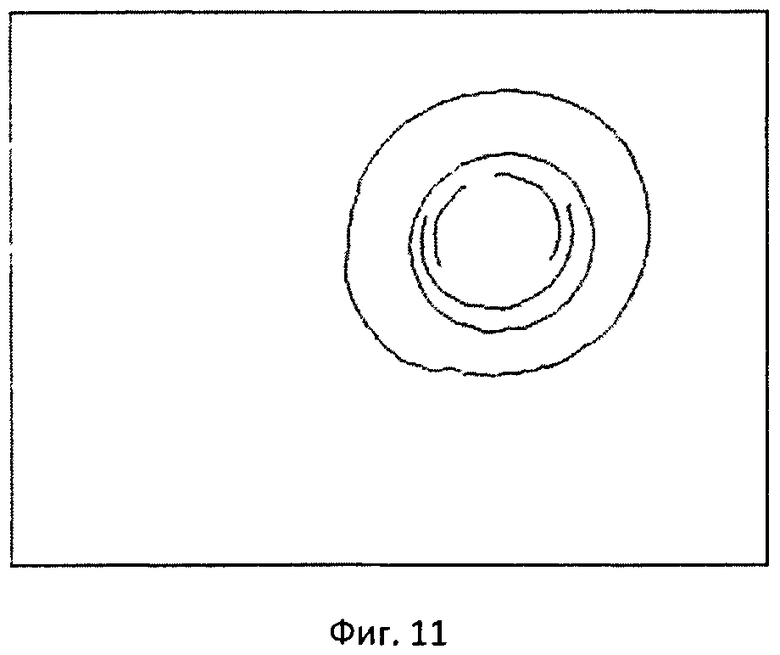

Шаг 4. Удалим заведомо прямолинейные сегменты. Для этого вычислим эллипс инерции каждого сегмента и отбросим сегменты с эксцентриситетом эллипса инерции выше порога (Фиг.11).

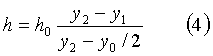

Шаг 5. Аппроксимируем каждый сегмент кривой второго порядка. Для этого будем решать систему вида:

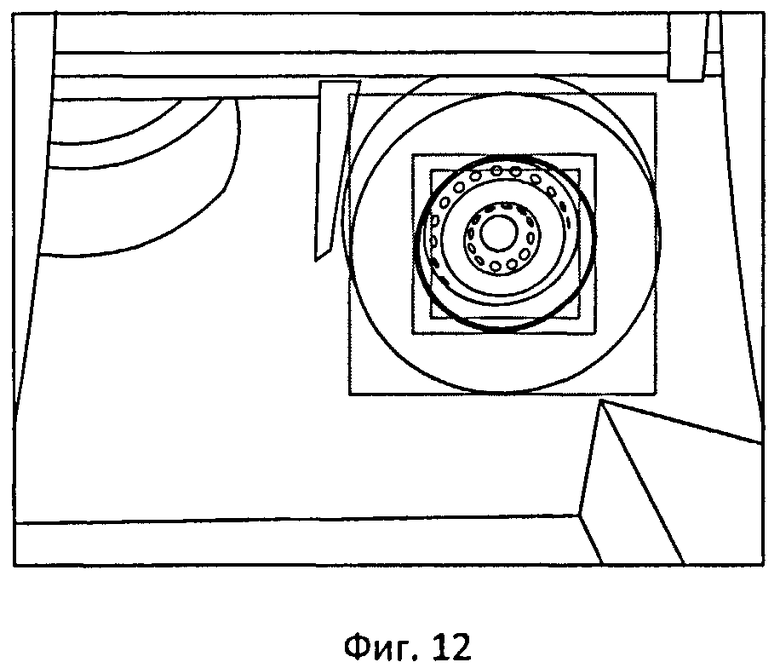

Вычислим инварианты получившейся кривой второго порядка и отбросим сегменты, аппроксимация которых не соответствует эллипсу. Для оставшихся сегментов вычислим центр эллипса и радиус (как среднее арифметическое размеров полуосей). Отбросим сегменты со слишком большим и слишком маленьким радиусом. Результат работы алгоритма изображен на Фиг.12.

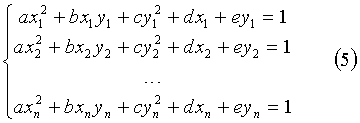

ПРЕДВАРИТЕЛЬНЫЙ ПОДСЧЕТ КОЛИЧЕСТВА ОСЕЙ ТРАНСПОРТНОГО СРЕДСТВА (СТАТИСТИЧЕСКАЯ ОБРАБОТКА)

Детектирование колес позволяет обнаруживать колеса на статическом кадре без учета движения автомобиля. Это означает, что все кадры, на которых запечатлено проезжающее транспортное средство, обрабатываются независимо, и каждый раз колеса ищутся заново. Вместе с тем фактом, что модуль детектирования почти всегда дает несколько срабатываний на одном колесе, получается, что результатом детектирования является таблица колес, количество записей в которой во много раз превышает реальное количество колес (осей) у транспортного средства, и для вычисления последнего необходимо анализировать эту таблицу.

Будем называть срабатыванием набор S=[x, y, t, r, w), где x - абсцисса центра колеса на кадре, y - ордината центра колеса на кадре, f - порядковый номер кадра, на котором произошло срабатывание, r - радиус колеса в пикселах, w - степень уверенности детектора (вес). Множество срабатываний K={Si} назовем набором.

На вход интегратору подается набор K, по которому требуется определить количество колес. Обозначим его через n и будем под Kj понимать подмножество срабатываний из K, соответствующих j-му колесу, где j принимает значения от 1 до n. Через K0 обозначим срабатывания из K, не попавшие ни в одно из Kj, т.е. ложные срабатывания.

Задача свелась к задаче определения количества кластеров, образуемых данными в пространстве срабатываний. Заметим, что срабатывания из множества K0 не образуют единого кластера, т.к. ложные срабатывания могут происходить на любом кадре в любой позиции, и поэтому перед кластеризацией полезно отфильтровать их. Выделяются две фазы алгоритма: фильтрация данных и кластеризация.

ФИЛЬТРАЦИЯ РЕЗУЛЬТАТОВ ПРЕДВАРИТЕЛЬНОГО ПОДСЧЕТА

(СТАТИСТИЧЕСКАЯ ОБРАБОТКА)

Метод фильтрации данных, применяемый в интеграторе, - это медианная фильтрация по двум параметрам: ординате центра колеса и радиусу колеса.

Транспортное средство движется прямолинейно, поэтому положение колеса x=x(t) - линейная функция. Это значит, что если в плоскости (x, t), которую мы далее будем называть xt -диаграммой отметить те точки, которые занимало колесо в течение проезда, получится прямая линия. Однако из-за того, детектор колес имеет некоторую пространственную толерантность, т.е. дает срабатывания и при небольших сдвигах окна поиска, на реальной xt - диаграмме полосы будут получаться размытыми.

ОКОНЧАТЕЛЬНЫЙ ПОДСЧЕТ КОЛИЧЕСТВА ОСЕЙ ТРАНСПОРТНОГО СРЕДСТВА

(СТАТИСТИЧЕСКАЯ ОБРАБОТКА)

Рассмотрим xt - диаграмму с весами, т.е. будем считать, что каждое срабатывание вносит в интенсивность J(t, x) вклад, равный его весу:

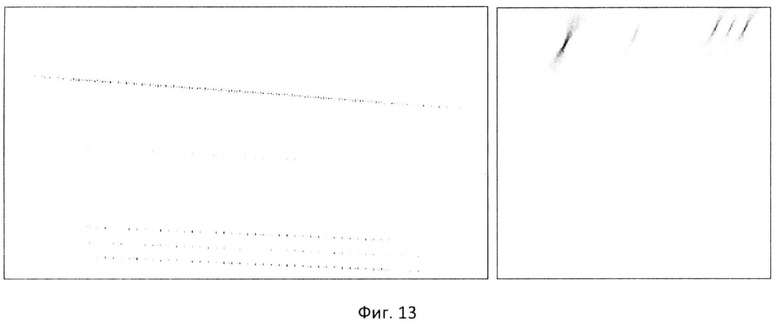

Применим к изображению J преобразование Хафа: Н=H(J). На изображении Н(а, b) (в некоторых целочисленных координатах (a, b) получится набор ярко светящихся областей. На Фиг.13 показаны реальная xt - диаграмма для фуры с пятью колесными осями и ее преобразование Хафа. Для того чтобы подсчитать количество колес, вычисляется количество локальных максимумов на H(J), больших некоторого порога.

КЛЮЧЕВЫЕ КОМПОНЕНТЫ СИСТЕМЫ, ПРИМЕНЯЕМОЙ ДЛЯ РЕАЛИЗАЦИИ ПРЕДЛАГАЕМОГО СПОСОБА

Система для реализации предлагаемого способа включает, по меньшей мере, средства для преобразования электромагнитного излучения в цифровой сигнал (сенсорный блок) и средства цифровой обработки данных (блок цифровой обработки данных).

Сенсорный блок системы представляет собой набор из нескольких специализированных видеокамер с частично перекрывающимися полями зрения. Возможны несколько вариантов геометрии взаимного расположения камер, с использованием от 2 до 4 камер.

Рассмотрим различные варианты 4-камерного сенсорного блока.

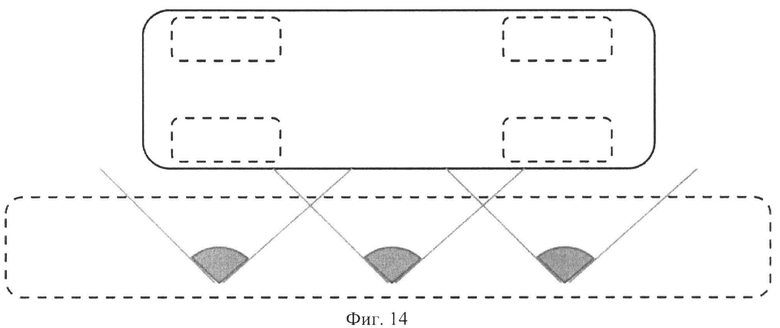

«Т-вариант» конфигурации видеокамер предполагает расположение трех видеокамер на одном уровне (~1 метр) и четвертой камеры на высоте ~2.5 метра (над средней из нижних). Оптические оси камер располагаются перпендикулярно плоскости борта транспортного средства (Фиг.14).

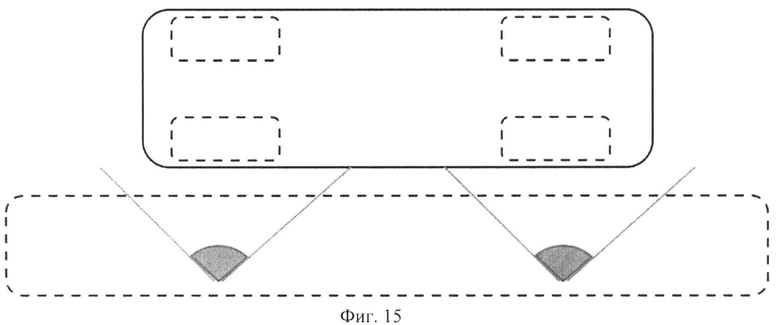

«II-вариант» конфигурации видеокамер предполагает расположение двух видеокамер на одном уровне (~1 метр) и двух камер над нижними на высоте ~2.5 метра.

Оптические оси камер располагаются перпендикулярно плоскости борта транспортного средства (Фиг.15).

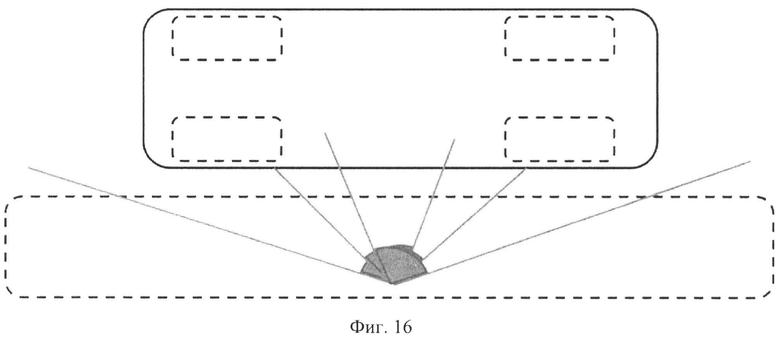

«W-Вариант» конфигурации видеокамер предполагает расположение трех видеокамер на одном уровне (~1 метр) с минимальным смещением непосредственно одна над другой и четвертой камеры на высоте ~2.5 метра (над ними). Оптические оси нижних камер располагаются под углами 45, 90 и 135 градусов к плоскости борта транспортного средства (Фиг.16).

В качестве двухкамерной конфигурации может быть «I» - конфигурация сенсорного блока, в которой две камеры расположены вертикально, оптические оси в горизонтальной плоскости перпендикулярны дороге, а в вертикальной ось нижняя камеры горизонтальна либо имеет небольшой наклон для оптимизации детального изображения ТС, тогда как ось верхней камеры имеет значительный уклон вверх для наиболее полного охвата диапазона высот.

В качестве основной двухкамерной конфигурации используется конфигурация сенсорного блока, при которой камеры находятся по разные стороны от наблюдаемой полосы и направлены вдоль одной оси навстречу друг другу.

В зависимости от оптимальной конфигурации расположения камер определяется тип крепления. Возможны два основных типа крепления. При первом типе все камеры размещаются на отдельных металлических стойках, устанавливаемых на межполосном островке безопасности. При втором типе крепления нижние камеры крепятся непосредственно к заградительной решетке. При этом камера определения высоты транспортного средства крепится на выносном кронштейне к опорной колонне А со стороны, противоположной шкафу.

| название | год | авторы | номер документа |

|---|---|---|---|

| Способ детекции протяженных линейных объектов на изображении | 2022 |

|

RU2802991C1 |

| Аппаратно-программный комплекс по мониторингу лесовозов и логистики объектов лесопромышленного комплекса | 2023 |

|

RU2826607C1 |

| Способ калибровки внешних параметров видеокамер | 2021 |

|

RU2780717C1 |

| СПОСОБ АВТОМАТИЧЕСКОГО КОНТРОЛЯ ДОРОЖНОГО ДВИЖЕНИЯ И СИСТЕМА, ЕГО РЕАЛИЗУЮЩАЯ | 2021 |

|

RU2760058C1 |

| СПОСОБ И СИСТЕМА ОПРЕДЕЛЕНИЯ СКОРОСТИ ТРАНСПОРТНОГО СРЕДСТВА | 2015 |

|

RU2592712C1 |

| Способ косвенного измерения дальности от маневрового тепловоза до вагона на прямолинейном участке железнодорожного пути | 2019 |

|

RU2729512C1 |

| СПОСОБ АВТОМАТИЧЕСКОГО ОБНАРУЖЕНИЯ ОБЪЕКТОВ С ИСПОЛЬЗОВАНИЕМ СИСТЕМЫ ТЕХНИЧЕСКОГО ЗРЕНИЯ, УСТАНОВЛЕННОЙ НА БВС | 2023 |

|

RU2817534C1 |

| Универсальный способ фотофиксации нарушений ПДД | 2019 |

|

RU2749941C2 |

| СПОСОБ И СИСТЕМА ОПРЕДЕЛЕНИЯ СРЕДНЕЙ СКОРОСТИ ТРАНСПОРТНОГО СРЕДСТВА | 2015 |

|

RU2606521C1 |

| СПОСОБ И СИСТЕМА ДЕТЕКТИРОВАНИЯ ТРЕВОЖНЫХ СОБЫТИЙ, ПРОИСХОДЯЩИХ НА ТРАНСПОРТНОМ СРЕДСТВЕ ВО ВРЕМЯ ПЕРЕВОЗКИ ГРУЗОВ, В РЕЖИМЕ РЕАЛЬНОГО ВРЕМЕНИ | 2020 |

|

RU2748780C1 |

Изобретение относится к области контроля движения дорожного транспорта. Предложенный способ предусматривает семь основных этапов: (1) исправление радиальной дисторсии; (2) детекцию въездов и/или выездов; (3) определение высоты транспортного средства; (4) детекцию осей транспортного средства; (5) предварительный подсчет количества осей транспортного средства; (6) фильтрацию результатов предварительного подсчета (статистическую обработку) и (7) окончательный подсчет количества осей транспортного средства. Технический результат - высокоточная, полностью автономная, многокритериальная классификация транспортных средств. 8 з.п. ф-лы, 16 ил.

1. Способ автоматической классификации транспортных средств, в котором используют цифровые оптико-электронные преобразователи на основе видеокамеры и средства цифровой обработки данных; непрерывно получают видеопоток с камеры, установленной сбоку от зоны наблюдения; компенсируют радиальную дисторсию кадров видеопотока, получая множество значений элементов видеопотока Pxyt, где х - горизонтальная координата, у - вертикальная координата, t - временная координата; вычисляют экспоненциальное скользящее среднее (по времени) элементов видеопотока Bxyt; вычисляют коэффициент корреляции по координатам х, у D1(t) между Pxyt и Bxyt и определяют такие моменты времени tin, когда D1(t) становится больше предварительно заданного порогового значения L1 после чего определяют такие моменты времени tout, когда D1(t) становится меньше L1; вычисляют интегрированные и/или усредненные по времени Pxyt за период времени Т4 (период нахождения транспортного средства в поле зрения камеры) между моментами tin и tout для множества постоянных у, получая множество PT4(у); вычисляют разность D2(y, t) между Pxyt(y, t) и PT4(у) и находят такое ytop(t) (соответствующее профилю транспортного средства), при котором значения D2(y, t) превышают предварительно заданное пороговое значение L2; распознают эллиптические контуры на отдельных кадрах (подмножества Pxyt вида Pt(x, у)) видеопотока, соответствующих периоду Т4, определяют координаты центров эллипсов (Xc(t), Yc(t)), отбрасывают значения, вертикальная координата Yc(t) которых отличается на величину больше порогового значения L3 от усредненных значений, получая множество фильтрованных значений координат центров эллипсов (Xcf(t), Ycf(t)); применяют преобразование Хафа к Xcf(t), и по количеству максимумов в пространстве Хафа определяют количество осей транспортного средства; по значениям Ycf(t) и максимальному значению ytop за период Т4 определяют высоту транспортного средства.

2. Способ по п.1, в котором положение образов колес транспортных средств на изображении определяют с использованием метода Виолы-Джонса.

3. Способ по п.1, в котором осуществляют дополнительную фильтрацию значений вертикальной координаты с учетом допустимого размера колес транспортных средств.

4. Способ по п.1, в котором упомянутые камеры установлены на разном уровне по вертикали.

5. Способ по п.1, в котором используют, по меньшей мере, две камеры, поля зрения которых, по меньшей мере, частично перекрываются.

6. Способ по п.5, в котором используют, по меньшей мере, две камеры, имеющие различную чувствительность сенсоров.

7. Способ по п.1, в котором используют, по меньшей мере, две камеры, при этом ориентируют их в продольной плоскости таким образом, чтобы оптические оси были направлены под углом навстречу друг другу, а боковые границы полей зрения камер пересекались вблизи границ зоны детекции, не выходя за ее пределы.

8. Способ по п.1, в котором используют, по меньшей мере, две камеры, при этом ориентируют одну из них под углом к горизонтали таким образом, чтобы граница поля зрения этой камеры располагалась вблизи границы зоны детекции, не выходя за ее пределы.

9. Способ по п.1, в котором дополнительно используют осветительный прибор для увеличения освещенности зоны детекции при недостатке освещенности.

| WO 03096300 A1, 20.11.2003 | |||

| US 5446291 A, 29.08.1995 | |||

| JP 2001283375 A, 12.10.2001 | |||

| US 5750069 A, 12.05.1998 | |||

| Устройство для измерения параметров потока экипажей | 1975 |

|

SU557405A1 |

Авторы

Даты

2013-06-27—Публикация

2012-02-09—Подача