Область техники

Изобретение относится к области информационной безопасности.

Уровень техники

Все большую популярность в повседневной жизни пользователей набирают различные компьютерные устройства, а в последнее время также устройства Интернета вещей (англ. Internet of Things, IoT). Таким образом, в ежедневном распоряжении пользователя или группы пользователей (домохозяйств) может быть набор устройств, таких как смартфон, ноутбук, роутер, система хранения данных, умные часы и др. Большинство устройств пользователей взаимодействуют между собой, например, подключены к одной сети, на устройствах могут быть установлены приложения для доступа к сервисам и общим хранилищам данных и т.д.

Интернет вещей стремительно развивается в последнее время. Это связано с развитием технологий, внедрением новых стандартов связи, в частности 5G, а также доступностью техники. Так, уже в 2018 году в мире насчитывалось 22 миллиарда IoT-устройств. Однако, такое развитие и рост сопровождается увеличением количества и сложности угроз информационной безопасности (сокр. ИБ), в частности, вредоносного программного обеспечения (сокр. ПО). И многие производители ПО не успевают исправлять известные уязвимости и выпускать обновления для их исправления. Также не все производители ПО производят полноценное тестирование и применение прогрессивных стандартов разработки. При этом обеспечение информационной защиты набора устройств пользователя становится еще более сложной задачей ввиду постоянного обмена данными между устройствами набора. В результате чего нарушение ИБ одного устройства может отразиться на ИБ других устройств и сервисов.

Существующие средства защиты устройств, такие как антивирусы, достаточно хорошо справляются с обнаружением известного вредоносного ПО. Однако, антивирусы не всегда справляются с обнаружением новых ранее неизвестных угроз. Кроме того, большинство антивирусных решений работает лишь на одном устройстве и не обменивается данными об угрозах с другими устройствами пользователя, что не позволяет повысить уровень защиты устройств. Поэтому возникает техническая проблема, заключающаяся в низком качестве обеспечения информационной безопасности набора устройств пользователя.

Ввиду роста количества и разнообразия компьютерных устройств, которые используют пользователи, возникает потребность в новых подходах к технологиям защиты от вредоносного ПО, в которых бы использовались данные об угрозах и знания на основе этих данных, собранных со всего разнообразия устройств и сервисов пользователя.

В последнее время в индустрии информационной безопасности набирают популярность технологии определения вредоносного ПО, использующие методы машинного обучения. Например, в публикации US 20190387011 А1 для определения нежелательного поведения среди устройств Интернета вещей сравнивают поведение устройств с шаблонами известного легитимного или нежелательного поведения. В случае совпадения поведения устройства с шаблоном нежелательного поведения пользователю отображается уведомление о возможном нежелательном поведении устройства. Недостатком данного подхода является отсутствие автоматических действий, направленных на нейтрализацию (удаление, лечение) найденного нежелательного поведения. Кроме того, в указанном решении не учитываются данные о взаимодействии пользователя с устройствами. Из-за этого, легитимное взаимодействие пользователя с устройством может быть определено как нежелательное поведение. В результате возникнет ложное срабатывание (ошибка первого рода). Таким образом, найденная публикация не решает заявленную техническую проблему.

Анализ предшествующего уровня техники позволяет сделать вывод о неэффективности и в некоторых случаях о невозможности применения предшествующих технологий для обеспечения информационной безопасности набора устройств пользователя, недостатки которых решаются настоящим изобретением, а именно заявленной системой и способом защиты устройств пользователя.

Раскрытие сущности изобретения

Первый технический результат заключается в улучшении уровня защиты набора устройств пользователя.

Второй технический результат заключается в снижении ошибок первого и второго рода при определении аномалии, связанной с угрозой информационной безопасности, на устройствах пользователя.

Согласно варианту реализации используется способ защиты устройств пользователя, в котором: определяют значения признаков активности пользователя с набора устройств пользователя из, по меньшей мере, двух устройств; определяют аномалию, указывающую на угрозу информационной безопасности устройств пользователя, путем применения обученной модели определения аномалии, принимающей на вход определенные значения признаков активности пользователя; определяют тип определенной аномалии и устройство, являющееся источником аномалии, путем применения обученной модели классификации аномалии, принимающей на вход значения признаков активности пользователя; изменяют настройки информационной безопасности устройства согласно определенному типу аномалии.

Согласно одному из частных вариантов реализации дополнительно выполняют обучение модели определения аномалии на данных обучающей выборки, включающей значения признаков активности пользователя за исторический период наблюдения.

Согласно другому варианту реализации выполняют тестирование и валидацию обученной модели определения аномалии на данных тестовой и валидационной выборок соответственно, включающих значения признаков активности пользователя за исторический период наблюдения, где для, по меньшей мере, заданной части значений признаков активности пользователя известна угроза информационной безопасности, связанная с аномалией, а также устройства, на которых возникла аномалия, при этом по результатам упомянутого тестирования и валидации выполняют дообучение модели определения аномалии.

Согласно еще одному частному варианту реализации обучают модель классификации аномалии на данных второй обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

Согласно одному из частных вариантов реализации получают от пользователя через устройство пользователя обратную связь, подтверждающую или опровергающую определенную аномалию, и которую включают в обучающую выборку для дообучения модели определения аномалии.

Согласно другому частному варианту реализации выполняют обучение модели определения аномалии во время простоя устройства, на котором установлено средство обучения.

Согласно еще одному частному варианту реализации дополнительно получают от пользователя через устройство пользователя обратной связи, подтверждающей или опровергающей определенную аномалию, и которую включают в обучающую выборку для дообучения модели определения аномалии.

Согласно одному из частных вариантов реализации получают обученную модель классификации аномалии от удаленного сервера, где удаленный сервер служит для обучения модели классификации аномалии на данных третьей обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения для, по меньшей мере, двух пользователей, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

Согласно другому частному варианту реализации с помощью средства защиты на другом устройстве пользователя, связанном с определенным устройством, изменяют настройки информационной безопасности на определенном устройстве.

Согласно еще одному частному варианту реализации изменяют настройки информационной безопасности в соответствии с заранее сформированными правилами изменения настроек информационной безопасности.

Согласно одному из частных вариантов реализации изменяют настройки информационной безопасности путем применения обученной модели определения оптимальных изменений настроек информационной безопасности, принимающей на вход, в частности, тип аномалии.

Согласно варианту реализации используется система защиты устройств пользователя, содержащая: средство формирования, предназначенное для определения значений признаков активности пользователя с набора устройств пользователя из, по меньшей мере, двух устройств; средство обнаружения аномалии, предназначенное для: определения аномалии, указывающей на угрозу информационной безопасности устройств пользователя, путем применения обученной модели определения аномалии, принимающей на вход определенные значения признаков активности пользователя; определения типа определенной аномалии и устройства, являющегося источником аномалии, путем применения обученной модели классификации аномалии, принимающей на вход определенные значения признаков активности пользователя; средство защиты, предназначенное для изменения настроек информационной безопасности на определенном устройстве согласно определенному типу аномалии; где упомянутые средство формирования, средство обнаружения аномалии и средство защиты установлены на, по меньшей мере, двух устройствах из набора устройств.

Согласно одному из частных вариантов реализации, активности пользователя включают, по меньшей мере, изменение местоположения пользователя, взаимодействие пользователя с устройствами пользователя и сервисами пользователя, доступ к которым осуществляется посредством устройств пользователя.

Согласно другому частному варианту реализации, признаки активности пользователя дополнительно включают признаки планируемой активности пользователя из, по меньшей мере, одного сервиса пользователя, при этом доступ к упомянутым сервисам пользователя осуществляется посредством, по меньшей мере, одного устройства пользователя.

Согласно еще одному частному варианту реализации сервисы пользователя, к которым пользователь предоставил доступ, включают, в частности: календарь; антивирусное приложение; приложение звонков; электронную почту; веб-браузер.

Согласно одному из частных вариантов реализации используется система, дополнительно включающая средство обучения, установленное на, по меньшей мере, одном из устройств пользователя, при этом средство обучения служит для обучения модели определения аномалии на данных обучающей выборки, включающей значения признаков активности пользователя за исторический период наблюдения.

Согласно другому частному варианту реализации средство обучения дополнительно предназначено для выполнения тестирования и валидации обученной модели определения аномалии на данных тестовой и валидационной выборок соответственно, включающих значения признаков активности пользователя за исторический период наблюдения, где для, по меньшей мере, заданной части значений признаков активности пользователя известна угроза информационной безопасности, связанная с аномалией, а также устройства, на которых возникла аномалия, при этом по результатам упомянутого тестирования и валидации выполняют дообучение модели определения аномалии.

Согласно еще одному частному варианту реализации средство обучения дополнительно служит для обучения модели классификации аномалии на данных второй обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

Согласно одному из частных вариантов реализации средство обучения дополнительно служит для получения от пользователя через устройство пользователя обратной связи, подтверждающей или опровергающей определенную аномалию, и которую включают в обучающую выборку для дообучения модели определения аномалии.

Согласно другому частному варианту реализации, средство обучения служит для обучения модели определения аномалии во время простоя устройства, на котором установлено упомянутое средство обучения.

Согласно еще одному из частных вариантов реализации средство обнаружения аномалии получает обученную модель классификации аномалии от удаленного сервера, где удаленный сервер служит для обучения модели классификации аномалии на данных третьей обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения для, по меньшей мере, двух пользователей, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

Согласно одному из частных вариантов реализации изменение настроек информационной безопасности устройства включает, в частности: осуществление антивирусной проверки актуальными базами; изменение параметров сети; ограничение функциональности устройства; ограничение взаимодействия устройства с другими устройствами; ограничение доступа к ресурсам устройства; включение многофакторной аутентификации; обновление средства защиты на устройстве, на котором определена аномалия; получение обратной связи по результатам описанных выше способов.

Согласно другому частному варианту реализации, дополнительно изменяют настройки информационной безопасности других устройств пользователя, связанных с определенным устройством.

Согласно еще одному частному варианту реализации, признаки активности пользователя включают: взаимодействие устройства с сервером; подключение новых устройств к сети устройств пользователя; количество новых устройств, подключенных к сети устройств пользователя; доступ к ресурсам устройства; перечень ресурсов, к которым осуществляется доступ; характеристики устройства; передачу данных; тип передаваемых данных; события антивируса; тип активности пользователя.

Согласно одному из частных вариантов реализации тип активности пользователя является одним из следующих: наличие определенного местоположения; управление транспортным средством; взаимодействие с, по меньшей мере, одним из устройств пользователя; взаимодействие с новыми устройствами.

Согласно другому частному варианту реализации средство защиты на другом устройстве пользователя, связанном с определенным устройством, производит изменения настроек информационной безопасности на определенном устройстве.

Согласно еще одному частному варианту реализации тип аномалии является, в частности, одним из следующих: вредоносное ПО; утечка данных; неавторизированный вход; несанкционированный доступ к, по меньшей мере, устройству, сервису, данным; компрометация устройства; подключение к командному центру бот-сети; шифрование данных пользователя; другой.

Согласно одному из частных вариантов реализации средство защиты предназначено для изменения настроек информационной безопасности в соответствии с заранее сформированными правилами изменения настроек информационной безопасности.

Согласно еще одному частному варианту реализации средство защиты предназначено для изменения настроек информационной безопасности путем применения обученной модели определения оптимальных изменений настроек информационной безопасности, принимающей на вход, в частности, тип аномалии.

Краткое описание чертежей

Дополнительные цели, признаки и преимущества настоящего изобретения будут очевидными из прочтения последующего описания осуществления изобретения со ссылкой на прилагаемые чертежи, на которых:

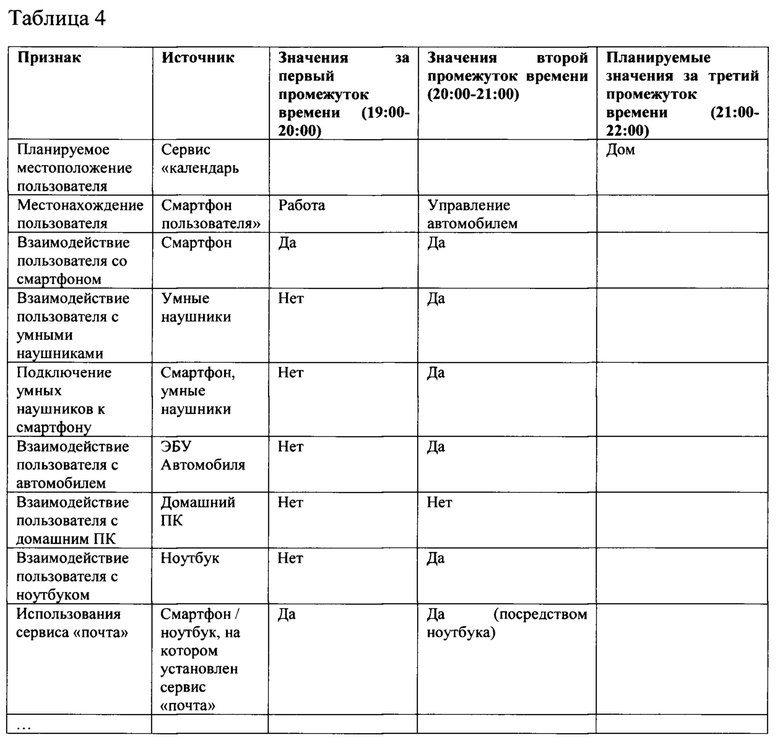

На Фиг. 1 представлена схема защиты устройств пользователя.

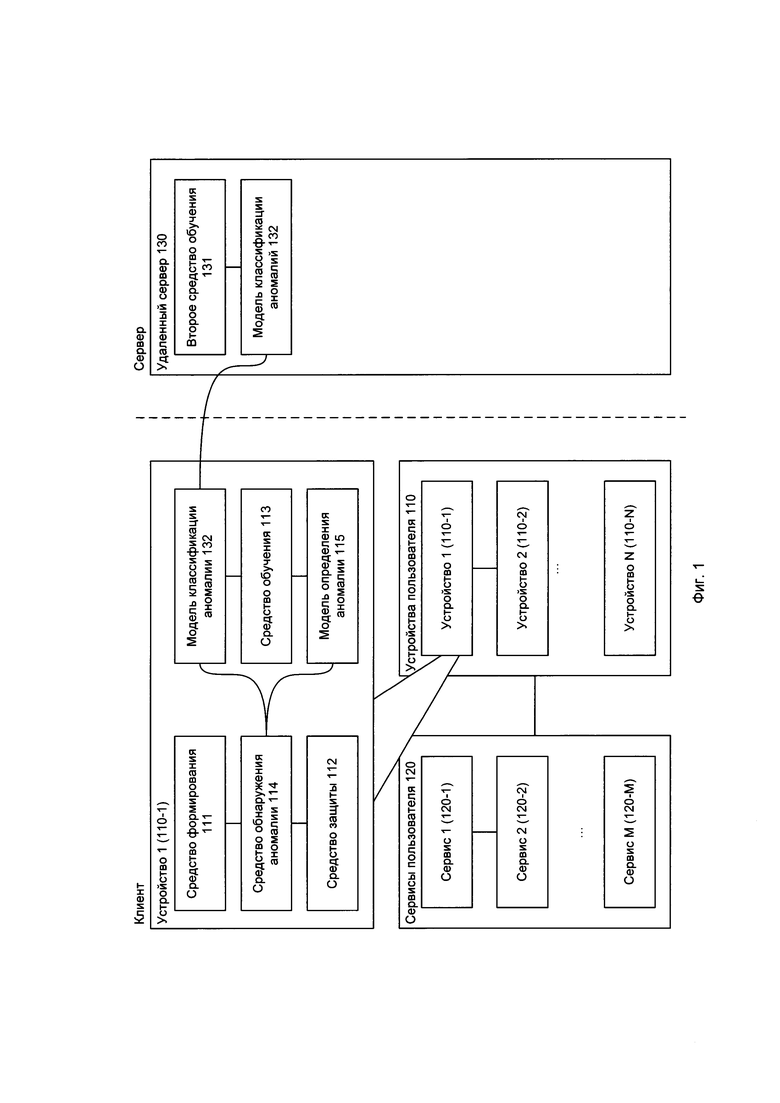

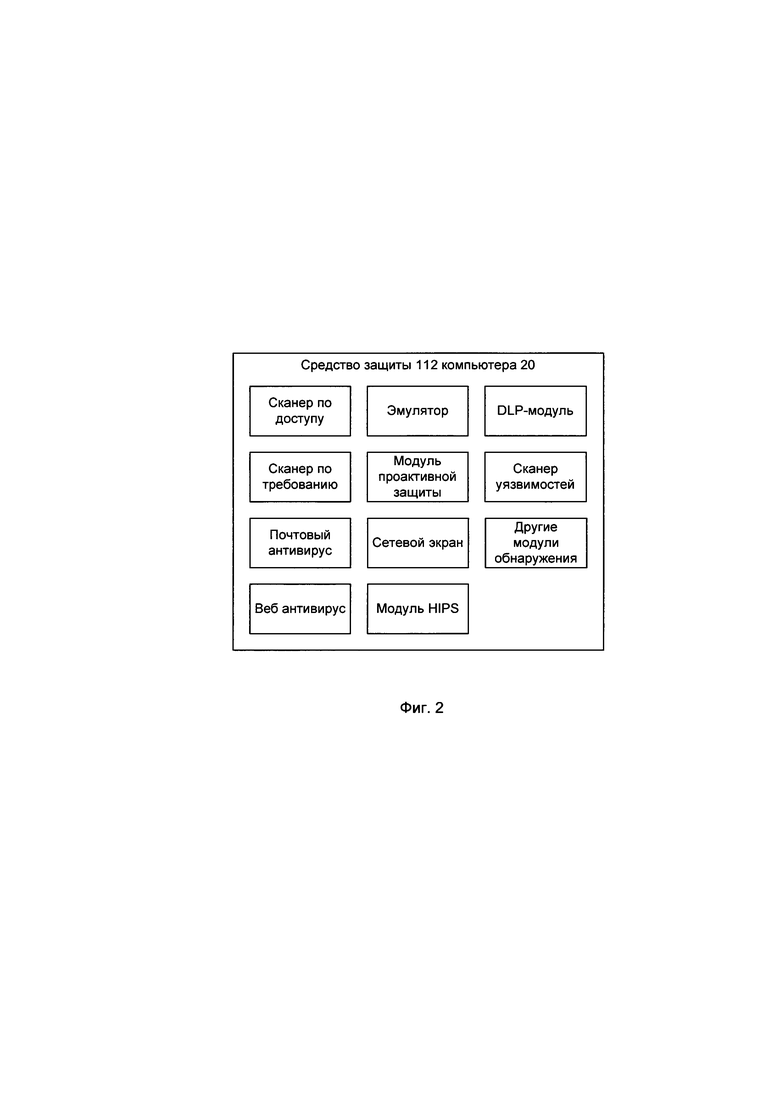

На Фиг. 2 приведен возможный пример модулей средства защиты компьютера.

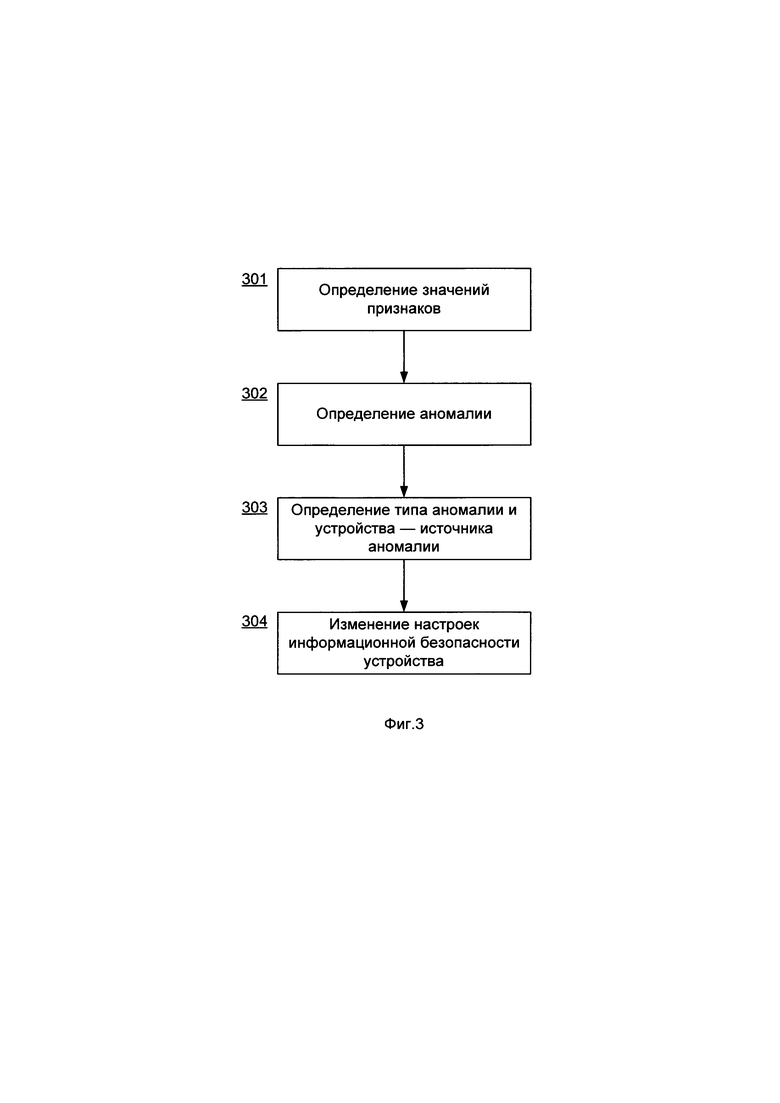

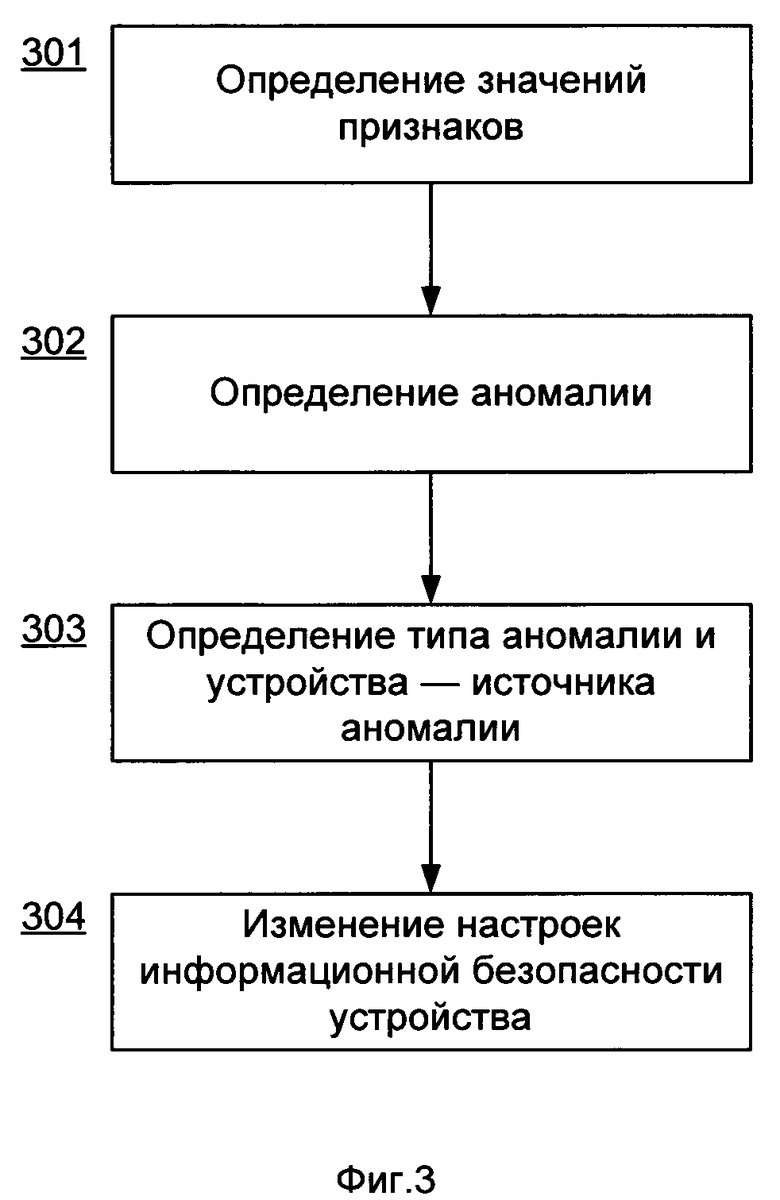

На Фиг. 3 представлен вариант способа защиты устройств пользователя.

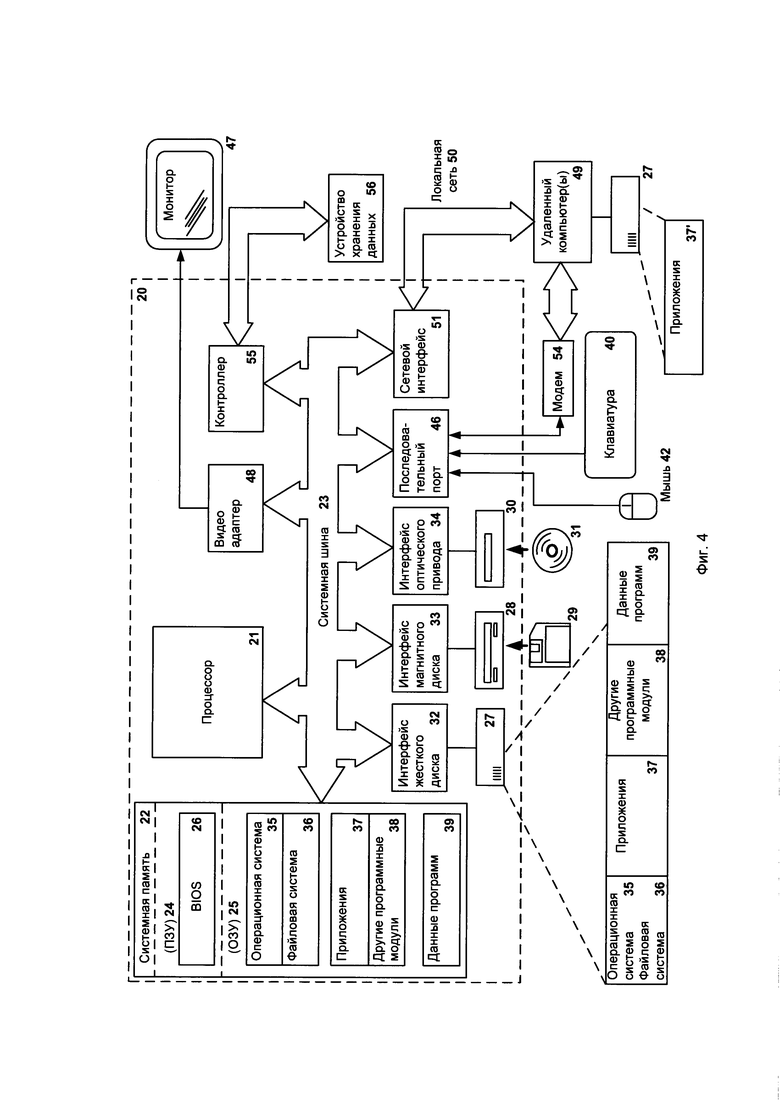

Фиг. 4 представляет пример компьютерной системы общего назначения.

Осуществление изобретения

Объекты и признаки настоящего изобретения, способы для достижения этих объектов и признаков станут очевидными посредством отсылки к примерным вариантам осуществления. Однако, настоящее изобретение не ограничивается примерными вариантами осуществления, раскрытыми ниже, оно может воплощаться в различных видах. Сущность, приведенная в описании, является ничем иным, как конкретными деталями, обеспеченными для помощи специалисту в области техники в исчерпывающем понимании изобретения, и настоящее изобретение определяется в объеме приложенной формулы.

Глоссарий

Интернет вещей (англ. Internet of Things, IoT) - вычислительная сеть устройств и физических предметов («вещей»), оснащенных встроенными технологиями для взаимодействия друг с другом или с внешней средой. Интернет вещей включает в себя носимые устройства, электронные системы транспортных средств, умные автомобили, умные города, промышленные системы и пр.

Промышленный Интернет вещей (англ. Industrial Internet of Things, IIoT) состоит из подключенного к Интернету оборудования и платформ расширенной аналитики, которые выполняют обработку данных, получаемых от подключенных устройств. Устройства IIoT могут быть самыми разными - от небольших датчиков погоды до сложных промышленных роботов (https://www.hpe.com/ru/ru/what-is/industrial-iot.html).

На Фиг. 1 представлена схема защиты устройств пользователя.

Система включает набор устройств пользователя 110, набор сервисов пользователя 120, удаленный сервер 130. Набор устройств пользователя 110 состоит из, по меньшей мере, двух устройств (N≥2). При этом устройствами пользователя являются любые устройства, например, смартфон, персональный компьютер (сокр. ПК), ноутбук, роутер, система хранения данных (сокр. СХД), устройства Интернета вещей, умные часы, умные наушники, модули автомобиля и др. К устройствам пользователя также могут относиться устройства Промышленного Интернета вещей, например, если пользователь является оператором таких устройств. По меньшей мере на двух устройствах 110 установлены средство формирования 111, средство защиты 112, средство обнаружения (определения) аномалии 114. Кроме того, на части устройств 110 может быть установлено средство обучения 113. На Фиг. 1, в качестве примера, указанные средства установлены на устройстве 110-1.

Набор сервисов пользователя 120 состоит из, по меньшей мере, одного сервиса (М≥1) и может включать такие сервисы и приложения, как календарь, антивирусное приложение, приложение звонков, приложение электронной почты, веб-браузер и др. Доступ к сервисам осуществляется после предоставления пользователем соответствующего разрешения и посредством одного или нескольких устройств пользователя 110 или удаленного сервера 130.

Активность пользователя может быть в реальном времени, а также планируемая. В данном изобретении под активностью пользователя понимается, в частности, передвижение пользователя (изменение местоположения), взаимодействие пользователя с устройствами, взаимодействие пользователя с сервисами (например, взаимодействие с приложением электронной почты на телефоне), взаимодействие устройств или сервисов между собой (например, установка нового приложения на устройстве, обмен данными между устройствами). Под планируемой активностью пользователя понимается активность пользователя, которая ожидается в один из моментов времени в будущем по отношению к моменту времени, когда информация о планируемой активности была получена. Соответственно, планируемая активность включает, в частности, планируемые передвижения пользователя, планируемое взаимодействие пользователя с устройствами, планируемое взаимодействие пользователя с сервисами, планируемое взаимодействие устройств или сервисов между собой.

Средство формирования 111 служит для определения значений признаков активности пользователя (далее - признаки) с набора устройств пользователя 110. В частном варианте реализации признаки активности дополнительно включают признаки планируемой активности, значения которых получены от набора сервисов пользователя 120. Упомянутые признаки являются численными характеристиками активности пользователя и соответственно планируемой активности пользователя.

В частном варианте реализации признаки включают один или несколько из следующих:

а) взаимодействие устройства с сервером;

б) подключение новых устройств к сети устройств пользователя;

в) количество новых устройств, подключенных к сети устройств пользователя;

г) доступ к ресурсам устройства (память, процессор и др.);

д) перечень ресурсов, к которым осуществляется доступ;

е) характеристики устройства;

ж) передачу данных;

з) тип передаваемых данных (например, команды, сырые данные, зашифрованные данные и др.);

и) события антивируса, например: обнаружен вредоносный файл, отключение самозащиты, неудачная попытка обновления и другие события антивируса и модулей антивируса (см. Фиг. 2);

к) тип активности пользователя.

При этом тип активности пользователя может являться одним из следующих:

а) наличие определенного местоположения;

б) управление транспортным средством;

в) взаимодействие с, по меньшей мере, одним из устройств пользователя;

г) взаимодействие с новыми устройствами.

Средство обнаружения аномалии 114 предназначено для определения аномалии, указывающей на угрозу информационной безопасности, путем применения обученной модели определения аномалии 115, принимающей на вход значения признаков. Под угрозой информационной безопасности понимается любое нарушение или попытка нарушения информационной безопасности устройства, в частности, несанкционированный доступ к данным пользователя, мошенничество (англ. fraud), загрузка или выполнение вредоносного ПО и другие угрозы.

После определения аномалии средство обнаружения аномалии 114 также предназначено для определения типа определенной аномалии и устройства, являющегося источником аномалии, путем применения обученной модели классификации аномалии 132, принимающей на вход определенные значения признаков.

Средство защиты 112 предназначено для изменения настроек информационной безопасности на определенном устройстве согласно определенному типу аномалии.

В частном варианте реализации изменение настроек информационной безопасности устройства включает, одно или несколько из следующих:

а) осуществление антивирусной проверки актуальными базами;

б) изменение параметров сети;

в) ограничение функциональности устройства;

г) ограничение взаимодействия устройства с другими устройствами;

д) ограничение доступа к ресурсам устройства;

е) включение многофакторной аутентификации;

ж) обновление средства защиты на устройстве, на котором определена аномалия;

з) получение обратной связи по результатам описанных выше способов.

В частном варианте реализации тип аномалии является одним из следующих:

а) вредоносное ПО;

б) утечка данных;

в) неавторизированный вход;

а) несанкционированный доступ к, по меньшей мере, устройству, сервису, данным;

б) компрометация устройства;

в) подключение к командному центру бот-сети;

г) шифрование данных пользователя;

д) другой.

При этом изменение настроек информационной безопасности осуществляется согласно определенному типу аномалии, например, в соответствии с заранее сформированными правилами изменения настроек ИБ. Где упомянутые правила определяют изменения настроек ИБ, соответствующие определенному типу аномалии. Упомянутые правила могут быть заранее сформированы специалистами по ИБ на удаленном сервере 130 и переданы на устройства пользователей 110.

В другом варианте реализации может быть использована модель машинного обучения для определения оптимальных изменений настроек ИБ (на фигуре не указана), принимающая на вход, в частности, тип аномалии и выбирающая среди изменений настроек ИБ те изменения, которые обеспечивают наилучшую защиту устройств. При этом упомянутая модель определения оптимальных изменений настроек ИБ может быть обучена на четвертой обучающей выборке, содержащей примеры применения упомянутых правил с последующим анализом результатов применения правил на данных с устройств нескольких пользователей. Процесс обучения модели определения оптимальных изменений настроек ИБ может происходить как на удаленном сервере 130, так и на устройствах пользователя 110. Модель определения оптимальных изменений настроек ИБ может дообучаться при добавлении новых правил, а также через определенные промежутки времени, при получении новых данных о применении упомянутых правил на устройствах пользователей и данных об уровне защиты устройств пользователя после применения соответствующих правил. В одном варианте упомянутая модель определения оптимальных изменений настроек ИБ дополнительно принимает на вход информацию об определенных устройствах, являющихся источником определенной аномалии (например, идентификатор устройства, тип устройства и др.). В другом примере упомянутая модель определения оптимальных изменений настроек ИБ дополнительно принимает на вход определенные значения признаков.

Еще в одном частном варианте реализации средство защиты 112 дополнительно служит для изменения настроек информационной безопасности других устройств пользователя, например, связанных с определенным устройством, имеющих одного владельца, обладающих схожими характеристиками и др. Например, усиливают защиту устройств, находящихся в одной подсети. Под связью между устройствами понимается состояние устройств, в результате которого действия, выполняемые на одном устройстве, могут отразиться на функционировании другого устройства, на данных на другом устройстве или на функционировании сервисов на другом устройстве. Например, связь может заключаться в обмене данными между устройствами, в подключении устройств к одной сети, в наличии общих сервисов, установленных на упомянутых устройствах.

Средство обучения 113 служит для обучения и дообучения модели определения аномалии 115 по данным обучающей выборки, включающей значения признаков за исторический период наблюдения (например, неделя, месяц). Стоит отметить, что под дообучением в данной заявке понимается повторное обучение модели на новых данных или с использованием новых параметров модели. Также под дообучением в данной заявке понимается повторное обучение модели с использованием новой спецификации модели, например, изменение нейронной сети на логистическую регрессию для модели определения аномалии 115. Обучающая выборка формируется средством обучения 113 по данным от средства формирования 111 и средства обнаружения аномалий 114 за исторический период наблюдения. Затем после обучения или дообучения моделей машинного обучения (модели определения аномалии 115 и модели классификации аномалии 132) средство обучения 113 передает обученные модели средству обнаружения аномалии 114. В частном варианте реализации дообучение моделей происходит периодически, например, раз в месяц. При этом, если у пользователя большое количество устройств, будет формироваться большее количество событий и соответственно признаков. В этом случае модель будет дообучаться чаще (например, раз в неделю), чем у другого пользователя, у которого количество устройств меньше (раз в месяц). В еще одном примере реализации дообучение происходит при добавлении нового устройства пользователя или сервиса пользователя, к которому подключается пользователь или устройство пользователя. В еще одном примере реализации может использоваться несколько моделей. При добавлении нового устройства или сервиса происходит обучение новой модели. В еще одном примере реализации может использоваться метод онлайн обучения (англ. online machine learning), в котором данные становятся доступными в последовательном порядке и используются для обновления параметров модели для поступающих в будущем данных на каждом шаге. То есть модель дообучается при каждом получении новых данных. Такой подход позволит лучше учитывать изменения в поведении пользователя и, соответственно, в новых признаках активности пользователя.

В частном варианте реализации средство обучения 113 дополнительно служит для обучения и дообучения модели классификации аномалии 132 на данных второй обучающей выборки, включающей группы значений признаков и сформированной по данным от средства формирования 111 за второй исторический период наблюдения (например, неделя, месяц). Также указанная выборка для каждой группы значений признаков включает значения типа аномалии и устройства, являющегося источником аномалии.

Соответственно модель классификации аномалий 132 служит для классификации аномалии на классы, задаваемые значениями типа аномалии и устройства, являющегося источником аномалии. Поэтому вторая обучающая выборка включает размеченные данные по классам аномалий. Кроме того, для обучения и дообучения модели классификации аномалий 132 могут быть использованы частные варианты реализации, применимые для модели определения аномалии 115, в частности, онлайн обучение.

В частном варианте реализации средство обнаружения аномалии 114 получает обученную модель классификации аномалии 132 от удаленного сервера 130. Второе средство обучения 131 расположено на удаленном сервере 130 и служит для обучения и дообучения модели классификации аномалии 132 на данных третьей обучающей выборки. Где третья обучающая выборка формируется вторым средством обучения 131 по данным от средств формирования 111 устройств пользователей за второй исторический период наблюдения (например, месяц, год) и включает группы значений признаков для, по меньшей мере, двух устройств пользователей и класс, задаваемый значениями типа аномалии и устройства, являющегося источником аномалии, для каждой группы значения признаков.

В еще одном частном варианте реализации с помощью средства обучения 113 или соответственно второго средства обучения 131 выполняют тестирование и валидацию обученной модели определения аномалий 115 и обученной модели классификации аномалии 132 на данных тестовой и валидационной выборок соответственно. Тестовая и валидационная выборки дополнительно включают значения признаков за исторический период наблюдения, где для, по меньшей мере, заданной части значений признаков известна угроза информационной безопасности, связанная с аномалией, а также устройства, на которых возникла аномалия. В этом случае третья обучающая выборка формируется средством обучения 113 или вторым средством обучения 131 по данным от средств формирования 111 и средств обнаружения аномалий 114 устройств пользователей за первый исторический период наблюдения или за второй исторический промежуток времени соответственно. Затем после обучения или дообучения моделей машинного обучения (модели определения аномалии 115 и модели классификациианомалии 132), средство обучения 113 передает обученные модели средству обнаружения аномалии 114. При этом могут быть использованы известные подходы к формированию тестовой и валидационной выборок. Например, путем разделения исходной обучающей выборки на обучающую, тестовую и валидационную выборки в пропорциях 60%, 20%, 20% соответственно. Таким образом, в этом примере при обучении модели будет использоваться только 60% примеров исходной обучающей выборки. При тестировании обученной модели определения аномалии 115 или соответственно модели классификации аномалии 132 может использоваться любая известная из уровня техники метрика качества, в частности NAB-метрика, F1-метрика, МАРЕ-метрика, accuracy (доля верных прогнозов), точность (англ. precision, доля верных прогнозов, которые были подтверждены), полнота (англ. recall), количество ошибок первого и второго рода и другие метрики. Стоит отметить, что метрику качества выбирают, в частности, в зависимости от используемой модели определения аномалии 115 или соответственно модели классификации аномалии 132. При этом по результатам упомянутого тестирования и валидации выполняют дообучение модели определения аномалии в соответствии с известными в уровне техники подходами, для достижения требуемых значений выбранных метрик качества. При дообучении модели могут изменять параметры модели, признаки активности пользователя, используемые в модели, параметры регуляризации модели в случае использования регуляризации, добавлять (удалять, изменять) слои нейронной сети, если моделью является нейронная сеть, увеличивать объем обучающей выборки, а также использовать другие подходы. При этом, дообучение модели может происходить до тех пор, пока упомянутые значения метрик качества не будут достигнуты (например, количество ошибок первого и второго рода не превышают 0.1%). Таким образом, дообучение модели позволяет снизить ошибки первого и второго рода при определении аномалии, связанной с угрозой информационной безопасности, на устройствах пользователя.

Модель определения аномалии 115 может быть любой известной из уровня техники моделью машинного обучения, которая может быть применена в раскрытом изобретении. Далее приведены несколько возможных моделей определения аномалии 115. Однако, настоящее изобретение не ограничивается ими, и в изобретении могут быть применены другие известные модели определения аномалии 115.

Если обучающая выборка содержит малое количество примеров, указывающих на угрозы информационной безопасности (то есть количество примеров, указывающих на аномалии, например, менее 10 или менее 1% от общего количества), то может использоваться модель определения аномалий 115 в предположении, что признаки обучающей выборки подчиняются распределению Гаусса. В этом случае по данным обучающей выборки будут оценены выборочные средние и выборочные дисперсии для каждого признака, после чего будет рассчитана совместная плотность вероятности распределения. В итоге, если значение вероятности, оцененное на новых данных, окажется ниже заданного порога (заданной квантили распределения), то будет определена аномалия. При этом устройство, на котором обнаружена аномалия, может быть определено по наименьшему значению плотности вероятности для соответствующих признаков активности, полученных с данного устройства. В этом случае тестовая и валидационная выборки будут содержать незначительное количество примеров, указывающих на угрозу информационной безопасности (аномалию), достаточное для определения качества модели и последующего корректирования параметров модели для максимизации качества. Кроме того, в качестве модели определения аномалии 115 могут быть использованы модели временных рядов, такие как ARIMA, ARIMAX и др.

Когда обучающая выборка содержит большое количество примеров, содержащих угрозы информационной безопасности (то есть примеров с аномалией), тогда могут быть использованы модели классификации, такие как логистическая регрессия, нейронные сети, решающее дерево, решающий лес, метод опорных векторов, метод ближайший соседей и др. Такая модель определения аномалии 115 на основе модели машинного обучения для классификации будет осуществлять классификацию активности пользователя на аномальную / ожидаемую.

В частном варианте реализации модель определения аномалии 115 содержит в себе набор моделей, то есть ансамбль, принимающий решение путем усреднения результатов работы отдельных моделей из набора. В еще одном частном варианте реализации оптимизируют нейронную сеть с использованием генетических алгоритмов. В другом частном варианте реализации выбирают нейронную сеть с использованием одной из метрик качества, например, NAB-метрики или F1-метрики.

В частном варианте реализации построение модели определения аномалии 115 средством обучения 113 происходит следующем образом. Вначале выбирают шаблон архитектуры нейронной сети. Например, многослойный перцептрон, сверточную нейронную сеть, рекуррентную нейронную сеть или другие. Далее формируют описание выбранной архитектуры:

• оптимизатор и его параметры;

• начальные значения весовых коэффициентов и сдвигов;

• максимальное количество слоев;

• для каждого слоя:

список возможных типов слоя, состоящий по меньшей мере из подмножества следующих слоев: Dense, Convolutional, GRU, LSTM, Dropout;

список возможных типов слоя, состоящий по меньшей мере из подмножества следующих слоев: Dense, Convolutional, GRU, LSTM, Dropout;

функция активации: линейная, ReLU, Tanh, сигмоида, Softmax и др.;

функция активации: линейная, ReLU, Tanh, сигмоида, Softmax и др.;

возможный размер слоя (число нейронов в слое).

возможный размер слоя (число нейронов в слое).

Затем производят оптимизацию архитектуры нейронной сети с использованием оптимизатора. В частном варианте реализации оптимизация архитектуры нейронной сети производится с использованием генетических алгоритмов. Для выбора лучшей архитектуры также используется метрика качества. В частном варианте реализации используется метрика качества, например, NAB-метрика, F1-метрика.

Средство обучения 113 дополнительно служит для получения обратной связи от пользователя устройства 110, подтверждающей или опровергающей определенную аномалию, и включают указанную информацию в обучающую выборку для дообучения модели определения аномалии 115. Таким образом, дообучение модели позволяет снизить ошибки первого и второго рода при определении аномалии, связанной с угрозой информационной безопасности, на устройствах пользователя.

В качестве модели классификации аномалий 132 может быть выбрана любая известная из уровня техники модель машинного обучения для решения задач классификации. Поэтому примеры моделей для решения задач классификации, представленные выше, могут быть также использованы в качестве модели классификации аномалии 132. В частности, такие как логистическая регрессия, нейронные сети, решающее дерево, решающий лес, метод опорных векторов, метод ближайший соседей и др.

На Фиг. 2 приведен возможный пример модулей средства защиты 112 компьютера 20. Средство защиты 112 (антивирус или другое средство защиты) устройства может содержать модули, предназначенные для обеспечения безопасности устройства: сканер по доступу, сканер по требованию, почтовый антивирус, веб антивирус, модуль проактивной защиты, модуль HIPS (англ. Host Intrusion Prevention System - система предотвращения вторжений), DLP-модуль (англ. data loss prevention - предотвращение утечки данных), сканер уязвимостей, эмулятор, сетевой экран и др. В частном варианте реализации указанные модули могут быть составной частью средства защиты 112. В еще одном варианте реализации данные модули могут быть реализованы в виде отдельных программных компонент.

Сканер по доступу содержит функционал определения вредоносной активности всех открываемых, запускаемых и сохраняемых файлов на компьютерной системе пользователя. Сканер по требованию отличается от сканера по доступу тем, что сканирует заданные пользователем файлы и директории по требованию пользователя.

Почтовый антивирус необходим для контроля входящей и исходящей электронной почты на предмет содержания вредоносных объектов. Веб-антивирус служит для предотвращения исполнения вредоносного кода, который может содержаться на веб-сайтах, посещаемых пользователем, а также для блокирования открытия веб-сайтов. Модуль HIPS служит для определения нежелательной и вредоносной активности программ и блокирования ее в момент исполнения. DLP-модуль служит для определения и предотвращения утечки конфиденциальных данных за пределы компьютера или сети. Сканер уязвимостей необходим для определения уязвимостей на устройстве (например, отключены некоторые компоненты средства защиты, не актуальные вирусные базы, закрыт сетевой порт и пр.). Сетевой экран осуществляет контроль и фильтрацию сетевого трафика в соответствии с заданными правилами. Работа эмулятора заключается в имитации гостевой системы во время исполнения инструкций файла в эмуляторе и будет подробно рассмотрена далее. Модуль проактивной защиты использует поведенческие сигнатуры для определения поведения исполняемых файлов и их классификации по уровню доверия. Стоит, отметить, что средство защиты 112 может включать и другие модули, для осуществления функционала, описанного на Фиг. 1, 3.

На Фиг. 3 представлен вариант способа защиты устройств пользователя.

На этапе 301 с помощью средства формирования 111 определяют значения признаков. Далее, на этапе 302 с помощью средства обнаружения аномалии 114 определяют аномалию, указывающую на угрозу информационной безопасности устройств 110 пользователя, путем применения обученной модели определения аномалии 115, принимающей на вход значения признаков. Далее, на этапе 303 с помощью средства обнаружения аномалии 114 определяют тип аномалии и устройство, являющееся источником аномалии, путем применения обученной модели классификации аномалии 132, принимающей на вход значения признаков. В итоге, на этапе 304 с помощью средства защиты 112 на определенном устройстве изменяют настройки информационной безопасности устройства согласно определенному типу аномалии.

Стоит также отметить, что для простоты изложения, в описании изобретения средства 111-114 упоминаются в единственном числе. Однако, как было упомянуто ранее, часть указанных средств 111-114 установлены на двух или более устройствах пользователя 110. При этом признаки определяются на всех устройствах 110, на которых содержатся данные, необходимые для формирования указанных признаков, и установлены средства формирования 111. Если на каком-либо устройстве пользователя 110 не установлено средство формирования 111, то данные с этого устройства тем не менее могут быть использованы для определения признаков. Это возможно, если упомянутое устройство связано с другим устройством, на котором в свою очередь установлено средство формирования 111. Например, на умных часах пользователя могут отсутствовать средства 111-114. Тем не менее, умные часы подключены по беспроводному соединению к смартфону пользователя, на котором установлены средства 111-114. Стоит отметить, что если в описанном примере аномалия будет обнаружена именно на умных часах пользователя, то изменение настроек информационной безопасности умных часов может заключаться в том, что средство защиты 112 на смартфоне пользователя перестанет принимать данные с умных часов, либо сбросит настройки умных часов в исходное состояние, либо обновит прошивку умных часов.

В предпочтительном варианте реализации обработка данных (этапы 302-303) осуществляется на одном из устройств 110 (также - головное устройство пользователя). А после определения аномалии, упомянутое головное устройство сообщает средству защиты 112 на устройстве, на котором обнаружена аномалия, о необходимости изменить настройки информационной безопасности на этом устройстве. В другом частном варианте реализации часть или все этапы 302-303, а также процесс обучения моделей, могут также осуществляться на удаленном сервере 130. Например, второе средство обучения 131 может осуществлять обучение модели классификации аномалии 132 на данных, полученных от устройств 110 множества различных пользователей. Таким образом, используя мощности удаленного сервера 130, качество модели классификации аномалии 132 может быть еще выше. Без ограничения общности можно считать удаленный сервер 130 одним из устройств пользователя 110, так как в рассматриваемом примере пользователь взаимодействует с удаленным сервером 130 путем передачи и приема данных.

В еще одном варианте реализации этапы 302-303, а также процесс обучения моделей, могут осуществляться на нескольких или на всех устройствах пользователя 110, на которых установлены соответствующие средства обучения 113 и средства обнаружения аномалии 114.

В одном примере все или часть этапов 302-303, а также процесс обучения моделей, выполняются на всех устройствах 110 одновременно. В этом случае на каждом из устройств 110 средство обнаружения аномалии 114 определит тип аномалии и устройство, на котором была определена аномалия (для определенности, устройство 110-1). Таким образом, если на устройстве 110-1, на котором определена аномалия, средство защиты 112 перестало корректно функционировать, то средства защиты 112 других устройств 110 изменят настройки информационной защиты других устройств 110. Например, путем изоляции скомпрометированного устройства, отключения его от сети и сервисов пользователя, изменения паролей к сервисам пользователя, принудительного обновления средства защиты 110-1.

В другом примере все или часть этапов 302-303, а также процесс обучения моделей, могут выполняться на части устройств пользователя 110. Например, на тех устройствах, которые находятся в состоянии простоя на момент выполнения этапов 302-303, а также процесса обучения моделей. Таким образом, это позволит снизить нагрузку на вычислительные ресурсы тех устройств 110, с которыми пользователь взаимодействует в момент выполнения этапов 302-303. Например, если у пользователя в распоряжении смартфон, домашний ПК, ноутбук, роутер, то в момент, когда пользователь находится на работе, вычисления, производимые на этапах 302-303, а также процесс обучения моделей, будут осуществляться на домашнем ПК.

В еще одном частном варианте реализации средство обучения 113 служит для обучения модели определения аномалии 115 во время простоя устройства, на котором установлено упомянутое средство обучения.

Ниже рассмотрены несколько примеров работы заявленной системы и способа, которые представлены на Фиг. 1, 3. В рассматриваемых примерах значения признаков активности пользователя, признаков планируемой активности пользователя определяют в каждый момент времени определенного промежутка времени. Например, каждый час в течение трех часов и т.д.

Пример 1.

В первом примере были определены значения следующих признаков активности пользователя за первый промежуток времени (с 00:00 до 20:00 текущего дня):

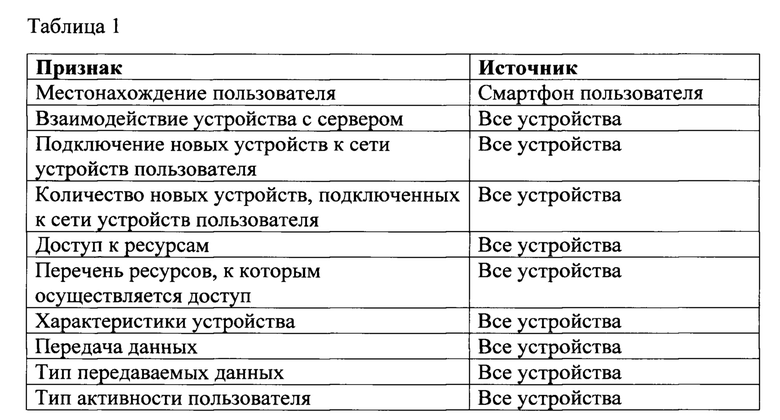

При этом, указанные признаки будут определены для всех устройств 110 (кроме признака «местонахождение пользователя»). Поэтому общее количество признаков активности будет зависеть от количества устройств пользователя 110. В таблице 1 не указаны значения признаков, так как они могут варьироваться в течение первого промежутка времени.

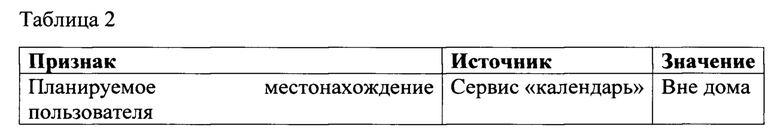

Предполагается, что были сформированы следующие признаки планируемой активности за второй промежуток времени (с 20:00 до 21:00 текущего дня) на основании данных от сервиса «календарь»:

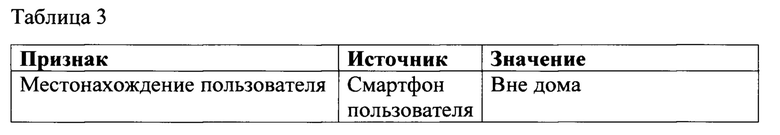

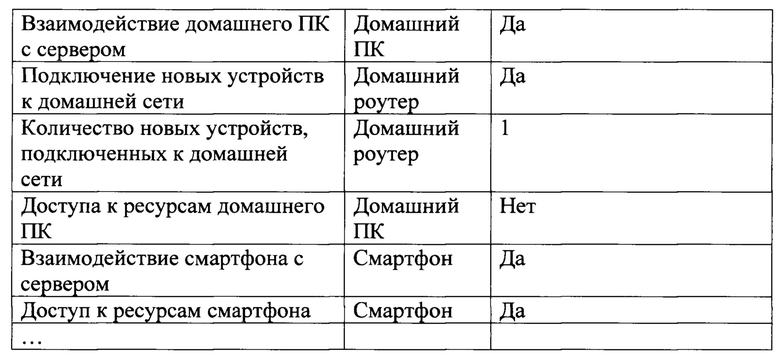

Кроме того, определены значения признаков активности за второй промежуток времени (20:00-21:00), которые представлены в таблице 3.

Из таблиц видно, что значения признаков активности пользователя за второй промежуток времени подтвердили нахождение пользователя вне дома и взаимодействие со смартфоном. Однако, также была зафиксирована активность среди устройств 110 домашней сети пользователя (домашний ПК, домашний роутер). Поэтому средство определения аномалий 112 путем применения обученной модели определения аномалии 115 определит аномалию.

Далее с использованием обученной модели классификации аномалии 132 средство обнаружения аномалии 114 определит устройства 110, на которых обнаружена аномалия - домашний ПК и домашний роутер, а также определит тип аномалии - несанкционированный доступ к одному или нескольким устройствам 110 пользователя. В итоге средством защиты 112 на каждом определенном устройстве 110 будут изменены настройки ИБ. Например, будет ограничен доступ к ресурсам ПК, заблокировано неизвестное подключенное устройство к роутеру, активирован второй фактор авторизации для доступа к ПК (по телефону).

Пример 2.

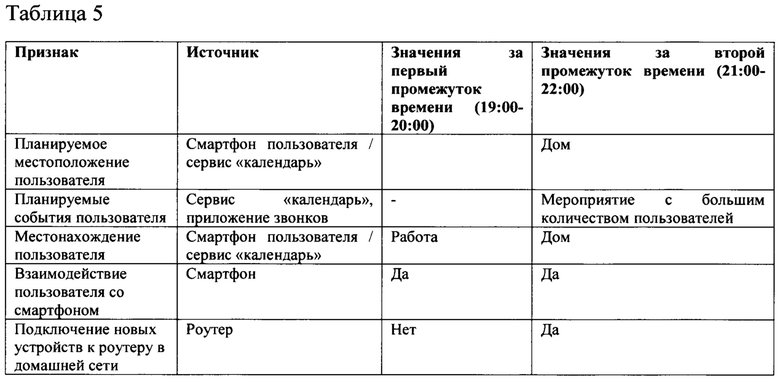

Во втором примере были определены признаки, представленные в таблице 4. Так, за первый промежуток времени (19:00-20:00) местоположением пользователя была его работа, где он взаимодействовал со смартфоном, но не взаимодействовал с другими устройствами 110 и рядом сервисов 120 (умные наушники, автомобиль, домашний ПК, ноутбук, сервис «почта»). За второй промежуток времени (20:00-21:00) местоположение пользователя было «управление автомобилем», значения других признаков приведены в таблице. Значения признаков планируемой активности определены за третий промежуток времени (21:00-22:00), в данном примере - признак «планируемое местоположение пользователя». По данным сервиса «календарь» было определено, что пользователь будет находиться дома во втором промежутке времени.

Из таблицы видно, что значение признака местоположение за второй промежуток времени согласуется со значением признака местоположение за первый промежуток времени и признаком «планируемое местоположение» за третий промежуток времени. В это же время признаки «взаимодействие пользователя с ноутбуком» и «использование сервиса «почта» выглядят аномальными, так как пользователь управляет автомобилем. Таким образом, средство защиты 112 определит аномалию, согласно обученной модели определения аномалии 115. Затем с помощью средства классификации аномалии 132 будет определено устройство (ноутбук), на котором обнаружена аномалия, а именно зафиксировано взаимодействие пользователя с ноутбуком и взаимодействие с сервисом «почта» посредством ноутбука (например, отправка письма). Также будет определен тип аномалии - несанкционированный доступ к ноутбуку, поэтому средство защиты 112 изменит настройки ИБ ноутбука, например, путем включения второго фактора авторизации и проведением антивирусной проверки с усиленными параметрами защиты.

Стоит отметить, что в рассматриваемых примерах для иллюстрации работы изобретения приведено небольшое количество признаков активности и за небольшой интервал времени. В действительности их количество может составлять тысячи или даже сотни тысяч. Во втором примере могут быть включены дополнительные признаки планируемой активности «переход ноутбука в спящий режим по расписанию» и «отложенная отправка письма». И, если значения этих дополнительных признаков указывают на переход ноутбука в спящий режим, а также отложенную отправку письма в течение второго промежутка времени, то средство обнаружения аномалии 114 не определит аномалии в том, что было зафиксировано взаимодействие с ноутбуком и отправлено письмо в то время, когда пользователь находился за рулем автомобиля, так как эти действия были ожидаемы. Стоит также отметить, что представленные в примерах значения признака местоположения «дом» / «работа» приведены для удобства понимания примера. В действительности же признак местоположения может принимать значения координат или значения из перечня местоположения: «местоположение 1», «местоположения 2» и т.д. Возможный перечень местоположений пользователя может быть получен путем кластеризации местоположений пользователя за определенный период времени с использованием методов кластеризации (таких как метод k-средних и др.). Кроме того, могут быть применены различные способы анонимизации признаков для защиты данных пользователя.

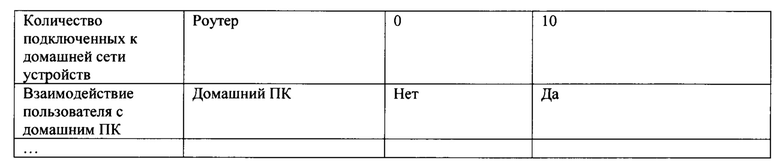

Пример 3.

В третьем примере в первый промежуток времени (19:00-20:00) пользователь находился на работе. При этом фиксировалось взаимодействие со смартфоном, но отсутствовало взаимодействие с домашними устройствами 110 пользователя (роутер, домашний ПК). Согласно данным от сервисов 120 «календарь» и «приложение звонков» было определено, что во второй промежуток времени (21:00-22:00) пользователь будет находиться дома, и, кроме того, ожидается мероприятие с большим количеством пользователей (например, гостей), что отражено в значениях признаков за второй промежуток времени (21:00-22:00). В соответствии с описанной логикой были сформированы признаки активности, указанные в таблице 5.

Стоит отметить, что традиционные антивирусные решения в подобной ситуации могли определить аномалию и заблокировать доступ к домашней сети для новых устройств 110. Однако, настоящее изобретение не определит аномалию. Модель машинного обучения, обученная на большом количестве признаков планируемой активности, в частности, указывающих, что во второй промежуток времени планируется мероприятие с большим количеством пользователей, определит, что подключение к роутеру 10 новых устройств 110 не является аномалией. Таким образом, данный пример показывает, что настоящее изобретение позволяет снизить количество ложных срабатываний.

В то же время, если в третьем примере дополнительные признаки активности «взаимодействие с «почтой», «взаимодействие с банковским сайтом», «передача неизвестных файлов по сети» принимают значение 1 (то есть подтверждают взаимодействие с почтой, банковским сайтом и передачу неизвестных файлов по сети), то средство обнаружения аномалии 114 определит аномалию, ведь указанные признаки свидетельствуют о скомпрометированном устройстве нового пользователя (гостя), подключенного к роутеру домашней сети. В результате чего на устройства 110 пользователя мог попасть неизвестный вредоносный файл с устройства гостя. В данном случае средство обнаружения аномалии 114 определит устройства 110, на которых была зафиксирована аномалия и изменит их настройки ИБ. Если доступ к почте и банковскому сайту был осуществлен с домашнего ПК, то средство защиты 112, установленное на домашнем ПК, отключит устройства гостя из списка доверенных, включит дополнительные факторы авторизации.

Стоит отметить, что описанные примеры могли быть не определены в качестве аномалии существующими в уровне техники антивирусными решениями. Например, используя уязвимость нулевого дня, вредоносное приложение могло проникнуть на ПК пользователя заранее. А в момент отсутствия пользователя упомянутое вредоносное приложение могло отправлять запросы на удаленный сервер, который не числится в базах вредоносных серверов. Поэтому именно использование признаков активности пользователя, а также признаков планируемой активности пользователя позволит обнаружить описанные аномалии, связанные с угрозой информационной безопасности. Кроме того, использование двух моделей машинного обучения для определения аномалии и классификации аномалии снизит ошибки первого и второго рода при обнаружении и классификации аномалии.

Стоит также отметить, что выбранные в примерах признаки активности пользователя, признаки планируемой активности и промежутки времени хорошо иллюстрируют аномалию, тип аномалии и устройство, являющееся источником аномалии. Однако в действительности такая связь может быть незаметна специалисту по ИБ. Ведь количество признаков может достигать сотни тысяч, принимающих разные значения в каждый момент времени. Именно поэтому в настоящем изобретении используются модели машинного обучения для определения аномалии, связанной с угрозой информационной безопасности устройств 110 пользователя, а затем - для определения типа определенной аномалии и устройства - источника этой аномалии.

Таким образом, из описания системы и способа защиты устройств пользователя, а также основываясь на приведенных выше примерах, следует, что заявленное изобретение решает указанную техническую проблему и позволяет достичь заявленных технических результатов. А именно, заявленное изобретение улучшает уровень защиты набора устройств пользователя и снижает ошибки первого и второго рода при обнаружении аномалии, связанной с угрозой информационной безопасности, на устройствах пользователя.

Фиг. 4 представляет пример компьютерной системы общего назначения, персональный компьютер или сервер 20, содержащий центральный процессор 21, системную память 22 и системную шину 23, которая содержит разные системные компоненты, в том числе память, связанную с центральным процессором 21. Системная шина 23 реализована, как любая известная из уровня техники шинная структура, содержащая в свою очередь память шины или контроллер памяти шины, периферийную шину и локальную шину, которая способна взаимодействовать с любой другой шинной архитектурой. Системная память содержит постоянное запоминающее устройство (ПЗУ) 24, память с произвольным доступом (ОЗУ) 25. Основная система ввода/вывода (BIOS) 26, содержит основные процедуры, которые обеспечивают передачу информации между элементами персонального компьютера 20, например, в момент загрузки операционной системы с использованием ПЗУ 24.

Персональный компьютер 20 в свою очередь содержит жесткий диск 27 для чтения и записи данных, привод магнитных дисков 28 для чтения и записи на сменные магнитные диски 29 и оптический привод 30 для чтения и записи на сменные оптические диски 31, такие как CD-ROM, DVD-ROM и иные оптические носители информации. Жесткий диск 27, привод магнитных дисков 28, оптический привод 30 соединены с системной шиной 23 через интерфейс жесткого диска 32, интерфейс магнитных дисков 33 и интерфейс оптического привода 34 соответственно. Приводы и соответствующие компьютерные носители информации представляют собой энергонезависимые средства хранения компьютерных инструкций, структур данных, программных модулей и прочих данных персонального компьютера 20.

Настоящее описание раскрывает реализацию системы, которая использует жесткий диск 27, сменный магнитный диск 29 и сменный оптический диск 31, но следует понимать, что возможно применение иных типов компьютерных носителей информации 56, которые способны хранить данные в доступной для чтения компьютером форме (твердотельные накопители, флеш карты памяти, цифровые диски, память с произвольным доступом (ОЗУ) и т.п.), которые подключены к системной шине 23 через контроллер 55.

Компьютер 20 имеет файловую систему 36, где хранится записанная операционная система 35, а также дополнительные программные приложения 37, другие программные модули 38 и данные программ 39. Пользователь имеет возможность вводить команды и информацию в персональный компьютер 20 посредством устройств ввода (клавиатуры 40, манипулятора «мышь» 42). Могут использоваться другие устройства ввода (не отображены): микрофон, джойстик, игровая консоль, сканер и т.п. Подобные устройства ввода по своему обычаю подключают к компьютерной системе 20 через последовательный порт 46, который в свою очередь подсоединен к системной шине, но могут быть подключены иным способом, например, при помощи параллельного порта, игрового порта или универсальной последовательной шины (USB). Монитор 47 или иной тип устройства отображения также подсоединен к системной шине 23 через интерфейс, такой как видеоадаптер 48. В дополнение к монитору 47, персональный компьютер может быть оснащен другими периферийными устройствами вывода (не отображены), например, колонками, принтером и т.п.

Персональный компьютер 20 способен работать в сетевом окружении, при этом используется сетевое соединение с другим или несколькими удаленными компьютерами 49. Удаленный компьютер (или компьютеры) 49 являются такими же персональными компьютерами или серверами, которые имеют большинство или все упомянутые элементы, отмеченные ранее при описании существа персонального компьютера 20, представленного на Фиг. 4. В вычислительной сети могут присутствовать также и другие устройства, например, маршрутизаторы, сетевые станции, пиринговые устройства или иные сетевые узлы.

Сетевые соединения могут образовывать локальную вычислительную сеть (LAN) 50 и глобальную вычислительную сеть (WAN). Такие сети применяются в корпоративных компьютерных сетях (также - информационных системах), внутренних сетях компаний и, как правило, имеют доступ к сети Интернет. В LAN- или WAN-сетях персональный компьютер 20 подключен к локальной сети 50 через сетевой адаптер или сетевой интерфейс 51. При использовании сетей персональный компьютер 20 может использовать модем 54 или иные средства обеспечения связи с глобальной вычислительной сетью, такой как Интернет. Модем 54, который является внутренним или внешним устройством, подключен к системной шине 23 посредством последовательного порта 46. Следует уточнить, что сетевые соединения являются лишь примерными и не обязаны отображать точную конфигурацию сети, т.е. в действительности существуют иные способы установления соединения техническими средствами связи одного компьютера с другим.

В соответствии с описанием, компоненты, этапы исполнения, структура данных, описанные выше, могут быть выполнены, используя различные типы операционных систем, компьютерных платформ, программ.

В заключение следует отметить, что приведенные в описании сведения являются примерами, которые не ограничивают объем настоящего изобретения, определенного формулой.

| название | год | авторы | номер документа |

|---|---|---|---|

| Система и способ защиты данных абонента при нежелательном звонке | 2021 |

|

RU2774054C1 |

| Компьютерное устройство для определения нежелательного звонка | 2021 |

|

RU2780046C1 |

| Способ корректировки параметров модели машинного обучения для определения ложных срабатываний и инцидентов информационной безопасности | 2020 |

|

RU2763115C1 |

| Способ обработки событий информационной безопасности перед передачей на анализ | 2020 |

|

RU2762528C1 |

| Система и способ определения источника аномалии в кибер-физической системе, обладающей определенными характеристиками | 2018 |

|

RU2724075C1 |

| Способ определения источников аномалии в кибер-физической системе | 2020 |

|

RU2749252C1 |

| Способ диагностики и мониторинга аномалий в кибер-физической системе | 2021 |

|

RU2784981C1 |

| Система и способ выбора модели описания пользователя | 2020 |

|

RU2764383C2 |

| Система и способ формирования данных для мониторинга кибер-физической системы с целью раннего определения аномалий в системе графического интерфейса пользователя | 2018 |

|

RU2724716C1 |

| Система и способ формирования индивидуального содержимого для пользователя сервиса | 2019 |

|

RU2745362C1 |

Изобретение относится к вычислительной технике. Технический результат заключается в улучшении уровня защиты набора устройств пользователя. Способ защиты устройств пользователя, в котором: определяют значения признаков активности пользователя с набора устройств пользователя из по меньшей мере двух устройств; определяют аномалию, указывающую на угрозу информационной безопасности устройств пользователя, путем применения обученной модели определения аномалии, принимающей на вход определенные значения признаков активности пользователя; определяют тип определенной аномалии и устройство, являющееся источником аномалии, путем применения обученной модели классификации аномалии, принимающей на вход значения признаков активности пользователя; изменяют настройки информационной безопасности устройства согласно определенному типу аномалии. 2 н. и 26 з.п. ф-лы, 5 табл., 4 ил.

1. Способ защиты устройств пользователя, в котором:

а) определяют значения признаков активности пользователя с набора устройств пользователя из по меньшей мере двух устройств;

б) определяют аномалию, указывающую на угрозу информационной безопасности устройств пользователя, путем применения обученной модели определения аномалии, принимающей на вход определенные значения признаков активности пользователя;

в) определяют тип определенной аномалии и устройство, являющееся источником аномалии, путем применения обученной модели классификации аномалии, принимающей на вход значения признаков активности пользователя, где модель классификации аномалий служит для классификации аномалии на классы, задаваемые значениями типа аномалии, и устройства, являющегося источником аномалии;

г) изменяют настройки информационной безопасности на определенном устройстве, являющемся источником аномалии, согласно определенному типу аномалии.

2. Способ по п. 1, в котором дополнительно выполняют обучение модели определения аномалии на данных обучающей выборки, включающей значения признаков активности пользователя за исторический период наблюдения.

3. Способ по п. 2, в котором выполняют тестирование и валидацию обученной модели определения аномалии на данных тестовой и валидационной выборок соответственно, включающих значения признаков активности пользователя за исторический период наблюдения, где для, по меньшей мере, заданной части значений признаков активности пользователя известна угроза информационной безопасности, связанная с аномалией, а также устройства, на которых возникла аномалия, при этом по результатам упомянутого тестирования и валидации выполняют дообучение модели определения аномалии.

4. Способ по п. 2, в котором обучают модель классификации аномалии на данных второй обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

5. Способ по п. 2, в котором получают от пользователя через устройство пользователя обратную связь, подтверждающую или опровергающую определенную аномалию, которую включают в обучающую выборку для дообучения модели определения аномалии.

6. Способ по п. 2, в котором выполняют обучение модели определения аномалии во время простоя устройства, на котором установлено средство обучения.

7. Способ по п. 1, в котором получают обученную модель классификации аномалии от удаленного сервера, где удаленный сервер служит для обучения модели классификации аномалии на данных третьей обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения для по меньшей мере двух устройств пользователей, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

8. Способ по п. 1, в котором с помощью средства защиты на другом устройстве пользователя, связанном с определенным устройством, изменяют настройки информационной безопасности на определенном устройстве.

9. Способ по п. 1, в котором изменяют настройки информационной безопасности в соответствии с заранее сформированными правилами изменения настроек информационной безопасности, при этом упомянутые правила определяют изменения настроек ИБ, соответствующие определенному типу аномалии.

10. Способ по п. 1, в котором изменяют настройки информационной безопасности путем применения обученной модели определения оптимальных изменений настроек информационной безопасности, принимающей на вход, в частности, тип аномалии.

11. Система защиты устройств пользователя, содержащая:

а) средство формирования, предназначенное для определения значений признаков активности пользователя с набора устройств пользователя из по меньшей мере двух устройств;

б) средство обнаружения аномалии, предназначенное для:

• определения аномалии, указывающей на угрозу информационной безопасности устройств пользователя, путем применения обученной модели определения аномалии, принимающей на вход определенные значения признаков активности пользователя;

• определения типа определенной аномалии и устройства, являющегося источником аномалии, путем применения обученной модели классификации аномалии, принимающей на вход определенные значения признаков активности пользователя, где модель классификации аномалий служит для классификации аномалии на классы, задаваемые значениями типа аномалии и устройства, являющегося источником аномалии;

в) средство защиты, предназначенное для изменения настроек информационной безопасности на определенном устройстве, являющемся источником аномалии, согласно определенному типу аномалии;

где упомянутые средство формирования, средство обнаружения аномалии и средство защиты установлены на по меньшей мере двух устройствах из набора устройств.

12. Система по п. 11, в которой активности пользователя включают, по меньшей мере, изменение местоположения пользователя, взаимодействие пользователя с устройствами пользователя и сервисами пользователя, доступ к которым осуществляется посредством устройств пользователя.

13. Система по п. 11, в которой признаки активности пользователя дополнительно включают признаки планируемой активности пользователя из по меньшей мере одного сервиса пользователя, при этом доступ к упомянутым сервисам пользователя осуществляется посредством по меньшей мере одного устройства пользователя.

14. Система по п. 13, в которой сервисы пользователя, к которым пользователь предоставил доступ, включают, в частности:

а) календарь;

б) антивирусное приложение;

в) приложение звонков;

г) электронную почту;

д) веб-браузер.

15. Система по п. 12, дополнительно включающая средство обучения, установленное на по меньшей мере одном из устройств пользователя, при этом средство обучения служит для обучения модели определения аномалии на данных обучающей выборки, включающей значения признаков активности пользователя за исторический период наблюдения.

16. Система по п. 15, в которой средство обучения дополнительно предназначено для выполнения тестирования и валидации обученной модели определения аномалии на данных тестовой и валидационной выборок соответственно, включающих значения признаков активности пользователя за исторический период наблюдения, где для, по меньшей мере, заданной части значений признаков активности пользователя известна угроза информационной безопасности, связанная с аномалией, а также устройства, на которых возникла аномалия, при этом по результатам упомянутого тестирования и валидации выполняют дообучение модели определения аномалии.

17. Система по п. 15, в которой средство обучения дополнительно служит для обучения модели классификации аномалии на данных второй обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

18. Система по п. 15, в которой средство обучения дополнительно служит для получения от пользователя через устройство пользователя обратной связи, подтверждающей или опровергающей определенную аномалию, которую включают в обучающую выборку для дообучения модели определения аномалии.

19. Система по п. 15, в которой средство обучения служит для обучения модели определения аномалии во время простоя устройства, на котором установлено упомянутое средство обучения.

20. Система по п. 11, в которой средство обнаружения аномалии получает обученную модель классификации аномалии от удаленного сервера, где удаленный сервер служит для обучения модели классификации аномалии на данных третьей обучающей выборки, включающей группы значений признаков активности пользователя за второй исторический период наблюдения для по меньшей мере двух устройств пользователей, где упомянутая выборка для каждой группы значений признаков активности пользователя включает значения типа аномалии и устройства, являющегося источником аномалии.

21. Система по п. 11, в которой изменение настроек информационной безопасности устройства включает, в частности:

а) осуществление антивирусной проверки актуальными базами;

б) изменение параметров сети;

в) ограничение функциональности устройства;

г) ограничение взаимодействия устройства с другими устройствами;

д) ограничение доступа к ресурсам устройства;

е) включение многофакторной аутентификации;

ж) обновление средства защиты на устройстве, на котором определена аномалия;

з) получение обратной связи по результатам описанных выше способов.

22. Система по п. 11, в которой дополнительно изменяют настройки информационной безопасности других устройств пользователя, связанных с определенным устройством.

23. Система по п. 11, в которой признаки активности пользователя включают:

а) взаимодействие устройства с сервером;

б) подключение новых устройств к сети устройств пользователя;

в) количество новых устройств, подключенных к сети устройств пользователя;

г) доступ к ресурсам устройства;

д) перечень ресурсов, к которым осуществляется доступ;

е) характеристики устройства;

ж) передачу данных;

з) тип передаваемых данных;

и) события антивируса;

к) тип активности пользователя.

24. Система по п. 23, в которой тип активности пользователя является одним из следующих:

а) наличие определенного местоположения;

б) управление транспортным средством;

в) взаимодействие с по меньшей мере одним из устройств пользователя;

г) взаимодействие с новыми устройствами.

25. Система по п. 11, в которой средство защиты на другом устройстве пользователя, связанном с определенным устройством, производит изменения настроек информационной безопасности на определенном устройстве.

26. Система по п. 11, в которой тип аномалии является, в частности, одним из следующих:

а) вредоносное ПО;

б) утечка данных;

в) неавторизированный вход;

а) несанкционированный доступ к по меньшей мере устройству, сервису, данным;

б) компрометация устройства;

в) подключение к командному центру бот-сети;

г) шифрование данных пользователя.

27. Система по п. 11, в которой средство защиты предназначено для изменения настроек информационной безопасности в соответствии с заранее сформированными правилами изменения настроек информационной безопасности, при этом упомянутые правила определяют изменения настроек ИБ, соответствующие определенному типу аномалии.

28. Система по п. 11, в которой средство защиты предназначено для изменения настроек информационной безопасности путем применения обученной модели определения оптимальных изменений настроек информационной безопасности, принимающей на вход, в частности, тип аномалии.

| Изложница с суживающимся книзу сечением и с вертикально перемещающимся днищем | 1924 |

|

SU2012A1 |

| Станок для придания концам круглых радиаторных трубок шестигранного сечения | 1924 |

|

SU2019A1 |

| Станок для придания концам круглых радиаторных трубок шестигранного сечения | 1924 |

|

SU2019A1 |

| Способ получения цианистых соединений | 1924 |

|

SU2018A1 |

| US 10728263 B1, 28.07.2020 | |||

| Станок для придания концам круглых радиаторных трубок шестигранного сечения | 1924 |

|

SU2019A1 |

| Система и способ выявления подозрительной активности пользователя при взаимодействии пользователя с различными банковскими сервисами | 2016 |

|

RU2635275C1 |

Авторы

Даты

2022-04-14—Публикация

2020-08-24—Подача