Область техники

Изобретение относится к области промышленной безопасности, а более конкретно к способам диагностики и мониторинга аномалий в кибер-физической системе.

Уровень техники

Одной из актуальных проблем промышленной безопасности является проблема безопасного функционирования технологических процессов (ТП). К основным угрозам для ТП можно отнести износ и отказ оборудования и агрегатов, непреднамеренные ошибки или злонамеренные действия в операционном управлении, компьютерные атаки на системы управления и информационную систему (ИС) и другие.

Для противодействия упомянутым угрозам традиционно используются системы безопасности кибер-физических систем (КФС), к которым можно отнести системы противоаварийной защиты (ПАЗ), системы обнаружения аномалий на базе автоматизированной системы управления технологическим процессом (АСУ ТП) и специально выстроенные «внешние» системы мониторинга того или иного оборудования и агрегатов, при этом такие «внешние» системы как правило не интегрированы с АСУ ТП. Следует отметить, что вышеуказанные «внешние» системы в силу тех или иных особенностей КФС и ТП, протекающих в них, могут быть развернуты далеко не всегда. Однако даже в случае, если такая установка возможна, ее развертывание проводится лишь на критически важных узлах и агрегатах предприятия по причине дороговизны и сложности в обслуживании таких систем.

В отличие от «внешних» систем, система ПАЗ, напротив, выстраивается при проектировании предприятия, затем интегрируется с системой АСУ ТП и служит для предотвращения развития заранее известных аварийных процессов. Очевидным достоинством системы ПАЗ является ее простота, ориентированность на производственные процессы конкретного предприятия и учет всех конструкционных и технологических решений, используемых на этом предприятии. К недостаткам системы ПАЗ можно отнести достаточную инертность принятия решений в системе и присутствие человеческого фактора в принятии таких решений. Кроме того, ПАЗ функционирует в предположении корректного функционировании контрольно-измерительных приборов (КИП). Обеспечить выполнение безотказного функционирования КИП в полном объеме на практике не представляется возможным, поскольку КИП периодически выходят из строя, имеют тенденцию к временным сбоям, а дублирование всех КИП крайне затратно и не всегда технически возможно.

Системы обнаружения аномалий на базе телеметрии АСУ ТП в силу полноты таких данных располагают возможностями одновременно «видеть» все ТП предприятия, причем в их взаимодействии друг с другом, что позволяет даже при наличии отказов КИП уверенно детектировать аномалии. Богатство данных, представленных в АСУ ТП, позволяет проводить мониторинг всего предприятия — как физических (химических или других) процессов предприятия, так и корректности работы всех систем контроля этих процессов, включая корректность действий операторов производства. Применение в таких системах методов машинного обучения позволяет строить высокоэффективные статистические модели корректной работы предприятия с огромным числом анализируемых параметров, что позволяет находить даже незначительные отклонения в работе оборудования, причем уже на ранней стадии развития аномалии (см. патенты RU2724716, RU2724075, RU2749252). Специальная архитектура и интерфейс таких систем позволяет им работать параллельно с системой АСУ ТП, не затрачивая ее ресурсы, находить аномалии (англ. fault detection — обнаружение неисправности), отображать и локализовывать (англ. fault isolation — локализация отказов) найденные аномалии, а также информировать операторов производства о найденных аномалиях с указанием тех или иных технологических параметров, по которым данная аномалия была определена.

Однако существующие системы определения и локализации аномалий по данным телеметрии АСУ ТП не рассматривают третий традиционный вопрос мониторинга аномалий, а именно самый технически сложный вопрос диагностики аномалий (англ. fault diagnosis), состоящий в классификации аномалий по их типам (классам), фильтрации несущественных аномалий, определении тех или иных характеристик аномалии, прогноза развития аномалии и так далее. Не вызывает сомнений, что именно этот тип анализа аномалий наиболее востребован производством в силу возможности мониторинга аномалий, то есть оценки опасности тех или иных аномалий, ретроспективного анализа их развития, предиктивной оценки характеристик аномалий, а также возможности выработки операторами предприятия наиболее экономически выгодной стратегии по их устранению. Также не вызывает сомнений, что такой тип анализа ранее найденных аномалий в подавляющем числе случаев возможен, поскольку данные телеметрии АСУ ТП содержат исчерпывающий объем информации о функционировании того или иного предприятия, о протекании всех его физических, химических и других процессах, а также всю информацию о процессах управления. Однако такая информация содержит только исходные, необработанные и неразмеченные данные и требует проведения этапов диагностики и мониторинга аномалий, приведенных выше.

Таким образом, вполне естественно возникает техническая проблема создания автоматизированных систем диагностики и мониторинга ранее найденных аномалий в КФС по данным телеметрии. Указанная проблема актуальна для всех КФС, содержащих КИП, исполнительные механизмы, системы контроля или что-либо одно из перечисленного. В частности, такими данными могут быть данные диагностики того или иного объекта мониторинга (например, данные неразрушающего контроля магистральных нефтепроводов), данные интернета вещей или данные промышленного интернета вещей.

Из уровня техники известен патент US10680919B2, в котором описаны система и способ обнаружения аномалий в сети путем применения моделей машинного обучения на данных телеметрии сети. Информацию об аномалиях передают группе пользователей, каждый из которых предоставляет обратную связь об аномалии системе обнаружения аномалий. Обратная связь может содержать инструкции по настройке сети для устранения аномалий. Однако указанные пользователи иногда могут предоставлять некорректную или заведомо ложную обратную связь, например, неверные инструкции по настройке сети, которые не позволят устранить аномалию. Поэтому заявленная в упомянутом патенте система также выполняет кластеризацию указанных пользователей по уровню доверия к обратной связи от них, чтобы использовать обратную связь только от доверенных пользователей. Однако данная технология не решает заявленную техническую проблему, так как не позволяет провести диагностику и мониторинг найденных аномалий. Поэтому возникает необходимость в заявленном изобретении, а именно в способе диагностики и мониторинга аномалий в кибер-физической системе.

Раскрытие сущности изобретения

Технический результат заключается в обеспечении автоматизации диагностики и мониторинга аномалий в КФС. Технический результат достигается за счет классификации аномалий, диагностики аномалий каждого класса аномалий и последующего мониторинга аномалий каждого класса

Согласно варианту реализации используется способ диагностики и мониторинга аномалий в кибер-физической системе (КФС), реализованный на аппаратном процессоре компьютерной системы, содержащий инструкции, согласно которым: получают информацию о выявленных аномалиях в КФС, при этом упомянутая информация включает перечень параметров КФС, включающих технологические параметры КФС, и их значений; формируют классифицирующие признаки для выявленных аномалий на основании собранной информации; выполняют классификацию выявленных аномалий по меньшей мере на два класса на основании сформированных классифицирующих признаков; осуществляют диагностику аномалий каждого класса путем расчета значений характеристик каждого класса аномалий; осуществляют мониторинг аномалий каждого класса по данным значений характеристик каждого класса.

Согласно одному из частных вариантов реализации получают информацию о выявленных аномалиях в КФС от средств определения аномалий, при этом выявляют аномалии в КФС по меньшей мере одним из способов: в случае превышения общей ошибкой прогноза порогового значения, при этом предварительно выполняют прогнозирование значений параметров КФС и последующее определение общей ошибки прогноза для параметров КФС; путем применения обученной базовой модели машинного обучения по значениям параметров КФС; при выполнении правила определения аномалий; в случае выхода значения по меньшей мере одного параметра КФС за пределы предварительно заданного диапазона значений для указанного параметра КФС; путем использования ансамбля из двух или более перечисленных выше способов.

Согласно другому частному варианту реализации информация об аномалиях в КФС дополнительно включает следующие сведения об аномалии: временной интервал наблюдения аномалии, вклад каждого параметра КФС в аномалию, информацию о способе выявления указанной аномалии, значения параметров КФС в каждый момент временного интервала.

Согласно еще одному частному варианту реализации информация об аномалиях в КФС дополнительно включает для каждого параметра КФС по меньшей мере один из параметров: временной ряд значений; текущую величину отклонения спрогнозированного значения от фактического значения; сглаженную величину отклонения спрогнозированного значения от фактического значения.

Согласно одному из частных вариантов реализации значения параметров КФС включают по меньшей мере одно из значений: измерение датчика; значение управляемого параметра исполнительного механизма; уставку исполнительного механизма; значения входных сигналов пропорционально-интегрально-дифференцирующего регулятора (ПИД-регулятора); значение выходного сигнала ПИД-регулятора.

Согласно другому частному варианту реализации формируют классифицирующие признаки путем присвоения им значений параметров КФС в исходном виде, или в преобразованном виде, или как результата применения функции от указанных параметров КФС.

Согласно одному из частных вариантов реализации формируют классифицирующие признаки на основании обратной связи от оператора КФС.

Согласно другому частному варианту реализации классификацию аномалий осуществляют с использованием обученной модели классификации или с использованием обученной модели кластеризации, при этом входными данными для упомянутых моделей служат классифицирующие признаки, а результатом классификации аномалий является присвоение класса каждой из выявленных аномалий.

Согласно одному из частных вариантов реализации значения характеристик класса аномалий включают по меньшей мере одну из: уровень критичности аномалии, частоту появления аномалии, периодичность появления аномалии.

Согласно другому частному варианту реализации рассчитывают значения характеристик класса аномалий с учетом параметров КФС, в частности рассчитывают значение по меньшей мере одной из следующих характеристик: статистические характеристики параметров КФС, спектральные характеристики параметров КФС.

Согласно еще одному частному варианту реализации мониторинг аномалий каждого класса включает выполнение с заданной периодичностью по меньшей мере одного из следующих видов анализа по данным значений характеристик каждого класса аномалий: ретроспективного анализа, включающего расчет значений дополнительных характеристик каждого класса аномалий по данным значений характеристик каждого класса аномалий за предварительно заданный предшествующий промежуток времени; предиктивного анализа, включающего прогноз значений характеристик каждого класса аномалий; потокового анализа значений характеристик каждого класса аномалий.

Согласно одному из частных вариантов реализации мониторинг аномалий каждого класса дополнительно включает сравнение результатов, полученных при выполнении упомянутых видов анализа, с правилами критичности и, при выполнении по меньшей мере одного правила, формируют перечень действий по обработке аномалий в соответствии с выполненным правилом.

Краткое описание чертежей

Дополнительные цели, признаки и преимущества настоящего изобретения будут очевидными из прочтения последующего описания осуществления изобретения со ссылкой на прилагаемые чертежи, на которых:

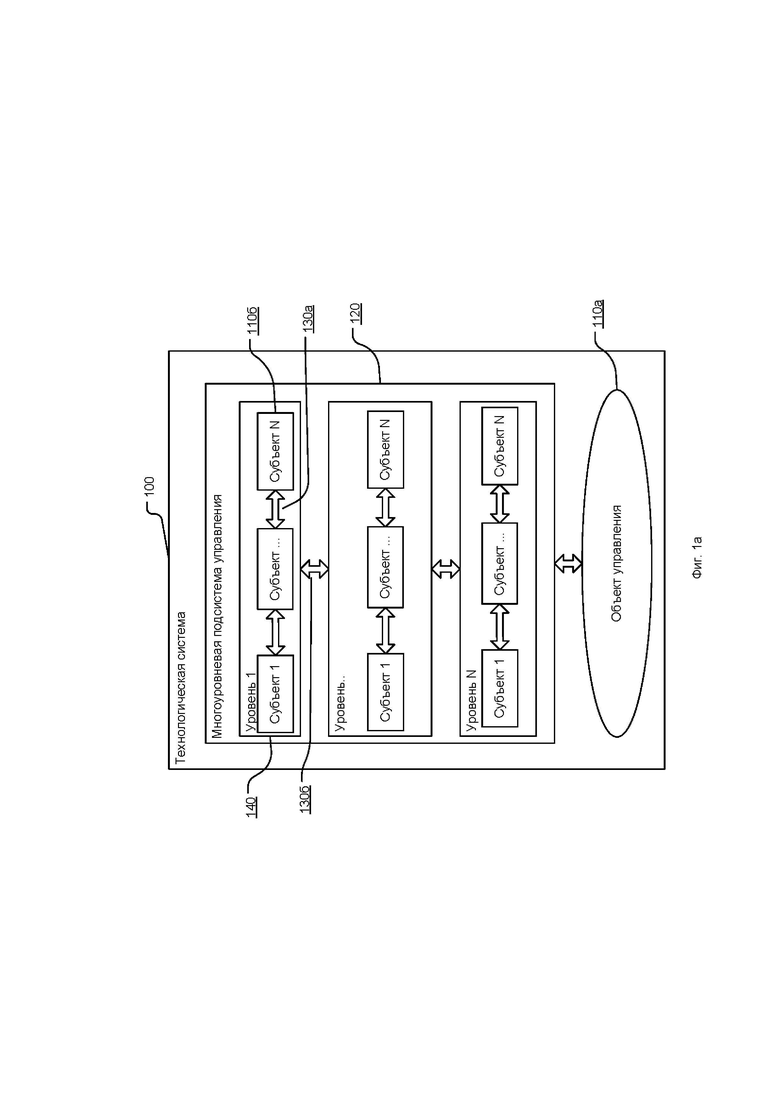

На Фиг. 1а схематично изображен пример технологической системы.

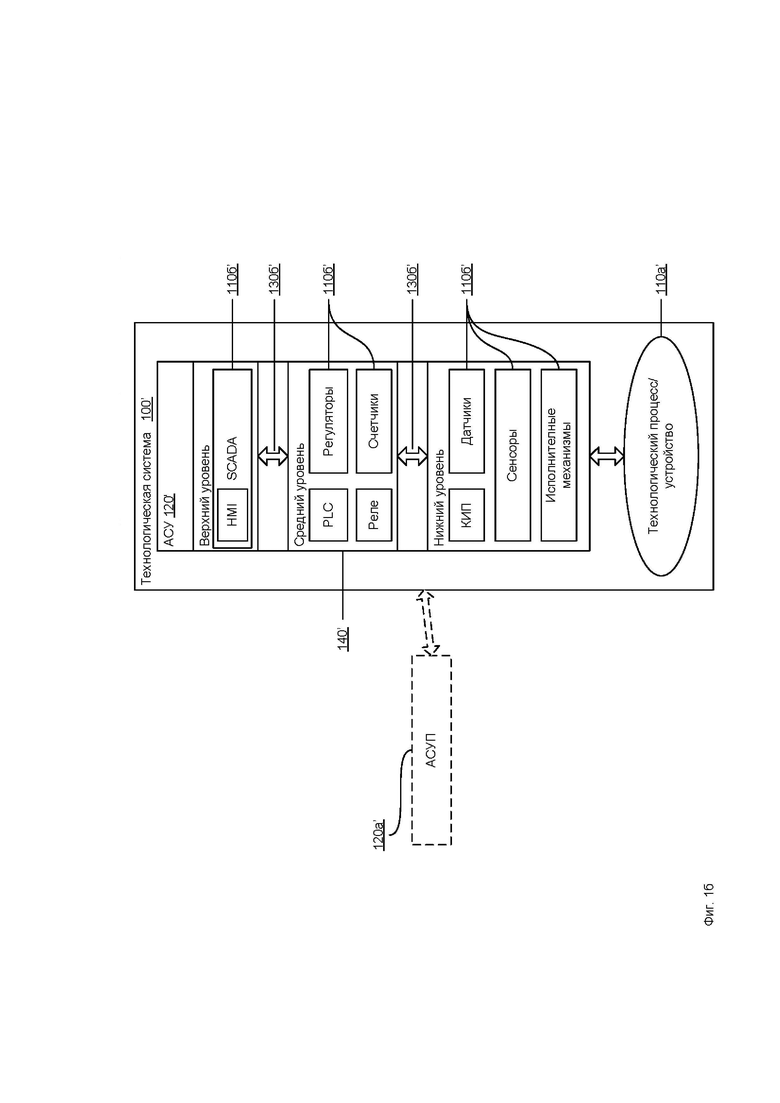

На Фиг. 1б схематично изображен частный пример имплементации технологической системы.

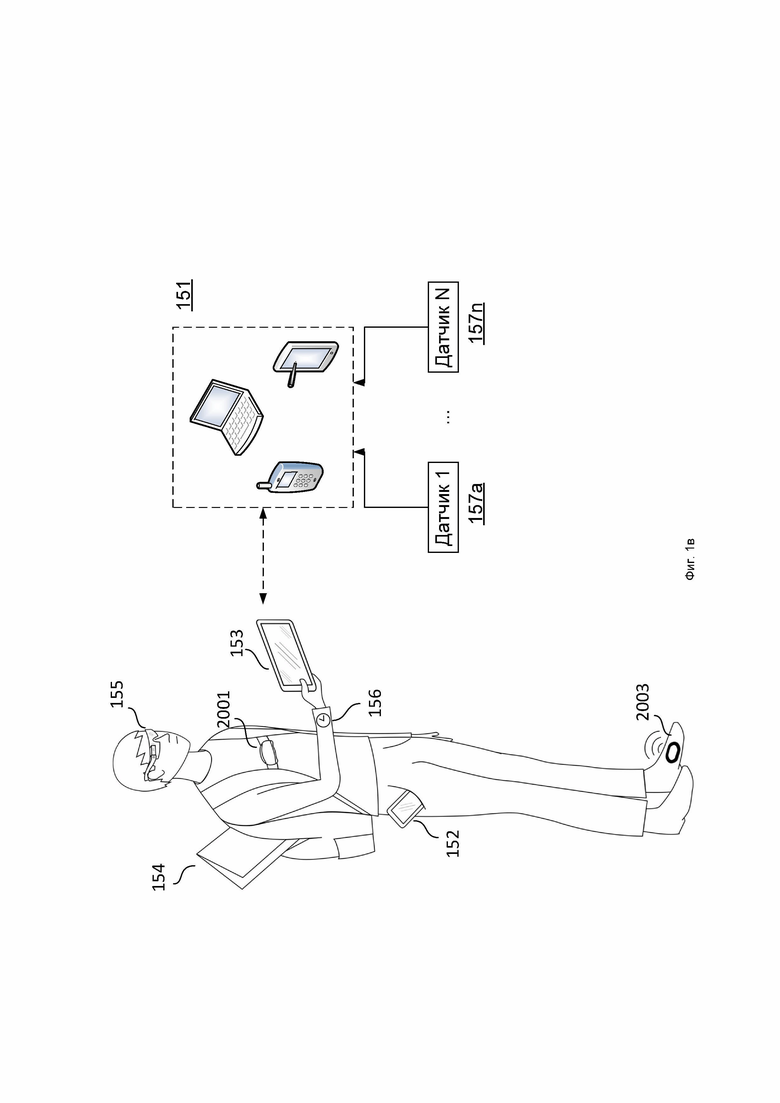

На Фиг. 1в представлен возможный вариант организации интернета вещей на примере носимых устройств.

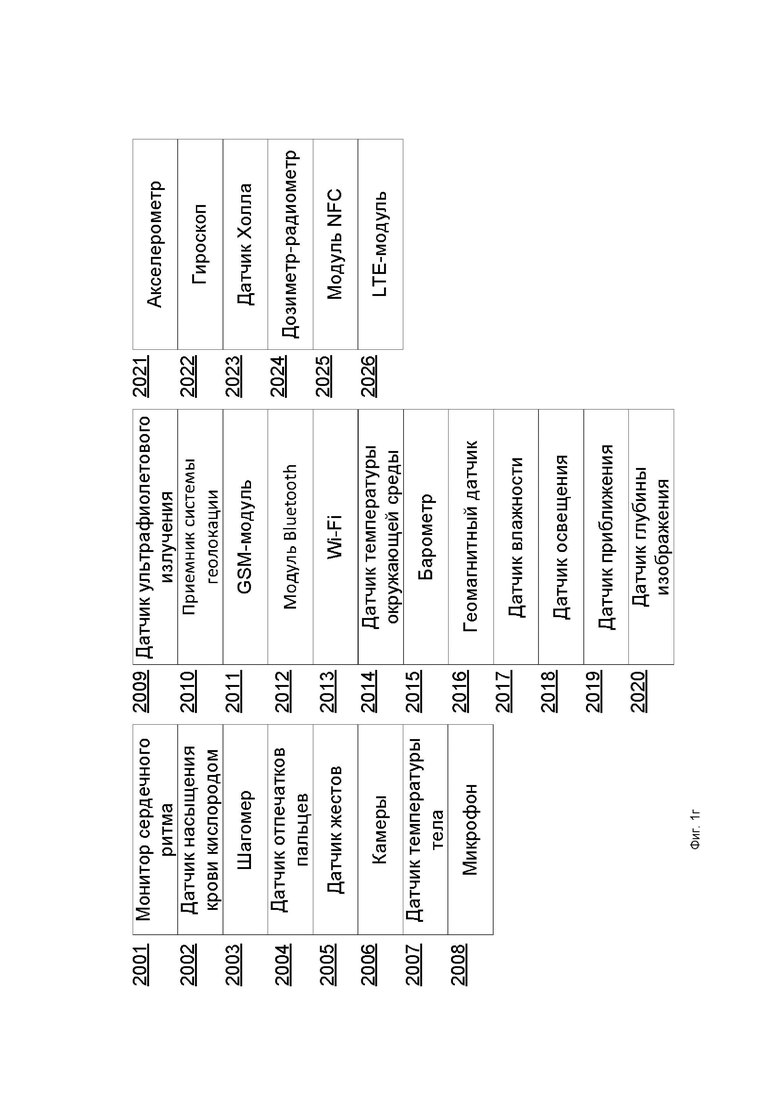

На Фиг. 1г представлен возможный набор датчиков устройств.

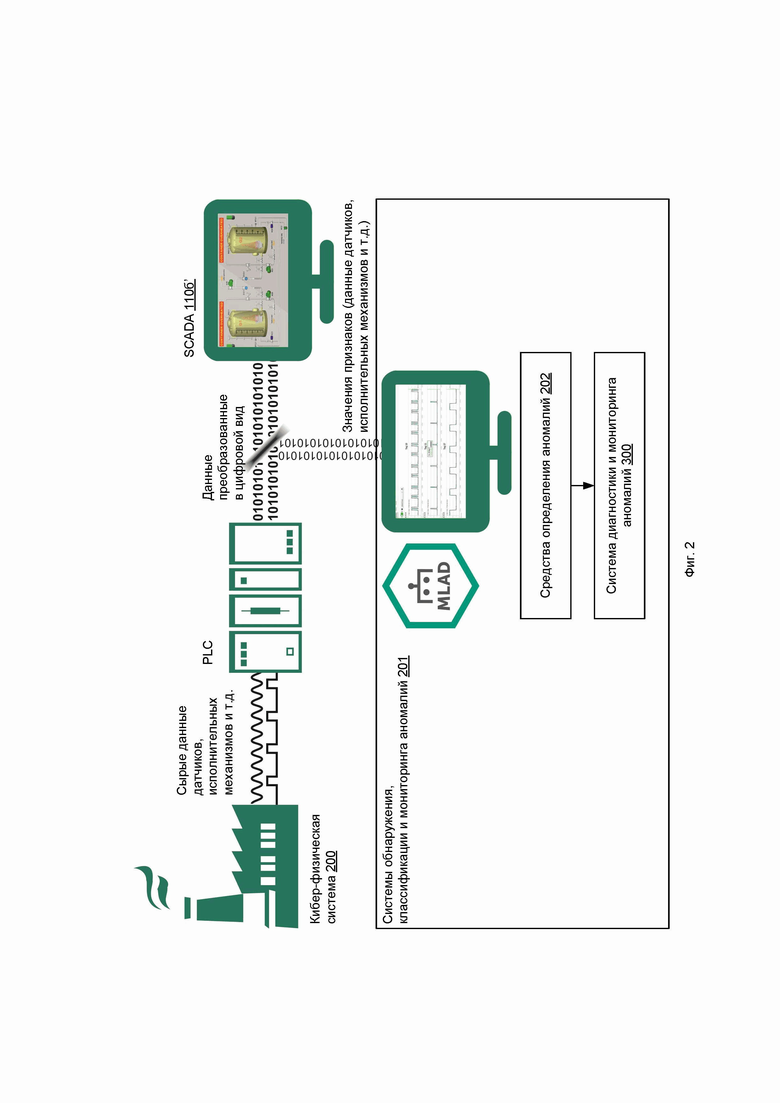

На Фиг. 2 представлен пример кибер-физической системы (КФС), обладающей определенными характеристиками, а также систем обнаружения, классификации и мониторинга аномалий.

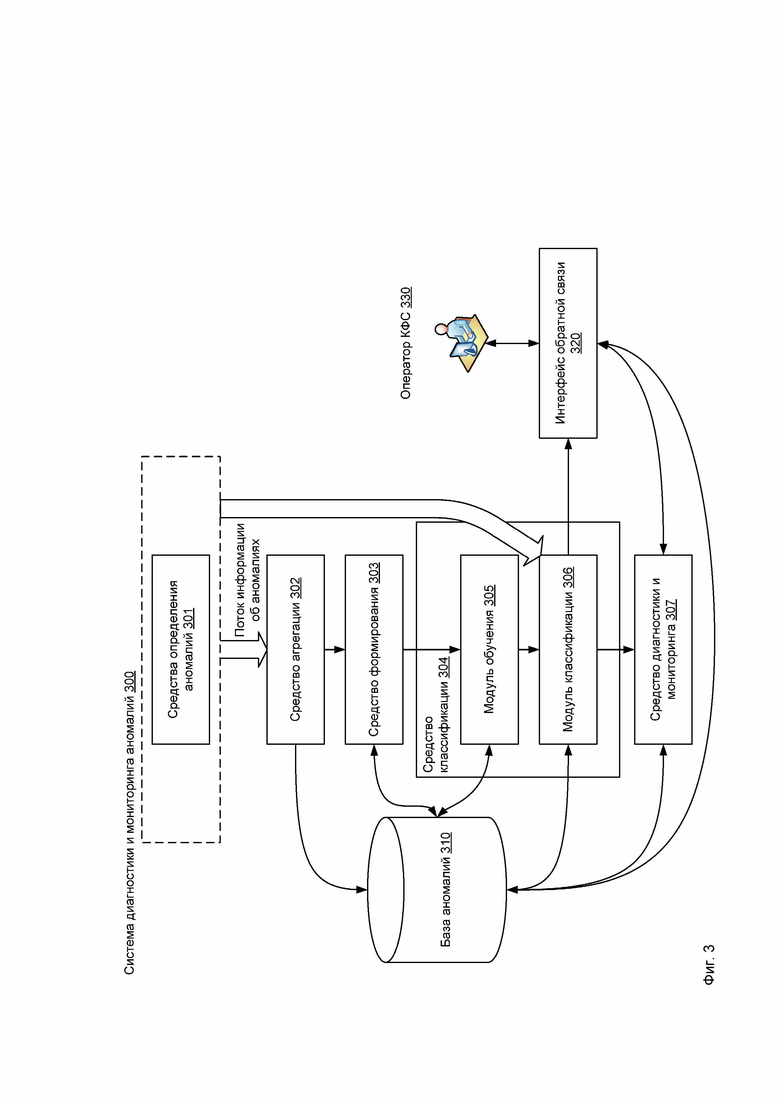

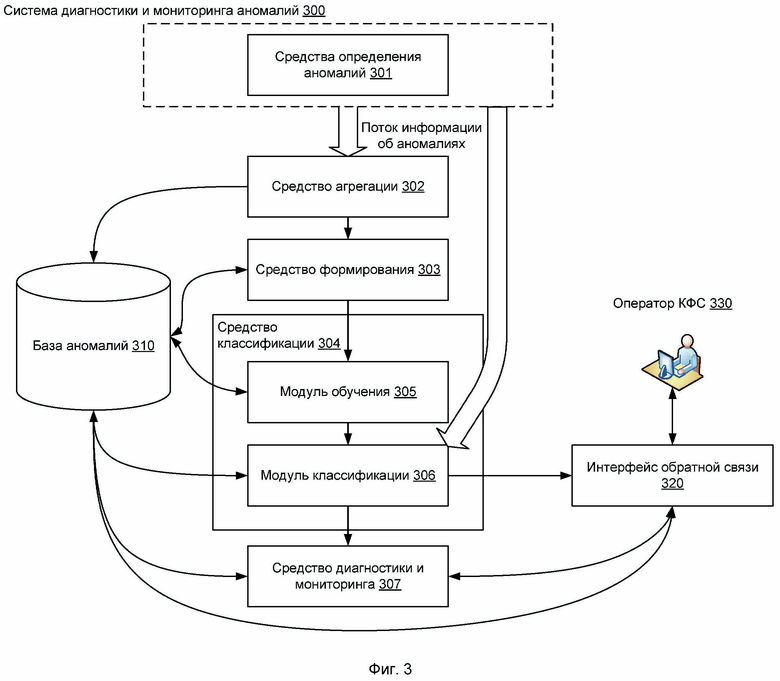

На Фиг. 3 представлена система диагностики и мониторинга аномалий в КФС.

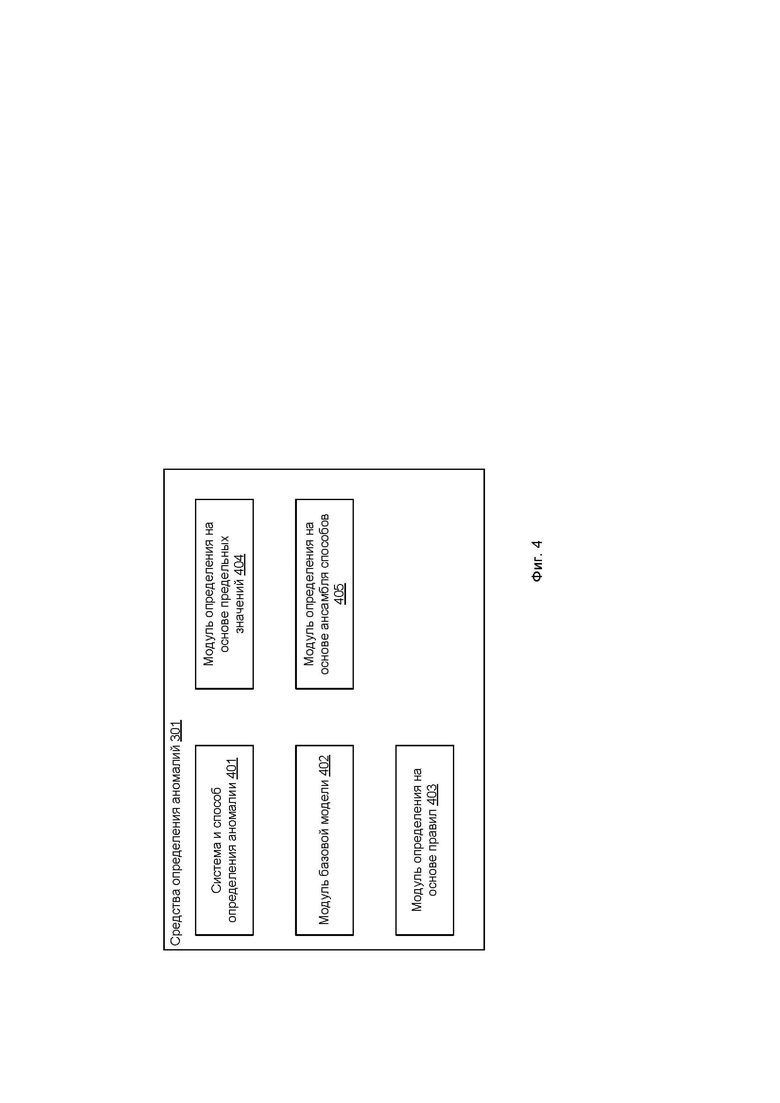

На Фиг. 4 представлены примеры средств определения аномалий.

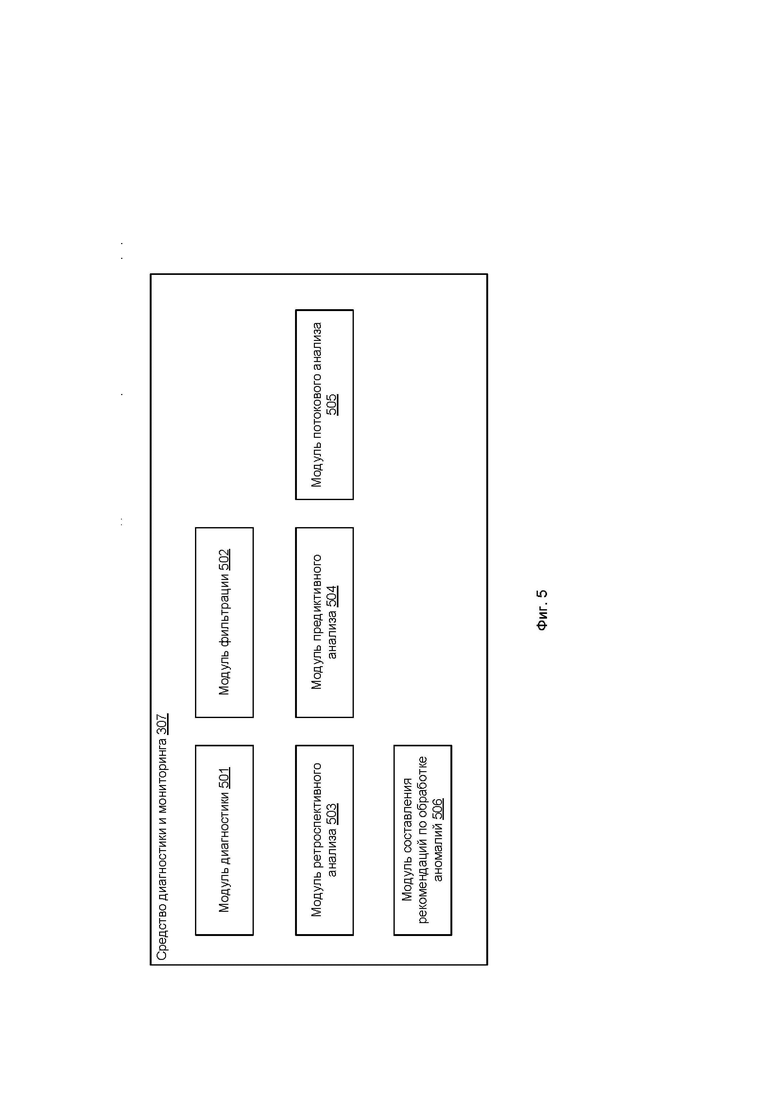

На Фиг. 5 представлен вариант исполнения средства диагностики и мониторинга аномалий.

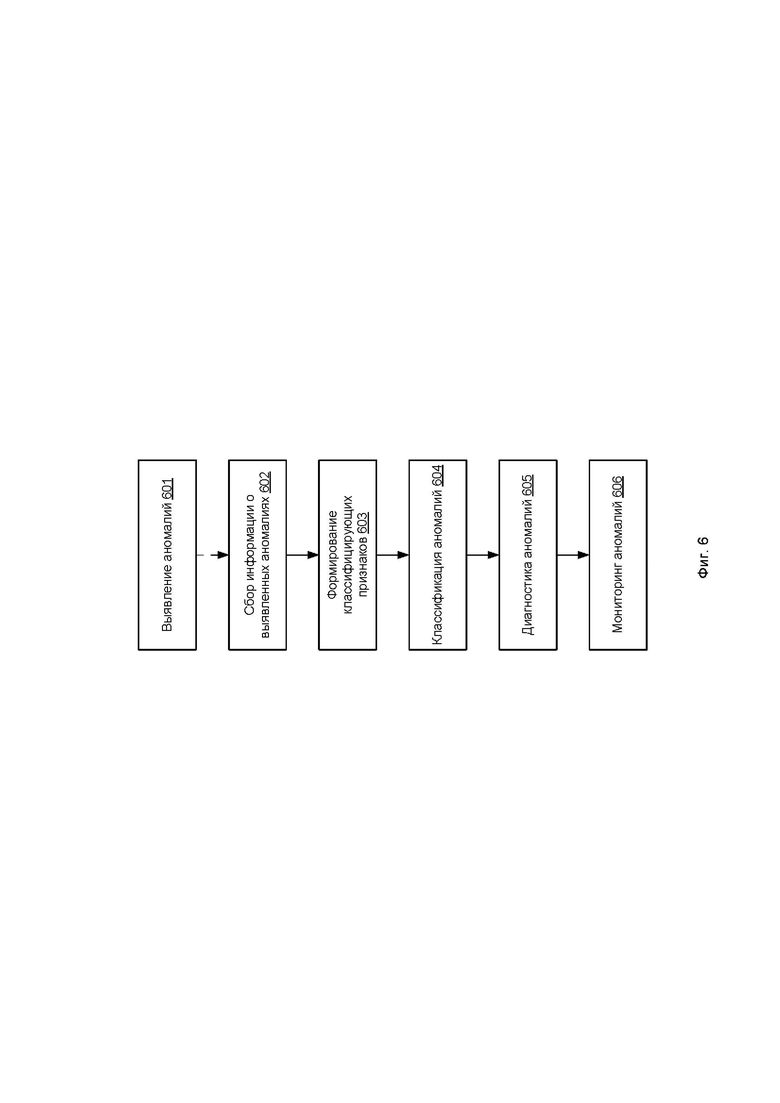

На Фиг. 6 представлен вариант способа диагностики и мониторинга аномалий в КФС.

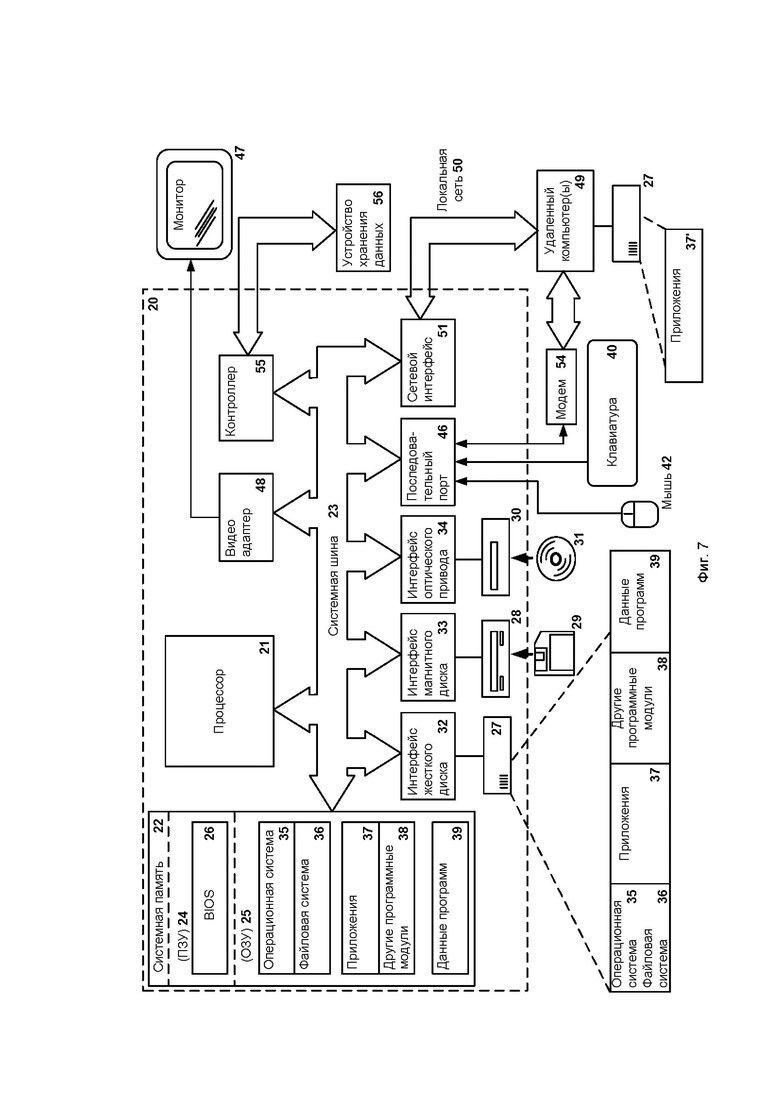

Фиг. 7 представляет пример компьютерной системы общего назначения, с помощью которой может быть реализовано настоящее изобретение.

Осуществление изобретения

Объекты и признаки настоящего изобретения, способы для достижения этих объектов и признаков станут очевидными посредством отсылки к примерным вариантам осуществления. Однако настоящее изобретение не ограничивается примерными вариантами осуществления, раскрытыми ниже, оно может воплощаться в различных видах. Приведенное описание предназначено для помощи специалисту в области техники для исчерпывающего понимания изобретения, которое определяется только в объеме приложенной формулы.

Глоссарий

Объект управления — технологический объект, на который направляются внешние воздействия (управляющие и/или возмущающие) с целью изменения его состояния, в частном случае такими объектами являются устройство (например, электродвигатель) или технологический процесс (или его часть).

Технологический процесс (ТП) — процесс материального производства, заключающийся в последовательной смене состояний материальной сущности (предмета труда).

Контур управления (англ. control loop) — состоит из материальных сущностей и управляющих функций, необходимых для автоматизированной регулировки значений измеренных технологических параметров к значениям желаемых уставок. Контур управления содержит датчики и сенсоры, контроллеры и исполнительные механизмы.

Технологический параметр (англ. Process Variable, PV) — текущее измеренное значение определенной части ТП, который наблюдается или контролируется. Технологическим параметром может быть, например, измерение датчика.

Уставка (англ. Setpoint) — поддерживаемое значение технологического параметра.

Управляемый параметр (англ. Manipulated Variable, MV) — параметр, который регулируется для того, чтобы значение технологического параметра поддерживалось на уровне уставки.

Внешнее воздействие — способ изменения состояния элемента, на которое направлено воздействие (например, элемента технологической системы (ТС)) в определенном направлении, воздействие от элемента ТС к другому элементу ТС передается в виде сигнала.

Состояние объекта управления — совокупность его существенных свойств, выраженных параметрами состояний, изменяемых или удерживаемых под влиянием внешних воздействий, в том числе и управляющих воздействий со стороны подсистемы управления. Параметр состояния — одно или несколько числовых значений, характеризующих существенное свойство объекта, в частном случае параметр состояния является числовым значением физической величины.

Формальное состояние объекта управления — состояние объекта управления, соответствующее технологической карте и другой технологической документации (если речь идет о ТП) или расписанию движения (если речь идет об устройстве).

Управляющее воздействие — целенаправленное (цель воздействия — воздействие на состояние объекта) легитимное (предусмотренное ТП) внешнее воздействие со стороны субъектов управления подсистемы управления на объект управления, приводящее к изменению состояния объекта управления или удержанию состояния объекта управления.

Субъект управления — устройство, которое направляет управляющее воздействие на объект управления или передает управляющее воздействие другому субъекту управления для преобразования перед непосредственным направлением на объект.

Состояние субъекта управления — совокупность его существенных свойств, выраженных параметрами состояний, изменяемых или удерживаемых под влиянием внешних воздействий. Параметр состояния — одно или несколько числовых значений, характеризующих существенное свойство субъекта, в частном случае параметр состояния является числовым значением физической величины.

Существенными свойствами (соответственно и существенными параметрами состояния) субъекта управления являются свойства, оказывающие непосредственное влияние на состояние объекта управления. При этом существенными свойствами объекта управления являются свойства, оказывающие непосредственное влияние на контролируемые факторы (точность, безопасность, эффективность) функционирования ТС. Например, соответствие режимов резания формально заданным режимам, движение поезда в соответствии с расписанием, удержание температуры реактора в допустимых границах. В зависимости от контролируемых факторов выбираются параметры состояния объекта управления и соответственно связанные с ними параметры состояний субъектов управления, оказывающие управляющее воздействие на объект управления.

Многоуровневая подсистема управления — включающая несколько уровней совокупность субъектов управления.

Кибер-физическая система (англ. cyber-physical system) — информационно-технологическая концепция, подразумевающая интеграцию вычислительных ресурсов в физические процессы. В такой системе датчики, оборудование и информационные системы соединены на протяжении всей цепочки создания стоимости, выходящей за рамки одного предприятия или бизнеса. Эти системы взаимодействуют друг с другом с помощью стандартных интернет-протоколов для прогнозирования, самонастройки и адаптации к изменениям. Примерами кибер-физической системы является технологическая система, интернет вещей (в т.ч. носимые устройства), промышленный интернет вещей.

Интернет вещей (англ. Internet of Things, IoT) — вычислительная сеть физических предметов («вещей»), оснащённых встроенными сетевыми технологиями для взаимодействия друг с другом или с внешней средой. Интернет вещей включает такие технологии, как носимые устройства, электронные системы транспортных средств, умные автомобили, умные города, промышленные системы и пр.

Промышленный Интернет вещей (англ. Industrial Internet of Things, IIoT) — состоит из подключенного к Интернету оборудования и платформ расширенной аналитики, которые выполняют обработку данных, получаемых от подключенных устройств. Устройства IIoT могут быть самыми разными — от небольших датчиков погоды до сложных промышленных роботов. Несмотря на то, что слово «промышленный» вызывает такие ассоциации, как склады, судоверфи и производственные цеха, технологии IIoT имеют большой потенциал использования в самых различных отраслях, включая сельское хозяйство, здравоохранение, финансовые услуги, розничную торговлю и рекламу. Промышленный Интернет вещей является подкатегорией Интернета вещей https://www.hpe.com/ru/ru/what-is/industrial-iot.html.

Технологическая система (ТС) — функционально взаимосвязанная совокупность субъектов управления многоуровневой подсистемы управления и объекта управления (ТП или устройство), реализующая через изменение состояний субъектов управления изменение состояния объекта управления. Структуру технологической системы образуют основные элементы технологической системы (взаимосвязанные субъекты управления многоуровневой подсистемы управления и объект управления), а также связи между этими элементами. В том случае, когда объектом управления в технологической системе является технологический процесс, конечной целью управления является изменение состояния предмета труда (сырья, заготовки и т.д.) через изменение состояния объекта управления. В том случае, когда объектом управления в технологической системе является устройство, конечной целью управления является изменение состояния устройства (транспортное средство, космический объект и т.д.). Функциональная взаимосвязь элементов ТС подразумевает взаимосвязь состояний этих элементов. При этом непосредственной физической связи между элементами может и не быть, в частности физическая связь между исполнительными механизмами и технологической операцией отсутствует. К примеру, скорость резания функционально связана с частотой вращения шпинделя несмотря на то, что физически эти параметры состояний не связаны.

Компьютерная атака (также кибератака, от англ. cyber attack) — целенаправленное воздействие на информационные системы и информационно-телекоммуникационные сети программно-техническими средствами, осуществляемое в целях нарушения безопасности информации в этих системах и сетях (см. «Основные направления государственной политики в области обеспечения безопасности автоматизированных систем управления производственными и технологическими процессами критически важных объектов инфраструктуры Российской Федерации» (утв. Президентом РФ 03.02.2012 N 803).

На Фиг. 1а схематично изображен пример технологической системы 100, которая включает в себя элементы 110а и 110б, где элементы ТС: объект управления 110а; субъекты управления 110б, образующие многоуровневую подсистему управления 120; горизонтальные связи 130а и вертикальные связи 130б. Субъекты управления 110б сгруппированы по уровням 140.

На Фиг. 1б схематично изображен частный пример имплементации технологической системы 100’. Объектом управления 110а’ является ТП или устройство, на объект управления 110а’ направляются управляющие воздействия, которые вырабатываются и реализуются автоматизированной системой управления (АСУ) 120’, в АСУ различают три уровня 140’, состоящих из субъектов управления 110б’, взаимосвязанных между собой как по горизонтали горизонтальными связями (связи внутри уровня, на фигуре не указаны), так и по вертикали вертикальными связями 130б’ (связи между уровнями). Взаимосвязи являются функциональными, т.е. в общем случае изменение состояния субъекта управления 110б’ на одном уровне вызывает изменение состояний связанных с ним субъектов управления 110б’ на этом уровне и других уровнях. Информация об изменении состояния субъекта управления 110б’ передается в виде сигнала по горизонтальным и вертикальным связям, установленным между субъектами управления 110б’, т.е. информация об изменении состояния рассматриваемого субъекта управления 110б’ является внешним воздействием по отношению к другим субъектам управления 110б’. Уровни 140’ в АСУ 120’ выделяют в соответствии с назначением субъектов управления 110б’. Количество уровней может варьироваться в зависимости от сложности АСУ 120’. Простые системы могут содержать в себе один или несколько нижних уровней. Для физической связи элементов ТС (110а, 110б) и подсистем ТС 100 используются проводные сети, беспроводные сети, интегральные микросхемы, для логической связи между элементами ТС (110а, 110б) и подсистемами ТС 100 используются Ethernet, промышленный Ethernet, промышленные сети. При этом промышленные сети и протоколы используются различных типов и стандартов: Profibus, FIP, ControlNet, Interbus-S, DeviceNet, P-NET, WorldFIP, LongWork, Modbus и др.

Верхний уровень (уровень supervisory control and data acquisition, SCADA) — это уровень диспетчерско-операторского управления, включает в себя, по меньшей мере, следующие субъекты управления 110б’: контроллеры, управляющие компьютеры, человеко-машинные интерфейсы (англ. human-machine interface, HMI) (на Фиг. 1б изображены в рамках одного субъекта управления SCADA). Уровень предназначен для отслеживания состояний элементов ТС (110а’, 110б’), получения и накопления информации о состоянии элементов ТС (110а’, 110б’) и при необходимости их корректировки.

Средний уровень (уровень CONTROL) — это уровень контроллеров, включает, по меньшей мере, следующие субъекты управления 110б’: программируемые логические контроллеры (англ. programmable Logic Controller, PLC), счетчики, реле, регуляторы. Субъекты управления 110б’ типа «PLC» получают информацию с субъектов управления 110б’ типа «контрольно-измерительное оборудование» и субъектов управления 110б’ типа «датчики» о состоянии объекта управления 110а’. Субъекты управления 110б’ типа «PLC» вырабатывают (создают) управляющее воздействие в соответствии с запрограммированным алгоритмом управления на субъекты управления 110б’ типа «исполнительные механизмы». Исполнительные механизмы непосредственно реализуют указанное управляющее воздействие (применяют к объекту управления) на нижнем уровне. Исполнительный механизм (англ. actuator) — часть исполнительного устройства (оборудования). Регуляторы, например, ПИД-регуляторы (Пропорционально-интегрально-дифференцирующий регулятор, англ. proportional–integral–derivative controller — PID controller) являются устройствами в контуре управления с обратной связью.

Нижний уровень (уровень Input/Output) — это уровень таких субъектов управления 110б’, как датчики и сенсоры (англ. sensors), контрольно-измерительные приборы (КИП), контролирующие состояние объекта управления 110а’, а также исполнительные механизмы (actuators). Исполнительные механизмы непосредственно воздействуют на состояние объекта управления 110а’ для приведения его в соответствие с формальным состоянием, т.е. состоянием, соответствующим технологическому заданию, технологической карте или другой технологической документации (если речь идет о ТП) или расписанию движения (если речь идет об устройстве). На этом уровне осуществляется согласование сигналов от субъектов управления 110б’ типа «датчики» с входами субъектов управления 110б’ среднего уровня, и согласование вырабатываемых субъектами управления 110б’ типа «PLC» управляющих воздействий с субъектами управления 110б’ типа «исполнительные механизмы», которые их реализуют. Исполнительный механизм — это часть исполнительного устройства. Исполнительное устройство осуществляет перемещение регулирующего органа в соответствии с сигналами, поступающими от регулятора или управляющего устройства. Исполнительные устройства являются последним звеном цепи автоматического управления и в общем случае состоят из блоков:

• устройства усиления (контактор, частотный преобразователь, усилитель, и т.п.);

• исполнительного механизма (электро-, пневмо-, гидропривод) с элементами обратной связи (датчики положения выходного вала, сигнализации конечных положений, ручного привода и т. п.);

• регулирующего органа (вентили, клапаны, заслонки, шиберы и т.п.).

В зависимости от условий применения исполнительные устройства конструктивно могут различаться между собой. К основным блокам исполнительных устройств обычно относят исполнительные механизмы и регулирующие органы.

В частном примере исполнительное устройство в целом называют исполнительным механизмом.

Стоит отметить, что для решения задач планирования и управления предприятием используется АСУП 120а’ (автоматическая система управления предприятием), которая является частью АСУ 120’.

На Фиг. 1в представлен возможный вариант организации интернета вещей на примере носимых устройств. Система содержит множество различных компьютерных устройств 151 пользователя. Среди устройств пользователя 151 могут быть, например, смартфон 152, планшет 153, ноутбук 154, носимые устройства, такие, как очки дополненной реальности 155, «умные» часы 156 (англ. smart watch) и др. Устройства пользователя 151 содержат множество различных датчиков 157а-157n, например, монитор сердечного ритма 2001 и шагомер 2003.

Стоит отметить, что датчики 157а-157n могут находиться как на одном устройстве пользователя 151, так и на нескольких. Более того, некоторые датчики 157а-157n могут находиться на нескольких устройствах пользователя 151 одновременно. Часть датчиков 157а-157n может быть представлена в нескольких экземплярах. Например, модуль Bluetooth может находиться на всех устройствах пользователя 151, а смартфон 152 может содержать два и более микрофона, необходимых для шумоподавления и определения расстояния до источника звука.

На Фиг. 1г представлен возможный набор датчиков устройств 151. Среди датчиков 157а-157n могут быть, например, следующие:

• монитор сердечного ритма (датчик сердцебиения) 2001 для определения частоты пульса пользователя. В одном примере реализации монитор сердечного ритма 2001 может содержать электроды и измерять электрокардиограмму;

• датчик насыщения крови кислородом 2002;

• шагомер 2003;

• датчик определения отпечатков пальцев 2004;

• датчик жестов 2005, служащий для распознавания жестов пользователя;

• камеры 2006, например камера, направленная на глаза пользователя, служащая для определения движения глаз пользователя, а также аутентификации личности пользователя по радужной оболочке или сетчатке глаза, а также камера, направленная на окружающую устройство пользователя среду;

• датчик температуры тела 2007 пользователя (например, имеющий непосредственный контакт с телом пользователя или бесконтактный);

• микрофон 2008;

• датчик ультрафиолетового излучения 2009;

• приемник системы геолокации 2010, например, приемник GPS, ГЛОНАСС, BeiDou, Galileo, DORIS, IRNSS, QZSS и др.;

• GSM-модуль 2011;

• модуль Bluetooth 2012;

• модуль Wi-Fi 2013;

• датчик температуры окружающей среды 2014;

• барометр 2015, необходимый для измерения атмосферного давления и определения высоты над уровнем моря в соответствии с атмосферным давлением;

• геомагнитный датчик 2016 (электронный компас), необходимый для определения сторон света и азимута;

• датчик влажности 2017;

• датчик освещения 2018, необходимый для определения цветовой температуры и освещенности;

• датчик приближения 2019, служащий для определения расстояния до различных предметов, находящихся поблизости;

• датчик глубины изображения 2020, служащий для получения трехмерного изображения пространства;

• акселерометр 2021, служащий для измерения ускорения в пространстве;

• гироскоп 2022, необходимый для определения положения в пространстве;

• датчик Холла 2023 (датчик магнитного поля) для определения напряженности магнитного поля;

• дозиметр-радиометр 2024 для определения уровня радиации;

• модуль NFC 2025;

• LTE-модуль 2026.

На Фиг. 2 представлен пример кибер-физической системы (КФС) 200, обладающей определенными характеристиками, а также системы обнаружения, классификации и мониторинга аномалий 201. КФС 200 представлена в упрощенном варианте. Примерами КФС 200 являются описанные ранее технологическая система (ТС) 100 (см. Фиг. 1а-1б), интернет вещей (см. Фиг. 1в-1г), промышленный интернет вещей. Для определенности далее в заявке в качестве основного примера КФС 200 будет рассматриваться ТС. Как уже упоминалось ранее при описании Фиг. 1а-1б, КФС 200 содержит множество субъектов управления, таких как датчики, исполнительные механизмы, ПИД-регуляторы. Данные упомянутых субъектов управления в необработанном виде передаются на PLC. При этом может использоваться аналоговый сигнал. Затем PLC выполняет обработку данных и преобразование данных в цифровой вид — в значения параметров КФС, включающих технологические параметры КФС (то есть в данные телеметрии КФС 200). Значения параметров КФС затем передают системе SCADA 110б' и рассматриваемой системе 201.

Параметры КФС являются численными характеристиками субъектов управления — датчиков, исполнительных механизмов, ПИД-регуляторов. А значения параметров КФС включают соответственно по меньшей мере одно из значений: измерение (показание) датчика; значение управляемого параметра исполнительного механизма; уставку исполнительного механизма; значения входных сигналов пропорционально-интегрально-дифференцирующего регулятора (ПИД-регулятора); значение выходного сигнала ПИД-регулятора и другие технологические параметры КФС.

В частном варианте реализации значения параметров КФС могут быть представлены в виде следующего набора значений: [идентификатор (наименование параметра), время, значение]. Например, параметром КФС является датчик температуры, и значение параметра КФС может быть представлено в следующем виде: [датчик температуры, 01.01.2022 10:00:00, 99 °C].

Значения параметров КФС используются средствами определения аномалий 202, которые предназначены для определения аномалий в КФС 200. Аномалия в КФС 200 — событие, характеризующее отклонение от нормы значения одного или нескольких параметров КФС. Аномалия в КФС 200 может возникнуть, например, из-за компьютерной атаки, из-за некорректного или нелегитимного вмешательства в работу ТС или ТП человека, из-за сбоя или отклонения технологического процесса, в том числе связанного с периодами смены его режимов, из-за перевода контуров управления в ручной режим или из-за некорректных показаний датчиков, а также по другим причинам, известным из уровня техники. Информацию об определенных аномалиях в КФС 200 затем передают в систему диагностики и мониторинга аномалий 300.

На Фиг. 3 представлена система диагностики и мониторинга аномалий 300 в КФС 200. Система 300 является компьютерной системой, например, компьютером общего назначения, представленным на Фиг. 7. Система 300 обладает аппаратным процессором 21 и памятью 22. Система 300 содержит функциональные и/или аппаратные модули и средства, которые в свою очередь содержат инструкции для исполнения на аппаратном процессоре 21. Ниже описаны варианты реализации упомянутых модулей и средств системы 300.

Система 300 содержит средство агрегации 302, предназначенное для сбора информации об аномалиях в КФС 200, выявленных средствами определения аномалий 301. Примеры средств определения аномалий 301, в частности средств 401-405, представлены на Фиг. 4, описание вариантов их реализации представлено ниже.

Описание средств определения аномалий 301

В качестве средств определения аномалии 301 могут быть использованы система и способ определения аномалии в КФС 401, описанные ранее в патентах RU2724716, RU2724075, RU2749252, которые осуществляют определение аномалии путем прогнозирования значений параметров КФС (в упомянутых патентах использовался термин «признаки КФС», соответствующий термину «параметры КФС» в заявленном изобретении) и последующего определения общей ошибки прогноза для параметров КФС, при этом определяют аномалию в КФС 200 в случае превышения общей ошибкой прогноза порогового значения, кроме того определяют вклад параметров КФС в общую ошибку прогноза как вклад ошибки прогноза соответствующего параметра КФС в общую ошибку прогноза.

Средства определения аномалий 301 могут включать модуль применения обученной базовой модели машинного обучения для выявления аномалий по значениям параметров КФС (далее — модуль базовой модели) 402. При этом базовая модель выявления аномалий может быть обучена на данных обучающей выборки, включающей или не включающей известные аномалии в КФС 200 и значения параметров КФС за определенный период времени. Для повышения качества базовой модели могут выполнять тестирование и валидацию обученной базовой модели на тестовой и валидационной выборках соответственно. При этом тестовая и валидационная выборки могут включать известные аномалии и значения параметров КФС за определенный период времени, предшествующий известной аномалии в КФС 200, но отличаются от обучающей выборки.

В еще одном варианте реализации средства определения аномалий 301 включают модуль определения на основе правил 403, с использованием которого применяют правила определения аномалий. Такие правила могут быть предварительно сформированы и получены от оператора КФС 330 посредством интерфейса обратной связи 320 и содержат условия, применяемые к значениям параметров КФС, при выполнении которых определяют аномалию.

В еще одном частном варианте реализации средства определения аномалий 301 включают модуль определения на основе предельных значений 404, с использованием которого определяют аномалию, когда значение по меньшей мере одного параметра КФС вышло за пределы предварительно заданного диапазона значений для указанного параметра КФС. При этом указанные диапазоны значений могут быть рассчитаны из значений характеристик или документации для КФС 200 или получены от оператора КФС 330 посредством интерфейса обратной связи 320.

В другом частном варианте реализации средства определения аномалии 301 включают модуль определения на основе ансамбля способов 405, при использовании которого используют ансамбль из двух или более перечисленных выше способов, реализуемых модулями и средствами 401-404, при этом определяют аномалию в КФС 200 путем усреднения результатов работы способов упомянутого ансамбля 405 (например, применяют операцию конъюнкции к результатам работы различных способов).

В еще одном частном варианте реализации средства определения аномалии 301 включают систему графического интерфейса для определения аномалии вручную оператором КФС 330 (см. патент RU2724716), информация о которой может быть передана через интерфейс обратной связи 320.

В частном варианте реализации информация об аномалиях в КФС 200 дополнительно включает следующие сведения об аномалии: временной интервал наблюдения аномалии, вклад каждого параметра КФС в аномалию, информацию о способе выявления указанной аномалии, значения параметров КФС в каждый момент временного интервала. В еще одном частном варианте реализации информация об аномалиях в КФС 200 дополнительно включает для каждого параметра КФС по меньшей мере один из: временной ряд значений, текущую величину отклонения спрогнозированного значения от фактического значения, сглаженную величину отклонения спрогнозированного значения от фактического значения. В другом частном случае информация об аномалиях включает информацию о средстве (способе), с использованием которого была выявлена аномалия.

Описание базы аномалий 310

Информация о выявленных аномалиях может включать перечень параметров КФС, их значения за определенный промежуток времени и дополнительную информацию, описанную выше. Средство агрегации 302 может сохранять такую информацию по каждой аномалии в базу аномалий 310. При этом база аномалий 310 содержится в памяти 22, Память 22 содержит постоянное запоминающее устройство (ПЗУ) 24 и память с произвольным доступом (ОЗУ) 25. Соответственно база аномалий 310 может содержаться как в ПЗУ 24, так и в ОЗУ 25. К базе аномалий 310 может иметь доступ также оператор КФС 330 посредством интерфейса обратной связи 320, обладая таким образом полной и актуальной информацией об аномалиях в КФС 200.

В качестве базы аномалий 310 могут быть использованы различные виды баз данных, а именно: иерархические (IMS, TDMS, System 2000), сетевые (Cerebrum, Сronospro, DBVist), реляционные (DB2, Informix, Microsoft SQL Server), объектно-ориентированные (Jasmine, Versant, POET), объектно-реляционные (Oracle Database, PostgreSQL, FirstSQL/J), функциональные, базы данных временных рядов (InfluxDB) и т.д. Кроме того, база аномалий 310 может быть реализована в виде списка или массива данных об аномалиях, хранящегося в файле в памяти 22.

Описание классифицирующих признаков

Система 300 также содержит средство формирования 303, связанное со средством агрегации 302 и предназначенное для формирования классифицирующих признаков для выявленных аномалий на основании собранной информации, при этом классифицирующие признаки сохраняют в базу аномалий 310.

В частном варианте реализации средство формирования 303 формирует классифицирующие признаки путем присвоения им значений параметров КФС в исходном виде, или в преобразованном виде, или как результат применения функции от указанных параметров КФС. Например, в качестве классифицирующего признака может быть выбрано выборочное среднее или выборочная дисперсия от параметров КФС. В другом частном варианте реализации классифицирующий признак получают как результат анализа Фурье от параметров КФС. В еще одном частном варианте реализации классифицирующий признак получают как результат применения анализа главных компонент (PCA analysis) от параметров КФС. В еще одном частном варианте реализации в качестве классифицирующих признаков выбирают также информацию об одном из средств определения аномалий 301, с использованием которого была выявлена аномалия. В итоге перечень классифицирующих признаков представляют в виде вектора значений классифицирующих признаков. При этом набор классифицирующих признаков, а также способ их формирования, может быть задан заранее или получен посредством интерфейса обратной связи 320 от оператора КФС 330. В частности, для конкретного типа КФС 200 и процессов, происходящих на этом типе КФС 200, может быть заранее известен набор таких классифицирующих признаков и технологии их численного расчета. Например, в задачах диагностики и мониторинга аномалий стенки трубы магистральных трубопроводов методами магнитной дефектоскопии такими классифицирующими признаками являются размер отклика от дефекта в данных диагностики, максимальное значение этого отклика, форма сигнала отклика и другие.

Описание этапов классификации

Система 300 также содержит средство классификации 304, связанное со средством формирования 303. Средство классификации 304 может включать модуль обучения 305 и модуль классификации 306. При этом модуль обучения 305 предназначен для настройки правил классификации на основании классифицирующих признаков из базы аномалий 310. В предпочтительных вариантах реализации указанные правила классификации включают модели машинного обучения для классификации с учителем или модели машинного обучения для классификации без учителя (модели кластеризации). В этих вариантах реализации настройка правил классификации заключается в формировании обучающей выборки, включающей значения классифицирующих признаков за исторический период времени, содержащей временной интервал наблюдения аномалий. Кроме того, могут быть также сформированы тестовая и валидационные выборки, также включающие значения классифицирующих признаков за исторический период времени. Упомянутые выборки могут быть сохранены в базу аномалий 310.

В одном частном варианте реализации, когда классификация аномалий осуществляется без учителя, то есть с использованием модели кластеризации, то в качестве упомянутой модели кластеризации может быть выбрана одна или несколько из следующих:

• иерархическая кластеризация (англ. Hierarchical clustering);

• основанная на плотности пространственная кластеризация для приложений с шумами (англ. DBSCAN — Density-based spatial clustering of applications with noise);

• алгоритм о расширяющемся нейронном газе (англ. growing neural gas, GNG);

• алгоритм упорядочения точек для обнаружения кластерной структуры (англ. Ordering points to identify the clustering structure, OPTICS).

Стоит отметить, что указанные методы позволяют сравнивать аномалии и формировать классы из нескольких аномалий, которые были выявлены разными средствами определения аномалий 301. Тем не менее могут быть использованы и другие известные из уровня техники методы кластеризации, в частности метод K-средних.

В другом частном варианте реализации аномалии классифицируют по размеченной исторической выборке на предварительно заданные классы, то есть с использованием модели классификации (обучение с учителем). При этом в качестве модели классификации может быть выбрана любая известная из уровня техники модель машинного обучения для классификации, в частности, логистическая регрессия, нейронные сети, решающие деревья, градиентный бустинг над решающими деревьями, метод опорных векторов и др. При этом список предварительно заданных классов может быть получен от оператора КФС 330 посредством интерфейса обратной связи 320. В другом варианте реализации список предварительно заданных классов может быть получен при предыдущем использовании настоящего изобретения, в котором использовался метод кластеризации.

Кроме того, может быть использован ансамбль из двух и более моделей кластеризации или соответственно моделей классификации, принимающий решение путем голосования отдельных моделей из набора.

Модуль классификации 306 использует настроенные правила классификации для выполнения классификации выявленных аномалий по меньшей мере на два класса на основании классифицирующих признаков. При этом модуль классификации 306 может выполнять классификацию аномалий как из базы аномалий 310, так и классификацию аномалий, поступающих от средств определения аномалий 301, то есть в режиме реального времени или в потоковом режиме. В этом случае средство формирования 303 также работает в потоковом режиме, последовательно или параллельно обрабатывая все входящие аномалии.

Полученные классы аномалий сохраняют в базу аномалий 310 и при необходимости передают оператору КФС 330 через интерфейс обратной связи 320. Система 300 также включает средство диагностики и мониторинга 307, связанное с базой аномалий 310, средством классификации 304 и интерфейсом обратной связи 320. Средство диагностики и мониторинга 307 получает информацию об аномалиях и классах аномалий, после чего осуществляют диагностику и последующий мониторинг аномалий каждого класса аномалий по отдельности. Подробнее о средстве анализа и мониторинга 307 будет раскрыто далее, в описании к Фиг. 5.

Описание средства диагностики и мониторинга 307

На Фиг. 5 представлен вариант исполнения средства диагностики и мониторинга аномалий 307. Так, средство диагностики и мониторинга 307 может включать модуль диагностики 501, модуль фильтрации 502, модуль ретроспективного анализа 503, модуль предиктивного анализа 504, модуль потокового анализа 505 и модуль составления рекомендаций по обработке аномалий 506.

Мониторинг аномалий каждого класса включает выполнение с заданной периодичностью по меньшей мере одного из следующих видов анализа по данным значений характеристик каждого класса аномалий: ретроспективного анализа модулем 503, предиктивного анализа модулем 504, потокового анализа модулем 505. Упомянутая периодичность мониторинга может быть предварительно задана или указана оператором КФС 330 посредством интерфейса обратной связи 320. В частном варианте реализации периодичность мониторинга может определяться интервалами времени, в которые происходит мониторинг — например, каждый час или каждые сутки. В другом частном варианте реализации упомянутая периодичность мониторинга может определяться условиями, при которых происходит мониторинг — например, при поступлении предварительно заданного количества новых аномалий. Таким образом, достигается актуальность и полнота результатов мониторинга аномалий каждого класса — то есть актуальность и полнота информации об аномалиях.

Модуль диагностики 501 предназначен для расчета определенного набора характеристик для аномалий каждого класса. В частном варианте реализации упомянутый набор характеристик рассчитывают с учетом характеристик технологических процессов КФС 200, состава оборудования и агрегатов КФС 200, отраслевых стандартов для данного КФС 200. Например, значения упомянутых характеристик рассчитывают путем присвоения одних из следующих значений: определенные параметров КФС для данного класса аномалии, производных от таких параметров КФС 200, статистических характеристик значений параметров КФС, численных значений частотного анализа параметров КФС и других значений. Так, для широкого класса КФС 200 актуальна их защита от потенциальных компьютерных атак на технологический процесс КФС 200. Примером таких компьютерных атак является, в частности, спуффинг (англ. spoofing — подмена) данных тех или иных параметров КФС с целью нарушения обратных связей в контурах управления КФС 200 с последующим потенциальным повреждением оборудования и агрегатов КФС 200. Для предотвращения таких компьютерных атак может быть использован предиктивный метод определения аномалий (см. патенты RU2724716, RU2724075, RU2749252), а к выбранным характеристикам будет отнесен признак «залипания» (повторения значений во времени) определенных параметров КФС в одном и том же положении и время такого «залипания». В еще одном варианте подмена данных осуществляется путем многократного повторения одной и той же ретроспективной части данных. В качестве характеристик в таком случае будут выбраны и выбраны и оконные статистические моменты такого сигнала, а именно выборочные моменты (например, выборочное среднее), дисперсия, авто- и кросс-корреляционные моменты сигнала и т.д.

Таким образом, в частном варианте реализации рассчитывают значения характеристик класса аномалий с учетом параметров КФС, к примеру рассчитывают значения по меньшей мере одной из следующих характеристик: минимальные и максимальные значения параметров КФС, статистические характеристики параметров КФС (в частности, выборочные средние, выборочные дисперсии), наличие и характеристики трендов в поведении параметров КФС, спектральные характеристики параметров КФС(в частности, коэффициенты преобразования Фурье, наличие определенных колебательных мод) и другие характеристики.

Кроме того, значения таких характеристик могут включать вычисленное значение уровня критичности той или иной аномалии, частоту появления аномалий данного класса, периодичность такого появления, появление определенных колебательных мод на заранее известной или неизвестной частоте и так далее. Здесь уровень критичности аномалии определяют как превышение значением заданной характеристикой или значениями заданного набора характеристик аномалии заранее заданного уровня(-ей), при котором возможно появление негативных процессов в ТП КФС. Так, для ротационного оборудования, включающего такие критически важные агрегаты, как циркуляционные насосы, характерны аномалии, связанные с вибрацией ротационных механизмов и диагностируемые, как правило, по данным датчиков виброскоростей и виброускорений. В качестве характеристик аномалий такого рода выбирают максимальные оконные значения данных виброанализа. Кроме того, набор характеристик может быть расширен такими характеристиками, как оконное преобразование Фурье и выделением диапазона мод для мониторинга. Такой расширенный набор характеристик позволяет проводить полноценную диагностику и мониторинг вибро-аномалий циркуляционных насосов, на ранней стадии обнаруживать появление новых паразитных колебательных мод и прогнозировать развитие таких аномалий во времени.

В другом частном варианте реализации упомянутый набор характеристик для аномалий каждого класса может быть получен, например, от оператора КФС 330 посредством интерфейса обратной связи 320.

Модуль фильтрации 502 предназначен для создания правил фильтрации аномалий класса на основании результатов диагностики аномалий модулем диагностики 501. Например, модуль фильтрации 502 может создать правила фильтрации, согласно которым будут пропущены все аномалии с характеристиками, полученными модулем 501 и выходящими за определенные диапазоны значений, заданных заранее. Например, все аномалии из классов с низким уровнем критичности будут отфильтрованы, то есть пропущены. Другим примером аномалий, которые должны быть отфильтрованы, являются ложно-определенные или специально отмеченные оператором КФС 330 аномалии, а также аномалии, связанные с легитимным вмешательством человека в процессы предприятия. Такие аномалии могут быть выделены как оператором КФС 330, так и автоматически, например, по данным уставок ПИД-регуляторов в местах их скачкообразных изменений.

Модуль ретроспективного анализа 503 предназначен для ретроспективного анализа характеристик аномалий (полученных модулем диагностики 501), относящихся к одному оборудованию и классу аномалий. Модуль ретроспективного анализа 503 выбирает значения характеристик классов аномалий в КФС 200 из базы аномалии 310 от одного выделенного оператором КФС 330 агрегата или оборудования за определенное время наблюдения. Затем рассчитанные модулем диагностики 501 значения характеристик аномалий для каждого класса аномалий используют для осуществления анализа в каждом классе аномалий векторов (набор значений) характеристик аномалии за определенный исторический интервал времени путем применения моделей машинного обучения для ретроспективного анализа, включая модели регрессионного анализа и модели интерполяции. Указанные модели получают на вход значения характеристик аномалии за определенный исторический интервал времени, а результат применения модели (то есть результат ретроспективного анализа характеристик аномалии) заключается в построении ретроспективных трендов развития аномалии, в расчете скорости и монотонности развития аномалии, в расчете величины отклонения значений характеристик аномалии от тренда и так далее. Кроме того, указанный результат может быть передан оператору КФС 330 посредством интерфейса обратной связи 320 для анализа динамики развития аномалии в прошлом и анализа причин развития аномалии данного класса.

Данные модуля ретроспективного анализа 503, а именно значения характеристик аномалии за определенный исторический интервал времени, могут являться дополнительными входными данными для модуля предиктивного анализа 504, который предназначен для прогнозирования развития аномалий, относящихся к одному оборудованию и одному классу, в частности, для прогнозирования значений характеристик аномалий в будущем. Данные векторов характеристик аномалии, взятые за определенный исторический интервал, анализируют с применением моделей машинного обучения для предиктивного анализа, в частности моделями регрессионного анализа, моделями экстраполяции, результатом применения которых будет получение прогнозных значений вектора характеристик на заданный промежуток времени прогноза. Кроме того, могут быть рассчитаны моменты времени достижения определенными характеристиками заранее заданных уровней (уровней критичности аномалий данного класса), необходимые для планирования операторами КФС 330 ремонтно-сервисных работ.

Модуль потокового анализа 505 предназначен для выполнения потокового анализа значений характеристик каждого класса аномалий, то есть значений, полученных в текущий момент времени или за заданное входное окно (входной интервал времени). Модуль потокового анализа 305 осуществляет запись информации, содержащей классы аномалий и значения характеристик каждого класса аномалий в базу аномалий 310 в режиме реального времени, то есть по мере поступления информации о выявленных аномалиях. Кроме того, модуль потокового анализа 305 выполняет сравнение значений характеристик каждого класса аномалий с предварительно заданными критическими значениями и, в случае превышения заданных критических значений, в базе аномалий 310 отмечают факт указанного превышения критических значений и дополнительно отправляют оператору КФС 330 посредством интерфейса обратной связи 320 уведомление об указанном превышении критических значений.

В еще одном частном варианте реализации мониторинга аномалий каждого класса с помощью модуля составления рекомендаций по обработке аномалий 506 сравнивают результаты, полученные при выполнении упомянутых видов анализа, выполненных одним из модулей 503-505, с правилами критичности и, при выполнении по меньшей мере одного правила, формируют перечень действий по обработке аномалий в соответствии с выполненным правилом.

В частном варианте реализации условия правил критичности включают превышение значением одной или нескольких характеристик КФС заданных порогов, наличие тренда на рост значения одной или нескольких характеристик КФС и другие.

В частном варианте реализации перечень действий по обработке аномалий включает нижеперечисленное:

а) Выполнение настройки датчика, исполнительного механизма или ПИД-регулятора, в котором выявлена аномалия. При этом указанная настройка может быть осуществлена в соответствии с характеристиками КФС, в соответствии с документацией к КФС.

б) Отключение датчика, исполнительного механизма или ПИД-регулятора, в котором выявлена аномалия. Например, если выявленная аномалия указывает на неисправность датчика или использование датчика злоумышленниками и пр.

в) Изменение настроек информационной безопасности КФС. Например, могут быть обновлены различные протоколы безопасности КФС, выполнена полная антивирусная проверка, проверка на уязвимости, отключены уязвимые сетевые соединения и пр.

г) Автоматическая корректировка управления. В частном варианте реализации могут быть заданы способы корректировки управления в соответствии с классом аномалий.

д) Оповещение системы SCADA 110б' о выявленных классах аномалий, а также о результатах диагностики и мониторинга аномалий каждого класса.

Ниже рассмотрен ряд примеров осуществления настоящего изобретения.

Так, к одному классу аномалий, сформированному в результате классификации, выполненной средством классификации 304, могут принадлежать все аномалии, заключающиеся в краткосрочном «залипании» датчика уровнемера, используемого в вязких парафинистых средах, характерных для нефтехимической промышленности. В данном примере «залипание» датчика означает, что его показания периодически становятся нулевыми или вообще некорректными, что не является критической аномалией. Все такие аномалии могут быть объединены в один класс средством классификации 304, а дальнейший анализ в классе заключается в диагностике аномалий класса, то есть в определении значений таких характеристик касса аномалии, как частота и продолжительность такого «залипания» и в последующем мониторинге значений указанных характеристик аномалий класса. Кроме того, при существенном изменении значений указанных характеристик информацию об этом сохраняют в базу аномалий 310, а также направляют оператору КФС 330 посредством интерфейса обратной связи 320.

Другим примером может служить ситуация, при которой технологией производства допускается кратковременное превышение заданного диапазона изменений по меньшей мере одним параметром КФС, однако, продолжительное или слишком частое такое превышение не допускается — в этом случае возникает аномалия, которую выявит одно из средств определения аномалий 301. Далее все такие выявленные аномалии будут объединены средством классификации 304 в один класс с последующей диагностикой каждого класса аномалий путем расчета значений характеристик аномалий каждого класса (например, уровня критичности аномалии, частоты появления аномалии, периодичности появления аномалии) и с последующим мониторингом рассчитанных значений характеристик аномалий класса — к примеру, частоты появления аномалии. При этом если значение характеристики «частота появления аномалии» со временем возрастает, средство диагностики и мониторинга 307 может информировать оператора КФС 330 посредством интерфейса обратной связи 320 о критическом возрастании значения указанной характеристики. Такое возрастание значений характеристики «частота появления аномалии» может быть определено модулем предиктивного анализа 504 путем прогноза значений упомянутой характеристики, а при превышении упомянутого прогноза заданного порога характеристики будет информирован оператор КФС 330.

Еще одним примером может служить внутритрубная диагностика магистральных трубопроводов, проводимая внутритрубными инспекционными снарядами. Имеется широкий набор классов дефектов стенки трубопровода, включая трещины, коррозию, вмятины, для которых по данным диагностики определяют значения ряда специфических характеристик, выбранных для класса аномалий, таких как длина, ширина, глубина дефектов. Мониторинг значений таких характеристик аномалий класса позволяет операторам трубопроводов спланировать сервисно-ремонтные работы и избежать дорогостоящих остановок и аварий.

На Фиг. 6 представлен вариант способа диагностики и мониторинга аномалий в КФС. На шаге 601 выявляют аномалии в КФС 200 путем анализа значений параметров КФС. Далее, на шаге 602 получают информацию о выявленных аномалиях в КФС 200, при этом упомянутая информация включает перечень параметров КФС и их значений. После этого на шаге 603 формируют классифицирующие признаки для выявленных аномалий на основании собранной информации. Затем на шаге 604 выполняют классификацию аномалий по меньшей мере на два класса на основании сформированных классифицирующих признаков. На шаге 605 осуществляют диагностику каждого класса аномалий путем расчета значений характеристик каждого класса аномалий. В итоге на шаге 606 на основании результатов диагностики каждого класса аномалий осуществляют мониторинг аномалий. Частные варианты реализации, приведенные ранее к Фиг 2-5, также применимы и к способу по Фиг. 6. Стоит также отметить, что заявленный способ может работать также в потоковом режиме, то есть при выявлении новой аномалии в КФС она будет добавлена в один из сформированных классов, либо для нее будет сформирован новый класс.

Таким образом, заявленное изобретение позволяет решить сформулированную техническую проблему и достичь заявленного технического результата. А именно, за счет классификации аномалий, диагностики аномалий каждого класса аномалий и последующего мониторинга аномалий каждого класса аномалий будет достигнут технический результат, заключающийся в обеспечении автоматизации диагностики и мониторинга аномалий в КФС.

Фиг. 7 представляет пример компьютерной системы общего назначения, с помощью которой может быть реализовано настоящее изобретение. Персональный компьютер или сервер 20, содержит центральный процессор 21, системную память 22 и системную шину 23, которая содержит разные системные компоненты, в том числе память, связанную с центральным процессором 21. Системная шина 23 реализована, как любая известная из уровня техники шинная структура, содержащая в свою очередь память шины или контроллер памяти шины, периферийную шину и локальную шину, которая способна взаимодействовать с любой другой шинной архитектурой. Системная память содержит постоянное запоминающее устройство (ПЗУ) 24, память с произвольным доступом (ОЗУ) 25. Основная система ввода/вывода (BIOS) 26, содержит основные процедуры, которые обеспечивают передачу информации между элементами персонального компьютера 20, например, в момент загрузки операционной системы с использованием ПЗУ 24.

Персональный компьютер 20 в свою очередь содержит жесткий диск 27 для чтения и записи данных, привод магнитных дисков 28 для чтения и записи на сменные магнитные диски 29 и оптический привод 30 для чтения и записи на сменные оптические диски 31, такие как CD-ROM, DVD-ROM и иные оптические носители информации. Жесткий диск 27, привод магнитных дисков 28, оптический привод 30 соединены с системной шиной 23 через интерфейс жесткого диска 32, интерфейс магнитных дисков 33 и интерфейс оптического привода 34 соответственно. Приводы и соответствующие компьютерные носители информации представляют собой энергонезависимые средства хранения компьютерных инструкций, структур данных, программных модулей и прочих данных персонального компьютера 20.

Настоящее описание раскрывает реализацию системы, которая использует жесткий диск 27, сменный магнитный диск 29 и сменный оптический диск 31, но следует понимать, что возможно применение иных типов компьютерных носителей информации 56, которые способны хранить данные в доступной для чтения компьютером форме (твердотельные накопители, флеш карты памяти, цифровые диски, память с произвольным доступом (ОЗУ) и т.п.), которые подключены к системной шине 23 через контроллер 55.

Компьютер 20 имеет файловую систему 36, где хранится записанная операционная система 35, а также дополнительные программные приложения 37, другие программные модули 38 и данные программ 39. Пользователь (оператор) имеет возможность вводить команды и информацию в персональный компьютер 20 посредством устройств ввода (клавиатуры 40, манипулятора «мышь» 42). Могут использоваться другие устройства ввода (не отображены): микрофон, джойстик, игровая консоль, сканер и т.п. Подобные устройства ввода по своему обычаю подключают к компьютерной системе 20 через последовательный порт 46, который в свою очередь подсоединен к системной шине, но могут быть подключены иным способом, например, при помощи параллельного порта, игрового порта или универсальной последовательной шины (USB). Монитор 47 или иной тип устройства отображения также подсоединен к системной шине 23 через интерфейс, такой как видеоадаптер 48. В дополнение к монитору 47, персональный компьютер может быть оснащен другими периферийными устройствами вывода (не отображены), например, колонками, принтером и т.п.

Персональный компьютер 20 способен работать в сетевом окружении, при этом используется сетевое соединение с другим или несколькими удаленными компьютерами 49. Удаленный компьютер (или компьютеры) 49 являются такими же персональными компьютерами или серверами, которые имеют большинство или все упомянутые элементы, отмеченные ранее при описании существа персонального компьютера 20, представленного на Фиг. 7. В вычислительной сети могут присутствовать также и другие устройства, например, маршрутизаторы, сетевые станции, пиринговые устройства или иные сетевые узлы.

Сетевые соединения могут образовывать локальную вычислительную сеть (LAN) 50 и глобальную вычислительную сеть (WAN). Такие сети применяются в корпоративных компьютерных сетях (также — информационных системах), внутренних сетях компаний и, как правило, имеют доступ к сети Интернет. В LAN- или WAN-сетях персональный компьютер 20 подключен к локальной сети 50 через сетевой адаптер или сетевой интерфейс 51. При использовании сетей персональный компьютер 20 может использовать модем 54 или иные средства обеспечения связи с глобальной вычислительной сетью, такой как Интернет. Модем 54, который является внутренним или внешним устройством, подключен к системной шине 23 посредством последовательного порта 46. Следует уточнить, что сетевые соединения являются лишь примерными и не обязаны отображать точную конфигурацию сети, т.е. в действительности существуют иные способы установления соединения техническими средствами связи одного компьютера с другим.

В соответствии с описанием, компоненты, этапы исполнения, структура данных, описанные выше, могут быть выполнены, используя различные типы операционных систем, компьютерных платформ, программ.

В заключение следует отметить, что приведенные в описании сведения являются примерами, которые не ограничивают объем настоящего изобретения, определенного формулой.

| название | год | авторы | номер документа |

|---|---|---|---|

| Система и способ выявления аномалий в киберфизической системе | 2022 |

|

RU2800740C1 |

| Способ определения аномалии в киберфизической системе | 2022 |

|

RU2790331C1 |

| Способ определения источников аномалии в кибер-физической системе | 2020 |

|

RU2749252C1 |

| Система и способ формирования данных для мониторинга кибер-физической системы с целью раннего определения аномалий в системе графического интерфейса пользователя | 2018 |

|

RU2724716C1 |

| Система и способ определения источника аномалии в кибер-физической системе, обладающей определенными характеристиками | 2018 |

|

RU2724075C1 |

| Способ адаптивного управления системой обеспечения информационной безопасности корпоративной сети связи | 2023 |

|

RU2823575C1 |

| Система и способ корреляции событий для выявления инцидента информационной безопасности | 2019 |

|

RU2739864C1 |

| Система и способ контроля доступа к кибер-физической системе | 2019 |

|

RU2726884C1 |

| Система и способ определения устройств компьютерной сети с использованием правил инвентаризации | 2019 |

|

RU2746101C2 |

| Способ выявления аномалий в киберфизической системе в реальном времени | 2023 |

|

RU2824318C1 |

Изобретение относится к области промышленной безопасности, а более конкретно к способам диагностики и мониторинга аномалий в кибер-физической системе. Технический результат заключается в обеспечении автоматизации диагностики и мониторинга аномалий в КФС. Технический результат достигается за счет способа диагностики и мониторинга аномалий в кибер-физической системе (КФС), который реализован на аппаратном процессоре компьютерной системы и содержит инструкции, согласно которым получают информацию о выявленных аномалиях в КФС, при этом упомянутая информация включает перечень параметров КФС, включающих технологические параметры КФС, и их значений; формируют классифицирующие признаки для выявленных аномалий на основании собранной информации; выполняют классификацию выявленных аномалий по меньшей мере на два класса на основании сформированных классифицирующих признаков; осуществляют диагностику аномалий каждого класса путем расчета значений характеристик каждого класса аномалий; осуществляют мониторинг аномалий каждого класса по данным значений характеристик каждого класса. 11 з.п. ф-лы, 10 ил.

1. Способ диагностики и мониторинга аномалий в кибер-физической системе (КФС), реализованный на аппаратном процессоре компьютерной системы, содержащий инструкции, согласно которым:

а) получают информацию о выявленных аномалиях в КФС, при этом упомянутая информация включает перечень параметров КФС, включающих технологические параметры КФС, и их значений;

б) формируют классифицирующие признаки для выявленных аномалий на основании собранной информации;

в) выполняют классификацию выявленных аномалий по меньшей мере на два класса на основании сформированных классифицирующих признаков;

г) осуществляют диагностику аномалий каждого класса путем расчета значений характеристик каждого класса аномалий;

д) осуществляют мониторинг аномалий каждого класса по данным значений характеристик каждого класса.

2. Способ по п. 1, в котором получают информацию о выявленных аномалиях в КФС от средств определения аномалий, при этом выявляют аномалии в КФС по меньшей мере одним из способов:

• в случае превышения общей ошибкой прогноза порогового значения, при этом предварительно выполняют прогнозирование значений параметров КФС и последующее определение общей ошибки прогноза для параметров КФС;

• путем применения обученной базовой модели машинного обучения по значениям параметров КФС;

• при выполнении правила определения аномалий;

• в случае выхода значения по меньшей мере одного параметра КФС за пределы предварительно заданного диапазона значений для указанного параметра КФС;

• путем использования ансамбля из двух или более перечисленных выше способов.

3. Способ по п. 1, в котором информация об аномалиях в КФС дополнительно включает следующие сведения об аномалии: временной интервал наблюдения аномалии, вклад каждого параметра КФС в аномалию, информацию о способе выявления указанной аномалии, значения параметров КФС в каждый момент временного интервала.

4. Способ по п. 1, в котором информация об аномалиях в КФС дополнительно включает для каждого параметра КФС по меньшей мере один из параметров: временной ряд значений; текущую величину отклонения спрогнозированного значения от фактического значения; сглаженную величину отклонения спрогнозированного значения от фактического значения.

5. Способ по п. 1, в котором значения параметров КФС включают по меньшей мере одно из значений: измерение датчика; значение управляемого параметра исполнительного механизма; уставку исполнительного механизма; значения входных сигналов пропорционально-интегрально-дифференцирующего регулятора (ПИД-регулятора); значение выходного сигнала ПИД-регулятора.

6. Способ по п. 1, в котором формируют классифицирующие признаки путем присвоения им значений параметров КФС в исходном виде, или в преобразованном виде, или как результата применения функции от указанных параметров КФС.

7. Способ по п. 1, в котором формируют классифицирующие признаки на основании обратной связи от оператора КФС.

8. Способ по п. 1, в котором классификацию аномалий осуществляют с использованием обученной модели классификации или с использованием обученной модели кластеризации, при этом входными данными для упомянутых моделей служат классифицирующие признаки, а результатом классификации аномалий является присвоение класса каждой из выявленных аномалий.

9. Способ по п. 1, в котором значения характеристик класса аномалий включают по меньшей мере одну из: уровень критичности аномалии, частоту появления аномалии, периодичность появления аномалии.

10. Способ по п. 1, в котором рассчитывают значения характеристик класса аномалий с учетом параметров КФС, в частности рассчитывают значение по меньшей мере одной из следующих характеристик: статистические характеристики параметров КФС, спектральные характеристики параметров КФС.

11. Способ по п. 1, в котором мониторинг аномалий каждого класса включает выполнение с заданной периодичностью по меньшей мере одного из следующих видов анализа по данным значений характеристик каждого класса аномалий:

• ретроспективного анализа, включающего расчет значений дополнительных характеристик каждого класса аномалий по данным значений характеристик каждого класса аномалий за предварительно заданный предшествующий промежуток времени;

• предиктивного анализа, включающего прогноз значений характеристик каждого класса аномалий;

• потокового анализа значений характеристик каждого класса аномалий.

12. Способ по п. 11, в котором мониторинг аномалий каждого класса дополнительно включает сравнение результатов, полученных при выполнении упомянутых видов анализа, с правилами критичности, и при выполнении по меньшей мере одного правила формируют перечень действий по обработке аномалий в соответствии с выполненным правилом.

| Способ восстановления спиралей из вольфрамовой проволоки для электрических ламп накаливания, наполненных газом | 1924 |

|

SU2020A1 |

| Способ защиты переносных электрических установок от опасностей, связанных с заземлением одной из фаз | 1924 |

|

SU2014A1 |

| Приспособление для суммирования отрезков прямых линий | 1923 |

|

SU2010A1 |

| EP 3674946 B1, 11.08.2021 | |||

| Система и способ определения источника аномалии в кибер-физической системе, обладающей определенными характеристиками | 2018 |

|

RU2724075C1 |

Авторы

Даты

2022-12-01—Публикация

2021-12-28—Подача