Область техники, к которой относится изобретение

[01] Настоящая технология относится к способам машинного обучения, в частности к способам и системам для обучения и использования моделей машинного обучения на основе трансформера для ранжирования результатов поиска.

Уровень техники

[02] Веб-поиск представляет собой важную задачу, связанную с ежедневной обработкой миллиардов пользовательских запросов. Современные системы веб-поиска обычно ранжируют результаты поиска по их релевантности поисковому запросу и другим критериям. Определение релевантности результатов поиска запросу часто предусматривает использование алгоритмов машинного обучения, обученных использованию нескольких определенных вручную признаков для оценивания различных показателей релевантности. Такое определение релевантности можно рассматривать, по меньшей мере частично, как проблему понимания языка, поскольку релевантность документа поисковому запросу имеет по меньшей мере некоторое отношение к семантическому пониманию запроса и результатов поиска, даже в случаях, когда запрос и результаты не содержат общих слов или когда результаты представляют собой изображения, музыку или другие нетекстовые результаты.

[03] Недавние разработки в области нейронной обработки естественного языка включают в себя использование трансформерных моделей машинного обучения, как описано в статье Vaswani et al., «Attention Is All You Need», Advances in neural information processing systems, pages 5998–6008, 2017. Трансформер представляет собой модель глубокого обучения (т.е. искусственную нейронную сеть или другую модель машинного обучения, содержащую несколько слоев), в которой для назначения некоторым частям входных данных большей значимости, чем другим, используется механизм внимания. При обработке естественного языка механизм внимания используется с целью определения контекста для слов из входных данных, при этом одно и то же слово в разных контекстах может иметь различные значения. Трансформеры также способны параллельно обрабатывать множество слов или токенов естественного языка, что позволяет реализовать параллельное обучение.

[04] На трансформерах основаны и другие достижения в области обработки естественного языка, включая заранее обучаемые системы, которые могут заранее обучаться с использованием большого набора данных, а затем точно настраиваться для использования в конкретных целях. Примеры таких систем включают в себя модель «Представления двунаправленного кодера из трансформеров» (BERT, Bidirectional Encoder Representations from Transformers), описанную в работе Devlin et al., «BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding», Proceedings of NAACL-HLT 2019, pages 4171–4186, 2019, и заранее обучаемый генеративный трансформер (GPT, Generative Pre-trained Transformer), описанный в работе Radford et al., «Improving Language Understanding by Generative Pre-Training», 2018.

[05] Несмотря на обеспечение трансформерами значительных успехов в задачах обработки естественного языка, при их использовании на практике для ранжирования результатов поиска возможны некоторые затруднения. Например, многие большие наборы данных о релевантности поиска содержат нетекстовые данные, такие как информация о выбранных пользователем ссылках, которая может быть полезна при обучении модели ранжирования.

Раскрытие изобретения

[06] Некоторые не имеющие ограничительного характера варианты осуществления настоящей технологии относятся к способам и системам для обучения модели обучения на основе трансформера определению параметров релевантности результатов поиска, предоставленных пользователю интерактивной поисковой платформой (например, такой как поисковая система). В частности, в по меньшей мере некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии такие параметры релевантности могут быть представлены значениями вероятности действий пользователя (таких как «клик» или «длинный клик») в отношении результатов поиска, при этом модель обучения на основе трансформера может быть обучена на основе особым образом подготовленных обучающих данных.

[07] В частности, разработчики настоящей технологии установили, что качество ранжирования результатов поиска может быть повышено в результате двухэтапного обучения модели обучения на основе трансформера. Во время первого этапа, который здесь также называется этапом предварительного обучения, обучающие данные подготавливаются в первом обучающем наборе данных, который содержит по меньшей мере подмножество прошлых результатов поиска и соответствующие прошлые поисковые запросы, но не содержит указаний на взаимодействие пользователя с ними. Таким образом, на первом этапе обучения модель обучения на основе трансформера обучается на первом обучающем наборе данных прогнозированию того, взаимодействовал ли пользователь с каждым результатом из числа прошлых результатов поиска.

[08] На втором этапе обучения обучающие данные подготавливаются во втором обучающем наборе данных, содержащем только прошлые результаты поиска, с которым взаимодействовал пользователь, и их соответствующие прошлые поисковые запросы. Сформированный таким образом второй обучающий набор данных используется для обучения модели обучения на основе трансформера прогнозированию того, будет ли пользователь взаимодействовать с результатом поиска этапа использования, предоставленным ему в ответ на отправку соответствующего поискового запроса этапа использования.

[09] Таким образом, эти способы и системы предназначены для предоставления модели обучения на основе трансформера во время первого этапа обучения большего количества токенов, на которых модель обучения обучается формированию прогноза, в результате чего определяются предварительные веса для слоев модели обучения на основе трансформера. Затем эти веса могут быть точно настроены на втором этапе обучения, когда модель обучения на основе трансформера обучается только на основе прошлых результатов поиска, содержащих указания на реальные прошлые действия пользователя в их отношении.

[010] Следовательно, описанные здесь способы и системы позволяют более эффективно и с использованием ограниченного объема обучающих данных обучать модель обучения на основе трансформера ранжированию результатов поиска. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии при этом повышается качество прогнозирования релевантности результата поиска для конкретного пользователя, т.е. улучшается персонализированное ранжирование.

[011] Согласно первому аспекту настоящей технологии реализован компьютерный способ обучения алгоритма машинного обучения (MLA, Machine Learning Algorithm) ранжированию цифровых документов этапа использования на интерактивной поисковой платформе. Способ выполняется процессором. Способ включает в себя: получение процессором обучающих данных, связанных с пользователем и содержащих (а) множество прошлых запросов, отправленных пользователем интерактивной поисковой платформе, и (б) наборы прошлых цифровых документов, сформированные интерактивной поисковой платформой в ответ на отправку ей запросов из множества прошлых запросов, при этом прошлый цифровой документ содержит параметр прошлых взаимодействий пользователя, указывающий на то, взаимодействовал ли пользователь с прошлым цифровым документом. На первом этапе обучения способ включает в себя подготовку процессором обучающих данных в первом наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) заранее заданное количество прошлых цифровых документов, соответствующих прошлому запросу; обучение алгоритма MLA, выполняемое процессором на основе первого набора обучающих цифровых объектов, определению для обучающего цифрового объекта из первого набора обучающих цифровых объектов того, взаимодействовал ли пользователь с каждым документом из заранее заданного количества прошлых цифровых документов. На втором этапе обучения, который следует за первым этапом обучения, способ включает в себя: подготовку процессором обучающих данных во втором наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) некоторое количество прошлых цифровых документов, соответствующих этому запросу, с которыми взаимодействовал пользователь; и обучение алгоритма MLA, выполняемое процессором на основе второго набора обучающих цифровых объектов, определению для цифрового документа этапа использования параметра вероятности взаимодействия пользователя с этим цифровым документом этапа использования.

[012] В некоторых вариантах осуществления способа прошлые цифровые документы, связанные с обучающими цифровыми объектами из первого набора обучающих цифровых объектов, случайным образом выбираются из набора цифровых документов, соответствующих прошлому запросу.

[013] В некоторых вариантах осуществления способа параметр прошлых взаимодействий пользователя, связанный с прошлым цифровым документом, определяется на основе данных о прошлых «кликах» пользователя.

[014] В некоторых вариантах осуществления способа данные о «кликах» содержат данные о по меньшей мере одном «клике» пользователя на прошлом цифровом документе, сделанном после отправки прошлого запроса интерактивной поисковой платформе.

[015] В некоторых вариантах осуществления способа он дополнительно включает в себя: получение процессором запроса этапа использования; получение процессором набора цифровых документов этапа использования, соответствующих запросу этапа использования; применение процессором алгоритма MLA в отношении каждого документа из набора цифровых документов этапа использования с целью формирования параметров вероятности взаимодействия с ними пользователя; и использование процессором этих параметров вероятности для ранжирования каждого документа из набора цифровых документов этапа использования.

[016] В некоторых вариантах осуществления способа использование параметров вероятности включает в себя ввод параметров вероятности в качестве входных данных в другой алгоритм MLA, способный ранжировать набор цифровых документов этапа использования на основе по меньшей мере значений вероятности взаимодействия с ними пользователя.

[017] В некоторых вариантах осуществления способа другой алгоритм MLA представляет собой ансамбль деревьев решений CatBoost.

[018] В некоторых вариантах осуществления способа количество прошлых цифровых документов, соответствующих прошлому запросу, с которыми взаимодействовал пользователь, соответствует всем прошлым цифровым документам из набора цифровых документов, соответствующих прошлому запросу, с которыми взаимодействовал пользователь.

[019] В некоторых вариантах осуществления способа первая общая численность первого набора обучающих цифровых объектов равна второй общей численности второго набора обучающих цифровых объектов.

[020] В некоторых вариантах осуществления способа первая общая численность первого набора обучающих цифровых объектов и вторая общая численность второго набора обучающих цифровых объектов заданы заранее.

[021] В некоторых вариантах осуществления способа алгоритм MLA представляет собой алгоритм MLA на основе трансформера.

[022] Согласно второму аспекту настоящей технологии реализована система для обучения алгоритма MLA ранжированию цифровых документов этапа использования на интерактивной поисковой платформе. Система содержит процессор и машиночитаемый физический носитель информации, хранящий команды. Процессор при исполнении команд способен: получать обучающие данные, связанные с пользователем и содержащие (а) множество прошлых запросов, отправленных пользователем интерактивной поисковой платформе, и (б) наборы прошлых цифровых документов, сформированные интерактивной поисковой платформой в ответ на отправку ей запросов из множества прошлых запросов, при этом прошлый цифровой документ содержит параметр прошлых взаимодействий пользователя, указывающий на то, взаимодействовал ли пользователь с этим прошлым цифровым документом. На первом этапе обучения процессор способен: подготавливать обучающие данные в первом наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) заранее заданное количество прошлых цифровых документов, соответствующих прошлому запросу; обучать на основе первого набора обучающих цифровых объектов алгоритм MLA определению для обучающего цифрового объекта из первого набора обучающих цифровых объектов того, взаимодействовал ли пользователь с каждым документом из заранее заданного количества прошлых цифровых документов. На втором этапе обучения, который следует за первым этапом обучения, процессор способен: подготавливать обучающие данные во втором наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) некоторое количество прошлых цифровых документов, соответствующих этому запросу, с которыми взаимодействовал пользователь; и обучать на основе второго набора обучающих цифровых объектов алгоритм MLA определению для цифрового документа этапа использования параметра вероятности взаимодействия пользователя с этим цифровым документом этапа использования.

[023] В некоторых вариантах осуществления системы процессор способен случайным образом выбирать прошлые цифровые документы, связанные с обучающими цифровыми объектами из первого набора обучающих цифровых объектов в наборе цифровых документов, соответствующем прошлому запросу.

[024] В некоторых вариантах осуществления системы процессор дополнительно способен определять на основе данных о прошлых «кликах» пользователя параметр прошлых взаимодействий пользователя, связанный с прошлым цифровым документом.

[025] В некоторых вариантах осуществления системы данные о «кликах» содержат данные о по меньшей мере одном «клике» пользователя на прошлом цифровом документе, сделанном после отправки прошлого запроса интерактивной поисковой платформе.

[026] В некоторых вариантах осуществления системы процессор дополнительно способен: получать запрос этапа использования; получать набор цифровых документов этапа использования, соответствующих запросу этапа использования; применять алгоритм MLA в отношении каждого документа из набора цифровых документов этапа использования с целью формирования параметров вероятности взаимодействия с ними пользователя; и использовать эти параметры вероятности для ранжирования каждого документа из набора цифровых документов этапа использования.

[027] В некоторых вариантах осуществления системы для использования параметров вероятности процессор дополнительно способен вводить параметры вероятности в качестве входных данных в другой алгоритм MLA, способный ранжировать набор цифровых документов этапа использования на основе по меньшей мере значений вероятности взаимодействия с ними пользователя.

[028] В некоторых вариантах осуществления системы другой алгоритм MLA представляет собой ансамбль деревьев решений CatBoost.

[029] В некоторых вариантах осуществления системы количество прошлых цифровых документов, соответствующих прошлому запросу, с которыми взаимодействовал пользователь, соответствует всем прошлым цифровым документам из набора цифровых документов, соответствующих прошлому запросу, с которыми взаимодействовал пользователь.

[030] В некоторых вариантах осуществления системы первая общая численность первого набора обучающих цифровых объектов равна второй общей численности второго набора обучающих цифровых объектов.

[031] В некоторых вариантах осуществления системы первая общая численность первого набора обучающих цифровых объектов и вторая общая численность второго набора обучающих цифровых объектов заданы заранее.

[032] В некоторых вариантах осуществления системы алгоритм MLA представляет собой алгоритм MLA на основе трансформера.

[033] В контексте настоящего описания термин «сервер» означает компьютерную программу, выполняемую соответствующими аппаратными средствами и способную принимать запросы (например, от клиентских устройств) через сеть и выполнять эти запросы или инициировать их выполнение. Аппаратные средства могут представлять собой один физический компьютер или одну компьютерную систему, что не существенно для настоящей технологии. В данном контексте выражение «сервер» не означает, что каждая задача (например, принятая команда или запрос) или некоторая конкретная задача принимается, выполняется или запускается одним и тем же сервером (т.е. одними и теми же программными и/или аппаратными средствами). Это выражение означает, что любое количество программных средств или аппаратных средств может принимать, отправлять, выполнять или инициировать выполнение любой задачи или запроса либо результатов любых задач или запросов. Все эти программные и аппаратные средства могут представлять собой один сервер или несколько серверов, причем оба эти случая подразумеваются в выражении «по меньшей мере один сервер».

[034] В контексте настоящего описания термин «клиентское устройство» означает любое компьютерное аппаратное средство, способное выполнять программы, подходящие для решения конкретной задачи. Таким образом, некоторые (не имеющие ограничительного характера) примеры клиентских устройств включают в себя персональные компьютеры (настольные, ноутбуки, нетбуки и т.п.), смартфоны и планшеты, а также сетевое оборудование, такое как маршрутизаторы, коммутаторы и шлюзы. Следует отметить, что в данном контексте устройство, функционирующее как клиентское устройство, также может функционировать как сервер для других клиентских устройств. Использование выражения «клиентское устройство» не исключает использования нескольких клиентских устройств для приема, отправки, выполнения или инициирования выполнения любой задачи или запроса либо результатов любых задач или запросов, либо шагов любого описанного здесь способа.

[035] В контексте настоящего описания термин «база данных» означает любой структурированный набор данных, независимо от его конкретной структуры, программного обеспечения для управления базой данных или компьютерных аппаратных средств для хранения этих данных, их применения или обеспечения их использования иным способом. База данных может располагаться в тех же аппаратных средствах, где реализован процесс, обеспечивающий хранение или использование информации, хранящейся в базе данных, либо база данных может располагаться в отдельных аппаратных средствах, таких как специализированный сервер или множество серверов.

[036] В контексте настоящего описания выражение «информация» включает в себя информацию любого рода или вида, допускающую хранение в базе данных. Таким образом, информация включает в себя аудиовизуальные произведения (изображения, фильмы, звукозаписи, презентации и т.д.), данные (данные о местоположении, числовые данные и т.д.), текст (мнения, комментарии, вопросы, сообщения и т.д.), документы, электронные таблицы, списки слов и т.д., но не ограничивается ими.

[037] В контексте настоящего описания выражение «компонент» включает в себя обозначение программного обеспечения (подходящего для определенных аппаратных средств), необходимого и достаточного для выполнения определенной функции или нескольких функций.

[038] В контексте настоящего описания выражение «пригодный для использования в компьютере носитель информации» означает носители любого рода и вида, включая оперативное запоминающее устройство (ОЗУ), постоянное запоминающее устройство (ПЗУ), диски (CD-ROM, DVD, гибкие диски, жесткие диски и т.д.), USB-накопители, твердотельные накопители, накопители на магнитных лентах и т.д.

[039] В контексте настоящего описания числительные «первый», «второй», «третий» и т.д. используются лишь для указания различия между существительными, к которым они относятся, но не для описания каких-либо определенных взаимосвязей между этими существительными. Например, должно быть понятно, что использование терминов «первый сервер» и «третий сервер» не подразумевает какого-либо определенного порядка, типа, хронологии, иерархии или классификации, в данном случае, серверов, а также что их использование (само по себе) не подразумевает наличие «второго сервера» в любой ситуации. Кроме того, как встречается в настоящем описании в другом контексте, ссылка на «первый» элемент и «второй» элемент не исключает того, что эти два элемента в действительности могут быть одним и тем же элементом. Таким образом, например, в некоторых случаях «первый» сервер и «второй» сервер могут представлять собой одно и то же программное и/или аппаратное средство, а в других случаях – различные программные и/или аппаратные средства.

[040] Каждый вариант осуществления настоящей технологии относится к по меньшей мере одной из вышеупомянутых целей и/или аспектов, но не обязательно ко всем ним. Должно быть понятно, что некоторые аспекты настоящей технологии, связанные с попыткой достижения вышеупомянутой цели, могут не соответствовать этой цели и/или могут соответствовать другим целям, явным образом здесь не упомянутым.

[041] Дополнительные и/или альтернативные признаки, аспекты и преимущества вариантов осуществления настоящей технологии содержатся в дальнейшем описании, в приложенных чертежах и в формуле изобретения.

Краткое описание чертежей

[042] Эти и другие признаки, аспекты и преимущества настоящей технологии поясняются в дальнейшем описании, приложенной формуле изобретения и на следующих чертежах.

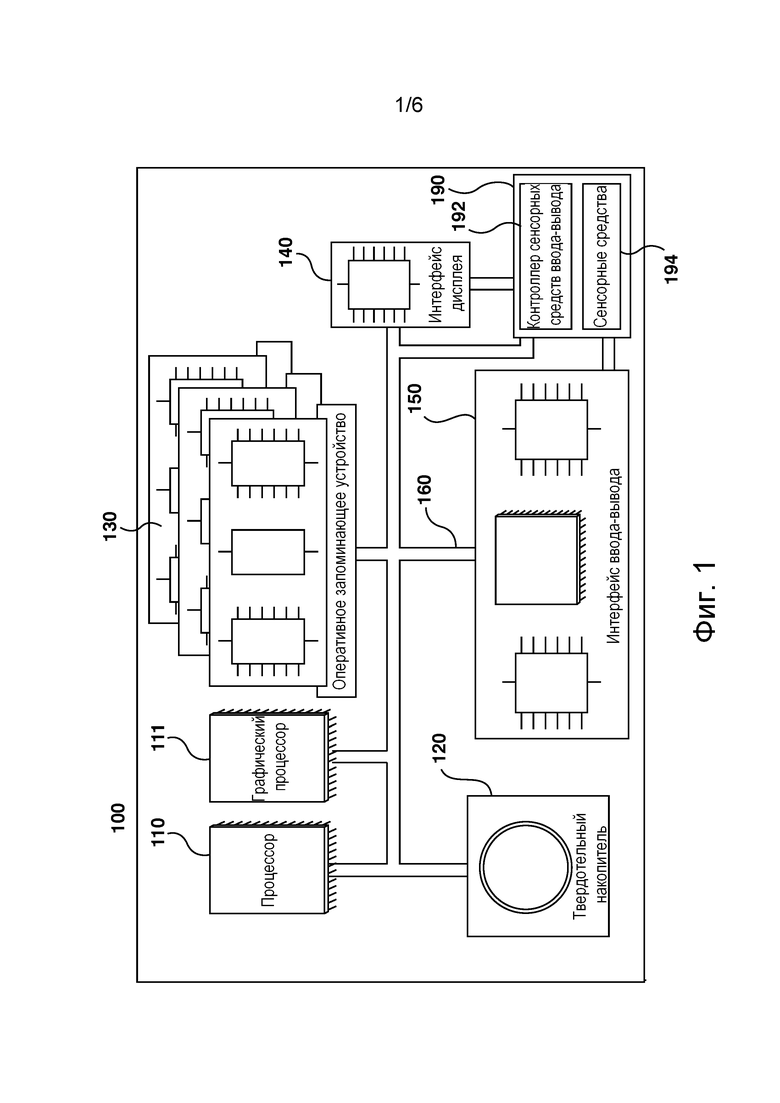

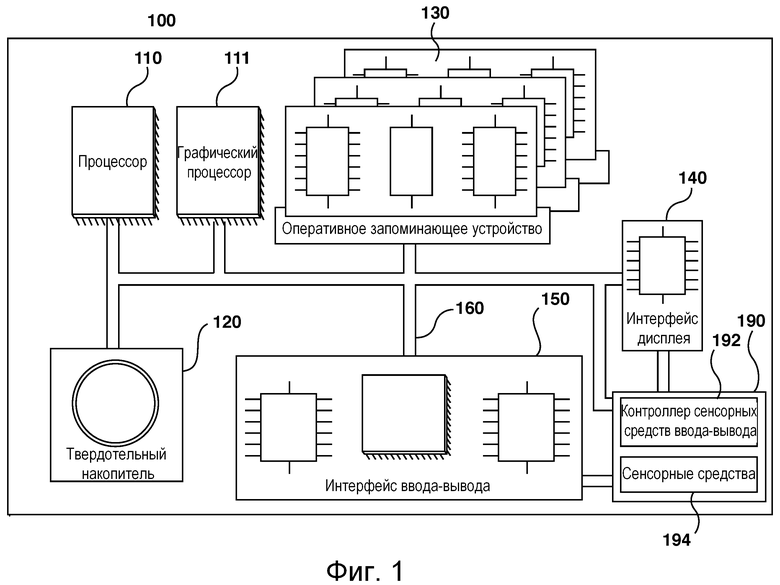

[043] На фиг. 1 приведена схема примера компьютерной системы для реализации некоторых не имеющих ограничительного характера вариантов осуществления систем и/или способов согласно настоящей технологии.

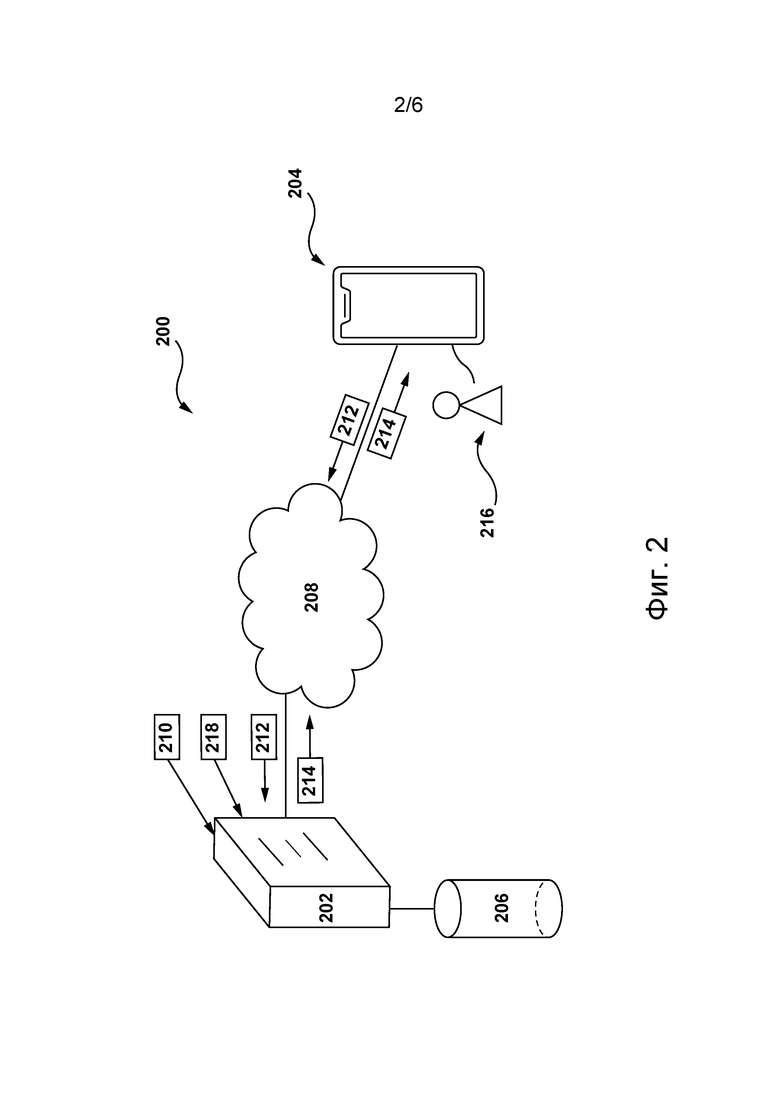

[044] На фиг. 2 представлена вычислительная сетевая среда, подходящая для обучения модели машинного обучения определению значений вероятности взаимодействия пользователя с цифровыми документами, предоставленными интерактивной поисковой платформой, согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

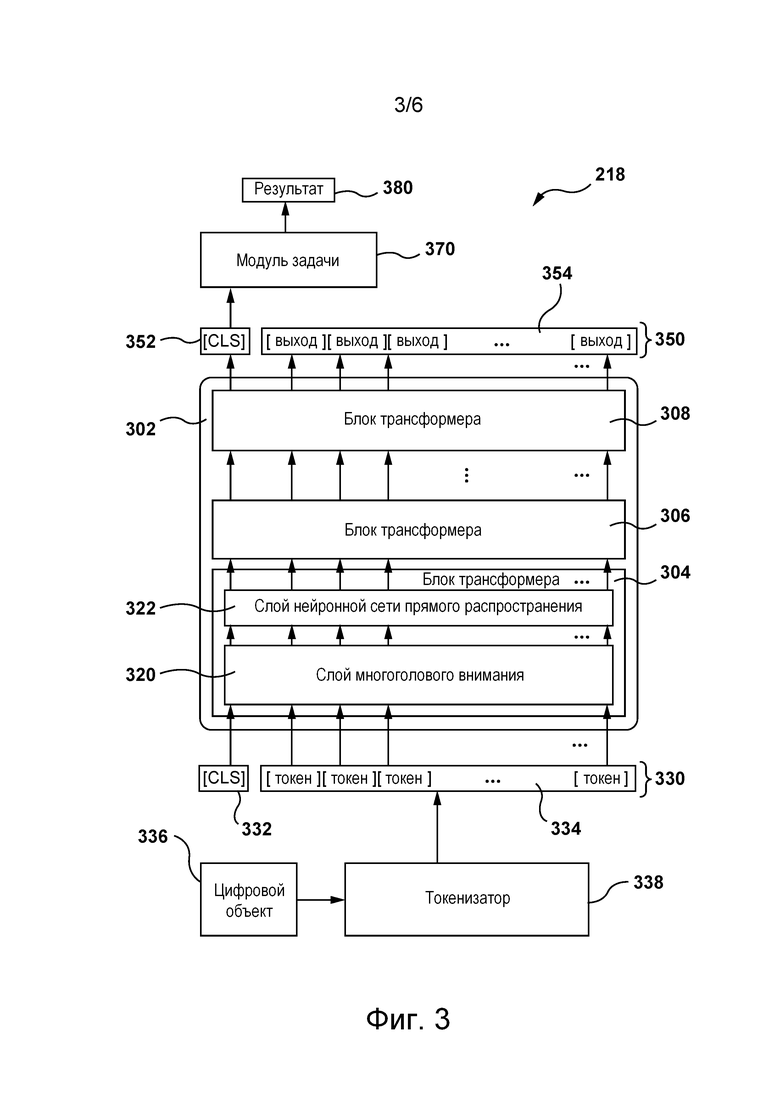

[045] На фиг. 3 приведена блок-схема архитектуры модели машинного обучения, выполняемой сервером из вычислительной сетевой среды, представленной на фиг. 2, согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

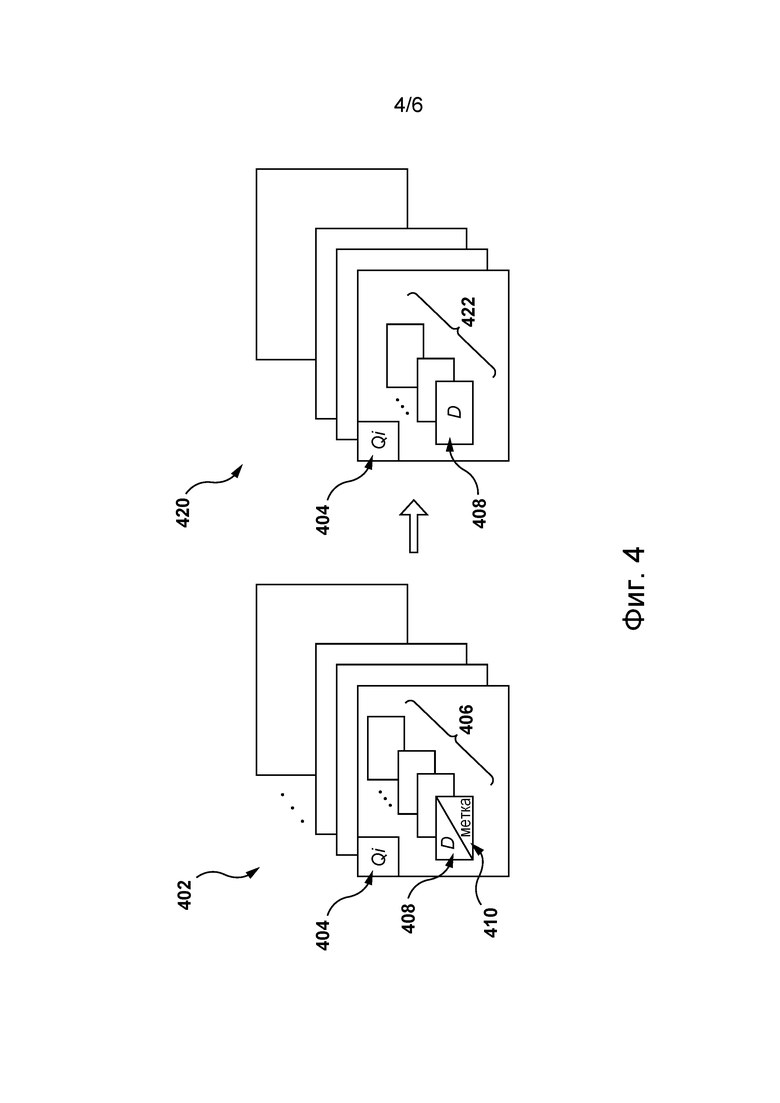

[046] На фиг. 4 приведена схема процесса подготовки сервером из вычислительной сетевой среды, представленной на фиг. 2, обучающих данных для обучения модели машинного обучения, представленной на фиг. 3, на первом этапе обучения модели машинного обучения согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

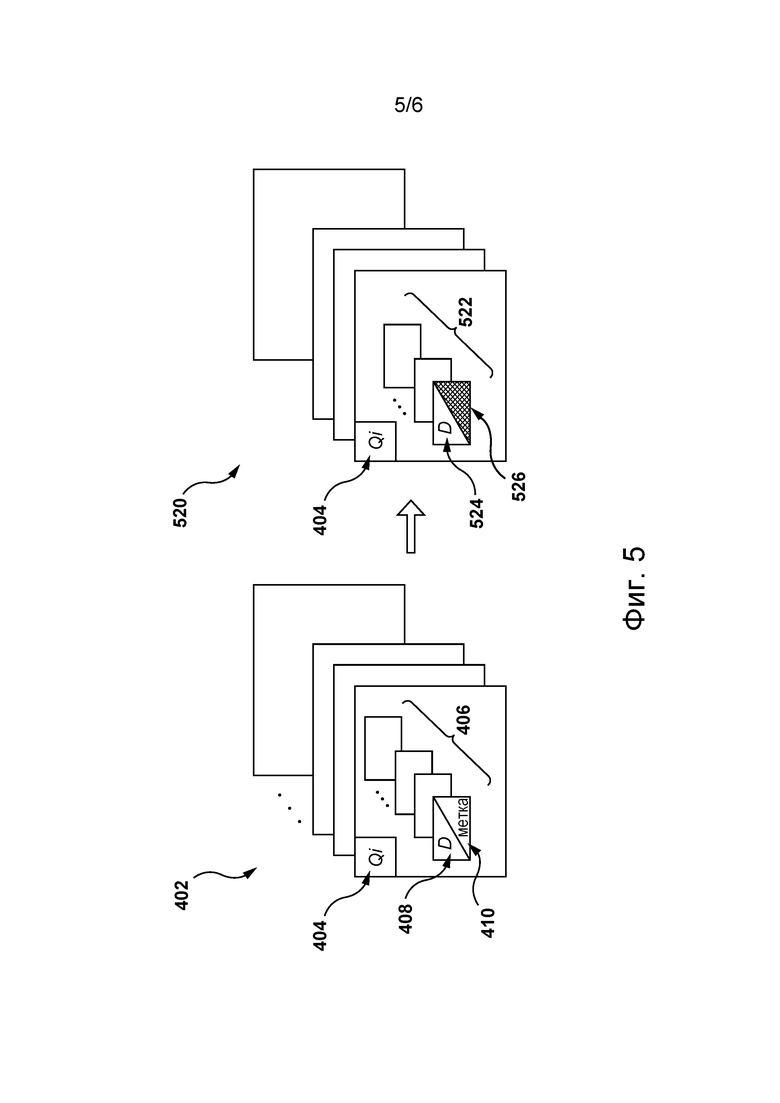

[047] На фиг. 5 приведена схема процесса подготовки сервером из вычислительной сетевой среды, представленной на фиг. 2, обучающих данных для обучения модели машинного обучения, представленной на фиг. 3, на втором этапе обучения модели машинного обучения согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

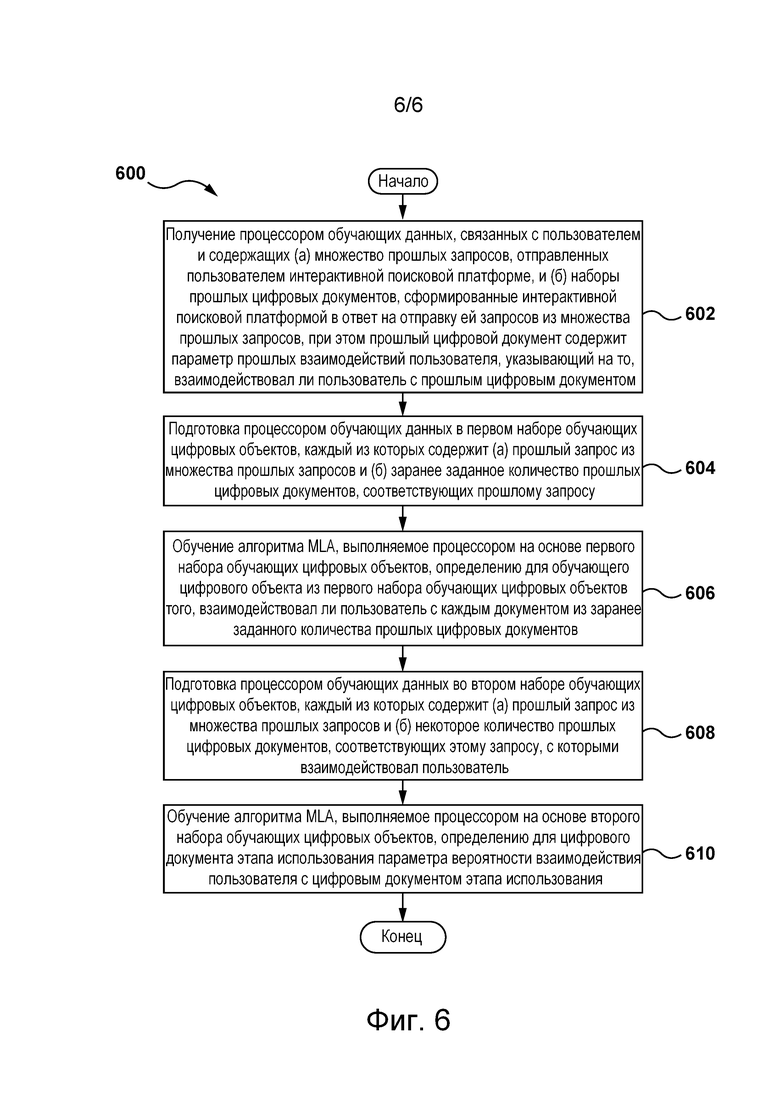

[048] На фиг. 6 приведена блок-схема способа обучения модели машинного обучения, представленной на фиг. 3, определению значений вероятности взаимодействия пользователя с цифровыми документами согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

Осуществление изобретения

[049] Представленные здесь примеры и условный язык предназначены для обеспечения лучшего понимания принципов настоящей технологии, а не для ограничения ее объема до таких специально приведенных примеров и условий. Очевидно, что специалисты в данной области техники способны разработать различные способы и устройства, которые явно не описаны и не показаны, но реализуют принципы настоящей технологии в пределах ее существа и объема.

[050] Кроме того, чтобы способствовать лучшему пониманию, последующее описание может содержать упрощенные варианты реализации настоящей технологии. Специалистам в данной области должно быть понятно, что другие варианты осуществления настоящей технологии могут быть значительно сложнее.

[051] В некоторых случаях приводятся полезные примеры модификаций настоящей технологии. Они способствуют пониманию, но также не определяют объема или границ настоящей технологии. Представленный перечень модификаций не является исчерпывающим и специалист в данной области может разработать другие модификации в пределах объема настоящей технологии. Кроме того, если в некоторых случаях модификации не описаны, это не означает, что они невозможны и/или что описание содержит единственно возможный вариант реализации того или иного элемента настоящей технологии.

[052] Описание принципов, аспектов и вариантов реализации настоящей технологии, а также их конкретные примеры предназначены для охвата их структурных и функциональных эквивалентов, независимо от того, известны они в настоящее время или будут разработаны в будущем. Например, специалистам в данной области техники должно быть понятно, что любые описанные здесь структурные схемы соответствуют концептуальным представлениям иллюстративных принципиальных схем, реализующих основы настоящей технологии. Также должно быть понятно, что любые блок-схемы, схемы процессов, диаграммы изменения состояния, псевдокоды и т.п. соответствуют различным процессам, которые могут быть представлены на машиночитаемом физическом носителе информации и могут выполняться компьютером или процессором, независимо от того, показан такой компьютер или процессор явно или нет.

[053] Функции различных элементов, показанных на чертежах, включая любой функциональный блок, обозначенный как «процессор» или «графический процессор», могут быть реализованы с использованием специализированных аппаратных средств, а также с использованием аппаратных средств, способных выполнять соответствующее программное обеспечение. Если используется процессор, эти функции могут выполняться одним выделенным процессором, одним совместно используемым процессором и/или множеством отдельных процессоров, некоторые из которых могут использоваться совместно. В некоторых вариантах осуществления настоящей технологии процессор может представлять собой процессор общего назначения, такой как центральный процессор (CPU), или специализированный процессор, такой как графический процессор (GPU). Кроме того, явное использование термина «процессор» или «контроллер» не должно трактоваться как указание исключительно на аппаратные средства, способные выполнять программное обеспечение, и может подразумевать, помимо прочего, аппаратные средства цифрового сигнального процессора (DSP), сетевой процессор, специализированную интегральную схему (ASIC), программируемую вентильную матрицу (FPGA), ПЗУ для хранения программного обеспечения, ОЗУ и/или энергонезависимое запоминающее устройство. Также могут подразумеваться другие аппаратные средства, общего назначения и/или заказные.

[054] Программные модули или просто модули, реализация которых предполагается в виде программных средств, могут быть представлены здесь как любое сочетание элементов блок-схемы или других элементов, указывающих на выполнение шагов процесса и/или содержащих текстовое описание. Такие модули могут выполняться аппаратными средствами, показанными явно или подразумеваемыми.

[055] Далее с учетом вышеизложенных принципов рассмотрены некоторые не имеющие ограничительного характера примеры, иллюстрирующие различные варианты реализации аспектов настоящей технологии.

Компьютерная система

[056] На фиг. 1 представлена компьютерная система 100, пригодная для использования в некоторых вариантах осуществления настоящей технологии. Вычислительная система 100 содержит различные аппаратные элементы, включая один или несколько одно- или многоядерных процессоров, обобщенно представленных процессором 110, процессор 111 GPU, твердотельный накопитель 120, ОЗУ 130, интерфейс 140 дисплея и интерфейс 150 ввода-вывода.

[057] Связь между различными элементами компьютерной системы 100 может осуществляться через одну или несколько внутренних и/или внешних шин 160 (таких как шина PCI, шина USB, шина FireWire стандарта IEEE 1394, шина SCSI, шина Serial-ATA и т.д.), с которыми различные аппаратные элементы соединены электронными средствами.

[058] Интерфейс 150 ввода-вывода может быть связан с сенсорным экраном 190 и/или с одной или несколькими внутренними и/или внешними шинами 160. Сенсорный экран 190 может входить в состав дисплея. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сенсорный экран 190 представляет собой дисплей. Сенсорный экран 190 может также называться экраном 190. В представленных на фиг. 1 вариантах осуществления изобретения сенсорный экран 190 содержит сенсорные аппаратные средства 194 (например, чувствительные к нажатию ячейки, встроенные в слой дисплея и позволяющие фиксировать физическое взаимодействие между пользователем и дисплеем) и контроллер 192 ввода-вывода для сенсорных устройств, который обеспечивает связь с интерфейсом 140 дисплея и/или с одной или несколькими внутренними и/или внешними шинами 160. В некоторых вариантах осуществления изобретения интерфейс 150 ввода-вывода может соединяться с клавиатурой (не показана), мышью (не показана) или сенсорной площадкой (не показана), которые обеспечивают взаимодействие пользователя с компьютерной системой 100 в дополнение к сенсорному экрану 190 или вместо него.

[059] Следует отметить, что в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии некоторые элементы компьютерной системы 100 могут отсутствовать. Например, может отсутствовать сенсорный экран 190, в частности, если компьютерная система реализована в виде сервера, но не ограничиваясь этим.

[060] Согласно вариантам осуществления настоящей технологии, твердотельный накопитель 120 хранит программные команды, пригодные для загрузки в ОЗУ 130 и исполнения процессором 110 и/или процессором 111 GPU. Программные команды могут, например, входить в состав библиотеки или приложения.

Вычислительная сетевая среда

[061] На фиг. 2 представлена схема вычислительной сетевой среды 200, пригодной для использования с некоторыми не имеющими ограничительного характера вариантами осуществления систем и/или способов согласно настоящей технологии. Вычислительная сетевая среда 200 содержит сервер 202, соединенный с электронным устройством 204 через сеть 208 связи. В не имеющих ограничительного характера вариантах осуществления настоящей технологии электронное устройство 204 может быть связано с пользователем 216.

[062] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии электронное устройство 204 может представлять собой любые компьютерные аппаратные средства, способные выполнять программы, подходящие для решения поставленной задачи. Таким образом, некоторые не имеющие ограничительного характера примеры электронного устройства 204 могут включать в себя персональные компьютеры (настольные, ноутбуки, нетбуки и т.п.), смартфоны и планшеты. Должно быть понятно, что в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии электронное устройство 204 может быть не единственным электронным устройством, связанным с пользователем 216, который может быть связан с другими электронными устройствами (не показаны на фиг. 2), имеющим доступ к интерактивной поисковой платформе 210 через сеть 208 связи, без выхода за границы настоящей технологии.

[063] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 реализован в виде традиционного компьютерного сервера и может содержать некоторые или все элементы компьютерной системы 100, представленной на фиг. 1. В конкретном не имеющем ограничительного характера примере сервер 202 реализован в виде сервера Dell™ PowerEdge™, работающего под управлением операционной системы Microsoft™ Windows Server™, но он также может быть реализован с использованием любых других подходящих аппаратных средств, прикладного программного обеспечения и/или встроенного программного обеспечения либо их сочетания. В представленных не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 представляет собой один сервер. В других не имеющих ограничительного характера вариантах осуществления настоящей технологии (не показаны) функции сервера 202 могут быть распределены между несколькими серверами.

[064] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может содержать интерактивную поисковую платформу 210. В общем случае интерактивная поисковая платформа 210 соответствует программной веб-системе, способной выполнять поиски в ответ на отправленные ей поисковые запросы. Виды результатов поиска, которые интерактивная поисковая платформа 210 способна предоставлять в ответ на поисковые запросы, обычно зависят от конкретного варианта реализации интерактивной поисковой платформы 210. Например, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии интерактивная поисковая платформа 210 может быть реализована в виде поисковой системы (такой как поисковая система Google™, поисковая система Yandex™ и т.п.), а результаты поиска могут включать в себя цифровые документы различных видов, такие как цифровые аудиодокументы (например, песни, записи речи, подкасты), цифровые видеодокументы (например, видеоклипы, фильмы, мультипликацию), текстовые цифровые документы и т.д. Кроме того, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии интерактивная поисковая платформа 210 может быть реализована в виде платформы интерактивных списков (такой как платформа интерактивных списков Yandex™ Market™), а результаты поиска могут включать в себя цифровые документы, содержащие рекламу различных элементов, таких как товары и услуги. Также возможны другие варианты реализации интерактивной поисковой платформы 210.

[065] Таким образом, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может быть связан с поисковой базой 206 данных, способной хранить информацию о цифровых документах, потенциально доступных через сеть 208 связи, в частности, электронному устройству 204. С этой целью поисковая база 206 данных может быть предварительно наполнена указаниями на цифровые документы, например, с использованием процесса обхода, который в некоторых не имеющих ограничительного характера вариантах осуществления изобретения может, в частности, быть реализован сервером 202. Например, в дополнительных не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может хранить в поисковой базе 206 данных данные, указывающие на каждый поиск, выполненный пользователем 216 на интерактивной поисковой платформе 210, в частности, поисковые запросы и наборы соответствующих им цифровых документов, а также их метаданные.

[066] Кроме того, несмотря на то, что в представленных на фиг. 2 вариантах осуществления изобретения поисковая база 206 данных показана в виде одного элемента, должно быть понятно, что в других не имеющих ограничительного характера вариантах осуществления настоящей технологии функции поисковой базы 206 данных могут быть распределены между несколькими базами данных. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии поисковая база 206 данных может быть доступна серверу 202 через сеть 208 связи, а не через прямую линию связи (отдельно не обозначена), как показано на фиг. 2.

[067] Таким образом, пользователь 216 с использованием электронного устройства 204 может отправлять запрос 212 интерактивной поисковой платформе 210, способной определять в поисковой базе 206 данных набор 214 цифровых документов, соответствующих запросу 212. Кроме того, чтобы способствовать навигации пользователя в наборе 214 цифровых документов, может потребоваться их ранжирование, например, по степени их релевантности запросу 212.

[068] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии степень релевантности каждого документа из набора 214 цифровых документов для пользователя 216 может быть представлена соответствующим значением вероятности взаимодействия пользователя 216 с каждым документом из набора 214 цифровых документов. Например, согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, взаимодействие с цифровым документом может включать в себя (а) выполнение пользователем 216 по меньшей мере одного «клика» на цифровом документе и/или (б) выполнение пользователем 216 «длинного клика» на цифровом документе, например, когда пользователь взаимодействует с цифровым документом более заранее заданного периода времени (например, более 120 секунд), и/или (в) пребывание пользователя 216 на цифровом документе из набора 214 цифровых документов в течение заранее заданного периода времени и т.п. Должно быть понятно, что также возможны пользовательские действия других видов, выполняемые пользователем 216 в отношении цифровых документов без выхода за границы настоящей технологии.

[069] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии для определения соответствующего значения вероятности для каждого документа из набора 214 цифровых документов сервер 202 может обучать и затем применять алгоритм 218 MLA. В общем случае можно сказать, что сервер 202 должен выполнять два соответствующих процесса в отношении алгоритма 218 MLA. Первый из этих двух процессов представляет собой процесс обучения, в котором сервер 202 может на основе обучающего набора данных обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя 216 с цифровыми документами из набора 214 цифровых документов (описано ниже со ссылкой на фиг. 3-5). Второй процесс представляет собой процесс этапа использования, на котором сервер 202 выполняет обученный таким образом алгоритм 218 MLA для определения соответствующих значений вероятности (описано ниже) согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

[070] Разработчики настоящей технологии установили, что определение соответствующего значения вероятности для каждого документа из набора 214 цифровых документов может быть более эффективным и/или точным, если алгоритм 218 MLA обучается подобно алгоритмам MLA для обработки естественного языка, способным определять отсутствующие токены в тексте (такие как слова, фонемы, слоги и т.п.) на основе контекста, обеспечиваемого соседними токенами. Таким образом, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии алгоритм 218 MLA может быть реализован в виде алгоритма MLA на основе трансформера, такого как алгоритм BERT MLA, архитектура которого и формирование для него обучающего набора данных описаны ниже согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии со ссылкой на фиг. 3-5.

Сеть связи

[071] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сеть 208 связи представляет собой сеть Интернет. В альтернативных не имеющих ограничительного характера вариантах осуществления настоящей технологии сеть 208 связи может быть реализована в виде любой подходящей локальной сети (LAN, Local Area Network), глобальной сети (WAN, Wide Area Network), частной сети связи и т.п. Очевидно, что варианты осуществления сети связи приведены лишь в иллюстративных целях. Реализация соответствующих линий связи (отдельно не обозначены) между сервером 202, электронным устройством 204 и сетью 208 связи зависит, среди прочего, от реализации сервера 202 и электронного устройства 204. Лишь в качестве примера, не имеющего ограничительного характера, в тех вариантах осуществления настоящей технологии, где электронное устройство 204 реализовано в виде устройства беспроводной связи, такого как смартфон, линия связи может быть реализована в виде беспроводной линии связи. Примеры беспроводных линий связи включают в себя канал сети связи 3G, канал сети связи 4G и т.д. В сети 208 связи также может использоваться беспроводное соединение с сервером 202.

Архитектура модели машинного обучения

[072] На фиг. 3 представлена блок-схема архитектуры алгоритма 218 MLA согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии. Как отмечено выше, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии алгоритм 218 MLA может быть основан на модели машинного обучения BERT, как описано, например, в указанной выше работе (Devlin et al.). Подобно модели BERT, алгоритм 218 MLA содержит стек 302 трансформеров, состоящий из блоков трансформеров и содержащий, например, блоки 304, 306 и 308 трансформеров.

[073] Каждый из блоков 304, 306 и 308 трансформеров содержит блок кодера трансформера, например, как описано в указанной выше работе (Vaswani et al.). Каждый из блоков 304, 306 и 308 трансформеров содержит слой 320 многоголового внимания (показан для иллюстрации лишь в блоке 304 трансформера) и слой 322 нейронной сети прямого распространения (также для иллюстрации показан лишь в блоке 304 трансформера). Блоки 304, 306 и 308 обычно имеют одинаковую структуру, но приобретают различные веса (после обучения). В слое 320 многоголового внимания реализованы зависимости между входными данными блока трансформера, которые, например, могут использоваться с целью предоставления контекстной информации для каждого элемента входных данных на основе каждого другого элемента входных данных блока трансформера. В слое 322 нейронной сети прямого распространения такие зависимости обычно отсутствуют, поэтому входные данные слоя 322 нейронной сети прямого распространения могут обрабатываться параллельно. Должно быть понятно, что, несмотря на то, что на фиг. 3 показано лишь три блока трансформеров (блоки 304, 306 и 308 трансформеров), в практических вариантах реализации настоящей технологии стек 302 трансформеров может содержать намного больше таких блоков трансформеров. Например, в некоторых вариантах реализации изобретения в стеке 302 трансформеров может использоваться 12 блоков трансформеров.

[074] Входные данные 330 стека 302 трансформеров содержат токены, такие как токен 332 [CLS] и токены 334. Токены 334 могут, например, представлять собой слова или части слов. Токен 332 [CLS] используется в качестве представления для классификации всего набора токенов 334. Каждый токен 334 и токен 332 [CLS] представлен вектором. В некоторых вариантах осуществления изобретения длина каждого из этих векторов может, например, соответствовать 768 значениям с плавающей запятой. Должно быть понятно, что для эффективного уменьшения размеров (размерности) векторов может использоваться множество способов сжатия. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии в качестве входных данных 330 стека 302 трансформеров может использоваться фиксированное количество токенов 334. Например, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии может использоваться 1024 токена, а в других вариантах осуществления изобретения стек 302 трансформеров может получать 512 токенов (помимо токена 332 [CLS]). Входные данные 330 меньшей длины, чем это фиксированное количество токенов 334, могут быть дополнены до фиксированной длины, например, путем добавления заполняющих токенов.

[075] В некоторых вариантах осуществления изобретения входные данные 330 могут быть сформированы из обучающего цифрового объекта 336, такого как по меньшей мере один прошлый цифровой документ и связанный с ним прошлый запрос, с использованием токенизатора 338, как описано ниже. Архитектура токенизатора 338 обычно зависит от обучающего цифрового объекта 336, используемого в качестве входных данных токенизатора 338. Например, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии для формирования входных данных 330 в токенизаторе 338 могут использоваться известные способы кодирования, такие как кодирование пар байтов, а также могут использоваться предварительно обученные нейронные сети.

[076] Тем не менее, в других не имеющих ограничительного характера вариантах осуществления настоящей технологии токенизатор 338 может быть реализован на основе используемой в моделях обучения BERT схемы кодирования пар байтов WordPiece с достаточно большим размером словаря. Например, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии размер словаря может соответствовать приблизительно 120 000 токенов. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии входные данные 330 могут быть обработаны до применения токенизатора 338. Например, все слова входных данных 330 могут быть преобразованы в строчные буквы, а также может быть выполнена нормализация Unicode NFC. Схема кодирования пар байтов WordPiece, которая может быть использована в некоторых вариантах осуществления изобретения для построения словаря токенов, описана, например, в работе Rico Sennrich et al., «Neural Machine Translation of Rare Words with Subword Units», Proceedings of the 54th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers), pages 1715–1725, 2016.

[077] Выходные данные 350 стека 302 трансформеров содержат выходные данные 352 [CLS] и вектор выходных данных 354, включая соответствующее выходное значение для каждого токена 334 из входных данных 330 стека 302 трансформеров. Затем выходные данные 350 могут быть отправлены модулю 370 задачи. Как показано на фиг. 3, в некоторых вариантах осуществления изобретения модуль 370 задачи использует только выходные данные 352 [CLS], которые представляют весь вектор выходных данных 354. Это может быть наиболее полезно, когда модуль 270 задачи используется в качестве классификатора или для вывода метки либо значения, характеризующего весь входной обучающий цифровой объект 336, например, для формирования оценки релевантности, такой как соответствующее значение вероятности взаимодействия пользователя 216 с цифровым документом, как описано выше. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии (не показано на фиг. 3) все или некоторые значения вектора выходных данных 354 и, возможно, выходные данные 352 [CLS] могут использоваться в качестве входных данных модуля 370 задачи. Это может быть наиболее полезно, когда модуль 370 задачи используется с целью формирования меток или значений для каждого токена 334 из входных данных 330, например, для предсказания замаскированного либо отсутствующего токена или для распознавания именованного объекта. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии модуль 370 задачи может содержать нейронную сеть прямого распространения (не показана), формирующую зависящий от задачи результат 380, такой как оценка релевантности или вероятность «клика». Другие модели также могут использоваться в модуле 370 задачи. Например, модуль 370 задачи может представлять собой трансформер или нейронную сеть другого вида. Кроме того, зависящий от задачи результат 380 может использоваться в качестве входных данных для других моделей, таких как модель CatBoost, как описано в работе Dorogush et al., «CatBoost: gradient boosting with categorical features support», NIPS 2017.

[078] Должно быть понятно, что архитектура алгоритма 218 MLA, описанная выше со ссылкой на фиг. 3, упрощена для ясности и лучшего понимания некоторых не имеющих ограничительного характера вариантов осуществления настоящей технологии. Например, в фактических вариантах реализации алгоритма 218 MLA каждый из блоков 304, 306 и 308 трансформеров может содержать операции нормализации слоя, модуль 370 задачи может содержать функцию нормализации softmax и т.д. Специалистам в данной области должно быть понятно, что эти операции широко используются в нейронных сетях и моделях глубокого обучения, таких как алгоритм 218 MLA.

Процесс обучения

[079] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, сервер 202 может получать обучающие данные и на их основе обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя 216 с каждым документом из набора 214 цифровых документов.

[080] На фиг. 4 представлена структура обучающих данных 402, связанных с пользователем 216, и один из подходов к их подготовке для обучения алгоритма 218 MLA согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

[081] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии обучающие данные 402 могут содержать данные прошлых поисков, выполненных пользователем 216 с использованием интерактивной поисковой платформы 210. Например, сервер 202 может получать через сеть 208 связи данные прошлых поисков, выполненных пользователем 216, от по меньшей мере одного связанного с ним электронного устройства, такого как электронное устройство 204, описанное выше. Тем не менее, в других не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может получать данные прошлых поисков из поисковой базы 206 данных. Кроме того, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии обучающие данные 402 могут содержать данные заранее заданного количества прошлых поисков, ранее выполненных пользователем 216, например, 256 или 128 поисков. В других не имеющих ограничительного характера вариантах осуществления настоящей технологии обучающие данные 402 могут содержать данные прошлых поисков, выполненных пользователем 216 в течение заранее заданного периода времени, такого как один месяц, одна неделя и т.п.

[082] В частности, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии обучающие данные 402 могут содержать множество прошлых запросов, отправленных пользователем 216 интерактивной поисковой платформе 210, таких как прошлый запрос 404. Кроме того, для прошлого запроса 404 в обучающих данных 402 может дополнительно содержаться набор 406 прошлых цифровых документов, сформированный интерактивной поисковой платформой 210 в ответ на получение прошлого запроса 404. Кроме того, прошлый цифровой документ 408 из набора 406 прошлых цифровых документов содержит метку 410, указывающую на прошлое взаимодействие пользователя 216 с прошлым цифровым документом 408 после получения набора 406 прошлых цифровых документов.

[083] Как описано выше, прошлый цифровой документ 408 может содержать элементы электронного медиаконтента различных форматов и видов, которые пригодны для передачи, получения, хранения и отображения на электронном устройстве 204 с использованием подходящего программного обеспечения, например, такого как браузер.

[084] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, прошлое взаимодействие пользователя 216 с прошлым цифровым документом 408 может включать в себя, например, (а) «клик» пользователя 216 на прошлом цифровом документе 408 и/или (б) «длинный клик» на прошлом цифровом документе 408, когда пользователь после выполнения на нем «клика» взаимодействует с прошлым цифровым документом 408 в течение заранее заданного периода времени (например, 120 секунд), и/или (в) пребывание на прошлом цифровом документе 408 в течение заранее заданного периода времени (такого как 10 секунд).

[085] Таким образом, метка 410 может представлять собой двоичное значение, такое как 1 (или «положительное»), если пользователь 216 взаимодействовал с прошлым цифровым документом 408 (например, выполнил «клик»), или 0 (или «отрицательное»), если пользователь 216 не взаимодействовал с прошлым цифровым документом 408 после получения набора 406 прошлых цифровых документов.

[086] В дополнительных не имеющих ограничительного характера вариантах осуществления настоящей технологии прошлый запрос 404 может дополнительно содержать метаданные запроса (не показаны), такие как географический регион, из которого пользователь 216 отправил прошлый запрос 404, и т.п. Подобным образом, прошлый цифровой документ 408 может дополнительно содержать метаданные документа (не показаны), такие как его заголовок и веб-адрес (например, в виде универсального указателя ресурсов (URL, Universal Resource Locator)).

[087] Кроме того, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя 216 с каждым документом из набора 214 цифровых документов, описанных выше, на двух этапах. В частности, на первом этапе обучения сервер 202 может обучать алгоритм 218 MLA определению того, взаимодействовал ли пользователь 216 с прошлым цифровым документом 408, т.е. определять значение связанной с ним метки 410. Затем на втором этапе обучения сервер 202 может обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя 216 с цифровыми документами этапа использования, такими как каждый документ из набора 214 цифровых документов, имея доступ к весам, сформированным на первом этапе обучения. В частности, можно сказать, что на первом этапе обучения сервер 202 определяет первоначальные веса блоков 304, 306 и 308 трансформеров, как описано выше, а на втором этапе обучения сервер 202 может точно настраивать определенные таким образом первоначальные веса блоков 304, 306 и 308 трансформеров алгоритма 218 MLA.

[088] Таким образом, для первого и второго этапов обучения алгоритма 218 MLA сервер 202 может подготавливать обучающие данные 402 в двух различных обучающих наборах данных, как описано ниже.

[089] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии для обучения алгоритма 218 MLA на первом этапе обучения сервер 202 может подготавливать обучающие данные 402 в первом наборе 420 обучающих цифровых объектов (см. фиг. 4).

[090] Объект из первого набора 420 обучающих цифровых объектов содержит (а) прошлый запрос 404 и (б) первый набор 422 прошлых цифровых документов. Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, каждый документ из первого набора 422 прошлых цифровых документов выбирается из набора 406 прошлых цифровых документов, сформированного интерактивной поисковой платформой 210 в ответ на отправку пользователем 216 прошлого запроса 404, но без данных связанных с ними соответствующих меток, таких как метка 410, связанная с прошлым цифровым документом 408. Иными словами, на первом этапе обучения алгоритм 218 MLA не осведомлен о значении метки 410 и обучается ее прогнозированию на основе контекста, обеспечиваемого по меньшей мере одним связанным с ней прошлым цифровым документом 408 и прошлым запросом 404.

[091] Должно быть понятно, что не накладывается каких-либо ограничений на то, как каждый документ из первого набора 422 прошлых цифровых документов выбирается из набора 406 прошлых цифровых документов. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии первый набор 422 прошлых цифровых документов может содержать все прошлые цифровые документы из набора 406 прошлых цифровых документов. Тем не менее, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии первый набор 422 прошлых цифровых документов может содержать заранее заданное количество прошлых цифровых документов из набора 406 прошлых цифровых документов, например, три, пять или двадцать. В других не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может выбирать каждый объект из заранее заданного количества обучающих цифровых объектов из набора 406 прошлых цифровых документов случайным образом, например, на основе заранее заданного распределения, такого как нормальное. В других не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может выбирать каждый объект из заранее заданного количества обучающих цифровых объектов из набора 406 прошлых цифровых документов, расположенный в заранее заданной позиции в наборе 406 прошлых цифровых документов, такой как пятая, десятая, тридцать вторая и т.п.

[092] Кроме того, как описано выше со ссылкой на фиг. 3, с использованием токенизатора 338 сервер 202 может преобразовывать объект из первого набора 420 обучающих цифровых объектов в соответствующий токен и предоставлять его алгоритму 218 MLA в качестве части входных данных 330 для обучения алгоритма 218 MLA определению значений соответствующих меток, связанных с документами из первого набора 422 прошлых цифровых документов в первом наборе 420 обучающих цифровых объектов, т.е. определению того, взаимодействовал ли с ними пользователь 216.

[093] Таким образом, в результате подготовки обучающих данных 402 в первом наборе 420 обучающих цифровых объектов алгоритму 218 MLA предоставляется больше токенов во входных данных 330, для которых алгоритм 218 MLA обучается формировать соответствующее значение вектора выходных данных 354, определяя таким образом первоначальные веса блоков 304, 306 и 308 трансформеров. Например, первоначальные веса могут быть определены и дополнительно скорректированы на основе различия или расстояния между прогнозируемыми значениями меток, связанных с каждым документом из первого набора 422 прошлых цифровых документов, и контрольными значениями, т.е. фактическими их значениями, полученными в качестве части обучающих данных 402. Например, сервер 202 может определять различие с использованием функции потерь, такой как функция потерь кросс-энтропии, и дополнительно корректировать первоначальные веса блоков 304, 306 и 308 трансформеров для минимизации различия между прогнозируемыми и фактическими значениями соответствующих меток.

[094] Должно быть понятно, что в не имеющих ограничительного характера вариантах осуществления настоящей технологии также возможны другие варианты реализации функции потерь, например, функция потерь среднеквадратичной ошибки, функция потерь по Губеру, кусочно-линейная функция потерь и т.д.

[095] На фиг. 5 представлена схема подготовки сервером 202 обучающих данных 402 во втором наборе 520 обучающих цифровых объектов для обучения алгоритма 218 MLA на втором этапе обучения согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии.

[096] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, объект из второго набора 520 обучающих цифровых объектов содержит (а) прошлый запрос 404 и (б) второй набор 522 прошлых цифровых документов, выбранных сервером 202 из набора 406 прошлых цифровых документов. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может выбирать каждый документ из второго набора 522 прошлых цифровых документов, имеющий заранее заданное значение взаимодействия пользователя с ним, представленное метками, например, соответствующим значением метки 410, связанной с прошлым цифровым документом 408. В частности, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может выбирать для включения в состав второго набора 522 прошлых цифровых документов только те документы из набора 406 прошлых цифровых документов, с которыми связаны метки с положительными значениями, такие как положительная метка 526, связанная с другим прошлым цифровым документом 524. Иными словами, в этих вариантах осуществления изобретения сервер 202 может добавлять только те прошлые цифровые документы, с которыми взаимодействовал пользователь 216, например, выполнил на них «клик».

[097] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии общее количество обучающих цифровых объектов во втором наборе 520 обучающих цифровых объектов может быть тем же, что и в первом наборе 420 обучающих цифровых объектов. Тем не менее, в тех вариантах осуществления настоящей технологии, где обучающие данные 402 содержат соответствующие наборы прошлых цифровых документов, ни с одним из которых не взаимодействовал пользователь 216, общее количество обучающих цифровых объектов во втором наборе 520 обучающих цифровых объектов может быть меньшим, чем в первом наборе 420 обучающих цифровых объектов.

[098] В других не имеющих ограничительного характера вариантах осуществления настоящей технологии общее количество объектов в первом наборе 420 обучающих цифровых объектов и во втором наборе 520 обучающих цифровых объектов может быть задано заранее и может, например, быть равно 100, 200 или 300, как описано выше со ссылкой на фиг. 4 и 5, соответственно.

[099] Кроме того, как и на первом этапе обучения, сервер 202 может преобразовывать каждый объект из второго набора 520 обучающих цифровых объектов в токен с использованием токенизатора 338 и предоставлять сформированные таким образом токены алгоритму 218 MLA, обучая таким образом алгоритм 218 MLA определению значений вероятности взаимодействия пользователя 216 с цифровыми документами этапа использования, такими как набор 214 цифровых документов, сформированный в ответ на отправку пользователем 216 запроса 212.

[0100] В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 также может использовать сформированные таким образом значения вероятности взаимодействия пользователя 216 с цифровыми документами этапа использования и соответствующие положительные метки, связанные с каждым прошлым цифровым документом из второго набора 520 обучающих цифровых объектов, для определения различия между ними с использованием функции потерь, как описано выше. Кроме того, сервер 202 может минимизировать это различие путем корректировки первоначальных весов блоков 304, 306 и 308 трансформеров, определенных на первом этапе обучения.

[0101] Сервер 202 может использовать алгоритм 218 MLA со скорректированными таким образом весами блоков 304, 306 и 308 трансформеров для определения соответствующих значений вероятности взаимодействия пользователя 216 с цифровыми документами этапа использования, например, с набором 214 цифровых документов, сформированным в ответ на отправку пользователем 216 запроса 212, как описано выше со ссылкой на фиг. 2.

Процесс этапа использования

[0102] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, в ходе этапа использования сервер 202 может получать набор 214 цифровых документов. Кроме того, сервер 202 может подготавливать набор 214 цифровых документов в наборе цифровых объектов этапа использования, каждый из которых содержит (а) запрос 212 и (б) соответствующий цифровой документ из набора 214 цифровых документов. В дополнительных не имеющих ограничительного характера вариантах осуществления настоящей технологии цифровые объекты этапа использования могут содержать метаданные, связанные с запросом 212, и метаданные документа, связанные с каждым документом из набора 214 цифровых документов, как описано выше.

[0103] Кроме того, сервер 202 может токенизировать, например, с помощью описанного выше токенизатора 338, каждый объект из набора цифровых объектов этапа использования и предоставлять полученные в результате токены алгоритму 218 MLA в качестве входных данных 330. Таким образом, на основе контекста, обеспечиваемого соседними токенами из входных данных 330, алгоритм 218 MLA может прогнозировать для токена соответствующее значение вероятности взаимодействия пользователя 216 с соответствующим документом из набора 214 цифровых документов, связанным с этим токеном.

[0104] Кроме того, сервер 202 может использовать определенные таким образом значения вероятности для ранжирования набора 214 цифровых документов. С этой целью в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может предоставлять значения вероятности, определенные алгоритмом 218 MLA, в качестве входных данных другому алгоритму MLA (не показан), способному ранжировать цифровые документы на основе по меньшей мере значений вероятности взаимодействия с ними пользователя, такого как пользователь 216. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии другой алгоритм MLA может включать в себя ансамбль деревьев решений CatBoost, как описано выше. Таким образом, другой алгоритм MLA может формировать ранжированный набор цифровых документов.

[0105] Кроме того, сервер 202 может выбирать N цифровых документов с наибольшим рангом из ранжированного набора цифровых документов для отправки указаний на них электронному устройству 204 пользователя 216, например, через соответствующий клиентский интерфейс (не показан) интерактивной поисковой платформы 210.

Способ

[0106] Описанные выше архитектура и примеры позволяют выполнять способ обучения алгоритма MLA для ранжирования цифровых документов, такого как описанный выше алгоритм 218 MLA. На фиг. 6 представлена блок-схема способа 600 согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии. Способ 600 может выполняться сервером 202.

Шаг 602: получение процессором обучающих данных, связанных с пользователем и содержащих (а) множество прошлых запросов, отправленных пользователем интерактивной поисковой платформе, и (б) наборы прошлых цифровых документов, сформированные интерактивной поисковой платформой в ответ на отправку ей запросов из множества прошлых запросов, при этом прошлый цифровой документ содержит параметр прошлых взаимодействий пользователя, указывающий на то, взаимодействовал ли пользователь с этим прошлым цифровым документом.

[0107] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, на шаге 602 сервер 202 может получать обучающие данные 402, связанные с пользователем 216, для обучения алгоритма 218 MLA.

[0108] Согласно некоторым не имеющим ограничительного характера вариантам осуществления настоящей технологии, алгоритм 218 MLA может включать в себя алгоритм MLA на основе трансформера, такой как алгоритм BERT MLA, архитектура которого описана выше со ссылкой на фиг. 3.

[0109] Как описано выше со ссылкой на фиг. 4, обучающие данные 402 могут содержать: (1) множество прошлых запросов, отправленных пользователем 216 интерактивной поисковой платформе 210; (2) соответствующие наборы прошлых цифровых документов, такие как набор 406 прошлых цифровых документов, сформированный интерактивной поисковой платформой 210 в ответ на получение прошлого запроса 404, при этом (3) прошлый цифровой документ 408 из набора 406 прошлых цифровых документов содержит метку 410, указывающую на прошлое взаимодействие пользователя 216 с прошлым цифровым документом 408 после получения набора 406 прошлых цифровых документов.

[0110] В дополнительных не имеющих ограничительного характера вариантах осуществления настоящей технологии прошлый запрос 404 может дополнительно содержать метаданные запроса (не показаны), такие как географический регион, из которого пользователь 216 отправил прошлый запрос 404, и т.п. Подобным образом, прошлый цифровой документ 408 может дополнительно содержать метаданные документа (не показаны), такие как его заголовок, его веб-адрес (например, в виде URL-адреса).

[0111] Например, в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может получать обучающие данные 402, связанные с пользователем 216, от электронного устройства 204 через сеть 208 связи. Тем не менее, в других не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может получать обучающие данные 402 из связанной с ним поисковой базы 206 данных.

[0112] Затем способ 600 переходит к шагу 604.

Шаг 604: подготовка процессором обучающих данных в первом наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) заранее заданное количество прошлых цифровых документов, соответствующих прошлому запросу.

[0113] На шаге 604 сервер 202 может подготавливать обучающие данные 402 в первом наборе 420 обучающих цифровых объектов для обучения алгоритма 218 MLA на первом этапе обучения определению прошлых взаимодействий пользователя 216 с каждым прошлым цифровым документом из обучающих данных 402, таким как прошлый цифровой документ 408.

[0114] Как описано выше со ссылкой на фиг. 4, объект из первого набора 420 обучающих цифровых объектов содержит (а) прошлый запрос 404 и (б) первый набор 422 прошлых цифровых документов, выбранных из набора 406 прошлых цифровых документов. Каждый документ из первого набора 422 прошлых цифровых документов выбирается из набора 406 прошлых цифровых документов без данных связанных с ними соответствующих меток, таких как метка 410, связанная с прошлым цифровым документом 408.

[0115] Способ 600 продолжается на шаге 606.

Шаг 606: обучение алгоритма MLA, выполняемое процессором на основе первого набора обучающих цифровых объектов, определению для обучающего цифрового объекта из первого набора обучающих цифровых объектов того, взаимодействовал ли пользователь с каждым документом из заранее заданного количества прошлых цифровых документов.

[0116] Как описано выше со ссылкой на фиг. 3 и 4, с использованием первого набора 420 обучающих цифровых объектов сервер 202 может обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя с каждым документом из первого набора 422 прошлых цифровых документов, связанных с объектом из первого набора 420 обучающих цифровых объектов.

[0117] В частности, сервер 202 может преобразовывать объект из первого набора 420 обучающих цифровых объектов в соответствующий токен и предоставлять его алгоритму 218 MLA в качестве части входных данных 330 для обучения алгоритма 218 MLA определению значений соответствующих меток, связанных с документами из первого набора 422 прошлых цифровых документов из первого набора 420 обучающих цифровых объектов, т.е. определению того, взаимодействовал с ними пользователь 216 или нет.

[0118] Иными словами, на первом этапе обучения алгоритм 218 MLA не осведомлен о значениях соответствующих меток, связанных с документами из первого набора 422 прошлых цифровых документов, и обучается их прогнозированию на основе контекста, обеспечиваемого прошлыми документами и прошлым запросом 404, который использовался для их определения.

[0119] Способ 600 продолжается на шаге 608.

Шаг 608: подготовка процессором обучающих данных во втором наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) некоторое количество прошлых цифровых документов, соответствующих этому запросу, с которыми взаимодействовал пользователь.

[0120] На шаге 608, как описано выше со ссылкой на фиг. 5, сервер 202 может подготавливать обучающие данные 402 во втором наборе 520 обучающих цифровых объектов для обучения алгоритма 218 MLA на втором этапе обучения.

[0121] В частности, как описано выше со ссылкой на фиг. 5, объект из второго набора 520 обучающих цифровых объектов содержит (а) прошлый запрос 404 и (б) второй набор 522 прошлых цифровых документов, выбранных сервером 202 из набора 406 прошлых цифровых документов, с которыми связаны соответствующие метки с положительными значениями.

[0122] Способ 600 продолжается на шаге 610.

Шаг 610: обучение алгоритма MLA, выполняемое процессором на основе второго набора обучающих цифровых объектов, определению для цифрового документа этапа использования параметра вероятности взаимодействия пользователя с этим цифровым документом этапа использования.

[0123] Сформировав второй набор 520 обучающих цифровых объектов, сервер 202 может обучать алгоритм 218 MLA определению соответствующих значений вероятности взаимодействия пользователя 216 с цифровыми документами этапа использования, такими как документы из набора 214 цифровых документов (описано выше со ссылкой на фиг. 3 и 5), подобно первому этапу обучения.

[0124] После обучения алгоритма 218 MLA сервер 202 может использовать его для определения соответствующих значений вероятности взаимодействия пользователя 216 с каждым документом из набора 214 цифровых документов путем подготовки их в наборе этапа использования цифровых объектов, как описано выше, и предоставления этого набора этапа использования цифровых объектов алгоритму 218 MLA.

[0125] Кроме того, сервер 202 может использовать соответствующие значения вероятности для ранжирования каждого документа из набора 214 цифровых документов. С этой целью в некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии сервер 202 может предоставлять соответствующие значения вероятности, определенные алгоритмом 218 MLA, в качестве входных данных другому алгоритму MLA (не показан), способному ранжировать цифровые документы на основе по меньшей мере значений вероятности взаимодействия с ними пользователя, такого как пользователь 216. В некоторых не имеющих ограничительного характера вариантах осуществления настоящей технологии другой алгоритм MLA может включать в себя ансамбль деревьев решений CatBoost, как описано выше.

[0126] Кроме того, сервер 202 может выбирать N цифровых документов с наибольшим рангом из ранжированного набора цифровых документов для отправки указаний на них электронному устройству 204 пользователя 216, например, через соответствующий клиентский интерфейс (не показан) интерактивной поисковой платформы 210.

[0127] Таким образом, некоторые не имеющие ограничительного характера варианты осуществления способа 600 позволяют повысить качество персонализированного ранжирования цифровых документов.

[0128] На этом выполнение способа 600 завершается.

[0129] Должно быть понятно, что несмотря на описание представленных здесь вариантов осуществления изобретения со ссылкой на конкретные признаки и структуры, без выхода за границы таких технологий могут быть реализованы их различные модификации и сочетания. Например, различные оптимизации, применяемые в нейронных сетях, включая трансформеры и/или модель BERT, могут подобным образом применяться и в настоящей технологии. Кроме того, могут применяться оптимизации, ускоряющие определение релевантности на этапе использования. Например, в некоторых вариантах осуществления изобретения трансформерная модель может быть разделена так, что некоторые блоки трансформеров разделены между обработкой запроса и обработкой документа, поэтому представления документов могут быть предварительно рассчитаны в автономном режиме и сохранены в индексе поиска документов. Описание и чертежи следует рассматривать лишь как иллюстрацию обсуждаемых вариантов реализации или осуществления изобретения, принципы которого определены приложенной формулой изобретения, которая охватывает все модификации, изменения, сочетания и эквиваленты в пределах объема настоящего изобретения.

| название | год | авторы | номер документа |

|---|---|---|---|

| СИСТЕМА И СПОСОБ ОБУЧЕНИЯ МОДЕЛЕЙ МАШИННОГО ОБУЧЕНИЯ ДЛЯ РАНЖИРОВАНИЯ РЕЗУЛЬТАТОВ ПОИСКА | 2023 |

|

RU2832419C2 |

| СПОСОБ И СИСТЕМА ДЛЯ ПРОВЕРКИ МЕДИАКОНТЕНТА | 2022 |

|

RU2815896C2 |

| СИСТЕМА И СПОСОБ ОБУЧЕНИЯ МОДЕЛЕЙ МАШИННОГО ОБУЧЕНИЯ ДЛЯ РАНЖИРОВАНИЯ РЕЗУЛЬТАТОВ ПОИСКА | 2023 |

|

RU2829065C1 |

| Система и способ для формирования обучающего набора для алгоритма машинного обучения | 2020 |

|

RU2790033C2 |

| СПОСОБ И СЕРВЕР ДЛЯ ПОВТОРНОГО ОБУЧЕНИЯ АЛГОРИТМА МАШИННОГО ОБУЧЕНИЯ | 2019 |

|

RU2743932C2 |

| Система и способ формирования обучающего набора для алгоритма машинного обучения | 2018 |

|

RU2744029C1 |

| СПОСОБЫ И СЕРВЕРЫ ДЛЯ ОПРЕДЕЛЕНИЯ ЗАВИСЯЩИХ ОТ МЕТРИКИ ПОРОГОВ, ИСПОЛЬЗУЕМЫХ СО МНОЖЕСТВОМ ВЛОЖЕННЫХ МЕТРИК ДЛЯ БИНАРНОЙ КЛАССИФИКАЦИИ ЦИФРОВОГО ОБЪЕКТА | 2020 |

|

RU2795202C2 |

| СПОСОБ И СЕРВЕР ДЛЯ ОБУЧЕНИЯ АЛГОРИТМА МАШИННОГО ОБУЧЕНИЯ РАНЖИРОВАНИЮ ОБЪЕКТОВ | 2020 |

|

RU2782502C1 |

| СПОСОБ И СЕРВЕР ДЛЯ ОБУЧЕНИЯ НЕЙРОННОЙ СЕТИ ФОРМИРОВАНИЮ ТЕКСТОВОЙ ВЫХОДНОЙ ПОСЛЕДОВАТЕЛЬНОСТИ | 2020 |

|

RU2798362C2 |

| СПОСОБ И СИСТЕМА ДЛЯ РАСШИРЕНИЯ ПОИСКОВЫХ ЗАПРОСОВ С ЦЕЛЬЮ РАНЖИРОВАНИЯ РЕЗУЛЬТАТОВ ПОИСКА | 2018 |

|

RU2720905C2 |

Настоящая технология относится к способам машинного обучения, в частности к способам и системам для обучения и использования моделей машинного обучения на основе трансформера для ранжирования результатов поиска. Способ включает в себя обучение алгоритма MLA на первом этапе определению прошлых взаимодействий пользователя с прошлыми цифровыми документами на основе первого набора обучающих объектов, содержащих прошлые цифровые документы, определенные интерактивной поисковой платформой в ответ на отправку ей пользователем соответствующих прошлых запросов. Способ также включает в себя обучение алгоритма MLA на втором этапе определению значений вероятности взаимодействия пользователя с цифровыми документами этапа использования на основе второго набора обучающих объектов, содержащих только прошлые цифровые документы, с которыми взаимодействовал пользователь, и связанные с ними прошлые запросы. Технический результат заключается в обеспечении более эффективного обучения модели обучения с использованием ограниченного объема обучающих данных на основе трансформера ранжирования результатов поиска, а также повышается качество прогнозирования релевантности результата поиска для конкретного пользователя, т.е. улучшается персонализированное ранжирование. 3 н. и 13 з.п. ф-лы, 6 ил.

1. Компьютерный способ обучения алгоритма машинного обучения (MLA) определению релевантности цифрового документа этапа использования запросу пользователя на интерактивной поисковой платформе, выполняемый процессором и включающий в себя:

- получение процессором обучающих данных, связанных с пользователем и содержащих (а) множество прошлых запросов, отправленных пользователем интерактивной поисковой платформе, и (б) наборы прошлых цифровых документов, сформированные интерактивной поисковой платформой в ответ на отправку ей запросов из множества прошлых запросов, при этом прошлый цифровой документ содержит параметр прошлых взаимодействий пользователя, указывающий на то, взаимодействовал ли пользователь с прошлым цифровым документом, причём параметр прошлых взаимодействий пользователя определяется на основе данных о прошлых «кликах» пользователя на прошлом цифровом документе, сделанных после отправки прошлого запроса интерактивной поисковой платформе, причём упомянутые данные о прошлых «кликах» пользователя приняты интерактивной поисковой платформой от связанного с пользователем электронного устройства через сеть связи;

на первом этапе обучения:

- подготовку процессором обучающих данных в первом наборе обучающих цифровых объектов, каждый из которых содержит (а) прошлый запрос из множества прошлых запросов и (б) заранее заданное количество прошлых цифровых документов, соответствующих прошлому запросу; и